JP6690649B2 - 情報処理装置、情報処理方法、およびプログラム - Google Patents

情報処理装置、情報処理方法、およびプログラム Download PDFInfo

- Publication number

- JP6690649B2 JP6690649B2 JP2017539715A JP2017539715A JP6690649B2 JP 6690649 B2 JP6690649 B2 JP 6690649B2 JP 2017539715 A JP2017539715 A JP 2017539715A JP 2017539715 A JP2017539715 A JP 2017539715A JP 6690649 B2 JP6690649 B2 JP 6690649B2

- Authority

- JP

- Japan

- Prior art keywords

- vehicle

- information

- user

- evaluation

- information processing

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/09—Arrangements for giving variable traffic instructions

- G08G1/0962—Arrangements for giving variable traffic instructions having an indicator mounted inside the vehicle, e.g. giving voice messages

- G08G1/0965—Arrangements for giving variable traffic instructions having an indicator mounted inside the vehicle, e.g. giving voice messages responding to signals from another vehicle, e.g. emergency vehicle

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/0104—Measuring and analyzing of parameters relative to traffic conditions

- G08G1/0108—Measuring and analyzing of parameters relative to traffic conditions based on the source of data

- G08G1/0112—Measuring and analyzing of parameters relative to traffic conditions based on the source of data from the vehicle, e.g. floating car data [FCD]

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/0104—Measuring and analyzing of parameters relative to traffic conditions

- G08G1/0125—Traffic data processing

- G08G1/0129—Traffic data processing for creating historical data or processing based on historical data

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/04—Detecting movement of traffic to be counted or controlled using optical or ultrasonic detectors

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/09—Arrangements for giving variable traffic instructions

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/09—Arrangements for giving variable traffic instructions

- G08G1/0962—Arrangements for giving variable traffic instructions having an indicator mounted inside the vehicle, e.g. giving voice messages

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R21/00—Arrangements or fittings on vehicles for protecting or preventing injuries to occupants or pedestrians in case of accidents or other traffic risks

Description

1.本開示の一実施形態による情報処理システムの概要

2.構成

2−1.基本構成

2−2.詳細構成

3.各実施形態

3−1.第1の実施形態

3−2.第2の実施形態

3−3.第3の実施形態

3−4.第4の実施形態

3−5.第5の実施形態

3−6.第6の実施形態

4.補足

5.ハードウェア構成例

5−1.車両制御システムの構成例

5−2.情報処理装置の構成例

5−3.その他

6.まとめ

本開示の一実施形態による情報処理システムは、対象車両に対するユーザ評価に関する情報を効果的に利用することで、例えば運転マナーの向上や、事故の未然防止、快適な走行等を支援する。図1は、本開示の一実施形態による情報処理システムの概要について説明する図である。図示された例では、車両10A、車両10B、および車両10Cが、周辺に存在する他車両と信号の送受信が可能な車車間通信機能を有している。

次に、上述した情報処理システムを実現する情報処理装置100の構成について、図2および図3を参照して説明する。情報処理装置100は、例えば車両10A、10B、10C等の移動体に搭載され得る。若しくは、情報処理装置100は、車両10に持ち込まれるスマートフォン、タブレット端末、携帯電話端末、PC(パーソナルコンピュータ)等に搭載され得る。

図2は、本実施形態による情報処理装置100の基本構成の一例を示す図である。図2に示すように、情報処理装置100は、制御部110、通信部120、入力部130、出力部140、および記憶部150を含む。

図3は、本実施形態による情報処理装置100の詳細構成の一例を示す図である。図3に示すように、情報処理装置100は、車載機器1301、センサ1302、操作入力部1303、マイクロホン1304、車車間通信部1201、路車間通信部1202、ネットワークI/F(interface)部1203、認識部1101、ユーザ評価取得部1102、通知情報生成部1103、通知制御部1104、推定部1105、表示部1401、およびスピーカ1402を含む。

<3−1.第1の実施形態>

まず、図5〜図10を参照して第1の実施形態による情報処理システムについて説明する。第1の実施形態では、他車両への評価処理、および各車両に蓄積された評価情報の活用について説明する。

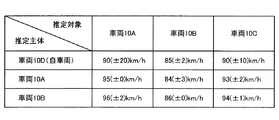

続いて、図11〜図16を参照して第2の実施形態による情報処理システムについて説明する。第2の実施形態では、他車両の速度情報の活用について説明する。

次に、図17〜図20を参照して第3の実施形態による情報処理システムについて説明する。第3の実施形態では、他車両の加減速に関する情報の活用について説明する。

続いて、図21〜図24を参照して第4の実施形態による情報処理システムについて説明する。第4の実施形態では、他車両が自車両を認識しているか否か(他車両の自車両への気付き)に関する情報の活用について説明する。

次に、図25〜図27を参照して第5の実施形態による情報処理システムについて説明する。第5の実施形態では、他車両から取得した種々の情報に基づくユーザ車両の走行予測結果や警告の通知について説明する。

続いて、図28〜図32を参照して第6の実施形態による情報処理システムについて説明する。第6の実施形態では、車両の情報をネットワークを介して他者に公開して活用する場合について説明する。

以上説明した各実施形態について以下補足する。

本開示に係る技術は、様々な製品へ応用可能である。例えば、情報処理装置100は、自動車、電気自動車、ハイブリッド電気自動車、自動二輪車などのいずれかの種類の車両に搭載される装置として実現されてもよい。また、情報処理装置100の少なくとも一部の構成要素は、車両に搭載される装置のためのモジュール(例えば、1つのダイで構成される集積回路モジュール)において実現されてもよい。

図33は、本開示に係る技術が適用され得る車両制御システム900の概略的な構成の一例を示すブロック図である。車両制御システム900は、電子制御ユニット902、ストレージ装置904、入力装置906、車外センサ908、車両状態センサ910、搭乗者センサ912、通信IF914、出力装置916、動力生成装置918、制動装置920、ステアリング922及びランプ作動装置924を備える。

図34は、本実施形態に係る情報処理装置のハードウェア構成の一例を示すブロック図である。なお、図34に示す情報処理装置1000は、例えば、図28に示した管理サーバ4を実現し得る。本実施形態に係る管理サーバ28による情報処理は、ソフトウェアと、以下に説明するハードウェアとの協働により実現される。

以上、本実施形態に係る情報処理装置100又は管理サーバ28の機能を実現可能なハードウェア構成の一例を示した。上記の各構成要素は、汎用的な部材を用いて実現されていてもよいし、各構成要素の機能に特化したハードウェアにより実現されていてもよい。従って、本実施形態を実施する時々の技術レベルに応じて、適宜、利用するハードウェア構成を変更することが可能である。

以上、図1〜図34を参照して、本開示の一実施形態について詳細に説明した。上述したように、本開示の実施形態による情報処理システムでは、対象車両に対するユーザ評価に関する情報を効果的に利用することが可能となる。

(1)

ユーザの環境情報から対象車両の情報を自動的に認識する認識部と、

前記認識した対象車両に対するユーザ評価を取得する取得部と、

前記取得したユーザ評価を通知するための情報を生成する生成部と、

を備える、情報処理装置。

(2)

前記認識部は、ユーザ車両に設けられたセンサからの情報に基づいて前記対象車両を認識し、

前記情報処理装置は、

前記認識部で認識された対象車両に関する他ユーザからの評価に関する情報を取得する他ユーザ評価取得部と、

前記取得した所定の情報をユーザ車両においてユーザに通知するよう制御する通知制御部と、をさらに備える、前記(1)に記載の情報処理装置。

(3)

前記他ユーザ評価取得部は、車車間通信により前記対象車両から受信した情報を取得する、前記(2)に記載の情報処理装置。

(4)

前記生成部により生成された情報は、評価者、被評価者、および周辺の第三者のうち少なくともいずれかに通知される、前記(2)または(3)に記載の情報処理装置。

(5)

前記認識部は、ユーザの環境情報に含まれる、視線情報、周辺情報、ユーザ車両と周囲の車両との位置関係、ユーザの集中度、ユーザ車両の走行状況、またはユーザの発話内容に基づいて、ユーザ評価対象となる対象車両を自動的に認識する、前記(2)〜(4)のいずれか1項に記載の情報処理装置。

(6)

前記取得部は、ユーザによる操作入力、音声入力、または運転操作に基づくユーザ評価を取得する、前記(2)〜(5)のいずれか1項に記載の情報処理装置。

(7)

前記通知制御部は、車内に設けられたユーザにより視認可能な表示装置または音声出力装置から通知するよう制御する、前記(2)〜(6)のいずれか1項に記載の情報処理装置。

(8)

前記情報処理装置は、

現在運転者に前記認識された対象車両に関するどのような情報を通知すべきかを推定する推定部と、

前記推定部による推定された情報を前記対象車両から取得するよう制御する取得制御部と、をさらに備える、前記(2)〜(7)のいずれか1項に記載の情報処理装置。

(9)

前記対象車両から取得する情報は、前記対象車両に対する他ユーザからの評価に関する情報、前記対象車両の速度情報、前記対象車両の加減速情報、前記対象車両におけるユーザ車両への認識情報、および前記対象車両の走行予測認識結果、プロファイルの少なくともいずれかである、前記(8)に記載の情報処理装置。

(10)

前記通知制御部は、前記対象車両から取得した情報を、車内に設けられた、ユーザにより視認可能な表示装置において前記対象車両に対応して視認されるよう表示制御する、前記(8)に記載の情報処理装置。

(11)

前記通知制御部は、前記対象車両から取得した情報に基づいて、ユーザへの警告を行うよう制御する、前記(9)または(10)に記載の情報処理装置。

(12)

前記通知制御部は、前記対象車両から取得した情報に基づいて、ユーザ車両の走行予測結果を通知するよう制御する、前記(9)〜(11)のいずれか1項に記載の情報処理装置。

(13)

前記通知制御部は、前記対象車両へ行った評価内容、他ユーザからユーザ車両に対して行われた評価内容、または他ユーザから他車両へ行われた評価内容を、リアルタイムでユーザに通知するよう制御する、前記(2)〜(12)のいずれか1項に記載の情報処理装置。

(14)

前記情報処理装置は、ユーザ車両の運転状況をネットワーク上のサーバへ送信するよう制御する送信制御部をさらに備える、前記(2)〜(13)のいずれか1項に記載の情報処理装置。

(15)

前記取得部は、歩行者または自転車運転者による対象車両に対するユーザ評価を取得する、前記(2)に記載の情報処理装置。

(16)

前記生成部は、前記対象車両に関する情報またはユーザの環境情報の少なくともいずれかに基づいて、前記ユーザに対して評価を求める通知を行うための情報を生成する、前記(2)〜(15)のいずれか1項に記載の情報処理装置。

(17)

前記生成部は、前記対象車両に関する情報またはユーザの環境情報の少なくともいずれかに基づいて、前記ユーザ評価の理由を生成する、前記(2)〜(16)のいずれか1項に記載の情報処理装置。

(18)

プロセッサが、

ユーザの環境情報から対象車両の情報を自動的に認識することと、

前記認識した対象車両に対するユーザ評価を取得することと、

前記取得したユーザ評価を通知するための情報を生成することと、

を含む、情報処理方法。

(19)

コンピュータを、

ユーザの環境情報から対象車両の情報を自動的に認識する認識部と、

前記認識した対象車両に対するユーザ評価を取得する取得部と、

前記取得したユーザ評価を通知するための情報を生成する生成部と、

として機能させるための、プログラム。

110 制御部

1101 認識部

1102 ユーザ評価取得部

1103 通知情報生成部

1104 通知制御部

120 通信部

1201 車車間通信部

1202 路車間通信部

1203 ネットワークI/F部

130 入力部

1301 車載機器

1302 センサ

1303 操作入力部

1304 マイクロホン

140 出力部

1401 表示部

1402 スピーカ

150 記憶部

10 車両

4 管理サーバ

Claims (18)

- ユーザ車両に設けられたセンサから取得されたセンサ情報に基づいて対象車両を認識する認識部と、

前記対象車両に対するユーザ評価情報を取得する取得部と、

前記ユーザ評価情報を通知するための通知情報を生成する生成部と、

前記認識部で認識された前記対象車両に関する他ユーザからの評価に関する他ユーザ評価情報を取得する他ユーザ評価取得部と、

前記他ユーザ評価情報を、前記ユーザ車両においてユーザに通知するよう制御する通知制御部と、

を備える、情報処理装置。 - 前記他ユーザ評価取得部は、車車間通信により前記対象車両から受信した情報を取得する、請求項1に記載の情報処理装置。

- 前記通知情報は、評価者、被評価者、および周辺の第三者のうち少なくともいずれかに通知される、請求項1または2に記載の情報処理装置。

- 前記認識部は、視線情報、周辺情報、前記ユーザ車両と周囲の車両との位置関係、ユーザの集中度、前記ユーザ車両の走行状況、またはユーザの発話内容に基づいて、ユーザ評価対象となる前記対象車両を自動的に認識する、請求項1〜3のいずれか1項に記載の情報処理装置。

- 前記取得部は、ユーザによる操作入力、音声入力、または運転操作に基づくユーザ評価情報を取得する、請求項1〜4のいずれか1項に記載の情報処理装置。

- 前記通知制御部は、車内に設けられた、ユーザにより視認可能な表示装置または音声出力装置から通知するよう制御する、請求項1〜5のいずれか1項に記載の情報処理装置。

- 前記情報処理装置は、

現在運転者に認識された前記対象車両に関するどのような情報を通知すべきかを推定する推定部と、

前記推定部による推定された情報を前記対象車両から取得するよう制御する取得制御部と、

をさらに備える、請求項1〜6のいずれか1項に記載の情報処理装置。 - 前記対象車両から取得する情報は、前記対象車両に対する他ユーザからの評価に関する情報、前記対象車両の速度情報、前記対象車両の加減速情報、前記対象車両における前記ユーザ車両への認識情報、および前記対象車両の走行予測認識結果、プロファイルの少なくともいずれかである、請求項7に記載の情報処理装置。

- 前記通知制御部は、前記対象車両から取得した情報を、車内に設けられた、ユーザにより視認可能な表示装置において前記対象車両に対応して視認されるよう表示制御する、請求項7に記載の情報処理装置。

- 前記通知制御部は、前記対象車両から取得した情報に基づいて、ユーザへの警告を行うよう制御する、請求項8または9に記載の情報処理装置。

- 前記通知制御部は、前記対象車両から取得した情報に基づいて、前記ユーザ車両の走行予測結果を通知するよう制御する、請求項8〜10のいずれか1項に記載の情報処理装置。

- 前記通知制御部は、前記対象車両へ行った評価内容、前記他ユーザから前記ユーザ車両に対して行われた評価内容、または前記他ユーザから他車両へ行われた評価内容を、リアルタイムで前記ユーザに通知するよう制御する、請求項1〜11のいずれか1項に記載の情報処理装置。

- 前記情報処理装置は、前記ユーザ車両の運転状況をネットワーク上のサーバへ送信するよう制御する送信制御部をさらに備える、請求項1〜12のいずれか1項に記載の情報処理装置。

- 前記取得部は、歩行者または自転車運転者による前記対象車両に対するユーザ評価情報を取得する、請求項1〜13のいずれか1項に記載の情報処理装置。

- 前記生成部は、前記対象車両に関する情報またはユーザの環境情報の少なくともいずれかに基づいて、前記ユーザに対して評価を求める通知を行うための情報を生成する、請求項1〜14のいずれか1項に記載の情報処理装置。

- 前記生成部は、前記対象車両に関する情報またはユーザの環境情報の少なくともいずれかに基づいて、前記ユーザ評価情報の理由を生成する、請求項1〜15のいずれか1項に記載の情報処理装置。

- プロセッサが、

ユーザ車両に設けられたセンサから取得されたセンサ情報に基づいて対象車両を認識することと、

前記対象車両に対するユーザ評価情報を取得することと、

前記ユーザ評価情報を通知するための通知情報を生成することと、

前記対象車両に関する他ユーザからの評価に関する他ユーザ評価情報を取得することと、

前記他ユーザ評価情報を、前記ユーザ車両においてユーザに通知するよう制御することと、

を含む、情報処理方法。 - コンピュータを、

ユーザ車両に設けられたセンサから取得されたセンサ情報に基づいて対象車両を認識する認識部と、

前記対象車両に対するユーザ評価情報を取得する取得部と、

前記ユーザ評価情報を通知するための通知情報を生成する生成部と、

前記認識部で認識された前記対象車両に関する他ユーザからの評価に関する他ユーザ評価情報を取得する他ユーザ評価取得部と、

前記他ユーザ評価情報を、前記ユーザ車両においてユーザに通知するよう制御する通知制御部と、

として機能させるための、プログラム。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015185362 | 2015-09-18 | ||

| JP2015185362 | 2015-09-18 | ||

| PCT/JP2016/067568 WO2017047176A1 (ja) | 2015-09-18 | 2016-06-13 | 情報処理装置、情報処理方法、およびプログラム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JPWO2017047176A1 JPWO2017047176A1 (ja) | 2018-06-28 |

| JP6690649B2 true JP6690649B2 (ja) | 2020-04-28 |

Family

ID=58288657

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2017539715A Active JP6690649B2 (ja) | 2015-09-18 | 2016-06-13 | 情報処理装置、情報処理方法、およびプログラム |

Country Status (5)

| Country | Link |

|---|---|

| US (2) | US10380888B2 (ja) |

| EP (1) | EP3352154A4 (ja) |

| JP (1) | JP6690649B2 (ja) |

| CN (1) | CN108028015B (ja) |

| WO (1) | WO2017047176A1 (ja) |

Families Citing this family (55)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6635428B2 (ja) * | 2015-05-20 | 2020-01-22 | 修一 田山 | 自動車周辺情報表示システム |

| WO2017047176A1 (ja) * | 2015-09-18 | 2017-03-23 | ソニー株式会社 | 情報処理装置、情報処理方法、およびプログラム |

| JP6623657B2 (ja) * | 2015-10-05 | 2019-12-25 | 日産自動車株式会社 | 情報提供装置、情報提供システム及び情報提供方法 |

| US10479373B2 (en) * | 2016-01-06 | 2019-11-19 | GM Global Technology Operations LLC | Determining driver intention at traffic intersections for automotive crash avoidance |

| JP6650635B2 (ja) * | 2016-02-29 | 2020-02-19 | パナソニックIpマネジメント株式会社 | 判定装置、判定方法、および判定プログラム |

| JP6748206B2 (ja) * | 2016-07-12 | 2020-08-26 | 本田技研工業株式会社 | 運転支援装置 |

| US9919648B1 (en) | 2016-09-27 | 2018-03-20 | Robert D. Pedersen | Motor vehicle artificial intelligence expert system dangerous driving warning and control system and method |

| WO2018225178A1 (ja) * | 2017-06-07 | 2018-12-13 | 三菱電機株式会社 | 危険車両予測装置、危険車両警報システムおよび危険車両予測方法 |

| KR101973627B1 (ko) * | 2017-07-11 | 2019-04-29 | 엘지전자 주식회사 | 차량에 구비된 차량 제어 장치 및 차량의 제어방법 |

| JP7188389B2 (ja) * | 2017-08-23 | 2022-12-13 | ソニーグループ株式会社 | 情報処理装置、情報処理システム、および情報処理方法、並びにプログラム |

| US11315415B2 (en) * | 2017-09-03 | 2022-04-26 | Innovart Design Inc. | Information sharing system and information sharing method for vehicle |

| KR102029906B1 (ko) * | 2017-11-10 | 2019-11-08 | 전자부품연구원 | 이동수단의 가상현실 콘텐츠 제공 장치 및 방법 |

| US20190161007A1 (en) * | 2017-11-29 | 2019-05-30 | GM Global Technology Operations LLC | Unilluminated vehicle indication based on communication |

| JP7043845B2 (ja) * | 2018-01-17 | 2022-03-30 | トヨタ自動車株式会社 | 車両用表示連携制御装置 |

| JP6894857B2 (ja) * | 2018-01-26 | 2021-06-30 | Kddi株式会社 | 周辺走行中の被観測車両の運転特性を推定するプログラム、装置及び方法 |

| JP7003689B2 (ja) * | 2018-01-29 | 2022-01-20 | トヨタ自動車株式会社 | 制御装置およびエージェント連携方法 |

| USD914734S1 (en) * | 2018-02-05 | 2021-03-30 | St Engineering Land Systems Ltd | Display screen or portion thereof with graphical user interface |

| JP7134649B2 (ja) * | 2018-03-08 | 2022-09-12 | 東芝デジタルソリューションズ株式会社 | 隊列走行運用システムおよび隊列走行運用方法 |

| CN108284838A (zh) * | 2018-03-27 | 2018-07-17 | 杭州欧镭激光技术有限公司 | 一种用于检测车辆外部环境信息的检测系统及检测方法 |

| US10957188B2 (en) * | 2018-04-04 | 2021-03-23 | Toyota Motor Engineering & Manufacturing North America, Inc. | Systems and methods for determining traffic flow using observations of surrounding vehicles |

| JP7006527B2 (ja) | 2018-07-09 | 2022-01-24 | トヨタ自動車株式会社 | 車載装置および車両捜索システム |

| CN108924624B (zh) * | 2018-08-03 | 2021-08-31 | 百度在线网络技术(北京)有限公司 | 信息处理方法和装置 |

| JP7192398B2 (ja) * | 2018-10-31 | 2022-12-20 | トヨタ自動車株式会社 | 情報処理装置、情報処理システム、プログラム、および情報処理方法 |

| CN111161554A (zh) * | 2018-11-07 | 2020-05-15 | 北京宝沃汽车有限公司 | 信息发送的方法和装置 |

| JP7206854B2 (ja) * | 2018-11-29 | 2023-01-18 | トヨタ自動車株式会社 | 情報提供システム、サーバ、携帯端末、プログラム及び情報提供方法 |

| JP2020101869A (ja) * | 2018-12-19 | 2020-07-02 | 本田技研工業株式会社 | 制御装置及びプログラム |

| WO2020148854A1 (ja) * | 2019-01-17 | 2020-07-23 | 三菱電機株式会社 | 情報処理装置、および情報処理システム |

| US11423779B2 (en) | 2019-02-15 | 2022-08-23 | Ford Global Technologies, Llc | Vehicle detection systems and methods |

| JP7088076B2 (ja) * | 2019-02-25 | 2022-06-21 | トヨタ自動車株式会社 | 情報処理システム、プログラム、及び制御方法 |

| CN109801508B (zh) * | 2019-02-26 | 2021-06-04 | 百度在线网络技术(北京)有限公司 | 路口处障碍物的运动轨迹预测方法及装置 |

| US10933317B2 (en) | 2019-03-15 | 2021-03-02 | Sony Interactive Entertainment LLC. | Near real-time augmented reality video gaming system |

| CN111756783B (zh) * | 2019-03-29 | 2021-11-12 | 比亚迪股份有限公司 | 终端的信息推送方法、服务器和终端的信息推送系统 |

| WO2020208696A1 (ja) * | 2019-04-09 | 2020-10-15 | 三菱電機株式会社 | 情報記録制御装置および情報記録制御方法 |

| US10839682B1 (en) * | 2019-04-26 | 2020-11-17 | Blackberry Limited | Method and system for traffic behavior detection and warnings |

| US11403949B2 (en) * | 2019-05-09 | 2022-08-02 | Hitachi Astemo, Ltd. | System for predicting vehicle behavior |

| CN113784861B (zh) * | 2019-05-15 | 2023-01-17 | 日产自动车株式会社 | 显示控制方法及显示控制装置 |

| US11001200B2 (en) * | 2019-05-30 | 2021-05-11 | Nissan North America, Inc. | Vehicle occupant warning system |

| JP6969803B2 (ja) * | 2019-05-31 | 2021-11-24 | Necプラットフォームズ株式会社 | 運転マナー評価提示装置、運転マナー評価提示方法、運転マナー評価システム、および運転マナー評価提示プログラム |

| US20210061276A1 (en) * | 2019-08-27 | 2021-03-04 | GM Global Technology Operations LLC | Systems and methods for vehicle operator intention prediction using eye-movement data |

| US11603098B2 (en) * | 2019-08-27 | 2023-03-14 | GM Global Technology Operations LLC | Systems and methods for eye-tracking data collection and sharing |

| DE112019007681T5 (de) * | 2019-09-02 | 2022-06-09 | Mitsubishi Electric Corporation | Automatische Fahrsteuerungsvorrichtung und automatisches Fahrsteuerungsverfahren |

| USD948552S1 (en) * | 2019-09-06 | 2022-04-12 | Kubota Corporation | Display screen for tractor with graphical user interface |

| KR20220077125A (ko) * | 2019-10-09 | 2022-06-08 | 소니그룹주식회사 | 정보 처리 장치, 및 정보 처리 시스템, 그리고 정보 처리 방법 |

| JP7268581B2 (ja) * | 2019-11-07 | 2023-05-08 | トヨタ自動車株式会社 | 車両、音響制御装置、及び音響制御プログラム |

| WO2021111753A1 (ja) * | 2019-12-05 | 2021-06-10 | ソニーグループ株式会社 | 情報処理装置、および情報処理方法、並びにプログラム |

| US20230104858A1 (en) * | 2020-03-19 | 2023-04-06 | Nec Corporation | Image generation apparatus, image generation method, and non-transitory computer-readable medium |

| US11555711B2 (en) * | 2020-04-11 | 2023-01-17 | Harman Becker Automotive Systems Gmbh | Systems and methods for augmented reality in a vehicle |

| JP7463896B2 (ja) | 2020-07-30 | 2024-04-09 | 株式会社デンソー | 運転支援装置、運転支援プログラム、運転訓練プログラム及び情報管理プログラム |

| DE102020210238A1 (de) | 2020-08-12 | 2022-02-17 | Robert Bosch Gesellschaft mit beschränkter Haftung | Verfahren zum Warnen von Verkehrsteilnehmern mit einer Umfeldüberwachung eines in Betrieb befindlichen Fahrzeugs und Vorrichtung zur Ausführung des Verfahrens |

| JP7170076B2 (ja) * | 2020-10-28 | 2022-11-11 | 株式会社日本総合研究所 | 情報処理方法及び情報処理システム |

| JPWO2022102374A1 (ja) * | 2020-11-16 | 2022-05-19 | ||

| JP2022181692A (ja) * | 2021-05-26 | 2022-12-08 | 株式会社デンソー | 車両用制御装置及び車両用制御方法 |

| US11830489B2 (en) | 2021-06-30 | 2023-11-28 | Bank Of America Corporation | System and method for speech processing based on response content |

| CN114248806A (zh) * | 2022-01-13 | 2022-03-29 | 云控智行科技有限公司 | 一种无人车驾驶控制方法、装置及电子设备 |

| CN115624008B (zh) * | 2022-07-08 | 2023-09-05 | 珠海科艺普检测科技有限公司 | 一种基于生物信息技术的大口黑鲈鱼的鱼苗智能检测方法 |

Family Cites Families (17)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2001034897A (ja) * | 1999-07-21 | 2001-02-09 | Toyota Central Res & Dev Lab Inc | 運転支援システム |

| US7639841B2 (en) * | 2004-12-20 | 2009-12-29 | Siemens Corporation | System and method for on-road detection of a vehicle using knowledge fusion |

| JP4655730B2 (ja) * | 2005-04-07 | 2011-03-23 | トヨタ自動車株式会社 | 車両用運転支援装置 |

| JP2008126954A (ja) * | 2006-11-24 | 2008-06-05 | Tokai Rika Co Ltd | 意思伝達装置 |

| US8818725B2 (en) * | 2011-11-16 | 2014-08-26 | Flextronics Ap, Llc | Location information exchange between vehicle and device |

| JP2012150557A (ja) | 2011-01-17 | 2012-08-09 | Toyota Central R&D Labs Inc | 運転マナー啓発装置、システム、及びプログラム |

| JP5621682B2 (ja) | 2011-03-29 | 2014-11-12 | 株式会社デンソー | 車載用情報提示装置 |

| JP2012252407A (ja) * | 2011-05-31 | 2012-12-20 | Nissan Motor Co Ltd | 車両用通行支援装置及び車両用通行支援方法 |

| JP5974498B2 (ja) | 2012-01-24 | 2016-08-23 | 株式会社デンソー | 車車間通信装置 |

| JP6033838B2 (ja) * | 2012-02-27 | 2016-11-30 | ヤマハ発動機株式会社 | 運転状態共有装置および運転状態共有システム |

| US9536361B2 (en) * | 2012-03-14 | 2017-01-03 | Autoconnect Holdings Llc | Universal vehicle notification system |

| DE102012014457A1 (de) * | 2012-07-21 | 2014-01-23 | Audi Ag | Verfahren zum Betreiben eines Kraftfahrzeugs und Kraftfahrzeug |

| US20140080098A1 (en) * | 2012-09-14 | 2014-03-20 | Hyundai Motor Company | System and method of evaluating and reporting the driving acuity and performance of a test subject |

| CN103198685B (zh) * | 2013-03-15 | 2016-04-13 | Tcl康钛汽车信息服务(深圳)有限公司 | 一种实现驾驶安全预警的方法、系统 |

| US20140322676A1 (en) * | 2013-04-26 | 2014-10-30 | Verizon Patent And Licensing Inc. | Method and system for providing driving quality feedback and automotive support |

| US10692370B2 (en) * | 2014-03-03 | 2020-06-23 | Inrix, Inc. | Traffic obstruction detection |

| WO2017047176A1 (ja) * | 2015-09-18 | 2017-03-23 | ソニー株式会社 | 情報処理装置、情報処理方法、およびプログラム |

-

2016

- 2016-06-13 WO PCT/JP2016/067568 patent/WO2017047176A1/ja active Application Filing

- 2016-06-13 EP EP16846049.1A patent/EP3352154A4/en not_active Ceased

- 2016-06-13 CN CN201680052582.5A patent/CN108028015B/zh active Active

- 2016-06-13 JP JP2017539715A patent/JP6690649B2/ja active Active

- 2016-06-13 US US15/750,384 patent/US10380888B2/en active Active

-

2019

- 2019-07-09 US US16/505,721 patent/US10699569B2/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| US20180225963A1 (en) | 2018-08-09 |

| EP3352154A1 (en) | 2018-07-25 |

| JPWO2017047176A1 (ja) | 2018-06-28 |

| US10699569B2 (en) | 2020-06-30 |

| US10380888B2 (en) | 2019-08-13 |

| CN108028015B (zh) | 2021-07-23 |

| EP3352154A4 (en) | 2019-08-07 |

| WO2017047176A1 (ja) | 2017-03-23 |

| CN108028015A (zh) | 2018-05-11 |

| US20190333380A1 (en) | 2019-10-31 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6690649B2 (ja) | 情報処理装置、情報処理方法、およびプログラム | |

| JP7399075B2 (ja) | 情報処理装置、情報処理方法及びプログラム | |

| JP7371671B2 (ja) | 車両に安全に追い付けるように運転を支援するシステムおよび方法 | |

| JP7003660B2 (ja) | 情報処理装置、情報処理方法及びプログラム | |

| JP2022009112A (ja) | 情報処理装置、端末装置、情報処理方法、プログラム、および情報処理システム | |

| US11873007B2 (en) | Information processing apparatus, information processing method, and program | |

| JP2018041328A (ja) | 車両用情報提示装置 | |

| JP2019079363A (ja) | 車両制御装置 | |

| JP2018097479A (ja) | 運転支援装置、運転支援方法、運転支援プログラム、及び運転支援システム | |

| CN112789205A (zh) | 针对自动驾驶车辆检测队列并对队列进行响应 | |

| JP2014085900A (ja) | 車載装置 | |

| JP2012256138A (ja) | 携帯端末装置およびこれを備えた運転評価システム | |

| JP2012103849A (ja) | 情報提供装置 | |

| JP2019104354A (ja) | 情報処理方法及び情報処理装置 | |

| CN114572219B (zh) | 自动超车方法、装置、车辆、存储介质及芯片 | |

| WO2023132055A1 (ja) | 評価装置、評価方法、及びプログラム | |

| WO2022145286A1 (ja) | 情報処理装置、情報処理方法、プログラム、移動装置、及び、情報処理システム | |

| WO2024038759A1 (ja) | 情報処理装置、情報処理方法、及び、プログラム | |

| JP2023151659A (ja) | 交通安全支援システム | |

| JP2018097485A (ja) | 運転支援装置、運転支援方法、運転支援プログラム、及び運転支援システム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20190208 |

|

| RD03 | Notification of appointment of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7423 Effective date: 20190214 |

|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20190222 |

|

| RD02 | Notification of acceptance of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7422 Effective date: 20190515 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20190521 |

|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20190522 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20200107 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20200225 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20200310 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20200323 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 6690649 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |