RU2298294C2 - Интерактивная видеодисплейная система - Google Patents

Интерактивная видеодисплейная система Download PDFInfo

- Publication number

- RU2298294C2 RU2298294C2 RU2003137846/09A RU2003137846A RU2298294C2 RU 2298294 C2 RU2298294 C2 RU 2298294C2 RU 2003137846/09 A RU2003137846/09 A RU 2003137846/09A RU 2003137846 A RU2003137846 A RU 2003137846A RU 2298294 C2 RU2298294 C2 RU 2298294C2

- Authority

- RU

- Russia

- Prior art keywords

- image

- background

- processor

- virtual element

- influence

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G03—PHOTOGRAPHY; CINEMATOGRAPHY; ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ELECTROGRAPHY; HOLOGRAPHY

- G03B—APPARATUS OR ARRANGEMENTS FOR TAKING PHOTOGRAPHS OR FOR PROJECTING OR VIEWING THEM; APPARATUS OR ARRANGEMENTS EMPLOYING ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ACCESSORIES THEREFOR

- G03B21/00—Projectors or projection-type viewers; Accessories therefor

- G03B21/14—Details

- G03B21/26—Projecting separately subsidiary matter simultaneously with main image

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/011—Arrangements for interaction with the human body, e.g. for user immersion in virtual reality

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/041—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means

- G06F3/042—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means by opto-electronic means

- G06F3/0425—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means by opto-electronic means using a single imaging device like a video camera for tracking the absolute position of a single or a plurality of objects with respect to an imaged reference surface, e.g. video camera imaging a display or a projection screen, a table or a wall surface, on which a computer generated image is displayed or projected

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/56—Cameras or camera modules comprising electronic image sensors; Control thereof provided with illuminating means

-

- A—HUMAN NECESSITIES

- A63—SPORTS; GAMES; AMUSEMENTS

- A63F—CARD, BOARD, OR ROULETTE GAMES; INDOOR GAMES USING SMALL MOVING PLAYING BODIES; VIDEO GAMES; GAMES NOT OTHERWISE PROVIDED FOR

- A63F2300/00—Features of games using an electronically generated display having two or more dimensions, e.g. on a television screen, showing representations related to the game

- A63F2300/10—Features of games using an electronically generated display having two or more dimensions, e.g. on a television screen, showing representations related to the game characterized by input arrangements for converting player-generated signals into game device control signals

- A63F2300/1012—Features of games using an electronically generated display having two or more dimensions, e.g. on a television screen, showing representations related to the game characterized by input arrangements for converting player-generated signals into game device control signals involving biosensors worn by the player, e.g. for measuring heart beat, limb activity

-

- A—HUMAN NECESSITIES

- A63—SPORTS; GAMES; AMUSEMENTS

- A63F—CARD, BOARD, OR ROULETTE GAMES; INDOOR GAMES USING SMALL MOVING PLAYING BODIES; VIDEO GAMES; GAMES NOT OTHERWISE PROVIDED FOR

- A63F2300/00—Features of games using an electronically generated display having two or more dimensions, e.g. on a television screen, showing representations related to the game

- A63F2300/10—Features of games using an electronically generated display having two or more dimensions, e.g. on a television screen, showing representations related to the game characterized by input arrangements for converting player-generated signals into game device control signals

- A63F2300/1087—Features of games using an electronically generated display having two or more dimensions, e.g. on a television screen, showing representations related to the game characterized by input arrangements for converting player-generated signals into game device control signals comprising photodetecting means, e.g. a camera

- A63F2300/1093—Features of games using an electronically generated display having two or more dimensions, e.g. on a television screen, showing representations related to the game characterized by input arrangements for converting player-generated signals into game device control signals comprising photodetecting means, e.g. a camera using visible light

-

- A—HUMAN NECESSITIES

- A63—SPORTS; GAMES; AMUSEMENTS

- A63F—CARD, BOARD, OR ROULETTE GAMES; INDOOR GAMES USING SMALL MOVING PLAYING BODIES; VIDEO GAMES; GAMES NOT OTHERWISE PROVIDED FOR

- A63F2300/00—Features of games using an electronically generated display having two or more dimensions, e.g. on a television screen, showing representations related to the game

- A63F2300/60—Methods for processing data by generating or executing the game program

- A63F2300/69—Involving elements of the real world in the game world, e.g. measurement in live races, real video

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/30—Transforming light or analogous information into electric information

- H04N5/33—Transforming infrared radiation

Abstract

Устройство обеспечивает простое и необременительное взаимодействие между человеком и компьютерной дисплейной системой, использующей движение и положение человека (или другого объекта) в качестве входного сигнала компьютера. В некоторых конфигурациях отображение можно проецировать вокруг пользователя, так что действия человека отображаются вокруг него. Видеокамера и проектор работают на разных длинах волн, так что они не создают помех друг другу. Использование такого устройства включает, но не ограничивается этим, интерактивные эффекты освещения для людей в клубах или в событиях, интерактивное отображение рекламы и т.д. Созданные компьютером знаки и виртуальные объекты могут реагировать на движения прохожих, генерировать интерактивное окружающее освещение для помещений общего пользования, таких как рестораны, фойе и парки, системы видеоигр и создавать интерактивные информационные системы и художественные инсталляции. Можно использовать узорчатое освещение и яркость и градиент для улучшения способности обнаруживать объект на фоне видеоизображений. 5 н. и 71 з.п. ф-лы, 6 ил.

Description

Ссылки на родственные заявки

Данная заявка испрашивает на приоритет находящейся одновременно на рассмотрении временной заявки на патент США №60/296189, поданной 5 июня 2001 с названием "Интерактивная видеодисплейная система, которая использует видеовход", полное содержание которой включается в данное описание для всех целей.

Область техники, к которой относится изобретение

Данное изобретение относится в целом к системам обработки изображения и, в частности, к системе для приема и обработки изображения человека-пользователя для обеспечения взаимодействия с видеодисплеем.

Обработку изображения используют во многих областях анализа, образования, торговли и развлечений. Один аспект обработки изображения включает взаимодействие человек-компьютер посредством обнаружения форм и движений человека для обеспечения взаимодействия с изображениями. Прикладные программы такой обработки могут использовать эффективные или занимательные пути взаимодействия с изображениями для задания цифровых форм или других данных, анимации объектов, создания выразительных форм и т.д.

Обнаружение положения и движения человеческого тела называют "захватом движения". С помощью технологии захвата движения подают математические описания движений человека на вход компьютера или другой обрабатывающей системы. Естественные движения человека можно использовать в качестве входных сигналов компьютера для изучения атлетического движения, сбора данных для последующего воспроизведения или моделирования, углубленного анализа для медицинских целей и т.д.

Хотя захват движения обеспечивает преимущества и недостатки, технология захвата движения имеет тенденцию к сложности. Некоторые технологии требуют от актера ношение специальных костюмов с сильно заметными точками в нескольких местах. В других подходах используют радиочастотные или другие типы излучателей, множество датчиков и детекторов, голубые фильтры, сложную последующую обработку и т.д. Технологии, которые основаны на простом изображении в видимом свете, обычно являются недостаточно точными для обеспечения хорошо заданного и точного захвата движения.

Некоторые прикладные программы захвата движения позволяют актеру, или пользователю, взаимодействовать с изображениями, которые создаются и отображаются компьютерной системой. Например, актер может перемещать, или по-другому создавать, модифицировать и манипулировать объектами с использованием движений тела. Различные эффекты, основанные на движениях актера, можно вычислять с помощью компьютерной системы и отображать на экране дисплея. Например, компьютерная система может отслеживать путь актера перед экраном дисплея и выдавать приближение или артистическую интерпретацию пути на экране дисплея. Изображения, с которыми актер может взаимодействовать, могут быть, например, на полу, на стене или на другой поверхности; подвешенными в трехмерном пространстве, отображенными на одном или нескольких мониторах, проекционных экранах или других устройствах. Можно использовать любой тип дисплейного устройства или технологию для представления изображений, которыми может управлять или с которыми может взаимодействовать пользователь.

В некоторых применениях, таких как торговая точка, реклама, организация продаж, диалоговые развлечения и т.д., желательно захватывать движения нетренированного пользователя (например, проходящего человека) очень незаметным образом. В идеальном случае пользователь не нуждается в специальной подготовке или тренировке, а система не использует неоправданно дорогое оборудование. Кроме того, система и способ, используемые для захвата движения актера, должны быть предпочтительно невидимыми или незаметными для пользователя. Многие реальные прикладные программы должны работать в условиях, где имеется сложный и изменяющийся фон и объекты переднего плана, короткие интервалы времени для захвата движения, изменяющиеся условия освещения и другие факторы, которые могут затруднять захват движения.

Сущность изобретения

Данное изобретение обеспечивает взаимодействие между пользователем и дисплейной системой компьютера, использующей движение и положение пользователя (или другого объекта) в качестве входного сигнала компьютера. Компьютер генерирует отображение, которое реагирует на положение и движение пользователя. Создаваемое изображение может содержать объекты или формы, которые можно перемещать, модифицировать или управлять ими с помощью движений тела пользователя.

В предпочтительном варианте выполнения изобретения на отображаемые изображения оказывают влияния действия пользователя в реальном времени. Отображение можно проецировать вокруг пользователя, так что действия пользователя создают эффекты, которые исходят от пользователя и воздействуют на зоны отображения вблизи пользователя. Или же пользователь может воздействовать на видеообъекты посредством ударов, толкания, перемещения, деформации элементов видеоизображений, прикосновения к ним и т.д. Помехи между светом, используемым для отображения интерактивных изображений, и светом, используемым для обнаружения пользователя, являются минимальными за счет использования света по существу с разными длинами волн.

В одном варианте выполнения пользователя освещают инфракрасным светом, который невидим для человеческого глаза. Для захвата изображения пользователя с целью анализа его положения и движения используют камеру, которая чувствительна к инфракрасному свету. Видимый свет проецируют с помощью проектора на экран, стекло или другую поверхность для отображения интерактивных изображений, объектов, узоров или других форм и эффектов. Поверхность дисплея может быть размещена вокруг пользователя, так что его физическое присутствие внутри дисплея соответствует его виртуальному присутствию, давая чувство физического прикосновения и взаимодействия с виртуальными объектами.

Согласно одному аспекту изобретения можно использовать узорчатое освещение вместо простого, невидимого, однородного "прожекторного света". С помощью узорчатого освещения проецируют рисунок, такой как шахматная доска, случайный точечный узор и т.д. Узор используют с помощью обработки, выполняемой компьютером, для интерпретации изображения камеры и для обнаружения объекта на заднем фоне и/или на фоне других элементов сцены. Узор можно генерировать в виде фона (так что он не падает на объект, подлежащий обнаружению) или же узор можно проецировать на всю видимую камере сцену, так что он освещает фон, передний план и объекты, подлежащие обнаружению и захвату движения.

Один путь обеспечения узорчатого освещения включает использование группы инфракрасных светоизлучающих диодов или другого источника невидимого света в проекторе слайдов. В другом подходе можно использовать инфракрасный лазерный луч, который отклоняют, закрывают, сканируют и т.д. для получения узора.

Другим путем обеспечения узорчатого освещения является использование обычного "прожекторного освещения", но с маркировкой указанного узора на видимой зоне камеры с использованием чернил, красителя или краски, которая является темной или сильно отражающей на частоте чувствительности камеры. Эти чернила, краситель или краска могут быть сделаны невидимыми для глаза человека для улучшения внешнего вида дисплея.

Согласно другому аспекту изобретения используют градиентный подход для определения взаимодействия объекта и изображения. "Изображение влияния" создают посредством создания градиентного ореола или серого перехода вокруг обнаруженного объекта. При движении обнаруженного объекта градиентный ореол вычисляют в реальном времени. При столкновении градиентного ореола с видеоизображением или элементом, вычисляют интенсивность и градиент в зоне элемента сталкивания. Сила и направление взаимодействия (например, толкания элемента) является функцией интенсивности и градиента соответственно зоны сталкивания.

Согласно одному варианту выполнения изобретения создана система для обнаружения объекта и генерирования в ответ изображения, при этом система содержит первый источник для выдачи электромагнитной энергии в первом диапазоне длин волн, детектор для обнаружения отражения электромагнитной энергии первого источника от объекта, процессор, соединенный с детектором для использования обнаруженного отражения для генерирования сигнала обнаружения, второй источник для выдачи электромагнитной энергии во втором диапазоне длин волн, при этом второй источник генерирует видимое отображение в ответ на сигнал отображения, причем первый и второй диапазоны длин волн являются различными.

Согласно другому варианту выполнения изобретения создан способ обнаружения объекта в изображении, захваченном камерой, при этом способ содержит использование узорчатого освещения для освещения фона отлично от объекта; и использование системы обработки для определения объекта отдельно от фона.

Согласно другому варианту выполнения изобретения создан способ вычисления взаимодействия объекта с видеоэлементом, при этом способ содержит процессор для определения градиента для объекта; использование процессора для определения границы видеоэлемента и идентификацию взаимодействия с использованием градиента и границы.

Краткое описание чертежей

На чертежах изображено:

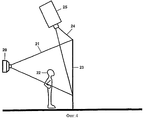

фиг.1 - первая конфигурация предпочтительного варианта выполнения с расположенными в одном месте проектором и камерой;

фиг.2 - конфигурация с верхней проекцией;

фиг.3 - конфигурация с задней проекцией;

фиг.4 - конфигурация с боковой проекцией;

фиг.5А - субъект при равномерном освещении;

фиг.5В - фон при освещении в виде случайного точечного узора;

фиг.5С - субъект и фон при освещении в виде случайного точечного узора;

фиг.5D - результат обнаружения объекта на фоне при использовании освещения в виде случайного точечного узора;

фиг.6А - пользователь, воздействующий с видеообъектом; и

фиг.6В - изображение влияния.

Подробное описание изобретения

Ниже приводится описание нескольких вариантов осуществления изобретения. В целом, в данном изобретении используют первый источник света для освещения пользователя или другого объекта. Первый источник света использует свет, невидимый для человека. Например, можно использовать инфракрасный или ультрафиолетовый свет. Для обнаружения пользователя, освещаемого первым источником света, используют камеру, которая чувствительна к свету в диапазоне длин волн первого источника света. Для обработки изображения обнаруженного объекта и для генерирования изображений для дисплея используют процессор (или другую систему обработки). Второй источник света (например, проектор, видеоэкран и т.д.) используют для отображения генерированных дисплейных изображений пользователю или зрителям. Отображаемые изображения выполняются на длинах волн, которые минимизируют помехи для обнаружения камерой объекта. Для отображения изображений обычно используют видимый спектр света.

Согласно предпочтительному варианту выполнения дисплей окружает пользователя, так что виртуальное присутствие пользователя совмещается с физическим присутствием пользователя. Таким образом, виртуальная сцена на дисплее имеет физическое местоположение вокруг пользователя, и движения пользователя внутри дисплея приводят к идентичному движению представления пользователя внутри виртуальной схемы. Например, пользователь может сталкиваться с физическим местоположением виртуального объекта и знать, что это приведет к тому, что его виртуальное представление коснется виртуального объекта в компьютерной системе. Использование понятия "прикосновение" или "прикоснуться" в данном описании не означает физического контакта с объектом, таким как человек или элемент изображения. Вместо этого упоминание соприкосновения означает, что положение объекта и действие в физическом пространстве переводится в эффект в генерированном изображении, включая эффекты движения элементов в генерированных изображениях.

Отображенные изображения или элементы могут включать объекты, узоры, формы или любые видимые узоры, эффекты и т.д. Некоторые аспекты изобретения можно использовать для прикладных программ, таких как интерактивные эффекты освещения людей в клубах или событиях, интерактивные рекламные дисплеи, знаки и виртуальные объекты, которые реагируют на движения прохожих, интерактивное освещение окружения для общественных помещений, таких как рестораны, ярмарки, спортивные арены, магазины, фойе и парки, видеоигровые системы и интерактивные информационные дисплеи. Возможны другие прикладные программы и они входят в объем изобретения.

На фиг.1 показан вариант выполнения изобретения с проекцией спереди с использованием расположенных в одном месте камерой и проектором. Как показано на фиг.1, человек 1 освещается инфракрасной лампой 2 (или другим невидимым светом). Изображение человека фотографируется инфракрасной (или работающей в другом диапазоне невидимого света) камерой 3. Этот сигнал 4 передается в реальном времени в компьютер 5. Компьютер выполняет алгоритм обнаружения объекта и генерирует видеоэффект в реальном времени. Эффект 6 передается в реальном времени в видеопроектор 7. Проектор проецирует результирующее изображение на экран в реальном времени и в совмещении с человеком.

На фиг.2 показана конфигурация системы с верхней проекцией. Компонент 10 включает указанную выше систему. В данном случае компонент 10 показан установленным вертикально, однако камера, проектор и источник света внутри компонента 10 могут быть установлены также горизонтально и затем направлены вниз с помощью зеркала. Человек, движущийся на полу 11, может иметь видеосигнал 12, проецируемый на пол вокруг него. Собственная тень человека затмевает минимальную часть изображения, когда проектор находится непосредственно над головой.

На фиг.2 и 3 показаны еще две альтернативные конфигурации для камеры и проектора. На обеих фигурах камера 20 захватывает объект, такой как человек 22 перед экраном 23. Угол зрения камеры обозначен позицией 21. На фиг.3 проектор 25 расположен позади экрана. Исходящий из проектора свет 24 можно видеть на экране с обеих сторон. На фиг.4 проектор 25 расположен с наклоном к экрану; показан его конус 24 света. Обе эти конфигурации увеличивают вероятность отсутствия теней, искажающих проецируемое изображение.

Как указывалось в приведенных выше конфигурациях, видеокамера используется для захвата сцены в частном положении для ввода в компьютер. В большинстве конфигураций устройства камера видит часть выходного видеодисплея. Для предотвращения не желательной обратной видеосвязи камера может работать на длине волны, которая не используется видеодисплеем. В большинстве случаев дисплей использует видимый спектр света. В этом случае камера должна фотографировать в невидимом диапазоне длин волн, таком как инфракрасный, так что выход видеодисплея не обнаруживается.

Сцена, снимаемая на видео, должна освещаться светом с длиной волны камеры. В случае инфракрасного света можно использовать источники, включая солнечный свет, тепловую лампу или инфракрасные светоизлучающие диоды, для освещения сцены. Эти источники света могут быть расположены в любом месте; однако попадание ложных теней в поле зрения камеры от этих источников света можно минимизировать за счет расположения источников света вблизи камеры. Источник света, такой как одна или более ламп, может освещать объекты равномерным светом в противоположность узорчатому освещению, которое будет описано ниже. В предпочтительном варианте выполнения видеосигнал передается в реальном времени в компьютер. Однако в других вариантах выполнения не обязательно обеспечивать обработку в реальном или близком к реальному времени и можно обрабатывать объект или видеоизображения (т.е. изображения дисплея) во время, значительно предшествующее отображению изображений.

Этот компонент выполнен модульным; в нем можно использовать любое программное обеспечение компьютера, которое использует входной видеосигнал от предшествующего компонента и выдает результат в виде видеоотображения.

Большинство примеров выполнения этого компонента имеет две части: первая часть осуществляет обнаружение мобильных объектов на неподвижном фоне, в то время как вторая часть использует информацию об объекте для генерирования выходного видеосигнала. Описание нескольких примеров выполнения будет приведено ниже; эти примеры выполнения являются лишь примерами и никак не являются всеобъемлющими.

В первой части живое изображение из видеокамеры обрабатывается в реальном времени с целью отделения подвижных объектов (например, людей) от неподвижного фона, независимо от характера фона. Обработку можно выполнять следующим образом.

Сначала входные кадры из видеокамеры преобразуются в полутоновое изображение для уменьшения количества данных и упрощения процесса обнаружения. Затем их можно слегка размыть для уменьшения шума.

Любой объект, который не движется в течение длительного времени, считается фоном; поэтому при необходимости система способна адаптироваться к изменению освещения или состоянию фона. Модельное изображение фона можно генерировать с помощью различных способов, в каждом из которых проверяют входные кадры в течение некоторого времени. В одном способе проверяют последние несколько кадров (или их подмножество) для генерирования модели фона посредством усреднения, генерирования срединного значения выборки, обнаружения периодов постоянной яркости или других эвристических процедур. Длительность времени, в течение которого проверяют входные кадры, определяет скорость, с которой модель фона адаптируется к изменениям входного изображения.

В другом способе модель фона генерируют в каждой временной стадии (или реже) посредством вычисления взвешенного среднего значения текущего кадра и модели фона из предыдущей стадии. Вес текущего кадра в этом вычислении является относительно небольшим; таким образом, изменения в действительном фоне постепенно ассимилируются в модель фона. Этот вес можно настраивать для изменения скорости, с которой модель фона адаптируется к изменениям во входном изображении.

Считается, что представляющий интерес объект отличается по яркости от фона. С целью нахождения объектов в каждой стадии времени текущий видеосигнал вычитают из модельного изображения фона. Если абсолютная величина этой разницы в конкретном месте больше конкретного порогового значения, то это место классифицируется как объект; в противном случае оно классифицируется как фон.

Вторая часть может быть любой программой, которая воспринимает классификацию объект/фон изображения (возможно, дополнительно к другим данным) в качестве входного сигнала и выдает видеоизображение на основе этого входного сигнала, возможно, в реальном времени. Эта программа может принимать бесконечное число форм и таким образом определяется в широком смысле как компьютерная прикладная программа. Например, этот компонент может быть простым и создавать направленную освещенность в форме обнаруженных объектов или сложным в виде рисующей программы, управляемой с помощью жестов людей, обнаруженных в качестве объектов. Дополнительно к этому, прикладные программы могут использовать другие формы входного сигнала, такие как звуковой, температурный, клавиатурный входной сигнал и т.д., а также дополнительные формы выходного сигнала, такие как звуковой, тактильный, виртуальной действительности, ароматический и т.д.

Один большой класс прикладных программ включает специальные эффекты, которые используют классификацию объект/фон в качестве входного сигнала. Например, звезды, линии или другие формы можно рисовать в выходном видеоизображении в случайной части мест, которые были классифицированы как объект. Затем эти формы могут со временем постепенно исчезать, так что люди оставляют промежуточные следы форм за собой при их движении. Ниже приводятся примеры других эффектов того же класса:

- контуры и рябь, окружающие объекты,

- сетка, деформированная присутствием объектов,

- имитация пламени или ветра или другие матричные конволюции, применяемые к объектам,

- специальные эффекты, которые пульсируют в так музыки, которая обнаруживается отдельно.

Другой большой класс прикладных программ позволяет реальным объектам взаимодействовать с виртуальными объектами или знаками. Например, изображение, показывающее группу утят, можно запрограммировать для прохождения позади любого реального объекта (например, человека), который идет перед дисплеем.

Дополнительно к этому, компьютерные игры, в которые могут играть люди, движущиеся перед камерой, образуют другой класс прикладных программ.

Однако этот список не является исчерпывающим; этот компонент выполнен с возможностью программирования и тем самым может выполнять любую прикладную программу.

Выходной сигнал программного обеспечения обработки из предыдущего компонента отображается визуально. Возможные дисплеи включают, но не ограничиваясь этим, видеопроекторы, телевизионные, плазменные дисплеи и лазерные стенды. Отображаемое изображение можно выравнивать с входной областью камеры, так что видеоэффекты выравниваются с местоположением людей, вызывающих их. Поскольку некоторые конфигурации видеокамеры могут обнаруживать объекты в невидимом свете, исключается проблема создания дисплеем помех для камеры.

Имеются различные возможные конфигурации для различных компонентов. Например, камера и видеопроектор могут быть в одном и том же месте и направлены в одном направлении. Затем камера и проектор могут быть направлены на стену, как показано на фиг.1, направлены на пол, отклонены с помощью зеркала, как показано на фиг.2, или направлены на любую другую поверхность. В качестве альтернативного решения проектор может быть расположен позади экрана, как показано на фиг.3, так что экран является идентичным экрану на фиг.1, но человек больше не находится на пути проекции, так что он не отбрасывает тени. Тень можно также исключить за счет расположения проектора под наклоном к экрану, как показано на фиг.4. Видеодисплей может быть также телевизионным большим экраном, плазменным дисплеем или видеостеной. Хотя во всех указанных выше конфигурациях видеодисплей находится на одной линии с видеовходом, это не является обязательным; видеодисплей может быть расположен в любом месте. Предшествующий список не является исчерпывающим; имеются многочисленные возможные дополнительные конфигурации.

Вся система может быть включена в информационную сеть для обеспечения обмена между системами визуальной информацией и информацией о состоянии программного обеспечения обработки. Таким образом, объект, обнаруженный в сигнале зрения одной системы, может воздействовать на программное обеспечение в другой системе. Дополнительно к этому, виртуальный элемент в дисплее одной системы можно перемещать в другие системы. Если дисплеи нескольких систем выровнены друг с другом, так что они образуют единый большой дисплей, то в этом случае несколько систем могут действовать как одна очень большая система, при этом объекты и взаимодействия бесшовно перемещаются через границы дисплеев.

Общая проблема системы зрения состоит в том, что в случаях, когда имеется неконтролируемое окружающее освещение (например, солнечный свет) видимой камерой зоны под значительно отличным углом, чем камера, то объекты отбрасывают тени на фон. Если эти тени являются достаточно сильными, то система зрения может ошибочно принимать их за объекты. Эти тени могут быть обнаружены и удалены посредством стробирования источника света камеры. Посредством вычитания входного изображения камеры с одним окружающим светом из входного изображения камеры как с окружающим светом, так и со светом камеры система получает изображение, которое захватывает сцену, как если бы использовался лишь свет камеры, за счет чего исключаются обнаруживаемые тени из окружающего света.

Дополнительную точность обнаружения объектов с помощью изображений, захваченных камерой, можно обеспечить посредством использования узорчатого освещения или узорчатых маркировок.

Один недостаток использования системы простого прожекторного освещения для компьютерного зрения состоит в том, что если цвета объектов, наблюдаемых камерой, являются очень похожими, то может быть очень трудно обнаруживать объекты. Если камера работает в монохромном режиме, то еще больше повышается вероятность того, что объект и фон выглядят одинаково.

Использование узорчатого объекта для закрывания видимой камерой зоны может улучшить обнаружение объекта. Если используется узор, который содержит два или более цветов, смешанных в тесной близости, то вероятность того, что другие объекты имеют похожий вид, очень мала, поскольку по меньшей мере один цвет узора будет выглядеть отлично от цвета окружающих объектов. Если используется узорчатый объект, такой как экран, в качестве фона, перед которым необходимо обнаруживать объекты, то объекты, которые проходят перед узорчатым экраном, можно обнаруживать более просто с помощью алгоритма зрения.

Например, в инфракрасной прикладной программе зрения узорчатый объект может быть фоном, который кажется белым для глаза человека, однако он содержит покрытие в виде черно-белого шахматного узора, который невидим для глаза человека, но видим для камеры. За счет использования узора, который невидим в видимом спектре света, узорчатое покрытие не нарушает приятного внешнего вида системы. Дисплейная система (например, видеопроектор) может проецировать выходные изображения на покрытия, как указывалось выше. В процесс, выполняемый обрабатывающей системой, такой как компьютерная система, можно вводить узор фона, что упрощает обнаружение объекта перед покрытием, хотя система может обучаться узорчатому фону тем же образом, каким алгоритм зрения обучается любому другому фону. Кроме того, способность системы приспосабливаться к изменениям яркости фона также не испытывает отрицательного взаимодействия.

Узорчатое освещение можно также проецировать из источника света на видимую камерой зону. Пока камера и источник невидимого света находятся в различных, разнесенных местах, эффекты параллакса приводят к нарушению вида проецируемого узора для камеры при движении объектов в видимой камере зоне. Это нарушение помогает объектам, имеющим сходные цвета, выделяться друг из друга. Если взять различие между двумя изображениями, видимые камерой, то результат показывает форму любого объекта, который появляется, исчезает или перемещается между двумя изображениями. Если изображение одного объекта перед фоном вычесть из изображения одного фона, то результатом является изображение, которое равно нулю, когда имеется фон, и не равно нулю, когда имеются другие объекты. Эту технологию можно использовать в комбинации с другими описываемыми здесь аспектами изобретения.

В качестве источника узорчатого света используется различные средства. Один метод состоит в использовании группы инфракрасных светоизлучающих диодов или другого источника невидимого света в проекторе слайдов. Используется комплект линз для фокусировки света источника через слайд, содержащий желаемый узор, за счет чего проецируется изображение узора на видимую камере зону. В другом способе инфракрасным лазерным лучом можно освещать генератор лазерного узора или другое рассеивающее устройство для создания светового узора на видимой камере зоне. Для создания узора свет можно отражать, затенять, сканировать и т.д. Возможны также многие другие подходы.

Источник узорчатого света является также полезным для трехмерного компьютерного зрения. Технология трехмерного компьютерного зрения, такая как алгоритм Марр-Поггио, принимает в качестве входного сигнала два изображения одной и той же сцены, снятой под слегка разными углами. Узоры на изображениях совмещают для определения величины сдвига и тем самым расстояние до камеры в каждой точке изображения. Действие этого алгоритма ухудшается, когда объекты имеют однородный цвет, поскольку однородный цвет затрудняет совмещение соответствующих частей в паре изображений. Таким образом, источник узорчатого света может улучшить оценку расстояния некоторых алгоритмов трехмерного компьютерного зрения.

Два входных изображения для этих алгоритмов трехмерного зрения обычно генерируют с использованием пары камер, направленных на сцену. Однако можно использовать также лишь одну камеру. Второе изображение может быть полностью неискаженной версией проецируемого узора, которая известна заранее. Это изображение узора по существу идентично тому, что видела бы вторая камера, если ее разместить точно в том же месте, что и источник узорчатого света. Таким образом, можно использовать совместно вид единственной камеры и проецируемый узор в качестве входного сигнала для алгоритма трехмерного зрения. В качестве альтернативного решения вторым изображением может быть изображение только фона, снятое той же камерой.

Хотя можно использовать различные типы узоров, узор случайных точек высокого разрешения имеет определенные преимущества для двухмерного и трехмерного зрения. За счет случайности точечного узора каждая имеющая значительный размер часть точечного узора с очень малой вероятностью выглядит как любая другая часть узора. Таким образом, смещенный узор, обусловленный присутствием объекта в рассматриваемой зоне с очень низкой вероятностью выглядит сходно с узором при отсутствии здесь объекта. Это делает максимальной способность алгоритма зрения обнаруживать смещения в узоре и тем самым объекты. Использование регулярного узора, такого как решетка, может создавать некоторые трудности, поскольку разные части узора являются идентичными, что приводит к тому, что часто смещенные части выглядят как несмещенные части.

На фиг.5А-D показана полезность узора случайных точек для обнаружения объекта. На фиг.5А показано изображение человека при нормальном освещении. Изображение человека имеет яркость, сходную с яркостью фона, что затрудняет обнаружение. На фиг.5В на фон проецируется узор из случайных точек из источника света вблизи камеры. Когда человек стоит перед этим узором, то узор, отражаемый от человека, смещен, как показано на фиг.5С. За счет определения разницы между изображениями на фиг.5А и 5С, получают изображение на фиг.5D, которое задает зону изображения человека с помощью сильного сигнала.

Можно использовать другие подходы для улучшения обнаружения объекта. Например, источник света можно "стробировать" или периодически включать и выключать, так что легче обнаруживать тени, обусловленные другими источниками света (например, окружающим светом).

После обнаружения и определения объекта в предпочтительных вариантах выполнения используют градиентный ореол для определения степени и направления взаимодействия объекта с отображенным элементом изображения.

На фиг.6 показан пользователь, взаимодействующий с видеообъектом.

На фиг.6 объект 304 обнаружен и показан в виде контура. Одно представление объекта процессор компьютера может использовать определение контура, показанного на фиг.6А. Видеоэкран 302 отображает несколько элементом изображения, таких как изображение 306 мяча.

На фиг.6В показано изображение влияния для зоны 308 на фиг.6А.

На фиг.6В контурное изображение ноги 320 пользователя используется для генерирования последовательных более крупных контурных зон. Области исходной контурной зоны 320 присваивается большая величина яркости пикселей, соответствующая белому цвету. Каждой последующей контурной зоне 322, 324, 326, 328, 380 присваивается прогрессивно уменьшающаяся величина, так что точка, более удаленная от исходной контурной (белой) зоны, будет иметь более низкую величину яркости пикселей. Следует отметить, что можно использовать любое число контурных зон. Кроме того, по желанию можно изменять размер и приращения контурных зон. Например, можно использовать непрерывный градиент, а не дискретные зоны. Совокупность всех контурных зон называется "изображением влияния".

Изображение влияния сравнивают для различных элементов изображения. На фиг.6В элемент мяч 306 сталкивается с градиентными зонами 326, 328 и 330. Как известно из уровня техники, линии направления определяются в направлении градиента поля величин пикселей для зон сталкивания. На фиг.6В показаны три примера линий направления внутри элемента 306. Линии направления можно комбинировать, например, посредством усреднения или же можно использовать выбранную единственную линию. С помощью обработки также обнаруживают, что наиболее яркой контурной зоной, толкаемой элементом, является контурная зона 326. Возможны другие подходы. Например, можно усреднять яркость и градиент в каждой точке зоны элемента изображения или подмножества этих точек. Кроме того, некоторые варианты выполнения могут включать длительность контакта в качестве фактора в дополнение к яркости и градиенту.

Взаимодействие между объектом, таким как человек, и элементом на экране вычисляют с использованием как яркости соударяемой контурной зоны, так и направления, вычисленного с использованием одной или более линий направления. Яркость соударения соответствует силе, с которой пользователь соприкасается с элементом. Градиент соответствует направлению, в котором (или из которого в зависимости от знака вычисления) произошло соприкосновение с элементом.

Хотя изобретение было описано применительно к конкретным вариантам его выполнения, эти варианты выполнения являются иллюстрацией и не ограничивают данное изобретение. Например, хотя в предпочтительных вариантах выполнения используется камера в качестве детектора, можно использовать различные типы обнаружения. Камера может быть цифровой или аналоговой. Можно использовать стереокамеру для обеспечения информации о глубине, а также о положении. В случаях, когда обработка и отображение выполняются не в реальном времени, можно использовать пленку или другие типы носителей с последующим цифровым преобразованием перед вводом данных в процессор. Можно использовать световые чувствительные элементы или детекторы. Например, вместо камеры можно использовать матрицу из фотодетекторов. Можно использовать другие детекторы, не рассматриваемые здесь, с подходящими результатами.

В целом можно в данном изобретении использовать любой тип дисплейного устройства. Например, хотя были описаны видеоустройства в различных вариантах выполнения и конфигурациях, можно использовать другие устройства визуальной презентации. Можно использовать матрицу из светоизлучающих диодов, органических светоизлучающих диодов, электромагнитные, катодно-лучевые, плазменные, механические или другие дисплейные системы.

Можно использовать дисплеи виртуальной реальности, трехмерные и другие типы дисплеев. Например, пользователь может носить формирующие изображение очки или колпак, так что он погружается внутрь созданного окружения. В этом подходе создаваемое отображение может выравниваться с воспринимаемым им окружением для создания увеличенной или улучшенной реальности. В одном варианте выполнения пользователь может взаимодействовать с изображением знака. Знак может создаваться компьютером, изображаться актером и т.д. Знак может реагировать на действия пользователя и положения его тела. Взаимодействие может включать речь, взаимную манипуляцию объектами и т.д.

Несколько систем могут быть соединены друг с другом через, например, цифровую сеть. Например, можно использовать локальную сеть Ethernet, универсальную последовательную шину (USB), IEEE 1394 (Firewire) и т.д.

Можно использовать беспроводные линии связи, такие как 802.11b. За счет использования множества систем пользователи в разных географических местах могут кооперировать, соревноваться или взаимодействовать друг с другом другим образом с помощью созданных изображений. Изображения, созданные двумя или более системами, можно объединять друг с другом в мозаику или комбинировать другим образом для создания многокомпонентного изображения.

Можно использовать другие типы освещения, отличные от света. Например, можно использовать радарные сигналы, микроволновые или другие электромагнитные волны с получением преимуществ в ситуациях, где подлежащий обнаружению объект (например, металлический объект) имеет сильную отражательную способность для таких волн. Можно приспособить аспекты данного изобретения для других видов обнаружения, таких как с использованием акустических волн в воздухе или в воде.

Хотя для приема и обработки сигналов изображения объекта и для создания сигналов отображения описаны компьютерные системы, можно использовать любые другие типы системы обработки. Например, можно использовать систему обработки, которая не использует компьютер общего назначения. Системы обработки, использующие конструкции, основанные на заказных или полузаказных схемах или кристаллах, специальных прикладных интегральных схемах (ASIC), программируемых пользователем вентильных матриц (FPGA), мультипроцессорах, асинхронные или любых другие типы конструкции или методологии могут подходить для использования в данном изобретении.

Таким образом, объем изобретения определяется лишь прилагаемой формулой изобретения.

Claims (78)

1. Интерактивная видеодисплейная система, предназначенная для обнаружения объекта и генерирования в ответ отображения, в которой указанный объект взаимодействует с, по меньшей мере, одним изображением виртуального элемента, содержащая

первый источник для выдачи электромагнитной энергии в невидимом диапазоне длин волн в направлении местоположения, содержащего указанный объект;

детектор для обнаружения отражения электромагнитной энергии первого источника от указанного местоположения;

процессор, соединенный с детектором и предназначенный для выполнения процесса обнаружения изображения объекта в обнаруженном отражении, определения изображения влияния объекта, при этом изображение влияния включает в себя область вокруг обнаруженного изображения объекта, генерирования сигнала отображения включающего, по меньшей мере, один виртуальный элемент, при этом изображение влияния объекта взаимодействует с, по меньшей мере, одним виртуальным элементом; и второй источник для выдачи электромагнитной энергии в диапазоне длин волн видимого спектра, при этом второй источник создает видимое отображение в ответ на сигнал отображения.

2. Система по п.1, отличающаяся тем, что генерирование сигнала отображения, когда изображение влияния взаимодействует с, по меньшей мере, одним виртуальным элементом, содержит обнаружение отражения виртуального элемента в изображении влияния, и получение взаимодействия изображения влияния с виртуальным элементом из обнаруженного отражения.

3. Система по п.1, отличающаяся тем, что обнаруженное изображение объекта представляет собой контурное изображение объекта.

4. Система по п.1, отличающаяся тем, что первый источник выдает инфракрасный свет.

5. Система по любому из пп.1-4, отличающаяся тем, что объект включает в себя пользователя-человека, а второй источник содержит видеопроектор для проецирования изображений на поверхность, смежную с объектом, при этом поверхность представляет собой одна из следующих частей: часть системы проекции сверху, часть системы проекции сзади, часть системы проекции спереди.

6. Система по п.1, отличающаяся тем, что первый источник обеспечивает узорчатое освещение и содержит устройство для генерирования узорчатого освещения, представляющее собой группу инфракрасных светоизлучающих диодов для генерирования узорчатого освещения.

7. Система по п.1, отличающаяся тем, что изображение влияния объекта содержит параметры для вычисления интенсивности и направления влияния объекта на виртуальный элемент.

8. Система по п.7, отличающаяся тем, что изображение влияния содержит множество последовательных более крупных контурных зон.

9. Система по п.8, отличающаяся тем, что каждой из последовательных более крупных контурных зон присвоено прогрессивно уменьшающееся значение таким образом, что наиболее удаленной от контура объекта зоне присваивается наименьшее значение.

10. Система по п.8, отличающаяся тем, что изображение влияния содержит, по меньшей мере, одну большую контурную зону, точкам которой непрерывно присвоены прогрессивно уменьшающиеся значения таким образом, что наиболее удаленной от контура объекта точке присваивается наименьшее значение.

11. Система по любому из пп.8-10, отличающаяся тем, что интенсивность влияния объекта на виртуальный элемент получают на основе значений присвоенных точкам последовательно возрастающих контурных зон, на которые накладывается виртуальный элемент, а направление влияния объекта на виртуальный элемент получают на основе градиента значений присвоенных точкам, последовательных более крупных контурных зон, на которые накладывается виртуальный элемент.

12. Система по п.11, отличающаяся тем, что значения, присвоенные точкам, контурных зон, на которые накладывается виртуальный элемент и градиент значений, присвоенных точкам, усредняются в каждой точке зоны виртуального элемента.

13. Система по п.11, отличающаяся тем, что значения присвоенные подмножеству точек, контурных зон, на которые накладывается виртуальный элемент и градиент значений, присвоенных точкам, усредняются в каждой точке подмножества точек.

14. Система по п.8, отличающаяся тем, что продолжительность контакта между виртуальным элементом и изображением влияния используется для определения влияния объекта на виртуальный элемент.

15. Система по п.1, отличающаяся тем, что процессор обеспечивает определение изображения объекта путем отделения объекта от фона обнаруженного отражения, при этом отделение объекта от фона обнаруженного отражения включает генерирование адаптивной модели указанного фона путем анализа изменений во времени обнаруженного отражения.

16. Система по п.15, отличающаяся тем, что генерирование адаптивной модели указанного фона включает вычисление средневзвешенной величины текущего обнаруженного отражения и предыдущего обнаруженного отражения, а отделение объекта от фона включает вычитание указанной средневзвешенной величины из текущего обнаруженного отражения.

17. Система по п.1, отличающаяся тем, что указанный процесс дополнительно содержит генерирование градиентного ореола вокруг определенного изображения объекта и использование наложения виртуального элемента на градиентный ореол для определения взаимодействия между объектом и виртуальным элементом.

18. Система по п.1, отличающаяся тем, что указанный виртуальный элемент включает отображение указанного объекта.

19. Система по п.6, отличающаяся тем, что узорчатое освещение включает случайный точечный узор или шахматный узор.

20. Система по п.1, отличающаяся тем, что обнаружение изображения объекта в обнаруженном отражении включает вычитание обнаруженного отражения из отражения только фона.

21. Система по п.17, отличающаяся тем, что процесс использования градиента для определения взаимодействия между объектом и виртуальным элементом, содержит использование процессора для определения границы виртуального элемента и идентификацию взаимодействия с использованием градиента и границы.

22. Способ по п.21, отличающийся тем, что дополнительно содержит использование процессора для определения яркости ореола вокруг определенного изображения объекта и идентификацию взаимодействия с использованием яркости ореола и границы.

23. Способ по п.1, отличающийся тем, что взаимодействие является одним из следующего: толкание человеком виртуального элемента, соприкосновение человека с виртуальным элементом, деформация человеком виртуального элемента, манипулирование человеком виртуальным элементом, при этом система дополнительно содержит звуковой выход для выдачи звукового сигнала.

24. Способ по п.1, отличающийся тем, что область вокруг обнаруженного изображения содержит пиксели, значения которых отличают их от обнаруженного изображения, а область формируется вокруг обнаруженного изображения путем изменения значения пикселя, что обеспечивает вычисления положения и направления влияния объекта на, по меньшей мере, один виртуальный элемент.

25. Способ обнаружения объекта и генерирования в ответ отображения, в которой указанный объект взаимодействует с, по меньшей мере, одним изображением виртуального элемента, содержащий использование первого источника света в невидимом диапазоне длины волны для освещения местоположения, содержащего объект; использование камеры, чувствительный к свету в невидимом диапазоне длины волны, для обнаружения отражения указанного света от указанного местоположения; и использование процессора, связанного с камерой, для выполнения процесса; обнаружения изображения объекта в обнаруженном отражении, определения изображения влияния объекта, при этом изображение влияния включает в себя область вокруг обнаруженного изображения объекта,

генерирования сигнала отображения, включающего, по меньшей мере, один виртуальный элемент, при этом изображение влияния объекта взаимодействует с, по меньшей мере, одним виртуальным элементом; и использование второго источника света в диапазоне длины волны видимого спектра для генерирования отображенного изображения из сигнала отображения.

26. Способ по п.25, отличающийся тем, что объект представляет собой пользователя-человека, при этом осуществляют генерирование сигнала отображения используя видеопроектор для проецирования изображений на поверхность, смежную с объектом, при этом поверхность переставляет собой одну из следующих частей:

часть системы проекции сверху, часть системы проекции сзади, часть системы проекции спереди.

27. Способ по п.25, отличающийся тем, что используют несколько камер и используют, по меньшей мере, две камеры для создания стереоэффекта.

28. Способ по п.25, отличающийся тем, что используют плазменный экран для создания отображаемого изображения.

29. Способ по п.25, отличающийся тем, что отображаемое изображение включает в себя рекламу.

30. Способ по п.25, отличающийся тем, что отображаемое изображение является частью видеоигры.

31. Способ по п.25, отличающийся тем, что дополнительно содержит стробирование невидимого света.

32. Способ по п.25, отличающийся тем, что дополнительно содержит соединение друг с другом нескольких систем, так что информацию об обнаружении изображения и отображениях можно передавать между системами.

33. Способ по п.32, отличающийся тем, что дополнительно содержит использование переданной информации для создания одного отображения из двух или более отображений.

34. Способ по п.25, отличающийся тем, что дополнительно используют первый источник света для генерирования узорчатого освещения.

35. Способ по любому из пп.25-34, отличающийся тем, что область вокруг обнаруженного изображения содержит пиксели, значения которых отличают их от обнаруженного изображения, а область формируется вокруг обнаруженного изображения путем изменения значения пикселя, что обеспечивает вычисления положения и направления влияния объекта на, по меньшей мере, один виртуальный элемент.

36. Способ обнаружения объекта в изображении, захваченном камерой, содержащий использование источника света для освещения фона объекта узорчатым освещением; получение первого изображения только освещенного фона, и второго изображения освещенного фона и объекта; и вычитание первого и второго изображений для определения изображения объекта отдельно от фона.

37. Способ по п.36, отличающийся тем, что узорчатое освещение включает случайный точечный узор или шахматный узор.

38. Способ по п.36, отличающийся тем, что узорчатое освещение освещает также объект.

39. Способ вычисления взаимодействия объекта с виртуальным элементом, содержащий использование камеры для определения отражения, включающего изображение объекта; использование процессора, связанного с камерой, для выполнения процесса:

обнаружения изображения объекта в обнаруженном отражении,

определения изображения влияния объекта, при этом изображение влияния включает в себя область вокруг обнаруженного изображения объекта,

генерирования сигнала отображения, включающего, по меньшей мере, один виртуальный элемент, при этом изображение влияния объекта взаимодействует с, по меньшей мере, одним виртуальным элементом.

40. Система обнаружения объекта и генерирования в ответ отображения, содержащая

систему камеры, предназначенную для обеспечения изображения объекта отдельно от фона; систему отображения, предназначенную для отображения видеоизображений на поверхности; и процессор, предназначенный для получения указанных изображений от указанной системы камеры и вывода на указанную систему отображения, при этом указанный процессор предназначен для генерирования адаптивной модели указанного фона путем анализа изменений на протяжении всего времени, кадров изображений, вводимых из указанной системы камеры.

41. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанных видеоизображений на основе указанной адаптивной модели и указанных вводимых из указанной системы камер изображений.

42. Система по п.40, отличающаяся тем, что, по меньшей мере, часть указанной поверхности совпадает с указанным фоном.

43. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для обнаружения указанного объекта и его позиции.

44. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для определения изображения влияния, при этом изображение влияния содержит область вокруг изображения объекта, производного от объекта.

45. Система по п.44, отличающаяся тем, что процессор дополнительно предназначен для определения взаимодействия объекта и, по меньшей мере, одного видеоизображения на основе изображения влияния.

46. Система по п.44, отличающаяся тем, что процессор дополнительно предназначен для определения градиента изображения влияния и определения взаимодействия объекта и, по меньшей мере, одного видеоизображения на основе градиента.

47. Система по п.46, отличающаяся тем, что процессор дополнительно предназначен для определения яркости изображения влияния и определения взаимодействия объекта и, по меньшей мере, одного видеоизображения на основе яркости.

48. Система по п.44, отличающаяся тем, что процессор дополнительно предназначен для определения яркости изображения влияния и определения взаимодействия объекта и, по меньшей мере, одного из видеоизображений на основе яркости.

49. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для определения градиента изображения влияния и определения взаимодействия объекта и, по меньшей мере, одного из видеоизображений на основе градиента.

50. Система по п.49, отличающаяся тем, что процессор дополнительно предназначен для определения яркости области производной от объекта и определения взаимодействия объекта и, по меньшей мере, одного видеоизображения на основе яркости.

51. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для определения яркости области производной от объекта и определения взаимодействия объекта и, по меньшей мере, одного из видеоизображений на основе яркости.

52. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для определения взаимодействия объекта и, по меньшей мере, одного из видеоизображений.

53. Система по п.52, отличающаяся тем, что процессор дополнительно предназначен для определения интенсивности взаимодействия.

54. Система по п.53, отличающаяся тем, что процессор дополнительно предназначен для определения направления взаимодействия.

55. Система по п.52, отличающаяся тем, что процессор дополнительно предназначен для определения направления взаимодействия.

56. Система по п.52, отличающаяся тем, что указанное взаимодействие представляет собой толкание объектом, по меньшей мере, одного видеоизображения.

57. Система по п.52, отличающаяся тем, что указанное взаимодействие представляет собой соприкосновение объекта с, по меньшей мере, одним видеоизображением.

58. Система по п.52, отличающаяся тем, что указанное взаимодействие представляет собой деформацию объектом, по меньшей мере, одного видеоизображения.

59. Система по п.52, отличающаяся тем, что указанное взаимодействие представляет собой манипулирование объекта, по меньшей мере, одним видеоизображением.

60. Система по п.40, отличающаяся тем, что указанная система камеры содержит стробоскопический источник света.

61. Система по п.60, отличающаяся тем, что процессор дополнительно предназначен для обработки указанного изображения, полученного от системы камеры, используя указанный стробоскопический источник света.

62. Система по п.61, отличающаяся тем, что процессор дополнительно предназначен для обнаружения светового явления, проявляющегося вследствие использования других источников света, отличных от источника света системы камеры.

63. Система по п.62, отличающаяся тем, что указанное явление включает тени.

64. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанной адаптивной модели указанного фона путем идентификации пикселей в указанных кадрах, имеющих по существу постоянную яркость на протяжении всего времени.

65. Система по п.64, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанной адаптивной модели указанного фона путем вычисления средних значений указанных пикселей на протяжении всего времени.

66. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанной адаптивной модели указанного фона путем вычисления средних значений указанных пикселей в указанных кадрах, на протяжении всего времени.

67. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанной адаптивной модели указанного фона путем внедрения в указанную адаптивную модель указанных фоновых изменений в указанном фоне, которые происходят на протяжении всего времени.

68. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанной адаптивной модели указанного фона путем внедрения в указанную адаптивную модель указанных фоновых изменений в указанном фоне, которые происходят благодаря изменениям света, освещающего указанный фон.

69. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанной адаптивной модели указанного фона путем создания изображения модели из указанного изображения, полученного от указанной системы камеры, которое классифицирует пиксели в указанном изображении модели, как пиксели переднего плана или фона.

70. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанной адаптивной модели указанного фона путем внедрения в указанную адаптивную модель указанной фоновой информации, относящейся к, по меньшей мере, части указанного объекта который остается по существу неподвижным в период времени.

71. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования указанной адаптивной модели указанного фона путем вычисления средневзвешенной величины текущего кадра указанного изображения, полученного от системы камеры, с указанной адаптивной моделью указанного фона.

72. Система по п.71, отличающаяся тем, что процессор дополнительно предназначен для настройки средневзвешенной величины для изменения значения, при котором указанная модель указанного фона может быть изменена в указанном изображении, полученном от системы камеры.

73. Система по п.40, отличающаяся тем, что процессор дополнительно предназначен для генерирования отображения элемента путем вычисления отличий между передним планом, который соответствует объекту, и фоном.

74. Система по п.73, отличающаяся тем, что вычисление отличий включает сравнение текущего кадра указанного изображения, получаемого из системы камеры с указанной адаптивной моделью фона.

75. Система по п.74, отличающаяся тем, что вычисление отличий дополнительно включает определение, превышает ли разница между соответствующими пикселями в указанном текущем кадре указанного изображения получаемого от системы камеры и указанной адаптивной моделью фона порог, необходимый для определения местоположения объекта.

76. Система по п.40, отличающаяся тем, что указанная система камеры содержит две камеры для обеспечения стереоизображения, а процессор дополнительно предназначен для вычисления глубоких данных на основе указанного стереоизображения и для использования указанных глубоких данных для генерирования указанной модели фона.

Приоритет по пунктам:

28.05.2002 - пп.1-39, 44-51, 53-57, 60-63, 76;

05.06.2001 - пп.40-43, 52, 58, 59, 64-75.

Applications Claiming Priority (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US29618901P | 2001-06-05 | 2001-06-05 | |

| US60/296,189 | 2001-06-05 | ||

| US10/160,217 | 2002-05-28 | ||

| US10/160,217 US7259747B2 (en) | 2001-06-05 | 2002-05-28 | Interactive video display system |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| RU2003137846A RU2003137846A (ru) | 2005-05-27 |

| RU2298294C2 true RU2298294C2 (ru) | 2007-04-27 |

Family

ID=26856697

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| RU2003137846/09A RU2298294C2 (ru) | 2001-06-05 | 2002-06-04 | Интерактивная видеодисплейная система |

Country Status (14)

| Country | Link |

|---|---|

| US (2) | US7259747B2 (ru) |

| EP (1) | EP1393549B1 (ru) |

| JP (1) | JP4077787B2 (ru) |

| KR (1) | KR100847795B1 (ru) |

| CN (2) | CN102033608B (ru) |

| AT (1) | ATE336860T1 (ru) |

| BR (1) | BR0210162A (ru) |

| CA (1) | CA2449300C (ru) |

| DE (1) | DE60213975T2 (ru) |

| ES (1) | ES2271272T3 (ru) |

| IL (1) | IL159207A0 (ru) |

| MX (1) | MXPA03011203A (ru) |

| RU (1) | RU2298294C2 (ru) |

| WO (1) | WO2002100094A2 (ru) |

Cited By (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2010027291A1 (ru) * | 2008-09-08 | 2010-03-11 | Rurin Oleg Stanislavovich | Способ отображения информации |

| RU2461143C2 (ru) * | 2008-08-13 | 2012-09-10 | Александр Львович Шведов | Способ создания эффекта виртуального присутствия с комбинированным видеоизображением |

| RU2486591C2 (ru) * | 2008-12-30 | 2013-06-27 | Интел Корпорейшн | Способ и устройство для уменьшения шумов в видеоизображении |

| RU2486608C2 (ru) * | 2011-08-23 | 2013-06-27 | Федеральное государственное автономное образовательное учреждение высшего профессионального образования "Национальный исследовательский университет "МИЭТ" | Устройство для организации интерфейса с объектом виртуальной реальности |

| RU2486403C2 (ru) * | 2011-07-28 | 2013-06-27 | Александр Викторович Белокопытов | Способ освещения изображения, система для освещения изображения и машиночитаемый носитель |

| RU2541936C2 (ru) * | 2008-10-28 | 2015-02-20 | Конинклейке Филипс Электроникс Н.В. | Система трехмерного отображения |

| RU2580450C2 (ru) * | 2009-05-01 | 2016-04-10 | МАЙКРОСОФТ ТЕКНОЛОДЖИ ЛАЙСЕНСИНГ, ЭлЭлСи | Системы и способы применения отслеживания модели для захвата движений |

| RU2581013C2 (ru) * | 2010-11-01 | 2016-04-10 | Томсон Лайсенсинг | Способ и устройство для обнаружения вводов при помощи жестов |

| RU2579952C2 (ru) * | 2010-11-22 | 2016-04-10 | Эпсон Норвей Рисерч Энд Дивелопмент Ас | Система и способ мультисенсорного взаимодействия и подсветки на основе камеры |

| WO2016108720A1 (ru) * | 2014-12-31 | 2016-07-07 | Общество С Ограниченной Ответственностью "Заботливый Город" | Способ и устройство для отображения трехмерных объектов |

| RU2678468C2 (ru) * | 2013-02-22 | 2019-01-29 | ЮНИВЕРСАЛ СИТИ СТЬЮДИОС ЭлЭлСи | Система и способ для отслеживания пассивной палочки и активации эффекта на основе обнаруженной траектории палочки |

| RU2760179C1 (ru) * | 2021-01-20 | 2021-11-22 | Виктор Александрович Епифанов | Система дополненной реальности |

Families Citing this family (533)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8352400B2 (en) | 1991-12-23 | 2013-01-08 | Hoffberg Steven M | Adaptive pattern recognition based controller apparatus and method and human-factored interface therefore |

| US7904187B2 (en) | 1999-02-01 | 2011-03-08 | Hoffberg Steven M | Internet appliance system and method |

| US7009523B2 (en) * | 1999-05-04 | 2006-03-07 | Intellimats, Llc | Modular protective structure for floor display |

| US6982649B2 (en) | 1999-05-04 | 2006-01-03 | Intellimats, Llc | Floor display system with interactive features |

| US7259747B2 (en) | 2001-06-05 | 2007-08-21 | Reactrix Systems, Inc. | Interactive video display system |

| US8300042B2 (en) | 2001-06-05 | 2012-10-30 | Microsoft Corporation | Interactive video display system using strobed light |

| US8035612B2 (en) | 2002-05-28 | 2011-10-11 | Intellectual Ventures Holding 67 Llc | Self-contained interactive video display system |

| US7088684B2 (en) * | 2001-07-16 | 2006-08-08 | International Business Machines Corporation | Methods and arrangements for dynamically modifying subsource address multicast data distribution trees |

| US20030063052A1 (en) * | 2001-09-28 | 2003-04-03 | Rebh Richard G. | Methods and systems of conveying information with an electroluminescent display |

| US6990639B2 (en) | 2002-02-07 | 2006-01-24 | Microsoft Corporation | System and process for controlling electronic components in a ubiquitous computing environment using multimodal integration |

| US20050122308A1 (en) * | 2002-05-28 | 2005-06-09 | Matthew Bell | Self-contained interactive video display system |

| US7710391B2 (en) * | 2002-05-28 | 2010-05-04 | Matthew Bell | Processing an image utilizing a spatially varying pattern |

| US7646372B2 (en) * | 2003-09-15 | 2010-01-12 | Sony Computer Entertainment Inc. | Methods and systems for enabling direction detection when interfacing with a computer program |

| JP4230999B2 (ja) * | 2002-11-05 | 2009-02-25 | ディズニー エンタープライゼス インコーポレイテッド | ビデオ作動インタラクティブ環境 |

| US7671843B2 (en) * | 2002-11-12 | 2010-03-02 | Steve Montellese | Virtual holographic input method and device |

| US20100262489A1 (en) * | 2002-12-13 | 2010-10-14 | Robert Salinas | Mobile enabled advertising and marketing methods for computer games, simulations, demonstrations, and the like |

| AU2003301043A1 (en) | 2002-12-13 | 2004-07-09 | Reactrix Systems | Interactive directed light/sound system |

| US6840627B2 (en) * | 2003-01-21 | 2005-01-11 | Hewlett-Packard Development Company, L.P. | Interactive display device |

| JP3849654B2 (ja) * | 2003-02-21 | 2006-11-22 | 株式会社日立製作所 | 投射型表示装置 |

| US7665041B2 (en) | 2003-03-25 | 2010-02-16 | Microsoft Corporation | Architecture for controlling a computer using hand gestures |

| US8745541B2 (en) | 2003-03-25 | 2014-06-03 | Microsoft Corporation | Architecture for controlling a computer using hand gestures |

| US7428997B2 (en) * | 2003-07-29 | 2008-09-30 | Microvision, Inc. | Method and apparatus for illuminating a field-of-view and capturing an image |

| IL157156A0 (en) * | 2003-07-29 | 2004-08-31 | Rafael Armament Dev Authority | Predictive display for system having delayed feedback of a command issued |

| GB2406634A (en) * | 2003-10-02 | 2005-04-06 | Mathmos Ltd | An object sensing lighting apparatus |

| US7536032B2 (en) | 2003-10-24 | 2009-05-19 | Reactrix Systems, Inc. | Method and system for processing captured image information in an interactive video display system |

| CN1902930B (zh) | 2003-10-24 | 2010-12-15 | 瑞克楚斯系统公司 | 管理交互式视频显示系统的方法和系统 |

| KR100588042B1 (ko) * | 2004-01-14 | 2006-06-09 | 한국과학기술연구원 | 인터액티브 프레젠테이션 시스템 |

| JP4559092B2 (ja) * | 2004-01-30 | 2010-10-06 | 株式会社エヌ・ティ・ティ・ドコモ | 携帯通信端末及びプログラム |

| JP2005276139A (ja) * | 2004-02-23 | 2005-10-06 | Aruze Corp | 情報入力装置 |

| CN100573548C (zh) * | 2004-04-15 | 2009-12-23 | 格斯图尔泰克股份有限公司 | 跟踪双手运动的方法和设备 |

| US7467380B2 (en) * | 2004-05-05 | 2008-12-16 | Microsoft Corporation | Invoking applications with virtual objects on an interactive display |

| US20050265580A1 (en) * | 2004-05-27 | 2005-12-01 | Paul Antonucci | System and method for a motion visualizer |

| US20050275915A1 (en) | 2004-06-01 | 2005-12-15 | Vesely Michael A | Multi-plane horizontal perspective display |

| KR100616532B1 (ko) * | 2004-06-07 | 2006-08-28 | 조열 | 광고 콘텐츠 제공방법 |

| US7593593B2 (en) | 2004-06-16 | 2009-09-22 | Microsoft Corporation | Method and system for reducing effects of undesired signals in an infrared imaging system |

| CN102006346A (zh) * | 2004-09-21 | 2011-04-06 | 株式会社尼康 | 投影仪装置 |

| WO2006050197A2 (en) | 2004-10-28 | 2006-05-11 | Accelerated Pictures, Llc | Camera and animation controller, systems and methods |

| US20060126925A1 (en) * | 2004-11-30 | 2006-06-15 | Vesely Michael A | Horizontal perspective representation |

| US8508710B2 (en) | 2004-12-02 | 2013-08-13 | Hewlett-Packard Development Company, L.P. | Display panel |

| HUE049974T2 (hu) * | 2005-01-07 | 2020-11-30 | Qualcomm Inc | Képeken lévõ objektumok észlelése és követése |

| US20070189544A1 (en) * | 2005-01-15 | 2007-08-16 | Outland Research, Llc | Ambient sound responsive media player |

| US8144118B2 (en) * | 2005-01-21 | 2012-03-27 | Qualcomm Incorporated | Motion-based tracking |

| WO2006085834A1 (en) * | 2005-01-28 | 2006-08-17 | Microvision, Inc. | Method and apparatus for illuminating a field-of-view and capturing an image |

| US20060170871A1 (en) * | 2005-02-01 | 2006-08-03 | Dietz Paul H | Anti-blinding safety feature for projection systems |

| EP1851750A4 (en) | 2005-02-08 | 2010-08-25 | Oblong Ind Inc | SYSTEM AND METHOD FOR CONTROL SYSTEM BASED ON GESTURES |

| US7760962B2 (en) * | 2005-03-30 | 2010-07-20 | Casio Computer Co., Ltd. | Image capture apparatus which synthesizes a plurality of images obtained by shooting a subject from different directions, to produce an image in which the influence of glare from a light is reduced |

| WO2006105660A1 (en) * | 2005-04-05 | 2006-10-12 | Google Inc. | Method and system supporting audited reporting of advertising impressions from video games |

| US9128519B1 (en) | 2005-04-15 | 2015-09-08 | Intellectual Ventures Holding 67 Llc | Method and system for state-based control of objects |

| US20060241864A1 (en) * | 2005-04-22 | 2006-10-26 | Outland Research, Llc | Method and apparatus for point-and-send data transfer within an ubiquitous computing environment |

| US8717423B2 (en) * | 2005-05-09 | 2014-05-06 | Zspace, Inc. | Modifying perspective of stereoscopic images based on changes in user viewpoint |

| US20060250391A1 (en) | 2005-05-09 | 2006-11-09 | Vesely Michael A | Three dimensional horizontal perspective workstation |

| CN100359437C (zh) * | 2005-05-11 | 2008-01-02 | 凌阳科技股份有限公司 | 交互式影像游戏系统 |

| US20060262188A1 (en) * | 2005-05-20 | 2006-11-23 | Oded Elyada | System and method for detecting changes in an environment |

| US20060267952A1 (en) * | 2005-05-26 | 2006-11-30 | Steve Alcorn | Interactive display table top |

| US8081822B1 (en) | 2005-05-31 | 2011-12-20 | Intellectual Ventures Holding 67 Llc | System and method for sensing a feature of an object in an interactive video display |

| JP2007017364A (ja) * | 2005-07-11 | 2007-01-25 | Kyoto Univ | シルエット抽出装置及び該方法並びに3次元形状データ生成装置及び該方法 |

| US20070018989A1 (en) * | 2005-07-20 | 2007-01-25 | Playmotion, Llc | Sensory integration therapy system and associated method of use |

| FR2889303B1 (fr) * | 2005-07-26 | 2008-07-11 | Airbus France Sas | Procede de mesure d'une anomalie de forme sur un panneau d'une structure d'aeronef et systeme de mise en oeuvre |

| US8625845B2 (en) * | 2005-08-06 | 2014-01-07 | Quantum Signal, Llc | Overlaying virtual content onto video stream of people within venue based on analysis of the people within the video stream |

| TWI412392B (zh) * | 2005-08-12 | 2013-10-21 | Koninkl Philips Electronics Nv | 互動式娛樂系統及其操作方法 |

| US7911444B2 (en) | 2005-08-31 | 2011-03-22 | Microsoft Corporation | Input method for surface of interactive display |

| US20070063981A1 (en) * | 2005-09-16 | 2007-03-22 | Galyean Tinsley A Iii | System and method for providing an interactive interface |

| US7917148B2 (en) | 2005-09-23 | 2011-03-29 | Outland Research, Llc | Social musical media rating system and method for localized establishments |

| US8176101B2 (en) | 2006-02-07 | 2012-05-08 | Google Inc. | Collaborative rejection of media for physical establishments |

| US7697827B2 (en) | 2005-10-17 | 2010-04-13 | Konicek Jeffrey C | User-friendlier interfaces for a camera |

| US8098277B1 (en) | 2005-12-02 | 2012-01-17 | Intellectual Ventures Holding 67 Llc | Systems and methods for communication between a reactive video system and a mobile communication device |

| US20070145680A1 (en) * | 2005-12-15 | 2007-06-28 | Outland Research, Llc | Shake Responsive Portable Computing Device for Simulating a Randomization Object Used In a Game Of Chance |

| AT503008B1 (de) * | 2005-12-16 | 2008-09-15 | Dobler & Stampfl Audite Oeg | Interaktives optisches system und verfahren zum extrahieren und verwerten von interaktionen in einem optischen system |

| US7630002B2 (en) * | 2007-01-05 | 2009-12-08 | Microsoft Corporation | Specular reflection reduction using multiple cameras |

| DE102006002602A1 (de) | 2006-01-13 | 2007-07-19 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Kalibrierungsverfahren und Kalibrierungssystem |

| EP1983402A4 (en) * | 2006-02-03 | 2013-06-26 | Panasonic Corp | INPUT DEVICE AND ITS METHOD |

| US9823747B2 (en) | 2006-02-08 | 2017-11-21 | Oblong Industries, Inc. | Spatial, multi-modal control device for use with spatial operating system |

| US9075441B2 (en) * | 2006-02-08 | 2015-07-07 | Oblong Industries, Inc. | Gesture based control using three-dimensional information extracted over an extended depth of field |

| US9910497B2 (en) * | 2006-02-08 | 2018-03-06 | Oblong Industries, Inc. | Gestural control of autonomous and semi-autonomous systems |

| US8370383B2 (en) | 2006-02-08 | 2013-02-05 | Oblong Industries, Inc. | Multi-process interactive systems and methods |

| US8537112B2 (en) * | 2006-02-08 | 2013-09-17 | Oblong Industries, Inc. | Control system for navigating a principal dimension of a data space |

| US8537111B2 (en) * | 2006-02-08 | 2013-09-17 | Oblong Industries, Inc. | Control system for navigating a principal dimension of a data space |

| US8531396B2 (en) | 2006-02-08 | 2013-09-10 | Oblong Industries, Inc. | Control system for navigating a principal dimension of a data space |

| ITRM20060136A1 (it) * | 2006-03-10 | 2007-09-11 | Link Formazione S R L | Sistema multimediale interattivo |

| US8930834B2 (en) * | 2006-03-20 | 2015-01-06 | Microsoft Corporation | Variable orientation user interface |

| WO2007107874A2 (en) * | 2006-03-22 | 2007-09-27 | Home Focus Development Ltd | Interactive playmat |

| US8139059B2 (en) * | 2006-03-31 | 2012-03-20 | Microsoft Corporation | Object illumination in a virtual environment |

| KR100742664B1 (ko) * | 2006-05-10 | 2007-07-25 | 주식회사 플러 | 인터랙티브 영상의 디스플레이 시스템 및 방법 |

| CN101657825B (zh) * | 2006-05-11 | 2014-02-19 | 普莱姆传感有限公司 | 根据深度图对人形进行建模 |

| US7724952B2 (en) * | 2006-05-15 | 2010-05-25 | Microsoft Corporation | Object matting using flash and no-flash images |