JP2005123775A - 再生装置、再生方法、再生プログラムおよび記録媒体 - Google Patents

再生装置、再生方法、再生プログラムおよび記録媒体 Download PDFInfo

- Publication number

- JP2005123775A JP2005123775A JP2003354741A JP2003354741A JP2005123775A JP 2005123775 A JP2005123775 A JP 2005123775A JP 2003354741 A JP2003354741 A JP 2003354741A JP 2003354741 A JP2003354741 A JP 2003354741A JP 2005123775 A JP2005123775 A JP 2005123775A

- Authority

- JP

- Japan

- Prior art keywords

- image data

- storage means

- plane

- recording medium

- moving image

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/76—Television signal recording

- H04N5/91—Television signal processing therefor

- H04N5/93—Regeneration of the television signal or of selected parts thereof

- H04N5/9305—Regeneration of the television signal or of selected parts thereof involving the mixing of the reproduced video signal with a non-recorded signal, e.g. a text signal

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/44—Receiver circuitry for the reception of television signals according to analogue transmission standards

- H04N5/445—Receiver circuitry for the reception of television signals according to analogue transmission standards for displaying additional information

- H04N5/45—Picture in picture, e.g. displaying simultaneously another television channel in a region of the screen

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B20/00—Signal processing not specific to the method of recording or reproducing; Circuits therefor

- G11B20/10—Digital recording or reproducing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/431—Generation of visual interfaces for content selection or interaction; Content or additional data rendering

- H04N21/4312—Generation of visual interfaces for content selection or interaction; Content or additional data rendering involving specific graphical features, e.g. screen layout, special fonts or colors, blinking icons, highlights or animations

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/431—Generation of visual interfaces for content selection or interaction; Content or additional data rendering

- H04N21/4312—Generation of visual interfaces for content selection or interaction; Content or additional data rendering involving specific graphical features, e.g. screen layout, special fonts or colors, blinking icons, highlights or animations

- H04N21/4314—Generation of visual interfaces for content selection or interaction; Content or additional data rendering involving specific graphical features, e.g. screen layout, special fonts or colors, blinking icons, highlights or animations for fitting data in a restricted space on the screen, e.g. EPG data in a rectangular grid

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/431—Generation of visual interfaces for content selection or interaction; Content or additional data rendering

- H04N21/4312—Generation of visual interfaces for content selection or interaction; Content or additional data rendering involving specific graphical features, e.g. screen layout, special fonts or colors, blinking icons, highlights or animations

- H04N21/4316—Generation of visual interfaces for content selection or interaction; Content or additional data rendering involving specific graphical features, e.g. screen layout, special fonts or colors, blinking icons, highlights or animations for displaying supplemental content in a region of the screen, e.g. an advertisement in a separate window

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/44—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream or rendering scenes according to encoded video stream scene graphs

- H04N21/4402—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream or rendering scenes according to encoded video stream scene graphs involving reformatting operations of video signals for household redistribution, storage or real-time display

- H04N21/440218—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream or rendering scenes according to encoded video stream scene graphs involving reformatting operations of video signals for household redistribution, storage or real-time display by transcoding between formats or standards, e.g. from MPEG-2 to MPEG-4

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/272—Means for inserting a foreground image in a background image, i.e. inlay, outlay

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/44—Receiver circuitry for the reception of television signals according to analogue transmission standards

- H04N5/445—Receiver circuitry for the reception of television signals according to analogue transmission standards for displaying additional information

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/76—Television signal recording

- H04N5/91—Television signal processing therefor

- H04N5/92—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback

- H04N5/926—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback by pulse code modulation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/76—Television signal recording

- H04N5/91—Television signal processing therefor

- H04N5/93—Regeneration of the television signal or of selected parts thereof

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/79—Processing of colour television signals in connection with recording

- H04N9/80—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback

- H04N9/82—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback the individual colour picture signal components being recorded simultaneously only

- H04N9/8205—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback the individual colour picture signal components being recorded simultaneously only involving the multiplexing of an additional signal and the colour video signal

- H04N9/8227—Transformation of the television signal for recording, e.g. modulation, frequency changing; Inverse transformation for playback the individual colour picture signal components being recorded simultaneously only involving the multiplexing of an additional signal and the colour video signal the additional signal being at least another television signal

Landscapes

- Engineering & Computer Science (AREA)

- Signal Processing (AREA)

- Multimedia (AREA)

- Business, Economics & Management (AREA)

- Marketing (AREA)

- Controls And Circuits For Display Device (AREA)

- Studio Circuits (AREA)

- Television Signal Processing For Recording (AREA)

- Signal Processing For Digital Recording And Reproducing (AREA)

- Indexing, Searching, Synchronizing, And The Amount Of Synchronization Travel Of Record Carriers (AREA)

- Management Or Editing Of Information On Record Carriers (AREA)

Abstract

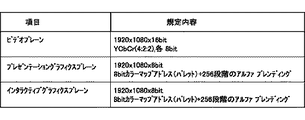

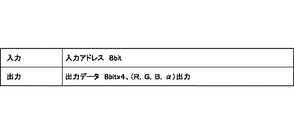

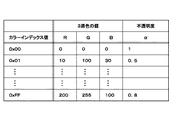

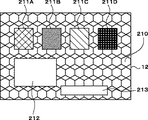

【解決手段】 それぞれ動画、字幕およびグラフィクスを表示するプレーン10、11および12に対して、動画を表示する第2ビデオプレーン50を追加する。第2ビデオプレーン50およびビデオプレーン10の出力は、スイッチ51により画素単位で選択される。第2ビデオプレーン50に縮小動画データを格納し、スイッチ51を縮小動画データの表示位置に対応して画素単位で切り替え制御することで、ビデオプレーン10の動画データに対して第2ビデオプレーン50の縮小動画データが子画面表示される。ビデオプレーン10に、動画データの代わりに壁紙画像データを格納することで、恰も縮小動画データの背景に壁紙が表示されているかのような表示画面が得られる。

【選択図】 図8

Description

(1)ピクチャインピクチャ機能。

(2)動画データを縮小し、表示領域中の任意の位置へ表示させる。

(3)(2)の縮小表示の際の縮小表示された動画データ以外の部分(背景)に対して壁紙を表示させる。

(1)各プレーンの表示に対して最も奥に表示される。

(2)ビデオプレーン10上に表示される動画201のサイズ変更に応じて、背景を隙間無く埋め尽くして表示される。

(3)インタラクティブグラフィクスプレーン12に表示されるGUIの部品の背景として表示される。

11 プレゼンテーショングラフィクスプレーン

12 インタラクティブグラフィクスプレーン

21,23,25,28 乗算器

24,29 加算器

50 第2ビデオプレーン

51 スイッチ

100 プレーヤデコーダ

106 マルチメディアエンジン

116 グラフィクスデコーダA

117 グラフィクスデコーダB

120 MPEGビデオデコーダ

132 グラフィクスプレーンA

133 グラフィクスプレーンB

134 ビデオプレーン

160 第2ビデオプレーン

200 壁紙画像

201 動画

202A,202B 部品

210 壁紙画像

211A,211B,211C,211D 部品

220 画像出力部

221A,221B フレームバッファ

222A,222B ダウンコンバータ

223 スイッチ

230 子画面

301 CPU

302 DRAM

303 グラフィクス部

304 VRAM

Claims (19)

- 円盤状記録媒体に記録されたコンテンツデータを再生する再生装置において、

記録媒体から再生された第1の動画データを格納する第1の記憶手段と、

記録媒体から再生された第2の動画データを格納する第2の記憶手段と、

上記第1の記憶手段および上記第2の記憶手段の出力を所定領域単位で選択する選択手段と

を有し、

上記選択手段の出力に基づき表示信号を生成するようにしたことを特徴とする再生装置。 - 請求項1に記載の再生装置において、

上記所定領域は、画素であることを特徴とする再生装置。 - 請求項1に記載の再生装置において、

上記第1の記憶手段および上記第2の記憶手段は、プレーンメモリであることを特徴とする再生装置。 - 請求項3に記載の再生装置において、

上記第1の記憶手段および上記第2の記憶手段のうち一方に、対応する上記動画データが縮小された縮小動画データが表示位置に対応して格納され、上記選択手段は、上記縮小動画データの上記表示位置に対応して上記選択を行うようにしたことを特徴とする再生装置。 - 請求項4に記載の再生装置において、

上記第1の記憶手段および上記第2の記憶手段のうち他方は、上記動画データの代わりに壁紙画像データが格納されるようにしたことを特徴とする再生装置。 - 請求項3に記載の再生装置において、

上記選択手段の出力と上記記録媒体から再生された字幕データとを合成する第1の合成手段と、

上記第1の合成手段の出力と上記記録媒体から再生された画像データとを合成する第2の合成手段と

をさらに有することを特徴とする再生装置。 - 請求項6に記載の再生装置において、

上記第1の合成手段による上記合成の度合いは、上記字幕データに応じて制御されることを特徴とする再生装置。 - 請求項6に記載の再生装置において、

上記第2の合成手段による上記合成の度合いは、上記画像データに応じて制御されることを特徴とする再生装置。 - 請求項1に記載の再生装置において、

上記第1の記憶手段および上記第2の記憶手段は、フレームメモリであって、上記選択手段の出力がプレーンメモリに供給されるようにしたことを特徴とする再生装置。 - 請求項9に記載の再生装置において、

上記第1の記憶手段または上記第2の記憶手段から出力された動画データを縮小した縮小動画データを、上記選択手段により該縮小動画データの表示位置に対応して上記選択し、上記プレーンメモリに供給するようにしたことを特徴とする再生装置。 - 請求項10に記載の再生装置において、

上記プレーンメモリの出力と上記記録媒体から再生された字幕データとを合成する第1の合成手段と、

上記第1の合成手段の出力と上記記録媒体から再生された画像データとを合成する第2の合成手段と

をさらに有することを特徴とする再生装置。 - 請求項11に記載の再生装置において、

上記第1の合成手段による上記合成の度合いは、上記字幕データに応じて制御されることを特徴とする再生装置。 - 請求項11に記載の再生装置において、

上記第2の合成手段による上記合成の度合いは、上記画像データに応じて制御されることを特徴とする再生装置。 - 請求項11に記載の再生装置において、

上記第2の合成手段で上記第1の合成手段の出力が合成される上記画像データに対して、上記第1の合成手段の出力を透過表示させる透明領域を上記縮小動画データの上記表示位置に対応して設けるようにしたことを特徴とする再生装置。 - 請求項14に記載の再生装置において、

上記画像データの上記透明領域以外の領域に壁紙画像を表示するようにしたことを特徴とする再生装置。 - 請求項15に記載の再生装置において、

上記第2の合成手段の出力に対して、さらに部品画像が表示され、上記壁紙画像は、上記透明領域および上記部品画像の表示領域以外の領域に表示されるようにしたことを特徴とする再生装置。 - 円盤状記録媒体に記録されたコンテンツデータを再生する再生方法において、

記録媒体から再生された第1の動画データを第1の記憶手段に格納するステップと、

記録媒体から再生された第2の動画データを第2の記憶手段に格納するステップと、

上記第1の記憶手段および上記第2の記憶手段の出力を所定領域単位で選択する選択のステップと

を有し、

上記選択のステップによる出力に基づき表示信号を生成するようにしたことを特徴とする再生方法。 - 円盤状記録媒体に記録されたコンテンツデータを再生する再生方法をコンピュータ装置に実行させる再生プログラムにおいて、

上記再生方法は、

記録媒体から再生された第1の動画データを第1の記憶手段に格納するステップと、

記録媒体から再生された第2の動画データを第2の記憶手段に格納するステップと、

上記第1の記憶手段および上記第2の記憶手段の出力を所定領域単位で選択する選択のステップと

を有し、

上記選択のステップによる出力に基づき表示信号を生成するようにしたことを特徴とする再生プログラム。 - 円盤状記録媒体に記録されたコンテンツデータを再生する再生方法をコンピュータ装置に実行させる再生プログラムが記録されたコンピュータ装置が読み取り可能な記録媒体において、

上記再生方法は、

記録媒体から再生された第1の動画データを第1の記憶手段に格納するステップと、

記録媒体から再生された第2の動画データを第2の記憶手段に格納するステップと、

上記第1の記憶手段および上記第2の記憶手段の出力を所定領域単位で選択する選択のステップと

を有し、

上記選択のステップによる出力に基づき表示信号を生成するようにしたことを特徴とする記録媒体。

Priority Applications (7)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003354741A JP2005123775A (ja) | 2003-10-15 | 2003-10-15 | 再生装置、再生方法、再生プログラムおよび記録媒体 |

| CNA2004800284718A CN1860785A (zh) | 2003-10-15 | 2004-09-16 | 再现设备、再现方法、再现程序、以及记录介质 |

| US10/574,582 US8204357B2 (en) | 2003-10-15 | 2004-09-16 | Reproducing device, reproducing method, reproducing program and recording medium |

| EP04773378A EP1675395A4 (en) | 2003-10-15 | 2004-09-16 | PLAYING DEVICE, PLAYING PROCESS, PLAY PROGRAM AND RECORDING MEDIUM |

| MXPA06003719A MXPA06003719A (es) | 2003-10-15 | 2004-09-16 | Aparato y reproduccion, metodo de reproduccion, programa de reproduccion, y medio de registro. |

| KR1020067007240A KR101038631B1 (ko) | 2003-10-15 | 2004-09-16 | 재생 장치, 재생 방법 및 기록 매체 |

| PCT/JP2004/013988 WO2005039177A1 (ja) | 2003-10-15 | 2004-09-16 | 再生装置、再生方法、再生プログラムおよび記録媒体 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003354741A JP2005123775A (ja) | 2003-10-15 | 2003-10-15 | 再生装置、再生方法、再生プログラムおよび記録媒体 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2005123775A true JP2005123775A (ja) | 2005-05-12 |

Family

ID=34463148

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2003354741A Pending JP2005123775A (ja) | 2003-10-15 | 2003-10-15 | 再生装置、再生方法、再生プログラムおよび記録媒体 |

Country Status (7)

| Country | Link |

|---|---|

| US (1) | US8204357B2 (ja) |

| EP (1) | EP1675395A4 (ja) |

| JP (1) | JP2005123775A (ja) |

| KR (1) | KR101038631B1 (ja) |

| CN (1) | CN1860785A (ja) |

| MX (1) | MXPA06003719A (ja) |

| WO (1) | WO2005039177A1 (ja) |

Cited By (14)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2007074476A (ja) * | 2005-09-08 | 2007-03-22 | Sanyo Electric Co Ltd | 携帯電話機 |

| JP2007325242A (ja) * | 2005-08-09 | 2007-12-13 | Matsushita Electric Ind Co Ltd | 記録媒体、再生装置、方法、プログラム |

| JP2009140603A (ja) * | 2007-12-11 | 2009-06-25 | Hitachi Ltd | 記録装置及び再生装置及び記録媒体 |

| WO2009081650A1 (ja) * | 2007-12-26 | 2009-07-02 | Nec Corporation | 画像表示システム、画像表示方法及び記録媒体 |

| WO2009081682A1 (ja) * | 2007-12-26 | 2009-07-02 | Nec Corporation | 画像表示システム、画像表示方法及び記録媒体 |

| WO2009098895A1 (ja) * | 2008-02-07 | 2009-08-13 | Panasonic Corporation | 映像信号処理方法、集積回路および映像再生装置 |

| US7630018B2 (en) | 2005-04-15 | 2009-12-08 | Sony Corporation | On-screen display apparatus and on-screen display generation method |

| JP2010063131A (ja) * | 2005-08-09 | 2010-03-18 | Panasonic Corp | 記録媒体、再生装置 |

| JP2010512564A (ja) * | 2006-11-30 | 2010-04-22 | ソニー エリクソン モバイル コミュニケーションズ, エービー | マルチメディアコンテンツとデコーディング手段とのバンドル |

| EP2200287A2 (en) | 2005-07-27 | 2010-06-23 | Sharp Kabushiki Kaisha | Video synthesis device and program |

| JP2010244244A (ja) * | 2009-04-03 | 2010-10-28 | Sony Corp | 情報処理装置、情報処理方法、及び、プログラム |

| JP2011097612A (ja) * | 2006-12-14 | 2011-05-12 | Panasonic Corp | 動画像符号化方法、動画像符号化装置、動画像記録方法、動画像再生方法および動画像再生装置 |

| JP2012213197A (ja) * | 2004-04-22 | 2012-11-01 | Technicolor Inc | ディジタル多用途ディスクのためのコンテキスト依存のマルチアングル・ナビゲーション技術 |

| US8401368B2 (en) | 2005-06-20 | 2013-03-19 | Sharp Kabushiki Kaisha | Video data reproducing apparatus, video data generating apparatus and recording medium |

Families Citing this family (39)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2007048348A (ja) * | 2005-08-08 | 2007-02-22 | Toshiba Corp | 情報記憶媒体、情報再生装置、情報再生方法、及び情報再生プログラム |

| JP4199280B2 (ja) | 2005-08-10 | 2008-12-17 | 三菱電機株式会社 | 映像情報再生方法、および映像情報再生装置 |

| EP2073540A4 (en) * | 2006-10-10 | 2011-06-08 | Nikon Corp | PICTURE PROCESSING PROGRAM, PICTURE PROCESSING APPARATUS AND PICTURE PROCESSING METHOD |

| JP2009027552A (ja) * | 2007-07-20 | 2009-02-05 | Funai Electric Co Ltd | 光ディスク再生装置 |

| US8169449B2 (en) * | 2007-10-19 | 2012-05-01 | Qnx Software Systems Limited | System compositing images from multiple applications |

| KR101315415B1 (ko) * | 2007-12-06 | 2013-10-07 | 삼성전자주식회사 | 영상처리장치 및 그 제어방법 |

| JP2010028456A (ja) * | 2008-07-18 | 2010-02-04 | Sony Corp | データ構造、再生装置および方法、並びにプログラム |

| CN101800042A (zh) * | 2009-02-06 | 2010-08-11 | 中兴通讯股份有限公司 | 使多媒体应用与其他应用在并发时同时显示的方法及装置 |

| US20100201879A1 (en) * | 2009-02-12 | 2010-08-12 | Echostar Technologies L.L.C. | Customizable Picture-in-Picture |

| JP5820276B2 (ja) * | 2009-02-17 | 2015-11-24 | コーニンクレッカ フィリップス エヌ ヴェKoninklijke Philips N.V. | 3d画像及びグラフィカル・データの結合 |

| US8976187B2 (en) * | 2009-04-01 | 2015-03-10 | 2236008 Ontario, Inc. | System for accelerating composite graphics rendering |

| US8208790B2 (en) | 2009-05-19 | 2012-06-26 | Panasonic Corporation | Recording medium, reproducing device, encoding device, integrated circuit, and reproduction output device |

| US8290338B2 (en) * | 2009-05-27 | 2012-10-16 | Panasonic Corporation | Recording medium, playback device, encoding device, integrated circuit, and playback output device |

| BRPI1005171A2 (pt) * | 2009-06-17 | 2019-07-02 | Panasonic Corp | meio de gravação de informações e dispositivo de reprodução destinado à reprodução de imagens em 3d |

| US20110013888A1 (en) * | 2009-06-18 | 2011-01-20 | Taiji Sasaki | Information recording medium and playback device for playing back 3d images |

| EP2442550B1 (en) * | 2010-10-14 | 2015-06-17 | Sony Corporation | Image capturing device, system and method |

| WO2012112090A1 (en) | 2011-02-17 | 2012-08-23 | Saab Ab | Flight data display |

| US8724029B2 (en) * | 2011-05-26 | 2014-05-13 | Adobe Systems Incorporated | Accelerating video from an arbitrary graphical layer |

| KR20130094044A (ko) * | 2012-02-15 | 2013-08-23 | 삼성전자주식회사 | 영상 표시 장치에서 자막 속성을 변경하기 위한 장치 및 방법 |

| US9691359B2 (en) | 2012-10-15 | 2017-06-27 | Saab Ab | Vehicle display system with transparent display layer |

| US9537811B2 (en) | 2014-10-02 | 2017-01-03 | Snap Inc. | Ephemeral gallery of ephemeral messages |

| US9396354B1 (en) | 2014-05-28 | 2016-07-19 | Snapchat, Inc. | Apparatus and method for automated privacy protection in distributed images |

| US9113301B1 (en) | 2014-06-13 | 2015-08-18 | Snapchat, Inc. | Geo-location based event gallery |

| US10824654B2 (en) | 2014-09-18 | 2020-11-03 | Snap Inc. | Geolocation-based pictographs |

| US11216869B2 (en) | 2014-09-23 | 2022-01-04 | Snap Inc. | User interface to augment an image using geolocation |

| US10284508B1 (en) | 2014-10-02 | 2019-05-07 | Snap Inc. | Ephemeral gallery of ephemeral messages with opt-in permanence |

| US10311916B2 (en) | 2014-12-19 | 2019-06-04 | Snap Inc. | Gallery of videos set to an audio time line |

| US9385983B1 (en) | 2014-12-19 | 2016-07-05 | Snapchat, Inc. | Gallery of messages from individuals with a shared interest |

| US10133705B1 (en) | 2015-01-19 | 2018-11-20 | Snap Inc. | Multichannel system |

| EP4325806A3 (en) | 2015-03-18 | 2024-05-22 | Snap Inc. | Geo-fence authorization provisioning |

| US10135949B1 (en) * | 2015-05-05 | 2018-11-20 | Snap Inc. | Systems and methods for story and sub-story navigation |

| JP6657652B2 (ja) * | 2015-08-12 | 2020-03-04 | 富士ゼロックス株式会社 | 駆動力伝達装置及び画像形成装置 |

| US10354425B2 (en) | 2015-12-18 | 2019-07-16 | Snap Inc. | Method and system for providing context relevant media augmentation |

| CN105635772A (zh) * | 2015-12-30 | 2016-06-01 | 北京奇艺世纪科技有限公司 | 画中画视频播放方法和支持画中画视频播放的移动终端 |

| US10581782B2 (en) | 2017-03-27 | 2020-03-03 | Snap Inc. | Generating a stitched data stream |

| US10582277B2 (en) | 2017-03-27 | 2020-03-03 | Snap Inc. | Generating a stitched data stream |

| CN109272565A (zh) * | 2017-07-18 | 2019-01-25 | 腾讯科技(深圳)有限公司 | 动画播放方法、装置、存储介质以及终端 |

| KR102580344B1 (ko) | 2019-01-02 | 2023-09-19 | 삼성전자주식회사 | 여러 타입의 컨텐츠를 출력하기 위한 디스플레이 장치 |

| US12177509B2 (en) * | 2023-05-07 | 2024-12-24 | Yahoo Ad Tech Llc | System and method for labeling and presenting content |

Family Cites Families (44)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US4218710A (en) * | 1978-05-15 | 1980-08-19 | Nippon Electric Company, Ltd. | Digital video effect system comprising only one memory of a conventional capacity |

| GB2063616B (en) * | 1979-11-16 | 1984-06-20 | Quantel Ltd | Multiple picture image manipulation |

| JPS59114581A (ja) | 1982-12-21 | 1984-07-02 | 三菱電機株式会社 | デイスプレイ装置 |

| JPS6159481A (ja) | 1984-08-31 | 1986-03-26 | 株式会社東芝 | 表示画面切換え制御方式 |

| US4961153A (en) * | 1987-08-18 | 1990-10-02 | Hewlett Packard Company | Graphics frame buffer with strip Z buffering and programmable Z buffer location |

| JPH03251893A (ja) | 1990-03-01 | 1991-11-11 | Toshiba Corp | 画像表示制御装置 |

| JPH04220693A (ja) * | 1990-03-14 | 1992-08-11 | Hewlett Packard Co <Hp> | 画素単位のディジタル画像混合装置 |

| JPH04248591A (ja) | 1991-02-04 | 1992-09-04 | Nippon Telegr & Teleph Corp <Ntt> | 動画ウィンドウ表示装置 |

| JPH0614300A (ja) | 1991-03-18 | 1994-01-21 | Dainippon Printing Co Ltd | 電子出版システムにおける補助パターン表示方式 |

| DE4114440A1 (de) * | 1991-05-03 | 1992-11-05 | Broadcast Television Syst | Einrichtung zum mischen von videosignalen |

| US5530797A (en) * | 1992-04-09 | 1996-06-25 | Matsushita Electric Industrial Co., Ltd. | Workstation for simultaneously displaying overlapped windows using a priority control register |

| US5315390A (en) * | 1993-04-02 | 1994-05-24 | The Grass Valley Group, Inc. | Simple compositing system which processes one frame of each sequence of frames in turn and combines them in parallel to create the final composite sequence |

| JP3543978B2 (ja) | 1993-07-23 | 2004-07-21 | ソニー株式会社 | デジタル画像信号の伝送装置、受信装置およびデジタル画像信号の記録装置、再生装置 |

| JP3289449B2 (ja) | 1993-12-10 | 2002-06-04 | 松下電器産業株式会社 | 放送受信装置 |

| JPH09284692A (ja) | 1996-04-10 | 1997-10-31 | Olympus Optical Co Ltd | 画像再生装置 |

| US6558049B1 (en) * | 1996-06-13 | 2003-05-06 | Texas Instruments Incorporated | System for processing video in computing devices that multiplexes multiple video streams into a single video stream which is input to a graphics controller |

| KR100225063B1 (ko) | 1996-10-17 | 1999-10-15 | 윤종용 | 다중비디오출력장치(Multiple Video Displayer) |

| JPH10145735A (ja) * | 1996-11-05 | 1998-05-29 | Toshiba Corp | 復号装置および画像/音声再生方法 |

| JP3742167B2 (ja) * | 1996-12-18 | 2006-02-01 | 株式会社東芝 | 画像表示制御装置 |

| JP3791114B2 (ja) | 1997-04-30 | 2006-06-28 | ソニー株式会社 | 信号再生装置及び方法 |

| JPH11355714A (ja) | 1998-06-11 | 1999-12-24 | Toshiba Corp | 映像再生装置と映像データ記録方式 |

| CN1165165C (zh) * | 1998-10-12 | 2004-09-01 | 松下电器产业株式会社 | 信息记录介质及用于记录或再现数据的装置和方法 |

| US6414996B1 (en) * | 1998-12-08 | 2002-07-02 | Stmicroelectronics, Inc. | System, method and apparatus for an instruction driven digital video processor |

| KR100306977B1 (ko) * | 1998-12-15 | 2001-11-30 | 김용두 | 영상음향복합재생시스템 |

| JP3382170B2 (ja) * | 1998-12-25 | 2003-03-04 | 株式会社東芝 | マルチウインドウ画像表示装置 |

| US6741794B1 (en) * | 1999-01-29 | 2004-05-25 | Sony Corporation | System and method for flexibly blending multiple image planes in a video device |

| US6359631B2 (en) | 1999-02-16 | 2002-03-19 | Intel Corporation | Method of enabling display transparency for application programs without native transparency support |

| US7623140B1 (en) * | 1999-03-05 | 2009-11-24 | Zoran Corporation | Method and apparatus for processing video and graphics data to create a composite output image having independent and separate layers of video and graphics |

| EP1133869A1 (en) * | 1999-09-25 | 2001-09-19 | Koninklijke Philips Electronics N.V. | User interface generation |

| JP2001189703A (ja) | 1999-10-22 | 2001-07-10 | Hitachi Ltd | 衛星データ放送システム、衛星データ放送方法、衛星データ放送装置、衛星データ放送受信装置 |

| US6493036B1 (en) | 1999-11-17 | 2002-12-10 | Teralogic, Inc. | System and method for scaling real time video |

| AU2710201A (en) | 2000-01-24 | 2001-07-31 | Matsushita Electric Industrial Co., Ltd. | Image composting apparatus, recording medium and program |

| US7054539B2 (en) * | 2000-02-09 | 2006-05-30 | Canon Kabushiki Kaisha | Image processing method and apparatus |

| JP2001238094A (ja) | 2000-02-25 | 2001-08-31 | Canon Inc | 画像処理装置および画像再生装置 |

| JP2003101957A (ja) | 2001-09-19 | 2003-04-04 | Matsushita Electric Ind Co Ltd | マルチアングル再生装置 |

| JP3826039B2 (ja) * | 2002-01-22 | 2006-09-27 | キヤノン株式会社 | 信号処理装置 |

| JP3874730B2 (ja) | 2002-01-24 | 2007-01-31 | シャープ株式会社 | 動画像再生装置 |

| JP2003234974A (ja) | 2002-02-08 | 2003-08-22 | Mitsubishi Electric Corp | 表示制御装置および表示制御方法 |

| US20030156824A1 (en) * | 2002-02-21 | 2003-08-21 | Koninklijke Philips Electronics N.V. | Simultaneous viewing of time divided segments of a tv program |

| JP4573491B2 (ja) | 2002-02-28 | 2010-11-04 | 三洋電機株式会社 | 画像処理装置および画像処理方法 |

| JP2003283925A (ja) * | 2002-03-20 | 2003-10-03 | Sony Corp | 画像合成装置及び方法 |

| US7676142B1 (en) * | 2002-06-07 | 2010-03-09 | Corel Inc. | Systems and methods for multimedia time stretching |

| US7463311B2 (en) * | 2002-09-09 | 2008-12-09 | General Instrument Corporation | Method and system for including non-graphic data in an analog video output signal of a set-top box |

| US8112711B2 (en) * | 2003-10-06 | 2012-02-07 | Disney Enterprises, Inc. | System and method of playback and feature control for video players |

-

2003

- 2003-10-15 JP JP2003354741A patent/JP2005123775A/ja active Pending

-

2004

- 2004-09-16 EP EP04773378A patent/EP1675395A4/en not_active Ceased

- 2004-09-16 KR KR1020067007240A patent/KR101038631B1/ko not_active Expired - Fee Related

- 2004-09-16 WO PCT/JP2004/013988 patent/WO2005039177A1/ja not_active Ceased

- 2004-09-16 MX MXPA06003719A patent/MXPA06003719A/es active IP Right Grant

- 2004-09-16 US US10/574,582 patent/US8204357B2/en not_active Expired - Fee Related

- 2004-09-16 CN CNA2004800284718A patent/CN1860785A/zh active Pending

Cited By (38)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2012213197A (ja) * | 2004-04-22 | 2012-11-01 | Technicolor Inc | ディジタル多用途ディスクのためのコンテキスト依存のマルチアングル・ナビゲーション技術 |

| US7630018B2 (en) | 2005-04-15 | 2009-12-08 | Sony Corporation | On-screen display apparatus and on-screen display generation method |

| US8401368B2 (en) | 2005-06-20 | 2013-03-19 | Sharp Kabushiki Kaisha | Video data reproducing apparatus, video data generating apparatus and recording medium |

| US8836803B2 (en) | 2005-07-27 | 2014-09-16 | Sharp Kabushiki Kaisha | Video synthesizing apparatus and program |

| US8743228B2 (en) | 2005-07-27 | 2014-06-03 | Sharp Kabushiki Kaisha | Video synthesizing apparatus and program |

| US8736698B2 (en) | 2005-07-27 | 2014-05-27 | Sharp Kabushiki Kaisha | Video synthesizing apparatus and program |

| US8687121B2 (en) | 2005-07-27 | 2014-04-01 | Sharp Kabushiki Kaisha | Video synthesizing apparatus and program |

| EP2200289A2 (en) | 2005-07-27 | 2010-06-23 | Sharp Kabushiki Kaisha | Video synthesis device and program |

| US8836804B2 (en) | 2005-07-27 | 2014-09-16 | Sharp Kabushiki Kaisha | Video synthesizing apparatus and program |

| US9100619B2 (en) | 2005-07-27 | 2015-08-04 | Sharp Kabushiki Kaisha | Video synthesizing apparatus and program |

| EP2200290A2 (en) | 2005-07-27 | 2010-06-23 | Sharp Kabushiki Kaisha | Video synthesis device and program |

| EP2200287A2 (en) | 2005-07-27 | 2010-06-23 | Sharp Kabushiki Kaisha | Video synthesis device and program |

| EP2200288A2 (en) | 2005-07-27 | 2010-06-23 | Sharp Kabushiki Kaisha | Video synthesis device and program |

| US8335424B2 (en) | 2005-08-09 | 2012-12-18 | Panasonic Corporation | Recording medium, playback apparatus, method and program |

| US8301017B2 (en) | 2005-08-09 | 2012-10-30 | Panasonic Corporation | Recording medium, playback apparatus, method and program |

| JP2007325242A (ja) * | 2005-08-09 | 2007-12-13 | Matsushita Electric Ind Co Ltd | 記録媒体、再生装置、方法、プログラム |

| KR101375067B1 (ko) | 2005-08-09 | 2014-03-17 | 파나소닉 주식회사 | 기록매체, 재생장치, 재생방법, 프로그램 |

| US8452165B2 (en) | 2005-08-09 | 2013-05-28 | Panasonic Corporation | Recording medium, playback apparatus, method and program |

| US8331773B2 (en) | 2005-08-09 | 2012-12-11 | Panasonic Corporation | Recording medium, playback apparatus, method and program |

| JP2010063131A (ja) * | 2005-08-09 | 2010-03-18 | Panasonic Corp | 記録媒体、再生装置 |

| US8275234B2 (en) | 2005-08-09 | 2012-09-25 | Panasonic Corporation | Recording medium, playback apparatus, method and program |

| US8280232B2 (en) | 2005-08-09 | 2012-10-02 | Panasonic Corporation | Recording medium, playback apparatus, method and program |

| JP2007074476A (ja) * | 2005-09-08 | 2007-03-22 | Sanyo Electric Co Ltd | 携帯電話機 |

| JP2010512564A (ja) * | 2006-11-30 | 2010-04-22 | ソニー エリクソン モバイル コミュニケーションズ, エービー | マルチメディアコンテンツとデコーディング手段とのバンドル |

| JP4718616B2 (ja) * | 2006-12-14 | 2011-07-06 | パナソニック株式会社 | 動画像符号化方法、動画像符号化装置、動画像記録方法、動画像再生方法および動画像再生装置 |

| JP2011097612A (ja) * | 2006-12-14 | 2011-05-12 | Panasonic Corp | 動画像符号化方法、動画像符号化装置、動画像記録方法、動画像再生方法および動画像再生装置 |

| US7974521B2 (en) | 2006-12-14 | 2011-07-05 | Panasonic Corporation | Moving image coding method, moving image coding device, moving image recording method, recording medium, moving image playback method, moving image playback device, and moving image playback system |

| JP2011103669A (ja) * | 2006-12-14 | 2011-05-26 | Panasonic Corp | 動画像符号化方法、動画像符号化装置、動画像記録方法、動画像再生方法および動画像再生装置 |

| US8023804B2 (en) | 2006-12-14 | 2011-09-20 | Panasonic Corporation | Moving image coding method, moving image coding device, moving image recording method, recording medium, moving image playback method, moving image playback device, and moving image playback system |

| US8526797B2 (en) | 2006-12-14 | 2013-09-03 | Panasonic Corporation | Moving image coding method, moving image coding device, moving image recording method, recording medium, moving image playback method, moving image playback device, and moving image playback system |

| JP2009140603A (ja) * | 2007-12-11 | 2009-06-25 | Hitachi Ltd | 記録装置及び再生装置及び記録媒体 |

| WO2009081682A1 (ja) * | 2007-12-26 | 2009-07-02 | Nec Corporation | 画像表示システム、画像表示方法及び記録媒体 |

| JP2009157635A (ja) * | 2007-12-26 | 2009-07-16 | Nec Corp | 画像表示装置、表示制御方法及びプログラム |

| JP2009157077A (ja) * | 2007-12-26 | 2009-07-16 | Nec Corp | 画像表示装置、表示制御方法及びプログラム |

| WO2009081650A1 (ja) * | 2007-12-26 | 2009-07-02 | Nec Corporation | 画像表示システム、画像表示方法及び記録媒体 |

| JPWO2009098895A1 (ja) * | 2008-02-07 | 2011-05-26 | パナソニック株式会社 | 映像信号処理方法、集積回路および映像再生装置 |

| WO2009098895A1 (ja) * | 2008-02-07 | 2009-08-13 | Panasonic Corporation | 映像信号処理方法、集積回路および映像再生装置 |

| JP2010244244A (ja) * | 2009-04-03 | 2010-10-28 | Sony Corp | 情報処理装置、情報処理方法、及び、プログラム |

Also Published As

| Publication number | Publication date |

|---|---|

| MXPA06003719A (es) | 2006-06-23 |

| EP1675395A4 (en) | 2009-11-25 |

| WO2005039177A1 (ja) | 2005-04-28 |

| US20070003221A1 (en) | 2007-01-04 |

| CN1860785A (zh) | 2006-11-08 |

| KR20070020378A (ko) | 2007-02-21 |

| EP1675395A1 (en) | 2006-06-28 |

| US8204357B2 (en) | 2012-06-19 |

| KR101038631B1 (ko) | 2011-06-03 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR101038631B1 (ko) | 재생 장치, 재생 방법 및 기록 매체 | |

| JP4715094B2 (ja) | 再生装置、再生方法、再生プログラムおよび記録媒体 | |

| JP4442564B2 (ja) | 再生装置、再生方法、再生プログラムおよび記録媒体 | |

| KR101089974B1 (ko) | 재생 장치, 재생 방법, 및 기록 매체 | |

| US8483544B2 (en) | Reproducing apparatus, reproducing method, reproducing program, and recording medium | |

| US20090162036A1 (en) | Playback apparatus and playback method | |

| JP2002091409A (ja) | 副映像処理機能付き再生装置 | |

| US20080126993A1 (en) | Reproduction apparatus, display control method and display control program | |

| JP2006230001A (ja) | 再生装置、再生方法、再生プログラムおよび記録媒体 | |

| JP4534975B2 (ja) | 再生装置、再生方法、記録方法、映像表示装置及び記録媒体 | |

| JP5209516B2 (ja) | 記録媒体 | |

| JP5209513B2 (ja) | 記録媒体 | |

| JP2009135946A (ja) | 記録媒体 | |

| JP4277863B2 (ja) | 再生装置、再生方法、再生プログラムおよび記録媒体 | |

| JP2011097614A (ja) | 再生装置、再生方法、記録装置、記録方法および記録媒体 | |

| JP4277862B2 (ja) | 再生装置、再生方法、再生プログラムおよび記録媒体 | |

| JP4277865B2 (ja) | 再生装置、再生方法、再生プログラムおよび記録媒体 | |

| JP4534974B2 (ja) | 再生装置、再生方法、記録方法、映像表示装置及び記録媒体 | |

| JP4277864B2 (ja) | 再生装置、再生方法、再生プログラムおよび記録媒体 | |

| JP3840894B2 (ja) | 画像情報処理方法 | |

| JP5209514B2 (ja) | 記録媒体 | |

| JP5494780B2 (ja) | データ構造 | |

| WO2006018786A1 (en) | Method of storing and transferring image signals | |

| JP2013051723A (ja) | データ格納方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20051227 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20060227 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20070424 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20070625 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20080603 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20080801 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20080925 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20081121 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20090310 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20090511 |

|

| A911 | Transfer of reconsideration by examiner before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20090522 |

|

| A912 | Removal of reconsideration by examiner before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A912 Effective date: 20090605 |