WO2016129233A1 - 車両用表示制御装置及び車両用表示制御方法 - Google Patents

車両用表示制御装置及び車両用表示制御方法 Download PDFInfo

- Publication number

- WO2016129233A1 WO2016129233A1 PCT/JP2016/000488 JP2016000488W WO2016129233A1 WO 2016129233 A1 WO2016129233 A1 WO 2016129233A1 JP 2016000488 W JP2016000488 W JP 2016000488W WO 2016129233 A1 WO2016129233 A1 WO 2016129233A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- image

- display

- opening

- vehicle

- area

- Prior art date

Links

- 238000000034 method Methods 0.000 title claims description 15

- 238000001514 detection method Methods 0.000 claims abstract description 128

- 230000004044 response Effects 0.000 claims description 3

- 238000005562 fading Methods 0.000 claims 1

- 230000015654 memory Effects 0.000 description 26

- 230000004048 modification Effects 0.000 description 25

- 238000012986 modification Methods 0.000 description 25

- 230000006870 function Effects 0.000 description 19

- 230000004913 activation Effects 0.000 description 11

- 230000009467 reduction Effects 0.000 description 9

- 238000009434 installation Methods 0.000 description 7

- 238000012544 monitoring process Methods 0.000 description 7

- 239000000446 fuel Substances 0.000 description 6

- 230000002093 peripheral effect Effects 0.000 description 6

- 230000006399 behavior Effects 0.000 description 5

- 230000000694 effects Effects 0.000 description 5

- 238000010586 diagram Methods 0.000 description 4

- 238000005516 engineering process Methods 0.000 description 4

- 230000008569 process Effects 0.000 description 4

- 238000004891 communication Methods 0.000 description 3

- 230000001186 cumulative effect Effects 0.000 description 3

- 239000004973 liquid crystal related substance Substances 0.000 description 3

- 238000000926 separation method Methods 0.000 description 3

- XLYOFNOQVPJJNP-UHFFFAOYSA-N water Substances O XLYOFNOQVPJJNP-UHFFFAOYSA-N 0.000 description 3

- 238000002485 combustion reaction Methods 0.000 description 2

- 239000000498 cooling water Substances 0.000 description 2

- 238000011160 research Methods 0.000 description 2

- 241001465754 Metazoa Species 0.000 description 1

- 238000013459 approach Methods 0.000 description 1

- 230000008859 change Effects 0.000 description 1

- 239000003086 colorant Substances 0.000 description 1

- 150000001875 compounds Chemical class 0.000 description 1

- 230000007812 deficiency Effects 0.000 description 1

- 239000002828 fuel tank Substances 0.000 description 1

- 238000002347 injection Methods 0.000 description 1

- 239000007924 injection Substances 0.000 description 1

- 230000003287 optical effect Effects 0.000 description 1

- 238000012545 processing Methods 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

- 230000007480 spreading Effects 0.000 description 1

- 230000000007 visual effect Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/50—Context or environment of the image

- G06V20/56—Context or environment of the image exterior to a vehicle by using sensors mounted on the vehicle

- G06V20/58—Recognition of moving objects or obstacles, e.g. vehicles or pedestrians; Recognition of traffic objects, e.g. traffic signs, traffic lights or roads

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S13/00—Systems using the reflection or reradiation of radio waves, e.g. radar systems; Analogous systems using reflection or reradiation of waves whose nature or wavelength is irrelevant or unspecified

- G01S13/88—Radar or analogous systems specially adapted for specific applications

- G01S13/93—Radar or analogous systems specially adapted for specific applications for anti-collision purposes

- G01S13/931—Radar or analogous systems specially adapted for specific applications for anti-collision purposes of land vehicles

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R1/00—Optical viewing arrangements; Real-time viewing arrangements for drivers or passengers using optical image capturing systems, e.g. cameras or video systems specially adapted for use in or on vehicles

- B60R1/12—Mirror assemblies combined with other articles, e.g. clocks

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R1/00—Optical viewing arrangements; Real-time viewing arrangements for drivers or passengers using optical image capturing systems, e.g. cameras or video systems specially adapted for use in or on vehicles

- B60R1/20—Real-time viewing arrangements for drivers or passengers using optical image capturing systems, e.g. cameras or video systems specially adapted for use in or on vehicles

- B60R1/22—Real-time viewing arrangements for drivers or passengers using optical image capturing systems, e.g. cameras or video systems specially adapted for use in or on vehicles for viewing an area outside the vehicle, e.g. the exterior of the vehicle

- B60R1/23—Real-time viewing arrangements for drivers or passengers using optical image capturing systems, e.g. cameras or video systems specially adapted for use in or on vehicles for viewing an area outside the vehicle, e.g. the exterior of the vehicle with a predetermined field of view

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S15/00—Systems using the reflection or reradiation of acoustic waves, e.g. sonar systems

- G01S15/88—Sonar systems specially adapted for specific applications

- G01S15/93—Sonar systems specially adapted for specific applications for anti-collision purposes

- G01S15/931—Sonar systems specially adapted for specific applications for anti-collision purposes of land vehicles

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/02—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S13/00

- G01S7/04—Display arrangements

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/1423—Digital output to display device ; Cooperation and interconnection of the display device with other functional units controlling a plurality of local displays, e.g. CRT and flat panel display

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/09—Arrangements for giving variable traffic instructions

- G08G1/0962—Arrangements for giving variable traffic instructions having an indicator mounted inside the vehicle, e.g. giving voice messages

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/09—Arrangements for giving variable traffic instructions

- G08G1/0962—Arrangements for giving variable traffic instructions having an indicator mounted inside the vehicle, e.g. giving voice messages

- G08G1/0967—Systems involving transmission of highway information, e.g. weather, speed limits

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/16—Anti-collision systems

- G08G1/165—Anti-collision systems for passive traffic, e.g. including static obstacles, trees

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/16—Anti-collision systems

- G08G1/166—Anti-collision systems for active traffic, e.g. moving vehicles, pedestrians, bikes

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/16—Anti-collision systems

- G08G1/167—Driving aids for lane monitoring, lane changing, e.g. blind spot detection

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/90—Arrangement of cameras or camera modules, e.g. multiple cameras in TV studios or sports stadiums

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/18—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/18—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast

- H04N7/181—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast for receiving images from a plurality of remote sources

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R1/00—Optical viewing arrangements; Real-time viewing arrangements for drivers or passengers using optical image capturing systems, e.g. cameras or video systems specially adapted for use in or on vehicles

- B60R1/12—Mirror assemblies combined with other articles, e.g. clocks

- B60R2001/1253—Mirror assemblies combined with other articles, e.g. clocks with cameras, video cameras or video screens

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R2300/00—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle

- B60R2300/10—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the type of camera system used

- B60R2300/105—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the type of camera system used using multiple cameras

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R2300/00—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle

- B60R2300/30—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the type of image processing

- B60R2300/301—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the type of image processing combining image information with other obstacle sensor information, e.g. using RADAR/LIDAR/SONAR sensors for estimating risk of collision

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R2300/00—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle

- B60R2300/80—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement

- B60R2300/802—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement for monitoring and displaying vehicle exterior blind spot views

- B60R2300/8026—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement for monitoring and displaying vehicle exterior blind spot views in addition to a rear-view mirror system

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R2300/00—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle

- B60R2300/80—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement

- B60R2300/8033—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement for pedestrian protection

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R2300/00—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle

- B60R2300/80—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement

- B60R2300/804—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement for lane monitoring

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R2300/00—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle

- B60R2300/80—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement

- B60R2300/8066—Details of viewing arrangements using cameras and displays, specially adapted for use in a vehicle characterised by the intended use of the viewing arrangement for monitoring rearward traffic

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T11/00—2D [Two Dimensional] image generation

- G06T11/60—Editing figures and text; Combining figures or text

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/0104—Measuring and analyzing of parameters relative to traffic conditions

- G08G1/0108—Measuring and analyzing of parameters relative to traffic conditions based on the source of data

- G08G1/0116—Measuring and analyzing of parameters relative to traffic conditions based on the source of data from roadside infrastructure, e.g. beacons

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/04—Detecting movement of traffic to be counted or controlled using optical or ultrasonic detectors

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/042—Detecting movement of traffic to be counted or controlled using inductive or magnetic detectors

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/052—Detecting movement of traffic to be counted or controlled with provision for determining speed or overspeed

Definitions

- the present disclosure relates to a vehicle display control device and a vehicle display control method.

- vehicle display control technology for controlling display on a display unit mounted on the host vehicle is widely known.

- an opening image is displayed on the display unit during the opening period when the opening command is detected by detecting the opening command from the user for the host vehicle. I am letting.

- the opening image displayed on the display unit is for performing an effect that welcomes the user, and is stored in advance in the image storage unit so that it is read and displayed during the opening period. .

- an obstacle in the outside world is detected by a plurality of outside sensors mounted on the own vehicle, and a notification according to the distance of the obstacle from the own vehicle is sounded. It is realized by the change of. According to such notification, it is possible to enhance the effect of reducing or avoiding the collision damage targeted by the safety system using these external sensors, and to ensure the safety and security of the user.

- the present inventor supports the user's understanding of the functions, capabilities, and limitations of each external sensor by displaying sensor information regarding each external sensor as the opening period display as disclosed in Patent Document 1. We have conducted extensive research on the technology to do this.

- the present disclosure was created as a result of such earnest research, and the purpose of the present disclosure is to reduce the collision damage by supporting the user's understanding of each external sensor in the own vehicle on which a plurality of external sensors are mounted.

- the object is to provide a vehicle display control device and a vehicle display control method that contribute to avoidance.

- a display control device for a vehicle is a sensor information display unit related to each external sensor in a host vehicle equipped with a plurality of external sensors that detect obstacles in the external environment and a display unit that displays information.

- Display control device for controlling the display of the vehicle, an opening detection unit for detecting an opening command from the user to the host vehicle, a host vehicle image showing the host vehicle, and a detection area capable of detecting an obstacle for each external sensor

- a plurality of area images associated with the vehicle image and an image storage unit for storing the vehicle image and each area image from the image storage unit during the opening period when the opening command is detected by the opening detection unit

- An opening control unit that reads and displays the images as sensor information on the display unit.

- a vehicle display control method includes a sensor information display unit for each external sensor in a host vehicle equipped with a plurality of external sensors for detecting obstacles in the external environment and a display unit for displaying information.

- the opening command from the user for the host vehicle is detected, and the host vehicle image indicating the host vehicle and an obstacle for each external sensor are detected during the opening period when the opening command is detected.

- the vehicle image and each area image are read out from the stored image storage unit including a plurality of area images indicating the detection areas where objects can be detected in association with the vehicle image, and these images are read as sensor information on the display unit. Including displaying.

- an image read from the image storage unit is displayed on the display unit as sensor information during the opening period when an opening command from the user to the host vehicle is detected.

- the image displayed at this time is obtained by associating an area image indicating a detection area where an obstacle can be detected for each external sensor with a host vehicle image indicating the host vehicle. Therefore, the user can intuitively grasp and understand the function, performance, and limit of each external sensor from the display of the area image for each external sensor associated with the host vehicle image. According to this, since the user's understanding regarding each external sensor can be supported, it is possible to contribute to the reduction or avoidance of collision damage.

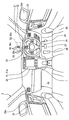

- FIG. 1 is an interior view showing an interior of a host vehicle equipped with a travel assist system according to a first embodiment of the present disclosure.

- FIG. 2 is a block diagram showing the driving assist system according to the first embodiment.

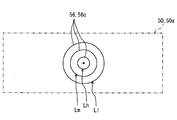

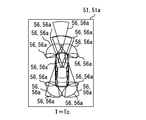

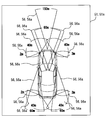

- FIG. 3 is a schematic top view for explaining the plurality of external sensors in FIG.

- FIG. 4 is a front view showing a display state by the HUD of FIG.

- FIG. 5 is a front view showing a display state by the HUD of FIG.

- FIG. 6 is a front view showing a display state by the MFD of FIG.

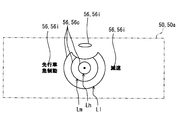

- FIG. 7A is a schematic front view for explaining the display by the MFD of FIG.

- FIG. 1 is an interior view showing an interior of a host vehicle equipped with a travel assist system according to a first embodiment of the present disclosure.

- FIG. 2 is a block diagram showing the driving assist system according to the first embodiment.

- FIG. 3 is a schematic top view for explaining the plurality of external sensors in FIG.

- FIG. 4 is a front view showing

- FIG. 7B is a schematic front view for explaining display by MFD, following FIG. 7A.

- FIG. 7C is a schematic front view for explaining display by MFD, following FIG. 7B.

- FIG. 7D is a schematic front view for explaining display by MFD, following FIG. 7C.

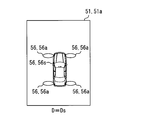

- FIG. 8 is a front view showing a display state by the MFD of FIG.

- FIG. 9 is a front view showing a display state by the MFD of FIG.

- FIG. 10 is a front view showing a display state by the MFD of FIG.

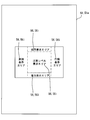

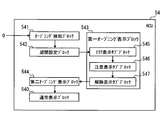

- FIG. 11 is a block diagram showing a plurality of blocks constructed by the HCU of FIG.

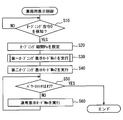

- FIG. 12 is a flowchart showing a vehicle display control flow by the HCU of FIG. FIG.

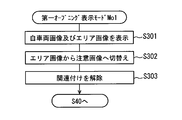

- FIG. 13 is a flowchart showing the first opening display mode according to S30 of FIGS. 7A to 7D.

- FIG. 14A is a schematic front view for explaining display by MFD according to the second embodiment of the present disclosure

- FIG. 14B is a schematic front view for explaining the display by MFD, following FIG. 14A.

- FIG. 14C is a schematic front view for explaining display by MFD, following FIG. 14B.

- FIG. 15A is a schematic front view for explaining display by MFD according to the third embodiment of the present disclosure

- FIG. 15B is a schematic front view for explaining display by MFD, following FIG. 15A.

- FIG. 15C is a schematic front view for explaining display by MFD, following FIG. 15B.

- FIG. 15D is a schematic front view for explaining display by MFD, following FIG.

- FIG. 16 is a block diagram illustrating a plurality of blocks constructed by the HCU according to the fourth embodiment of the present disclosure.

- FIG. 17 is a flowchart showing a vehicle display control flow by the HCU of FIG.

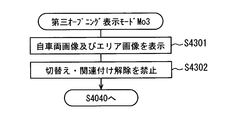

- FIG. 18 is a flowchart showing the first opening display mode in S4030 of FIG.

- FIG. 19 is a front view showing a modification of the display state shown in FIG. 20 is an interior view showing a modified example of the interior of the host vehicle shown in FIG.

- FIG. 21 is a block diagram showing a modification of the travel assist system shown in FIG.

- a travel assist system (ASSIST) 1 according to a first embodiment to which the present disclosure is applied is mounted on a host vehicle (VH) 2 as shown in FIGS.

- VH host vehicle

- the speed at which the host vehicle 2 travels is referred to as a vehicle speed

- the road on which the host vehicle 2 travels is referred to as a travel path

- the vehicle speed limited to the host vehicle 2 on the travel path is referred to as a limit speed.

- the travel assist system 1 includes a periphery monitoring system (MONITOR) 3, a vehicle control system (CONTROL) 4, and an information presentation system (INFO PROVIDE) 5.

- the systems 3, 4, and 5 of the travel assist system 1 are connected via an in-vehicle network 6 such as a LAN (Local Area Network).

- LAN Local Area Network

- the periphery monitoring system 3 includes an external sensor 30 and a periphery monitoring ECU (Electronic Control Unit) 31.

- the outside sensor 30 detects obstacles that exist in the outside of the host vehicle 2 and may collide, such as other vehicles, artificial structures, humans and animals, and traffic indications in the outside.

- sonars 301 and 302 As the external sensor 30, sonars 301 and 302, radars 303, 304, and 305 and cameras 306 and 307 are mounted on the host vehicle 2.

- the front side sonar 301 is an ultrasonic sensor installed on each of the left and right sides of the front portion of the vehicle 2.

- Each front side sonar 301 receives the reflected wave of the ultrasonic wave transmitted to the front side detection area 301a in the outside of the host vehicle 2, thereby detecting an obstacle in the area 301a and outputting a detection signal.

- the detection area 301a that can be detected by each front side sonar 301 is set with a maximum detection distance Ds of, for example, about 2 m as a distance from the installation location of the sonar 301 in the own vehicle 2.

- the rear side sonar 302 is an ultrasonic sensor that is installed on each of the left and right sides of the rear portion of the vehicle 2. Each rear side sonar 302 detects the obstacle in the area 302a by receiving the reflected wave of the ultrasonic wave transmitted to the detection area 302a on the rear side of the outside of the host vehicle 2, and detects the detection signal. Is output.

- the detection area 302a that can be detected by each rear side sonar 302 is set with a maximum detection distance Ds of, for example, about 2 m as a distance from the installation location of the sonar 302 in the own vehicle 2.

- the front short-range millimeter-wave radar 303 is a millimeter-wave sensor installed on each of the left and right sides of the front portion of the vehicle 2.

- Each near-field millimeter wave radar 303 detects an obstacle in the area 303a by receiving a millimeter wave or quasi-millimeter reflected wave transmitted to the front detection area 303a in the external environment of the host vehicle 2. And outputs a detection signal.

- the detection area 303a that can be detected by each forward short-range millimeter wave radar 303 is set with a maximum detection distance Drs of, for example, about 40 m as a distance from the installation location of the radar 303 in the own vehicle 2. .

- the rear short-range millimeter-wave radar 304 is a millimeter-wave sensor installed on each of the left and right sides of the rear portion of the vehicle 2. Each rear short-range millimeter-wave radar 304 detects the obstacle in the area 304a by receiving the reflected millimeter wave or quasi-millimeter wave transmitted to the rear detection area 304a in the external environment of the host vehicle 2. And outputs a detection signal.

- the detection area 304a that can be detected by each rear short-range millimeter-wave radar 304 is set with a maximum detection distance Drs of, for example, about 40 m as a distance from the installation location of the radar 304 in the own vehicle 2. .

- the long-distance millimeter-wave radar 305 is a millimeter-wave sensor installed in the center of the front portion of the host vehicle 2.

- the long-distance millimeter-wave radar 305 receives the reflected millimeter wave transmitted to the front detection area 305a in the external environment of the host vehicle 2, thereby detecting an obstacle in the area 305a and outputting a detection signal.

- the detection area 305a that can be detected by the long-range millimeter-wave radar 305 is set with a maximum detection distance Drl of, for example, about 70 to 150 m as the distance from the installation location of the radar 305 in the own vehicle 2. .

- the front camera 306 is a single-lens or compound-eye camera that is installed in a pair in the center mirror in the passenger compartment 2c of the host vehicle 2.

- Each front camera 306 detects an obstacle or traffic display in the area 306a and outputs an image signal by photographing a front detection area 306a in the external world of the host vehicle 2.

- the detection area 306a that can be detected by each front camera 306 is set with a maximum detection distance Dc of, for example, about 50 to 60 m as the distance from the installation location of the camera 306 in the host vehicle 2.

- the rear camera 307 that also functions as an electronic mirror is a monocular or compound eye camera provided on each of the left and right door mirrors 29 (see FIG. 1) of the vehicle 2.

- Each rear camera 307 captures an image of the rear detection area 307a in the external environment of the host vehicle 2, thereby detecting an obstacle in the area 307a and outputting an image signal.

- the detection area 307a that can be detected by each rear camera 307 is set with a maximum detection distance Dc of, for example, about 50 to 60 m as the distance from the installation location of the camera 307 in the host vehicle 2.

- the sonars 301 and 302, the radars 303, 304, and 305 and the cameras 306 and 307 are collectively referred to as “external sensor 30”.

- the detection areas 301a, 302a, 303a, 304a, 305a, 306a, and 307a of the sonars 301 and 302, the radars 303, 304, and 305 and the cameras 306 and 307 are collectively referred to as “detection area 30a”.

- the maximum detection distances Ds, Drs, Drl, and Dc of the sonars 301 and 302, the radars 303, 304, and 305 and the cameras 306 and 307 are collectively referred to as “maximum detection distance D”.

- the maximum detection distance D of the detection area 30a for each external sensor 30 is Ds, Drs, Dc, Drl in order from the shortest, as described above.

- the 2 is composed mainly of a microcomputer having a processor and a memory, and is connected to the external sensor 30 and the in-vehicle network 6.

- the surroundings monitoring ECU 31 uses, for example, sign information such as a speed limit sign, a stop sign, an intersection sign, an entrance / exit guide sign, a tunnel sign and a gradient sign, and lane marking information such as a white line and a yellow line based on an output signal of the external sensor 30. get.

- the periphery monitoring ECU 31 acquires obstacle information such as the type of the obstacle and the relative relationship of the obstacle with respect to the host vehicle 2 based on the output signal of the external sensor 30.

- the distance monitoring ECU 31 acquires the inter-vehicle distance, the inter-vehicle time, the relative speed, the collision prediction time, and the like for the front vehicle as the front obstacle.

- the vehicle control system 4 includes a vehicle state sensor 40, an occupant sensor 41, and a vehicle control ECU 42.

- the vehicle state sensor 40 is connected to the in-vehicle network 6.

- the vehicle state sensor 40 detects the traveling state of the host vehicle 2.

- the vehicle state sensor 40 is, for example, one type or a plurality of types among a vehicle speed sensor, a rotation speed sensor, a fuel sensor, a water temperature sensor, a battery sensor, a radio wave receiver, and the like.

- the vehicle speed sensor detects the vehicle speed of the host vehicle 2 and outputs a vehicle speed signal corresponding to the detection.

- the rotation speed sensor detects the engine rotation speed in the host vehicle 2 and outputs a rotation speed signal corresponding to the detection.

- the fuel sensor detects the remaining amount of fuel in the fuel tank of the host vehicle 2 and outputs a fuel signal corresponding to the detection.

- the water temperature sensor detects the cooling water temperature of the internal combustion engine in the host vehicle 2 and outputs a water temperature signal corresponding to the detection.

- a battery sensor outputs the battery signal according to the said detection by detecting the battery remaining charge of the own vehicle 2.

- the radio wave receiver outputs a traffic signal by receiving output radio waves from, for example, a positioning satellite, another vehicle transmitter for vehicle-to-vehicle communication, and a roadside device for road-to-vehicle communication.

- the traffic signal is a signal representing traffic information related to the host vehicle 2 such as a travel position, a travel direction, a travel time, a travel path state, a speed limit, and the like, and the obstacle information.

- the passenger sensor 41 is connected to the in-vehicle network 6.

- the occupant sensor 41 detects the state or operation of a user who has boarded in the passenger compartment 2c of the host vehicle 2 shown in FIG.

- the occupant sensor 41 is, for example, one type or a plurality of types among a power switch, a user state monitor, a seating sensor, a door sensor, a display setting switch, a light switch, a turn switch, and the like.

- the power switch is turned on by the user in the passenger compartment 2c to start the internal combustion engine or the electric motor of the host vehicle 2, and outputs a power signal corresponding to the operation.

- the user state monitor captures the user state on the driver's seat 20 in the passenger compartment 2c with an image sensor, thereby detecting the user state and outputting an image signal.

- the seating sensor outputs a seating signal corresponding to the detection by detecting the user's seating operation on the driver's seat 20 in the passenger compartment 2c.

- a door sensor outputs the door signal according to the said detection by detecting opening operation by the user from the vehicle interior 2c in the door 25 by the side of the driver's seat 20 among the own vehicles 2.

- the display setting switch is operated by the user to set the display state in the passenger compartment 2c and outputs a display setting signal corresponding to the operation.

- the light switch is turned on by the user in the passenger compartment 2c to turn on various lights of the host vehicle 2, and outputs a light signal corresponding to the operation.

- the turn switch is turned on by the user in the passenger compartment 2c to operate the direction indicator of the host vehicle 2, and outputs a turn signal corresponding to the operation.

- the vehicle control ECU 42 shown in FIG. 2 is mainly composed of a microcomputer having a processor and a memory, and is connected to the in-vehicle network 6.

- the vehicle control ECU 42 is one type or a plurality of types including at least an integrated control ECU among an engine control ECU, a motor control ECU, a brake control ECU, an integrated control ECU, and the like.

- the engine control ECU accelerates or decelerates the vehicle speed of the host vehicle 2 by controlling the operation of the throttle actuator and the fuel injection valve of the engine according to the operation of the accelerator pedal 26 (see FIG. 1) or automatically.

- the motor control ECU accelerates or decelerates the vehicle speed of the host vehicle 2 by controlling the operation of the motor generator according to the operation of the accelerator pedal 26 or automatically.

- the brake control ECU accelerates or decelerates the vehicle speed of the host vehicle 2 by controlling the operation of the brake actuator according to the operation of the brake pedal 27 (see FIG. 1) or automatically.

- the integrated control ECU synchronously controls the operation of the other control ECU based on, for example, the output signals of the sensors 40 and 41, the acquired information in the periphery monitoring ECU 31, the control information in the other control ECU as the vehicle control ECU 42, and the like.

- the integrated control ECU of the present embodiment automatically reduces the collision damage of the host vehicle 2 against a front obstacle such as a forward vehicle traveling in the same direction by giving a control command to another control ECU as the vehicle control ECU 42 or Operates to avoid.

- the integrated control ECU forcibly and automatically decelerates the vehicle speed of the host vehicle 2 to realize collision damage reduction braking (AEB: Autonomous Emergency Braking) when the emergency control condition is satisfied.

- AEB Autonomous Emergency Braking

- the emergency control condition of the AEB is that the predicted time of collision of the host vehicle 2 with respect to the preceding vehicle approaches, for example, 5 seconds or less.

- the information presentation system 5 is a combination of an acoustic unit 5s, a vibration unit 5v, and a display unit 5d.

- the acoustic unit 5s is mounted on the host vehicle 2 in order to present information in an auditory manner.

- the acoustic unit 5s is mainly composed of a speaker and a sound source circuit, and is connected to the in-vehicle network 6.

- the acoustic unit 5s is installed, for example, in one or a plurality of locations among the driver's seat 20, the instrument panel 22, and the door 25 in the passenger compartment 2c of the host vehicle 2 shown in FIG. A perceptible sound wave or sound is generated.

- the vibration unit 5v shown in FIG. 2 is mounted on the host vehicle 2 for tactile presentation of information.

- the vibration unit 5v is mainly composed of a vibration actuator, and is connected to the in-vehicle network 6.

- the vibration unit 5v is installed, for example, in one or a plurality of locations of the driver's seat 20, the steering handle 24, the accelerator pedal 26, the brake pedal 27, and the footrest 28 in the passenger compartment 2c shown in FIG. An alarm vibration that can be perceived by the user is generated.

- the display unit 5d shown in FIG. 2 is mounted on the host vehicle 2 for visually presenting information.

- the display unit 5d includes a HUD (Head-up Display) 50, an MFD (Multi Function Display) 51, a combination meter 52, and an HCU (HMI (Human Machine Interface) Control Unit) 54.

- HUD Head-up Display

- MFD Multi Function Display

- HCU HMI (Human Machine Interface) Control Unit

- the HUD 50 is installed on the instrument panel 22 in the passenger compartment 2c shown in FIG.

- the HUD 50 projects the image 56 formed so as to show predetermined information on the liquid crystal panel or the projection screen onto the windshield 21 of the host vehicle 2 so that the virtual image of the image 56 can be visually recognized by the user on the driver's seat 20. indicate.

- the virtual image display by the HUD 50 is visually recognized by the user in the display area 50a having a predetermined area that is the projection range of the image 56 on the windshield 21 and overlapping with the outside scene in front of the host vehicle 2.

- the display of the caution image 56c and the notification image 56i as shown in FIGS.

- the virtual image display by the HUD 50 in addition to the images 56c and 56i, for example, an image display indicating one type or a plurality of types of information among navigation information, sign information, obstacle information, and the like may be adopted.

- an image display indicating one type or a plurality of types of information among navigation information, sign information, obstacle information, and the like may be adopted.

- a virtual image display can also be realized by projecting the image 56 on the combiner.

- the navigation information can be acquired based on the map information stored in the memory 54m and the output signal of the sensor 40, for example, in the HCU 54 described in detail later.

- the MFD 51 is installed in the center console 23 in the passenger compartment 2c shown in FIG.

- the MFD 51 displays a real image of the image 56 formed so as to show predetermined information on one or a plurality of liquid crystal panels so that the user on the driver's seat 20 can visually recognize the image.

- the real image display by the MFD 51 is visually recognized by the user in the display range 51 a having a larger area than the display range 50 a of the HUD 50.

- the display of the host vehicle image 56s, the area image 56a, the caution image 56c, and the notification image 56i as shown in FIGS. 4 to 10 is employed.

- the real image display by the MFD 51 employs an image display that shows one or more types of information among navigation information, audio information, video information, communication information, and the like. May be.

- the combination meter 52 is installed on the instrument panel 22 in the passenger compartment 2c shown in FIG.

- the combination meter 52 displays vehicle information related to the host vehicle 2 so that the user on the driver's seat 20 can visually recognize the vehicle information.

- the combination meter 52 is a digital meter that displays vehicle information by an image formed on a liquid crystal panel, or an analog meter that displays vehicle information by indicating a scale with a pointer.

- As the display by the combination meter 52 for example, one type or plural types of vehicle speed, engine speed, fuel remaining amount, cooling water temperature, battery remaining amount, operation state of the light switch, turn switch and door 25, etc. A display showing information is adopted.

- the HCU 54 is mainly composed of a microcomputer having a processor 54p and a memory 54m, and is connected to the display elements 50, 51, 52 and the in-vehicle network 6 of the display unit 5d.

- the HCU 54 controls the operations of the acoustic unit 5s and the vibration unit 5v and the operations of the display elements 50, 51, and 52 of the display unit 5d in synchronization.

- the HCU 54 controls the operation thereof based on, for example, output signals of the sensors 40 and 41, acquisition information in the ECU 31, control information in the ECU 42, storage information in the memory 54m, and acquisition information including time information of the HCU 54 itself.

- the memory 54m of the HCU 54 and the memories of other various ECUs are respectively configured by using one or a plurality of storage media such as a semiconductor memory, a magnetic medium, or an optical medium.

- the images 56s, 56a, 56c, and 56i are stored as data in the memory 54m as the “image storage unit”, so that the HCU 54 functions as a “vehicle display control device”. With this function, the HCU 54 controls the virtual image display of the images 56c and 56i on the HUD 50 and the real image display of the images 56s, 56a, 56c and 56i on the MFD 51 as sensor information display regarding each external sensor 30. This will be described below.

- the “image storage unit” for storing the images 56s, 56a, 56c, and 56i is selected from any of the memories of the built-in ECU of the display elements 50, 51, and 52, or of these memories and the memory 54m of the HCU 54. Of course, it may be realized by jointly using a plurality of memories.

- the HCU 54 functionally constructs a plurality of blocks 541, 542, 543, 544, and 540 as shown in FIG. 11 by executing the vehicle display control program stored in the memory 54m by the processor 54p.

- these blocks 541, 542, 543, 544, and 540 may be constructed by hardware using one or a plurality of ICs.

- the opening detection block 541 as an “opening detection unit” detects an opening command O from the user to the host vehicle 2.

- the opening command O refers to a user's intention to start driving the host vehicle 2 and is detected based on an output signal of the occupant sensor 41.

- Such opening command O is detected based on, for example, an ON operation detected based on a power signal of a power switch, an opening operation detected based on a door signal of a door sensor, and a seating signal of a seating sensor or an image signal of a user status monitor.

- the seating operation is adopted.

- the period setting block 542 as the “opening control unit” sets the opening period Po (see FIG. 12) after the opening command O is detected by the opening detection block 541.

- the opening period Po is started immediately after the opening command O is detected or after a set time from the detection of the opening command O.

- the time length after the start of the opening period Po is displayed on display blocks 543 and 544, which will be described in detail later, so that the user on the driver's seat 20 can view the images 56s, 56a, 56c, and 56i. For example, it is set to about 5 to 10 seconds according to the control content.

- the display blocks 543 and 544 as the “opening control unit” sequentially execute the individual opening display modes Mo1 and Mo2 (see FIG. 12), respectively.

- the first opening display block 543 is composed of a plurality of sub-blocks 545, 546, 547.

- the area display sub-block 545 reads the host vehicle image 56s and the plurality of area images 56a from the memory 54m and displays them on the MFD 51 as shown in FIG.

- the host vehicle image 56 s at this time is a graphic image schematically showing the top view shape of the host vehicle 2.

- each area image 56a at this time is a graphic image schematically showing a corresponding area in the detection area 30a (see FIG. 3) for each external sensor 30.

- the display colors of these area images 56a may be the same as each other or different from each other.

- the separation distance from the own vehicle image 56s to the most distant portion is an index that visually represents the maximum detection distance D (see FIG. 3) of the corresponding detection area 30a.

- the ratio of the separation distances to the part farthest from the host vehicle image 56 s in the outer peripheral contour line of each area image 56 a is the maximum detection distance D of the corresponding detection area 30 a.

- the ratio between the two is different for convenience of display size.

- the area display sub-block 545 sequentially displays each area image 56a on the display range 51a of the MFD 51 in order from the outside sensor 30 side having the shortest maximum detection distance D corresponding to the area image 56a as shown in FIGS. 7A to 7D.

- Ds sonars 301 and 302 shown in FIG. 7A Ds sonars 301 and 302 shown in FIG. 7A

- Drs short-range millimeter wave radars 303 and 304 shown in FIG. 7B Dc cameras 306 and 307 shown in FIG. 7C

- the corresponding area image 56a is superimposed and displayed on the host vehicle image 56s in the order of the long distance millimeter wave radar 305 of Drl.

- the MFD 51 in the display control period by the area display sub-block 545 in the opening period Po all the area images 56a are displayed in association with the host vehicle image 56s as shown in FIG.

- each of the caution images 56c at this time includes a plurality of cautions corresponding to the risk of depending on the distance of the obstacle from the own vehicle 2 (hereinafter simply referred to as “obstacle distance”) as the driving risk of the own vehicle 2 by the user

- the graphic images schematically show the levels Ll, Lh, and Lm, respectively.

- the caution image 56c indicating the caution level L1 when the driving risk is low is a circular image in which the radius of the outer peripheral outline centering on the host vehicle image 56s is the maximum diameter.

- the caution image 56c indicating the caution level Lh when the driving risk is high is a circular image in which the radius of the outer periphery contour centering on the host vehicle image 56s is the minimum diameter.

- the caution image 56c indicating the caution level Lm when the driving risk is moderate is a circular image in which the radius of the outer peripheral contour centered on the host vehicle image 56s is between the minimum diameter and the maximum diameter.

- the radius of the outer peripheral contour line of each of the attention images 56c is an index that visually associates the obstacle distance from the own vehicle 2 with the detection area 30a shown in FIG. 6 by each area image 56a before switching. .

- the attention levels Ll, Lh, and Lm are collectively referred to as “attention level L”.

- the caution display sub-block 546 displays each of all the caution images 56c switched from the area image 56a in the display range 51a of the MFD 51 in association with the host vehicle image 56s as shown in FIG.

- the images 56a and 56c are animatedly displayed in the form of moving images in which the respective attention images 56c are faded in at the respective display positions while the respective area images 56a are faded out at the respective display positions.

- the cancellation display sub-block 547 shown in FIG. 11 deletes the vehicle image 56s associated with each caution image 56c in the MFD 51 as shown in FIG. 9 after the display control period by the caution display sub-block 546 in the opening period Po. Then, the association is released. At this time, particularly in the present embodiment, the display of each caution image 56c released from the association with the host vehicle image 56s is concentrically reduced in the display range 51a of the MFD 51. As a result, in the MFD 51 in the display control period by the release display sub-block 547 in the opening period Po, only the caution images 56c are displayed in a reduced state.

- the first opening display mode Mo1 is realized in a series of display control periods by the sub-blocks 545, 546, and 547. Therefore, in the present embodiment, the MFD 51 used in the first opening display mode Mo1 corresponds to the “first opening display unit”.

- the second opening display block 544 shown in FIG. 11 displays the caution images 56c on the MFD 51 to the HUD 50 after the display control period by the release display sub-block 547 in the opening period Po.

- each reduced attention image 56c released from the association with the host vehicle image 56s is displayed in the display range 50a of the HUD 50 in substantially the same size as the display size of the MFD 51.

- each caution image 56c to be moved is erased in the display range 51a of the MFD 51, and a plurality of notification images 56i are read from the memory 54m and displayed in the range 51a.

- the images 56c and 56i may be displayed in animation in the form of moving images in which the respective notification images 56i are faded in at the respective display locations while the respective caution images 56c are faded out at the respective display locations.

- all the notification images 56i may be displayed after the all erasure of the attention image 56c or simultaneously with the all erasure.

- Each notification image 56i at this time indicates the distinction of notification contents (see FIG. 5) notified in association with the attention level of each attention image 56c by the HUD 50 after the opening period Po, which will be described in detail later. Character image.

- one of the notification images 56i indicates that the cause of driving risk corresponding to the attention level L is notified in the factor display area in the display range 51a of the MUD 51 by the character notation of the display area name. It is a character image. Another one of the notification images 56i is a character image indicating that the driving behavior corresponding to the attention level L is notified in the behavior display area in the display range 51a by the character notation of the display area name. Another one of the notification images 56i is a character image indicating that the attention level L to the front obstacle is notified in the front display area of the display range 51a by the character notation of the display area name.

- Yet another one of the notification images 56i is a character image indicating that the attention level L to the rear obstacle is notified in the rear display area of the display range 51a by the character notation of the display area name. Still another one of the notification images 56i is a character image that indicates that the attention level L is notified in the attention level display area in the display range 51a by the character notation of the display area name.

- the boundaries between the display areas corresponding to the respective notification images 56i are virtually indicated by two-dot chain lines.

- the second opening display mode Mo2 is realized in the display control period by the second opening display block 544 in the opening period Po. Therefore, in the present embodiment, the HUD 50 used in the second opening display mode Mo2 corresponds to the “second opening display unit”.

- the display of the caution image 56c on the HUD 50 by the execution of the second opening display mode Mo2 is continued even after the opening period Po ends, but the display of the notification image 56i on the MFD 51 by the execution is performed in the opening period Po. It will be erased upon completion.

- the normal display block 540 shown in FIG. 11 executes the normal display mode Mn (see FIG. 12) after the opening period Po. By executing the normal display mode Mn, the normal display block 540 continues to display each caution image 56c in the caution level display area as shown in FIG. 5 in the display range 50a of the HUD 50, and is selected as necessary.

- the notification image 56i is also displayed in a predetermined area.

- the notification image 56i at this time is a character image or a graphic image in which the notification content itself that is notified in association with the attention level of each attention image 56c is represented by character notation or schematically.

- one of the notification images 56i is a character representation of the driving risk occurrence factor corresponding to the attention level L in the factor display area in the display range 50a of the HUD 50 that has a smaller display area than the display range 51a of the MUD 51. It is a character image shown by.

- Another one of the notification images 56i is a character image that indicates the driving behavior according to the attention level L in a character notation in the behavior display area of the display range 50a.

- Another one of the notification images 56i is an elliptical image that schematically shows the attention level L to the front obstacle in the front display area of the display range 50a.

- Still another one of the notification images 56i is an oval image (not shown) schematically showing the attention level L to the rear obstacle in the rear display area of the display range 50a.

- the normal display block 540 for displaying an elliptical image as the notification image 56i in the front display area or the rear display area is an image corresponding to the attention level L among the attention images 56c displayed in the attention level display area. For example as shown in FIG. As a result, the user can be alerted to the driving risk from the stage before the operation of the AEB.

- the vehicle display control flow as the “vehicle display control method” is realized. Details thereof will be described below. Note that “S” in the vehicle display control flow means each step.

- the opening detection block 541 determines whether or not the opening command O from the user for the host vehicle 2 has been detected.

- the opening command O at this time is assumed to be an ON operation of the power switch here.

- S10 is repeated until the opening command O is detected.

- the process proceeds to S20.

- the opening period Po is set by the period setting block 542.

- the first opening display mode Mo1 in the opening period Po is executed by the first opening display block 543.

- the host vehicle image 56s and a plurality of area images 56a associated therewith are read from the memory 54m by the area display sub-block 545 and displayed on the MFD 51.

- the area images 56a are sequentially displayed in order from the outside sensor 30 side where the maximum detection distance D is short.

- the caution display sub-block 546 executes the display on the MFD 51 of each caution image 56c read from the memory 54m by switching from the entire area image 56a.

- the entire area image 56a associated with the own vehicle image 56s is faded out, and the all caution image 56c is associated with the own vehicle image 56s and displayed in animation. It will be.

- the second opening display block 544 executes the second opening display mode Mo2 in the opening period Po in S40 of the vehicle display control flow shown in FIG. Specifically, in the second opening display mode Mo ⁇ b> 2, the display of each caution image 56 c released from the association with the host vehicle image 56 s by the MFD 51 is moved to the HUD 50 by the second opening display block 544. At this time, in the MFD 51 of the present embodiment, each caution image 56c to be moved is deleted and each notification image 56i read from the memory 54m is displayed.

- the normal display block 540 determines whether or not the power switch is turned off in S50. As a result, when the power switch is turned off, the vehicle display control flow is terminated, while when the switch is turned on, the process proceeds to S60.

- the normal display mode Mn is executed by the normal display block 540. Specifically, in the normal display mode Mn, the display of each caution image 56c on the HUD 50 is continued, and the notification image 56i selected as necessary is displayed on the HUD 50. After this, the process returns to S50, whereby the display of each caution image 56c and the display of the notification image 56i as necessary are executed until the power switch is turned off.

- S10 corresponds to an “opening detection step”

- S20, S30, and S40 correspond to an “opening control step”.

- an image read from the memory 54m is displayed on the MFD 51 as sensor information during the opening period Po when the opening command O from the user to the host vehicle 2 is detected.

- the image displayed at this time is obtained by associating the area image 56 a showing the detection area 30 a where the obstacle can be detected for each external sensor 30 with the own vehicle image 56 s showing the own vehicle 2. Therefore, the user can intuitively grasp and understand the function, performance, and limit of each external sensor 30 from the display of the area image 56a for each external sensor 30 associated with the own vehicle image 56s. According to this, since the user's understanding regarding each external sensor 30 can be supported, it is possible to contribute to the reduction or avoidance of collision damage.

- each area image 56a is sequentially displayed in sequence from the external sensor 30 side where the maximum detection distance D of the detection area 30a is short as the distance from the host vehicle 2. Accordingly, the user can intuitively and accurately grasp the maximum detection distance D representing the detection limit for the detection area 30a for each external sensor 30 in order from the shortest, so that the user's understanding of the detection limit can be improved. . Therefore, this is effective in reducing or avoiding collision damage.

- the area image 56a displayed in association with the host vehicle image 56s in the opening period Po is switched to the attention image 56c read from the memory 54m after the association display.

- the user can detect the driving risk that depends on the obstacle distance corresponding to the attention level L indicated by the attention image 56c after switching, and the detection area 30a for each external sensor 30 corresponding to each area image 56a before switching. It becomes easy to be conscious in connection with. Therefore, the user intuitively understands that an obstacle detected in the detection area 30a by the function of each external sensor 30 requires a level of attention corresponding to the distance from the host vehicle 2. Can do. Therefore, this is effective in reducing or avoiding collision damage.

- the attention image 56c switched from the area image 56a in the opening period Po is displayed in association with the host vehicle image 56s.

- both the area image 56a before the switching and the attention image 56c after the switching are clearly related to the distance from the host vehicle 2 by the association with the common host vehicle image 56s.

- the user grasps the driving risk that depends on the obstacle distance corresponding to the attention level L indicated by the attention image 56c after switching in association with the detection area 30a corresponding to each area image 56a before switching. It becomes easy. Therefore, for the obstacle detected in the detection area 30a by the function of each external sensor 30, an intuitive understanding level that the level of attention corresponding to the distance from the host vehicle 2 is necessary, It can be enhanced by the user. Therefore, it is particularly effective in contributing to the reduction or avoidance of collision damage.

- the area image 56a fades out at the display location, and the caution image 56c is displayed as an animation that fades in at the same location.

- the area image 56a before switching and the caution image 56c after switching are temporarily superimposed and displayed.

- the user grasps the driving risk that depends on the obstacle distance corresponding to the attention level L indicated by the attention image 56c after switching in association with the detection area 30a corresponding to each area image 56a before switching. It becomes easy. Therefore, for the obstacle detected in the detection area 30a by the function of each external sensor 30, an intuitive understanding level that the level of attention corresponding to the distance from the host vehicle 2 is necessary, It can be enhanced by the user. Therefore, it is particularly effective in contributing to the reduction or avoidance of collision damage.

- the area image 56a is displayed on the MFD 51 in the display unit 5d after being displayed in association with the host vehicle image 56s. It is switched to 56c. Therefore, the user can easily grasp the driving risk that depends on the obstacle distance corresponding to the attention level L indicated by the attention image 56c after switching in association with the detection area 30a corresponding to each area image 56a before switching. . Furthermore, during the opening period Po, the display of the caution image 56c on the MFD 51 is moved to the HUD 50 that displays the caution image 56c after the synchronization Po in the display unit 5d by executing the second opening display mode Mo2. .

- the user can associate the attention level L indicated by the attention image 56c in the HUD 50 after the opening period Po with the attention level L indicated by the attention image 56c in the HUD 50 during the synchronization Po. Therefore, the user grasps the driving risk that depends on the obstacle distance corresponding to the attention level L indicated by the attention image 56c after the opening period Po in association with the detection area 30a corresponding to each area image 56a before switching. It becomes easy to do. According to the above, an intuitive understanding that an obstacle detected in the detection area 30a by the function of each external sensor 30 requires a level of attention corresponding to the distance from the host vehicle 2. The degree can be increased by the user. Therefore, it is particularly effective in contributing to the reduction or avoidance of collision damage.

- the caution image 56c is switched from the area image 56a and displayed in association with the host vehicle image 56s by executing the first opening display mode Mo1 in the opening period Po. Therefore, the user can easily grasp the driving risk that depends on the obstacle distance corresponding to the attention level L indicated by the attention image 56c after switching in association with the detection area 30a corresponding to each area image 56a before switching. .

- the vehicle image 56s is erased in the MFD 51 and the association with the caution image 56c is released, and then the second opening display mode Mo2 is executed.

- the attention image 56c whose association has been released is displayed on the HUD 50.

- the attention image 56c is set to an appropriate size in order to associate the driving risk that depends on the obstacle distance with the detection area 30a and correspond to the attention level L. Can be displayed. Therefore, for the obstacle detected in the detection area 30a by the function of each external sensor 30, the level of caution according to the distance from the host vehicle 2 is necessary, and it is difficult to prevent the driving view.

- the HUD 50 of the area it can be continuously conscious until after the opening period Po. Therefore, it is possible to greatly contribute to the reduction or avoidance of collision damage.

- the notification image 56i is displayed on the MFD 51.

- the notification image 56i is read from the memory 54m and displayed in order to show the distinction of the notification content notified in association with the attention image 56c after the opening period Po. Therefore, it is ensured that the user understands that the obstacle detected in the detection area 30a by the function of each external sensor 30 requires a level of caution according to the distance from the vehicle 2. Can be raised. Therefore, it is possible to greatly contribute to the reduction or avoidance of collision damage.

- the second embodiment of the present disclosure is a modification of the first embodiment.

- the area display sub-block 545 displays each area image 56a in order from the outside sensor 30 side in which the activation time T required for activation in response to the opening command O is short.

- the sequence is displayed on the MFD 51. Therefore, in S301 of the vehicle display control flow of the second embodiment, the respective area images 56a are sequentially displayed in order from the outside sensor 30 side with the short activation time T.

- the activation times Ts of the sonars 301 and 302 shown in FIG. 14A are about 1 second, for example, the activation times Tr of the radars 303, 304, and 305 shown in FIG. 14B are about 3 seconds, and the cameras 306 and 307 shown in FIG.

- the activation time Tc is about 5 seconds, for example. Therefore, when the activation times Ts, Tr, and Tc of the sonars 301 and 302, the radars 303, 304, and 305 and the cameras 306 and 307 are collectively referred to as the above-described “activation time T”, the activation times T are in order from the shortest. Ts, Tr, Tc.

- the corresponding area image 56a is superimposed and displayed on the host vehicle image 56s.

- each area image 56a is displayed in sequence from the external sensor 30 side having a short activation time T in response to the opening command O. Accordingly, the user can intuitively and accurately grasp the activation time T as the performance of each external sensor 30 in order from the shortest one, so that the user's understanding of the performance can be improved. Therefore, this is effective in reducing or avoiding collision damage.

- the third embodiment of the present disclosure is a modification of the first embodiment.

- the area display sub-block 545 displays the animation of each area image 56a in an MFD 51 as a moving image that gradually spreads away from the host vehicle image 56s as shown in FIGS. 15A to 15D. Therefore, in S301 of the vehicle display control flow of the third embodiment, each area image 56a is displayed in animation in a moving image shape that gradually spreads away from the own vehicle image 56s.

- 15A to 15D show the gradually expanding display state in time order for the area image 56a showing the detection areas 306a and 307a corresponding to the cameras 306 and 307 in the external sensor 30, In this case, the spread is smoothly continuous.

- the area image 56a showing the detection areas 301a, 302a, 303a, 304a, and 305a corresponding to the external sensors 30 other than the cameras 306 and 307 also has a display state that gradually increases as shown in FIGS. 15A to 15D. It goes without saying.

- each area image 56a is displayed as an animation that gradually spreads toward the side away from the host vehicle image 56s.

- the user can intuitively understand the range of the detection area 30a spreading toward the side away from the host vehicle 2 as the performance of each external sensor 30, for example, with an image of ultrasonic waves or the like as a detection irradiation wave. Therefore, the user's understanding of the performance can be improved. Therefore, this is effective in reducing or avoiding collision damage.

- the fourth embodiment of the present disclosure is a modification of the first embodiment.

- the HCU 4054 of the fourth embodiment constructs an opening detection block 4541 as an “opening detection unit”.

- the opening detection block 4541 determines the number of times of detection on the same date, in addition to executing detection of the opening command O as in the first embodiment.

- the opening detection block 4541 determines the date when the detection of the opening command O is executed based on one or more of the output signal of the radio wave receiver serving as the occupant sensor 41 and the timing information of the HCU 54.

- the opening detection block 4541 stores or updates the number of detections of the opening command O in the memory 54m on the same date, and resets the number of detections as the date is changed.

- the HCU 4054 constructs a first opening display block 4543 as an “opening detection unit”.

- the opening detection block 4541 determines that the opening command O is detected for the first time on the same date

- the first opening display block 4543 executes the first opening display mode Mo1 during the opening period Po.

- the display control content of 1st opening display mode Mo1 is the same as that of 1st embodiment.

- the HCU 4054 additionally constructs a third opening display block 4548 as an “opening control unit”.

- the third opening display block 4548 displays the third opening display mode Mo3 (see FIG. 17) during the opening period Po.

- the third opening display block 4548 is composed of only the area display sub-block 4545.

- the area display sub-block 4545 reads the vehicle image 56s and the plurality of area images 56a from the memory 54m and displays them on the display range 51a of the MFD 51. .

- the HCU 4054 additionally constructs a fourth opening display block 4549 as an “opening control unit”.

- the fourth opening display block 4549 executes the fourth opening display mode Mo4 (see FIG. 17) after the display control period by the area display sub-block 4545 in the opening period Po.

- the fourth opening display block 4549 displays each caution image 56c in the caution level display area in the display range 50a of the HUD 50.

- the reduced attention images 56c that are no longer associated with the vehicle image 56s are displayed as the display size in the display mode Mo2. It is displayed in the display range 50a of the HUD 50 with substantially the same size.

- the display of the notification image 56i is not executed in the MFD 51 at this time, the display of the images 56s and 56a is completely erased before or after the entire display of the caution image 56c by the HUD 50 or simultaneously with the entire display. May be.

- period setting block 542 the second opening display block 544, and the normal display block 540 constructed by the HCU 4054 are the same as those in the first embodiment.

- the vehicle display control flow is realized as shown in FIGS. The details will be described focusing on the different parts.

- the process proceeds to S4010 after performing S10 and S20 similar to those in the first embodiment.

- the first opening display block 4543 determines the number of times the opening command O is detected on the same date.

- S30 and S40 similar to those of the first embodiment are sequentially executed.

- S4030 is different from S30 and S40.

- S4040 are sequentially executed.

- the third opening display block 4548 executes the third opening display mode Mo3 in the opening period Po.

- the host vehicle image 56s and a plurality of area images 56a associated therewith are read from the memory 54m by the area display sub-block 4545 and displayed on the MFD 51.

- the area display sub-block 4545 switches the area image 56a to the attention image 56c in the first opening display mode Mo1 and cancels the association between the images 56c and 56s in the display mode Mo1. It is prohibited by.

- the fourth opening display block 4549 executes the fourth opening display mode Mo4 in the opening period Po. Specifically, in the fourth opening display mode Mo4, each caution image 56c whose association with the host vehicle image 56s is released is displayed on the HUD 50. At this time, the display of the notification image 56i is not executed in the MFD 51 of the fourth embodiment.

- S50 and S60 similar to those of the first embodiment are executed both after the sequential execution of S30 and S40 and after the sequential execution of S4030 and S4040. Accordingly, in the vehicle display control flow of the fourth embodiment, S10 and S4010 correspond to “opening detection step”, and S20, S30, S40, S4030, and S4040 correspond to “opening control step”.

- the first opening display mode Mo1 and the second opening display mode Mo2 are sequentially executed during the opening period Po when the opening command O is detected for the first time on the same date. . Therefore, the user can easily grasp the driving risk that depends on the obstacle distance corresponding to the attention level L indicated by the attention image 56c in association with the detection area 30a corresponding to each area image 56a before switching.

- the third opening display mode Mo3 and the fourth opening display mode Mo4 are sequentially executed in the opening period Po when the opening command O is detected for the second time or later on the same date.

- the third opening display mode Mo3 in the first opening display mode Mo1, switching from the area image 56a displayed in association with the host vehicle image 56s in the MFD 51 to the attention image 56c is prohibited. Therefore, it is possible to suppress the user from feeling troublesome due to repeated display of the caution image 56c on the same date.

- the fourth opening display mode Mo4 after the third opening display mode Mo3 attention is paid to the HUD 50. An image 56c is displayed. Therefore, the user can easily grasp the driving risk that depends on the obstacle distance corresponding to the attention level L indicated by the attention image 56c in the HUD 50 in association with the detection area 30a corresponding to each area image 56a in the MFD 51. Become.

- the display order of each area image 56a is in an order other than that described in the first and second embodiments, for example, according to the operation of the display setting switch by the user. You may employ

- all area images 56a may be displayed simultaneously.

- sub-blocks 545 and 4545 and S301 and S4301 of Modification 3 for example, only the area image 56a corresponding to the detection area 30a of the external sensor 30 selected according to the operation of the display setting switch by the user may be displayed.

- the sequence display of each area image 56a according to the second embodiment may be adopted in the sub blocks 545 and 4545 and S301 and S4301 of the fourth embodiment.

- the area image 56a corresponding to the detection area 305a of the long-distance millimeter-wave radar 305 having a long maximum detection distance D is displayed, and other area images 56a and The own vehicle image 56s may be reduced.

- the ratio of the separation distances from the own vehicle image 56s to the most distant portion of the outer peripheral contour line of each area image 56a is set to the ratio of the maximum detection distances D of the corresponding detection areas 30a.

- the sub blocks 547 and S303 may not be employed.

- the association between the image 56s and the attention image 56c may be canceled by deleting the host vehicle image 56s in the sub blocks 546 and S302.

- the previous modification 8 may be employed or may not be employed.