WO2012144396A1 - 情報処理装置、情報処理方法、およびプログラム - Google Patents

情報処理装置、情報処理方法、およびプログラム Download PDFInfo

- Publication number

- WO2012144396A1 WO2012144396A1 PCT/JP2012/059958 JP2012059958W WO2012144396A1 WO 2012144396 A1 WO2012144396 A1 WO 2012144396A1 JP 2012059958 W JP2012059958 W JP 2012059958W WO 2012144396 A1 WO2012144396 A1 WO 2012144396A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- user

- score

- unit

- wake

- sleep

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H40/00—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices

- G16H40/60—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices

- G16H40/67—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices for remote operation

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/48—Other medical applications

- A61B5/4806—Sleep evaluation

- A61B5/4809—Sleep detection, i.e. determining whether a subject is asleep or not

-

- G—PHYSICS

- G04—HOROLOGY

- G04F—TIME-INTERVAL MEASURING

- G04F10/00—Apparatus for measuring unknown time intervals by electric means

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q10/00—Administration; Management

- G06Q10/10—Office automation; Time management

- G06Q10/109—Time management, e.g. calendars, reminders, meetings or time accounting

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09B—EDUCATIONAL OR DEMONSTRATION APPLIANCES; APPLIANCES FOR TEACHING, OR COMMUNICATING WITH, THE BLIND, DEAF OR MUTE; MODELS; PLANETARIA; GLOBES; MAPS; DIAGRAMS

- G09B7/00—Electrically-operated teaching apparatus or devices working with questions and answers

-

- G—PHYSICS

- G11—INFORMATION STORAGE

- G11B—INFORMATION STORAGE BASED ON RELATIVE MOVEMENT BETWEEN RECORD CARRIER AND TRANSDUCER

- G11B27/00—Editing; Indexing; Addressing; Timing or synchronising; Monitoring; Measuring tape travel

- G11B27/10—Indexing; Addressing; Timing or synchronising; Measuring tape travel

- G11B27/102—Programmed access in sequence to addressed parts of tracks of operating record carriers

- G11B27/105—Programmed access in sequence to addressed parts of tracks of operating record carriers of operating discs

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H20/00—ICT specially adapted for therapies or health-improving plans, e.g. for handling prescriptions, for steering therapy or for monitoring patient compliance

- G16H20/30—ICT specially adapted for therapies or health-improving plans, e.g. for handling prescriptions, for steering therapy or for monitoring patient compliance relating to physical therapies or activities, e.g. physiotherapy, acupressure or exercising

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H40/00—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices

- G16H40/60—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices

- G16H40/63—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices for local operation

Definitions

- the present technology particularly relates to an information processing apparatus, an information processing method, and a program that can improve sleep efficiency.

- the present technology has been made in view of such a situation, and is intended to improve sleep efficiency.

- An information processing apparatus includes at least one of an acquisition unit that acquires information representing a user's action schedule, and whether or not to wake up or not according to the user's action schedule And a first determination unit that performs at least one of the following determinations: determination of whether to wake up when to wake up;

- a first score representing the degree to be awakened or the degree to be asleep can be obtained.

- a second determination unit that obtains a second score representing the degree of sleepiness of the user based on the data detected by the sensor can be further provided.

- a selection unit that selects content to be played based on the first score and the second score, and a playback unit that plays the content selected by the selection unit may be further provided.

- the selection unit selects the content that causes a change in sleepiness corresponding to the difference between the first score and the second score based on the information stored in the storage unit. Can be made.

- the second determination unit further determines the second score based on data detected by the sensor after the content is reproduced, and the second score obtained before the reproduction of the content is started. Based on the difference from the second score obtained after the reproduction of the content, the information indicating the degree of change in sleepiness for the reproduced content stored in the storage unit is updated.

- An updating unit can be further provided.

- the wakeup unit that wakes up the user according to the level of wakeup, and the first determination unit

- a sleep unit that causes the user to fall asleep according to the level to which the user should sleep can be further provided.

- information representing a user's action schedule is acquired, and at least one of whether to wake up or whether to sleep is determined according to the user's action schedule.

- the determination of at least one of the degree to wake up in the case of being or the degree to sleep in the case of being to sleep is made.

- FIG. It is a block diagram which shows the structural example of a drowsiness judgment part. It is a block diagram which shows the structural example of a music selection / reproduction

- FIG. It is a flowchart explaining the process which learns a user's nearest station. It is a flowchart explaining the process in the case of use case 2.

- FIG. It is a flowchart explaining the process in the case of use case 3.

- FIG. It is a flowchart explaining the process in the case of use case 4.

- FIG. It is a flowchart explaining a music selection / reproduction

- FIG. 1 is a diagram illustrating an information processing apparatus according to an embodiment of the present technology.

- the information processing device 1 in FIG. 1 is a portable device such as a mobile phone, a PDA (Personal Digital Assistant), a digital camera, or a PND (Portable Navigation Device), and has a casing that can be held with one hand. Have.

- a display unit such as an LCD (Liquid Crystal Display) is provided on the front surface of the housing of the information processing apparatus 1.

- the information processing apparatus 1 has a schedule DB, which is a DB (Data Base) in which information on a user's action schedule is stored, for example, in an internal memory.

- the information processing apparatus 1 determines whether the user should wake up or should sleep based on the user's action schedule. When the information processing apparatus 1 determines that the user should wake up, the information processing apparatus 1 obtains an awakening score that expresses the degree (degree) of wakeup as a numerical value. When the information processing apparatus 1 determines that the user should go to sleep, the degree is expressed as a numerical value. Get the sleep score to represent.

- the information processing apparatus 1 obtains a sleepiness score representing the user's sleep desire, that is, sleepiness, as a numerical value based on sensor data detected by various sensors.

- the information processing apparatus 1 has a music playback function, and selects and plays back music that can cause the sleepiness change to bring the sleepiness score close to the arousal score or the sleep onset score. Each piece of music that can be played back by the information processing apparatus 1 is set with metadata that represents changes in sleepiness caused by a user who has listened to the music.

- the information processing apparatus 1 outputs the sound obtained by reproducing the music from the speaker of the information processing apparatus 1 or the earphone attached to the information processing apparatus 1 and allows the user to listen to the sound.

- the information processing apparatus 1 selects the music piece in consideration of the user's sleepiness score and the wakefulness score and reproduces it, so that the information processing apparatus 1 determines the user's sleepiness score. Can be close to the awakening score.

- the information processing apparatus 1 selects and reproduces the music in consideration of the user's sleepiness score and sleepiness score, so that the information processing apparatus 1 The score can be brought close to the sleep onset score.

- the wakefulness score representing the degree to be awakened and the sleepiness score representing the degree to be asleep represent the sleepiness score of the user that should be present, which is determined based on the action schedule.

- FIG. 2 is a diagram illustrating a first example of a use case of the information processing apparatus 1.

- the information processing apparatus 1 obtains a wake-up score representing the degree to which the user should wake up when it is determined that the user should wake up because the current time has approached the wake-up time such as 7:00 am .

- the user's wake-up time is determined in advance by the information processing apparatus 1 based on the user's behavior history, for example.

- the arousal score obtained at this time is, for example, a score smaller than the awakening score obtained when it is determined that it should occur to prevent sleep overtime on the train as described later.

- the information processing apparatus 1 obtains the user's sleepiness score based on the sensor data.

- the sleepiness score obtained at this time is a small score when the sleep time is long and the user is already sufficiently sleeping, and a large score when the sleep time is short and the user is not sleeping much.

- the information processing apparatus 1 selects and reproduces music that can cause the user to cause a change in sleepiness that brings the sleepiness score closer to the awakening score. If the wakefulness score is constant, if the sleepiness score is large, music that causes a large change in sleepiness is played, and if the sleepiness score is small, the music that causes a small change in sleepiness is played. .

- the music that causes a great change in sleepiness in the direction of lowering the sleepiness score is, for example, a music that includes a music with a fast tempo, a music with a high volume, or vocal sounds.

- the music that causes a small change in sleepiness in the direction of lowering the sleepiness score is, for example, a music that has a slower tempo than a music that causes a large change in sleepiness, a music that has a low volume, and a music that does not include vocal sound.

- FIG. 3 is a diagram illustrating a second example of the use case of the information processing apparatus 1.

- the information processing apparatus 1 obtains a wake-up score indicating the degree to which the user should get up when it is determined that the user should get up because the train has approached the getting-off station.

- the disembarking station is the user's home or the nearest station of the company, but it may be another station.

- the nearest station is determined in advance by the information processing apparatus 1 based on the user's action history, for example. Whether the train on board is approaching the nearest station is determined by the information processing apparatus 1 based on the train timetable or the like.

- the arousal score obtained at this time is a score larger than the arousal score obtained in the case of use case 1.

- the information processing apparatus 1 obtains the user's sleepiness score based on the sensor data.

- the information processing apparatus 1 selects and reproduces music that can cause the user to cause a change in sleepiness that brings the sleepiness score closer to the awakening score. If the same drowsiness score as in use case 1 is obtained, the arousal score is large, so that a music that causes a large change in sleepiness is reproduced as compared to use case 1.

- FIG. 4 is a diagram illustrating a third example of the use case of the information processing apparatus 1.

- the information processing apparatus 1 determines that the user should sleep based on the user's action schedule, the information processing apparatus 1 obtains a recommended bedtime.

- the recommended bedtime for example, if the next day's action plan is to go out at a time earlier than the normal wake-up time, recommend a time that is a predetermined time, such as 8 hours, based on the time to go out. It is determined by the information processing apparatus 1.

- the information processing apparatus 1 obtains the user's sleepiness score based on the sensor data.

- the sleepiness score obtained at this time is a small score when the current time is much before the normal bedtime, and a large score when the current time is close to the normal bedtime.

- the information processing apparatus 1 obtains a sleep score indicating the degree to which the person should sleep.

- the information processing apparatus 1 selects and reproduces music that can cause the user to cause a change in sleepiness that brings the sleepiness score closer to the sleep onset score.

- the music that causes a small change in sleepiness in the direction of increasing the sleepiness score is, for example, a music with a slow tempo, a music with a low volume, or a music that does not include vocal sound.

- songs that cause a large change in sleepiness in the direction of increasing sleepiness score do not include, for example, a song that is much slower in tempo than a song that causes a change in sleepiness, a song that has a very low volume, or vocal sound. It is a song.

- FIG. 5 is a diagram illustrating a fourth example of the use case of the information processing apparatus 1.

- the information processing apparatus 1 determines that there is time until the start time of the next meeting based on the user's action schedule, determines that the user should sleep and obtains a sleep score indicating the degree to which the user should sleep.

- the sleep onset score obtained at this time is, for example, a larger score as the work end time of the previous day is later, and a larger score as the time is reached until the start time of the next meeting.

- the information processing apparatus 1 obtains the user's sleepiness score based on the sensor data.

- the information processing apparatus 1 selects and reproduces music that can cause the user to cause a change in sleepiness that brings the sleepiness score closer to the sleep onset score.

- the information processing apparatus 1 When the current time approaches the start time of the conference, the information processing apparatus 1 performs a process for awakening the user in the same manner as in use case 1 or 2.

- FIG. 6 is a diagram illustrating an example of a wakefulness score and a sleep onset score.

- a score less than 0 represents a wakefulness score

- a score greater than 0 represents a sleep onset score.

- the maximum arousal score is 100 (-100) and the maximum sleep score is 100.

- the arousal score is calculated as 40 (-40) in order to gradually awaken.

- the arousal score is calculated as 80 (-80) in order to suddenly awaken.

- the sleep score is calculated as 60 (+60) in order to sleep more strongly.

- the sleep onset score is obtained as 20 (+20).

- FIG. 7 is a block diagram illustrating a hardware configuration example of the information processing apparatus 1.

- the information processing apparatus 1 is configured by connecting a sensor unit 12, a camera 13, an operation unit 14, a display unit 15, a storage unit 16, a communication unit 17, and a reproduction sound output unit 18 to a controller 11. .

- the controller 11 includes a CPU (Central Processing Unit), ROM (Read Only Memory), RAM (Random Access Memory), and the like.

- the CPU of the controller 11 loads a program from the ROM and executes it using the RAM, and controls the overall operation of the information processing apparatus 1.

- the sensor unit 12 includes various sensors such as a sensor that detects biological information that is information related to the user's body and a sensor that detects device information that is information related to the information processing apparatus 1. Sensors that detect information about the user's body include a pulse sensor that detects the user's pulse, a body temperature sensor that detects body temperature, and an electroencephalogram sensor that detects brain waves. Data representing the pulse, body temperature, and electroencephalogram detected by these sensors is output to the controller 11.

- sensors that detect information related to the information processing apparatus 1 include an acceleration sensor, a gyro sensor, and a GPS (Global Positioning System). Data representing the acceleration and angle generated in the information processing apparatus 1 and data representing the position of the information processing apparatus 1 detected by these sensors are output to the controller 11.

- the camera 13 is an image sensor such as a CMOS (Complementary Metal Oxide Semiconductor) image sensor, and performs photoelectric conversion of light taken in by a lens provided on the back side of the housing of the information processing apparatus 1 to generate image data. To do. For example, the camera 13 photographs the user and outputs a face image to the controller 11.

- CMOS Complementary Metal Oxide Semiconductor

- the operation unit 14 includes a button provided on the surface of the casing of the information processing apparatus 1 and a touch panel provided by being stacked on a display such as an LCD constituting the display unit 15.

- the operation unit 14 detects a user operation and outputs information representing the content of the detected operation to the controller 11.

- the display unit 15 displays various types of information such as images and texts according to control by the controller 11.

- the storage unit 16 is composed of a flash memory or the like.

- the storage unit 16 stores various types of information such as a schedule DB that is a schedule information DB representing a user's action schedule and a music DB that is a music DB.

- the communication unit 17 receives radio waves from the base station and communicates with a server on a network such as a LAN (Local Area Network) or the Internet via the network.

- a server on a network such as a LAN (Local Area Network) or the Internet via the network.

- the reproduction sound output unit 18 includes a signal processing unit that outputs a music signal to a speaker provided in the information processing apparatus 1 or an earphone attached to the earphone jack of the information processing apparatus 1.

- the reproduction sound output unit 18 outputs the music reproduced by the controller 11 and allows the user to listen to it.

- FIG. 8 is a block diagram illustrating a functional configuration example of the information processing apparatus 1. At least a part of the functional units shown in FIG. 8 is realized by executing a predetermined program by the controller 11 of FIG.

- a control unit 21, a sleep / wakefulness determination unit 22, a drowsiness determination unit 23, a music selection / playback unit 24, a schedule DB 25, and a music DB 26 are realized.

- the control unit 21 learns the user's behavior based on the sensor data supplied from the sensor unit 12 and specifies the user's wake-up time and the nearest station.

- the control unit 21 registers the specified wake-up time and the nearest station information in the schedule DB 25.

- the control unit 21 controls the sleep / wakefulness determination unit 22 to calculate a wakefulness score or a sleepiness score, and controls the sleepiness determination unit 23 to calculate a sleepiness score.

- the sleep / wakefulness determination unit 22 reads schedule information from the schedule DB 25, and determines whether the user should wake up or should sleep based on the user's action schedule.

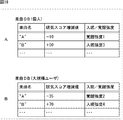

- the schedule DB 25 includes a DB that stores user work-related (work-related) schedule information and a DB that stores private life-related schedule information.

- the sleep / wakefulness determination unit 22 obtains a sleepiness score when it is determined that the user should wake up, and obtains a sleepiness score when it is determined that the user should sleep.

- the sleep / wakefulness determination unit 22 outputs the obtained awakening score or sleepiness score to the music selection / playback unit 24.

- the sleepiness determination unit 23 obtains a sleepiness score based on the sensor data supplied from the sensor unit 12.

- the sleepiness determination unit 23 outputs the obtained sleepiness score to the music selection / playback unit 24.

- the music selection / reproduction unit 24 selects and reproduces the music based on the arousal score or the sleep onset score obtained by the sleep / wakefulness determination unit 22 and the sleepiness score obtained by the sleepiness determination unit 23.

- the music selection by the music selection / playback unit 24 is performed on the music stored in the music DB 26.

- the music DB 26 stores a plurality of music data.

- the music data is taken into the information processing apparatus 1 in advance by the user.

- information representing changes in sleepiness caused by the user who listened to the music is set as metadata.

- the schedule DB 25 and the music DB 26 can be realized in a server on the network. In this case, transmission / reception of data performed between the schedule DB 25 and the music DB 26 and each unit in FIG. 8 is performed via the communication unit 17.

- FIG. 9 is a block diagram illustrating a configuration example of the sleep / wakefulness determination unit 22.

- the sleep / wakefulness determination unit 22 includes a work-related schedule acquisition unit 41, a delivery date / achievement status / importance management unit 42, a bedtime / wakeup time determination unit 43, a private life-related schedule acquisition unit 44, a bedtime / wakeup time determination unit 45, and The score calculation unit 46 is configured.

- the business-related schedule acquisition unit 41 reads and acquires the business-related schedule information of the user from the business-related schedule DB 25A constituting the schedule DB 25.

- the business-related schedule includes, for example, a meeting start time, a business trip departure time, a predetermined document creation deadline, a lunch time, and the like.

- the business-related schedule acquisition unit 41 outputs the acquired schedule information to the delivery date / achievement status / importance level management unit 42.

- the delivery date / achievement status / importance level management unit 42 manages information such as the delivery date of the product, the achievement status of the work, and the importance level of each item registered as a schedule. Information managed by the delivery date / achievement status / importance level management unit 42 is set in advance by the user, for example.

- the delivery date / achievement status / importance level management unit 42 uses the schedule information supplied from the work-related schedule acquisition unit 41 together with information such as the delivery date of the product, the achievement status of the work, the importance level of the schedule, and the bedtime / wakeup time determination unit 43. Output to. For example, when information including the meeting start time is supplied from the work-related schedule acquisition unit 41, the delivery date / achievement status / importance level management unit 42 together with the information supplied from the work-related schedule acquisition unit 41 Output importance information.

- the bedtime / wake-up time determination unit 43 acquires the information supplied from the delivery date / achievement status / importance level management unit 42 and determines whether the user should wake up or should go to sleep according to the schedule.

- the sleeping / wake-up time determination unit 43 determines the wake-up time when it is determined that the user should wake up, and determines the bedtime when it is determined that the user should sleep.

- the bed / wake-up time determination unit 43 specifies that there is time until the start time of the next meeting, the user determines that the user should go to sleep. Also, the bedtime / wake-up time determination unit 43 determines a time that is a predetermined time before the start time of the next meeting as the wake-up time. The bedtime / wakeup time determination unit 43 outputs the information of the wakeup time or bedtime determined in this way to the score calculation unit 46.

- the private life related schedule acquisition unit 44 reads and acquires the user's private life related schedule information from the private life related schedule DB 25B of the schedule DB 25.

- the schedule related to private life includes, for example, the user's normal wake-up time, bedtime, and nearest station.

- the private life related schedule acquisition unit 44 outputs the acquired schedule information to the bedtime / wake-up time determination unit 45.

- the bedtime / wake-up time determination unit 45 acquires the schedule information supplied from the private life related schedule acquisition unit 44, and determines whether the user should wake up or sleep according to the schedule. The bedtime / wake-up time determination unit 45 determines the bedtime when it is determined that the user should wake up, and the bedtime when it is determined that the user should sleep.

- the bedtime / wake-up time determination unit 45 acquires schedule information including a user's normal wake-up time, and determines that the user should wake up when the current time approaches the wake-up time.

- the bedtime / wake-up time determination unit 45 determines a time that is a predetermined time before the normal wake-up time as the wake-up time.

- the bedtime / wake-up time determination unit 45 outputs the information on the wake-up time or bedtime determined in this way to the score calculation unit 46.

- the score calculation unit 46 calculates the awakening score based on the wake-up time and the current time when the wake-up time is determined by the bed / wake-up time determination unit 43 or the bed / wake-up time determination unit 45. On the other hand, when the bedtime is determined by the bedtime / wake-up time determination unit 43 or the bedtime / wake-up time determination unit 45, the score calculation unit 46 calculates a sleep onset score based on the bedtime and the current time.

- the score calculation unit 46 when the wake-up time determined by the sleep / wake-up time determination unit 43 or the sleep / wake-up time determination unit 45 is a time 10 minutes after the current time, the score calculation unit 46 is 30 minutes after the current time. A greater arousal score is calculated than when it is time. In this way, the score calculation unit 46 obtains a smaller score as the time from the current time to the wake-up time is longer, and conversely, obtains a larger score as the time from the current time to the wake-up time is shorter. calculate.

- the score calculation unit 46 is 30 minutes after the current time. A greater sleep score is calculated than when the current time is. Thus, the score calculation unit 46 obtains a smaller score as the time from the current time to the bedtime becomes longer, and conversely, obtains a higher score as the time from the current time to the bedtime becomes shorter. calculate.

- the score calculation unit 46 outputs the calculated sleep onset score or wakefulness score to the music selection / playback unit 24.

- FIG. 10 is a block diagram illustrating a configuration example of the drowsiness determination unit 23.

- the sleepiness determination unit 23 includes a sensor data acquisition unit 61, a feature amount extraction unit 62, a sleepiness determination unit 63, a face recognition unit 64, a face motion determination unit 65, and a score calculation unit 66.

- the sensor data acquisition unit 61 includes a biological information acquisition unit 71, a device information acquisition unit 72, and a captured image acquisition unit 73.

- the biological information acquisition unit 71 of the sensor data acquisition unit 61 acquires sensor data output from a sensor that detects biological information among the sensors constituting the sensor unit 12.

- the biometric information acquisition unit 71 outputs biometric information, which is information of the user's pulse detected by the pulse sensor, the user's body temperature detected by the body temperature sensor, and the user's brain wave detected by the electroencephalogram sensor, to the feature amount extraction unit 62. To do.

- the device information acquisition unit 72 acquires sensor data output from a sensor that detects device information among the sensors constituting the sensor unit 12.

- the device information acquisition unit 72 outputs device information, which is information on the acceleration detected by the acceleration sensor and the angle detected by the gyro sensor, to the feature amount extraction unit 62.

- the captured image acquisition unit 73 acquires an image of the user's face taken by the camera 13 and outputs the acquired image to the face recognition unit 64.

- the feature amount extraction unit 62 analyzes the biological information supplied from the biological information acquisition unit 71 and extracts the feature amount of the biological information. In addition, the feature amount extraction unit 62 analyzes the device information supplied from the device information acquisition unit 72 and extracts the feature amount of the device information. The feature amount extraction unit 62 outputs the extracted feature amount of the biological information and the feature amount of the device information to the sleepiness determination unit 63.

- the drowsiness discriminating unit 63 is a drowsiness discriminator that discriminates the user's drowsiness by matching the pre-given teacher data with the feature amount supplied from the drowsiness discrimination unit 63. For example, a feature amount extracted from biological information when a person is sleeping and a feature amount extracted from device information are given to the sleepiness determination unit 63 as teacher data.

- the sleepiness determination unit 63 performs matching between the teacher data of the biological information and the feature amount extracted from the biological information by the feature amount extraction unit 62, and obtains a matching score. Further, the drowsiness determination unit 63 performs matching between the teacher data of the device information and the feature amount extracted from the device information by the feature amount extraction unit 62, and obtains a matching score. For example, the sleepiness determination unit 63 outputs the obtained matching score to the score calculation unit 66 as information representing the user's sleepiness.

- the drowsiness discrimination by the drowsiness discrimination unit 63 is performed using at least a part of the plurality of sensor data included in the biological information and the device information. For example, when the user is out and cannot obtain biometric information, the user's sleepiness is determined based only on the device information.

- the face recognition unit 64 recognizes the user's face in the image by analyzing the image acquired by the captured image acquisition unit 73. Further, the face recognition unit 64 extracts the recognized facial features and outputs them to the face motion determination unit 65. For example, the features of the user's eyes are extracted by the face recognition unit 64.

- the face motion determination unit 65 determines whether or not the user is sleeping, such as whether or not the user's eyes are open or blinking. The user's face motion is determined. The face motion determination unit 65 outputs information representing the determination result of the user's face motion to the score calculation unit 66.

- a score indicating the possibility that the user's eyes are open or not open, and a score indicating the possibility that the user is blinking or not blinking are provided.

- the score is output to the score calculator 66. For example, if the number of blinks of the user per predetermined unit time is less than the threshold number, it is determined that the user is likely to be sleepy.

- the score calculation unit 66 calculates a drowsiness score based on the information representing the user's sleepiness supplied from the sleepiness determination unit 63 and the determination result of the user's face movement supplied from the face motion determination unit 65. The current time is also taken into account when calculating the sleepiness score.

- the score calculation unit 66 outputs the calculated sleepiness score information to the music selection / playback unit 24.

- FIG. 11 is a block diagram illustrating a configuration example of the music selection / playback unit 24.

- the music selection / reproduction unit 24 includes a music selection unit 81, a reproduction unit 82, an information management unit 83, and a detection unit 84.

- the sleep or awake score supplied from the sleep / wake determination unit 22 is input to the music selection unit 81, and the sleepiness score supplied from the sleepiness determination unit 23 is input to the music selection unit 81, the information management unit 83, and the detection unit 84, respectively. Is done.

- the music selection unit 81 selects the music to be reproduced from the music stored in the music DB 26 as the sleep or wake score supplied from the sleep / wake determination unit 22 and the sleepiness score supplied from the sleepiness determination unit 23. Select based on.

- the music selection unit 81 reads the data of the selected music from the music DB 26 and outputs it to the playback unit 82.

- the reproduction unit 82 reproduces the music selected by the music selection unit 81 and outputs the sound obtained by the reproduction from the reproduction sound output unit 18.

- the information management unit 83 updates the metadata of the reproduced music based on the sleepiness score before the music reproduction by the reproduction unit 82 and the sleepiness score obtained from the sensor data detected after the music reproduction.

- the update of the metadata is performed, for example, when it is detected that the user has fallen asleep by playing music or when the user has been awakened by playing music.

- the detection unit 84 detects whether the user is awake or sleeping based on the input sleepiness score. When it is determined that the user should sleep, the detection unit 84 outputs information representing the fact to the music selection unit 81 and the information management unit 83 when detecting that the user has gone to sleep by playing the music. To do. Further, when it is determined that the user should wake up, when the detection unit 84 detects that the user has woken up by reproducing the music, information indicating the information is displayed as the music selection unit 81 and the information management unit 83. Output to.

- the selection of music by the music selection unit 81, the update of metadata by the information management unit 83, and the detection of the user state by the detection unit 84 will be described in detail later.

- FIG. 12 is performed, for example, after the wake-up time is set by the alarm function that the information processing apparatus 1 has.

- the control unit 21 outputs an alarm sound from the reproduction sound output unit 18.

- step S1 the control unit 21 determines whether or not the user has been woken up, and waits until it is determined that the wake-up has been detected. Whether or not the user has woken up is determined based on whether or not an alarm sound stop operation has been performed by the user. Whether or not the user has woken up may be determined based on the drowsiness score or sensor data as described later.

- step S2 the control unit 21 acquires the current time.

- step S3 the control unit 21 obtains the wake-up frequency in the time zone including the current time.

- the control unit 21 stores and manages a history of daily user wake-up times in the schedule DB 25. Based on the history stored in the schedule DB 25, the control unit 21 obtains the wake-up frequency in a time zone including the current time among predetermined time zones such as every 15 minutes.

- step S4 the control unit 21 determines whether or not the wake-up frequency in the time zone including the current time is equal to or more than a predetermined number of times as a threshold value. When it is determined in step S4 that the wake-up frequency in the time zone including the current time is less than the predetermined number, the process returns to step S1 and the above processing is repeated.

- step S5 when it is determined in step S4 that the wake-up frequency in the time zone including the current time is equal to or greater than the predetermined number, in step S5, the control unit 21 determines the time zone including the current time as the wake-up time zone.

- the control unit 21 sets a predetermined time in the wake-up time zone, such as the start time of the determined wake-up time zone, as the wake-up time, and stores the information on the wake-up time in the private life related schedule DB 25B of the schedule DB 25. Thereafter, the process ends.

- step S11 the private life related schedule acquisition unit 44 (FIG. 9) of the sleep / wakefulness determination unit 22 acquires the information of the usual wake-up time obtained by learning from the private life related schedule DB 25B.

- the bedtime / wake-up time determination unit 45 determines the normal wake-up time acquired from the private life related schedule DB 25B as the wake-up time.

- step S12 the score calculation unit 46 determines that the user should wake up, and determines whether or not the current time is a certain time before the wake-up time.

- the score calculation unit 46 waits until it is determined in step S12 that the current time is a certain time before the wake-up time.

- step S12 If it is determined in step S12 that the current time is a certain time before the wake-up time, the drowsiness determination unit 23 calculates the drowsiness score based on the sensor data detected by the sensor unit 12 in step S13.

- step S14 the score calculation unit 46 of the sleep / wakefulness determination unit 22 obtains a wakefulness score.

- step S15 the music selection / playback unit 24 performs music selection / playback processing.

- music selection / reproduction process music that can cause the user to change sleepiness that brings the sleepiness score closer to the arousal score is selected and reproduced.

- the music selection / playback process will be described later. After the music selection / playback process is performed and the user wakes up, the process ends.

- the information processing apparatus 1 can wake up the user comfortably by playing music with a slow tempo when the user's sleepiness is low.

- the process of FIG. 14 is started when it is detected that the user is on the train, for example.

- the current position detected by GPS is a position on a train track and the moving speed of the position is the same as the speed of the train, it is detected that the user is on the train. It is also possible to detect that the user is on the train when the vibration feature detected by the sensor unit 12 matches the vibration feature detected in the train. Information representing the speed of the train and the characteristics of the vibration detected in the train is stored in advance in the storage unit 16, for example. It may be detected that the user is on the train in response to an operation by the user.

- step S21 the control unit 21 determines whether or not the user's getting off is detected, and waits until it is determined that the getting off is detected. For example, when the current position detected by GPS is the position of a train station and the moving speed is a walking speed, it is detected that the user has got off the train. It may be detected that the user gets off in response to an operation by the user.

- step S22 the control unit 21 acquires date information and position information.

- the location information is acquired by GPS.

- step S23 the control unit 21 specifies the getting-off station based on the acquired position information.

- the control unit 21 specifies the position represented by the position information on the map, and if the specified position is the position of the station, the control unit 21 specifies the station as the getting-off station.

- the map previously given to the control unit 21 includes information on the position of each station.

- step S24 the control unit 21 obtains the frequency of getting off within a predetermined period at the specified getting-off station. For example, the control unit 21 identifies the getting-off station every day, and manages the history of the getting-off station stored in the schedule DB 25. Based on the history stored in the schedule DB 25, the control unit 21 calculates the frequency of getting off within a predetermined period such as one week.

- step S25 the control unit 21 determines whether or not the getting-off frequency obtained in step S24 is equal to or more than a predetermined number of times as a threshold value. When it is determined in step S25 that the frequency of getting off is less than the predetermined number of times, the process returns to step S21 and the above processing is repeated.

- step S26 the control unit 21 determines the specified getting-off station as the nearest station.

- the control unit 21 stores the information on the nearest station in the private life related schedule DB 25B of the schedule DB 25 and ends the process.

- step S31 the control unit 21 determines whether or not the user has got on the train and waits until it is determined that the user has got on the train. Whether or not the user is on the train is determined using the current position and map detected by GPS as described above, for example.

- step S32 the private life related schedule acquisition unit 44 acquires information on the timetable of the train on which the user has taken.

- the train on which the user got is detected based on, for example, the position of the boarding station and the moving direction of the user detected by GPS.

- the information on the timetable of the train on which the user has boarded is downloaded in advance from a predetermined server, for example, and stored in the private life related schedule DB 25B.

- the bedtime / wake-up time determination unit 45 refers to the timetable acquired by the private life related schedule acquisition unit 44, and identifies the time at which the train on which the user rides arrives at the nearest station.

- the score calculation unit 46 determines the specified arrival time as the getting-off time, that is, the wake-up time of the user sleeping on the train.

- step S34 the score calculation unit 46 determines whether or not the current time is a certain time before the getting-off time, and waits until it is determined that the time is a certain time before the getting-off time.

- step S34 When it is determined in step S34 that the current time is a certain time before the departure time, the drowsiness determination unit 23 calculates a drowsiness score based on the sensor data detected by the sensor unit 12 in step S35.

- step S36 the score calculation unit 46 obtains a wakefulness score.

- step S37 the music selection / playback unit 24 performs music selection / playback processing.

- the music selection / reproduction processing here, a music that causes a greater change in sleepiness than in the use case 1 is selected and reproduced.

- the information processing apparatus 1 can wake up the user before the train reaches the nearest station by listening to music that causes a great change in sleepiness.

- step S41 the work-related schedule acquisition unit 41 of the sleep / wakefulness determination unit 22 acquires the wake-up time of the next morning of the user. For example, when schedule information including the wake-up time of the next morning is stored in the work-related schedule DB 25A of the schedule DB 25, the work-related schedule acquisition unit 41 acquires the wake-up time of the next morning from the schedule information.

- schedule information of a person who accompanies a business trip with the user of the information processing device 1 is registered in the business-related schedule DB 25A, the wake-up time of the user of the information processing device 1 is acquired based on the schedule information. May be.

- step S42 the bedtime / wake-up time determination unit 43 obtains a recommended bedtime according to the wake-up time acquired in step S41.

- the bedtime / wake-up time determination unit 43 obtains a recommended bedtime that is a predetermined time before the wake-up time acquired in step S41.

- the recommended sleeping time is determined. It may be required. For example, a time after a predetermined time from the time when the accompanying person goes to bed is obtained as a recommended bedtime. In determining the recommended bedtime, the importance of the next morning schedule managed by the delivery date / achievement status / importance level management unit 42 is also taken into consideration.

- step S43 the bedtime / wake-up time determination unit 43 determines whether or not the current time is a certain time before the recommended bedtime.

- the bedtime / wake-up time determination unit 43 waits until it is determined in step S43 that the current time is a predetermined time before the recommended bedtime.

- step S44 the drowsiness determination unit 23 calculates a drowsiness score based on the sensor data detected by the sensor unit 12. To do.

- step S45 the score calculation unit 46 obtains a sleep onset score.

- step S46 the music selection / playback unit 24 performs music selection / playback processing.

- music selection / reproduction processing here, music that can cause the user to change sleepiness that brings the sleepiness score closer to the sleep onset score is selected and reproduced.

- the information processing apparatus 1 can cause the user to fall asleep at an early time by listening to music that increases drowsiness.

- step S51 the work-related schedule acquisition unit 41 of the sleep / wakefulness determination unit 22 acquires schedule information stored in the work-related schedule DB 25A of the schedule DB 25.

- schedule information stored in the work-related schedule DB 25A of the schedule DB 25.

- information including the start time of the next meeting is acquired.

- the information acquired by the work-related schedule acquisition unit 41 is output to the score calculation unit 46 through the delivery date / achievement status / importance level management unit 42 and the bedtime / wake-up time determination unit 43 together with information such as the importance level of the conference.

- step S52 the score calculation unit 46 obtains a sleep onset score when there is an idle time longer than a predetermined time until the start time of the next meeting.

- step S53 the drowsiness determination unit 23 calculates a drowsiness score based on the sensor data detected by the sensor unit 12.

- step S54 the music selection / playback unit 24 performs music selection / playback processing.

- the music selection / reproduction process here is a process for causing the user to fall asleep, and the user who has listened to the reproduced music will appropriately take a nap.

- step S55 the bedtime / wake-up time determination unit 43 determines that the user should wake up and sets the wake-up time. For example, the higher the sleepiness score, the later the wake-up time.

- step S56 the bedtime / wake-up time determination unit 43 determines whether or not the current time is a time that is a predetermined time before the wake-up time, and waits until it is determined that the time is a predetermined time before the wake-up time.

- step S56 If it is determined in step S56 that the current time is a certain time before the wake-up time, the drowsiness determination unit 23 calculates a drowsiness score based on the sensor data detected by the sensor unit 12 in step S57.

- step S58 the score calculation unit 46 obtains a wakefulness score.

- step S59 the music selection / playback unit 24 performs music selection / playback processing.

- the music selection / reproduction process here is a process for awakening the user who takes a nap, and the user who listens to the music wakes up from the nap. After the music selection / playback process is performed and the user wakes up, the process ends.

- the information processing apparatus 1 can make the user take a nap when there is time until the next schedule, and can wake up before the next schedule.

- the music selection unit 81 of the music selection / playback unit 24 selects a music DB.

- the music DB includes a large-scale user DB on a server that can be accessed by a plurality of users.

- the information processing apparatus 1 can acquire and reproduce music data from a music DB of a large-scale user. For example, one of the music DB 26 which is a personal DB and the music DB of a large-scale user is designated and selected by the user.

- FIG. 19 is a diagram showing an example of the metadata of music stored in the music DB.

- 19A shows a music DB 26 (personal music DB)

- FIG. 19B shows a music DB of a large-scale user.

- the sleepiness score increase / decrease value is a value representing a change in sleepiness score caused to the user who listens to the music.

- the sleep intensity represents the degree of sleep

- the arousal intensity represents the degree of arousal.

- the sleepiness score increase / decrease value of the music “A” in FIG. 19A is ⁇ 10

- the sleepiness score of the user is reduced by 10. This means that the user can be awakened by the value 10.

- the awakening intensity of the music “A” is 1.

- the sleepiness score increase / decrease value of the music “B” in FIG. 19A is +50, which means that when the user of the information processing apparatus 1 listens to the music “B”, the user's sleepiness score is increased by 50. This means that the user can fall asleep for the value 50.

- the sleep intensity of the music “B” is 3.

- the sleepiness score increase / decrease value of the music DB 26 is registered in advance by, for example, detecting changes in the sleepiness score before and after listening to the music “A” and the music “B”. It is what.

- the sleepiness score increase / decrease value in the music DB of the large-scale user in B of FIG. 19 is the sleepiness before and after listening to the music “A” and the music “B” to a plurality of users. Represents the average score change.

- the music “A” and the music “B” are reproduced at the terminals of the respective users, the detected sleepiness score increase / decrease value is transmitted to the server, and the average value is obtained and managed by the server.

- FIG. 20 is a diagram showing an example of the correspondence between sleepiness score increase / decrease values and sleep onset / wakefulness intensity. 20 is managed by the music selection unit 81, for example.

- the wakefulness intensity when the sleepiness score increase / decrease value is 0 to -25, the wakefulness intensity is 1, and when the sleepiness score increase / decrease value is -25 to -50, the wakefulness intensity is 2.

- the sleepiness score increase / decrease value is -50 to -75, the awakening intensity is 3, and when the sleepiness score increase / decrease value is -75 to -100, the awakening intensity is 4, and the sleepiness score increase / decrease value is -100 or more.

- the arousal intensity is 5.

- the sleepiness intensity when the sleepiness score increase / decrease value is 0-25, the sleepiness intensity is 1, and when the sleepiness score increase / decrease value is 25-50, the sleepiness intensity is 2.

- the sleepiness score increase / decrease value when the sleepiness score increase / decrease value is 50 to 75, the sleepiness intensity is 3; when the sleepiness score increase / decrease value is 75 to 100, the sleepiness intensity is 4, and when the sleepiness score increase / decrease value is 100 or more, The strength is 5.

- the music selection unit 81 acquires the sleepiness score obtained by the sleepiness determination unit 23 in step S72.

- the sleepiness score obtained by the sleepiness determination unit 23 is also supplied to the information management unit 83.

- step S73 the music selection unit 81 acquires the sleep onset score or the arousal score obtained by the sleep onset / wakefulness determination unit 22.

- step S74 when the sleep onset score is obtained by the sleep onset / wakefulness determination unit 22, the music selection unit 81 obtains the sleep intensity based on the sleepiness score and the sleep onset score, and the sleepfulness score is obtained by the sleep onset / wakeup determination unit 22.

- the arousal intensity is obtained based on the sleepiness score and the arousal score.

- the sleep onset score or the arousal score can be considered as the sleepiness score that the user should be.

- the music selection unit 81 obtains the difference between the sleepiness score and the sleepiness score, and obtains the sleepiness intensity of the sleepiness score increase / decrease value corresponding to the obtained difference from the conversion table of FIG.

- the music selection unit 81 obtains the difference between the arousal score and the drowsiness score, and obtains the arousal intensity of the sleepiness score increase / decrease value corresponding to the obtained difference from the conversion table of FIG.

- the music selection unit 81 obtains a difference ⁇ 70 between the sleepiness score and the sleepiness score, and the awakening intensity corresponding to the ⁇ 70 sleepiness score increase / decrease value Awakening intensity 3 is obtained.

- step S75 the music selection unit 81 selects music having the sleep intensity or arousal intensity obtained in step S74 as metadata from the music registered in the music DB selected in step S71, and acquires data. .

- the music selected in this way is a music that changes the sleepiness score of the user to the sleepiness score that should be present.

- the music data selected by the music selection unit 81 and acquired from the music DB is supplied to the reproduction unit 82.

- step S76 the playback unit 82 plays back the music selected by the music selection unit 81.

- step S77 the drowsiness determination unit 23 obtains the user's drowsiness score again based on the sensor data detected by the sensor unit 12 after reproducing the music, and updates the drowsiness score.

- the updated sleepiness score is closer to the sleepiness score or the awakening score than the sleepiness score before the music reproduction.

- the updated sleepiness score is also supplied to the information management unit 83 and the detection unit 84.

- step S78 the information management unit 83 obtains the difference between the sleepiness score after the music reproduction and the sleepiness score before the music reproduction as an increase / decrease value of the sleepiness score, and records it in a memory (not shown) or the like.

- step S79 the detection unit 84 performs sleep / wakefulness determination processing.

- the sleep / wakefulness determination process is a process for detecting that the user has fallen asleep when it is determined that the user should sleep, and when the user has determined that the user should wake up, It is a process to detect what happened.

- the sleep / wakefulness determination process will be described later.

- step S80 the information management unit 83 determines whether the user has fallen asleep or woke up based on the result of the sleep / wakefulness determination process.

- step S80 When it is determined that the user should sleep, when it is determined in step S80 that the user has slept, or when it is determined that the user should wake up, it is determined that the user has occurred in step S80.

- step S81 the information management unit 83 feeds back the sleepiness score increase / decrease value recorded in the memory.

- the feedback of the sleepiness score increase / decrease value is performed by updating the sleepiness score increase / decrease value set as metadata in the reproduced music based on the new sleepiness score increase / decrease value recorded in the memory.

- the sleepiness score increase / decrease value of the music is rewritten with the new sleepiness score increase / decrease value.

- the sleepiness score increase / decrease value of the music is transmitted to the server.

- the average value of the sleepiness score increase / decrease values of a plurality of users is obtained again based on the new sleepiness score increase / decrease value transmitted from the information processing apparatus 1, and the music metadata is rewritten.

- step S15 in FIG. 13 After the sleepiness score increase / decrease value is fed back, the process returns to step S15 in FIG. 13, step S37 in FIG. 15, step S46 in FIG. 16, and steps S54 and S59 in FIG. Is called.

- step S82 the score calculation unit 46 of the sleep / wakefulness determination unit 22 calculates and updates the sleepiness score or the sleepfulness score again. .

- the processing after step S74 is performed. For example, when the user does not wake up even though the music for wake-up is played, the current time approaches the wake-up time, so that the wake-up score is updated, and the processes after step S74 are performed.

- the sleep detection process is a process of detecting that the user has fallen asleep.

- the sleep onset determination process is a process performed when it is determined that the user should sleep.

- the detection unit 84 acquires a sleep threshold.

- the sleep threshold is a sleepiness score that is a reference for detecting that the user has fallen asleep.

- the sleep threshold is obtained in advance based on the sleepiness score of the user of the information processing apparatus 1 or the sleepiness scores of a plurality of users, and is stored in the storage unit 16 or the like. Has been. If the user's sleepiness score is higher than the sleep threshold, it is determined that the user has fallen asleep.

- step S92 the detection unit 84 acquires the drowsiness score updated in step S77 of FIG.

- step S93 the detection unit 84 determines whether or not the updated sleepiness score is equal to or higher than the sleep onset threshold. If it is determined that the updated sleepiness score is lower than the sleep onset threshold, the processing after step S92 is repeated.

- step S93 determines in step S93 that the updated sleepiness score is greater than or equal to the sleep threshold.

- the detection unit 84 determines in step S94 that the user has fallen asleep, and information indicating that is sent to the music selection unit 81 and the information management unit 83. Output.

- step S94 If it is determined in step S94 that the user has fallen asleep, or if it is determined in step S93 that the drowsiness score is less than the sleep threshold value a predetermined number of times or more, the process returns to step S79 in FIG. 18 and the subsequent processing is performed. .

- the awakening determination process is a process performed when it is determined that the user should wake up.

- the detection unit 84 acquires an arousal threshold value.

- the awakening threshold is a drowsiness score serving as a reference for detecting that the user has woken up, and is obtained in advance based on the drowsiness score of the user of the information processing apparatus 1 or the drowsiness scores of a plurality of users, and is stored in the storage unit 16 or the like Has been. If the user's sleepiness score is lower than the wakefulness threshold, it is determined that the user has woken up.

- step S102 the detection unit 84 acquires the drowsiness score updated in step S77 of FIG.

- step S103 the detection unit 84 determines whether or not the updated drowsiness score is equal to or lower than the wakefulness threshold value. If it is determined that the updated sleepiness score is greater than the wakefulness threshold value, the process from step S102 is repeated.

- step S103 determines in step S104 that the user has occurred, and information indicating that is sent to the music selection unit 81 and the information management unit 83. Output.

- step S104 If it is determined in step S104 that the user has woken up, or if it is determined in step S103 that the drowsiness score exceeds the awakening threshold value a predetermined number of times or more, the process returns to step S79 in FIG. Is called.

- the process of FIG. 23 differs from the process of FIG. 21 in that the determination as to whether or not the user has fallen is performed based on the sensor data detected by the sensor unit 12.

- step S111 the detection unit 84 acquires teacher data during sleep.

- the sleep teacher data is the sensor data itself detected by the sensor unit 12 when the user goes to sleep, or data representing the characteristics of the sensor data extracted from the sensor data, and is stored in advance in the storage unit 16 or the like. Has been.

- step S112 the detection unit 84 acquires the current sensor data.

- step S113 the detection unit 84 performs matching between the acquired sensor data or the feature extracted from the sensor data and the teacher data to obtain a matching score.

- step S114 the detection unit 84 determines whether or not the matching score is greater than or equal to a threshold value. If it is determined that the matching score is less than the threshold value, the process from step S112 is repeated.

- step S114 determines that the matching score is greater than or equal to the threshold value

- the detection unit 84 determines that the user has fallen asleep in step S115, and outputs information indicating that to the music selection unit 81 and the information management unit 83.

- step S115 If it is determined in step S115 that the user has fallen asleep, or if it is determined in step S114 that the matching score is less than the predetermined number of times or more, the process returns to step S79 in FIG.

- the process of FIG. 24 differs from the process of FIG. 22 in that the determination as to whether or not the user has occurred is performed based on the sensor data detected by the sensor unit 12.

- step S121 the detection unit 84 acquires teacher data at awakening.

- the teacher data at the time of awakening is the sensor data itself detected by the sensor unit 12 when the user wakes up, or data representing the characteristics of the sensor data extracted from the sensor data. Has been.

- step S122 the detection unit 84 acquires current sensor data.

- step S123 the detection unit 84 performs matching between the acquired sensor data or the feature extracted from the sensor data and the teacher data to obtain a matching score.

- step S124 the detection unit 84 determines whether or not the matching score is greater than or equal to a threshold value, and if it is determined that the matching score is less than the threshold value, the process from step S122 is repeated.

- step S124 determines in step S124 that the matching score is greater than or equal to the threshold value, the detection unit 84 determines in step S125 that the user has occurred, and outputs information indicating that to the music selection unit 81 and the information management unit 83.

- step S125 If it is determined in step S125 that the user has occurred, or if it is determined in step S124 that the matching score is less than the predetermined number of times, the process returns to step S79 in FIG. 18 and the subsequent processing is performed.

- the information processing apparatus 1 can lay the user down when it should sleep, and can wake up the user when it should wake up, improving the sleep efficiency of the user. It becomes possible.

- FIG. 25 is a diagram illustrating an example of learning by the sleepiness discriminator.

- information processing apparatuses 1A to 1D are connected to a server 101 via a network.

- Each of the information processing apparatuses 1A to 1D has the same configuration and the same function as the information processing apparatus 1 described above.

- Each of the information processing apparatuses 1A to 1D uploads sensor data detected by the sensor unit 12 to the server 101.

- the server 101 accumulates the sensor data transmitted from the information processing apparatuses 1A to 1D and learns the sleepiness discriminator based on the sensor data transmitted from the information processing apparatuses 1A to 1D.

- the server 101 transmits the data of the sleepiness discriminator updated by learning to the information processing apparatuses 1A to 1D.

- each of the information processing apparatuses 1A to 1D can obtain a highly accurate sleepiness score.

- various types of processing are performed in the information processing apparatus 1 including determination as to whether the user should wake up or should go to sleep.

- the processing may be performed in the server 101.

- the user is put to sleep or awaken by playing music, but the means for putting the user to sleep or awaken is not limited to playing music.

- a means for causing the user to fall asleep or wake up a device that reproduces and displays an image, an air conditioner, a vibration generator, or the like that can be controlled by the information processing device 1 can be used.

- the air conditioner when used as a means to put a user to sleep or wake up, the air conditioner is adjusted so that the room is adjusted to an appropriate temperature when the user is asleep, and the room is adjusted to be lower or higher than the appropriate temperature when the user is awakened. Processing to be controlled is performed by the information processing apparatus 1.

- the degree to which the user should wake up is determined.

- the degree of sleep should be determined. However, only the former determination or only the latter determination may be performed. That is, it is possible to make the information processing apparatus 1 only determine whether the user should wake up or go to sleep. It is also possible to cause the information processing apparatus 1 to make only the judgment of the degree to sleep.

- FIG. 26 is a block diagram showing an example of the hardware configuration of a computer that executes the above-described series of processes using a program.

- a CPU Central Processing Unit

- ROM Read Only Memory

- RAM Random Access Memory

- An input / output interface 155 is further connected to the bus 154.

- the input / output interface 155 is connected to an input unit 156 composed of a keyboard, a mouse, etc., and an output unit 157 composed of a display, a speaker, and the like.

- the input / output interface 155 is connected to a storage unit 158 made up of a hard disk, a non-volatile memory, etc., a communication unit 159 made up of a network interface, etc., and a drive 160 that drives the removable media 161.

- the CPU 151 loads the program stored in the storage unit 158 to the RAM 153 via the input / output interface 155 and the bus 154 and executes it, thereby executing the above-described series of processing. Is done.

- the program executed by the CPU 151 is recorded on the removable medium 161 or provided via a wired or wireless transmission medium such as a local area network, the Internet, or digital broadcasting, and is installed in the storage unit 158.

- the program executed by the computer may be a program that is processed in time series in the order described in this specification, or in parallel or at a necessary timing such as when a call is made. It may be a program for processing.

- Embodiments of the present technology are not limited to the above-described embodiments, and various modifications can be made without departing from the gist of the present technology.

- An acquisition unit for acquiring information representing a user's action schedule; In accordance with the user's action schedule, at least one of whether to wake up or whether to sleep and whether to wake up when to wake up, or to wake up when to sleep

- An information processing apparatus comprising: a determination; and a first determination unit that determines at least one of the determination.

- the first determination unit obtains a first score representing the degree to be awakened or the degree to be asleep when performing the determination of the degree to be awakened or the degree to be asleep.

- Information processing apparatus according to (1) .

- the information processing apparatus further including a second determination unit that obtains a second score representing the degree of sleepiness of the user based on data detected by the sensor.

- a selection unit that selects content to be reproduced based on the first score and the second score;

- the information processing apparatus further comprising: a reproduction unit that reproduces the content selected by the selection unit.

- a storage unit that stores information representing a relationship between each of the content and a degree of change in sleepiness caused to a user who has viewed the content with respect to the plurality of content.

- the selection unit selects the content that causes a change in sleepiness corresponding to a difference between the first score and the second score based on the information stored in the storage unit. ).

- the second determination unit further obtains the second score based on data detected by the sensor after reproduction of the content, Based on the difference between the second score obtained before starting the reproduction of the content and the second score obtained after the reproduction of the content, the reproduction stored in the storage unit is performed.

- the information processing apparatus further including an update unit that updates the information indicating a degree of change in sleepiness for the content.

- An awakening unit that awakens the user according to the degree to be awakened when it is determined that the first judgment unit is to be awakened and the degree to be awakened is determined;

- the (1) to (1) to (1) further comprising: a sleep unit that causes the user to fall asleep according to the degree to sleep when the first determination unit determines that the user should sleep.

Landscapes

- Engineering & Computer Science (AREA)

- Health & Medical Sciences (AREA)

- Business, Economics & Management (AREA)

- Biomedical Technology (AREA)

- Life Sciences & Earth Sciences (AREA)

- General Health & Medical Sciences (AREA)

- Medical Informatics (AREA)

- Public Health (AREA)

- Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Human Resources & Organizations (AREA)

- General Business, Economics & Management (AREA)

- Primary Health Care (AREA)

- Epidemiology (AREA)

- General Physics & Mathematics (AREA)

- Strategic Management (AREA)

- Entrepreneurship & Innovation (AREA)

- Biophysics (AREA)

- Tourism & Hospitality (AREA)

- Marketing (AREA)

- Economics (AREA)

- Operations Research (AREA)

- Heart & Thoracic Surgery (AREA)

- Data Mining & Analysis (AREA)

- Surgery (AREA)

- Quality & Reliability (AREA)

- Educational Technology (AREA)

- Animal Behavior & Ethology (AREA)

- Veterinary Medicine (AREA)

- Molecular Biology (AREA)

- Pathology (AREA)

- Anesthesiology (AREA)

- Educational Administration (AREA)

- Physical Education & Sports Medicine (AREA)

- Measurement Of The Respiration, Hearing Ability, Form, And Blood Characteristics Of Living Organisms (AREA)

- Medical Treatment And Welfare Office Work (AREA)

- Child & Adolescent Psychology (AREA)

Abstract

本技術は、睡眠効率を向上させることができるようにする情報処理装置、情報処理方法、およびプログラムに関する。本技術の一側面の情報処理装置は、ユーザの行動予定を表す情報を取得する取得部と、前記ユーザの行動予定に応じて、起きるべきか寝るべきかを判断し、起きるべきと判断した場合には起きるべき程度を、寝るべきと判断した場合には寝るべき程度を判断する第1の判断部とを備える。本技術は、携帯電話機、PDA、デジタルカメラなどの携帯型の機器に適用することができる。

Description

本技術は、特に、睡眠効率を向上させることができるようにした情報処理装置、情報処理方法、およびプログラムに関する。

睡眠の重要性が認識されている。慢性的な睡眠不足は、体力低下、免疫力の低下などの肉体的な影響を及ぼすとともに、うつ病などの精神的な影響を及ぼす可能性があることが分かってきている。

一般の人も睡眠の重要性については分かっているものの、各種の事情により、睡眠時間を十分に確保することができなかったり、質の高い睡眠をとることができなかったりすることが多い。

寝ている状態から起きる場合であっても、急にたたき起こされるときと、ゆっくり起こされるときとでは、睡眠に対する起きたときの充実感が異なる。また、起きている状態から寝る場合であっても、なかなか寝付けないときと、スムーズに寝たときとでも、睡眠に対する充実感が異なる。

このことは、睡眠時間が同じであっても、入眠の仕方、覚醒の仕方によって、睡眠効率に違いがあることを表す。

本技術はこのような状況に鑑みてなされたものであり、睡眠効率を向上させることができるようにするものである。

本技術の一側面の情報処理装置は、ユーザの行動予定を表す情報を取得する取得部と、前記ユーザの行動予定に応じて、起きるべきかどうかと寝るべきかどうかとのうちの少なくともいずれかの判断と、起きるべきである場合における起きるべき程度、または寝るべきである場合における寝るべき程度の判断と、のうちの少なくともいずれかの判断を行う第1の判断部とを備える。

前記第1の判断部には、前記起きるべき程度または前記寝るべき程度の判断を行わせる場合、前記起きるべき程度または前記寝るべき程度を表す第1のスコアを求めさせることができる。

センサにより検出されたデータに基づいて、前記ユーザの眠気の程度を表す第2のスコアを求める第2の判断部をさらに設けることができる。

前記第1のスコアと前記第2のスコアに基づいて、再生するコンテンツを選択する選択部と、前記選択部により選択された前記コンテンツを再生する再生部とをさらに設けることができる。

複数の前記コンテンツについて、それぞれの前記コンテンツと、前記コンテンツを視聴したユーザに生じさせる眠気の変化の程度との関係を表す情報を記憶する記憶部をさらに設けることができる。この場合、前記選択部には、前記記憶部に記憶されている前記情報に基づいて、前記第1のスコアと前記第2のスコアとの差に相当する眠気の変化を生じさせる前記コンテンツを選択させることができる。

前記第2の判断部には、前記コンテンツの再生後に前記センサにより検出されたデータに基づいて前記第2のスコアをさらに求めさせ、前記コンテンツの再生開始前に求められた前記第2のスコアと、前記コンテンツの再生後に求められた前記第2のスコアとの差に基づいて、前記記憶部に記憶されている、再生が行われた前記コンテンツについての眠気の変化の程度を表す前記情報を更新する更新部をさらに設けることができる。

前記第1の判断部により起きるべきであると判断されるとともに、前記起きるべき程度が判断された場合、前記起きるべき程度に応じて前記ユーザを覚醒させる覚醒部と、前記第1の判断部により寝るべきであると判断されるとともに、前記寝るべき程度が判断された場合、前記寝るべき程度に応じて前記ユーザを入眠させる入眠部とをさらに設けることができる。

本技術の一側面においては、ユーザの行動予定を表す情報が取得され、前記ユーザの行動予定に応じて、起きるべきかどうかと寝るべきかどうかとのうちの少なくともいずれかの判断と、起きるべきである場合における起きるべき程度、または寝るべきである場合における寝るべき程度の判断と、のうちの少なくともいずれかの判断が行われる。

本技術によれば、睡眠効率を向上させることができる。

以下、本技術を実施するための形態について説明する。説明は以下の順序で行う。

1.情報処理装置による睡眠効率の向上の概念

2.情報処理装置の構成例

3.情報処理装置の動作

第1の実施の形態(朝快適に起きる例)

第2の実施の形態(電車での寝過ごしを防止する例)

第3の実施の形態(早寝の例)

第4の実施の形態(仮眠の例)

4.楽曲選択・再生処理

5.変形例

1.情報処理装置による睡眠効率の向上の概念

2.情報処理装置の構成例

3.情報処理装置の動作

第1の実施の形態(朝快適に起きる例)

第2の実施の形態(電車での寝過ごしを防止する例)

第3の実施の形態(早寝の例)

第4の実施の形態(仮眠の例)

4.楽曲選択・再生処理

5.変形例

1.<情報処理装置による睡眠効率の向上の概念>

図1は、本技術の一実施形態に係る情報処理装置を示す図である。

図1は、本技術の一実施形態に係る情報処理装置を示す図である。

図1の情報処理装置1は、携帯電話機、PDA(Personal Digital Assistants)、デジタルカメラ、PND(Portable Navigation Device)などの携帯型の装置であり、ユーザが片手で把持可能な大きさの筐体を有している。情報処理装置1の筐体の前面にはLCD(Liquid Crystal Display)などよりなる表示部が設けられる。