JP7250824B2 - 位置センサベースの分岐予測のためのシステム及び方法 - Google Patents

位置センサベースの分岐予測のためのシステム及び方法 Download PDFInfo

- Publication number

- JP7250824B2 JP7250824B2 JP2020566601A JP2020566601A JP7250824B2 JP 7250824 B2 JP7250824 B2 JP 7250824B2 JP 2020566601 A JP2020566601 A JP 2020566601A JP 2020566601 A JP2020566601 A JP 2020566601A JP 7250824 B2 JP7250824 B2 JP 7250824B2

- Authority

- JP

- Japan

- Prior art keywords

- instrument

- orientation

- data

- segment

- computer

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H40/00—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices

- G16H40/60—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices

- G16H40/63—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices for local operation

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/267—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor for the respiratory tract, e.g. laryngoscopes, bronchoscopes

- A61B1/2676—Bronchoscopes

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/273—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor for the upper alimentary canal, e.g. oesophagoscopes, gastroscopes

- A61B1/2736—Gastroscopes

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/307—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor for the urinary organs, e.g. urethroscopes, cystoscopes

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/313—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor for introducing through surgical openings, e.g. laparoscopes

- A61B1/3132—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor for introducing through surgical openings, e.g. laparoscopes for laparoscopy

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/10—Computer-aided planning, simulation or modelling of surgical operations

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/25—User interfaces for surgical systems

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/30—Surgical robots

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/30—Surgical robots

- A61B34/35—Surgical robots for telesurgery

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/30—Surgical robots

- A61B34/37—Master-slave robots

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/70—Manipulators specially adapted for use in surgery

- A61B34/76—Manipulators having means for providing feel, e.g. force or tactile feedback

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B90/37—Surgical systems with images on a monitor during operation

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61G—TRANSPORT, PERSONAL CONVEYANCES, OR ACCOMMODATION SPECIALLY ADAPTED FOR PATIENTS OR DISABLED PERSONS; OPERATING TABLES OR CHAIRS; CHAIRS FOR DENTISTRY; FUNERAL DEVICES

- A61G12/00—Accommodation for nursing, e.g. in hospitals, not covered by groups A61G1/00 - A61G11/00, e.g. trolleys for transport of medicaments or food; Prescription lists

- A61G12/001—Trolleys for transport of medicaments, food, linen, nursing supplies

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61G—TRANSPORT, PERSONAL CONVEYANCES, OR ACCOMMODATION SPECIALLY ADAPTED FOR PATIENTS OR DISABLED PERSONS; OPERATING TABLES OR CHAIRS; CHAIRS FOR DENTISTRY; FUNERAL DEVICES

- A61G13/00—Operating tables; Auxiliary appliances therefor

- A61G13/02—Adjustable operating tables; Controls therefor

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61G—TRANSPORT, PERSONAL CONVEYANCES, OR ACCOMMODATION SPECIALLY ADAPTED FOR PATIENTS OR DISABLED PERSONS; OPERATING TABLES OR CHAIRS; CHAIRS FOR DENTISTRY; FUNERAL DEVICES

- A61G13/00—Operating tables; Auxiliary appliances therefor

- A61G13/02—Adjustable operating tables; Controls therefor

- A61G13/04—Adjustable operating tables; Controls therefor tiltable around transverse or longitudinal axis

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61G—TRANSPORT, PERSONAL CONVEYANCES, OR ACCOMMODATION SPECIALLY ADAPTED FOR PATIENTS OR DISABLED PERSONS; OPERATING TABLES OR CHAIRS; CHAIRS FOR DENTISTRY; FUNERAL DEVICES

- A61G13/00—Operating tables; Auxiliary appliances therefor

- A61G13/10—Parts, details or accessories

- A61G13/12—Rests specially adapted therefor; Arrangements of patient-supporting surfaces

- A61G13/128—Rests specially adapted therefor; Arrangements of patient-supporting surfaces with mechanical surface adaptations

- A61G13/1295—Rests specially adapted therefor; Arrangements of patient-supporting surfaces with mechanical surface adaptations having alignment devices for the patient's body

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T17/00—Three dimensional [3D] modelling, e.g. data description of 3D objects

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/0002—Inspection of images, e.g. flaw detection

- G06T7/0012—Biomedical image inspection

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H10/00—ICT specially adapted for the handling or processing of patient-related medical or healthcare data

- G16H10/60—ICT specially adapted for the handling or processing of patient-related medical or healthcare data for patient-specific data, e.g. for electronic patient records

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H20/00—ICT specially adapted for therapies or health-improving plans, e.g. for handling prescriptions, for steering therapy or for monitoring patient compliance

- G16H20/40—ICT specially adapted for therapies or health-improving plans, e.g. for handling prescriptions, for steering therapy or for monitoring patient compliance relating to mechanical, radiation or invasive therapies, e.g. surgery, laser therapy, dialysis or acupuncture

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B17/00—Surgical instruments, devices or methods, e.g. tourniquets

- A61B2017/00743—Type of operation; Specification of treatment sites

- A61B2017/00809—Lung operations

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/10—Computer-aided planning, simulation or modelling of surgical operations

- A61B2034/101—Computer-aided simulation of surgical operations

- A61B2034/105—Modelling of the patient, e.g. for ligaments or bones

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

- A61B2034/2046—Tracking techniques

- A61B2034/2051—Electromagnetic tracking systems

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

- A61B2034/2046—Tracking techniques

- A61B2034/2059—Mechanical position encoders

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

- A61B2034/2046—Tracking techniques

- A61B2034/2065—Tracking using image or pattern recognition

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/30—Surgical robots

- A61B2034/301—Surgical robots for introducing or steering flexible instruments inserted into the body, e.g. catheters or endoscopes

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/30—Surgical robots

- A61B2034/302—Surgical robots specifically adapted for manipulations within body cavities, e.g. within abdominal or thoracic cavities

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/30—Devices for illuminating a surgical field, the devices having an interrelation with other surgical devices or with a surgical procedure

- A61B2090/306—Devices for illuminating a surgical field, the devices having an interrelation with other surgical devices or with a surgical procedure using optical fibres

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/30—Devices for illuminating a surgical field, the devices having an interrelation with other surgical devices or with a surgical procedure

- A61B2090/309—Devices for illuminating a surgical field, the devices having an interrelation with other surgical devices or with a surgical procedure using white LEDs

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B90/361—Image-producing devices, e.g. surgical cameras

- A61B2090/3612—Image-producing devices, e.g. surgical cameras with images taken automatically

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B90/37—Surgical systems with images on a monitor during operation

- A61B2090/376—Surgical systems with images on a monitor during operation using X-rays, e.g. fluoroscopy

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61G—TRANSPORT, PERSONAL CONVEYANCES, OR ACCOMMODATION SPECIALLY ADAPTED FOR PATIENTS OR DISABLED PERSONS; OPERATING TABLES OR CHAIRS; CHAIRS FOR DENTISTRY; FUNERAL DEVICES

- A61G13/00—Operating tables; Auxiliary appliances therefor

- A61G13/10—Parts, details or accessories

- A61G13/12—Rests specially adapted therefor; Arrangements of patient-supporting surfaces

- A61G13/1205—Rests specially adapted therefor; Arrangements of patient-supporting surfaces for specific parts of the body

- A61G13/125—Ankles or feet

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61G—TRANSPORT, PERSONAL CONVEYANCES, OR ACCOMMODATION SPECIALLY ADAPTED FOR PATIENTS OR DISABLED PERSONS; OPERATING TABLES OR CHAIRS; CHAIRS FOR DENTISTRY; FUNERAL DEVICES

- A61G2203/00—General characteristics of devices

- A61G2203/10—General characteristics of devices characterised by specific control means, e.g. for adjustment or steering

- A61G2203/16—Touchpads

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61G—TRANSPORT, PERSONAL CONVEYANCES, OR ACCOMMODATION SPECIALLY ADAPTED FOR PATIENTS OR DISABLED PERSONS; OPERATING TABLES OR CHAIRS; CHAIRS FOR DENTISTRY; FUNERAL DEVICES

- A61G2210/00—Devices for specific treatment or diagnosis

- A61G2210/50—Devices for specific treatment or diagnosis for radiography

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H30/00—ICT specially adapted for the handling or processing of medical images

- G16H30/20—ICT specially adapted for the handling or processing of medical images for handling medical images, e.g. DICOM, HL7 or PACS

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H50/00—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics

- G16H50/50—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics for simulation or modelling of medical disorders

Description

本願は、2018年5月30日に出願された米国特許仮出願第62/678,160号、及び2018年5月31日に出願された米国特許仮出願第62/678,962号に対して優先権を主張するものであり、これらの各々は、参照によりその全体が本明細書に組み込まれる。

本明細書に開示されているシステム及び方法は、管腔網における分岐予測を対象とし、より具体的には、位置センサデータに基づいて、器具がどの分岐に前進するのかを予測するための技術を対象とする。

本開示の態様は、腹腔鏡などの低侵襲性、及び内視鏡などの非侵襲性の両方の処置を含む、様々な医療処置を行うことができるロボット制御可能な医療システムに統合され得る。内視鏡処置のうち、システムは、気管支鏡検査、尿管鏡検査、胃鏡検査などを行うことができる。

ロボット制御可能な医療システムは、特定の処置に応じて様々な方法で構成され得る。図1は、診断及び/又は治療用気管支鏡検査処置のために配置された、カートベースのロボット制御可能なシステム10の実施形態を示す。気管支鏡検査の間、システム10は、気管支鏡検査のための処置特有の気管支鏡であり得る操縦可能な内視鏡13などの医療器具を、診断及び/又は治療用具を送達するための自然オリフィスアクセスポイント(すなわち、本実施例ではテーブル上に位置付けられた患者の口)に送達するための1つ又は2つ以上のロボットアーム12を有するカート11を含み得る。図示のように、カート11は、アクセスポイントへのアクセスを提供するために、患者の上部胴体に近接して位置付けられ得る。同様に、ロボットアーム12は、アクセスポイントに対して気管支鏡を位置付けるために作動され得る。図1の配置はまた、胃腸管(gastro-intestinal、GI)処置を胃鏡(GI処置のための特殊な内視鏡)を用いて実行するときにも利用され得る。図2は、カートの例示的な実施形態をより詳細に描画する。

ロボット制御可能な医療システムの実施形態はまた、患者テーブルを組み込んでもよい。テーブルの組み込みは、カートを除去することによって手術室内の資本設備の量を低減し、患者へのより大きなアクセスを可能にする。図5は、気管支鏡検査処置のために配されたこのようなロボット制御可能なシステムの一実施形態を示す。システム36は、床の上にプラットフォーム38(「テーブル」又は「ベッド」として図示)を支持するための支持構造体又はカラム37を含む。カートベースのシステムと同様に、システム36のロボットアーム39のエンドエフェクタは、器具ドライバ42の線形整合から形成された仮想レール41を通して、又はそれに沿って、図5の気管支鏡40などの細長い医療器具を操作するように設計された器具ドライバ42を含む。実際には、X線透視撮像を提供するためのCアームは、放射器及び検出器をテーブル38の周囲に置くことによって、患者の上部腹部領域の上方に配置されてもよい。

システムのロボットアームのエンドエフェクタは、(i)医療器具を作動させるための電気機械的手段を組み込む器具ドライバ(代替的には、「器具駆動機構」又は「器具デバイスマニピュレータ」と呼ばれる)と、(ii)モータなどの任意の電気機械的構成要素を欠いていてもよい除去可能な又は取り外し可能な医療器具と、を含む。この二分法は、医療処置に使用される医療器具を滅菌する必要性、それらの複雑な機械的アセンブリ及び敏感な電子機器により、高価な資本設備を十分に滅菌することができないことに牽引され得る。したがって、医療器具は、医師又は医師のスタッフによる個々の滅菌又は廃棄のために、器具ドライバ(したがってそのシステム)から取り外し、除去、及び交換されるように設計され得る。対照的に、器具ドライバは交換又は滅菌される必要がなく、保護のために掛け布がされ得る。

図13は、ペアにされた器具ドライバを備えた例示的な医療器具を示す。ロボットシステムと共に使用するために設計された他の器具と同様に、医療器具70は、細長いシャフト71(又は細長い本体)及び器具基部72を含む。医師による手動相互作用が意図されているその設計により「器具ハンドル」とも呼ばれる器具基部72は、概して、ロボットアーム76の遠位端において器具ドライバ75上の駆動インターフェースを通って延在する駆動出力部74と嵌合するように設計された、回転可能な駆動入力部73、例えば、レセプタクル、プーリ、又はスプールを含んでもよい。物理的に接続、ラッチ、及び/又は結合されるときに、器具基部72の嵌合された駆動入力部73は、器具ドライバ75における駆動出力部74と回転軸を共有して、駆動出力部74から駆動入力部73へのトルクの伝達を可能することができる。いくつかの実施形態では、駆動出力部74は、駆動入力部73上のレセプタクルと嵌合するように設計されたスプラインを含んでもよい。

従来の内視鏡検査は、操作者である医師に腔内誘導を提供するために、蛍光透視法(例えば、Cアームを通して送達され得るような)、及び他の形態の放射線ベースの撮像モダリティの使用を伴うことがある。対照的に、本開示によって企図されるロボットシステムは、放射線への医師の曝露を低減し、手術室内の機器の量を低減するために、非放射線ベースのナビゲーション及び位置特定手段を提供することができる。本明細書で使用するとき、用語「位置特定」は、基準座標系内のオブジェクトの位置を判定及び/又は監視することを指すことがある。術前マッピング、コンピュータビジョン、リアルタイムEM追跡、及びロボットコマンドデータなどの技術は、放射線を含まない動作環境を達成するために個別に又は組み合わせて使用されてもよい。放射線ベースの撮像モダリティが依然として使用されるその他の場合、術前マッピング、コンピュータビジョン、リアルタイムEM追跡、及びロボットコマンドデータは、放射線ベースの撮像モダリティによってのみ取得される情報を改善するために、個別に又は組み合わせて使用されてもよい。

本開示の実施形態は、位置センサベースの分岐予測のためのシステム及び技術に関する。システムは、例えば医療処置中に、器具の遠位端の位置特定を行うために、位置センサ(複数可)又は位置感知デバイス(複数可)を使用してもよい。位置センサは、器具の遠位端に若しくはその近くに位置決めされてもよく、又は器具の遠位端から離れて位置決めされてもよい。器具の遠位端に又はその近くに位置決めされ得る位置センサ又は位置感知デバイスの例としては、EMセンサ、ビジョンベースの位置センサ(例えば、カメラ)、形状感知繊維等が挙げられる。器具の遠位端から離れて位置決めされ得る位置センサ又は位置感知デバイスの例としては、X線透視撮像デバイス、1つ又は2つ以上の器具マニピュレータを用いて器具の位置を制御するためのロボットデータを生成又は処理するロボットシステム構成要素(複数可)、リモートビジョンベースの位置センサ、等が挙げられる。

以下、位置センサベースの分岐予測のための技術を採用することができる例示的なシステムについて説明する。例えば、システムは、EMナビゲーション誘導気管支鏡処置のために構成されてもよい。しかしながら、本開示の態様はまた、位置データを生成することができる他の位置センサを使用するシステム、並びに他のタイプの医療処置にも適用することができる。

上で考察されるように、医療処置の初期段階は、位置センサ(複数可)が管腔網のモデルに位置合わせされる前に実行されてもよい。しかしながら、位置センサ(複数可)は、位置合わせ前に位置データを生成し得る。モデルに位置合わせされていないが、生の位置センサデータは、特定の位置特定及びナビゲーション機能を提供するのに有用であり得る。例えば、プロセッサは、位置合わせされていない生の位置データに基づいて、異なる時間における器具の相対的な配向を判定することができる。したがって、特定の実施形態では、管腔網の形状及び構造、並びに位置合わせされてないデータに基づいて判定された器具の配向に基づいて、プロセッサは、器具が前進する可能性がある管腔網の次の分岐を予測することを容易にし得る。

S1=CEM *P1,EM+CImage *P1,Image+CRobot *P1,Robot、

S2=CEM *P2,EM+CImage *P2,Image+CRobot *P2,Robot、

S3=CEM *P3,EM+CImage *P3,Image+CRobot *P3,Robot。

Pi,Image、及びPi,Robotは、セグメントiの確率を表す。

EMベースのアルゴリズムモジュール250は、EM位置合わせモジュール252、EM位置特定モジュール254、及びEM分岐予測モジュール256を更に含む。EM位置合わせモジュール252は、3Dモデル座標に対してEM座標の位置合わせを行うことができる。EM位置特定モジュール254は、器具のポジション及び配向の推定値を判定することができる。EM分岐予測モジュール256は、器具が現在位置している現在のセグメントから、器具がモデルのどのセグメントに前進するのかについての予測を判定することができる。

例示的な目的で、位置センサベースの分岐予測に関連する本開示の態様は、気管支鏡検査及び気管支内腔網の一部をナビゲートするという状況において説明される。しかしながら、本開示は、他の管腔網及び他の医療処置にも適用することができる。

図18Bは、本開示の態様による、器具が管腔網を通して駆動される際に1つ又は2つ以上の位置センサによって生成され得る、例示的な一組の位置データ点を示す。図18Bでは、ナビゲーション経路345は、処置中に器具が駆動される経路として定義されてもよい。ナビゲーション経路345は、経路計画プログラムなどによって生成された手順を実行する前に、ユーザによって選択されてもよい。便宜上、図18Bは2Dで図示されているが、本開示はまた、3Dナビゲーション経路にも適用され得ることを理解されたい。ナビゲーション経路345は、患者の管腔網のモデル(例えば、図20の骨格ベースのモデル500)が定義されるモデル座標系350に関して定義されてもよい。

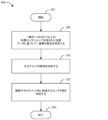

図19は、本開示の態様による、位置センサによる分岐予測のための、ロボットシステム又はその構成要素(複数可)によって動作可能な例示的な方法を示すフローチャートである。例えば、図19に示される方法400の工程は、ロボットシステム又は関連システム(複数可)のプロセッサ(複数可)及び/又は他の構成要素(複数可)によって実行され得る。便宜上、方法400は、位置センサベースの分岐予測システムによって実行されるものとして説明され、方法400の説明に関連して単に「システム」とも称される。

上述のように、方法400は、器具が初期位置に位置しているときに、ブロック405において器具の第1の配向を判定することを含み得る。位置センサベースの分岐予測システムは、状態推定モジュール240の初期化に応じて、器具の初期位置を選択してもよい。特定の実施形態では、位置センサベースの分岐予測システムは、初期位置として初期化後に、状態推定モジュール240によって生成された器具の位置の第1の表示を選択してもよい。しかしながら、他の実施形態では、システムは、状態推定モジュール240によって初期位置として生成された他の位置(例えば、器具の第2、第3などの位置)を選択してもよい。

特定の実施態様では、システムは、位置センサ(複数可)の座標系を管腔網のモデルの座標系に位置合わせするために、位置合わせプロセスを実行するように構成されてもよい。位置合わせは、図17に示すように位置合わせデータストア225に記憶されてもよい。位置合わせプロセスは、位置センサ座標系とモデル座標系との間の位置合わせを判定するために、位置合わせされていない位置データの使用を容易にするプロセスを含んでもよい。特定の実施形態では、位置合わせプロセスは、位置センサ(複数可)から受信したデータの履歴を維持し、位置データの履歴によって形成された形状を、解剖学的構造のモデルに基づいて、器具がそれに沿って移動できる候補経路に一致させることに基づいて実行されてもよい。システムは、ユーザに、所定の位置合わせ経路に沿って器具を駆動するように指示を提供し、位置合わせプロセス中にユーザが位置合わせ経路に沿って器具を駆動することに応じて、位置センサに基づいて器具の位置を追跡してもよい。特定の処置では、位置合わせ経路は、器具が位置合わせプロセスのためにそれに沿って駆動される経路の形状を定義する対側位置合わせ経路を含んでもよい。対側位置合わせ経路は、標的の位置に対して管腔網上の対側のセグメントに沿って器具を駆動することと、対側の側から器具を後退させることと、標的までの経路(標的経路ともいう)に沿って管腔網の側方に沿って器具を駆動することとを含んでもよい。したがって、対側位置合わせ経路は、標的経路の外側で管腔網の対側分岐に沿って(例えば、標的に対して管腔網の対側の側にある分岐に沿って)器具を駆動することと、標的経路に器具を戻すことと、標的経路の一部に沿って配置された側方分岐に沿って器具を駆動することとを含んでもよい。

システムが、位置センサ座標系をモデル座標系に位置合わせする位置合わせプロセスを実行した後、システムは、位置センサ(複数可)によって生成されたデータを使用して、モデル座標系に関連付けられたモデルを参照して、器具の遠位端の位置の表示を判定することができるようにしてもよい。位置合わせされたデータ位置のデータを使用して、システムは、器具が内部に前進する可能性が最も高い管腔網の子セグメントに関する予測を生成することができる。実施態様によっては、位置合わせされていない位置センサデータを使用しても、器具が特定の距離を超えて管腔網内に前進させられた後は、管腔網内での分岐予測に十分な精度が提供されない場合がある。例えば、器具が一次気管支内に前進させられると、システムは、位置合わせされた位置センサデータなしで分岐予測を実行することができない場合がある。したがって、本開示の態様はまた、分岐予測のための位置合わせされた位置データの使用に関する。

本明細書に開示される実施態様は、位置センサベースの分岐予測のためのシステム、方法、及び装置を提供する。

(1) システムであって、

プロセッサと、

前記プロセッサと通信し、かつ患者の管腔網のモデルを記憶した少なくとも1つのコンピュータ可読メモリと、を含み、前記メモリは、前記メモリに記憶されたコンピュータ実行可能命令を更に有しており、前記コンピュータ実行可能命令が、前記プロセッサに、

器具のための一組の1つ又は2つ以上の位置センサによって生成された第1の位置データに基づいて、前記器具の第1の配向を判定することであって、前記第1の位置データが、第1の時間における位置センサ座標系内の前記器具の位置を示す、判定することと、

前記一組の位置センサによって生成された第2の位置データに基づいて、第2の時間における前記器具の第2の配向を判定することであって、前記器具の遠位端が、前記第1の時間及び前記第2の時間において前記モデルの第1のセグメント内に位置し、前記第1のセグメントが、2つ又は3つ以上の子セグメントに分岐している、判定することと、

前記第1の配向と前記第2の配向との間の差を示すデータを判定することと、

前記差を示す前記データに基づいて、前記器具が前記子セグメントのうちの第1の子セグメント内に前進するという予測を判定することと、を行わせる、システム。

(2) 前記予測は、前記器具が前記第1の子セグメント内に前進する確率を示すデータを含む、実施態様1に記載のシステム。

(3) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記差を示す前記データに基づいて、前記器具が前記子セグメントのうちの第2の子セグメント内に前進するという予測を判定することを行わせる、実施態様1に記載のシステム。

(4) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記一組の位置センサによって生成された第3の位置データに基づいて、第3の時間における前記器具の第3の配向を判定することと、

前記第3の配向と前記第1の配向との間の角度を判定することと、

前記角度を閾値角度と比較することと、

前記角度が前記閾値角度よりも大きいことに応じて、前記器具が前記第1の子セグメン内に前進するという前記予測を更新することと、を行わせる、実施態様1に記載のシステム。

(5) 前記一組の位置センサが、電磁(EM)場内のEMセンサの配向を示すデータを生成するように構成された前記EMセンサを含み、

前記EM場が、EM場発生器によって生成され、

前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、前記EMセンサによって生成された前記データに基づいて、前記第1の配向と前記第2の配向との間のヨー角を判定することを行わせる、実施態様1に記載のシステム。

(7) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記位置データ、前記器具の移動を制御するために提供される一組のコマンド、及び前記器具が前記第1の子セグメント内に前進するという前記予測を分析することによって、前記モデルに対する前記器具の前記遠位端のポジションを判定することを行わせる、実施態様1に記載のシステム。

(8) 前記位置データが、前記モデルのモデル座標系に位置合わせされていない、実施態様1に記載のシステム。

(9) 前記メモリが、前記メモリに記憶された、

前記モデル内の標的への標的経路と、

対側位置合わせ経路であって、前記標的経路の外側で前記管腔網の第1の分岐に沿って前記器具を駆動することと、前記標的経路に前記器具を戻すことと、前記標的経路の一部である第2の分岐に沿って前記器具を駆動することと、を含む、対側位置合わせ経路と、

コンピュータ実行可能命令であって、前記コンピュータ実行可能命令が、前記プロセッサに、前記器具が前記第1の子セグメント内に前進するという前記予測に基づいて、前記器具が前記対側位置合わせ経路に沿って配置されているかどうかを判定させる、コンピュータ実行可能命令と、を更に有する、実施態様1に記載のシステム。

(10) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定することと、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定したことに応じて、対側位置合わせが失敗したという表示を提供することと、を行わせる、実施態様9に記載のシステム。

器具のための一組の1つ又は2つ以上の位置センサによって生成された第1の位置データに基づいて、前記器具の第1の配向を判定することであって、前記第1の位置データが第1の時間における位置センサ座標系内の前記器具の位置を示す、判定することと、

前記一組の位置センサによって生成された第2の位置データに基づいて、第2の時間における前記器具の第2の配向を判定することであって、前記器具の遠位端が、前記第1の時間及び前記第2の時間においてモデルの第1のセグメント内に位置し、前記第1のセグメントが、2つ又は3つ以上の子セグメントに分岐し、前記モデルが、メモリに記憶され、患者の管腔網をモデル化する、判定することと、

前記第1の配向と前記第2の配向との間の差を示すデータを判定することと、

前記差を示す前記データに基づいて、前記器具が前記子セグメントのうちの第1の子セグメント内に前進するという予測を判定することと、を行わせる、非一時的コンピュータ可読記憶媒体。

(12) 前記予測は、前記器具が前記第1の子セグメント内に前進する確率を示すデータを含む、実施態様11に記載の非一時的コンピュータ可読記憶媒体。

(13) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、

前記差を示す前記データに基づいて、前記器具が前記子セグメントのうちの第2の子セグメント内に前進するという予測を判定することを行わせる、実施態様11に記載の非一時的コンピュータ可読記憶媒体。

(14) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、

前記一組の位置センサによって生成された第3の位置データに基づいて、第3の時間における前記器具の第3の配向を判定することと、

前記第3の配向と前記第1の配向との間の角度を判定することと、

前記角度を閾値角度と比較することと、

前記角度が前記閾値角度よりも大きいことに応じて、前記器具が前記第1の子セグメント内に前進するという前記予測を更新することと、を行わせる、実施態様11に記載の非一時的コンピュータ可読記憶媒体。

(15) 前記一組の位置センサが、電磁(EM)場内のEMセンサの配向を示すデータを生成するように構成された前記EMセンサを含み、

前記EM場が、EM場発生器によって生成され、

前記非一時的コンピュータ可読記憶媒体が、前記非一時的コンピュータ可読記憶媒体に記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、前記EMセンサによって生成された前記データに基づいて、前記第1の配向と前記第2の配向との間のヨー角を判定することを行わせる、実施態様11に記載の非一時的コンピュータ可読記憶媒体。

(17) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、

前記位置データ、前記器具の移動を制御するために提供される一組のコマンド、及び前記器具が前記第1の子セグメント内に前進するという前記予測を分析することによって、前記モデルに対する前記器具の前記遠位端のポジションを判定することを行わせる、実施態様11に記載の非一時的コンピュータ可読記憶媒体。

(18) 前記位置データが、前記モデルのモデル座標系に位置合わせされていない、実施態様11に記載の非一時的コンピュータ可読記憶媒体。

(19) 前記メモリが、前記メモリに記憶された、

前記モデル内の標的への標的経路と、

対側位置合わせ経路であって、前記標的経路の外側で前記管腔網の第1の分岐に沿って前記器具を駆動することと、前記標的経路に前記器具を戻すことと、前記標的経路の一部である第2の分岐に沿って前記器具を駆動することと、を含む、対側位置合わせ経路と、を更に有し、

前記非一時的コンピュータ可読記憶媒体が、前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、前記器具が前記第1の子セグメント内に前進するという前記予測に基づいて、前記器具が前記対側位置合わせ経路に沿って配置されているかどうかを判定させる、実施態様11に記載の非一時的コンピュータ可読記憶媒体。

(20) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定することと、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定したことに応じて、対側位置合わせが失敗したという表示を提供することと、を行わせる、実施態様11に記載の非一時的コンピュータ可読記憶媒体。

前記器具のための一組の1つ又は2つ以上の位置センサによって生成された第1の位置データに基づいて、前記器具の第1の配向を判定することであって、前記第1の位置データが第1の時間における位置センサ座標系内の前記器具の位置を示す、判定することと、

前記一組の位置センサによって生成された第2の位置データに基づいて、第2の時間における前記器具の第2の配向を判定することであって、前記器具の遠位端が、前記第1の時間及び前記第2の時間においてモデルの第1のセグメント内に位置し、前記第1のセグメントが、2つ又は3つ以上の子セグメントに分岐し、前記モデルがメモリに記憶され、患者の管腔網をモデル化する、判定することと、

前記第1の配向と前記第2の配向との間の差を示すデータを判定することと、

前記差を示す前記データに基づいて、前記器具が前記子セグメントのうちの第1の子セグメント内に前進するという予測を判定することと、を含む、方法。

(22) 前記予測は、前記器具が前記第1の子セグメント内に前進する確率を示すデータを含む、実施態様21に記載の方法。

(23) 前記差を示す前記データに基づいて、前記器具が前記子セグメントのうちの第2の子セグメント内に前進するという予測を判定することを更に含む、実施態様21に記載の方法。

(24) 前記一組の位置センサによって生成された第3の位置データに基づいて、第3の時間における前記器具の第3の配向を判定することと、

前記第3の配向と前記第1の配向との間の角度を判定することと、

前記角度を閾値角度と比較することと、

前記角度が前記閾値角度よりも大きいことに応じて、前記器具が前記第1の子セグメント内に前進するという前記予測を更新することと、を更に含む、実施態様21に記載の方法。

(25) 前記一組の位置センサが、電磁(EM)場内のEMセンサの配向を示すデータを生成するように構成された前記EMセンサを含み、

前記EM場が、EM場発生器によって生成され、

前記方法が、前記EMセンサによって生成された前記データに基づいて、前記第1の配向と前記第2の配向との間のヨー角を判定することを更に含む、実施態様21に記載の方法。

(27) 前記位置データ、前記器具の移動を制御するために提供される一組のコマンド、及び前記器具が前記第1の子セグメント内に前進するという前記予測を分析することによって、前記モデルに対する前記器具の前記遠位端のポジションを判定することを更に含む、実施態様21に記載の方法。

(28) 前記位置データが、前記モデルのモデル座標系に位置合わせされていない、実施態様21に記載の方法。

(29) 前記メモリが、前記メモリに記憶された、

前記モデル内の標的への標的経路と、

対側位置合わせ経路であって、前記標的経路の外側で前記管腔網の第1の分岐に沿って前記器具を駆動することと、前記標的経路に前記器具を戻すことと、前記標的経路の一部である第2の分岐に沿って前記器具を駆動することと、を含む、対側位置合わせ経路と、を更に有し、

前記方法は、前記器具が前記第1の子セグメント内に前進するという前記予測に基づいて、前記器具が前記対側位置合わせ経路に沿って配置されているかどうかを判定することを更に含む、実施態様21に記載の方法。

(30) 前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定することと、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定したことに応じて、対側位置合わせが失敗したという表示を提供することと、を更に含む、実施態様21に記載の方法。

プロセッサと、

前記プロセッサと通信し、かつ患者の管腔網のモデルを記憶している少なくとも1つのコンピュータ可読メモリであって、前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有しており、前記コンピュータ実行可能命令が、前記プロセッサに、

器具のための一組の1つ又は2つ以上の位置センサによって生成された位置データに基づいて、前記モデルに対する前記器具の配向を判定することであって、前記器具の遠位端が、前記モデルの第1のセグメント内に位置し、前記第1のセグメントが、2つ又は3つ以上の子セグメントに分岐している、判定することと、

前記子セグメントのうちの第1の子セグメントの配向を判定することと、

前記器具の前記配向及び前記第1の子セグメントの前記配向に基づいて、前記器具が前記第1の子セグメント内に前進するという予測を判定することと、を行わせる、システム。

(32) 前記予測は、前記器具が前記第1の子セグメント内に前進する確率を示すデータを含む、実施態様31に記載のシステム。

(33) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記器具の前記配向と前記第1の子セグメントの前記配向との間の差を示すデータを判定することを行わせ、

前記器具が前記第1の子セグメント内に前進するという前記予測が、前記器具の前記配向と前記第1の子セグメントの前記配向との間の前記差を示す前記データに更に基づく、実施態様31に記載のシステム。

(34) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記子セグメントのうちの第2の子セグメントの配向を判定することと、

前記器具の前記配向及び前記第2の子セグメントの前記配向に基づいて、前記器具が前記第2の子セグメント内に前進するという予測を判定することと、を行わせる、実施態様31に記載のシステム。

(35) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記器具の前記配向と前記第1の子セグメントの前記配向との間の角度を判定することを行わせ、

前記器具が前記第1の子セグメント内に前進するという前記予測が、前記角度に更に基づく、実施態様31に記載のシステム。

(37) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記位置データ、前記器具の移動を制御するために提供される一組のコマンド、及び前記器具が前記第1の子セグメント内に前進するという前記予測を分析することによって、前記モデルに対する前記器具の前記遠位端のポジションを判定することを行わせる、実施態様31に記載のシステム。

(38) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記位置データに基づいて、前記モデルに対する前記器具の前記遠位端の位置を判定することと、

前記器具の前記遠位端の前記位置に基づいて、前記器具が前記第1の子セグメント内に前進するという補助予測を判定することと、を行わせ、

前記モデルに対する前記器具の前記遠位端の前記ポジションを判定することが、前記補助予測を分析することに更に基づく、実施態様37に記載のシステム。

(39) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記器具の前記遠位端が前記第1のセグメントの始まりから前記第1のセグメントの終わりまで前進するときに、前記器具が前記第1の子セグメント内に前進するという前記予測を判定することを行わせる、実施態様31に記載のシステム。

(40) 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記器具が、前記第1のセグメント内の前記器具の前記遠位端のポジションとは独立して、前記第1のセグメントから前記第1の子セグメント内に前進するという前記予測を判定することを行わせる、実施態様31に記載のシステム。

器具のための一組の1つ又は2つ以上の位置センサによって生成された位置データに基づいて、モデルに対する前記器具の配向を判定することであって、前記モデルが、メモリに記憶されて患者の管腔網をモデル化し、前記器具の遠位端が、前記モデルの第1のセグメント内に位置し、前記第1のセグメントが、2つ又は3つ以上の子セグメントに分岐している、判定することと、

前記子セグメントのうちの第1の子セグメントの配向を判定することと、

前記器具の前記配向及び前記第1の子セグメントの前記配向に基づいて、前記器具が前記第1の子セグメント内に前進するという予測を判定することと、を行わせる、非一時的コンピュータ可読記憶媒体。

(42) 前記予測は、前記器具が前記第1の子セグメント内に前進する確率を示すデータを含む、実施態様41に記載の非一時的コンピュータ可読記憶媒体。

(43) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、

前記器具の前記配向と前記第1の子セグメントの前記配向との間の差を示すデータを判定することを行わせ、

前記器具が前記第1の子セグメント内に前進するという前記予測が、前記器具の前記配向と前記第1の子セグメントの前記配向との間の前記差を示す前記データに更に基づく、実施態様41に記載の非一時的コンピュータ可読記憶媒体。

(44) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、

前記子セグメントのうちの第2の子セグメントの配向を判定することと、

前記器具の前記配向及び前記第2の子セグメントの前記配向に基づいて、前記器具が前記第2の子セグメント内に前進するという予測を判定することと、を行わせる、実施態様41に記載の非一時的コンピュータ可読記憶媒体。

(45) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、

前記器具の前記配向と前記第1の子セグメントの前記配向との間の角度を判定することを行わせ、

前記器具が前記第1の子セグメント内に前進するという前記予測が、前記角度に更に基づく、実施態様41に記載の非一時的コンピュータ可読記憶媒体。

(47) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、

前記位置データ、前記器具の移動を制御するために提供される一組のコマンド、及び前記器具が前記第1の子セグメント内に前進するという前記予測を分析することによって、前記モデルに対する前記器具の前記遠位端のポジションを判定することを行わせる、実施態様41に記載の非一時的コンピュータ可読記憶媒体。

(48) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、

前記位置データに基づいて、前記モデルに対する前記器具の前記遠位端の位置を判定することと、

前記器具の前記遠位端の前記位置に基づいて、前記器具が前記第1の子セグメント内に前進するという補助予測を判定することと、を行わせ、

前記モデルに対する前記器具の前記遠位端の前記ポジションを判定することが、前記補助予測を分析することに更に基づく、実施態様47に記載の非一時的コンピュータ可読記憶媒体。

(49) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、

前記器具の前記遠位端が前記第1のセグメントの始まりから前記第1のセグメントの終わりまで前進するときに、前記器具が前記第1の子セグメント内に前進するという前記予測を判定することを行わせる、実施態様41に記載の非一時的コンピュータ可読記憶媒体。

(50) 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、

前記器具が、前記第1のセグメント内の前記器具の前記遠位端のポジションとは独立して、前記第1のセグメントから前記第1の子セグメント内に前進するという前記予測を判定することを行わせる、実施態様41に記載の非一時的コンピュータ可読記憶媒体。

器具のための一組の1つ又は2つ以上の位置センサによって生成された位置データに基づいて、モデルに対する前記器具の配向を判定することであって、前記モデルが、メモリに記憶され、患者の管腔網をモデル化し、前記器具の遠位端が、前記モデルの第1のセグメント内に位置し、前記第1のセグメントが、2つ又は3つ以上の子セグメントに分岐している、判定することと、

前記子セグメントのうちの第1の子セグメントの配向を判定することと、

前記器具の前記配向及び前記第1の子セグメントの前記配向に基づいて、前記器具が前記第1の子セグメント内に前進するという予測を判定することと、を含む、方法。

(52) 前記予測は、前記器具が前記第1の子セグメント内に前進する確率を示すデータを含む、実施態様51に記載の方法。

(53) 前記器具の前記配向と前記第1の子セグメントの前記配向との間の差を示すデータを判定することを更に含み、

前記器具が前記第1の子セグメント内に前進するという前記予測が、前記器具の前記配向と前記第1の子セグメントの前記配向との間の前記差を示す前記データに更に基づく、実施態様51に記載の方法。

(54) 前記子セグメントのうちの第2の子セグメントの配向を判定することと、

前記器具の前記配向及び前記第2の子セグメントの前記配向に基づいて、前記器具が前記第2の子セグメント内に前進するという予測を判定することと、を更に含む、実施態様51に記載の方法。

(55) 前記器具の前記配向と前記第1の子セグメントの前記配向との間の角度を判定することを更に含み、

前記器具が前記第1の子セグメント内に前進するという前記予測が、前記角度に更に基づく、実施態様51に記載の方法。

(57) 前記位置データ、前記器具の移動を制御するために提供される一組のコマンド、及び前記器具が前記第1の子セグメント内に前進するという前記予測を分析することによって、前記モデルに対する前記器具の前記遠位端のポジションを判定することを更に含む、実施態様51に記載の方法。

(58) 前記位置データに基づいて、前記モデルに対する前記器具の前記遠位端の位置を判定することと、

前記器具の前記遠位端の前記位置に基づいて、前記器具が前記第1の子セグメント内に前進するという補助予測を判定することと、を更に含み、

前記モデルに対する前記器具の前記遠位端の前記ポジションを判定することが、前記補助予測を分析することに更に基づく、実施態様57に記載の方法。

(59) 前記器具の前記遠位端が前記第1のセグメントの始まりから前記第1のセグメントの終わりまで前進するときに、前記器具が前記第1の子セグメント内に前進するという前記予測を判定することを更に含む、実施態様51に記載の方法。

(60) 前記器具が、前記第1のセグメント内の前記器具の前記遠位端のポジションとは独立して、前記第1のセグメントから前記第1の子セグメント内に前進するという前記予測を判定することを更に含む、実施態様51に記載の方法。

Claims (15)

- システムであって、

プロセッサと、

前記プロセッサと通信し、かつ患者の管腔網のモデルを記憶した少なくとも1つのコンピュータ可読メモリと、を含み、前記モデルが、モデル座標系に関連付けられ、前記メモリは、前記メモリに記憶されたコンピュータ実行可能命令を更に有しており、

前記コンピュータ実行可能命令が、前記プロセッサに、器具のための一組の1つ又は2つ以上の電磁(EM)位置センサによって生成された第1のEM位置データに基づいて、前記器具の第1の配向を判定すること、を行わせ、前記第1のEM位置データが、第1の時間におけるEM位置センサ座標系内の前記器具の位置を示し、

前記コンピュータ実行可能命令が、前記プロセッサに、前記一組のEM位置センサによって生成された第2のEM位置データに基づいて、第2の時間における前記器具の第2の配向を判定すること、を行わせ、前記器具の遠位端が、前記第1の時間及び前記第2の時間において前記モデルの第1のセグメントに対応する前記管腔網の一部内に位置し、前記第1のセグメントが、2つ又は3つ以上の子セグメントに分岐しており、前記第1のEM位置データ及び前記第2のEM位置データが、前記モデル座標系に位置合わせされていないものであり、

前記コンピュータ実行可能命令が、前記プロセッサに、前記第1の配向と前記第2の配向との間の差を示すデータを判定すること、を行わせ、

前記コンピュータ実行可能命令が、前記プロセッサに、前記差を示す前記データに基づいて、前記器具が、前記第2の時間における前記第1のセグメント内の前記器具の位置から、前記子セグメントのうちの第1の子セグメント内に前進するという予測を判定すること、を行わせ、前記第1のEM位置データ及び前記第2のEM位置データは、前記予測が判定されるまで、前記モデル座標系に位置合わせされていないままである、システム。 - 前記予測は、前記器具が前記第1の子セグメント内に前進する確率を示すデータを含む、請求項1に記載のシステム。

- 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記差を示す前記データに基づいて、前記器具が前記子セグメントのうちの第2の子セグメント内に前進するという予測を判定することを行わせる、請求項1に記載のシステム。 - 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記一組のEM位置センサによって生成された第3のEM位置データに基づいて、第3の時間における前記器具の第3の配向を判定することと、

前記第3の配向と前記第1の配向との間の角度を判定することと、

前記角度を閾値角度と比較することと、

前記角度が前記閾値角度よりも大きいことに応じて、前記器具が前記第1の子セグメント内に前進するという前記予測を更新することと、を行わせる、請求項1に記載のシステム。 - 前記一組のEM位置センサが、EM場内の前記EM位置センサの配向を示すデータを生成するように構成され、

前記EM場が、EM場発生器によって生成され、

前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、前記EM位置センサによって生成された前記データに基づいて、前記第1の配向と前記第2の配向との間のヨー角を判定することを行わせる、請求項1に記載のシステム。 - 前記EM場に基づいて判定された前記器具のヨー軸が、前記子セグメントのうちの前記第1の子セグメントと第2の子セグメントとの間の配向の差と実質的に整合する、請求項5に記載のシステム。

- 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記第1のEM位置データ及び前記第2のEM位置データ、前記器具の移動を制御するために提供される一組のコマンド、及び前記器具が前記第1の子セグメント内に前進するという前記予測を分析することによって、前記モデルに対する前記器具の前記遠位端のポジションを判定することを行わせる、請求項1に記載のシステム。 - 前記メモリが、前記メモリに記憶された、

前記モデル内の標的への標的経路と、

対側位置合わせ経路であって、前記標的経路の外側で前記管腔網の第1の分岐に沿って前記器具を駆動することと、前記標的経路に前記器具を戻すことと、前記標的経路の一部である第2の分岐に沿って前記器具を駆動することと、を含む、対側位置合わせ経路と、

コンピュータ実行可能命令であって、前記コンピュータ実行可能命令が、前記プロセッサに、前記器具が前記第1の子セグメント内に前進するという前記予測に基づいて、前記器具が前記対側位置合わせ経路に沿って配置されているかどうかを判定させる、コンピュータ実行可能命令と、を更に有する、請求項1に記載のシステム。 - 前記メモリが、前記メモリに記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令が、前記プロセッサに、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定することと、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定したことに応じて、対側位置合わせが失敗したという表示を提供することと、を行わせる、請求項8に記載のシステム。 - 非一時的コンピュータ可読記憶媒体であって、前記非一時的コンピュータ可読記憶媒体は、前記非一時的コンピュータ可読記憶媒体に記憶された命令を有し、

前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、器具のための一組の1つ又は2つ以上の電磁(EM)位置センサによって生成された第1のEM位置データに基づいて、前記器具の第1の配向を判定すること、を行わせ、前記第1のEM位置データが第1の時間におけるEM位置センサ座標系内の前記器具の位置を示し、

前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、前記一組のEM位置センサによって生成された第2のEM位置データに基づいて、第2の時間における前記器具の第2の配向を判定すること、を行わせ、前記器具の遠位端が、前記第1の時間及び前記第2の時間においてモデルの第1のセグメントに対応する管腔網の一部内に位置し、前記第1のセグメントが、2つ又は3つ以上の子セグメントに分岐し、前記モデルが、メモリに記憶され、患者の管腔網をモデル化し、前記モデルが、モデル座標系に関連付けられ、前記第1のEM位置データ及び前記第2のEM位置データが、前記モデル座標系に位置合わせされていないものであり、

前記命令は、実行されたときに、少なくとも1つのコンピューティングデバイスに、前記第1の配向と前記第2の配向との間の差を示すデータを判定すること、を行わせ、

前記命令は、実行されたときに、前記差を示す前記データに基づいて、前記器具が、前記第2の時間における前記第1のセグメント内の前記器具の位置から、前記子セグメントのうちの第1の子セグメント内に前進するという予測を判定すること、を行わせ、前記第1のEM位置データ及び前記第2のEM位置データは、前記予測が判定されるまで、前記モデル座標系に位置合わせされていないままである、非一時的コンピュータ可読記憶媒体。 - 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、

前記差を示す前記データに基づいて、前記器具が前記子セグメントのうちの第2の子セグメント内に前進するという予測を判定することを行わせる、請求項10に記載の非一時的コンピュータ可読記憶媒体。 - 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、

前記一組のEM位置センサによって生成された第3のEM位置データに基づいて、第3の時間における前記器具の第3の配向を判定することと、

前記第3の配向と前記第1の配向との間の角度を判定することと、

前記角度を閾値角度と比較することと、

前記角度が前記閾値角度よりも大きいことに応じて、前記器具が前記第1の子セグメント内に前進するという前記予測を更新することと、を行わせる、請求項10に記載の非一時的コンピュータ可読記憶媒体。 - 前記一組のEM位置センサが、EM場内の前記EM位置センサの配向を示すデータを生成するように構成され、

前記EM場が、EM場発生器によって生成され、

前記非一時的コンピュータ可読記憶媒体が、前記非一時的コンピュータ可読記憶媒体に記憶されたコンピュータ実行可能命令を更に有し、前記コンピュータ実行可能命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、前記EM位置センサによって生成された前記データに基づいて、前記第1の配向と前記第2の配向との間のヨー角を判定することを行わせる、請求項10に記載の非一時的コンピュータ可読記憶媒体。 - 前記メモリが、前記メモリに記憶された、

前記モデル内の標的への標的経路と、

対側位置合わせ経路であって、前記標的経路の外側で前記管腔網の第1の分岐に沿って前記器具を駆動することと、前記標的経路に前記器具を戻すことと、前記標的経路の一部である第2の分岐に沿って前記器具を駆動することと、を含む、対側位置合わせ経路と、を更に有し、

前記非一時的コンピュータ可読記憶媒体が、前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、前記器具が前記第1の子セグメント内に前進するという前記予測に基づいて、前記器具が前記対側位置合わせ経路に沿って配置されているかどうかを判定させる、請求項10に記載の非一時的コンピュータ可読記憶媒体。 - 前記非一時的コンピュータ可読記憶媒体に記憶された命令を更に有し、前記命令は、実行されたときに、前記少なくとも1つのコンピューティングデバイスに、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定することと、

前記対側位置合わせ経路に沿って前進される前に、前記器具が前記標的経路に沿って前進させられたと判定したことに応じて、対側位置合わせが失敗したという表示を提供することと、を行わせる、請求項14に記載の非一時的コンピュータ可読記憶媒体。

Applications Claiming Priority (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US201862678160P | 2018-05-30 | 2018-05-30 | |

| US62/678,160 | 2018-05-30 | ||

| US201862678962P | 2018-05-31 | 2018-05-31 | |

| US62/678,962 | 2018-05-31 | ||

| PCT/US2019/034145 WO2019231895A1 (en) | 2018-05-30 | 2019-05-28 | Systems and methods for location sensor-based branch prediction |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2021525572A JP2021525572A (ja) | 2021-09-27 |

| JPWO2019231895A5 JPWO2019231895A5 (ja) | 2022-08-16 |

| JP7250824B2 true JP7250824B2 (ja) | 2023-04-03 |

Family

ID=68694866

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020566601A Active JP7250824B2 (ja) | 2018-05-30 | 2019-05-28 | 位置センサベースの分岐予測のためのシステム及び方法 |

Country Status (7)

| Country | Link |

|---|---|

| US (3) | US10905499B2 (ja) |

| EP (1) | EP3801190A4 (ja) |

| JP (1) | JP7250824B2 (ja) |

| KR (1) | KR102499906B1 (ja) |

| CN (1) | CN110831486B (ja) |

| MX (1) | MX2020012902A (ja) |

| WO (1) | WO2019231895A1 (ja) |

Families Citing this family (182)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8414505B1 (en) | 2001-02-15 | 2013-04-09 | Hansen Medical, Inc. | Catheter driver system |

| WO2005087128A1 (en) | 2004-03-05 | 2005-09-22 | Hansen Medical, Inc. | Robotic catheter system |

| US9232959B2 (en) | 2007-01-02 | 2016-01-12 | Aquabeam, Llc | Multi fluid tissue resection methods and devices |

| EP2259742B1 (en) | 2008-03-06 | 2020-01-01 | AquaBeam LLC | Tissue ablation and cautery with optical energy carried in fluid stream |

| US8218847B2 (en) | 2008-06-06 | 2012-07-10 | Superdimension, Ltd. | Hybrid registration method |

| WO2013130895A1 (en) | 2012-02-29 | 2013-09-06 | Aquabeam, Llc | Automated image-guided tissue resection and treatment |

| US9254123B2 (en) | 2009-04-29 | 2016-02-09 | Hansen Medical, Inc. | Flexible and steerable elongate instruments with shape control and support elements |

| US8672837B2 (en) | 2010-06-24 | 2014-03-18 | Hansen Medical, Inc. | Methods and devices for controlling a shapeable medical device |

| US9314306B2 (en) | 2010-09-17 | 2016-04-19 | Hansen Medical, Inc. | Systems and methods for manipulating an elongate member |

| US9138166B2 (en) | 2011-07-29 | 2015-09-22 | Hansen Medical, Inc. | Apparatus and methods for fiber integration and registration |

| US20130317519A1 (en) | 2012-05-25 | 2013-11-28 | Hansen Medical, Inc. | Low friction instrument driver interface for robotic systems |

| US20140148673A1 (en) | 2012-11-28 | 2014-05-29 | Hansen Medical, Inc. | Method of anchoring pullwire directly articulatable region in catheter |

| US10231867B2 (en) | 2013-01-18 | 2019-03-19 | Auris Health, Inc. | Method, apparatus and system for a water jet |

| US10149720B2 (en) | 2013-03-08 | 2018-12-11 | Auris Health, Inc. | Method, apparatus, and a system for facilitating bending of an instrument in a surgical or medical robotic environment |

| US9057600B2 (en) | 2013-03-13 | 2015-06-16 | Hansen Medical, Inc. | Reducing incremental measurement sensor error |

| US9326822B2 (en) | 2013-03-14 | 2016-05-03 | Hansen Medical, Inc. | Active drives for robotic catheter manipulators |

| US11213363B2 (en) | 2013-03-14 | 2022-01-04 | Auris Health, Inc. | Catheter tension sensing |

| US9173713B2 (en) | 2013-03-14 | 2015-11-03 | Hansen Medical, Inc. | Torque-based catheter articulation |

| US20140277334A1 (en) | 2013-03-14 | 2014-09-18 | Hansen Medical, Inc. | Active drives for robotic catheter manipulators |

| US9629595B2 (en) | 2013-03-15 | 2017-04-25 | Hansen Medical, Inc. | Systems and methods for localizing, tracking and/or controlling medical instruments |

| US9014851B2 (en) | 2013-03-15 | 2015-04-21 | Hansen Medical, Inc. | Systems and methods for tracking robotically controlled medical instruments |

| US9452018B2 (en) | 2013-03-15 | 2016-09-27 | Hansen Medical, Inc. | Rotational support for an elongate member |

| US20140276936A1 (en) | 2013-03-15 | 2014-09-18 | Hansen Medical, Inc. | Active drive mechanism for simultaneous rotation and translation |

| US20140276647A1 (en) | 2013-03-15 | 2014-09-18 | Hansen Medical, Inc. | Vascular remote catheter manipulator |

| US9408669B2 (en) | 2013-03-15 | 2016-08-09 | Hansen Medical, Inc. | Active drive mechanism with finite range of motion |

| US9283046B2 (en) | 2013-03-15 | 2016-03-15 | Hansen Medical, Inc. | User interface for active drive apparatus with finite range of motion |

| US9271663B2 (en) | 2013-03-15 | 2016-03-01 | Hansen Medical, Inc. | Flexible instrument localization from both remote and elongation sensors |

| US10849702B2 (en) | 2013-03-15 | 2020-12-01 | Auris Health, Inc. | User input devices for controlling manipulation of guidewires and catheters |

| US10376672B2 (en) | 2013-03-15 | 2019-08-13 | Auris Health, Inc. | Catheter insertion system and method of fabrication |

| US11020016B2 (en) | 2013-05-30 | 2021-06-01 | Auris Health, Inc. | System and method for displaying anatomy and devices on a movable display |

| US10744035B2 (en) | 2013-06-11 | 2020-08-18 | Auris Health, Inc. | Methods for robotic assisted cataract surgery |

| US10426661B2 (en) | 2013-08-13 | 2019-10-01 | Auris Health, Inc. | Method and apparatus for laser assisted cataract surgery |

| EP3243476B1 (en) | 2014-03-24 | 2019-11-06 | Auris Health, Inc. | Systems and devices for catheter driving instinctiveness |

| US10046140B2 (en) | 2014-04-21 | 2018-08-14 | Hansen Medical, Inc. | Devices, systems, and methods for controlling active drive systems |

| US10569052B2 (en) | 2014-05-15 | 2020-02-25 | Auris Health, Inc. | Anti-buckling mechanisms for catheters |

| US9744335B2 (en) | 2014-07-01 | 2017-08-29 | Auris Surgical Robotics, Inc. | Apparatuses and methods for monitoring tendons of steerable catheters |

| US10792464B2 (en) | 2014-07-01 | 2020-10-06 | Auris Health, Inc. | Tool and method for using surgical endoscope with spiral lumens |

| US9561083B2 (en) | 2014-07-01 | 2017-02-07 | Auris Surgical Robotics, Inc. | Articulating flexible endoscopic tool with roll capabilities |

| US9603668B2 (en) | 2014-07-02 | 2017-03-28 | Covidien Lp | Dynamic 3D lung map view for tool navigation inside the lung |

| US9633431B2 (en) | 2014-07-02 | 2017-04-25 | Covidien Lp | Fluoroscopic pose estimation |

| CN107427327A (zh) | 2014-09-30 | 2017-12-01 | 奥瑞斯外科手术机器人公司 | 具有虚拟轨迹和柔性内窥镜的可配置机器人外科手术系统 |

| US10499999B2 (en) | 2014-10-09 | 2019-12-10 | Auris Health, Inc. | Systems and methods for aligning an elongate member with an access site |

| US10314463B2 (en) | 2014-10-24 | 2019-06-11 | Auris Health, Inc. | Automated endoscope calibration |

| US9974525B2 (en) | 2014-10-31 | 2018-05-22 | Covidien Lp | Computed tomography enhanced fluoroscopic system, device, and method of utilizing the same |

| US11819636B2 (en) | 2015-03-30 | 2023-11-21 | Auris Health, Inc. | Endoscope pull wire electrical circuit |

| US20160287279A1 (en) | 2015-04-01 | 2016-10-06 | Auris Surgical Robotics, Inc. | Microsurgical tool for robotic applications |

| WO2016164824A1 (en) | 2015-04-09 | 2016-10-13 | Auris Surgical Robotics, Inc. | Surgical system with configurable rail-mounted mechanical arms |

| US9622827B2 (en) | 2015-05-15 | 2017-04-18 | Auris Surgical Robotics, Inc. | Surgical robotics system |

| US10716525B2 (en) | 2015-08-06 | 2020-07-21 | Covidien Lp | System and method for navigating to target and performing procedure on target utilizing fluoroscopic-based local three dimensional volume reconstruction |

| US10702226B2 (en) | 2015-08-06 | 2020-07-07 | Covidien Lp | System and method for local three dimensional volume reconstruction using a standard fluoroscope |

| US10674982B2 (en) | 2015-08-06 | 2020-06-09 | Covidien Lp | System and method for local three dimensional volume reconstruction using a standard fluoroscope |

| CN108348133B (zh) | 2015-09-09 | 2020-11-13 | 奥瑞斯健康公司 | 用于手术机器人系统的器械装置操纵器 |

| AU2016323982A1 (en) | 2015-09-18 | 2018-04-12 | Auris Health, Inc. | Navigation of tubular networks |

| US10231793B2 (en) | 2015-10-30 | 2019-03-19 | Auris Health, Inc. | Object removal through a percutaneous suction tube |

| US9955986B2 (en) | 2015-10-30 | 2018-05-01 | Auris Surgical Robotics, Inc. | Basket apparatus |

| US9949749B2 (en) | 2015-10-30 | 2018-04-24 | Auris Surgical Robotics, Inc. | Object capture with a basket |

| US10143526B2 (en) | 2015-11-30 | 2018-12-04 | Auris Health, Inc. | Robot-assisted driving systems and methods |

| US10932861B2 (en) | 2016-01-14 | 2021-03-02 | Auris Health, Inc. | Electromagnetic tracking surgical system and method of controlling the same |

| US10932691B2 (en) | 2016-01-26 | 2021-03-02 | Auris Health, Inc. | Surgical tools having electromagnetic tracking components |

| US11324554B2 (en) | 2016-04-08 | 2022-05-10 | Auris Health, Inc. | Floating electromagnetic field generator system and method of controlling the same |

| US10454347B2 (en) | 2016-04-29 | 2019-10-22 | Auris Health, Inc. | Compact height torque sensing articulation axis assembly |

| US11037464B2 (en) | 2016-07-21 | 2021-06-15 | Auris Health, Inc. | System with emulator movement tracking for controlling medical devices |

| US10463439B2 (en) | 2016-08-26 | 2019-11-05 | Auris Health, Inc. | Steerable catheter with shaft load distributions |

| US11241559B2 (en) | 2016-08-29 | 2022-02-08 | Auris Health, Inc. | Active drive for guidewire manipulation |

| EP3506836A4 (en) | 2016-08-31 | 2020-04-29 | Auris Health, Inc. | EXTENSION FOR SURGICAL INSTRUMENT |

| US9931025B1 (en) * | 2016-09-30 | 2018-04-03 | Auris Surgical Robotics, Inc. | Automated calibration of endoscopes with pull wires |

| US10244926B2 (en) | 2016-12-28 | 2019-04-02 | Auris Health, Inc. | Detecting endolumenal buckling of flexible instruments |

| US10136959B2 (en) | 2016-12-28 | 2018-11-27 | Auris Health, Inc. | Endolumenal object sizing |

| US11793579B2 (en) | 2017-02-22 | 2023-10-24 | Covidien Lp | Integration of multiple data sources for localization and navigation |

| AU2018244318B2 (en) | 2017-03-28 | 2023-11-16 | Auris Health, Inc. | Shaft actuating handle |

| US11490782B2 (en) | 2017-03-31 | 2022-11-08 | Auris Health, Inc. | Robotic systems for navigation of luminal networks that compensate for physiological noise |

| WO2018187069A1 (en) | 2017-04-07 | 2018-10-11 | Auris Surgical Robotics, Inc. | Patient introducer alignment |

| US10285574B2 (en) | 2017-04-07 | 2019-05-14 | Auris Health, Inc. | Superelastic medical instrument |

| JP2020520691A (ja) | 2017-05-12 | 2020-07-16 | オーリス ヘルス インコーポレイテッド | 生検装置およびシステム |

| KR102576296B1 (ko) | 2017-05-17 | 2023-09-08 | 아우리스 헬스, 인코포레이티드 | 교환 가능한 작업 채널 |

| US10022192B1 (en) | 2017-06-23 | 2018-07-17 | Auris Health, Inc. | Automatically-initialized robotic systems for navigation of luminal networks |

| US11026758B2 (en) | 2017-06-28 | 2021-06-08 | Auris Health, Inc. | Medical robotics systems implementing axis constraints during actuation of one or more motorized joints |

| CN116725667A (zh) | 2017-06-28 | 2023-09-12 | 奥瑞斯健康公司 | 提供定位信息的系统和在解剖结构内定位器械的方法 |

| EP3645100A4 (en) | 2017-06-28 | 2021-03-17 | Auris Health, Inc. | INSTRUMENT INSERTION COMPENSATION |

| WO2019005696A1 (en) | 2017-06-28 | 2019-01-03 | Auris Health, Inc. | DETECTION OF ELECTROMAGNETIC DISTORTION |

| US10699448B2 (en) | 2017-06-29 | 2020-06-30 | Covidien Lp | System and method for identifying, marking and navigating to a target using real time two dimensional fluoroscopic data |

| US10426559B2 (en) | 2017-06-30 | 2019-10-01 | Auris Health, Inc. | Systems and methods for medical instrument compression compensation |

| US10464209B2 (en) | 2017-10-05 | 2019-11-05 | Auris Health, Inc. | Robotic system with indication of boundary for robotic arm |

| US10145747B1 (en) | 2017-10-10 | 2018-12-04 | Auris Health, Inc. | Detection of undesirable forces on a surgical robotic arm |

| CN111163697B (zh) | 2017-10-10 | 2023-10-03 | 柯惠有限合伙公司 | 用于在荧光三维重构中识别和标记目标的系统和方法 |

| US10016900B1 (en) | 2017-10-10 | 2018-07-10 | Auris Health, Inc. | Surgical robotic arm admittance control |

| US10555778B2 (en) | 2017-10-13 | 2020-02-11 | Auris Health, Inc. | Image-based branch detection and mapping for navigation |

| US11058493B2 (en) | 2017-10-13 | 2021-07-13 | Auris Health, Inc. | Robotic system configured for navigation path tracing |

| WO2019113249A1 (en) | 2017-12-06 | 2019-06-13 | Auris Health, Inc. | Systems and methods to correct for uncommanded instrument roll |

| EP3684438A4 (en) | 2017-12-08 | 2021-09-22 | Auris Health, Inc. | DIRECTED FLUIDS |

| WO2019113391A1 (en) | 2017-12-08 | 2019-06-13 | Auris Health, Inc. | System and method for medical instrument navigation and targeting |

| US10470830B2 (en) | 2017-12-11 | 2019-11-12 | Auris Health, Inc. | Systems and methods for instrument based insertion architectures |

| CN110869173B (zh) | 2017-12-14 | 2023-11-17 | 奥瑞斯健康公司 | 用于估计器械定位的系统与方法 |

| JP7059377B2 (ja) | 2017-12-18 | 2022-04-25 | オーリス ヘルス インコーポレイテッド | 管腔ネットワーク内の器具の追跡およびナビゲーションの方法およびシステム |

| USD924410S1 (en) | 2018-01-17 | 2021-07-06 | Auris Health, Inc. | Instrument tower |

| USD932628S1 (en) | 2018-01-17 | 2021-10-05 | Auris Health, Inc. | Instrument cart |

| USD873878S1 (en) | 2018-01-17 | 2020-01-28 | Auris Health, Inc. | Robotic arm |

| CN111867511A (zh) | 2018-01-17 | 2020-10-30 | 奥瑞斯健康公司 | 具有改进的机器人臂的外科机器人系统 |

| EP3740152A4 (en) | 2018-01-17 | 2021-11-03 | Auris Health, Inc. | SURGICAL PLATFORM WITH ADJUSTABLE ARMRESTS |

| USD901694S1 (en) | 2018-01-17 | 2020-11-10 | Auris Health, Inc. | Instrument handle |

| USD901018S1 (en) | 2018-01-17 | 2020-11-03 | Auris Health, Inc. | Controller |

| US11364004B2 (en) | 2018-02-08 | 2022-06-21 | Covidien Lp | System and method for pose estimation of an imaging device and for determining the location of a medical device with respect to a target |

| US10905498B2 (en) | 2018-02-08 | 2021-02-02 | Covidien Lp | System and method for catheter detection in fluoroscopic images and updating displayed position of catheter |

| US10930064B2 (en) | 2018-02-08 | 2021-02-23 | Covidien Lp | Imaging reconstruction system and method |

| US10765303B2 (en) | 2018-02-13 | 2020-09-08 | Auris Health, Inc. | System and method for driving medical instrument |

| MX2020010112A (es) | 2018-03-28 | 2020-11-06 | Auris Health Inc | Sistemas y metodos para el registro de sensores de ubicacion. |

| JP7305668B2 (ja) | 2018-03-28 | 2023-07-10 | オーリス ヘルス インコーポレイテッド | 可変曲げ剛性プロファイルを有する医療用器具 |

| JP7225259B2 (ja) | 2018-03-28 | 2023-02-20 | オーリス ヘルス インコーポレイテッド | 器具の推定位置を示すためのシステム及び方法 |

| KR20210010871A (ko) | 2018-05-18 | 2021-01-28 | 아우리스 헬스, 인코포레이티드 | 로봇식 원격작동 시스템을 위한 제어기 |

| WO2019231895A1 (en) | 2018-05-30 | 2019-12-05 | Auris Health, Inc. | Systems and methods for location sensor-based branch prediction |

| US10898275B2 (en) | 2018-05-31 | 2021-01-26 | Auris Health, Inc. | Image-based airway analysis and mapping |

| EP3801189A4 (en) | 2018-05-31 | 2022-02-23 | Auris Health, Inc. | PATH-BASED NAVIGATION OF TUBULAR NETWORKS |

| EP3801280A4 (en) | 2018-05-31 | 2022-03-09 | Auris Health, Inc. | ROBOTIC SYSTEMS AND LUMINAL NETWORK NAVIGATION METHODS THAT DETECT PHYSIOLOGICAL NOISE |

| KR102579505B1 (ko) | 2018-06-07 | 2023-09-20 | 아우리스 헬스, 인코포레이티드 | 고출력 기구를 가진 로봇 의료 시스템 |

| CN112384121A (zh) | 2018-06-27 | 2021-02-19 | 奥瑞斯健康公司 | 用于医疗器械的对准系统和附接系统 |

| JP7391886B2 (ja) | 2018-06-28 | 2023-12-05 | オーリス ヘルス インコーポレイテッド | 滑車共有を組み込んだ医療システム |

| US11705238B2 (en) | 2018-07-26 | 2023-07-18 | Covidien Lp | Systems and methods for providing assistance during surgery |

| US11071591B2 (en) | 2018-07-26 | 2021-07-27 | Covidien Lp | Modeling a collapsed lung using CT data |

| CN112804946A (zh) | 2018-08-07 | 2021-05-14 | 奥瑞斯健康公司 | 将基于应变的形状感测与导管控制相结合 |

| EP3806772A4 (en) | 2018-08-15 | 2022-03-30 | Auris Health, Inc. | MEDICAL INSTRUMENTS FOR TISSUE CAUTERIZATION |

| US10639114B2 (en) | 2018-08-17 | 2020-05-05 | Auris Health, Inc. | Bipolar medical instrument |

| AU2019326548B2 (en) | 2018-08-24 | 2023-11-23 | Auris Health, Inc. | Manually and robotically controllable medical instruments |

| WO2020060750A1 (en) | 2018-09-17 | 2020-03-26 | Auris Health, Inc. | Systems and methods for concomitant medical procedures |

| WO2020068303A1 (en) | 2018-09-26 | 2020-04-02 | Auris Health, Inc. | Systems and instruments for suction and irrigation |

| WO2020068853A2 (en) | 2018-09-26 | 2020-04-02 | Auris Health, Inc. | Articulating medical instruments |

| KR20210073542A (ko) | 2018-09-28 | 2021-06-18 | 아우리스 헬스, 인코포레이티드 | 의료 기구를 도킹시키기 위한 시스템 및 방법 |

| US10820947B2 (en) | 2018-09-28 | 2020-11-03 | Auris Health, Inc. | Devices, systems, and methods for manually and robotically driving medical instruments |

| US11944388B2 (en) | 2018-09-28 | 2024-04-02 | Covidien Lp | Systems and methods for magnetic interference correction |

| WO2020076447A1 (en) | 2018-10-08 | 2020-04-16 | Auris Health, Inc. | Systems and instruments for tissue sealing |

| US11877806B2 (en) | 2018-12-06 | 2024-01-23 | Covidien Lp | Deformable registration of computer-generated airway models to airway trees |

| US11045075B2 (en) | 2018-12-10 | 2021-06-29 | Covidien Lp | System and method for generating a three-dimensional model of a surgical site |

| US11617493B2 (en) | 2018-12-13 | 2023-04-04 | Covidien Lp | Thoracic imaging, distance measuring, surgical awareness, and notification system and method |

| US11801113B2 (en) | 2018-12-13 | 2023-10-31 | Covidien Lp | Thoracic imaging, distance measuring, and notification system and method |

| US11950863B2 (en) | 2018-12-20 | 2024-04-09 | Auris Health, Inc | Shielding for wristed instruments |

| US11254009B2 (en) | 2018-12-20 | 2022-02-22 | Auris Health, Inc. | Systems and methods for robotic arm alignment and docking |

| JP7480152B2 (ja) | 2018-12-28 | 2024-05-09 | オーリス ヘルス インコーポレイテッド | ロボット医療用システム及び方法のための経皮的シース |

| US11357593B2 (en) | 2019-01-10 | 2022-06-14 | Covidien Lp | Endoscopic imaging with augmented parallax |

| CN113347938A (zh) | 2019-01-25 | 2021-09-03 | 奥瑞斯健康公司 | 具有加热和冷却能力的血管密封器 |

| US11625825B2 (en) | 2019-01-30 | 2023-04-11 | Covidien Lp | Method for displaying tumor location within endoscopic images |

| US11564751B2 (en) | 2019-02-01 | 2023-01-31 | Covidien Lp | Systems and methods for visualizing navigation of medical devices relative to targets |

| US11925333B2 (en) | 2019-02-01 | 2024-03-12 | Covidien Lp | System for fluoroscopic tracking of a catheter to update the relative position of a target and the catheter in a 3D model of a luminal network |

| US11744643B2 (en) | 2019-02-04 | 2023-09-05 | Covidien Lp | Systems and methods facilitating pre-operative prediction of post-operative tissue function |

| US11857277B2 (en) | 2019-02-08 | 2024-01-02 | Auris Health, Inc. | Robotically controlled clot manipulation and removal |

| WO2020172394A1 (en) | 2019-02-22 | 2020-08-27 | Auris Health, Inc. | Surgical platform with motorized arms for adjustable arm supports |

| KR20210137508A (ko) | 2019-03-08 | 2021-11-17 | 아우리스 헬스, 인코포레이티드 | 의료 시스템 및 응용을 위한 틸트 메커니즘 |

| US11638618B2 (en) | 2019-03-22 | 2023-05-02 | Auris Health, Inc. | Systems and methods for aligning inputs on medical instruments |

| WO2020197625A1 (en) | 2019-03-25 | 2020-10-01 | Auris Health, Inc. | Systems and methods for medical stapling |

| US11617627B2 (en) | 2019-03-29 | 2023-04-04 | Auris Health, Inc. | Systems and methods for optical strain sensing in medical instruments |

| US11819285B2 (en) | 2019-04-05 | 2023-11-21 | Covidien Lp | Magnetic interference detection systems and methods |

| KR20210149805A (ko) | 2019-04-08 | 2021-12-09 | 아우리스 헬스, 인코포레이티드 | 동시 절차를 위한 시스템, 방법, 및 작업흐름 |

| US11856899B2 (en) | 2019-06-20 | 2024-01-02 | Reinke Manufacturing Co., Inc. | Monitoring and control of a movable tower in an irrigation system |

| WO2020263629A1 (en) | 2019-06-27 | 2020-12-30 | Auris Health, Inc. | Systems and methods for a medical clip applier |

| EP3989863A4 (en) | 2019-06-28 | 2023-10-11 | Auris Health, Inc. | MEDICAL INSTRUMENTS WITH WRISTS WITH HYBRID DIVERSION SURFACES |

| US11872007B2 (en) | 2019-06-28 | 2024-01-16 | Auris Health, Inc. | Console overlay and methods of using same |

| US11896330B2 (en) | 2019-08-15 | 2024-02-13 | Auris Health, Inc. | Robotic medical system having multiple medical instruments |

| EP4013285A4 (en) | 2019-08-15 | 2023-11-22 | Auris Health, Inc. | MEDICAL DEVICE COMPRISING SEVERAL FLEXIBLE SECTIONS |

| US11269173B2 (en) | 2019-08-19 | 2022-03-08 | Covidien Lp | Systems and methods for displaying medical video images and/or medical 3D models |

| CN114340540B (zh) | 2019-08-30 | 2023-07-04 | 奥瑞斯健康公司 | 器械图像可靠性系统和方法 |

| EP4021331A4 (en) | 2019-08-30 | 2023-08-30 | Auris Health, Inc. | SYSTEMS AND METHODS FOR WEIGHT-BASED REGISTRATION OF POSITION SENSORS |

| CN114641252B (zh) | 2019-09-03 | 2023-09-01 | 奥瑞斯健康公司 | 电磁畸变检测和补偿 |

| US11864935B2 (en) | 2019-09-09 | 2024-01-09 | Covidien Lp | Systems and methods for pose estimation of a fluoroscopic imaging device and for three-dimensional imaging of body structures |

| US11931111B2 (en) | 2019-09-09 | 2024-03-19 | Covidien Lp | Systems and methods for providing surgical guidance |

| EP4028221A1 (en) | 2019-09-10 | 2022-07-20 | Auris Health, Inc. | Systems and methods for kinematic optimization with shared robotic degrees-of-freedom |

| US11627924B2 (en) | 2019-09-24 | 2023-04-18 | Covidien Lp | Systems and methods for image-guided navigation of percutaneously-inserted devices |

| CN114502094A (zh) | 2019-09-26 | 2022-05-13 | 奥瑞斯健康公司 | 用于碰撞检测和避免的系统和方法 |

| US11737845B2 (en) | 2019-09-30 | 2023-08-29 | Auris Inc. | Medical instrument with a capstan |

| US11737835B2 (en) | 2019-10-29 | 2023-08-29 | Auris Health, Inc. | Braid-reinforced insulation sheath |

| WO2021137108A1 (en) | 2019-12-31 | 2021-07-08 | Auris Health, Inc. | Alignment interfaces for percutaneous access |

| WO2021137104A1 (en) | 2019-12-31 | 2021-07-08 | Auris Health, Inc. | Dynamic pulley system |

| EP4084721A4 (en) | 2019-12-31 | 2024-01-03 | Auris Health Inc | IDENTIFICATION OF AN ANATOMIC FEATURE AND AIMING |

| JP2023508718A (ja) | 2019-12-31 | 2023-03-03 | オーリス ヘルス インコーポレイテッド | 高度バスケット駆動モード |

| EP4084720A4 (en) | 2019-12-31 | 2024-01-17 | Auris Health Inc | ALIGNMENT TECHNIQUES FOR PERCUTANE ACCESS |

| US11847730B2 (en) | 2020-01-24 | 2023-12-19 | Covidien Lp | Orientation detection in fluoroscopic images |

| US11380060B2 (en) | 2020-01-24 | 2022-07-05 | Covidien Lp | System and method for linking a segmentation graph to volumetric data |

| US20210393344A1 (en) * | 2020-06-22 | 2021-12-23 | Auris Health, Inc. | Control scheme calibration for medical instruments |

| EP4171427A1 (en) | 2020-06-29 | 2023-05-03 | Auris Health, Inc. | Systems and methods for detecting contact between a link and an external object |

| WO2022003493A1 (en) | 2020-06-30 | 2022-01-06 | Auris Health, Inc. | Robotic medical system with collision proximity indicators |

| US11357586B2 (en) | 2020-06-30 | 2022-06-14 | Auris Health, Inc. | Systems and methods for saturated robotic movement |

| US11950950B2 (en) | 2020-07-24 | 2024-04-09 | Covidien Lp | Zoom detection and fluoroscope movement detection for target overlay |

| CN113055598B (zh) * | 2021-03-25 | 2022-08-05 | 浙江商汤科技开发有限公司 | 朝向数据补偿方法、装置、电子设备、可读存储介质 |

| WO2023154713A1 (en) * | 2022-02-11 | 2023-08-17 | Canon U.S.A., Inc. | Collision warning for medical device |

| WO2023192129A1 (en) * | 2022-03-29 | 2023-10-05 | Noah Medical Corporation | Systems and methods for responsive insertion and retraction of robotic endoscope |

Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2017049163A1 (en) | 2015-09-18 | 2017-03-23 | Auris Surgical Robotics, Inc. | Navigation of tubular networks |

Family Cites Families (359)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US4745908A (en) | 1987-05-08 | 1988-05-24 | Circon Corporation | Inspection instrument fexible shaft having deflection compensation means |

| JP2750201B2 (ja) | 1990-04-13 | 1998-05-13 | オリンパス光学工業株式会社 | 内視鏡の挿入状態検出装置 |

| US5550953A (en) | 1994-04-20 | 1996-08-27 | The United States Of America As Represented By The Administrator Of The National Aeronautics And Space Administration | On-line method and apparatus for coordinated mobility and manipulation of mobile robots |

| US5603318A (en) | 1992-04-21 | 1997-02-18 | University Of Utah Research Foundation | Apparatus and method for photogrammetric surgical localization |

| US5526812A (en) | 1993-06-21 | 1996-06-18 | General Electric Company | Display system for enhancing visualization of body structures during medical procedures |

| US6059718A (en) | 1993-10-18 | 2000-05-09 | Olympus Optical Co., Ltd. | Endoscope form detecting apparatus in which coil is fixedly mounted by insulating member so that form is not deformed within endoscope |

| AU3950595A (en) | 1994-10-07 | 1996-05-06 | St. Louis University | Surgical navigation systems including reference and localization frames |

| US6690963B2 (en) * | 1995-01-24 | 2004-02-10 | Biosense, Inc. | System for determining the location and orientation of an invasive medical instrument |

| US6246898B1 (en) | 1995-03-28 | 2001-06-12 | Sonometrics Corporation | Method for carrying out a medical procedure using a three-dimensional tracking and imaging system |

| CA2231425A1 (en) | 1995-09-20 | 1997-03-27 | Texas Heart Institute | Detecting thermal discrepancies in vessel walls |

| US6203493B1 (en) | 1996-02-15 | 2001-03-20 | Biosense, Inc. | Attachment with one or more sensors for precise position determination of endoscopes |

| WO1997029709A1 (en) | 1996-02-15 | 1997-08-21 | Biosense, Inc. | Medical procedures and apparatus using intrabody probes |

| US6063095A (en) | 1996-02-20 | 2000-05-16 | Computer Motion, Inc. | Method and apparatus for performing minimally invasive surgical procedures |

| US6047080A (en) | 1996-06-19 | 2000-04-04 | Arch Development Corporation | Method and apparatus for three-dimensional reconstruction of coronary vessels from angiographic images |

| US5831614A (en) | 1996-07-01 | 1998-11-03 | Sun Microsystems, Inc. | X-Y viewport scroll using location of display with respect to a point |

| JP2000509626A (ja) | 1997-01-24 | 2000-08-02 | コーニンクレッカ フィリップス エレクトロニクス エヌ ヴィ | 画像表示システム |

| US6246784B1 (en) | 1997-08-19 | 2001-06-12 | The United States Of America As Represented By The Department Of Health And Human Services | Method for segmenting medical images and detecting surface anomalies in anatomical structures |

| US6810281B2 (en) | 2000-12-21 | 2004-10-26 | Endovia Medical, Inc. | Medical mapping system |

| FR2779339B1 (fr) | 1998-06-09 | 2000-10-13 | Integrated Surgical Systems Sa | Procede et appareil de mise en correspondance pour la chirurgie robotisee, et dispositif de mise en correspondance en comportant application |

| US6425865B1 (en) | 1998-06-12 | 2002-07-30 | The University Of British Columbia | Robotically assisted medical ultrasound |

| WO2000028882A2 (en) | 1998-11-18 | 2000-05-25 | Microdexterity Systems, Inc. | Medical manipulator for use with an imaging device |

| US6493608B1 (en) | 1999-04-07 | 2002-12-10 | Intuitive Surgical, Inc. | Aspects of a control system of a minimally invasive surgical apparatus |

| US6501981B1 (en) | 1999-03-16 | 2002-12-31 | Accuray, Inc. | Apparatus and method for compensating for respiratory and patient motions during treatment |

| US6594552B1 (en) | 1999-04-07 | 2003-07-15 | Intuitive Surgical, Inc. | Grip strength with tactile feedback for robotic surgery |

| US7386339B2 (en) | 1999-05-18 | 2008-06-10 | Mediguide Ltd. | Medical imaging and navigation system |

| US6466198B1 (en) | 1999-11-05 | 2002-10-15 | Innoventions, Inc. | View navigation and magnification of a hand-held device with a display |

| FI114282B (fi) | 1999-11-05 | 2004-09-30 | Polar Electro Oy | Menetelmä, järjestely ja sykemittari sydämen lyönnin tunnistamiseksi |

| US7747312B2 (en) | 2000-01-04 | 2010-06-29 | George Mason Intellectual Properties, Inc. | System and method for automatic shape registration and instrument tracking |

| DE10011790B4 (de) | 2000-03-13 | 2005-07-14 | Siemens Ag | Medizinisches Instrument zum Einführen in ein Untersuchungsobjekt, sowie medizinisches Untersuchungs- oder Behandlungsgerät |

| US7181289B2 (en) | 2000-03-20 | 2007-02-20 | Pflueger D Russell | Epidural nerve root access catheter and treatment methods |

| DE10025285A1 (de) | 2000-05-22 | 2001-12-06 | Siemens Ag | Vollautomatische, robotergestützte Kameraführung unter Verwendung von Positionssensoren für laparoskopische Eingriffe |

| DE10033723C1 (de) | 2000-07-12 | 2002-02-21 | Siemens Ag | Visualisierung von Positionen und Orientierung von intrakorporal geführten Instrumenten während eines chirurgischen Eingriffs |

| US6865498B2 (en) | 2001-11-30 | 2005-03-08 | Thermwood Corporation | System for calibrating the axes on a computer numeric controlled machining system and method thereof |

| US6812842B2 (en) | 2001-12-20 | 2004-11-02 | Calypso Medical Technologies, Inc. | System for excitation of a leadless miniature marker |

| US8095200B2 (en) | 2002-03-06 | 2012-01-10 | Mako Surgical Corp. | System and method for using a haptic device as an input device |

| DE10210646A1 (de) | 2002-03-11 | 2003-10-09 | Siemens Ag | Verfahren zur Bilddarstellung eines in einen Untersuchungsbereich eines Patienten eingebrachten medizinischen Instruments |

| US20050256398A1 (en) | 2004-05-12 | 2005-11-17 | Hastings Roger N | Systems and methods for interventional medicine |

| EP3189781A1 (en) | 2002-04-17 | 2017-07-12 | Covidien LP | Endoscope structures and techniques for navigating to a target in branched structure |

| US7998062B2 (en) | 2004-03-29 | 2011-08-16 | Superdimension, Ltd. | Endoscope structures and techniques for navigating to a target in branched structure |

| AU2003247338A1 (en) | 2002-04-25 | 2003-11-10 | The John Hopkins University | Robot for computed tomography interventions |

| JP2005528157A (ja) | 2002-06-04 | 2005-09-22 | コーニンクレッカ フィリップス エレクトロニクス エヌ ヴィ | 回転血管造影法に基づく冠状動脈構造のハイブリッド3d再構成 |

| JP4439393B2 (ja) | 2002-06-17 | 2010-03-24 | メイザー サージカル テクノロジーズ リミテッド | 整形外科的インサートと併用するロボット |

| WO2004000151A1 (en) | 2002-06-25 | 2003-12-31 | Michael Nicholas Dalton | Apparatus and method for superimposing images over an object |

| KR100449765B1 (ko) | 2002-10-12 | 2004-09-22 | 삼성에스디아이 주식회사 | 리튬전지용 리튬메탈 애노드 |

| US6899672B2 (en) | 2002-11-08 | 2005-05-31 | Scimed Life Systems, Inc. | Endoscopic imaging system including removable deflection device |

| JP4804005B2 (ja) | 2002-11-13 | 2011-10-26 | コーニンクレッカ フィリップス エレクトロニクス エヌ ヴィ | 境界構造を検出するための医用ビューイングシステム及び方法 |

| US7599730B2 (en) | 2002-11-19 | 2009-10-06 | Medtronic Navigation, Inc. | Navigation system for cardiac therapies |

| US20040186349A1 (en) | 2002-12-24 | 2004-09-23 | Usgi Medical Corp. | Apparatus and methods for achieving endoluminal access |

| FR2852226B1 (fr) | 2003-03-10 | 2005-07-15 | Univ Grenoble 1 | Instrument medical localise a ecran orientable |

| US7203277B2 (en) | 2003-04-25 | 2007-04-10 | Brainlab Ag | Visualization device and method for combined patient and object image data |

| US7822461B2 (en) | 2003-07-11 | 2010-10-26 | Siemens Medical Solutions Usa, Inc. | System and method for endoscopic path planning |

| EP2316328B1 (en) | 2003-09-15 | 2012-05-09 | Super Dimension Ltd. | Wrap-around holding device for use with bronchoscopes |

| US7835778B2 (en) | 2003-10-16 | 2010-11-16 | Medtronic Navigation, Inc. | Method and apparatus for surgical navigation of a multiple piece construct for implantation |

| WO2005058137A2 (en) | 2003-12-12 | 2005-06-30 | University Of Washington | Catheterscope 3d guidance and interface system |

| JP2005192632A (ja) | 2003-12-26 | 2005-07-21 | Olympus Corp | 被検体内移動状態検出システム |

| US8021301B2 (en) | 2003-12-26 | 2011-09-20 | Fujifilm Corporation | Ultrasonic image processing apparatus, ultrasonic image processing method and ultrasonic image processing program |

| US20050193451A1 (en) | 2003-12-30 | 2005-09-01 | Liposonix, Inc. | Articulating arm for medical procedures |

| US7974681B2 (en) | 2004-03-05 | 2011-07-05 | Hansen Medical, Inc. | Robotic catheter system |

| WO2005087128A1 (en) | 2004-03-05 | 2005-09-22 | Hansen Medical, Inc. | Robotic catheter system |

| US7811294B2 (en) * | 2004-03-08 | 2010-10-12 | Mediguide Ltd. | Automatic guidewire maneuvering system and method |

| WO2005094665A2 (en) | 2004-03-23 | 2005-10-13 | Boston Scientific Limited | In-vivo visualization system |

| WO2005092188A1 (ja) | 2004-03-29 | 2005-10-06 | Olympus Corporation | 被検体内位置検出システム |

| US7720521B2 (en) | 2004-04-21 | 2010-05-18 | Acclarent, Inc. | Methods and devices for performing procedures within the ear, nose, throat and paranasal sinuses |

| US20070208252A1 (en) | 2004-04-21 | 2007-09-06 | Acclarent, Inc. | Systems and methods for performing image guided procedures within the ear, nose, throat and paranasal sinuses |

| US7462175B2 (en) | 2004-04-21 | 2008-12-09 | Acclarent, Inc. | Devices, systems and methods for treating disorders of the ear, nose and throat |

| US8155403B2 (en) | 2004-05-05 | 2012-04-10 | University Of Iowa Research Foundation | Methods and devices for airway tree labeling and/or matching |

| US7632265B2 (en) | 2004-05-28 | 2009-12-15 | St. Jude Medical, Atrial Fibrillation Division, Inc. | Radio frequency ablation servo catheter and method |

| US20060209019A1 (en) | 2004-06-01 | 2006-09-21 | Energid Technologies Corporation | Magnetic haptic feedback systems and methods for virtual reality environments |

| US7772541B2 (en) | 2004-07-16 | 2010-08-10 | Luna Innnovations Incorporated | Fiber optic position and/or shape sensing based on rayleigh scatter |

| US20060025668A1 (en) | 2004-08-02 | 2006-02-02 | Peterson Thomas H | Operating table with embedded tracking technology |

| WO2007017847A1 (en) | 2005-08-11 | 2007-02-15 | Navotek Medical Ltd. | Medical treatment system and method using radioactivity based position sensor |

| US7536216B2 (en) | 2004-10-18 | 2009-05-19 | Siemens Medical Solutions Usa, Inc. | Method and system for virtual endoscopy with guidance for biopsy |

| US9049954B2 (en) | 2004-11-03 | 2015-06-09 | Cambridge International, Inc. | Hanger bar assembly for architectural mesh and the like |

| CA2587857C (en) | 2004-11-23 | 2017-10-10 | Pneumrx, Inc. | Steerable device for accessing a target site and methods |

| CA2588002A1 (en) | 2005-01-18 | 2006-07-27 | Traxtal Inc. | Method and apparatus for guiding an instrument to a target in the lung |

| US8335357B2 (en) | 2005-03-04 | 2012-12-18 | Kabushiki Kaisha Toshiba | Image processing apparatus |

| US20060258935A1 (en) | 2005-05-12 | 2006-11-16 | John Pile-Spellman | System for autonomous robotic navigation |

| US10555775B2 (en) | 2005-05-16 | 2020-02-11 | Intuitive Surgical Operations, Inc. | Methods and system for performing 3-D tool tracking by fusion of sensor and/or camera derived data during minimally invasive robotic surgery |

| US7756563B2 (en) | 2005-05-23 | 2010-07-13 | The Penn State Research Foundation | Guidance method based on 3D-2D pose estimation and 3D-CT registration with application to live bronchoscopy |

| US7889905B2 (en) | 2005-05-23 | 2011-02-15 | The Penn State Research Foundation | Fast 3D-2D image registration method with application to continuously guided endoscopy |

| JP4813190B2 (ja) | 2005-05-26 | 2011-11-09 | オリンパスメディカルシステムズ株式会社 | カプセル型医療装置 |

| GB2428110A (en) | 2005-07-06 | 2007-01-17 | Armstrong Healthcare Ltd | A robot and method of registering a robot. |

| US20070123748A1 (en) | 2005-07-14 | 2007-05-31 | Dwight Meglan | Robot for minimally invasive interventions |

| US8583220B2 (en) | 2005-08-02 | 2013-11-12 | Biosense Webster, Inc. | Standardization of catheter-based treatment for atrial fibrillation |