JP6372266B2 - 投射型表示装置および機能制御方法 - Google Patents

投射型表示装置および機能制御方法 Download PDFInfo

- Publication number

- JP6372266B2 JP6372266B2 JP2014182976A JP2014182976A JP6372266B2 JP 6372266 B2 JP6372266 B2 JP 6372266B2 JP 2014182976 A JP2014182976 A JP 2014182976A JP 2014182976 A JP2014182976 A JP 2014182976A JP 6372266 B2 JP6372266 B2 JP 6372266B2

- Authority

- JP

- Japan

- Prior art keywords

- light

- projection

- display device

- area

- detection

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/041—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means

- G06F3/042—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means by opto-electronic means

-

- G—PHYSICS

- G03—PHOTOGRAPHY; CINEMATOGRAPHY; ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ELECTROGRAPHY; HOLOGRAPHY

- G03B—APPARATUS OR ARRANGEMENTS FOR TAKING PHOTOGRAPHS OR FOR PROJECTING OR VIEWING THEM; APPARATUS OR ARRANGEMENTS EMPLOYING ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ACCESSORIES THEREFOR

- G03B17/00—Details of cameras or camera bodies; Accessories therefor

- G03B17/48—Details of cameras or camera bodies; Accessories therefor adapted for combination with other photographic or optical apparatus

- G03B17/54—Details of cameras or camera bodies; Accessories therefor adapted for combination with other photographic or optical apparatus with projector

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F1/00—Details not covered by groups G06F3/00 - G06F13/00 and G06F21/00

- G06F1/16—Constructional details or arrangements

- G06F1/1613—Constructional details or arrangements for portable computers

- G06F1/1633—Constructional details or arrangements of portable computers not specific to the type of enclosures covered by groups G06F1/1615 - G06F1/1626

- G06F1/1637—Details related to the display arrangement, including those related to the mounting of the display in the housing

- G06F1/1639—Details related to the display arrangement, including those related to the mounting of the display in the housing the display being based on projection

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/002—Specific input/output arrangements not covered by G06F3/01 - G06F3/16

- G06F3/005—Input arrangements through a video camera

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/017—Gesture based interaction, e.g. based on a set of recognized hand gestures

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/02—Input arrangements using manually operated switches, e.g. using keyboards or dials

- G06F3/0202—Constructional details or processes of manufacture of the input device

- G06F3/0219—Special purpose keyboards

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/041—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/041—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means

- G06F3/042—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means by opto-electronic means

- G06F3/0425—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means by opto-electronic means using a single imaging device like a video camera for tracking the absolute position of a single or a plurality of objects with respect to an imaged reference surface, e.g. video camera imaging a display or a projection screen, a table or a wall surface, on which a computer generated image is displayed or projected

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0481—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance

- G06F3/0482—Interaction with lists of selectable items, e.g. menus

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

- G06F3/04886—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures by partitioning the display area of the touch-screen or the surface of the digitising tablet into independently controllable areas, e.g. virtual keyboards or menus

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/20—Movements or behaviour, e.g. gesture recognition

- G06V40/28—Recognition of hand or arm movements, e.g. recognition of deaf sign language

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/12—Picture reproducers

- H04N9/31—Projection devices for colour picture display, e.g. using electronic spatial light modulators [ESLM]

- H04N9/3141—Constructional details thereof

- H04N9/3173—Constructional details thereof wherein the projection device is specially adapted for enhanced portability

- H04N9/3176—Constructional details thereof wherein the projection device is specially adapted for enhanced portability wherein the projection device is incorporated in a camera

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/12—Picture reproducers

- H04N9/31—Projection devices for colour picture display, e.g. using electronic spatial light modulators [ESLM]

- H04N9/3191—Testing thereof

- H04N9/3194—Testing thereof including sensor feedback

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2340/00—Aspects of display data processing

- G09G2340/04—Changes in size, position or resolution of an image

- G09G2340/0464—Positioning

- G09G2340/0471—Vertical positioning

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2340/00—Aspects of display data processing

- G09G2340/04—Changes in size, position or resolution of an image

- G09G2340/0464—Positioning

- G09G2340/0478—Horizontal positioning

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2354/00—Aspects of interface with display user

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/12—Picture reproducers

- H04N9/31—Projection devices for colour picture display, e.g. using electronic spatial light modulators [ESLM]

Description

・実施の形態(投影エリア内外に特定の入力操作を検出するためのチャンネル領域を設けた投射型表示装置の例)

1.構成

2.作用,効果

[構成]

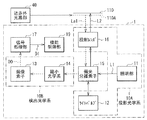

図1は、本開示の一実施の形態に係る投射型表示装置(投射型表示装置1)の外観とその使用状態とを表したものである。図2は投射型表示装置1の機能構成を表したものである。投射型表示装置1は、例えば卓上などのフラットな面の上に置かれた状態(あるいは壁面などに取り付けられた状態)で、装置の近傍に映像を投影するタイプ(いわゆる超短焦点型)のプロジェクタである。この投射型表示装置1は、また、映像表示と共に、物体検出をアクティブに行う機能を有している。詳細は後述するが、図1に示したように、映像が投射される投影エリアS11(ライトバルブサイズに対応する投影可能エリア)において、表示された映像を指(指示物71)でタッチする等、ユーザが何らかの動作を行うことで、所定の入力操作を行うことができるようになっている。

ライトバルブ12は、例えばLCOS(Liquid Crystal On Silicon)等の反射型の液晶素子である。ライトバルブ12は、例えば照明光L1に含まれる第1の偏光成分(例えば、後述のs偏光成分Ls1)を映像データに基づいて変調するものである。ライトバルブ12によって変調された光は、偏光状態が回転されており、第2の偏光成分(例えば、後述のp偏光成分Lp1)となる。この変調光が、偏光分離素子15を介して投射レンズ16に向けて出射されるようになっている。なお、ライトバルブ12では、入射光(s偏光成分Ls1)をそのままの偏光状態で偏光分離素子15に戻すことで黒表示を行うことも可能である。このライトバルブ12の有効エリア(後述の矩形状A1)の面形状は、例えば矩形状である。

偏光分離素子15は、入射した光を第1の偏光成分(例えばs偏光成分)と第2の偏光成分(例えばp偏光成分)とに分離し、それぞれを互いに異なる方向に出射するものである。この偏光分離素子15は、例えば偏光ビームスプリッタ(PBS)からなり、第1の偏光成分を選択的に反射させる(偏光分離面150において反射させる)と共に、第2の偏光成分を選択的に透過させる(偏光分離面150を透過させる)ように構成されている。本実施の形態では、偏光分離素子15として偏光ビームスプリッタを用いる場合を例に挙げて説明するが、偏光分離素子15はこれに限らず、ワイヤーグリッドから構成されていてもよい。その場合には、偏光ビームスプリッタと特性が異なり、入射した光のうちの第1の偏光成分としてp偏光成分を選択的に反射し、第2の偏光成分としてs偏光成分を選択的に透過させることができる。

撮像素子13は、ライトバルブ12と光学的に共役な位置に配置されている。より具体的には、ライトバルブ12が反射型の液晶素子である場合、映像を創り出す表示面(液晶面)と撮像素子13の撮像面とが光学的に共役な関係となるように配置されている。撮像素子13は、例えばCMOS(Complementary Metal-Oxide Semiconductor)やCCD(Charge Coupled Device)などの固体撮像素子により構成され、有効エリア(後述の矩形状A3)の面形状は、例えば矩形状である。本実施の形態では、詳細は後述するが、この撮像素子13のサイズが、投影エリアS11の周辺の領域をも受光対象とするように設計されている。

本実施の形態では、投影面上において、投影エリアS11の周辺に物体検出の可能なエリア(第2の検出エリア)が形成される。この第2の検出エリアには、特定の入力操作に対応づけられたチャンネル領域(後述のチャンネル領域CH1a〜CH4a等)が割り当てられている。つまり、投影エリアS11の周辺(以下、「エリア外」と称する)における物体検出が可能であり、エリア外において特定の入力操作がなされると、その入力操作に対応づけられた機能が実行されるようになっている。なお、チャンネル領域ではなく、位置座標に特定の入力操作が割り当てられていてもよい。このエリア外検出による入力操作を実現するための具体的な構成について、以下に説明する。

d1<β×d2 ………(1)

投射型表示装置1では、図13に示したように、ライトバルブ12に形成された映像情報V1を投射レンズ16によって、卓上などの投影面110上に投影し、投影画像V2として拡大表示する。この一方で、投射型表示装置1は、投影面110上における物体の位置、例えば人の指やポインタ等の指示物(物体)71の特徴点の位置Pt1を、撮像素子13から得られた撮像信号D0を用いて検出する。

ウインドウ画面のスタートボタン、閉じる(×)ボタン、ブラウザ閲覧時の上下スクロールバーなど、画面の外周あるいは角部に設けられた比較的細かい,狭い部位における操作を、その周辺に割り当てられたチャンネル領域CH1a〜CH4aを用いて行う。その模式図を図15に示す。画面内の狭小な操作部位(ボタン、スクロールなど)B11,B12,B13等を直接タッチして操作するよりも、チャンネル領域CH1a〜CH4aのうちの選択的な領域(本来の操作部位B11,B12,B13の近傍の領域)をタッチする方が操作し易く、またタッチ操作が画面情報の妨げになることもない。

上記の入力操作の際に、更にチャンネル領域CH1a〜CH4aのうちの所定の領域を同時にタッチしている場合にのみ、機能を実行する。例えば、チャンネル領域CH3a(あるいはその一部)をタッチしながら、チャンネル領域CH4a(あるいはその一部)をタッチする操作を行った場合に、ウインドウ画面が閉じられる、などの機能を実行する。これにより、機能の誤作動を抑制することができる。

映像、音楽あるいはその他の画面情報をタッチ操作により妨げられたくない場合の入力操作を、エリア外にて行い、例えば曲送り、シーク、音量調整などの機能を実行する。

エリア外(投影エリアS11あるいは映像表示エリアS11aの周辺)にて映像表示エリアS11aの位置(投影位置)を動かすジェスチャーを行い、投影位置を調整する。例えば、机上に本やコップなどが置かれている場合、投影面110がフラットな面とならず、凹凸が生じる。そのような凹凸を生じる物が置かれている場合などに、エリア外での入力操作により、凹凸部分を回避して映像表示エリアS11aをフラットな面にシフトする機能を実行する。

エリア外の選択的な複数の領域(例えば2つの辺または2つの隅)を同時にシークすることで、表示画面サイズを拡大あるいは縮小する機能を実行する。投影エリアS11内は、映像のポインティング操作の検出に割り当てられることから、エリア外での操作および複数箇所同時操作により、誤検出ないし誤作動を抑制することができる。

投影エリアS11の周辺に置いた、スマートフォンやタブレットなど他の電子機器を検出し、例えば待ち受け画面のページアイコンを投影エリアS11に展開して、電子機器より大きな画面に、電子機器の映像を表示する機能を実行する。

エリア外の選択的な領域を2回タップすることで、前画面表示に戻る機能を実行する。エリア内での2回タップは、通常のダブルクリック操作として認識されるが、エリア外では、2回タップに他の操作を割り当てることができる。

エリア外の選択的な領域、例えば画面下のチャンネル領域CH2aを長押しすることにより、キーボードを表示する機能を実行する。

いわゆるマルチタッチ検出(多点検出)に対応することも可能である。つまり複数の人が同時に操作した場合、あるいは複数の点を近づける、あるいは離す等の操作により表示映像の拡大あるいは縮小等を行うことができる。このマルチタッチ検出への適用はメリットでもあるが、誤検出となる場合もある。例えば、ユーザが投影面110の手前に座り、何らかの操作、例えば文字を書く、絵を書くなどの操作を行う場合、一般的に手の位置を固定するため、手の腹を画面に付けた状態でそのような操作を行うことが多い。指先と手の腹とを同時に検出してしまい、誤操作につながる。このような場合、指先と手の腹との特徴点の違いから信号処理によって指先の位置のみを選択的に検出することもできるが、次のような手法をとることが可能である。

(1)

照明部と、投射レンズと、前記照明部から供給された照明光を映像信号に基づいて変調して前記投射レンズへ向けて出射するライトバルブとを有する投影光学系と、

前記ライトバルブと前記投射レンズとの間に配置され、入射光を第1および第2の偏光成分に分離すると共に、それぞれを互いに異なる方向に出射する偏光分離素子と、

前記ライトバルブと光学的に共役な位置に配置された撮像素子を有する検出光学系と

を備え、

前記撮像素子には、投影面の近傍の面に沿って照射された非可視光に基づく光が、前記投射レンズと前記偏光分離素子とを介して入射され、かつ

前記投影面上の投影エリアの周辺において、入力操作を検出すると共にその検出結果に応じて特定の機能を実行可能に構成された

投射型表示装置。

(2)

前記投射レンズの略焦点距離の位置またはこれと光学的に共役の関係となる位置において、

前記ライトバルブの有効エリアに対応する面形状は、第1の矩形状であり、

前記撮像素子の有効エリアに対応する面形状は、前記第1の矩形状と中心位置が略同一で、かつ前記第1の矩形状よりも大きな第2の矩形状である

上記(1)に記載の投射型表示装置。

(3)

投影面上に、

前記投影エリアに対応する第1の検出エリアと、 前記投影エリアの周辺部に対応する第2の検出エリアと

を形成可能に構成された

上記(2)に記載の投射型表示装置。

(4)

前記第2の検出エリアは、それぞれが前記入力操作に対応づけられた1または複数のチャンネル領域または位置座標を有する

上記(3)に記載の投射型表示装置。

(5)

前記投影エリアの矩形状の4辺のそれぞれに対向して、前記チャンネル領域が1つ以上設けられている

上記(4)に記載の投射型表示装置。

(6)

前記複数のチャンネル領域のうちの1のチャンネル領域において、一定時間内に複数回にわたって物体が検出された場合に、前記機能を実行する

上記(4)または(5)に記載の投射型表示装置。

(7)

前記複数のチャンネル領域のうちの1のチャンネル領域において、一定時間にわたって連続的に物体が検出された場合に、前記機能を実行する

上記(4)または(5)に記載の投射型表示装置。

(8)

前記複数のチャンネル領域のうちの1のチャンネル領域において物体が検出された後、一定時間内に他のチャンネル領域において物体が検出された場合に、前記機能を実行する

上記(4)または(5)に記載の投射型表示装置。

(9)

前記複数のチャンネル領域のうちの異なる2以上のチャンネル領域において、同時に物体が検出された場合に、前記機能を実行する

上記(4)または(5)に記載の投射型表示装置。

(10)

前記複数のチャンネル領域のうちの1のチャンネル領域と、前記第1の検出エリア内の選択的な領域とにおいて同時に物体が検出された場合に、前記機能を実行する

上記(4)または(5)に記載の投射型表示装置。

(11)

前記第1の検出エリアは、前記投影エリアのうちの選択的な映像表示エリアの周辺に、それぞれが前記入力操作に対応づけられた1または複数のチャンネル領域を有する

上記(3)に記載の投射型表示装置。

(12)

前記投射レンズは、短焦点レンズである

上記(1)〜(11)のいずれかに記載の投射型表示装置。

(13)

前記非可視光を出射する光源部が外筐に設けられている

上記(1)〜(12)のいずれかに記載の投射型表示装置。

(14)

前記非可視光は、近赤外光である

上記(1)〜(13)のいずれかに記載の投射型表示装置。

(15)

前記偏光分離素子は、偏光ビームスプリッタである

上記(1)〜(14)のいずれかに記載の投射型表示装置。

(16)

前記ライトバルブは、反射型液晶表示素子である

上記(1)〜(15)のいずれかに記載の投射型表示装置。

(17)

前記偏光分離素子は、それぞれが光入射面または光出射面となる第1ないし第4の面を有すると共に、前記第1の面から入射した光のうちの前記第1の偏光成分を前記第2の面から出射し、前記第1の面から入射した光のうちの前記第2の偏光成分を前記第3の面から出射し、前記第2の面から入射した光のうちの前記第2の偏光成分を前記第4の面から出射し、かつ、前記第4の面から入射した光のうちの前記第1の偏光成分を前記第3の面から出射する、ように構成されている

上記(16)に記載の投射型表示装置。

(18)

前記投影光学系は、

前記照明部が、前記照明光を前記偏光分離素子の前記第1の面に向けて出射し、

前記ライトバルブが、前記照明光のうち、前記偏光分離素子の前記第2の面から出射した前記第1の偏光成分を変調し、その変調光を、前記偏光分離素子の前記第2の面に向けて出射し、

前記投射レンズが、前記変調光のうち、前記偏光分離素子の前記第4の面から出射した光を、前記投影面に向けて投射する、ように構成されている

上記(17)に記載の投射型表示装置。

(19)

前記検出光学系は、

縮小光学系に、前記投射レンズと前記偏光分離素子の前記第4の面および前記第3の面とを介して物体検出用の光が入射され、

前記撮像素子に、前記縮小光学系から出射された光が入射する、ように構成されている

上記(18)に記載の投射型表示装置。

(20)

投射レンズと、照明光を映像信号に基づいて変調して前記投射レンズへ向けて出射するライトバルブと、前記ライトバルブと前記投射レンズとの間に配置された偏光分離素子と、前記ライトバルブと光学的に共役な位置に配置されると共に非可視光を受光する撮像素子とを備えた光学系により得られた撮像信号に基づき、投影エリアの周辺における特定の入力操作の有無を判定し、

その判定結果に基づいて特定の機能を実行するように制御する

機能制御方法。

Claims (20)

- 照明部と、投射レンズと、前記照明部から供給された照明光を映像信号に基づいて変調して前記投射レンズへ向けて出射するライトバルブとを有する投影光学系と、

前記ライトバルブと前記投射レンズとの間に配置され、入射光を第1および第2の偏光成分に分離すると共に、それぞれを互いに異なる方向に出射する偏光分離素子と、

前記ライトバルブと光学的に共役な位置に配置された撮像素子を有する検出光学系と、

前記投射レンズの下方に配置され、非可視光を出射する光源部と

を備え、

前記撮像素子には、前記映像信号に基づいて前記投射レンズから投射される投影面に平行に照射された前記非可視光に基づく光が、前記投射レンズと前記偏光分離素子とを介して入射され、

前記撮像素子に入射される前記非可視光に基づく光は、前記光源部から出射された前記非可視光が前記投影面内に存在する指示物にあたり反射された光であり、

前記撮像素子に入射される前記非可視光に基づく光により得られた撮像信号から、前記指示物の位置に基づく入力操作を検出すると共にその検出結果に応じて特定の機能を実行可能に構成された

投射型表示装置。 - 前記投射レンズの略焦点距離の位置またはこれと光学的に共役の関係となる位置において、

前記ライトバルブの有効エリアに対応する面形状は、第1の矩形状であり、

前記撮像素子の有効エリアに対応する面形状は、前記第1の矩形状と中心位置が略同一で、かつ前記第1の矩形状よりも大きな第2の矩形状である

請求項1に記載の投射型表示装置。 - 前記投影面上に、

投影エリアに対応する第1の検出エリアと、

前記投影エリアの周辺部に対応する第2の検出エリアと

を形成可能に構成された

請求項2に記載の投射型表示装置。 - 前記第2の検出エリアは、それぞれが前記入力操作に対応づけられた1または複数のチャンネル領域または位置座標を有する

請求項3に記載の投射型表示装置。 - 前記投影エリアの矩形状の4辺のそれぞれに対向して、前記チャンネル領域が1つ以上設けられている

請求項4に記載の投射型表示装置。 - 前記複数のチャンネル領域のうちの1のチャンネル領域において、一定時間内に複数回にわたって物体が検出された場合に、前記機能を実行する

請求項4または請求項5に記載の投射型表示装置。 - 前記複数のチャンネル領域のうちの1のチャンネル領域において、一定時間にわたって連続的に物体が検出された場合に、前記機能を実行する

請求項4または請求項5に記載の投射型表示装置。 - 前記複数のチャンネル領域のうちの1のチャンネル領域において物体が検出された後、一定時間内に他のチャンネル領域において物体が検出された場合に、前記機能を実行する

請求項4または請求項5に記載の投射型表示装置。 - 前記複数のチャンネル領域のうちの異なる2以上のチャンネル領域において、同時に物体が検出された場合に、前記機能を実行する

請求項4または請求項5に記載の投射型表示装置。 - 前記複数のチャンネル領域のうちの1のチャンネル領域と、前記第1の検出エリア内の選択的な領域とにおいて同時に物体が検出された場合に、前記機能を実行する

請求項4または請求項5に記載の投射型表示装置。 - 前記第1の検出エリアは、前記投影エリアのうちの選択的な映像表示エリアの周辺に、それぞれが前記入力操作に対応づけられた1または複数のチャンネル領域を有する

請求項3に記載の投射型表示装置。 - 前記投射レンズは、短焦点レンズである

請求項1ないし請求項11のいずれか1項に記載の投射型表示装置。 - 前記非可視光を出射する前記光源部が外筐に設けられている

請求項1ないし請求項12のいずれか1項に記載の投射型表示装置。 - 前記非可視光は、近赤外光である

請求項1ないし請求項13のいずれか1項に記載の投射型表示装置。 - 前記偏光分離素子は、偏光ビームスプリッタである

請求項1ないし請求項14のいずれか1項に記載の投射型表示装置。 - 前記ライトバルブは、反射型液晶表示素子である

請求項1ないし請求項15のいずれか1項に記載の投射型表示装置。 - 前記偏光分離素子は、それぞれが光入射面または光出射面となる第1ないし第4の面を有すると共に、前記第1の面から入射した光のうちの前記第1の偏光成分を前記第2の面から出射し、前記第1の面から入射した光のうちの前記第2の偏光成分を前記第3の面から出射し、前記第2の面から入射した光のうちの前記第2の偏光成分を前記第4の面から出射し、かつ、前記第4の面から入射した光のうちの前記第1の偏光成分を前記第3の面から出射する、ように構成されている

請求項16に記載の投射型表示装置。 - 前記投影光学系は、

前記照明部が、前記照明光を前記偏光分離素子の前記第1の面に向けて出射し、

前記ライトバルブが、前記照明光のうち、前記偏光分離素子の前記第2の面から出射した前記第1の偏光成分を変調し、その変調光を、前記偏光分離素子の前記第2の面に向けて出射し、

前記投射レンズが、前記変調光のうち、前記偏光分離素子の前記第4の面から出射した光を、前記投影面に向けて投射する、ように構成されている

請求項17に記載の投射型表示装置。 - 前記検出光学系は、

縮小光学系に、前記投射レンズと前記偏光分離素子の前記第4の面および前記第3の面とを介して物体検出用の光が入射され、

前記撮像素子に、前記縮小光学系から出射された光が入射する、ように構成されている

請求項18に記載の投射型表示装置。 - 投射レンズと、照明光を映像信号に基づいて変調して前記投射レンズへ向けて出射するライトバルブと、前記ライトバルブと前記投射レンズとの間に配置された偏光分離素子と、前記ライトバルブと光学的に共役な位置に配置されると共に非可視光を受光する撮像素子と、前記投射レンズの下方に配置され、非可視光を出射する光源部とを備えた光学系により撮像信号を取得し、

前記撮像素子には、前記映像信号に基づいて前記投射レンズから投射される投影面に平行に照射された前記非可視光に基づく光が、前記投射レンズと前記偏光分離素子とを介して入射し、

前記撮像素子に入射される前記非可視光に基づく光は、前記光源部から出射された前記非可視光が前記投影面内に存在する指示物にあたり反射された光であり、

前記撮像信号から、前記指示物の位置に基づく入力操作の有無を判定し、

その判定結果に基づいて特定の機能を実行するように制御する

機能制御方法。

Priority Applications (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2014182976A JP6372266B2 (ja) | 2014-09-09 | 2014-09-09 | 投射型表示装置および機能制御方法 |

| EP15767337.7A EP3227766B1 (en) | 2014-09-09 | 2015-08-28 | Projection display unit and function control method |

| US15/502,231 US11054944B2 (en) | 2014-09-09 | 2015-08-28 | Projection display unit and function control method |

| PCT/JP2015/004369 WO2016038839A1 (en) | 2014-09-09 | 2015-08-28 | Projection display unit and function control method |

| CN201580041613.2A CN106716318B (zh) | 2014-09-09 | 2015-08-28 | 投影显示单元和功能控制方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2014182976A JP6372266B2 (ja) | 2014-09-09 | 2014-09-09 | 投射型表示装置および機能制御方法 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2016057426A JP2016057426A (ja) | 2016-04-21 |

| JP2016057426A5 JP2016057426A5 (ja) | 2017-03-16 |

| JP6372266B2 true JP6372266B2 (ja) | 2018-08-15 |

Family

ID=54151362

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2014182976A Active JP6372266B2 (ja) | 2014-09-09 | 2014-09-09 | 投射型表示装置および機能制御方法 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US11054944B2 (ja) |

| EP (1) | EP3227766B1 (ja) |

| JP (1) | JP6372266B2 (ja) |

| CN (1) | CN106716318B (ja) |

| WO (1) | WO2016038839A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11755152B2 (en) | 2017-03-23 | 2023-09-12 | Sony Corporation | Projector with detection function for stabilizing intensity distribution of an irradiation beam |

Families Citing this family (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN110058476B (zh) * | 2014-07-29 | 2022-05-27 | 索尼公司 | 投影型显示装置 |

| JP6669068B2 (ja) * | 2014-08-27 | 2020-03-18 | ソニー株式会社 | 投射型表示装置 |

| JP7143840B2 (ja) * | 2017-03-23 | 2022-09-29 | ソニーグループ株式会社 | ビーム照射装置、および検出機能付きプロジェクタ |

| JP6972609B2 (ja) * | 2017-03-28 | 2021-11-24 | セイコーエプソン株式会社 | 光射出装置および画像表示システム |

| JP6919266B2 (ja) * | 2017-03-28 | 2021-08-18 | セイコーエプソン株式会社 | 光射出装置および画像表示システム |

| KR101941369B1 (ko) * | 2017-06-24 | 2019-01-23 | 주식회사 카피모션 | 광학식 모션 트랙킹 센서 |

| CN107562316B (zh) * | 2017-08-29 | 2019-02-05 | Oppo广东移动通信有限公司 | 界面展示方法、装置及终端 |

| CN107577377A (zh) * | 2017-09-26 | 2018-01-12 | 哈尔滨工业大学 | 基于视觉和红外技术的触摸信号采集装置 |

| JP2019174513A (ja) * | 2018-03-27 | 2019-10-10 | セイコーエプソン株式会社 | 表示装置、及び、表示装置の制御方法 |

| US11835696B2 (en) | 2018-04-09 | 2023-12-05 | Sony Corporation | Optical system and projector |

| CN108762483B (zh) * | 2018-04-16 | 2021-02-09 | 广景视睿科技(深圳)有限公司 | 一种互动投影仪及互动投影方法 |

| JP7087828B2 (ja) * | 2018-08-27 | 2022-06-21 | セイコーエプソン株式会社 | 光学素子、光射出装置および画像表示システム |

| WO2020261850A1 (ja) * | 2019-06-28 | 2020-12-30 | 富士フイルム株式会社 | 投影装置 |

| CN111123625B (zh) * | 2019-12-13 | 2021-05-18 | 成都极米科技股份有限公司 | 投影仪及投影方法 |

| JP2022059236A (ja) * | 2020-10-01 | 2022-04-13 | セイコーエプソン株式会社 | 投写システム、および、什器 |

| KR20220091195A (ko) * | 2020-12-23 | 2022-06-30 | 현대모비스 주식회사 | 차량의 입력 장치 및 방법 |

Family Cites Families (53)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3278350B2 (ja) | 1996-05-15 | 2002-04-30 | シャープ株式会社 | 投影表示装置 |

| JP3832132B2 (ja) * | 1999-03-11 | 2006-10-11 | セイコーエプソン株式会社 | 表示システム、及びプレゼンテーションシステム |

| JP4620909B2 (ja) | 2001-07-26 | 2011-01-26 | 日東光学株式会社 | 画像入出力装置 |

| US20030226968A1 (en) * | 2002-06-10 | 2003-12-11 | Steve Montellese | Apparatus and method for inputting data |

| JP4175070B2 (ja) | 2002-10-03 | 2008-11-05 | セイコーエプソン株式会社 | 画像入出力装置、マンマシンインターフェイスシステムおよびプログラム |

| US6840627B2 (en) | 2003-01-21 | 2005-01-11 | Hewlett-Packard Development Company, L.P. | Interactive display device |

| US20050168448A1 (en) * | 2004-01-30 | 2005-08-04 | Simpson Zachary B. | Interactive touch-screen using infrared illuminators |

| JP2006065558A (ja) * | 2004-08-26 | 2006-03-09 | Canon Inc | 入力表示装置 |

| US8648805B2 (en) * | 2004-11-05 | 2014-02-11 | Ftm Computer Products | Fingertip mouse and base |

| CN2802536Y (zh) * | 2005-06-27 | 2006-08-02 | 广东威创日新电子有限公司 | 一种用于交互式投影显示的光学装置 |

| JP2007052218A (ja) | 2005-08-18 | 2007-03-01 | Nikon Corp | 撮像機能付きプロジェクタ |

| TWI292052B (en) | 2006-05-09 | 2008-01-01 | Young Optics Inc | Optical projection and image detection apparatus |

| JP2008257125A (ja) | 2007-04-09 | 2008-10-23 | Seiko Epson Corp | プロジェクションシステム、形状測定装置、および光学特性評価装置 |

| JP2010538685A (ja) * | 2007-07-17 | 2010-12-16 | エクスプレイ・リミテッド | 光学投影方法及びシステム |

| JP2009047819A (ja) | 2007-08-17 | 2009-03-05 | Sony Corp | 偏光ビームスプリッタ、投写型光学装置、投写型表示装置 |

| JP5277703B2 (ja) * | 2008-04-21 | 2013-08-28 | 株式会社リコー | 電子機器 |

| US7738190B2 (en) | 2008-09-27 | 2010-06-15 | Meistream International Optical Ltd. | Optical engine and wide angle projection lens module thereof |

| JP5199016B2 (ja) | 2008-10-10 | 2013-05-15 | 富士フイルム株式会社 | 単板投写型表示装置 |

| US8144269B2 (en) * | 2009-01-08 | 2012-03-27 | Micron Technology, Inc. | Reflective LCOS displays utilizing novel polarizing beam splitters |

| CN101943843B (zh) | 2009-05-22 | 2012-03-07 | 上海丽恒光微电子科技有限公司 | 集成微型显示投影及成像系统 |

| JP5471266B2 (ja) * | 2009-10-07 | 2014-04-16 | セイコーエプソン株式会社 | 位置検出機能付き投射型表示装置 |

| CN101776836B (zh) * | 2009-12-28 | 2013-08-07 | 武汉全真光电科技有限公司 | 投影显示系统及桌面计算机 |

| US9110495B2 (en) * | 2010-02-03 | 2015-08-18 | Microsoft Technology Licensing, Llc | Combined surface user interface |

| JP2011209531A (ja) * | 2010-03-30 | 2011-10-20 | Seiko Epson Corp | プロジェクター |

| US8434873B2 (en) | 2010-03-31 | 2013-05-07 | Hong Kong Applied Science and Technology Research Institute Company Limited | Interactive projection device |

| KR20110121125A (ko) * | 2010-04-30 | 2011-11-07 | 삼성전자주식회사 | 인터랙티브 디스플레이 장치 및 이의 동작 방법 |

| US8542218B2 (en) * | 2010-08-19 | 2013-09-24 | Hyundai Motor Company | Electronic switch apparatus for vehicle |

| JP5710929B2 (ja) | 2010-10-08 | 2015-04-30 | 船井電機株式会社 | プロジェクタ |

| GB2486445B (en) * | 2010-12-14 | 2013-08-14 | Epson Norway Res And Dev As | Camera-based multi-touch interaction apparatus system and method |

| WO2012120958A1 (ja) | 2011-03-04 | 2012-09-13 | 株式会社ニコン | 投影装置 |

| CN102156593B (zh) * | 2011-04-13 | 2013-01-16 | 中国科学院深圳先进技术研究院 | 光学触摸屏及光学触摸屏的触摸定位方法 |

| JP2012256000A (ja) * | 2011-06-10 | 2012-12-27 | Sanyo Electric Co Ltd | 投写型映像表示装置 |

| KR101773988B1 (ko) * | 2011-07-29 | 2017-09-01 | 휴렛-팩커드 디벨롭먼트 컴퍼니, 엘.피. | 시각적 계층화 시스템 및 시각적 계층화 방법 |

| JP2013061598A (ja) * | 2011-09-15 | 2013-04-04 | Funai Electric Co Ltd | プロジェクタおよびプロジェクタ機能を有する電子機器 |

| JP2013120586A (ja) | 2011-12-09 | 2013-06-17 | Nikon Corp | プロジェクタ |

| JP2013168922A (ja) | 2012-01-18 | 2013-08-29 | Sony Corp | 投影型画像表示装置及び画像投影方法、並びにコンピューター・プログラム |

| US20140362052A1 (en) * | 2012-01-20 | 2014-12-11 | Light Blue Optics Ltd | Touch Sensitive Image Display Devices |

| US9105211B2 (en) * | 2012-03-13 | 2015-08-11 | Samsung Electronics Co., Ltd | Portable projector and image projecting method thereof |

| US20130257811A1 (en) * | 2012-03-29 | 2013-10-03 | Hitachi Solutions, Ltd. | Interactive display device |

| JP2013228607A (ja) * | 2012-04-26 | 2013-11-07 | Sony Corp | 表示装置および照明装置 |

| JP5895703B2 (ja) * | 2012-05-22 | 2016-03-30 | ソニー株式会社 | 画像処理装置及び画像処理方法、並びにコンピューター・プログラム |

| US20130342458A1 (en) * | 2012-06-23 | 2013-12-26 | VillageTech Solutions | Methods and systems for input to an interactive audiovisual device |

| US9317109B2 (en) * | 2012-07-12 | 2016-04-19 | Mep Tech, Inc. | Interactive image projection accessory |

| JP2014081510A (ja) * | 2012-10-17 | 2014-05-08 | Sony Corp | 表示装置 |

| JP2014092715A (ja) * | 2012-11-05 | 2014-05-19 | Toshiba Corp | 電子機器、情報処理方法及びプログラム |

| US20140267031A1 (en) * | 2013-03-12 | 2014-09-18 | Kenneth J. Huebner | Spatially aware pointer for mobile appliances |

| US20160021351A1 (en) | 2013-03-14 | 2016-01-21 | Nittoh Kogaku K.K. | Optical system and device having optical system |

| JP6128008B2 (ja) | 2013-08-26 | 2017-05-17 | ソニー株式会社 | 投射型表示装置 |

| US10114512B2 (en) * | 2013-09-30 | 2018-10-30 | Hewlett-Packard Development Company, L.P. | Projection system manager |

| JP6413236B2 (ja) * | 2013-12-20 | 2018-10-31 | セイコーエプソン株式会社 | プロジェクター、プロジェクションシステム、及び、プロジェクターの制御方法 |

| JP6303545B2 (ja) * | 2014-01-29 | 2018-04-04 | 株式会社リコー | 計測装置、投影装置、計測方法、及びプログラム |

| CN110058476B (zh) * | 2014-07-29 | 2022-05-27 | 索尼公司 | 投影型显示装置 |

| JP6669068B2 (ja) | 2014-08-27 | 2020-03-18 | ソニー株式会社 | 投射型表示装置 |

-

2014

- 2014-09-09 JP JP2014182976A patent/JP6372266B2/ja active Active

-

2015

- 2015-08-28 CN CN201580041613.2A patent/CN106716318B/zh active Active

- 2015-08-28 EP EP15767337.7A patent/EP3227766B1/en active Active

- 2015-08-28 US US15/502,231 patent/US11054944B2/en active Active

- 2015-08-28 WO PCT/JP2015/004369 patent/WO2016038839A1/en active Application Filing

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11755152B2 (en) | 2017-03-23 | 2023-09-12 | Sony Corporation | Projector with detection function for stabilizing intensity distribution of an irradiation beam |

Also Published As

| Publication number | Publication date |

|---|---|

| US11054944B2 (en) | 2021-07-06 |

| WO2016038839A1 (en) | 2016-03-17 |

| JP2016057426A (ja) | 2016-04-21 |

| US20170228057A1 (en) | 2017-08-10 |

| CN106716318B (zh) | 2020-03-03 |

| CN106716318A (zh) | 2017-05-24 |

| EP3227766B1 (en) | 2022-05-11 |

| EP3227766A1 (en) | 2017-10-11 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6372266B2 (ja) | 投射型表示装置および機能制御方法 | |

| JP6597615B2 (ja) | 投射型表示装置 | |

| KR101410387B1 (ko) | 프로젝션 디스플레이 시스템 및 테이블 컴퓨터 | |

| JP2016057426A5 (ja) | ||

| US10171780B2 (en) | Lighting apparatus | |

| US8775958B2 (en) | Assigning Z-order to user interface elements | |

| EP2740259A1 (en) | Portable projection capture device | |

| JP6597625B2 (ja) | 投射型表示装置 | |

| US10805586B2 (en) | Projection display unit with detection function | |

| TWI470511B (zh) | 雙模輸入裝置 | |

| JP6669068B2 (ja) | 投射型表示装置 | |

| WO2018051886A1 (ja) | 検出機能付き表示装置 | |

| US20170329459A1 (en) | Projection display unit | |

| JP4961891B2 (ja) | 対話型リアープロジェクションテレビシステム | |

| KR100978437B1 (ko) | 멀티터치 제어시스템 및 제어방법 | |

| TWI611211B (zh) | 用於可攜式裝置之頭戴式顯示器 | |

| JP2011186704A (ja) | 位置検出ユニット及び位置検出システム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20170206 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20170206 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20171122 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20171205 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20180201 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20180619 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20180702 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 6372266 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |