WO2019103052A1 - 投影装置 - Google Patents

投影装置 Download PDFInfo

- Publication number

- WO2019103052A1 WO2019103052A1 PCT/JP2018/043036 JP2018043036W WO2019103052A1 WO 2019103052 A1 WO2019103052 A1 WO 2019103052A1 JP 2018043036 W JP2018043036 W JP 2018043036W WO 2019103052 A1 WO2019103052 A1 WO 2019103052A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- light

- projection

- image

- imaging

- visible

- Prior art date

Links

- 238000003384 imaging method Methods 0.000 claims abstract description 100

- 230000003287 optical effect Effects 0.000 claims abstract description 90

- 230000005284 excitation Effects 0.000 claims description 27

- 238000002834 transmittance Methods 0.000 claims description 15

- 230000001678 irradiating effect Effects 0.000 claims description 3

- 239000012466 permeate Substances 0.000 claims 1

- 238000001356 surgical procedure Methods 0.000 description 56

- 230000006870 function Effects 0.000 description 16

- 238000010586 diagram Methods 0.000 description 9

- MOFVSTNWEDAEEK-UHFFFAOYSA-M indocyanine green Chemical compound [Na+].[O-]S(=O)(=O)CCCCN1C2=CC=C3C=CC=CC3=C2C(C)(C)C1=CC=CC=CC=CC1=[N+](CCCCS([O-])(=O)=O)C2=CC=C(C=CC=C3)C3=C2C1(C)C MOFVSTNWEDAEEK-UHFFFAOYSA-M 0.000 description 7

- 229960004657 indocyanine green Drugs 0.000 description 7

- 239000003504 photosensitizing agent Substances 0.000 description 7

- 238000010276 construction Methods 0.000 description 6

- 238000000034 method Methods 0.000 description 6

- 239000000428 dust Substances 0.000 description 5

- 238000005516 engineering process Methods 0.000 description 4

- 239000000463 material Substances 0.000 description 4

- 238000007792 addition Methods 0.000 description 3

- 230000008859 change Effects 0.000 description 3

- 230000007246 mechanism Effects 0.000 description 3

- 238000005065 mining Methods 0.000 description 3

- 238000012634 optical imaging Methods 0.000 description 3

- 239000011248 coating agent Substances 0.000 description 2

- 238000000576 coating method Methods 0.000 description 2

- 239000003086 colorant Substances 0.000 description 2

- 238000002073 fluorescence micrograph Methods 0.000 description 2

- 230000008569 process Effects 0.000 description 2

- 230000004044 response Effects 0.000 description 2

- 239000000126 substance Substances 0.000 description 2

- 239000008280 blood Substances 0.000 description 1

- 210000004369 blood Anatomy 0.000 description 1

- 238000006243 chemical reaction Methods 0.000 description 1

- 230000004907 flux Effects 0.000 description 1

- 238000005286 illumination Methods 0.000 description 1

- 238000010348 incorporation Methods 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 210000002751 lymph Anatomy 0.000 description 1

- NJPPVKZQTLUDBO-UHFFFAOYSA-N novaluron Chemical compound C1=C(Cl)C(OC(F)(F)C(OC(F)(F)F)F)=CC=C1NC(=O)NC(=O)C1=C(F)C=CC=C1F NJPPVKZQTLUDBO-UHFFFAOYSA-N 0.000 description 1

- 239000003973 paint Substances 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 231100000241 scar Toxicity 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

Images

Classifications

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B90/361—Image-producing devices, e.g. surgical cameras

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/12—Picture reproducers

- H04N9/31—Projection devices for colour picture display, e.g. using electronic spatial light modulators [ESLM]

- H04N9/3141—Constructional details thereof

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B34/00—Computer-aided surgery; Manipulators or robots specially adapted for use in surgery

- A61B34/20—Surgical navigation systems; Devices for tracking or guiding surgical instruments, e.g. for frameless stereotaxis

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/30—Devices for illuminating a surgical field, the devices having an interrelation with other surgical devices or with a surgical procedure

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B90/37—Surgical systems with images on a monitor during operation

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B27/00—Optical systems or apparatus not provided for by any of the groups G02B1/00 - G02B26/00, G02B30/00

- G02B27/10—Beam splitting or combining systems

- G02B27/14—Beam splitting or combining systems operating by reflection only

- G02B27/141—Beam splitting or combining systems operating by reflection only using dichroic mirrors

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B5/00—Optical elements other than lenses

- G02B5/003—Light absorbing elements

-

- G—PHYSICS

- G03—PHOTOGRAPHY; CINEMATOGRAPHY; ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ELECTROGRAPHY; HOLOGRAPHY

- G03B—APPARATUS OR ARRANGEMENTS FOR TAKING PHOTOGRAPHS OR FOR PROJECTING OR VIEWING THEM; APPARATUS OR ARRANGEMENTS EMPLOYING ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ACCESSORIES THEREFOR

- G03B21/00—Projectors or projection-type viewers; Accessories therefor

-

- G—PHYSICS

- G03—PHOTOGRAPHY; CINEMATOGRAPHY; ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ELECTROGRAPHY; HOLOGRAPHY

- G03B—APPARATUS OR ARRANGEMENTS FOR TAKING PHOTOGRAPHS OR FOR PROJECTING OR VIEWING THEM; APPARATUS OR ARRANGEMENTS EMPLOYING ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ACCESSORIES THEREFOR

- G03B9/00—Exposure-making shutters; Diaphragms

- G03B9/02—Diaphragms

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/20—Cameras or camera modules comprising electronic image sensors; Control thereof for generating image signals from infrared radiation only

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/30—Transforming light or analogous information into electric information

- H04N5/33—Transforming infrared radiation

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B90/361—Image-producing devices, e.g. surgical cameras

- A61B2090/3614—Image-producing devices, e.g. surgical cameras using optical fibre

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B2090/364—Correlation of different images or relation of image positions in respect to the body

- A61B2090/366—Correlation of different images or relation of image positions in respect to the body using projection of images directly onto the body

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B90/00—Instruments, implements or accessories specially adapted for surgery or diagnosis and not covered by any of the groups A61B1/00 - A61B50/00, e.g. for luxation treatment or for protecting wound edges

- A61B90/36—Image-producing devices or illumination devices not otherwise provided for

- A61B90/37—Surgical systems with images on a monitor during operation

- A61B2090/373—Surgical systems with images on a monitor during operation using light, e.g. by using optical scanners

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/0059—Measuring for diagnostic purposes; Identification of persons using light, e.g. diagnosis by transillumination, diascopy, fluorescence

- A61B5/0071—Measuring for diagnostic purposes; Identification of persons using light, e.g. diagnosis by transillumination, diascopy, fluorescence by measuring fluorescence emission

Definitions

- the present disclosure relates to a projection apparatus that projects an image based on a captured image of a subject.

- Patent Document 1 discloses an optical imaging system used in the medical field.

- the optical imaging system of Patent Document 1 includes an electronic imaging device for imaging a surgical field, a projector for projecting a visible light image of an imaging result of a surgical field during surgery, an optical axis of the electronic imaging device and the projector, and the same optical axis. And an optical element aligned with the The optical imaging system captures a fluorescent image of a surgical field in an electronic imaging device, and projects a projection image for visualizing a fluorescent image of an imaging result from a projector.

- An object of the present disclosure is to provide a projection device capable of performing imaging with visible light with high accuracy when projecting a projected image of visible light based on a captured image of non-visible light.

- the projection apparatus in the present disclosure includes an invisible imaging unit, a projection unit, a visible imaging unit, an imaging optical system, a light guiding unit, and a light shielding unit.

- the non-visible imaging unit captures a non-visible light image of a subject in non-visible light.

- the projection unit projects a projection image based on the non-visible light image onto the subject with visible light.

- the visible imaging unit captures an object on which a projection image is projected in visible light.

- the imaging optical system includes an invisible imaging unit and an aperture that adjusts the amount of light collected on the visible imaging unit.

- the light guiding unit guides light entering the imaging optical system and also guides light exiting from the projection unit.

- the light shielding portion is disposed spaced from the light guiding portion.

- the distance between the optical distance from the near point of the depth of field to the imaging optical system and the optical distance from the light shielding portion to the imaging optical system is set so that the distance difference of the distance .alpha.

- the projection apparatus in the present disclosure when the projected image of visible light based on the captured image of non-visible light is projected, imaging with visible light can be performed with high accuracy by setting the aperture.

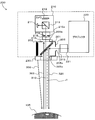

- FIG. 1 Schematic diagram showing the configuration of the surgery support system according to the first embodiment

- Block diagram showing the configuration of the imaging and irradiator in the surgery support system

- Flow chart for explaining the projection operation in the surgery support system Diagram illustrating the condition of the surgical field before projection in the surgery support system Diagram illustrating the condition of the operative field at the time of projection in the surgery support system Diagram for explaining the optical path of visible light in the surgery support system Diagram for explaining the optical distance of light incident on the imaging and irradiation device Diagram for explaining multiple images in the surgery support system

- Embodiment 1 A surgery support system will be described as a specific example of a projection system provided with a projection device according to the present disclosure.

- FIG. 1 is a schematic view showing the configuration of a surgery support system 100 according to the first embodiment.

- the surgery support system 100 includes a camera 210, a projector 220 and an excitation light source 230.

- the surgery support system 100 is a system that visually supports surgery performed by a doctor or the like on a patient in an operating room or the like using a projection image. In the case of using the surgery support system 100, a light sensitive substance is previously administered to the patient 120 who is to undergo surgery.

- a photosensitizer is a substance that emits fluorescence in response to excitation light.

- a photosensitizer ICG (indocyanine green) etc. are used, for example.

- ICG indocyanine green

- the ICG emits fluorescence in the infrared region of wavelengths 800 to 860 nm by being irradiated with excitation light in the infrared region near wavelengths of 760 to 780 nm.

- the photosensitizer When administered to a patient 120, the photosensitizer accumulates in the affected area 130 where blood or lymph flow is stagnant. For this reason, it becomes possible to specify the area of the affected area 130 by detecting the area that emits fluorescence in response to the irradiation of the excitation light.

- the doctor or the like looks at the region of the affected region 130 even when viewing the operation area. It is difficult to identify. Therefore, in the surgery support system 100, the area of the affected part 130 that emits the fluorescence 310 is specified using the camera 210. Furthermore, the projector 220 emits the projection light 320 of visible light to the affected area 130 so that the identified affected area 130 can be viewed by a human. As a result, a projection image for visualizing the identified area of the affected area 130 is projected, and identification of the area of the affected area 130 by a doctor or the like who performs an operation can be supported.

- the surgery support system 100 is disposed and used in an operating room of a hospital.

- the surgery support system 100 includes an imaging and irradiation apparatus 200, a memory 240, and a projection control apparatus 250.

- the surgery support system 100 includes a mechanism for changing the arrangement of the imaging and irradiation apparatus 200, for example, a drive arm mechanically connected to the imaging and irradiation apparatus 200, and a set of the surgery support system 100. It has a caster on a pedestal on which to place the

- the imaging irradiation apparatus 200 is disposed vertically above the operating table 110 on which the patient 120 is placed or at an angle from the vertical direction.

- the operating table 110 may be provided with a drive mechanism capable of changing its height and direction.

- the imaging and irradiation apparatus 200 is an example of a projection apparatus in which the camera 210, the projector 220, and the excitation light source 230 are integrally assembled together with the dichroic mirror 201. Details of the configuration of the imaging and irradiating apparatus 200 will be described later.

- the memory 240 is a storage medium that is appropriately accessed when the projection control device 250 executes various operations.

- the memory 240 is configured of, for example, a ROM and a RAM.

- the memory 240 is an example of a storage unit in the present embodiment.

- the projection control device 250 generally controls each part constituting the surgery support system 100.

- the projection control device 250 is electrically connected to the camera 210, the projector 220, the excitation light source 230, and the memory 240, and outputs control signals for controlling the respective units.

- the projection control device 250 is constituted by, for example, a CPU, and realizes its function by executing a predetermined program.

- the function of the projection control device 250 may be realized by a specially designed electronic circuit or a reconfigurable electronic circuit (FPGA, ASIC or the like).

- the projection control device 250 performs various types of image processing on an image captured by the camera 210 to generate a video signal (image data) indicating a projection image.

- the projection control device 250 is an example of an image generation unit in the present disclosure.

- the surgery support system 100 includes a display control device 150, a monitor 160, and a mouse 170.

- the display control device 150 is configured of, for example, a PC (personal computer), and is connected to the projection control device 250.

- the display control device 150 includes, for example, a CPU, and performs image processing or the like for generating an image to be displayed on the monitor 160.

- the display control device 150 is an example of an image generation unit in the present disclosure.

- the display control device 150 also includes an internal memory (ROM, RAM, etc.) which is an example of a storage unit in the present disclosure.

- the monitor 160 is configured of, for example, a liquid crystal display or an organic EL display, and has a display surface on which an image is displayed.

- the monitor 160 is an example of the display unit in the present disclosure.

- the mouse 170 is used by the user to input an operation to the display control device 150.

- the mouse 170 is an example of the adjustment unit in the present disclosure.

- the surgery support system 100 may include various adjustment units in place of or in addition to the mouse 170, and may include, for example, a keyboard, a touch pad, a touch panel, a button, a switch, and the like.

- An operator 140 (user) of the display control device 150 can check a captured image of the camera 210 on the monitor 160, for example, during surgery.

- the operator 140 can adjust various settings of the projection image (for example, a threshold for the intensity distribution of fluorescence).

- FIG. 2 is a block diagram showing the configuration of the imaging and irradiation apparatus 200 in the surgery support system.

- the imaging and irradiation apparatus 200 includes an excitation light source 230, a camera 210, a zoom lens 215, an optical filter 216, a projector 220, a teleconversion (telecon) lens 221, a dichroic mirror 201, and a light shielding unit 202.

- the imaging and irradiation apparatus 200 is disposed at a distance (height) to a subject such as the operation field 135, for example, at a position such as 1 m.

- the excitation light source 230 is a light source device that emits excitation light 300 for causing the photosensitizer to emit fluorescence.

- the excitation light source 230 since ICG is used as the photosensitizer, the excitation light source 230 emits excitation light 300 having a wavelength band (for example, around 760 to 780 nm) including the excitation wavelength of ICG.

- the excitation light source 230 is an example of the illumination unit in the present embodiment.

- the excitation light source 230 switches ON / OFF of the irradiation of the excitation light 300 in accordance with the control signal from the projection control device 250.

- the excitation light source 230 may be configured separately from the imaging and irradiation apparatus 200.

- the camera 210 captures an object including the surgical field 135 of the patient 120 and the like to generate a captured image.

- the camera 210 transmits image data indicating the generated captured image to the projection control device 250.

- the camera 210 includes an IR sensor 211, an RGB sensor 212, and a prism 213.

- the IR sensor 211 performs imaging in infrared light (an example of invisible light) including a wavelength band of 800 to 860 nm of fluorescence of ICG, and generates an invisible light image as a captured image.

- the IR sensor 211 is configured of, for example, a CMOS image sensor or a CCD image sensor.

- the IR sensor 211 includes a filter that blocks light other than infrared light.

- the IR sensor 211 is an example of the invisible imaging unit in the present embodiment.

- the RGB sensor 212 is configured of, for example, a CMOS image sensor or a CCD image sensor provided with RGB color filters for each pixel.

- the RGB sensor 212 captures an image of visible light and generates visible light images of multiple colors (RGB).

- the RGB sensor 212 is an example of a visible imaging unit in the present embodiment.

- the visible imaging unit is not limited to the RGB sensor 212, and may be, for example, a monochrome image sensor.

- the prism 213 transmits visible light components and reflects infrared light components in incident light. As shown in FIG. 2, the prism 213 is disposed between the zoom lens 215 and the RGB sensor 212. Further, an IR sensor 211 is disposed on the reflective surface side of the prism 213.

- the prism 213 is an example of an internal optical system provided inside the camera 210. The internal optical system of the camera 210 is not limited to the prism 213. For example, an optical path length adjustment member may be disposed between the IR sensor 211 and / or the RGB sensor 212 and the prism 213.

- the zoom lens 215 is attached to the camera 210 and condenses external light inside the camera 210.

- the zoom lens 215 adjusts the angle of view (zoom value) of the camera 210, the depth of field, the focus, and the like.

- the zoom lens 215 includes various lens elements including a lens 215a, and an aperture 214.

- the aperture 214 is, for example, an aperture stop.

- the aperture 214 adjusts the amount of light collected by the zoom lens 215 according to an aperture value (for example, an F value) indicating the degree of aperture.

- the zoom value by the zoom lens 215, the aperture value (F value) of the diaphragm 214, and the like can be set from the outside, for example.

- the zoom lens 215 is an example of the imaging optical system in the present embodiment.

- the imaging optical system is not limited to the zoom lens 215, and may include, for example, an internal optical system of the camera 210 and various external optical elements, or may be incorporated in the camera 210 as an internal optical system.

- the optical filter 216 is disposed on the incident surface of the zoom lens 215, for example, as shown in FIG.

- the optical filter 216 is configured of a band cut filter that cuts off a wavelength band component of 680 to 825 nm including the wavelength of 760 to 780 nm of the excitation light in incident light.

- the projector 220 is, for example, a projector such as a DLP method, a 3 LCD method, or an LCOS method.

- the projector 220 emits the projection light 315 so that the projection image based on the video signal input from the projection control device 250 is projected as visible light.

- the projector 220 is an example of a projection unit in the present embodiment.

- the projector 220 includes, for example, a light source, an image forming unit, and an internal optical system.

- the light source of the projector 220 is configured by, for example, an LD (semiconductor laser) or an LED.

- the image forming unit of the projector 220 includes a spatial light modulator such as a DMD or an LCD, and forms an image based on the video signal from the projection control device 250 on the image forming surface of the spatial light modulator.

- the projector 220 spatially modulates the light from the light source according to the formed image to generate the projection light 315 and emits it from the internal optical system.

- the projector 220 may have a projection control circuit that implements functions specific to the projector 220, such as, for example, keystone correction and lens shift functions. Also, each function described above may be realized in the projection control device 250.

- the projector 220 may be of a laser scanning type, and may be configured to include a MEMS mirror or a galvano mirror that can be driven in the scanning direction.

- Telecon lens 221 is arranged to be optically coupled to the internal optical system of projector 220.

- the telecon lens 221 extends the focal length of the projector 220 to the telephoto side.

- Various optical elements may be disposed in the optical path from the projector 220 to the dichroic mirror 201 in addition to or in place of the telecon lens 221.

- the dichroic mirror 201 is an example of a light guide having an optical characteristic of transmitting or reflecting light which is selectively incident according to a wavelength band of light.

- the transmittance of infrared light is set to 100% and the reflectance is set to 0% within the range of tolerance.

- the dichroic mirror 201 is set to have the reflectance and the transmittance of the visible light so as to transmit the visible light within a range smaller than the reflectance of the visible light.

- the visible light transmittance of the dichroic mirror 201 is preferably 5% or less, for example, the visible light reflectance (hereinafter referred to as “R1”) of the dichroic mirror 201 is 99%, and the visible light transmittance (hereinafter It is assumed that T1 ′ ′ is 1%.

- the visible light that can be imaged by the RGB sensor 212 by the dichroic mirror 201 is 5% or less.

- the dichroic mirror 201 in order to make it 5% or less, not only the dichroic mirror 201 but a member on the optical path of imaging may be combined and realized, for example, in addition to the dichroic mirror 201, the optical filter 216, the prism 213, etc.

- a filter may be provided to make the total 5% or less.

- the dichroic mirror 201 has two main surfaces facing each other at a thickness of 5 mm or less, for example. As shown in FIG. 2, the dichroic mirror 201 is fixed, for example, inside the housing 205 so that the main surfaces thereof are directed to the telecon lens 221 on the projector 220 side and the zoom lens 215 on the camera 210 side. In the housing 205, a light guide hole 205a for the projector 220, a light guide hole 205b for the camera 210, and a light guide hole 205c for the outside are provided. In the dichroic mirror 201, for example, an AR (anti-reflection) coating is applied to the main surface on the opposite side to the projector 220 side (details will be described later).

- an AR anti-reflection

- the dichroic mirror 201 transmits the fluorescence 310 and the like directed to the camera 210 through the zoom lens 215 and the like due to the above optical characteristics, while the majority of the projection light 315 irradiated from the projector 220 (half Or more).

- the reflected projection light 320 is irradiated onto the operating field 135.

- the dichroic mirror 201 has an optical axis of incident light incident on the camera 210 such as the fluorescence 310 from the operation field 135, and an optical axis of the projection light 320 projecting the projection image on the operation field 135 The light is guided to coincide with the optical axis J1. Thereby, the positional deviation of the projection image based on the captured image of the camera 210 can be reduced.

- a tolerance may be set appropriately for the coincidence of the optical axes in the present disclosure.

- the respective optical axes may coincide with each other within a tolerance of an angle of ⁇ 5 degrees or an optical axis interval of 1 cm.

- the optical characteristics of the dichroic mirror 201 can be set as appropriate according to the fluorescence characteristics of the photosensitizer to be used.

- the light shielding unit 202 is provided on the inner wall of the housing 205 on the side facing the projector 220 via the dichroic mirror 201.

- the light shielding unit 202 is disposed in the vicinity of the dichroic mirror 201 in the housing 205 with a space.

- the light shielding unit 202 shields the dichroic mirror 201 from stray light and the like.

- the light shielding portion 202 is made of, for example, a black member having a visible light reflectance of 3% or less (e.g., 0.5%).

- the black member is made of, for example, a light absorbing film that absorbs incident light, or a blackening treatment film.

- the black member of the light shielding portion 202 may be a sheet member or may be made of a paint.

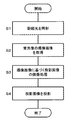

- FIG. 3 is a flowchart for explaining the projection operation in the surgery support system 100.

- FIG. 4A shows the state of the surgical field 135 in the surgery support system 100 before performing the projection operation in the normal mode.

- FIG. 4B shows a state in which the projection operation is performed on the operation field 135 of FIG. 4A.

- the flowchart of FIG. 3 is performed by the projection control device 250.

- the projection control device 250 drives the excitation light source 230 to irradiate the excitation light 300 to the surgical field 135, as shown in FIG. 4A (S1).

- the irradiation of the excitation light 300 causes the affected area 130 in the operation field 135 to emit fluorescence, and the fluorescence 310 from the affected area 130 enters the imaging and irradiation apparatus 200.

- the fluorescence 310 passes through the dichroic mirror 201 and passes through the optical filter 216 of the camera 210, as shown in FIG.

- the camera 210 receives the fluorescence 310 at the IR sensor 211.

- the reflected light 305 of the excitation light 300 is blocked by the optical filter 216.

- the projection control device 250 controls the camera 210, for example, to image the surgical field 135, and acquires a captured image from the camera 210 (S2).

- the captured image acquired in step S2 includes a fluorescence image generated by receiving the fluorescence 310 emitted from the affected area 130.

- the projection control device 250 performs image processing for generating a projection image based on the acquired captured image (S3).

- the projection control device 250 generates an image corresponding to the fluorescent image in the captured image, and outputs it to the projector 220 as a video signal.

- the projection control device 250 binarizes the distribution of the light reception intensity in the captured image based on a predetermined threshold value, and a region considered as a region of a fluorescent image in the captured image Identify Then, the projection control device 250 refers to various parameters stored in the memory 240, and performs coordinate conversion such as shift, rotation, and enlargement / reduction on the image including the specified area, and correction of image distortion and the like. Etc. Thereby, an image representing a specific area corresponding to the fluorescent image in the captured image is generated.

- the projection control device 250 controls the projector 220 to project a projection image based on the generated video signal (S4).

- the projector 220 generates the projection light 315 representing the projection image according to the video signal from the projection control device 250 under the control of the projection control device 250, and emits the projection light 315 to the dichroic mirror 201 via the telecon lens 221. (See Figure 2).

- the dichroic mirror 201 reflects (the majority of) the projection light 315 which is visible light, and emits the projection light 320 along the optical axis J1.

- the imaging irradiation apparatus 200 irradiates the projection light 320 to the operation field 135, and the projection image G320 is projected on the affected part 130 in the operation field 135.

- FIG. The projection image G320 is, for example, a single color image.

- the above process is repeatedly performed in a predetermined cycle (for example, 1/60 to 1/30 seconds).

- the projection control device 250 specifies the area of the diseased part 130 that emits fluorescence based on the image captured by the camera 210, and the projector 220 projects the projected image G320 of visible light onto the diseased part 130.

- the surgery support system 100 it is possible to visualize the affected part 130 which is difficult to visually recognize.

- the surgery support system 100 allows a doctor or the like to visually recognize the real-time state of the affected part 130.

- the projected image G320 has been described as an example of a single color image.

- the projection control device 250 may generate a multi-graded projection image by determining the regions of the fluorescence image in the captured image in multiple stages using, for example, a plurality of threshold values. Also, the projection control device 250 may generate a projection image so as to continuously reproduce the distribution of the light reception intensity in the captured image. Also, the projected image may be generated in multiple colors or full color.

- the surgery support system 100 captures an image of a surgical field or the like in visible light in addition to the imaging of the fluorescent image (S2 in FIG. 3) for generating the projection image as described above. Do.

- the visible imaging function in the surgery support system 100 will be described with reference to FIG.

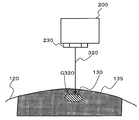

- FIG. 5 is a view for explaining an optical path of visible light in the surgery support system 100.

- the visible light 330 incident on the imaging and irradiation device 200 of the surgery support system 100 includes light in which external light is reflected on a subject 136 such as a surgical field, reflected light of projection light 320, and the like.

- the visible light 330 is incident on the dichroic mirror 201 in the imaging and irradiation apparatus 200.

- the dichroic mirror 201 of the present embodiment transmits a part of the incident visible light 330 and causes the light to enter the zoom lens 215 via the optical filter 216.

- the optical filter 216 of the present embodiment transmits the incident visible light 330 with a predetermined transmittance.

- the zoom lens 215 adjusts the luminous flux of the visible light 330 incident according to the set zoom value and aperture value, and causes the camera 210 to be incident.

- the prism 213 transmits the incident visible light 330.

- the RGB sensor 212 receives visible light 330 transmitted through the prism 213. Thereby, the RGB sensor 212 captures an image of the visible light 330 from the subject 136 or the like.

- the camera 210 outputs a visible light image of the imaging result of the RGB sensor 212 to, for example, the display control device 150 and / or the projection control device 250 (see FIG. 1).

- the prism 213 reflects the incident infrared light and guides the infrared light to the IR sensor 211. According to the camera 210, the non-visible light image in the IR sensor 211 and the visible light image in the RGB sensor 212 can be simultaneously captured.

- the visible imaging function described above is used, for example, to display or record the state of the surgical field during surgery.

- the display control device 150 (FIG. 1) displays the visible light image on the monitor 160 or records it in the memory 240 or the like.

- various display modes can be set in the surgery support system 100 by performing image processing or the like for superimposing a non-visible light image on a visible light image.

- the visible imaging function can also be used to correct the positional deviation of the projected image G320 (FIG. 4B).

- the projection control device 250 calculates the shift amount of the position of the projection image shown in the visible light image, and performs the correction process of the projection image according to the calculated shift amount.

- the visible imaging function described above is incorporated such that the optical axis of visible imaging coincides with the optical axis J1 of the fluorescent image and the projection image.

- the transmittance T1 of visible light is smaller than the reflectance R1 of visible light, it needs to be larger than 0%. From this, in the dichroic mirror 201, light leakage of the projection light 315 from the projector 220 may occur. An example of the optical path of the stray light resulting from such a light leak is shown in FIG.

- the projection light 315 from the projector 220 generates stray light 325 passing through the dichroic mirror 201 in addition to the projection light 320 reflected by the dichroic mirror 201 toward the subject 136.

- the stray light 325 is emitted from the dichroic mirror 201 to the wall surface of the housing 205 opposite to the projector 220.

- the stray light 325 enters the dichroic mirror 201 from the side opposite to the projector 220.

- at least a part of the stray light 325 incident on the dichroic mirror 201 is reflected, and the stray light 325 enters the camera 210.

- the light shielding portion 202 is provided at a position which does not interfere with the optical path of the visible light 330 or the like in the housing 205. According to the light shield 202, the total amount of stray light 325 reflected inside the housing 205 can be reduced. Further, by forming the light shielding portion 202 with a black member, the contrast of the visible light image can be improved.

- the diaphragm 214 of the zoom lens 215 is opened to such an extent as to fly the reflection image of the stray light 325.

- the setting of the aperture value of the aperture 214 in the present embodiment will be described.

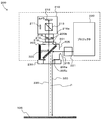

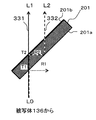

- FIG. 6 is a diagram for explaining an optical distance of light incident on the imaging and irradiation device 200 of the surgery support system 100. As shown in FIG. In the following, for convenience of explanation, instead of illustrating details of an imaging optical system of the camera 210 by various lens elements of the zoom lens 215, a lens 215a optically equivalent to the optical system is used.

- FIG. 6 schematically shows the range from the vicinity of the subject 136 of the surgery support system 100 (FIG. 5) to the vicinity of the focal point of the camera 210 using the lens 215a.

- the subject distance a and the light shielding portion distance b are shown with reference to the lens 215a.

- the effective diameter D of the lens 215a, the depth of field d, the front depth of field c, the back depth of field e, the focal length f, the depth of focus 2 ⁇ , and the permissible circle of confusion diameter ⁇ It shows.

- the subject distance a is an optical distance from the subject position P1 indicating the position of the subject 136 (FIG. 5) to the principal point P0 of the lens 215a.

- the subject position P1 is located between the near point P10 closest to the lens 215a and the far point P11 farthest from the depth of field d.

- the light shielding portion distance b is an optical distance from the light shielding portion 202 (FIG. 5) to the principal point P0 of the lens 215a. In FIG. 6, for convenience of explanation, the light shielding portion distance b is illustrated on the same straight line as the subject distance a.

- the front depth of field c is a portion from the subject position P1 to the near point P10 in the range of the depth of field d.

- the rear depth of field e is a portion from the subject position P1 to the far point P11 in the range of the depth of field d.

- the near point P10 of the depth of field d to the lens 215a It is necessary that the distance to the principal point P0 be greater than the light shielding portion distance b. That is, it is necessary to satisfy the following equation (1). a-c> b (1)

- n is a number of 1 or more, preferably 2 or more.

- the equation (2) is expressed as the following equation (3) using the F value (f-stop value).

- the upper limit value of the F value is defined.

- the aperture 214 is set such that the F value is smaller than the upper limit defined by the right side of the above equation (3). Further, the lower limit value of the F value of the aperture 214 is defined from the following viewpoint.

- the specification value d 0 of the depth of field d is, for example, 5 to 50 cm. From the viewpoint of securing the specification value d 0 of the depth of field d, the following depth equation (4) is imposed on the forward depth of field c. c> d 0/2 ... ( 4)

- the above equation (4) defines the lower limit value of the F value as in the following equation (5), similarly to the above equations (2) and (3).

- the subject distance a 1300 mm

- the light shielding plate distance b 300 mm

- the depth of field d (specification value d 0 ) 130 mm

- the permissible circle of confusion diameter ⁇ 0.03 mm

- the focal length f 25.5 mm.

- the range of the F value of diaphragm 214 is considered to be 1.0 to 10.0.

- the F-number of the aperture 214 is preferably around 2.0.

- FIG. 7 is a view for explaining multiple images in the surgery support system 100.

- the principal surface 201a closer to the subject 136 is referred to as the “front surface”

- the principal surface 201b on the far side is referred to as the “back surface”.

- the dichroic mirror 201 is disposed such that the front surface 201a is closer to the projector 220 than the camera 210, and the back surface 201b is closer to the camera 210 than the projector 220 (see FIG. 5).

- both the reflectance R1 of the visible light and the transmittance T1 of the dichroic mirror 201 are set to be larger than 0%. For this reason, visible light from the subject 136 may be branched into a plurality of optical paths due to internal reflection of the dichroic mirror 201 to produce a multiple image.

- FIG. 7 illustrates two light paths 331, 332 that can produce a double image.

- the first light path 331 is a light path which passes the dichroic mirror 201 linearly and forms an original visible light image of the object 136.

- the second optical path 332 is an optical path which is reflected by the back surface 201 b and the front surface 201 a inside the dichroic mirror 201 and passes through the dichroic mirror 201.

- the second light path 332 produces a visible light image which is offset from the visible light image by the first light path 331, ie a double image.

- the reflectance R2 of visible light on the back surface 201b of the dichroic mirror 201 is the reflectance of the main body of the dichroic mirror 201 by the AR coating or the like in order to reduce the reflection of multiple images due to the second light path 332 or the like. (Or the reflectance of the surface 201a) is set smaller than R1.

- the visible light L0 from the subject 136 is incident on the inside of the dichroic mirror 201 from the surface 201a side with the transmittance T1 and exits the back surface 201b with the transmittance T2 without being particularly reflected. Accordingly, the visible light L1 that has passed through the first light path 331 is represented by the following equation (6).

- L1 L0 ⁇ T1 ⁇ T2 (6)

- the visible light L2 that has passed through the second light path 332 is represented by the following equation (7).

- L2 L0 ⁇ T1 ⁇ R2 ⁇ R1 ⁇ T2 (7)

- the light amount of the double image by the second light path 332 is smaller than the light amount of the original visible light image by the first light path 331 by the magnification R2 ⁇ R1. Therefore, even when the reflectance R1 of the visible light of the dichroic mirror 201 (main body) is 95% or more, for example, by setting the reflectance R2 of the back surface 201b to 1%, the light quantity of the double image is originally visible. It can be reduced to less than 1% of the amount of light.

- the reflectance R2 of the back surface 201b of the dichroic mirror 201 may be 5% or less. Further, from the viewpoint of avoiding multiple images, it is desirable that the thickness of the dichroic mirror 201 be thin (for example, 5 mm or less). Further, according to the configuration of the dichroic mirror 201 as described above, it is possible to reduce the multiple image by the projection light from the projector 220.

- the imaging and irradiation apparatus 200 as an example of the projection apparatus in the surgery support system 100 of the present embodiment includes the IR sensor 211, the projector 220, the RGB sensor 212, the zoom lens 215, and the dichroic mirror 201. And a light shielding portion 202.

- the IR sensor 211 is an example of an invisible imaging unit that captures an invisible light image of the subject 136 in invisible light.

- the projector 220 is an example of a projection unit that projects a projection image G320 based on a non-visible light image onto a subject 136 with visible light.

- the RGB sensor 212 is an example of a visible imaging unit that images the subject 136 on which the projection image G 320 is projected in visible light.

- the zoom lens 215 is an example of an imaging optical system provided with a diaphragm 214 that adjusts the amount of light collected on the IR sensor 211 and the RGB sensor 212.

- the dichroic mirror 201 is an example of a light guiding unit that guides the light incident on the zoom lens 215 and the light emitted from the projector 220.

- the light shielding unit 202 is disposed with a space from the dichroic mirror 201.

- the optical distance (a-c) from the near point P10 of the depth of field to the zoom lens 215 and the zoom lens from the light shield 202 The aperture value of the diaphragm 214 is set such that the difference in distance from the optical distance b up to 215 is longer than the front depth of field c of the object 136 (see equation (2)).

- the above projection apparatus when projecting a projected image of visible light based on a captured image of non-visible light, the reflected image of dust etc. in the vicinity of the light shielding unit 202 is skipped to accurately capture visible light. it can.

- the stop value of the stop 214 may be set such that the above-mentioned difference in distance is longer than the depth of field d of the zoom lens 215 regardless of the position of the subject 136.

- the light shielding portion distance b is equal to or more than the depth of field d and away from the near point P10 of the depth of field d, the reflected image such as dust can be sufficiently blown away.

- the aperture 214 is narrowed (opened) within a range where the depth of field d is equal to or greater than a predetermined length (specification value d 0 ) (see equation (4)).

- the f-number of the aperture 214 is an object disposed within the range of the focal length f of the zoom lens 215, the depth of field d, the permissible circle of confusion diameter ⁇ , and the depth of field d.

- the optical distance a between 136 and the zoom lens 215, the optical distance b between the light shield 202 and the zoom lens 215, and the number n of 2 or more it is defined by an F value that satisfies Equations (3) and (5). May be Thereby, imaging in visible light can be performed with high accuracy while securing the ease of handling of the surgery support system 100.

- the light guide portion is configured of the dichroic mirror 201 having a transmittance T1 that transmits visible light within a range smaller than the reflectance R1 of visible light.

- the dichroic mirror 201 transmits light from the outside and guides the light to the zoom lens 215, and is arranged to reflect light from the projector 220 and guide the light to the outside.

- the transmittance T1 may be 5% or less.

- the dichroic mirror 201 has two main surfaces 201 a and 201 b facing each other with a predetermined thickness.

- the dichroic mirror 201 has two principal surfaces 201a and 201b on the side closer to the zoom lens 215 than the projector 220, and the reflectance R2 at which the visible light is reflected on the principal surface 201b is on the other principal surface 201a. It is configured to be smaller than the reflectance R1. Thereby, the multiple image in the dichroic mirror 201 can be suppressed, and the accuracy of visible imaging can be improved.

- the reflectance at which the visible light is reflected on the principal surface 201b closer to the zoom lens 215 in the dichroic mirror 201 may be 5% or less.

- the light shielding portion 202 includes a black member having a visible light reflectance of 3% or less.

- the total amount of stray light 325 can be reduced to improve the contrast of the visible light image.

- the projection apparatus in the present embodiment may further include an excitation light source 230 that emits excitation light 300 that causes the subject 136 to emit fluorescence 310 of invisible light.

- the IR sensor 211 captures an image of a subject that emits fluorescence as an invisible light image.

- the projection apparatus may further include an optical filter 216 that blocks light in the same wavelength band as the excitation light 300 and transmits light in the same wavelength band as the fluorescence 310 and visible light.

- Embodiment 1 has been described as an example of the technology disclosed in the present application.

- the technology in the present disclosure is not limited to this, and is also applicable to embodiments in which changes, replacements, additions, omissions, and the like are appropriately made.

- the dichroic mirror 201 has been described as an example of the light guide.

- the light guide in the present disclosure is not limited to the dichroic mirror 201, and may be, for example, a polarizing prism. In this case, a phase plate (1/4 ⁇ plate) or a polarizing plate may be appropriately combined.

- the light guide may be a dichroic mirror that reflects non-visible light such as infrared light and mainly transmits visible light. In this case, the relative positions of the projector 220 and the camera 210 are interchanged with those in FIG.

- non-visible light may be not only infrared light but ultraviolet light.

- the non-visible light is not necessarily limited to the light having the wavelength band of the non-visible region, but may include, for example, weak fluorescence of the red region emitting based on the excitation light of the blue region. Under the present circumstances, visible light made into the object of a projection image and visible imaging may be green light etc.

- the display system in this indication is not limited to this.

- the projection apparatus in the present disclosure may be applied. it can.

- a fluorescent material is applied to an object whose state change can not be visually confirmed, kneaded or cast in a construction site, a mining site, a construction site, a factory for processing materials, etc. It may be an imaging target.

- the projection apparatus according to the present disclosure is applicable when working with an object such as a medical application, a construction site, a mining site, a construction site, a factory for processing materials, or the like for which it is difficult to visually confirm a change in state.

Landscapes

- Health & Medical Sciences (AREA)

- Life Sciences & Earth Sciences (AREA)

- Surgery (AREA)

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Nuclear Medicine, Radiotherapy & Molecular Imaging (AREA)

- Public Health (AREA)

- Veterinary Medicine (AREA)

- General Health & Medical Sciences (AREA)

- Biomedical Technology (AREA)

- Heart & Thoracic Surgery (AREA)

- Medical Informatics (AREA)

- Molecular Biology (AREA)

- Animal Behavior & Ethology (AREA)

- General Physics & Mathematics (AREA)

- Pathology (AREA)

- Oral & Maxillofacial Surgery (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Optics & Photonics (AREA)

- Robotics (AREA)

- Gynecology & Obstetrics (AREA)

- Radiology & Medical Imaging (AREA)

- Projection Apparatus (AREA)

- Microscoopes, Condenser (AREA)

- Investigating, Analyzing Materials By Fluorescence Or Luminescence (AREA)

Abstract

投影装置(200)は、非可視撮像部(211)と、投影部(220)と、可視撮像部(212)と、撮像光学系(215)と、導光部(201)と、遮光部(202)とを備える。非可視撮像部は、被写体の非可視光画像を撮像する。投影部は、非可視光画像に基づく投影画像を可視光で被写体に投影する。可視撮像部は、投影画像が投影された被写体を撮像する。撮像光学系は、絞り(214)を備える。導光部は、撮像光学系に入射する光を導光すると共に投影部から出射する光を導光する。遮光部は、導光部から空間をあけて配置される。被写界深度の近点から撮像光学系までの光学距離と、遮光部から撮像光学系までの光学距離との間の距離差が、被写体の前方被写界深度よりも長くなるように、絞りの絞り値が設定されている。

Description

本開示は、本開示は、被写体の撮像画像に基づく画像を投影する投影装置に関する。

特許文献1は、医療分野において用いられる光学撮像システムを開示している。特許文献1の光学撮像システムは、術野を撮像する電子撮像装置と、手術中の術野の撮像結果の可視光像を投影するプロジェクタと、電子撮像装置及びプロジェクタの光軸を同一の光軸に揃える光学素子とを備えている。光学撮像システムは、電子撮像装置において術野の蛍光像を撮像し、撮像結果の蛍光像を可視化するための投影画像をプロジェクタから投影している。

本開示の目的は、非可視光の撮像画像に基づく可視光の投影画像を投影する際に、可視光における撮像を精度良く行うことができる投影装置を提供することにある。

本開示における投影装置は、非可視撮像部と、投影部と、可視撮像部と、撮像光学系と、導光部と、遮光部とを備える。非可視撮像部は、非可視光における被写体の非可視光画像を撮像する。投影部は、非可視光画像に基づく投影画像を可視光で被写体に投影する。可視撮像部は、可視光において投影画像が投影された被写体を撮像する。撮像光学系は、非可視撮像部及び可視撮像部に集光する光量を調整する絞りを備える。導光部は、撮像光学系に入射する光を導光すると共に投影部から出射する光を導光する。遮光部は、導光部から空間をあけて配置される。撮像光学系の被写界深度の範囲内に被写体が配置された状態において、被写界深度の近点から撮像光学系までの光学距離と、遮光部から撮像光学系までの光学距離との間の距離差が、被写体の前方被写界深度よりも長くなるように、絞りの絞り値が設定されている。

本開示における投影装置によると、絞りの設定により、非可視光の撮像画像に基づく可視光の投影画像を投影する際に、可視光における撮像を精度良く行うことができる。

以下、適宜図面を参照しながら、実施の形態を詳細に説明する。但し、必要以上に詳細な説明は省略する場合がある。例えば、既によく知られた事項の詳細説明や実質的に同一の構成に対する重複説明を省略する場合がある。これは、以下の説明が不必要に冗長になるのを避け、当業者の理解を容易にするためである。

なお、出願人は、当業者が本開示を十分に理解するために添付図面および以下の説明を提供するのであって、これらによって特許請求の範囲に記載の主題を限定することを意図するものではない。

(実施の形態1)

本開示に係る投影装置を備えた投影システムの具体的な実施例として、手術支援システムを説明する。

本開示に係る投影装置を備えた投影システムの具体的な実施例として、手術支援システムを説明する。

1.構成

1-1.手術支援システムの概要

実施の形態1にかかる手術支援システムの概要を、図1を用いて説明する。図1は、実施の形態1にかかる手術支援システム100の構成を示す概略図である。

1-1.手術支援システムの概要

実施の形態1にかかる手術支援システムの概要を、図1を用いて説明する。図1は、実施の形態1にかかる手術支援システム100の構成を示す概略図である。

手術支援システム100は、カメラ210、プロジェクタ220及び励起光源230を備える。手術支援システム100は、手術室等において医師等が患者に対して行う手術を、投影画像を用いて視覚的に支援するシステムである。手術支援システム100を使用する場合に、手術を受ける患者120には、予め光感受性物質が投与される。

光感受性物質は、励起光に反応して蛍光を発する物質である。光感受性物質としては、例えばICG(インドシアニングリーン)などが用いられる。本実施形態では、光感受性物質の一例として、ICGを用いた場合を説明する。ICGは、波長760~780nm近傍の赤外領域の励起光が照射されることにより、波長800~860nmの赤外領域の蛍光を発する。

光感受性物質は、患者120に投与されると、血液又はリンパ液の流れが滞っている患部130に蓄積する。このため、励起光の照射に応じて蛍光発光する領域を検出することにより、患部130の領域を特定することが可能となる。

ここで、患部130が発する蛍光は微弱であったり、蛍光の波長帯が非可視領域又は非可視領域近傍であったりするため、医師等は、術野を目視しても、患部130の領域を特定することが困難である。そこで、手術支援システム100では、カメラ210を用いて蛍光310を発する患部130の領域を特定する。さらに、特定した患部130が人間に視認可能となるように、プロジェクタ220から患部130に可視光の投影光320を照射する。これにより、特定した患部130の領域を可視化する投影画像が投影され、手術を行う医師等による患部130の領域の特定を支援することができる。

1-2.手術支援システムの構成

以下、手術支援システム100の構成について、図1を用いて説明する。手術支援システム100は、病院の手術室内に配置されて使用される。手術支援システム100は、撮像照射装置200と、メモリ240と、投影制御装置250とを備える。

以下、手術支援システム100の構成について、図1を用いて説明する。手術支援システム100は、病院の手術室内に配置されて使用される。手術支援システム100は、撮像照射装置200と、メモリ240と、投影制御装置250とを備える。

また、図示していないが、手術支援システム100は、撮像照射装置200の配置を変更するための機構、例えば、撮像照射装置200と機械的に接続された駆動アーム、及び手術支援システム100の一式を載置する台座のキャスターなどを備える。上記の機構により、撮像照射装置200は、患者120が載置される手術台110の鉛直上方または鉛直方向からある角度を持った上方に配置される。また、手術台110は、高さ及び向きを変更可能な駆動機構を備えてもよい。

撮像照射装置200は、カメラ210、プロジェクタ220、及び励起光源230が、ダイクロイックミラー201と共に一体的に組み付けられた投影装置の一例である。撮像照射装置200の構成の詳細については後述する。

メモリ240は、投影制御装置250が種々の演算を実行する際に、適宜アクセスを行う記憶媒体である。メモリ240は、例えばROM及びRAMで構成される。メモリ240は、本実施形態における記憶部の一例である。

投影制御装置250は、手術支援システム100を構成する各部を統括制御する。投影制御装置250は、カメラ210、プロジェクタ220、励起光源230、及びメモリ240に電気的に接続され、各部をそれぞれ制御するための制御信号を出力する。投影制御装置250は、例えばCPUで構成され、所定のプログラムを実行することによってその機能を実現する。なお、投影制御装置250の機能は、専用に設計された電子回路や再構成可能な電子回路(FPGA、又はASIC等)により実現されてもよい。

投影制御装置250は、例えば、カメラ210による撮像画像に対して種々の画像処理を行って、投影画像を示す映像信号(画像データ)を生成する。投影制御装置250は、本開示における画像生成部の一例である。

また、本実施形態において、手術支援システム100は、表示制御装置150と、モニタ160と、マウス170とを備える。

表示制御装置150は、例えばPC(パーソナルコンピュータ)で構成され、投影制御装置250に接続されている。表示制御装置150は、例えばCPUを備え、モニタ160に表示する画像を生成する画像処理等を行う。表示制御装置150は、本開示における画像生成部の一例である。また、表示制御装置150は、本開示における記憶部の一例である内部メモリ(ROM,RAMなど)を備える。

モニタ160は、例えば液晶ディスプレイ又は有機ELディスプレイで構成され、画像を表示する表示面を有する。モニタ160は、本開示における表示部の一例である。

マウス170は、表示制御装置150に対してユーザが操作を入力するために用いられる。マウス170は、本開示における調整部の一例である。手術支援システム100は、マウス170に代えて、又はこれに加えて、種々の調整部を含んでもよく、例えば、キーボード、タッチパッド、タッチパネル、ボタン、スイッチなどを含んでもよい。

表示制御装置150の操作者140(ユーザ)は、例えば手術中に、カメラ210の撮像画像をモニタ160において確認することができる。また、操作者140は、投影画像の種々の設定(例えば蛍光の強度分布に対するしきい値)を調整することができる。

1-3.撮像照射装置の構成

撮像照射装置200の構成の詳細について、図2を用いて説明する。図2は、手術支援システムにおける撮像照射装置200の構成を示すブロック図である。撮像照射装置200は、励起光源230と、カメラ210と、ズームレンズ215と、光学フィルタ216と、プロジェクタ220と、テレコンバージョン(テレコン)レンズ221と、ダイクロイックミラー201と、遮光部202とを備える。撮像照射装置200は、術野135等の被写体までの距離(高さ)が例えば1m等の位置に配置される。

撮像照射装置200の構成の詳細について、図2を用いて説明する。図2は、手術支援システムにおける撮像照射装置200の構成を示すブロック図である。撮像照射装置200は、励起光源230と、カメラ210と、ズームレンズ215と、光学フィルタ216と、プロジェクタ220と、テレコンバージョン(テレコン)レンズ221と、ダイクロイックミラー201と、遮光部202とを備える。撮像照射装置200は、術野135等の被写体までの距離(高さ)が例えば1m等の位置に配置される。

励起光源230は、光感受性物質を蛍光発光させるための励起光300を照射する光源装置である。本実施形態では、光感受性物質としてICGを用いることから、励起光源230は、ICGの励起波長を含む波長帯(例えば760~780nm近傍)を有する励起光300を照射する。励起光源230は、本実施形態における照明部の一例である。励起光源230は、投影制御装置250からの制御信号に従って、励起光300の照射のON/OFFを切り替える。なお、励起光源230は、撮像照射装置200とは別体で構成されてもよい。

カメラ210は、患者120の術野135などを含む被写体を撮像して撮像画像を生成する。カメラ210は、生成した撮像画像を示す画像データを投影制御装置250に伝送する。本実施形態では、カメラ210は、図2に示すように、IRセンサ211と、RGBセンサ212と、プリズム213とを備える。

IRセンサ211は、ICGの蛍光800nm~860nmの波長帯を含む赤外光(非可視光の一例)における撮像を行って、撮像画像として非可視光画像を生成する。IRセンサ211は、例えばCMOSイメージセンサ又はCCDイメージセンサなどで構成される。IRセンサ211は、赤外光以外の光を遮断するフィルタ等を含む。IRセンサ211は、本実施形態における非可視撮像部の一例である。

RGBセンサ212は、例えばRGBのカラーフィルタが画素毎に設けられたCMOSイメージセンサ又はCCDイメージセンサなどで構成される。RGBセンサ212は、可視光における撮像を行い、複数色(RGB)の可視光画像を生成する。RGBセンサ212は、本実施形態における可視撮像部の一例である。可視撮像部は、RGBセンサ212に限らず、例えば、モノクロのイメージセンサであってもよい。

プリズム213は、入射する光において、可視光成分を透過し、赤外光成分を反射する。図2に示すように、プリズム213は、ズームレンズ215とRGBセンサ212との間に配置される。また、プリズム213の反射面側には、IRセンサ211が配置される。プリズム213は、カメラ210の内部に設けられる内部光学系の一例である。カメラ210の内部光学系はプリズム213に限らない。例えば、光路長の調整部材が、IRセンサ211及び/又はRGBセンサ212とプリズム213との間に配置されてもよい。

ズームレンズ215は、カメラ210に取り付けられ、外部からの光をカメラ210内部に集光する。ズームレンズ215は、カメラ210の画角(ズーム値)、被写界深度、及びフォーカス等を調整する。ズームレンズ215は、レンズ215aを含む各種レンズ素子、および絞り214を備える。絞り214は、例えば開口絞りである。絞り214は、開口度合いを示す絞り値(例えばF値)に応じて、ズームレンズ215が集光する光の光量を調整する。

ズームレンズ215によるズーム値、及び絞り214の絞り値(F値)等は、例えば外部から設定可能である。ズームレンズ215は、本実施形態における撮像光学系の一例である。撮像光学系は、ズームレンズ215に限らず、例えばカメラ210の内部光学系や外部の各種光学素子を含めてもよいし、カメラ210に内部光学系として組み込まれてもよい。

光学フィルタ216は、例えば図2に示すように、ズームレンズ215の入射面に配置される。光学フィルタ216は、入射する光において、励起光の波長760~780nmを含む680~825nmの波長帯成分を遮断するバンドカットフィルタで構成される。

プロジェクタ220は、例えばDLP方式、3LCD方式又はLCOS方式などのプロジェクタである。プロジェクタ220は、投影制御装置250から入力される映像信号に基づく投影画像を可視光で投影するように、投影光315を出射する。プロジェクタ220は、本実施形態における投影部の一例である。プロジェクタ220は、例えば光源、画像形成部、及び内部光学系などを備える。

プロジェクタ220の光源は、例えばLD(半導体レーザ)又はLEDなどで構成される。プロジェクタ220の画像形成部は、DMD又はLCDなどの空間光変調素子を含み、空間光変調素子における画像形成面に、投影制御装置250からの映像信号に基づく画像を形成する。プロジェクタ220は、形成した画像に応じて光源からの光を空間変調して、投影光315を生成し、内部光学系から出射する。

プロジェクタ220は、例えば台形補正およびレンズシフト機能などのプロジェクタ220特有の機能を実現する投影制御回路を有してもよい。また、上記の各機能は、投影制御装置250において実現されてもよい。また、プロジェクタ220は、レーザ走査式であってもよく、走査方向に駆動可能なMEMSミラー或いはガルバノミラーを備えて構成されてもよい。

テレコンレンズ221は、プロジェクタ220の内部光学系に光学的に結合するように配置される。テレコンレンズ221は、プロジェクタ220の焦点距離を望遠側に延長する。テレコンレンズ221に加えて、又はこれに代えて、プロジェクタ220からダイクロイックミラー201までの光路に各種の光学素子が配置されてもよい。

ダイクロイックミラー201は、光の波長帯に応じて選択的に入射する光を透過または反射する光学特性を有する導光部の一例である。例えば、ダイクロイックミラー201は、許容誤差の範囲内で赤外光の透過率を100%に設定され、反射率を0%に設定される。また、本実施形態において、ダイクロイックミラー201は、可視光の反射率よりも小さい範囲内で可視光を透過するように、可視光の反射率及び透過率を設定される。ダイクロイックミラー201の可視光の透過率は、5%以下が好ましく、例えば、ダイクロイックミラー201の可視光の反射率(以下「R1」とする)は99%であり、可視光の透過率(以下「T1」とする)は1%である。

つまり、ダイクロイックミラー201により、RGBセンサ212が撮像できる可視光が5%以下となる。なお、5%以下にするためには、ダイクロイックミラー201のみではなく、撮像の光路上にある部材を組み合わせて実現してもよく、例えば、ダイクロイックミラー201の他に、光学フィルタ216、プリズム213等にフィルタを設けて、合わせて5%以下としてもよい。

ダイクロイックミラー201は、例えば5mm以下の厚さにおいて互いに対向する2つの主面を有する。図2に示すように、ダイクロイックミラー201は、プロジェクタ220側のテレコンレンズ221とカメラ210側のズームレンズ215とに各々の主面を向けるように、例えば筐体205の内部に固定される。筐体205には、プロジェクタ220に対する導光孔205aと、カメラ210に対する導光孔205bと、外部に対する導光孔205cとが設けられている。ダイクロイックミラー201において、プロジェクタ220側とは反対側の主面には、例えばAR(反射防止)コーティングが施されている(詳細は後述)。

図2に示すように、ダイクロイックミラー201は、上記の光学特性により、ズームレンズ215等を介してカメラ210に向かう蛍光310等を透過する一方、プロジェクタ220から照射された投影光315の大半(半分以上)を反射する。反射された投影光320は、術野135上に照射される。本実施形態では、ダイクロイックミラー201は、術野135からの蛍光310などのカメラ210に入射する入射光の光軸と、術野135上に投影画像を投影する投影光320の光軸とが、光軸J1において一致するように導光する。これにより、カメラ210の撮像画像に基づく投影画像の位置ずれを低減することができる。

なお、本開示における光軸の一致には、適宜、許容誤差が設定されてもよい。例えば、角度が±5度の範囲内、或いは光軸の間隔が1cmの範囲内の許容誤差において、各光軸が一致してもよい。また、ダイクロイックミラー201の光学特性は、使用する光感受性物質の蛍光特性等に応じて適宜、設定可能である。

遮光部202は、筐体205の内壁において、ダイクロイックミラー201を介してプロジェクタ220に対向する側の内壁に設けられる。遮光部202は、筐体205においてダイクロイックミラー201の近傍に、空間をあけて配置される。遮光部202は、迷光などからダイクロイックミラー201を遮光する。

本実施形態において、遮光部202は、例えば可視光の反射率が3%以下(例えば0.5%)である黒色部材によって構成される。黒色部材は、例えば入射する光を吸収する光吸収膜、又は黒化処理皮膜などで構成される。遮光部202の黒色部材は、シート部材であってもよいし、塗料で構成されてもよい。

2.動作

以下、本実施形態にかかる手術支援システム100の動作について説明する。

以下、本実施形態にかかる手術支援システム100の動作について説明する。

2-1.投影動作について

手術支援システム100の基本的な投影動作について、図3,4A,4Bを用いて説明する。

手術支援システム100の基本的な投影動作について、図3,4A,4Bを用いて説明する。

図3は、手術支援システム100における投影動作を説明するためのフローチャートである。図4Aは、通常モードによる投影動作を行う前の手術支援システム100における術野135の状態を示す。図4Bは、図4Aの術野135に対して投影動作を行った状態を示す。図3のフローチャートは、投影制御装置250によって実行される。

図3のフローチャートにおいて、まず、投影制御装置250は、励起光源230を駆動して、図4Aに示すように、励起光300を術野135に照射する(S1)。励起光300の照射により、術野135における患部130が蛍光発光し、患部130からの蛍光310が撮像照射装置200に入射する。

撮像照射装置200において、蛍光310は図2に示すように、ダイクロイックミラー201を透過し、カメラ210の光学フィルタ216を透過する。これにより、カメラ210は、IRセンサ211において蛍光310を受光する。この際、励起光300の反射光305は、光学フィルタ216において遮断される。

次に、投影制御装置250は、例えばカメラ210を制御して術野135を撮像させ、カメラ210から撮像画像を取得する(S2)。ステップS2で取得される撮像画像には、患部130が発した蛍光310の受光によって生成される蛍光像が含まれる。

次に、投影制御装置250は、取得した撮像画像に基づく投影画像を生成するための画像処理を行う(S3)。投影制御装置250は、撮像画像中の蛍光像に対応する画像を生成し、映像信号としてプロジェクタ220に出力する。

ステップS3の画像処理において、投影制御装置250は、例えば、撮像画像における受光強度の分布に対して所定のしきい値に基づき二値化を行い、撮像画像中で蛍光像の領域と考えられる領域を特定する。次いで、投影制御装置250は、メモリ240に格納された種々のパラメータを参照し、特定した領域を含む画像に対してシフト、回転、及び拡大/縮小などの座標変換、並びに画像の歪み等の補正などを行う。これにより、撮像画像中の蛍光像に応じた特定の領域を表す画像が生成される。

次に、投影制御装置250は、生成した映像信号に基づく投影画像を投影するように、プロジェクタ220を制御する(S4)。プロジェクタ220は、投影制御装置250の制御により、投影制御装置250からの映像信号に応じた投影画像を表す投影光315を生成して、テレコンレンズ221を介してダイクロイックミラー201に投影光315を出射する(図2参照)。

ダイクロイックミラー201は、図2に示すように、可視光である投影光315(の大半)を反射し、光軸J1に沿って投影光320を出射する。これにより、図4Bに示すように、撮像照射装置200は術野135に投影光320を照射し、投影画像G320が、術野135における患部130に投影される。投影画像G320は、例えば単色の画像である。

以上の処理は、所定の周期(例えば1/60~1/30秒)で繰り返し実行される。

以上の処理により、投影制御装置250が、カメラ210の撮像画像に基づき蛍光発光する患部130の領域を特定し、プロジェクタ220から可視光の投影画像G320が患部130に投影される。これにより、手術支援システム100において、目視では視認することが困難な患部130を可視化することができる。手術支援システム100により、医師等は患部130のリアルタイムの状態を視認することができる。

以上の説明では、投影画像G320が単色の画像の例を説明した。投影制御装置250は、例えば複数のしきい値を用いて撮像画像中の蛍光像の領域を多段階で判定することにより、多階調の投影画像を生成してもよい。また、投影制御装置250は、撮像画像における受光強度の分布を連続的に再現するように、投影画像を生成してもよい。また、投影画像は、複数色あるいはフルカラーで生成されてもよい。

2-2.可視撮像機能について

本実施形態にかかる手術支援システム100は、上記のような投影画像を生成するための蛍光像の撮像(図3のS2)に加えて、可視光において術野等の画像を撮像する。手術支援システム100における可視撮像機能について、図5を用いて説明する。

本実施形態にかかる手術支援システム100は、上記のような投影画像を生成するための蛍光像の撮像(図3のS2)に加えて、可視光において術野等の画像を撮像する。手術支援システム100における可視撮像機能について、図5を用いて説明する。

図5は、手術支援システム100における可視光の光路を説明するための図である。手術支援システム100の撮像照射装置200に入射する可視光330は、外光が術野等の被写体136上で反射した光や、投影光320の反射光などを含む。可視光330は、撮像照射装置200において、ダイクロイックミラー201に入射する。

本実施形態のダイクロイックミラー201は、入射した可視光330の一部を透過し、光学フィルタ216を介してズームレンズ215に入射させる。本実施形態の光学フィルタ216は、入射した可視光330を所定の透過率で透過する。ズームレンズ215は、設定されたズーム値および絞り値に応じて入射した可視光330の光束を調整して、カメラ210に入射させる。

カメラ210において、プリズム213は、入射した可視光330を透過する。RGBセンサ212は、プリズム213を透過した可視光330を受光する。これにより、RGBセンサ212は、被写体136等からの可視光330の画像を撮像する。カメラ210は、RGBセンサ212の撮像結果の可視光画像を、例えば表示制御装置150及び/又は投影制御装置250等に出力する(図1参照)。

また、プリズム213は、蛍光310等の赤外光が入射すると(図2参照)、入射した赤外光を反射して、IRセンサ211に導光する。カメラ210によると、IRセンサ211における非可視光画像と、RGBセンサ212における可視光画像とを同時に撮像することができる。

上記の可視撮像機能は、例えば手術中の術野の状態の表示や記録に利用される。例えば、表示制御装置150(図1)が、可視光画像をモニタ160に表示したり、メモリ240等に記録したりする。また、可視光画像に非可視光画像を重畳する画像処理等を行うことにより、手術支援システム100において多様な表示モードを設定可能である。また、可視撮像機能は、投影画像G320(図4B)の位置ずれの補正にも利用可能である。例えば、投影制御装置250が、可視光画像に映った投影画像の位置のずれ量を計算し、計算したずれ量に応じて投影画像の補正処理を行う。

本実施形態の手術支援システム100では、上記の可視撮像機能が、可視撮像の光軸が、蛍光像の撮像および投影画像の光軸J1と一致するように組み込まれている。これにより、上記の可視光画像を用いた画像処理や補正処理の精度を良くする等、各種用途に可視光画像を利用し易くすることができる。

ここで、以上のように可視撮像機能を手術支援システム100に組み込むと、当該機能を組み込んでいないシステムでは予期されない新たな課題が想定される。以下、可視撮像機能の追加による課題について説明する。

本実施形態のダイクロイックミラー201では、可視光の透過率T1が、可視光の反射率R1よりも小さいものの、0%よりも大きい必要がある。このことから、ダイクロイックミラー201においては、プロジェクタ220からの投影光315の光漏れが生じ得る。このような光漏れに起因した迷光の光路の一例を図5に示す。

図5に例示するように、プロジェクタ220からの投影光315は、ダイクロイックミラー201において被写体136側に反射される投影光320以外に、ダイクロイックミラー201を透過する迷光325を生じる。迷光325は、ダイクロイックミラー201から、プロジェクタ220とは反対側の筐体205の壁面に出射する。このような迷光325が、当該壁面において反射すると、プロジェクタ220とは反対側からダイクロイックミラー201に入射する。すると、ダイクロイックミラー201が入射した迷光325の少なくとも一部を反射し、迷光325がカメラ210に入射してしまう。

以上のような迷光325によると、可視撮像の撮像精度を劣化させてしまうという課題が想定される。そこで、本実施形態では、筐体205内部で可視光330等の光路に干渉しない位置に、遮光部202を設けている。遮光部202によると、筐体205内部で反射する迷光325の総量を低減できる。また、遮光部202を黒色部材で構成することにより、可視光画像のコントラストを向上できる。

ここで、例えば遮光部202等の筐体205の内壁に塵埃が付着したり、傷跡があったりする場合、塵埃などにおける迷光325の反射像が可視光画像中に映り込むという可視撮像の精度劣化を生じることが考えられる。そこで、本実施形態では、迷光325の反射像を飛ばす程度にまで、ズームレンズ215の絞り214を開放させる。以下、本実施形態における絞り214の絞り値の設定について説明する。

2-2-1.絞り値の設定について

本実施形態の絞り214の絞り値の設定について、図6を用いて説明する。

本実施形態の絞り214の絞り値の設定について、図6を用いて説明する。

図6は、手術支援システム100の撮像照射装置200に入射する光の光学距離を説明するための図である。以下では説明の便宜上、ズームレンズ215の各種レンズ素子によるカメラ210の撮像光学系の詳細を図示する代わりに、当該光学系と光学的に等価なレンズ215aを用いる。

図6は、レンズ215aを用いて、手術支援システム100(図5)の被写体136近傍から、カメラ210の焦点近傍までの範囲を模式的に示している。図6では、レンズ215aを基準として、被写体距離aおよび遮光部距離bを示している。また、レンズ215aの有効径Dと、被写界深度dと、前方被写界深度cと、後方被写界深度eと、焦点距離fと、焦点深度2σと、許容錯乱円径εとを示している。

被写体距離aは、被写体136(図5)の位置を示す被写体位置P1からレンズ215aの主点P0までの光学距離である。本実施形態の手術支援システム100では、被写体136を被写界深度dの範囲内に配置して使用することを想定している。これに対応して、被写体位置P1は、被写界深度dの中でレンズ215aに最も近い近点P10と最も遠い遠点P11との間に位置する。

遮光部距離bは、遮光部202(図5)からレンズ215aの主点P0までの光学距離である。図6では、説明の便宜上、被写体距離aと同一直線上に、遮光部距離bを図示している。

前方被写界深度cは、被写界深度dの範囲内において、被写体位置P1から近点P10までの部分である。後方被写界深度eは、被写界深度dの範囲内において、被写体位置P1から遠点P11までの部分である。

手術支援システム100(図5)において、筐体205中の塵埃などの遮光部距離bにある物体にフォーカスが合わないようにするためには、被写界深度dの近点P10からレンズ215aの主点P0までの距離が、遮光部距離bよりも遠いことが必要である。つまり、次式(1)を満たすことが必要である。

a-c>b …(1)

a-c>b …(1)

本実施形態の手術支援システム100では、遮光部距離bにおいてフォーカスを外すだけでなく、遮光部距離bにおける反射像が、可視光画像に映り込まないようにする必要がある。つまり、上式(1)よりも被写界深度dの近点P10を充分に遠ざけることが必要になる。このことは、次式(2)のように表すことができる。

a-b>n×c …(2)

a-b>n×c …(2)

上式(2)において、nは1以上の数であり、2以上であることが好ましい。n≧2のとき、被写界深度dの近点P10までの距離(a-c)と遮光部距離bとの間の距離差を、前方被写界深度cの長さ以上に確保することができる。

ここで、前方被写界深度cはF値の関数であることから、式(2)は、F値(絞り値)を用いて次式(3)のように表される。

F<f2×(a-b)/[a×ε×{(n-1)a+b}] …(3)

F<f2×(a-b)/[a×ε×{(n-1)a+b}] …(3)

上式(3)によると、F値の上限値が規定される。絞り214は、F値が上式(3)の右辺で規定される上限値よりも小さくなるように、開放度合いを設定される。また、絞り214のF値の下限値については、下記の観点から規定される。

すなわち、手術支援システム100における被写界深度dとしては、手術支援の用途に望ましい仕様値d0を確保することが要求される。被写界深度dの仕様値d0は、例えば5~50cmである。被写界深度dの仕様値d0を確保する観点から、前方被写界深度cには次式(4)が課される。

c>d0/2 …(4)

c>d0/2 …(4)

上式(4)は、上述の式(2),(3)と同様に、次式(5)のようにF値の下限値を規定する。

F>f2×d0/{a×ε×(2a-d)} …(5)

F>f2×d0/{a×ε×(2a-d)} …(5)

例えば、手術支援システム100の実装として、被写体距離a=1300mm、遮光板距離b=300mm、被写界深度d(仕様値d0)=130mm、許容錯乱円径ε=0.03mm、焦点距離f=25.5mmである場合が想定される。この場合、式(3)の右辺は10.4であり、式(5)の右辺は0.9であることから、絞り214のF値の範囲は、1.0~10.0と考えられる。絞り214のF値は、2.0近傍であることが好ましい。

2-2-2.多重像について

上述した可視撮像機能の組込みによると、多重像の映り込みによって撮像精度が低下するという課題がある。この課題に対して、本実施形態に係る手術支援システム100では、ダイクロイックミラー201の構成により、多重像の映り込みを低減可能である。本実施形態の多重像に対する対策について、図7を用いて説明する。

上述した可視撮像機能の組込みによると、多重像の映り込みによって撮像精度が低下するという課題がある。この課題に対して、本実施形態に係る手術支援システム100では、ダイクロイックミラー201の構成により、多重像の映り込みを低減可能である。本実施形態の多重像に対する対策について、図7を用いて説明する。

図7は、手術支援システム100における多重像を説明するための図である。以下では、図7に示すダイクロイックミラー201の2つの主面201a,201bにおいて、より被写体136に近い側の主面201aを「表面」とし、遠い側の主面201bを「裏面」とする。

本実施形態のダイクロイックミラー201は、表面201aが、カメラ210よりもプロジェクタ220近傍に位置し、裏面201bが、プロジェクタ220よりもカメラ210近傍に位置するように配置される(図5参照)。

本実施形態では、可視撮像機能を実現するために、ダイクロイックミラー201における可視光の反射率R1と透過率T1との双方が0%よりも大きくなるように設定されている。このため、被写体136からの可視光が、ダイクロイックミラー201の内部反射により複数の光路に分岐して、多重像を生じ得る。図7では、二重像を生じ得る2つの光路331,332を例示している。

図7において、第1の光路331は、ダイクロイックミラー201を直線的に通過し、被写体136の本来の可視光像を形成する光路である。第2の光路332は、ダイクロイックミラー201内部で裏面201b及び表面201aにおいて反射して、ダイクロイックミラー201を通過する光路である。第2の光路332は、第1の光路331による可視光像からずれた可視光像、即ち二重像を生じさせる。

本実施形態では、第2の光路332等による多重像の映り込みを低減させるために、ダイクロイックミラー201の裏面201bにおける可視光の反射率R2が、ARコート等により、ダイクロイックミラー201本体の反射率(或いは表面201aの反射率)R1よりも小さく設定される。

第1の光路331によると、被写体136からの可視光L0は、表面201a側から透過率T1でダイクロイックミラー201の内部に入射し、特に反射することなく、裏面201bを透過率T2で出射する。よって、第1の光路331を通った可視光L1は、次式(6)のように表される。

L1=L0×T1×T2 …(6)

L1=L0×T1×T2 …(6)

一方、第2の光路332によると、被写体136からの可視光L0は、表面201a側から透過率T1でダイクロイックミラー201の内部に入射すると、裏面201bにおいて反射率R2で反射する。裏面201bにおける反射光は、さらに表面201aにおいて反射率R1で反射して、裏面201bを透過率T2で出射する。よって、第2の光路332を通った可視光L2は、次式(7)のように表される。

L2=L0×T1×R2×R1×T2 …(7)

L2=L0×T1×R2×R1×T2 …(7)

上式(6),(7)によると、第2の光路332による二重像の光量は、第1の光路331による本来の可視光像の光量よりも倍率R2×R1分、小さくなる。よって、ダイクロイックミラー201(本体)の可視光の反射率R1が95%以上であった場合でも、例えば裏面201bの反射率R2=1%とすることで、二重像の光量を、本来の可視光の光量の1%未満にまで低減することができる。

ダイクロイックミラー201の裏面201bの反射率R2は、5%以下であってもよい。また、多重像を回避する観点からは、ダイクロイックミラー201の厚さが薄いことが望ましい(例えば5mm以下)。また、以上のようなダイクロイックミラー201の構成によると、プロジェクタ220からの投影光による多重像についても低減することができる。

3.まとめ

以上のように、本実施形態の手術支援システム100における投影装置の一例の撮像照射装置200は、IRセンサ211と、プロジェクタ220と、RGBセンサ212と、ズームレンズ215と、ダイクロイックミラー201と、遮光部202とを備える。IRセンサ211は、非可視光における被写体136の非可視光画像を撮像する非可視撮像部の一例である。プロジェクタ220は、非可視光画像に基づく投影画像G320を可視光で被写体136に投影する投影部の一例である。RGBセンサ212は、可視光において投影画像G320が投影された被写体136を撮像する可視撮像部の一例である。ズームレンズ215は、IRセンサ211及びRGBセンサ212に集光する光量を調整する絞り214を備える撮像光学系の一例である。ダイクロイックミラー201は、ズームレンズ215に入射する光を導光すると共にプロジェクタ220から出射する光を導光する導光部の一例である。遮光部202は、ダイクロイックミラー201から空間をあけて配置される。ズームレンズ215の被写界深度の範囲内に被写体136が配置された状態において、被写界深度の近点P10からズームレンズ215までの光学距離(a-c)と、遮光部202からズームレンズ215までの光学距離bとの間の距離差が、被写体136の前方被写界深度cよりも長くなるように、絞り214の絞り値が設定されている(式(2)参照)。

以上のように、本実施形態の手術支援システム100における投影装置の一例の撮像照射装置200は、IRセンサ211と、プロジェクタ220と、RGBセンサ212と、ズームレンズ215と、ダイクロイックミラー201と、遮光部202とを備える。IRセンサ211は、非可視光における被写体136の非可視光画像を撮像する非可視撮像部の一例である。プロジェクタ220は、非可視光画像に基づく投影画像G320を可視光で被写体136に投影する投影部の一例である。RGBセンサ212は、可視光において投影画像G320が投影された被写体136を撮像する可視撮像部の一例である。ズームレンズ215は、IRセンサ211及びRGBセンサ212に集光する光量を調整する絞り214を備える撮像光学系の一例である。ダイクロイックミラー201は、ズームレンズ215に入射する光を導光すると共にプロジェクタ220から出射する光を導光する導光部の一例である。遮光部202は、ダイクロイックミラー201から空間をあけて配置される。ズームレンズ215の被写界深度の範囲内に被写体136が配置された状態において、被写界深度の近点P10からズームレンズ215までの光学距離(a-c)と、遮光部202からズームレンズ215までの光学距離bとの間の距離差が、被写体136の前方被写界深度cよりも長くなるように、絞り214の絞り値が設定されている(式(2)参照)。

以上の投影装置によると、非可視光の撮像画像に基づく可視光の投影画像を投影する際に、遮光部202近傍における塵埃などの反射像を飛ばして、可視光における撮像を精度良く行うことができる。

本実施形態において、絞り214の絞り値は、上記の距離差が、特に被写体136の位置に依らず、ズームレンズ215の被写界深度dよりも長くなるように設定されていてもよい。遮光部距離bが被写界深度dの長さ以上、被写界深度dの近点P10から離れていることにより、塵埃などの反射像を充分に飛ばすことができる。

また、本実施形態において、絞り214は、被写界深度dが所定長さ(仕様値d0)以上となる範囲内で絞られている(開放されている)(式(4)参照)。これにより、手術支援システム100の扱い易さを確保しながら、可視光における撮像を精度良く行うことができる。

また、本実施形態において、絞り214の絞り値は、ズームレンズ215の焦点距離fと、被写界深度dと、許容錯乱円径εと、被写界深度dの範囲内に配置された被写体136とズームレンズ215間の光学距離aと、遮光部202とズームレンズ215間の光学距離bと、2以上の数nとに基づき、式(3)及び(5)を満たすF値で規定されてもよい。これにより、手術支援システム100の扱い易さを確保しながら、可視光における撮像を精度良く行うことができる。

また、本実施形態において、導光部は、可視光の反射率R1よりも小さい範囲内で可視光を透過する透過率T1を有するダイクロイックミラー201で構成される。ダイクロイックミラー201は、外部からの光を透過してズームレンズ215に導光すると共に、プロジェクタ220からの光を反射して外部に導光するように配置される。透過率T1は、5%以下であってもよい。

また、本実施形態において、ダイクロイックミラー201は、所定の厚さで対向する2つの主面201a,201bを有する。ダイクロイックミラー201は、2つの主面201a,201bにおいてプロジェクタ220よりもズームレンズ215に近い側の主面201bは、可視光が当該主面201bにおいて反射する反射率R2が、他方の主面201aにおける反射率R1よりも小さくなるように構成される。これにより、ダイクロイックミラー201における多重像を抑制して、可視撮像の精度を良くすることができる。可視光がダイクロイックミラー201におけるズームレンズ215に近い側の主面201bにおいて反射する反射率は、5%以下であってもよい。

また、本実施形態において、遮光部202は、可視光の反射率が3%以下の黒色部材を含む。これにより、迷光325の総量を低減して、可視光画像のコントラストを良くすることができる。

また、本実施形態における投影装置は、被写体136に非可視光の蛍光310を発光させる励起光300を照射する励起光源230をさらに備えてもよい。IRセンサ211は、非可視光画像として蛍光を発光した被写体の画像を撮像する。投影装置は、励起光300と同じ波長帯の光を遮断し、蛍光310と同じ波長帯の光および可視光を透過する光学フィルタ216をさらに備えてもよい。

(他の実施の形態)

以上のように、本出願において開示する技術の例示として、実施の形態1を説明した。しかしながら、本開示における技術は、これに限定されず、適宜、変更、置き換え、付加、省略などを行った実施の形態にも適用可能である。また、上記の実施の形態1で説明した各構成要素を組み合わせて、新たな実施の形態とすることも可能である。そこで、以下、他の実施の形態を例示する。

以上のように、本出願において開示する技術の例示として、実施の形態1を説明した。しかしながら、本開示における技術は、これに限定されず、適宜、変更、置き換え、付加、省略などを行った実施の形態にも適用可能である。また、上記の実施の形態1で説明した各構成要素を組み合わせて、新たな実施の形態とすることも可能である。そこで、以下、他の実施の形態を例示する。

上記の実施形態1では、導光部の一例としてダイクロイックミラー201について説明した。本開示における導光部はダイクロイックミラー201に限らず、例えば偏光プリズムであってもよい。この場合、適宜、位相板(1/4λ板)や偏光板を組み合わせてもよい。また、導光部は、赤外光等の非可視光を反射し、可視光を主に透過するダイクロイックミラーであってもよい。この場合、プロジェクタ220とカメラ210との相対位置が、図1の場合とは入れ替えられる。

また、上記の各実施形態では、非可視光の一例として赤外光を説明したが、非可視光は赤外光に限らず、紫外光であってもよい。また、非可視光は、必ずしも非可視領域の波長帯を有する光に限らず、例えば青色領域の励起光に基づき発光する赤色領域の微弱な蛍光などを含んでもよい。この際、投影画像及び可視撮像の対象とする可視光は、緑色光等であってもよい。

また、上記の各実施形態では、医療用途における投影装置の適用例を説明したが、本開示における表示システムはこれには限定されない。例えば、工事現場や採掘現場、建築現場、材料を加工する工場など、目視では状態変化を確認できないような対象物に対して作業を行う必要がある場合、本開示における投影装置を適用することができる。

具体的には、工事現場や採掘現場、建築現場、材料を加工する工場などにおける、目視では状態変化を確認できないような対象物に蛍光材料を塗布し、練りこみ、或いは流し込んで、カメラ210による撮像の対象としてもよい。

以上のように、本開示における技術の例示として、実施の形態を説明した。そのために、添付図面および詳細な説明を提供した。

したがって、添付図面および詳細な説明に記載された構成要素の中には、課題解決のために必須な構成要素だけでなく、上記技術を例示するために、課題解決のためには必須でない構成要素も含まれ得る。そのため、それらの必須ではない構成要素が添付図面や詳細な説明に記載されていることをもって、直ちに、それらの必須ではない構成要素が必須であるとの認定をするべきではない。

また、上述の実施の形態は、本開示における技術を例示するためのものであるから、特許請求の範囲またはその均等の範囲において、種々の変更、置き換え、付加、省略などを行うことができる。

本開示における投影装置は、医療用途、工事現場、採掘現場、建築現場、材料を加工する工場など、目視では状態変化を確認しづらいような被写体に対して作業を行う際に適用可能である。

Claims (10)

- 非可視光における被写体の非可視光画像を撮像する非可視撮像部と、

前記非可視光画像に基づく投影画像を可視光で前記被写体に投影する投影部と、

可視光において前記投影画像が投影された前記被写体を撮像する可視撮像部と、

前記非可視撮像部及び前記可視撮像部に集光する光量を調整する絞りを備える撮像光学系と、

前記撮像光学系に入射する光を導光すると共に前記投影部から出射する光を導光する導光部と、

前記導光部から空間をあけて配置された遮光部とを備え、

前記撮像光学系の被写界深度の範囲内に前記被写体が配置された状態において、前記被写界深度の近点から前記撮像光学系までの光学距離と、前記遮光部から前記撮像光学系までの光学距離との間の距離差が、前記被写体の前方被写界深度よりも長くなるように、前記絞りの絞り値が設定された

投影装置。 - 前記絞り値は、前記距離差が、前記撮像光学系の被写界深度よりも長くなるように設定された

請求項1に記載の投影装置。 - 前記絞りは、前記被写界深度が所定長さ以上となる範囲内で絞られている

請求項1に記載の投影装置。 - 前記絞り値は、前記撮像光学系の焦点距離fと、被写界深度dと、許容錯乱円径εと、前記被写界深度dの範囲内に配置された被写体と前記撮像光学系間の光学距離aと、前記遮光部と前記撮像光学系間の光学距離bと、2以上の数nとに基づき、式(1)及び(2)を満たすF値で規定される

請求項1に記載の投影装置。

F<f2×(a-b)/[a×ε×{(n-1)a+b}] (1)

F>f2×d/{a×ε×(2a-d)} (2) - 前記導光部は、

可視光の反射率よりも小さい範囲内で可視光を透過する透過率を有するダイクロイックミラーで構成され、

外部からの光を透過して前記撮像光学系に導光すると共に、前記投影部からの光を反射して外部に導光するように配置される

請求項1~4のいずれか1項に記載の投影装置。 - 前記透過率は、5%以下である

請求項5に記載の投影装置。 - 前記導光部は、所定の厚さで対向する2つの主面を有し、

前記2つの主面において前記投影部よりも前記撮像光学系に近い側の主面は、可視光が当該主面において反射する反射率が、他方の主面における反射率よりも小さくなるように構成される

請求項5又は6に記載の投影装置。 - 可視光が前記導光部における前記撮像光学系に近い側の主面において反射する反射率は、5%以下である

請求項7に記載の投影装置。 - 前記遮光部は、可視光の反射率が3%以下の黒色部材を含む

請求項1~8のいずれか1項に記載の投影装置。 - 前記被写体に非可視光の蛍光を発光させる励起光を照射する励起光源をさらに備え、

前記非可視撮像部は、前記非可視光画像として前記蛍光を発光した被写体の画像を撮像する

請求項1~9のいずれか1項に記載の投影装置。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2019555342A JP6921987B2 (ja) | 2017-11-27 | 2018-11-21 | 投影装置 |

| EP18881790.2A EP3701901B1 (en) | 2017-11-27 | 2018-11-21 | Projection device |

| US16/881,490 US11140371B2 (en) | 2017-11-27 | 2020-05-22 | Projection device |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017227164 | 2017-11-27 | ||

| JP2017-227164 | 2017-11-27 |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| US16/881,490 Continuation US11140371B2 (en) | 2017-11-27 | 2020-05-22 | Projection device |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2019103052A1 true WO2019103052A1 (ja) | 2019-05-31 |

Family

ID=66631482

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2018/043036 WO2019103052A1 (ja) | 2017-11-27 | 2018-11-21 | 投影装置 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US11140371B2 (ja) |

| EP (1) | EP3701901B1 (ja) |

| JP (1) | JP6921987B2 (ja) |

| WO (1) | WO2019103052A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP3968628A4 (en) * | 2019-06-25 | 2022-10-12 | Panasonic Intellectual Property Management Co., Ltd. | PROJECTION SYSTEM |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN113974832B (zh) * | 2021-12-01 | 2023-01-24 | 辽宁北镜医疗科技有限公司 | 具有投影导航功能的近红外荧光手术导航系统及方法 |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0714412U (ja) * | 1993-08-05 | 1995-03-10 | 株式会社ニコン | 落射照明装置 |

| US20080004533A1 (en) | 2006-06-30 | 2008-01-03 | General Electric Company | Optical imaging systems and methods |

| JP2012018293A (ja) * | 2010-07-08 | 2012-01-26 | Seiko Epson Corp | プロジェクター |

| WO2015072047A1 (ja) * | 2013-11-14 | 2015-05-21 | パナソニックIpマネジメント株式会社 | 投影システム |

| WO2017043539A1 (ja) * | 2015-09-11 | 2017-03-16 | 国立研究開発法人産業技術総合研究所 | 画像処理システム、画像処理装置、投影装置、及び投影方法 |

Family Cites Families (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|