KR20170136920A - 화면 출력 방법 및 이를 지원하는 전자 장치 - Google Patents

화면 출력 방법 및 이를 지원하는 전자 장치 Download PDFInfo

- Publication number

- KR20170136920A KR20170136920A KR1020160069091A KR20160069091A KR20170136920A KR 20170136920 A KR20170136920 A KR 20170136920A KR 1020160069091 A KR1020160069091 A KR 1020160069091A KR 20160069091 A KR20160069091 A KR 20160069091A KR 20170136920 A KR20170136920 A KR 20170136920A

- Authority

- KR

- South Korea

- Prior art keywords

- electronic device

- image

- processor

- display

- output

- Prior art date

Links

- 238000000034 method Methods 0.000 title claims description 37

- 230000001133 acceleration Effects 0.000 claims description 13

- 239000000284 extract Substances 0.000 claims description 13

- 230000008859 change Effects 0.000 description 28

- 238000004891 communication Methods 0.000 description 28

- 230000006870 function Effects 0.000 description 17

- 238000010586 diagram Methods 0.000 description 15

- 230000008569 process Effects 0.000 description 9

- 230000001413 cellular effect Effects 0.000 description 8

- 239000003086 colorant Substances 0.000 description 8

- 238000007726 management method Methods 0.000 description 8

- 238000012545 processing Methods 0.000 description 7

- 230000014509 gene expression Effects 0.000 description 5

- 230000033001 locomotion Effects 0.000 description 5

- 238000005259 measurement Methods 0.000 description 5

- 230000003287 optical effect Effects 0.000 description 5

- 230000004044 response Effects 0.000 description 4

- 238000001914 filtration Methods 0.000 description 3

- WQZGKKKJIJFFOK-GASJEMHNSA-N Glucose Natural products OC[C@H]1OC(O)[C@H](O)[C@@H](O)[C@@H]1O WQZGKKKJIJFFOK-GASJEMHNSA-N 0.000 description 2

- 239000008280 blood Substances 0.000 description 2

- 210000004369 blood Anatomy 0.000 description 2

- 230000000295 complement effect Effects 0.000 description 2

- 230000000694 effects Effects 0.000 description 2

- 230000002708 enhancing effect Effects 0.000 description 2

- 238000000605 extraction Methods 0.000 description 2

- 239000008103 glucose Substances 0.000 description 2

- YCISZOVUHXIOFY-HKXOFBAYSA-N Halopredone acetate Chemical compound C1([C@H](F)C2)=CC(=O)C(Br)=C[C@]1(C)[C@]1(F)[C@@H]2[C@@H]2CC[C@](OC(C)=O)(C(=O)COC(=O)C)[C@@]2(C)C[C@@H]1O YCISZOVUHXIOFY-HKXOFBAYSA-N 0.000 description 1

- 238000002583 angiography Methods 0.000 description 1

- 238000003491 array Methods 0.000 description 1

- 238000013473 artificial intelligence Methods 0.000 description 1

- 230000005540 biological transmission Effects 0.000 description 1

- 230000036772 blood pressure Effects 0.000 description 1

- 230000036760 body temperature Effects 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 230000007613 environmental effect Effects 0.000 description 1

- 239000000446 fuel Substances 0.000 description 1

- 239000011521 glass Substances 0.000 description 1

- 238000005286 illumination Methods 0.000 description 1

- 238000003384 imaging method Methods 0.000 description 1

- 230000006698 induction Effects 0.000 description 1

- 238000009434 installation Methods 0.000 description 1

- 230000002452 interceptive effect Effects 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 238000010295 mobile communication Methods 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 229920001690 polydopamine Polymers 0.000 description 1

- 238000011084 recovery Methods 0.000 description 1

- 230000000284 resting effect Effects 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

- 238000005406 washing Methods 0.000 description 1

- XLYOFNOQVPJJNP-UHFFFAOYSA-N water Substances O XLYOFNOQVPJJNP-UHFFFAOYSA-N 0.000 description 1

- 229910052724 xenon Inorganic materials 0.000 description 1

- FHNFHKCVQCLJFQ-UHFFFAOYSA-N xenon atom Chemical compound [Xe] FHNFHKCVQCLJFQ-UHFFFAOYSA-N 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/033—Pointing devices displaced or positioned by the user, e.g. mice, trackballs, pens or joysticks; Accessories therefor

- G06F3/0346—Pointing devices displaced or positioned by the user, e.g. mice, trackballs, pens or joysticks; Accessories therefor with detection of the device orientation or free movement in a 3D space, e.g. 3D mice, 6-DOF [six degrees of freedom] pointers using gyroscopes, accelerometers or tilt-sensors

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/40—Analysis of texture

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/97—Determining parameters from multiple pictures

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/50—Constructional details

- H04N23/54—Mounting of pick-up tubes, electronic image sensors, deviation or focusing coils

-

- H04N5/225—

-

- H04N5/2253—

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10004—Still image; Photographic image

Abstract

본 발명의 다양한 실시 예에 따른 전자 장치는 이미지를 촬영할 수 있는 카메라 모듈, 전자 장치 또는 외부 객체에 관한 신호를 인식할 수 있는 센서 모듈, 컨텐츠를 출력할 수 있는 제1 디스플레이 및 제2 디스플레이, 메모리 및 상기 카메라 모듈, 상기 제1 디스플레이, 제2 디스플레이 및 상기 메모리와 전기적으로 연결되는 프로세서를 포함하고, 상기 프로세서는 상기 전자 장치가 제1 상태에 진입하는지를 확인하고, 상기 제1 상태에 진입하면 상기 카메라 모듈을 이용하여 소스 이미지를 촬영하고, 상기 소스 이미지를 기반으로 상기 제1 디스플레이에 출력되는 제1 출력 이미지, 또는 상기 제2 디스플레이에 출력되는 제2 출력 이미지를 생성할 수 있다. 이 외에도 명세서를 통해 파악되는 다양한 실시 예가 가능하다.

Description

본 문서의 다양한 실시 예는 전자 장치에서 화면을 통해 컨텐츠를 출력하는 방법 및 이를 지원하는 전자 장치에 관한 것이다.

스마트폰, 태블릿 PC 등과 같은 전자 장치는 무선 데이터 통신, 동영상 재생, 인터넷 검색 등 다양한 기능을 수행할 수 있다. 전자 장치는 동작에 따라 다양한 화면을 출력할 수 있다. 예를 들어, 전자 장치는 홈 화면, 잠금 화면, 어플리케이션 실행 화면 등을 출력할 수 있다

종래 기술에 따른 전자 장치는 주변의 환경에 대응하여 홈 화면, 잠금 화면, 스크린 오프 상태 등이 변경되지 않고, 사용자가 설정한 화면 또는 전자 장치에서 기본 설정된 화면이 출력되는 방식으로 동작한다. 상기 전자 장치는 디스플레이 영역이 넓어지는 추세에 따라 디스플레이의 사용 방식이 다양하지 않고, 사용자에게 주변의 변화하는 상황에 따른 다양한 사용자 경험을 제공할 수 없다.

본 발명의 다양한 실시 예에 따른 전자 장치는 이미지를 촬영할 수 있는 카메라 모듈, 전자 장치 또는 외부 객체에 관한 신호를 인식할 수 있는 센서 모듈, 컨텐츠를 출력할 수 있는 제1 디스플레이 및 제2 디스플레이, 메모리 및 상기 카메라 모듈, 상기 제1 디스플레이, 제2 디스플레이 및 상기 메모리와 전기적으로 연결되는 프로세서를 포함하고, 상기 프로세서는 상기 전자 장치가 제1 상태에 진입하는지를 확인하고, 상기 제1 상태에 진입하면 상기 카메라 모듈을 이용하여 소스 이미지를 촬영하고, 상기 소스 이미지를 기반으로 상기 제1 디스플레이에 출력되는 제1 출력 이미지, 또는 상기 제2 디스플레이에 출력되는 제2 출력 이미지를 생성할 수 있다.

본 발명의 다양한 실시 예에 따른 화면 출력 방법 및 이를 지원하는 전자 장치는 카메라 모듈 또는 센서 모듈을 이용하여 주변의 환경을 인식하고, 자동으로 주변의 색 또는 무늬와 동일 또는 유사한 이미지를 복수의 디스플레이들에 출력할 수 있다.

본 발명의 다양한 실시 예에 따른 화면 출력 방법 및 이를 지원하는 전자 장치는 배경 화면, 팝업 화면 등이 주변 환경과 어울리는 다양한 화면으로 출력되어 감성적인 사용자 경험을 제공할 수 있다.

도 1은 다양한 실시 예에 따른 전자 장치의 블럭도를 도시한다.

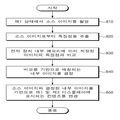

도 2는 다양한 실시 예에 따른 카메라 모듈을 이용한 화면 표시 방법을 설명하는 순서도이다.

도 3은 다양한 실시 예에 따른 화면 출력 방법을 설명하는 화면 예시도이다.

도 4는 다양한 실시 예에 따른 소스 이미지를 제1 디스플레이의 배경 이미지로 활용하는 화면 예시도이다.

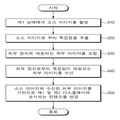

도 5는 다양한 실시 예에 따른 전자 장치의 복수의 상태들을 인식하여 화면을 출력하는 방법을 설명하는 순서도이다.

도 6은 다양한 실시 예에 따른 복수의 상태들에서 추출하는 예시도이다.

도 7은 다양한 실시 예에 따른 소스 이미지에서 추출된 특징점을 적용하는 화면 예시도이다.

도 8은 다양한 실시 예에 따른 내부 이미지를 이용하는 화면 출력 방법을 설명하는 순서도이다.

도 9는 다양한 실시 예에 따른 외부 이미지를 이용하는 화면 출력 방법을 설명하는 순서도이다.

도 10는 다양한 실시 예에 따른 제2 디스플레이에 제2 출력 이미지를 적용한 예시도이다.

도 11은 다양한 실시 예에 따른 제1 및 제2 출력 이미지의 동적 변화를 설명하는 화면 예시도 이다.

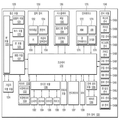

도 12는 다양한 실시 예에 따른 전자 장치의 블록도를 나타낸다.

도 13은 다양한 실시 예에 따른 프로그램 모듈의 블록도를 나타낸다.

도 2는 다양한 실시 예에 따른 카메라 모듈을 이용한 화면 표시 방법을 설명하는 순서도이다.

도 3은 다양한 실시 예에 따른 화면 출력 방법을 설명하는 화면 예시도이다.

도 4는 다양한 실시 예에 따른 소스 이미지를 제1 디스플레이의 배경 이미지로 활용하는 화면 예시도이다.

도 5는 다양한 실시 예에 따른 전자 장치의 복수의 상태들을 인식하여 화면을 출력하는 방법을 설명하는 순서도이다.

도 6은 다양한 실시 예에 따른 복수의 상태들에서 추출하는 예시도이다.

도 7은 다양한 실시 예에 따른 소스 이미지에서 추출된 특징점을 적용하는 화면 예시도이다.

도 8은 다양한 실시 예에 따른 내부 이미지를 이용하는 화면 출력 방법을 설명하는 순서도이다.

도 9는 다양한 실시 예에 따른 외부 이미지를 이용하는 화면 출력 방법을 설명하는 순서도이다.

도 10는 다양한 실시 예에 따른 제2 디스플레이에 제2 출력 이미지를 적용한 예시도이다.

도 11은 다양한 실시 예에 따른 제1 및 제2 출력 이미지의 동적 변화를 설명하는 화면 예시도 이다.

도 12는 다양한 실시 예에 따른 전자 장치의 블록도를 나타낸다.

도 13은 다양한 실시 예에 따른 프로그램 모듈의 블록도를 나타낸다.

이하, 본 문서의 다양한 실시 예들이 첨부된 도면을 참조하여 기재된다. 실시 예 및 이에 사용된 용어들은 본 문서에 기재된 기술을 특정한 실시 형태에 대해 한정하려는 것이 아니며, 해당 실시 예의 다양한 변경, 균등물, 및/또는 대체물을 포함하는 것으로 이해되어야 한다. 도면의 설명과 관련하여, 유사한 구성요소에 대해서는 유사한 참조 부호가 사용될 수 있다. 단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함할 수 있다. 본 문서에서, "A 또는 B" 또는 "A 및/또는 B 중 적어도 하나" 등의 표현은 함께 나열된 항목들의 모든 가능한 조합을 포함할 수 있다. "제 1," "제 2," "첫째," 또는 "둘째,"등의 표현들은 해당 구성요소들을, 순서 또는 중요도에 상관없이 수식할 수 있고, 한 구성요소를 다른 구성요소와 구분하기 위해 사용될 뿐 해당 구성요소들을 한정하지 않는다. 어떤(예: 제 1) 구성요소가 다른(예: 제 2) 구성요소에 "(기능적으로 또는 통신적으로) 연결되어" 있다거나 "접속되어" 있다고 언급된 때에는, 상기 어떤 구성요소가 상기 다른 구성요소에 직접적으로 연결되거나, 다른 구성요소(예: 제 3 구성요소)를 통하여 연결될 수 있다.

본 문서에서, "~하도록 구성된(또는 설정된)(configured to)"은 상황에 따라, 예를 들면, 하드웨어적 또는 소프트웨어적으로 "~에 적합한," "~하는 능력을 가지는," "~하도록 변경된," "~하도록 만들어진," "~를 할 수 있는," 또는 "~하도록 설계된"과 상호 호환적으로(interchangeably) 사용될 수 있다. 어떤 상황에서는, "~하도록 구성된 장치"라는 표현은, 그 장치가 다른 장치 또는 부품들과 함께 "~할 수 있는" 것을 의미할 수 있다. 예를 들면, 문구 "A, B, 및 C를 수행하도록 구성된(또는 설정된) 프로세서"는 해당 동작을 수행하기 위한 전용 프로세서(예: 임베디드 프로세서), 또는 메모리 장치에 저장된 하나 이상의 소프트웨어 프로그램들을 실행함으로써, 해당 동작들을 수행할 수 있는 범용 프로세서(예: CPU 또는 application processor)를 의미할 수 있다.

본 문서의 다양한 실시 예들에 따른 전자 장치는, 예를 들면, 스마트폰, 태블릿 PC, 이동 전화기, 영상 전화기, 전자책 리더기, 데스크탑 PC, 랩탑 PC, 넷북 컴퓨터, 워크스테이션, 서버, PDA, PMP(portable multimedia player), MP3 플레이어, 의료기기, 카메라, 또는 웨어러블 장치 중 적어도 하나를 포함할 수 있다. 웨어러블 장치는 액세서리형(예: 시계, 반지, 팔찌, 발찌, 목걸이, 안경, 콘택트 렌즈, 또는 머리 착용형 장치(head-mounted-device(HMD)), 직물 또는 의류 일체형(예: 전자 의복), 신체 부착형(예: 스킨 패드 또는 문신), 또는 생체 이식형 회로 중 적어도 하나를 포함할 수 있다. 어떤 실시 예들에서, 전자 장치는, 예를 들면, 텔레비전, DVD(digital video disk) 플레이어, 오디오, 냉장고, 에어컨, 청소기, 오븐, 전자레인지, 세탁기, 공기 청정기, 셋톱 박스, 홈 오토매이션 컨트롤 패널, 보안 컨트롤 패널, 미디어 박스(예: 삼성 HomeSyncTM, 애플TVTM, 또는 구글 TVTM), 게임 콘솔(예: XboxTM, PlayStationTM), 전자 사전, 전자 키, 캠코더, 또는 전자 액자 중 적어도 하나를 포함할 수 있다.

다른 실시 예에서, 전자 장치는, 각종 의료기기(예: 각종 휴대용 의료측정기기(혈당 측정기, 심박 측정기, 혈압 측정기, 또는 체온 측정기 등), MRA(magnetic resonance angiography), MRI(magnetic resonance imaging), CT(computed tomography), 촬영기, 또는 초음파기 등), 네비게이션 장치, 위성 항법 시스템(GNSS(global navigation satellite system)), EDR(event data recorder), FDR(flight data recorder), 자동차 인포테인먼트 장치, 선박용 전자 장비(예: 선박용 항법 장치, 자이로 콤파스 등), 항공 전자기기(avionics), 보안 기기, 차량용 헤드 유닛(head unit), 산업용 또는 가정용 로봇, 드론(drone), 금융 기관의 ATM, 상점의 POS(point of sales), 또는 사물 인터넷 장치 (예: 전구, 각종 센서, 스프링클러 장치, 화재 경보기, 온도조절기, 가로등, 토스터, 운동기구, 온수탱크, 히터, 보일러 등) 중 적어도 하나를 포함할 수 있다. 어떤 실시 예에 따르면, 전자 장치는 가구, 건물/구조물 또는 자동차의 일부, 전자 보드(electronic board), 전자 사인 수신 장치(electronic signature receiving device), 프로젝터, 또는 각종 계측 기기(예: 수도, 전기, 가스, 또는 전파 계측 기기 등) 중 적어도 하나를 포함할 수 있다. 다양한 실시 예에서, 전자 장치는 플렉서블하거나, 또는 전술한 다양한 장치들 중 둘 이상의 조합일 수 있다. 본 문서의 실시 예에 따른 전자 장치는 전술한 기기들에 한정되지 않는다. 본 문서에서, 사용자라는 용어는 전자 장치를 사용하는 사람 또는 전자 장치를 사용하는 장치(예: 인공지능 전자 장치)를 지칭할 수 있다.

도 1을 참조하여, 다양한 실시 예에서의, 네트워크 환경(100) 내의 전자 장치(101)가 기재된다. 전자 장치(101)는 버스(110), 프로세서(120), 메모리(130), 입출력 인터페이스(150), 디스플레이(160), 및 통신 인터페이스(170)를 포함할 수 있다. 어떤 실시 예에서는, 전자 장치(101)는, 구성요소들 중 적어도 하나를 생략하거나 다른 구성요소를 추가적으로 구비할 수 있다.

버스(110)는 구성요소들(110-170)을 서로 연결하고, 구성요소들 간의 통신(예: 제어 메시지 또는 데이터)을 전달하는 회로를 포함할 수 있다. 프로세서(120)는, 중앙처리장치, 어플리케이션 프로세서, 또는 커뮤니케이션 프로세서(communication processor(CP)) 중 하나 또는 그 이상을 포함할 수 있다.

프로세서(120)는, 예를 들면, 전자 장치(101)의 적어도 하나의 다른 구성요소들의 제어 및/또는 통신에 관한 연산이나 데이터 처리를 실행할 수 있다.

다양한 실시 예에 따르면, 프로세서(120)는 카메라 모듈(180) 또는 센서 모듈(190)을 이용하여, 전자 장치(101) 주변의 변화를 인식할 수 있다. 프로세서(120)는 인식된 정보를 기반으로 디스플레이(160)을 통해 출력되는 컨텐츠를 변경할 수 있다. 예를 들어, 프로세서(120)는 전자 장치(101)이 놓여 있는 바닥면의 이미지를 촬영할 수 있다. 프로세서(120)는 바닥면의 이미지에서 대표 색상 또는 대표 무늬 등을 추출하여, 디스플레이(160)에서 출력되는 배경 이미지를 바닥면의 특징점(예: 색상 또는 무늬)과 동일하도록 변경할 수 있다. 프로세서(120)가 전자 장치(101) 주변의 환경 변화를 기반으로 컨텐츠를 변경하는 화면 출력 방법에 관한 추가 정보는 도 2 내지 도 11을 통해 제공될 수 있다.

메모리(130)는, 휘발성 및/또는 비휘발성 메모리를 포함할 수 있다. 메모리(130)는, 예를 들면, 전자 장치(101)의 적어도 하나의 다른 구성요소에 관계된 명령 또는 데이터를 저장할 수 있다.

한 실시 예에 따르면, 메모리(130)는 소프트웨어 및/또는 프로그램(140)을 저장할 수 있다. 프로그램(140)은, 예를 들면, 커널(141), 미들웨어(143), 어플리케이션 프로그래밍 인터페이스(API)(145), 및/또는 어플리케이션 프로그램(또는 "어플리케이션")(147) 등을 포함할 수 있다. 커널(141), 미들웨어(143), 또는 API(145)의 적어도 일부는, 운영 시스템으로 지칭될 수 있다. 커널(141)은, 예를 들면, 다른 프로그램들(예: 미들웨어(143), API(145), 또는 어플리케이션 프로그램(147))에 구현된 동작 또는 기능을 실행하는 데 사용되는 시스템 리소스들(예: 버스(110), 프로세서(120), 또는 메모리(130) 등)을 제어 또는 관리할 수 있다. 또한, 커널(141)은 미들웨어(143), API(145), 또는 어플리케이션 프로그램(147)에서 전자 장치(101)의 개별 구성요소에 접근함으로써, 시스템 리소스들을 제어 또는 관리할 수 있는 인터페이스를 제공할 수 있다.

미들웨어(143)는, 예를 들면, API(145) 또는 어플리케이션 프로그램(147)이 커널(141)과 통신하여 데이터를 주고받을 수 있도록 중개 역할을 수행할 수 있다. 또한, 미들웨어(143)는 어플리케이션 프로그램(147)으로부터 수신된 하나 이상의 작업 요청들을 우선 순위에 따라 처리할 수 있다. 예를 들면, 미들웨어(143)는 어플리케이션 프로그램(147) 중 적어도 하나에 전자 장치(101)의 시스템 리소스(예: 버스(110), 프로세서(120), 또는 메모리(130) 등)를 사용할 수 있는 우선 순위를 부여하고, 상기 하나 이상의 작업 요청들을 처리할 수 있다. API(145)는 어플리케이션(147)이 커널(141) 또는 미들웨어(143)에서 제공되는 기능을 제어하기 위한 인터페이스로, 예를 들면, 파일 제어, 창 제어, 영상 처리, 또는 문자 제어 등을 위한 적어도 하나의 인터페이스 또는 함수(예: 명령어)를 포함할 수 있다. 입출력 인터페이스(150)는, 예를 들면, 사용자 또는 다른 외부 기기로부터 입력된 명령 또는 데이터를 전자 장치(101)의 다른 구성요소(들)에 전달하거나, 또는 전자 장치(101)의 다른 구성요소(들)로부터 수신된 명령 또는 데이터를 사용자 또는 다른 외부 기기로 출력할 수 있다.

디스플레이(160)는, 예를 들면, 액정 디스플레이(LCD), 발광 다이오드(LED) 디스플레이, 유기 발광 다이오드(OLED) 디스플레이, 또는 마이크로 전자기계 시스템 (MEMS) 디스플레이, 또는 전자종이(electronic paper) 디스플레이를 포함할 수 있다. 디스플레이(160)는, 예를 들면, 사용자에게 각종 콘텐츠(예: 텍스트, 이미지, 비디오, 아이콘, 및/또는 심볼 등)을 표시할 수 있다. 디스플레이(160)는, 터치 스크린을 포함할 수 있으며, 예를 들면, 전자 펜 또는 사용자의 신체의 일부를 이용한 터치, 제스쳐, 근접, 또는 호버링 입력을 수신할 수 있다.

다양한 실시 예에 따르면, 디스플레이(160)는 제1 디스플레이(161) 및 제2 디스플레이(162)를 포함할 수 있다. 예를 들어, 제1 디스플레이(161)는 전자 장치(101)의 제1 면에 배치되는 메인 디스플레이일 수 있고, 제2 디스플레이(162)는 상기 제1 면과 다른 면에 배치되는 서브 디스플레이일 수 있다.

다양한 실시 예에 따르면, 제1 디스플레이(161) 및 제2 디스플레이(162)는 서로 다른 컨텐츠를 출력하도록 설정될 수 있다. 예를 들어, 제1 디스플레이(161)는 동영상을 재생할 수 있고, 제2 디스플레이(162)는 전자 장치(101)의 동영상을 제어하는 버튼(예: 재생 일시정지, 빨리 감기, 뒤로 감기 등)을 표시할 수 있다.

다양한 실시 예에 따르면, 제1 디스플레이(161) 및 제2 디스플레이(162)는 카메라 모듈(180)을 통해 수집된 소스 이미지와 연관된 이미지를 출력할 수 있다. 예를 들어, 제1 디스플레이(161)는 소스 이미지를 제1 필터를 이용하여 이미지 처리한 제1 이미지를 출력할 수 있고, 제2 디스플레이(162)는 소스 이미지를 제2 필터를 이용하여 이미지 처리한 제2 이미지를 출력할 수 있다. 제1 디스플레이(161) 및 제2 디스플레이(162)의 출력 방법에 관한 추가 정보는 도2 내지 도 11을 통해 제공될 수 있다.일 실시 예에 따르면, 제1 디스플레이(161) 및 제2 디스플레이(162)는 하나의 디스플레이 패널 상의 서로 다른 영역으로 구현될 수 있다. 예를 들어, 제1 디스플레이(161)는 전자 장치(101)의 전면 영역일 수 있고, 제2 디스플레이(162)는 전자 장치(101)의 엣지 영역 또는 측면 영역일 수 있다. 다른 일 실시 예에 따르면, 제1 디스플레이(161) 및 제2 디스플레이(162)는 서로 디스플레이 패널 상에 구현될 수 있다. 예를 들어, 제1 디스플레이(161)는 전자 장치(101)의 전면 디스플레이 패널을 통해 구현되고, 제2 디스플레이(162)는 전자 장치(101)의 후면 디스플레이 패널을 통해 구현될 수 있다.

이하에서는, 제1 디스플레이(161)가 전자 장치(101)의 전면 영역이고, 제2 디스플레이(162)가 전자 장치(101)의 엣지 영역인 경우를 중심으로 논의하지만, 이에 한정되는 것은 아니다. 복수의 디스플레이들을 포함하는 다양한 형태의 전자 장치에 적용될 수 있다.

통신 인터페이스(170)는, 예를 들면, 전자 장치(101)와 외부 장치(예: 제 1 외부 전자 장치(102), 제 2 외부 전자 장치(104), 또는 서버(106)) 간의 통신을 설정할 수 있다. 예를 들면, 통신 인터페이스(170)는 무선 통신 또는 유선 통신을 통해서 네트워크(162)에 연결되어 외부 장치(예: 제 2 외부 전자 장치(104) 또는 서버(106))와 통신할 수 있다.

무선 통신은, 예를 들면, LTE, LTE-A(LTE Advance), CDMA(code division multiple access), WCDMA(wideband CDMA), UMTS(universal mobile telecommunications system), WiBro(Wireless Broadband), 또는 GSM(Global System for Mobile Communications) 등 중 적어도 하나를 사용하는 셀룰러 통신을 포함할 수 있다. 한 실시 예에 따르면, 무선 통신은, 예를 들면, WiFi(wireless fidelity), 블루투스, 블루투스 저전력(BLE), 지그비(Zigbee), NFC(near field communication), 자력 시큐어 트랜스미션(Magnetic Secure Transmission), 라디오 프리퀀시(RF), 또는 보디 에어리어 네트워크(BAN) 중 적어도 하나를 포함할 수 있다. 한실시 예에 따르면, 무선 통신은 GNSS를 포함할 수 있다. GNSS는, 예를 들면, GPS(Global Positioning System), Glonass(Global Navigation Satellite System), Beidou Navigation Satellite System(이하 “Beidou”) 또는 Galileo, the European global satellite-based navigation system일 수 있다. 이하, 본 문서에서는, “GPS”는 “GNSS”와 상호 호환적으로 사용될 수 있다. 유선 통신은, 예를 들면, USB(universal serial bus), HDMI(high definition multimedia interface), RS-232(recommended standard232), 전력선 통신, 또는 POTS(plain old telephone service) 등 중 적어도 하나를 포함할 수 있다. 네트워크(162)는 텔레커뮤니케이션 네트워크, 예를 들면, 컴퓨터 네트워크(예: LAN 또는 WAN), 인터넷, 또는 텔레폰 네트워크 중 적어도 하나를 포함할 수 있다.

카메라 모듈(180)은 전자 장치(101)의 주변을 촬영할 수 있다. 촬영된 이미지는 디스플레이(160)를 통해 출력되는 컨텐츠의 출력 방식을 변경하는데 이용될 수 있다. 다양한 실시 예에서, 카메라 모듈(180)은 광학 렌즈를 포함할 수 있다. 예를 들어, 광학 렌즈를 이용하는 경우, 카메라 모듈(180)은 180도에서 220도 사이의 시야각을 이용하여 이미지를 촬영할 수 있다.

다양한 실시 예에서, 카메라 모듈(180)은 복수개일 수 있다. 예를 들어, 카메라 모듈(180)는 전자 장치(101)의 전면(디스플레이(160)가 배치되는 면)에 배치되는 전면 카메라 및 전자 장치(101)의 후면(디스플레이(160)가 배치되는 면의 반대면)에 배치되는 후면 카메라를 포함할 수 있다.

센서 모듈(190)은 전자 장치(101) 또는 전자 장치(101) 주변의 상태 에 관한 정보를 수집할 수 있다. 예를 들어, 센서 모듈(190)은 자이로 센서, 가속도 센서를 포함할 수 있고, 전자 장치(101)의 속도 변화, 가속도 변화 등을 인식할 수 있다. 다른 예를 들어, 센서 모듈(190)은 IR 센서, HRM 센서 등을 이용하여, 주변의 객체와 전자 장치(101) 사이의 거리를 인식할 수 있다.

제 1 및 제 2 외부 전자 장치(102, 104) 각각은 전자 장치(101)와 동일한 또는 다른 종류의 장치일 수 있다. 다양한 실시 예에 따르면, 전자 장치(101)에서 실행되는 동작들의 전부 또는 일부는 다른 하나 또는 복수의 전자 장치(예: 전자 장치(102,104), 또는 서버(106)에서 실행될 수 있다. 한 실시 예에 따르면, 전자 장치(101)가 어떤 기능이나 서비스를 자동으로 또는 요청에 의하여 수행해야 할 경우에, 전자 장치(101)는 기능 또는 서비스를 자체적으로 실행시키는 대신에 또는 추가적으로, 그와 연관된 적어도 일부 기능을 다른 장치(예: 전자 장치(102, 104), 또는 서버(106))에게 요청할 수 있다. 다른 전자 장치(예: 전자 장치(102, 104), 또는 서버(106))는 요청된 기능 또는 추가 기능을 실행하고, 그 결과를 전자 장치(101)로 전달할 수 있다. 전자 장치(101)는 수신된 결과를 그대로 또는 추가적으로 처리하여 요청된 기능이나 서비스를 제공할 수 있다. 이를 위하여, 예를 들면, 클라우드 컴퓨팅, 분산 컴퓨팅, 또는 클라이언트-서버 컴퓨팅 기술이 이용될 수 있다.

도 2는 다양한 실시 예에 따른 카메라 모듈을 이용한 화면 표시 방법을 설명하는 순서도이다.

도 2를 참조하면, 동작 210에서, 프로세서(120)는 전자 장치(101)가 제1 상태에 진입하는지를 확인할 수 있다. 일 실시 예에서, 상기 제1 상태는 전자 장치(101)가 별도의 움직임 없이 정지한 상태일 수 있다. 프로세서(120)는 센서 모듈(190)(예: 자이로 센서 또는 가속도 센서 등)의 측정값을 기반으로 전자 장치(101)이 정지된 상태인지를 결정할 수 있다.

동작 220에서, 프로세서(120)는 전자 장치(101)가 제1 상태에 진입하는 경우, 카메라 모듈(180)을 이용하여 소스 이미지를 촬영할 수 있다. 프로세서(120)는 별도의 사용자 입력 없어도, 전자 장치(101)가 제1 상태에 진입하면, 카메라 모듈(180)을 자동으로 실행하여 소스 이미지를 촬영할 수 있다. 상기 소스 이미지는 전자 장치(101) 주변의 객체에 대한 이미지를 포함할 수 있다.

예를 들어, 프로세서(120)는 전자 장치(101)의 후면 카메라를 이용하여, 전자 장치(101)이 놓여 있는 바닥면(예: 책상, 탁자 등)을 촬영하여 소스 이미지를 획득할 수 있다. 다른 예를 들어, 프로세서(120)는 전자 장치(101)의 전면 카메라를 이용하여, 전자 장치(101)의 전면에 배치되는 외부 객체(예: 사용자 얼굴, 천장, 하늘 등)을 촬영하여 소스 이미지로 활용할 수도 있다.

다양한 실시 예에서, 프로세서(120)는 연속 촬영을 통해 소스 이미지를 수집할 수 있다. 연속 촬영된 복수의 이미지들 중 적어도 일부는 소스 이미지로 결정될 수 있다. 예를 들어, 프로세서(120)는 복수의 이미지들 중 선명도가 높은 이미지를 소스 이미지로 결정할 수 있다. 다른 예를 들어, 프로세서(120)는 복수의 이미지들을 조합하여 소스 이미지를 결정할 수 있다.

다양한 실시 예에서, 프로세서(120)는 소스 이미지를 이미지 프로세싱하여, 특징점(예: 대표 색, 대표 무늬)을 추출할 수 있다. 예를 들어, 프로세서(120)는 필터링을 통해 소스 이미지의 중심 영역에서 대표 색, 대표 무늬를 추출할 수 있다.

다양한 실시 예에서, 프로세서(120)는 미리 설정된 필터를 이용하여 소스 이미지를 촬영할 수 있다. 프로세서(120)는 필터를 통해 특정 색상 또는 무늬로 구성된 소스 이미지를 생성할 수 있다. 이 경우, 프로세서(120)는 이미지 프로세싱을 통해 소스 이미지의 특징점을 추출하는 시간을 단축할 수 있다.

동작 230에서, 프로세서(120)는 상기 소스 이미지를 기반으로 제1 디스플레이(161) 및 제2 디스플레이(162))에 출력되는 컨텐츠를 변경할 수 있다. 프로세서(120)는 소스 이미지를 기반으로 제1 디스플레이(161)에 출력되는 제1 출력 이미지, 또는 제2 디스플레이에 출력되는 제2 출력 이미지(162)를 생성할 수 있다. 프로세서(120)는 제1 출력 이미지를 제1 디스플레이(161)에 적용하고, 제2 출력 이미지를 제2 디스플레이(162)에 적용할 수 있다.

예를 들어, 프로세서(120)는 소스 이미지를 제1 필터를 이용하여 이미지 처리한 제1 이미지를 제1 디스플레이(161)에 출력할 수 있고, 소스 이미지를 제2 필터를 이용하여 이미지 처리한 제2 이미지를 제2 디스플레이(162)에 출력할 수 있다. 다른 예를 들어, 프로세서(120)는 추출된 대표 색상을 이용하여, 제1 디스플레이(161)에 표시되는 홈 화면, 잠금 화면 등의 배경 이미지를 변경하고, 제2 디스플레이(162)에 표시되는 바로 가기 아이콘의 색상을 변경할 수 있다.

또 다른 실시 예에서, 프로세서(120)는 소스 이미지에서 추출된 무늬를 제1 디스플레이(161)에 표시되는 홈 화면, 잠금 화면, AOD 화면 등의 배경 이미지에 적용하고, 제2 디스플레이(162)에 표시되는 버튼을 추출된 무늬로 변경할 수 있다.

다양한 실시 예에서, 프로세서(120)는 제1 디스플레이(161) 및 제2 디스플레이(162)에 출력되는 컨텐츠의 적어도 일부가 전자 장치(101)이 놓여 있는 바닥면의 무늬 및 색상과 모두 동일(또는 유사)하도록 출력할 수 있다. 이를 통해, 전자 장치(101)는 주변 환경과 대응하여 화면 상의 컨텐츠가 변경되는 인터액티브(interactive)한 사용자 경험(user interface)를 제공할 수 있다.

다양한 실시 예에서, 프로세서(120)는 센서 모듈(190)을 통해 수집된 정보를 기반으로 출력되는 이미지(이하, 출력 이미지)를 변경할 수 있다. 예를 들어, 소스 이미지의 대표 색을 기반으로 출력 이미지를 생성하고, 조도 센서를 통해 인식된 값을 기반으로 출력 이미지의 밝기를 변경하여 출력할 수 있다. 프로세서(120)는 조도 센서를 이용하여 주기적으로 주변의 밝기를 측정하고, 측정값에 따라 출력 이미지의 밝기를 변경할 수 있다.

다양한 실시 예에서, 프로세서(120)는 생성된 출력 이미지를 별도의 파일로 저장할 수 있다. 출력 이미지는 메모리(160)에 저장되어 앨범 앱 등에서 이용될 수 있다. 사용자는 생성된 출력 이미지를 SNS에 공유하거나, 배경 이미지로 활용할 수 있다.

다양한 실시 예에 따르면, 프로세서(120)는 제1 디스플레이(161) 및 제2 디스플레이(162)에 표시되는 컨텐츠를 소스 이미지의 색상 또는 무늬와 결합하여 출력할 수 있다. 예를 들어, 제1 디스플레이(161)의 잠금 화면의 바탕 이미지가 소스 이미지의 대표색인 제1 색으로 변경되는 경우, 날짜 정보, 시간 정보, 날씨 정보 등의 텍스트 또는 아이콘은 제1 색에 대한 보색인 제2 색으로 표시되어, 사용자의 눈에 잘 보이도록 변경될 수 있다.

도 3은 다양한 실시 예에 따른 화면 출력 방법을 설명하는 화면 예시도이다. 도 3에서는 전자 장치(101)가 바닥면에 정지된 상태인 경우를 예시적으로 도시하였으나, 이에 한정되는 것은 아니다.

도 3을 참조하면, 제1 화면(301)에서, 전자 장치(101)는 바닥면(310)(예: 책상, 테이블 등)에 놓여 움직이지 않는 정지 상태일 수 있다. 바닥면(310)은 본래의 색 또는 무늬를 가지고 있을 수 있다.

전자 장치(101)가 바닥면(310)에 놓이기 전 상태 또는 바닥면(310)에 놓인 직후 상태에서, 제1 디스플레이(161a)는 바닥면(310)과 무관한 컨텐츠(예: 홈 화면, 잠금 화면, 앱 실행 화면, AOD 화면 등)를 출력하거나 별도 출력이 없는 상태(예: 스크린 오프 상태)일 수 있다. 예를 들어, 제1 디스플레이(161a)는 사용자가 설정한 배경 이미지 또는 전자 장치(101)에서 기본 설정된 배경 이미지를 출력하는 상태일 수 있다. 제2 디스플레이(162a)도 바닥면(310)과 무관한 컨텐츠(예: 앱 실행 아이콘, 바로 가기 아이콘, 터치 버튼 등)을 출력하거나 별도 출력이 없는 상태(예: 스크린 오프 상태)일 수 있다.

프로세서(120)는 전자 장치(101)가 지정된 시간(예: 0.5초) 동안 정지 상태가 유지되는 경우, 카메라 모듈(180)을 이용하여 바닥면(310)을 촬영할 수 있다. 예를 들어, 프로세서(120)는 후면 카메라(미도시, 제1 디스플레이(161a)가 장착된 면의 반대면에 장착된 카메라)를 이용하여, 전자 장치(101)가 놓여 있는 바닥면(310)을 촬영하여 소스 이미지를 획득할 수 있다.

다양한 실시 예에서, 프로세서(120)는 카메라 렌즈를 통해 유입되는 외부 빛이 부족한 것으로 판단되는 경우, 플래시 이용하여 소스 이미지를 촬영할 수 있다. 프로세서(120)는 소스 이미지로부터 특징점(예: 대표 색상 또는 무늬)을 추출하고, 추출된 특징점을 기반으로 출력 이미지를 생성할 수 있다.

다양한 실시 예에서, 프로세서(120)는 일반적인 사진 촬영과 달리, 제1 디스플레이(161a)에 촬영된 소스 이미지를 실시간으로 출력하지 않을 수 있다. 소스 이미지가 촬영되는 과정에서, 제1 디스플레이(161a)는 기존 상태(예: 홈 화면이 표시되는 상태, 화면 꺼짐 상태, 잠금 화면 상태)를 계속적으로 유지할 수 있다. 사용자는 소스 이미지가 촬영되는 과정을 인식하지 못하거나 관심을 갖지 않을 수 있다.

다양한 실시 예에서, 프로세서(120)는 연속 촬영을 통해 소스 이미지를 수집할 수 있다. 프로세서(120)는 복수의 이미지들을 복수의 이미지들을 이용하여, 대표색 추출, 무늬 추출의 정확성을 높일 수 있다.

다양한 실시 예에 따르면, 프로세서(120)는 전면 카메라(180a)를 이용하여 소스 이미지를 촬영될 수 있다. 이 경우, 전면 카메라(180a)는 전자 장치(101)의 전면에 배치되는 외부 객체(예: 사용자 얼굴, 천장, 하늘 등)을 촬영하여 소스 이미지로 활용할 수 있다.

제2 화면(302)에서, 소스 이미지를 이용하여 생성된 제1 출력 이미지는 제1 디스플레이(161b)에 출력될 수 있다. 외부에서 사용자가 전자 장치(101)를 바라보는 경우, 바닥면(310)에 포함된 색상 또는 무늬와 동일(또는 유사)한 색상 또는 무늬가 제1 디스플레이(161b)에 표시될 수 있다.

소스 이미지를 이용하여 생성된 제2 출력 이미지는 제2 디스플레이(162b)에 출력될 수 있다. 바닥면(310)에 포함된 색상 또는 무늬와 동일(또는 유사)한 색상 또는 무늬가 제2 디스플레이(162b)에 표시될 수 있다.

전자 장치(101)는 제1 디스플레이(161b) 및 제2 디스플레이(162b)가 주변 환경과 어울리게 자동으로 변경되는 사용자 경험을 제공할 수 있다.

제 3 화면(303)에서, 프로세서(120)는 배경 이미지뿐만 아니라, 제1 디스플레이(161c) 또는 제2 디스플레이(162c)에 표시되는 다른 컨텐츠를 소스 이미지의 색상 또는 무늬와 결합하여 출력할 수 있다. 프로세서(120)는 바닥면(310)의 색상 또는 무늬를 고려하여, 제1 디스플레이(161c) 또는 제2 디스플레이(162b)에 출력되는 텍스트 또는 아이콘의 출력 방식을 변경할 수 있다. 예를 들어, 텍스트 또는 아이콘의 색상이 배경 색과 대조되는 색(예: 보색)으로 출력되거나, 텍스트 또는 아이콘이 배경 무늬와 동일한 무늬를 가지도록 출력될 수 있다.

도 4는 다양한 실시 예에 따른 소스 이미지를 제1 디스플레이의 배경 이미지로 활용하는 화면 예시도이다. 도 4는 예시적인 것으로 이에 한정되는 것은 아니다.

도 4를 참조하면, 화면(401)에서, 프로세서(120)는 소스 이미지에서 추출한 특징점(예: 대표색, 대표 무늬 등)을 이용하여 홈 화면의 배경 이미지(410)를 변경할 수 있다. 사용자가 전자 장치를 책상, 테이블 등의 위에 내려놓는 경우, 프로세서(120)는 홈 화면의 배경 이미지(410)를 전자 장치(101)가 놓여 있는 책상, 테이블 등과 동일한 형태 또는 어울리는 형태로 출력할 수 있다. 다양한 실시 예에서, 프로세서(120)는 홈 화면에 표시되는 텍스트 또는 아이콘의 색상을 변경된 배경 이미지(410)의 색상과 대조되는 색상으로 변경하여, 시인성을 높일 수 있다.

화면(402)에서, 프로세서(120)는 소스 이미지에서 추출한 특징점(예: 대표색, 대표 무늬 등)을 이용하여 잠금 화면의 배경 이미지(420)를 변경할 수 있다. 프로세서(120)는 잠금 화면에 표시되는 알림 표시, 날씨 표시 등을 배경 이미지(420)의 색상과 대조되는 색상 또는 무늬로 출력하여, 시인성을 높일 수 있다.

화면(403)에서, 프로세서(120)는 소스 이미지에서 추출한 특징점(예: 대표색, 대표 무늬 등)을 이용하여 팝업창 또는 알림창의 배경 이미지(430)를 변경할 수 있다. 사용자가 전자 장치를 책상, 테이블 등의 위에 내려놓는 경우, 프로세서(120)는 스크린 오프 상태에서, 책상 또는 테이블의 색상 또는 무늬를 추출할 수 있다. 전자 장치(101)의 내부의 어플리케이션의 실행에 따라 팝업창 또는 알림창이 출력되는 경우(예: 메시지 수신, 전화 수신, 일정 알림 등), 프로세서(120)는 책상 또는 테이블의 색상 또는 무늬와 동일한 배경을 가지는 팝업창 또는 알림창을 출력할 수 있다.

도 5는 다양한 실시 예에 따른 전자 장치의 복수의 상태들을 인식하여 화면을 출력하는 방법을 설명하는 순서도이다.

도 5를 참조하면, 동작 510에서, 프로세서(120)는 센서 모듈(180)을 이용하여, 전자 장치(101)가 제1 상태인지를 확인할 수 있다. 일 실시 예에서, 상기 제1 상태는 전자 장치(101)가 지정된 속도 이하 또는 지정된 가속도 이하로 움직이는 상태, 또는 외부 객체와의 거리가 미리 설정된 범위 이내인 상태일 수 있다.

다양한 실시 예에서, 프로세서(120)는 센서 모듈(190)을 통해 측정된 전자 장치(101)의 이동 속도 또는 전자 장치(101)와 외부 객체 사이의 거리 중 적어도 하나를 기반으로 전자 장치(101)가 제1 상태에 진입하는지를 결정할 수 있다. 예를 들어, 프로세서(120)는 자이로 센서 또는 가속도 센서를 이용하여 측정된 전자 장치(101)의 이동 속도가 제1 문턱값(예: 10cm/s) 이하이고, IR 센서(또는 HRM 센서)를 이용하여 측정된 전자 장치(101)와 외부 객체(예: 테이블) 사이의 거리가 제2 문턱값(예: 20cm) 이하인 경우, 전자 장치(101)가 제1 상태에 진입한 것으로 결정할 수 있다.

동작 520에서, 프로세서(120)는 제1 상태에서, 카메라 모듈(180)을 이용하여 전자 장치(101) 주변(예: 바닥면)을 촬영하여 소스 이미지를 획득할 수 있다. 다양한 실시 예에서, 촬영된 소스 이미지는 버퍼에 임시로 저장될 수 있고, 앨범 앱 등에서 확인되지 않을 수 있다. 또한, 소스 이미지는 디스플레이(150)에 실시간으로 표시되지 않을 수 있고, 사용자는 소스 이미지의 촬영을 인식하지 못하거나 관심을 갖지 않을 수 있다.

동작 530에서, 프로세서(120)는 소스 이미지를 이미지 프로세싱하여, 특징점(예: 대표 색, 대표 무늬)을 추출할 수 있다. 예를 들어, 프로세서(120)는 필터링을 통해 소스 이미지의 중심 영역에서 대표 색, 대표 무늬를 추출할 수 있다.

동작 540에서, 프로세서(120)는 추출된 특징점을 기반으로 제1 출력 이미지 및 제2 출력 이미지를 생성할 수 있다. 제1 출력 이미지는 제1 디스플레이(161)를 통해 출력될 이미지일 수 있고, 제2 출력 이미지는 제2 디스플레이(162)를 통해 출력될 이미지일 수 있다. 예를 들어, 제1 출력 이미지는 전자 장치(101)가 놓여 있는 책상 또는 테이블과 동일한 색상 또는 무늬를 가질 수 있고, 제2 출력 이미지는 책상 또는 테이블과 동일한 색상 또는 무늬를 가지는 아이콘 이미지 또는 터치 버튼 이미지일 수 있다. 다른 예를 들어, 제1 출력 이미지 및 제2 출력 이미지는 전자 장치(101)가 놓여 있는 책상 또는 테이블과 동일한 무늬를 가지고, 책상 또는 테이블의 색상과는 대조되는 색(예: 보색)을 가질 수 있다.

다양한 실시 예에서, 프로세서(120)는 생성된 출력 이미지를 디스플레이 구동 회로의 그래픽 램에 저장할 수 있다.

동작 550에서, 프로세서(120)는 전자 장치(101)가 제2 상태인지를 확인할 수 있다. 일 실시 예에서, 상기 제2 상태는 전자 장치(101)가 별도의 움직임 없이 정지한 상태일 수 있다. 프로세서(120)는 센서 모듈(190)(예: 자이로 센서 또는 가속도 센서 등)의 측정값을 기반으로 전자 장치(101)이 정지된 상태인지를 결정할 수 있다.

동작 560에서, 프로세서(120)는 제2 상태에서, 제1 출력 이미지를 제1 디스플레이(161)에 적용하고, 제2 출력 이미지를 제2 디스플레이(162)에 적용할 수 있다. 예를 들어, 제1 디스플레이(161)의 홈 화면, 잠금 화면 등의 배경 이미지가 주변의 색상 또는 무늬와 동일(또는 유사)한 출력 이미지로 변경될 수 있다. 제2 디스플레이(162)의 아이콘, 터치 버튼 등이 주변의 색상 또는 무늬와 동일(또는 유사)한 출력 이미지로 변경될 수 있다.

다양한 실시 예에 따르며, 프로세서(120)는 제2 상태에서 카메라 모듈, 센서 모듈 등을 이용하여 주변의 상황 변화를 주기적으로 인식할 수 있다. 프로세서(120)는 전자 장치(101) 주변의 색상 또는 무늬가 변경되는 경우, 제1 출력 이미지 또는 제2 출력 이미지를 업데이트할 수 있다.

도 6은 다양한 실시 예에 따른 복수의 상태들에서 추출하는 예시도이다. 도 6은 예시적인 것으로 이에 한정되는 것은 아니다.

도 6을 참조하면, 제1 동작(601)에서, 사용자가 전자 장치(101)를 테이블(610)에 내려놓고 있는 경우, 프로세서(120)는 전자 장치(101)가 제1 상태로 진입하는지를 확인할 수 있다. 예를 들어, 상기 제1 상태는 전자 장치(101)가 지정된 속도 이하로 이동하거나, 테이블(610)과의 거리가 미리 설정된 범위(예: 20cm) 이내인 상태일 수 있다.

프로세서(120)는 제1 상태에 진입하는 경우, 카메라 모듈(180)(예: 후면 카메라)를 이용하여 주변 환경(예: 테이블(610)의 바닥면)을 촬영할 수 있다.

프로세서(120)는 소스 이미지를 이미지 프로세싱하여, 특징점(예: 대표 색, 대표 무늬)을 추출할 수 있다. 프로세서(120)는 추출된 특징점을 기반으로 제1 출력 이미지 및 제2 출력 이미지를 생성할 수 있다.

예를 들어, 프로세서(120)는 소스 이미지를 구성하는 전체 픽셀의 RGB 평균값을 산출하거나, 소스 이미지에서 선택된 일부 영역(예: 소스 이미지의 중심점에서 일정 범위 이내의 픽셀들)의 RGB 평균값을 산출 할 수 있다. 다른 예를 들어, 프로세서(120)는 소스 이미지를 구성하는 픽셀들을 샘플링하여, RGB 평균값을 산출할 수도 있다.

제2 동작(602)에서, 프로세서(120)는 제2 상태에 진입하는지를 확인할 수 있다. 상기 제2 상태는 전자 장치(101)가 별도의 움직임 없이 정지한 상태일 수 있다. 프로세서(120)는 센서 모듈(190)(예: 자이로 센서 또는 가속도 센서 등)의 측정값을 기반으로 전자 장치(101)이 정지된 상태인지를 결정할 수 있다.

예를 들어, 프로세서(120)는 가속도 센서의 X값, Y값, Z값이 변하지 않고, Z값이 9.0 이상 유지되고는 상태가 1초 이상 지속되는 경우, 프로세서(120)은 전자 장치(101)가 정지 상태에 진입한 것으로 결정할 수 있다.

제3 동작(603)에서, 프로세서(120)는 제1 출력 이미지 및 제2 출력 이미지를 제1 디스플레이(161) 및 제2 디스플레이(162)에 적용할 수 있다. 디스플레이(160)은 테이블(610)의 색상 또는 무늬와 동일(또는 유사)한 색상 또는 무늬의 이미지를 출력할 수 있다.

도 7은 다양한 실시 예에 따른 소스 이미지에서 추출된 특징점을 적용하는 화면 예시도이다. 도 7은 예시적인 것으로 이에 한정되는 것은 아니다.

도 7을 참조하면, 전자 장치(101)가 놓인 바닥면(710)이 카모플라쥬(camouflage) 무늬를 가지는 경우, 제1 디스플레이(161)는 바닥면(710)과 동일한 무늬를 출력할 수 있다. 프로세서(160)는 후면 카메라를 이용하여, 전자 장치(101)가 바닥면(710)에 놓이기 전 또는 놓인 후에 바닥면(710)을 촬영할 수 있다. 프로세서(160)는 촬영된 이미지를 처리하여, 카모플라쥬(camouflage) 무늬 및 색상을 추출할 수 있다. 프로세서(160)는 추출된 무늬 및 색상을 기반으로 제1 디스플레이(161)에 표시되는 잠금 화면 또는 올웨이즈온(always on; AOD) 화면의 배경 이미지를 변경할 수 있다.

다양한 실시 예에 따르면, 프로세서(160)는 제1 디스플레이(161)에 출력되는 제1 출력 이미지와 다른 방식으로 소스 이미지를 이미지 처리하여, 제2 디스플레이(162)에 출력될 제2 출력 이미지를 생성할 수 있다. 예를 들어, 프로세서(160)는 소스 이미지를 측면 방향으로 확장하여, 사용자가 정면에서 전자 장치(101)을 바라보는 경우, 카모플라쥬(camouflage) 무늬가 제1 디스플레이(161)에 출력되는 제1 출력 이미지와 연속되도록 제2 출력 이미지를 생성할 수 있다. 생성된 제2 출력 이미지는 제2 디스플레이(162)를 통해 출력될 수 있다.

일 실시 예에 따르면, 프로세서(120)는 전자 장치(101)가 바닥면(710)위에서 위치가 변경되는 경우, 소스 이미지를 다시 촬영하여 제1 출력 이미지 및 제2 출력 이미지를 업데이트 할 수 있다. 프로세서(120)는 센서 모듈(예: 자이로 센서 또는 가속도 센서)를 통해 전자 장치(101)이 수평 방향으로 이동하고, 다시 정지 상태가 유지되는 경우, 카메라 모듈(180)을 이용하여 다시 소스 이미지를 촬영할 수 있다. 프로세서(120)는 업데이트된 소스 이미지를 이용하여 제1 출력 이미지 및 제2 출력 이미지를 변경할 수 있다.

다른 일 실시 예에 따르면, 프로세서(120)는 전자 장치(101)의 이동이 지정된 범위 이내인 경우, 이동 전에 버퍼에 저장된 소스 이미지를 이용하여, 출력 이미지를 업데이트 할 수 있다. 예를 들어, 프로세서(120)는 센서 모듈(예: 자이로 센서 또는 가속도 센서)를 통해 인식한 전자 장치의 이동 범위가 5cm 이내인 경우, 버퍼에 저장된 소스 이미지를 대응하는 거리만큼 이동하여 특징점을 다시 추출할 수 있다. 프로세서는 새로 추출된 특징점을 이용하여 제1 출력 이미지 및 제2 출력 이미지를 생성하고 출력할 수 있다.

도 8은 다양한 실시 예에 따른 내부 이미지를 이용하는 화면 출력 방법을 설명하는 순서도이다.

도 8을 참조하면, 동작 810에서, 프로세서(120)는 전자 장치(101)가 제1 상태(예: 정지 상태, 지정된 속도 이하 상태, 바닥면과 지정된 거리 이내에 배치된 상태 등)에서 소스 이미지를 촬영할 수 있다.

동작 820에서, 프로세서(120)는 소스 이미지로부터 특징점을 추출할 수 있다. 프로세서(120)는 필터링을 통해 소스 이미지의 대표 색, 대표 무늬를 추출할 수 있다.

동작 830에서, 프로세서(120)는 추출된 특징점을 기반으로 전자 장치(101)의 내부 메모리에 미리 저장된 이미지의 특징점과 비교할 수 있다.

프로세서(120)는 메모리(130)에 저장된 이미지(예: 앨범 앱에 저장된 이미지)(이하, 내부 이미지)에 대한 특징점(예: 대표 색상, 대표 무늬)에 관한 정보를 미리 저장할 수 있다. 프로세서(120)는 소스 이미지에 대한 특징점과 내부 이미지에 대한 특징점을 비교할 수 있다.

동작 840에서, 프로세서(120)는 상기 비교를 기반으로 매칭되는 내부 이미지를 결정할 수 있다. 예를 들어, 프로세서(120)는 소스 이미지에 대한 특징점과 일치율이 가장 높거나, 지정된 값 이상의 일치율을 가지는 내부 이미지를 결정할 수 있다.

동작 850에서, 프로세서(120)는 소스 이미지와 결정된 내부 이미지를 기반으로 제1 디스플레이(161) 및 제2 디스플레이(162)에 표시되는 컨텐츠를 변경할 수 있다. 예를 들어, 프로세서(120)는 소스 이미지와 결정된 내부 이미지를 결합하여 제1 디스플레이(161) 및 제2 디스플레이(162)의 배경 이미지로 출력할 수 있다. 다른 예를 들어, 프로세서(120)는 결정된 내부 이미지를 일부 변경하거나 일부 영역을 추출하여, 제1 디스플레이(161) 및 제2 디스플레이(162)의 배경 이미지로 출력할 수 있다

도 9는 다양한 실시 예에 따른 외부 이미지를 이용하는 화면 출력 방법을 설명하는 순서도이다.

도 9를 참조하면, 동작 910 및 920의 동작은 도 8에서의 동작 810 내지 830의 동작과 동일 또는 유사할 수 있다.

동작 930에서, 프로세서(120)는 외부 장치(예: 도1 의 서버(106))에 매칭되는 외부 이미지를 요청할 수 있다. 프로세서(120)는 추출된 특징점에 관한 정보를 외부 장치에 전송하고 매칭되는 이미지를 송신할 것을 요청할 수 있다.

동작 940에서, 프로세서(120)는 외부 장치로부터 특징점이 매칭되는 외부 이미지를 수신할 수 있다.

동작 950에서, 프로세서(120)는 소스 이미지와 수신한 외부 이미지를 기반으로 제1 디스플레이(161) 및 제2 디스플레이(162)에 표시되는 컨텐츠를 변경할 수 있다. 예를 들어, 프로세서(120)는 소스 이미지와 수신한 외부 이미지를 결합하여 제1 디스플레이(161) 및 제2 디스플레이(162)의 배경 이미지로 출력할 수 있다. 다른 예를 들어, 프로세서(120)는 수신한 외부 이미지를 일부 변경하거나 일부 영역을 추출하여, 제1 디스플레이(161) 및 제2 디스플레이(162)의 배경 이미지로 출력할 수 있다

도 10는 다양한 실시 예에 따른 제2 디스플레이에 제2 출력 이미지를 적용한 예시도이다. 도 10은 제2 디스플레이(162)가 전자 장치(101)의 좌측 또는 우측 영역인 경우를 예시적으로 도시하였으나, 이에 한정되는 것은 아니다.

도 10을 참조하면, 화면(1001)에서, 프로세서(120)는 제1 디스플레이(161)가 스크린 오프 상태에서, 제2 디스플레이(162a, 162b)를 주변의 색상 또는 무늬와 동일하도록 변경할 수 있다. 예를 들어, 프로세서(120)는 전자 장치(101)이 정지 상태인 경우, 전면 카메라를 이용하여 주변의 조명을 촬영할 수 있다. 프로세서(120)는 해당 조명과 유사한 형태의 무늬를 제2 디스플레이(162a, 162b)에 출력할 수 있다.

다양한 실시 예에서, 제2 디스플레이(162a, 162b)에 출력되는 이미지는 주변에서 발생하는 소리에 반응하여 실시간으로 변경될 수 있다. 예를 들어, 전자 장치(101)의 좌측에 소리를 발생시키는 물체가 있는 경우, 제2 디스플레이(162a)의 이미지 변화가 제2 디스플레이(162b)의 이미지 변화 보다 클 수 있다.

화면(1002)에서, 프로세서(120)는 제1 디스플레이(161)에는 다른 이미지가 출력되는 상태에서, 제2 디스플레이(162a, 162b)를 주변의 색상 또는 무늬와 동일하도록 변경할 수 있다. 예를 들어, 프로세서(120)는 전자 장치(101)이 정지 상태인 경우, 제1 디스플레이(161)에는 비디오 재생 화면이 출력되고, 제2 디스플레이(162a, 162b)에는 전면 카메라를 이용하여 촬영된 주변의 이미지가 출력될 수 있다.

화면(1003)에서, 프로세서(120)는 제2 디스플레이(162a, 162b) 중 지정된 조건에 따라 하나의 영역만 출력되도록 할 수 있다. 예를 들어, 프로세서(120)는 전자 장치(101)의 좌측에 소리를 발생시키는 물체가 있는 경우, 제2 디스플레이(162a)에는 주변의 동일한 무늬의 이미지가 출력되도록 하고, 제2 디스플레이(162b)에는 별도의 이미지가 출력되지 않도록 할 수 있다.

도 11은 다양한 실시 예에 따른 제1 및 제2 출력 이미지의 동적 변화를 설명하는 화면 예시도 이다.

도 11을 참조하면, 프로세서(120)는 주변 환경(예: 바닥면(1110))의 변화에 대응하여 제1 디스플레이(161) 및 제2 디스플레이(162a, 162b)에 출력되는 이미지가 변경된 이후, 카메라 모듈(180) 또는 센서 모듈(190)을 통해 수집된 정보를 기반으로 제1 및 제2 출력 이미지를 업데이트할 수 있다. 도 11에서는 주변의 마이크를 통해 수집된 소리를 기반으로 출력 이미지가 업데이트 되는 경우를 예시적으로 도시하였으나, 이에 한정되는 것은 아니다. 예를 들어, 조도 센서를 이용하여 측정된 주변의 밝기에 따라 출력 이미지의 밝기가 변경될 수 있다.

화면(1101)에서, 프로세서(120)는 제1 디스플레이(161) 및 제2 디스플레이(162a, 162b)를 바닥면(1110)과 동일 또는 유사한 색상 또는 무늬로 출력할 수 있다.

화면(1102)에서, 프로세서(120)는 전자 장치(101)의 좌측에 소리를 발생시키는 제1 물체가 있는 경우, 마이크를 통해 소리의 방향을 인식할 수 있다. 프로세서(120)는 제2 디스플레이(162a)와 제1 디스플레이(161)의 의 좌측 영역에 제1 물체에서 발생하는 소리의 패턴에 따라 실시간으로 변화하는 추가적인 무늬를 출력할 수 있다.

화면(1103)에서, 프로세서(120)는 전자 장치(101)의 우측에 소리를 발생시키는 제2 물체가 있는 경우, 마이크를 통해 소리의 방향을 인식할 수 있다. 프로세서(120)는 제2 디스플레이(162b)와 제1 디스플레이(161)의 의 우측 영역에 제2 물체에서 발생하는 소리의 패턴에 따라 실시간으로 변화하는 추가적인 무늬를 출력할 수 있다.

도 12는 다양한 실시 예에 따른 전자 장치(1201)의 블록도이다.

전자 장치(1201)는, 예를 들면, 도 1에 도시된 전자 장치(101)의 전체 또는 일부를 포함할 수 있다. 전자 장치(1201)는 하나 이상의 프로세서(예: AP)(1212), 통신 모듈(1220), (가입자 식별 모듈(1224), 메모리(1230), 센서 모듈(1240), 입력 장치(1250), 디스플레이(1260), 인터페이스(1270), 오디오 모듈(1280), 카메라 모듈(1291), 전력 관리 모듈(1295), 배터리(1296), 인디케이터(1297), 및 모터(1298)를 포함할 수 있다. 프로세서(1210)는, 예를 들면, 운영 체제 또는 응용 프로그램을 구동하여 프로세서(1210)에 연결된 다수의 하드웨어 또는 소프트웨어 구성요소들을 제어할 수 있고, 각종 데이터 처리 및 연산을 수행할 수 있다. 프로세서(1210)는, 예를 들면, SoC(system on chip) 로 구현될 수 있다. 한 실시 예에 따르면, 프로세서(1210)는 GPU(graphic processing unit) 및/또는 이미지 신호 프로세서를 더 포함할 수 있다. 프로세서(1210)는 도 12에 도시된 구성요소들 중 적어도 일부(예: 셀룰러 모듈(1221))를 포함할 수도 있다. 프로세서(1210) 는 다른 구성요소들(예: 비휘발성 메모리) 중 적어도 하나로부터 수신된 명령 또는 데이터를 휘발성 메모리에 로드)하여 처리하고, 결과 데이터를 비휘발성 메모리에 저장할 수 있다.

통신 모듈(1220)(예: 통신 인터페이스(170))와 동일 또는 유사한 구성을 가질 수 있다. 통신 모듈(1220)은, 예를 들면, 셀룰러 모듈(1221), WiFi 모듈(1223), 블루투스 모듈(1225), GNSS 모듈(1227), NFC 모듈(1228) 및 RF 모듈(1229)를 포함할 수 있다. 셀룰러 모듈(1221)은, 예를 들면, 통신망을 통해서 음성 통화, 영상 통화, 문자 서비스, 또는 인터넷 서비스 등을 제공할 수 있다. 한 실시 예에 따르면, 셀룰러 모듈(1221)은 가입자 식별 모듈(예: SIM 카드)(1224)을 이용하여 통신 네트워크 내에서 전자 장치(1201)의 구별 및 인증을 수행할 수 있다. 한 실시 예에 따르면, 셀룰러 모듈(1221)은 프로세서(1210)가 제공할 수 있는 기능 중 적어도 일부 기능을 수행할 수 있다. 한 실시 예에 따르면, 셀룰러 모듈(1221)은 커뮤니케이션 프로세서(CP)를 포함할 수 있다. 어떤 실시 예에 따르면, 셀룰러 모듈(1221), WiFi 모듈(1223), 블루투스 모듈(1225), GNSS 모듈(1227) 또는 NFC 모듈(1228) 중 적어도 일부(예: 두 개 이상)는 하나의 integrated chip(IC) 또는 IC 패키지 내에 포함될 수 있다. RF 모듈(1229)은, 예를 들면, 통신 신호(예: RF 신호)를 송수신할 수 있다. RF 모듈(1229)은, 예를 들면, 트랜시버, PAM(power amp module), 주파수 필터, LNA(low noise amplifier), 또는 안테나 등을 포함할 수 있다. 다른 실시 예에 따르면, 셀룰러 모듈(1221), WiFi 모듈(1223), 블루투스 모듈(1225), GNSS 모듈(1227) 또는 NFC 모듈(1228) 중 적어도 하나는 별개의 RF 모듈을 통하여 RF 신호를 송수신할 수 있다. 가입자 식별 모듈(1224)은, 예를 들면, 가입자 식별 모듈을 포함하는 카드 또는 임베디드 SIM을 포함할 수 있으며, 고유한 식별 정보(예: ICCID(integrated circuit card identifier)) 또는 가입자 정보(예: IMSI(international mobile subscriber identity))를 포함할 수 있다.

메모리(1230)(예: 메모리(130))는, 예를 들면, 내장 메모리(1232) 또는 외장 메모리(1234)를 포함할 수 있다. 내장 메모리(1232)는, 예를 들면, 휘발성 메모리(예: DRAM, SRAM, 또는 SDRAM 등), 비휘발성 메모리(예: OTPROM(one time programmable ROM), PROM, EPROM, EEPROM, mask ROM, flash ROM, 플래시 메모리, 하드 드라이브, 또는 솔리드 스테이트 드라이브 (SSD) 중 적어도 하나를 포함할 수 있다. 외장 메모리(1234)는 플래시 드라이브(flash drive), 예를 들면, CF(compact flash), SD(secure digital), Micro-SD, Mini-SD, xD(extreme digital), MMC(multi-media card) 또는 메모리 스틱 등을 포함할 수 있다. 외장 메모리(1234)는 다양한 인터페이스를 통하여 전자 장치(1201)와 기능적으로 또는 물리적으로 연결될 수 있다.

센서 모듈(1240)은, 예를 들면, 물리량을 계측하거나 전자 장치(1201)의 작동 상태를 감지하여, 계측 또는 감지된 정보를 전기 신호로 변환할 수 있다. 센서 모듈(1240)은, 예를 들면, 제스처 센서(1240A), 자이로 센서(1240B), 기압 센서(1240C), 마그네틱 센서(1240D), 가속도 센서(1240E), 그립 센서(1240F), 근접 센서(1240G), 컬러(color) 센서(1240H)(예: RGB(red, green, blue) 센서), 생체 센서(1240I), 온/습도 센서(1240J), 조도 센서(1240K), 또는 UV(ultra violet) 센서(1240M) 중의 적어도 하나를 포함할 수 있다. 추가적으로 또는 대체적으로, 센서 모듈(1240)은, 예를 들면, 후각(e-nose) 센서, 일렉트로마이오그라피(EMG) 센서, 일렉트로엔씨팔로그램(EEG) 센서, 일렉트로카디오그램(ECG) 센서, IR(infrared) 센서, 홍채 센서 및/또는 지문 센서를 포함할 수 있다. 센서 모듈(1240)은 그 안에 속한 적어도 하나 이상의 센서들을 제어하기 위한 제어 회로를 더 포함할 수 있다. 어떤 실시 예에서는, 전자 장치(1201)는 프로세서(1210)의 일부로서 또는 별도로, 센서 모듈(1240)을 제어하도록 구성된 프로세서를 더 포함하여, 프로세서(1210)가 슬립(sleep) 상태에 있는 동안, 센서 모듈(1240)을 제어할 수 있다.

입력 장치(1250)는, 예를 들면, 터치 패널(1252), (디지털) 펜 센서(1254), 키(1256), 또는 초음파 입력 장치(1258)를 포함할 수 있다. 터치 패널(1252)은, 예를 들면, 정전식, 감압식, 적외선 방식, 또는 초음파 방식 중 적어도 하나의 방식을 사용할 수 있다. 또한, 터치 패널(1252)은 제어 회로를 더 포함할 수도 있다. 터치 패널(1252)은 택타일 레이어(tactile layer)를 더 포함하여, 사용자에게 촉각 반응을 제공할 수 있다. (디지털) 펜 센서(1254)는, 예를 들면, 터치 패널의 일부이거나, 별도의 인식용 쉬트를 포함할 수 있다. 키(1256)는, 예를 들면, 물리적인 버튼, 광학식 키, 또는 키패드를 포함할 수 있다. 초음파 입력 장치(1258)는 마이크(예: 마이크(1288))를 통해, 입력 도구에서 발생된 초음파를 감지하여, 상기 감지된 초음파에 대응하는 데이터를 확인할 수 있다.

디스플레이(1260)(예: 디스플레이(160))는 패널(1262), 홀로그램 장치(1264), 프로젝터(1266), 및/또는 이들을 제어하기 위한 제어 회로를 포함할 수 있다. 패널(1262)은, 예를 들면, 유연하게, 투명하게, 또는 착용할 수 있게 구현될 수 있다. 패널(1262)은 터치 패널(1252)과 하나 이상의 모듈로 구성될 수 있다. 한 실시 예에 따르면, 패널(1262)은 사용자의 터치에 대한 압력의 세기를 측정할 수 있는 압력 센서(또는 포스 센서)를 포함할 수 있다. 상기 압력 센서는 터치 패널(1252)과 일체형으로 구현되거나, 또는 터치 패널(1252)과는 별도의 하나 이상의 센서로 구현될 수 있다. 홀로그램 장치(1264)는 빛의 간섭을 이용하여 입체 영상을 허공에 보여줄 수 있다. 프로젝터(1266)는 스크린에 빛을 투사하여 영상을 표시할 수 있다. 스크린은, 예를 들면, 전자 장치(1201)의 내부 또는 외부에 위치할 수 있다. 인터페이스(1270)는, 예를 들면, HDMI(1272), USB(1274), 광 인터페이스(optical interface)(1276), 또는 D-sub(D-subminiature)(1278)를 포함할 수 있다. 인터페이스(1270)는, 예를 들면, 도 1에 도시된 통신 인터페이스(170)에 포함될 수 있다. 추가적으로 또는 대체적으로, 인터페이스(1270)는, 예를 들면, MHL(mobile high-definition link) 인터페이스, SD카드/MMC(multi-media card) 인터페이스, 또는 IrDA(infrared data association) 규격 인터페이스를 포함할 수 있다.

오디오 모듈(1280)은, 예를 들면, 소리와 전기 신호를 쌍방향으로 변환시킬 수 있다. 오디오 모듈(1280)의 적어도 일부 구성요소는, 예를 들면, 도 1 에 도시된 입출력 인터페이스(145)에 포함될 수 있다. 오디오 모듈(1280)은, 예를 들면, 스피커(1282), 리시버(1284), 이어폰(1286), 또는 마이크(1288) 등을 통해 입력 또는 출력되는 소리 정보를 처리할 수 있다. 카메라 모듈(1291)은, 예를 들면, 정지 영상 및 동영상을 촬영할 수 있는 장치로서, 한 실시 예에 따르면, 하나 이상의 이미지 센서(예: 전면 센서 또는 후면 센서), 렌즈, 이미지 시그널 프로세서(ISP), 또는 플래시(예: LED 또는 xenon lamp 등)를 포함할 수 있다. 전력 관리 모듈(1295)은, 예를 들면, 전자 장치(1201)의 전력을 관리할 수 있다. 한 실시 예에 따르면, 전력 관리 모듈(1295)은 PMIC(power management integrated circuit), 충전 IC, 또는 배터리 또는 연료 게이지를 포함할 수 있다. PMIC는, 유선 및/또는 무선 충전 방식을 가질 수 있다. 무선 충전 방식은, 예를 들면, 자기공명 방식, 자기유도 방식 또는 전자기파 방식 등을 포함하며, 무선 충전을 위한 부가적인 회로, 예를 들면, 코일 루프, 공진 회로, 또는 정류기 등을 더 포함할 수 있다. 배터리 게이지는, 예를 들면, 배터리(1296)의 잔량, 충전 중 전압, 전류, 또는 온도를 측정할 수 있다. 배터리(1296)는, 예를 들면, 충전식 전지 및/또는 태양 전지를 포함할 수 있다.

인디케이터(1297)는 전자 장치(1201) 또는 그 일부(예: 프로세서(1210))의 특정 상태, 예를 들면, 부팅 상태, 메시지 상태 또는 충전 상태 등을 표시할 수 있다. 모터(1298)는 전기적 신호를 기계적 진동으로 변환할 수 있고, 진동, 또는 햅틱 효과 등을 발생시킬 수 있다. 전자 장치(1201)는, 예를 들면, DMB(digital multimedia broadcasting), DVB(digital video broadcasting), 또는 미디어플로(mediaFloTM) 등의 규격에 따른 미디어 데이터를 처리할 수 있는 모바일 TV 지원 장치(예: GPU)를 포함할 수 있다. 본 문서에서 기술된 구성요소들 각각은 하나 또는 그 이상의 부품(component)으로 구성될 수 있으며, 해당 구성요소의 명칭은 전자 장치의 종류에 따라서 달라질 수 있다. 다양한 실시 예에서, 전자 장치(예: 전자 장치(1201))는 일부 구성요소가 생략되거나, 추가적인 구성요소를 더 포함하거나, 또는, 구성요소들 중 일부가 결합되어 하나의 개체로 구성되되, 결합 이전의 해당 구성요소들의 기능을 동일하게 수행할 수 있다.

도 13은 다양한 실시 예에 따른 프로그램 모듈의 블록도이다. 한 실시 예에 따르면, 프로그램 모듈(1310)(예: 프로그램(140))은 전자 장치(예: 전자 장치(101))에 관련된 자원을 제어하는 운영 체제 및/또는 운영 체제 상에서 구동되는 다양한 어플리케이션(예: 어플리케이션 프로그램(147))을 포함할 수 있다. 운영 체제는, 예를 들면, AndroidTM, iOSTM, WindowsTM, SymbianTM, TizenTM, 또는 BadaTM를 포함할 수 있다. 도 13을 참조하면, 프로그램 모듈(1310)은 커널(1320)(예: 커널(141)), 미들웨어(1330)(예: 미들웨어(143)), (API(1360)(예: API(145)), 및/또는 어플리케이션(1370)(예: 어플리케이션 프로그램(147))을 포함할 수 있다. 프로그램 모듈(1310)의 적어도 일부는 전자 장치 상에 프리로드 되거나, 외부 전자 장치(예: 전자 장치(102, 104), 서버(106) 등)로부터 다운로드 가능하다.

커널(1320)은, 예를 들면, 시스템 리소스 매니저(1321) 및/또는 디바이스 드라이버(1323)를 포함할 수 있다. 시스템 리소스 매니저(1321)는 시스템 리소스의 제어, 할당, 또는 회수를 수행할 수 있다. 한 실시 예에 따르면, 시스템 리소스 매니저(1321)는 프로세스 관리부, 메모리 관리부, 또는 파일 시스템 관리부를 포함할 수 있다. 디바이스 드라이버(1323)는, 예를 들면, 디스플레이 드라이버, 카메라 드라이버, 블루투스 드라이버, 공유 메모리 드라이버, USB 드라이버, 키패드 드라이버, WiFi 드라이버, 오디오 드라이버, 또는 IPC(inter-process communication) 드라이버를 포함할 수 있다. 미들웨어(1330)는, 예를 들면, 어플리케이션(1370)이 공통적으로 필요로 하는 기능을 제공하거나, 어플리케이션(1370)이 전자 장치 내부의 제한된 시스템 자원을 사용할 수 있도록 API(1360)를 통해 다양한 기능들을 어플리케이션(1370)으로 제공할 수 있다. 한 실시 예에 따르면, 미들웨어(1330) 는 런타임 라이브러리(1335), 어플리케이션 매니저(1341), 윈도우 매니저(1342), 멀티미디어 매니저(1343), 리소스 매니저(1344), 파워 매니저(1345), 데이터베이스 매니저(1346), 패키지 매니저(1347), 연결 매니저(1348), 통지 매니저(1349), 위치 매니저(1350), 그래픽 매니저(1351), 또는 보안 매니저(1352) 중 적어도 하나를 포함할 수 있다.

런타임 라이브러리(1335)는, 예를 들면, 어플리케이션(1370)이 실행되는 동안에 프로그래밍 언어를 통해 새로운 기능을 추가하기 위해 컴파일러가 사용하는 라이브러리 모듈을 포함할 수 있다. 런타임 라이브러리(1335)는 입출력 관리, 메모리 관리, 또는 산술 함수 처리를 수행할 수 있다. 어플리케이션 매니저(1341)는, 예를 들면, 어플리케이션(1370)의 생명 주기를 관리할 수 있다. 윈도우 매니저(1342)는 화면에서 사용되는 GUI 자원을 관리할 수 있다. 멀티미디어 매니저(1343)는 미디어 파일들의 재생에 필요한 포맷을 파악하고, 해당 포맷에 맞는 코덱을 이용하여 미디어 파일의 인코딩 또는 디코딩을 수행할 수 있다. 리소스 매니저(1344)는 어플리케이션(1370)의 소스 코드 또는 메모리의 공간을 관리할 수 있다. 파워 매니저(1345)는, 예를 들면, 배터리의 용량 또는 전원을 관리하고, 전자 장치의 동작에 필요한 전력 정보를 제공할 수 있다. 한 실시 예에 따르면, 파워 매니저(1345)는 바이오스(BIOS: basic input/output system)와 연동할 수 있다. 데이터베이스 매니저(1346)는, 예를 들면, 어플리케이션(1370)에서 사용될 데이터베이스를 생성, 검색, 또는 변경할 수 있다. 패키지 매니저(1347)는 패키지 파일의 형태로 배포되는 어플리케이션의 설치 또는 갱신을 관리할 수 있다.

커넥티비티 매니저(1348)는, 예를 들면, 무선 연결을 관리할 수 있다. 노티피케이션 매니저(1349)는, 예를 들면, 도착 메시지, 약속, 근접성 알림 등의 이벤트를 사용자에게 제공할 수 있다. 로케이션 매니저(1350)는, 예를 들면, 전자 장치의 위치 정보를 관리할 수 있다. 그래픽 매니저(1351)는, 예를 들면, 사용자에게 제공될 그래픽 효과 또는 이와 관련된 사용자 인터페이스를 관리할 수 있다. 보안 매니저(1352)는, 예를 들면, 시스템 보안 또는 사용자 인증을 제공할 수 있다. 한 실시 예에 따르면, 미들웨어(1330)는 전자 장치의 음성 또는 영상 통화 기능을 관리하기 위한 통화(telephony) 매니저 또는 전술된 구성요소들의 기능들의 조합을 형성할 수 있는 하는 미들웨어 모듈을 포함할 수 있다. 한 실시 예에 따르면, 미들웨어(1330)는 운영 체제의 종류 별로 특화된 모듈을 제공할 수 있다. 미들웨어(1330)는 동적으로 기존의 구성요소를 일부 삭제하거나 새로운 구성요소들을 추가할 수 있다. API(1360)는, 예를 들면, API 프로그래밍 함수들의 집합으로, 운영 체제에 따라 다른 구성으로 제공될 수 있다. 예를 들면, 안드로이드 또는 iOS의 경우, 플랫폼 별로 하나의 API 셋을 제공할 수 있으며, 타이젠의 경우, 플랫폼 별로 두 개 이상의 API 셋을 제공할 수 있다.

어플리케이션(1370)은, 예를 들면, 홈(1371), 다이얼러(1372), SMS/MMS(1373), IM(instant message)(1374), 브라우저(1375), 카메라(1376), 알람(1377), 컨택트(1378), 음성 다이얼(1379), 이메일(1380), 달력(1381), 미디어 플레이어(1382), 앨범(1383), 와치(1384), 헬스 케어(예: 운동량 또는 혈당 등을 측정), 또는 환경 정보(예: 기압, 습도, 또는 온도 정보) 제공 어플리케이션을 포함할 수 있다. 한 실시 예에 따르면, 어플리케이션(1370)은 전자 장치와 외부 전자 장치 사이의 정보 교환을 지원할 수 있는 정보 교환 어플리케이션을 포함할 수 있다. 정보 교환 어플리케이션은, 예를 들면, 외부 전자 장치에 특정 정보를 전달하기 위한 노티피케이션 릴레이 어플리케이션, 또는 외부 전자 장치를 관리하기 위한 장치 관리 어플리케이션을 포함할 수 있다. 예를 들면, 알림 전달 어플리케이션은 전자 장치의 다른 어플리케이션에서 발생된 알림 정보를 외부 전자 장치로 전달하거나, 또는 외부 전자 장치로부터 알림 정보를 수신하여 사용자에게 제공할 수 있다. 장치 관리 어플리케이션은, 예를 들면, 전자 장치와 통신하는 외부 전자 장치의 기능(예: 외부 전자 장치 자체(또는, 일부 구성 부품)의 턴-온/턴-오프 또는 디스플레이의 밝기(또는, 해상도) 조절), 또는 외부 전자 장치에서 동작하는 어플리케이션을 설치, 삭제, 또는 갱신할 수 있다. 한 실시 예에 따르면, 어플리케이션(1370)은 외부 전자 장치의 속성에 따라 지정된 어플리케이션(예: 모바일 의료 기기의 건강 관리 어플리케이션)을 포함할 수 있다. 한 실시 예에 따르면, 어플리케이션(1370)은 외부 전자 장치로부터 수신된 어플리케이션을 포함할 수 있다. 프로그램 모듈(1310)의 적어도 일부는 소프트웨어, 펌웨어, 하드웨어(예: 프로세서(120)), 또는 이들 중 적어도 둘 이상의 조합으로 구현(예: 실행)될 수 있으며, 하나 이상의 기능을 수행하기 위한 모듈, 프로그램, 루틴, 명령어 세트 또는 프로세스를 포함할 수 있다.

다양한 실시 예에 따른 전자 장치는 이미지를 촬영할 수 있는 카메라 모듈, 전자 장치 또는 외부 객체에 관한 신호를 인식할 수 있는 센서 모듈, 컨텐츠를 출력할 수 있는 제1 디스플레이 및 제2 디스플레이, 메모리 및 상기 카메라 모듈, 상기 제1 디스플레이, 제2 디스플레이 및 상기 메모리와 전기적으로 연결되는 프로세서를 포함하고, 상기 프로세서는 상기 전자 장치가 제1 상태에 진입하는지를 확인하고, 상기 제1 상태에 진입하면 상기 카메라 모듈을 이용하여 소스 이미지를 촬영하고, 상기 소스 이미지를 기반으로 상기 제1 디스플레이에 출력되는 제1 출력 이미지, 또는 상기 제2 디스플레이에 출력되는 제2 출력 이미지를 생성할 수 있다.

일 실시 예에서, 상기 프로세서는 상기 센서 모듈을 통해 수집된 정보를 기반으로 상기 전자 장치가 정지된 상태를 상기 제1 상태로 결정할 수 있다. 다른 일 실시 예에서, 상기 프로세서는 자이로 센서 또는 가속도 센서의 측정값을 기반으로 상기 전자 장치의 정지된 상태를 결정할 수 있다.

다양한 실시 예에 따르면, 상기 프로세서는 상기 소스 이미지에서 추출된 색상 또는 무늬를 기반으로 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 생성할 수 있다. 상기 프로세서는 상기 소스 이미지의 중심 영역에서 상기 색상 또는 상기 무늬를 추출할 수 있다. 상기 프로세서는 상기 소스 이미지의 전체 픽셀 또는 샘플링된 픽셀에서 상기 색상 또는 상기 무늬를 추출할 수 있다.

다양한 실시 예에 따르면, 상기 프로세서는 상기 센서 모듈을 통해 측정된 상기 전자 장치의 이동 속도 또는 상기 전자 장치와 외부 객체 사이의 거리 중 적어도 하나를 기반으로 상기 제1 상태를 결정할 수 있다. 상기 프로세서는 상기 이동 속도가 제1 문턱값 이하이고, 상기 거리가 제2 문턱값 이하인 상태를 상기 제1 상태로 결정할 수 있다.

다양한 실시 예에 따르면, 상기 프로세서는 상기 전자 장치가 제2 상태에 진입하면, 상기 제1 출력 이미지를 상기 제1 디스플레이에 적용하고, 상기 제2 출력 이미지를 상기 제2 디스플레이에 적용할 수 있다. 상기 프로세서는 상기 센서 모듈을 통해 수집된 정보를 기반으로 상기 전자 장치가 정지된 상태를 상기 제2상태로 결정할 수 있다.

다양한 실시 예에 따르면, 상기 프로세서는 미리 설정된 필터를 적용하여 상기 소스 이미지를 촬영할 수 있다. 상기 프로세서는 상기 전자 장치가 상기 제1 상태에 진입하면 복수의 이미지들을 촬영하고, 복수의 이미지들 중 적어도 일부를 상기 소스 이미지로 결정할 수 있다.

일 실시 예에서, 상기 프로세서는 상기 소스 이미지에서 추출한 특징점을 기반으로 상기 메모리에 저장된 이미지를 검색하여 매칭되는 내부 이미지를 결정하고, 상기 소스 이미지 및 상기 결정된 내부 이미지를 기반으로 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 생성할 수 있다. 다른 일 실시 예에서, 상기 프로세서는 상기 소스 이미지에서 추출한 특징점을 기반으로 외부 장치에 매칭되는 외부 이미지를 요청하고, 상기 소스 이미지 및 상기 외부 이미지를 기반으로 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 생성할 수 있다.

다양한 실시 예에 따르면, 상기 소스 이미지에서 추출한 특징점을 기반으로 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 생성하고, 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 상기 메모리에 저장할 수 있다.

다양한 실시 예에 따른 화면 출력 방법은 전자 장치에서 수행되고, 상기 전자 장치가 제1 상태에 진입하는지를 확인하는 동작, 상기 제1 상태에 진입하면 카메라 모듈을 이용하여 소스 이미지를 촬영하는 동작 및, 상기 소스 이미지를 기반으로 제1 디스플레이에 출력되는 제1 출력 이미지 및 제2 디스플레이에 출력되는 제2 출력 이미지를 생성하는 동작을 포함할 수 있다.

일 실시 예에서, 상기 전자 장치가 제1 상태에 진입하는지를 확인하는 동작은 상기 센서 모듈을 통해 수집된 정보를 기반으로 상기 전자 장치가 정지된 상태를 상기 제1 상태로 결정하는 동작을 포함할 수 있다. 다른 일 실시 예에서, 상기 전자 장치가 제1 상태에 진입하는지를 확인하는 동작은 센서 모듈을 통해 측정된 상기 전자 장치의 이동 속도 또는 상기 전자 장치와 외부 객체 사이의 거리 중 적어도 하나를 기반으로 상기 제1 상태를 결정하는 동작을 포함할 수 있다.

다양한 실시 예에 따르면, 상기 화면 출력 방법은 상기 전자 장치가 제2 상태에 진입하면, 상기 제1 디스플레이 및 상기 제2 디스플레이에 각각 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 적용하는 동작을 더 포함할 수 있다. 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 적용하는 동작은 상기 센서 모듈을 통해 수집된 정보를 기반으로 상기 전자 장치가 정지된 상태를 상기 제2상태로 결정하는 동작을 포함할 수 있다.

본 문서에서 사용된 용어 "모듈"은 하드웨어, 소프트웨어 또는 펌웨어로 구성된 유닛을 포함하며, 예를 들면, 로직, 논리 블록, 부품, 또는 회로 등의 용어와 상호 호환적으로 사용될 수 있다. "모듈"은, 일체로 구성된 부품 또는 하나 또는 그 이상의 기능을 수행하는 최소 단위 또는 그 일부가 될 수 있다. "모듈"은 기계적으로 또는 전자적으로 구현될 수 있으며, 예를 들면, 어떤 동작들을 수행하는, 알려졌거나 앞으로 개발될, ASIC(application-specific integrated circuit) 칩, FPGAs(field-programmable gate arrays), 또는 프로그램 가능 논리 장치를 포함할 수 있다. 다양한 실시 예에 따른 장치(예: 모듈들 또는 그 기능들) 또는 방법(예: 동작들)의 적어도 일부는 프로그램 모듈의 형태로 컴퓨터로 판독 가능한 저장 매체(예: 메모리(130))에 저장된 명령어로 구현될 수 있다. 상기 명령어가 프로세서(예: 프로세서(120))에 의해 실행될 경우, 프로세서가 상기 명령어에 해당하는 기능을 수행할 수 있다. 컴퓨터로 판독 가능한 기록 매체는, 하드디스크, 플로피디스크, 마그네틱 매체(예: 자기테이프), 광기록 매체(예: CD-ROM, DVD, 자기-광 매체 (예: 플롭티컬 디스크), 내장 메모리 등을 포함할 수 있다. 명령어는 컴파일러에 의해 만들어지는 코드 또는 인터프리터에 의해 실행될 수 있는 코드를 포함할 수 있다. 다양한 실시 예에 따른 모듈 또는 프로그램 모듈은 전술한 구성요소들 중 적어도 하나 이상을 포함하거나, 일부가 생략되거나, 또는 다른 구성요소를 더 포함할 수 있다. 다양한 실시 예에 따른, 모듈, 프로그램 모듈 또는 다른 구성요소에 의해 수행되는 동작들은 순차적, 병렬적, 반복적 또는 휴리스틱하게 실행되거나, 적어도 일부 동작이 다른 순서로 실행되거나, 생략되거나, 또는 다른 동작이 추가될 수 있다.

Claims (20)

- 전자 장치에 있어서,

이미지를 촬영할 수 있는 카메라 모듈;

전자 장치 또는 외부 객체에 관한 신호를 인식할 수 있는 센서 모듈;

컨텐츠를 출력할 수 있는 제1 디스플레이 및 제2 디스플레이;

메모리; 및

상기 카메라 모듈, 상기 제1 디스플레이, 제2 디스플레이 및 상기 메모리와 전기적으로 연결되는 프로세서;를 포함하고,

상기 프로세서는

상기 전자 장치가 제1 상태에 진입하는지를 확인하고,

상기 제1 상태에 진입하면 상기 카메라 모듈을 이용하여 소스 이미지를 촬영하고,

상기 소스 이미지를 기반으로 상기 제1 디스플레이에 출력되는 제1 출력 이미지 또는 상기 제2 디스플레이에 출력되는 제2 출력 이미지를 생성하는 전자 장치. - 제1항에 있어서, 상기 프로세서는

상기 센서 모듈을 통해 수집된 정보를 기반으로 상기 전자 장치가 정지된 상태를 상기 제1 상태로 결정하는 전자 장치. - 제2항에 있어서, 상기 프로세서는

자이로 센서 또는 가속도 센서의 측정값을 기반으로 상기 전자 장치의 정지된 상태를 결정하는 전자 장치. - 제1항에 있어서, 상기 프로세서는

상기 소스 이미지에서 추출된 색상 또는 무늬를 기반으로 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 생성하는 전자 장치. - 제4항에 있어서, 상기 프로세서는

상기 소스 이미지의 중심 영역에서 상기 색상 또는 상기 무늬를 추출하는 전자 장치. - 제4항에 있어서, 상기 프로세서는

상기 소스 이미지의 전체 픽셀 또는 샘플링된 픽셀에서 상기 색상 또는 상기 무늬를 추출하는 전자 장치. - 제1항에 있어서, 상기 프로세서는

상기 센서 모듈을 통해 측정된 상기 전자 장치의 이동 속도 또는 상기 전자 장치와 외부 객체 사이의 거리 중 적어도 하나를 기반으로 상기 제1 상태를 결정하는 전자 장치. - 제7항에 있어서, 상기 프로세서는

상기 이동 속도가 제1 문턱값 이하이고, 상기 거리가 제2 문턱값 이하인 상태를 상기 제1 상태로 결정하는 전자 장치. - 제7항에 있어서, 상기 프로세서는

상기 전자 장치가 제2 상태에 진입하면, 상기 제1 출력 이미지를 상기 제1 디스플레이에 적용하고, 상기 제2 출력 이미지를 상기 제2 디스플레이에 적용하는 전자 장치. - 제9항에 있어서, 상기 프로세서는

상기 센서 모듈을 통해 수집된 정보를 기반으로 상기 전자 장치가 정지된 상태를 상기 제2상태로 결정하는 전자 장치. - 제1항에 있어서, 상기 프로세서는

미리 설정된 필터를 적용하여 상기 소스 이미지를 촬영하는 전자 장치. - 제1항에 있어서, 상기 프로세서는

상기 제1 상태에 진입하면 복수의 이미지들을 촬영하고, 복수의 이미지들 중 적어도 일부를 상기 소스 이미지로 결정하는 전자 장치. - 제1항에 있어서, 상기 프로세서는

상기 소스 이미지에서 추출한 특징점을 기반으로 상기 메모리에 저장된 이미지를 검색하여 매칭되는 내부 이미지를 결정하고, 상기 소스 이미지 및 상기 결정된 내부 이미지를 기반으로 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 생성하는 전자 장치. - 제1항에 있어서, 상기 프로세서는

상기 소스 이미지에서 추출한 특징점을 기반으로 외부 장치에 매칭되는 외부 이미지를 요청하고, 상기 소스 이미지 및 상기 외부 이미지를 기반으로 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 생성하는 전자 장치. - 제1항에 있어서, 상기 프로세서는

상기 소스 이미지에서 추출한 특징점을 기반으로 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 생성하고, 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 상기 메모리에 저장하는 전자 장치. - 전자 장치에서 수행되는 화면 출력 방법에 있어서,

상기 전자 장치가 제1 상태에 진입하는지를 확인하는 동작;

상기 제1 상태에 진입하면 카메라 모듈을 이용하여 소스 이미지를 촬영하는 동작; 및,

상기 소스 이미지를 기반으로 제1 디스플레이에 출력되는 제1 출력 이미지 및 제2 디스플레이에 출력되는 제2 출력 이미지를 생성하는 동작;을 포함하는 방법. - 제16항에 있어서, 상기 전자 장치가 제1 상태에 진입하는지를 확인하는 동작은

상기 센서 모듈을 통해 수집된 정보를 기반으로 상기 전자 장치가 정지된 상태를 상기 제1 상태로 결정하는 동작;을 포함하는 방법. - 제16항에 있어서, 상기 전자 장치가 제1 상태에 진입하는지를 확인하는 동작은

센서 모듈을 통해 측정된 상기 전자 장치의 이동 속도 또는 상기 전자 장치와 외부 객체 사이의 거리 중 적어도 하나를 기반으로 상기 제1 상태를 결정하는 동작;을 포함하는 방법. - 제18항에 있어서,

상기 전자 장치가 제2 상태에 진입하면, 상기 제1 디스플레이 및 상기 제2 디스플레이에 각각 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 적용하는 동작;을 더 포함하는 방법. - 제19항에 있어서, 상기 제1 출력 이미지 및 상기 제2 출력 이미지를 적용하는 동작은

상기 센서 모듈을 통해 수집된 정보를 기반으로 상기 전자 장치가 정지된 상태를 상기 제2상태로 결정하는 동작;을 포함하는 방법.

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020160069091A KR102620138B1 (ko) | 2016-06-02 | 2016-06-02 | 화면 출력 방법 및 이를 지원하는 전자 장치 |

| EP17807053.8A EP3457268B1 (en) | 2016-06-02 | 2017-06-02 | Screen output method and electronic device supporting same |

| PCT/KR2017/005782 WO2017209560A1 (ko) | 2016-06-02 | 2017-06-02 | 화면 출력 방법 및 이를 지원하는 전자 장치 |

| US16/306,763 US10990196B2 (en) | 2016-06-02 | 2017-06-02 | Screen output method and electronic device supporting same |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020160069091A KR102620138B1 (ko) | 2016-06-02 | 2016-06-02 | 화면 출력 방법 및 이를 지원하는 전자 장치 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| KR20170136920A true KR20170136920A (ko) | 2017-12-12 |

| KR102620138B1 KR102620138B1 (ko) | 2024-01-03 |

Family

ID=60477682

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020160069091A KR102620138B1 (ko) | 2016-06-02 | 2016-06-02 | 화면 출력 방법 및 이를 지원하는 전자 장치 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US10990196B2 (ko) |

| EP (1) | EP3457268B1 (ko) |

| KR (1) | KR102620138B1 (ko) |

| WO (1) | WO2017209560A1 (ko) |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN109189544A (zh) * | 2018-10-17 | 2019-01-11 | 三星电子(中国)研发中心 | 用于生成表盘的方法和装置 |

| WO2019132409A1 (ko) * | 2017-12-29 | 2019-07-04 | 삼성전자 주식회사 | 전자 장치 및 그 제어 방법 |

| WO2019164374A1 (ko) * | 2018-02-23 | 2019-08-29 | 삼성전자 주식회사 | 전자 장치 및 아바타 기반의 커스텀 객체 운용 방법 |

| US11113850B2 (en) | 2018-09-27 | 2021-09-07 | Samsung Electronics Co., Ltd. | Electronic apparatus and control method thereof |

Families Citing this family (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2017200571A1 (en) | 2016-05-16 | 2017-11-23 | Google Llc | Gesture-based control of a user interface |

| CN110514181A (zh) * | 2018-05-22 | 2019-11-29 | 杭州萤石软件有限公司 | 一种电子设备定位方法和装置 |

| EP3991067A1 (en) | 2019-06-26 | 2022-05-04 | Google LLC | Radar-based authentication status feedback |

| KR20210153695A (ko) | 2019-07-26 | 2021-12-17 | 구글 엘엘씨 | Imu 및 레이더를 통한 인증 관리 |

| US11868537B2 (en) | 2019-07-26 | 2024-01-09 | Google Llc | Robust radar-based gesture-recognition by user equipment |

| US11385722B2 (en) | 2019-07-26 | 2022-07-12 | Google Llc | Robust radar-based gesture-recognition by user equipment |

| CN113853567B (zh) | 2019-07-26 | 2024-03-29 | 谷歌有限责任公司 | 基于imu和雷达降低状态 |

| EP3811187B1 (en) | 2019-08-30 | 2021-10-06 | Google LLC | Input methods for mobile devices |

| US11467672B2 (en) | 2019-08-30 | 2022-10-11 | Google Llc | Context-sensitive control of radar-based gesture-recognition |

| WO2021040748A1 (en) | 2019-08-30 | 2021-03-04 | Google Llc | Visual indicator for paused radar gestures |

| WO2021040742A1 (en) * | 2019-08-30 | 2021-03-04 | Google Llc | Input-mode notification for a multi-input node |

| US11868596B2 (en) * | 2021-07-28 | 2024-01-09 | Capital One Services, Llc | Color-based system for generating notifications |

| CN114356264B (zh) * | 2021-12-30 | 2023-12-05 | 威创集团股份有限公司 | 一种信号生成方法、装置、设备及可读存储介质 |

Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20050212749A1 (en) * | 2004-03-23 | 2005-09-29 | Marvit David L | Motion sensor engagement for a handheld device |

| US20070070076A1 (en) * | 2003-09-08 | 2007-03-29 | Eral Foxenland | Device with graphics dependent on the environment and method therefor |

| KR20110011266A (ko) * | 2009-07-28 | 2011-02-08 | 이화여자대학교 산학협력단 | 플렉시블 디스플레이 패널을 이용한 실시간 환경 색 감응형 위장 스마트웨어 |

| US20140228073A1 (en) * | 2013-02-14 | 2014-08-14 | Lsi Corporation | Automatic presentation of an image from a camera responsive to detection of a particular type of movement of a user device |

| US20150138385A1 (en) * | 2013-11-18 | 2015-05-21 | Heekwan Kim | Digital annotation-based visual recognition book pronunciation system and related method of operation |

| JP2016032152A (ja) * | 2014-07-28 | 2016-03-07 | コニカミノルタ株式会社 | 管理システム、画像処理装置、およびプロトコル分担プログラム |

| KR20160127515A (ko) * | 2015-04-27 | 2016-11-04 | 삼성전자주식회사 | 사용자 인터페이스 표시 방법 및 그 전자 장치 |

| KR20170019806A (ko) * | 2015-08-12 | 2017-02-22 | 삼성전자주식회사 | 위치 정보 제공 방법 및 장치 |

Family Cites Families (22)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20030225848A1 (en) | 2002-05-31 | 2003-12-04 | Brian Heikes | Remote instant messaging personalization items |

| US7689649B2 (en) | 2002-05-31 | 2010-03-30 | Aol Inc. | Rendering destination instant messaging personalization items before communicating with destination |

| US7779076B2 (en) | 2002-05-31 | 2010-08-17 | Aol Inc. | Instant messaging personalization |

| US20030225847A1 (en) | 2002-05-31 | 2003-12-04 | Brian Heikes | Sending instant messaging personalization items |

| US7685237B1 (en) | 2002-05-31 | 2010-03-23 | Aol Inc. | Multiple personalities in chat communications |

| US7636755B2 (en) | 2002-11-21 | 2009-12-22 | Aol Llc | Multiple avatar personalities |

| US8037150B2 (en) | 2002-11-21 | 2011-10-11 | Aol Inc. | System and methods for providing multiple personas in a communications environment |

| WO2004049113A2 (en) | 2002-11-21 | 2004-06-10 | America Online, Inc. | Multiple personalities |

| US7908554B1 (en) | 2003-03-03 | 2011-03-15 | Aol Inc. | Modifying avatar behavior based on user action or mood |

| US20070168863A1 (en) | 2003-03-03 | 2007-07-19 | Aol Llc | Interacting avatars in an instant messaging communication session |

| US20070113181A1 (en) | 2003-03-03 | 2007-05-17 | Blattner Patrick D | Using avatars to communicate real-time information |

| US7913176B1 (en) | 2003-03-03 | 2011-03-22 | Aol Inc. | Applying access controls to communications with avatars |

| US20040179037A1 (en) | 2003-03-03 | 2004-09-16 | Blattner Patrick D. | Using avatars to communicate context out-of-band |

| JP4218830B2 (ja) | 2003-11-18 | 2009-02-04 | ソニー・エリクソン・モバイルコミュニケーションズ株式会社 | 携帯型情報装置 |

| JP4885170B2 (ja) | 2008-06-27 | 2012-02-29 | 京セラ株式会社 | 携帯電話機 |

| US20170352188A1 (en) * | 2011-03-24 | 2017-12-07 | Pantomime Corporation | Support Based 3D Navigation |

| US8947627B2 (en) | 2011-10-14 | 2015-02-03 | Apple Inc. | Electronic devices having displays with openings |

| KR101872861B1 (ko) * | 2012-05-04 | 2018-06-29 | 엘지전자 주식회사 | 이동 단말기 및 그 제어 방법 |

| US9330587B2 (en) * | 2012-07-31 | 2016-05-03 | Hewlett-Packard Development Company, L.P. | Color adjustment based on object positioned near display surface |

| US9806219B2 (en) | 2013-02-14 | 2017-10-31 | Apple Inc. | Displays with camera window openings |

| KR20150017258A (ko) * | 2013-08-06 | 2015-02-16 | 엘지전자 주식회사 | 이동 단말기 및 이의 제어방법 |

| JP6698544B2 (ja) | 2014-03-31 | 2020-05-27 | ミューラル インコーポレイテッド | 周囲の状況に基づいた出力表示生成のためのシステム及び方法 |

-

2016

- 2016-06-02 KR KR1020160069091A patent/KR102620138B1/ko active IP Right Grant

-

2017

- 2017-06-02 US US16/306,763 patent/US10990196B2/en active Active

- 2017-06-02 WO PCT/KR2017/005782 patent/WO2017209560A1/ko unknown

- 2017-06-02 EP EP17807053.8A patent/EP3457268B1/en active Active

Patent Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20070070076A1 (en) * | 2003-09-08 | 2007-03-29 | Eral Foxenland | Device with graphics dependent on the environment and method therefor |

| US20050212749A1 (en) * | 2004-03-23 | 2005-09-29 | Marvit David L | Motion sensor engagement for a handheld device |

| KR20110011266A (ko) * | 2009-07-28 | 2011-02-08 | 이화여자대학교 산학협력단 | 플렉시블 디스플레이 패널을 이용한 실시간 환경 색 감응형 위장 스마트웨어 |

| US20140228073A1 (en) * | 2013-02-14 | 2014-08-14 | Lsi Corporation | Automatic presentation of an image from a camera responsive to detection of a particular type of movement of a user device |

| US20150138385A1 (en) * | 2013-11-18 | 2015-05-21 | Heekwan Kim | Digital annotation-based visual recognition book pronunciation system and related method of operation |

| JP2016032152A (ja) * | 2014-07-28 | 2016-03-07 | コニカミノルタ株式会社 | 管理システム、画像処理装置、およびプロトコル分担プログラム |

| KR20160127515A (ko) * | 2015-04-27 | 2016-11-04 | 삼성전자주식회사 | 사용자 인터페이스 표시 방법 및 그 전자 장치 |

| KR20170019806A (ko) * | 2015-08-12 | 2017-02-22 | 삼성전자주식회사 | 위치 정보 제공 방법 및 장치 |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2019132409A1 (ko) * | 2017-12-29 | 2019-07-04 | 삼성전자 주식회사 | 전자 장치 및 그 제어 방법 |

| WO2019164374A1 (ko) * | 2018-02-23 | 2019-08-29 | 삼성전자 주식회사 | 전자 장치 및 아바타 기반의 커스텀 객체 운용 방법 |

| US11113850B2 (en) | 2018-09-27 | 2021-09-07 | Samsung Electronics Co., Ltd. | Electronic apparatus and control method thereof |

| CN109189544A (zh) * | 2018-10-17 | 2019-01-11 | 三星电子(中国)研发中心 | 用于生成表盘的方法和装置 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20190129520A1 (en) | 2019-05-02 |

| EP3457268B1 (en) | 2020-08-05 |

| US10990196B2 (en) | 2021-04-27 |

| EP3457268A1 (en) | 2019-03-20 |

| EP3457268A4 (en) | 2019-06-19 |

| KR102620138B1 (ko) | 2024-01-03 |

| WO2017209560A1 (ko) | 2017-12-07 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10871798B2 (en) | Electronic device and image capture method thereof | |

| CN110462572B (zh) | 电子装置及其控制方法 | |

| US10944908B2 (en) | Method for controlling camera and electronic device therefor | |

| KR102620138B1 (ko) | 화면 출력 방법 및 이를 지원하는 전자 장치 | |

| CN107665485B (zh) | 用于显示图形对象的电子装置和计算机可读记录介质 | |

| CN113377317A (zh) | 用于提供屏幕镜像服务的设备和方法 | |

| KR20170019823A (ko) | 이미지 처리 방법 및 이를 지원하는 전자장치 | |

| KR20170097860A (ko) | 디스플레이를 이용하여 이미지를 촬영하는 전자 장치 및 이미지 촬영 방법 | |

| KR102588524B1 (ko) | 전자 장치 및 그의 동작 방법 | |

| KR20170097884A (ko) | 이미지를 처리하기 위한 방법 및 그 전자 장치 | |

| KR20180094290A (ko) | 전자 장치 및 전자 장치의 수중 촬영 판단 방법 | |

| US10719209B2 (en) | Method for outputting screen and electronic device supporting the same | |

| KR20160114434A (ko) | 전자 장치 및 전자 장치의 이미지 촬영 방법 | |

| KR20180131863A (ko) | 스마트 워치에 대한 정보를 제공하는 전자 장치와 이의 동작 방법 | |

| KR20180043098A (ko) | 영상을 표시하기 위한 전자 장치 및 컴퓨터 판독 가능한 기록 매체 | |

| KR20170098093A (ko) | 전자 장치 및 그의 동작 방법 | |

| KR20170052984A (ko) | 사용자의 위치를 결정하는 전자 장치 및 그 제어 방법 | |

| KR20170030347A (ko) | 전자 장치 및 그의 카메라 노출 조정 방법 | |

| KR20180108280A (ko) | 포커스에 대한 그래픽 인디케이터를 제공하는 전자 장치와 이의 동작 방법 | |

| KR20180082273A (ko) | 영상 통화를 수행하기 위한 전자 장치 및 컴퓨터 판독 가능한 기록매체 | |

| KR102568387B1 (ko) | 전자 장치 및 그의 데이터 처리 방법 | |

| KR20180106221A (ko) | 객체의 구성 정보에 대응하는 그래픽 효과를 제공하기 위한 방법 및 그 전자 장치 | |

| KR20180109204A (ko) | 전자 장치 및 그의 이미지 처리 방법 | |

| KR20180041905A (ko) | Emi 센서를 포함하는 전자 장치 | |

| US11210828B2 (en) | Method and electronic device for outputting guide |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| E902 | Notification of reason for refusal | ||

| E902 | Notification of reason for refusal | ||

| E701 | Decision to grant or registration of patent right | ||

| GRNT | Written decision to grant |