JP2014504413A - 理解および意図に基づく拡張現実表示用コンテンツ - Google Patents

理解および意図に基づく拡張現実表示用コンテンツ Download PDFInfo

- Publication number

- JP2014504413A JP2014504413A JP2013544548A JP2013544548A JP2014504413A JP 2014504413 A JP2014504413 A JP 2014504413A JP 2013544548 A JP2013544548 A JP 2013544548A JP 2013544548 A JP2013544548 A JP 2013544548A JP 2014504413 A JP2014504413 A JP 2014504413A

- Authority

- JP

- Japan

- Prior art keywords

- user

- objects

- interact

- intention

- determining

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 230000003190 augmentative effect Effects 0.000 title claims description 20

- 238000000034 method Methods 0.000 claims abstract description 104

- 210000001508 eye Anatomy 0.000 claims description 82

- 230000000007 visual effect Effects 0.000 claims description 24

- 230000033001 locomotion Effects 0.000 claims description 20

- 230000004424 eye movement Effects 0.000 claims description 7

- 210000003128 head Anatomy 0.000 claims description 4

- 230000000704 physical effect Effects 0.000 claims description 4

- 230000002708 enhancing effect Effects 0.000 claims description 3

- 238000000638 solvent extraction Methods 0.000 claims description 3

- 230000008569 process Effects 0.000 description 70

- 230000003993 interaction Effects 0.000 description 28

- 238000012545 processing Methods 0.000 description 26

- 230000003287 optical effect Effects 0.000 description 24

- 238000013459 approach Methods 0.000 description 16

- 238000004891 communication Methods 0.000 description 16

- 238000005516 engineering process Methods 0.000 description 13

- 238000010586 diagram Methods 0.000 description 10

- 238000005286 illumination Methods 0.000 description 9

- 230000006870 function Effects 0.000 description 8

- 239000000758 substrate Substances 0.000 description 7

- 238000012800 visualization Methods 0.000 description 7

- 230000009471 action Effects 0.000 description 6

- 230000005540 biological transmission Effects 0.000 description 6

- 230000008859 change Effects 0.000 description 6

- 230000000875 corresponding effect Effects 0.000 description 6

- 238000004458 analytical method Methods 0.000 description 5

- 238000004364 calculation method Methods 0.000 description 5

- 230000002596 correlated effect Effects 0.000 description 4

- 230000000694 effects Effects 0.000 description 4

- 239000011521 glass Substances 0.000 description 4

- 238000003384 imaging method Methods 0.000 description 4

- 210000001747 pupil Anatomy 0.000 description 4

- 230000002123 temporal effect Effects 0.000 description 4

- 235000013549 apple pie Nutrition 0.000 description 3

- 238000001514 detection method Methods 0.000 description 3

- 238000009499 grossing Methods 0.000 description 3

- 230000001965 increasing effect Effects 0.000 description 3

- 230000006855 networking Effects 0.000 description 3

- 230000002093 peripheral effect Effects 0.000 description 3

- 230000004044 response Effects 0.000 description 3

- RZVAJINKPMORJF-UHFFFAOYSA-N Acetaminophen Chemical compound CC(=O)NC1=CC=C(O)C=C1 RZVAJINKPMORJF-UHFFFAOYSA-N 0.000 description 2

- 241000282412 Homo Species 0.000 description 2

- 230000001133 acceleration Effects 0.000 description 2

- 239000011149 active material Substances 0.000 description 2

- 239000003086 colorant Substances 0.000 description 2

- 230000007123 defense Effects 0.000 description 2

- 230000004927 fusion Effects 0.000 description 2

- 239000010985 leather Substances 0.000 description 2

- 239000004973 liquid crystal related substance Substances 0.000 description 2

- 230000010363 phase shift Effects 0.000 description 2

- 238000009877 rendering Methods 0.000 description 2

- 238000005070 sampling Methods 0.000 description 2

- 235000011888 snacks Nutrition 0.000 description 2

- 230000005236 sound signal Effects 0.000 description 2

- 210000000707 wrist Anatomy 0.000 description 2

- 241001025261 Neoraja caerulea Species 0.000 description 1

- 206010039740 Screaming Diseases 0.000 description 1

- XUIMIQQOPSSXEZ-UHFFFAOYSA-N Silicon Chemical compound [Si] XUIMIQQOPSSXEZ-UHFFFAOYSA-N 0.000 description 1

- 206010047571 Visual impairment Diseases 0.000 description 1

- 230000003416 augmentation Effects 0.000 description 1

- 230000008901 benefit Effects 0.000 description 1

- 210000000988 bone and bone Anatomy 0.000 description 1

- 210000004087 cornea Anatomy 0.000 description 1

- 210000005069 ears Anatomy 0.000 description 1

- 210000000887 face Anatomy 0.000 description 1

- 230000001815 facial effect Effects 0.000 description 1

- 230000008921 facial expression Effects 0.000 description 1

- 238000003780 insertion Methods 0.000 description 1

- 230000037431 insertion Effects 0.000 description 1

- 230000010354 integration Effects 0.000 description 1

- 239000000463 material Substances 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 238000002310 reflectometry Methods 0.000 description 1

- 210000001525 retina Anatomy 0.000 description 1

- 229910052710 silicon Inorganic materials 0.000 description 1

- 239000010703 silicon Substances 0.000 description 1

- 239000000126 substance Substances 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

- 238000002834 transmittance Methods 0.000 description 1

- 230000004393 visual impairment Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/011—Arrangements for interaction with the human body, e.g. for user immersion in virtual reality

- G06F3/013—Eye tracking input arrangements

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B27/00—Optical systems or apparatus not provided for by any of the groups G02B1/00 - G02B26/00, G02B30/00

- G02B27/01—Head-up displays

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B27/00—Optical systems or apparatus not provided for by any of the groups G02B1/00 - G02B26/00, G02B30/00

- G02B27/01—Head-up displays

- G02B27/017—Head mounted

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/017—Gesture based interaction, e.g. based on a set of recognized hand gestures

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T17/00—Three dimensional [3D] modelling, e.g. data description of 3D objects

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/20—Servers specifically adapted for the distribution of content, e.g. VOD servers; Operations thereof

- H04N21/25—Management operations performed by the server for facilitating the content distribution or administrating data related to end-users or client devices, e.g. end-user or client device authentication, learning user preferences for recommending movies

- H04N21/258—Client or end-user data management, e.g. managing client capabilities, user preferences or demographics, processing of multiple end-users preferences to derive collaborative data

- H04N21/25866—Management of end-user data

- H04N21/25891—Management of end-user data being end-user preferences

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/472—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content

- H04N21/47205—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content for manipulating displayed content, e.g. interacting with MPEG-4 objects, editing locally

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/472—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content

- H04N21/4722—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content for requesting additional data associated with the content

- H04N21/4725—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content for requesting additional data associated with the content using interactive regions of the image, e.g. hot spots

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B27/00—Optical systems or apparatus not provided for by any of the groups G02B1/00 - G02B26/00, G02B30/00

- G02B27/01—Head-up displays

- G02B27/0101—Head-up displays characterised by optical features

- G02B2027/014—Head-up displays characterised by optical features comprising information/image processing systems

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B27/00—Optical systems or apparatus not provided for by any of the groups G02B1/00 - G02B26/00, G02B30/00

- G02B27/01—Head-up displays

- G02B27/017—Head mounted

- G02B2027/0178—Eyeglass type

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B27/00—Optical systems or apparatus not provided for by any of the groups G02B1/00 - G02B26/00, G02B30/00

- G02B27/01—Head-up displays

- G02B27/0179—Display position adjusting means not related to the information to be displayed

- G02B2027/0187—Display position adjusting means not related to the information to be displayed slaved to motion of at least a part of the body of the user, e.g. head, eye

Abstract

【選択図】図14

Description

[0050] 実世界物体の代用にz−バッファリングを行った後、レンダリング・パイプラインからアルファ値のマスクを用いることができる。本システムは、拡張現実表示のために場面をレンダリングするとき、どの実世界物体がどの仮想物体の前にあるか注意を払う。仮想物体が実世界物体の前にある場合、仮想物体が遮るエリアを不透明にしなければならない。仮想物体が(仮想的に)実世界物体の後ろにある場合、ユーザーが実際の光のその対応するエリア(1画素以上のサイズ)の実世界の物体だけを見るように、その画素に対するあらゆる色だけでなく不透明性もオフにする。遮蔽(coverage)は、画素毎であるので、本システムは、仮想物体の一部が実世界の物体の前にある場合、仮想物体の一部が実世界の物体の後ろにある場合、そして仮想物体の一部が実世界の物体と同じ位置にある場合も扱うことができる。0%から100%まで不透明性を可変にすることができる低コスト、低パワーおよび軽量のディスプレイが、この使用には最も望ましい。更に、不透明フィルターは、カラーLCDによって、または有機LEDのような他のディスプレイによって、カラーでレンダリングし、広い視野を設けることができる。不透明フィルターについてのこれ以上の詳細は、"Opacity Filter For See-Through Mounted Display"(透視装着ディスプレイ用不透明フィルター)と題し、2010年9月21日に出願された米国特許出願第12/887,426号において示されている。この出願をここで引用したことにより、その内容全体が本願にも含まれることとする。

Claims (10)

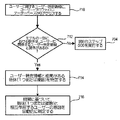

- 拡張現実システムにおけるユーザーの意図に基づいて最適画像を生成する方法であって、

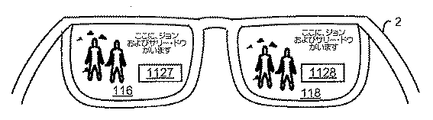

ユーザーが透視ディスプレイ・デバイスを用いている場面において1つ以上の対象物体を判定するステップと、

前記場面におけるユーザーの視野を判定し、前記視野内において前記ユーザーの焦点領域を判定するステップと、

前記ユーザーの焦点領域において1つ以上の物体と相互作用する前記ユーザーの意図を判定するステップと、

前記ユーザーの意図に基づいて最適画像を生成するステップと、

前記透視ディスプレイ・デバイスを介して、前記最適画像を前記ユーザーに表示するステップと、

を備えている、方法。 - 請求項1記載の方法において、1つ以上の対象物体を判定する前記ステップが、前記場面の三次元モデルを作成するステップを含み、更に、

前記三次元モデルを、前記場面を構成する前記物体の1つ以上に区分し、前記場面において前記1つ以上の物体を特定するステップを備えている、方法。 - 請求項2記載の方法において、前記ユーザーの視野を判定するステップが、更に、

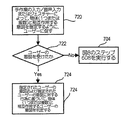

前記場面の三次元モデル内において、前記ユーザーの頭部の位置および向きを判定するステップを含む、方法。 - 請求項1記載の方法において、前記ユーザーの焦点領域において1つ以上の物体と相互作用する前記ユーザーの意図を判定するステップが、

前記ユーザーの焦点領域における前記ユーザーの目の移動パターンを検出するステップと、

前記ユーザーの焦点領域においてユーザーによって見られている1つ以上の物体上における前記ユーザーの凝視の強さを判定するステップと、

前記目の移動パターンおよび前記ユーザーの凝視の強さに基づいて、前記ユーザーの焦点領域において前記1つ以上の物体と相互作用するユーザーの意図を推論するステップと、

を含む、方法。 - 請求項1記載の方法において、前記ユーザーの焦点領域において1つ以上の物体と相互作用する前記ユーザーの意図を判定するステップが、更に、

前記ユーザーに関係があるユーザー特定情報にアクセスするステップと、

前記ユーザーの焦点領域における前記物体の1つ以上を、前記ユーザー特定情報と相関付けるステップと、

前記相関に基づいて、前記ユーザーの焦点領域において前記1つ以上の物体と相互作用するユーザーの意図を自動的に推論するステップと、

を含む、方法。 - 請求項1記載の方法において、前記ユーザーの焦点領域において1つ以上の物体と相互作用する前記ユーザーの意図を判定するステップが、

前記ユーザーの焦点領域において前記物体の1つ以上と相互作用する意図を指定するように、前記ユーザーに促すステップと、

ユーザーの身体的行為の少なくとも1つによって、ユーザーの意図を受けるステップと、

前記ユーザーの身体的行為に基づいて、前記1つ以上の物体と相互作用するユーザーの意図を判定するステップと、

を含む、方法。 - 請求項1記載の方法において、前記最適画像を生成するステップが、更に、

前記ユーザーの焦点領域において、ユーザーが相互作用しようとする前記1つ以上の物体の外観を視覚的に強調するステップと、

前記ユーザーの焦点領域の外側であるが前記ユーザーの視野内にあり、前記ユーザーが相互作用しようとしない前記1つ以上の物体の外観を目立たなくするステップと、

前記ユーザーの焦点領域における前記1つ以上の物体に関係する拡張コンテンツまたはオーディオ・コンテンツの内少なくとも1つを読み出すステップと、

前記ユーザーの焦点領域において、前記1つ以上の物体に被せてまたはその隣りに、前記拡張コンテンツまたはオーディオ情報を投射するステップと、

を含む、方法。 - 拡張現実システムであって、

透視ディスプレイ・デバイスと、

前記透視ディスプレイに取り付けられ、ユーザーが見る場面において1つ以上の物体と相互作用する前記ユーザーの意図を判定することに基づいて、前記ユーザーに最適画像を表示するマイクロ・ディスプレイ・デバイスと、

前記マイクロ・ディスプレイ・デバイスに通信状態で結合されているプロセッサーと、

前記プロセッサーによってアクセス可能であり、ソフトウェアおよびデーターを格納するメモリーと、

を備えており、

ソフトウェアの制御の下で、前記プロセッサーが、前記ユーザーの焦点領域において前記1つ以上の物体と相互作用するユーザーの意図を判定し、前記ユーザーの意図に基づいて、前記ユーザーのために最適画像を生成する、拡張現実システム。 - 請求項8記載の拡張現実システムにおいて、前記プロセッサーが、前記ユーザーの目の移動パターン、前記ユーザーの凝視の強さ、および前記ユーザーに関係があるユーザー特定情報の内少なくとも1つに基づいて、前記ユーザーの焦点領域において1つ以上の物体と相互作用する前記ユーザーの意図を判定する、拡張現実システム。

- 請求項8記載の拡張現実システムにおいて、前記マイクロ・ディスプレイ・アセンブリーが、前記1つ以上の物体の縁端を際立たせること、あるいは前記1つ以上の物体が配置されている領域において仮想的なボックス、円、または視覚的インディケーターを表示することの内少なくとも1つによって、前記最適画像において、ユーザーが相互作用しようとしている前記1つ以上の物体を視覚的に強調する、拡張現実システム。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US12/970,695 US9213405B2 (en) | 2010-12-16 | 2010-12-16 | Comprehension and intent-based content for augmented reality displays |

| US12/970,695 | 2010-12-16 | ||

| PCT/US2011/063350 WO2012082444A1 (en) | 2010-12-16 | 2011-12-05 | Comprehension and intent-based content for augmented reality displays |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2014504413A true JP2014504413A (ja) | 2014-02-20 |

| JP2014504413A5 JP2014504413A5 (ja) | 2015-01-08 |

Family

ID=46233877

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2013544548A Pending JP2014504413A (ja) | 2010-12-16 | 2011-12-05 | 理解および意図に基づく拡張現実表示用コンテンツ |

Country Status (9)

| Country | Link |

|---|---|

| US (1) | US9213405B2 (ja) |

| EP (1) | EP2652940B1 (ja) |

| JP (1) | JP2014504413A (ja) |

| KR (1) | KR101935061B1 (ja) |

| CN (1) | CN102566756B (ja) |

| AR (1) | AR084345A1 (ja) |

| HK (1) | HK1171103A1 (ja) |

| TW (1) | TWI549505B (ja) |

| WO (1) | WO2012082444A1 (ja) |

Cited By (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2015176526A (ja) * | 2014-03-18 | 2015-10-05 | セイコーエプソン株式会社 | 頭部装着型表示装置および頭部装着型表示装置の制御方法 |

| JP2016024690A (ja) * | 2014-07-22 | 2016-02-08 | Necパーソナルコンピュータ株式会社 | 動作認識装置、動作認識方法、及び、プログラム |

| JP2016042680A (ja) * | 2014-08-19 | 2016-03-31 | セイコーエプソン株式会社 | 頭部装着型表示装置、画像表示システム、頭部装着型表示装置を制御する方法、および、コンピュータープログラム |

| JP2017055993A (ja) * | 2015-09-16 | 2017-03-23 | グリー株式会社 | ゲーム処理プログラム、ゲーム処理装置及びゲーム処理方法 |

| JP2017510877A (ja) * | 2014-01-25 | 2017-04-13 | ソニー インタラクティブ エンタテインメント アメリカ リミテッド ライアビリテイ カンパニー | ヘッドマウントディスプレイにおけるメニューナビゲーション |

| JPWO2016002445A1 (ja) * | 2014-07-03 | 2017-04-27 | ソニー株式会社 | 情報処理装置、情報処理方法、及びプログラム |

| JP2017519999A (ja) * | 2014-04-22 | 2017-07-20 | アルブーゾフ, イワンARBOUZOV, Ivan | 頭部搭載型スマートデバイス用熱画像形成アクセサリ |

| JP2017526078A (ja) * | 2014-05-09 | 2017-09-07 | グーグル インコーポレイテッド | 実在および仮想のオブジェクトと対話するための生体力学ベースの眼球信号のためのシステムおよび方法 |

| KR20180083252A (ko) * | 2015-08-15 | 2018-07-20 | 구글 엘엘씨 | 실제 객체 및 가상 객체와 상호작용하기 위한 생체기계적 기반의 안구 신호를 위한 시스템 및 방법 |

| WO2018198320A1 (ja) * | 2017-04-28 | 2018-11-01 | 株式会社オプティム | ウェアラブル端末表示システム、ウェアラブル端末表示方法およびプログラム |

| JPWO2017169158A1 (ja) * | 2016-03-29 | 2019-02-07 | ソニー株式会社 | 情報処理装置、情報処理方法、およびプログラム |

| JPWO2017187708A1 (ja) * | 2016-04-26 | 2019-02-28 | ソニー株式会社 | 情報処理装置、情報処理方法、及びプログラム |

| US10228895B2 (en) | 2012-11-06 | 2019-03-12 | Sony Corporation | Image display device, image display method, and computer program |

| US10297062B2 (en) | 2014-03-18 | 2019-05-21 | Seiko Epson Corporation | Head-mounted display device, control method for head-mounted display device, and computer program |

| JP2019533824A (ja) * | 2016-07-25 | 2019-11-21 | マジック リープ, インコーポレイテッドMagic Leap,Inc. | 拡張現実および仮想現実アイウェアを用いた結像修正、表示、および可視化 |

| JP7407929B2 (ja) | 2019-11-11 | 2024-01-04 | リアルシー・(ベイジン)・テクノロジー・カンパニー・リミテッド | 情報再生方法、装置、コンピュータ読み取り可能な記憶媒体及び電子機器 |

Families Citing this family (269)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP2570981A4 (en) * | 2010-05-28 | 2014-04-09 | Rakuten Inc | CONTENTS OF THE TABLE OF CONTENTS, TABLE OF CONTENTS, TABLE OF CONTENTS AND RECORDING MEDIUM, WITH THE CONTENT OF THE TABLE OF CONTENTS |

| US9132352B1 (en) | 2010-06-24 | 2015-09-15 | Gregory S. Rabin | Interactive system and method for rendering an object |

| US9429438B2 (en) * | 2010-12-23 | 2016-08-30 | Blackberry Limited | Updating map data from camera images |

| JP5841538B2 (ja) * | 2011-02-04 | 2016-01-13 | パナソニック インテレクチュアル プロパティ コーポレーション オブアメリカPanasonic Intellectual Property Corporation of America | 関心度推定装置および関心度推定方法 |

| JP5377537B2 (ja) * | 2011-02-10 | 2013-12-25 | 株式会社エヌ・ティ・ティ・ドコモ | オブジェクト表示装置、オブジェクト表示方法及びオブジェクト表示プログラム |

| US10895917B2 (en) * | 2011-03-12 | 2021-01-19 | Uday Parshionikar | Multipurpose controllers and methods |

| US20130010068A1 (en) * | 2011-04-12 | 2013-01-10 | Radiation Monitoring Devices, Inc. | Augmented reality system |

| US8836771B2 (en) * | 2011-04-26 | 2014-09-16 | Echostar Technologies L.L.C. | Apparatus, systems and methods for shared viewing experience using head mounted displays |

| US8885877B2 (en) * | 2011-05-20 | 2014-11-11 | Eyefluence, Inc. | Systems and methods for identifying gaze tracking scene reference locations |

| JP5757166B2 (ja) * | 2011-06-09 | 2015-07-29 | ソニー株式会社 | 音制御装置、プログラム及び制御方法 |

| US9921641B1 (en) | 2011-06-10 | 2018-03-20 | Amazon Technologies, Inc. | User/object interactions in an augmented reality environment |

| US10008037B1 (en) * | 2011-06-10 | 2018-06-26 | Amazon Technologies, Inc. | User/object interactions in an augmented reality environment |

| US9996972B1 (en) | 2011-06-10 | 2018-06-12 | Amazon Technologies, Inc. | User/object interactions in an augmented reality environment |

| US20120326948A1 (en) * | 2011-06-22 | 2012-12-27 | Microsoft Corporation | Environmental-light filter for see-through head-mounted display device |

| US9288468B2 (en) * | 2011-06-29 | 2016-03-15 | Microsoft Technology Licensing, Llc | Viewing windows for video streams |

| US8558759B1 (en) * | 2011-07-08 | 2013-10-15 | Google Inc. | Hand gestures to signify what is important |

| WO2013028908A1 (en) | 2011-08-24 | 2013-02-28 | Microsoft Corporation | Touch and social cues as inputs into a computer |

| JP5762892B2 (ja) * | 2011-09-06 | 2015-08-12 | ビッグローブ株式会社 | 情報表示システム、情報表示方法、及び情報表示用プログラム |

| CA2847975A1 (en) * | 2011-09-07 | 2013-03-14 | Tandemlaunch Technologies Inc. | System and method for using eye gaze information to enhance interactions |

| US9690100B1 (en) * | 2011-09-22 | 2017-06-27 | Sprint Communications Company L.P. | Wireless communication system with a liquid crystal display embedded in an optical lens |

| US20150199081A1 (en) * | 2011-11-08 | 2015-07-16 | Google Inc. | Re-centering a user interface |

| USH2282H1 (en) * | 2011-11-23 | 2013-09-03 | The United States Of America, As Represented By The Secretary Of The Navy | Automatic eye tracking control |

| US9182815B2 (en) | 2011-12-07 | 2015-11-10 | Microsoft Technology Licensing, Llc | Making static printed content dynamic with virtual data |

| US9183807B2 (en) | 2011-12-07 | 2015-11-10 | Microsoft Technology Licensing, Llc | Displaying virtual data as printed content |

| US9229231B2 (en) * | 2011-12-07 | 2016-01-05 | Microsoft Technology Licensing, Llc | Updating printed content with personalized virtual data |

| US9256071B1 (en) * | 2012-01-09 | 2016-02-09 | Google Inc. | User interface |

| JP5620414B2 (ja) * | 2012-01-18 | 2014-11-05 | 株式会社スクウェア・エニックス | ゲーム装置 |

| US9829715B2 (en) | 2012-01-23 | 2017-11-28 | Nvidia Corporation | Eyewear device for transmitting signal and communication method thereof |

| US9625720B2 (en) | 2012-01-24 | 2017-04-18 | Accipiter Radar Technologies Inc. | Personal electronic target vision system, device and method |

| FR2987155A1 (fr) * | 2012-02-16 | 2013-08-23 | Univ Paris Curie | Procede de mise en evidence d'au moins un element en mouvement dans une scene ainsi qu'un dispositif portatif de realite augmentee mettant en oeuvre ledit procede |

| EP2629498A1 (en) * | 2012-02-17 | 2013-08-21 | Sony Ericsson Mobile Communications AB | Portable electronic equipment and method of visualizing sound |

| US20140204014A1 (en) * | 2012-03-30 | 2014-07-24 | Sony Mobile Communications Ab | Optimizing selection of a media object type in which to present content to a user of a device |

| GB2501567A (en) * | 2012-04-25 | 2013-10-30 | Christian Sternitzke | Augmented reality information obtaining system |

| US9165381B2 (en) | 2012-05-31 | 2015-10-20 | Microsoft Technology Licensing, Llc | Augmented books in a mixed reality environment |

| JP5483761B2 (ja) * | 2012-06-29 | 2014-05-07 | 株式会社ソニー・コンピュータエンタテインメント | 映像出力装置、立体映像観察デバイス、映像提示システム、および映像出力方法 |

| US9557565B2 (en) | 2012-07-02 | 2017-01-31 | Nvidia Corporation | Near-eye optical deconvolution displays |

| USRE47984E1 (en) | 2012-07-02 | 2020-05-12 | Nvidia Corporation | Near-eye optical deconvolution displays |

| US9841537B2 (en) | 2012-07-02 | 2017-12-12 | Nvidia Corporation | Near-eye microlens array displays |

| US9494797B2 (en) | 2012-07-02 | 2016-11-15 | Nvidia Corporation | Near-eye parallax barrier displays |

| US9349218B2 (en) * | 2012-07-26 | 2016-05-24 | Qualcomm Incorporated | Method and apparatus for controlling augmented reality |

| US20150156196A1 (en) * | 2012-07-31 | 2015-06-04 | Intellectual Discovery Co., Ltd. | Wearable electronic device and method for controlling same |

| US9329678B2 (en) | 2012-08-14 | 2016-05-03 | Microsoft Technology Licensing, Llc | Augmented reality overlay for control devices |

| US10548514B2 (en) | 2013-03-07 | 2020-02-04 | Alpinereplay, Inc. | Systems and methods for identifying and characterizing athletic maneuvers |

| US10408857B2 (en) * | 2012-09-12 | 2019-09-10 | Alpinereplay, Inc. | Use of gyro sensors for identifying athletic maneuvers |

| KR101989893B1 (ko) | 2012-10-29 | 2019-09-30 | 엘지전자 주식회사 | 헤드 마운트 디스플레이 및 이를 이용한 오디오 신호 출력 방법 |

| JP5787099B2 (ja) * | 2012-11-06 | 2015-09-30 | コニカミノルタ株式会社 | 案内情報表示装置 |

| US9619911B2 (en) | 2012-11-13 | 2017-04-11 | Qualcomm Incorporated | Modifying virtual object display properties |

| TWI486629B (zh) * | 2012-11-21 | 2015-06-01 | Ind Tech Res Inst | 穿透型頭部穿戴式顯示系統與互動操作方法 |

| US9189021B2 (en) * | 2012-11-29 | 2015-11-17 | Microsoft Technology Licensing, Llc | Wearable food nutrition feedback system |

| US20140152530A1 (en) * | 2012-12-03 | 2014-06-05 | Honeywell International Inc. | Multimedia near to eye display system |

| US9851783B2 (en) * | 2012-12-06 | 2017-12-26 | International Business Machines Corporation | Dynamic augmented reality media creation |

| US20140218281A1 (en) | 2012-12-06 | 2014-08-07 | Eyefluence, Inc. | Systems and methods for eye gaze determination |

| US9317972B2 (en) * | 2012-12-18 | 2016-04-19 | Qualcomm Incorporated | User interface for augmented reality enabled devices |

| US9996150B2 (en) * | 2012-12-19 | 2018-06-12 | Qualcomm Incorporated | Enabling augmented reality using eye gaze tracking |

| US20140168264A1 (en) | 2012-12-19 | 2014-06-19 | Lockheed Martin Corporation | System, method and computer program product for real-time alignment of an augmented reality device |

| US10514541B2 (en) * | 2012-12-27 | 2019-12-24 | Microsoft Technology Licensing, Llc | Display update time reduction for a near-eye display |

| US9497448B2 (en) * | 2012-12-31 | 2016-11-15 | Lg Display Co., Ltd. | Image processing method of transparent display apparatus and apparatus thereof |

| US9685065B2 (en) * | 2013-01-03 | 2017-06-20 | Sensolid Bvba | Dual sensor system and related data manipulation methods and uses |

| KR102019124B1 (ko) * | 2013-01-04 | 2019-09-06 | 엘지전자 주식회사 | 헤드 마운트 디스플레이 및 그 제어 방법 |

| US20140195968A1 (en) * | 2013-01-09 | 2014-07-10 | Hewlett-Packard Development Company, L.P. | Inferring and acting on user intent |

| US9812046B2 (en) * | 2013-01-10 | 2017-11-07 | Microsoft Technology Licensing, Llc | Mixed reality display accommodation |

| WO2014115387A1 (ja) * | 2013-01-28 | 2014-07-31 | ソニー株式会社 | 情報処理装置、情報処理方法およびプログラム |

| US10133342B2 (en) * | 2013-02-14 | 2018-11-20 | Qualcomm Incorporated | Human-body-gesture-based region and volume selection for HMD |

| US9791921B2 (en) | 2013-02-19 | 2017-10-17 | Microsoft Technology Licensing, Llc | Context-aware augmented reality object commands |

| US11553228B2 (en) * | 2013-03-06 | 2023-01-10 | Arthur J. Zito, Jr. | Multi-media presentation system |

| JP5962547B2 (ja) * | 2013-03-08 | 2016-08-03 | ソニー株式会社 | 情報処理装置、情報処理方法およびプログラム |

| EP2967322A4 (en) | 2013-03-11 | 2017-02-08 | Magic Leap, Inc. | System and method for augmented and virtual reality |

| US20140280503A1 (en) | 2013-03-15 | 2014-09-18 | John Cronin | System and methods for effective virtual reality visitor interface |

| US20140280505A1 (en) | 2013-03-15 | 2014-09-18 | John Cronin | Virtual reality interaction with 3d printing |

| US20140280506A1 (en) | 2013-03-15 | 2014-09-18 | John Cronin | Virtual reality enhanced through browser connections |

| US11228805B2 (en) * | 2013-03-15 | 2022-01-18 | Dish Technologies Llc | Customized commercial metrics and presentation via integrated virtual environment devices |

| WO2014138925A1 (en) * | 2013-03-15 | 2014-09-18 | Interaxon Inc. | Wearable computing apparatus and method |

| CN108427504B (zh) | 2013-03-15 | 2021-06-11 | 奇跃公司 | 显示系统和方法 |

| US20140280502A1 (en) | 2013-03-15 | 2014-09-18 | John Cronin | Crowd and cloud enabled virtual reality distributed location network |

| US20140280644A1 (en) | 2013-03-15 | 2014-09-18 | John Cronin | Real time unified communications interaction of a predefined location in a virtual reality location |

| US9838506B1 (en) | 2013-03-15 | 2017-12-05 | Sony Interactive Entertainment America Llc | Virtual reality universe representation changes viewing based upon client side parameters |

| US20140267581A1 (en) | 2013-03-15 | 2014-09-18 | John Cronin | Real time virtual reality leveraging web cams and ip cams and web cam and ip cam networks |

| JP5900393B2 (ja) * | 2013-03-21 | 2016-04-06 | ソニー株式会社 | 情報処理装置、操作制御方法及びプログラム |

| EP2790126B1 (en) * | 2013-04-08 | 2016-06-01 | Cogisen SRL | Method for gaze tracking |

| US20160109957A1 (en) * | 2013-05-09 | 2016-04-21 | Sony Computer Entertainment Inc. | Information processing apparatus and application execution method |

| CN103246350A (zh) * | 2013-05-14 | 2013-08-14 | 中国人民解放军海军航空工程学院 | 基于感兴趣区实现辅助信息提示的人机接口设备及方法 |

| US9230368B2 (en) * | 2013-05-23 | 2016-01-05 | Microsoft Technology Licensing, Llc | Hologram anchoring and dynamic positioning |

| US10019057B2 (en) * | 2013-06-07 | 2018-07-10 | Sony Interactive Entertainment Inc. | Switching mode of operation in a head mounted display |

| US9710130B2 (en) * | 2013-06-12 | 2017-07-18 | Microsoft Technology Licensing, Llc | User focus controlled directional user input |

| US9329682B2 (en) * | 2013-06-18 | 2016-05-03 | Microsoft Technology Licensing, Llc | Multi-step virtual object selection |

| US10955665B2 (en) * | 2013-06-18 | 2021-03-23 | Microsoft Technology Licensing, Llc | Concurrent optimal viewing of virtual objects |

| US10330931B2 (en) | 2013-06-28 | 2019-06-25 | Microsoft Technology Licensing, Llc | Space carving based on human physical data |

| KR102056221B1 (ko) * | 2013-07-12 | 2019-12-16 | 삼성전자주식회사 | 시선인식을 이용한 장치 연결 방법 및 장치 |

| US9582075B2 (en) | 2013-07-19 | 2017-02-28 | Nvidia Corporation | Gaze-tracking eye illumination from display |

| US9880325B2 (en) | 2013-08-14 | 2018-01-30 | Nvidia Corporation | Hybrid optics for near-eye displays |

| KR20150020918A (ko) * | 2013-08-19 | 2015-02-27 | 엘지전자 주식회사 | 디스플레이 장치 및 그것의 제어 방법 |

| KR102160650B1 (ko) * | 2013-08-26 | 2020-09-28 | 삼성전자주식회사 | 사용자의 의도를 자동으로 인지하여 정보를 제공하는 모바일 장치 및 그의 동작 방법 |

| US9658454B2 (en) | 2013-09-06 | 2017-05-23 | Omnivision Technologies, Inc. | Eyewear display system providing vision enhancement |

| US9630105B2 (en) * | 2013-09-30 | 2017-04-25 | Sony Interactive Entertainment Inc. | Camera based safety mechanisms for users of head mounted displays |

| US9729864B2 (en) * | 2013-09-30 | 2017-08-08 | Sony Interactive Entertainment Inc. | Camera based safety mechanisms for users of head mounted displays |

| US9489765B2 (en) * | 2013-11-18 | 2016-11-08 | Nant Holdings Ip, Llc | Silhouette-based object and texture alignment, systems and methods |

| WO2015084227A1 (en) * | 2013-12-06 | 2015-06-11 | Telefonaktiebolaget L M Ericsson (Publ) | Optical head mounted display, television portal module and methods for controlling graphical user interface |

| JP6331374B2 (ja) * | 2013-12-17 | 2018-05-30 | セイコーエプソン株式会社 | 頭部装着型表示装置 |

| CN103752010B (zh) * | 2013-12-18 | 2017-07-11 | 微软技术许可有限责任公司 | 用于控制设备的增强现实覆盖 |

| JP2015118556A (ja) * | 2013-12-18 | 2015-06-25 | マイクロソフト コーポレーション | コントロールデバイスのための拡張現実オーバーレイ |

| US9484005B2 (en) | 2013-12-20 | 2016-11-01 | Qualcomm Incorporated | Trimming content for projection onto a target |

| TWI530909B (zh) | 2013-12-31 | 2016-04-21 | 財團法人工業技術研究院 | 影像合成系統及方法 |

| JP2015134079A (ja) * | 2014-01-17 | 2015-07-27 | 株式会社ユニバーサルエンターテインメント | ゲーミングマシン |

| TWI486631B (zh) * | 2014-01-24 | 2015-06-01 | Quanta Comp Inc | 頭戴式顯示裝置及其控制方法 |

| US9437159B2 (en) | 2014-01-25 | 2016-09-06 | Sony Interactive Entertainment America Llc | Environmental interrupt in a head-mounted display and utilization of non field of view real estate |

| US9792406B2 (en) | 2014-02-10 | 2017-10-17 | Neuronetics, Inc. | Head modeling for a therapeutic or diagnostic procedure |

| JP2015158748A (ja) * | 2014-02-21 | 2015-09-03 | ソニー株式会社 | 制御装置、情報処理装置、制御方法、情報処理方法、情報処理システム、ウェアラブル機器 |

| US20160371888A1 (en) * | 2014-03-10 | 2016-12-22 | Bae Systems Plc | Interactive information display |

| KR102227659B1 (ko) * | 2014-03-12 | 2021-03-15 | 삼성전자주식회사 | Hmd 장치를 통하여 가상 이미지를 디스플레이하는 시스템 및 방법 |

| CN103927966A (zh) * | 2014-04-02 | 2014-07-16 | 北京智谷睿拓技术服务有限公司 | 显示控制方法及显示控制装置 |

| US10083675B2 (en) | 2014-04-02 | 2018-09-25 | Beijing Zhigu Rui Tuo Tech Co., Ltd | Display control method and display control apparatus |

| US10564714B2 (en) | 2014-05-09 | 2020-02-18 | Google Llc | Systems and methods for biomechanically-based eye signals for interacting with real and virtual objects |

| KR20150131577A (ko) * | 2014-05-15 | 2015-11-25 | 엘지전자 주식회사 | 글래스 타입 단말기 |

| CN103984413B (zh) * | 2014-05-19 | 2017-12-08 | 北京智谷睿拓技术服务有限公司 | 信息交互方法及信息交互装置 |

| KR102266195B1 (ko) * | 2014-06-20 | 2021-06-17 | 삼성전자주식회사 | 객체와 관련된 정보를 제공하는 방법 및 장치 |

| US10371944B2 (en) * | 2014-07-22 | 2019-08-06 | Sony Interactive Entertainment Inc. | Virtual reality headset with see-through mode |

| WO2016017945A1 (en) | 2014-07-29 | 2016-02-04 | Samsung Electronics Co., Ltd. | Mobile device and method of pairing the same with electronic device |

| KR102437104B1 (ko) * | 2014-07-29 | 2022-08-29 | 삼성전자주식회사 | 모바일 디바이스에서 촬영된 전자 기기와 페어링하는 방법 및 장치 |

| US9830395B2 (en) | 2014-08-15 | 2017-11-28 | Daqri, Llc | Spatial data processing |

| US9799143B2 (en) * | 2014-08-15 | 2017-10-24 | Daqri, Llc | Spatial data visualization |

| US9799142B2 (en) | 2014-08-15 | 2017-10-24 | Daqri, Llc | Spatial data collection |

| US9829708B1 (en) * | 2014-08-19 | 2017-11-28 | Boston Incubator Center, LLC | Method and apparatus of wearable eye pointing system |

| CN107111894B (zh) | 2014-09-08 | 2022-04-29 | 西姆克斯有限责任公司 | 用于专业和教育训练的增强或虚拟现实模拟器 |

| US9924143B2 (en) * | 2014-09-23 | 2018-03-20 | Intel Corporation | Wearable mediated reality system and method |

| US10495726B2 (en) | 2014-11-13 | 2019-12-03 | WorldViz, Inc. | Methods and systems for an immersive virtual reality system using multiple active markers |

| GB201421000D0 (en) * | 2014-11-26 | 2015-01-07 | Bae Systems Plc | Improvements in and relating to displays |

| ES2642263T3 (es) * | 2014-12-23 | 2017-11-16 | Nokia Technologies Oy | Control de contenido de realidad virtual |

| US20160189268A1 (en) * | 2014-12-31 | 2016-06-30 | Saumil Ashvin Gandhi | Wearable device for interacting with media-integrated vendors |

| US9407865B1 (en) * | 2015-01-21 | 2016-08-02 | Microsoft Technology Licensing, Llc | Shared scene mesh data synchronization |

| WO2016134031A1 (en) | 2015-02-17 | 2016-08-25 | Alpinereplay, Inc | Systems and methods to control camera operations |

| US11468639B2 (en) * | 2015-02-20 | 2022-10-11 | Microsoft Technology Licensing, Llc | Selective occlusion system for augmented reality devices |

| EP3062142B1 (en) | 2015-02-26 | 2018-10-03 | Nokia Technologies OY | Apparatus for a near-eye display |

| CN104754497B (zh) * | 2015-04-02 | 2018-10-16 | 清华大学 | 一种视觉注意力驱动的通信连接建立方法 |

| JP6892213B2 (ja) * | 2015-04-30 | 2021-06-23 | ソニーグループ株式会社 | 表示装置及び表示装置の初期設定方法 |

| EP3292431B1 (en) * | 2015-05-04 | 2022-05-11 | Magic Leap, Inc. | Separated pupil optical systems for virtual and augmented reality and methods for displaying images using same |

| US9910275B2 (en) | 2015-05-18 | 2018-03-06 | Samsung Electronics Co., Ltd. | Image processing for head mounted display devices |

| CN107852488B (zh) * | 2015-05-22 | 2021-03-30 | 三星电子株式会社 | 用于通过hmd设备显示虚拟图像的系统和方法 |

| US11252399B2 (en) * | 2015-05-28 | 2022-02-15 | Microsoft Technology Licensing, Llc | Determining inter-pupillary distance |

| CA2989894A1 (en) * | 2015-06-24 | 2016-12-29 | Magic Leap, Inc. | Augmented reality devices, systems and methods for purchasing |

| US10464482B2 (en) * | 2015-07-21 | 2019-11-05 | Utherverse Digital Inc. | Immersive displays |

| AU2016324039B2 (en) | 2015-09-16 | 2021-09-30 | Magic Leap, Inc. | Head pose mixing of audio files |

| US10466780B1 (en) * | 2015-10-26 | 2019-11-05 | Pillantas | Systems and methods for eye tracking calibration, eye vergence gestures for interface control, and visual aids therefor |

| US10321208B2 (en) | 2015-10-26 | 2019-06-11 | Alpinereplay, Inc. | System and method for enhanced video image recognition using motion sensors |

| US9990689B2 (en) | 2015-12-16 | 2018-06-05 | WorldViz, Inc. | Multi-user virtual reality processing |

| WO2017104089A1 (ja) * | 2015-12-18 | 2017-06-22 | 日立マクセル株式会社 | ヘッドマウントディスプレイ連携表示システム、及び、表示装置とヘッドマウントディスプレイとを含むシステム、及び、その表示装置 |

| US11386556B2 (en) | 2015-12-18 | 2022-07-12 | Orthogrid Systems Holdings, Llc | Deformed grid based intra-operative system and method of use |

| US10052170B2 (en) | 2015-12-18 | 2018-08-21 | MediLux Capitol Holdings, S.A.R.L. | Mixed reality imaging system, apparatus and surgical suite |

| US10037085B2 (en) * | 2015-12-21 | 2018-07-31 | Intel Corporation | Techniques for real object and hand representation in virtual reality content |

| US10095928B2 (en) | 2015-12-22 | 2018-10-09 | WorldViz, Inc. | Methods and systems for marker identification |

| KR20180101496A (ko) | 2016-02-18 | 2018-09-12 | 애플 인크. | 인사이드-아웃 위치, 사용자 신체 및 환경 추적을 갖는 가상 및 혼합 현실을 위한 머리 장착 디스플레이 |

| JP6632443B2 (ja) * | 2016-03-23 | 2020-01-22 | 株式会社ソニー・インタラクティブエンタテインメント | 情報処理装置、情報処理システム、および情報処理方法 |

| US10824638B2 (en) * | 2016-03-25 | 2020-11-03 | Microsoft Technology Licensing, Llc | Enhancing object representations using inferred user intents |

| US9807383B2 (en) * | 2016-03-30 | 2017-10-31 | Daqri, Llc | Wearable video headset and method for calibration |

| US10242501B1 (en) | 2016-05-03 | 2019-03-26 | WorldViz, Inc. | Multi-user virtual and augmented reality tracking systems |

| US10238001B2 (en) | 2016-05-19 | 2019-03-19 | Cimcon Lighting, Inc. | Configurable data center platform |

| US10089071B2 (en) | 2016-06-02 | 2018-10-02 | Microsoft Technology Licensing, Llc | Automatic audio attenuation on immersive display devices |

| FR3052565B1 (fr) * | 2016-06-10 | 2019-06-28 | Stereolabs | Dispositif individuel d'immersion visuelle pour personne en mouvement |

| WO2017219195A1 (zh) * | 2016-06-20 | 2017-12-28 | 华为技术有限公司 | 一种增强现实显示方法及头戴式显示设备 |

| CN106204743B (zh) * | 2016-06-28 | 2020-07-31 | Oppo广东移动通信有限公司 | 一种增强现实功能的控制方法、装置及移动终端 |

| GB2553086B (en) | 2016-07-20 | 2022-03-02 | V Nova Int Ltd | Decoder devices, methods and computer programs |

| US11570454B2 (en) | 2016-07-20 | 2023-01-31 | V-Nova International Limited | Use of hierarchical video and image coding for telepresence |

| US20180310066A1 (en) * | 2016-08-09 | 2018-10-25 | Paronym Inc. | Moving image reproduction device, moving image reproduction method, moving image distribution system, storage medium with moving image reproduction program stored therein |

| WO2018035133A1 (en) * | 2016-08-17 | 2018-02-22 | Vid Scale, Inc. | Secondary content insertion in 360-degree video |

| CN107077755B (zh) * | 2016-09-30 | 2021-06-04 | 达闼机器人有限公司 | 虚拟与现实融合方法、系统和虚拟现实设备 |

| JP6996514B2 (ja) * | 2016-10-26 | 2022-01-17 | ソニーグループ株式会社 | 情報処理装置、情報処理システム、および情報処理方法、並びにプログラム |

| WO2018082692A1 (en) * | 2016-11-07 | 2018-05-11 | Changchun Ruixinboguan Technology Development Co., Ltd. | Systems and methods for interaction with application |

| US10979721B2 (en) | 2016-11-17 | 2021-04-13 | Dolby Laboratories Licensing Corporation | Predicting and verifying regions of interest selections |

| US10152851B2 (en) * | 2016-11-29 | 2018-12-11 | Microsoft Technology Licensing, Llc | Notification artifact display |

| CN111654473B (zh) * | 2016-12-13 | 2022-07-19 | 创新先进技术有限公司 | 基于增强现实的虚拟对象分配方法及装置 |

| US10650552B2 (en) | 2016-12-29 | 2020-05-12 | Magic Leap, Inc. | Systems and methods for augmented reality |

| EP3343267B1 (en) | 2016-12-30 | 2024-01-24 | Magic Leap, Inc. | Polychromatic light out-coupling apparatus, near-eye displays comprising the same, and method of out-coupling polychromatic light |

| CN106531073B (zh) * | 2017-01-03 | 2018-11-20 | 京东方科技集团股份有限公司 | 显示屏的处理电路、显示方法及显示器件 |

| JP6266814B1 (ja) * | 2017-01-27 | 2018-01-24 | 株式会社コロプラ | 情報処理方法及び当該情報処理方法をコンピュータに実行させるためのプログラム |

| GB2560177A (en) | 2017-03-01 | 2018-09-05 | Thirdeye Labs Ltd | Training a computational neural network |

| JP2018163461A (ja) * | 2017-03-24 | 2018-10-18 | ソニー株式会社 | 情報処理装置、および情報処理方法、並びにプログラム |

| CN113721368A (zh) * | 2017-04-04 | 2021-11-30 | 国立大学法人福井大学 | 影像生成装置 |

| US10872289B2 (en) | 2017-04-08 | 2020-12-22 | Geun Il Kim | Method and system for facilitating context based information |

| US10403050B1 (en) * | 2017-04-10 | 2019-09-03 | WorldViz, Inc. | Multi-user virtual and augmented reality tracking systems |

| WO2018225149A1 (ja) | 2017-06-06 | 2018-12-13 | マクセル株式会社 | 複合現実表示システム及び複合現実表示端末 |

| US10366691B2 (en) * | 2017-07-11 | 2019-07-30 | Samsung Electronics Co., Ltd. | System and method for voice command context |

| WO2019015765A1 (en) * | 2017-07-20 | 2019-01-24 | Universitätsklinikum Hamburg-Eppendorf | APPARATUS FOR MEASURING OR DRIVING EMOTION OR BEHAVIOR |

| US10578870B2 (en) | 2017-07-26 | 2020-03-03 | Magic Leap, Inc. | Exit pupil expander |

| EP3665647A4 (en) * | 2017-08-07 | 2021-01-06 | Standard Cognition, Corp. | PREDICTION OF INVENTORY EVENTS USING FOREGROUND / BACKGROUND PROCESSING |

| US20190057180A1 (en) * | 2017-08-18 | 2019-02-21 | International Business Machines Corporation | System and method for design optimization using augmented reality |

| US10943399B2 (en) | 2017-08-28 | 2021-03-09 | Microsoft Technology Licensing, Llc | Systems and methods of physics layer prioritization in virtual environments |

| US10904615B2 (en) * | 2017-09-07 | 2021-01-26 | International Business Machines Corporation | Accessing and analyzing data to select an optimal line-of-sight and determine how media content is distributed and displayed |

| CN107656613B (zh) * | 2017-09-08 | 2020-12-18 | 国网智能科技股份有限公司 | 一种基于眼动追踪的人机交互系统及其工作方法 |

| US10437328B2 (en) * | 2017-09-27 | 2019-10-08 | Igt | Gaze detection using secondary input |

| CN107835361B (zh) * | 2017-10-27 | 2020-02-11 | Oppo广东移动通信有限公司 | 基于结构光的成像方法、装置和移动终端 |

| US11280937B2 (en) | 2017-12-10 | 2022-03-22 | Magic Leap, Inc. | Anti-reflective coatings on optical waveguides |

| AU2018392482A1 (en) | 2017-12-20 | 2020-07-02 | Magic Leap, Inc. | Insert for augmented reality viewing device |

| CN108108025A (zh) * | 2018-01-03 | 2018-06-01 | 上海闻泰电子科技有限公司 | 基于头戴设备的信息指引方法、装置、头戴设备和介质 |

| KR20200110771A (ko) | 2018-01-18 | 2020-09-25 | 삼성전자주식회사 | 증강 현실 콘텐츠 조정 방법 및 장치 |

| WO2019143688A1 (en) | 2018-01-19 | 2019-07-25 | Pcms Holdings, Inc. | Multi-focal planes with varying positions |

| JP7042644B2 (ja) * | 2018-02-15 | 2022-03-28 | 株式会社ソニー・インタラクティブエンタテインメント | 情報処理装置、画像生成方法およびコンピュータプログラム |

| US11716548B2 (en) * | 2018-03-13 | 2023-08-01 | Meta Platforms Technologies, Llc | Timing of multiplexed sensor phase measurements in a depth camera assembly for depth determination using fringe interferometry |

| WO2019178567A1 (en) | 2018-03-15 | 2019-09-19 | Magic Leap, Inc. | Image correction due to deformation of components of a viewing device |

| JP6774975B2 (ja) | 2018-03-19 | 2020-10-28 | 株式会社東芝 | 眼球回転検出装置、電子機器及びシステム |

| EP3769517B1 (en) | 2018-03-23 | 2023-09-13 | InterDigital VC Holdings, Inc. | Multifocal plane based method to produce stereoscopic viewpoints in a dibr system (mfp-dibr) |

| WO2019189965A1 (ko) * | 2018-03-30 | 2019-10-03 | 데이터얼라이언스 주식회사 | 가상 현실과 증강 현실을 이용한 IoT 디바이스 제어 시스템 및 방법 |

| JP2021525902A (ja) | 2018-05-30 | 2021-09-27 | マジック リープ, インコーポレイテッドMagic Leap,Inc. | 小型の可変焦点構成 |

| EP3803450A4 (en) | 2018-05-31 | 2021-08-18 | Magic Leap, Inc. | POSITIONING A RADAR HEAD |

| EP3804306B1 (en) | 2018-06-05 | 2023-12-27 | Magic Leap, Inc. | Homography transformation matrices based temperature calibration of a viewing system |

| WO2019237099A1 (en) * | 2018-06-08 | 2019-12-12 | Magic Leap, Inc. | Augmented reality viewer with automated surface selection placement and content orientation placement |

| WO2019245581A1 (en) * | 2018-06-22 | 2019-12-26 | Hewlett-Packard Development Company, L.P. | Virtual display monitors |

| JP2020005038A (ja) * | 2018-06-25 | 2020-01-09 | キヤノン株式会社 | 送信装置、送信方法、受信装置、受信方法、及び、プログラム |

| WO2020010097A1 (en) | 2018-07-02 | 2020-01-09 | Magic Leap, Inc. | Pixel intensity modulation using modifying gain values |

| US11856479B2 (en) | 2018-07-03 | 2023-12-26 | Magic Leap, Inc. | Systems and methods for virtual and augmented reality along a route with markers |

| WO2020010226A1 (en) | 2018-07-03 | 2020-01-09 | Magic Leap, Inc. | Systems and methods for virtual and augmented reality |

| US11689709B2 (en) | 2018-07-05 | 2023-06-27 | Interdigital Vc Holdings, Inc. | Method and system for near-eye focal plane overlays for 3D perception of content on 2D displays |

| US11169601B2 (en) | 2018-07-12 | 2021-11-09 | Toyota Research Institute, Inc. | Methods and systems for determining teleoperating user intent via eye tracking |

| US10607083B2 (en) * | 2018-07-19 | 2020-03-31 | Microsoft Technology Licensing, Llc | Selectively alerting users of real objects in a virtual environment |

| WO2020023543A1 (en) | 2018-07-24 | 2020-01-30 | Magic Leap, Inc. | Viewing device with dust seal integration |

| JP7426982B2 (ja) | 2018-07-24 | 2024-02-02 | マジック リープ, インコーポレイテッド | 移動検出デバイスの温度依存較正 |

| CN112740665A (zh) | 2018-08-02 | 2021-04-30 | 奇跃公司 | 基于头部运动的瞳孔间距离补偿的观察系统 |

| JP7438188B2 (ja) | 2018-08-03 | 2024-02-26 | マジック リープ, インコーポレイテッド | ユーザ相互作用システムにおけるトーテムの融合姿勢の非融合姿勢ベースのドリフト補正 |

| US11336968B2 (en) * | 2018-08-17 | 2022-05-17 | Samsung Electronics Co., Ltd. | Method and device for generating content |

| TWI669703B (zh) | 2018-08-28 | 2019-08-21 | 財團法人工業技術研究院 | 適於多人觀看的資訊顯示方法及資訊顯示裝置 |

| EP4276520A3 (en) | 2018-08-31 | 2024-01-24 | Magic Leap, Inc. | Spatially-resolved dynamic dimming for augmented reality device |

| US10832482B2 (en) | 2018-09-11 | 2020-11-10 | International Business Machines Corporation | Augmented reality layers enhancement |

| EP3852645A4 (en) | 2018-09-12 | 2022-08-24 | Orthogrid Systems, SAS | INTRAOPERATIVE ARTIFICIAL INTELLIGENCE SURGICAL GUIDANCE SYSTEM AND METHOD OF USE |

| US11540794B2 (en) | 2018-09-12 | 2023-01-03 | Orthogrid Systesm Holdings, LLC | Artificial intelligence intra-operative surgical guidance system and method of use |

| US10764558B2 (en) * | 2018-09-27 | 2020-09-01 | Valve Corporation | Reduced bandwidth stereo distortion correction for fisheye lenses of head-mounted displays |

| CN109324689A (zh) * | 2018-09-30 | 2019-02-12 | 平安科技(深圳)有限公司 | 基于眼球运动轨迹的测试题目放大方法、系统及设备 |

| US11279036B2 (en) * | 2018-10-01 | 2022-03-22 | Toyota Research Institute, Inc. | Methods and systems for implementing customized motions based on individual profiles for identified users |

| WO2020071728A1 (ko) * | 2018-10-02 | 2020-04-09 | 한국전자통신연구원 | 가상 현실에서 음향 확대 효과 적용을 위한 음향 신호 제어 방법 및 장치 |

| KR102458962B1 (ko) | 2018-10-02 | 2022-10-26 | 한국전자통신연구원 | 가상 현실에서 음향 확대 효과 적용을 위한 음향 신호 제어 방법 및 장치 |

| CN112822992A (zh) * | 2018-10-05 | 2021-05-18 | 脸谱科技有限责任公司 | 在增强现实环境中使用神经肌肉信号来提供与物理对象的增强交互 |

| US10915776B2 (en) * | 2018-10-05 | 2021-02-09 | Facebook, Inc. | Modifying capture of video data by an image capture device based on identifying an object of interest within capturted video data to the image capture device |

| US10914949B2 (en) | 2018-11-16 | 2021-02-09 | Magic Leap, Inc. | Image size triggered clarification to maintain image sharpness |

| TWI715903B (zh) | 2018-12-24 | 2021-01-11 | 財團法人工業技術研究院 | 動作追蹤系統及方法 |

| CN113490873A (zh) | 2018-12-28 | 2021-10-08 | 奇跃公司 | 带有机械致动图像投影仪的可变像素密度显示系统 |

| US11064255B2 (en) * | 2019-01-30 | 2021-07-13 | Oohms Ny Llc | System and method of tablet-based distribution of digital media content |

| USD910652S1 (en) | 2019-01-31 | 2021-02-16 | OrthoGrid Systems, Inc | Display screen or portion thereof with a graphical user interface |

| CN113518961A (zh) | 2019-02-06 | 2021-10-19 | 奇跃公司 | 限制由多个处理器产生的总热量的基于目标意图的时钟速度确定和调整 |

| CN113544766A (zh) | 2019-03-12 | 2021-10-22 | 奇跃公司 | 在第一和第二增强现实观看器之间配准本地内容 |

| CN114127837A (zh) | 2019-05-01 | 2022-03-01 | 奇跃公司 | 内容提供系统和方法 |

| JP7336266B2 (ja) | 2019-06-04 | 2023-08-31 | キヤノン株式会社 | 電子機器、電子機器の制御方法、プログラム、記憶媒体 |

| CN110398988A (zh) * | 2019-06-28 | 2019-11-01 | 联想(北京)有限公司 | 一种控制方法和电子设备 |

| US11589094B2 (en) * | 2019-07-22 | 2023-02-21 | At&T Intellectual Property I, L.P. | System and method for recommending media content based on actual viewers |

| CN114174895A (zh) | 2019-07-26 | 2022-03-11 | 奇跃公司 | 用于增强现实的系统和方法 |

| EP4014468A4 (en) | 2019-08-12 | 2022-10-19 | Magic Leap, Inc. | SYSTEMS AND PROCESSES FOR VIRTUAL AND AUGMENTED REALITY |

| US11381710B2 (en) | 2019-09-13 | 2022-07-05 | International Business Machines Corporation | Contextual masking of objects in social photographs |

| US11132827B2 (en) | 2019-09-19 | 2021-09-28 | Facebook Technologies, Llc | Artificial reality system architecture for concurrent application execution and collaborative 3D scene rendering |

| WO2021089111A1 (en) * | 2019-11-04 | 2021-05-14 | Telefonaktiebolaget Lm Ericsson (Publ) | See-through display, method for operating a see-through display and computer program |

| WO2021097323A1 (en) | 2019-11-15 | 2021-05-20 | Magic Leap, Inc. | A viewing system for use in a surgical environment |

| US11393198B1 (en) | 2020-06-02 | 2022-07-19 | State Farm Mutual Automobile Insurance Company | Interactive insurance inventory and claim generation |

| US11436828B1 (en) * | 2020-06-02 | 2022-09-06 | State Farm Mutual Automobile Insurance Company | Insurance inventory and claim generation |

| JP2023529126A (ja) * | 2020-06-08 | 2023-07-07 | アップル インコーポレイテッド | 三次元環境におけるアバターの提示 |

| US11630508B1 (en) * | 2020-06-12 | 2023-04-18 | Wells Fargo Bank, N.A. | Apparatuses and methods for securely presenting digital objects |

| US11361468B2 (en) | 2020-06-26 | 2022-06-14 | Standard Cognition, Corp. | Systems and methods for automated recalibration of sensors for autonomous checkout |

| US11303853B2 (en) | 2020-06-26 | 2022-04-12 | Standard Cognition, Corp. | Systems and methods for automated design of camera placement and cameras arrangements for autonomous checkout |

| US11490968B2 (en) | 2020-07-29 | 2022-11-08 | Karl Storz Se & Co. Kg | Devices, systems, and methods for labeling objects of interest during a medical procedure |

| US11861137B2 (en) | 2020-09-09 | 2024-01-02 | State Farm Mutual Automobile Insurance Company | Vehicular incident reenactment using three-dimensional (3D) representations |

| EP4182893A4 (en) * | 2020-10-08 | 2023-12-06 | Samsung Electronics Co., Ltd. | METHOD AND ELECTRONIC DEVICE FOR GENERATING AR CONTENT BASED ON INTENTION AND INTERACTION OF MULTIPLE OBJECTS |

| US11630509B2 (en) * | 2020-12-11 | 2023-04-18 | Microsoft Technology Licensing, Llc | Determining user intent based on attention values |

| JP2022110509A (ja) * | 2021-01-18 | 2022-07-29 | 富士フイルムビジネスイノベーション株式会社 | 情報処理装置及びプログラム |

| USD979578S1 (en) | 2021-02-08 | 2023-02-28 | Orthogrid Systems Holdings, Llc | Display screen or portion thereof with a graphical user interface |

| US11927756B2 (en) | 2021-04-01 | 2024-03-12 | Samsung Electronics Co., Ltd. | Method for providing augmented reality image and head mounted display device supporting the same |

| KR20220136776A (ko) * | 2021-04-01 | 2022-10-11 | 삼성전자주식회사 | 증강 현실 이미지를 제공하는 방법 및 이를 지원하는 hmd 장치 |

| US11567569B2 (en) * | 2021-04-08 | 2023-01-31 | Google Llc | Object selection based on eye tracking in wearable device |

| WO2022220459A1 (en) * | 2021-04-14 | 2022-10-20 | Samsung Electronics Co., Ltd. | Method and electronic device for selective magnification in three dimensional rendering systems |

| US11579752B1 (en) * | 2021-07-20 | 2023-02-14 | Sony Interactive Entertainment Inc. | Augmented reality placement for user feedback |

| WO2023101882A1 (en) * | 2021-12-01 | 2023-06-08 | Rovi Guides, Inc. | Augmented reality display for content consumption based on field of view |

| US11638061B1 (en) | 2021-12-01 | 2023-04-25 | Rovi Guides, Inc. | Augmented reality display for content consumption relative to a field of view |

| US20230229685A1 (en) * | 2022-01-18 | 2023-07-20 | At&T Intellectual Property I, L.P. | System and method for creating and using immersive media |

| US11768544B2 (en) | 2022-02-01 | 2023-09-26 | Microsoft Technology Licensing, Llc | Gesture recognition based on likelihood of interaction |

| WO2024034825A1 (ko) * | 2022-08-08 | 2024-02-15 | 삼성전자주식회사 | Ar 장치에게 표시하도록 명령할 컨텐츠를 결정하기 위한 방법 및 장치 |

| CN116225237B (zh) * | 2023-05-06 | 2023-10-10 | 北京虹宇科技有限公司 | 扩展现实空间中的交互控制方法、装置、设备及存储介质 |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH09204287A (ja) * | 1996-01-25 | 1997-08-05 | Canon Inc | 処理選択方法及び装置 |

| JP2002041234A (ja) * | 2000-05-09 | 2002-02-08 | Intel Corp | 凝視の対象を検出する機能を有する微小表示システム |

| JP2002223458A (ja) * | 2001-01-26 | 2002-08-09 | Nippon Hoso Kyokai <Nhk> | 立体映像作成装置 |

| JP2003508808A (ja) * | 1999-08-12 | 2003-03-04 | アライドシグナル インコーポレイテッド | 可変集中ビネット・ディスプレイ |

| JP2003132068A (ja) * | 2001-10-22 | 2003-05-09 | Nec Corp | ナビゲーションシステム及びナビゲーション端末 |

| JP2006145922A (ja) * | 2004-11-22 | 2006-06-08 | Olympus Corp | 画像再生装置 |

Family Cites Families (97)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US4934773A (en) | 1987-07-27 | 1990-06-19 | Reflection Technology, Inc. | Miniature video display system |

| US5016282A (en) | 1988-07-14 | 1991-05-14 | Atr Communication Systems Research Laboratories | Eye tracking image pickup apparatus for separating noise from feature portions |

| CA2054344C (en) | 1990-10-29 | 1997-04-15 | Kazuhiro Itsumi | Video camera having focusing and image-processing function |

| JP2901116B2 (ja) | 1992-11-30 | 1999-06-07 | 株式会社日立製作所 | オートフォーカス装置の制御方法 |

| US5471542A (en) | 1993-09-27 | 1995-11-28 | Ragland; Richard R. | Point-of-gaze tracker |

| US8330812B2 (en) | 1995-05-30 | 2012-12-11 | Simulated Percepts, Llc | Method and apparatus for producing and storing, on a resultant non-transitory storage medium, computer generated (CG) video in correspondence with images acquired by an image acquisition device tracked in motion with respect to a 3D reference frame |

| GB9511091D0 (en) | 1995-06-01 | 1995-07-26 | Silver Joshua D | Variable power spectacles |

| US6046712A (en) | 1996-07-23 | 2000-04-04 | Telxon Corporation | Head mounted communication system for providing interactive visual communications with a remote system |

| US5689619A (en) | 1996-08-09 | 1997-11-18 | The United States Of America As Represented By The Secretary Of The Army | Eyetracker control of heads-up displays |

| US6847336B1 (en) | 1996-10-02 | 2005-01-25 | Jerome H. Lemelson | Selectively controllable heads-up display system |

| KR100595912B1 (ko) | 1998-01-26 | 2006-07-07 | 웨인 웨스터만 | 수동 입력 통합 방법 및 장치 |

| US6466207B1 (en) | 1998-03-18 | 2002-10-15 | Microsoft Corporation | Real-time image rendering with layered depth images |

| GB9805977D0 (en) | 1998-03-19 | 1998-05-20 | Silver Joshua D | Improvements in variable focus optical devices |

| US6597346B1 (en) | 1998-10-02 | 2003-07-22 | Honeywell Inc. | Hand held computer with see-through display |

| US7080322B2 (en) | 1998-12-18 | 2006-07-18 | Tangis Corporation | Thematic response to a computer user's context, such as by a wearable personal computer |

| US6433760B1 (en) | 1999-01-14 | 2002-08-13 | University Of Central Florida | Head mounted display with eyetracking capability |

| JP2002542505A (ja) | 1999-04-08 | 2002-12-10 | ニューヨーク ユニバーシティ | 超解像力を有する中心窩画像表示装置 |

| US6053610A (en) | 1999-07-15 | 2000-04-25 | Lane Research | Actuation mechanism for variable focal length spectacles |

| US8686922B2 (en) | 1999-12-15 | 2014-04-01 | American Vehicular Sciences Llc | Eye-location dependent vehicular heads-up display system |

| US6711414B1 (en) | 2000-02-25 | 2004-03-23 | Charmed Technology, Inc. | Wearable computing device capable of responding intelligently to surroundings |

| JP2001264614A (ja) | 2000-03-15 | 2001-09-26 | Fuji Photo Optical Co Ltd | ズームレンズ |

| GB0007474D0 (en) | 2000-03-29 | 2000-05-17 | Hewlett Packard Co | Location-Dependent User Interface |

| EP1182541A3 (de) | 2000-08-22 | 2005-11-30 | Siemens Aktiengesellschaft | System und Verfahren zum kombinierten Einsatz verschiedener Display-/Gerätetypen mit systemgesteuerter kontextabhängiger Informationsdarstellung |

| JP3406965B2 (ja) * | 2000-11-24 | 2003-05-19 | キヤノン株式会社 | 複合現実感提示装置及びその制御方法 |

| JP2004537082A (ja) | 2001-01-26 | 2004-12-09 | ザクセル システムズ インコーポレイテッド | 仮想現実環境における実時間バーチャル・ビューポイント |

| US6975991B2 (en) | 2001-01-31 | 2005-12-13 | International Business Machines Corporation | Wearable display system with indicators of speakers |

| US6578962B1 (en) | 2001-04-27 | 2003-06-17 | International Business Machines Corporation | Calibration-free eye gaze tracking |

| US6886137B2 (en) | 2001-05-29 | 2005-04-26 | International Business Machines Corporation | Eye gaze control of dynamic information presentation |

| JP2005500096A (ja) | 2001-06-13 | 2005-01-06 | ヴォリューム・インタラクションズ・プライヴェート・リミテッド | ガイドシステム |

| US7133077B2 (en) | 2001-07-02 | 2006-11-07 | Canon Kabushiki Kaisha | Auto focus camera, lens apparatus and camera system with a vibration motor drive |

| GB0119859D0 (en) | 2001-08-15 | 2001-10-10 | Qinetiq Ltd | Eye tracking system |

| KR100427649B1 (ko) * | 2001-12-26 | 2004-04-28 | 한국전자통신연구원 | 증강현실 기술을 이용한 별자리 관측시스템 |

| KR100475247B1 (ko) * | 2001-12-28 | 2005-03-10 | 한국전자통신연구원 | 증강현실 기술을 이용한 게임 장치 및 방법 |

| US6659611B2 (en) | 2001-12-28 | 2003-12-09 | International Business Machines Corporation | System and method for eye gaze tracking using corneal image mapping |

| US20040008157A1 (en) | 2002-06-26 | 2004-01-15 | Brubaker Curtis M. | Cap-mounted monocular video/audio display |

| US6943754B2 (en) | 2002-09-27 | 2005-09-13 | The Boeing Company | Gaze tracking system, eye-tracking assembly and an associated method of calibration |

| US7401920B1 (en) | 2003-05-20 | 2008-07-22 | Elbit Systems Ltd. | Head mounted eye tracking and display system |

| US8072470B2 (en) | 2003-05-29 | 2011-12-06 | Sony Computer Entertainment Inc. | System and method for providing a real-time three-dimensional interactive environment |

| US20050047629A1 (en) | 2003-08-25 | 2005-03-03 | International Business Machines Corporation | System and method for selectively expanding or contracting a portion of a display using eye-gaze tracking |

| US7401300B2 (en) | 2004-01-09 | 2008-07-15 | Nokia Corporation | Adaptive user interface input device |

| US7532230B2 (en) | 2004-01-29 | 2009-05-12 | Hewlett-Packard Development Company, L.P. | Method and system for communicating gaze in an immersive virtual environment |

| JP4604190B2 (ja) | 2004-02-17 | 2010-12-22 | 国立大学法人静岡大学 | 距離イメージセンサを用いた視線検出装置 |

| EP1751499B1 (en) | 2004-06-03 | 2012-04-04 | Making Virtual Solid, L.L.C. | En-route navigation display method and apparatus using head-up display |

| SE525826C2 (sv) * | 2004-06-18 | 2005-05-10 | Totalfoersvarets Forskningsins | Interaktivt förfarande för att presentera information i en bild |

| US20060007308A1 (en) | 2004-07-12 | 2006-01-12 | Ide Curtis E | Environmentally aware, intelligent surveillance device |

| WO2006017771A1 (en) | 2004-08-06 | 2006-02-16 | University Of Washington | Variable fixation viewing distance scanned light displays |

| US7396129B2 (en) | 2004-11-22 | 2008-07-08 | Carestream Health, Inc. | Diagnostic system having gaze tracking |

| US20060146012A1 (en) | 2005-01-04 | 2006-07-06 | Arneson Theodore R | System and method for automatic display switching |

| US20060224046A1 (en) | 2005-04-01 | 2006-10-05 | Motorola, Inc. | Method and system for enhancing a user experience using a user's physiological state |

| US7686451B2 (en) | 2005-04-04 | 2010-03-30 | Lc Technologies, Inc. | Explicit raytracing for gimbal-based gazepoint trackers |

| US7457434B2 (en) | 2005-04-04 | 2008-11-25 | Massachusetts Eye & Ear Infirmary | Adaptively focusing extra-ocular vision prostheses |

| US20060250322A1 (en) * | 2005-05-09 | 2006-11-09 | Optics 1, Inc. | Dynamic vergence and focus control for head-mounted displays |

| JP2006330053A (ja) | 2005-05-23 | 2006-12-07 | Konica Minolta Opto Inc | レンズ鏡胴 |

| JP2006330054A (ja) | 2005-05-23 | 2006-12-07 | Konica Minolta Opto Inc | レンズ鏡胴 |

| US7822607B2 (en) | 2005-08-26 | 2010-10-26 | Palo Alto Research Center Incorporated | Computer application environment and communication system employing automatic identification of human conversational behavior |

| KR100695331B1 (ko) | 2005-09-23 | 2007-03-16 | 한국전자통신연구원 | 상황인지 환경을 위한 사용자 인터페이스 장치 및 이에연동되는 기기 제어 장치 및 그의 동작 방법 |

| WO2007066166A1 (en) | 2005-12-08 | 2007-06-14 | Abb Research Ltd | Method and system for processing and displaying maintenance or control instructions |

| US7522344B1 (en) | 2005-12-14 | 2009-04-21 | University Of Central Florida Research Foundation, Inc. | Projection-based head-mounted display with eye-tracking capabilities |

| WO2007085303A1 (en) | 2006-01-30 | 2007-08-02 | Verigy (Singapore) Pte. Ltd. | Information overlay system |

| US20070201859A1 (en) | 2006-02-24 | 2007-08-30 | Logitech Europe S.A. | Method and system for use of 3D sensors in an image capture device |

| US8725729B2 (en) * | 2006-04-03 | 2014-05-13 | Steven G. Lisa | System, methods and applications for embedded internet searching and result display |

| US8571580B2 (en) | 2006-06-01 | 2013-10-29 | Loopt Llc. | Displaying the location of individuals on an interactive map display on a mobile communication device |

| US7542210B2 (en) | 2006-06-29 | 2009-06-02 | Chirieleison Sr Anthony | Eye tracking head mounted display |

| KR100820639B1 (ko) | 2006-07-25 | 2008-04-10 | 한국과학기술연구원 | 시선 기반 3차원 인터랙션 시스템 및 방법 그리고 3차원시선 추적 시스템 및 방법 |

| KR100809479B1 (ko) | 2006-07-27 | 2008-03-03 | 한국전자통신연구원 | 혼합 현실 환경을 위한 얼굴 착용형 디스플레이 장치 |

| US7866816B2 (en) | 2006-10-10 | 2011-01-11 | Lane Research, Llc | Variable focus spectacles |

| WO2008091695A1 (en) | 2007-01-25 | 2008-07-31 | Samuel Pierce Baron | Virtual social interactions |

| US20090055739A1 (en) | 2007-08-23 | 2009-02-26 | Microsoft Corporation | Context-aware adaptive user interface |

| US20090225001A1 (en) | 2007-11-06 | 2009-09-10 | University Of Central Florida Research Foundation, Inc. | Hybrid Display Systems and Methods |

| US20090221368A1 (en) | 2007-11-28 | 2009-09-03 | Ailive Inc., | Method and system for creating a shared game space for a networked game |

| US20090174946A1 (en) | 2008-01-07 | 2009-07-09 | Roni Raviv | Customizable head mounted display |

| US8786675B2 (en) | 2008-01-23 | 2014-07-22 | Michael F. Deering | Systems using eye mounted displays |

| JP2009245392A (ja) | 2008-03-31 | 2009-10-22 | Brother Ind Ltd | ヘッドマウントディスプレイ及びヘッドマウントディスプレイシステム |

| KR100947990B1 (ko) | 2008-05-15 | 2010-03-18 | 성균관대학교산학협력단 | 차영상 엔트로피를 이용한 시선 추적 장치 및 그 방법 |

| US20090286570A1 (en) | 2008-05-15 | 2009-11-19 | Sony Ericsson Mobile Communications Ab | Portable communication device and method of processing embedded visual cues |

| KR20100009947A (ko) * | 2008-07-21 | 2010-01-29 | 삼성전자주식회사 | 가상 현실 서비스 간의 상호 연동을 위한 장치 및 방법 |

| US7736000B2 (en) | 2008-08-27 | 2010-06-15 | Locarna Systems, Inc. | Method and apparatus for tracking eye movement |

| US7850306B2 (en) * | 2008-08-28 | 2010-12-14 | Nokia Corporation | Visual cognition aware display and visual data transmission architecture |

| US8957835B2 (en) | 2008-09-30 | 2015-02-17 | Apple Inc. | Head-mounted display apparatus for retaining a portable electronic device with display |

| US8267781B2 (en) | 2009-01-30 | 2012-09-18 | Microsoft Corporation | Visual target tracking |

| JP5272827B2 (ja) * | 2009-03-18 | 2013-08-28 | ブラザー工業株式会社 | ヘッドマウントディスプレイ |

| US20100238161A1 (en) * | 2009-03-19 | 2010-09-23 | Kenneth Varga | Computer-aided system for 360º heads up display of safety/mission critical data |

| US20100257252A1 (en) | 2009-04-01 | 2010-10-07 | Microsoft Corporation | Augmented Reality Cloud Computing |

| US20120105486A1 (en) | 2009-04-09 | 2012-05-03 | Dynavox Systems Llc | Calibration free, motion tolerent eye-gaze direction detector with contextually aware computer interaction and communication methods |

| US8744121B2 (en) | 2009-05-29 | 2014-06-03 | Microsoft Corporation | Device for identifying and tracking multiple humans over time |

| US9000887B2 (en) | 2009-07-23 | 2015-04-07 | Qualcomm Incorporated | Method and apparatus for communicating control information by a wearable device to control mobile and consumer electronic devices |

| US8436872B2 (en) | 2010-02-03 | 2013-05-07 | Oculus Info Inc. | System and method for creating and displaying map projections related to real-time images |

| US20120021828A1 (en) | 2010-02-24 | 2012-01-26 | Valve Corporation | Graphical user interface for modification of animation data using preset animation samples |

| CN102906623A (zh) | 2010-02-28 | 2013-01-30 | 奥斯特豪特集团有限公司 | 交互式头戴目镜上的本地广告内容 |

| US9122707B2 (en) | 2010-05-28 | 2015-09-01 | Nokia Technologies Oy | Method and apparatus for providing a localized virtual reality environment |

| JP5791131B2 (ja) | 2010-07-20 | 2015-10-07 | アップル インコーポレイテッド | 自然な相互作用のための相互作用的現実拡張 |

| US9107040B2 (en) | 2010-09-29 | 2015-08-11 | Apple Inc. | Systems, methods, and computer readable media for sharing awareness information |

| US9304319B2 (en) | 2010-11-18 | 2016-04-05 | Microsoft Technology Licensing, Llc | Automatic focus improvement for augmented reality displays |

| US8660679B2 (en) | 2010-12-02 | 2014-02-25 | Empire Technology Development Llc | Augmented reality system |

| US8223088B1 (en) | 2011-06-09 | 2012-07-17 | Google Inc. | Multimode input field for a head-mounted display |

| US8184070B1 (en) | 2011-07-06 | 2012-05-22 | Google Inc. | Method and system for selecting a user interface for a wearable computing device |

| US8209183B1 (en) | 2011-07-07 | 2012-06-26 | Google Inc. | Systems and methods for correction of text from different input types, sources, and contexts |

-

2010

- 2010-12-16 US US12/970,695 patent/US9213405B2/en active Active

-

2011

- 2011-11-08 TW TW100140759A patent/TWI549505B/zh active

- 2011-12-05 WO PCT/US2011/063350 patent/WO2012082444A1/en unknown

- 2011-12-05 EP EP11849398.0A patent/EP2652940B1/en active Active

- 2011-12-05 JP JP2013544548A patent/JP2014504413A/ja active Pending

- 2011-12-05 KR KR1020137015226A patent/KR101935061B1/ko active IP Right Grant

- 2011-12-15 CN CN201110443987.0A patent/CN102566756B/zh active Active

- 2011-12-16 AR ARP110104752A patent/AR084345A1/es not_active Application Discontinuation

-

2012

- 2012-11-21 HK HK12111910.0A patent/HK1171103A1/xx not_active IP Right Cessation

Patent Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH09204287A (ja) * | 1996-01-25 | 1997-08-05 | Canon Inc | 処理選択方法及び装置 |

| JP2003508808A (ja) * | 1999-08-12 | 2003-03-04 | アライドシグナル インコーポレイテッド | 可変集中ビネット・ディスプレイ |

| JP2002041234A (ja) * | 2000-05-09 | 2002-02-08 | Intel Corp | 凝視の対象を検出する機能を有する微小表示システム |

| JP2002223458A (ja) * | 2001-01-26 | 2002-08-09 | Nippon Hoso Kyokai <Nhk> | 立体映像作成装置 |

| JP2003132068A (ja) * | 2001-10-22 | 2003-05-09 | Nec Corp | ナビゲーションシステム及びナビゲーション端末 |

| JP2006145922A (ja) * | 2004-11-22 | 2006-06-08 | Olympus Corp | 画像再生装置 |

Cited By (22)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US10228895B2 (en) | 2012-11-06 | 2019-03-12 | Sony Corporation | Image display device, image display method, and computer program |

| JP2017510877A (ja) * | 2014-01-25 | 2017-04-13 | ソニー インタラクティブ エンタテインメント アメリカ リミテッド ライアビリテイ カンパニー | ヘッドマウントディスプレイにおけるメニューナビゲーション |

| JP2015176526A (ja) * | 2014-03-18 | 2015-10-05 | セイコーエプソン株式会社 | 頭部装着型表示装置および頭部装着型表示装置の制御方法 |

| US10297062B2 (en) | 2014-03-18 | 2019-05-21 | Seiko Epson Corporation | Head-mounted display device, control method for head-mounted display device, and computer program |

| JP2017519999A (ja) * | 2014-04-22 | 2017-07-20 | アルブーゾフ, イワンARBOUZOV, Ivan | 頭部搭載型スマートデバイス用熱画像形成アクセサリ |

| JP2017526078A (ja) * | 2014-05-09 | 2017-09-07 | グーグル インコーポレイテッド | 実在および仮想のオブジェクトと対話するための生体力学ベースの眼球信号のためのシステムおよび方法 |

| US10827230B2 (en) | 2014-07-03 | 2020-11-03 | Sony Corporation | Information processing apparatus and information processing method |

| JPWO2016002445A1 (ja) * | 2014-07-03 | 2017-04-27 | ソニー株式会社 | 情報処理装置、情報処理方法、及びプログラム |

| JP2016024690A (ja) * | 2014-07-22 | 2016-02-08 | Necパーソナルコンピュータ株式会社 | 動作認識装置、動作認識方法、及び、プログラム |

| JP2016042680A (ja) * | 2014-08-19 | 2016-03-31 | セイコーエプソン株式会社 | 頭部装着型表示装置、画像表示システム、頭部装着型表示装置を制御する方法、および、コンピュータープログラム |

| KR102196975B1 (ko) | 2015-08-15 | 2020-12-30 | 구글 엘엘씨 | 실제 객체 및 가상 객체와 상호작용하기 위한 생체기계적 기반의 안구 신호를 위한 시스템 및 방법 |

| KR20180083252A (ko) * | 2015-08-15 | 2018-07-20 | 구글 엘엘씨 | 실제 객체 및 가상 객체와 상호작용하기 위한 생체기계적 기반의 안구 신호를 위한 시스템 및 방법 |

| JP2017055993A (ja) * | 2015-09-16 | 2017-03-23 | グリー株式会社 | ゲーム処理プログラム、ゲーム処理装置及びゲーム処理方法 |

| JPWO2017169158A1 (ja) * | 2016-03-29 | 2019-02-07 | ソニー株式会社 | 情報処理装置、情報処理方法、およびプログラム |

| JPWO2017187708A1 (ja) * | 2016-04-26 | 2019-02-28 | ソニー株式会社 | 情報処理装置、情報処理方法、及びプログラム |

| US11017257B2 (en) | 2016-04-26 | 2021-05-25 | Sony Corporation | Information processing device, information processing method, and program |

| JP2019533824A (ja) * | 2016-07-25 | 2019-11-21 | マジック リープ, インコーポレイテッドMagic Leap,Inc. | 拡張現実および仮想現実アイウェアを用いた結像修正、表示、および可視化 |

| US11327312B2 (en) | 2016-07-25 | 2022-05-10 | Magic Leap, Inc. | Imaging modification, display and visualization using augmented and virtual reality eyewear |

| JP7182538B2 (ja) | 2016-07-25 | 2022-12-02 | マジック リープ, インコーポレイテッド | 拡張現実および仮想現実アイウェアを用いた結像修正、表示、および可視化 |

| US11808943B2 (en) | 2016-07-25 | 2023-11-07 | Magic Leap, Inc. | Imaging modification, display and visualization using augmented and virtual reality eyewear |

| WO2018198320A1 (ja) * | 2017-04-28 | 2018-11-01 | 株式会社オプティム | ウェアラブル端末表示システム、ウェアラブル端末表示方法およびプログラム |

| JP7407929B2 (ja) | 2019-11-11 | 2024-01-04 | リアルシー・(ベイジン)・テクノロジー・カンパニー・リミテッド | 情報再生方法、装置、コンピュータ読み取り可能な記憶媒体及び電子機器 |

Also Published As

| Publication number | Publication date |

|---|---|

| EP2652940A1 (en) | 2013-10-23 |

| US9213405B2 (en) | 2015-12-15 |

| KR20130130740A (ko) | 2013-12-02 |

| TW201228380A (en) | 2012-07-01 |

| EP2652940B1 (en) | 2018-08-22 |

| HK1171103A1 (en) | 2013-03-15 |

| AR084345A1 (es) | 2013-05-08 |

| TWI549505B (zh) | 2016-09-11 |

| CN102566756A (zh) | 2012-07-11 |

| EP2652940A4 (en) | 2015-05-20 |

| US20120154557A1 (en) | 2012-06-21 |

| WO2012082444A1 (en) | 2012-06-21 |

| CN102566756B (zh) | 2015-07-22 |

| KR101935061B1 (ko) | 2019-01-03 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| EP2652940B1 (en) | Comprehension and intent-based content for augmented reality displays | |

| US9690099B2 (en) | Optimized focal area for augmented reality displays | |

| US9727132B2 (en) | Multi-visor: managing applications in augmented reality environments | |

| US9710130B2 (en) | User focus controlled directional user input | |

| CN112114429B (zh) | 基于用户的上下文敏感全息图反应 | |

| US8884984B2 (en) | Fusing virtual content into real content | |

| US9116666B2 (en) | Gesture based region identification for holograms | |

| US8576276B2 (en) | Head-mounted display device which provides surround video | |

| US9342610B2 (en) | Portals: registered objects as virtualized, personalized displays | |

| US10175483B2 (en) | Hybrid world/body locked HUD on an HMD | |

| US20130328925A1 (en) | Object focus in a mixed reality environment | |

| US20130342572A1 (en) | Control of displayed content in virtual environments | |

| US20130326364A1 (en) | Position relative hologram interactions | |

| US20160131902A1 (en) | System for automatic eye tracking calibration of head mounted display device |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20141114 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20141114 |

|

| A711 | Notification of change in applicant |

Free format text: JAPANESE INTERMEDIATE CODE: A711 Effective date: 20150525 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20151217 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20151222 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20160517 |