WO2019069342A1 - 端末装置、プログラム及び方法 - Google Patents

端末装置、プログラム及び方法 Download PDFInfo

- Publication number

- WO2019069342A1 WO2019069342A1 PCT/JP2017/035769 JP2017035769W WO2019069342A1 WO 2019069342 A1 WO2019069342 A1 WO 2019069342A1 JP 2017035769 W JP2017035769 W JP 2017035769W WO 2019069342 A1 WO2019069342 A1 WO 2019069342A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- objects

- terminal device

- display

- processor

- user

- Prior art date

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A63—SPORTS; GAMES; AMUSEMENTS

- A63F—CARD, BOARD, OR ROULETTE GAMES; INDOOR GAMES USING SMALL MOVING PLAYING BODIES; VIDEO GAMES; GAMES NOT OTHERWISE PROVIDED FOR

- A63F13/00—Video games, i.e. games using an electronically generated display having two or more dimensions

- A63F13/20—Input arrangements for video game devices

- A63F13/21—Input arrangements for video game devices characterised by their sensors, purposes or types

- A63F13/214—Input arrangements for video game devices characterised by their sensors, purposes or types for locating contacts on a surface, e.g. floor mats or touch pads

- A63F13/2145—Input arrangements for video game devices characterised by their sensors, purposes or types for locating contacts on a surface, e.g. floor mats or touch pads the surface being also a display device, e.g. touch screens

-

- A—HUMAN NECESSITIES

- A63—SPORTS; GAMES; AMUSEMENTS

- A63F—CARD, BOARD, OR ROULETTE GAMES; INDOOR GAMES USING SMALL MOVING PLAYING BODIES; VIDEO GAMES; GAMES NOT OTHERWISE PROVIDED FOR

- A63F13/00—Video games, i.e. games using an electronically generated display having two or more dimensions

- A63F13/80—Special adaptations for executing a specific game genre or game mode

-

- A—HUMAN NECESSITIES

- A63—SPORTS; GAMES; AMUSEMENTS

- A63F—CARD, BOARD, OR ROULETTE GAMES; INDOOR GAMES USING SMALL MOVING PLAYING BODIES; VIDEO GAMES; GAMES NOT OTHERWISE PROVIDED FOR

- A63F13/00—Video games, i.e. games using an electronically generated display having two or more dimensions

- A63F13/80—Special adaptations for executing a specific game genre or game mode

- A63F13/822—Strategy games; Role-playing games

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0484—Interaction techniques based on graphical user interfaces [GUI] for the control of specific functions or operations, e.g. selecting or manipulating an object, an image or a displayed text element, setting a parameter value or selecting a range

- G06F3/04842—Selection of displayed objects or displayed text elements

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0484—Interaction techniques based on graphical user interfaces [GUI] for the control of specific functions or operations, e.g. selecting or manipulating an object, an image or a displayed text element, setting a parameter value or selecting a range

- G06F3/04845—Interaction techniques based on graphical user interfaces [GUI] for the control of specific functions or operations, e.g. selecting or manipulating an object, an image or a displayed text element, setting a parameter value or selecting a range for image manipulation, e.g. dragging, rotation, expansion or change of colour

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

- G06F3/04883—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures for inputting data by handwriting, e.g. gesture or text

Definitions

- the present disclosure relates to a terminal device, program, and method capable of executing an application that is executed by moving an object placed on a board displayed on a display.

- Patent Document 1 describes an electronic game device that erases puzzle pieces that satisfy the conditions when the arrangement of the puzzle pieces satisfies a predetermined condition by moving the puzzle pieces by the user.

- the present disclosure provides a terminal device, program or method capable of executing an application that is more convenient for the user according to various embodiments in the present disclosure.

- a display configured to display a plurality of first objects and a board on which the first objects are arranged, a predetermined instruction command, and the first object

- a memory configured to store object attribute information, and a first object selected from the plurality of first objects, and the first object selected at an arbitrary position on the board

- An input interface configured to receive an instruction input by a user for moving, and a first object having the predetermined relationship by moving the selected first object based on the instruction input

- a processor configured to processing for displaying a position corresponding to the position of the first object continues to the terminal device that includes a "is provided.

- a display configured to display a plurality of first objects and a board on which the first objects are arranged, an object including an instruction command and the first object

- a memory configured to store attribute information, and selecting a first object of the plurality of first objects, and moving the selected first object to an arbitrary position on the board

- the attribute information has a predetermined relationship by moving a computer including an input interface configured to receive an instruction input by a user for the selected object based on the instruction input.

- a display configured to display a plurality of first objects and a board on which the first objects are arranged, an object including an instruction command and the first object

- a memory configured to store attribute information, and selecting a first object of the plurality of first objects, and moving the selected first object to an arbitrary position on the board

- a terminal device including an input interface configured to receive an instruction input by a user, wherein the instruction is performed by the processor executing the instruction instruction, the instruction selecting the first object being the instruction

- the instruction selecting the first object being the instruction

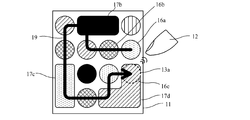

- FIG. 1a conceptually illustrates a game application implemented in a system according to various embodiments of the present disclosure.

- FIG. 1 b is a conceptual illustration of a game application implemented in a system according to various embodiments of the present disclosure.

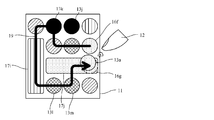

- FIG. 2 is a conceptual diagram schematically showing the configuration of the system 1 according to the first embodiment of the present disclosure.

- FIG. 3 is a block diagram illustrating an example of a configuration of the terminal device 100 according to the first embodiment of the present disclosure.

- FIG. 4 is a block diagram showing an example of the configuration of the server apparatus 200 according to the first embodiment of the present disclosure.

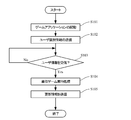

- FIG. 5 is a diagram showing a process flow executed by the terminal device 100 according to the first embodiment of the present disclosure.

- FIG. 1a conceptually illustrates a game application implemented in a system according to various embodiments of the present disclosure.

- FIG. 1 b is a conceptual illustration of a game application implemented in a system according to various embodiments of the present disclosure.

- FIG. 2 is a conceptual diagram schematic

- FIG. 6 is a diagram showing a process flow executed by the terminal device 100 according to the first embodiment of the present disclosure.

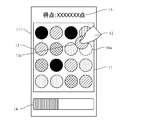

- FIG. 7 is a diagram illustrating an example of a screen displayed on the display 111 of the terminal device 100 according to the first embodiment of the present disclosure.

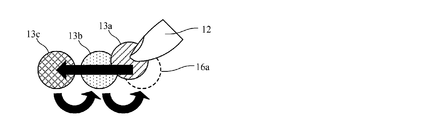

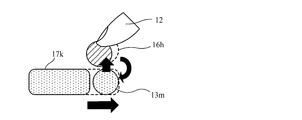

- FIG. 8a is a diagram conceptually showing the movement of the basic object 13 in the application according to the first embodiment of the present disclosure.

- FIG. 8 b is a diagram conceptually showing the movement of the basic object 13 in the application according to the first embodiment of the present disclosure.

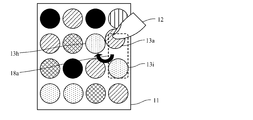

- FIG. 9a is a diagram conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure.

- FIG. 9 b is a diagram conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure.

- FIG. 9 b is a diagram conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure.

- FIG. 10a is a diagram conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure.

- FIG. 10 b is a diagram conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure.

- FIG. 11a is a diagram conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure.

- FIG. 11 b is a diagram conceptually illustrating the arrangement of objects in an application according to the first embodiment of the present disclosure.

- FIG. 11 c is a diagram conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure.

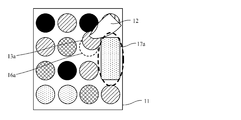

- FIG. 12 is a diagram conceptually showing the display of the combined object 17 in the application according to the first embodiment of the present disclosure.

- FIG. 13 is a diagram illustrating an example of a screen displayed on the display 111 of the terminal device 100 according to the second embodiment of the present disclosure.

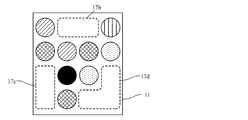

- FIG. 14 is a diagram conceptually showing the arrangement of objects in an application according to the third embodiment of the present disclosure.

- FIG. 15 is a diagram conceptually showing the arrangement of objects in an application according to the fourth embodiment of the present disclosure.

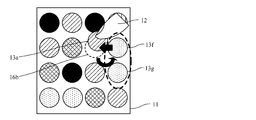

- FIG. 1a conceptually illustrates a game application implemented in a system according to various embodiments of the present disclosure. Specifically, FIG. 1a describes an example of a screen displayed by executing a game application according to various embodiments of the present disclosure on the terminal device 100. According to FIG. 1a, the user selects a desired basic object 13a from among the plurality of basic objects 13 (first objects) arranged on the board 11 displayed on the display 111 of the terminal device 100. It is possible to move.

- FIG. 1 b is a conceptual illustration of a game application implemented in a system according to various embodiments of the present disclosure. Specifically, in FIG. 1b, the basic object 13a selected by the user among the basic objects 13 arranged on the board 11 is moved from the position 16a to the position 16c along the trajectory 19 by the drag operation by the user The board 11 at the time of making it do is shown. According to FIG. 1b, following the movement of the basic object 13a along the trajectory 19, the other basic objects are sequentially moved and displayed on the board 11.

- the combined object (the position of the sequentially arranged basic objects is The second objects 17b, 17c and 17d) are sequentially displayed. Then, when the drag operation by the user is finished and the movement of the selected basic object 13a is finished, the combined object (17b, 17c and 17d) is erased from the board 11, and the effect corresponding to the eliminated combined object is the user or A predetermined effect is given to a game character operable by the user.

- the predetermined effect is imparted by continuously arranging a plurality of other basic objects while moving the basic object 13a.

- the combined objects (17b, 17c and 17d) are displayed instead of the continuous basic objects.

- the board surface 11 is formed in a square shape, but the board surface 11 may have any shape, for example, a circular shape.

- the board 11 is displayed on the display 111 so as to be visible to the user, the board 11 only needs to define the movable range of the basic object 13, and it is not necessary to display the board 11 so as to be visible.

- the basic object 13 is formed in a circular shape, but the basic object 13 may have any shape, for example, a rectangular shape, or a plurality of shapes may be combined. May be Further, in the example of FIGS.

- the basic object 13 and the combined object 17 are regularly arranged on the board 11, but may be arranged randomly. Further, in the example of FIGS. 1a and 1b, the combined object 17 is displayed by being replaced with the basic object 13 which is disposed in a plural number in a row, but may be displayed in a superimposed manner. Also, in the example of FIGS. 1a and 1b, although the instruction is input by tapping and dragging the touch panel using the user's finger 12, the instruction can be input using a stylus or the like that can be detected by the touch panel or a hard key You may do so.

- FIG. 2 is a conceptual view schematically showing a configuration of the system 1 according to the first embodiment of the present disclosure.

- system 1 includes a terminal device 100 and a server device 200 communicably connected to terminal device 100 via network 300.

- the server apparatus 200 and the terminal apparatus 100 communicate with each other as needed, and transmit and receive various information, programs, and the like necessary for the progress of the application.

- terminal device 100 Although only one terminal device 100 is described in the example of FIG. 2, naturally, a plurality of terminal devices may be connected to the server device 200. Also, although the server device 200 is described as a single device, it is also possible to distribute each component and processing of the server device 200 to a plurality of server devices. In addition, the terminal device 100 and the server device 200 may be able to execute functions other than the functions related to the execution of the game application according to the present embodiment.

- FIG. 3 is a block diagram showing an example of the configuration of the terminal device 100 according to the first embodiment of the present disclosure.

- the terminal device 100 does not have to include all of the components shown in FIG. 3, and can have a configuration in which a part is omitted, and can add other components.

- the terminal device 100 may be, for example, a portable terminal device capable of wireless communication represented by a smartphone. However, other than this, it is also possible to communicate with the server apparatus 200 such as a portable game machine, feature phone, portable information terminal, PDA, laptop personal computer, desktop personal computer, etc., and a terminal capable of executing the game application according to the present embodiment. Any device may be used.

- the terminal device 100 includes a display 111, a processor 112, and the like. It includes an input interface 116 including a memory 113, a timer 114, a communication interface 115, a touch panel 117 and a hard key 118. Then, these components are electrically connected to each other through control lines and data lines.

- the display 111 functions as a display unit that reads out the image information stored in the memory 113 and performs various displays according to an instruction of the processor 112. Specifically, the display 111 virtually associates the plurality of basic objects 13, the board 11 on which the basic objects 13 are arranged, the combined object 17, the time bar 14, the score 15, etc. in relation to the game application according to the present embodiment. Display.

- the display 111 is configured of, for example, a liquid crystal display.

- the processor 112 is configured by a CPU (microcomputer: microcomputer), and functions as a control unit that controls the other connected components based on various programs stored in the memory 113.

- the processor 112 processes instruction commands stored in the memory 113, that is, a program for executing a game application according to the present embodiment or a program for executing an OS. Specifically, the processor 112 controls the movement of the basic object 13 disposed on the board 11 according to the user's instruction input input through the input interface 116, and the control related to the display and deletion of the combined object 17. To execute various processes related to the game application according to the present embodiment.

- the processor 112 may be configured by a single CPU, but may be configured by a plurality of CPUs. Also, other types of processors such as a GPU specialized for image processing may be combined as appropriate.

- the memory 113 includes a RAM, a ROM, or a non-volatile memory (in some cases, an HDD), and functions as a storage unit.

- the ROM stores, as a program, an instruction for executing an application or an OS according to the present embodiment.

- the RAM is a memory used to write and read data while a program stored in the ROM is being processed by the processor 112.

- the non-volatile memory is a memory in which writing and reading of data are executed by the execution of the program, and the data written to the non-volatile memory is saved even after the execution of the program is completed.

- the memory 113 stores each attribute information in association with each basic object 13 and each combined object 17 as an example.

- attribute information examples include color attributes of objects such as “blue”, “red”, and “yellow”, shape attributes of objects such as “circles”, “triangles”, “squares”, and “stars”, At least one of the characteristic attributes of the object such as “flame”, “water”, and “forest” can be mentioned.

- user information of the game application received from the server device 200 user name, user identification information, name of user-operable game character, level of the game character, attack power

- result information obtained as a result of execution of the game application are updated and stored as needed.

- positional information of the basic object 13 and the combined object 17 arranged on the board 11 is updated as needed and stored.

- the timer 114 functions as a clock unit.

- the timer 114 is used to calculate the time elapsed since the basic object 13 can be moved.

- the time information used for the calculation is stored in the memory 113 as needed under the control of the processor 112.

- the communication interface 115 includes a wireless communication processing circuit and an antenna connected to the wireless communication processing device, and functions as a communication unit.

- the communication interface 115 transmits / receives a program necessary for execution of the game application according to the present embodiment, user information, information as a result of execution of the game application, and the like from the server device 200 connected via the network 300.

- the wireless communication processing circuit performs processing such as modulation and demodulation of information to be transmitted and received.

- the communication interface 115 is processed based on a broadband wireless communication method represented by W-CDMA (Wideband-Code Division Multiple Access) method, but a wireless LAN or Bluetooth (such as IEEE 802.11). It is also possible to process based on a scheme regarding narrow band wireless communication such as registered trademark).

- W-CDMA Wideband-Code Division Multiple Access

- Bluetooth such as IEEE 802.11. It is also possible to process based on a scheme regarding narrow band wireless communication such as registered trademark).

- the communication interface 115 may use wired communication instead of or in addition to wireless communication.

- a communication processing circuit for wired communication may be provided instead of or in addition to the wireless communication processing circuit.

- the input interface 116 includes the touch panel 117 and / or the hard key 118, and receives various instruction inputs from the user.

- the touch panel 117 is disposed so as to cover the display 111, and outputs information of positional coordinates touched by an object (a user's finger, a stylus or the like) corresponding to the image data displayed by the display 111.

- a touch panel method known methods such as a resistive film method, an electrostatic capacitance coupling method, and an ultrasonic surface acoustic wave method can be used.

- the input interface 116 is used to detect a selection operation (for example, a tap operation) of the basic object 13 and its movement operation (for example, a drag operation).

- FIG. 4 is a block diagram showing an example of the configuration of the server device 200 according to the first embodiment of the present disclosure.

- the server apparatus 200 does not have to include all of the components shown in FIG. 4, and can have a configuration in which a part is omitted, and can add other components.

- the server apparatus 200 includes a RAM, a ROM, a non-volatile memory, a memory 211 including an HDD and the like, a processor 212 including a CPU and the like, an I / O port 213, and a communication interface 214 including a communication processing circuit. including. Then, these components are electrically connected to each other through control lines and data lines.

- the memory 211 includes a RAM, a ROM, a non-volatile memory, and an HDD, and functions as a storage unit. Then, the memory 211 stores, as a program, an instruction for executing an application or an OS according to the present embodiment. Such programs are loaded and executed by processor 212. Also, the memory (particularly RAM) is temporarily used to execute writing and reading of data while the program is executed by the processor 212. In the present embodiment, as an example, the memory 211 stores user information (user name, user identification information, name of a game character operable by the user, name of the game character, attack power, defense, etc.) used to execute the game application. Power and the like) and result information which is the result of execution of the game application are stored in association with each other.

- user information user name, user identification information, name of a game character operable by the user, name of the game character, attack power, defense, etc.

- the processor 212 is composed of a CPU (microcomputer: microcomputer), and executes an instruction command stored in the memory 211, that is, various programs, and functions as a control unit for controlling other connected components. For example, when the processor 212 receives the user identification information from the terminal device 100, the processor 212 performs authentication processing with reference to the user information, and transmits the user information necessary for executing the game application to the terminal device 100.

- the processor 212 may be configured by a single CPU, but may be configured by a plurality of CPUs.

- the communication interface 214 transmits and receives a program for executing a game application, various information, and the like according to the present embodiment, as an example, via the terminal device 100 and the network 300, or via another server device and the network 300. To perform processing such as modulation and demodulation.

- the communication interface 214 communicates with each terminal device or another server device in accordance with a known wireless communication method or a known wired communication method. In the present embodiment, as one example, the communication interface 214 executes processing for transmitting user information in accordance with the processor 212.

- the I / O port 213 functions as an information input / output unit for inputting / outputting information to / from various external devices such as a printer.

- the I / O port 213 it is possible to adopt a known connection method such as a serial port, a parallel port, USB, etc. as desired.

- FIG. 5 is a diagram showing a process flow executed in the terminal device 100 according to the first embodiment of the present disclosure. Specifically, the process flow described in FIG. 5 is a process flow started when the game application according to the present embodiment is activated by the terminal device 100. The process flow is performed by the processor 112 reading and executing an instruction command (program) stored in the memory 113.

- an instruction command program

- the processor 112 when the touch operation of the start icon of the game application according to the present embodiment displayed on the display 111 on the touch panel 117 is detected, the processor 112 performs the start process of the game application (S101). Then, the processor 112 controls the communication interface 115 to transmit the user identification information stored in the memory 113 as the user holding the terminal device 100, ie, the user of the game application, to the server device 200 (S102).

- the server device 200 When the server device 200 receives the user identification information, it authenticates whether the user is a valid user. When the user is a valid user, the server device 200 transmits, to the terminal device 100, user information necessary for executing the game application.

- the processor 112 of the terminal device 100 stands by until user information is received from the server device 200 (S103), and when received, performs execution processing of a unit game included in the game application (S104). The details of the unit game execution process will be described later.

- the processor 112 transmits, to the server apparatus 200, the user information updated and stored in the memory and the result information indicating the execution result of the game application. Control the communication interface 115 (S105). Then, the execution of the game application being executed is ended.

- the unit game means one group of games, and is expressed by, for example, a quest, a scenario, a chapter, a dungeon, a mission, and the like.

- the game application according to the present embodiment is composed of a plurality of unit games. Then, in each memory of the terminal device 100 and / or the server device 200, a program for executing the unit game and various information (clear information of unit game, enemy character information, consumption stamina, etc.) are respectively user identification information. Are stored in association with Then, the unit game is executed by reading and executing these programs and various information.

- FIG. 6 is a diagram showing a processing flow executed in the terminal device 100 according to the first embodiment of the present disclosure. Specifically, the process flow described in FIG. 6 is a process flow started when the user instructs execution of a desired unit game while the game application according to the present embodiment is being executed. . The process flow is performed by the processor 112 reading and executing an instruction command (program) stored in the memory 113.

- an instruction command program

- the processor 112 controls the display to arrange and display a plurality of basic objects 13 on the board 11 that constitutes the unit game (S201). Then, when it becomes possible to select the basic object 13 by the user and move the selected basic object 13a, the timer 114 is used to start clocking (S202).

- an instruction input for selecting one basic object 13a of the plurality of basic objects 13 by the user, and any option on the board 11 while tapping the selected basic object 13a

- the processor 112 executes a movement process of the selected basic object 13a (S203).

- the processor 112 determines whether or not the combined object 17 is arranged at the position of the movement destination (S204). Then, as a result of the judgment, when the combined object 17 is not arranged, the moving process of the other basic object originally arranged at the position of the movement destination is performed (S205). The process in the case where the combined object 17 is arranged in S204 will be described later.

- FIG. 7 is a diagram illustrating an example of a screen displayed on the display 111 of the terminal device 100 according to the first embodiment of the present disclosure. Specifically, FIG. 7 shows an example of a screen when one basic object 13a is selected from the plurality of basic objects 13 arranged on the board 11 by the processing according to S203 of FIG. 6 and the movement is started. Indicates According to FIG. 7, in addition to the board 11 and the basic object 13, a score 15 currently acquired and a time bar 14 indicating a remaining time for which a unit game in progress can be executed are displayed on the display 111.

- the basic object 13a is selected. Then, when the finger 12 is dragged in an arbitrary direction as it is without releasing the tap by the finger 12, the basic object 13a selected following the movement is started to move from the position 16a originally arranged. Then, when the selected basic object 13a is superimposed on the display position of another basic object, the other basic object is moved so as to be shifted to the originally arranged position 16a of the basic object 13a.

- FIG. 8a is a diagram conceptually showing the movement of the basic object 13 in the application according to the first embodiment of the present disclosure. Specifically, FIG. 8 a is an enlarged view of a part of the board 11. FIG. 8a follows the movement of the selected basic object 13a in the left direction by the processing according to S203 to S205 in FIG. 6, and the other basic objects 13b and 13c slide to new positions and are arranged It shows how it is done. According to FIG. 8a, when the basic object 13a is selected by the finger 12 and dragged in the left direction, the movement is started from the originally arranged position 16a.

- the superimposed basic object 13b is slid to the position 16a where the basic object 13a was originally disposed. Further, when the selected basic object 13a moves in the left direction and is displayed superimposed on the display area of the basic object 13c, the basic object 13c on which the superimposed basic object 13c is slid is originally arranged Slide to the right position.

- FIG. 8A the case of moving the selected basic object 13a in the left direction has been described, but the same applies to the case of moving it in the right direction.

- FIG. 8 b is a diagram conceptually showing the movement of the basic object 13 in the application according to the first embodiment of the present disclosure. Specifically, FIG. 8 b is an enlarged view of a part of the board 11. FIG. 8b follows the movement of the selected basic object 13a downward by the processing according to S203 to S205 of FIG. 6, and the other basic objects 13d and 13e slide to new positions and are arranged It shows how it is done. Referring to FIG. 8b, when the basic object 13a is selected and dragged downward by the finger 12, the movement is started from the originally arranged position 16a.

- the superimposed basic object 13d is slid to the position 16a where the basic object 13a was originally disposed. Furthermore, when the selected basic object 13a moves downward and is displayed superimposed on the display area of the basic object 13e, the basic object 13e on which the superimposed basic object 13e is slid is originally disposed Slide to the right position.

- FIG. 8B the case of moving the selected basic object 13a downward is described, but the same applies to the case of moving upward.

- the processor 112 performs the moving process of the basic object 13a shown in FIG. 7, FIG. 8a and FIG. 8b and the moving process of other basic objects. Then, it is determined whether or not to be placed (S207). When a plurality of continuous objects are not arranged, each basic object is moved and arranged as it is, and the process proceeds to S209. On the other hand, when a plurality of continuous objects are to be arranged, the processor 112 performs processing for displaying the combined object at the arrangement position of the basic objects arranged continuously (S208).

- step S207 the processor 112 determines whether the same attribute information is included.

- the present invention is not limited to this, and it may be determined whether or not each piece of attribute information associated with a plurality of basic objects arranged consecutively is in a predetermined relationship. For example, if it is determined in advance that a predetermined relationship is established by a combination of the "blue" attribute and the “red” attribute, the "yellow” attribute and the “green” attribute, and the "black” attribute and the “white” attribute, It may be determined.

- FIGS. 9a and 9b are diagrams conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure. Specifically, FIGS. 9a and 9b show how the combined object 17 is displayed when the combined object display process is performed by the processing according to S205 to S208 of FIG.

- the basic object 13f which has been arranged at the position 16b is arranged to slide in the right direction. Then, since the basic object 13 f and the basic object 13 g both have the same attribute information (for example, the “red” attribute), a plurality of basic objects having the same attribute information are arranged in succession.

- a combined object 17 a having a shape different from that of the sequentially arranged basic objects 13 f and 13 g is displayed on the board 11.

- the combined object 17a is displayed at the display position of the basic objects 13f and 13g arranged consecutively.

- the combined object 17a is displayed in place of the basic objects 13f and 13g.

- the display mode of the combined object 17a is not limited to the example shown in FIG. 9b, and may be displayed superimposed on each basic object so that the continuous basic objects 13f and 13g can be visually recognized.

- the display position of the combined object 17a may also correspond to the display positions of the basic objects 13f and 13g. That is, the combined object 17a does not have to be displayed so as to cover the entire basic object, but may be displayed only in a part of the area.

- the processor 112 corresponds to whether or not the drag operation by the user has ended, ie, the display position of the selected basic object 13a. It is determined whether the finger 12 is released from the position on the touch panel (S209). If it is determined that the drag operation has not ended, the movement of the selected basic object 13a continues, so the processing of S203 to S209 is repeated again.

- the processor 112 decomposes the move destination combined object into individual basic objects, and processes each basic object to move to a predetermined position (S206).

- FIGS. 10a and 10b are diagrams conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure. Specifically, FIGS. 10a and 10b show that the combined object 17 is disassembled by the process according to S206 of FIG. 6, and each basic object moves to a predetermined position.

- the combined object 17a is already displayed at the movement destination.

- FIG. 10b when the selected basic object 13a moves in the display area of the combined object 17a, the combined object 17a being displayed is decomposed into basic objects 13h and 13i.

- the basic object 13a is arranged by sliding to the position 16a at which the basic object 13a originally selected was displayed.

- the basic object 13a and the basic object 13i which have moved are displayed at the position corresponding to the display position of the combined object 17a. That is, as shown in FIGS. 10a and 10b, the user can easily determine whether a plurality of basic objects having the same attribute are continuously arranged by changing the display mode of the combined object.

- the processing according to S203 to S209 is repeatedly performed, and when it is determined that the drag operation is ended in S209, the processor 112 ends the movement of the selected basic object 13a, and the displayed connection is displayed.

- a process of erasing the object 17 from the board 11 is executed (S210).

- the processor 112 calculates the score to be given to the user according to the deleted combined object 17, and updates the user's score information stored in the memory 113 based on the calculated score (S211) ).

- the end of the movement of the basic object 13a is determined based on the end of the drag operation, that is, whether or not the finger 12 is released, but it is arranged on the board 11 whether the operated finger has come out of the board 11 or not. It is also possible to replace with conditions such as whether or not the operation inhibited object has come into contact, and whether or not the operation time limit has been reached during the operation, or a combination as appropriate.

- the processor 112 determines whether or not a predetermined time has elapsed since the start of time counting by the timer 114 in S202 (S212). Then, if the predetermined time has not elapsed, it is possible to select and move the basic object 13 on the board 11 again, so the process of rearranging the basic object 13 on the board 11 is performed (S214).

- FIGS. 11a to 11c are diagrams conceptually showing the arrangement of objects in an application according to the first embodiment of the present disclosure. Specifically, in FIGS. 11a to 11c, the end of the drag operation is detected and the combined object 17 is erased from the board 11 by the processing according to S209 to S214 in FIG. 6, and the basic object 13 is rearranged. Indicates

- the processor 112 rearranges any basic object 13 at the positions 16d to 16j after the combined object 17 is deleted.

- the basic objects 13 displayed in advance are sequentially slid and displayed at each of the erased positions 16d to 16j, and thereafter, any basic object is rearranged at a position at which no basic object 13 is disposed. You may

- the processor 112 is executing the unit game being executed It is determined whether the end of has been selected by the user. If the end is not selected, the processor 112 starts the process again from S201. On the other hand, when the end is selected, the processor 112 ends the unit game execution process, and shifts to S105 of FIG.

- FIG. 12 is a diagram conceptually showing the display of the combined object 17 in the application according to the first embodiment of the present disclosure. Specifically, FIG. 12 shows how the display area of the combined object 17k already displayed is enlarged and displayed in the right direction in the process of moving the selected basic object 13a.

- the basic object 13a moves upward in the course of its movement, the basic object 13m is displayed superimposed on the position 16h originally displayed. As a result, the basic object 13m slides downward.

- the combined object 17 k already displayed and the basic object 13 m having the same attribute information are continuously arranged. In such a case, the combined object 17k is enlarged and displayed at a position corresponding to the arrangement position of the basic object 13m.

- the movement of the basic object 13 and the display of the combined object 17 are performed while the drag operation continues, as is particularly clear from FIG. It is erased from the board 11. Then, according to the deleted combined object, a predetermined effect is given to the user or a game character operable by the user. At this time, since the object to be deleted is displayed with a shape or the like different from that of the normal basic object 13, the user can easily determine the object to be deleted. Also, by displaying in this way, drawing of a plurality of objects displayed on the board 11 will be integrated into one at a time, which can contribute to the reduction of memory load and improvement of processing speed. It becomes.

- Second Embodiment In the first embodiment, as the effect given to the user or the game character operable by the user, the case where the “score” is given according to the deleted combined object 17 has been described.

- damage to an enemy character in a battle game is given as an effect given to the user or a game character operable by the user.

- the present embodiment is the same as the configuration, processing, and procedure in the first embodiment, except for the points specifically described below. Therefore, detailed description of those matters is omitted.

- FIG. 13 is a diagram illustrating an example of a screen displayed on the display 111 of the terminal device 100 according to the second embodiment of the present disclosure. Specifically, FIG. 13 shows that the connected object is erased from the board 11 and the game character 20 operable by the user damages the enemy character 21 with an aggressivity corresponding to the erased merged object. .

- parameter values of an attack power and a defense power are stored in advance in association with each game character and enemy character.

- damage to the enemy character 21 is given based on the attribute information of the deleted combined object, the attack power of the game character 20, and the defense power of the enemy character 21. calculate.

- an effect of giving 150 damage to the enemy character 21 is given, whereby 150 damage can be subtracted from the hit point parameter of the enemy character 21.

- damage to the enemy character is given as an example of the effect, but it is also possible to give a temporary improvement in offensive power, an improvement in defensive power, etc. as an example of the effect.

- the basic objects 13 are arranged in a 4 ⁇ 4 grid shape on the board 11 .

- the basic object 13 is disposed at an arbitrary position on the board 11 instead of in a lattice shape.

- the present embodiment is the same as the configurations, processes, and procedures in the first and second embodiments, except for the points specifically described below. Therefore, detailed description of those matters is omitted.

- FIG. 14 is a diagram conceptually showing the arrangement of objects in an application according to the third embodiment of the present disclosure. Specifically, FIG. 14 shows how the selected basic object 13a moves on the board 11 on which the basic objects 13 are arranged at arbitrary positions. According to FIG. 14, the selected basic object 13 a is moved along the trajectory 19 from the position 16 d to the position 16 e by the drag operation of the finger 12. Other basic objects are sequentially moved in accordance with the movement of the selected basic object 13a. Then, when a plurality of basic objects 13 having the same attribute are continuously arranged (or arranged adjacent to each other) by the movement, the combined objects 17e to 17h are displayed at their display positions. At this time, the shapes and sizes of the combined objects 17e to 17h can be determined in accordance with the number of basic objects arranged in succession and their positional relationship.

- the combined object 17 is displayed when two or more basic objects having the same attribute are arranged in succession.

- the combined object is displayed only when three or more basic objects are sequentially arranged.

- the present embodiment is the same as the configuration, processing, and procedure in the first embodiment, except for the points specifically described below. Therefore, detailed description of those matters is omitted.

- FIG. 15 is a diagram conceptually showing the arrangement of objects in an application according to the fourth embodiment of the present disclosure. Specifically, FIG. 15 shows how the basic object 13a selected by the finger 12 moves on the board 11 on which a plurality of basic objects 13 are displayed. According to FIG. 15, the selected basic object 13 a is moved along the trajectory 19 from the position 16 f to the position 16 g by the drag operation of the finger 12. Other basic objects are sequentially moved in accordance with the movement of the selected basic object 13a. Then, when three or more basic objects 13 having the same attribute are continuously arranged by the movement, the combined objects 17i and 17j are displayed at their display positions. At this time, focusing on the basic objects 13j and 13k and the basic objects 13l and 13m, for example, two basic objects having the same attribute are continuously arranged, but three or more are not continuously arranged. The objects 17 are not displayed at their display positions.

- the processes and procedures described herein can be realized not only by those explicitly described in the embodiments, but also by software, hardware, or a combination thereof. Specifically, the processes and procedures described in this specification are realized by implementing logic corresponding to the process on a medium such as an integrated circuit, volatile memory, non-volatile memory, magnetic disk, optical storage, etc. Be done. In addition, the processes and procedures described in the present specification can be implemented as computer programs of the processes and procedures and can be executed by various computers including a terminal device and a server device.

Abstract

【課題】 様々な実施形態により、ユーザにとってより利便性の高いアプリケーションの実行が可能な端末装置、プログラム又は方法を提供する。 【解決手段】 複数の第1オブジェクトと、前記第1オブジェクトが配置された盤面とを表示するように構成されたディスプレイと、所定の指示命令と、前記第1オブジェクトを含むオブジェクトの属性情報とを記憶するように構成されたメモリと、前記複数の第1オブジェクトのうちの一つの第1オブジェクトを選択し、前記盤面上の任意の位置に選択された前記第1オブジェクトを移動させるためのユーザによる指示入力を受け付けるように構成された入力インターフェイスと、選択された前記第1オブジェクトを前記指示入力に基づいて移動させることによって、前記属性情報が所定の関係を有する第1オブジェクトが複数連続して配置される場合には、連続する前記第1オブジェクトとは異なる第2オブジェクトを、連続する前記第1オブジェクトの配置位置に対応する位置に表示するための処理をするように構成されたプロセッサと、を含む端末装置である。

Description

本開示は、ディスプレイに表示された盤面上に配置されたオブジェクトの移動をすることにより実行されるアプリケーションの実行が可能な端末装置、プログラム、及び方法に関する。

従来より、ディスプレイ上に表示された盤面に配置されたオブジェクトをユーザの指示入力によって移動させて、例えば同じ色同士のオブジェクトが隣り合った場合には両オブジェクトを盤面から消去させるパズルゲームアプリケーションを実行可能な端末装置が知られていた。特許文献1には、ユーザによるパズルピースの移動によってパズルピースの配置が所定の条件を満たしたときにその条件を満たしたパズルピースを消去する電子ゲーム装置が記載されている。

そこで、上記のような技術を踏まえ、本開示では、様々な実施形態により、ユーザにとってより利便性の高いアプリケーションの実行が可能な端末装置、プログラム又は方法を提供する。

本開示の一態様によれば、「複数の第1オブジェクトと、前記第1オブジェクトが配置された盤面とを表示するように構成されたディスプレイと、所定の指示命令と、前記第1オブジェクトを含むオブジェクトの属性情報とを記憶するように構成されたメモリと、前記複数の第1オブジェクトのうちの一つの第1オブジェクトを選択し、前記盤面上の任意の位置に選択された前記第1オブジェクトを移動させるためのユーザによる指示入力を受け付けるように構成された入力インターフェイスと、選択された前記第1オブジェクトを前記指示入力に基づいて移動させることによって、前記属性情報が所定の関係を有する第1オブジェクトが複数連続して配置される場合には、連続する前記第1オブジェクトとは異なる第2オブジェクトを、連続する前記第1オブジェクトの配置位置に対応する位置に表示するための処理をするように構成されたプロセッサと、を含む端末装置」が提供される。

本開示の一態様によれば、「複数の第1オブジェクトと前記第1オブジェクトが配置された盤面とを表示するように構成されたディスプレイと、所定の指示命令と前記第1オブジェクトを含むオブジェクトの属性情報とを記憶するように構成されたメモリと、前記複数の第1オブジェクトのうちの一つの第1オブジェクトを選択し、前記盤面上の任意の位置に選択された前記第1オブジェクトを移動させるためのユーザによる指示入力を受け付けるように構成された入力インターフェイスと、を含むコンピュータを、選択された前記第1オブジェクトを前記指示入力に基づいて移動させることによって、前記属性情報が所定の関係を有する第1オブジェクトが複数連続して配置される場合には、連続する前記第1オブジェクトとは異なる第2オブジェクトを、連続する前記第1オブジェクトの配置位置に対応する位置に表示するための処理をするプロセッサ、として機能させるプログラム」が提供される。

本開示の一態様によれば、「複数の第1オブジェクトと前記第1オブジェクトが配置された盤面とを表示するように構成されたディスプレイと、所定の指示命令と前記第1オブジェクトを含むオブジェクトの属性情報とを記憶するように構成されたメモリと、前記複数の第1オブジェクトのうちの一つの第1オブジェクトを選択し、前記盤面上の任意の位置に選択された前記第1オブジェクトを移動させるためのユーザによる指示入力を受け付けるように構成された入力インターフェイスと、を含む端末装置において、プロセッサが前記指示命令を実行することによりなされる方法であって、選択された前記第1オブジェクトを前記指示入力に基づいて移動させることによって、前記属性情報が所定の関係を有する第1オブジェクトが複数連続して配置される場合には、連続する前記第1オブジェクトとは異なる第2オブジェクトを、連続する前記第1オブジェクトの配置位置に対応する位置に表示するための処理をする段階と、を含む方法」が提供される。

本開示の様々な実施形態によれば、ユーザにとってより利便性の高いアプリケーションの実行が可能な端末装置、プログラム又は方法を提供することができる。

なお、上記効果は説明の便宜のための例示的なものであるにすぎず、限定的なものではない。上記効果に加えて、または上記効果に代えて、本開示中に記載されたいかなる効果や当業者であれば明らかな効果を奏することも可能である。

添付図面を参照して本開示の様々な実施形態を説明する。なお、図面における共通する構成要素には同一の参照符号が付されている。

<本開示に係るシステムの概要>

図1aは、本開示の様々な実施形態に係るシステムにおいて実行されるゲームアプリケーションを概念的に示す図である。具体的には、図1aには、本開示の様々な実施形態に係るゲームアプリケーションを端末装置100で実行することによって表示される画面の一例が記載されている。図1aによると、端末装置100のディスプレイ111に表示された盤面11上に複数配置された基本オブジェクト13(第1オブジェクト)の中から、ユーザが所望の基本オブジェクト13aをタップすることにより選択して移動させることが可能である。

図1aは、本開示の様々な実施形態に係るシステムにおいて実行されるゲームアプリケーションを概念的に示す図である。具体的には、図1aには、本開示の様々な実施形態に係るゲームアプリケーションを端末装置100で実行することによって表示される画面の一例が記載されている。図1aによると、端末装置100のディスプレイ111に表示された盤面11上に複数配置された基本オブジェクト13(第1オブジェクト)の中から、ユーザが所望の基本オブジェクト13aをタップすることにより選択して移動させることが可能である。

図1bは、本開示の様々な実施形態に係るシステムにおいて実行されるゲームアプリケーションを概念的に示す図である。具体的には、図1bには、盤面11に配置された基本オブジェクト13のうち、ユーザによって選択された基本オブジェクト13aを、ユーザによるドラッグ操作によって、位置16aから軌跡19に沿って位置16cまで移動させたときの盤面11が示されている。図1bによると、軌跡19に沿った基本オブジェクト13aの移動に追従して、他の基本オブジェクトも盤面11上を順次移動して表示させる。さらに、他の基本オブジェクトの移動の結果、同じ属性を有する基本オブジェクトが複数個連続して配置されることになった場合には、その連続して配置される基本オブジェクトの位置に、結合オブジェクト(第2オブジェクト:17b、17c及び17d)を順次表示する。そして、ユーザによるドラッグ操作が終了し、選択された基本オブジェクト13aの移動が終了すると、結合オブジェクト(17b、17c及び17d)が盤面11から消去され、消去された結合オブジェクトに応じた効果がユーザ又はユーザが操作可能なゲームキャラクタに所定の効果を付与する。

すなわち、本開示に係るゲームアプリケーションでは、ユーザが選択した基本オブジェクト13aをドラッグ操作によって基本オブジェクト13aを移動させる間に他の基本オブジェクトを複数個連続して配置させることで所定の効果が付与される。このとき、複数個連続して配置され効果が付与される状態になったことをユーザにより分かりやすく表示するために、連続した基本オブジェクトに代えて結合オブジェクト(17b、17c及び17d)を表示する。

なお、図1a及び図1bの例では、盤面11を四角形状に形成しているが、盤面11は、例えば円形状など、いかなる形状であってもよい。また、盤面11がユーザに対して視認可能にディスプレイ111上に表示しているが、盤面11は基本オブジェクト13の移動可能な範囲を定めていればよく、視認可能に表示する必要はない。また、図1a及び図1bの例では、基本オブジェクト13を円形状に形成しているが、基本オブジェクト13は、例えば四角形状など、いかなる形状であってもよいし、複数の形状を組み合わせるようにしてもよい。また、図1a及び図1bの例では、基本オブジェクト13及び結合オブジェクト17を盤面11上に規則的に配置させているが、ランダムに配置させてもよい。また、図1a及び図1bの例では、結合オブジェクト17は、複数個連続して配置される基本オブジェクト13に置き換えて表示するようにしているが、重畳して表示するようにしてもよい。また、図1a及び図1bの例では、ユーザの指12を用いてタッチパネルのタップ、ドラッグ操作をすることで指示入力しているが、タッチパネルで検出可能なスタイラス等や、ハードキーによって指示入力するようにしてもよい。

<第1実施形態>

1.本開示の第1実施形態に係るシステム1の構成

図2は、本開示の第1実施形態に係るシステム1の構成を概略的に示す概念図である。図2を参照すると、システム1は、端末装置100と、端末装置100とネットワーク300を介して通信可能に接続されたサーバ装置200とを含む。サーバ装置200及び端末装置100は、互いに随時通信して、アプリケーションの進行に必要な各種情報やプログラム等を送受信する。

1.本開示の第1実施形態に係るシステム1の構成

図2は、本開示の第1実施形態に係るシステム1の構成を概略的に示す概念図である。図2を参照すると、システム1は、端末装置100と、端末装置100とネットワーク300を介して通信可能に接続されたサーバ装置200とを含む。サーバ装置200及び端末装置100は、互いに随時通信して、アプリケーションの進行に必要な各種情報やプログラム等を送受信する。

なお、図2の例では、端末装置100は1個しか記載されていないが、当然複数の端末装置がサーバ装置200に接続されていてもよい。また、サーバ装置200は単一のものとして記載されているが、サーバ装置200の各構成要素及び処理を複数のサーバ装置に分配することも可能である。また、端末装置100及びサーバ装置200は、本実施形態に係るゲームアプリケーションの実行に関する機能以外の機能を実行可能にしてもよい。

2.端末装置100の構成

図3は、本開示の第1実施形態に係る端末装置100の構成の例を示すブロック図である。端末装置100は、図3に示す構成要素の全てを備える必要はなく、一部を省略した構成をとることも可能であるし、他の構成要素を加えることも可能である。

図3は、本開示の第1実施形態に係る端末装置100の構成の例を示すブロック図である。端末装置100は、図3に示す構成要素の全てを備える必要はなく、一部を省略した構成をとることも可能であるし、他の構成要素を加えることも可能である。

端末装置100は、一例としては、スマートフォンに代表される無線通信可能な携帯型の端末装置が挙げられる。しかし、それ以外にも、携帯型ゲーム機、フィーチャーフォン、携帯情報端末、PDA、ラップトップパソコン、デスクトップパソコンなど、サーバ装置200と通信可能であって本実施形態に係るゲームアプリケーションを実行可能な端末装置であれば、いずれでもよい。

図3によると、端末装置100は、ディスプレイ111、プロセッサ112、

メモリ113、タイマー114、通信インターフェイス115、タッチパネル117及びハードキー118を含む入力インターフェイス116を含む。そして、これらの各構成要素が制御ライン及びデータラインを介して互いに電気的に接続される。

メモリ113、タイマー114、通信インターフェイス115、タッチパネル117及びハードキー118を含む入力インターフェイス116を含む。そして、これらの各構成要素が制御ライン及びデータラインを介して互いに電気的に接続される。

ディスプレイ111は、プロセッサ112の指示に応じて、メモリ113に記憶された画像情報を読み出して各種表示を行う表示部として機能する。具体的には、ディスプレイ111は、本実施形態に係るゲームアプリケーションに関連して、複数の基本オブジェクト13、基本オブジェクト13が配置された盤面11、結合オブジェクト17、タイムバー14、得点15などを仮想的に表示する。ディスプレイ111は、例えば液晶ディスプレイから構成される。

プロセッサ112は、CPU(マイクロコンピュータ:マイコン)から構成され、メモリ113に記憶された各種プログラムに基づいて、接続された他の構成要素を制御する制御部として機能する。プロセッサ112は、メモリ113に記憶された指示命令、すなわち本実施形態に係るゲームアプリケーションを実行するためのプログラムやOSを実行するためのプログラムを処理する。具体的には、プロセッサ112は、入力インターフェイス116を介して入力されたユーザの指示入力に応じて盤面11に配置された基本オブジェクト13の移動の制御や、結合オブジェクト17の表示および消去に係る制御を含む、本実施形態に係るゲームアプリケーションに関連する様々な処理を実行する。なお、プロセッサ112は、単一のCPUで構成されても良いが、複数のCPUで構成しても良い。また、画像処理に特化したGPU等、他の種類のプロセッサを適宜組み合わせてもよい。

メモリ113は、RAM、ROM、又は不揮発性メモリ(場合によっては、HDD)を含み、記憶部として機能する。ROMは、本実施形態に係るアプリケーションやOSを実行するための指示命令をプログラムとして記憶する。RAMは、ROMに記憶されたプログラムがプロセッサ112により処理されている間、データの書き込み及び読み込みをするために用いられるメモリである。不揮発性メモリは、当該プログラムの実行によってデータの書き込み及び読み込みが実行されるメモリであって、ここに書き込まれたデータは、当該プログラムの実行が終了した後でも保存される。メモリ113には、一例として、各基本オブジェクト13や結合オブジェクト17に対応付けて、各属性情報が記憶される。当該属性情報の一例としては、「青」、「赤」、「黄」などのオブジェクトの色属性や、「丸」、「三角」、「四角」、「星」などのオブジェクトの形状属性や、「炎」、「水」、「森」などのオブジェクトの特性属性などの少なくとも一つが挙げられる。また、メモリ113には、特に図示していないものの、サーバ装置200から受信したゲームアプリケーションのユーザ情報(ユーザ名、ユーザ識別情報、ユーザが操作可能なゲームキャラクタ名、当該ゲームキャラクタのレベル、攻撃力、防御力など)や、ゲームアプリケーションの実行した結果である結果情報が、随時更新して記憶される。さらに、メモリ113には、特に図示していないものの、盤面11に配置される基本オブジェクト13及び結合オブジェクト17の位置情報が、随時更新して記憶される。

タイマー114は、計時部として機能する。タイマー114は、基本オブジェクト13の移動が可能となってから経過した時間を算出するのに利用される。上記算出をするのに利用される時間情報は、プロセッサ112の制御により随時メモリ113に記憶される。

通信インターフェイス115は、無線通信処理回路、及び当該無線通信処理装置に接続されたアンテナを含み、通信部として機能する。通信インターフェイス115は、ネットワーク300を介して接続されたサーバ装置200から本実施形態に係るゲームアプリケーションの実行に必要なプログラムや、ユーザ情報、ゲームアプリケーションの実行の結果情報などの送受信を行う。無線通信処理回路では、送受信する情報の変調や復調などの処理を行う。

通信インターフェイス115は、W-CDMA(Wideband-Code Division Multiple Access)方式に代表されるような広帯域の無線通信方式に基づいて処理されるが、IEEE802.11に代表されるような無線LANやBluetooth(登録商標)のような狭帯域の無線通信に関する方式に基づいて処理することも可能である。

通信インターフェイス115は、無線通信に代えて、または加えて、有線通信を用いることも可能である。その場合には、無線通信処理回路に代えて、または加えて、有線通信のための通信処理回路を設ければよい。

入力インターフェイス116は、タッチパネル117及び/又はハードキー118を含み、ユーザからの各種指示入力を受け付ける。タッチパネル117は、ディスプレイ111を被覆するように配置され、ディスプレイ111の表示する画像データに対応して、客体(ユーザの指やスタイラス等)によってタッチされた位置座標の情報を出力する。タッチパネル方式としては、抵抗膜方式、静電容量結合方式、超音波表面弾性波方式など、公知の方式を利用することができる。本実施形態においては、入力インターフェイス116は、基本オブジェクト13の選択操作(例えば、タップ操作)、その移動操作(例えば、ドラッグ操作)を検出するために用いられる。

3.サーバ装置200の構成

図4は、本開示の第1実施形態に係るサーバ装置200の構成の例を示すブロック図である。サーバ装置200は、図4に示す構成要素の全てを備える必要はなく、一部を省略した構成をとることも可能であるし、他の構成要素を加えることも可能である。

図4は、本開示の第1実施形態に係るサーバ装置200の構成の例を示すブロック図である。サーバ装置200は、図4に示す構成要素の全てを備える必要はなく、一部を省略した構成をとることも可能であるし、他の構成要素を加えることも可能である。

図4によると、サーバ装置200は、RAM、ROM、及び不揮発性メモリ、HDD等を含むメモリ211、CPU等から構成されるプロセッサ212、I/Oポート213、及び通信処理回路を含む通信インターフェイス214を含む。そして、これらの各構成要素が制御ライン及びデータラインを介して互いに電気的に接続される。

メモリ211は、RAM、ROM、不揮発性メモリ、HDDを含み、記憶部として機能する。そして、当該メモリ211は、本実施形態に係るアプリケーションやOSを実行するための指示命令をプログラムとして記憶する。このようなプログラムは、プロセッサ212によってロードされ実行される。また、当該メモリ(特にRAM)は、上記プログラムがプロセッサ212によって実行される間、データの書き込み及び読み込みを実行するために一時的に用いられる。本実施形態においては、一例として、メモリ211には、ゲームアプリケーションの実行に用いられるユーザ情報(ユーザ名、ユーザ識別情報、ユーザが操作可能なゲームキャラクタ名、当該ゲームキャラクタのレベル、攻撃力、防御力など)や、ゲームアプリケーションの実行した結果である結果情報が、互いに関連付けて記憶される。

プロセッサ212は、CPU(マイクロコンピュータ:マイコン)から構成され、メモリ211に記憶された指示命令、すなわち各種プログラムを実行して、接続された他の構成要素を制御するための制御部として機能する。例えば、プロセッサ212は、端末装置100からユーザ識別情報を受信するとユーザ情報を参照して認証処理をするとともに、ゲームアプリケーションの実行に必要なユーザ情報を端末装置100に送信する処理をする。なお、プロセッサ212は、単一のCPUで構成されても良いが、複数のCPUで構成しても良い。

通信インターフェイス214は、一例として、端末装置100とネットワーク300を介して、又は他のサーバ装置とネットワーク300を介して、本実施形態に係るゲームアプリケーションの実行のためのプログラム、各種情報等を送受信するために、変調や復調などの処理を行う。通信インターフェイス214は、公知の無線通信方式や公知の有線通信方式にしたがって、各端末装置や他のサーバ装置と通信する。本実施形態においては、一例としては、通信インターフェイス214は、プロセッサ212にしたがって、ユーザ情報を送信するための処理を実行する。

I/Oポート213は、特に図示はしていないが、プリンタ等の様々な外部機器との間で情報の入出力をするための情報入出力部として機能する。I/Oポート213は、シリアルポート、パラレルポート、USB等、所望に応じて公知の接続形式を採用することが可能である。

4.端末装置100におけるゲームアプリケーションの処理フロー

図5は、本開示の第1実施形態に係る端末装置100において実行される処理フローを示す図である。具体的には、図5に記載の処理フローは、本実施形態に係るゲームアプリケーションを端末装置100で起動したときに開始される処理フローである。当該処理フローは、プロセッサ112がメモリ113に記憶された指示命令(プログラム)を読み出して実行することにより行われる。

図5は、本開示の第1実施形態に係る端末装置100において実行される処理フローを示す図である。具体的には、図5に記載の処理フローは、本実施形態に係るゲームアプリケーションを端末装置100で起動したときに開始される処理フローである。当該処理フローは、プロセッサ112がメモリ113に記憶された指示命令(プログラム)を読み出して実行することにより行われる。

図5によると、プロセッサ112は、タッチパネル117においてディスプレイ111に表示された本実施形態に係るゲームアプリケーションの起動アイコンのタッチ操作が検出されると、当該ゲームアプリケーションの起動処理を行う(S101)。そして、プロセッサ112は、端末装置100を保持するユーザ、すなわち当該ゲームアプリケーションのユーザとしてメモリ113に記憶されたユーザ識別情報をサーバ装置200に送信するよう、通信インターフェイス115を制御する(S102)。

サーバ装置200は、ユーザ識別情報を受信すると、そのユーザが正当なユーザであるか否かの認証を行う。そして正当なユーザであった場合には、サーバ装置200は、ゲームアプリケーションの実行に必要なユーザ情報を端末装置100に送信する。

端末装置100のプロセッサ112は、ユーザ情報をサーバ装置200から受信するまで待機し(S103)、受信していた場合にはゲームアプリケーションに含まれる単位ゲームの実行処理を行う(S104)。なお、単位ゲームの実行処理の詳細については、後述する。

そして、タッチパネル117が実行中のゲームアプリケーションの終了の指示入力を受け付けると、プロセッサ112は、メモリに更新して記憶されたユーザ情報やゲームアプリケーションの実行結果を示す結果情報をサーバ装置200に送信するよう通信インターフェイス115を制御する(S105)。そして、実行中のゲームアプリケーションの実行を終了する。

なお、単位ゲームとは、ゲームの一つのまとまりを意味し、例えば、クエスト、シナリオ、チャプター、ダンジョン、ミッション等によって表現される。本実施形態に係るゲームアプリケーションは、複数の単位ゲームから構成される。そして、端末装置100及び/又はサーバ装置200の各メモリには、当該単位ゲームを実行するためのプログラム、及び各種情報(単位ゲームのクリア情報、敵キャラクタ情報、消費スタミナなど)がそれぞれユーザ識別情報に対応付けて記憶されている。そして、これらプログラム、及び各種情報を読み出して実行することによって、当該単位ゲームが実行される。

5.端末装置100における単位ゲームの処理フロー

図6は、本開示の第1実施形態に係る端末装置100において実行される処理フローを示す図である。具体的には、図6に記載の処理フローは、本実施形態に係るゲームアプリケーションが実行されている際に、ユーザによって所望の単位ゲームの実行が指示されたときに開始される処理フローである。当該処理フローは、プロセッサ112がメモリ113に記憶された指示命令(プログラム)を読み出して実行することにより行われる。

図6は、本開示の第1実施形態に係る端末装置100において実行される処理フローを示す図である。具体的には、図6に記載の処理フローは、本実施形態に係るゲームアプリケーションが実行されている際に、ユーザによって所望の単位ゲームの実行が指示されたときに開始される処理フローである。当該処理フローは、プロセッサ112がメモリ113に記憶された指示命令(プログラム)を読み出して実行することにより行われる。

図6によると、プロセッサ112は、ユーザによって単位ゲームの実行が指示されると、単位ゲームを構成する盤面11に複数の基本オブジェクト13を配置して表示するようディスプレイを制御する(S201)。そして、ユーザによる基本オブジェクト13の選択操作及び選択された基本オブジェクト13aの移動操作が可能な状態になると、タイマー114を利用して計時を開始する(S202)。

次に、タッチパネル117において、ユーザによる、複数の基本オブジェクト13のうちの一つの基本オブジェクト13aを選択する指示入力(タップ操作)、及びその選択された基本オブジェクト13aをタップしたまま盤面11上の任意の位置に移動させる指示入力(ドラッグ操作)が受け付けられると、プロセッサ112は、選択された基本オブジェクト13aの移動処理を実行する(S203)。次に、プロセッサ112は、移動先の位置に結合オブジェクト17が配置されているか否かを判断する(S204)。そして、その判断の結果、結合オブジェクト17が配置されていない場合には、移動先の位置にもともと配置されていた他の基本オブジェクトの移動処理を行う(S205)。なお、S204で結合オブジェクト17が配置されている場合の処理については後述する。

図7は、本開示の第1実施形態に係る端末装置100のディスプレイ111に表示される画面の例を示す図である。具体的には、図7は、図6のS203に係る処理によって、盤面11に配置された複数の基本オブジェクト13の中から一の基本オブジェクト13aが選択され移動が開始された時の画面の例を示す。図7によると、ディスプレイ111上に、盤面11及び基本オブジェクト13に加えて、現在獲得している得点15、及び実行中の単位ゲームを実行可能な残り時間を示すタイムバー14が表示される。

そして、ユーザの指12によって基本オブジェクト13aの表示位置に対応するタッチパネル上の位置をタップすると、基本オブジェクト13aが選択される。そして、指12によるタップを解除することなく、そのまま任意の方向に指12をドラッグすると、それに追従して選択された基本オブジェクト13aが、もともと配置されていた位置16aから移動を開始する。そして、選択された基本オブジェクト13aが他の基本オブジェクトの表示位置に重畳すると、他の基本オブジェクトが基本オブジェクト13aのもともと配置されていた位置16aにずれるように移動される。

図8aは、本開示の第1実施形態に係るアプリケーションにおける基本オブジェクト13の移動を概念的に示す図である。具体的には、図8aは、盤面11の一部を拡大したものである。図8aは、図6のS203~S205に係る処理によって、選択された基本オブジェクト13aが左方向に移動されることに追従して、他の基本オブジェクト13b及び13cが新たな位置にスライドして配置される様子を示す。図8aによると、指12によって基本オブジェクト13aが選択され左方向にドラッグされると、もともと配置されていた位置16aから移動を開始する。そして、選択された基本オブジェクト13aが基本オブジェクト13bの表示領域に重畳して表示された状態になると、重畳された基本オブジェクト13bはもともと基本オブジェクト13aが配置されていた位置16aにスライドされる。さらに選択された基本オブジェクト13aが左方向に移動して基本オブジェクト13cの表示領域に重畳して表示された状態になると、重畳された基本オブジェクト13cはスライドさせられた基本オブジェクト13bがもともと配置されていた位置にスライドされる。

図8aにおいては、左方向に選択された基本オブジェクト13aを移動させる場合について説明したが、右方向に移動させる場合も同様である。

図8bは、本開示の第1実施形態に係るアプリケーションにおける基本オブジェクト13の移動を概念的に示す図である。具体的には、図8bは、盤面11の一部を拡大したものである。図8bは、図6のS203~S205に係る処理によって、選択された基本オブジェクト13aが下方向に移動されることに追従して、他の基本オブジェクト13d及び13eが新たな位置にスライドして配置される様子を示す。図8bによると、指12によって基本オブジェクト13aが選択され下方向にドラッグされると、もともと配置されていた位置16aから移動を開始する。そして、選択された基本オブジェクト13aが基本オブジェクト13dの表示領域に重畳して表示された状態になると、重畳された基本オブジェクト13dはもともと基本オブジェクト13aが配置されていた位置16aにスライドされる。さらに選択された基本オブジェクト13aが下方向に移動して基本オブジェクト13eの表示領域に重畳して表示された状態になると、重畳された基本オブジェクト13eはスライドさせられた基本オブジェクト13dがもともと配置されていた位置にスライドされる。

図8bにおいては、下方向に選択された基本オブジェクト13aを移動させる場合について説明したが、上方向に移動させる場合も同様である。

なお、図8a及び図8bにおいて、上下左右に基本オブジェクト13aが移動される場合について説明したが、斜め方向など任意の方向に移動可能にした場合も同様の処理をすることが可能である。

再び図6に戻り、プロセッサ112は、図7、図8a及び図8bに示す基本オブジェクト13aの移動処理、及び他の基本オブジェクトの移動処理がなされた結果、同じ属性情報を有する基本オブジェクトが複数連続して配置されるか否かを判断する(S207)。複数連続して配置されない場合には、そのまま各基本オブジェクトを移動して配置し、S209へ移行する。一方、複数連続して配置されることになる場合には、プロセッサ112は、その連続して配置される基本オブジェクトの配置位置に結合オブジェクトを表示するための処理を行う(S208)。

なお、S207において、プロセッサ112は同じ属性情報を有するか否を判断した。しかし、これに限らず複数連続して配置される基本オブジェクトに対応付けられた各属性情報が、所定の関係を有しているか否かを判断すればよい。例えば、「青」属性と「赤」属性、「黄」属性と「緑」属性、「黒」属性と「白」属性の組み合わせで所定の関係が成立すること予め決めた場合には、それにしたがって判断するようにしてもよい。

図9a及び図9bは、本開示の第1実施形態に係るアプリケーションにおけるオブジェクトの配置を概念的に示す図である。具体的には、図9a及び図9bは、図6のS205~S208に係る処理によって、結合オブジェクトの表示処理がなされたときに結合オブジェクト17が表示される様子を示す。

図9aによると、指12によって選択された基本オブジェクト13aが左方向に移動されることによって、位置16bに配置されていた基本オブジェクト13fが右方向にスライドして配置される。そうすると、基本オブジェクト13fと基本オブジェクト13gは、ともに同じ属性情報(例えば、「赤」属性)を有しているので、同じ属性情報を有する基本オブジェクトが複数連続して配置されることとなる。

その場合、本実施形態においては、図9bに示すように、連続して配置される基本オブジェクト13f及び13gとは形状の異なる結合オブジェクト17aが盤面11上に表示される。この結合オブジェクト17aは、連続して配置される基本オブジェクト13f及び13gの表示位置に表示される。本実施形態では、特に、基本オブジェクト13f及び13gに置き換えて、結合オブジェクト17aが表示される。

なお、結合オブジェクト17aの表示態様は、図9bに示す例に限らず、連続する基本オブジェクト13f及び13gが視認可能なように、各基本オブジェクトに重畳して表示してもよい。また、結合オブジェクト17aの表示位置も、基本オブジェクト13f及び13gの表示位置に対応していればよい。すなわち、各基本オブジェクト全体を覆うように結合オブジェクト17aが表示される必要はなく、その一部の領域のみに表示されてもよい。

再び図6に戻り、図9a及び図9bに示す結合オブジェクトの表示処理がなされると、プロセッサ112はユーザによるドラッグ操作が終了したか否か、すなわち選択された基本オブジェクト13aの表示位置に対応するタッチパネル上の位置から指12が離されたか否かを判断する(S209)。ドラッグ操作が終了していないと判断された場合には、引き続き選択された基本オブジェクト13aの移動が継続しているので、再度S203~S209の処理を繰り返す。

ここで、S204において、選択された基本オブジェクト13aの移動先の位置に結合オブジェクト17が配置されている場合の処理について説明する。この場合、プロセッサ112は、移動先の結合オブジェクトを個々の基本オブジェクトに分解し、個々の基本オブジェクトをそれぞれ所定の位置に移動するよう処理する(S206)

図10a及び図10bは、本開示の第1実施形態に係るアプリケーションにおけるオブジェクトの配置を概念的に示す図である。具体的には、図10a及び図10bは、図6のS206に係る処理によって、結合オブジェクト17が分解され、個々の基本オブジェクトがそれぞれ所定の位置に移動する様子を示す。

図10aによると、位置16aから選択された基本オブジェクト13aが右方向に移動したとき、その移動先には結合オブジェクト17aが既に表示されている。図10bによると、結合オブジェクト17aの表示領域に選択された基本オブジェクト13aが移動すると、表示されていた結合オブジェクト17aが基本オブジェクト13h及び13iに分解される。このとき、基本オブジェクト13hについては、既にその表示領域に選択された基本オブジェクト13aが移動しているので、もともと選択された基本オブジェクト13aが表示されていた位置16aにスライドして配置される。一方、結合オブジェクト17aの表示位置に対応する位置に、移動してきた基本オブジェクト13a及び基本オブジェクト13iが表示される。つまり、図10a及び図10bに示すように結合オブジェクトの表示態様を変化させることで、同じ属性を有する基本オブジェクトが複数連続して配置されているか否かをユーザが簡単に判断可能となる。

再び図6に戻り、S203~S209に係る処理が繰り返し行われ、S209においてドラッグ操作の終了が判断されると、プロセッサ112は選択された基本オブジェクト13aの移動を終了するとともに、表示されている結合オブジェクト17を盤面11から消去する処理を実行する(S210)。そして、プロセッサ112は、消去した結合オブジェクト17に応じて、ユーザに付与する得点を算出し、メモリ113内に記憶されたユーザの得点情報を算出された得点に基づいて更新する処理をする(S211)。なお、S210において基本オブジェクト13aの移動の終了をドラッグ操作の終了、すなわち指12が離されたか否かで判断したが、操作した指が盤面11の外に出たか否か、盤面11上に配置された操作阻害オブジェクトと接触したか否か、操作中に操作制限時間に達したか否か等の条件に置き換えるか、適宜組み合わせることも可能である。

次に、プロセッサ112は、S202でタイマー114による計時を開始してから所定時間が経過したか否かを判断する(S212)。そして、所定時間が経過していない場合には、再度盤面11上の基本オブジェクト13の選択とその移動が可能であるので、盤面11に基本オブジェクト13の再配置処理を行う(S214)。

図11a~図11cは、本開示の第1実施形態に係るアプリケーションにおけるオブジェクトの配置を概念的に示す図である。具体的には、図11a~図11cは、図6のS209~S214に係る処理によって、ドラッグ操作の終了が検出により結合オブジェクト17が盤面11から消去され、基本オブジェクト13の再配置が行われる様子を示す。

図11aによると、指12によって選択された基本オブジェクト13aを、軌跡19に沿って、位置16aから位置16cまで移動したのち、指12が基本オブジェクト13aから離されてドラッグ操作が終了している。その間、基本オブジェクト13aの移動に追従して、他の基本オブジェクトが順次移動されるとともに、結合オブジェクト17b、17c及び17dが表示されている(すなわち、基本オブジェクト13aが移動する間、図6のS203~S209が繰り返し実行されている)。

そして、図11bに示す通り、タッチパネル117でドラッグ操作が終了を検出すると、表示された結合オブジェクト17b、17c及び17dを盤面11から消去する。このとき、図6のS211で説明したとおり、消去された結合オブジェクト17に応じてユーザに得点が付与される。なお、この得点は、消去された結合オブジェクト17の数に応じてより多くの得点が付与されるようにしてもよい。また、消去された結合オブジェクト17の面積が大きければ大きいほど、より多くの得点が付与されるようにしてもよい。また、消去された結合オブジェクト17の属性に応じて、付与される得点が異なるようにしてもよい。

そして、図11cに示す通り、結合オブジェクト17が消去されたあとの位置16d~16jには、プロセッサ112によって任意の基本オブジェクト13が再配置される。なお、消去された各位置16d~16jに、予め表示されている基本オブジェクト13を順次スライドして表示させ、その後いずれの基本オブジェクト13も配置されていない位置に任意の基本オブジェクトを再配置するようにしてもよい。

再び図6に戻り、S212において所定の時間の経過が検出された場合、すなわち図7に示すタイムバー14の残り時間を示す領域がゼロになった場合は、プロセッサ112は実行していた単位ゲームの終了がユーザにより選択されたか否かを判断する。終了が選択されていない場合は、プロセッサ112は、再度S201から処理を開始する。一方、終了が選択された場合には、プロセッサ112は、単位ゲームの実行処理を終了し、図5のS105に移行する。

なお、図6のS203~S209、図9a、図9b、及び図11a~11cにおいて、結合オブジェクト17の表示について説明したが、選択された基本オブジェクト13aが移動した軌跡によっては、その移動の過程で既に表示された結合オブジェクトと同じ属性情報を有する基本オブジェクト13が連続して配置されることもありうる。

図12は、本開示の第1実施形態に係るアプリケーションにおける結合オブジェクト17の表示を概念的に示す図である。具体的には、図12は、選択された基本オブジェクト13aが移動する過程で、既に表示された結合オブジェクト17kの表示領域が右方向に拡大して表示される様子を示す。図12によると、基本オブジェクト13aがその移動の過程で上方向に移動したことによって基本オブジェクト13mがもともと表示されていた位置16hに重畳して表示されることになる。その結果、基本オブジェクト13mが下方向にスライドする。それにより、既に表示されていた結合オブジェクト17kと同じ属性情報を有する基本オブジェクト13mとが連続して配置されることになる。このような場合には、基本オブジェクト13mの配置位置に対応する位置に結合オブジェクト17kを拡大して表示する。

以上、本実施形態においては、特に図6からも明らかなとおり、ドラッグ操作が継続している間、基本オブジェクト13の移動と結合オブジェクト17の表示がなされ、ドラッグ操作が終了すると、結合オブジェクト17が盤面11から消去される。そして、その消去された結合オブジェクトに応じて、ユーザ又はユーザが操作可能なゲームキャラクタに対して所定の効果が付与される。このとき、消去されるオブジェクトを、通常の基本オブジェクト13とは形状等を異ならせて表示しているので、消去されるオブジェクトをユーザが簡単に判別することが可能となる。また、このように表示することによって、盤面11上に表示される複数のオブジェクトの描画をまとめて一つに統合することになるため、メモリの負荷軽減や処理速度の向上に寄与することが可能となる。

<第2実施形態>

第1実施形態では、ユーザ又はユーザが操作可能なゲームキャラクタに付与する効果として、消去された結合オブジェクト17に応じた「得点」を付与する場合について説明した。第2実施形態では、ユーザ又はユーザが操作可能なゲームキャラクタに付与する効果として、対戦ゲームにおける敵キャラクタへのダメージを付与する。なお、本実施形態は、以下で具体的に説明する点を除いて、第1実施形態における構成、処理、手順と同様である。したがって、それらの事項の詳細な説明は省略する。

第1実施形態では、ユーザ又はユーザが操作可能なゲームキャラクタに付与する効果として、消去された結合オブジェクト17に応じた「得点」を付与する場合について説明した。第2実施形態では、ユーザ又はユーザが操作可能なゲームキャラクタに付与する効果として、対戦ゲームにおける敵キャラクタへのダメージを付与する。なお、本実施形態は、以下で具体的に説明する点を除いて、第1実施形態における構成、処理、手順と同様である。したがって、それらの事項の詳細な説明は省略する。

図13は、本開示の第2実施形態に係る端末装置100のディスプレイ111に表示される画面の例を示す図である。具体的には、図13は、盤面11から結合オブジェクトが消去され、その消去された結合オブジェクトに応じた攻撃力で、ユーザが操作可能なゲームキャラクタ20が敵キャラクタ21にダメージを与える様子を示す。

ここで、各ゲームキャラクタ及び敵キャラクタには、予め対応付けて攻撃力や防御力のパラメータ値が記憶されている。結合オブジェクト17b、17c及び17dが消去されると、例えば、その消去された結合オブジェクトの属性情報、ゲームキャラクタ20の攻撃力、及び敵キャラクタ21の防御力に基づいて、敵キャラクタ21に与えるダメージを算出する。図13の例においては、150のダメージを敵キャラクタ21に対して与えるという効果が付与され、これによって敵キャラクタ21のヒットポイントパラメータから150ダメージ減算させることができる。

なお、本実施形態においては、敵キャラクタへのダメージを効果の一例として挙げたが、一時的な攻撃力の向上や防御力の向上などもその効果の例として挙げることが可能である。

<第3実施形態>

第1及び第2実施形態では、盤面11上に、4×4の格子状に基本オブジェクト13が配置される場合について説明した。第3実施形態では、格子状ではなく、盤面11上の任意の位置に基本オブジェクト13が配置される。なお、本実施形態は、以下で具体的に説明する点を除いて、第1及び第2実施形態における構成、処理、手順と同様である。したがって、それらの事項の詳細な説明は省略する。

第1及び第2実施形態では、盤面11上に、4×4の格子状に基本オブジェクト13が配置される場合について説明した。第3実施形態では、格子状ではなく、盤面11上の任意の位置に基本オブジェクト13が配置される。なお、本実施形態は、以下で具体的に説明する点を除いて、第1及び第2実施形態における構成、処理、手順と同様である。したがって、それらの事項の詳細な説明は省略する。

図14は、本開示の第3実施形態に係るアプリケーションにおけるオブジェクトの配置を概念的に示す図である。具体的には、図14は、任意の位置に各基本オブジェクト13が配置された盤面11上を、選択された基本オブジェクト13aが移動する様子を示す。図14によると、選択された基本オブジェクト13aが、軌跡19に沿って、位置16dから位置16eまで指12のドラッグ操作によって移動されている。選択された基本オブジェクト13aの移動に追従して、他の基本オブジェクトが順次移動される。そして、その移動によって、同じ属性を有する基本オブジェクト13が複数連続して配置(又は隣り合って配置)される場合には、それらの表示位置に結合オブジェクト17e~17hが表示される。このとき、各結合オブジェクト17e~17hの形状や大きさは、連続して配置される基本オブジェクトの個数やその位置関係に応じて決めることが可能である。

<第4実施形態>

第1~第3実施形態では、同じ属性を有する2個以上の基本オブジェクトが連続して配置される場合に結合オブジェクト17を表示した。第4実施形態では、3個以上の基本オブジェクトが連続して配置される場合にのみ結合オブジェクトを表示するようにした。なお、本実施形態は、以下で具体的に説明する点を除いて、第1実施形態における構成、処理、手順と同様である。したがって、それらの事項の詳細な説明は省略する。

第1~第3実施形態では、同じ属性を有する2個以上の基本オブジェクトが連続して配置される場合に結合オブジェクト17を表示した。第4実施形態では、3個以上の基本オブジェクトが連続して配置される場合にのみ結合オブジェクトを表示するようにした。なお、本実施形態は、以下で具体的に説明する点を除いて、第1実施形態における構成、処理、手順と同様である。したがって、それらの事項の詳細な説明は省略する。

図15は、本開示の第4実施形態に係るアプリケーションにおけるオブジェクトの配置を概念的に示す図である。具体的には、図15は、複数の基本オブジェクト13が表示された盤面11上を、指12によって選択された基本オブジェクト13aが移動する様子を示す。図15によると、選択された基本オブジェクト13aが、軌跡19に沿って、位置16fから位置16gまで指12のドラッグ操作によって移動されている。選択された基本オブジェクト13aの移動に追従して、他の基本オブジェクトが順次移動される。そして、その移動によって、同じ属性を有する基本オブジェクト13が3個以上連続して配置される場合には、それらの表示位置に結合オブジェクト17i及び17jが表示される。このとき、例えば基本オブジェクト13j及び13k、基本オブジェクト13l及び13mに着目すると、同じ属性を有する基本オブジェクトが2個連続して配置されているが、3個以上連続して配置されていないため、結合オブジェクト17がそれらの表示位置に表示されていない。

なお、各実施形態で説明した各要素を適宜組み合わせるか、それらを置き換えてシステムを構成することも可能である。

また、第2~第4実施形態においても、第1実施形態と同様の効果を奏することが可能である。

本明細書で説明される処理及び手順は、実施形態において明示的に説明されたものによってのみならず、ソフトウェア、ハードウェア又はこれらの組み合わせによっても実現可能である。具体的には、本明細書で説明された処理及び手順は、集積回路、揮発性メモリ、不揮発性メモリ、磁気ディスク、光ストレージ等の媒体に、当該処理に相当するロジックを実装することによって実現される。また、本明細書で説明される処理及び手順は、それらの処理・手順をコンピュータプログラムとして実装し、端末装置やサーバ装置を含む各種のコンピュータに実行させることが可能である。

本明細書中で説明される処理及び手順が単一の装置、ソフトウェア、コンポーネント、モジュールによって実行される旨が説明されたとしても、そのような処理又は手順は、複数の装置、複数のソフトウェア、複数のコンポーネント、及び/又は、複数のモジュールによって実行されるものとすることができる。また、本明細書中で説明される各種情報が単一のメモリや記憶部に格納される旨が説明されたとしても、そのような情報は、単一の装置に備えられた複数のメモリ又は複数の装置に分散して配置された複数のメモリに分散して格納されるものとすることができる。さらに、本明細書において説明されるソフトウェアおよびハードウェアの要素は、それらをより少ない構成要素に統合して、又は、より多い構成要素に分解することによって実現されるものとすることができる。

100 端末装置

200 サーバ装置

300 ネットワーク

200 サーバ装置

300 ネットワーク

Claims (13)

- 複数の第1オブジェクトと、前記第1オブジェクトが配置された盤面とを表示するように構成されたディスプレイと、

所定の指示命令と、前記第1オブジェクトを含むオブジェクトの属性情報とを記憶するように構成されたメモリと、

前記複数の第1オブジェクトのうちの一つの第1オブジェクトを選択し、前記盤面上の任意の位置に選択された前記第1オブジェクトを移動させるためのユーザによる指示入力を受け付けるように構成された入力インターフェイスと、

選択された前記第1オブジェクトを前記指示入力に基づいて移動させることによって、前記属性情報が所定の関係を有する第1オブジェクトが複数連続して配置される場合には、連続する前記第1オブジェクトとは異なる第2オブジェクトを、連続する前記第1オブジェクトの配置位置に対応する位置に表示するための処理をするように構成されたプロセッサと、

を含む端末装置。 - 前記所定の関係は、連続する前記第1オブジェクトが同じ属性情報を有する関係である、請求項1に記載の端末装置。

- 前記プロセッサは、前記第2オブジェクトを連続する前記第1オブジェクトに置き換えて表示する、請求項1又は2に記載の端末装置。

- 前記プロセッサは、前記第2オブジェクトの表示位置に選択された前記第1オブジェクトが移動した場合には、前記第2オブジェクトの表示位置に対応する位置に、前記複数の第1オブジェクトのうちのいずれかを表示させる、請求項1~3のいずれかに記載の端末装置。

- 前記第2オブジェクトは、前記第1オブジェクトが3個以上連続して配置される場合に表示される、請求項1~4のいずれかに記載の端末装置。

- 前記プロセッサは、前記移動によって前記属性情報が所定の関係を有する第1オブジェクトと前記第2オブジェクトとが連続して配置される場合には、前記第2オブジェクトを、所定の関係を有する前記第1オブジェクトに対応する位置に拡大して表示するための処理をする、請求項1~5のいずれかに記載の端末装置。

- 前記入力インターフェイスはタッチパネルであり、

前記選択は、前記複数の第1オブジェクトのうち一つの第1オブジェクトの表示位置に対応する前記タッチパネル上の位置をタップすることによってなされ、

前記移動は、前記タッチパネル上をドラッグすることによってなされる、

請求項1~6のいずれかに記載の端末装置。 - 前記入力インターフェイス上でのドラッグの終了を検出すると、前記移動を終了する、請求項7に記載の端末装置。

- 前記プロセッサは、前記移動が終了すると、表示された第2オブジェクトを消去する、請求項1~8のいずれかに記載の端末装置。

- 前記プロセッサは、消去された前記第2オブジェクトに応じて所定の効果を前記ユーザ又は前記ユーザが操作可能なゲームキャラクタに付与する、請求項9に記載の端末装置。

- 前記プロセッサは、消去された前記第2オブジェクトの面積に応じてより大きな効果を付与する、請求項10に記載の端末装置。

- 複数の第1オブジェクトと前記第1オブジェクトが配置された盤面とを表示するように構成されたディスプレイと、所定の指示命令と前記第1オブジェクトを含むオブジェクトの属性情報とを記憶するように構成されたメモリと、前記複数の第1オブジェクトのうちの一つの第1オブジェクトを選択し、前記盤面上の任意の位置に選択された前記第1オブジェクトを移動させるためのユーザによる指示入力を受け付けるように構成された入力インターフェイスと、を含むコンピュータを、

選択された前記第1オブジェクトを前記指示入力に基づいて移動させることによって、前記属性情報が所定の関係を有する第1オブジェクトが複数連続して配置される場合には、連続する前記第1オブジェクトとは異なる第2オブジェクトを、連続する前記第1オブジェクトの配置位置に対応する位置に表示するための処理をするプロセッサ、

として機能させるプログラム。 - 複数の第1オブジェクトと前記第1オブジェクトが配置された盤面とを表示するように構成されたディスプレイと、所定の指示命令と前記第1オブジェクトを含むオブジェクトの属性情報とを記憶するように構成されたメモリと、前記複数の第1オブジェクトのうちの一つの第1オブジェクトを選択し、前記盤面上の任意の位置に選択された前記第1オブジェクトを移動させるためのユーザによる指示入力を受け付けるように構成された入力インターフェイスと、を含む端末装置において、プロセッサが前記指示命令を実行することによりなされる方法であって、

選択された前記第1オブジェクトを前記指示入力に基づいて移動させることによって、前記属性情報が所定の関係を有する第1オブジェクトが複数連続して配置される場合には、連続する前記第1オブジェクトとは異なる第2オブジェクトを、連続する前記第1オブジェクトの配置位置に対応する位置に表示するための処理をする段階と、

を含む方法。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017552114A JP6726208B2 (ja) | 2017-10-02 | 2017-10-02 | 端末装置、プログラム及び方法 |

| PCT/JP2017/035769 WO2019069342A1 (ja) | 2017-10-02 | 2017-10-02 | 端末装置、プログラム及び方法 |

| US15/883,245 US10786730B2 (en) | 2017-10-02 | 2018-01-30 | Terminal device for game application using various objects with object attribute information |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2017/035769 WO2019069342A1 (ja) | 2017-10-02 | 2017-10-02 | 端末装置、プログラム及び方法 |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| US15/883,245 Continuation US10786730B2 (en) | 2017-10-02 | 2018-01-30 | Terminal device for game application using various objects with object attribute information |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2019069342A1 true WO2019069342A1 (ja) | 2019-04-11 |

Family

ID=65896376

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2017/035769 WO2019069342A1 (ja) | 2017-10-02 | 2017-10-02 | 端末装置、プログラム及び方法 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US10786730B2 (ja) |

| JP (1) | JP6726208B2 (ja) |

| WO (1) | WO2019069342A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2021220554A1 (ja) * | 2020-05-01 | 2021-11-04 | 株式会社ポケモン | ゲームシステム、ゲーム方法、ゲームプログラム、及びゲームサーバ |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6970712B2 (ja) * | 2019-06-14 | 2021-11-24 | 任天堂株式会社 | 情報処理プログラム、情報処理装置、情報処理システム、及び情報処理方法 |

| JP6731536B1 (ja) * | 2019-10-31 | 2020-07-29 | グリー株式会社 | ゲーム装置、制御方法、及び制御プログラム |

| CN112107854B (zh) * | 2020-09-01 | 2021-03-16 | 苏州紫焰网络科技有限公司 | 一种游戏任务引导完成方法、系统及设备 |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008246076A (ja) * | 2007-03-30 | 2008-10-16 | Sega Corp | ゲーム装置およびゲームプログラム |

| JP5755785B1 (ja) * | 2014-07-25 | 2015-07-29 | ガンホー・オンライン・エンターテイメント株式会社 | 端末装置 |

| JP2015167707A (ja) * | 2014-03-07 | 2015-09-28 | 株式会社コナミデジタルエンタテインメント | 情報処理装置、プログラム |

| US20160089603A1 (en) * | 2014-09-30 | 2016-03-31 | King.Com Limited | Controlling a display of a computer device |

| US20160139773A1 (en) * | 2014-11-17 | 2016-05-19 | Supercell Oy | Electronic device for facilitating user interactions |

Family Cites Families (26)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8177622B2 (en) * | 2004-12-20 | 2012-05-15 | Wms Gaming Inc. | Wagering game with background modification feature |

| JP4773159B2 (ja) * | 2005-08-19 | 2011-09-14 | 任天堂株式会社 | ゲームプログラム、ゲーム装置およびゲーム制御方法 |

| US8317581B2 (en) * | 2008-05-01 | 2012-11-27 | Canned Bananas Llc | Puzzle game |

| US9120010B2 (en) * | 2009-12-03 | 2015-09-01 | Megatouch, Llc | Touchscreen game allowing simultaneous movement of multiple rows and/or columns |

| JP5498817B2 (ja) * | 2010-02-26 | 2014-05-21 | 任天堂株式会社 | ゲームプログラムおよびゲーム装置 |

| WO2012135843A1 (en) * | 2011-03-31 | 2012-10-04 | Tetris Holding, Llc | Systems and methods for manipulation of objects |

| US20130331162A1 (en) * | 2012-06-12 | 2013-12-12 | Alexander Higgins Krivicich | Match three gaming system and method |

| US20140171166A1 (en) * | 2012-12-17 | 2014-06-19 | Naftali Merari | Controlling a movement of a plurality of graphical objects in a tile-matching puzzle |

| US9079097B2 (en) * | 2013-02-19 | 2015-07-14 | King.Com Ltd. | Video game with replaceable tiles having selectable physics |

| US9333421B2 (en) * | 2013-02-19 | 2016-05-10 | Funkitron, Inc. | Systems and methods for a token match game |

| JP2014184058A (ja) * | 2013-03-25 | 2014-10-02 | Square Enix Co Ltd | ビデオゲーム処理装置、及びビデオゲーム処理プログラム |

| US20140342791A1 (en) * | 2013-03-29 | 2014-11-20 | Rekkener Llc | Interactive electronic game of pattern matching |

| US20140302935A1 (en) * | 2013-04-04 | 2014-10-09 | DeNA Co. Ltd. | Turn timer system applied to a puzzle battle game |

| JP5457590B1 (ja) * | 2013-06-14 | 2014-04-02 | 株式会社 ディー・エヌ・エー | ゲーム提供システム、ゲーム提供プログラム及びゲーム提供方法 |

| JP5559920B1 (ja) * | 2013-09-30 | 2014-07-23 | 株式会社 ディー・エヌ・エー | サーバ装置、電子ゲーム装置及び電子ゲームプログラム |

| JP5646094B1 (ja) * | 2014-02-24 | 2014-12-24 | グリー株式会社 | ゲーム処理プログラム、ゲーム処理コンピュータ及びゲーム処理方法 |

| US9757646B2 (en) * | 2014-05-06 | 2017-09-12 | King.Com Ltd. | Selecting objects on a user interface based on angle of trajectory of user input |

| JP5724026B1 (ja) * | 2014-08-29 | 2015-05-27 | グリー株式会社 | ゲームプログラム、コンピュータの制御方法、およびコンピュータ |

| US9713772B2 (en) * | 2014-09-30 | 2017-07-25 | King.Com Limited | Controlling a display of a computer device |

| KR20160064375A (ko) * | 2014-11-27 | 2016-06-08 | 라인플러스 주식회사 | 퍼즐 게임 시스템 및 퍼즐 게임 방법 |

| JP6605217B2 (ja) * | 2015-03-26 | 2019-11-13 | 株式会社バンダイナムコエンターテインメント | プログラム、端末及びサーバ |

| JP2016007530A (ja) | 2015-04-09 | 2016-01-18 | 株式会社 ディー・エヌ・エー | 電子ゲーム装置及び電子ゲームプログラム |

| KR101829969B1 (ko) * | 2016-01-26 | 2018-02-20 | 엔에이치엔엔터테인먼트 주식회사 | 퍼즐 매칭 게임 진행 방법 및 이를 이용하여 퍼즐 매칭 게임을 진행시키는 게임 시스템 |

| US10195534B2 (en) * | 2016-04-15 | 2019-02-05 | Perfect Square Studios LLC | Game mechanics for transformation of an array including a plurality of rows and/or columns |

| US10124263B2 (en) * | 2016-11-30 | 2018-11-13 | King.Com Ltd. | Turn based game with backtracking |