KR20190109579A - 비디오 인코딩 및 디코딩을 위한 적응형 전달 함수 - Google Patents

비디오 인코딩 및 디코딩을 위한 적응형 전달 함수 Download PDFInfo

- Publication number

- KR20190109579A KR20190109579A KR1020197027139A KR20197027139A KR20190109579A KR 20190109579 A KR20190109579 A KR 20190109579A KR 1020197027139 A KR1020197027139 A KR 1020197027139A KR 20197027139 A KR20197027139 A KR 20197027139A KR 20190109579 A KR20190109579 A KR 20190109579A

- Authority

- KR

- South Korea

- Prior art keywords

- transfer function

- video

- data

- bit

- video data

- Prior art date

Links

- 238000012546 transfer Methods 0.000 title abstract description 229

- 230000003044 adaptive effect Effects 0.000 title abstract description 76

- 238000000034 method Methods 0.000 claims abstract description 103

- 230000000007 visual effect Effects 0.000 abstract description 14

- 230000006870 function Effects 0.000 description 235

- 230000015654 memory Effects 0.000 description 84

- 230000002093 peripheral effect Effects 0.000 description 40

- 230000033001 locomotion Effects 0.000 description 36

- 238000004891 communication Methods 0.000 description 32

- 238000012545 processing Methods 0.000 description 30

- 230000008569 process Effects 0.000 description 19

- 238000013507 mapping Methods 0.000 description 15

- 238000013139 quantization Methods 0.000 description 15

- 238000005516 engineering process Methods 0.000 description 13

- 230000003287 optical effect Effects 0.000 description 11

- 238000010586 diagram Methods 0.000 description 8

- 238000003384 imaging method Methods 0.000 description 7

- 239000004744 fabric Substances 0.000 description 6

- 238000012986 modification Methods 0.000 description 6

- 230000004048 modification Effects 0.000 description 6

- 229920001690 polydopamine Polymers 0.000 description 4

- 241000023320 Luma <angiosperm> Species 0.000 description 3

- 230000005540 biological transmission Effects 0.000 description 3

- OSWPMRLSEDHDFF-UHFFFAOYSA-N methyl salicylate Chemical compound COC(=O)C1=CC=CC=C1O OSWPMRLSEDHDFF-UHFFFAOYSA-N 0.000 description 3

- 238000003672 processing method Methods 0.000 description 3

- 239000004065 semiconductor Substances 0.000 description 3

- 230000001360 synchronised effect Effects 0.000 description 3

- 230000002123 temporal effect Effects 0.000 description 3

- 230000016776 visual perception Effects 0.000 description 3

- 238000007792 addition Methods 0.000 description 2

- 238000013459 approach Methods 0.000 description 2

- 230000001413 cellular effect Effects 0.000 description 2

- 230000000295 complement effect Effects 0.000 description 2

- 238000001514 detection method Methods 0.000 description 2

- 239000000835 fiber Substances 0.000 description 2

- 230000006872 improvement Effects 0.000 description 2

- 239000004973 liquid crystal related substance Substances 0.000 description 2

- 229910044991 metal oxide Inorganic materials 0.000 description 2

- 150000004706 metal oxides Chemical class 0.000 description 2

- 229920000642 polymer Polymers 0.000 description 2

- 238000003825 pressing Methods 0.000 description 2

- 238000009877 rendering Methods 0.000 description 2

- 230000003068 static effect Effects 0.000 description 2

- 239000013598 vector Substances 0.000 description 2

- 238000012935 Averaging Methods 0.000 description 1

- 230000001133 acceleration Effects 0.000 description 1

- 230000009471 action Effects 0.000 description 1

- 230000003213 activating effect Effects 0.000 description 1

- 230000004913 activation Effects 0.000 description 1

- 230000006978 adaptation Effects 0.000 description 1

- 238000004458 analytical method Methods 0.000 description 1

- 238000003491 array Methods 0.000 description 1

- 230000000386 athletic effect Effects 0.000 description 1

- 230000006399 behavior Effects 0.000 description 1

- 230000008901 benefit Effects 0.000 description 1

- 239000000872 buffer Substances 0.000 description 1

- 230000008859 change Effects 0.000 description 1

- 238000006243 chemical reaction Methods 0.000 description 1

- 239000003795 chemical substances by application Substances 0.000 description 1

- 230000006835 compression Effects 0.000 description 1

- 238000007906 compression Methods 0.000 description 1

- 230000009849 deactivation Effects 0.000 description 1

- 230000004069 differentiation Effects 0.000 description 1

- 230000009977 dual effect Effects 0.000 description 1

- 210000005069 ears Anatomy 0.000 description 1

- 238000011156 evaluation Methods 0.000 description 1

- 230000010365 information processing Effects 0.000 description 1

- 230000000977 initiatory effect Effects 0.000 description 1

- 230000010354 integration Effects 0.000 description 1

- 230000003993 interaction Effects 0.000 description 1

- 238000002372 labelling Methods 0.000 description 1

- 238000010295 mobile communication Methods 0.000 description 1

- 238000003032 molecular docking Methods 0.000 description 1

- 230000006855 networking Effects 0.000 description 1

- 230000010076 replication Effects 0.000 description 1

- 230000004044 response Effects 0.000 description 1

- 230000011218 segmentation Effects 0.000 description 1

- 230000011664 signaling Effects 0.000 description 1

- 239000010454 slate Substances 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

- 229920000638 styrene acrylonitrile Polymers 0.000 description 1

- 239000000758 substrate Substances 0.000 description 1

- 238000010897 surface acoustic wave method Methods 0.000 description 1

- 230000007704 transition Effects 0.000 description 1

- 230000001755 vocal effect Effects 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/14—Coding unit complexity, e.g. amount of activity or edge presence estimation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/1454—Digital output to display device ; Cooperation and interconnection of the display device with other functional units involving copying of the display data of a local workstation or window to a remote workstation or window so that an actual copy of the data is displayed simultaneously on two or more displays, e.g. teledisplay

-

- G06T5/92—

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G3/00—Control arrangements or circuits, of interest only in connection with visual indicators other than cathode-ray tubes

- G09G3/20—Control arrangements or circuits, of interest only in connection with visual indicators other than cathode-ray tubes for presentation of an assembly of a number of characters, e.g. a page, by composing the assembly by combination of individual elements arranged in a matrix no fixed position being assigned to or needed to be assigned to the individual characters or partial characters

- G09G3/2007—Display of intermediate tones

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G5/00—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators

- G09G5/003—Details of a display terminal, the details relating to the control arrangement of the display terminal and to the interfaces thereto

- G09G5/005—Adapting incoming signals to the display format of the display terminal

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G5/00—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators

- G09G5/02—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators characterised by the way in which colour is displayed

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G5/00—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators

- G09G5/10—Intensity circuits

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N1/00—Scanning, transmission or reproduction of documents or the like, e.g. facsimile transmission; Details thereof

- H04N1/46—Colour picture communication systems

- H04N1/56—Processing of colour picture signals

- H04N1/60—Colour correction or control

- H04N1/6058—Reduction of colour to a range of reproducible colours, e.g. to ink- reproducible colour gamut

- H04N1/6063—Reduction of colour to a range of reproducible colours, e.g. to ink- reproducible colour gamut dependent on the contents of the image to be reproduced

- H04N1/6066—Reduction of colour to a range of reproducible colours, e.g. to ink- reproducible colour gamut dependent on the contents of the image to be reproduced dependent on the gamut of the image to be reproduced

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N1/00—Scanning, transmission or reproduction of documents or the like, e.g. facsimile transmission; Details thereof

- H04N1/46—Colour picture communication systems

- H04N1/64—Systems for the transmission or the storage of the colour picture signal; Details therefor, e.g. coding or decoding means therefor

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/124—Quantisation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/154—Measured or subjectively estimated visual quality after decoding, e.g. measurement of distortion

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/172—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a picture, frame or field

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/177—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a group of pictures [GOP]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/182—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a pixel

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/184—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being bits, e.g. of the compressed video stream

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/186—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a colour or a chrominance component

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/188—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a video data packet, e.g. a network abstraction layer [NAL] unit

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

- H04N19/33—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability in the spatial domain

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/44—Decoders specially adapted therefor, e.g. video decoders which are asymmetric with respect to the encoder

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/513—Processing of motion vectors

- H04N19/517—Processing of motion vectors by encoding

- H04N19/52—Processing of motion vectors by encoding by predictive encoding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

- H04N19/98—Adaptive-dynamic-range coding [ADRC]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/41—Structure of client; Structure of client peripherals

- H04N21/422—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS]

- H04N21/42202—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS] environmental sensors, e.g. for detecting temperature, luminosity, pressure, earthquakes

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/431—Generation of visual interfaces for content selection or interaction; Content or additional data rendering

- H04N21/4318—Generation of visual interfaces for content selection or interaction; Content or additional data rendering by altering the content in the rendering process, e.g. blanking, blurring or masking an image region

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/70—Circuitry for compensating brightness variation in the scene

- H04N23/741—Circuitry for compensating brightness variation in the scene by increasing the dynamic range of the image compared to the dynamic range of the electronic image sensors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/14—Picture signal circuitry for video frequency region

- H04N5/20—Circuitry for controlling amplitude response

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/44—Receiver circuitry for the reception of television signals according to analogue transmission standards

- H04N5/50—Tuning indicators; Automatic tuning control

- H04N5/505—Invisible or silent tuning

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/64—Circuits for processing colour signals

- H04N9/641—Multi-purpose receivers, e.g. for auxiliary information

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N9/00—Details of colour television systems

- H04N9/64—Circuits for processing colour signals

- H04N9/67—Circuits for processing colour signals for matrixing

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20172—Image enhancement details

- G06T2207/20208—High dynamic range [HDR] image processing

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/02—Improving the quality of display appearance

- G09G2320/0261—Improving the quality of display appearance in the context of movement of objects on the screen or movement of the observer relative to the screen

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/02—Improving the quality of display appearance

- G09G2320/0271—Adjustment of the gradation levels within the range of the gradation scale, e.g. by redistribution or clipping

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/0613—The adjustment depending on the type of the information to be displayed

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/0613—The adjustment depending on the type of the information to be displayed

- G09G2320/062—Adjustment of illumination source parameters

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/0626—Adjustment of display parameters for control of overall brightness

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/066—Adjustment of display parameters for control of contrast

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/0666—Adjustment of display parameters for control of colour parameters, e.g. colour temperature

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/0673—Adjustment of display parameters for control of gamma adjustment, e.g. selecting another gamma curve

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/0686—Adjustment of display parameters with two or more screen areas displaying information with different brightness or colours

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/0693—Calibration of display systems

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/08—Arrangements within a display terminal for setting, manually or automatically, display parameters of the display terminal

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/10—Special adaptations of display systems for operation with variable images

- G09G2320/103—Detection of image changes, e.g. determination of an index representative of the image change

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2340/00—Aspects of display data processing

- G09G2340/02—Handling of images in compressed format, e.g. JPEG, MPEG

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2360/00—Aspects of the architecture of display systems

- G09G2360/14—Detecting light within display terminals, e.g. using a single or a plurality of photosensors

- G09G2360/144—Detecting light within display terminals, e.g. using a single or a plurality of photosensors the light being ambient light

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2370/00—Aspects of data communication

- G09G2370/04—Exchange of auxiliary data, i.e. other than image data, between monitor and graphics controller

- G09G2370/042—Exchange of auxiliary data, i.e. other than image data, between monitor and graphics controller for monitor identification

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

- H04N19/463—Embedding additional information in the video signal during the compression process by compressing encoding parameters before transmission

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/85—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using pre-processing or post-processing specially adapted for video compression

- H04N19/86—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using pre-processing or post-processing specially adapted for video compression involving reduction of coding artifacts, e.g. of blockiness

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/41—Structure of client; Structure of client peripherals

- H04N21/422—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS]

- H04N21/4223—Cameras

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/44—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream, rendering scenes according to MPEG-4 scene graphs

- H04N21/44008—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream, rendering scenes according to MPEG-4 scene graphs involving operations for analysing video streams, e.g. detecting features or characteristics in the video stream

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/44—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream, rendering scenes according to MPEG-4 scene graphs

- H04N21/4402—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream, rendering scenes according to MPEG-4 scene graphs involving reformatting operations of video signals for household redistribution, storage or real-time display

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/442—Monitoring of processes or resources, e.g. detecting the failure of a recording device, monitoring the downstream bandwidth, the number of times a movie has been viewed, the storage space available from the internal hard disk

- H04N21/44213—Monitoring of end-user related data

- H04N21/44218—Detecting physical presence or behaviour of the user, e.g. using sensors to detect if the user is leaving the room or changes his face expression during a TV program

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/485—End-user interface for client configuration

- H04N21/4854—End-user interface for client configuration for modifying image parameters, e.g. image brightness, contrast

Abstract

신호 표현을 위한 코덱 내에서 내부적으로 적응형 전달 함수 방법을 구현하는 비디오 인코딩 및 디코딩 시스템이 개시된다. 인간의 시각적 시스템의 유효 동적 범위를 표현하는 포커스 동적 범위가, 입력 비디오의 각각의 장면, 시퀀스, 프레임 또는 구역에 대해 동적으로 결정될 수 있다. 비디오 데이터는, 코덱 내에서 인코딩을 위한 전달 함수에 따라 코덱의 비트 깊이로 크로핑 및 양자화될 수 있다. 전달 함수는, 입력 비디오 데이터의 전달 함수와 동일할 수 있거나 또는 코덱 내부의 전달 함수일 수 있다. 인코딩된 비디오 데이터는 디스플레이(들)의 동적 범위로 디코딩 및 확장될 수 있다. 적응형 전달 함수 방법은, 코덱이 출력에서 신호의 전체 동적 범위를 여전히 표현하면서 신호의 내부적 표현에 대해 더 적은 비트들을 이용할 수 있게 한다.

Description

본 개시내용은 일반적으로 디지털 비디오 또는 이미지 프로세싱 및 디스플레이에 관한 것이다.

퍼스널 컴퓨터 시스템들, 데스크탑 컴퓨터 시스템들, 랩탑 및 노트북 컴퓨터들, 태블릿 또는 패드 디바이스들, 디지털 카메라들, 디지털 비디오 레코더들, 및 모바일 폰들 또는 스마트 폰들을 포함하지만, 이에 제한되지 않는 다양한 디바이스들은 비디오 프로세싱 방법(들)을 구현할 수 있는 소프트웨어 및/또는 하드웨어를 포함할 수 있다. 예를 들어, 디바이스는 하나 이상의 비디오 프로세싱 방법들에 따라 하나 이상의 소스들로부터 입력된 디지털 비디오를 수신 및 프로세싱하고 프로세싱된 비디오 프레임들을 출력할 수 있는 장치(예를 들어, 집적 회로(IC), 예컨대, 시스템-온-어-칩(system-on-a-chip, SOC), 또는 IC의 서브시스템)를 포함할 수 있다. 다른 예시로서, 소프트웨어 프로그램은 하나 이상의 비디오 프로세싱 방법들에 따라 하나 이상의 소스들로부터 입력된 디지털 비디오를 수신 및 프로세싱하고, 프로세싱된 비디오 프레임들을 하나 이상의 목적지들에 출력할 수 있는 디바이스 상에서 구현될 수 있다.

예시로서, 비디오 인코더는, 비디오 인코딩 방법, 예를 들어, H.264 / 어드밴스드 비디오 코딩(AVC) 포맷 또는 H.265 고효율 비디오 코딩(HEVC) 포맷과 같은 압축된 비디오 포맷에 따라 디지털 비디오 입력이 다른 포맷으로 인코딩 또는 변환되는 장치 또는 대안적으로 소프트웨어 프로그램으로 구현될 수 있다. 다른 예시로서, 비디오 디코더는, AVC 또는 HEVC와 같은 압축된 비디오 포맷의 비디오가 수신되고, 비디오 디코딩 방법, 예를 들어, 디스플레이 디바이스에 의해 이용되는 디스플레이 포맷에 따라, 다른 (압축해제된) 포맷으로 디코딩 또는 변환되는 장치 또는 대안적으로 소프트웨어 프로그램으로 구현될 수 있다. H.264/AVC 표준은 ITU-T에 의하여, 표제가 "ITU-T Recommendation H.264: Advanced video coding for generic audiovisual services"인 문헌에 공개된다. H.265/HEVC 표준은 ITU-T에 의하여,표제가 "ITU-T Recommendation H.265: High Efficiency Video Coding"인 문헌에 공개된다.

많은 시스템들에서, 장치 또는 소프트웨어 프로그램은, 비디오 인코더 컴포넌트 및 비디오 디코더 컴포넌트 둘 모두를 구현할 수 있고; 이러한 장치 또는 프로그램은 통상적으로 코덱으로 지칭된다. 코덱은, 비디오 스트림의 시각적/이미지 데이터 및 오디오/사운드 데이터 둘 모두를 인코딩/디코딩할 수 있음을 주목한다.

일반적으로 정의되면, 동적 범위는, 사운드 및 광과 같은 신호들에서와 같이, 변경가능한 양의 최대 및 최소 가능 값들 사이의 비이다. 디지털 이미지 및 비디오 프로세싱에서, 확장된 또는 높은 동적 범위(HDR) 이미징은, (예를 들어, 디스플레이 스크린들 또는 디바이스들 상에 디스플레이되는) 전자 이미지들에서, 표준 디지털 이미징 기술 및 기법들(표준 동적 범위, 또는 SDR 이미징으로 지칭됨)을 이용하여 획득되는 것보다 더 넓은 범위의 휘도를 생성하는 기술 및 기법들을 지칭한다.

전자-광학 전달 함수(EOTF)는 디지털 코드 값들을 광 값들, 예를 들어, 휘도 값들에 맵핑할 수 있다. 통상적으로 광학-전기 전달 함수(OETF)로 지칭되는 인버스 프로세스는 광 값들을 전자/디지털 값들에 맵핑한다. EOTF들 및 OETF들은 총괄적으로 전달 함수들로 지칭될 수 있다. 휘도에 대한 SI 단위는, 평방 미터당 칸델라(cd/m2)이다. 동일 단위에 대한 비-SI 용어는 "NIT"이다. 표준 동적 범위(SDR) 이미징 시스템들에서, 인코딩/디코딩 시스템들 또는 코덱들의 인코딩 및 디코딩 프로세스들을 단순화하기 위해, 고정된 전달 함수들, 예를 들어, 고정된 멱함수-법칙 감마 전달 함수들이 비디오 이미지 컨텐츠의 내부적 표현에 대해 일반적으로 이용되어 왔다. 높은 동적 범위(HDR) 이미징 기술들, 시스템들 및 디스플레이들의 등장으로 인해, 더 유연한 전달 함수들에 대한 요구가 등장해 왔다.

비디오 인코딩 및 디코딩 시스템 또는 코덱 내에서 내부적으로 비디오 이미지 컨텐츠의 표현을 위한 적응형 전달 함수를 구현하는, 비디오 인코딩 및 디코딩 시스템들 및 방법들의 실시예들이 설명된다. 실시예들은, 이미지 데이터의 하나 이상의 특성들(예를 들어, 밝기, 텍스쳐 등)에 기초하여, 입력 비디오 내의 프레임의 현재의 장면, 시퀀스, 프레임 또는 구역에 대한 포커스 동적 범위를 동적으로 결정하고, 입력 비디오 동적 범위를 그 포커스 범위로 크로핑(crop)하고, 그 다음, 코덱에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수에 따라, 크로핑된 범위의 값들을 입력 비디오의 비트 깊이로부터 코덱의 비트 깊이로 대략적으로 맵핑(예를 들어, 양자화)할 수 있다.

실시예들에서, 코덱에서 입력 비디오 데이터 및 포커스 범위 비디오 데이터를 표현하기 위해, 다양한 전달 함수들이 이용될 수 있다. 일부 실시예들에서, 코덱에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수는, 입력 비디오 데이터를 표현하기 위해 이용되는 전달 함수와 동일할 수 있다. 일부 실시예들에서, 코덱에서 비디오 데이터를 표현하기 위해, 입력 비디오 데이터를 표현하기 위해 이용되는 전달 함수(1차 전달 함수로 지칭됨)과는 상이한 전달 함수(내부적 또는 2차 전달 함수로 지칭됨)이 이용될 수 있다.

실시예들에서, 장면, 시퀀스, 프레임 또는 구역에 대해 인코더에 의해 이용되는 포커스 범위, 전달 함수, 양자화 파라미터들 및 다른 포맷 정보는, 예를 들어, 출력 비트 스트림에 내장된 메타데이터에 의해 디코더 컴포넌트에 시그널링될 수 있다. 디코더에서, 인코딩된 비트 스트림은, 비디오의 장면들, 시퀀스들, 프레임들 또는 구역들에 대한 시그널링된 포커스 범위(들)에 따라, 높은 동적 범위(HDR)-가능 디스플레이와 같은 타겟 디바이스의 전체 동적 범위로 디코딩되고 동적으로 확장될 수 있다.

전달 함수를 입력 비디오 데이터에 동적으로 적응시킴으로써, 실시예들은, 비디오 데이터가, 입력 비디오 데이터를 표현하기 위해 이용되는 것보다 더 적은 비트들로 코덱에서 표현되도록 허용할 수 있는 한편, 코덱에 의해 출력되는 비디오 데이터가, HDR-가능 디스플레이들과 같은 HDR 디바이스들의 동적 범위를 채우도록 확장되도록 또한 허용할 수 있다. 적응형 전달 함수 방법의 실시예들은, 예를 들어, 비디오 인코딩 및 디코딩 시스템들이 코덱 내의 비디오 데이터의 내부적 표현 및 프로세싱에 대해서는 10개 이하의 비트들을 이용하게 하는 한편, HDR-가능 디스플레이들과 같은 HDR 디바이스들에 비디오를 출력하는 경우, 예를 들어, 12개 이상의 비트들을 이용하여 비디오 데이터의 확장된 또는 높은 동적 범위를 표현하게 할 수 있다. 따라서, 비디오 인코딩 및 디코딩 시스템들에 대한 적응형 전달 함수 방법의 실시예들은 구현을 단순화할 수 있고, 결과적으로, 특히 소비자 공간에서 HDR 기술의 채택을 단순화시킬 수 있다.

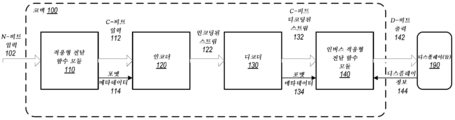

도 1은, 적응형 전달 함수의 실시예를 구현하는 예시적인 코덱 또는 비디오 인코딩 및 디코딩 시스템을 예시한다.

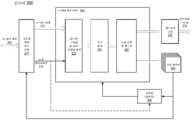

도 2는, 일부 실시예들에 따라, 비디오 입력 데이터에 적응형 전달 함수 방법을 적용하고, 인코딩된 비디오 데이터를 생성하는 예시적인 인코더를 예시한다.

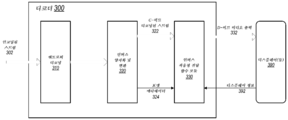

도 3은, 일부 실시예들에 따라, 디스플레이 포맷 비디오 데이터를 생성하기 위한 적응형 전달 함수 방법에 따라, 인코딩된 비디오 데이터를 디코딩하고, 디코딩된 비디오 데이터를 확장시키는 예시적인 디코더를 예시한다.

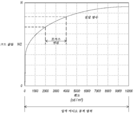

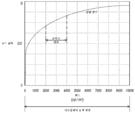

도 4는, 일부 실시예들에 따라, 입력 비디오 데이터에 대한 예시적인 전체 범위를 예시하고, 비디오 데이터에 대한 예시적인 포커스 범위를 도시한다.

도 5는, 일부 실시예들에 따라, C-비트 비디오 데이터를 생성하기 위한 포커스 범위 내에서 N-비트 입력 비디오 데이터를 맵핑하는 예를 예시한다.

도 6은, 일부 실시예들에 따라, 디바이스에 대한 D-비트 비디오 데이터를 생성하기 위해, C-비트 디코딩된 비디오를 HDR-가능 디바이스의 전체 동적 범위로 확장하는 예를 도식적으로 예시한다.

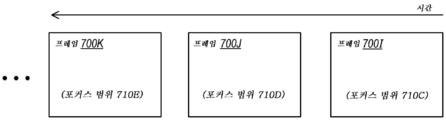

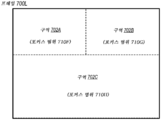

도 7a 내지 도 7c는, 적응형 전달 함수 방법의 실시예들에 따라, 비디오 시퀀스 또는 비디오 프레임의 상이한 부분들에 상이한 포커스 범위들을 적용하는 것을 도식적으로 예시한다.

도 8은, 일부 실시예들에 따라, 비디오 입력 데이터에 적응형 전달 함수 방법을 적용하고, 인코딩된 비디오 데이터를 생성하는 비디오 인코딩 방법의 흐름도이다.

도 9는, 일부 실시예들에 따라, 디스플레이 포맷 비디오 데이터를 생성하기 위한 적응형 전달 함수 방법에 따라, 인코딩된 비디오 데이터를 디코딩하고, 디코딩된 비디오 데이터를 확장시키는 비디오 디코딩 방법의 흐름도이다.

도 10은, 본원에서 설명되는 시스템들 및 방법들의 양상들을 구현하도록 구성될 수 있는 시스템 온 어 칩(SOC)의 일 실시예의 블록도이다.

도 11은, 하나 이상의 SOC들을 포함할 수 있는 시스템의 일 실시예의 블록도이다.

도 12는, 일부 실시예들에 따라, 본원에서 설명되는 시스템들 및 방법들의 양상들을 구현하도록 구성될 수 있는 예시적인 컴퓨터 시스템을 예시한다.

도 13은 일부 실시예들에 따른 휴대용 다기능 디바이스의 블록도를 예시한다.

도 14는 일부 실시예들에 따른 휴대용 다기능 디바이스를 도시한다.

본 발명이 다양한 수정들 및 대안적인 형태들이 가능하지만, 그의 특정 실시예들은 도면들에서 예시로 도시되고, 본 명세서에서 상세하게 기술될 것이다. 그러나, 본 명세서에 대한 도면들 및 상세한 설명이 개시된 특정 형태로 본 발명을 제한하는 것으로 의도되는 것이 아니라, 그와는 정반대로, 의도는 본 발명의 사상 및 범주 내에 속한 모든 수정들, 등가물들 및 대안들을 커버하기 위한 것임을 이해하여야 한다. 본 출원 전반에 걸쳐 사용되는 바와 같이, 단어 "일 수 있다(may)"는 의무적인 의미(즉, "이어야만 한다(must)"를 의미)라기보다 오히려 허용의 의미(즉, "~에 대해 가능성을 갖는다"는 의미)로 사용된다. 유사하게, 단어들 "포함하다(include)", "포함하는(including)", 및 "포함한다(includes)"는 포함하는 것을 의미하지만, 이에 제한되지 않는다.

다양한 유닛들, 회로들 또는 기타 컴포넌트들이 과제 또는 과제들을 수행하도록 "구성되는 것"으로 기술될 수 있다. 그러한 맥락에서, "~하도록 구성되는"은 동작 동안에 과제 또는 과제들을 수행하는 "회로를 가진"을 일반적으로 의미하는 구조의 광의의 설명이다. 이와 같이, 유닛/회로/컴포넌트는 유닛/회로/컴포넌트가 현재 온(on) 상태가 아닐 시에도 과제를 수행하도록 구성될 수 있다. 일반적으로, "~하도록 구성되는"에 대응하는 구조를 형성하는 회로는 하드웨어 회로들을 포함할 수 있다. 유사하게, 다양한 유닛들/회로들/컴포넌트들은 과제 또는 과제들을 수행할 시에 편의상 설명에 기술될 수 있다. 그러한 설명은 "~하도록 구성된"이라는 문구를 포함하는 것으로 해석되어야 한다. 하나 이상의 과제들을 수행하도록 구성된 유닛/회로/컴포넌트를 언급하는 것은 35 U.S.C. § 112, 6항의 유닛/회로/컴포넌트에 대한 해석을 적용하지 않고자 명백히 의도하는 것이다.

도 2는, 일부 실시예들에 따라, 비디오 입력 데이터에 적응형 전달 함수 방법을 적용하고, 인코딩된 비디오 데이터를 생성하는 예시적인 인코더를 예시한다.

도 3은, 일부 실시예들에 따라, 디스플레이 포맷 비디오 데이터를 생성하기 위한 적응형 전달 함수 방법에 따라, 인코딩된 비디오 데이터를 디코딩하고, 디코딩된 비디오 데이터를 확장시키는 예시적인 디코더를 예시한다.

도 4는, 일부 실시예들에 따라, 입력 비디오 데이터에 대한 예시적인 전체 범위를 예시하고, 비디오 데이터에 대한 예시적인 포커스 범위를 도시한다.

도 5는, 일부 실시예들에 따라, C-비트 비디오 데이터를 생성하기 위한 포커스 범위 내에서 N-비트 입력 비디오 데이터를 맵핑하는 예를 예시한다.

도 6은, 일부 실시예들에 따라, 디바이스에 대한 D-비트 비디오 데이터를 생성하기 위해, C-비트 디코딩된 비디오를 HDR-가능 디바이스의 전체 동적 범위로 확장하는 예를 도식적으로 예시한다.

도 7a 내지 도 7c는, 적응형 전달 함수 방법의 실시예들에 따라, 비디오 시퀀스 또는 비디오 프레임의 상이한 부분들에 상이한 포커스 범위들을 적용하는 것을 도식적으로 예시한다.

도 8은, 일부 실시예들에 따라, 비디오 입력 데이터에 적응형 전달 함수 방법을 적용하고, 인코딩된 비디오 데이터를 생성하는 비디오 인코딩 방법의 흐름도이다.

도 9는, 일부 실시예들에 따라, 디스플레이 포맷 비디오 데이터를 생성하기 위한 적응형 전달 함수 방법에 따라, 인코딩된 비디오 데이터를 디코딩하고, 디코딩된 비디오 데이터를 확장시키는 비디오 디코딩 방법의 흐름도이다.

도 10은, 본원에서 설명되는 시스템들 및 방법들의 양상들을 구현하도록 구성될 수 있는 시스템 온 어 칩(SOC)의 일 실시예의 블록도이다.

도 11은, 하나 이상의 SOC들을 포함할 수 있는 시스템의 일 실시예의 블록도이다.

도 12는, 일부 실시예들에 따라, 본원에서 설명되는 시스템들 및 방법들의 양상들을 구현하도록 구성될 수 있는 예시적인 컴퓨터 시스템을 예시한다.

도 13은 일부 실시예들에 따른 휴대용 다기능 디바이스의 블록도를 예시한다.

도 14는 일부 실시예들에 따른 휴대용 다기능 디바이스를 도시한다.

본 발명이 다양한 수정들 및 대안적인 형태들이 가능하지만, 그의 특정 실시예들은 도면들에서 예시로 도시되고, 본 명세서에서 상세하게 기술될 것이다. 그러나, 본 명세서에 대한 도면들 및 상세한 설명이 개시된 특정 형태로 본 발명을 제한하는 것으로 의도되는 것이 아니라, 그와는 정반대로, 의도는 본 발명의 사상 및 범주 내에 속한 모든 수정들, 등가물들 및 대안들을 커버하기 위한 것임을 이해하여야 한다. 본 출원 전반에 걸쳐 사용되는 바와 같이, 단어 "일 수 있다(may)"는 의무적인 의미(즉, "이어야만 한다(must)"를 의미)라기보다 오히려 허용의 의미(즉, "~에 대해 가능성을 갖는다"는 의미)로 사용된다. 유사하게, 단어들 "포함하다(include)", "포함하는(including)", 및 "포함한다(includes)"는 포함하는 것을 의미하지만, 이에 제한되지 않는다.

다양한 유닛들, 회로들 또는 기타 컴포넌트들이 과제 또는 과제들을 수행하도록 "구성되는 것"으로 기술될 수 있다. 그러한 맥락에서, "~하도록 구성되는"은 동작 동안에 과제 또는 과제들을 수행하는 "회로를 가진"을 일반적으로 의미하는 구조의 광의의 설명이다. 이와 같이, 유닛/회로/컴포넌트는 유닛/회로/컴포넌트가 현재 온(on) 상태가 아닐 시에도 과제를 수행하도록 구성될 수 있다. 일반적으로, "~하도록 구성되는"에 대응하는 구조를 형성하는 회로는 하드웨어 회로들을 포함할 수 있다. 유사하게, 다양한 유닛들/회로들/컴포넌트들은 과제 또는 과제들을 수행할 시에 편의상 설명에 기술될 수 있다. 그러한 설명은 "~하도록 구성된"이라는 문구를 포함하는 것으로 해석되어야 한다. 하나 이상의 과제들을 수행하도록 구성된 유닛/회로/컴포넌트를 언급하는 것은 35 U.S.C. § 112, 6항의 유닛/회로/컴포넌트에 대한 해석을 적용하지 않고자 명백히 의도하는 것이다.

비디오 인코딩 및 디코딩 시스템 또는 코덱 내에서 내부적으로 비디오 이미지 컨텐츠의 표현을 위한 적응형 전달 함수를 구현하는, 비디오 인코딩 및 디코딩 시스템들 및 방법들의 실시예들이 설명된다. 실시예들은, 인코딩 및 디코딩 프로세스들 동안, 입력 비디오 데이터의 동적 범위의, 코덱에 대한 적응을 허용할 수 있다. 실시예들에서, 전달 함수는, 코덱에 대한 입력 비디오의 각각의 장면, 시퀀스 또는 프레임에 대해 동적으로 적응될 수 있다. 실시예들에서, 전달 함수는 프레임의 구역들 내에서 동적으로 적응될 수 있다. 실시예들은, 입력 비디오 데이터에 전달 함수를 동적으로 적응시켜서, 인간의 시각적 시스템의 동적으로 결정된 유효 동적 범위(본원에서는 포커스 동적 범위 또는 단지 포커스 범위로 지칭됨) 내의 정보만을 유지하고, 포커스 범위 내의 데이터를, 코덱 내의 프로세싱을 위한 전달 함수에 따라, 입력 비디오의 비트 깊이로부터 코덱의 비트 깊이에 맵핑할 수 있다. 코덱의 출력은, 확장된 또는 높은 동적 범위(HDR) 디바이스들, 예를 들어, HDR-가능 디스플레이들을 포함하지만 이에 제한되는 것은 아닌 출력 또는 타겟 디바이스들의 동적 범위를 채우도록 확장될 수 있다. 도 1 내지 도 3은, 적응형 전달 함수 방법의 실시예들이 구현될 수 있는 예시적인 비디오 인코딩 및 디코딩 시스템들 또는 코덱들을 예시한다.

인간의 시각적 시스템은 전체적으로는 상당한 동적 범위를 커버한다. 그러나, 인간의 시각적 시스템은, 예를 들어, 장면 또는 이미지의 밝기(휘도) 및 텍스쳐 특성들에 따라, 관측되고 있는 현재의 장면 또는 이미지에 기초하여, 동적 범위에 적응하고 동적 범위를 제한하려는 경향이 있다. 따라서, 인간의 시각적 시스템의 전체 동적 범위가 비교적 크더라도, 비디오의 주어진 장면, 시퀀스, 프레임 또는 구역에 대한 유효 동적 범위는, 밝기 및 텍스쳐를 포함하지만 이에 제한되는 것은 아닌 이미지 특성들에 따라 상당히 더 작을 수 있다. 본원에서 설명되는 비디오 인코딩 및 디코딩 시스템들 및 방법들의 실시예들은, 현재의 장면, 시퀀스, 프레임 또는 구역의 특성들에 따라 코덱 내에서 범위를 동적으로 제한하기 위한 것과 유사한 전략을 이용하여, 인간의 시야의 이러한 특성을 레버리지(leverage)할 수 있다. 실시예들에서, 프로세싱되고 있는 현재의 장면, 시퀀스, 프레임 또는 구역의 하나 이상의 특성들(예를 들어, 밝기, 텍스쳐 등)에 따라, 인코더 컴포넌트 또는 프로세스는, 입력된 비디오 장면, 시퀀스, 프레임 또는 구역의 범위(예를 들어, 휘도)를, 인간의 시각적 시스템에 대한 유효 동적 범위 내로, 그리고 코덱의 요건들, 예를 들어, 비트 깊이 내로 동적으로 제한할 수 있다. 이것은, 예를 들어, 입력 비디오에서 현재의 장면, 시퀀스, 프레임 또는 구역 내의 영역을 샘플 값들의 측면에서 동적으로 결정하고, 코덱의 비트 깊이(예를 들어, 10 비트)를 그 범위로 포커싱함으로써 행해질 수 있다. 일부 실시예들에서, 이러한 포커싱은, 입력 비디오 동적 범위를 그 영역으로 크로핑하고, 그 다음, 크로핑된 범위(포커스 동적 범위 또는 포커스 범위로 지칭됨)의 값들을, 코덱에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수에 따라, 입력 비디오의 비트 깊이로부터 코덱의 비트 깊이로 대략적으로 맵핑(예를 들어, 양자화)함으로써 인코더에서 수행될 수 있다. 도 4 및 도 5는, 일부 실시예들에 따라, 입력 비디오 데이터에 대해 결정된 예시적인 포커스 범위, 및 N-비트 입력 비디오 데이터의, 전달 함수에 따른 코덱의 비트 깊이로의 맵핑을 도식적으로 예시한다. 본원에서 이용되는 바와 같이, N-비트는 입력 비디오의 비트 깊이를 지칭하고, C-비트는, 코덱 내에서 비디오 데이터를 표현하기 위해 이용되는 비트 깊이를 지칭하고, D-비트는, 디스플레이 디바이스와 같은, 디코딩된 비디오에 대한 타겟 디바이스의 비트 깊이를 지칭한다.

실시예들에서, 코덱에서 입력 비디오 데이터 및 포커스 범위 비디오 데이터를 표현하기 위해, 다양한 전달 함수들이 이용될 수 있다. 실시예들에서 비디오 데이터를 표현하기 위해 이용될 수 있는 전달 함수들의 예들은, 멱함수 법칙 감마-기반 전달 함수들, 로그-기반 전달 함수들, 및 인간의 시각적 지각에 기초한 전달 함수들, 예를 들어, Dolby Laboratories, Inc.에 의해 제안된 지각 양자화(PQ) 전달 함수를 포함할 수 있지만 이에 제한되는 것은 아니다. 일부 실시예들에서, 코덱에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수는, 입력 비디오 데이터를 표현하기 위해 이용되는 전달 함수와 동일할 수 있다. 그러나, 다른 실시예들에서, 코덱에서 비디오 데이터를 표현하기 위해, 입력 비디오 데이터를 표현하기 위해 이용되는 전달 함수(1차 전달 함수로 지칭됨)과는 상이한 전달 함수(내부적 또는 2차 전달 함수로 지칭됨)가 이용될 수 있다. 이것은, 예를 들어, 비디오 신호로 또한 지칭될 수 있는 비디오 데이터가, 코덱 내에서, 1차 전달 함수를 이용하여 행해질 수 있는 것보다 더 높은 정확도로 표현되도록 허용할 수 있다.

실시예들에서, 장면, 시퀀스, 프레임 또는 구역에 대해 인코더에 의해 이용되는 포커스 범위, 전달 함수, 양자화 파라미터들 및 다른 포맷 정보는, 예를 들어, 출력 비트 스트림에 내장된 메타데이터에 의해 디코더 컴포넌트에 시그널링될 수 있다. 디코더에서, 인코딩된 비트 스트림은, 비디오의 장면들, 시퀀스들, 프레임들 또는 구역들에 대한 시그널링된 포커스 범위(들)에 따라, HDR 디바이스(예를 들어, HDR-가능 디스플레이)와 같은 타겟 디바이스의 전체 동적 범위로 디코딩되고 동적으로 확장될 수 있다. 도 6은, 일부 실시예들에 따라, 디코딩된 비디오 데이터를 HDR 디바이스의 전체 동적 범위로 확장하는 것을 도식적으로 예시한다.

전달 함수를 입력 비디오 데이터에 동적으로 적응시킴으로써, 실시예들은, 비디오 데이터가, 입력 비디오 데이터를 표현하기 위해 이용되는 것보다 더 적은 비트들로 코덱에서 표현되도록 허용할 수 있는 한편, 코덱에 의해 출력되는 비디오 데이터가, HDR-가능 디스플레이들과 같은 HDR 디바이스들의 동적 범위를 채우도록 확장되도록 또한 허용할 수 있다. 적응형 전달 함수 방법의 실시예들은, 예를 들어, 비디오 인코딩 및 디코딩 시스템들이 코덱 내의 비디오 데이터의 내부적 표현 및 프로세싱에 대해서는 10개 이하의 비트들을 이용하게 하는 한편, HDR-가능 디스플레이들과 같은 HDR 디바이스들에 비디오를 출력하는 경우, 예를 들어, 12개 이상의 비트들을 이용하여 비디오 데이터의 확장된 또는 높은 동적 범위를 표현하게 할 수 있다. 따라서, 비디오 인코딩 및 디코딩 시스템들에 대한 적응형 전달 함수 방법의 실시예들은 구현을 단순화할 수 있고, 결과적으로, 특히 소비자 공간에서 HDR 기술의 채택을 단순화시킬 수 있다.

본원에서 설명되는 적응형 전달 함수 방법들은, 비디오 신호의 모든 색상 성분들에 적용될 수 있거나, 또는 대안적으로 비디오 신호의 휘도(루마) 및 색차(채도) 성분들 중 하나 또는 둘 모두에 개별적으로 적용될 수 있다.

도 1은, 적응형 전달 함수의 실시예를 구현하는 예시적인 비디오 인코딩 및 디코딩 시스템 또는 코덱(100)을 예시한다. 실시예들에서, 코덱(100)의 적응형 전달 함수(110) 컴포넌트 또는 모듈은, 적응형 전달 함수 방법에 따라, N-비트(예를 들어, 12-비트, 14-비트, 16-비트 등) 비디오 입력 데이터(102)를, 코덱(100)의 인코더(120) 컴포넌트 또는 모듈에 대한 C-비트(예를 들어, 10 또는 그 미만의 비트) 비디오 입력 데이터(112)로 변환할 수 있다. 일부 실시예들에서, N-비트 비디오 입력 데이터(102)를 C-비트 비디오 입력 데이터(112)로 변환하기 위해, 적응형 전달 함수(110)는, N-비트 비디오 입력 데이터(102)에서 현재의 장면, 시퀀스, 프레임 또는 구역 내의 영역을 샘플 값들의 측면에서 동적으로 결정하고, C 비트들을 그 영역으로 포커싱할 수 있다. 일부 실시예들에서, 이러한 포커싱은, N-비트 비디오 입력 데이터(102)를 결정된 포커스 범위로 크로핑하고, 그 다음, 인코더(120)에 대한 C-비트 비디오 입력 데이터(112)를 생성하기 위해, 인코더(120)에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수에 따라, 포커스 범위의 N-비트 값들을 코덱의 비트 깊이로 대략적으로 맵핑(예를 들어, 양자화)함으로써, 적응형 전달 함수(110)에서 수행될 수 있다.

일부 실시예들에서, 적응형 전달 함수(110)는 또한 인코더(120)로의 출력으로서 포맷 메타데이터(114)를 생성할 수 있다. 포맷 메타데이터(114)는, 적응형 전달 함수 방법을, 입력 비디오 데이터(102)에 적용되는 것으로 설명할 수 있다. 예를 들어, 포맷 메타데이터(114)는, 비디오 데이터를 인코더의 비트 깊이로 맵핑할 때 이용되는 파라미터들인 결정된 포커스 범위를 표시할 수 있고, 또한 포커스 범위에 적용되는 전달 함수에 대한 정보를 포함할 수 있다.

일부 실시예들에서, 인코더(120)는 그 다음, C-비트 비디오 입력 데이터(112)를 인코딩하여, 출력으로서 인코딩된 스트림(122)을 생성할 수 있다. 일부 실시예들에서, 인코더(120)는, H.264 / 어드밴스드 비디오 코딩(AVC) 포맷 또는 H.265 / 고효율 비디오 코딩(HEVC) 포맷과 같은 압축된 비디오 포맷에 따라 C-비트 비디오 입력 데이터(112)를 인코딩할 수 있다. 그러나, 다른 인코딩 포맷들이 이용될 수도 있다. 일부 실시예들에서, 인코더(120)는, 포맷 메타데이터(114)가 디코더(130) 컴포넌트에 제공될 수 있도록, 예를 들어, 포맷 메타데이터(114)를 출력 스트림(122)에 내장할 수 있다. 출력되는 인코딩된 스트림(122)은 메모리에 저장될 수 있거나, 또는 대안적으로, 코덱(100)의 디코더(130) 컴포넌트 또는 모듈에 직접 전송될 수 있다. 도 2는, 비디오 인코딩 및 디코딩 시스템 또는 코덱(100)의 예시적인 인코더 컴포넌트를 더 상세히 예시한다.

디코더(130)는, 인코딩된 스트림(122)을 판독 또는 수신하고, 스트림(122)을 디코딩하여, 코덱(100)의 인버스 적응형 전달 함수(140) 컴포넌트 또는 모듈에의 출력으로서 C-비트 디코딩된 스트림(132)을 생성할 수 있다. 일부 실시예들에서, 적응형 전달 함수 방법을, 적응형 전달 함수(110)에 의해 입력 비디오 데이터(102)에 적용되는 것으로 설명하는 포맷 메타데이터(134)는, 입력 스트림(122)으로부터 추출되고, 인버스 적응형 전달 함수(140)에 전달될 수 있다. 인버스 적응형 전달 함수(140)는, 포맷 메타데이터(134) 및 디스플레이 정보(144)에 따라 C-비트 디코딩된 스트림(132)을 변환하여, 하나 이상의 디스플레이들(190) 또는 다른 디바이스들로의 D-비트(예를 들어, 12-비트, 14-비트, 16-비트 등) HDR 출력(142)을 생성할 수 있다. 도 3은, 비디오 인코딩 및 디코딩 시스템 또는 코덱(100)의 예시적인 디코더 컴포넌트를 더 상세히 예시한다.

본원에서 설명되는 바와 같은 적응형 전달 함수 방법을 구현하는 비디오 인코딩 및 디코딩 시스템들 또는 코덱들(100)의 실시예들은, 예를 들어, 하나 이상의 이미지 캡쳐 디바이스들 및/또는 하나 이상의 디스플레이 디바이스들을 포함하는 디바이스들 또는 시스템들에서 구현될 수 있다. 이미지 캡쳐 디바이스는, 디지털 이미지들 또는 비디오를 캡쳐할 수 있는 광학 센서 또는 포토센서를 포함하는 임의의 디바이스일 수 있다. 이미지 캡쳐 디바이스들은, 비디오 카메라들 및 정지 이미지 카메라들 뿐만 아니라, 비디오 및 단일 이미지들 둘 모두를 캡쳐할 수 있는 이미지 캡쳐 디바이스들을 포함할 수 있지만, 이에 제한되는 것은 아니다. 이미지 캡쳐 디바이스들은 독립형 디바이스들일 수 있거나, 또는 스마트폰들, 셀폰들, PDA들, 태블릿 또는 패드 디바이스들, 다기능 디바이스들, 컴퓨팅 디바이스들, 랩탑 컴퓨터들, 노트북 컴퓨터들, 넷북 컴퓨터들, 데스크탑 컴퓨터들 등을 포함하지만 이에 제한되는 것은 아닌 다른 디바이스들에 통합된 카메라들일 수 있다. 이미지 캡쳐 디바이스들은 셀폰들, PDA들 및 태블릿 디바이스들과 같은 소형 디바이스들에 이용하기에 적합한 작은 폼 팩터의 카메라들을 포함할 수 있음을 주목한다. 디스플레이들 또는 디스플레이 디바이스들은, 스마트폰들, 셀폰들, PDA들, 태블릿 또는 패드 디바이스들, 다기능 디바이스들, 컴퓨팅 디바이스들, 랩탑 컴퓨터들, 노트북 컴퓨터들, 넷북 컴퓨터들, 데스크탑 컴퓨터들 등을 포함하지만 이에 제한되는 것은 아닌 다른 디바이스들에 통합된 디스플레이 스크린들 또는 패널들을 포함할 수 있다. 디스플레이 디바이스들은 또한, 비디오 모니터들, 프로젝터들, 또는 일반적으로, 디지털 이미지들 및/또는 디지털 비디오를 디스플레이 또는 투사할 수 있는 임의의 디바이스를 포함할 수 있다. 디스플레이들 또는 디스플레이 디바이스들은, LCD(liquid crystal display: 액정 디스플레이) 기술, LPD(light emitting polymer display: 발광 중합체 디스플레이) 기술, 또는 LED(light emitting diode: 발광 다이오드) 기술을 이용할 수 있지만, 다른 디스플레이 기술들이 이용될 수 있다.

도 10 내지 도 14는, 실시예들이 구현될 수 있는 디바이스들의 비제한적인 예들을 도시한다. 이미지 캡쳐 디바이스 및/또는 디스플레이 디바이스를 포함하는 디바이스 또는 시스템은, 본원에서 설명되는 바와 같이 비디오 데이터를 프로세싱하기 위한 기능 중 적어도 일부를 구현하는 하드웨어 및/또는 소프트웨어를 포함할 수 있다. 일부 실시예들에서, 본원에서 설명되는 바와 같은 기능 중 일부는 하나의 디바이스 상에서 구현될 수 있는 한편, 다른 부분은 다른 디바이스 상에서 구현될 수 있다. 예를 들어, 일부 실시예들에서, 이미지 캡쳐 디바이스를 포함하는 디바이스는, 포토센서를 통해 캡쳐된 이미지들 또는 비디오를 프로세싱 및 압축(즉, 인코딩)하는 센서 파이프라인을 구현할 수 있는 한편, 디스플레이 패널 또는 스크린을 포함하는 다른 디바이스는, 압축된 이미지들을 수신하고, 패널 또는 스크린으로의 디스플레이를 위해 프로세싱(즉, 디코딩)하는 디스플레이 파이프라인을 구현할 수 있다. 일부 실시예들에서, 본원에서 설명되는 기능 중 적어도 일부는, 다기능 디바이스들, 스마트폰들, 패드 또는 태블릿 디바이스들, 및 다른 휴대용 컴퓨팅 디바이스들, 예를 들어, 랩탑, 노트북 및 넷북 컴퓨터들을 포함하지만 이에 제한되는 것은 아닌 디바이스들에서 이용될 수 있는 시스템 온 어 칩(SOC)의 하나 이상의 컴포넌트들 또는 모듈들에 의해 구현될 수 있다. 도 10은, 예시적인 SOC를 예시하고, 도 11은, SOC를 구현하는 예시적인 디바이스를 예시한다. 도 12는, 본원에서 설명되는 방법들 및 장치를 구현할 수 있는 예시적인 컴퓨터 시스템을 예시한다. 도 13 및 도 14는, 본원에서 설명되는 방법들 및 장치를 구현할 수 있는 예시적인 다기능 디바이스들을 예시한다.

실시예들은 일반적으로, 프로세싱 비디오로서 본원에서 설명된다. 그러나, 실시예들은, 비디오 프레임들 또는 시퀀스들 뿐만 아니라 또는 그 대신에 단일 또는 정지 이미지들을 프로세싱하기 위해 적용될 수 있다. 따라서, 본원에서 "비디오", "비디오 프레임", "프레임" 등이 이용되는 경우, 이 용어들은 일반적으로 캡쳐된 디지털 이미지들을 지칭할 수 있음을 이해해야 한다.

도 2는, 일부 실시예들에 따라, 비디오 입력 데이터(202)에 적응형 전달 함수 방법을 적용하고, 출력으로서 인코딩된 비디오 데이터(232)를 생성하는 예시적인 인코더(200)를 예시한다. 인코더(200)는, 예를 들어, 도 1에 예시된 바와 같은 코덱(100)의 컴포넌트 또는 모듈일 수 있다. 실시예들에서, 인코더(200)의 적응형 전달 함수 컴포넌트 또는 모듈(210)은, 적응형 전달 함수 방법에 따라, N-비트(예를 들어, 12-비트, 14-비트, 16-비트 등) 비디오 입력 데이터(202)를, C-비트(예를 들어, 10 또는 그 미만의 비트) 데이터(212)로 변환하고, C-비트 데이터(212)를 인코더(200)의 프로세싱 파이프라인(220) 컴포넌트에 출력할 수 있다. 일부 실시예들에서, N-비트 비디오 입력 데이터(202)를 C-비트 비디오 데이터(212)로 변환하기 위해, 적응형 전달 함수 모듈(210)은, N-비트 비디오 입력 데이터(202)에서 현재의 장면, 시퀀스, 프레임 또는 구역 내의 영역을 샘플 값들의 측면에서 동적으로 결정하고, C 비트들을 그 영역으로 포커싱할 수 있다. 일부 실시예들에서, 이러한 포커싱은, N-비트 비디오 입력 데이터(202)의 동적 범위를 결정된 포커스 범위로 크로핑하고, 그 다음, 인코더(200)에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수에 따라, 포커스 범위의 N-비트 값들을 C 비트들로 대략적으로 맵핑(예를 들어, 양자화)함으로써, 적응형 전달 함수 모듈(210)에서 수행될 수 있다. 일부 실시예들에서, 적응형 전달 함수 모듈(210)은 또한 인코더(220)로의 출력으로서 포맷 메타데이터(214)를 생성할 수 있다. 포맷 메타데이터(214)는, 적응형 전달 함수 방법을, 입력 비디오 데이터(202)에 적용되는 것으로 설명할 수 있다. 예를 들어, 포맷 메타데이터(214)는, 비디오 데이터를 인코더의 비트 깊이로 맵핑할 때 이용되는 파라미터들인 결정된 포커스 범위를 표시할 수 있고, 또한 포커스 범위에 적용되는 전달 함수에 대한 정보를 포함할 수 있다.

일부 실시예들에서, 인코더(200)는 그 다음, 적응형 전달 함수 모듈(210)에 의해 생성된 C-비트 비디오 입력 데이터(212)를 인코딩하여, 출력으로서 인코딩된 스트림(232)을 생성할 수 있다. 일부 실시예들에서, 인코더(120)는, H.264 / 어드밴스드 비디오 코딩(AVC) 포맷 또는 H.265 / 고효율 비디오 코딩(HEVC) 포맷과 같은 압축된 비디오 포맷에 따라 C-비트 비디오 입력 데이터(112)를 인코딩할 수 있다. 그러나, 다른 인코딩 포맷들이 이용될 수도 있다.

일부 실시예들에서, 입력 비디오 프레임들은, 화소들(picture elements)(픽셀들 또는 펠(pel)들로 지칭됨)의 블록들에 따라 인코더(200)로 세분화되고 인코더(200)에서 프로세싱된다. 예를 들어, 매크로블록들로 지칭되는 16x16 픽셀 블록들이 H.264 인코딩에서 이용될 수 있다. HEVC 인코딩은 16x16 픽셀 내지 64x64 픽셀 블록들의 범위 내에서 변화할 수 있는 코딩 트리 유닛들(CTU들)로 지칭되는 블록들을 사용한다. CTU들은 코딩 유닛들(CU들)로 분할될 수 있고, 64 x 64 픽셀로부터 4 x 4 픽셀 블록들까지 크기가 작아질 수 있는 예측 유닛들(PU들)로 추가로 세분화될 수 있다. 일부 실시예들에서, 비디오 입력 데이터(212)는 루마 및 채도 성분들로 분리될 수 있고, 루마 및 채도 성분들은 인코더의 하나 이상의 컴포넌트들 또는 스테이지들에서 개별적으로 프로세싱될 수 있다.

도 2에 도시된 예시적인 인코더(200)에서, 인코더(200)는, 프로세싱 파이프라인(220) 컴포넌트 및 엔트로피 코딩(230) 컴포넌트를 포함한다. 프로세싱 파이프라인(220)은, 비디오 입력 데이터(212)가 프로세싱되는 다수의 컴포넌트들 또는 스테이지들을 포함할 수 있다. 프로세싱 파이프라인(220)은, 하나 이상의 스테이지들 또는 컴포넌트들로서, 예를 들어, 인트라-프레임 및 인터-프레임 추정(222), 모드 판정(224) 및 모션 보상 및 재구성(226) 동작들을 구현할 수 있다.

하기 내용은, 예시적인 프로세싱 파이프라인(220)의 동작들을 하이 레벨로 설명하며, 제한적인 것으로 의도되지 않는다. 일부 실시예들에서, 인트라-프레임 및 인터-프레임 추정(222)은 파이프라인에 입력되는 블록들을 인코딩할 때 사용될 이전에 인코딩된 픽셀들의 블록들을 결정할 수 있다. H.264 인코딩과 같은 일부 비디오 인코딩 기술들에서, 각각의 입력 블록은 현재 프레임 내에서 이미 인코딩된 픽셀들의 블록들을 이용하여 인코딩될 수 있다. 이러한 블록들을 결정하는 프로세스는 인트라-프레임 추정, 또는 단순히 인트라-추정으로 지칭될 수 있다. H.264 및 H.265 인코딩과 같은 일부 비디오 인코딩 기술들에서, 블록들은 또한, 하나 이상의 이전에 재구성된 프레임들(기준 프레임들로 지칭되고, 도 2에 기준 데이터(240)로서 도시됨)로부터의 픽셀들의 블록들을 이용하여 인코딩될 수 있다. 일부 실시예들에서, 인코더 파이프라인에 의해 출력되는 재구성된 및 인코딩된 프레임들은, 기준 프레임들로서 이용하기 위해 디코딩되고 기준 데이터(240)에 저장될 수 있다. 일부 실시예들에서, 현재의 프레임을 재구성할 때 이용되는 기준 데이터(240)에 저장되는 기준 프레임들은, 프로세싱되고 있는 비디오에서 시간상 현재의 프레임 이전에 발생한 하나 이상의 재구성된 프레임들 및/또는 프로세싱되고 있는 비디오에서 시간상 현재의 프레임 이후에 발생한 하나 이상의 재구성된 프레임들을 포함할 수 있다. 기준 프레임들 내의 픽셀 블록들을 매칭하는 것을 찾는 프로세스는 인터-프레임 추정으로, 또는 보다 일반적으로 모션 추정으로 지칭될 수 있다. 일부 실시예들에서, 모드 판정(224)은, 인트라-프레임 및 인터-프레임 추정(222)으로부터 주어진 블록에 대한 출력을 수신할 수 있고, 그 블록에 대해 최상의 예측 모드(예를 들어, 인터-프레임 예측 또는 인트라-프레임 예측 모드들) 및 대응하는 모션 벡터들을 결정할 수 있다. 이러한 정보는 모션 보상 및 재구성(226)에 전달되다.

모션 보상 및 재구성(226)의 동작들은, 모드 판정(224)으로부터 수신된 최상의 모드에 의존할 수 있다. 최상의 모드가 인터-예측되는 것이면, 모션 보상 컴포넌트는, 모션 벡터들에 대응하는 기준 프레임 블록들을 획득하고, 블록들을 예측 블록들로 결합한다. 그 다음, 모션 보상 컴포넌트는 최종 블록 예측기를 생성하기 위해 가중된 예측을 예측 블록들에 적용하고, 최종 블록 예측기는 재구성 컴포넌트로 전달된다. 가중된 예측에서, 기준 데이터로부터의 값들은, 하나 이상의 가중 파라미터들에 따라 가중되고, 오프셋 값으로 시프트되어, 현재의 블록을 인코딩할 때 이용될 예측 데이터를 생성할 수 있다. 최상의 모드가 인트라-예측된 것이면, 인트라 예측은 하나 이상의 이웃 블록들을 이용하여 수행되어, 파이프라인의 이 스테이지에서 프로세싱되고 있는 현재의 블록에 대한 예측 블록을 생성한다.

재구성 컴포넌트는, 모션 보상 출력에 따라 현재의 블록에 대한 블록(예를 들어, 매크로블록) 재구성 동작들을 수행한다. 재구성 동작들은 예를 들어, 순방향 변환 및 양자화(FTQ) 동작들을 포함할 수 있다. 모션 보상 및 재구성(226)은, 변환되고 양자화된 데이터를 인코더(200)의 엔트로피 코딩(230) 컴포넌트에 출력할 수 있다.

엔트로피 코딩(230) 컴포넌트는, 예를 들어, 파이프라인(220)에 의해 출력된 변환되고 양자화된 데이터를 압축하기 위해 엔트로피 코딩 기술을 적용하여, 인코딩된 출력 스트림(232)을 생성할 수 있다. 이용될 수 있는 예시적인 엔트로피 코딩 기술들은, Huffman 코딩 기술들, CAVLC(context-adaptive variable-length coding) 및 CABAC(context-adaptive binary arithmetic coding)을 포함할 수 있지만 이에 제한되는 것은 아니다. 일부 실시예들에서, 인코더(200)는, 포맷 메타데이터(214)가 디코더에 제공될 수 있도록, 포맷 메타데이터(214)를 인코딩된 출력 스트림(232)에 내장할 수 있다. 출력되는 인코딩된 스트림(232)은 메모리에 저장될 수 있거나, 또는 대안적으로, 디코더 컴포넌트에 직접 전송될 수 있다.

기준 데이터(240)는 또한 파이프라인(220)에 의해 출력되고 메모리에 저장될 수 있다. 기준 데이터(240)는, 예를 들어, 파이프라인(220)의 모션 추정 및 모션 보상 및 재구성 동작들에서 액세스될 수 있는 하나 이상의 이전에 인코딩된 프레임들(기준 프레임들로 지칭됨)을 포함할 수 있지만 이에 제한되는 것은 아니다.

일부 실시예들에서, 인코더(200)는, 현재의 프레임을 프로세싱하는 경우 파이프라인(220) 컴포넌트들에 의한 이용을 위해 기준 데이터(240)로부터 획득되는 기준 프레임 데이터를 리포맷하도록 구성될 수 있는 리포맷(250) 컴포넌트를 포함할 수 있다. 리포맷(250)은, 예를 들어, 기준 프레임 데이터를, 기준 프레임을 인코딩할 때 이용되는 포커스 범위 / 전달 함수로부터, 현재의 프레임을 인코딩할 때 이용되고 있는 포커스 범위 / 전달 함수로 변환하는 것을 수반할 수 있다. 예시로서, 기준 프레임에 대한 휘도의 포커스 범위 / 전달 함수 맵핑은, 0.05 cd/m2의 값으로부터 C (예를 들어, 10) 비트로 표현되는 1000 cd/m2로 진행할 수 있다. 현재의 프레임의 경우, 포커스 범위는 더 밝은 이미지 컨텐츠로 인해 확장될 수 있는데; 예를 들어, 포커스 범위는 2000 cd/m2으로 확장 또는 증가될 수 있다. 따라서, 현재의 프레임에 대한 휘도의 포커스 범위 및/ 전달 함수 맵핑은 0.05 cd/m2 내지 2000 cd/m2일 수 있다. 파이프라인(220)에서, 예를 들어, 모션 추정 동작들에서 기준 프레임 데이터를 이용하기 위해, 기준 프레임 데이터는, 리포맷(250) 컴포넌트에 의해 현재의 프레임을 인코딩하기 위해 이용되고 있는 포커스 범위 / 전달 함수에 따라 리포맷될 수 있다.

주어진 예에서, 리포맷(250) 컴포넌트는, 기준 프레임 데이터를, 데이터가 재구성된 0.05 cd/m2 내지 1000 cd/m2 범위로부터, 현재의 프레임에 대해 이용되고 있는 0.05 cd/m2 내지 2000 cd/m2 범위까지의 범위로 변환할 수 있다. 이러한 예에서, 기준 프레임은 오직 0.05 cd/m2 내지 1000 cd/m2의 데이터만을 포함하기 때문에, 리포맷된 기준 데이터의 C-비트 표현의 일부 코드 워드들(예를 들어, 1000 cd/m2보다 큰 값들을 표현하는 코드 워드들)은 리포맷된 기준 데이터에서 이용되지 않을 수 있다. 그러나, 값들은 예측 또는 다른 동작들에서의 이용을 위해 현재의 포커스 범위에 맵핑된다.

기준 데이터(240)로부터 적응형 전달 함수 모듈(210)로 리턴하는 화살표로 도시된 바와 같이, 일부 실시예들에서, 적응형 전달 함수 모듈(210)은, 파이프라인(220)에서 프로세싱되는 현재의 프레임에 대한 포커스 범위 / 전달 함수를 결정할 때 하나 이상의 이전에 프로세싱된 프레임들로부터의 적응형 전달 함수 정보를 이용할 수 있다.

도 3은, 일부 실시예들에 따라, 디스플레이 포맷 비디오 데이터(332)를 생성하기 위한 적응형 전달 함수 방법에 따라, 인코딩된 비디오 데이터(302)를 디코딩하고, 디코딩된 비디오 데이터(322)를 확장시키는 예시적인 디코더(300)를 예시한다. 디코더(300)는, 예를 들어, 도 1에 예시된 바와 같은 코덱(100)의 컴포넌트 또는 모듈일 수 있다. 도 3에 도시된 예시적인 디코더(300)에서, 디코더(300)는, 엔트로피 디코딩(310) 컴포넌트, 인버스 양자화 및 변환(320) 컴포넌트 및 인버스 적응형 전달 함수 모듈(330)을 포함한다. 엔트로피 디코딩(310) 컴포넌트는, 예를 들어, 도 2에 도시된 인코더(200)와 같은 인코더에 의해 출력되는 인코딩된 스트림(302)을 압축해제하기 위해 엔트로피 디코딩 기술을 적용할 수 있다. 인버스 양자화 및 변환(320) 컴포넌트는, 엔트로피 디코딩(310)에 의해 출력된 데이터에 대해 인버스 양자화 및 인버스 변환 동작들을 수행하여, 디코더(300)의 인버스 적응형 전달 함수 모듈(330)로의 출력으로서 C-비트 디코딩된 스트림(322)을 생성한다. 일부 실시예들에서, 적응형 전달 함수 방법을, 현재의 장면, 시퀀스, 프레임 또는 구역에 적용되는 것으로 설명하는 포맷 메타데이터(324)는, 입력 스트림(302)으로부터 추출되고, 인버스 적응형 전달 함수 모듈(330)에 전달될 수 있다. 인버스 적응형 전달 함수 모듈(330)은, 포맷 메타데이터(324) 및 디스플레이 정보(392)에 따라 C-비트 디코딩된 스트림(322)을 확장시켜, 하나 이상의 디스플레이들(390) 또는 다른 디바이스들로의 D-비트(예를 들어, 12-비트, 14-비트, 16-비트 등) HDR 출력(332)을 생성할 수 있다.

도 4 내지 도 6은, 일부 실시예들에 따라, N-비트 입력 비디오 데이터에 대한 예시적인 포커스 범위를 결정하는 것, 입력 비디오 데이터의, 전달 함수에 따라 코덱 내에서 이용가능한 C 비트들로의 맵핑, 및 디코딩된 비디오를 HDR 디바이스의 전체 동적 범위로 확장시켜 디바이스에 대한 D-비트 비디오 데이터를 생성하는 것을 도식적으로 예시한다.

도 4는, 일부 실시예들에 따라, N-비트 입력 비디오 데이터에 대한 예시적인 전체 동적 범위를 예시하고, 입력 비디오 데이터에 대해 결정된 예시적인 포커스 범위를 도시한다. 도 4에서, 수직축은 입력 비디오 데이터에서 N-비트(예를 들어, 12-비트, 14-비트, 16-비트 등) 코드 값들을 표현한다. 수평축은, 이 예에서는 0 내지 10000 cd/m2인 입력 비디오 데이터의 휘도에 대한 동적 범위를 표현하고, 여기서, cd/m2(평방 미터당 칸델라)는 휘도에 대한 SI 단위이다. 동일 단위에 대한 비-SI 용어는 "NIT"이다. 곡선은, 입력 비디오 데이터에 대한 예시적인 전달 함수를 표현한다. 포커스 범위(이 예에서는, 2000 내지 4000 cd/m2)는, 각각의 비디오 데이터의 하나 이상의 특성들(예를 들어, 밝기, 텍스쳐 등)에 따라, 현재의 장면, 시퀀스, 프레임 또는 구역에 대해 결정되는 인간의 시각적 시스템의 유효 동적 범위를 표현한다. 볼 수 있는 바와 같이, 이 예에서, 포커스 범위는 N-비트 코드 값들의 분수값(대략 1/8)으로 표현된다. 도 7a 내지 도 7c에 예시된 바와 같이, 비디오 스트림 내의 상이한 장면들, 시퀀스들, 프레임들 또는 구역들에 대해 상이한 포커스 범위들이 결정될 수 있음을 주목한다.

도 5는, 일부 실시예들에 따라, 코덱 내에서 C-비트 비디오 데이터를 생성하기 위해, 결정된 포커스 범위 내에서 N-비트 입력 비디오 데이터를 맵핑하는 예를 예시한다. 도 5에서, 수직축은 코덱에서 이용가능한 C-비트(예를 들어, 12-비트, 10-비트, 8-비트 등) 코드 값들을 표현한다. 수평축은, C-비트 코드 값들에 맵핑되는 휘도 값들(이 예에서는, 2000 내지 4000 cd/m2)에 대한 포커스 범위를 도시한다. 곡선은, 코드 내에서 포커스 범위 데이터를 표현하기 위해 이용되는 예시적인 전달 함수를 표현한다. 일부 실시예들에서, 코덱에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수는, 입력 비디오 데이터를 표현하기 위해 이용되는 것과 동일한 전달 함수일 수 있다. 그러나, 다른 실시예들에서, 코덱에서 비디오 데이터를 표현하기 위해, 입력 비디오 데이터를 표현하기 위해 이용되는 전달 함수(1차 전달 함수로 지칭됨)과는 상이한 전달 함수(내부적 또는 2차 전달 함수로 지칭됨)가 이용될 수 있다. 이것은, 예를 들어, 비디오 신호의 포커스 범위가, 코덱 내에서, 1차 전달 함수를 이용하여 행해질 수 있는 것보다 더 높은 정확도로 표현되도록 허용할 수 있다.

도 6은, 일부 실시예들에 따라, 디바이스에 대한 D-비트 비디오 데이터를 생성하기 위해, C-비트 디코딩된 비디오를 HDR-가능 디바이스의 동적 범위로 확장하는 예를 예시한다. 도 6에서, 수직축은, 도 3에 예시된 디코더(300)와 같은 디코더로부터 출력되는 비디오 데이터에서 D-비트(예를 들어, 12-비트, 14-비트, 16-비트 등) 코드 값들을 표현한다. 수평축은, 디코더에 의해 출력된 D-비트 비디오 데이터가 향하는 디스플레이 디바이스에 의해 지원되는 휘도에 대한 동적 범위를 표현하며; 이 예에서는, 0 내지 10000 cd/m2의 동적 범위가 도시된다. 곡선은, 디스플레이 디바이스에 대한 예시적인 전달 함수를 표현한다. 인코딩된 비디오 신호가 디코더에 의해 디코딩된 후, 코덱에서 신호의 내부적 표현을 위해 이용되는 포커스 범위는 C-비트 표현으로부터 디스플레이 디바이스의 더 넓은 동적 범위 및 D-비트 표현으로 리맵핑된다. 도 7a 내지 도 7c에 예시된 바와 같이, 비디오 스트림 내의 상이한 장면들, 시퀀스들, 프레임들 또는 구역들에 대해 상이한 포커스 범위들이 인코딩될 수 있음을 주목한다. 일부 실시예들에서, 포맷 메타데이터는, 각각의 장면, 시퀀스, 프레임 또는 구역을 인코딩할 때 이용되는 포커스 범위를 표현하는 인코딩된 비디오 스트림에서 또는 그 스트림에 의해 디코더에 제공될 수 있다. 일부 실시예들에서, 메타데이터는 또한, 비디오 데이터를 코딩된 것의 비트 깊이로 맵핑할 때 이용되는 하나 이상의 파라미터들을 포함할 수 있다. 일부 실시예들에서, 메타데이터는 또한, 코덱에서 포커스 범위 데이터를 표현하기 위해 이용되는 내부적 전달 함수에 대한 정보를 포함할 수 있다. 메타데이터는, 포커스 범위 데이터를 C-비트 표현으로부터 디스플레이 디바이스의 더 넓은 동적 범위 및 D-비트 표현으로 리맵핑할 때 디코더에 의해 이용될 수 있다.

도 7a 내지 도 7c는, 적응형 전달 함수 방법의 실시예들에 따라, 비디오 시퀀스 또는 비디오 프레임의 상이한 부분들에 상이한 포커스 범위들을 적용하는 것을 도식적으로 예시한다.

도 7a는, 적응형 전달 함수 방법의 일부 실시예들에 따라, 입력 비디오의 상이한 장면들 또는 시퀀스들에 상이한 포커스 범위들을 적용하는 것을 도식적으로 예시한다. 이 예에서, 포커스 범위(710A)는 프레임들(700A-700E)에 대해 동적으로 결정되고 이를 인코딩할 때 이용되며, 포커스 범위(710B)는 프레임들(700F-700G)에 대해 동적으로 결정되고 이를 인코딩할 때 이용된다. 프레임들(700A-700E) 및 프레임들(700F-700H)은, 예를 들어, 비디오 내에서 상이한 장면들을 표현할 수 있거나, 또는 비디오의 장면들 내에서 또는 장면들에 걸쳐 프레임들의 상이한 시퀀스들을 표현할 수 있다.

도 7b는, 적응형 전달 함수 방법의 일부 실시예들에 따라, 입력 비디오의 각각의 프레임에 상이한 포커스 범위들을 적용하는 것을 도식적으로 예시한다. 이 예에서, 포커스 범위(710C)는 프레임(700I)에 대해 동적으로 결정되고 이를 인코딩할 때 이용되며, 포커스 범위(710D)는 프레임들(700J)에 대해 동적으로 결정되고 이를 인코딩할 때 이용되며, 포커스 범위(710E)는 프레임들(700K)에 대해 동적으로 결정되고 이를 인코딩할 때 이용된다.

도 7c는, 적응형 전달 함수 방법의 일부 실시예들에 따라, 비디오 프레임의 상이한 구역들에 상이한 포커스 범위들을 적용하는 것을 도식적으로 예시한다. 도 7a 및 도 7b에 도시된 바와 같이, 일부 실시예들에서, 적응형 전달 함수 방법은, 프레임, 장면 또는 시퀀스에 적용될 수 있다. 그러나, 일부 실시예들에서, 적응형 전달 함수 방법은 그 대신, 또는 추가적으로, 도 7c에 도시된 바와 같이, 프레임 내의 둘 이상의 구역들(702)에 적용될 수 있다. 이 예에서, 포커스 범위(710F)는 프레임(700L)의 구역(702A)에 대해 동적으로 결정되고 이를 인코딩할 때 이용되며, 포커스 범위(710G)는 프레임들(700L)의 구역(702B)에 대해 동적으로 결정되고 이를 인코딩할 때 이용되며, 포커스 범위(710H)는 프레임들(700L)의 구역(702C)에 대해 동적으로 결정되고 이를 인코딩할 때 이용된다. 다양한 실시예들에서, 적응형 전달 함수 방법에 따라 인코딩되는 구역들(702)은 직사각형일 수 있거나, 또는 임의적으로 결정되는 불규칙한 형상들을 포함하지만 이에 제한되는 것은 아닌 다른 형상들일 수 있다. 일부 실시예들에서, 적응형 전달 함수 방법에 따라 인코딩되는 각각의 프레임에는 고정된 수의 구역들(702)이 존재할 수 있다. 일부 실시예들에서, 적응형 전달 함수 방법에 따라 인코딩되는 구역들(702)의 수 및/또는 구역들(702)의 형상은 각각의 프레임, 장면 또는 시퀀스에 대해 결정될 수 있다. 일부 실시예들에서, 인코더에 의해 생성되어 디코더로 전달되는 포맷 메타데이터는, 포커스 범위, 양자화 파라미터들, 및 프레임(들)(700)의 각각의 구역(702)을 인코딩하기 위해 이용되는 다른 정보를 표시할 수 있다. 2차 또는 내부적 전달 함수가 코덱 내에서 이용되는 실시예들에서, 포맷 메타데이터는, 2차 전달 함수로부터 1차 전달 함수로 변환하기 위한 정보를 포함할 수 있다. 구역들(702)의 수가 변할 수 있는 실시예들에서, 구역들(702)의 실제 수의 표시는 디코더에 전달되는 메타데이터에 포함될 수 있다. 일부 실시예들에서, 구역들(702)에 대한 좌표 및 형상 정보가 또한 디코더에 전달되는 메타데이터에 포함될 수 있다.

비디오 컨텐츠에서, 프로세싱되고 있는 입력 비디오의 일 구역 또는 프레임으로부터 다음 구역 또는 프레임까지, 적응형 전달 함수 방법에서 이용되는 다양한 파라미터들(예를 들어, 포커스 범위, 양자화 파라미터들 등)은, 특히 장면 내에서 유사할 수 있다. 따라서, 일부 실시예들에서, 적응형 전달 함수 방법은, 예를 들어, AVC 및 HEVC 코덱들과 같은 코덱들에서 가중된 예측 프로세스를 레버리지함으로써, 인코더에서 이러한 적응형 전달 함수 파라미터들 중 하나 이상에 대한 인트라-프레임(공간적) 및/또는 인터-프레임(시간적) 예측을 제공할 수 있다. 인터-프레임(시간적) 예측에서, 하나 이상의 시간상 과거 또는 장래의 프레임들로부터 이전에 프로세싱된 기준 데이터는, 현재의 프레임의 컨텐츠에 대한 파라미터들 중 하나 이상을 예측할 때 이용될 수 있다. 인트라-프레임(공간적) 예측에서, 프레임 내의 하나 이상의 이웃 블록들 또는 구역들로부터의 데이터는, 현재의 블록 또는 구역의 컨텐츠에 대한 파라미터들 중 하나 이상을 예측할 때 이용될 수 있다.

도 8은, 일부 실시예들에 따라, 비디오 입력 데이터에 적응형 전달 함수 방법을 적용하고, 인코딩된 비디오 데이터를 생성하는 비디오 인코딩 방법의 하이 레벨 흐름도이다. 도 8의 800에 표시된 바와 같이, N-비트(예를 들어, 12-비트, 14-비트, 16-비트 등) 비디오 데이터가 인코딩을 위해 수신될 수 있다. 일부 실시예들에서, 비디오 스트림의 프레임들은 인코더에 의해 순차적으로 프로세싱된다. 일부 실시예들에서, 입력 비디오 프레임들은, 픽셀들의 블록들(예를 들어, 매크로블록들, CU들, PU들 또는 CTU들)에 따라 인코더로 세분화되고 인코더에 의해 프로세싱된다.

도 8의 802에 표시된 바와 같이, 포커스 범위는 입력 비디오 데이터에 대해 결정될 수 있다. 일부 실시예들에서, 포커스 범위는, 인코더에 입력되는 비디오의 각각의 장면, 시퀀스 또는 프레임에 대해 동적으로 결정될 수 있다. 일부 실시예들에서, 포커스 범위는, 프레임 내의 둘 이상의 구역들 각각에 대해 동적으로 결정될 수 있다. 일부 실시예들에서, 포커스 범위는, 프로세싱되고 있는 현재의 장면, 시퀀스, 프레임 또는 구역의 하나 이상의 특성들(예를 들어, 밝기, 텍스쳐 등)에 따라 결정될 수 있다. 포커스 범위는, 현재의 장면, 시퀀스, 프레임 또는 구역에서 이미지 데이터(예를 들어, 휘도)에 대한 인간의 시각적 시스템의 유효 동적 범위를 표현한다. 예를 들어, 입력 비디오 데이터에서 휘도에 대한 동적 범위가 0 내지 10000 cd/m2이면, 다양한 장면들, 시퀀스들, 프레임들 또는 구역들의 특정 특성들에 기초한 예시적인 포커스 범위들은, 2000 내지 4000 cd/m2, 0 내지 1000 cd/m2, 1000 내지 2500 cd/m2 등일 수 있다. 도 4는, 일부 실시예들에 따라, N-비트 입력 비디오 데이터에 대해 결정되는 예시적인 포커스 범위를 도식적으로 예시한다.

도 8의 804에 표시된 바와 같이, 포커스 범위 내의 N-비트 비디오 데이터는 전달 함수에 따라 C-비트 비디오 데이터에 맵핑될 수 있다. 일부 실시예들에서, 입력 비디오 데이터는, 결정된 포커스 범위에 따라 크로핑될 수 있고, 그 다음, 크로핑된 데이터 값들은, 인코더에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수에 따라 인코더에서 이용가능한 C 비트들로 대략적으로 맵핑(예를 들어, 양자화)될 수 있다. 도 5는, 일부 실시예들에 따라, 예시적인 포커스 범위 내의 N-비트 입력 비디오 데이터의, 전달 함수에 따른 인코더 내에서 이용가능한 C 비트들로의 예시적인 맵핑을 도식적으로 예시한다. 실시예들에서, 인코더에서 N-비트 입력 비디오 데이터 및 C-비트 비디오 데이터를 표현하기 위해, 다양한 전달 함수들이 이용될 수 있다. 실시예들에서 비디오 데이터를 표현하기 위해 이용될 수 있는 전달 함수들의 예들은, 멱함수 법칙 감마-기반 전달 함수들, 로그-기반 전달 함수들, 및 인간의 시각적 지각에 기초한 전달 함수들, 예를 들어, PQ 전달 함수를 포함할 수 있지만 이에 제한되는 것은 아니다. 일부 실시예들에서, 인코더에서 C-비트 비디오 데이터를 표현하기 위해 이용되는 전달 함수는, N-비트 입력 비디오 데이터를 표현하기 위해 이용되는 것과 동일한 전달 함수일 수 있다. 그러나, 다른 실시예들에서, 입력 비디오 데이터는 1차 전달 함수에 따라 표현될 수 있고, 인코더의 비디오 데이터를 표현하기 위해서는 상이한(2차) 전달 함수가 이용될 수 있다. 2차 전달 함수는, 예를 들어, 인코더 내에서, 1차 전달 함수를 이용하여 가능할 것보다 더 높은 정확도로 비디오 신호를 표현할 수 있다.

도 8의 엘리먼트(806)에 의해 도시된 바와 같이, 엘리먼트(800 내지 804)에서 수행되는 적응형 전달 함수 프로세싱은, 프로세싱될 더 많은 N-비트 입력 비디오 데이터(예를 들어, 장면들, 시퀀스들, 프레임들 또는 구역들)가 존재하는 한 반복된다. 엘리먼트들(800 내지 804)에서 적응형 전달 함수 방법에 의해 출력되는 C-비트 비디오 데이터(예를 들어, 장면 시퀀스, 프레임 또는 구역)의 각각의 유닛은, 도 8의 810에 표시된 바와 같이, 인코더에 입력되고 인코더에 의해 프로세싱된다. 이전에 언급된 바와 같이, 일부 실시예들에서, N-비트 입력 비디오 데이터는, 적응형 전달 함수 모듈 또는 컴포넌트로 세분화되고 그에 의해 프로세싱될 수 있고, 픽셀들의 블록들(예를 들어, 매크로블록들, CU들, PU들 또는 CTU들)에 따라 C-비트 비디오 데이터로서 인코더에 전달될 수 있다.

도 8의 810에 표시된 바와 같이, 인코더의 하나 이상의 컴포넌트들은 C-비트 비디오 데이터를 프로세싱하여, 인코딩된(및 압축된) 비디오 데이터 출력(예를 들어, CAVLC 또는 CABAC 출력)을 생성할 수 있다. 일부 실시예들에서, 인코더는, H.264 / AVC 포맷 또는 H.265 / HEVC 포맷과 같은 압축된 비디오 포맷에 따라 C-비트 비디오 입력 데이터를 인코딩할 수 있다. 그러나, 다른 인코딩 포맷들이 이용될 수도 있다. 일부 실시예들에서, 각각의 장면, 시퀀스, 프레임 또는 구역을 인코딩할 때 이용되는 포커스 범위, 전달 함수, 양자화 파라미터들 및 다른 포맷 정보는 인코딩된 출력 스트림에 메타데이터로서 내장될 수 있거나, 그렇지 않으면 디코더(들)에 시그널링될 수 있다. 인코딩된 출력 스트림을 생성하기 위해 C-비트 비디오 데이터를 프로세싱하기 위한 예시적인 인코더는 도 2의 인코더(200)에 의해 예시된다. 일부 구현들에서, 메타데이터를 포함하는 인코딩된 출력 스트림은 예를 들어, 다이렉트 메모리 액세스(DMA)를 통해 메모리에 기입될 수 있다. 일부 구현들에서, 메모리에 출력 스트림 및 메타데이터를 기입하는 것 대신에 또는 그에 추가로, 인코딩된 출력 스트림 및 메타데이터는 적어도 하나의 디코더에 직접 전송될 수 있다. 디코더는, 인코더와 동일한 디바이스 또는 장치 상에서, 또는 상이한 디바이스 또는 장치 상에서 구현될 수 있다.

도 9는, 일부 실시예들에 따라, 디스플레이 포맷 비디오 데이터를 생성하기 위한 적응형 전달 함수 방법에 따라, 인코딩된 비디오 데이터를 디코딩하고, 디코딩된 비디오 데이터를 확장시키는 비디오 디코딩 방법의 하이 레벨 흐름도이다. 도 9의 900에 표시된 바와 같이, 디코더는 인코딩된 데이터(예를 들어, CAVLC 또는 CABAC 인코딩된 및 압축된 데이터)를 획득할 수 있다. 인코딩된 데이터는, 예를 들어, 메모리로부터 판독되거나, 인코더로부터 수신되거나 또는 달리 획득될 수 있다. 도 9의 902에 표시된 바와 같이, 디코더는, 인코딩된 데이터를 디코딩하여, 디코딩된 C-비트 비디오 데이터 및 포맷 메타데이터를 생성할 수 있다. 일부 실시예들에서, 디코더는, H.264 / AVC 포맷 또는 H.265 / HEVC 포맷과 같은 압축된 비디오 포맷에 따라 인코딩된 데이터를 디코딩할 수 있다. 그러나, 다른 인코딩/디코딩 포맷들이 이용될 수도 있다. 인코딩된 데이터로부터 추출되는 포맷 메타데이터는, 예를 들어, 포커스 범위, 전달 함수, 양자화 파라미터들, 및 각각의 장면, 시퀀스, 프레임 또는 구역을 인코딩할 때 이용된 다른 포맷 정보를 포함할 수 있다.

도 9의 엘리먼트(904)에 의해 도시된 바와 같이, 900 및 902에서 수행되는 디코딩은, 인코딩된 데이터가 존재하는 한 계속될 수 있다. 디코더에 의해 디코딩되는 디코딩된 데이터(예를 들어, 각각의 장면 시퀀스, 프레임 또는 구역)의 각각의 유닛은, 도 9의 910에 표시된 바와 같이, 인버스 적응형 전달 함수 방법에 따라 출력 및 프로세싱될 수 있다. 인코딩된 데이터로부터 추출된 포맷 메타데이터의 적어도 일부는 또한, 인버스 적응형 전달 함수 방법에 출력될 수 있다.

도 9의 910에 표시된 바와 같이, 인버스 적응형 전달 함수 방법은, 포커스 범위로부터 디코딩된 C-비트 비디오 데이터를 동적으로 확장시켜, HDR-가능 디스플레이 디바이스와 같은 타겟 디바이스에의 출력을 위한 전체 동적 범위 D-비트 비디오 데이터를 생성할 수 있다. 주어진 장면, 시퀀스, 프레임 또는 구역에 대해, 확장은, 디코더에 의해, 인코딩된 데이터로부터 추출된 각각의 포맷 메타데이터에 따라 동적으로 수행될 수 있다. 도 6은, 일부 실시예들에 따라, 디코딩된 비디오 데이터를 HDR 디바이스의 전체 동적 범위로 확장하는 것을 도식적으로 예시한다.

1차 및 2차 전달 함수들

본원에서 설명되는 적응형 전달 함수 방법의 실시예들에서 비디오 데이터를 표현하기 위해 이용될 수 있는 전달 함수들의 예들은, 멱함수 법칙 감마-기반 전달 함수들, 대수적(로그-기반) 전달 함수들, 및 인간의 시각적 지각에 기초한 전달 함수들, 예를 들어, Dolby Laboratories, Inc.에 의해 제안된 지각 양자화(PQ) 전달 함수를 포함할 수 있지만 이에 제한되는 것은 아니다.

일부 실시예들에서, 코덱에서 비디오 데이터를 표현하기 위해 이용되는 전달 함수는, 입력 비디오 데이터를 표현하기 위해 이용되는 전달 함수(1차 전달 함수로 지칭됨)와 동일할 수 있다. 이러한 실시예들에서, 입력 비디오 데이터는, 장면, 시퀀스, 프레임 또는 구역에 대해 결정된 포커스 범위에 따라 크로핑될 수 있고, 그 다음, 1차 전달 함수에 따라 코덱의 이용가능한 비트들로 맵핑(예를 들어, 양자화)될 수 있다. 포커스 범위, 크로핑 및 맵핑(예를 들어, 양자화) 파라미터들은, 예를 들어, 출력된 인코딩된 스트림에서 메타데이터로서 디코더에 시그널링될 수 있어서, HDR-가능 디스플레이와 같은 디바이스에 대한 전체-범위 비디오 데이터를 생성하기 위한 인버스 적응형 전달 함수 방법이 디코더에서 수행될 수 있다.

그러나, 일부 실시예들에서, 코덱 내의 비디오 데이터를 표현하기 위해, 1차 전달 함수와는 상이한 전달 함수(내부적 또는 2차 전달 함수로 지칭됨)가 이용될 수 있다. 이러한 실시예들에서, 입력 비디오 데이터는, 장면, 시퀀스, 프레임 또는 구역에 대해 결정된 포커스 범위에 대해 크로핑될 수 있고, 그 다음, 2차 전달 함수에 따라 코덱의 이용가능한 비트들로 맵핑, 스케일링 또는 양자화될 수 있다. 2차 전달 함수는, 예를 들어, 코덱 내에서, 1차 전달 함수를 이용하여 행해질 수 있는 것보다 더 높은 정확도로 비디오 신호가 표현되도록 허용할 수 있다. 이러한 실시예들에서, 포커스 범위, 크로핑 및 맵핑(예를 들어 양자화) 파라미터들에 추가로, 비디오 데이터를 2차 전달 함수로부터 1차 전달 함수로 변환하는 방법에 대한 정보가 또한, 예를 들어, 출력 스트림에서의 메타데이터로서 디코더에 시그널링될 수 있다. 이러한 정보는, 2차 전달 함수의 유형(예를 들어, 멱함수 법칙 감마, 로그, PQ 등) 및 전달 함수에 대한 하나 이상의 제어 파라미터들을 포함할 수 있지만, 이에 제한되는 것은 아니다. 일부 실시예들에서, 1차 전달 함수를 설명하는 정보가 또한 시그널링될 수 있다.

적응형 전달 함수 방법의 일부 실시예들에서, 코덱 내에서 이용되는 내부적 또는 2차 전달 함수는, 원래의 또는 1차 전달 함수의 하나 이상의 부분들이 내부적 표현을 위해 유지될 수 있고, 내부적 표현의 나머지에 대해 상이한 전달 함수가 이용될 수 있는 불연속 전달 함수 표현일 수 있다. 이러한 실시예들에서, 유지되는 1차 전달 함수의 구역(들)은, 예를 들어, 표 표현을 이용하여 출력 스트림에서 정확하게 설명 및 시그널링될 수 있다. 상이한 전달 함수에 대한 정보가 또한 시그널링될 수 있다.

도 7a 내지 도 7c에 예시된 바와 같이, 적응형 전달 함수 방법의 실시예들은 프레임 내에서 프레임 레벨로 또는 구역 레벨로 수행될 수 있다. 따라서, 이웃 또는 인근의 인코딩된 및 디코딩된 비디오 프레임들 또는 프레임 내의 구역들은, 상당히 상이한 전달 함수 표현들을 가질 수 있고, 이는, 예를 들어, 인코딩되고 있는 현재의 프레임 또는 구역의 전달 함수 표현이, 인코딩 프로세스에서 이용될 수 있는 이웃 프레임들 또는 구역들의 전달 함수 표현과 상당히 상이할 수 있기 때문에 인코딩(예를 들어, 모션 추정, 모션 보상 및 재구성)에 부정적인 영향을 미칠 수 있다. 그러나, 일부 실시예들에서, 진보된 비디오 코딩(AVC) 및 고효율 비디오 코딩(HEVC) 포맷들과 같은 코딩 포맷들을 이용하여 코덱들에서 제공될 수 있는 가중된 예측이 레버리지되어 인코딩을 상당히 개선시킬 수 있다. 이러한 실시예들에서, 전달 함수 표현들에서 차이들을 조절하기 위해 가중된 예측 프로세스에서 이용될 수 있는 가중 파라미터들이 프레임들 또는 구역들에 제공될 수 있다. 가중 파라미터들은, 예를 들어, 프레임 또는 블록 메타데이터에 파라미터들을 포함시킴으로써 시그널링될 수 있다. 예를 들어, AVC 또는 HEVC 인코더에서, 가중 파라미터들은 슬라이스 헤더 메타데이터에서 시그널링될 수 있고, AVC의 매크로블록 또는 HEVC의 예측 유닛(PU) 내의 기준 인덱스를 변경함으로써 선택될 수 있다. 일부 실시예들에서, 가중 정보는, 슬라이스 헤더에 부분적으로 의존하여 또는 전혀 의존하지 않고, 블록바다 명시적으로 시그널링될 수 있다. 예를 들어, 일부 실시예들에서, 1차 또는 마스터 가중치들이 슬라이스 헤더에서 시그널링될 수 있고, 1차 가중치들을 조절하기 위해 이용될 수 있는 델타들 또는 차이들은 블록 레벨로 시그널링될 수 있다. 일부 실시예들에서, 가중 파라미터들은 또한 색상-가중 정보를 포함할 수 있다. 일부 실시예들에서, 이러한 가중 파라미터들은, 인트라-프레임 예측 뿐만 아니라 인터-프레임 예측에서 이용될 수 있다. 예를 들어, 인트라-프레임 예측에서는, 이전에 프로세싱된 이웃 또는 인근의 데이터(예를 들어, 픽셀들 또는 픽셀들의 블록들)를 이용하는 것 대신에 또는 그에 추가로, 이웃 또는 인근의 샘플들의 가능한 상이한 전달 함수 특성들에 따라 예측기들을 조절하기 위해 이용될 수 있는 추가적인 가중 및 오프셋 파라미터들이 제공될 수 있다.

코덱 내에서 데이터를 표현하기 위해 내부적 또는 2차 전달 함수가 이용되는 일부 실시예들에서는, 가중 파라미터들에 추가로, 2차 전달 함수에 대한 정보가 또한 전달 함수 예측에서의 이용을 위해 코덱에서 시그널링될 수 있다. 일부 실시예들에서, 예를 들어, 2차 전달 함수 정보는, 하나 이상의 전달 함수 조절 파라미터들과 모든 기준 데이터 인덱스를 연관시키는 전달 함수 표를 이용하여 슬라이스 헤더에서 시그널링될 수 있다. 일부 실시예들에서, 2차 전달 함수 정보는, 그 대신, 또는 추가적으로, 블록 레벨로 시그널링될 수 있다. 불연속 전달 함수 표현을 이용하는 실시예들에서, 다수의 가중 파라미터들(예를 들어, 상이한 밝기 값들 또는 레벨들에 상이하게 영향을 미치는 파라미터들)이 슬라이스 헤더에서 및/또는 블록 레벨로 시그널링될 수 있다.