WO2020256101A1 - 画像システムおよび画像システムを備える作業車両 - Google Patents

画像システムおよび画像システムを備える作業車両 Download PDFInfo

- Publication number

- WO2020256101A1 WO2020256101A1 PCT/JP2020/024136 JP2020024136W WO2020256101A1 WO 2020256101 A1 WO2020256101 A1 WO 2020256101A1 JP 2020024136 W JP2020024136 W JP 2020024136W WO 2020256101 A1 WO2020256101 A1 WO 2020256101A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- image

- bird

- crane

- eye view

- processing device

- Prior art date

Links

- 238000012545 processing Methods 0.000 claims abstract description 99

- 239000002131 composite material Substances 0.000 claims abstract description 33

- 240000004050 Pentaglottis sempervirens Species 0.000 claims description 85

- 235000004522 Pentaglottis sempervirens Nutrition 0.000 claims description 85

- 230000002093 peripheral effect Effects 0.000 claims description 16

- 230000000295 complement effect Effects 0.000 description 28

- 238000000034 method Methods 0.000 description 9

- 238000004891 communication Methods 0.000 description 6

- 230000008602 contraction Effects 0.000 description 4

- 238000006243 chemical reaction Methods 0.000 description 3

- 238000012937 correction Methods 0.000 description 3

- 238000010586 diagram Methods 0.000 description 3

- 238000000605 extraction Methods 0.000 description 3

- 239000000284 extract Substances 0.000 description 2

- 238000004804 winding Methods 0.000 description 2

- 230000000694 effects Effects 0.000 description 1

- 239000010720 hydraulic oil Substances 0.000 description 1

- 239000013589 supplement Substances 0.000 description 1

- 230000002194 synthesizing effect Effects 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

Images

Classifications

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B66—HOISTING; LIFTING; HAULING

- B66C—CRANES; LOAD-ENGAGING ELEMENTS OR DEVICES FOR CRANES, CAPSTANS, WINCHES, OR TACKLES

- B66C13/00—Other constructional features or details

- B66C13/18—Control systems or devices

- B66C13/46—Position indicators for suspended loads or for crane elements

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B66—HOISTING; LIFTING; HAULING

- B66C—CRANES; LOAD-ENGAGING ELEMENTS OR DEVICES FOR CRANES, CAPSTANS, WINCHES, OR TACKLES

- B66C23/00—Cranes comprising essentially a beam, boom, or triangular structure acting as a cantilever and mounted for translatory of swinging movements in vertical or horizontal planes or a combination of such movements, e.g. jib-cranes, derricks, tower cranes

- B66C23/88—Safety gear

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T3/00—Geometric image transformations in the plane of the image

- G06T3/40—Scaling of whole images or parts thereof, e.g. expanding or contracting

- G06T3/4038—Image mosaicing, e.g. composing plane images from plane sub-images

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/2621—Cameras specially adapted for the electronic generation of special effects during image pickup, e.g. digital cameras, camcorders, video cameras having integrated special effects capability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/2628—Alteration of picture size, shape, position or orientation, e.g. zooming, rotation, rolling, perspective, translation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/265—Mixing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

- H04N5/272—Means for inserting a foreground image in a background image, i.e. inlay, outlay

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B66—HOISTING; LIFTING; HAULING

- B66C—CRANES; LOAD-ENGAGING ELEMENTS OR DEVICES FOR CRANES, CAPSTANS, WINCHES, OR TACKLES

- B66C13/00—Other constructional features or details

- B66C13/18—Control systems or devices

- B66C13/40—Applications of devices for transmitting control pulses; Applications of remote control devices

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B66—HOISTING; LIFTING; HAULING

- B66C—CRANES; LOAD-ENGAGING ELEMENTS OR DEVICES FOR CRANES, CAPSTANS, WINCHES, OR TACKLES

- B66C2700/00—Cranes

- B66C2700/03—Cranes with arms or jibs; Multiple cranes

- B66C2700/0321—Travelling cranes

- B66C2700/0357—Cranes on road or off-road vehicles, on trailers or towed vehicles; Cranes on wheels or crane-trucks

- B66C2700/0364—Cranes on road or off-road vehicles, on trailers or towed vehicles; Cranes on wheels or crane-trucks with a slewing arm

- B66C2700/0371—Cranes on road or off-road vehicles, on trailers or towed vehicles; Cranes on wheels or crane-trucks with a slewing arm on a turntable

Definitions

- the present invention relates to an image system and a work vehicle including an image system.

- the view of the operator from the cockpit may be obstructed by a boom or the like stored in the vehicle during traveling, and a blind spot may occur.

- the cockpit provided on the swivel turns with the swivel during work, the position and range of the blind spot from the cockpit changes. Therefore, even if the position of the rear-view mirror or the like is devised, it may not be easy to see from the driver's seat.

- the bird's-eye view image system described in Patent Document 1 displays a plurality of cameras that acquire a peripheral image of a work vehicle provided with a swivel table that can turn on a traveling body, and a display that displays a bird's-eye view image based on the images acquired by each camera. It is equipped with a unit and a control unit that converts an image acquired by each camera into an image looking down from a virtual viewpoint above and connects them to generate a bird's-eye view image and display it on the display unit.

- a plurality of cameras are provided on each of the traveling body and the swivel table. The bird's-eye view image system can obtain an appropriate bird's-eye view image by switching the camera used during running and working.

- the bird's-eye view image system configured in this way can obtain a field of view as if a camera is installed above by generating a bird's-eye view image looking down from a virtual viewpoint above.

- the bird's-eye view image system since the bird's-eye view image system generates a bird's-eye view image with a camera provided on the traveling body or the swivel, the very vicinity of the traveling body, a part of the traveling body, and the swivel are not included in the shooting range of the camera. That is, in the bird's-eye view image system, a blind spot is generated in a part of the traveling body, the turning body itself, and the very vicinity of the traveling vehicle, and it is necessary for the operator to visually recognize the vehicle.

- An object of the present invention is an image system and an image system capable of generating an image of a range covering the entire circumference of a work vehicle including the entire work vehicle and the immediate vicinity of the work vehicle from an image actually taken.

- the purpose is to provide a work vehicle.

- the present invention is communicably connected to a photographing device provided on a traveling body of a work vehicle having a boom, and the photographing device captures a plurality of peripheral images seamlessly over the entire circumference of the traveling body.

- the photographing device includes an image processing device that generates a composite image based on the traveling body and an upper image obtained by photographing the periphery of the traveling body from above, and a display device that displays the composite image.

- the image processing device converts the plurality of peripheral images into an image viewed from an upper virtual viewpoint and joins them to generate a bird's-eye view image, and one missing portion of the bird's-eye view image and the upper image is combined with the other corresponding portion.

- the composite image is generated by superimposing.

- the present invention has the following effects.

- the present invention by synthesizing the upper image of the work vehicle and the bird's-eye view image around the work vehicle, the missing portion in the upper image and the bird's-eye view image is supplemented with the image actually taken. As a result, it is possible to generate an image of the entire circumference of the work vehicle including the entire work vehicle and the immediate vicinity of the work vehicle from the image actually taken.

- FIG. 6 shows images taken by the vehicle body camera and the upper camera.

- FIG. 6A shows a bird's-eye view image generated from the peripheral image taken by the vehicle body camera

- FIG. 6B shows a complementary image generated from the upper image taken by the upper camera.

- FIG. 8 shows the relationship between the turning of the swivel table in the crane and the display mode of the bird's-eye view image.

- FIG. 8A shows a state in which the swivel table of the crane is swiveled

- FIG. 8B shows a composite image displayed in rotation.

- FIG. 12 shows another embodiment in the superimposed image generation step.

- FIG. 12A shows a missing portion in the upper image of the crane

- FIG. 12B shows a complementary image corresponding to the missing portion in the bird's-eye view image

- FIG. 12C shows a composite image in which the complementary image is superimposed on the missing portion in the upper image.

- the crane 1 which is an embodiment of the work vehicle in the present invention will be described below with reference to FIGS. 1 and 2.

- the rough terrain crane will be described, but any work vehicle having a boom such as an all-terrain crane, a truck crane, a loaded truck crane, and an aerial work platform may be used.

- the crane 1 is a mobile crane that can move to an unspecified place.

- the crane 1 has a vehicle 2 which is a traveling body, a crane device 6 which is a working device, a control device 30, and a remote control terminal 39 (see FIG. 2) capable of remotely controlling the crane device 6.

- the crane 1 includes an image system 31 (see FIG. 2).

- the vehicle 2 is a moving body that conveys the crane device 6.

- the vehicle 2 has a plurality of wheels 3 and runs on the engine 4 as a power source.

- the vehicle 2 is provided with an outrigger 5.

- the vehicle 2 can expand the workable range of the crane 1 by extending the outrigger 5 in the width direction of the vehicle 2 and grounding the jack cylinder.

- the crane device 6 is a device for lifting the luggage W with a wire rope.

- the crane device 6 includes a swivel base 7, a swivel hydraulic motor 8, a boom 9, a main hook block 10, a sub hook block 11, an undulating hydraulic cylinder 12, a main winch 13, a main hydraulic motor 13a, a main wire rope 14, and a sub. It includes a winch 15, a sub hydraulic motor 15a, a sub wire rope 16, a cabin 17, and the like.

- the swivel base 7 is a device that swivels the crane device 6.

- the swivel base 7 is rotatably configured with the center of the annular bearing as the center of rotation.

- the swivel base 7 is provided with a swivel hydraulic motor 8 which is an actuator.

- the swivel base 7 is configured to be swivelable in one direction and the other direction by a swivel hydraulic motor 8.

- the swivel hydraulic motor 8 is rotated by a swivel valve 23 (see FIG. 2), which is an electromagnetic proportional switching valve.

- the swivel valve 23 can control the flow rate of the hydraulic oil supplied to the swivel hydraulic motor 8 to an arbitrary flow rate.

- the swivel 7 is provided with a swivel sensor 27 (see FIG. 2) that detects a swivel angle ⁇ 2, which is the swivel angle of the swivel 7 from the reference position.

- the boom 9 is a beam member that supports the wire rope so that the luggage W can be lifted.

- the boom 9 is provided so that the base end of the base boom member can swing at substantially the center of the swivel base 7.

- the boom 9 is configured to be expandable and contractible in the axial direction by moving each boom member by an expansion / contraction hydraulic cylinder (not shown) which is an actuator. Further, the boom 9 is provided with a jib 9a.

- the suspended load camera 9b (see FIG. 2) is a photographing device that photographs the luggage W and the features around the luggage W.

- the suspended load camera 9b is provided at the tip of the boom 9.

- the suspended load camera 9b is configured to be capable of photographing the features and terrain around the load W and the crane 1 from vertically above the load W.

- the expansion / contraction hydraulic cylinder is expanded / contracted by the expansion / contraction valve 24 (see FIG. 2), which is an electromagnetic proportional switching valve.

- the boom 9 is provided with a telescopic sensor 28 for detecting the length of the boom 9, a weight sensor for detecting the weight of the luggage W, and the like.

- the main hook block 10 and the sub hook block 11 are members for hanging the luggage W.

- the main hook block 10 is provided with a plurality of hook sheaves around which the main wire rope 14 is wound and a main hook 10a for suspending the luggage W.

- the sub-hook block 11 is provided with a sub-hook 11a for suspending the luggage W.

- the undulating hydraulic cylinder 12 is an actuator that raises and lays down the boom 9 and holds the posture of the boom 9.

- the undulating hydraulic cylinder 12 is expanded and contracted by the undulating valve 25 (see FIG. 2), which is an electromagnetic proportional switching valve.

- the boom 9 is provided with an undulation sensor 29 (see FIG. 2) that detects the undulation angle ⁇ 1 of the boom 9.

- the main winch 13 and the sub winch 15 carry out (winding up) and unwinding (winding down) the main wire rope 14 and the sub wire rope 16.

- the main winch 13 is rotated by a main hydraulic motor 13a in which the main drum around which the main wire rope 14 is wound is an actuator

- the sub winch 15 is a sub hydraulic motor in which the sub drum around which the sub wire rope 16 is wound is an actuator. It is configured to be rotated by 15a.

- the main hydraulic motor 13a is rotationally operated by the main valve 26m (see FIG. 2), which is an electromagnetic proportional switching valve.

- the main winch 13 is configured to control the main hydraulic motor 13a by a main valve 26m so that it can be operated at an arbitrary feeding and feeding speed.

- the sub winch 15 is configured to control the sub hydraulic motor 15a by a sub valve 26s (see FIG. 2), which is an electromagnetic proportional switching valve, so that the sub winch 15 can be operated at an arbitrary feeding and feeding speed.

- the cabin 17 is mounted on the swivel table 7.

- a cockpit (not shown) is provided.

- an operation tool for operating the vehicle 2 and a turning operation tool 18 for operating the crane device 6, an undulation operation tool 19, a telescopic operation tool 20, a main drum operation tool 21m, a sub-drum operation tool 21s, etc. is provided.

- the communication device 22 receives the control signal from the remote control terminal 39 via the wide area information communication network or the like, and transmits the control information or the like from the crane device 6 via the wide area information communication network or the like. It is a device to do.

- the communication device 22 is provided in the cabin 17.

- the communication device 22 is configured to transfer the control signal or the like from the remote control terminal 39 to the control device 30 of the crane 1.

- the control device 30 is a device that controls the actuator of the crane 1 via each operation valve.

- the control device 30 is provided in the cabin 17.

- the control device 30 may be substantially configured such that a CPU, ROM, RAM, HDD, etc. are connected by a bus, or may be configured to be composed of a one-chip LSI or the like.

- the control device 30 stores various programs and data for controlling the operation of each actuator, switching valve, sensor, and the like.

- the control device 30 is connected to the suspended load camera 9b, the swivel operating tool 18, the undulating operating tool 19, the telescopic operating tool 20, the main drum operating tool 21m, and the sub-drum operating tool 21s, acquires the image of the suspended load camera 9b, and swivels. It is possible to acquire the operating amounts of the operating tool 18, the undulating operating tool 19, the main drum operating tool 21m, and the sub-drum operating tool 21s.

- the control device 30 is connected to the communication device 22 and can acquire a control signal from the remote control terminal 39 and transmit control information from the crane device 6 and an image from the suspended load camera 9b.

- the control device 30 is connected to the swivel valve 23, the telescopic valve 24, the undulation valve 25, the main valve 26m and the sub valve 26s, and is connected to the swivel valve 23, the undulation valve 25, the main valve 26m and the sub.

- a control signal can be transmitted to the valve 26s.

- the control device 30 is connected to the swivel sensor 27, the telescopic sensor 28, and the undulation sensor 29, and acquires posture information such as the swivel angle ⁇ 2, boom length, and undulation angle ⁇ 1 of the swivel base 7 and the weight of the luggage W. be able to.

- the control device 30 can generate a control signal corresponding to each operation tool based on the operation amounts of the turning operation tool 18, the undulation operation tool 19, the expansion / contraction operation tool 20, the main drum operation tool 21m, and the sub drum operation tool 21s. ..

- the image system 31 is a system that combines the peripheral image of the crane 1 and the upper image to generate an image of the entire circumference of the crane 1.

- the image system 31 is provided in the cabin 17 of the crane 1 and is connected to the control device 30.

- the image system 31 is connected to the control device 30 and can acquire the turning angle ⁇ 2 of the swivel base 7 and the undulation angle ⁇ 1 of the boom 9 from the control device 30. Further, the image system 31 can acquire an operation signal for grounding the jack cylinder of the outrigger 5 from the control device 30.

- the crane 1 configured in this way can move the crane device 6 to an arbitrary position by traveling the vehicle 2. Further, in the crane 1, the boom 9 is erected at an arbitrary undulation angle ⁇ 1 by the undulating hydraulic cylinder 12 by the operation of the undulation operating tool 19, and the boom 9 is extended to an arbitrary boom length by the operation of the telescopic operating tool 20. By doing so, the lift and working radius of the crane device 6 can be expanded. Further, the crane 1 can convey the luggage W by lifting the luggage W by the sub-drum operating tool 21s or the like and turning the swivel base 7 by operating the swivel operating tool 18.

- the image system 31 is a system that combines the bird's-eye view image P1 around the crane 1 and the complementary image P2 extracted from the upper image to generate a composite image P3 over the entire circumference of the crane 1 including the crane 1.

- the image of the entire circumference of the crane 1 is an image of the vehicle 2 of the crane 1 and the ground (running surface) and features surrounding the vehicle 2 when viewed from above (above) in the vertical direction of the crane 1. Yes, it is an image of the ground and a feature in a region from a position adjacent to the vehicle 2 to a position at a predetermined distance centered on the vehicle 2 (see FIG. 6).

- the image system 31 includes a vehicle body front camera 32, a vehicle body rear camera 33, a vehicle body right camera 34, a vehicle body left camera 35, and a boom 9 which are vehicle body cameras provided in the vehicle 2.

- the upper camera 36, the display device 37, and the image processing device 38 provided in the above are provided.

- the vehicle body front camera 32, the vehicle body rear camera 33, the vehicle body right camera 34, the vehicle body left camera 35, and the upper camera 36 correspond to the "photographing device" of the present invention and are communicably connected to the image processing device 38.

- the vehicle body front camera 32, the vehicle body rear camera 33, the vehicle body right camera 34, and the vehicle body left camera 35 are composed of, for example, a wide-angle camera having an angle of view of approximately 180 degrees.

- the vehicle body front camera 32 is provided at the front end portion, which is the end portion of the vehicle 2 on the forward direction side.

- the vehicle body front camera 32 captures an image in front of the vehicle 2.

- the vehicle body rear camera 33 is provided at the rear end portion, which is the end portion of the vehicle 2 on the reverse direction side.

- the vehicle body rear camera 33 captures an image of the rear of the vehicle 2.

- the vehicle body right side camera 34 is provided on the right side surface of the vehicle 2 in the traveling direction.

- the vehicle body right camera 34 captures an image on the right side of the vehicle 2.

- the vehicle body left camera 35 is provided on the left side surface of the vehicle 2 in the traveling direction.

- the vehicle body left camera 35 captures an image of the left side of the vehicle 2. It is sufficient that each vehicle body camera is provided at a position where an image of the periphery of the vehicle 2 can be continuously acquired over the entire circumference.

- the upper camera 36 is composed of, for example, a wide-angle camera having an angle of view of approximately 180 degrees.

- the upper camera 36 is provided at the tip of the base boom member swingably supported by the swivel base 7 in the boom 9 (see FIG. 1).

- the upper camera 36 acquires an upper image of the crane 1 which is an image of the vehicle 2 and the surroundings of the vehicle 2 from above the vehicle 2 in the upright state of the boom 9.

- the upper camera 36 is provided on the base boom member, but is provided on a portion where an upper image of the crane 1 which is an image of the vehicle 2 and the periphery of the vehicle 2 can be acquired from above the vehicle 2. It suffices if it is done.

- the display device 37 is a device that displays images of each vehicle body camera and the upper camera 36.

- the display device 37 is arranged inside the cabin 17.

- the display device 37 may be provided on the remote control terminal 39 that remotely controls the crane 1 outside the cabin 17.

- the image processing device 38 is a processing device that converts and combines the peripheral image of the crane 1 taken by each vehicle body camera and the upper image of the crane 1 taken by the upper camera 36.

- the image processing device 38 is provided in the cabin 17.

- the image processing device 38 may substantially have a configuration in which a CPU, ROM, RAM, HDD, etc. are connected by a bus, or may have a configuration including a one-chip LSI or the like.

- the image processing device 38 controls each vehicle body camera, the upper camera 36, and each sensor, acquires an image or a signal from the sensor, and stores various programs and data for performing image processing.

- the image processing device 38 is connected to the vehicle body front camera 32, the vehicle body rear camera 33, the vehicle body right camera 34, the vehicle body left camera 35, and the upper camera 36, and is connected to the vehicle body front camera 32, the vehicle body rear camera 33, and the vehicle body right camera 34.

- the peripheral image of the crane 1 taken by the left side camera 35 of the vehicle body and the upper image of the crane 1 taken by the upper camera 36 can be acquired.

- the image processing device 38 is connected to the display device 37 and can transmit the generated image to the display device 37.

- the image processing device 38 includes a bird's-eye view image P1 (its image data) based on signals from each vehicle body camera, a complementary image P2 (its image data) based on a signal from the upper camera 36, and a composite image of the bird's-eye view image P1 and the complementary image P2. Controls such as generation processing of P3 (the image data), display processing of displaying the composite image P3 on the display device 37, acquisition processing of various acquired information, and the like.

- the image processing device 38 is a bird's-eye image generation step of generating a bird's-eye view image P1 from the peripheral images of the crane 1 taken by the vehicle body front camera 32, the vehicle body rear camera 33, the vehicle body right camera 34, and the vehicle body left camera 35 every unit time. Can be carried out (see FIG. 10).

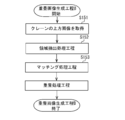

- the bird's-eye view image generation step is composed of, for example, a distortion correction processing step (step S121), a bird's-eye view conversion processing step (step S122), and an image combination processing step (step S123). If the image processing device 38 generates the bird's-eye view image P1, each of these processes may be performed at the same time, or other processes may be performed.

- the image processing device 38 multiplies the coordinate value of the input pixel of the image taken by each vehicle body camera by a coefficient based on the lens distortion coefficient, the aspect ratio, etc., and converts it into the coordinate value of the output pixel. Correct the distortion caused by the lens.

- the image processing apparatus 38 forms all the coordinate values of the output pixels by multiplying the coordinate values of the input pixels appropriately selected by various coefficients based on the camera mounting angle and the like, thereby forming all the coordinate values above the crane 1. Converts to a captured image (individual bird's-eye view image) looking down from the virtual viewpoint set in.

- the image processing device 38 linearly interpolates the brightness of the corresponding coordinate values to eliminate the discomfort of the joint, and performs the above-mentioned processing, and the adjacent individual bird's-eye view images from the vehicle body cameras. Are joined as one image to generate a bird's-eye view image P1.

- the image processing device 38 generates a complementary image P2 which is an image of a portion corresponding to the missing portion of the bird's-eye view image P1 in the upper image of the crane 1 taken by the upper camera 36, and the complementary image P2 is generated in the missing portion of the bird's-eye view image P1. It is possible to carry out a superimposed image generation step of generating a composite image P3 on which the above is superimposed every unit time (see FIG. 11).

- the superimposed image generation step is composed of, for example, a region extraction processing step (step S152), a matching processing step (step S153), and a superimposing processing step (step S154).

- the image processing device 38 may perform each of these processes at the same time, or may perform processes of other contents.

- the missing portion of the bird's-eye view image P1 is a portion corresponding to an image of the vehicle 2 and the swivel 7 of the crane 1 not included in the field of view of each vehicle body camera.

- the image processing apparatus extracts a closed region from the upper image of the crane 1 taken by the upper camera 36 by a known method such as binarization.

- the image processing device 38 uses a pre-registered image of the vehicle 2 as a reference image, slides the reference image on the upper image, and compares the region extracted in the upper image with the reference image.

- the image processing device 38 specifies a region having a high degree of similarity to the reference image as the complementary image P2 corresponding to the vehicle 2.

- the image processing device 38 cuts out the specified complementary image P2 and corrects the distortion by multiplying it by a coefficient based on the lens distortion coefficient, the aspect ratio, or the like so as to fit the missing portion of the bird's-eye view image P1. Further, the image processing device 38 generates the composite image P3 in a state in which the corrected complementary image P2 is superimposed on the bird's-eye view image P1.

- the image system 31 configured in this way has a bird's-eye view image P1 as a unit from the peripheral images of the crane 1 taken by the vehicle body front camera 32, the vehicle body rear camera 33, the vehicle body right camera 34, and the vehicle body left camera 35, which are vehicle body cameras. It can be generated hourly. Further, the image system 31 can generate a complementary image P2 which is an image of a portion corresponding to the missing portion of the bird's-eye view image P1 from the upper image of the crane 1 taken by the upper camera 36 every unit time. Further, the image system 31 can synthesize a composite image P3 in which the complementary image P2 is superimposed on the missing portion of the bird's-eye view image P1 generated from the image around the vehicle body 2 every unit time.

- the traveling state of the crane 1 means a state in which the boom 9 is not realistically used and the upper camera 36 is laid down to a reference angle ⁇ or less in which a sufficient field of view cannot be secured.

- the working mode of the crane 1 means a state in which the boom 9 is upright from the reference angle ⁇ .

- the image processing device 38 of the image system 31 starts photographing the surroundings of the crane 1 with the vehicle body front camera 32, the vehicle body rear camera 33, the vehicle body right camera 34, and the vehicle body left camera 35.

- the image processing device 38 acquires the undulation angle ⁇ 1 of the boom 9 from the control device 30 of the crane 1.

- the image processing device 38 determines that the crane 1 is in the traveling mode.

- the image processing device 38 determines that the crane 1 is in the working mode when the undulation angle ⁇ 1 of the boom 9 acquired from the control device 30 of the crane 1 is larger than the reference angle ⁇ .

- the image processing device 38 carries out a bird's-eye view image generation step, and generates a bird's-eye view image P1 from the peripheral image of the crane 1 taken by each vehicle body camera every unit time.

- the image processing device 38 generates a front-viewed image (hereinafter, simply referred to as “overhead image”) A1 viewed from a virtual viewpoint set above the crane 1 from the image taken by the vehicle body front camera 32.

- the image processing device 38 generates a rear bird's-eye view image A2 from the image taken by the vehicle body rear camera 33, generates a right bird's-eye view image A3 from the image taken by the vehicle body right camera 34, and generates a right bird's-eye view image A3 from the image taken by the vehicle body right camera 34. Generates a left bird's-eye view image A4 from the image taken by.

- the image processing device 38 connects the front bird's-eye view image A1, the rear bird's-eye view image A2, the right bird's-eye view image A3, and the left bird's-eye view image A4 as one bird's-eye view image to generate the bird's-eye view image P1.

- the portion of the crane 1 corresponding to the vehicle 2 is generated as a missing portion A5 that cannot be photographed by the vehicle body camera.

- the range surrounded by the ring in FIGS. 7, 8 and 12 is the range displayed on the display device 37.

- the image processing device 38 determines that the crane 1 is in the work mode, it executes a superimposed image generation step, and in the upper image of the crane 1 taken by the upper camera 36, the bird's-eye view image P1 is taken.

- the image processing device 38 performs a superimposed image generation step, superimposes the complementary image P2 on the missing portion A5 of the bird's-eye view image P1, and creates a composite image P3 based on the bird's-eye view image P1 every unit time. To generate.

- the image processing device 38 acquires the turning angle ⁇ 2 of the swivel base 7 from the control device 30 of the crane 1.

- the image processing device 38 acquires the swivel as a swivel angle ⁇ 2.

- the image processing device 38 rotates the composite image P3 counterclockwise by an angle ⁇ 2 and displays it on the display device 37. That is, in the image processing device 38, when the swivel table 7 is swiveled by an arbitrary angle in one direction, the swivel table 7 reconstructs the composite image P3 in which the missing portion in the bird's-eye view image P1 is supplemented by the complementary image P2. It is displayed by rotating it by the angle of rotation. By controlling in this way, the image system 31 is displayed on the display device 37 so that the composite image P3 is interlocked with the rotation of the swivel table 7 with reference to the swivel table 7. As a result, the entire circumference of the crane 1, including the entire crane 1 and the very vicinity of the crane 1, is displayed based on the cockpit reference, so that the operator can grasp the positional relationship between the circumference of the crane 1 and the boom 9. easy.

- the crane 1 is operated by an operating tool provided in the cabin 17, but may be controlled by a remote control terminal 39.

- step S110 of the image processing control the image processing device 38 starts shooting with the vehicle body front camera 32, the vehicle body rear camera 33, the vehicle body right camera 34, and the vehicle body left camera 35, and the crane.

- the peripheral image of 1 is acquired, and the step is shifted to step S120.

- step S120 the image processing device 38 starts the bird's-eye view image generation step A and shifts the step to step S121 (see FIG. 10).

- step S121 in the bird's-eye view image generation step A the image processing device 38 corrects the distortion of the acquired image due to the lens as a distortion correction processing step, and shifts the step to step S122.

- step S122 the image processing device 38 converts the acquired peripheral image of the crane 1 into a front bird's-eye view image A1, a rear bird's-eye view image A2, a right-side bird's-eye view image A3, and a left-side bird's-eye view image A4 as a bird's-eye view conversion processing step.

- step S123 the image processing device 38 converts the acquired peripheral image of the crane 1 into a front bird's-eye view image A1, a rear bird's-eye view image A2, a right-side bird's-eye view image A3, and a left-side bird's-eye view image A4 as a bird's-eye view conversion processing step.

- step S123 the image processing device 38 generates a bird's-eye view image P1 by joining adjacent individual bird's-eye view images from each vehicle body camera that has performed each process as one image as an image combining processing step.

- the generation step A is completed, and the step is shifted to step S130 (see FIG. 9).

- step S130 the image processing device 38 acquires the undulation angle ⁇ 1 of the boom 9 from the control device 30 of the crane 1, and causes the step to follow step S140.

- step S140 the image processing device 38 determines whether or not the acquired undulation angle ⁇ 1 of the boom 9 is larger than the reference angle ⁇ .

- the image processing device 38 shifts the step to step S150.

- the image processing device 38 shifts the step to step S160.

- step S150 the image processing device 38 starts the superimposed image generation step B and shifts the step to step S151 (see FIG. 11).

- step S151 in the superimposed image generation step B the image processing device 38 starts shooting with the upper camera 36, acquires an upper image of the crane 1, and shifts the step to step S152.

- step S152 the image processing apparatus 38 extracts a closed region from the upper image of the crane 1 by a known method such as binarization as an region extraction processing step, and shifts the step to step S153.

- step S153 as a matching processing step, the image processing device 38 compares the region extracted in the upper image of the crane 1 with the reference image, identifies the region having a high degree of similarity as the complementary image P2 corresponding to the vehicle 2. The step is moved to step 154.

- step S154 as a superimposition processing step, the image processing device 38 cuts out the complementary image P2 and corrects it so as to fit the missing portion of the bird's-eye view image P1, and superimposes the complementary image P2 on the bird's-eye view image P1 to superimpose the complementary image P1 on the bird's-eye view image P1.

- the composite image P3 based on the above is generated, the superimposed image generation step B is completed, and the step is shifted to step S160 (see FIG. 9).

- step S160 the image processing device 38 causes the display device 37 to display the generated image, and shifts the step to step S110.

- the image processing device 38 of the image system 31 determines whether the crane 1 is in the traveling mode or the working mode based on the undulation angle ⁇ 1 of the boom 9. Therefore, the image system 31 always captures the upper image of the crane 1 as long as the upper camera 36 can capture the upper image of the crane 1. That is, in the image processing system, the entire circumference of the crane 1 is photographed by a camera suitable for photographing according to the state of the crane 1.

- the image system 31 generates a bird's-eye view image P1 in the traveling mode, and generates a composite image P3 based on the bird's-eye view image P1 in the working mode.

- the composite image P3 is superposed with the complementary image P2 of the vehicle 2 taken by the upper camera 36, the portion that cannot be taken by the vehicle body camera is supplemented. Therefore, the composite image P3 of the image system is displayed in real time even when an operator or the like rises on the vehicle 2 during the work. As a result, it is possible to generate an image of the entire circumference of the crane 1 including the crane 1 and the very vicinity of the crane 1 from the image actually taken.

- the composite image P3 superimposes the complementary image P2 on the missing portion of the bird's-eye view image P1 generated based on the peripheral image of the crane 1 taken by the vehicle body camera, but the upper camera 36 takes a picture.

- the corresponding portion of the bird's-eye view image P1 may be superimposed and displayed on the missing portion of the upper image of the crane 1.

- the boom 9 enters the field of view of the upper camera 36 depending on the undulation angle ⁇ 1 of the boom 9, and a missing portion A6 in which the photographing area is blocked occurs. Therefore, in the image processing device 38 of the image system 31, a missing portion A6 blocked by the boom 9 according to the undulation angle ⁇ 1 of the boom 9 is registered in the image processing device 38 of the upper camera 36 for each undulation angle ⁇ 1 of the boom 9. There is.

- the image processing device 38 specifies a region having a shape corresponding to the missing portion A6 of the upper image from the undulation angle ⁇ 1 of the boom 9. Further, the image processing device 38 identifies a position corresponding to the missing portion A6 of the upper image from the turning angle ⁇ 2 of the turning table 7 in the bird's-eye view image P1. Then, the image processing device 38 cuts out the position specified in the region of the specified shape from the bird's-eye view image P1 and generates it as the complementary image P4.

- the image processing device 38 generates a composite image P5 in which the complementary image P4 is superimposed on the upper image of the crane 1. That is, the image processing device 38 generates a composite image P5 based on the upper image of the crane 1.

- the image system 31 supplements the missing portion in the upper image with the image actually taken by combining the complementary image P4 and the bird's-eye view image P1.

- the crane 1 is provided with each vehicle body camera on the front end portion, the rear end portion, and the left and right side surfaces of the vehicle 2, but the front end portion, the rear end portion, and the left and right side surfaces of the swivel base 7. It may be provided in. Further, the image processing device 38 of the image system 31 determines the traveling mode and the working mode of the crane 1 based on the undulation angle ⁇ 1 of the boom 9, but the operating state of the outrigger 5 and the turning angle ⁇ 2 of the swivel table 7 are determined. The traveling mode and the working mode of the crane 1 may be determined based on a state or a control signal that always occurs only in the working mode.

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Mechanical Engineering (AREA)

- Automation & Control Theory (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Jib Cranes (AREA)

- Closed-Circuit Television Systems (AREA)

Abstract

Description

6 クレーン装置

9 ブーム

30 制御装置

31 画像システム

32 車体前方カメラ

33 車体後方カメラ

34 車体右方カメラ

35 車体左方カメラ

36 上部カメラ

37 表示装置

P1 俯瞰画像

P2 補完画像

P3 合成画像

Claims (11)

- ブームを有する作業車両の走行体に設けられた撮影装置と通信可能に接続され、前記撮影装置が前記走行体の周辺を全周に亘り切れ目なく撮影した複数の周辺画像と前記撮影装置が前記走行体および前記走行体の周辺を上方から撮影した上方画像とに基づいて、合成画像を生成する画像処理装置と、

前記合成画像を表示する表示装置と、を有し、

前記画像処理装置は、

前記複数の周辺画像を上方の仮想視点から見下ろした画像に変換し繋ぎ合わせて俯瞰画像を生成し、

前記俯瞰画像および前記上方画像の一方の欠落部分に他方の該当する部分を重畳して前記合成画像を生成する、

画像システム。 - 前記画像処理装置は、前記俯瞰画像の欠落部分に前記上方画像の該当する部分を重畳する、

請求項1に記載の画像システム。 - 前記画像処理装置は、前記上方画像の欠落部分に前記俯瞰画像の該当する部分を重畳する、

請求項1に記載の画像システム。 - 前記走行体には、旋回台を介して前記ブームが設けられており、

前記画像処理装置は、前記旋回台が一方向に旋回した場合、前記表示装置に表示中の前記合成画像を、他方向に前記旋回台が旋回した角度だけ回転させる、

請求項1から請求項3のいずれか一項に記載の画像システム。 - 前記ブームは、起伏可能であり、

前記画像処理装置は、

前記俯瞰画像の生成中に前記ブームの起伏角度が基準角度を超えた場合、前記合成画像の生成を開始する、

請求項1から請求項4のいずれか一項に記載の画像システム。 - 前記画像処理装置は、

前記作業車両が走行モードの場合、前記俯瞰画像を生成し、前記作業車両が作業モードの場合、前記合成画像を生成する、

請求項1から請求項5のいずれか一項に記載の画像システム。 - 前記撮影装置は、前記複数の周辺画像を撮影する複数の車体カメラと、前記上方画像を撮影する上部カメラと、を含む、

請求項1から請求項6のいずれか一項に記載の画像システム。 - 前記画像処理装置は、前記旋回台に搭載されたキャビン内に設けられている、

請求項1から請求項7のいずれか一項に記載の画像システム。 - 前記表示装置は、前記旋回台に搭載されたキャビンの内部に配置されている、

請求項1から請求項8のいずれか一項に記載の画像システム。 - 前記表示装置は、前記旋回台に搭載されたキャビンの外部で前記作業車両を遠隔操作する遠隔操作端末に設けられている、

請求項1から請求項8のいずれか一項に記載の画像システム。 - 請求項1から請求項9のいずれか一項に記載の画像システムを備える作業車両。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP20826038.0A EP3988491A4 (en) | 2019-06-20 | 2020-06-19 | IMAGE SYSTEM AND CONSTRUCTION MACHINE PROVIDED WITH THE IMAGE SYSTEM |

| JP2021526916A JPWO2020256101A1 (ja) | 2019-06-20 | 2020-06-19 | |

| US17/615,756 US20220315391A1 (en) | 2019-06-20 | 2020-06-19 | Image system and work vehicle provided with image system |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2019-114943 | 2019-06-20 | ||

| JP2019114943 | 2019-06-20 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2020256101A1 true WO2020256101A1 (ja) | 2020-12-24 |

Family

ID=74040508

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2020/024136 WO2020256101A1 (ja) | 2019-06-20 | 2020-06-19 | 画像システムおよび画像システムを備える作業車両 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US20220315391A1 (ja) |

| EP (1) | EP3988491A4 (ja) |

| JP (1) | JPWO2020256101A1 (ja) |

| WO (1) | WO2020256101A1 (ja) |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2011151742A (ja) * | 2010-01-25 | 2011-08-04 | Tadano Ltd | 画像表示システム |

| JP2015139158A (ja) * | 2014-01-23 | 2015-07-30 | クラリオン株式会社 | 重機用周辺監視装置 |

| WO2018047954A1 (ja) * | 2016-09-09 | 2018-03-15 | 株式会社タダノ | 俯瞰画像システム、俯瞰画像表示方法及びプログラム |

| JP2018095449A (ja) | 2016-12-15 | 2018-06-21 | 株式会社タダノ | 遠隔操作端末 |

| WO2019077993A1 (ja) * | 2017-10-17 | 2019-04-25 | 株式会社タダノ | 作業車両 |

| JP2019114943A (ja) | 2017-12-25 | 2019-07-11 | 株式会社メガチップス | 送信回路及び該送信回路の制御方法 |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5269026B2 (ja) * | 2010-09-29 | 2013-08-21 | 日立建機株式会社 | 作業機械の周囲監視装置 |

| JP6080450B2 (ja) * | 2012-09-21 | 2017-02-15 | 株式会社タダノ | 監視カメラ装置 |

| CN107406035B (zh) * | 2015-03-31 | 2020-09-25 | 株式会社小松制作所 | 工程作业机械 |

| JP6756554B2 (ja) * | 2016-09-09 | 2020-09-16 | 株式会社タダノ | 画像表示システム |

| CN110114244B (zh) * | 2017-02-17 | 2023-07-04 | 住友重机械工业株式会社 | 工作机械用周边监视系统 |

| JP6958216B2 (ja) * | 2017-10-17 | 2021-11-02 | 株式会社タダノ | 作業車両 |

| JP7095287B2 (ja) * | 2018-01-22 | 2022-07-05 | コベルコ建機株式会社 | 旋回式油圧作業機械 |

| JP7151532B2 (ja) * | 2019-02-14 | 2022-10-12 | 株式会社タダノ | クレーンおよびクレーンの経路生成システム |

-

2020

- 2020-06-19 EP EP20826038.0A patent/EP3988491A4/en active Pending

- 2020-06-19 WO PCT/JP2020/024136 patent/WO2020256101A1/ja active Application Filing

- 2020-06-19 US US17/615,756 patent/US20220315391A1/en active Pending

- 2020-06-19 JP JP2021526916A patent/JPWO2020256101A1/ja active Pending

Patent Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2011151742A (ja) * | 2010-01-25 | 2011-08-04 | Tadano Ltd | 画像表示システム |

| JP2015139158A (ja) * | 2014-01-23 | 2015-07-30 | クラリオン株式会社 | 重機用周辺監視装置 |

| WO2018047954A1 (ja) * | 2016-09-09 | 2018-03-15 | 株式会社タダノ | 俯瞰画像システム、俯瞰画像表示方法及びプログラム |

| JP2018095449A (ja) | 2016-12-15 | 2018-06-21 | 株式会社タダノ | 遠隔操作端末 |

| WO2019077993A1 (ja) * | 2017-10-17 | 2019-04-25 | 株式会社タダノ | 作業車両 |

| JP2019114943A (ja) | 2017-12-25 | 2019-07-11 | 株式会社メガチップス | 送信回路及び該送信回路の制御方法 |

Non-Patent Citations (1)

| Title |

|---|

| See also references of EP3988491A4 |

Also Published As

| Publication number | Publication date |

|---|---|

| JPWO2020256101A1 (ja) | 2020-12-24 |

| US20220315391A1 (en) | 2022-10-06 |

| EP3988491A4 (en) | 2023-08-02 |

| EP3988491A1 (en) | 2022-04-27 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US11292699B2 (en) | Remote operation terminal and work vehicle provided with remote operation terminal | |

| CN110062744B (zh) | 远程操作终端及具备远程操作终端的作业车辆 | |

| JP6321977B2 (ja) | 重機用周辺監視装置 | |

| JP7091729B2 (ja) | 遠隔操作端末および遠隔操作端末を備える作業車両 | |

| JP2008312004A (ja) | カメラシステム及び機械装置 | |

| WO2020235681A1 (ja) | 遠隔操作端末および遠隔操作端末を備える移動式クレーン | |

| JP7087475B2 (ja) | 遠隔操作端末および遠隔操作端末を備える移動式クレーン | |

| JP2011151742A (ja) | 画像表示システム | |

| WO2020153325A1 (ja) | クレーン | |

| JP7114950B2 (ja) | 遠隔操作端末及び作業車両 | |

| JP7099150B2 (ja) | クレーン及び情報共有システム | |

| WO2014119711A1 (ja) | 運搬機械の位置調整システム | |

| KR101811926B1 (ko) | 무인비행체를 이용한 타워크레인의 운전 보조시스템 및 이를 이용한 타워크레인의 영상 제공 방법 | |

| CN111052734B (zh) | 作业车辆 | |

| WO2020256101A1 (ja) | 画像システムおよび画像システムを備える作業車両 | |

| JP6713884B2 (ja) | 俯瞰画像システム、俯瞰画像表示方法およびプログラム | |

| WO2020080434A1 (ja) | クレーン装置 | |

| JP7172199B2 (ja) | 遠隔操作端末及び作業車両 | |

| JP6958216B2 (ja) | 作業車両 | |

| JP6919548B2 (ja) | 遠隔操作端末および遠隔操作端末を備える作業車両 | |

| JPWO2019163875A1 (ja) | カメラ装置、吊荷監視システム、及び、作業機 | |

| JP7167464B2 (ja) | 遠隔操作端末および遠隔操作端末を備える作業車両 | |

| JP7167469B2 (ja) | 遠隔操作端末および遠隔操作端末を備える作業車両 | |

| JP7143578B2 (ja) | 作業車両 | |

| JP2022166669A (ja) | アウトリガ装置の設置位置表示システム及び作業車両 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| 121 | Ep: the epo has been informed by wipo that ep was designated in this application |

Ref document number: 20826038 Country of ref document: EP Kind code of ref document: A1 |

|

| ENP | Entry into the national phase |

Ref document number: 2021526916 Country of ref document: JP Kind code of ref document: A |

|

| NENP | Non-entry into the national phase |

Ref country code: DE |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 2020826038 Country of ref document: EP |

|

| ENP | Entry into the national phase |

Ref document number: 2020826038 Country of ref document: EP Effective date: 20220120 |