RU2582057C2 - Устройство и способ обработки изображений - Google Patents

Устройство и способ обработки изображений Download PDFInfo

- Publication number

- RU2582057C2 RU2582057C2 RU2014134533/08A RU2014134533A RU2582057C2 RU 2582057 C2 RU2582057 C2 RU 2582057C2 RU 2014134533/08 A RU2014134533/08 A RU 2014134533/08A RU 2014134533 A RU2014134533 A RU 2014134533A RU 2582057 C2 RU2582057 C2 RU 2582057C2

- Authority

- RU

- Russia

- Prior art keywords

- module

- coefficient

- matrix

- data

- difference

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/124—Quantisation

- H04N19/126—Details of normalisation or weighting functions, e.g. normalisation matrices or variable uniform quantisers

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/12—Selection from among a plurality of transforms or standards, e.g. selection between discrete cosine transform [DCT] and sub-band transform or selection between H.263 and H.264

- H04N19/122—Selection of transform size, e.g. 8x8 or 2x4x8 DCT; Selection of sub-band transforms of varying structure or type

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/124—Quantisation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/18—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a set of transform coefficients

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

- H04N19/463—Embedding additional information in the video signal during the compression process by compressing encoding parameters before transmission

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/59—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving spatial sub-sampling or interpolation, e.g. alteration of picture size or resolution

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

- H04N19/61—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding in combination with predictive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

- H04N19/91—Entropy coding, e.g. variable length coding [VLC] or arithmetic coding

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Physics & Mathematics (AREA)

- Discrete Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Compression Or Coding Systems Of Tv Signals (AREA)

- Compression Of Band Width Or Redundancy In Fax (AREA)

- Image Processing (AREA)

Abstract

Изобретение относится к технологиям кодирования/декодирования видеоданных. Техническим результатом является уменьшение объема кода, требуемого для обработки данных изображений, за счет передачи значения заменяющего коэффициента, вместо коэффициента, расположенного в начале матрицы квантования. Предложено устройство обработки изображений. Устройство содержит задающий модуль, модуль повышающего преобразования, модель замены, модуль деквантования. Устройство содержит модуль замены, выполненный с возможностью замены заменяющим коэффициентом, коэффициента, расположенного в начале подвергшейся повышающему преобразованию матрицы квантования, заданной модулем повышающего преобразования. Устройство содержит модуль деквантования, выполненный с возможностью выполнения деквантования квантованных данных, получаемых посредством декодирования кодированных данных, с использованием подвергшейся повышающему преобразованию матрицы квантования, в которой коэффициент, расположенный в начале, заменен модулем замены упомянутым заменяющим коэффициентом. 2 н. и 8 з.п. ф-лы, 59 ил.

Description

Область техники, к которой относится изобретение

Настоящее раскрываемое изобретение относится к устройству и способу обработки изображений.

Уровень техники, предшествующий изобретению

В стандарте H.264/AVC (Усовершенствованного кодирования видеоданных), который является одной из стандартных спецификаций схем кодирования видеоданных, профили, относящиеся к Высокому профилю или более высокому, делают возможным квантование данных изображения с размерами шага квантования, которые различаются от одного компонента коэффициента ортогонального преобразования к другому. Размер шага квантования для каждого компонента коэффициента ортогонального преобразования может быть установлен на базе некоторого опорного значения шага и матрицы квантования (также именуемой как список масштабирования), определенной размером, эквивалентным порции ортогонального преобразования.

Указанное значение матрицы квантования подготавливается для каждого режима предсказания (режима внутрикадрового предсказания, режима межкадрового предсказания) и для каждого размера (4×4,8×8) порции преобразования. Кроме того, пользователям разрешено указывать уникальную матрицу квантования, отличную от указанных значений, в наборе параметров последовательности или наборе параметров изображения. В случае, когда матрицы квантования не используются, размеры шага квантования, используемые для квантования, имеют равное значение для всех компонентов.

В стандарте HEVC (Высокоэффективного кодирования видеоданных), который стандартизируют в качестве схемы кодирования видеоданных, относящейся к следующему поколению, и который является преемником стандарта H.264/AVC, было введено понятие порций кодирования (CU-порций), соответствующих традиционным макроблокам (смотри, например, Непатентый документ 1). Диапазон размера порций кодирования указывается посредством набора значений, которые являются степенями 2, именуемых наибольшая порция кодирования (LCU-порция) и наименьшая порция кодирования (SCU-порция), в наборе параметров последовательности. Кроме того, конкретный размер порции кодирования в диапазоне, определенном наибольшей порцией кодирования и наименьшей порцией кодирования, указывается с использованием split_flag (флажок_разделения).

В стандарте HEVC одна порция кодирования может быть разделена на одну или более порций ортогонального преобразования или одну или более порций преобразования (TU-порций). Применимый размер порции преобразования представляет собой любой размер из числа: 4×4,8×8,16×16 и 32×32.

Между тем, в целях, таких как уменьшение объема кодирования во время передачи, постоянная составляющая (также именуемая как составляющая постоянного тока) матрицы квантования (списка масштабирования) передается как данные, отличные от ее переменных составляющих (также именуемых как составляющие переменного тока). В частности, составляющая постоянного тока списка масштабирования передается как коэффициент постоянного тока (также именуемый как DC-коэффициент), отличный от коэффициентов переменного тока (также именуемых как АС-коэффициенты), которые являются переменными составляющими списка масштабирования.

Для того, чтобы уменьшить объем кодирования для коэффициента постоянного тока во время передачи, было предложено, чтобы из значения коэффициента постоянного тока вычиталась некоторая константа (например, 8), и получающееся значение (scaling_list_dc_coef_minus8 (коэффициент_постоянного_тока_списка_масштабирования_минус8) кодировалось с использованием экспоненциального кодирования Голомба (Golomb) со знаком (смотри, например, Непатентый документ 1).

Список упоминаемых документов

Непатентый документ

Непатентый документ 1: Benjamin Bross (Бенджамин Бросс), Fraunhofer HHI, Woo-Jin Han (Цу-Джин Хэн, университет Gachon), Jens-Rainer Ohm (Йенс-Райнер Ом), RWTH Ахен, Gary J. Sullivan (Гари Дж. Салливан), Microsoft, Thomas Wiegand (Томас Вигланд), Fraunhofer HHI/TU Берлин, JCTVC - Н1003, "High Efficiency Video Coding (HEVC) text specification draft 6" ("Проект 6 спецификации текста стандарта Высокоэффективного кодирования видеоданных (HEVC)"), Седьмое заседание Joint Collaborative Team on Video Coding (JCT-VC) (Совместной объединенной группы по кодированию видеоданных) ITU-Τ SG16 WP3 и ISO/TEC JTC1/SC29/WG11: Женева, Швейцария, 21-30 ноября 2011 года

Раскрытие изобретения

Техническая проблема

Однако существует опасность того, что способ, описанный выше, не будет обеспечивать достаточную эффективность сжатия, хотя он и облегчает процессы.

Настоящее раскрываемое изобретение было сделано ввиду вышеописанной ситуации, и цель настоящего раскрываемого изобретения заключается в том, чтобы позволить сдерживать увеличение объема кодирования для списка масштабирования.

Решение проблемы

В одном аспекте настоящего раскрываемого изобретения предлагается устройство обработки изображений, включающее в себя задающий модуль, выполненный с возможностью задавать коэффициент, расположенный в начале матрицы квантования, размер которой ограничен размером, не превышающим размер передачи, который представляет собой максимальный размер, допускаемый при передаче данных, суммируя с коэффициентом, расположенным в начале матрицы квантования, заменяющий разностный коэффициент, который представляет собой разность между заменяющим коэффициентом и коэффициентом, расположенным в начале матрицы квантования, причем заменяющий коэффициент используется для замены коэффициента, расположенного в начале подвергшейся повышающему преобразованию матрицы квантования, которая получена посредством повышающего преобразования матрицы квантования до того же самого размера, что и размер блока, который является порцией обработки, в которой выполняется деквантование; модуль повышающего преобразования, выполненный с возможностью осуществлять повышающее преобразование матрицы квантования, заданной задающим модулем, для задания подвергшейся повышающему преобразованию матрицы квантования; и модуль деквантования, выполненный с возможностью осуществлять деквантование квантованных данных, полученных посредством декодирования кодированных данных, с использованием подвергшейся повышающему преобразованию матрицы квантования, в которой коэффициент, расположенный в начале подвергшейся повышающему преобразованию матрицы квантования, заданной модулем повышающего преобразования, заменен указанным заменяющим коэффициентом.

Задающий модуль может задавать заменяющий коэффициент, суммируя разность между заменяющим коэффициентом и начальным значением, заданным для матрицы квантования, с указанным начальным значением.

Задающий модуль может задавать коэффициенты матрицы квантования, используя заменяющий разностный коэффициент и разностные коэффициенты, которые представляют собой разности между коэффициентами матрицы квантования.

Заменяющий разностный коэффициент и разностные коэффициенты, которые представляют собой разности между коэффициентами матрицы квантования, могут быть переданы совместно. Задающий модуль может задавать коэффициенты матрицы квантования, используя указанные совместно передаваемые заменяющий разностный коэффициент и разностные коэффициенты.

Заменяющий разностный коэффициент и разностные коэффициенты, которые представляют собой разности между коэффициентами матрицы квантования, могут быть кодированы. Задающий модуль может декодировать кодированный заменяющий разностный коэффициент и кодированные разностные коэффициенты.

Модуль повышающего преобразования может выполнять повышающее преобразование матрицы квантования, размер которой ограничен размером, не превышающим размер передачи, выполняя над элементами матрицы, входящими в состав матрицы квантования, процесс интерполяции по "ближайшим соседям".

Размер передачи может представлять собой размер 8×8. Модуль повышающего преобразования может выполнять повышающее преобразование матрицы квантования, имеющей размер 8×8, в матрицу квантования, имеющую размер 16×16, выполняя над элементами матрицы, входящими в состав матрицы квантования, имеющей размер 8×8, процесс интерполяции по "ближайшим соседям".

Модуль повышающего преобразования может осуществлять повышающее преобразование матрицы квантования, имеющей размер 8×8, в матрицу квантования, имеющую размер 32×32, выполняя над элементами матрицы, входящими в состав матрицы квантования, имеющей размер 8×8, процесс интерполяции по "ближайшим соседям".

Порция кодирования, которая представляет собой порцию обработки, в которой выполняется процесс декодирования, и порция преобразования, которая представляет собой порцию обработки, в которой выполняется процесс преобразования, могут иметь многоуровневую структуру. Устройство обработки изображений может дополнительно включать в себя модуль декодирования, выполненный с возможностью выполнять процесс декодирования над кодированными данными, используя порцию, имеющую многоуровневую структуру, для генерирования квантованных данных. Модуль повышающего преобразования может осуществлять повышающее преобразование матрицы квантования от размера передачи до размера порции преобразования, которая является порцией обработки, в которой выполняется деквантование.

В одном аспекте настоящего раскрываемого изобретения предлагается способ обработки изображений, включающий в себя этапы, на которых: задают коэффициент, расположенный в начале матрицы квантования, размер которой ограничен размером, не превышающим размер передачи, который представляет собой максимальный размер, допускаемый при передаче данных, суммируя с коэффициентом, расположенным в начале матрицы квантования, заменяющий разностный коэффициент, который представляет собой разность между заменяющий коэффициентом и коэффициентом, расположенным в начале матрицы квантования, причем заменяющий коэффициент используется для замены коэффициента, расположенного в начале подвергшейся повышающему преобразованию матрицы квантования, которая получена посредством повышающего преобразования матрицы квантования до того же размера, что и размер блока, который является порцией обработки, в которой выполняется деквантование; осуществляют повышающее преобразование заданной матрицы квантования для задания подвергшейся повышающему преобразованию матрицу квантования; и выполняют деквантование квантованных данных, полученных посредством декодирования кодированных данных, используя подвергшуюся повышающему преобразованию матрицу квантования, в которой коэффициент, расположенный в начале заданной подвергшейся повышающему преобразованию матрицы квантования, заменен указанным заменяющим коэффициентом.

В другом аспекте настоящего раскрываемого изобретения предлагается устройство обработки изображений, включающее в себя: задающий модуль, выполненный с возможностью задавать заменяющий разностный коэффициент, который представляет собой разность между заменяющим коэффициентом и коэффициентом, расположенным в начале матрицы квантования, размер которой ограничен размером, не превышающим размер передачи, который представляет собой максимальный размер, допускаемый при передаче данных, причем заменяющий коэффициент используется для замены коэффициента, расположенного в начале подвергшейся повышающему преобразованию матрицы квантования, которая получена посредством повышающего преобразования матрицы квантования до того же самого размера, что и размер блока, который является порцией обработки, в которой выполняется деквантование; модуль квантования, выполненный с возможностью квантовать изображение для генерирования квантованных данных; и передающий модуль, выполненный с возможностью передавать кодированные данные, полученные посредством кодирования квантованных данных, сгенерированных модулем квантования, данные заменяющего коэффициента, полученные посредством кодирования заменяющего коэффициента, и данные заменяющего разностного коэффициента, полученные посредством кодирования заменяющего разностного коэффициента, заданного задающим модулем.

Задающий модуль может задавать разность между заменяющим коэффициентом и некоторым начальным значением, заданным для матрицы квантования.

Задающий модуль может задавать разностные коэффициенты, которые представляют собой разности между коэффициентами матрицы квантования. Передающий модуль может передавать данные разностных коэффициентов, полученные посредством кодирования разностных коэффициентов, заданных задающим модулем.

Передающий модуль может совместно передавать данные заменяющего коэффициента и данные заменяющего разностного коэффициента.

Передающий модуль может передавать данные заменяющего коэффициента и данные заменяющего разностного коэффициента в порядке: данные заменяющего коэффициента и данные заменяющего разностного коэффициента.

Модуль квантования может квантовать изображение, используя матрицу квантования или подвергшуюся повышающему преобразованию матрицу квантования.

Порция кодирования, которая представляет собой порцию обработки, в которой выполняется процесс кодирования, и порция преобразования, которая представляет собой порцию обработки, в которой выполняется процесс преобразования, могут иметь многоуровневую структуру. Устройство обработки изображений может дополнительно включать в себя модуль кодирования, выполненный с возможностью кодировать квантованные данные, сгенерированные модулем квантования.

В другом аспекте настоящего раскрываемого изобретения предлагается способ обработки изображений, включающий в себя этапы, на которых: задают заменяющий разностный коэффициент, который представляет собой разность между заменяющим коэффициентом и коэффициентом, расположенным в начале матрицы квантования, размер которой ограничен размером, не превышающим размер передачи, который представляет собой максимальный размер, допускаемый при передаче данных, причем заменяющий коэффициент используется для замены коэффициента, расположенного в начале подвергшейся повышающему преобразованию матрицы квантования, которая получена посредством повышающего преобразования матрицы квантования до того же размера, что и размер блока, который является порцией обработки, в которой выполняется деквантование; выполняют квантование изображения для генерирования квантованных данных; и передают кодированные данные, полученные посредством кодирования сгенерированных квантованных данных, данные заменяющего коэффициента, полученные посредством кодирования заменяющего коэффициента, и данные заменяющего разностного коэффициента, полученные посредством кодирования заданного заменяющего разностного коэффициента.

В еще одном аспекте настоящего раскрываемого изобретения предлагается устройство обработки изображений, включающее в себя: модуль декодирования, выполненный с возможностью декодировать кодированные данные для генерирования квантованных данных; и модуль деквантования, выполненный с возможностью выполнять деквантование квантованных данных, сгенерированных модулем декодирования, используя матрицу квантования по умолчанию, имеющую тот же размер, что и размер блока, являющийся порцией обработки, в которой выполняется деквантование, когда в режиме копирования, в котором осуществляется копирование матрицы квантования, опорные данные матрицы квантования, идентифицирующие опорное место назначения матрицы квантования, совпадают с идентификационными данными матрицы квантования, идентифицирующими матрицу квантования.

Модуль деквантования может выполнять деквантование квантованных данных посредством анализа синтаксиса, семантика которого задана так, чтобы обращение к матрице квантования по умолчанию осуществлялось тогда, когда опорные данные обращения матрицы квантования совпадают с идентификационными данными матрицы квантования.

Модуль деквантования может выполнять деквантование квантованных данных посредством анализа синтаксиса, семантика которого задана так, чтобы обращение к матрице квантования по умолчанию осуществлялось тогда, когда разность между опорными данными к матрице квантования и идентификационными данными матрицы квантования равна 0.

В еще одном аспекте настоящего раскрываемого изобретения предлагается способ обработки изображений, включающий в себя этапы, на которых: декодируют кодированные данные для генерирования квантованных данных; и выполняют деквантование квантованных данных, сгенерированных при декодировании, используя матрицу квантования по умолчанию, имеющую тот же самый размер, что и размер блока, который является порцией обработки, в которой выполняется деквантование, когда в режиме копирования, в котором выполняется копирование матрицы квантования, опорные данные матрицы квантования, идентифицирующие опорное место назначения матрицы квантования, совпадают с идентификационными данными матрицы квантования, идентифицирующими матрицу квантования.

В еще одном аспекте настоящего раскрываемого изобретения предлагается устройство обработки изображений, включающее в себя: модуль кодирования, выполненный с возможностью кодировать изображение для генерирования кодированных данных; и задающий модуль, выполненный с возможностью задавать в качестве синтаксиса кодированных данных, сгенерированных модулем кодирования, синтаксис, семантика которого задана так, чтобы выполнять обращение к матрице квантования по умолчанию, имеющую тот же размер, что и размер блока, который является порцией обработки, в которой выполняется квантование, когда в режиме копирования, в котором выполняется копирование матрицы квантования, опорные данные матрицы квантования, идентифицирующие опорное место назначения матрицы квантования, совпадают с идентификационными данными матрицы квантования, идентифицирующими матрицу квантования.

В еще одном аспекте настоящего раскрываемого изобретения предлагается способ обработки изображений, включающий в себя этапы, на которых: кодируют изображение для генерирования кодированных данных; и задают, в качестве синтаксиса сгенерированных кодированных данных, синтаксис, семантика которого задана так, чтобы выполнять обращение к матрице квантования по умолчанию, имеющей тот же размер, что и размер блока, который является порцией обработки, в которой выполняется квантование, когда в режиме копирования, в котором выполняется копирование матрицы квантования, опорные данные матрицы квантования, идентифицирующие опорное место назначения матрицы квантования, совпадают с идентификационными данными матрицы квантования, идентифицирующими матрицу квантования.

В одном аспекте настоящего раскрываемого изобретения, коэффициент, расположенный в начале матрицы квантования, размер которой ограничен размером, не превышающим размер передачи, который представляет собой максимальный размер, допускаемый при передаче данных, задают посредством суммирования с коэффициентом, расположенным в начале матрицы квантования, заменяющего разностного коэффициента, который представляет собой разность между заменяющим коэффициентом и коэффициентом, расположенным в начале матрицы квантования, причем заменяющий коэффициент используется для замены коэффициента, расположенного в начале подвергшейся повышающему преобразованию матрицы квантования, которая получена посредством повышающего преобразования матрицы квантования до того же размера, что и размер блока, который является порцией обработки, в которой выполняется деквантование; заданная матрица квантования подвергается повышающему преобразованию для задания подвергшейся повышающему преобразованию матрицы квантования; и квантованные данные, полученные посредством декодирования кодированных данных, подвергаются деквантованию с использованием подвергшейся повышающему преобразованию матрицы квантования, в которой коэффициент, расположенный в начале заданной подвергшейся повышающему преобразованию матрицы квантования, заменен указанным заменяющим коэффициентом.

В другом аспекте настоящего раскрываемого изобретения, задается заменяющий разностный коэффициент, который представляет собой разность между заменяющим коэффициентом и коэффициентом, расположенным в начале матрицы квантования, размер которой ограничен размером, не превышающим размер передачи, который представляет собой максимальный размер, допускаемый при передаче данных, причем заменяющий коэффициент используется для замены коэффициента, расположенного в начале подвергшейся повышающему преобразованию матрицы квантования, которая получена посредством повышающего преобразования матрицы квантования до того же размера, что и размер блока, который является порцией обработки, в которой выполняется деквантование; изображение квантуется для генерирования квантованных данных; и кодированные данные, полученные посредством кодирования сгенерированных квантованных данных, данные заменяющего коэффициента, полученные посредством кодирования заменяющего коэффициента, и данные заменяющего разностного коэффициента, полученные посредством кодирования заданного заменяющего разностного коэффициента, передаются.

В еще одном аспекте настоящего раскрываемого изобретения, кодированные данные декодируются для генерирования квантованных данных; и квантованные данные, сгенерированные при декодировании, подвергаются деквантованию с использованием матрицы квантования по умолчанию, имеющей тот же размер, что и размер блока, который является порцией обработки, в которой выполняется деквантование, когда в режиме копирования, в котором осуществляется копирование матрицы квантования, опорные данные матрицы квантования, идентифицирующие опорное место назначения матрицы квантования, совпадают с идентификационными данными матрицы квантования, идентифицирующими матрицу квантования.

В еще одном аспекте настоящего раскрываемого изобретения изображение кодируется для генерирования кодированных данных; и в качестве синтаксиса сгенерированных кодированных данных задается синтаксис, семантика которого задана так, чтобы обращение осуществлялось к матрице квантования по умолчанию, имеющей тот же размер, что и размер блока, который является порцией обработки, в которой выполняется квантование, когда в режиме копирования, в котором выполняется копирование матрицы квантования, опорные данные матрицы квантования, идентифицирующие опорное место назначения матрицы квантования, совпадают с идентификационными данными матрицы квантования, идентифицирующими матрицу квантования.

Полезные результаты изобретения

В соответствии с настоящим раскрываемым изобретением имеется возможность обрабатывать изображение. В частности, имеется возможность сдерживать увеличение объема кодирования матрицы квантования.

Краткое описание чертежей

Фиг. 1 представляет собой схему, на которой проиллюстрирован пример списка масштабирования.

Фиг. 2 представляет собой схему, на которой проиллюстрирован пример повышающего преобразования.

Фиг. 3 представляет собой схему, на которой проиллюстрирован пример того, каким образом список масштабирования используется в декодере.

Фиг. 4 представляет собой схему, на которой проиллюстрирован пример кодирования списка масштабирования.

Фиг. 5 представляет собой схему, на которой проиллюстрирован пример кодирования списка масштабирования с использованием настоящей технологии.

Фиг. 6 представляет собой схему, на которой проиллюстрирован пример экспоненциальных кодов Голомба (Golomb).

Фиг. 7 включает в себя схемы, на которых проиллюстрирован пример синтаксиса для списка масштабирования.

Фиг. 8 представляет собой схему, на которой проиллюстрирован пример синтаксиса для матрицы по умолчанию.

Фиг. 9 включает в себя схемы, на которых проиллюстрированы примеры семантики матрицы по умолчанию.

Фиг. 10 представляет собой схему, на которой проиллюстрирован пример синтаксиса для списка масштабирования.

Фиг. 11 представляет собой схему, на которой проиллюстрирован пример синтаксиса для списка масштабирования, использующий настоящую технологию.

Фиг. 12 включает в себя схемы, на которых проиллюстрирован пример синтаксиса списка масштабирования на предшествующем уровне техники.

Фиг. 13 представляет собой схему, на которой проиллюстрирован пример синтаксиса списка масштабирования.

Фиг. 14 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации устройства кодирования изображений.

Фиг. 15 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации модуля ортогонального преобразования/квантования.

Фиг. 16 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации модуля обработки матрицы.

Фиг. 17 представляет собой схему, на которой проиллюстрирован пример понижающей дискретизации.

Фиг.18 представляет собой схему, на которой проиллюстрирован пример удаления совпадающей части.

Фиг. 19 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации модуля дифференциальной импульсно-кодовой модуляции (DPCM-модуля).

Фиг. 20 представляет собой блок-схему алгоритма, на которой проиллюстрирован пример последовательности операций процесса кодирования матрицы квантования.

Фиг. 21 представляет собой блок-схему алгоритма, на которой проиллюстрирован пример последовательности операций процесса дифференциальной импульсно-кодовой модуляции (DPCM-модуляции).

Фиг. 22 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации устройства декодирования изображений.

Фиг. 23 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации модуля деквантования/обратного ортогонального преобразования.

Фиг. 24 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации модуля генерирования матрицы.

Фиг. 25 представляет собой схему, на которой проиллюстрирован пример процесса интерполяции по "ближайшему соседу".

Фиг. 26 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации модуля процесса, обратного дифференциальной импульсно-кодовой модуляции.

Фиг. 27 представляет собой блок-схему алгоритма, на которой проиллюстрирован пример последовательности операций процесса генерирования матрицы.

Фиг. 28 представляет собой блок-схему алгоритма, на которой проиллюстрирован пример последовательности операций процесса декодирования разностного сигнала.

Фиг. 29 представляет собой блок-схему алгоритма, на которой проиллюстрирован пример последовательности операций процесса, обратного дифференциальной импульсно-кодовой модуляции.

Фиг. 30 представляет собой схему, на которой проиллюстрирован другой пример синтаксиса списка масштабирования.

Фиг. 31 представляет собой структурную схему, на которой проиллюстрирован другой пример конфигурации модуля дифференциальной импульсно-кодовой модуляции.

Фиг. 32 представляет собой блок-схему алгоритма, на которой проиллюстрирован другой пример последовательности операций процесса дифференциальной импульсно-кодовой модуляции.

Фиг. 33 представляет собой структурную схему, на которой проиллюстрирован другой пример конфигурации модуля процесса, обратного дифференциальной импульсно-кодовой модуляции.

Фиг. 34 представляет собой блок-схему алгоритма, на которой проиллюстрирован другой пример последовательности операций процесса, обратного дифференциальной импульсно-кодовой модуляции.

Фиг. 35 представляет собой схему, на которой проиллюстрирован еще один другой пример синтаксиса списка масштабирования.

Фиг. 36 представляет собой блок-схему алгоритма, на которой проиллюстрирован еще один другой пример последовательности операций процесса, обратного дифференциальной импульсно-кодовой модуляции.

Фиг. 37 представляет собой схему, на которой проиллюстрирован еще один другой пример синтаксиса списка масштабирования.

Фиг. 38 представляет собой структурную схему, на которой проиллюстрирован еще один другой пример конфигурации модуля дифференциальной импульсно-кодовой модуляции.

Фиг. 39 представляет собой блок-схему алгоритма, на которой проиллюстрирован еще один другой пример процесса дифференциальной импульсно-кодовой модуляции.

Фиг. 40 представляет собой структурную схему, на которой проиллюстрирован еще один другой пример конфигурации модуля процесса, обратного дифференциальной импульсно-кодовой модуляции.

Фиг. 41 представляет собой блок-схему алгоритма, на которой проиллюстрирован еще один другой пример последовательности операций процесса, обратного дифференциальной импульсно-кодовой модуляции.

Фиг. 42 представляет собой блок-схему алгоритма, которая продолжается с Фиг. 41 и на которой проиллюстрирован еще один другой пример последовательности операций процесса, обратного дифференциальной импульсно-кодовой модуляции.

Фиг. 43 включает в себя схемы, на которых проиллюстрирован еще один другой пример синтаксиса списка масштабирования.

Фиг. 44 включает в себя схемы, на которых проиллюстрирован еще один другой пример синтаксиса списка масштабирования.

Фиг. 45 включает в себя схемы, на которых проиллюстрирован еще один другой пример синтаксиса списка масштабирования.

Фиг. 46 представляет собой схему, на которой проиллюстрирован пример схемы кодирования изображения с множественными представлениями.

Фиг. 47 представляет собой схему, на которой проиллюстрирован пример основной конфигурации устройства кодирования изображений с множественными представлениями, в котором применена настоящая технология.

Фиг. 48 представляет собой схему, на которой проиллюстрирован пример основной конфигурации устройства декодирования изображений с множественными представлениями, в котором применена настоящая технология.

Фиг. 49 представляет собой схему, на которой проиллюстрирован пример схемы кодирования многоуровневого изображения.

Фиг. 50 представляет собой схему, на которой проиллюстрирован пример устройства кодирования многоуровневых изображений, в котором применена настоящая технология.

Фиг. 51 представляет собой схему, на которой проиллюстрирован пример основной конфигурации устройства декодирования многоуровневых изображений, в котором применена настоящая технология.

Фиг. 52 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации компьютера.

Фиг. 53 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации телевизионного аппарата.

Фиг. 54 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации мобильного оконечного устройства.

Фиг. 55 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации аппарата записи/воспроизведения.

Фиг. 56 представляет собой структурную схему, на которой проиллюстрирован пример основной конфигурации аппарата формирования изображения.

Фиг. 57 представляет собой структурную схему, на которой проиллюстрирован пример использования масштабируемого кодирования.

Фиг. 58 представляет собой структурную схему, на которой проиллюстрирован другой пример использования масштабируемого кодирования.

Фиг. 59 представляет собой структурную схему, на которой проиллюстрирован еще один другой пример использования масштабируемого кодирования.

Осуществление изобретения

Далее будут описаны способы для осуществления настоящего раскрываемого изобретения (в дальнейшем именуемые как варианты реализации изобретения). В отношении этого отметим, что описание будет произведено в следующем порядке:

1. Первый вариант реализации изобретения (приводимое в качестве примера применение настоящей технологии)

2. Второй вариант реализации изобретения (устройство кодирования изображений, устройство декодирования изображений: первый способ)

3. Третий вариант реализации изобретения (устройство кодирования изображений, устройство декодирования изображений: второй способ)

4. Четвертый вариант реализации изобретения (устройство кодирования изображений, устройство декодирования изображений: третий способ)

5. Пятый вариант реализации изобретения (устройство кодирования изображений, устройство декодирования изображений: четвертый способ)

6. Шестой вариант реализации изобретения (устройство кодирования изображений, устройство декодирования изображений: другие способы)

7. Седьмой вариант реализации изобретения (устройство кодирования изображений с множественными представлениями, устройство декодирования изображений с множественными представлениями),

8. Восьмой вариант реализации изобретения (устройство кодирования многоуровневых изображений, устройство декодирования многоуровневых изображений)

9. Девятый вариант реализации изобретения (компьютер)

10. Приводимые в качестве примера варианты применения

11. Приводимые в качестве примера варианты применения масштабируемого кодирования

1. Первый вариант реализации изобретения

В этом варианте реализации изобретения будет приведено описание приводимых в качестве примера вариантов применения настоящей технологии, которая будет описана подробно во втором и последующих вариантах его реализации.

1-1. Приводимый в качестве примера вариант применения настоящей технологий

Сначала будет описан иллюстративный пример, к которому применима настоящая технология. Настоящая технология представляет собой технологию, относящуюся к кодированию и декодированию списка масштабирования, используемого в процессах квантования и деквантования, когда данные изображения кодируются и декодируются.

Кодирование и декодирование данных изображения могут включать в себя квантование и деквантование данных, представляющих собой коэффициенты. Такие квантование и деквантование выполняются в порциях блока, имеющего некоторый предварительно заданный размер, и используется список масштабирования (или матрица квантования), имеющий размер, соответствующий размеру блока. Например, в стандарте HEVC (Высокоэффективного кодирования видеоданных) квантование (или деквантование) выполняются с такими размерами, как 4×4, 8×8, 16×16 и 32×32. В стандарте HEVC могут быть приготовлены матрицы квантования, имеющие размеры 4×4 и 8×8.

На Фиг. 1 проиллюстрирован пример списка масштабирования размером 8×8. Как проиллюстрировано на Фиг. 1, список масштабирования включает в себя коэффициент постоянного тока и коэффициенты переменного тока. Коэффициент постоянного тока, составленный из одного значения, представляет собой коэффициент (0, 0) матрицы квантования, и соответствует коэффициенту постоянного тока дискретного косинусного преобразования (DCT-преобразования). Коэффициенты переменного тока представляют собой коэффициенты матрицы квантования кроме коэффициента (0, 0) и соответствуют коэффициентам дискретного косинусного преобразования кроме коэффициента постоянного тока. Отметим, что, как проиллюстрировано на Фиг. 1, коэффициенты переменного тока представлены матрицей. Таким образом, коэффициенты переменного тока также включают в себя коэффициент (0, 0) (в дальнейшем также именуемый как коэффициент (0, 0) переменного тока), и при использовании для квантования/деквантования этот коэффициент (0, 0), который расположен в начале матрицы квантования, заменяется коэффициентом постоянного тока. Следовательно, коэффициент постоянного тока также именуется как заменяющий коэффициент. В примере, проиллюстрированном на Фиг. 1, коэффициенты переменного тока образуют матрицу размером 8×8.

Кроме того, в стандарте HEVC, подвергшаяся повышающему преобразованию версия (повышающее преобразование) матрицы (8×8) квантования используется для квантования (или деквантования) 16×16 или 32×32.

На Фиг. 2 проиллюстрирован пример повышающего преобразования списка (8×8) масштабирования в список (16×16) масштабирования. Как проиллюстрировано на Фиг. 2, повышающее преобразование списка масштабирования осуществляется с использованием, например, процесса интерполяции по "ближайшему соседу". Подробности процесса интерполяции по "ближайшему соседу" будут описаны ниже со ссылкой, например, на Фиг. 25. Как проиллюстрировано на Фиг. 2, повышающее преобразование выполняется над коэффициентами переменного тока в списке масштабирования. После этого, коэффициент (0, 0) из числа коэффициентов переменного тока после повышающего преобразования заменяется коэффициентом постоянного тока.

Подготавливаются два типа списков (8×8) масштабирования, а именно, тот, что используется для повышающего преобразования до размера 16×16 ("8×8 для 16×16"), и тот, что используется для повышающего преобразования до размера 32×32 ("8×8 для 32×32").

Список масштабирования, используемый для квантования во время кодирования (с использованием кодера) также используется для деквантования во время декодирования (с использованием декодера). Таким образом, список масштабирования передается от стороны кодирования (кодера) стороне декодирования (декодеру). На Фиг. 3 проиллюстрирован пример передачи списков масштабирования.

Согласно примеру, проиллюстрированному на Фиг. 3, передаются два типа списков (8×8) масштабирования, а именно, тот, что используется для повышающего преобразования до размера 16×16, и тот, что используется для повышающего преобразования до размера 32×32, как описано выше. Хотя это и не проиллюстрировано на чертежах, также передается и список (4×4) масштабирования.

Коэффициенты переменного тока из списка (8×8) масштабирования, используемого для повышающего преобразования до размера 16×16, который был передан описанным выше способом, подвергаются повышающему преобразованию до размера (16×16) на стороне декодирования (в декодере) с использованием процесса интерполяции по "ближайшему соседу", описанному выше, и используются для деквантования блока, имеющего размер 16×16, после того, как коэффициент (0, 0) заменен коэффициентом постоянного тока.

Аналогичным образом, коэффициенты переменного тока из списка (8×8) масштабирования, используемого для повышающего преобразования до размера 32×32, который был передан описанным выше способом, также подвергаются повышающему преобразованию до размера (32×32) на стороне декодирования (в декодере) с использованием процесса интерполяции по "ближайшему соседу", описанному выше, и используются для деквантования блока, имеющего размер 32×32, после того, как коэффициент (0, 0) заменен коэффициентом постоянного тока.

1-2. Кодирование списка масштабирования

Передача списков масштабирования описанным выше способом соответствующим образом увеличит объем кодирования. Таким образом, для того, чтобы сдерживать снижение эффективности кодирования, списки масштабирования кодируются с использованием некоторого способа для уменьшения объема кодирования списков масштабирования. На Фиг. 4 проиллюстрирован пример кодирования списка масштабирования. В частности, список (8×8) масштабирования передается следующим образом.

В случае повышающего преобразования матрицы (8×8) в матрицу (16×16):

(1) Берется разность между коэффициентом (0, 0) (то есть, коэффициентом (0, 0) переменного тока) матрицы (8×8) и некоторым предварительно заданным начальным значением "8".

(2) Берутся разности между коэффициентами (то есть, коэффициентами переменного тока) (смежными коэффициентами в последовательности коэффициентов, одномерно расположенных в порядке сканирования) матрицы (8×8).

(3) Берется разность между коэффициентом (0, 0) (то есть, коэффициентом постоянного тока) матрицы (16×16) и некоторым предварительно заданным начальным значением "8".

(4) Разности, полученные в (1) и (2), и разность, полученная в (3), передаются отдельно.

В случае повышающего преобразования матрицы (8×8) в матрицу (32×32):

(1) Берется разность между коэффициентом (0, 0) (то есть, коэффициентом (0, 0) переменного тока) матрицы (8×8) и некоторым предварительно заданным начальным значением "8".

(2) Берутся разности между коэффициентами (то есть, коэффициентами переменного тока) (смежными коэффициентами в последовательности коэффициентов, одномерно расположенных в порядке сканирования) матрицы (8×8).

(3) Берется разность между коэффициентом (0, 0) (то есть, коэффициентом постоянного тока) матрицы (32×32) и некоторым предварительно заданным начальным значением "8".

(4) Разности, полученные в (1) и (2), и разность, полученная в (3), передаются отдельно.

Однако в способе, описанном выше, разности кодируются с использованием экспоненциального кодирования Голомба со знаком и передаются на этап (4). Как было описано выше, разность, полученная на этапе (1), представляет собой разность между коэффициентом (0, 0) переменного тока и начальным значением "8". Таким образом, существует опасность того, что объем кодирования может возрастать в случае, если значение коэффициента (0, 0) переменного тока не является значением, близким к начальному значению "8".

Например, на Фиг. 4, значение коэффициента (0, 0) переменного тока составляет "12", и значение "4" кодируется с использованием экспоненциального кодирования Голомба со знаком и передается в качестве разницы, полученной на этапе (1). Таким образом, для передачи разности, полученной на этапе (1), требуются 7 битов и эффективность кодирования может быть, соответственно, снижена. Если значение разности, полученное на этапе (1), увеличивается, то эффективность кодирования может еще более снижаться. То же самое верно и для случая списка (8×8) масштабирования, используемого для повышающего преобразования до размера 16×16 и списка (8×8) масштабирования, используемого для повышающего преобразования до размера 32×32.

Между тем, энергия коэффициентов дискретного косинусного преобразования обычно сосредоточена в коэффициенте постоянного тока и соседних коэффициентах низкого порядка. Следовательно, в общем, матрица квантования также имеет малые значения для коэффициента постоянного тока и соседних коэффициентов. Кроме того, если для отдельных частот используются значения, которые значительно отличаются, то ошибка квантования может быть субъективно заметной. Для того, чтобы подавлять такое визуальное ухудшение качества изображения, для коэффициента постоянного тока и соседних коэффициентов используются последовательные значения.

Коэффициент (0, 1), коэффициент (1. 0) и коэффициент (1. 1), полученные после повышающего преобразования, соответствуют коэффициенту (0, 0) переменного тока перед повышающим преобразованием. Кроме того, коэффициент (0, 0), полученный после повышающего преобразования, соответствует коэффициенту постоянного тока.

Таким образом, в списках масштабирования значение коэффициента (0, 0) переменного тока и значение коэффициента постоянного тока обычно близки друг к другу. Например, матрицы по умолчанию в стандартах MPEG2, AVC и HEVC принимают значения, имеющие такого рода соотношение. Также в примере, проиллюстрированном на Фиг. 4, значение коэффициента постоянного тока является тем же самым, что и значение коэффициента (0, 0) переменного тока, то есть, "12". Таким образом, значение разности, получаемое на этапе (3), то есть, разности между коэффициентом постоянного тока и начальным значением "8", также составляет "4".

Таким образом, вычисление разности между каждым коэффициентом из числа: коэффициента постоянного тока и коэффициента (0, 0) переменного тока, и значение которых близки друг к другу, и начальным значением может увеличивать значение разности между ними и может также приводить к избыточности. Можно сказать, что будет существовать риск дополнительного снижения эффективности кодирования.

Для решения этой проблемы, список масштабирования передают, используя нижеследующий способ, вместо того, чтобы использовать способ, проиллюстрированный на Фиг. 4. На Фиг. 5 проиллюстрирован пример этого способа.

В случае повышающего преобразования матрицы (8×8) в матрицу (16×16):

(1) Берется разность между коэффициентом (0, 0) (то есть, коэффициентом (0, 0) переменного тока) матрицы (8×8) и коэффициентом (0, 0) (то есть, коэффициентом постоянного тока) матрицы (16)×(16).

(2) Берутся разности между коэффициентами (то есть, коэффициентами переменного тока) (смежными коэффициентами в последовательности коэффициентов, одномерно расположенных в порядке сканирования) матрицы (8×8).

(3) Берется разность между коэффициентом (0, 0) (то есть, коэффициентом постоянного тока) матрицы (16×16) и некоторым предварительно заданным начальным значением "8".

(4) Разности, полученные на этапах: с (1) по (3), передаются вместе.

В случае повышающего преобразования матрицы (8×8) в матрицу (32×32):

(1) Берется разность между коэффициентом (0, 0) (то есть, коэффициентом (0, 0) переменного тока) матрицы (8×8) и коэффициентом (0, 0) (то есть, коэффициентом постоянного тока) матрицы (32×32).

(2) Берутся разности между коэффициентами (то есть, коэффициентами переменного тока) (смежными коэффициентами в последовательности коэффициентов, одномерно расположенных в порядке сканирования) матрицы (8×8).

(3) Берется разность между коэффициентом (0, 0) (то есть, коэффициентом постоянного тока) матрицы (32×32) и некоторым предварительно заданным начальным значением "8".

(4) Разности, полученные на этапах: с (1) по (3), передаются вместе.

Аналогично способу, проиллюстрированному на Фиг. 4, на этапе (4) разности кодируются с использованием экспоненциального кодирования Голомба и передаются как экспоненциальные коды Голомба.

В пункте назначения, куда эти разности передаются как экспоненциальные коды Голомба, когда экспоненциальные коды Голомба приняты, принятые экспоненциальные коды Голомба декодируются для получения индивидуальных разностей, и над полученными разностями выполняются процессы, обратные вышеописанным этапам: с (1) по (3), для определения индивидуальных коэффициентов (коэффициента постоянного тока и коэффициенты переменного тока).

1-3. Приводимые в качестве примера признаки настоящей технологии

Теперь опишем приводимые в качестве примера признаки настоящей технологии, относящиеся к вышеописанному способу передачи данных.

1-3-1. Дифференциальная импульсно-кодовая модуляция между коэффициентом (0, 0) переменного тока и коэффициентом постоянного тока

Списки масштабирования кодируются с использованием дифференциальной импульсно-кодовой модуляции (DPCM) и передаются. В примере, проиллюстрированном на Фиг. 4, коэффициенты переменного тока и коэффициент постоянного тока кодируются посредством дифференциальной импульсно-кодовой модуляции индивидуально, тогда как в соответствии с одним из признаков настоящей технологии, как в примере, проиллюстрированном на Фиг. 5, определяется и передается разность (также именуемая как заменяющий разностный коэффициент) между коэффициентом (0, 0) переменного тока и коэффициентом постоянного тока.

Как было описано выше, коэффициент (0, 0) переменного тока и коэффициент постоянного тока обычно принимают значения, которые являются близкими друг к другу. Таким образом, разность между коэффициентом (0, 0) переменного тока и коэффициентом постоянного тока вероятно может быть меньше, чем разность между коэффициентом (0, 0) переменного тока и начальным значением "8". Таким образом, передача заменяющего разностного коэффициента, который является разностью между коэффициентом (0, 0) переменного тока и коэффициентом постоянного тока, с использованием настоящей технологии может быть более предпочтительной для того, чтобы уменьшить объем кодирования.

Например, в примере, проиллюстрированном на Фиг. 5, значение этой разности, полученной на этапе (1), составляет "0".

Фиг. 6 представляет собой таблицу, на которой проиллюстрирован пример экспоненциального кодирования Голомба со знаком. Как показано в таблице, проиллюстрированной на Фиг. 6, экспоненциальный код Голомба для значения "4" имеет длину кода, составляющую 7 битов, тогда как экспоненциальный код Голомба для значения "0" имеет длину кода, составляющую 1 бит. Таким образом, способ, проиллюстрированный на Фиг. 5, по сравнению со способом, проиллюстрированным на Фиг. 4, может уменьшить объем кодирования на 6 битов.

Вообще говоря, для передачи матрицы квантования, имеющей размер 8×8, требуется объем кодирования, составляющий приблизительно от 100 битов до 200 битов. Следовательно, 6 битов занимают приблизительно 6% общего объема. Сокращение объема кодирования на 6% в Синтаксисе высокого уровня может быть названо очень большим эффектом.

1-3-2. Совместная передача коэффициента постоянного тока и коэффициентов переменного тока

На Фиг. 7 проиллюстрирован пример синтаксиса списка масштабирования. Синтаксис для примера, проиллюстрированного на Фиг. 4, проиллюстрирован в примере, проиллюстрированном в части (А) на Фиг. 7. В частности, после того, как переданы разность между коэффициентом (0, 0) переменного тока и начальным значением "8" и разности между коэффициентами переменного тока (scaling_list_delta_coef (коэффициент_дельта_списка_масштабирования)), отдельно передается разность между коэффициентом постоянного тока и начальным значением "8" (scaling_list_dc_coef_minus8 (коэффиициент_постоянного_тока_списка_масштабирования_минус8)).

В противоположность этому, один из признаков настоящей технологии заключается в том, что разность между коэффициентом постоянного тока и коэффициентом (0, 0) переменного тока и разности между коэффициентами переменного тока располагаются в этом порядке и передаются совместно. В частности, как проиллюстрировано на Фиг. 5, после того, как коэффициент постоянного тока и коэффициенты переменного тока, располагаемые в предварительно заданном порядке сканирования, расположены одномерным образом, и определена разность между коэффициентом постоянного тока и начальным значением "8", определяются разности между смежными коэффициентами в этой последовательности. Далее, полученные в результате этого разности (разности между коэффициентами) располагаются одномерным образом в порядке получения и передаются все вмести.

Синтаксис в этом случае проиллюстрирован в примере в части (В) на Фиг. 7. В частности, сначала передается разность между коэффициентом постоянного тока и начальным значением "8" (scaling_list_dc_coef_minus8 (коэффиициент_постоянного_тока_списка_масштабирования_минус8)), а после этого передаются разность между коэффициентом постоянного тока и коэффициентом (0, 0) переменного тока и разности между коэффициентами переменного тока (scaling_list_delta_coef (коэффициент_дельта_списка_масштабирования)). Таким образом, коэффициент постоянного тока и коэффициенты переменного тока кодируются и передаются все вместе.

Таким образом, совместная передача разностей, расположенных в порядке получения, позволяет стороне декодирования (декодеру), которому переданы эти разности, декодировать эти разности в порядке их передачи и получить индивидуальные коэффициенты. Таким образом, закодированный посредством дифференциальной импульсно-кодовой модуляции список масштабирования может быть с легкостью декодирован. Более конкретно, нагрузка по обработке данных может быть уменьшена. В дополнение к этому, больше нет необходимости в перестановке разностей, что в результате приводит к уменьшению емкости буфера. Кроме того, соответствующие разности могут быть декодированы в порядке поступления, что в результате приводит к сдерживанию увеличения продолжительности обработки данных.

1-3-3. Передача матрицы по умолчанию

Фиг. 8 представляет собой схему, на которой проиллюстрирован пример синтаксиса для передачи матрицы по умолчанию. На предшествующем уровне техники, как проиллюстрировано на Фиг. 8, для того, чтобы передать информацию, указывающую на использование матрицы по умолчанию, начальный коэффициент (то есть, коэффициент постоянного тока) передается как "0". Таким образом, значение разности между коэффициентом постоянного тока и начальным значением "8" (scaling_list_dc_coef_minus8 (коэффиициент_постоянного_тока_списка_масштабирования_минус8)) составляет "-8". Однако, как проиллюстрировано на Фиг. 6, экспоненциальный код Голомба для значения "-8" имеет длину кода, составляющую 9 битов. Таким образом, существует риск того, что эффективность кодирования может значительно снизиться. Вообще говоря, желательно, чтобы количество битов Синтаксиса высокого уровня было как можно меньше. В дополнение к этому, как проиллюстрировано на Фиг. 8, вследствие повышенной сложности синтаксиса может увеличиться нагрузка по обработке данных.

Для решения этих проблем начальный коэффициент не устанавливается в "0", но изменена семантика scaling_list_pred_matrix_id_delta (дельта_идентификатора_матрицы_предсказания_списка масштабирования). Если описать это более конкретно, то семантика scaling_list_pred_matrix_id_delta изменена с той, что проиллюстрирована в части (А) на Фиг. 9, на ту, что проиллюстрирована в части (В) на Фиг. 9. Таким образом, на предшествующем уровне техники, как проиллюстрировано в части (А) на Фиг. 9, значение, равное "0", указывает на то, что обращение осуществляется к непосредственно предшествующей матрице (MatrixID-1 (ИдентификаторМатрицы-1)). Вместо этого описания, как проиллюстрировано в части (В) на Фиг. 9, значение scaling_list_pred_matrix_id_delta, равное "0" означает то, что обращение осуществляется к матрице по умолчанию.

Соответственно, длина кода у экспоненциального кода Голомба для передачи информации, указывающей на использование матрицы по умолчанию, может быть равной 1 биту, и можно сдерживать снижение эффективности кодирования. Кроме того, на предшествующем уровне техники, для списка масштабирования необходим синтаксис, который проиллюстрирован в частях (А) и (В) на Фиг. 10. Этот синтаксис может быть упрощен, как в примере, проиллюстрированном на Фиг. 11. Таким образом, нагрузка по обработке данных, имеющая место при кодировании и декодировании списка масштабирования, может быть уменьшена.

1-4. Признаки синтаксиса при использовании настоящей технологии

Более конкретно опишем синтаксис.

В примере предшествующего уровня техники, проиллюстрированном в частях (А) и (В) на Фиг. 10, определение умолчания должно быть выполнено дважды, а именно, в случае scaling_list_dc_coef_minus8 (коэффиициент_постоянного_тока_списка_масштабирования_минус8) и scaling_list_delta_coef (коэффициент_дельта_списка_масштабирования). В дополнение к этому, для scaling_list_delta_coef это определение производится в середине цикла "for" ("для"), и в случае, когда useDefaultScalingMatrixFlag = 1 (ФлажокИспользованияМатрицыМасштабированияПоУмолчанию = 1) осуществляется выход из цикла. Кроме того, требуется промежуточный флажок, названный как "stopNow" ("остановкаСейчас"), и, вследствие этого условия, дополнительно существует ответвление, такое как подстановка nextCoef (следующегоКоэффициента) в значение scalingList (спискаМасштабирования). Таким образом, синтаксис на предшествующем уровне техники включает в себя усложненную обработку данных.

В настоящей технологии, соответственно, как в примере, проиллюстрированном на Фиг. 11, коэффициент постоянного тока, вычисленный, исходя из scaling_list_dc_coef_minus8 (коэффиициент_постоянного_тока_списка_масштабирования_минус8) подставляется в nextCoef (следующийКоэффициент) для того, чтобы задать коэффициенту постоянного тока начальное значение scaling_list_delta_coef (коэффициент_дельта_списка_масштабирования).

Кроме того, в семантике, значение scaling_list_pred_matrix_id_delta (дельта_идентификатора_матрицы_предсказания_списка масштабирования), которое на предшествующем уровне техники представлено значением "+1", остается неизменным, и в качестве частного значения используется значение "0".

То есть на предшествующем уровне техники, когда ScalingList [0] [2] (СписокМасштабирования [0] [2]) подлежит декодированию (matrixId = 2) (идентификаторМатрицы = 2), если scaling_list_pred_matrix_id_delta = 0 (дельта_идентификатора_матрицы_предсказания_списка масштабирования = 0), то matrixId = 2 получается из refMatrixId = matrixId-(1+scaling_list_pred_matrix_id_delta) (идентификаторМатрицыДляОбращения = ИдентификаторМатрицы-(1 + дельта_идентификатора_матрицы_предсказания_списка масштабирования)). Таким образом, получается refMatrixId = 1, и значение ScalingList [0] [1] копируется.

В противоположность этому, в настоящей технологии, задается refMatrixId = matrixId-scaling_list_pred_matrix_id_delta. Когда ScalingList [0] [2] подлежит декодированию (matrixId = 2), если ScalingList [0] [1] должен быть скопирован (или если должен быть получен refMatrixId = 1), может быть установлен scaling_list_pred_matrix_id_delta=1.

Соответственно, как проиллюстрировано на Фиг. 11, количество строк синтаксиса для списка масштабирования может быть значительно уменьшено. В дополнение к этому, две переменные, включаемые в состав синтаксиса в качестве промежуточных данных, а именно, UseDefaultScalingMatrix (ИспользованиеМатрицыМасштабированияПоУмолчанию) и stopNow (остановкаСейчас), могут быть опущены. Кроме того, ответвление, сделанное в цикле "for", как это проиллюстрировано на Фиг. 10, больше может не требоваться. Следовательно, нагрузка по обработке данных, имеющая место при кодировании и декодировании списка масштабирования, может быть уменьшена.

1-5. Модули обработки данных, реализующие настоящую технологию

В случае, при котором настоящая технология применяется к передаче списка масштабирования, список масштабирования кодируется и декодируется способом описанным выше. В частности, устройство (10) кодирования изображений, описываемое ниже со ссылкой на Фиг. 14, кодирует список масштабирования и осуществляет передачу закодированного списка масштабирования, а устройство (300) декодирование изображений, описываемое ниже со ссылкой на Фиг. 22, принимает и декодирует закодированный список масштабирования.

Список масштабирования кодируется модулем (150) обработки матрицы (смотри Фиг. 15), имеющемся в модуле (14) ортогонального преобразования/квантования (смотри Фиг. 14), относящемся к устройству (10) кодирования изображений. Если описать это более конкретно, то список масштабирования кодируется модулем (192) дифференциальной импульсно-кодовой модуляции и модулем (193) ехр-G (оба из которых проиллюстрированы на Фиг. 16) в модуле (164) энтропийного кодирования (смотри Фиг. 16), имеющемся в модуле (150) обработки матрицы. Таким образом, модуль (192) дифференциальной импульсно-кодовой модуляции определяет разности между коэффициентами (коэффициентом постоянного тока и коэффициентами переменного тока) списка масштабирования, а модуль (193) ехр-G кодирует индивидуальные разности, используя экспоненциальное кодирование Голомба.

Для того, чтобы закодировать список масштабирования, используя настоящую технологию, которая описана выше, модуль (192) дифференциальной импульсно-кодовой модуляции может иметь приводимую в качестве примера конфигурацию, которая проиллюстрирована, например, на Фиг. 19, и может выполнять процесс дифференциальной импульсно-кодовой модуляции как в примере, проиллюстрированном на Фиг. 21. Кроме того, может быть использована семантика как в примере, проиллюстрированном в части (С) на Фиг. 44 или части (С) на Фиг. 45.

Другими словами, выполнение кодирования списка масштабирования, использующее настоящую технологию, может требоваться только от модуля (192) дифференциальной импульсно-кодовой модуляции и модуля (193) ехр-G, а другие компоненты, имеющие любую конфигурацию, можно использовать как угодно. Необходимая конфигурация, такая как модуль обработки данных для повышающего преобразования списка масштабирования и модуль обработки данных для выполнения квантования с использованием списка масштабирования могут быть предусмотрены в соответствии с вариантами реализации изобретения.

Кроме того, список масштабирования декодирован модулем (410) генерирования матрицы (смотри Фиг. 23), имеющемся в модуле (313) деквантования/обратного ортогонального преобразования (смотри Фиг. 22), относящемся к устройству (300) декодирования изображений. Если описать это более конкретно, то список масштабирования декодируется модулем (551) ехр-G и модулем (552) процесса, обратного дифференциальной импульсно-кодовой модуляции (смотри Фиг. 24), в модуле (533) энтропийного декодирования (смотри Фиг. 24), имеющемся в модуле (410) генерирования матрицы. Таким образом, модуль (551) ехр-G декодирует коды Голомба для того, чтобы получить разности, а модуль (552) процесса, обратного дифференциальной импульсно-кодовой модуляции, определяет, исходя из соответствующих разностей, индивидуальные коэффициенты (коэффициент постоянного тока и коэффициенты переменного тока) списка масштабирования.

Для того, чтобы декодировать закодированный список масштабирования, используя настоящую технологию, которая описана выше, модуль (552) процесса, обратного дифференциальной импульсно-кодовой модуляции, может иметь приводимую в качестве примера конфигурацию, которая проиллюстрирована, например, на Фиг. 26, и может выполнять процесс, обратный дифференциальной импульсно-кодовой модуляции как в примере, проиллюстрированном на Фиг. 29. Кроме того, может быть использована семантика как в примере, проиллюстрированном в части (С) на Фиг. 44 или части (С) на Фиг. 45.

Другими словами, выполнение декодирования списка масштабирования, использующее настоящую технологию, может требоваться только от модуля (551) ехр-G и модуля (552) процесса, обратного дифференциальной импульсно-кодовой модуляции, а другие компоненты, имеющие любую конфигурацию, можно использовать как угодно. Необходимая конфигурация, такая как модуль обработки данных для повышающего преобразования списка масштабирования и модуль обработки данных для выполнения деквантования с использованием списка масштабирования могут быть предусмотрены в соответствии с вариантами реализации изобретения.

Далее, для более детального описания настоящей технологии, будут описаны отдельные варианты реализации изобретения, в которых применена настоящая технология.

2. Второй вариант реализации изобретения

2-1. Синтаксис: Первый способ

(1) Синтаксис на предшествующем уровне техники

Прежде всего, на Фиг. 12 проиллюстрирован пример синтаксиса матрицы квантования (или списка масштабирования) на предшествующем уровне техники. При практическом использовании, обычно осуществляется передача матрицы разностей между списком масштабирования и его матрицей предсказания, а не списком масштабирования. Таким образом, в нижеследующем описании синтаксиса и так далее, предполагается, что описание списка масштабирования может также применяться к матрице разностей.

В части (А) на Фиг. 12 проиллюстрирован синтаксис для данных списка масштабирования (синтаксис данных списка масштабирования), а в части (В) на Фиг. 12 проиллюстрирован синтаксис для списка масштабирования (синтаксис списка масштабирования).

(1-1) Синтаксис данных списка масштабирования

Как проиллюстрировано в части (А) на Фиг. 12, синтаксис для данных списка масштабирования указывает, что считываются флажок (scaling_list_present_flag (флажок_наличия_списка_масштабирования)), показывающий то, предоставлен ли список масштабирования, флажок (scaling_list_pred_mode_flag (флажок_режима_предсказания_списка_масштабирования)), показывающий то, является ли текущий режим режимом копирования, информация (scaling_list_pred_matrix_id_delta (дельта_идентификатора_матрицы_предсказания_списка_масштабирования)), показывающая то, к какому списку масштабирования обращаться в режиме копирования и так далее.

(1-2) Синтаксис списка масштабирования

Как проиллюстрировано в части (В) на Фиг. 12, синтаксис списка масштабирования указывает, что считываются коэффициент постоянного тока, из которого вычтена некоторая постоянная (например, 8) (scaling_list_dc_coef_minus8 (коэффициент_постоянного_тока_списка_масштабирования_минус8)), значение разности (scaling_list_delta_coef (коэффициент_дельта_списка_масштабирования)) между коэффициентами переменного тока и так далее, и что коэффициент постоянного тока и восстанавливаются коэффициенты переменного тока.

Однако существует риск того, что части синтаксиса, описанного выше, не обеспечат достаточную эффективность сжатия коэффициента постоянного тока, хотя он и облегчает процессы.

Соответственно, для того, чтобы получить достаточную эффективность сжатия коэффициента постоянного тока (также именуемого как DC-коэффициент), который является коэффициентом постоянной составляющей (составляющей постоянного тока), определяется разность между коэффициентом постоянного тока и другим коэффициентом, и передается это значение разности вместо коэффициента постоянного тока. Таким образом, значение разности представляет собой информацию для вычисления коэффициента постоянного тока, и, другими словами, является, по существу, эквивалентным коэффициенту постоянного тока. Однако значение разности обычно меньше чем коэффициент постоянного тока. Следовательно, передача значения разности вместо коэффициента постоянного тока может привести в результате к уменьшению объема кодирования.

В нижеследующем описании, для удобства описания, список масштабирования (матрица квантования) имеет размер 8×8. Далее будет описан конкретный пример описанного выше способа для передачи, вместо коэффициента постоянного тока, разности между коэффициентом постоянного тока и другим коэффициентом.

(2) Синтаксис для первого способа

Например, с использованием дифференциальной импульсно-кодовой модуляции (DPCM-модуляции) может быть передано 65 коэффициентов, где коэффициент постоянного тока рассматривается как элемент, расположенный в начале матрицы (8×8) (коэффициентов переменного тока) (первый способ).

Таким образом, в первую очередь, вычисляется разность между некоторой предварительно заданной постоянной и коэффициентом постоянного тока, и эта разность используется в качестве начального коэффициента данных дифференциальной импульсно-кодовой модуляции. После этого вычисляется разность между коэффициентом постоянного тока и начальным коэффициентом переменного тока, и эта разность используется в качестве второго коэффициента данных дифференциальной импульсно-кодовой модуляции. После этого вычисляется разность между начальным коэффициентом переменного тока и вторым коэффициентом переменного тока, и эта разность используется в качестве третьего коэффициента данных дифференциальной импульсно-кодовой модуляции. Вслед за этим, вычисляется разность по отношению к непосредственно предшествующему коэффициенту переменного тока, и эта разность используется в качестве четвертого коэффициента данных дифференциальной импульсно-кодовой модуляции, и следующие коэффициенты данных дифференциальной импульсно-кодовой модуляции определяются способом, аналогичным описанному выше. Коэффициенты данных дифференциальной импульсно-кодовой модуляции, сгенерированные способом, описанный выше, передаются последовательным образом, начиная с начального коэффициента.

Соответственно, степень сжатия может быть улучшена в случае, когда значения коэффициента (0, 0) (коэффициента переменного тока) матрицы (8×8) и коэффициента постоянного тока близки друг к другу. При осуществлении первого способа, описанного выше, устройство кодирования изображений может обрабатывать коэффициент постоянного тока способом, аналогичным способу для коэффициентов переменного тока (АС-коэффициентов), которые являются коэффициентами переменных составляющих (также именуемых как составляющие переменного тока). Отметим, что для осуществления первого способа, описанного выше, устройству декодирования изображений, которому передаются коэффициенты, описанные выше, необходимо специальным образом обрабатывать только начальный коэффициент. В частности, устройство декодирования изображений должно извлечь коэффициент постоянного тока из числа коэффициентов переменного тока.

На Фиг. 13 проиллюстрирован синтаксис списка масштабирования в случае, описанном выше. В примере, проиллюстрированном на Фиг. 13, считываются 65 значений разностей (scaling_list_delta_coef (коэффициент_дельта_списка_масштабирования)) между коэффициентами, и, среди коэффициентов (nextcoef (следующийкоэффициент)) определенных, исходя из этих значений разности, коэффициент (nextcoef), расположенный в начале, используется в качестве коэффициента постоянного тока (scaling_list_dc_coef (коэффиициент_постоянного_тока_списка_масштабирования)), в то время как другие коэффициенты используются в качестве коэффициентов переменного тока (ScalingList [i] (СписокМасштабирования [i])).

Далее будет описано устройство кодирования изображений, которое реализует синтаксис для первого способа, описанного выше.

2-2. Устройство кодирования изображений

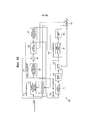

Фиг. 14 представляет собой структурную схему, на которой проиллюстрирован пример конфигурации устройства (10) кодирования изображений, соответствующего варианту реализации настоящего раскрываемого изобретения. Устройство (10) кодирования изображений, проиллюстрированное на Фиг. 14, представляет собой устройство обработки изображений, в котором применена настоящая технология, и которое сконфигурировано таким образом, чтобы кодировать данные входного изображения и выводить закодированные данные изображения. Что касается Фиг. 14, то устройство (10) кодирования изображений включает в себя: модуль (11) аналого-цифрового (A/D) преобразования, буфер (12) переупорядочивания, вычитающий модуль (13), модуль (14) ортогонального преобразования/квантования, модуль (16) кодирования без потерь, накопительный буфер (17), модуль (18) управления скоростью, модуль (21) деквантования, модуль (22) обратного ортогонального преобразования, модуль-сумматор (23), фильтр (24) устранения блочности, память (25) кадров, переключатель (113), модуль (30) внутрикадрового предсказания, модуль (40) поиска движения, модуль (50) выбора режима.

Модуль (11) аналого-цифрового преобразования осуществляет преобразование сигнала изображения, вводимого в аналоговой форме, в данные изображения в цифровой форме и выводит последовательность цифровых данных изображения в буфер (12) переупорядочивания.