JP2005106989A - 楽譜対応データ生成装置及びプログラム - Google Patents

楽譜対応データ生成装置及びプログラム Download PDFInfo

- Publication number

- JP2005106989A JP2005106989A JP2003337914A JP2003337914A JP2005106989A JP 2005106989 A JP2005106989 A JP 2005106989A JP 2003337914 A JP2003337914 A JP 2003337914A JP 2003337914 A JP2003337914 A JP 2003337914A JP 2005106989 A JP2005106989 A JP 2005106989A

- Authority

- JP

- Japan

- Prior art keywords

- note

- information

- note information

- pitch

- data

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 239000011295 pitch Substances 0.000 claims description 153

- 238000000034 method Methods 0.000 claims description 30

- 230000008921 facial expression Effects 0.000 claims description 15

- 238000000605 extraction Methods 0.000 claims description 5

- 230000010365 information processing Effects 0.000 claims description 5

- 238000000926 separation method Methods 0.000 abstract description 46

- 239000000872 buffer Substances 0.000 description 9

- 238000004891 communication Methods 0.000 description 6

- 238000001514 detection method Methods 0.000 description 4

- 230000006870 function Effects 0.000 description 4

- 238000010586 diagram Methods 0.000 description 2

- 230000008447 perception Effects 0.000 description 2

- 238000006243 chemical reaction Methods 0.000 description 1

- 238000007796 conventional method Methods 0.000 description 1

- 230000000694 effects Effects 0.000 description 1

- 239000000203 mixture Substances 0.000 description 1

- 230000008929 regeneration Effects 0.000 description 1

- 238000011069 regeneration method Methods 0.000 description 1

- 230000004044 response Effects 0.000 description 1

- 230000005236 sound signal Effects 0.000 description 1

- 230000002123 temporal effect Effects 0.000 description 1

Images

Landscapes

- Auxiliary Devices For Music (AREA)

- Electrophonic Musical Instruments (AREA)

Abstract

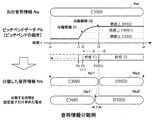

【解決手段】この楽譜対応データ生成システムでは、演奏データ中の音符情報Na及び表情付け情報Pbを分析する。表情付け情報は、各音符情報Naiの聴感上の音高を変化させるピッチベンドデータPb等の情報であり、各音符情報Nai毎に、表情付け情報Pbに基づき所定の音高変化(半音)を与える音高変化点t2,t3を検出し、表情付け情報Pbに対応する奏法を認識する。そして、認識された奏法から元の音符情報Naを分離した方が楽譜に対応すると判断したときは、分離ポイントPsに従って聴感上の音高変化に合う複数の音符情報Nb1,Nb2;Nb1’,Nb2’を生成する。分離ポイントPsは、音高変化点t2,t3の内、分離後の音符長が短くなり過ぎない点に決定される。

【選択図】図2

Description

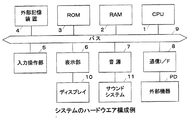

図1は、この発明の一実施例による楽譜対応データ生成システムのハードウエア構成例を示す。この例では、楽譜対応データ生成システムが構築される音楽情報処理装置には、パーソナルコンピュータ等の汎用の情報処理装置に演奏入力及び楽音生成機能を設けたものが用いられるが、電子楽器などの音楽専用の処理装置を用いてもよい。この音楽情報処理装置は、中央処理装置(CPU)1、ランダムアクセスメモリ(RAM)2、読出専用メモリ(ROM)3、外部記憶装置4、入力操作部5、表示部6、音源部7、通信インターフェース(通信I/F)8等の要素を備え、これら要素1〜8はバス9に接続される。

この発明の一実施例による楽譜対応データ生成システムでは、楽譜対応データ生成プログラムに従い、演奏データ中の音符情報及びピッチベンドデータなどの表情付け情報を利用して楽譜対応データが生成される。図2は、この発明の一実施例による音符情報の分離ルールを説明するための図である。

(1)原則として、半音毎の音高変化点t2,t3で音符情報Naiを分離する。

(2)ただし、或る音高変化点t2から次の音高変化点t3までの時間が所定の最小音長時間幅(分離最小時間幅)Δ以上でなければ、当該音高変化点t2では分離しない。

(3)音高変化が終了する最後の音高変化点t3については、調整可能な所定の移動時間幅(音符分離位置調整幅)δだけ早めた時点で分離する場合がある。

(4)なお、例外的に、一旦半音以上の最高音に上げた後再び元の音高に戻る「往復音高変化」の場合には、音符情報Naiを最高音に変更する。

図3は、この発明の一実施例による楽譜対応データ生成の動作例を表わすフローチャートであり、図4は、この発明の一実施例による音符分離処理例を表わすフローチャートである。まず、図3の楽譜対応データ生成動作について説明する。

以上、この発明の好適な一実施例について説明したが、これは単なる一例であって、この発明は、その精神を逸脱しない範囲で種々の変更が可能であり、種々の態様で実施することができる。例えば、生成した楽譜対応データは楽譜の表示に使用してもよいし、演奏ガイドに使用してもよい。また、曲データ中の聴感上も含めた音高の動きを分析するためなどに使用することもできる。

ts,te 個々の音符情報Naiの開始(ノートオン)及び終了(ノートオフ)時間、

Pb ピッチベンドデータ(ピッチベンドイベント、ピッチベンド情報)、

t1,t2,t3,… ピッチベンドの開始時間及び半音変化毎の時間、

C1,C2,… 分離候補音符,

P1,P2,P3,… ポイント要素(ポイント、要素),

Δ 分離最小時間幅(最小音長時間幅)、

Ps 分離ポイント、

Nb;Nb1,Nb2,…;Nb1’,Nb2’,… 分離後の音符情報、

δ 音符分離位置調整幅(移動時間幅)。

Claims (3)

- 演奏データを取得する取得手段と、

取得された演奏データ中の各音符情報、及び、該音符情報の聴感上の音高を変化させる表情付け情報を抽出する抽出手段と、

抽出された表情付け情報に対応する奏法を認識する認識手段と、

認識された奏法に基づいて、抽出された音符情報を異なる音高の複数の音符情報に分離した方が楽譜に対応するか否かを判定する判定手段と、

分離した方が楽譜に対応すると判断されたとき、聴感上の音高が変化するポイントを元にして、当該音符情報を分離し、聴感上の音高変化に合う複数の音符情報を生成する生成手段と

を具備することを特徴とする楽譜対応データ生成装置。 - 前記生成手段は、生成される音符情報の音符長が短くなり過ぎないように前記ポイントを決定する手段を有することを特徴とする請求項1に記載の楽譜対応データ生成装置。

- 演奏データを取得するステップと、

取得された演奏データ中の各音符情報、及び、該音符情報の聴感上の音高を変化させる表情付け情報を抽出するステップと、

抽出された表情付け情報に対応する奏法を認識するステップと、

認識された奏法に基づいて、抽出された音符情報を異なる音高の複数の音符情報に分離した方が楽譜に対応するか否かを判定するステップと、

分離した方が楽譜に対応すると判断されたとき、聴感上の音高が変化するポイントを元にして、当該音符情報を分離し、聴感上の音高変化に合う複数の音符情報を生成するステップと

から成る手順を音楽情報処理装置に実行させるための楽譜対応データ生成プログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003337914A JP2005106989A (ja) | 2003-09-29 | 2003-09-29 | 楽譜対応データ生成装置及びプログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003337914A JP2005106989A (ja) | 2003-09-29 | 2003-09-29 | 楽譜対応データ生成装置及びプログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2005106989A true JP2005106989A (ja) | 2005-04-21 |

Family

ID=34533598

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2003337914A Pending JP2005106989A (ja) | 2003-09-29 | 2003-09-29 | 楽譜対応データ生成装置及びプログラム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2005106989A (ja) |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2007017651A (ja) * | 2005-07-07 | 2007-01-25 | Xing Inc | 楽音再生プログラムおよび楽音再生装置 |

| JP2007256399A (ja) * | 2006-03-21 | 2007-10-04 | Yamaha Corp | 演奏データ処理装置及びプログラム |

| JP2009223078A (ja) * | 2008-03-18 | 2009-10-01 | Yamaha Corp | 音処理装置およびプログラム |

-

2003

- 2003-09-29 JP JP2003337914A patent/JP2005106989A/ja active Pending

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2007017651A (ja) * | 2005-07-07 | 2007-01-25 | Xing Inc | 楽音再生プログラムおよび楽音再生装置 |

| JP2007256399A (ja) * | 2006-03-21 | 2007-10-04 | Yamaha Corp | 演奏データ処理装置及びプログラム |

| JP2009223078A (ja) * | 2008-03-18 | 2009-10-01 | Yamaha Corp | 音処理装置およびプログラム |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US9818396B2 (en) | Method and device for editing singing voice synthesis data, and method for analyzing singing | |

| JP3823930B2 (ja) | 歌唱合成装置、歌唱合成プログラム | |

| US6856923B2 (en) | Method for analyzing music using sounds instruments | |

| CN113874932B (zh) | 电子乐器、电子乐器的控制方法及存储介质 | |

| JP2006030414A (ja) | 音色設定装置及びプログラム | |

| EP3462443B1 (en) | Singing voice edit assistant method and singing voice edit assistant device | |

| JP5061926B2 (ja) | 電子音楽装置及び演奏データ編集表示プログラム | |

| JP2005106989A (ja) | 楽譜対応データ生成装置及びプログラム | |

| JP2013164609A (ja) | 歌唱合成用データベース生成装置、およびピッチカーブ生成装置 | |

| JP3623557B2 (ja) | 自動作曲システムおよび自動作曲方法 | |

| JP4595948B2 (ja) | データ再生装置、データ再生方法およびプログラム | |

| JP3702691B2 (ja) | 自動演奏の制御データ入力装置 | |

| JP2004258564A (ja) | スコアデータ編集装置、スコアデータ表示装置およびプログラム | |

| KR101790998B1 (ko) | 악보전환방법 및 악보전환장치 | |

| JP7260313B2 (ja) | 音楽データ表示プログラム及び音楽データ表示装置 | |

| JP2003216156A (ja) | 和音検出装置及びプログラム | |

| JP7260312B2 (ja) | 音楽データ表示プログラム及び音楽データ表示装置 | |

| CN119296497B (zh) | 翻唱歌曲生成方法、计算机设备、存储介质和程序产品 | |

| JP4595852B2 (ja) | 演奏データ処理装置及びプログラム | |

| JP7578192B2 (ja) | 機械学習モデルを用いた音生成方法および音生成装置 | |

| JP4735221B2 (ja) | 演奏データ編集装置及びプログラム | |

| JP3885803B2 (ja) | 演奏データ変換処理装置及び演奏データ変換処理プログラム | |

| JP6424907B2 (ja) | 演奏情報検索方法を実現するためのプログラム、当該演奏情報検索方法および演奏情報検索装置 | |

| JP5184234B2 (ja) | データ生成装置及びデータ生成プログラム、並びに、再生装置 | |

| JP3775039B2 (ja) | メロディ生成装置と記録媒体 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20060323 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20090216 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20090224 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20090422 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20090526 |