WO2022059463A1 - 広角レンズおよび撮像装置 - Google Patents

広角レンズおよび撮像装置 Download PDFInfo

- Publication number

- WO2022059463A1 WO2022059463A1 PCT/JP2021/031610 JP2021031610W WO2022059463A1 WO 2022059463 A1 WO2022059463 A1 WO 2022059463A1 JP 2021031610 W JP2021031610 W JP 2021031610W WO 2022059463 A1 WO2022059463 A1 WO 2022059463A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- lens

- negative

- wide

- image

- angle

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B13/00—Optical objectives specially designed for the purposes specified below

- G02B13/04—Reversed telephoto objectives

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B13/00—Optical objectives specially designed for the purposes specified below

- G02B13/18—Optical objectives specially designed for the purposes specified below with lenses having one or more non-spherical faces, e.g. for reducing geometrical aberration

Definitions

- the present disclosure relates to a wide-angle lens having a focusing function and an image pickup apparatus provided with such a wide-angle lens.

- the retrofocus type optical system is relatively easy to widen while ensuring the flange back, but it is a restriction on the miniaturization of the optical system because it can take a long flange back. Moreover, it is difficult to correct various aberrations.

- the wide-angle lens according to the embodiment of the present disclosure is a first negative lens, a diaphragm, a first negative lens, and a diaphragm, which are arranged on the most object side and consist of a negative meniscus lens having a convex surface facing the object side.

- L1 ⁇ d ⁇ Lk ⁇ d ⁇ Ln ⁇ d ?? (1) Ln ⁇ d ⁇ 35 ; (2) However, L1 ⁇ d: Abbe number of the first negative lens Ln ⁇ d: Abbe number of the nth negative lens Lk ⁇ d: Abbe number of the kth negative lens (k 2, ..., N-1) And.

- the image pickup apparatus includes a wide-angle lens and an image pickup element that outputs an image pickup signal corresponding to an optical image formed by the wide-angle lens, and the wide-angle lens is the embodiment of the present disclosure. It is composed of a wide-angle lens according to the form.

- n (n ⁇ 4) negative lenses are arranged on the object side of the aperture

- various aberrations are present despite the small size and large diameter. Is well corrected, and the configuration of each negative lens is optimized so that high optical performance can be achieved over the entire screen.

- FIG. 1 It is a lens sectional view which shows the 1st structural example (Example 1) of the wide-angle lens which concerns on one Embodiment of this disclosure. It is an aberration diagram which shows the longitudinal aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 1.

- FIG. It is an aberration diagram which shows the longitudinal aberration at the time of short-distance focusing of the wide-angle lens which concerns on Example 1.

- FIG. It is an aberration diagram which shows the lateral aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 1.

- FIG. 2nd structural example (Example 2) of the wide-angle lens which concerns on one Embodiment It is an aberration diagram which shows the longitudinal aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 2.

- FIG. 2 It is an aberration diagram which shows the longitudinal aberration at the time of short-distance focusing of the wide-angle lens which concerns on Example 2.

- FIG. 2 It is an aberration diagram which shows the lateral aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 2.

- FIG. 3 It is a lens sectional view which shows the 3rd structural example (Example 3) of the wide-angle lens which concerns on one Embodiment. It is an aberration diagram which shows the longitudinal aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 3.

- FIG. 2 It is an aberration diagram which shows the longitudinal aberration at the time of short-distance focusing of the wide-angle lens which concerns on Example 3.

- FIG. It is an aberration diagram which shows the lateral aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 3.

- FIG. It is an aberration diagram which shows the lateral aberration at the time of short-distance focusing of the wide-angle lens which concerns on Example 3.

- FIG. 3 It is an aberration diagram which shows the lateral aberration at the time of short-distance focusing of the wide-angle lens which concerns on Example 3.

- FIG. 4 It is a lens sectional view which shows the 4th structural example (Example 4) of the wide-angle lens which concerns on one Embodiment. It is an aberration diagram which shows the longitudinal aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 4.

- FIG. It is an aberration diagram which shows the longitudinal aberration at the time of short-distance focusing of the wide-angle lens which concerns on Example 4.

- FIG. It is an aberration diagram which shows the lateral aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 4.

- FIG. It is an aberration diagram which shows the lateral aberration at the time of short-distance focusing of the wide-angle lens which concerns on Example 4.

- FIG. 5 It is a lens sectional view which shows the 5th structural example (Example 5) of the wide-angle lens which concerns on one Embodiment. It is an aberration diagram which shows the longitudinal aberration at the time of infinity focusing of the wide-angle lens which concerns on Example 5.

- the retrofocus type optical system is relatively easy to widen the angle while ensuring the flange back, but it is a restriction on the miniaturization of the optical system because a long flange back can be taken. Further, since it is composed of a lens group having a strong negative refractive power on the object side and a lens group having a strong positive refractive power on the image plane side, it is difficult to suppress coma. In addition, it becomes difficult to suppress various aberrations such as chromatic aberration due to the increase in diameter.

- Patent Document 1 Japanese Unexamined Patent Publication No. 2014-202952

- various aberrations associated with an increase in aperture are corrected by adopting a Gaussian type configuration in which the rear group is symmetrical to the aperture stop.

- the positive refractive power on the image plane side is strong, which is disadvantageous for shortening the total length, and it is difficult to suppress coma.

- Patent Document 2 Japanese Unexamined Patent Publication No. 2016-126279

- the focus group is lightened by fixing the aperture stop, while the rear group maintains a symmetric optical system close to the Gaussian type. Therefore, the positive refractive power on the image plane side is strong, which is disadvantageous for shortening the total length, and it is difficult to suppress coma.

- FIG. 1 shows a first configuration example of a wide-angle lens according to an embodiment of the present disclosure, and corresponds to the configuration of the first embodiment described later.

- FIG. 6 shows a second configuration example of the wide-angle lens according to the embodiment, and corresponds to the configuration of the second embodiment described later.

- FIG. 11 shows a third configuration example of the wide-angle lens according to the embodiment, and corresponds to the configuration of the third embodiment described later.

- FIG. 16 shows a fourth configuration example of the wide-angle lens according to the embodiment, and corresponds to the configuration of the fourth embodiment described later.

- FIG. 21 shows a fifth configuration example of the wide-angle lens according to the embodiment, and corresponds to the configuration of the fifth embodiment described later.

- Z1 indicates an optical axis.

- An optical member such as a cover glass for protecting the image pickup device may be arranged between the wide-angle lenses 1 to 5 according to the first to fifth configuration examples and the image plane IMG. Further, in addition to the cover glass, various optical filters such as a low-pass filter and an infrared cut filter may be arranged as optical members.

- the configuration of the wide-angle lens according to the embodiment of the present disclosure will be described in association with the wide-angle lenses 1 to 5 according to each configuration example shown in FIG. It is not limited to the configuration example.

- the wide-angle lens according to the embodiment includes a first negative lens L1 composed of a negative meniscus lens having a convex surface facing the object side, an aperture stop St, and a first negative lens L1.

- a second to nth (n ⁇ 4) negative lenses arranged in order from the object side to the image plane side are provided between the aperture diaphragm St and the lens.

- the wide-angle lens according to the embodiment includes a biconvex air lens La1 formed on an optical path between the second negative lens L2 and the third negative lens L3.

- the "negative lens" of the first to nth negative lenses is a single lens having a negative refractive power by regarding the junction lens as a combination of a plurality of single lenses.

- the junction lens is regarded as a combination of two single lenses.

- the wide-angle lens according to the embodiment satisfies the following conditional expressions (1) and (2).

- L1 ⁇ d ⁇ Lk ⁇ d ⁇ Ln ⁇ d > (1) Ln ⁇ d ⁇ 35 ; (2)

- L1 ⁇ d Abbe number of the first negative lens

- L1 Ln ⁇ d Abbe number of the nth negative lens

- Ln Lk ⁇ d Abbe number of the kth negative lens

- Lk (k 2, ..., N-1)

- L1 ⁇ d Abbe number of the first negative lens

- L1 Ln ⁇ d Abbe number of the nth negative lens

- Ln Lk ⁇ d Abbe number of the kth negative lens

- the wide-angle lens according to the embodiment further satisfies the predetermined conditional expression and the like described later.

- the configuration of each negative lens is optimized, so that the size is small and large.

- various aberrations are satisfactorily corrected, and high optical performance can be realized over the entire screen.

- a first negative lens L1 composed of a negative meniscus lens having a convex surface facing the object side is arranged on the most object side, and from the first negative lens L1 to the aperture stop St. It has four or more negative lenses.

- the wide-angle lens according to the embodiment it is possible to satisfactorily correct coma by having the first negative lens L1 composed of the negative meniscus lens.

- a glass material with a high Abbe number for the first negative lens L1 arranged on the most object side and gradually using a glass material with a low Abbe number as it approaches the aperture stop St four or more negative lenses are used.

- the negative refractive power can be divided on the object side of the aperture aperture St, the occurrence of aberrations of each negative lens can be suppressed, and various aberrations such as distortion and curvature of field can be suppressed. It is possible to provide a large-diameter wide-angle lens that can be corrected satisfactorily and a good image can be obtained over the entire screen.

- the lens arranged on the object side of the aperture stop St plays the role of a wide converter that secures sufficient back focus while increasing the angle of view. Since the lens placed on the object side of the aperture stop St plays the role of a wide converter, it is necessary to arrange the retrofocus type refractive power with the object side as the negative refractive power and the image plane side as the positive refractive power. be. In this case, by arranging the aspherical negative menis lens L1 having a small cornic coefficient with respect to the aperture stop St, it is possible to correct distortion and curvature of field and reduce the size.

- the lens arranged on the object side of the aperture stop St plays the role of a wide converter. Therefore, on the object side of the aperture stop St, it is necessary to arrange the refractive power of the retrofocus type with the object side as the negative refractive power and the image plane side as the positive refractive power.

- the wide-angle lens according to the embodiment by having the biconvex air lens La1 between the second negative lens L2 and the third negative lens L3, the first negative on the object side from the aperture aperture St.

- the negative refractive power of the lens L1 can be suppressed, and various aberrations such as distortion can be corrected.

- the above conditional expression (1) is a preferable condition for suppressing the occurrence of axial chromatic aberration while satisfactorily correcting the chromatic aberration of magnification in the wide-angle lens.

- a glass material having a relatively low Abbe number is used for the negative lens on the object side, the effect of correcting chromatic aberration of magnification is weak.

- a glass material having a high Abbe number is used for the negative lens near the aperture stop St, not only the effect of correcting chromatic aberration of magnification is weak, but also axial chromatic aberration is generated, which makes it difficult to correct it satisfactorily.

- conditional expression (1) is preferable because the chromatic aberration can be corrected more satisfactorily by further satisfying the following conditions.

- L1 ⁇ d ⁇ Lm-1 ⁇ ⁇ d ⁇ Lm ⁇ d > (1)'

- conditional expression (2) is a preferable condition for suppressing the axial chromatic aberration generated in the nth negative lens Ln located at the position closest to the aperture stop St among the plurality of negative lenses on the object side of the aperture stop St. It regulates. If the upper limit of the conditional expression (2) is exceeded, the correction of the axial chromatic aberration will be insufficient and it will be difficult to eliminate the aberration.

- the wide-angle lens according to the embodiment satisfies the following conditional expression (3). -60 ⁇ fLa1 ⁇ -20 together with (3)

- fLa1 The focal length of the air lens La1.

- the air lens La1 has a negative refractive power.

- the air lens La1 plays a role of suppressing the negative refractive power of the first negative lens L1 that causes distortion and coma.

- the conditional expression (3) defines preferable conditions for the air lens La1 to effectively play its role.

- the negative refractive power of the first negative lens L1 becomes stronger, so that distortion and coma are greatly generated, and the lens succeeding the first negative lens L1. This is not preferable because it becomes difficult to correct various aberrations and the role of the air lens La1 having a negative refractive power cannot be sufficiently fulfilled.

- the lower limit value of the conditional expression (3) to ⁇ 55

- the negative refractive power of the first negative lens L1 can be further suppressed, which is preferable.

- the lower limit value of the conditional expression (3) to ⁇ 50, the negative refractive power of the first negative lens L1 can be further suppressed, which is more preferable.

- the wide-angle lens according to the embodiment includes a first lens group G1 having a first to nth negative lens, an aperture aperture St, and the like, in order from the object side to the image plane side along the optical axis Z1.

- the configuration may include a second lens group G2 having a plurality of lenses and having a positive refractive power. In this case, it is desirable that a part of the lenses of the entire second lens group G2 or the plurality of lenses of the second lens group G2 move in the optical axis direction during focusing. This makes it possible to simplify the mechanical mechanism.

- the entire second lens group G2 is regarded as the focus group.

- a part of the lenses of the second lens group G2 is set as the focus group.

- FIG. 1 and the like show the lens arrangement at infinity focusing.

- the moving direction of the focus group when focusing from infinity to a short distance is indicated by an arrow.

- the wide-angle lens according to the embodiment satisfies the following conditional expression (4). 5.5 ⁇

- / f > (4)

- f Focal length of the entire system in the state of focusing at infinity

- f1 Focal length of the first lens group G1.

- the first lens group G1 plays a role similar to that of a wide converter, and by bringing it closer to an afocal optical system, it is possible to suppress the occurrence of distortion and spherical aberration. Further, since the refractive power of the first lens group G1 becomes stronger, the outer diameter of the negative meniscus lens and the size of the aperture diameter are changed, which affects the outer diameter of the lens as a product.

- Conditional expression (4) defines a preferable range for realizing miniaturization of the lens while suppressing the occurrence of distortion and spherical aberration.

- the first lens group G1 has a positive refractive power and falls below the lower limit of the conditional equation (4), distortion aberration is greatly generated and it becomes difficult to correct the aberration. Further, the light beam near the aperture stop St becomes high, and the aperture diameter becomes large, so that the outer diameter of the lens as a product becomes large, which is not preferable.

- the first length group G1 has a negative refractive power and falls below the lower limit of the conditional equation (4), spherical aberration is greatly generated and it becomes difficult to correct the aberration. Further, the outer diameter of the first negative lens L1 made of a negative meniscus lens becomes large, and the outer diameter of the lens as a product becomes large, which is not preferable.

- the lower limit value of the conditional expression (4) it is preferable to set the lower limit value of the conditional expression (4) to 6.5 because it is possible to reduce the size while further suppressing the occurrence of various aberrations. Further, by setting the lower limit value of the conditional expression (4) to 7.3, it is possible to further reduce the size while suppressing the occurrence of various aberrations, which is more preferable.

- f Focal length of the entire system in the state of focusing at infinity

- BF The distance from the lens surface on the image plane side to the image plane IMG.

- conditional expression (5) If the upper limit of the conditional expression (5) is exceeded, the back focus becomes long, and it becomes difficult to shorten the optical system. Further, if it is less than the lower limit of the conditional expression (5), the distance between the lens surface on the image plane side and the image plane IMG becomes short, which makes it difficult to mechanically design the product.

- the back focus can be shortened and the optical system can be shortened, which is preferable.

- the lower limit value of the conditional expression (5) it becomes easier to secure the distance between the lens surface on the image plane side and the image plane IMG, which is preferable.

- the wide-angle lens according to the embodiment satisfies the following conditional expression (6). 3.0 ⁇ f1

- f1 Focal length of the first lens group G1

- f2 Focal length of the second lens group G2 in a state of focusing at infinity.

- the conditional expression (6) is a conditional expression for appropriately setting the ratio of the refractive powers of the first lens group G1 and the second lens group G2.

- the first lens group G1 plays the role of a wide converter that secures sufficient back focus while increasing the angle of view. By making the incident light beam from the first lens group G1 afocal with respect to the second lens group G2, it is possible to suppress fluctuations in spherical aberration during focusing.

- the lower limit value of the conditional expression (6) is 3.5 because various aberrations such as spherical aberration can be suppressed. Further, by setting the lower limit value of the conditional expression (6) to 4.0, various aberrations such as spherical aberration can be suppressed, which is more preferable.

- FIG. 26 shows an example of a configuration of an image pickup apparatus 100 to which a wide-angle lens according to an embodiment is applied.

- the image pickup device 100 is, for example, a digital still camera, and includes a camera block 10, a camera signal processing unit 20, an image processing unit 30, an LCD (Liquid Crystal Display) 40, and an R / W (reader / writer) 50. , CPU (Central Processing Unit) 60, an input unit 70, and a lens drive control unit 80.

- CPU Central Processing Unit

- the camera block 10 is responsible for an image pickup function, and has an image pickup lens 11 and an image pickup element 12 such as a CCD (Charge Coupled Devices) or a CMOS (Complementary Metal Oxide Semiconductor).

- the image pickup element 12 converts the optical image formed by the image pickup lens 11 into an electric signal, thereby outputting an image pickup signal (image signal) corresponding to the optical image.

- the image pickup lens 11 the wide-angle lenses 1 to 5 according to each configuration example shown in FIG. 1 and the like can be applied.

- the camera signal processing unit 20 performs various signal processing such as analog-to-digital conversion, noise removal, image quality correction, and conversion to a brightness / color difference signal for the image signal output from the image pickup element 12.

- the image processing unit 30 performs recording / reproduction processing of an image signal, and performs compression coding / decompression decoding processing of an image signal based on a predetermined image data format, conversion processing of data specifications such as resolution, and the like. It has become.

- the LCD 40 has a function of displaying various data such as an operation state for the user's input unit 70 and a captured image.

- the R / W 50 writes the image data encoded by the image processing unit 30 to the memory card 1000 and reads out the image data recorded on the memory card 1000.

- the memory card 1000 is, for example, a semiconductor memory that can be attached to and detached from a slot connected to the R / W 50.

- the CPU 60 functions as a control processing unit that controls each circuit block provided in the image pickup apparatus 100, and controls each circuit block based on an instruction input signal or the like from the input unit 70.

- the input unit 70 includes various switches and the like on which a required operation is performed by the user.

- the input unit 70 is composed of, for example, a shutter release button for performing a shutter operation, a selection switch for selecting an operation mode, and the like, and outputs an instruction input signal according to the operation by the user to the CPU 60.

- the lens drive control unit 80 controls the drive of the lens arranged in the camera block 10, and controls a motor (not shown) that drives each lens of the image pickup lens 11 based on a control signal from the CPU 60. It has become.

- the image signal shot in the camera block 10 is output to the LCD 40 via the camera signal processing unit 20 and displayed as a camera-through image under the control of the CPU 60. Further, for example, when an instruction input signal for zooming or focusing is input from the input unit 70, the CPU 60 outputs a control signal to the lens drive control unit 80, and the image pickup lens 11 is controlled by the lens drive control unit 80. The predetermined lens moves.

- the captured image signal is output from the camera signal processing unit 20 to the image processing unit 30 for compression coding processing, and a predetermined image signal is processed. Converted to digital data in data format. The converted data is output to the R / W 50 and written to the memory card 1000.

- the lens drive control unit 80 is based on a control signal from the CPU 60. This is done by moving a predetermined lens of the image pickup lens 11.

- the R / W 50 When reproducing the image data recorded on the memory card 1000, the R / W 50 reads out the predetermined image data from the memory card 1000 in response to the operation on the input unit 70, and the image processing unit 30 decompresses and decodes the predetermined image data. After the processing is performed, the reproduced image signal is output to the LCD 40 and the reproduced image is displayed.

- the image pickup device is applied to a digital still camera or the like, but the application range of the image pickup device is not limited to the digital still camera and is applied to various other image pickup devices. It is possible. For example, it can be applied to a digital single-lens reflex camera, a digital non-reflex camera, a digital video camera, a surveillance camera, and the like. Further, it can be widely applied as a camera unit of a digital input / output device such as a mobile phone having a built-in camera or an information terminal having a built-in camera. It can also be applied to interchangeable lens cameras.

- Si indicates the number of the i-th surface, which is coded so as to gradually increase from the object side.

- Ri indicates the value (mm) of the radius of curvature of the paraxial axis of the i-th plane.

- Di indicates the value (mm) of the distance on the optical axis between the i-th surface and the i + 1-th surface.

- Ndi indicates the value of the refractive index with respect to the d-line (wavelength 587.6 nm) of the material of the optical element having the i-th plane.

- ⁇ di indicates the value of the Abbe number in the d-line of the material of the optical element having the i-th plane.

- the part where the value of "ri” is “ ⁇ ” indicates a plane, a diaphragm surface, or the like.

- ASP in the column of the surface number (Si) indicates that the surface is formed of an aspherical shape.

- STO in the surface number column indicates that the aperture stop St is arranged at the corresponding position.

- OBJ in the column of the surface number indicates that the surface is an object surface (subject surface).

- IMG in the surface number column indicates that the surface is an image surface.

- F indicates the focal length of the entire system (unit: mm).

- “Fno” indicates an open F value (F number).

- ⁇ indicates a half angle of view (unit: °).

- Y indicates the image height (unit: mm).

- L indicates the total optical length (distance on the optical axis from the surface closest to the object to the image plane IMG) (unit: mm).

- some lenses used in each embodiment have a lens surface formed of an aspherical surface.

- the aspherical shape is defined by the following equation.

- "Ei” represents an exponential notation with a base of 10, that is, “10- i ", and for example, "0.12345E-05” is “0.12345E-05". It represents "0.12345 x 10-5 ".

- [Table 1] shows the basic lens data of the wide-angle lens 1 according to the first embodiment shown in FIG.

- [Table 2] shows the values of the focal length f, F value, total angle of view 2 ⁇ , image height Y, and optical total length L of the entire system in the wide-angle lens 1 according to the first embodiment.

- [Table 3] shows the data of the plane spacing that becomes variable during focusing in the wide-angle lens 1 according to the first embodiment.

- [Table 4] shows the values of the coefficients representing the shape of the aspherical surface in the wide-angle lens 1 according to the first embodiment.

- [Table 5] shows the start surface and focal length (unit: mm) of each group of the wide-angle lens 1 according to the first embodiment.

- the wide-angle lens 1 according to the first embodiment has a first negative lens L1 composed of a negative meniscus lens having a convex surface facing the object side on the most object side. Further, four negative lenses (first negative lens L1, second negative lens L2, third negative lens L3, and fourth negative lens L4) are used from the first negative lens L1 to the aperture stop St. Have. Further, the wide-angle lens 1 according to the first embodiment has a first lens group G1 having a negative refractive power, an aperture aperture St, and positive lenses in order from the object side to the image plane side along the optical axis Z1. It is composed of a second lens group G2 having a refractive power.

- the first lens group G1 includes a first negative lens L1, a second negative lens L2, a positive lens E3, a third negative lens L3, a positive lens E5, and a positive lens E6 in order from the object side. It is composed of a fourth negative lens L4.

- the second negative lens L2 has a biconcave shape.

- the positive lens E3 is composed of a positive meniscus lens having a convex surface facing the object side.

- the third negative lens L3 has a biconcave shape.

- the positive lens E5 has a biconvex shape.

- the positive lens E6 is composed of a positive meniscus lens having a convex surface facing the image plane side.

- the fourth negative lens L4 is composed of a negative meniscus lens having a convex surface facing the image plane side.

- the first negative lens L1 is an aspherical lens having an aspherical shape formed on both sides.

- the second negative lens L2 and the positive lens E3 are bonded to each other to form a bonded lens.

- the third negative lens L3 and the positive lens E5 are bonded to each other to form a bonded lens.

- the positive lens E6 and the fourth negative lens L4 are bonded to each other to form a bonded lens.

- the first lens group G1 is composed of seven lenses. If the junction lens is regarded as one lens component, the first lens group G1 is composed of four lens components.

- an air lens La1 having a negative refractive power is formed between the positive lens E3 and the third negative lens L3.

- the second lens group G2 consists of lenses E8 to E14 in order from the object side.

- the lens E8 is a biconvex positive lens.

- the lens E9 is a biconvex positive lens.

- the lens E10 is a negative lens having a biconcave shape.

- the lens E11 is a biconvex positive lens.

- the lens E12 is a negative meniscus lens with a convex surface facing the object side.

- the lens E13 is a negative lens having a biconcave shape.

- the lens E14 is a positive meniscus lens with a convex surface facing the object side.

- the lens E9 and the lens E10 are bonded to each other to form a bonded lens.

- the lens E13 is an aspherical lens having an aspherical shape formed on both sides.

- the second lens group G2 is composed of seven lenses. If the junction lens is regarded as one lens component, the second lens group G2 is composed of six lens components.

- the lens E8 to the lens E13 move in the optical axis direction when focusing from an infinity object to a short-distance object. That is, a part of the lenses of the second lens group G2 is the focus group. However, at the time of focusing, a plurality of lenses in the second lens group G2 may be moved at different movement ratios with different air intervals.

- FIG. 2 shows the longitudinal aberration of the wide-angle lens 1 according to the first embodiment at infinity focusing.

- FIG. 3 shows the longitudinal aberration of the wide-angle lens 1 according to the first embodiment at the time of short-distance focusing.

- FIG. 4 shows the lateral aberration of the wide-angle lens 1 according to the first embodiment at infinity focusing.

- FIG. 5 shows the lateral aberration of the wide-angle lens 1 according to the first embodiment at the time of short-distance focusing.

- FIGS. 2 and 3 show spherical aberration, astigmatism (curvature of field), and distortion as longitudinal aberrations.

- the solid line is the d line (587.56 nm)

- the alternate long and short dash line is the g line (435.84 nm)

- the broken line is the C line (656.27 nm).

- S indicates a value in the sagittal image plane

- T indicates a value in the tangential image plane.

- the distortion diagram shows the values on the d-line.

- the values on the tangential image plane are shown on the left side and the values on the sagittal image plane are shown on the right side. The same applies to the aberration diagrams in the other examples thereafter.

- the wide-angle lens 1 according to the first embodiment has a large aperture of about 1.4 F-number and is downsized by the above configuration. Further, as can be seen from each aberration diagram, the wide-angle lens 1 according to the first embodiment has various aberrations satisfactorily corrected and has excellent imaging performance.

- [Table 6] shows the basic lens data of the wide-angle lens 2 according to the second embodiment shown in FIG.

- [Table 7] shows the values of the focal length f, F value, total angle of view 2 ⁇ , image height Y, and optical total length L of the entire system in the wide-angle lens 2 according to the second embodiment.

- [Table 8] shows the data of the plane spacing which is variable at the time of focusing in the wide-angle lens 2 according to the second embodiment.

- [Table 9] shows the values of the coefficients representing the shape of the aspherical surface in the wide-angle lens 2 according to the second embodiment.

- [Table 10] shows the start surface and the focal length (unit: mm) of each group of the wide-angle lens 2 according to the second embodiment.

- the wide-angle lens 2 according to the second embodiment has a first negative lens L1 composed of a negative meniscus lens having a convex surface facing the object side on the most object side. Further, four negative lenses (first negative lens L1, second negative lens L2, third negative lens L3, and fourth negative lens L4) are used from the first negative lens L1 to the aperture stop St. Have. Further, the wide-angle lens 2 according to the second embodiment has a first lens group G1 having a positive refractive power, an aperture aperture St, and positive lenses in order from the object side to the image plane side along the optical axis Z1. It is composed of a second lens group G2 having a refractive power.

- the first lens group G1 includes a first negative lens L1, a second negative lens L2, a positive lens E3, a third negative lens L3, a positive lens E5, and a positive lens E6 in order from the object side. It is composed of a fourth negative lens L4.

- the second negative lens L2 has a biconcave shape.

- the positive lens E3 is composed of a positive meniscus lens having a convex surface facing the object side.

- the third negative lens L3 has a biconcave shape.

- the positive lens E5 has a biconvex shape.

- the positive lens E6 has a biconvex shape.

- the fourth negative lens L4 is composed of a negative meniscus lens having a convex surface facing the image plane side.

- the first negative lens L1 is an aspherical lens having an aspherical shape formed on both sides.

- the second negative lens L2 and the positive lens E3 are bonded to each other to form a bonded lens.

- the third negative lens L3 and the positive lens E5 are bonded to each other to form a bonded lens.

- the positive lens E6 and the fourth negative lens L4 are bonded to each other to form a bonded lens.

- the first lens group G1 is composed of seven lenses. If the junction lens is regarded as one lens component, the first lens group G1 is composed of four lens components.

- an air lens La1 having a negative refractive power is formed between the positive lens E3 and the third negative lens L3.

- the second lens group G2 is composed of lenses E8 to E13 in order from the object side.

- the lens E8 is a biconvex positive lens.

- the lens E9 is a negative lens having a biconcave shape.

- the lens E10 is a biconvex positive lens.

- the lens E11 is a biconvex positive lens.

- the lens E12 is a negative meniscus lens with a convex surface facing the object side.

- the lens E13 is a negative lens having a biconcave shape.

- the lens E8 and the lens E9 are bonded to each other to form a bonded lens.

- the lens E13 is an aspherical lens having an aspherical shape formed on both sides.

- the second lens group G2 is composed of six lenses. If the junction lens is regarded as one lens component, the second lens group G2 is composed of five lens components.

- the lens E8 to the lens E13 move in the optical axis direction when focusing from an infinity object to a short-distance object. That is, the entire second lens group G2 is regarded as the focus group. However, at the time of focusing, a plurality of lenses in the second lens group G2 may be moved at different movement ratios with different air intervals.

- FIG. 7 shows the longitudinal aberration of the wide-angle lens 2 according to the second embodiment at infinity focusing.

- FIG. 8 shows the longitudinal aberration of the wide-angle lens 2 according to the second embodiment at the time of short-distance focusing.

- FIG. 9 shows the lateral aberration of the wide-angle lens 2 according to the second embodiment at infinity focusing.

- FIG. 10 shows the lateral aberration of the wide-angle lens 2 according to the second embodiment at the time of short-distance focusing.

- the wide-angle lens 2 according to the second embodiment has a large aperture of about 1.4 F-number and is downsized by the above configuration. Further, as can be seen from each aberration diagram, the wide-angle lens 2 according to the second embodiment has various aberrations satisfactorily corrected and has excellent imaging performance.

- [Table 11] shows the basic lens data of the wide-angle lens 3 according to the third embodiment shown in FIG.

- [Table 12] shows the values of the focal length f, F value, total angle of view 2 ⁇ , image height Y, and optical total length L of the entire system in the wide-angle lens 3 according to the third embodiment.

- [Table 13] shows the data of the plane spacing which is variable at the time of focusing in the wide-angle lens 3 according to the third embodiment.

- [Table 14] shows the values of the coefficients representing the shape of the aspherical surface in the wide-angle lens 3 according to the third embodiment.

- [Table 15] shows the start surface and the focal length (unit: mm) of each group of the wide-angle lens 3 according to the third embodiment.

- the wide-angle lens 3 according to the third embodiment has a first negative lens L1 made of a negative meniscus lens having a convex surface facing the object side on the most object side. Further, four negative lenses (first negative lens L1, second negative lens L2, third negative lens L3, and fourth negative lens L4) are used from the first negative lens L1 to the aperture stop St. Have. Further, the wide-angle lens 3 according to the third embodiment has a first lens group G1 having a negative refractive power, an aperture aperture St, and positive lenses in order from the object side to the image plane side along the optical axis Z1. It is composed of a second lens group G2 having a refractive power.

- the first lens group G1 includes a first negative lens L1, a second negative lens L2, a positive lens E3, a third negative lens L3, a positive lens E5, and a positive lens E6 in order from the object side. It is composed of a fourth negative lens L4.

- the second negative lens L2 is composed of a negative meniscus lens with a convex surface facing the object side.

- the positive lens E3 is composed of a positive meniscus lens having a convex surface facing the object side.

- the third negative lens L3 has a biconcave shape.

- the positive lens E5 has a biconvex shape.

- the positive lens E6 has a biconvex shape.

- the fourth negative lens L4 is composed of a negative meniscus lens having a convex surface facing the image plane side.

- the first negative lens L1 is an aspherical lens having an aspherical shape formed on both sides.

- the second negative lens L2 and the positive lens E3 are bonded to each other to form a bonded lens.

- the third negative lens L3 and the positive lens E5 are bonded to each other to form a bonded lens.

- the positive lens E6 and the fourth negative lens L4 are bonded to each other to form a bonded lens.

- the first lens group G1 is composed of seven lenses. If the junction lens is regarded as one lens component, the first lens group G1 is composed of four lens components.

- an air lens La1 having a negative refractive power is formed between the positive lens E3 and the third negative lens L3.

- the second lens group G2 consists of lenses E8 to E14 in order from the object side.

- the lens E8 is a biconvex positive lens.

- the lens E9 is a negative lens having a biconcave shape.

- the lens E10 is a biconvex positive lens.

- the lens E11 is a biconvex positive lens.

- the lens E12 is a negative meniscus lens with a convex surface facing the object side.

- the lens E13 is a negative lens having a biconcave shape.

- the lens E14 is a biconvex positive lens.

- the lens E8 and the lens E9 are bonded to each other to form a bonded lens.

- the lens E13 is an aspherical lens having an aspherical shape formed on both sides.

- the second lens group G2 is composed of seven lenses. If the junction lens is regarded as one lens component, the second lens group G2 is composed of six lens components.

- the lens E8 to the lens E13 move in the optical axis direction when focusing from an infinity object to a short-distance object. That is, a part of the lenses of the second lens group G2 is the focus group.

- a plurality of lenses in the second lens group G2 may be moved at different movement ratios with different air intervals.

- FIG. 12 shows the longitudinal aberration of the wide-angle lens 3 according to the third embodiment at infinity focusing.

- FIG. 13 shows the longitudinal aberration of the wide-angle lens 3 according to the third embodiment at the time of short-distance focusing.

- FIG. 14 shows the lateral aberration of the wide-angle lens 3 according to the third embodiment at infinity focusing.

- FIG. 15 shows the lateral aberration of the wide-angle lens 3 according to the third embodiment at the time of short-distance focusing.

- the wide-angle lens 3 according to the third embodiment has a large aperture of about 1.4 F-number and is downsized by the above configuration. Further, as can be seen from each aberration diagram, the wide-angle lens 3 according to the third embodiment has various aberrations satisfactorily corrected and has excellent imaging performance.

- [Table 16] shows the basic lens data of the wide-angle lens 4 according to the fourth embodiment shown in FIG.

- [Table 17] shows the values of the focal length f, F value, total angle of view 2 ⁇ , image height Y, and optical total length L of the entire system in the wide-angle lens 4 according to the fourth embodiment.

- [Table 18] shows the data of the plane spacing which is variable at the time of focusing in the wide-angle lens 4 according to the fourth embodiment.

- [Table 19] shows the values of the coefficients representing the shape of the aspherical surface in the wide-angle lens 4 according to the fourth embodiment.

- [Table 20] shows the start surface and focal length (unit: mm) of each group of the wide-angle lens 4 according to the fourth embodiment.

- the wide-angle lens 4 according to the fourth embodiment has a first negative lens L1 made of a negative meniscus lens having a convex surface facing the object side on the most object side. Further, five negative lenses (first negative lens L1, second negative lens L2, third negative lens L3, fourth negative lens L4, and first negative lens L1) from the first negative lens L1 to the aperture stop St. It has a negative lens L5) of 5. Further, the wide-angle lens 4 according to the fourth embodiment has a first lens group G1 having a positive refractive power, an aperture aperture St, and positive lenses in order from the object side to the image plane side along the optical axis Z1. It is composed of a second lens group G2 having a refractive power.

- the first lens group G1 includes a first negative lens L1, a second negative lens L2, a third negative lens L3, a positive lens E4, a fourth negative lens L4, and a positive lens in order from the object side. It is composed of E6, a positive lens E7, and a fifth negative lens L5.

- the second negative lens L2 is composed of a negative meniscus lens with a convex surface facing the object side.

- the third negative lens L3 has a biconcave shape.

- the positive lens E4 has a biconvex shape.

- the fourth negative lens L4 is composed of a negative meniscus lens having a convex surface facing the image plane side.

- the positive lens E6 is composed of a positive meniscus lens with a convex surface facing the image plane side.

- the positive lens E7 has a biconvex shape.

- the fifth negative lens L5 is composed of a negative meniscus lens having a convex surface facing the image plane side.

- the first negative lens L1 is an aspherical lens having an aspherical shape formed on both sides.

- the third negative lens L3 and the positive lens E4 are bonded to each other to form a bonded lens.

- the fourth negative lens L4 and the positive lens E6 are bonded to each other to form a bonded lens.

- the positive lens E7 and the fifth negative lens L5 are bonded to each other to form a bonded lens.

- the first lens group G1 is composed of eight lenses. If the junction lens is regarded as one lens component, the first lens group G1 is composed of five lens components.

- an air lens La1 having a negative refractive power is formed between the second negative lens L2 and the third negative lens L3.

- the second lens group G2 consists of lenses E9 to E15 in order from the object side.

- the lens E9 is a biconvex positive lens.

- the lens E10 is a negative lens having a biconcave shape.

- the lens E11 is a biconvex positive lens.

- the lens E12 is a biconvex positive lens.

- the lens E13 comprises a negative meniscus lens with a convex surface facing the object side.

- the lens E14 is a negative lens having a biconcave shape.

- the lens E15 is a biconvex positive lens.

- the lens E9 and the lens E10 are bonded to each other to form a bonded lens.

- the lens E14 is an aspherical lens having an aspherical shape formed on both sides.

- the second lens group G2 is composed of seven lenses. If the junction lens is regarded as one lens component, the second lens group G2 is composed of six lens components.

- the lens E9 and the lens E14 move in the optical axis direction when focusing from an infinity object to a short-distance object. That is, a part of the lenses of the second lens group G2 is the focus group. However, at the time of focusing, a plurality of lenses in the second lens group G2 may be moved at different movement ratios with different air intervals.

- FIG. 17 shows the longitudinal aberration of the wide-angle lens 4 according to the fourth embodiment at infinity focusing.

- FIG. 18 shows the longitudinal aberration of the wide-angle lens 4 according to the fourth embodiment at the time of short-distance focusing.

- FIG. 19 shows the lateral aberration of the wide-angle lens 4 according to the fourth embodiment at infinity focusing.

- FIG. 20 shows the lateral aberration of the wide-angle lens 4 according to the fourth embodiment at the time of short-distance focusing.

- the wide-angle lens 4 according to the fourth embodiment has a large aperture of about 1.8 F-number and is downsized by the above configuration. Further, as can be seen from each aberration diagram, the wide-angle lens 4 according to the fourth embodiment has various aberrations satisfactorily corrected and has excellent imaging performance.

- [Table 21] shows the basic lens data of the wide-angle lens 5 according to the fifth embodiment shown in FIG.

- [Table 22] shows the values of the focal length f, F value, total angle of view 2 ⁇ , image height Y, and optical total length L of the entire system in the wide-angle lens 5 according to the fifth embodiment.

- [Table 23] shows the data of the plane spacing that becomes variable during focusing in the wide-angle lens 5 according to the fifth embodiment.

- [Table 24] shows the values of the coefficients representing the shape of the aspherical surface in the wide-angle lens 5 according to the fifth embodiment.

- [Table 25] shows the start surface and the focal length (unit: mm) of each group of the wide-angle lens 5 according to the fifth embodiment.

- the wide-angle lens 5 according to the fifth embodiment has a first negative lens L1 made of a negative meniscus lens having a convex surface facing the object side on the most object side. Further, four negative lenses (first negative lens L1, second negative lens L2, third negative lens L3, and fourth negative lens L4) are used from the first negative lens L1 to the aperture stop St. Have. Further, the wide-angle lens 5 according to the fifth embodiment has a first lens group G1 having a negative refractive power, an aperture aperture St, and positive lenses in order from the object side to the image plane side along the optical axis Z1. It is composed of a second lens group G2 having a refractive power.

- the first lens group G1 includes a first negative lens L1, a second negative lens L2, a positive lens E3, a third negative lens L3, a positive lens E5, and a positive lens E6 in order from the object side. It is composed of a fourth negative lens L4.

- the second negative lens L2 is composed of a negative meniscus lens with a convex surface facing the object side.

- the positive lens E3 is composed of a positive meniscus lens having a convex surface facing the object side.

- the third negative lens L3 has a biconcave shape.

- the positive lens E5 has a biconvex shape.

- the positive lens E6 has a biconvex shape.

- the fourth negative lens L4 is composed of a negative meniscus lens having a convex surface facing the image plane side.

- the first negative lens L1 is an aspherical lens having an aspherical shape formed on both sides.

- the second negative lens L2 and the positive lens E3 are bonded to each other to form a bonded lens.

- the third negative lens L3 and the positive lens E5 are bonded to each other to form a bonded lens.

- the positive lens E6 and the fourth negative lens L4 are bonded to each other to form a bonded lens.

- the first lens group G1 is composed of seven lenses. If the junction lens is regarded as one lens component, the first lens group G1 is composed of four lens components.

- an air lens La1 having a negative refractive power is formed between the positive lens E3 and the third negative lens L3.

- the second lens group G2 consists of lenses E8 to E14 in order from the object side.

- the lens E8 is a biconvex positive lens.

- the lens E9 is a negative lens having a biconcave shape.

- the lens E10 is a biconvex positive lens.

- the lens E11 is a biconvex positive lens.

- the lens E12 is a negative meniscus lens with a convex surface facing the object side.

- the lens E13 is a negative lens having a biconcave shape.

- the lens E14 is a biconvex positive lens.

- the lens E8 and the lens E9 are bonded to each other to form a bonded lens.

- the lens E13 is an aspherical lens having an aspherical shape formed on both sides.

- the second lens group G2 is composed of seven lenses. If the junction lens is regarded as one lens component, the second lens group G2 is composed of six lens components.

- the lens E8 to the lens E13 move in the optical axis direction when focusing from an infinity object to a short-distance object. That is, a part of the lenses of the second lens group G2 is the focus group. However, at the time of focusing, a plurality of lenses in the second lens group G2 may be moved at different movement ratios with different air intervals.

- FIG. 22 shows the longitudinal aberration of the wide-angle lens 5 according to the fifth embodiment at infinity focusing.

- FIG. 23 shows the longitudinal aberration of the wide-angle lens 5 according to the fifth embodiment at the time of short-distance focusing.

- FIG. 24 shows the lateral aberration of the wide-angle lens 5 according to the fifth embodiment at infinity focusing.

- FIG. 25 shows the lateral aberration of the wide-angle lens 5 according to the fifth embodiment at the time of short-distance focusing.

- the wide-angle lens 5 according to the fifth embodiment has a large aperture of about 1.4 F-number and is downsized by the above configuration. Further, as can be seen from each aberration diagram, the wide-angle lens 5 according to the fifth embodiment has various aberrations satisfactorily corrected and has excellent imaging performance.

- [Other numerical data of each embodiment] [Table 26] shows a summary of the values related to each of the above conditional expressions for each embodiment. As can be seen from [Table 26], the values of each embodiment are within the numerical range for each conditional expression.

- the technology according to the present disclosure can be applied to various products.

- the technology according to the present disclosure is any kind of movement such as an automobile, an electric vehicle, a hybrid electric vehicle, a motorcycle, a bicycle, a personal mobility, an airplane, a drone, a ship, a robot, a construction machine, and an agricultural machine (tractor). It may be realized as a device mounted on the body.

- FIG. 27 is a block diagram showing a schematic configuration example of a vehicle control system 7000, which is an example of a mobile control system to which the technique according to the present disclosure can be applied.

- the vehicle control system 7000 includes a plurality of electronic control units connected via a communication network 7010.

- the vehicle control system 7000 includes a drive system control unit 7100, a body system control unit 7200, a battery control unit 7300, an outside information detection unit 7400, an in-vehicle information detection unit 7500, and an integrated control unit 7600. ..

- the communication network 7010 connecting these plurality of control units conforms to any standard such as CAN (Controller Area Network), LIN (Local Interconnect Network), LAN (Local Area Network) or FlexRay (registered trademark). It may be an in-vehicle communication network.

- CAN Controller Area Network

- LIN Local Interconnect Network

- LAN Local Area Network

- FlexRay registered trademark

- Each control unit includes a microcomputer that performs arithmetic processing according to various programs, a storage unit that stores programs executed by the microcomputer or parameters used for various arithmetic, and a drive circuit that drives various controlled devices. To prepare for.

- Each control unit is provided with a network I / F for communicating with other control units via the communication network 7010, and is connected to devices or sensors inside or outside the vehicle by wired communication or wireless communication.

- a communication I / F for performing communication is provided. In FIG.

- control unit 7600 As the functional configuration of the integrated control unit 7600, the microcomputer 7610, the general-purpose communication I / F7620, the dedicated communication I / F7630, the positioning unit 7640, the beacon receiving unit 7650, the in-vehicle device I / F7660, the audio image output unit 7670, The vehicle-mounted network I / F 7680 and the storage unit 7690 are illustrated.

- Other control units also include a microcomputer, a communication I / F, a storage unit, and the like.

- the drive system control unit 7100 controls the operation of the device related to the drive system of the vehicle according to various programs.

- the drive system control unit 7100 has a driving force generator for generating the driving force of the vehicle such as an internal combustion engine or a driving motor, a driving force transmission mechanism for transmitting the driving force to the wheels, and a steering angle of the vehicle. It functions as a control device such as a steering mechanism for adjusting and a braking device for generating braking force of the vehicle.

- the drive system control unit 7100 may have a function as a control device such as ABS (Antilock Brake System) or ESC (Electronic Stability Control).

- the vehicle state detection unit 7110 is connected to the drive system control unit 7100.

- the vehicle state detection unit 7110 may include, for example, a gyro sensor that detects the angular velocity of the axial rotation motion of the vehicle body, an acceleration sensor that detects the acceleration of the vehicle, an accelerator pedal operation amount, a brake pedal operation amount, or steering wheel steering. It includes at least one of sensors for detecting an angle, engine speed, wheel speed, and the like.

- the drive system control unit 7100 performs arithmetic processing using a signal input from the vehicle state detection unit 7110, and controls an internal combustion engine, a drive motor, an electric power steering device, a brake device, and the like.

- the body system control unit 7200 controls the operation of various devices mounted on the vehicle body according to various programs.

- the body system control unit 7200 functions as a keyless entry system, a smart key system, a power window device, or a control device for various lamps such as headlamps, back lamps, brake lamps, turn signals or fog lamps.

- a radio wave transmitted from a portable device that substitutes for a key or signals of various switches may be input to the body system control unit 7200.

- the body system control unit 7200 receives inputs of these radio waves or signals and controls a vehicle door lock device, a power window device, a lamp, and the like.

- the battery control unit 7300 controls the secondary battery 7310, which is the power supply source of the drive motor, according to various programs. For example, information such as the battery temperature, the battery output voltage, or the remaining capacity of the battery is input to the battery control unit 7300 from the battery device including the secondary battery 7310. The battery control unit 7300 performs arithmetic processing using these signals, and controls the temperature control of the secondary battery 7310 or the cooling device provided in the battery device.

- the vehicle outside information detection unit 7400 detects information outside the vehicle equipped with the vehicle control system 7000.

- the image pickup unit 7410 and the vehicle exterior information detection unit 7420 is connected to the vehicle exterior information detection unit 7400.

- the image pickup unit 7410 includes at least one of a ToF (TimeOfFlight) camera, a stereo camera, a monocular camera, an infrared camera, and other cameras.

- the vehicle outside information detection unit 7420 is used, for example, to detect the current weather or an environment sensor for detecting the weather, or other vehicles, obstacles, pedestrians, etc. around the vehicle equipped with the vehicle control system 7000. At least one of the ambient information detection sensors is included.

- the environment sensor may be, for example, at least one of a raindrop sensor that detects rainy weather, a fog sensor that detects fog, a sunshine sensor that detects the degree of sunshine, and a snow sensor that detects snowfall.

- the ambient information detection sensor may be at least one of an ultrasonic sensor, a radar device, and a LIDAR (Light Detection and Ringing, Laser Imaging Detection and Ringing) device.

- the image pickup unit 7410 and the vehicle exterior information detection unit 7420 may be provided as independent sensors or devices, or may be provided as a device in which a plurality of sensors or devices are integrated.

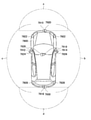

- FIG. 28 shows an example of the installation position of the image pickup unit 7410 and the vehicle exterior information detection unit 7420.

- the image pickup unit 7910, 7912, 7914, 7916, 7918 are provided, for example, at at least one of the front nose, side mirror, rear bumper, back door, and upper part of the windshield of the vehicle interior of the vehicle 7900.

- the image pickup unit 7910 provided in the front nose and the image pickup section 7918 provided in the upper part of the windshield in the vehicle interior mainly acquire an image in front of the vehicle 7900.

- the image pickup units 7912 and 7914 provided in the side mirrors mainly acquire images of the side of the vehicle 7900.

- the image pickup unit 7916 provided in the rear bumper or the back door mainly acquires an image of the rear of the vehicle 7900.

- the image pickup unit 7918 provided on the upper part of the windshield in the vehicle interior is mainly used for detecting a preceding vehicle, a pedestrian, an obstacle, a traffic light, a traffic sign, a lane, or the like.

- FIG. 28 shows an example of the shooting range of each of the imaging units 7910, 7912, 7914, 7916.

- the imaging range a indicates the imaging range of the imaging unit 7910 provided on the front nose

- the imaging ranges b and c indicate the imaging range of the imaging units 7912 and 7914 provided on the side mirrors, respectively

- the imaging range d indicates the imaging range d.

- the imaging range of the imaging unit 7916 provided on the rear bumper or the back door is shown. For example, by superimposing the image data captured by the image pickup units 7910, 7912, 7914, 7916, a bird's-eye view image of the vehicle 7900 can be obtained.

- the vehicle exterior information detection unit 7920, 7922, 7924, 7926, 7928, 7930 provided at the front, rear, side, corner and the upper part of the windshield of the vehicle interior of the vehicle 7900 may be, for example, an ultrasonic sensor or a radar device.

- the vehicle exterior information detection units 7920, 7926, 7930 provided on the front nose, rear bumper, back door, and upper part of the windshield in the vehicle interior of the vehicle 7900 may be, for example, a lidar device.

- These out-of-vehicle information detection units 7920 to 7930 are mainly used for detecting a preceding vehicle, a pedestrian, an obstacle, or the like.

- the vehicle outside information detection unit 7400 causes the image pickup unit 7410 to capture an image of the outside of the vehicle and receives the captured image data. Further, the vehicle exterior information detection unit 7400 receives detection information from the connected vehicle exterior information detection unit 7420. When the vehicle exterior information detection unit 7420 is an ultrasonic sensor, a radar device, or a lidar device, the vehicle exterior information detection unit 7400 transmits ultrasonic waves, electromagnetic waves, or the like, and receives received reflected wave information.

- the out-of-vehicle information detection unit 7400 may perform object detection processing or distance detection processing such as a person, a vehicle, an obstacle, a sign, or a character on a road surface based on the received information.

- the out-of-vehicle information detection unit 7400 may perform an environment recognition process for recognizing rainfall, fog, road surface conditions, etc. based on the received information.

- the out-of-vehicle information detection unit 7400 may calculate the distance to an object outside the vehicle based on the received information.

- the vehicle outside information detection unit 7400 may perform image recognition processing or distance detection processing for recognizing a person, a vehicle, an obstacle, a sign, a character on the road surface, or the like based on the received image data.

- the vehicle exterior information detection unit 7400 performs processing such as distortion correction or alignment on the received image data, and synthesizes image data captured by different image pickup units 7410 to generate a bird's-eye view image or a panoramic image. May be good.

- the vehicle exterior information detection unit 7400 may perform the viewpoint conversion process using the image data captured by different image pickup units 7410.

- the in-vehicle information detection unit 7500 detects the in-vehicle information.

- a driver state detection unit 7510 that detects the state of the driver is connected to the in-vehicle information detection unit 7500.

- the driver state detection unit 7510 may include a camera that captures the driver, a biosensor that detects the driver's biological information, a microphone that collects sound in the vehicle interior, and the like.

- the biosensor is provided on, for example, on the seat surface or the steering wheel, and detects the biometric information of the passenger sitting on the seat or the driver holding the steering wheel.

- the in-vehicle information detection unit 7500 may calculate the degree of fatigue or concentration of the driver based on the detection information input from the driver state detection unit 7510, and may determine whether the driver is asleep. You may.

- the in-vehicle information detection unit 7500 may perform processing such as noise canceling processing on the collected audio signal.

- the integrated control unit 7600 controls the overall operation in the vehicle control system 7000 according to various programs.

- An input unit 7800 is connected to the integrated control unit 7600.

- the input unit 7800 is realized by a device that can be input-operated by the occupant, such as a touch panel, a button, a microphone, a switch, or a lever. Data obtained by recognizing the voice input by the microphone may be input to the integrated control unit 7600.

- the input unit 7800 may be, for example, a remote control device using infrared rays or other radio waves, or an external connection device such as a mobile phone or a PDA (Personal Digital Assistant) corresponding to the operation of the vehicle control system 7000. You may.

- the input unit 7800 may be, for example, a camera, in which case the passenger can input information by gesture. Alternatively, data obtained by detecting the movement of the wearable device worn by the passenger may be input. Further, the input unit 7800 may include, for example, an input control circuit that generates an input signal based on the information input by the passenger or the like using the above input unit 7800 and outputs the input signal to the integrated control unit 7600. By operating the input unit 7800, the passenger or the like inputs various data to the vehicle control system 7000 and instructs the processing operation.

- the storage unit 7690 may include a ROM (Read Only Memory) for storing various programs executed by the microcomputer, and a RAM (Random Access Memory) for storing various parameters, calculation results, sensor values, and the like. Further, the storage unit 7690 may be realized by a magnetic storage device such as an HDD (Hard Disc Drive), a semiconductor storage device, an optical storage device, an optical magnetic storage device, or the like.

- ROM Read Only Memory

- RAM Random Access Memory

- the general-purpose communication I / F 7620 is a general-purpose communication I / F that mediates communication with various devices existing in the external environment 7750.

- General-purpose communication I / F7620 is a cellular communication protocol such as GSM (registered trademark) (Global System of Mobile communications), WiMAX (registered trademark), LTE (registered trademark) (Long Term Evolution) or LTE-A (LTE-Advanced).

- GSM Global System of Mobile communications

- WiMAX registered trademark

- LTE registered trademark

- LTE-A Long Term Evolution-Advanced

- Bluetooth® may be implemented.

- the general-purpose communication I / F7620 connects to a device (for example, an application server or a control server) existing on an external network (for example, the Internet, a cloud network, or a business-specific network) via a base station or an access point, for example. You may. Further, the general-purpose communication I / F7620 uses, for example, P2P (Peer To Peer) technology to provide a terminal existing in the vicinity of the vehicle (for example, a driver, a pedestrian or a store terminal, or an MTC (Machine Type Communication) terminal). May be connected with.

- P2P Peer To Peer

- MTC Machine Type Communication

- the dedicated communication I / F 7630 is a communication I / F that supports a communication protocol formulated for use in a vehicle.

- the dedicated communication I / F7630 uses a standard protocol such as WAVE (Wireless Access in Vehicle Environment), DSRC (Dedicated Short Range Communications), which is a combination of IEEE802.11p in the lower layer and IEEE1609 in the upper layer, or a cellular communication protocol. May be implemented.

- Dedicated communication I / F7630 is typically vehicle-to-vehicle (Vehicle to Vehicle) communication, road-to-vehicle (Vehicle to Infrastructure) communication, vehicle-to-home (Vehicle to Home) communication, and pedestrian-to-vehicle (Vehicle to Pedestrian) communication. ) Carry out V2X communication, a concept that includes one or more of the communications.

- the positioning unit 7640 receives, for example, a GNSS signal from a GNSS (Global Navigation Satellite System) satellite (for example, a GPS signal from a GPS (Global Positioning System) satellite) and executes positioning, and performs positioning, and the latitude, longitude, and altitude of the vehicle. Generate location information including.

- the positioning unit 7640 may specify the current position by exchanging signals with the wireless access point, or may acquire position information from a terminal such as a mobile phone, PHS, or smartphone having a positioning function.

- the beacon receiving unit 7650 receives, for example, a radio wave or an electromagnetic wave transmitted from a radio station or the like installed on a road, and acquires information such as a current position, a traffic jam, a road closure, or a required time.

- the function of the beacon receiving unit 7650 may be included in the above-mentioned dedicated communication I / F 7630.

- the in-vehicle device I / F 7660 is a communication interface that mediates the connection between the microcomputer 7610 and various in-vehicle devices 7760 existing in the vehicle.

- the in-vehicle device I / F7660 may establish a wireless connection using a wireless communication protocol such as wireless LAN, Bluetooth (registered trademark), NFC (Near Field Communication) or WUSB (Wireless USB).

- a wireless communication protocol such as wireless LAN, Bluetooth (registered trademark), NFC (Near Field Communication) or WUSB (Wireless USB).

- the in-vehicle device I / F7660 can be connected to USB (Universal Serial Bus), HDMI (registered trademark) (High-Definition Multimedia Interface), or MHL (Mobile) via a connection terminal (and a cable if necessary) (not shown).

- a wired connection such as High-definition Link may be established.

- the in-vehicle device 7760 may include, for example, at least one of a passenger's mobile device or wearable device, or information device carried in or attached to the vehicle. Further, the in-vehicle device 7760 may include a navigation device that searches for a route to an arbitrary destination.

- the in-vehicle device I / F 7660 exchanges control signals or data signals with these in-vehicle devices 7760.

- the in-vehicle network I / F7680 is an interface that mediates communication between the microcomputer 7610 and the communication network 7010.

- the vehicle-mounted network I / F7680 transmits / receives signals and the like according to a predetermined protocol supported by the communication network 7010.

- the microcomputer 7610 of the integrated control unit 7600 is via at least one of general-purpose communication I / F7620, dedicated communication I / F7630, positioning unit 7640, beacon receiving unit 7650, in-vehicle device I / F7660, and in-vehicle network I / F7680.

- the vehicle control system 7000 is controlled according to various programs based on the information acquired. For example, the microcomputer 7610 calculates the control target value of the driving force generator, the steering mechanism, or the braking device based on the acquired information inside and outside the vehicle, and outputs a control command to the drive system control unit 7100. May be good.

- the microcomputer 7610 realizes ADAS (Advanced Driver Assistance System) functions including vehicle collision avoidance or impact mitigation, follow-up driving based on inter-vehicle distance, vehicle speed maintenance driving, vehicle collision warning, vehicle lane deviation warning, and the like. Cooperative control may be performed for the purpose of.

- the microcomputer 7610 automatically travels autonomously without relying on the driver's operation by controlling the driving force generator, steering mechanism, braking device, etc. based on the acquired information on the surroundings of the vehicle. Coordinated control may be performed for the purpose of driving or the like.

- the microcomputer 7610 has information acquired via at least one of a general-purpose communication I / F7620, a dedicated communication I / F7630, a positioning unit 7640, a beacon receiving unit 7650, an in-vehicle device I / F7660, and an in-vehicle network I / F7680. Based on the above, three-dimensional distance information between the vehicle and an object such as a surrounding structure or a person may be generated, and local map information including the peripheral information of the current position of the vehicle may be created. Further, the microcomputer 7610 may predict the danger of a vehicle collision, a pedestrian or the like approaching or entering a closed road, and generate a warning signal based on the acquired information.

- the warning signal may be, for example, a signal for generating a warning sound or lighting a warning lamp.

- the audio image output unit 7670 transmits an output signal of at least one of audio and image to an output device capable of visually or audibly notifying information to the passenger or the outside of the vehicle.

- an audio speaker 7710, a display unit 7720, and an instrument panel 7730 are exemplified as output devices.

- the display unit 7720 may include, for example, at least one of an onboard display and a head-up display.

- the display unit 7720 may have an AR (Augmented Reality) display function.

- the output device may be other devices such as headphones, wearable devices such as eyeglass-type displays worn by passengers, projectors or lamps other than these devices.

- the display device displays the results obtained by various processes performed by the microcomputer 7610 or the information received from other control units in various formats such as texts, images, tables, and graphs. Display visually.

- the audio output device converts an audio signal composed of reproduced audio data, acoustic data, or the like into an analog signal and outputs the audio signal audibly.

- At least two control units connected via the communication network 7010 may be integrated as one control unit.

- each control unit may be composed of a plurality of control units.

- the vehicle control system 7000 may include another control unit (not shown).

- the other control unit may have a part or all of the functions carried out by any of the control units. That is, as long as information is transmitted and received via the communication network 7010, predetermined arithmetic processing may be performed by any of the control units.

- a sensor or device connected to any control unit may be connected to another control unit, and a plurality of control units may send and receive detection information to and from each other via the communication network 7010. .

- the wide-angle lens and the image pickup apparatus of the present disclosure can be applied to the image pickup unit 7410 and the image pickup unit 7910, 7912, 7914, 7916, 7918.

- the technique according to the present disclosure may be applied to an endoscopic surgery system.

- FIG. 29 is a diagram showing an example of a schematic configuration of an endoscopic surgery system 5000 to which the technique according to the present disclosure can be applied.

- FIG. 29 illustrates a surgeon (doctor) 5067 performing surgery on patient 5071 on patient bed 5069 using the endoscopic surgery system 5000.

- the endoscopic surgery system 5000 includes an endoscope 5001, other surgical tools 5017, a support arm device 5027 for supporting the endoscope 5001, and various devices for endoscopic surgery. It is composed of a cart 5037 and a cart 5037.