WO2017057041A1 - 信号処理装置、信号処理方法、およびプログラム - Google Patents

信号処理装置、信号処理方法、およびプログラム Download PDFInfo

- Publication number

- WO2017057041A1 WO2017057041A1 PCT/JP2016/077397 JP2016077397W WO2017057041A1 WO 2017057041 A1 WO2017057041 A1 WO 2017057041A1 JP 2016077397 W JP2016077397 W JP 2016077397W WO 2017057041 A1 WO2017057041 A1 WO 2017057041A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- target

- coordinate system

- signal processing

- correspondence

- detected

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/02—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S13/00

- G01S7/40—Means for monitoring or calibrating

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/02—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S13/00

- G01S7/40—Means for monitoring or calibrating

- G01S7/4004—Means for monitoring or calibrating of parts of a radar system

- G01S7/4026—Antenna boresight

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01C—MEASURING DISTANCES, LEVELS OR BEARINGS; SURVEYING; NAVIGATION; GYROSCOPIC INSTRUMENTS; PHOTOGRAMMETRY OR VIDEOGRAMMETRY

- G01C3/00—Measuring distances in line of sight; Optical rangefinders

- G01C3/02—Details

- G01C3/06—Use of electric means to obtain final indication

- G01C3/08—Use of electric radiation detectors

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01C—MEASURING DISTANCES, LEVELS OR BEARINGS; SURVEYING; NAVIGATION; GYROSCOPIC INSTRUMENTS; PHOTOGRAMMETRY OR VIDEOGRAMMETRY

- G01C3/00—Measuring distances in line of sight; Optical rangefinders

- G01C3/10—Measuring distances in line of sight; Optical rangefinders using a parallactic triangle with variable angles and a base of fixed length in the observation station, e.g. in the instrument

- G01C3/14—Measuring distances in line of sight; Optical rangefinders using a parallactic triangle with variable angles and a base of fixed length in the observation station, e.g. in the instrument with binocular observation at a single point, e.g. stereoscopic type

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S13/00—Systems using the reflection or reradiation of radio waves, e.g. radar systems; Analogous systems using reflection or reradiation of waves whose nature or wavelength is irrelevant or unspecified

- G01S13/86—Combinations of radar systems with non-radar systems, e.g. sonar, direction finder

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S13/00—Systems using the reflection or reradiation of radio waves, e.g. radar systems; Analogous systems using reflection or reradiation of waves whose nature or wavelength is irrelevant or unspecified

- G01S13/86—Combinations of radar systems with non-radar systems, e.g. sonar, direction finder

- G01S13/867—Combination of radar systems with cameras

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S13/00—Systems using the reflection or reradiation of radio waves, e.g. radar systems; Analogous systems using reflection or reradiation of waves whose nature or wavelength is irrelevant or unspecified

- G01S13/88—Radar or analogous systems specially adapted for specific applications

- G01S13/93—Radar or analogous systems specially adapted for specific applications for anti-collision purposes

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S13/00—Systems using the reflection or reradiation of radio waves, e.g. radar systems; Analogous systems using reflection or reradiation of waves whose nature or wavelength is irrelevant or unspecified

- G01S13/88—Radar or analogous systems specially adapted for specific applications

- G01S13/93—Radar or analogous systems specially adapted for specific applications for anti-collision purposes

- G01S13/931—Radar or analogous systems specially adapted for specific applications for anti-collision purposes of land vehicles

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/02—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S13/00

- G01S7/28—Details of pulse systems

- G01S7/285—Receivers

- G01S7/295—Means for transforming co-ordinates or for evaluating data, e.g. using computers

- G01S7/2955—Means for determining the position of the radar coordinate system for evaluating the position data of the target in another coordinate system

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/02—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S13/00

- G01S7/40—Means for monitoring or calibrating

- G01S7/4052—Means for monitoring or calibrating by simulation of echoes

- G01S7/4082—Means for monitoring or calibrating by simulation of echoes using externally generated reference signals, e.g. via remote reflector or transponder

- G01S7/4086—Means for monitoring or calibrating by simulation of echoes using externally generated reference signals, e.g. via remote reflector or transponder in a calibrating environment, e.g. anechoic chamber

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

- G06T7/74—Determining position or orientation of objects or cameras using feature-based methods involving reference images or patches

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/50—Context or environment of the image

- G06V20/56—Context or environment of the image exterior to a vehicle by using sensors mounted on the vehicle

- G06V20/58—Recognition of moving objects or obstacles, e.g. vehicles or pedestrians; Recognition of traffic objects, e.g. traffic signs, traffic lights or roads

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/60—Type of objects

- G06V20/64—Three-dimensional objects

- G06V20/647—Three-dimensional objects by matching two-dimensional images to three-dimensional objects

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/16—Anti-collision systems

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/16—Anti-collision systems

- G08G1/166—Anti-collision systems for active traffic, e.g. moving vehicles, pedestrians, bikes

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/204—Image signal generators using stereoscopic image cameras

- H04N13/239—Image signal generators using stereoscopic image cameras using two 2D image sensors having a relative position equal to or related to the interocular distance

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/204—Image signal generators using stereoscopic image cameras

- H04N13/246—Calibration of cameras

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60R—VEHICLES, VEHICLE FITTINGS, OR VEHICLE PARTS, NOT OTHERWISE PROVIDED FOR

- B60R21/00—Arrangements or fittings on vehicles for protecting or preventing injuries to occupants or pedestrians in case of accidents or other traffic risks

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S15/00—Systems using the reflection or reradiation of acoustic waves, e.g. sonar systems

- G01S15/86—Combinations of sonar systems with lidar systems; Combinations of sonar systems with systems not using wave reflection

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S15/00—Systems using the reflection or reradiation of acoustic waves, e.g. sonar systems

- G01S15/88—Sonar systems specially adapted for specific applications

- G01S15/93—Sonar systems specially adapted for specific applications for anti-collision purposes

- G01S15/931—Sonar systems specially adapted for specific applications for anti-collision purposes of land vehicles

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/86—Combinations of lidar systems with systems other than lidar, radar or sonar, e.g. with direction finders

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/88—Lidar systems specially adapted for specific applications

- G01S17/93—Lidar systems specially adapted for specific applications for anti-collision purposes

- G01S17/931—Lidar systems specially adapted for specific applications for anti-collision purposes of land vehicles

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S13/00—Systems using the reflection or reradiation of radio waves, e.g. radar systems; Analogous systems using reflection or reradiation of waves whose nature or wavelength is irrelevant or unspecified

- G01S13/88—Radar or analogous systems specially adapted for specific applications

- G01S13/93—Radar or analogous systems specially adapted for specific applications for anti-collision purposes

- G01S13/931—Radar or analogous systems specially adapted for specific applications for anti-collision purposes of land vehicles

- G01S2013/9323—Alternative operation using light waves

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S13/00—Systems using the reflection or reradiation of radio waves, e.g. radar systems; Analogous systems using reflection or reradiation of waves whose nature or wavelength is irrelevant or unspecified

- G01S13/88—Radar or analogous systems specially adapted for specific applications

- G01S13/93—Radar or analogous systems specially adapted for specific applications for anti-collision purposes

- G01S13/931—Radar or analogous systems specially adapted for specific applications for anti-collision purposes of land vehicles

- G01S2013/9324—Alternative operation using ultrasonic waves

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/497—Means for monitoring or calibrating

- G01S7/4972—Alignment of sensor

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/52—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S15/00

- G01S7/52004—Means for monitoring or calibrating

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10004—Still image; Photographic image

- G06T2207/10012—Stereo images

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10032—Satellite or aerial image; Remote sensing

- G06T2207/10044—Radar image

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30248—Vehicle exterior or interior

- G06T2207/30252—Vehicle exterior; Vicinity of vehicle

- G06T2207/30261—Obstacle

Definitions

- the present technology relates to a signal processing device, a signal processing method, and a program, and more particularly, to a signal processing device, a signal processing method, and a program that enable calibration with high accuracy.

- Patent Document 1 proposes a method of performing sensor fusion calibration using a calibration-dedicated board (reflecting plate).

- the present technology has been made in view of such a situation, and enables calibration with high accuracy.

- a signal processing device includes a first position calculation unit that calculates a three-dimensional position of a target in a first coordinate system from a stereo image captured by a stereo camera, and at least one of a horizontal direction and a vertical direction.

- a second position calculation unit that calculates the three-dimensional position of the target in the second coordinate system from the sensor signal of the sensor that can acquire the position information of the position and the position information in the depth direction; Based on the detected correspondence, the correspondence detection unit that detects the correspondence between the target and the target on the second coordinate system, the first coordinate system and the second coordinate system

- a positional relationship information estimation unit that estimates positional relationship information.

- a signal processing method calculates a three-dimensional position of a target in a first coordinate system from a stereo image captured by a stereo camera, and acquires position information of at least one of a horizontal direction and a vertical direction, and a depth.

- a three-dimensional position of the target in a second coordinate system is calculated from a sensor signal of a sensor capable of acquiring direction position information, and the target on the first coordinate system and the second coordinate system are calculated. Detecting a correspondence relationship with the target, and estimating positional relationship information between the first coordinate system and the second coordinate system based on the detected correspondence relationship.

- a program calculates a three-dimensional position of a target in a first coordinate system from a stereo image captured by a stereo camera on a computer, and position information on at least one of a horizontal direction and a vertical direction;

- a three-dimensional position of the target in a second coordinate system is calculated from a sensor signal of a sensor capable of acquiring position information in the depth direction, and the target on the first coordinate system and the second coordinate system are calculated.

- Detecting a correspondence relationship between the first coordinate system and the second coordinate system based on the detected correspondence relationship and executing a process including a step of estimating positional relationship information between the first coordinate system and the second coordinate system. Is.

- a three-dimensional position of the target in the first coordinate system is calculated from a stereo image captured by a stereo camera, and at least one position information in the horizontal direction or the vertical direction and a position in the depth direction are calculated.

- a three-dimensional position of the target in a second coordinate system is calculated from a sensor signal of a sensor capable of acquiring information, and the target on the first coordinate system, the target on the second coordinate system, And the positional relationship information between the first coordinate system and the second coordinate system is estimated based on the detected correspondence relationship.

- program can be provided by being transmitted through a transmission medium or by being recorded on a recording medium.

- the signal processing device may be an independent device, or may be an internal block constituting one device.

- calibration can be performed with high accuracy.

- FIG. 18 is a block diagram illustrating a configuration example of an embodiment of a computer to which the present technology is applied.

- FIG. 1 is a block diagram illustrating a configuration example of an object detection system to which the present technology is applied.

- the object detection system 1 in FIG. 1 includes a millimeter wave radar 11, a stereo camera 12, and a signal processing device 13, and detects an object that becomes an obstacle using each of the millimeter wave radar 11 and the stereo camera 12. System.

- the object detection system 1 is mounted on a vehicle such as an automobile or a truck.

- the millimeter wave radar 11 and the stereo camera 12 are mounted so that the detection direction faces the front of the vehicle, and the object detection direction is detected. Not limited to the front of the vehicle.

- the object detection system 1 detects an object behind the vehicle.

- the millimeter wave radar 11 emits a millimeter wave in a predetermined direction ⁇ , acquires a reflected wave that collides with a predetermined object, and supplies a reflected signal corresponding to the acquired reflected wave to the signal processing device 13. To do.

- the millimeter wave radar 11 scans the millimeter wave within a predetermined angle range in front of the vehicle, and supplies the reflected signal obtained as a result to the signal processing device 13 together with the direction ⁇ irradiated.

- a unit for scanning a predetermined angle range once in the millimeter wave radar 11 is called one frame.

- the stereo camera 12 includes a right camera 21R and a left camera 21L.

- the right camera 21R and the left camera 21L are disposed at the same height and at a predetermined interval in the horizontal direction, and take an image of a predetermined range in front of the vehicle.

- An image captured by the right camera 21R (hereinafter also referred to as a right camera image) and an image captured by the left camera 21L (hereinafter also referred to as a left camera image) have a parallax (in the horizontal direction) due to the difference in arrangement position.

- the image has a deviation.

- the positional relationship between the right camera 21R and the left camera 21L is accurately calibrated.

- the right camera image and the left camera image are not particularly distinguished, they are also referred to as stereo images.

- the signal processing device 13 performs signal processing on sensor signals output from the sensors of the millimeter wave radar 11 and the stereo camera 12. It is assumed that temporal synchronization when the millimeter wave radar 11 and the stereo camera 12 perform sensing is achieved to some extent.

- the signal processing device 13 includes a target detection unit 31, a three-dimensional position calculation unit 32, a target detection unit 33, a parallax estimation unit 34, a three-dimensional position calculation unit 35, a correspondence detection unit 36, a position and orientation estimation unit 37, and a storage unit. 38.

- the object detection system 1 in order to accurately detect an object, it is necessary to specify the correspondence between the objects detected by the millimeter wave radar 11 and the stereo camera 12. That is, the detected object is represented by different coordinate systems of the millimeter wave radar 11 and the stereo camera 12, but when the same object is detected, it is detected by the millimeter wave radar 11 and the stereo camera 12. It is necessary to convert to a predetermined one coordinate system so that the coordinate values of the obtained objects are the same.

- the signal processing device 13 performs processing for calculating the correspondence between the coordinate system of the millimeter wave radar 11 and the coordinate system of the stereo camera 12. In other words, the signal processing device 13 calculates the relationship of the other position (position and orientation) with respect to one position of the millimeter wave radar 11 and the stereo camera 12.

- the calibration process performed by the signal processing device 13 for calculating the positional relationship between the millimeter wave radar 11 and the stereo camera 12 includes a pre-shipment calibration process that is performed before the vehicle is shipped and a deviation that occurs after the shipment. There is an operation calibration process for adjustment.

- the deviation after shipment may be caused by, for example, a change with time, heat, vibration, or the like.

- the target in the calibration process before shipment is, for example, a pole that has a texture (pattern) whose position can be uniquely specified in a stereo image captured by the stereo camera 12 and reflects a millimeter wave.

- FIG. 2 shows an example of a target used in the calibration process before shipment.

- the target 51 shown in FIG. 2 is a cylindrical pole formed of a material that reflects millimeter waves, and a lattice-pattern texture is formed on the outer periphery of the cylindrical shape.

- the target detection unit 33 calculates the position of the target 51 in the stereo image, for example, the pixel position of the lattice pattern intersection 52 is calculated by pattern matching or feature extraction.

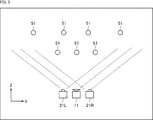

- 3 and 4 show examples of the arrangement of the targets 51 in the pre-shipment calibration process.

- FIG. 3 is a layout diagram of the targets 51 when the targets 51 in the pre-shipment calibration process are viewed from above.

- the vertical direction of the paper which is the front direction (depth direction) of the vehicle

- the horizontal direction of the paper which is the horizontal direction (horizontal direction) of the vehicle

- the direction perpendicular to the paper is the Y axis.

- the plurality of targets 51 are arranged so that they do not overlap when captured by the stereo camera 12. Then, as shown in FIG. 3, the plurality of targets 51 may be arranged so as not to be in the same position as other targets 51 in any one of the X-axis direction and the Z-axis direction. desirable.

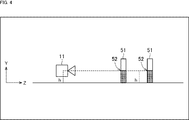

- FIG. 4 is a layout view of the targets 51 when the targets 51 in the pre-shipment calibration process are viewed from the lateral direction.

- the horizontal direction of the paper is the Z axis

- the vertical direction of the paper is the Y axis

- the direction perpendicular to the paper is the X axis.

- the millimeter wave radar 11 is arranged so as to irradiate millimeter waves on the XZ plane having a height h from the ground

- a plurality of targets 51 are intersecting points 52 of the targets 51 as shown in FIG. Is arranged to have a millimeter wave height h.

- the lattice pattern intersections 52 of the target 51 are formed in accordance with the height h of the millimeter wave irradiated by the millimeter wave radar 11.

- the stereo camera 12 may be arranged at the height of the millimeter wave radar 11 so that the position of the height h from the ground is the same as the intersection point 52 of the grid pattern. It is not necessary to match the 11 height positions.

- the target cannot be specified as a predetermined fixed object, an object that exists on the passage through which the vehicle passes is targeted.

- an object that exists on the passage through which the vehicle passes is targeted.

- pedestrians and poles such as signs and utility poles are targets in the calibration process during operation.

- positional information of a plurality of targets at different positions is necessary.

- the position information of a plurality of targets may be acquired by detecting a plurality of targets in one frame each for the millimeter wave radar 11 and the stereo camera 12, or by acquiring a plurality of frames that capture one target. May be.

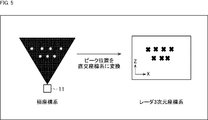

- the target detection unit 31 and the three-dimensional position calculation unit 32 on the millimeter wave radar 11 side will be described with reference to FIG.

- the target detection unit 31 detects the position of the target in front of the vehicle based on the reflection signal supplied from the millimeter wave radar 11 and the irradiation direction ⁇ . More specifically, the target detection unit 31 determines a peak position where the reflection signal intensity is equal to or higher than a predetermined intensity based on a reflection intensity map in which the intensity of the reflection signal is associated with the irradiation direction ⁇ . Detect as.

- the target detection position is represented by a polar coordinate system including a distance L based on the intensity of the reflected signal and an irradiation direction ⁇ .

- the detected target detection position is supplied to the three-dimensional position calculation unit 32.

- a black triangle extending from the millimeter wave radar 11 indicates the irradiation range of the millimeter wave, and the position where the target is detected is indicated in white. The greater the intensity of the reflected signal, the more white is expressed.

- the three-dimensional position calculation unit 32 supplies the target detection position represented by the polar coordinate system supplied from the target detection unit 31 to the Z direction in the front direction (depth direction) of the vehicle, the X axis in the horizontal direction (horizontal direction), Conversion is made to a target detection position on a three-dimensional coordinate system with the vertical direction (vertical direction) as the Y axis.

- the target detection position represented by the polar coordinate system composed of the distance L based on the intensity of the reflected signal and the irradiation direction ⁇ is converted into an orthogonal coordinate system by the three-dimensional position calculation unit 32, and XZ of the three-dimensional coordinate system is converted. It is converted into a target detection position on the plane.

- the calculated target detection position is a position on a three-dimensional coordinate system with the millimeter wave radar 11 as a reference, and a three-dimensional coordinate system with the millimeter wave radar 11 as a reference is connected to a stereo camera 12 described later.

- a radar three-dimensional coordinate system In order to distinguish from the reference three-dimensional coordinate system, it is also referred to as a radar three-dimensional coordinate system.

- the three-dimensional position calculation unit 32 supplies the target detection position represented by the calculated radar three-dimensional coordinate system to the correspondence detection unit 36.

- the target detection unit 33, the parallax estimation unit 34, and the three-dimensional position calculation unit 35 on the stereo camera 12 side will be described with reference to FIG.

- the target detection unit 33 performs pattern matching (image recognition processing) using a pre-registered pattern (shape or texture) on the stereo images supplied from the right camera 21R and the left camera 21L, and features of the target image. By performing feature detection processing for detecting the position of the target, the position of the target on the two-dimensional coordinate system composed of the X axis and the Y axis is detected.

- the target detection unit 33 uses the left camera image supplied from the right camera 21R and the left camera image supplied from the left camera 21L as a reference (left camera image in the present embodiment).

- the position of the intersection 52 of the target 51 in the camera image is detected with accuracy in units of pixels, and is supplied to the three-dimensional position calculation unit 35.

- the parallax estimation unit 34 calculates parallax from the right camera image supplied from the right camera 21R and the left camera image supplied from the left camera 21L, and supplies the calculation result to the three-dimensional position calculation unit 35 as parallax information. .

- FIG. 6 shows a parallax image represented by a higher luminance value as the parallax calculated from the right camera image and the left camera image is larger with the left camera image as a reference.

- the higher the luminance value the closer the distance to the target 51 is.

- the three-dimensional position calculation unit 35 calculates the position (distance) in the Z-axis direction, which is the forward direction of the vehicle, from the target parallax information supplied from the parallax estimation unit 34. Then, the three-dimensional position calculation unit 35 calculates the vehicle forward direction (depth) from the calculated target position in the Z-axis direction and the target position on the two-dimensional coordinate system (XY plane) supplied from the target detection unit 33.

- the target detection position on the three-dimensional coordinate system is calculated with the direction (direction) as the Z axis, the horizontal direction (horizontal direction) as the X axis, and the vertical direction (vertical direction) as the Y axis.

- the target detection position calculated here is a position on a three-dimensional coordinate system with the stereo camera 12 as a reference, and the axis direction is the same as that of the radar three-dimensional coordinate system, but the origin is different.

- the three-dimensional coordinate system with reference to the stereo camera 12 is also referred to as a camera three-dimensional coordinate system in distinction from the radar three-dimensional coordinate system described above. Further, when it is not necessary to particularly distinguish the radar three-dimensional coordinate system and the camera three-dimensional coordinate system, both are collectively referred to as a sensor coordinate system.

- the three-dimensional position calculation unit 35 supplies the target detection position represented by the calculated camera three-dimensional coordinate system to the correspondence detection unit 36.

- the correspondence detector 36 detects the correspondence between the target detected in the radar three-dimensional coordinate system and the target detected in the camera three-dimensional coordinate system. In other words, the correspondence detection unit 36 detects which target detected by the radar three-dimensional coordinate system corresponds to which target detected by the camera three-dimensional coordinate system.

- the target arrangement is known in advance.

- the correspondence detection unit 36 acquires the pre-arrangement information of the target from the storage unit 38, and sets the target detection position detected in the radar three-dimensional coordinate system and the target detection position detected in the camera three-dimensional coordinate system.

- the target pre-arrangement information is collated and the target is specified, and then the correspondence between the target detected in the radar three-dimensional coordinate system and the target detected in the camera three-dimensional coordinate system is detected.

- the correspondence detection unit 36 detects that the target detection position a detected in the radar three-dimensional coordinate system corresponds to the target position 1 of the target preliminary arrangement information, and detects the target. It is detected that the position b corresponds to the target position 2, and the target detection positions c to g correspond to the target positions 3 to 7, respectively.

- the correspondence detection unit 36 corresponds to the target detection position A detected by the camera three-dimensional coordinate system corresponding to the target position 1 of the target preliminary arrangement information, the target detection position B corresponding to the target position 2, and so on. Then, it is detected that the target detection positions C to G correspond to the target positions 3 to 7, respectively.

- the correspondence detection unit 36 detects that the target at the target detection position a detected in the radar three-dimensional coordinate system corresponds to the target at the target detection position A detected in the camera three-dimensional coordinate system. Similarly, it is detected that the targets at the target detection positions b to g detected in the radar three-dimensional coordinate system correspond to the targets at the target detection positions B to G detected in the camera three-dimensional coordinate system, respectively. .

- the correspondence detection unit 36 is based on the positional relationship already obtained by the previously executed pre-shipment calibration process or the operation calibration process.

- the target detection position detected in the radar three-dimensional coordinate system is compared with the target detection position detected in the camera three-dimensional coordinate system, and the target detected in the radar three-dimensional coordinate system and the camera three-dimensional coordinate system The correspondence of the target detected in step 1 is detected.

- the position / orientation estimation unit 37 calculates the positional relationship between the millimeter wave radar 11 and the stereo camera 12 using a plurality of targets whose correspondence relationship has been specified by the correspondence detection unit 36.

- the position of the kth target (0 ⁇ k ⁇ K + 1) among the K targets whose correspondence relationship is specified by the correspondence detection unit 36 is the radar three-dimensional.

- P MMW (k) [X MMW (k) Y A Z MMW (k)] T

- P cam (k) [X cam (k) Y cam (K) Z cam (k)] T

- T represents transposition

- Y A represents a predetermined fixed value.

- k is a variable (0 ⁇ k ⁇ K + 1) that identifies a predetermined one of a plurality (K) of targets

- P cam (k) is a camera three-dimensional coordinate system.

- the detected target detection position of the kth target, P MMW (k) represents the target detection position of the kth target detected in the radar three-dimensional coordinate system.

- Expression (1) is an expression for converting the target detection position P MMW (k) of the k-th target detected in the radar three-dimensional coordinate system into the target detection position P cam (k) on the camera three-dimensional coordinate system.

- the rotation matrix R represents the attitude of the millimeter wave radar 11 with respect to the stereo camera 12

- the translation vector V represents the position of the millimeter wave radar 11 with respect to the stereo camera 12.

- the rotation matrix R Since there are three variables of the rotation matrix R and three variables of the translation vector V, if at least six target detection positions can be obtained, the rotation matrix R and the translation vector V of Expression (1) are calculated. be able to. Note that the rotation matrix R can be expressed by a quaternion in addition to using the least square method.

- the storage unit 38 stores positional relationship information (calibration information) between the millimeter wave radar 11 and the stereo camera 12 calculated by the position / orientation estimation unit 37. Specifically, the rotation matrix R and the translation vector V of the equation (1) are supplied from the position / orientation estimation unit 37 to the storage unit 38 and stored therein.

- the object detection system 1 is configured as described above.

- P Det (k) [X Det (k) Y Det (k) Z Det (k)] Let it be represented by T.

- Y Det (k) is a fixed value as described above.

- K targets in the sensor coordinate system of the millimeter wave radar 11 or the stereo camera 12, K or more targets may be detected due to the influence of disturbance or the like.

- the target position f is detected as a target by, for example, noise, and the target detection positions a to f are 6 Targets have been detected.

- the detection of the correspondence between the five target positions 1 to 5 on the world coordinate system and the six target detection positions a to f on the sensor coordinate system is most likely performed by a three-dimensional point of a different coordinate system. It can be solved by considering it as a graph matching problem that finds the correspondences that overlap well.

- the correspondence (connection) between the five target positions 1 to 5 on the world coordinate system and the six target detection positions a to f on the sensor coordinate system is represented by a matrix variable X of M rows and N columns, and (2).

- the subscript i of x is a variable for identifying a target on the world coordinate system (0 ⁇ i ⁇ M + 1)

- the subscript j of x is a variable for identifying a target on the sensor coordinate system (0 ⁇ j ⁇ N + 1).

- x i, j represents whether or not the i th target on the world coordinate system and the j th target on the sensor coordinate system are connected, and is “1” when connected, “0” when not connected. It is a variable that takes

- the target position 1 on the world coordinate system and the target detection position a on the sensor coordinate system For example, as shown by a thick solid line in FIG. 11, the target position 1 on the world coordinate system and the target detection position a on the sensor coordinate system, the target position 2 on the world coordinate system and the target detection position b on the sensor coordinate system.

- Target position 3 on the world coordinate system Target detection position c on the sensor coordinate system

- target position 4 on the world coordinate system target detection position d on the sensor coordinate system

- target position 5 on the world coordinate system When the target detection position e on the sensor coordinate system corresponds, the matrix variable X representing the correspondence relationship is expressed as follows.

- the correspondence detection unit 36 obtains X that maximizes the score function score (X) using the matrix variable X represented by Expression (2).

- the score function score (X) is expressed by the following equation (3).

- i1 and i2 are variables that identify targets on the world coordinate system

- j1 and j2 are variables that identify targets on the sensor coordinate system.

- l i1, i2 is the length of the line segment connecting P MAP (i1) and P MAP (i2) on the world coordinate system

- h j1, j2 is P Det (j1) and P Det on the sensor coordinate system This represents the length of the line segment connecting (j2).

- S (l i1, i2 , h j1, j2 ) represents the similarity between the line length l i1, i2 and the line length h j1, j2 , and the line length l i1, i2 and the line The closer the minute length h j1, j2 is, the larger the value becomes.

- Similarity S (l i1, i2, h j1, j2) for example, the length of the line segment l i1, i2 and the line segment of length h j1, j2 of the difference d (l i1, i2, h j1, j2

- the following equation (4) using) can be employed.

- the first correspondence detection process described above is a detection method that uses the target pre-position information, but the target detected by the radar three-dimensional coordinate system and the camera three-dimensional coordinates without using the target pre-position information. It is also possible to detect the correspondence with the target detected by the system.

- the correspondence detection unit 36 determines at least one of the target position P MMW (k) on the radar three-dimensional coordinate system and the target position P cam (k) on the camera three-dimensional coordinate system. By superimposing by making a fixed amount slide, the targets arranged in the nearest vicinity can be made to correspond.

- FIG. 14 is a block diagram illustrating a detailed configuration example of the target detection unit 31 on the millimeter wave radar 11 side when the calibration process during operation is executed.

- the target detection unit 31 includes a motion detection unit 71, a peak detection unit 72, and an AND calculation unit 73.

- the motion detection unit 71 includes a storage unit that holds a reflection signal of at least one previous frame.

- the motion detection unit 71 includes a reflection signal of the current frame supplied from the millimeter wave radar 11 and a previous frame input from the previous frame. The movement of the peak position is detected by comparing with the reflected signal.

- the motion detection unit 71 supplies the peak position where the motion is detected to the AND calculation unit 73.

- the peak detection unit 72 detects a peak position where the reflection signal intensity is equal to or higher than a predetermined intensity from the reflection signal of the current frame supplied from the millimeter wave radar 11, and supplies the detection result to the AND calculation unit 73. .

- the AND operation unit 73 performs an AND operation on the peak position supplied from the motion detection unit 71 and the peak position supplied from the peak detection unit 72. In other words, the AND operation unit 73 extracts and extracts only the peak position supplied from the motion detection unit 71 from the peak position supplied from the peak detection unit 72, that is, the peak position where the motion is detected. The result is supplied to the three-dimensional position calculation unit 32 as a target detection position.

- FIG. 15 is a block diagram illustrating a detailed configuration example of the target detection unit 33 on the stereo camera 12 side when the calibration process during operation is executed.

- the target detection unit 33 includes a motion region detection unit 81, an image recognition unit 82, an AND calculation unit 83, and a center position calculation unit 84.

- the motion region detection unit 81 includes a storage unit that holds a stereo image of at least one previous frame.

- the motion region detection unit 81 includes a stereo image of the current frame supplied from the stereo camera 12 and the previous frame input from the previous frame.

- the motion area of the stereo image is detected by comparing with the stereo image. Detection of a motion area of a stereo image can be performed using motion vector estimation, frame difference, or the like.

- the motion region detection unit 81 supplies the detected motion region to the AND operation unit 83.

- the image recognition unit 82 detects the target area by performing image recognition on the stereo image of the current frame supplied from the stereo camera 12. For example, when a pedestrian (person) is detected as a target, the target region can be detected by image recognition processing that recognizes a human figure (silhouette) or face. The image recognition unit 82 supplies the detected target area to the AND calculation unit 83.

- the AND operation unit 83 performs an AND operation on the motion region supplied from the motion region detection unit 81 and the target region supplied from the image recognition unit 82. In other words, the AND operation unit 83 extracts only the target region supplied from the image recognition unit 82 among the motion regions supplied from the motion region detection unit 81, that is, the target region where the motion is detected. The result is supplied to the center position calculation unit 84.

- the center position calculation unit 84 calculates the pixel position that is the center of the target area supplied from the AND calculation unit 83, and supplies the calculated pixel position to the three-dimensional position calculation unit 32 as the target detection position.

- the object detection system 1 detects the pedestrian 101 in front shown in FIG. 16 as a target and executes the calibration process during operation. The case will be described.

- the detection range of the millimeter wave radar 11 and the stereo camera 12 includes a pedestrian 101 and two fixed objects 102-1 and 102-2.

- the pedestrian 101 is moving rightward in the figure, and the fixed objects 102-1 and 102-2 are objects that do not move.

- the peak detection unit 72 detects peak positions 111 to 113 from the reflected signal of the current frame supplied from the millimeter wave radar 11 as shown in FIG. The detection result is supplied to the AND operation unit 73.

- the peak position 111 corresponds to the pedestrian 101 in FIG. 16, and the peak positions 112 and 113 correspond to the fixed objects 102-1 and 102-2.

- the reflected signal of the current frame is compared with the reflected signal of the previous frame input immediately before, and only the peak position 111 is determined as the peak position where the motion is detected. It is supplied to the AND operation unit 73.

- the AND calculation unit 73 supplies only the peak position 111 supplied from the motion detection unit 71 among the peak positions 111 to 113 supplied from the peak detection unit 72 to the three-dimensional position calculation unit 32 as a target detection position. .

- the image recognition unit 82 performs image recognition processing for recognizing a human figure and a face on the stereo image of the current frame.

- the target area 121 is detected.

- the target area 121 corresponds to the pedestrian 101 in FIG.

- the motion region detection unit 81 detects the motion region 122 of the stereo image by comparing the stereo image of the current frame supplied from the stereo camera 12 with the stereo image of the previous frame input immediately before. .

- the motion region 122 detected here also corresponds to the pedestrian 101 in FIG.

- the same left camera image as the parallax image is used for the stereo image for which the target detection unit 33 performs image recognition processing and the stereo image for which the motion region detection unit 81 detects the motion region.

- the AND operation unit 83 performs an AND operation on the motion region 122 supplied from the motion region detection unit 81 and the target region 121 supplied from the image recognition unit 82, and as a result, the target region 121 is converted into the center position calculation unit 84. To supply.

- the center position calculation unit 84 calculates the center pixel position 123 of the target area 121 supplied from the AND calculation unit 83 and supplies the calculated center pixel position 123 to the three-dimensional position calculation unit 32 as the target detection position.

- the three-dimensional position calculation unit 35 on the stereo camera 12 side includes the parallax information based on the left camera image supplied from the parallax estimation unit 34 and the center position calculation unit of the target detection unit 33.

- a target detection position 131 on the camera three-dimensional coordinate system is calculated from the target detection position 123 supplied from 84, the front direction of the vehicle being the Z axis, the horizontal direction being the X axis, and the vertical direction being the Y axis. 36.

- the three-dimensional position calculation unit 32 on the millimeter wave radar 11 side uses the target detection position 111 represented by the polar coordinate system supplied from the target detection unit 31 as the Z-axis for the front direction of the vehicle and the X-axis for the horizontal direction. Then, it is converted to a target detection position 132 on the radar three-dimensional coordinate system with the vertical direction as the Y axis, and is supplied to the correspondence detection unit 36.

- the correspondence detection unit 36 is calculated by the pre-shipment calibration process and is stored in the storage unit 38.

- the correspondence detection unit 36 uses the current positional relationship information between the millimeter wave radar 11 and the stereo camera 12 and the radar three-dimensional coordinate system supplied from the three-dimensional position calculation unit 32 as shown in FIG.

- a target detection position 133 is calculated by correcting the position of the upper target detection position 132 to a position on the camera three-dimensional coordinate system.

- the correspondence detection unit 36 includes a target detection position 131 on the camera three-dimensional coordinate system supplied from the three-dimensional position calculation unit 35 on the stereo camera 12 side, and a millimeter wave radar whose position is corrected on the camera three-dimensional coordinate system.

- the target detection position 133 on the 11th side is compared, and the correspondence between the target detected on the stereo camera 12 side and the target detected on the millimeter wave radar 11 side is detected.

- the correspondence detection unit 36 recognizes the targets having the closest coordinate positions as corresponding targets.

- the number of detected targets is one.

- the detected position whose position is corrected using the positional relationship information calculated in the pre-shipment calibration process. Therefore, the correspondence can be easily detected.

- the signal processing device 13 performs the processing in a plurality of frames (N frames) as shown in FIG. Execute. As a result, when there is one corresponding point detected in each frame, N corresponding points with different detection positions are detected and stored in the storage unit 38 in N frames.

- the rotation matrix R and the translation vector V in Expression (1) at least six target detection positions are required.

- the six target detection positions may be obtained in a total of 6 frames including 1 point in each frame, or may be obtained in a total of 3 frames including 2 points in each frame, for example.

- the number N of frames is preferably 6 or more and a large value.

- the times t to t + N of the N frame for solving the equation (1) shown in FIG. 20 do not necessarily have to be continuous in time.

- the above-described calibration at the time of operation using corresponding points detected in 10 frames of a day that satisfy a predetermined condition and corresponding points detected in 20 frames of another day that satisfy a predetermined condition It is also possible to execute processing.

- the signal processing device 13 can select a frame to be used for the calibration process during operation in order to improve the calibration accuracy.

- the signal processing device 13 uses a frame in which no other target detection position exists within a predetermined range (distance) determined in advance from the detected target detection position, for the calibration process during operation. To be stored in the storage unit 38.

- the frame A in FIG. 21 is selected as a frame used for the calibration process during operation.

- the frame B in FIG. 21 another target detection position 142 exists within a predetermined range 143 from the target detection position 141.

- the frame B in FIG. 21 is excluded from the frames used for the calibration process during operation.

- the signal processing apparatus 13 excludes a frame from the frame used for the calibration process during operation even when a predetermined number of targets or more are detected in one frame, as in the frame C of FIG. To do.

- the in-operation calibration process does not use a target prepared in advance, and therefore selects a frame (target) from which a corresponding point is detected so that higher accuracy can be obtained.

- the frame may be selected by the target detection unit 31 or 33 or the correspondence detection unit 36.

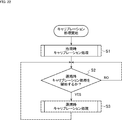

- step S1 the signal processing device 13 executes a factory calibration process.

- the details of this process will be described later with reference to the flowchart of FIG. 23.

- the rotation matrix R and the translation vector V of the equation (1) which are positional relationship information between the millimeter wave radar 11 and the stereo camera 12, are obtained. Calculated and stored in the storage unit 38.

- step S1 for example, in a factory that manufactures a vehicle equipped with the object detection system 1 or a dealer such as a dealer, the user (operator) starts the calibration on the operation panel or the like. It is executed when instructed by. Alternatively, it may be automatically executed when the vehicle stops (is detected) at a place where the calibration environment is prepared. After completion of the shipping calibration process, the vehicle is shipped and delivered to the owner (driver).

- step S2 the signal processing device 13 determines whether to start the calibration process during operation. For example, when a certain period or more has elapsed since the last shipping calibration process or operation calibration process, the signal processing device 13 accumulates a predetermined number or more of corresponding points in the storage unit 38 as described with reference to FIG. When the predetermined start condition is satisfied, such as when the displacement amount of the corresponding point after the position correction of the millimeter wave radar 11 and the stereo camera 12 is always (predetermined number of times) or more, a predetermined value is satisfied. It is determined that the calibration process is started.

- the vehicle when the vehicle is not level with the road surface (when it is tilted), when the vehicle is moving at a high speed, when the number of targets detected at a time is more than a predetermined value, bad weather, retrograde, darkness, etc.

- the stereo image captured by the stereo camera 12 is in an environmental condition where the reliability of the stereo image is low, the vehicle is in a place (for example, a tunnel) where the millimeter wave of the millimeter wave radar 11 is likely to cause multiple reflections.

- the signal processing device 13 determines that the in-operation calibration process is not started, for example, when the environmental condition is low in reliability. Whether or not the vehicle is likely to cause multiple reflections can be determined based on, for example, a GPS reception signal.

- step S2 If it is determined in step S2 that the operation calibration process is not started, the process returns to step S2, and the process in step S2 is repeated until it is determined that the operation calibration process is to be started next.

- step S2 determines whether the operation calibration process is started. If it is determined in step S2 that the operation calibration process is started, the process proceeds to step S3, and the signal processing device 13 executes the operation calibration process.

- the rotation matrix R and the translation vector V in Expression (1) which are positional relationship information between the millimeter wave radar 11 and the stereo camera 12, are obtained. It is calculated again and overwritten (updated) in the storage unit 38.

- FIG. 23 is a flowchart for explaining the details of the calibration process at the time of shipment in step S1 described above.

- step S21 the target detection unit 31 on the millimeter wave radar 11 side detects the position of the target in front of the vehicle based on the reflection signal supplied from the millimeter wave radar 11 and the irradiation direction ⁇ .

- the target detection position detected by the target detection unit 31 is represented by a polar coordinate system including the distance L based on the intensity of the reflected signal and the irradiation direction ⁇ , and is supplied to the three-dimensional position calculation unit 32.

- step S22 the three-dimensional position calculation unit 32 on the millimeter wave radar 11 side converts the target detection position represented by the polar coordinate system supplied from the target detection unit 31 into a target detection position on the radar three-dimensional coordinate system. To do.

- step S23 the target detection unit 33 on the stereo camera 12 side detects the position of the target on the two-dimensional coordinate system by performing image processing such as pattern matching and feature detection processing on the stereo image.

- step S24 the parallax estimation unit 34 calculates parallax from the right camera image supplied from the right camera 21R and the left camera image supplied from the left camera 21L, and supplies the parallax information to the three-dimensional position calculation unit 35. To do.

- step S ⁇ b> 25 the three-dimensional position calculation unit 35 uses the parallax information supplied from the parallax estimation unit 34 and the target detection position on the two-dimensional coordinate system supplied from the target detection unit 33 on the camera three-dimensional coordinate system. The target detection position is calculated.

- or S25 can be performed in parallel as mentioned above, and the process of step S21 and S22 and the process of step S23 thru

- step S ⁇ b> 26 the correspondence detection unit 36 executes the first correspondence detection process described above, thereby obtaining a correspondence relationship between the target detected in the radar three-dimensional coordinate system and the target detected in the camera three-dimensional coordinate system.

- the correspondence detection unit 36 compares the target detection position detected in the radar three-dimensional coordinate system with target pre-arrangement information, and identifies the target. Further, the correspondence detection unit 36 compares the target detection position detected in the camera three-dimensional coordinate system with the target pre-arrangement information, and identifies the target. Then, the correspondence detection unit 36 detects which target detected in the radar three-dimensional coordinate system corresponds to which target detected in the camera three-dimensional coordinate system based on the collation result with the target prior arrangement information. .

- step S26 the second correspondence detection process described above may be executed instead of the first correspondence detection process.

- step S27 the position / orientation estimation unit 37 substitutes the target detection positions of the plurality of targets whose correspondences are specified by the correspondence detection unit 36 into the equation (1), and solves them using the least square method or the like.

- the positional relationship between the wave radar 11 and the stereo camera 12 is calculated. Thereby, the rotation matrix R and the translation vector V of Formula (1) are calculated.

- step S28 the position / orientation estimation unit 37 stores the calculated rotation matrix R and translation vector V in the storage unit 38.

- step S41 the target detection unit 31 on the millimeter wave radar 11 side detects the position of the target where the motion is detected based on the reflection signal supplied from the millimeter wave radar 11 and the irradiation direction ⁇ .

- the motion detecting unit 71 compares the reflected signal of the current frame with the reflected signal of the previous frame input immediately before it, and detects the motion of the peak position.

- the peak detection unit 72 detects the peak position from the reflection signal of the current frame and supplies the peak position to the AND calculation unit 73.

- the AND calculation part 73 extracts only the peak position supplied from the motion detection part 71 among the peak positions supplied from the peak detection part 72, and uses the extracted result as the target detection position where the movement is detected. This is supplied to the three-dimensional position calculation unit 32.

- step S42 the three-dimensional position calculation unit 32 on the millimeter wave radar 11 side converts the target detection position represented by the polar coordinate system supplied from the target detection unit 31 into a target detection position on the radar three-dimensional coordinate system. To do.

- step S43 the target detection unit 33 on the stereo camera 12 side performs image processing such as pattern matching and feature detection processing on the stereo image to detect the position of the target where the motion is detected.

- the motion region detection unit 81 detects the motion region of the stereo image by comparing the current stereo image with the stereo image of the previous frame input immediately before.

- the image recognition unit 82 detects the target area by performing image recognition on the current stereo image supplied from the stereo camera 12.

- the AND operation unit 83 extracts the target region supplied from the image recognition unit 82 from the motion regions supplied from the motion region detection unit 81 and supplies the extracted result to the center position calculation unit 84.

- the center position calculation unit 84 calculates the center pixel position of the target area supplied from the AND calculation unit 83, and supplies the calculated center pixel position to the three-dimensional position calculation unit 32 as the target detection position where the motion is detected. To do.

- step S44 the parallax estimation unit 34 calculates parallax from the right camera image supplied from the right camera 21R and the left camera image supplied from the left camera 21L, and supplies the parallax information to the three-dimensional position calculation unit 35. To do.

- step S ⁇ b> 45 the three-dimensional position calculation unit 35 on the stereo camera 12 side calculates the camera 3 from the parallax information supplied from the parallax estimation unit 34 and the target detection position on the two-dimensional coordinate system supplied from the target detection unit 33.

- the target detection position on the dimensional coordinate system is calculated.

- step S46 the correspondence detection unit 36 acquires the positional relationship information between the millimeter wave radar 11 and the stereo camera 12 stored in the storage unit 38, specifically, the rotation matrix R and the translation vector V of Expression (1).

- the positional relationship information acquired from the storage unit 38 is data calculated in the pre-shipment calibration process in the first operation calibration process, but in the second and subsequent operation calibration processes. Is the data updated in the previous operational calibration process.

- step S47 the correspondence detection unit 36 uses the acquired positional relationship information to convert the target detection position 132 on the radar three-dimensional coordinate system supplied from the three-dimensional position calculation unit 32 into a position on the camera three-dimensional coordinate system.

- the target detection position corrected in position is calculated.

- step S48 the correspondence detection unit 36 detects the target detection position on the camera three-dimensional coordinate system supplied from the three-dimensional position calculation unit 35 on the stereo camera 12 side, and the millimeter wave radar whose position is corrected on the camera three-dimensional coordinate system. 11 is compared with the target detection position on the 11 side, and the correspondence between the target detected on the stereo camera 12 side and the target detected on the millimeter wave radar 11 side is detected.

- step S49 the position / orientation estimation unit 37 substitutes the target detection positions of the plurality of targets whose correspondences have been specified in the process of step S48 into equation (1) and solves them, whereby the millimeter wave radar 11 and the stereo camera 12 are detected. The positional relationship of is calculated.

- step S50 the position / orientation estimation unit 37 compares the current positional relationship information stored in the storage unit 38 with the positional relationship information newly calculated in step S49. It is determined whether it is within a predetermined range of the positional relationship information.

- step S50 If it is determined in step S50 that the new positional relationship information is within the predetermined range of the current positional relationship information, the process proceeds to step S51, and the position / orientation estimation unit 37 stores the current positional relationship information stored in the storage unit 38. The new positional relationship information is overwritten and stored in the positional relationship information, and the in-operation calibration process is terminated.

- step S50 determines whether the new positional relationship information is within the predetermined range of the current positional relationship information. If it is determined in step S50 that the new positional relationship information is not within the predetermined range of the current positional relationship information, the processing in step S51 is skipped, and the in-operation calibration processing ends.

- step S50 when the newly calculated positional relationship information is a value that is significantly different from the previous positional relationship information, the position / orientation estimation unit 37 calculates the calculated positional relationship information. Is not updated as an unreliable value including some error factor. Note that the processing in step S50 may be omitted, and the information stored in the storage unit 38 may be constantly updated with the newly calculated positional relationship information.

- the factory calibration process and the operation calibration process are executed as described above.

- the shipping calibration process and the operation calibration process described above are examples in which the process of calculating calibration data indicating the positional relationship between the millimeter wave radar 11 and the stereo camera 12 is performed only once.

- the average value may be stored in the storage unit 38 as final calibration data. Further, when using calibration data calculated a plurality of times, it is possible to calculate final calibration data after excluding data greatly deviating from other calibration data among the calibration data of a plurality of times. it can.

- FIG. 25 shows another example of a target that can be used in the calibration process at the time of shipment.

- a sphere 161 reflecting a millimeter wave or a corner reflector 162 can be used as a target.

- the target detection unit 33 that detects the target position based on the stereo image detects the target position at the pixel level in order to improve calibration accuracy.

- the intersection point 52 of the texture is calculated, but when the target is the sphere 161, the sphere 161 in the stereo image is detected as a circle by pattern matching or circular shape recognition. Then, the center position of the detected sphere 161 can be output as the target detection position.

- the corner reflector 162 in the stereo image is detected by pattern matching with a registered pattern of the corner reflector 162 registered in advance, and the detected corner reflector 162 is registered.

- the center position of the pattern can be output as the target detection position.

- FIG. 26 shows an example of a parallax image calculated from a reflection signal of the millimeter wave radar 11 and a stereo image by the stereo camera 12 when the target is a sphere 161.

- a target in addition to the above-described pedestrian (human), a general object existing in the traffic environment, for example, a part of another vehicle (for example, a license plate), a part of the own vehicle Signs, signs, traffic lights, utility poles, etc. can be used.

- a part of another vehicle for example, a license plate

- Signs, signs, traffic lights, utility poles, etc. can be used.

- the target detection unit 33 detects vertical parallel lines from the stereo image, and calculates a region surrounded by the detected parallel lines as a pole region.

- the target detection unit 33 detects vertical parallel lines from the stereo image, and calculates a region surrounded by the detected parallel lines as a pole region.

- one pole area is detected in the stereo image, but a plurality of pole areas may be detected.

- the target detection unit 33 performs pole determination in each of the horizontal direction and the vertical direction with respect to the detected pole region based on the parallax information of the stereo image calculated by the parallax estimation unit 34.

- the target detection unit 33 when the parallax when viewed in the horizontal direction changes so as to draw a convex curve in the pole region, For a region, the horizontal pole determination result is determined to be true, and otherwise, it is determined to be false.

- the target detection unit 33 determines that the vertical pole determination result is true for the pole region, and otherwise Is determined to be false.

- the target detection unit 33 performs an AND operation on the horizontal pole determination result and the vertical pole determination result. That is, when both the horizontal pole determination result and the vertical pole determination result are true, the target detection unit 33 outputs the position of the pole area as the target detection position.

- the target detection unit 33 when the target is a pole-shaped object such as a utility pole, the target detection unit 33 also detects the target using the parallax information calculated by the parallax estimation unit 34 and sets the target detection position. Can be output.

- the object detection system 1 it is possible to detect and calibrate positional relationship information between the millimeter wave radar 11 and the stereo camera 12 with accuracy in units of pixels of a stereo image, thereby realizing highly accurate calibration. it can.

- millimeter waves are caused by factors such as aging, vibration, and heat. Even when the positional relationship between the radar 11 and the stereo camera 12 changes, it can be corrected (automatically) at an arbitrary timing.

- the object detection system 1 is mounted on a vehicle.

- the present technology can also be mounted on a moving object that travels on land such as a robot in addition to the vehicle. .

- the millimeter wave radar 11 is employed as the first sensor for calculating the three-dimensional position of the target in the first coordinate system, and the second for calculating the three-dimensional position of the target in the second coordinate system.

- a stereo camera 12 was adopted.

- the first sensor in addition to the millimeter wave radar 11, other radar type sensors such as a radar using ultrasonic waves, a laser radar such as infrared rays, and a lidar may be used.

- the first sensor may be any sensor that can acquire position information in at least one of the horizontal direction (horizontal direction) and the vertical direction (vertical direction) and position information in the depth direction.

- the series of processes including the calibration process described above can be executed by hardware or can be executed by software.

- a program constituting the software is installed in the computer.

- the computer includes, for example, a general-purpose personal computer capable of executing various functions by installing various programs by installing a computer incorporated in dedicated hardware.

- FIG. 28 is a block diagram showing an example of the hardware configuration of a computer that executes the above-described series of processing by a program.

- a CPU Central Processing Unit

- ROM Read Only Memory

- RAM Random Access Memory

- An input / output interface 205 is further connected to the bus 204.

- An input unit 206, an output unit 207, a storage unit 208, a communication unit 209, and a drive 210 are connected to the input / output interface 205.

- the input unit 206 includes a keyboard, a mouse, a microphone, and the like.

- the output unit 207 includes a display, a speaker, and the like.

- the storage unit 208 includes a hard disk, a nonvolatile memory, and the like.

- the communication unit 209 includes a network interface and the like.

- the drive 210 drives a removable recording medium 211 such as a magnetic disk, an optical disk, a magneto-optical disk, or a semiconductor memory.

- the CPU 201 loads, for example, the program stored in the storage unit 208 to the RAM 203 via the input / output interface 205 and the bus 204 and executes the program. Is performed.

- the program can be installed in the storage unit 208 via the input / output interface 205 by attaching the removable recording medium 211 to the drive 210. Further, the program can be received by the communication unit 209 via a wired or wireless transmission medium such as a local area network, the Internet, or digital satellite broadcasting, and can be installed in the storage unit 208. In addition, the program can be installed in the ROM 202 or the storage unit 208 in advance.