KR20110056286A - 상대적 제스처 인식 모드를 갖는 휴대용 전자 장치 - Google Patents

상대적 제스처 인식 모드를 갖는 휴대용 전자 장치 Download PDFInfo

- Publication number

- KR20110056286A KR20110056286A KR1020117005120A KR20117005120A KR20110056286A KR 20110056286 A KR20110056286 A KR 20110056286A KR 1020117005120 A KR1020117005120 A KR 1020117005120A KR 20117005120 A KR20117005120 A KR 20117005120A KR 20110056286 A KR20110056286 A KR 20110056286A

- Authority

- KR

- South Korea

- Prior art keywords

- control

- gesture

- electronic device

- portable electronic

- virtual

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

- G06F3/04883—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures for inputting data by handwriting, e.g. gesture or text

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/017—Gesture based interaction, e.g. based on a set of recognized hand gestures

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0481—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance

- G06F3/04812—Interaction techniques based on cursor appearance or behaviour, e.g. being affected by the presence of displayed objects

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F9/00—Arrangements for program control, e.g. control units

- G06F9/06—Arrangements for program control, e.g. control units using stored programs, i.e. using an internal store of processing equipment to receive or retain programs

- G06F9/44—Arrangements for executing specific programs

- G06F9/445—Program loading or initiating

- G06F9/44568—Immediately runnable code

- G06F9/44584—Portable applications, i.e. making applications self-contained, e.g. U3 standard

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F2203/00—Indexing scheme relating to G06F3/00 - G06F3/048

- G06F2203/048—Indexing scheme relating to G06F3/048

- G06F2203/04808—Several contacts: gestures triggering a specific function, e.g. scrolling, zooming, right-click, when the user establishes several contacts with the surface simultaneously; e.g. using several fingers or a combination of fingers and pen

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- General Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Human Computer Interaction (AREA)

- Software Systems (AREA)

- Position Input By Displaying (AREA)

- User Interface Of Digital Computer (AREA)

Abstract

터치 스크린 센서를 가지는 휴대용 전자 장치 상에서 실행가능한 컴퓨터 프로그램이 제공된다. 컴퓨터 프로그램은 모드 전환 사용자 입력을 수신하여 직접 입력 모드와 상대적 제스처 인식 모드 간에 전환하도록 구성된 입력 모드 전환 모듈을 포함할 수 있다. 컴퓨터 프로그램은, 상대적 제스처 인식 모드에서, 그래픽 사용자 인터페이스 요소가 선택가능하지 않은 정의된 영역 내의 터치 스크린 센서의 표면과 사용자의 손가락 사이의 터치 스크린 센서 상의 접촉 지점을 인식하고, 접촉 지점으로부터 시작하는 사용자 터치 입력에 기초하여 검출된 제스처를 식별하고 검출된 제스처에 기초하여 휴대용 전자 장치의 동작을 조정하라는 메시지를 응용 프로그램으로 송신하도록 구성되어 있는 제스처-기반 제어 모듈을 추가로 포함할 수 있다.

Description

터치 스크린을 구비한 휴대용 전자 장치는 사용자가, 터치 스크린 센서에 의해 감지되는 터치 입력을 통해, 스크린 상에 디스플레이되는 그래픽 사용자 인터페이스 요소와 직접 상호작용할 수 있게 해준다. 사용자는 시각적으로 스크린을 검사하고, 그래픽 사용자 인터페이스 요소가 디스플레이되는 위치에서 스크린을 터치한다. 터치 입력이 그래픽 사용자 인터페이스 요소의 위치에서 행해져 휴대용 전자 장치 상의 적절한 기능을 트리거링할 때 장치에 의해 감지된다.

이러한 장치의 한가지 단점은 사용자가 시각적으로 스크린을 검사할 수 없거나 검사하고자 하지 않을 때는 상호작용하기가 어렵다는 것이다. 예를 들어, 사용자가 운동을 하거나, 지하철을 타고 있거나, 기타 등등을 하고 있을 때, 사용자는 오랫동안 스크린을 보는 것이 불편하거나 바람직하지 않음을 알게 될지도 모른다. 이로 인해 사용자의 입력 오류가 있을 수 있거나, 사용자가 바람직하지 않은 시간 동안 스크린을 보게 될 수 있고, 이는 일반적으로 사용자 경험을 좌절시킬 수 있다.

터치 스크린 센서를 가지는 휴대용 전자 장치 상에서 실행가능한 컴퓨터 프로그램이 제공된다. 컴퓨터 프로그램은 모드 전환 사용자 입력을 수신하고 사용자 입력에 응답하여 직접 입력 모드와 상대적 제스처 인식 모드 간에 전환하도록 구성된 입력 모드 전환 모듈을 포함할 수 있다. 직접 입력 모드에서는, 휴대용 전자 장치의 그래픽 사용자 인터페이스의 하나 이상의 그래픽 사용자 인터페이스 요소가 사용자의 터치 입력을 통해 선택가능하다. 상대적 제스처 인식 모드에서는, 그래픽 사용자 인터페이스의 적어도 정의된 영역에 있는 그래픽 사용자 인터페이스 요소가 선택가능하지 않게 된다. 컴퓨터 프로그램은, 상대적 제스처 인식 모드에서, 그래픽 사용자 인터페이스 요소가 선택가능하지 않은 정의된 영역 내의 터치 스크린 센서의 표면과 사용자의 손가락 사이에 있는 터치 스크린 센서 상의 접촉 지점을 인식하고 정의된 영역에서 접촉 지점에 근접하여 제스처 컨트롤을 제시하도록 구성된 제스처-기반 제어 모듈을 추가로 포함할 수 있다. 제스처-기반 제어 모듈은 또한 접촉 지점으로부터 시작하는 사용자 터치 입력에 기초하여 검출된 제스처를 식별하고 검출된 제스처에 기초하여 휴대용 전자 장치의 동작을 조정하라는 메시지를 응용 프로그램으로 송신하도록 구성되어 있을 수 있다.

이 요약은 이하에서 상세한 설명에 더 기술되는 일련의 개념들을 간략화된 형태로 소개하기 위해 제공된 것이다. 이 요약은 청구된 발명 대상의 주요 특징 또는 필수적인 특징을 명시하기 위한 것이 아니며, 청구된 발명 대상의 범위를 제한하는 데 사용되기 위한 것도 아니다. 게다가, 청구된 발명 대상이 본 개시 내용의 임의의 부분에 기술된 단점의 일부 또는 그 전부를 해결하는 구현으로 제한되지 않는다.

도 1은 터치 스크린 센서를 구비한 디스플레이를 가지며 컴퓨터 프로그램을 실행하여 직접 입력 모드와 상대적 제스처 인식 모드 간에 전환하도록 구성된 컴퓨팅 장치의 일 실시예의 개략도.

도 2는 도 1의 휴대용 전자 장치 상의 미디어 재생 응용 프로그램에서 사용되는, 상대적 제스처 인식 모드에서의 전송 컨트롤을 나타낸 도면.

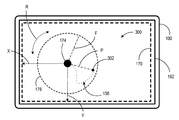

도 3은 도 1의 휴대용 전자 장치 상의 컴퓨터 게임 응용 프로그램에서 사용되는, 상대적 제스처 인식 모드에서의 가상 게임 컨트롤을 나타낸 도면.

도 4는 터치 스크린 센서를 가지는 휴대용 전자 장치를 제어하는 방법을 나타낸 도면.

도 2는 도 1의 휴대용 전자 장치 상의 미디어 재생 응용 프로그램에서 사용되는, 상대적 제스처 인식 모드에서의 전송 컨트롤을 나타낸 도면.

도 3은 도 1의 휴대용 전자 장치 상의 컴퓨터 게임 응용 프로그램에서 사용되는, 상대적 제스처 인식 모드에서의 가상 게임 컨트롤을 나타낸 도면.

도 4는 터치 스크린 센서를 가지는 휴대용 전자 장치를 제어하는 방법을 나타낸 도면.

도 1은, 예를 들어, 휴대용 미디어 플레이어 또는 인터넷이 가능한 휴대폰 등의 휴대용 전자 장치(100)일 수 있는 컴퓨팅 장치를 나타낸 것이다. 휴대용 전자 장치(100)는 통신 버스(102)를 통해 메모리(108) 및 대용량 저장 장치(106)와 전자 통신을 하고 메모리(108)의 일부분을 사용하여 하나 이상의 응용 프로그램(110)을 실행하도록 구성되어 있는 프로세서(104)를 포함한다. 휴대용 전자 장치(100)는 또한 터치 스크린 센서(162)를 가지는 디스플레이(160)를 포함한다. 디스플레이(160)는 하나 이상의 그래픽 사용자 인터페이스 요소(165)를 가지는 그래픽 사용자 인터페이스(164)를 제시할 수 있다.

그래픽 사용자 인터페이스(164)는, 그래픽 사용자 인터페이스의 하나 이상의 그래픽 사용자 인터페이스 요소(165)가 선택가능한 그래픽 사용자 인터페이스 요소(166)[디스플레이(160) 상의 선택가능한 그래픽 사용자 인터페이스 요소(166)의 위치에서 터치 스크린 센서(162)에 의해 감지된 사용자의 터치 입력을 통해 선택가능함]인 직접 입력 모드로 구성될 수 있다. 선택가능한 그래픽 사용자 인터페이스 요소(166)의 일례는 단추, 슬라이더, 스크롤 막대, 하이퍼링크, 풀다운 메뉴, 아이콘, 기타를 포함한다. 이들 다양한 선택가능한 그래픽 사용자 인터페이스 요소(166)의 거동은, 예를 들어, 응용 프로그래밍 인터페이스일 수 있는 컴퓨터 프로그램(130)을 통해 프로그램될 수 있다. 따라서, 사용자 터치 입력이 선택가능한 그래픽 사용자 인터페이스 요소(166)를 선택한 것에 응답하여, 휴대용 전자 장치는 선택가능한 그래픽 사용자 인터페이스 요소(166)와 연관된 프로그램된 거동(풀다운 메뉴 옵션을 선택하는 것, 창을 스크롤하는 것, 기타 등등)을 나타낼 수 있다.

사용자가 입력 모드를 전환할 수 있게 해주기 위해, 휴대용 전자 장치(100)는, 모드 전환 사용자 입력(152)을 수신하고 모드 전환 사용자 입력(152)에 응답하여 직접 입력 모드와 상대적 제스처 인식 모드 간에 전환하도록 구성된 입력 모드 전환 모듈(135)을 포함하는 컴퓨터 프로그램(130)(응용 프로그래밍 인터페이스 등)을 포함할 수 있다. 상대적 제스처 인식 모드에서는, 그래픽 사용자 인터페이스(164)의 적어도 정의된 영역(170)에 있는 하나 이상의 그래픽 사용자 인터페이스 요소(165)가 선택가능하지 않은 그래픽 사용자 인터페이스 요소(168)로 된다. 환언하면, 상대적 제스처 입력 모드에서 특정의 선택가능하지 않은 그래픽 사용자 인터페이스 요소(168)에 인접한 위치에서 수신된 입력은 휴대용 전자 장치(100)로 하여금 직접 입력 모드에서 그 사용자 인터페이스 요소와 연관된 프로그램된 기능을 실행하게 하지 않을 것이다. 오히려, 상대적 제스처 인식 모드에서의 터치 입력(156)은, 기반 그래픽 사용자 인터페이스 요소(165)에 상관없이, 상대적 제스처 입력으로서 처리될 것이며, 이에 대해서는 이하에서 기술한다.

상대적 제스처 인식 모드에서, 컴퓨터 프로그램(130) 내의 제스처-기반 제어 모듈(140)은 그래픽 사용자 인터페이스 요소(168)가 선택가능하지 않은 정의된 영역(170) 내의 터치 스크린 센서(162)의 표면과 사용자의 손가락 사이에 있는 터치 스크린 센서(162) 상의 접촉 지점(174)을 인식하고 정의된 영역(170)에서 접촉 지점(174)에 근접하여 제스처 컨트롤(172)을 제시하도록 구성되어 있다. 제스처-기반 제어 모듈(140)은 또한 접촉 지점(174)으로부터 시작하는 사용자 터치 입력(156)에 기초하여 검출된 제스처(158)를 식별하고 검출된 제스처(158)에 기초하여 휴대용 전자 장치(100)의 동작을 조정하라는 메시지를 응용 프로그램(110)으로 송신하도록 구성되어 있다.

컴퓨터 프로그램(130)은 또한 제스처-기반 제어 모듈(140)이 개발자 지정 제어 매개변수(149)[제스처 컨트롤(172)은 이 매개변수에 의해 동작하도록 구성되어 있음]에 액세스할 수 있게 해주도록 구성되어 있을 수 있다. 개발자 지정 제어 매개변수(149)는 개발자 지정 제어 매개변수 인터페이스(180)로부터 제스처-기반 제어 모듈(140)에 의해 수신될 수 있다. 개발자 지정 제어 매개변수(149)는, 예를 들어, 소프트웨어 개발 키트(SDK)를 통해 응용 프로그램 개발자에 의해 지정될 수 있고, 제스처 컨트롤(172)의 기능 및 특징을 사용자 지정하는 매개변수를 포함할 수 있다. 예를 들어, 개발자 지정 제어 매개변수(149)는 볼륨 매개변수, 재생 속도 매개변수, 재생 방향 매개변수, 컨트롤 주변부 정의 매개변수, 및 정의된 영역 정의 매개변수를 포함할 수 있다. 이러한 방식으로, 개발자는 제스처 컨트롤(172)을 볼륨 컨트롤 또는 재생 컨트롤로 정의할 수 있고, 컨트롤의 컨트롤 주변부 또는 기타 기하학적 속성은 물론, 제스처 입력을 수신하도록 구성될 디스플레이의 정의된 영역을 지정할 수 있다.

이들 개발자 지정 제어 매개변수에 따라, 또는 다른 대안으로서 컴퓨터 프로그램(130)에 의해 지정된 다른 사전 정의된 매개변수에 따라, 상대적 제스처 인식 모드에서, 제스처-기반 제어 모듈(140)은 터치 입력(156)을 수신하도록 구성된 제스처 컨트롤(172)을 정의된 영역(170) 내에 제시하도록 구성되어 있다. 정의된 영역(170) 내에서 검출된 제스처(158)를 식별함으로써, 제스처-기반 제어 모듈(140)은, 상대적 제스처 인식 모드에서, 그렇지 않았으면 직접 입력 모드에서 그래픽 사용자 인터페이스(164)로 보내지게 될 입력을 수신하는 프런트-엔드 프로세서로서 기능한다. 프런트-엔드 프로세서로서 기능할 때, 제스처-기반 제어 모듈(140)이, 휴대용 전자 장치(100)의 그래픽 사용자 인터페이스(164) 상에 디스플레이되는 다양한 요소에 무관하게, 정의된 영역(170)을 배치하도록 구성될 수 있으며, 따라서 정의된 영역(170)이 그래픽 사용자 인터페이스(164) 전체 또는 그 일부분에 걸쳐 떠돌아 다닌다는 것을 잘 알 것이다.

컴퓨터 프로그램(130)의 입력 모드 전환 모듈(135)에서 모드 전환 사용자 입력(152)을 수신하는 것에 의해 상대적 제스처 인식 모드가 시작될 수 있다. 모드 전환 사용자 입력(152)은, 도 1에서, 휴대용 전자 장치(100)와 연관된 클러치 키(clutch key)(154)를 통해 수신될 수 있는 터치 입력인 것으로 도시되어 있다. 클러치 키(154)는 물리적으로 휴대용 전자 장치(100)의 하우징 상에 위치하거나 액세서리[휴대용 전자 장치(100)와 통신하고 있는 헤드폰 등] 상에 위치할 수 있는 키(스위치 또는 단추 등)일 수 있다. 클러치 키(154)는, 예를 들어, 단추 또는 용량성 스위치일 수 있다. 다른 대안으로서, 모드 전환 사용자 입력(152)은 사용자의 손가락과 터치 스크린 센서(162)의 표면 간의 접촉을 통해 수신될 수 있고, 이 접촉은, 예를 들어, 온스크린 단추의 선택, 태핑, 또는 제스처일 수 있다.

모드 전환 사용자 입력(152)을 수신하면, 입력 모드 전환 모듈(135)은 상대적 제스처 인식 모드를 시작하고, 제스처-기반 제어 모듈(140)에 메시지를 출력한다. 구체적으로는, 입력 모드 전환 모듈(135)은, 상대적 제스처 인식 모드가 시작되었다는 것을 나타내고 접촉 지점 인식기(142)에게 정의된 영역(170)[정의된 영역(170) 내의 그래픽 사용자 인터페이스 요소(168)는 선택가능하지 않음] 내의 접촉 지점(174)을 반환하라고 요청하는 요청 메시지를 제스처-기반 제어 모듈(140) 내의 접촉 지점 인식기(142)로 전송한다.

요청 메시지를 수신할 때, 접촉 지점 인식기(142)는 터치 스크린 센서(162)의 표면 상의 정의된 영역(170) 내의 접촉 지점(174)을 인식한다. 접촉 지점(174)은 사용자의 손가락[도 1에서 터치 입력(156)으로 표현됨]과 정의된 영역(170) 내의 터치 스크린 센서(162)의 표면 간의 접촉에 의해 형성된다.

접촉 지점(174)을 인식할 때, 접촉 지점 인식기(142)는 정의된 영역(170) 내의 인식된 접촉 지점(174)에 근접하여 정의된 주변부(176)를 가지는 제스처 컨트롤(172)을 제시하도록 구성되어 있을 수 있다. 접촉 지점 인식기(142)는 컨트롤 주변부 정의기(144)로부터 컨트롤 주변부(176)에 대한 매개변수를 지정하는 입력을 수신할 수 있다. 접촉 지점 인식기(142)는 컨트롤 주변부 정의기(144)로부터 컨트롤 주변부 정의 매개변수를 수신할 수 있다. 컨트롤 주변부 정의 매개변수는, 예를 들어, 컨트롤 주변부를 계산하는 공식[이 공식은 접촉 지점(174)으로부터의 거리 D에 기초할 수 있음]을 지정할 수 있다. 한 일례에서, 컨트롤 주변부는 컴퓨터 프로그램(130)을 통해 액세스할 수 있는 일련의 표준 컨트롤 정의로부터의 사전 설정된 컨트롤 주변부일 수 있다. 다른 일례에서, 컨트롤 주변부 정의기(144)는 개발자 지정 매개변수 모듈(148)로부터 일련의 개발자 지정 제어 매개변수(149)에 포함된 컨트롤 주변부 정의 매개변수를 포함하는 입력을 수신할 수 있으며, 따라서 개발자가 컨트롤 주변부의 크기 및 형상을 지정할 수 있게 해줄 수 있다.

제스처 컨트롤(172)이 부분적으로 반투명일 수 있는 연관된 아이콘을 포함할 수 있지만, 다른 실시예에서, 제스처 컨트롤(172)이 시각적으로 인지가능하지 않을 수 있다는 것을 알 것이다. 아이콘(존재하는 경우)은 컨트롤 주변부 및/또는 접촉 지점을 시각적으로 표시할 수 있거나, 사용자에게 다른 도해적 정보(iconographic information)를 제공할 수 있다. 이러한 다른 도해적 정보는, 예를 들어, 가상 컨트롤 스틱 컨트롤(virtual control stick control)의 경우의 편향 각도 및 정도 또는 직선 슬라이더 컨트롤의 경우의 편향 정도를 포함할 수 있다. 일부 실시예에서, 아이콘은, 본 명세서에 기술된 바와 같이 제스처를 받아들이는 것에 부가하여, 태핑 입력에 응답할 수 있다.

제스처 컨트롤(172)을 제시할 때, 접촉 지점 인식기(142)는 검출된 제스처(158)[도 1에서 접촉 지점(174)에서 시작하는 것으로 나타내어져 있음]의 식별을 요청하는 메시지를 식별기(146)로 송신하도록 구성되어 있다. 식별기(146)는 제스처-기반 제어 모듈(140) 내에 존재하고 접촉 지점 인식기(142)로부터의 메시지는 물론 라이브러리(190) 및 개발자 지정 매개변수 모듈(148)로부터의 입력을 수신한다.

이들 입력에 기초하여, 식별기(146)는 터치 센서를 통해 수신된 터치 입력을, 접촉 지점(174)으로부터 시작하는 검출된 제스처(158)로서, 식별하도록 구성되어 있다. 예를 들어, 도 1에서, 식별기(146)는 사전-정의된 제스처(192)에 대한 정의를 포함하는 것으로 나타내어져 있는 라이브러리(190)로부터 입력을 수신하는 것으로 도시되어 있다. 따라서, 식별기(146)는 그래픽 사용자 인터페이스 요소(168)가 터치 스크린 센서(162)를 통해 선택가능하지 않은 정의된 영역(170) 내의 제스처 컨트롤(172)에 의해 수신되는 검출된 제스처(158)와 라이브러리(190) 내의 일련의 하나 이상의 사전 정의된 제스처(192) 중 하나에 대응하는 정의를 비교하는 것을 포함하는 검출된 제스처(158)의 해석에 적어도 부분적으로 기초하여 검출된 제스처(158)를 식별할 수 있다.

검출된 제스처(158)의 해석이, 개발자 지정 매개변수 모듈(148)에 포함되어 있고 개발자 지정 제어 매개변수 인터페이스(180)로부터 수신되는 하나 이상의 개발자 지정 제어 매개변수(149)에 기초할 수 있다는 것을 알 것이다. 이러한 방식으로, 응용 프로그램(110)의 개발자는 검출된 제스처(158)의 해석을 지정할 수 있다. 예를 들어, 개발자는 검출된 제스처(158)가 무시될 수 있는 정의된 영역(170) 내의 구역(예를 들어, "데드존"), 개발자 지정 규칙에 따라 검출된 제스처(158)를 해석하는 판별 매개변수, 실제 검출된 제스처(actual detected gesture)와 의사 검출된 제스처(spurious detected gesture)를 구분하도록 구성된 논리 등을 표시할 수 있다. 이러한 방식으로, 개발자는 특정의 응용 프로그램(110)에 따라 식별기(146)의 동작을 조정할 수 있다.

검출된 제스처(158)를 해석하였으면, 식별기(146)는 제스처-기반 제어 모듈의 통신 모듈(150)을 통해 메시지를 응용 프로그램(110)으로 송신한다. 메시지는 응용 프로그램(110)에 검출된 제스처(158)를 알려주고, 응용 프로그램으로 하여금 검출된 제스처(158)에 기초하여 휴대용 전자 장치(100)의 동작을 조정하게 하는 기능을 할 수 있다.

예를 들어, 식별기(146)는, 접촉 지점(174)으로부터 식별된 검출된 제스처(158)까지 상대 거리에 기초하여, 휴대용 전자 장치(100)의 동작을 조정하라고 응용 프로그램(110)에 지시하도록 구성될 수 있다. 이것의 한 일례가 도 2에 예시되어 있으며, 여기서 컴퓨터 프로그램(130)의 제스처-기반 제어 모듈(140)은 제스처-기반 제어 모듈(140)에 의해 식별되는 검출된 제스처(158)에 따라 휴대용 전자 장치(100)의 동작을 조정하라는 메시지를 미디어 재생 응용 프로그램으로 송신하도록 구성되어 있다. 축 V는 수평 방향을 나타내는 축 H에 직교인 수직 방향을 나타낸다.

계속하여 도 2에서, 제스처 컨트롤(172)(도 1)은 휴대용 전자 장치(100)의 터치 스크린 센서(162) 내의 정의된 영역(170)에 전송 컨트롤(200)으로서 제시된다. 상대적 제스처 인식 모드를 시작하기 위해, 동 도면에서 휴대용 전자 장치(100)의 가장자리에 도시되어 있는 클러치 키(154)가 작동될 수 있다. 정의된 영역(170) 내에서 손가락 터치를 수신할 때, 접촉 지점 인식기(142)는 전송 컨트롤(200)을 제시한다. 전송 컨트롤(200)은 전송 컨트롤(200)의 기준 프레임(frame of reference)(210)을 정의된 영역(170) 내의 접촉 지점(174)으로 스냅하도록 구성되어 있다. 전송 컨트롤(200)의 재생 제어 모드를 나타내는 이 일례에서, 사용자의 손가락이 기준 프레임(210)에 대해 실질적으로 수직인 방향인 것을 검출한 것에 기초하여 검출된 제스처(158)가 식별기(146)에 의해 식별되고, 그에 응답하여 통신 모듈(150)은 미디어 재생의 볼륨을 조정하라는 식별자(146)로부터의 메시지를 응용 프로그램(110)으로 송신한다.

검출된 제스처(158)의 실질적으로 플러스인 수직 방향은 미디어 재생의 볼륨을 증가시키라는 라이브러리(190) 내의 사전-정의된 제스처(192)에 대응하는 것으로 해석될 수 있다. 게다가, 미디어 재생의 볼륨 세기는, 접촉 지점(174)과 검출된 제스처(158)의 종료 지점 간의 거리를 나타내는 도시된 거리 B에 따라 결정될 수 있다. 예를 들어, 볼륨 세기는 거리 B의 절대 치수(absolute measure)로 결정될 수 있다. 따라서, B가 5개의 측정 거리 단위인 것으로 결정되는 경우, 볼륨 세기가, 예를 들어, 5개 볼륨 단위만큼 변경될 수 있다. 다른 일례에서, 볼륨 세기는 응용 프로그램(110)에 대해 개발자에 의해 지정된 일련의 개발자 지정 제어 매개변수(149)(도 1) 중에 지정될 수 있는 특정의 볼륨 레벨에 대한 거리 B에 의해 결정될 수 있다. 따라서, B가 5개의 측정 거리 단위인 것으로 결정되는 경우, 볼륨 세기가, 예를 들어, 사전-정의된 볼륨 레벨의 5 퍼센트만큼 변경될 수 있다. 대안의 일례에서, 거리 B가 컨트롤 주변부 정의 주변부(도시 생략)에 대응하는 거리의 5 퍼센트인 것으로 결정되는 경우, 볼륨 세기가 대응하는 5 퍼센트만큼 변경될 수 있다.

예를 들어, 일시정지 컨트롤을 구현하기 위해, 검출된 제스처(158)가 기준 프레임(210)에 대한 사용자의 손가락의 태핑 움직임의 검출에 기초하여 식별될 수 있다. 그에 응답하여, 제스처-기반 제어 모듈은 태핑 입력을 응용 프로그램으로 송신할 수 있고, 응용 프로그램은 태핑 입력을 해석하여 미디어 재생의 일시정지 상태를 변경할 수 있다. 고속 감기 및/또는 되감기 컨트롤을 구현하기 위해, 사용자의 손가락이 기준 프레임(210)에 대해 실질적으로 수평인 방향으로 움직인 것을 검출한 것에 기초하여 검출된 제스처(158)가 식별되고, 그에 응답하여 제스처-기반 제어 모듈은 검출된 제스처(158)를 응용 프로그램으로 송신할 수 있고, 응용 프로그램은 차례로 미디어 재생의 시간 위치를 조정할 수 있다. 미디어 재생이 휴대용 전자 장치(100)에 저장된 오디오 또는 비디오 미디어일 수 있거나 네트워크로부터 휴대용 전자 장치(100)에 의해 수신된 미디어일 수 있다는 것을 잘 알 것이다. 게다가, 전송 컨트롤(200)이 재생되는 미디어의 유형에 따라 구성될 수 있다. 예를 들어, 미디어 재생이 라디오 방송국으로부터의 브로드캐스트 스트림인 경우, 상기한 고속 감기 및/또는 되감기 컨트롤은 그 대신에 라디오 주파수에 걸쳐 전방으로 또는 후방으로 스캔하는 것을 제어할 수 있고, 상기한 태핑 입력이 방송국 사전 설정 등을 활성화시킬 수 있다.

또한, 제스처 기반 전송 컨트롤에 부가하여, 전송 컨트롤(200)이, 응용 프로그램의 상황에 따라, 제스처-기반(gesture based)이거나 비제스처-기반(non-gesture based)일 수 있는 제어 옵션을 제시할 수 있다는 것을 잘 알 것이다. 예를 들어, 전송 컨트롤(200)이 웹 브라우저 응용 프로그램과 관련하여 제시되는 경우, 미디어 재생을 제어하는 전송 컨트롤에 부가하여 웹 브라우저에 관련된 컨트롤이 제시될 수 있다. 다른 일례에서, 전송 컨트롤(200)이 컴퓨터 게임 응용 프로그램과 관련하여 제시되는 경우, 컴퓨터 게임에 관련된 컨트롤이 제시될 수 있으며, 예를 들어, 전송 컨트롤은 게임 음악 및 게임을 일시정지시키고 게임 옵션을 선택하기 위한 제스처 기반 메뉴를 제어한다. 이러한 방식으로, 개발자는 전송 컨트롤(200)을 응용 프로그램에 조화시킬 수 있다.

그에 부가하여, 제스처 기반 제어 모듈은 정의된 컨트롤 주변부(176) 상의 소정의 위치(178)로부터 검출된 제스처(158)까지의 상대 거리에 기초하여 휴대용 전자 장치(100)의 동작을 조정하라고 응용 프로그램에 지시하도록 구성될 수 있다. 예를 들어, 도 3에 도시한 바와 같이, 컴퓨터 프로그램은 컴퓨터 게임 응용 프로그램일 수 있고, 컴퓨터 프로그램(130)의 제스처-기반 제어 모듈(140)은 컨트롤 주변부(176) 또는 접촉 지점(174)으로부터의 가상 컨트롤 스틱 컨트롤(302)의 상대 거리에 기초하여 휴대용 전자 장치(100)의 동작을 조정하라는 메시지를 컴퓨터 게임 응용 프로그램으로 송신하도록 구성될 수 있다. 도 3에서, 축 Y가 수평 방향을 나타내는 축 X에 직교인 수직 방향을 나타낸다는 것을 잘 알 것이다. 부가의 기준 R은 평면 XY에 수직인 회전축을 중심으로 한 회전 방향을 나타내며, 여기서 평면 XY는 터치 스크린 센서(162)의 표면에 평행이다. 이 일례에서, 회전축은 접촉 지점(174)에서 평면 XY와 교차한다. 잘 알 것이다.

계속하여 도 3에서, 제스처 컨트롤(172)(도 1)이 가상 게임 컨트롤(300)으로서 제시된다. 가상 게임 컨트롤(300)은 상대적 제스처 인식 모드에서 정의된 영역(170) 내에서 터치 입력을 수신할 때 접촉 지점(174)에 가상 컨트롤 스틱 컨트롤(302)을 생성하도록 구성되어 있다. 가상 컨트롤 스틱 컨트롤(302)을 생성하는 프로세스는 접촉 지점(174)에 가상 컨트롤 스틱 컨트롤(302)의 인스턴스를 생성하는 것으로 이해될 것이다. 제스처-기반 제어 모듈(140)은 휴대용 전자 장치(100)의 터치 스크린 센서(162) 내의 정의된 영역(170)에서 가상 게임 컨트롤 스틱 컨트롤(302)을 둘러싸는 컨트롤 주변부(176)를 정의하도록 추가로 구성되어 있다. 제스처-기반 제어 모듈(140)은 컨트롤 주변부(176)에 가상 컨트롤 스틱 컨트롤(302)의 전범위 편향 F를 정의하도록 추가로 구성될 수 있다. 게다가, 가상 컨트롤 스틱 컨트롤(302)을 통해 가상 게임 컨트롤(300)에 의해 수신되는 사용자 터치 입력(156)(도 1)에 기초하여 검출된 제스처(158)가 컨트롤 주변부(176) 내에 있을 때 컴퓨터 게임 응용 프로그램으로 송신된 메시지가 가상 컨트롤 스틱 컨트롤(302)의 전범위 편향에 대한 가상 컨트롤 스틱 컨트롤(302)의 측정된 편향 P에 비례한다. 더욱이, 가상 컨트롤 스틱 컨트롤(302)을 통해 가상 게임 컨트롤(300)에 의해 수신되는 사용자 터치 입력(156)에 기초하여 검출된 제스처(158)가 컨트롤 주변부(176) 밖에서 수신될 때 컴퓨터 게임 응용 프로그램으로 송신된 메시지가 가상 컨트롤 스틱 컨트롤(302)의 전범위 편향 F와 실질적으로 동일하다.

가상 게임 컨트롤(300)의 컴퓨터 게임 제어 모드를 나타내는 도 3에 도시된 일례는 컨트롤 주변부(176) 내에서 접촉 지점(174)으로부터 거리 P에 가상 컨트롤 스틱 컨트롤(302)을 나타내고 있다. 이러한 일례에서, 검출된 제스처(158)는 접촉 지점(174)에서의 사용자의 손가락과 터치 스크린 센서(162)의 표면 사이의 검출된 접촉에 기초하여 식별기(146)(도 1)에 의해 식별된다. 그에 응답하여, 통신 모듈(150)은 거리 P와 가상 컨트롤 스틱 컨트롤(302)의 전범위 편향 F의 비율에 기초하여 휴대용 전자 장치(100)의 동작을 조정하라는 메시지를 응용 프로그램(110)으로 송신한다. 예를 들어, 비례 응답이 선형 비례이고 측정된 거리 P가 전범위 편향 F의 80 퍼센트를 나타내는 경우, 통신 모듈(150)은 휴대용 전자 장치(100)의 출력을 동작 매개변수의 80 퍼센트만큼 조정하라는 메시지를 응용 프로그램(110)으로 송신할 것이다. 컴퓨터 게임 응용 프로그램과 관련하여, 동작 매개변수가 이동 속도일 수 있지만, 다른 동작 매개변수가 이와 유사하게 조정될 수 있다는 것을 잘 알 것이다. 예를 들어, 정의된 영역(170) 내에서 접촉 지점(174)에 대한 가상 컨트롤 스틱 컨트롤(302)의 상대 위치가 방향 동작 매개변수를 제공할 수 있다. 구체적으로는, 검출된 제스처(158)가 나타내는 경로를 따른 가상 컨트롤 스틱 컨트롤(302)의 움직임이 해석되고 게임 캐릭터에 대한 이동 경로, 회전 움직임(캐릭터 또는 시점 회전시키기 등)의 방향 등으로서 출력될 수 있다. 또한, 동작 매개변수 및 이들과 연관된 출력을 비례시키는 방법의 이들 일례가 응용 프로그램(110)의 개발자에 의해 지정된 일련의 개발자 지정 제어 매개변수(149)(도 1) 중에서 지정될 수 있다는 것을 잘 알 것이다. 이러한 방식으로, 제스처-기반 제어 모듈(140)은 휴대용 전자 장치(100)의 동작을 조정하라는 메시지를 응용 프로그램(110)으로 송신할 수 있다.

상기한 다양한 실시예에서, 예를 들어, 접촉 지점 인식기가 사용자의 손가락과 터치 패드 센서 사이의 접촉이 종료되었음을 검출할 때, 소정의 기간 동안, 제스처-기반 제어 모듈(140)이 식별기(146)를 통해 제스처를 식별하는 것을 중단하고 터치의 검출을 시도하기 시작한다는 것을 잘 알 것이다. 새로운 접촉 지점(174)이 검출될 때, 새로운 제스처 컨트롤(172)이 인스턴스화될 것이고 그 결과 기준 프레임(210)이 사실상 새로운 접촉 지점(174)의 위치로 스냅하게 될 것임을 잘 알 것이다. 이러한 방식으로, 사용자가 정의된 영역(170) 내에서 터치 스크린 센서(162)에 접촉하기로 선택할 때마다, 제스처 컨트롤이 그 위치에 생성되고, 따라서 디스플레이(160) 상의 다양한 위치에서의 사용자 입력을 가능하게 해준다. 이러한 유연한 입력에 의해, 사용자는, 디스플레이(160)를 시각적으로 검사하지 않고 또한 선택가능하지 않은 그래픽 사용자 인터페이스 요소를 무의식적으로 활성화시키는 일 없이, 휴대용 전자 장치(100)를 용이하게 제어할 수 있다.

도 4는 터치 스크린 센서를 가지는 휴대용 전자 장치를 제어하는 방법(400)의 일 실시예를 나타낸 플로우차트이다. 방법(400)은, 도 1 내지 도 3의 휴대용 전자 장치(100)를 비롯하여, 터치 스크린 센서를 가지는 임의의 적당한 휴대용 전자 장치에 의해 구현될 수 있다.

방법(400)은, 402에서, 모드 전환 사용자 입력에 응답하여 상대적 제스처 인식 모드를 시작하는 단계를 포함하고, 상대적 제스처 인식 모드에서는, 그래픽 사용자 인터페이스의 정의된 영역에 있는 하나 이상의 그래픽 사용자 인터페이스 요소가 선택가능하지 않게 된다. 모드 전환 사용자 입력이 휴대용 전자 장치와 연관된 클러치 키를 통한 사용자 입력 및 사용자의 손가락과 터치 스크린 센서의 표면 간의 접촉을 통한 사용자 입력으로 이루어지는 그룹 중에서 선택될 수 있다. 어떤 일례에서, 402에서 상대적 제스처를 시작하는 단계는 그래픽 사용자 인터페이스와 무관하게 그래픽 사용자 인터페이스 요소가 선택가능하지 않은 그래픽 사용자 인터페이스의 정의된 영역을 배치하는 단계를 추가로 포함할 수 있다. 환언하면, 상대적 제스처 인식 모드가 활성화되면, 정의된 영역이 터치 스크린 센서 상의 아무데나 배치될 수 있고, 터치 스크린 센서의 서브영역 또는 터치 스크린 센서 전체를 포함할 수 있다.

방법(400)은, 404에서, 상대적 제스처 인식 모드에서 그래픽 사용자 인터페이스 요소가 선택가능하지 않은 정의된 영역에서 사용자의 손가락과 터치 스크린 센서의 표면 사이의 터치 스크린 센서 상의 접촉 지점을 인식하는 단계를 추가로 포함한다. 그 다음에, 방법(400)은, 406에서, 상대적 제스처 인식 모드에서 그래픽 사용자 인터페이스 요소가 선택가능하지 않은 정의된 영역에서 접촉 지점에 근접하여 정의된 컨트롤 주변부를 가지는 제스처 컨트롤을 제시하는 단계를 포함한다.

406에서 제스처 컨트롤을 제시하는 단계가, 상기한 바와 같이, 전송 컨트롤을 제시하는 단계를 포함할 수 있다는 것을 잘 알 것이다. 그에 부가하여, 제스처 컨트롤을 제시하는 단계가 전송 컨트롤의 기준 프레임을 정의된 영역 내의 접촉 지점으로 스냅하는 단계를 추가로 포함할 수 있다. 게다가, 접촉 지점에 근접하여 정의된 컨트롤 주변부를 가지는 제스처 컨트롤을 제시하는 단계가 접촉 지점에 가상 게임 컨트롤에 대한 가상 컨트롤 스틱 컨트롤을 생성하는 단계를 포함할 수 있고, 정의된 컨트롤 주변부가 정의된 컨트롤 주변부에서 가상 컨트롤 스틱 컨트롤의 전범위 편향을 가진다. 장치가 상대적 제스처 인식 모드에 있고 제스처 컨트롤이 이러한 방식으로 제시되는 경우, 검출된 제스처가 터치 스크린 센서의 정의된 영역 내에서 수신되고 식별될 수 있다.

방법(400)은, 408에서, 그래픽 사용자 인터페이스 요소가 터치 스크린 센서를 통해 터치 스크린 센서 내에서 선택가능하지 않은 정의된 영역에서 제스처 컨트롤에 의해 수신된 접촉 지점으로부터 시작하는 사용자 터치 입력에 기초하여 검출된 제스처를 식별하는 단계를 추가로 포함한다. 한 일례에서, 검출된 제스처를 식별하는 단계가 터치 스크린 센서를 통해 그래픽 사용자 인터페이스 요소가 선택가능하지 않은 정의된 영역에서 제스처 컨트롤에 의해 수신된 검출된 제스처를 사전-정의된 제스처 라이브러리 내의 일련의 하나 이상의 사전-정의된 제스처 중 하나의 제스처에 대응하는 정의와 비교한 것에 적어도 부분적으로 기초하여 검출된 제스처를 해석하는 단계를 추가로 포함한다.

방법(400)은, 408에서, 제스처-기반 제어 모듈이 개발자 지정 제어 매개변수 - 제스처 컨트롤은 이 매개변수에 의해 동작하도록 구성되어 있음 - 에 액세스할 수 있게 해주는 단계를 추가로 포함할 수 있다. 한 일례에서, 개발자 지정 제어 매개변수가 볼륨 매개변수, 재생 속도 매개변수, 재생 방향 매개변수, 컨트롤 주변부 정의 매개변수, 및 정의된 영역 정의 매개변수로 이루어지는 그룹 중에서 선택될 수 있다. 이러한 방식으로, 개발자는, 예를 들어, 소프트웨어 개발 키트를 통해, 특정의 응용 프로그램에 특유한 휴대용 전자 장치에 대한 제어 매개변수를 지정할 수 있다.

마지막으로, 방법(400)은, 410에서, 정의된 컨트롤 주변부 상의 소정의 위치로부터 그와 같이 식별되는 검출된 제스처까지의 상대 거리에 기초하여 또는 접촉 지점으로부터 그와 같이 식별되는 검출된 제스처까지의 상대 거리에 기초하여 휴대용 전자 장치의 동작을 조정하는 단계를 추가로 포함한다. 한 일례에서, 휴대용 전자 장치의 동작을 조정하는 단계는 검출된 제스처가 사용자의 손가락이 기준 프레임에 대해 실질적으로 수평인 방향으로 있는 것에 의해 식별된 것에 응답하여 미디어 재생의 시간 위치를 조정하는 단계를 포함한다. 다른 일례에서, 장치의 동작을 조정하는 단계는 검출된 제스처가 사용자의 손가락이 기준 프레임에 대해 실질적으로 수직인 방향으로 있는 것에 의해 식별된 것에 응답하여 미디어 재생의 볼륨을 조정하는 단계를 포함한다. 또 다른 일례에서, 장치의 동작을 조정하는 단계는 검출된 제스처가 기준 프레임에 대한 사용자의 손가락의 태핑 움직임에 의해 식별된 것에 응답하여 미디어 재생의 일시재생 상태를 조정하는 단계를 포함한다.

그에 부가하여, 휴대용 전자 장치의 동작을 조정하는 단계는 터치 스크린 센서에 의해 수신된 제스처가 정의된 컨트롤 주변부 내에서 수신될 때, 가상 컨트롤 스틱 컨트롤의 전범위 편향에 대한 가상 컨트롤 스틱 컨트롤의 측정된 편향에 비례하는 가상 게임 컨트롤로부터의 응답을 출력하는 단계를 포함할 수 있다. 그리고, 휴대용 전자 장치의 동작을 조정하는 단계는 상대적 제스처가 정의된 컨트롤 주변부 밖에서 수신될 때, 가상 컨트롤 스틱의 전범위 편향과 실질적으로 동일한 가상 게임 컨트롤로부터의 응답을 출력하는 단계를 추가로 포함할 수 있다.

상기한 방법이, 본 명세서에 기술된 시스템과 같이, 사용자가 장치를 시각적으로 검사하지 않는 상황에서 또한 선택가능하지 않게 된 그래픽 사용자 인터페이스 요소를 무의식적으로 선택하는 일 없이, 휴대용 전자 장치의 사용자 제어를 용이하게 해주는 데 사용될 수 있다.

도 4에 나타낸 방법이 상기 방법을 수행하기 위해 컴퓨팅 장치에 의해 실행가능한 명령어를 포함하는 컴퓨터-판독가능 저장 매체에 존재할 수 있다는 것을 잘 알 것이다. 본 명세서에 기술된 컴퓨팅 장치가 본 명세서에 기술된 프로그램을 실행하도록 구성된 임의의 적당한 컴퓨팅 장치일 수 있다는 것을 잘 알 것이다. 예를 들어, 컴퓨팅 장치는 메인프레임 컴퓨터, 개인용 컴퓨터, 랩톱 컴퓨터, PDA(portable data assistant), 컴퓨터-지원 무선 전화, 네트워크화된 컴퓨팅 장치, 또는 기타 적당한 컴퓨팅 장치일 수 있고, 인터넷과 같은 컴퓨터 네트워크를 통해 서로 연결될 수 있다. 이들 컴퓨팅 장치는 통상적으로 프로세서와, 관련 휘발성 및 비휘발성 메모리를 포함하고 있으며, 휘발성 메모리의 일부분 및 프로세서를 사용하여 비휘발성 메모리에 저장된 프로그램을 실행하도록 구성되어 있다. 본 명세서에서 사용되는 바와 같이, "프로그램"이라는 용어는 본 명세서에 기술된 하나 이상의 컴퓨팅 장치에 의해 실행되거나 이용될 수 있는 소프트웨어 또는 펌웨어 구성요소를 말하고, 개개의 또는 일군의 실행가능 파일, 데이터 파일, 라이브러리, 드라이버, 스크립트, 데이터베이스 레코드, 기타를 포괄하기 위한 것이다. 컴퓨팅 장치에 의해 실행될 때에 컴퓨팅 장치로 하여금 상기한 방법을 실행하게 하고 또 상기한 시스템을 동작시키는 프로그램 명령어가저장되어 있는 컴퓨터-판독가능 매체가 제공될 수 있다는 것을 잘 알 것이다.

본 발명의 범위가 이상의 설명에 의하기 보다는 첨부된 특허청구범위에 의해 한정되기 때문에, 본 명세서에서의 실시예들이 제한적인 것이 아니라 예시적인 것이라는 것과, 따라서 청구항들의 범위(metes and bounds) 또는 청구항들의 이러한 범위의 등가물 내에 속하는 모든 변경이 청구항들에 의해 포괄되는 것으로 보아야 한다는 것을 잘 알 것이다.

Claims (15)

- 터치 스크린 센서(162)를 가지는 휴대용 전자 장치(100) 상에서 실행가능한 컴퓨터 프로그램(130)으로서,

모드 전환 사용자 입력(152)을 수신하고 사용자 입력(152)에 응답하여 직접 입력 모드와 상대적 제스처 인식 모드 간을 전환하도록 구성된 입력 모드 전환 모듈(135) - 상기 직접 입력 모드에서는, 상기 휴대용 전자 장치(100)의 그래픽 사용자 인터페이스(164)의 하나 이상의 그래픽 사용자 인터페이스 요소(165)가 상기 사용자의 터치 입력을 통해 선택가능하고, 상기 상대적 제스처 인식 모드에서는, 상기 그래픽 사용자 인터페이스(164)의 적어도 정의된 영역(170)에 있는 상기 그래픽 사용자 인터페이스 요소(165)가 선택가능하지 않게 됨 -, 및

상기 상대적 제스처 인식 모드에서, 그래픽 사용자 인터페이스 요소(168)가 선택가능하지 않은 상기 정의된 영역(170) 내의 터치 스크린 센서(162)의 표면과 사용자의 손가락 사이에 있는 터치 스크린 센서(162) 상의 접촉 지점(174)을 인식하고, 상기 정의된 영역(170)에서 상기 접촉 지점(174)에 근접하여 제스처 컨트롤(172)을 제시하도록 구성된 제스처-기반 제어 모듈(140) - 상기 제스처-기반 제어 모듈(140)은 상기 접촉 지점(174)에서 생긴 사용자 터치 입력(156)에 기초하여 검출된 제스처(158)를 식별하고, 상기 검출된 제스처(158)에 기초하여 상기 휴대용 전자 장치(100)의 동작을 조정하라는 메시지를 응용 프로그램(110)으로 송신하도록 더 구성되어 있음 - 을 포함하는 컴퓨터 프로그램. - 제1항에 있어서, 상기 모드 전환 사용자 입력은, 상기 휴대용 전자 장치와 연관된 클러치 키(clutch key)를 통한 사용자 입력 및 상기 사용자의 손가락과 상기 터치 스크린 센서의 표면 간의 접촉을 통한 사용자 입력으로 이루어지는 그룹 중에서 선택되는 컴퓨터 프로그램.

- 제1항에 있어서, 상기 제스처 컨트롤은, 전송 컨트롤의 기준 프레임을 상기 정의된 영역 내의 접촉 지점으로 스냅하도록 구성된 전송 컨트롤을 포함하는 컴퓨터 프로그램.

- 제3항에 있어서, 상기 제스처-기반 제어 모듈은 상기 제스처-기반 제어 모듈에 의해 식별되는 상기 검출된 제스처에 따라 상기 휴대용 전자 장치의 동작을 조정하라는 메시지를 미디어 재생 응용 프로그램으로 송신하도록 구성되어 있고,

상기 전송 컨트롤의 재생 제어 모드에서, 상기 사용자의 손가락이 상기 기준 프레임에 대해 실질적으로 수평인 방향으로 움직인 것을 검출한 것에 기초하여 상기 검출된 제스처가 식별되고, 그에 응답하여, 미디어 재생의 시간 위치를 조정하며,

상기 전송 컨트롤의 볼륨 제어 모드에서, 상기 사용자의 손가락이 상기 기준 프레임에 대해 실질적으로 수직인 방향임을 검출한 것에 기초하여 상기 검출된 제스처가 식별되고, 그에 응답하여, 상기 미디어 재생의 볼륨을 조정하며,

상기 전송 컨트롤의 일시정지 제어 모드에서, 상기 기준 프레임에 대한 상기 사용자의 손가락의 태핑 움직임을 검출한 것에 기초하여 상기 검출된 제스처가 식별되고, 그에 응답하여, 상기 미디어 재생의 일시정지 상태를 변경하는 컴퓨터 프로그램. - 제1항에 있어서, 상기 제스처 컨트롤은 상기 접촉 지점에 가상 게임 컨트롤에 대한 가상 컨트롤 스틱 컨트롤을 생성하도록 구성된 가상 게임 컨트롤을 포함하고,

상기 제스처-기반 제어 모듈은 가상 게임 컨트롤 스틱을 둘러싸는 컨트롤 주변부를 정의하도록 더 구성되어 있으며,

상기 제스처-기반 제어 모듈은 상기 컨트롤 주변부 또는 상기 접촉 지점으로부터 상기 가상 컨트롤 스틱 컨트롤의 상대 거리에 기초하여 상기 휴대용 전자 장치의 동작을 조정하라는 메시지를 컴퓨터 게임 응용 프로그램으로 송신하도록 더 구성되어 있는 컴퓨터 프로그램. - 제5항에 있어서, 상기 제스처-기반 제어 모듈은 상기 컨트롤 주변부에 상기 가상 컨트롤 스틱 컨트롤의 전범위 편향(full-scale deflection)을 정의하도록 더 구성되어 있으며,

상기 가상 컨트롤 스틱 컨트롤을 통해 가상 게임 컨트롤에 의해 수신되는 사용자 터치 입력에 기초한 상기 검출된 제스처가 상기 컨트롤 주변부 내에 있을 때 상기 컴퓨터 게임 응용 프로그램으로 송신된 메시지는 상기 가상 컨트롤 스틱 컨트롤의 전범위 편향에 대한 상기 가상 컨트롤 스틱 컨트롤의 측정된 편향에 비례하며,

상기 가상 컨트롤 스틱 컨트롤을 통해 상기 가상 게임 컨트롤에 의해 수신되는 사용자 터치 입력에 기초한 상기 검출된 제스처가 상기 컨트롤 주변부 밖에서 수신될 때 상기 컴퓨터 게임 응용 프로그램으로 송신된 메시지는 가상 컨트롤 스틱 컨트롤의 전범위 편향과 실질적으로 동일한 컴퓨터 프로그램. - 제1항에 있어서, 상기 제스처-기반 제어 모듈은 상기 휴대용 전자 장치의 상기 그래픽 사용자 인터페이스와 무관하게 상기 정의된 영역을 배치하도록 더 구성되어 있는 컴퓨터 프로그램.

- 제1항에 있어서, 상기 제스처-기반 제어 모듈로 하여금 제스처 컨트롤이 동작하도록 구성되어 있는 개발자 지정 제어 매개변수에 액세스할 수 있게 하도록 더 구성되어 있는 컴퓨터 프로그램.

- 제8항에 있어서, 상기 개발자 지정 제어 매개변수는 볼륨 매개변수, 재생 속도 매개변수, 재생 방향 매개변수, 컨트롤 주변부 정의 매개변수, 및 정의된 영역 정의 매개변수로 이루어지는 그룹 중에서 선택되는 컴퓨터 프로그램.

- 터치 스크린 센서(162)를 가지는 휴대용 전자 장치(100)를 제어하는 방법으로서,

모드 전환 사용자 입력(152)에 응답하여 상대적 제스처 인식 모드를 시작하는 단계 - 상대적 제스처 인식 모드에서는, 그래픽 사용자 인터페이스(164)의 정의된 영역(170)에 있는 하나 이상의 그래픽 사용자 인터페이스 요소(165)가 선택가능하지 않게 됨 -, 및

상기 상대적 제스처 인식 모드에서 상기 그래픽 사용자 인터페이스 요소(168)가 선택가능하지 않은 상기 정의된 영역(170)에서 사용자의 손가락과 상기 터치 스크린 센서(162)의 표면 사이의 상기 터치 스크린 센서(162) 상의 접촉 지점(174)을 인식하는 단계,

상기 상대적 제스처 인식 모드에서 상기 그래픽 사용자 인터페이스 요소(168)가 선택가능하지 않은 상기 정의된 영역(170)에서 상기 접촉 지점(174)에 근접하여 정의된 컨트롤 주변부(176)를 가지는 제스처 컨트롤(172)을 제시하는 단계,

상기 그래픽 사용자 인터페이스 요소(168)가 상기 터치 스크린 센서(162)를 통해 상기 터치 스크린 센서(162) 내에서 선택가능하지 않은 상기 정의된 영역(170)에서 상기 제스처 컨트롤(172)에 의해 수신된 상기 접촉 지점(174)에서 생긴 사용자 터치 입력(156)에 기초하여 검출된 제스처(158)를 식별하는 단계, 및

상기 정의된 컨트롤 주변부(176) 상의 미리 정의된 위치(178)로부터 상기 검출된 제스처(158)까지의 상대 거리에 기초하여 또는 상기 접촉 지점(174)으로부터 상기 검출된 제스처(158)까지의 상대 거리에 기초하여 상기 휴대용 전자 장치(100)의 동작을 조정하는 단계를 포함하는 방법. - 제10항에 있어서, 상기 모드 전환 사용자 입력은, 상기 휴대용 전자 장치와 연관된 클러치 키를 통한 사용자 입력 및 상기 사용자의 손가락과 상기 터치 스크린 센서의 표면 간의 접촉을 통한 사용자 입력으로 이루어지는 그룹 중에서 선택되는 방법.

- 제10항에 있어서, 상기 제스처 컨트롤을 제시하는 단계는 전송 컨트롤을 제시하는 단계를 포함하고,

상기 제스처 컨트롤을 제시하는 단계는 상기 전송 컨트롤의 기준 프레임을 상기 정의된 영역 내의 상기 접촉 지점으로 스냅하는 단계를 더 포함하는 방법. - 제12항에 있어서, 상기 휴대용 전자 장치의 동작을 조정하는 단계는,

상기 검출된 제스처가 사용자의 손가락이 상기 기준 프레임에 대해 실질적으로 수평인 방향으로 있는 것에 의해 식별된 것에 응답하여 미디어 재생의 시간 위치를 조정하는 단계,

상기 검출된 제스처가 사용자의 손가락이 상기 기준 프레임에 대해 실질적으로 수직인 방향으로 있는 것에 의해 식별된 것에 응답하여 미디어 재생의 볼륨을 조정하는 단계, 및

상기 검출된 제스처가 상기 기준 프레임에 대한 사용자의 손가락의 태핑 움직임에 의해 식별된 것에 응답하여 미디어 재생의 일시재생 상태를 조정하는 단계

를 포함하는 방법. - 제10항에 있어서, 상기 접촉 지점에 근접하여 정의된 컨트롤 주변부를 가지는 제스처 컨트롤을 제시하는 단계는, 상기 접촉 지점에 가상 게임 컨트롤에 대한 가상 컨트롤 스틱 컨트롤을 생성하는 단계를 포함하고, 상기 정의된 컨트롤 주변부는 상기 정의된 컨트롤 주변부에서 가상 컨트롤 스틱 컨트롤의 전범위 편향을 갖는 방법.

- 제14항에 있어서, 상기 휴대용 전자 장치의 동작을 조정하는 단계는,

상기 터치 스크린 센서에 의해 수신된 제스처가 상기 정의된 컨트롤 주변부 내에서 수신될 때, 상기 가상 컨트롤 스틱 컨트롤의 전범위 편향에 대한 상기 가상 컨트롤 스틱 컨트롤의 측정된 편향에 비례하는 상기 가상 게임 컨트롤로부터의 응답을 출력하는 단계, 및

상기 상대적 제스처가 상기 정의된 컨트롤 주변부 밖에서 수신될 때, 상기 가상 컨트롤 스틱 컨트롤의 전범위 편향과 실질적으로 동일한 상기 가상 게임 컨트롤로부터의 응답을 출력하는 단계를 포함하는 방법.

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US12/206,747 US20100064261A1 (en) | 2008-09-09 | 2008-09-09 | Portable electronic device with relative gesture recognition mode |

| US12/206,747 | 2008-09-09 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20110056286A true KR20110056286A (ko) | 2011-05-26 |

Family

ID=41800241

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020117005120A KR20110056286A (ko) | 2008-09-09 | 2009-09-09 | 상대적 제스처 인식 모드를 갖는 휴대용 전자 장치 |

Country Status (7)

| Country | Link |

|---|---|

| US (1) | US20100064261A1 (ko) |

| EP (1) | EP2327011A4 (ko) |

| JP (1) | JP2012502393A (ko) |

| KR (1) | KR20110056286A (ko) |

| CN (1) | CN102150123B (ko) |

| RU (1) | RU2011108470A (ko) |

| WO (1) | WO2010030662A2 (ko) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2014017831A2 (ko) * | 2012-07-25 | 2014-01-30 | Park Chul | 터치패널을 갖는 개인휴대단말기의 작동방법 |

Families Citing this family (60)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8162816B2 (en) | 2001-03-09 | 2012-04-24 | Boston Scientific Scimed, Inc. | System for implanting an implant and method thereof |

| US8769427B2 (en) * | 2008-09-19 | 2014-07-01 | Google Inc. | Quick gesture input |

| US9250797B2 (en) * | 2008-09-30 | 2016-02-02 | Verizon Patent And Licensing Inc. | Touch gesture interface apparatuses, systems, and methods |

| US20100162181A1 (en) * | 2008-12-22 | 2010-06-24 | Palm, Inc. | Interpreting Gesture Input Including Introduction Or Removal Of A Point Of Contact While A Gesture Is In Progress |

| KR101471801B1 (ko) * | 2009-08-21 | 2014-12-10 | 애플 인크. | 정전용량 감지를 위한 방법 및 장치 |

| US20110148786A1 (en) * | 2009-12-18 | 2011-06-23 | Synaptics Incorporated | Method and apparatus for changing operating modes |

| US9465532B2 (en) | 2009-12-18 | 2016-10-11 | Synaptics Incorporated | Method and apparatus for operating in pointing and enhanced gesturing modes |

| US8621380B2 (en) | 2010-01-06 | 2013-12-31 | Apple Inc. | Apparatus and method for conditionally enabling or disabling soft buttons |

| US9268404B2 (en) * | 2010-01-08 | 2016-02-23 | Microsoft Technology Licensing, Llc | Application gesture interpretation |

| US20110283241A1 (en) * | 2010-05-14 | 2011-11-17 | Google Inc. | Touch Gesture Actions From A Device's Lock Screen |

| US9542091B2 (en) * | 2010-06-04 | 2017-01-10 | Apple Inc. | Device, method, and graphical user interface for navigating through a user interface using a dynamic object selection indicator |

| US20120102437A1 (en) * | 2010-10-22 | 2012-04-26 | Microsoft Corporation | Notification Group Touch Gesture Dismissal Techniques |

| US8659562B2 (en) | 2010-11-05 | 2014-02-25 | Apple Inc. | Device, method, and graphical user interface for manipulating soft keyboards |

| US8587547B2 (en) | 2010-11-05 | 2013-11-19 | Apple Inc. | Device, method, and graphical user interface for manipulating soft keyboards |

| US9361009B2 (en) * | 2010-12-01 | 2016-06-07 | Adobe Systems Incorporated | Methods and systems for setting parameter values via radial input gestures |

| US8612874B2 (en) | 2010-12-23 | 2013-12-17 | Microsoft Corporation | Presenting an application change through a tile |

| US20120166944A1 (en) | 2010-12-23 | 2012-06-28 | Stephen Hayden Cotterill | Device, Method, and Graphical User Interface for Switching Between Two User Interfaces |

| US8689123B2 (en) | 2010-12-23 | 2014-04-01 | Microsoft Corporation | Application reporting in an application-selectable user interface |

| US9411509B2 (en) * | 2010-12-29 | 2016-08-09 | Microsoft Technology Licensing, Llc | Virtual controller for touch display |

| US9092132B2 (en) | 2011-01-24 | 2015-07-28 | Apple Inc. | Device, method, and graphical user interface with a dynamic gesture disambiguation threshold |

| US10365819B2 (en) | 2011-01-24 | 2019-07-30 | Apple Inc. | Device, method, and graphical user interface for displaying a character input user interface |

| CN102156573B (zh) * | 2011-03-25 | 2015-05-20 | 中兴通讯股份有限公司 | 触摸屏电子设备及其可点触响应功能的定位方法 |

| US9658766B2 (en) | 2011-05-27 | 2017-05-23 | Microsoft Technology Licensing, Llc | Edge gesture |

| US20120304131A1 (en) * | 2011-05-27 | 2012-11-29 | Jennifer Nan | Edge gesture |

| US9158445B2 (en) | 2011-05-27 | 2015-10-13 | Microsoft Technology Licensing, Llc | Managing an immersive interface in a multi-application immersive environment |

| US9104307B2 (en) | 2011-05-27 | 2015-08-11 | Microsoft Technology Licensing, Llc | Multi-application environment |

| US20120304132A1 (en) | 2011-05-27 | 2012-11-29 | Chaitanya Dev Sareen | Switching back to a previously-interacted-with application |

| WO2013012424A1 (en) * | 2011-07-21 | 2013-01-24 | Research In Motion Limited | Electronic device including a touch-sensitive display and a navigation device and method of controlling the same |

| TWI446255B (zh) | 2011-07-28 | 2014-07-21 | Wistron Corp | 具有螢幕顯示選單功能之顯示裝置 |

| US20130057587A1 (en) | 2011-09-01 | 2013-03-07 | Microsoft Corporation | Arranging tiles |

| US9146670B2 (en) | 2011-09-10 | 2015-09-29 | Microsoft Technology Licensing, Llc | Progressively indicating new content in an application-selectable user interface |

| US10318146B2 (en) * | 2011-09-12 | 2019-06-11 | Microsoft Technology Licensing, Llc | Control area for a touch screen |

| KR20130050607A (ko) * | 2011-11-08 | 2013-05-16 | 삼성전자주식회사 | 단말기에서 독서 관리 방법 및 장치 |

| US9395901B2 (en) | 2012-02-08 | 2016-07-19 | Blackberry Limited | Portable electronic device and method of controlling same |

| CN103257817A (zh) * | 2012-02-21 | 2013-08-21 | 海尔集团公司 | 共享设备的确定方法和文件传输方法及系统 |

| CN103257813B (zh) * | 2012-02-21 | 2017-12-22 | 海尔集团公司 | 一种共享设备的确定方法和文件传输方法以及系统 |

| US9225307B2 (en) | 2012-06-28 | 2015-12-29 | Sonos, Inc. | Modification of audio responsive to proximity detection |

| CN103135929A (zh) * | 2013-01-31 | 2013-06-05 | 北京小米科技有限责任公司 | 控制应用界面移动的方法、装置和终端设备 |

| US9189149B2 (en) | 2013-03-21 | 2015-11-17 | Sharp Laboratories Of America, Inc. | Equivalent gesture and soft button configuration for touch screen enabled device |

| JP5449630B1 (ja) * | 2013-05-27 | 2014-03-19 | 三菱電機株式会社 | プログラマブル表示器およびその画面操作処理プログラム |

| US9405377B2 (en) * | 2014-03-15 | 2016-08-02 | Microsoft Technology Licensing, Llc | Trainable sensor-based gesture recognition |

| KR102302233B1 (ko) * | 2014-05-26 | 2021-09-14 | 삼성전자주식회사 | 사용자 인터페이스 제공 장치 및 방법 |

| US9898162B2 (en) | 2014-05-30 | 2018-02-20 | Apple Inc. | Swiping functions for messaging applications |

| US20170192465A1 (en) * | 2014-05-30 | 2017-07-06 | Infinite Potential Technologies Lp | Apparatus and method for disambiguating information input to a portable electronic device |

| US9971500B2 (en) | 2014-06-01 | 2018-05-15 | Apple Inc. | Displaying options, assigning notification, ignoring messages, and simultaneous user interface displays in a messaging application |

| CN104267904A (zh) * | 2014-09-26 | 2015-01-07 | 深圳市睿德网络科技有限公司 | 一种具有触摸屏虚拟单位控制的方法及移动终端 |

| US11567626B2 (en) * | 2014-12-17 | 2023-01-31 | Datalogic Usa, Inc. | Gesture configurable floating soft trigger for touch displays on data-capture electronic devices |

| JP6497549B2 (ja) * | 2015-03-05 | 2019-04-10 | カシオ計算機株式会社 | 電子機器、タッチ操作制御方法及びプログラム |

| WO2017200571A1 (en) * | 2016-05-16 | 2017-11-23 | Google Llc | Gesture-based control of a user interface |

| US10739972B2 (en) | 2016-06-10 | 2020-08-11 | Apple Inc. | Device, method, and graphical user interface for managing electronic communications |

| CN106028172A (zh) * | 2016-06-13 | 2016-10-12 | 百度在线网络技术(北京)有限公司 | 音/视频处理方法及装置 |

| US10466344B2 (en) * | 2016-07-07 | 2019-11-05 | Tactual Labs Co. | Human-computer interaction applications of precise ranging technology and geometric dilution of precision in a ranging positioning system for VR |

| JP6729338B2 (ja) * | 2016-12-13 | 2020-07-22 | ヤマハ株式会社 | 表示装置 |

| KR20190112160A (ko) * | 2017-03-23 | 2019-10-02 | 미쓰비시덴키 가부시키가이샤 | 터치 입력 판정 장치, 터치 입력 판정 방법, 및 터치 입력 판정 프로그램 |

| CN111399742B (zh) * | 2020-03-13 | 2024-04-26 | 华为技术有限公司 | 界面切换方法、装置和电子设备 |

| CN111522446B (zh) * | 2020-06-09 | 2023-10-03 | 宁波视睿迪光电有限公司 | 基于多点tof的手势识别方法及装置 |

| CN112535862A (zh) * | 2020-09-30 | 2021-03-23 | 深圳德深通商贸有限公司 | 一种虚拟摇杆的控制方法及控制系统 |

| CN114639158A (zh) * | 2020-11-30 | 2022-06-17 | 伊姆西Ip控股有限责任公司 | 计算机交互方法、设备和程序产品 |

| CN114446030B (zh) * | 2022-01-25 | 2024-04-09 | 惠州Tcl移动通信有限公司 | 姿势识别方法、装置、存储介质及电子设备 |

| US11785300B2 (en) * | 2022-02-17 | 2023-10-10 | Roku, Inc. | HDMI customized ad insertion |

Family Cites Families (30)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8479122B2 (en) * | 2004-07-30 | 2013-07-02 | Apple Inc. | Gestures for touch sensitive input devices |

| JPH11212726A (ja) * | 1998-01-29 | 1999-08-06 | Omron Corp | 入力装置 |

| JP3874571B2 (ja) * | 1999-05-21 | 2007-01-31 | シャープ株式会社 | ジェスチャー処理装置及びジェスチャー処理方法 |

| JP2001117686A (ja) * | 1999-10-20 | 2001-04-27 | Toshiba Corp | ペン入力装置およびペン入力装置のポインティング処理方法 |

| JP4532631B2 (ja) * | 1999-10-26 | 2010-08-25 | キヤノン株式会社 | 情報入出力装置、その制御方法、及びその制御プログラムを格納したコンピュータにより読み取り可能な記録媒体 |

| JP2001202174A (ja) * | 2000-01-21 | 2001-07-27 | Canon Inc | 画像表示装置、方法および記憶媒体 |

| FI20021655A (fi) | 2002-06-19 | 2003-12-20 | Nokia Corp | Menetelmä lukituksen avaamiseksi ja kannettava elektroninen laite |

| JP2006527439A (ja) * | 2003-06-13 | 2006-11-30 | ユニヴァーシティ オブ ランカスター | ユーザインタフェース |

| US7176886B2 (en) * | 2004-03-23 | 2007-02-13 | Fujitsu Limited | Spatial signatures |

| US7519223B2 (en) * | 2004-06-28 | 2009-04-14 | Microsoft Corporation | Recognizing gestures and using gestures for interacting with software applications |

| KR20060008735A (ko) * | 2004-07-24 | 2006-01-27 | 주식회사 대우일렉트로닉스 | 터치패드가 장착된 리모콘 |

| JP4903371B2 (ja) * | 2004-07-29 | 2012-03-28 | 任天堂株式会社 | タッチパネルを用いたゲーム装置およびゲームプログラム |

| EP2000894B1 (en) * | 2004-07-30 | 2016-10-19 | Apple Inc. | Mode-based graphical user interfaces for touch sensitive input devices |

| JP2006093901A (ja) * | 2004-09-21 | 2006-04-06 | Saxa Inc | ジェスチャ操作可能な電話機 |

| JP2006139615A (ja) * | 2004-11-12 | 2006-06-01 | Access Co Ltd | 表示装置、メニュー表示プログラムおよびタブ表示プログラム |

| US8464176B2 (en) * | 2005-01-19 | 2013-06-11 | Microsoft Corporation | Dynamic stacking and expansion of visual items |

| KR20160150116A (ko) * | 2005-03-04 | 2016-12-28 | 애플 인크. | 다기능 휴대용 장치 |

| JP4832826B2 (ja) * | 2005-07-26 | 2011-12-07 | 任天堂株式会社 | オブジェクト制御プログラムおよび情報処理装置 |

| US7657849B2 (en) * | 2005-12-23 | 2010-02-02 | Apple Inc. | Unlocking a device by performing gestures on an unlock image |

| US8078990B2 (en) * | 2006-02-01 | 2011-12-13 | Research In Motion Limited | Secure device sharing |

| US8587526B2 (en) * | 2006-04-12 | 2013-11-19 | N-Trig Ltd. | Gesture recognition feedback for a dual mode digitizer |

| KR20070113022A (ko) * | 2006-05-24 | 2007-11-28 | 엘지전자 주식회사 | 사용자 입력에 반응하는 터치스크린 장치 및 이의 작동방법 |

| US7422145B2 (en) * | 2006-05-08 | 2008-09-09 | Nokia Corporation | Mobile communication terminal and method |

| US8375326B2 (en) * | 2006-05-30 | 2013-02-12 | Dell Products Lp. | Contextual-based and overlaid user interface elements |

| US8842074B2 (en) * | 2006-09-06 | 2014-09-23 | Apple Inc. | Portable electronic device performing similar operations for different gestures |

| JP2008140182A (ja) * | 2006-12-01 | 2008-06-19 | Sharp Corp | 入力装置、送受信システム、入力処理方法、および制御プログラム |

| KR100842733B1 (ko) * | 2007-02-05 | 2008-07-01 | 삼성전자주식회사 | 터치스크린을 구비한 멀티미디어 재생장치의 사용자인터페이스 방법 |

| US9772751B2 (en) * | 2007-06-29 | 2017-09-26 | Apple Inc. | Using gestures to slide between user interfaces |

| US20090227369A1 (en) * | 2008-03-10 | 2009-09-10 | Merit Entertainment | Amusement Device Having a Configurable Display for Presenting Games Having Different Aspect Ratios |

| US20110163972A1 (en) * | 2010-01-06 | 2011-07-07 | Freddy Allen Anzures | Device, Method, and Graphical User Interface for Interacting with a Digital Photo Frame |

-

2008

- 2008-09-09 US US12/206,747 patent/US20100064261A1/en not_active Abandoned

-

2009

- 2009-09-09 CN CN200980135963.XA patent/CN102150123B/zh not_active Expired - Fee Related

- 2009-09-09 KR KR1020117005120A patent/KR20110056286A/ko not_active Application Discontinuation

- 2009-09-09 WO PCT/US2009/056357 patent/WO2010030662A2/en active Application Filing

- 2009-09-09 JP JP2011526938A patent/JP2012502393A/ja active Pending

- 2009-09-09 EP EP09813532A patent/EP2327011A4/en not_active Withdrawn

- 2009-09-09 RU RU2011108470/08A patent/RU2011108470A/ru not_active Application Discontinuation

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2014017831A2 (ko) * | 2012-07-25 | 2014-01-30 | Park Chul | 터치패널을 갖는 개인휴대단말기의 작동방법 |

| WO2014017831A3 (ko) * | 2012-07-25 | 2014-03-13 | Park Chul | 터치패널을 갖는 개인휴대단말기의 작동방법 |

Also Published As

| Publication number | Publication date |

|---|---|

| CN102150123B (zh) | 2013-08-14 |

| CN102150123A (zh) | 2011-08-10 |

| WO2010030662A2 (en) | 2010-03-18 |

| RU2011108470A (ru) | 2012-09-10 |

| JP2012502393A (ja) | 2012-01-26 |

| EP2327011A4 (en) | 2012-02-01 |

| WO2010030662A3 (en) | 2010-05-06 |

| US20100064261A1 (en) | 2010-03-11 |

| EP2327011A2 (en) | 2011-06-01 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR20110056286A (ko) | 상대적 제스처 인식 모드를 갖는 휴대용 전자 장치 | |

| US11687170B2 (en) | Systems, methods, and media for providing an enhanced remote control having multiple modes | |

| US10656715B2 (en) | Systems and methods for a haptically-enabled projected user interface | |

| US6947062B2 (en) | Seamlessly combined freely moving cursor and jumping highlights navigation | |

| KR101151028B1 (ko) | 포인팅 디바이스가 구비된 단말장치 및 화면 제어 방법 | |

| KR101391602B1 (ko) | 터치 스크린 기반의 사용자 인터페이스 인터렉션 방법 및 멀티 미디어 단말 기기 | |

| US9448714B2 (en) | Touch and non touch based interaction of a user with a device | |

| US10282081B2 (en) | Input and output method in touch screen terminal and apparatus therefor | |

| US20110134032A1 (en) | Method for controlling touch control module and electronic device thereof | |

| EP2107448A2 (en) | Electronic apparatus and control method thereof | |

| US20130254714A1 (en) | Method and apparatus for providing floating user interface | |

| US20110087983A1 (en) | Mobile communication terminal having touch interface and touch interface method | |

| KR100950080B1 (ko) | 소프트웨어 기능들을 제어하는 방법, 전자 장치, 그리고컴퓨터 프로그램 제품 | |

| JP4922901B2 (ja) | 入力装置 | |

| US20140055385A1 (en) | Scaling of gesture based input | |

| JP2001142634A (ja) | 専用化した機能の領域を有するトラックパッドポインティング装置 | |

| JP2010211323A (ja) | 入力システム、携帯端末、入出力装置、入力システム制御プログラム、コンピュータ読み取り可能な記録媒体、および、入力システムの制御方法 | |

| CN110538460A (zh) | 移动装置 | |

| KR20140043920A (ko) | 터치 스크린 기반의 사용자 인터페이스 인터렉션 방법 및 멀티 미디어 단말 기기 | |

| KR20150022598A (ko) | 제스처 인식에 따른 기능 실행 방법, 장치 및 기록매체 | |

| WO2006100811A1 (ja) | 情報処理装置、画像移動指示方法及び情報記憶媒体 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| N231 | Notification of change of applicant | ||

| E902 | Notification of reason for refusal | ||

| E601 | Decision to refuse application |