WO2021241019A1 - 撮像素子および撮像装置 - Google Patents

撮像素子および撮像装置 Download PDFInfo

- Publication number

- WO2021241019A1 WO2021241019A1 PCT/JP2021/014716 JP2021014716W WO2021241019A1 WO 2021241019 A1 WO2021241019 A1 WO 2021241019A1 JP 2021014716 W JP2021014716 W JP 2021014716W WO 2021241019 A1 WO2021241019 A1 WO 2021241019A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- image pickup

- light

- pixel

- pickup device

- semiconductor substrate

- Prior art date

Links

- 238000003384 imaging method Methods 0.000 title abstract description 30

- 239000010410 layer Substances 0.000 claims abstract description 223

- 239000004065 semiconductor Substances 0.000 claims abstract description 81

- 239000000758 substrate Substances 0.000 claims abstract description 81

- 230000003287 optical effect Effects 0.000 claims abstract description 65

- 239000011229 interlayer Substances 0.000 claims abstract description 29

- 238000006243 chemical reaction Methods 0.000 claims abstract description 10

- 238000009792 diffusion process Methods 0.000 claims description 26

- 238000007667 floating Methods 0.000 claims description 26

- 230000003321 amplification Effects 0.000 claims description 19

- 238000003199 nucleic acid amplification method Methods 0.000 claims description 19

- 238000012546 transfer Methods 0.000 claims description 18

- 230000002093 peripheral effect Effects 0.000 claims description 10

- 239000011159 matrix material Substances 0.000 claims description 7

- 229910052751 metal Inorganic materials 0.000 claims description 7

- 239000002184 metal Substances 0.000 claims description 7

- 238000012986 modification Methods 0.000 description 69

- 230000004048 modification Effects 0.000 description 69

- 210000003128 head Anatomy 0.000 description 26

- 238000000034 method Methods 0.000 description 25

- 238000012545 processing Methods 0.000 description 24

- 238000001514 detection method Methods 0.000 description 23

- 238000004891 communication Methods 0.000 description 17

- 230000035945 sensitivity Effects 0.000 description 16

- 238000010586 diagram Methods 0.000 description 15

- 238000002674 endoscopic surgery Methods 0.000 description 10

- LIVNPJMFVYWSIS-UHFFFAOYSA-N silicon monoxide Chemical compound [Si-]#[O+] LIVNPJMFVYWSIS-UHFFFAOYSA-N 0.000 description 10

- 239000000463 material Substances 0.000 description 9

- 238000005516 engineering process Methods 0.000 description 8

- 230000006870 function Effects 0.000 description 8

- 210000001519 tissue Anatomy 0.000 description 8

- VYPSYNLAJGMNEJ-UHFFFAOYSA-N Silicium dioxide Chemical compound O=[Si]=O VYPSYNLAJGMNEJ-UHFFFAOYSA-N 0.000 description 7

- 230000005540 biological transmission Effects 0.000 description 6

- 238000012937 correction Methods 0.000 description 6

- 230000000694 effects Effects 0.000 description 6

- 229910052814 silicon oxide Inorganic materials 0.000 description 6

- 229910010272 inorganic material Inorganic materials 0.000 description 5

- 239000011147 inorganic material Substances 0.000 description 5

- 210000001747 pupil Anatomy 0.000 description 5

- 229910052721 tungsten Inorganic materials 0.000 description 5

- 229910052581 Si3N4 Inorganic materials 0.000 description 4

- XUIMIQQOPSSXEZ-UHFFFAOYSA-N Silicon Chemical compound [Si] XUIMIQQOPSSXEZ-UHFFFAOYSA-N 0.000 description 4

- 230000008859 change Effects 0.000 description 4

- 239000010949 copper Substances 0.000 description 4

- 230000005284 excitation Effects 0.000 description 4

- 230000007246 mechanism Effects 0.000 description 4

- 229910052710 silicon Inorganic materials 0.000 description 4

- 239000010703 silicon Substances 0.000 description 4

- HQVNEWCFYHHQES-UHFFFAOYSA-N silicon nitride Chemical compound N12[Si]34N5[Si]62N3[Si]51N64 HQVNEWCFYHHQES-UHFFFAOYSA-N 0.000 description 4

- 238000001356 surgical procedure Methods 0.000 description 4

- WFKWXMTUELFFGS-UHFFFAOYSA-N tungsten Chemical compound [W] WFKWXMTUELFFGS-UHFFFAOYSA-N 0.000 description 4

- 239000010937 tungsten Substances 0.000 description 4

- 230000015572 biosynthetic process Effects 0.000 description 3

- 238000010336 energy treatment Methods 0.000 description 3

- 239000011810 insulating material Substances 0.000 description 3

- 239000007769 metal material Substances 0.000 description 3

- 238000002156 mixing Methods 0.000 description 3

- 239000011241 protective layer Substances 0.000 description 3

- RYGMFSIKBFXOCR-UHFFFAOYSA-N Copper Chemical compound [Cu] RYGMFSIKBFXOCR-UHFFFAOYSA-N 0.000 description 2

- 208000005646 Pneumoperitoneum Diseases 0.000 description 2

- 230000009471 action Effects 0.000 description 2

- 229910052782 aluminium Inorganic materials 0.000 description 2

- XAGFODPZIPBFFR-UHFFFAOYSA-N aluminium Chemical compound [Al] XAGFODPZIPBFFR-UHFFFAOYSA-N 0.000 description 2

- 210000004204 blood vessel Anatomy 0.000 description 2

- 239000003153 chemical reaction reagent Substances 0.000 description 2

- 229910052802 copper Inorganic materials 0.000 description 2

- 238000013461 design Methods 0.000 description 2

- MOFVSTNWEDAEEK-UHFFFAOYSA-M indocyanine green Chemical compound [Na+].[O-]S(=O)(=O)CCCCN1C2=CC=C3C=CC=CC3=C2C(C)(C)C1=CC=CC=CC=CC1=[N+](CCCCS([O-])(=O)=O)C2=CC=C(C=CC=C3)C3=C2C1(C)C MOFVSTNWEDAEEK-UHFFFAOYSA-M 0.000 description 2

- 229960004657 indocyanine green Drugs 0.000 description 2

- 238000009434 installation Methods 0.000 description 2

- 230000001678 irradiating effect Effects 0.000 description 2

- 229910021420 polycrystalline silicon Inorganic materials 0.000 description 2

- 229920005591 polysilicon Polymers 0.000 description 2

- 230000008569 process Effects 0.000 description 2

- 239000011347 resin Substances 0.000 description 2

- 229920005989 resin Polymers 0.000 description 2

- 238000000926 separation method Methods 0.000 description 2

- 230000002194 synthesizing effect Effects 0.000 description 2

- OGIDPMRJRNCKJF-UHFFFAOYSA-N titanium oxide Inorganic materials [Ti]=O OGIDPMRJRNCKJF-UHFFFAOYSA-N 0.000 description 2

- 240000004050 Pentaglottis sempervirens Species 0.000 description 1

- 235000004522 Pentaglottis sempervirens Nutrition 0.000 description 1

- 206010034960 Photophobia Diseases 0.000 description 1

- GWEVSGVZZGPLCZ-UHFFFAOYSA-N Titan oxide Chemical compound O=[Ti]=O GWEVSGVZZGPLCZ-UHFFFAOYSA-N 0.000 description 1

- 230000003187 abdominal effect Effects 0.000 description 1

- 230000001133 acceleration Effects 0.000 description 1

- 230000000740 bleeding effect Effects 0.000 description 1

- 230000003139 buffering effect Effects 0.000 description 1

- 238000002485 combustion reaction Methods 0.000 description 1

- 230000000295 complement effect Effects 0.000 description 1

- 239000002131 composite material Substances 0.000 description 1

- 150000001875 compounds Chemical class 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- 238000005401 electroluminescence Methods 0.000 description 1

- 238000002073 fluorescence micrograph Methods 0.000 description 1

- 229910000449 hafnium oxide Inorganic materials 0.000 description 1

- WIHZLLGSGQNAGK-UHFFFAOYSA-N hafnium(4+);oxygen(2-) Chemical compound [O-2].[O-2].[Hf+4] WIHZLLGSGQNAGK-UHFFFAOYSA-N 0.000 description 1

- 230000006872 improvement Effects 0.000 description 1

- 238000010030 laminating Methods 0.000 description 1

- 230000031700 light absorption Effects 0.000 description 1

- 208000013469 light sensitivity Diseases 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- ORUIBWPALBXDOA-UHFFFAOYSA-L magnesium fluoride Chemical compound [F-].[F-].[Mg+2] ORUIBWPALBXDOA-UHFFFAOYSA-L 0.000 description 1

- 229910001635 magnesium fluoride Inorganic materials 0.000 description 1

- 238000012423 maintenance Methods 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 229910044991 metal oxide Inorganic materials 0.000 description 1

- 150000004706 metal oxides Chemical class 0.000 description 1

- 239000003595 mist Substances 0.000 description 1

- 230000000116 mitigating effect Effects 0.000 description 1

- 210000004400 mucous membrane Anatomy 0.000 description 1

- 239000002086 nanomaterial Substances 0.000 description 1

- 238000005121 nitriding Methods 0.000 description 1

- 239000013307 optical fiber Substances 0.000 description 1

- 238000001579 optical reflectometry Methods 0.000 description 1

- 239000011368 organic material Substances 0.000 description 1

- 230000001151 other effect Effects 0.000 description 1

- 230000003071 parasitic effect Effects 0.000 description 1

- 238000007639 printing Methods 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 238000007789 sealing Methods 0.000 description 1

- 239000002356 single layer Substances 0.000 description 1

- 238000009751 slip forming Methods 0.000 description 1

- 230000001629 suppression Effects 0.000 description 1

- 239000002344 surface layer Substances 0.000 description 1

- 230000002123 temporal effect Effects 0.000 description 1

- 150000003553 thiiranes Chemical class 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14603—Special geometry or disposition of pixel-elements, address-lines or gate-electrodes

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/1464—Back illuminated imager structures

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14609—Pixel-elements with integrated switching, control, storage or amplification elements

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14609—Pixel-elements with integrated switching, control, storage or amplification elements

- H01L27/14612—Pixel-elements with integrated switching, control, storage or amplification elements involving a transistor

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14625—Optical elements or arrangements associated with the device

- H01L27/14629—Reflectors

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14636—Interconnect structures

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14643—Photodiode arrays; MOS imagers

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N25/00—Circuitry of solid-state image sensors [SSIS]; Control thereof

- H04N25/50—Control of the SSIS exposure

- H04N25/57—Control of the dynamic range

- H04N25/59—Control of the dynamic range by controlling the amount of charge storable in the pixel, e.g. modification of the charge conversion ratio of the floating node capacitance

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N25/00—Circuitry of solid-state image sensors [SSIS]; Control thereof

- H04N25/70—SSIS architectures; Circuits associated therewith

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N25/00—Circuitry of solid-state image sensors [SSIS]; Control thereof

- H04N25/70—SSIS architectures; Circuits associated therewith

- H04N25/76—Addressed sensors, e.g. MOS or CMOS sensors

- H04N25/766—Addressed sensors, e.g. MOS or CMOS sensors comprising control or output lines used for a plurality of functions, e.g. for pixel output, driving, reset or power

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N25/00—Circuitry of solid-state image sensors [SSIS]; Control thereof

- H04N25/70—SSIS architectures; Circuits associated therewith

- H04N25/76—Addressed sensors, e.g. MOS or CMOS sensors

- H04N25/7795—Circuitry for generating timing or clock signals

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/1462—Coatings

- H01L27/14623—Optical shielding

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14625—Optical elements or arrangements associated with the device

- H01L27/14627—Microlenses

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14641—Electronic components shared by two or more pixel-elements, e.g. one amplifier shared by two pixel elements

Definitions

- the present disclosure relates to, for example, a back-illuminated image sensor and an image sensor provided with the image sensor.

- CMOS Complementary Metal Oxide Semiconductor

- the light transmitted without being absorbed by the light receiving part is reflected by the wiring layer (metal layer) provided below the light receiving part and is reflected by the light receiving part. May re-enter.

- the intensity of the reflected light is non-uniform for each pixel, optical color mixing occurs between adjacent pixels.

- Patent Document 1 an image quality is obtained by periodically providing a first reflector that is uniform for each pixel and a second reflector between adjacent pixels below the light receiving portion.

- a solid-state image sensor with an improved design is disclosed.

- the image pickup device is required to improve the image quality.

- the image pickup element as one embodiment of the present disclosure has a first surface as a light incident surface and a second surface opposite to the first surface, and a charge corresponding to the amount of received light is photoelectric for each pixel.

- the multilayer wiring layer provided on the second surface side of the semiconductor substrate, and the multilayer wiring layer in which a plurality of wiring layers are laminated between the interlayer insulating layers, and the multilayer wiring layer.

- a plurality of structures provided on the second surface of the semiconductor substrate and a region provided in the multilayer wiring layer where no structures are formed, with an interlayer insulating layer in between, with respect to the optical center of the pixel. It includes a light-reflecting layer that forms a substantially symmetric reflective region or a substantially symmetric non-reflective region.

- the image pickup device as one embodiment of the present disclosure includes the image pickup device of the above-mentioned embodiment of the present disclosure.

- a light reflecting layer is provided in the multilayer wiring layer provided on the second surface side having the above.

- the light reflecting layer forms a reflecting region substantially symmetric or a non-reflective region substantially symmetric with respect to the optical center of the pixel with the interlayer insulating layer in between.

- FIG. 6 is a schematic cross-sectional view of the image pickup device shown in FIG. It is sectional drawing of the general image sensor. It is sectional drawing which shows an example of the schematic structure of the image pickup device which concerns on the modification 8 of this disclosure.

- FIG. 19 It is a plane schematic diagram which shows an example of the structure of the concavo-convex structure shown in FIG. It is sectional drawing which shows the other example of the schematic structure of the image pickup device which concerns on the modification 8 of this disclosure. It is a schematic diagram which shows an example of the cross-sectional structure of the concavo-convex structure of the image pickup element shown in FIG. 19 and the like. It is sectional drawing which shows an example of the schematic structure of the image pickup device which concerns on the modification 9 of this disclosure. It is a figure explaining the light reflection direction in the light reflection control layer of the image pickup device shown in FIG. 23. It is sectional drawing which shows an example of the schematic structure of the image pickup device which concerns on the modification 10 of this disclosure.

- FIG. 25 It is a figure explaining the light reflection direction in the light reflection control layer of the image pickup device shown in FIG. 25. It is sectional drawing which shows an example of the schematic structure of the image pickup device which concerns on the modification 11 of this disclosure. It is a plane schematic diagram which shows the other example of the schematic structure of the image pickup device which concerns on the modification 11 of this disclosure. It is a figure which shows an example of the schematic structure of the image pickup system provided with the image pickup element which concerns on the said Embodiment and the modification 1-11. It is a figure which shows an example of the image pickup procedure in the image pickup system of FIG. It is a block diagram which shows an example of the schematic structure of a vehicle control system.

- Modification 1 (Example in which a light reflecting layer having an opening symmetrical with respect to the optical center is provided) 2-2.

- Modification 2 (Other examples of the shape of the light reflecting layer) 2-3.

- Modification 3 (Example of the formation position of the light reflecting layer in the peripheral portion) 2-4.

- Modification 4 (Other examples of the formation position of the light reflecting layer) 2-5.

- Modification 5 (Other examples of the formation position of the light reflecting layer) 2-6.

- Modification 6 (Example of an image sensor equipped with a charge holding unit) 2-7.

- Modification 7 (Example of an image sensor that shares a readout circuit between adjacent pixels) 2-8.

- Modification 8 (Example of providing an uneven structure on the surface of a semiconductor substrate) 2-9.

- Modification 9 (Example in which a light reflection control layer is further provided on the light reflection layer) 2-10.

- Modification 10 (another example of the light reflection control layer) 2-11.

- Modification 11 (another example of the light reflecting layer) 3.

- Application example 4. Application example

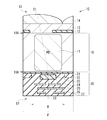

- FIG. 1 schematically shows an example of a cross-sectional configuration of an image pickup device (image pickup device 1) according to an embodiment of the present disclosure.

- FIG. 2 shows an example of the overall configuration of an image pickup device (imaging device 100) provided with the image pickup device 1 shown in FIG.

- the image pickup device 100 is, for example, a CMOS image sensor used in an electronic device such as a digital still camera or a video camera, and has a pixel portion 100A in which a plurality of pixels are two-dimensionally arranged in a matrix as an image pickup area. There is.

- the image pickup device 1 is a so-called back-illuminated image pickup device that constitutes one pixel (unit pixel P) in this CMOS image sensor or the like.

- the image pickup device 1 has a configuration in which a semiconductor substrate 10 in which a light receiving portion 11 is embedded and a multilayer wiring layer 20 having a plurality of wiring layers (for example, wiring layers 24, 25, 26) are laminated. ..

- the semiconductor substrate 10 has a first surface (front surface) 10A and a second surface (back surface) 10B facing each other.

- the multilayer wiring layer 20 is provided on the first surface 10A side of the semiconductor substrate 10, and the second surface 10B of the semiconductor substrate 10 is a light incident surface.

- the image pickup device 1 of the present embodiment has a light reflection layer 23 between the first surface 10A of the semiconductor substrate 10 and a plurality of wiring layers (wiring layers 24, 25, 26) provided in the multilayer wiring layer 20. Is provided.

- the light reflecting layer 23 is the optical of the unit pixel P in the region R in which the structure provided on the first surface 10A of the semiconductor substrate 10 is not formed in the multilayer wiring layer 20 with the interlayer insulating layer 27 in between. It forms a reflection region that is substantially symmetrical with respect to the center C1.

- the semiconductor substrate 10 corresponds to a specific example of the "semiconductor substrate” of the present disclosure

- the first surface 10A of the semiconductor substrate 10 is a specific example of the "second surface” of the present disclosure

- the second surface 10B is a specific example. It corresponds to a specific example of the "first aspect” of the present disclosure.

- the light reflecting layer 23 corresponds to a specific example of the "light reflecting layer” of the present disclosure.

- the semiconductor substrate 10 is composed of, for example, a silicon substrate. As described above, the light receiving portion 11 is embedded in the semiconductor substrate 10 for each unit pixel P, for example.

- the light receiving unit 11 is, for example, a PIN (Positive Intrinsic Negative) type photodiode PD, and has a pn junction in a predetermined region of the semiconductor substrate 10.

- PIN Positive Intrinsic Negative

- the first surface 10A of the semiconductor substrate 10 is provided with a floating diffusion FD and a pixel circuit that outputs a pixel signal based on the electric charge output from the light receiving unit 11.

- the pixel circuit has, for example, a transfer transistor TR, an amplification transistor AMP, a reset transistor RST, and a selection transistor SEL as pixel transistors.

- These floating diffusion FD, transfer transistor TR, amplification transistor AMP, reset transistor RST, and selection transistor SEL correspond to one specific example of the "structure" of the present disclosure.

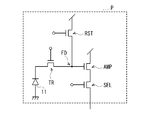

- FIG. 3 shows an example of the pixel circuit of the image pickup device 1 shown in FIG.

- the transfer transistor TR is connected between the light receiving unit 11 and the floating diffusion FD.

- a drive signal TGsig is applied to the gate electrode of the transfer transistor TR.

- this drive signal TGsig becomes active, the transfer gate of the transfer transistor TR becomes conductive, and the signal charge stored in the light receiving unit 11 is transferred to the floating diffusion FD via the transfer transistor TR.

- the floating diffusion FD is connected between the transfer transistor TR and the amplification transistor AMP.

- the floating diffusion FD converts the signal charge transferred by the transfer transistor TR into a voltage signal and outputs it to the amplification transistor AMP.

- the reset transistor RST is connected between the floating diffusion FD and the power supply unit.

- a drive signal RSTsig is applied to the gate electrode of the reset transistor RST.

- this drive signal RSTsig becomes active, the reset gate of the reset transistor RST becomes conductive, and the potential of the floating diffusion FD is reset to the level of the power supply unit.

- the gate electrode of the amplification transistor AMP is connected to the floating diffusion FD, and the drain electrode is connected to the power supply unit, which serves as an input unit for a voltage signal reading circuit held by the floating diffusion FD, a so-called source follower circuit. That is, the amplification transistor AMP constitutes a constant current source and a source follower circuit connected to one end of the vertical signal line Lsig by connecting its source electrode to the vertical signal line Lsig via the selection transistor SEL.

- the selection transistor SEL is connected between the source electrode of the amplification transistor AMP and the vertical signal line Lsig.

- a drive signal SELsig is applied to the gate electrode of the selection transistor SEL.

- the selection transistor SEL becomes a conduction state, and the unit pixel P becomes a selection state.

- the read signal (pixel signal) output from the amplification transistor AMP is output to the vertical signal line Lsig via the selection transistor SEL.

- the multilayer wiring layer 20 is provided on the first surface 10A side of the semiconductor substrate 10.

- the multilayer wiring layer 20 has, for example, an insulating layer 21, a gate wiring layer 22, and an interlayer insulating layer 27 in which the light reflecting layer 23 and a plurality of wiring layers 24, 25, 26 are provided in the layer. There is.

- the insulating layer 21 is provided on the first surface 10A of the semiconductor substrate 10, for example, as a gate insulating layer of a pixel transistor.

- Examples of the material of the insulating layer 21 include silicon oxide (SiO x ), silicon nitride (SiN x ), silicon oxynitride (SiO x N y ), and the like.

- the gate wiring layer 22 is provided with, for example, the above-mentioned transfer transistor TR, amplification transistor AMP, reset transistor RST, and gate electrodes of the selection transistor SEL.

- the gate wiring layer 22 is formed by using, for example, polysilicon (Poly-Si).

- the light reflecting layer 23 passes through the semiconductor substrate 10 without being absorbed by the light receiving unit 11, reflects the light incident on the multilayer wiring layer 20, and re-enters the semiconductor substrate 10.

- the light reflecting layer 23 is provided, for example, in the interlayer insulating layer 27 between the first surface 10A of the semiconductor substrate 10 and the wiring layer 24.

- the light reflection layer 23 has only the insulating layer 21 and the interlayer insulating layer 27 sandwiched between the insulating layer 21 and the interlayer insulating layer 27 with respect to the optical center C1 of the unit pixel P. It forms a substantially symmetric reflection area.

- the substantially symmetrical points for example, the width W A of the left and right with respect to optical center C1, the case is approximately equal W B (W A ⁇ W B ).

- the optical center C1 is an axis that passes through the lens center of the on-chip lens 14, which will be described later, and the center of the opening 12H of the light-shielding film 12.

- the light reflecting layer 23 can be formed by using a material having light reflecting property.

- the material having light reflectivity include metal materials such as tungsten (W), aluminum (Al) and copper (Cu).

- the light reflecting layer 23 is also formed by using, for example, a so-called dielectric multilayer film in which layers made of an inorganic material having a high refractive index and layers made of an inorganic material having a low refractive index are alternately laminated. be able to.

- Examples of the inorganic material having a high refractive index include titanium oxide (TiO x ) and hafnium oxide (HfO x ).

- the inorganic material having a low refractive index include silicon oxide (SiO x ) and magnesium fluoride (MgF x ).

- the wiring layers 24, 25, and 26 are for, for example, driving the light receiving unit 11, transmitting signals, and applying voltage to each unit.

- the wiring layers 24, 25, and 26 are laminated in the interlayer insulating layer 27 in the order of the wiring layers 24, 25, and 26 from the semiconductor substrate 10 side, with the interlayer insulating layers 27 interposed therebetween.

- the wiring layers 24, 25, and 26 are formed of, for example, copper (Cu) or aluminum (Al).

- the interlayer insulating layer 27 is provided on the insulating layer 21 so as to cover the gate wiring layer 22, and has the light reflecting layer 23 and the wiring layers 24, 25, 26 in the layer as described above. ..

- the interlayer insulating layer 27 is formed by using, for example, silicon oxide (SiO x ), silicon nitride (SiN x ), silicon nitriding (SiO x N y ), or the like.

- a light-shielding film 12, a protective layer 13, and an on-chip lens 14 are provided on the second surface 10B side of the semiconductor substrate 10.

- the light-shielding film 12 is for preventing the oblique light incident from the light incident side S1 from being incident on the adjacent unit pixels P.

- the light-shielding film 12 is provided between adjacent unit pixels P, for example, and has an opening 12H in the center of the unit pixels P.

- the light-shielding film 12 is formed of, for example, a metal film such as tungsten (W).

- the protective layer 13 includes, for example, a light-shielding film 12 in the layer to protect the second surface 10B of the semiconductor substrate 10 and to flatten the surface of the light incident side S1.

- the protective layer 13 is formed of, for example, silicon oxide (SiO x ), silicon nitride (SiN x ), silicon oxynitride (SiO x N y ), or the like.

- the on-chip lens 14 is for condensing the light incident from the light incident side S1 on the light receiving unit 11.

- the on-chip lens 14 is formed by using a high refractive index material, and specifically, is formed of an inorganic material such as silicon oxide (SiO x ) or silicon nitride (SiN x).

- an organic material having a high refractive index such as an episulfide resin, a thietan compound or the resin thereof may be used.

- the shape of the on-chip lens 14 is not particularly limited, and various lens shapes such as a hemispherical shape and a semi-cylindrical shape can be used. As shown in FIG. 1, the on-chip lens 14 may be provided for each unit pixel P, or for example, one on-chip lens may be provided for each of a plurality of unit pixels P.

- the image pickup apparatus 100 is, for example, a CMOS image sensor, which captures incident light (image light) from a subject via an optical lens system (not shown) and pixels the amount of incident light imaged on the image pickup surface. It is converted into an electric signal in units and output as a pixel signal.

- the image pickup apparatus 100 has a pixel portion 100A as an image pickup area on the semiconductor substrate 10, and in a peripheral region of the pixel portion 100A, for example, a vertical drive circuit 111, a column signal processing circuit 112, a horizontal drive circuit 113, and an output. It has a circuit 114, a control circuit 115, and an input / output terminal 116.

- the pixel unit 100A has, for example, a plurality of unit pixels P two-dimensionally arranged in a matrix.

- a pixel drive line Lread (specifically, a row selection line and a reset control line) is wired for each pixel row, and a vertical signal line Lsig is wired for each pixel column.

- the pixel drive line Lead transmits a drive signal for reading a signal from the pixel.

- One end of the pixel drive line Lead is connected to the output end corresponding to each line of the vertical drive circuit 111.

- the vertical drive circuit 111 is configured by a shift register, an address decoder, or the like, and is a pixel drive unit that drives each unit pixel P of the pixel unit 100A, for example, in row units.

- the signal output from each unit pixel P of the pixel row selectively scanned by the vertical drive circuit 111 is supplied to the column signal processing circuit 112 through each of the vertical signal lines Lsig.

- the column signal processing circuit 112 is composed of an amplifier, a horizontal selection switch, and the like provided for each vertical signal line Lsig.

- the horizontal drive circuit 113 is composed of a shift register, an address decoder, etc., and drives each horizontal selection switch of the column signal processing circuit 112 in order while scanning. By the selective scanning by the horizontal drive circuit 113, the signals of each pixel transmitted through each of the vertical signal lines Lsig are sequentially output to the horizontal signal line 121 and transmitted to the outside of the semiconductor substrate 10 through the horizontal signal line 121. ..

- the output circuit 114 processes signals and outputs the signals sequentially supplied from each of the column signal processing groups r112 via the horizontal signal line 121.

- the output circuit 114 may, for example, perform only buffering, or may perform black level adjustment, column variation correction, various digital signal processing, and the like.

- the circuit portion including the vertical drive circuit 111, the column signal processing circuit 112, the horizontal drive circuit 113, the horizontal signal line 121, and the output circuit 114 may be formed directly on the semiconductor substrate 10, or may be used as an external control IC. It may be arranged. Further, those circuit portions may be formed on another substrate connected by a cable or the like.

- the control circuit 115 receives a clock given from the outside of the semiconductor substrate 10, data instructing an operation mode, and the like, and outputs data such as internal information of the image pickup apparatus 100.

- the control circuit 115 further has a timing generator that generates various timing signals, and the vertical drive circuit 111, the column signal processing circuit 112, the horizontal drive circuit 113, and the like based on the various timing signals generated by the timing generator. It controls the drive of peripheral circuits.

- the input / output terminal 116 exchanges signals with the outside.

- the image sensor 1 is provided on the first surface 10A of the semiconductor substrate 10 in the multilayer wiring layer 20 provided on the first surface 10A side of the semiconductor substrate 10 opposite to the light incident side S1.

- the light reflecting layer 23 is provided in the region R where the gate electrode or the like of the pixel transistor is not formed.

- the light reflecting layer 23 forms a reflecting region substantially symmetrical with respect to the optical center C1 of the unit pixel P with the insulating layer 21 and the interlayer insulating layer 27 in between.

- the light transmitted through the semiconductor substrate 10, reflected by the light reflecting layer 23, and re-entered into the light receiving portion 11 becomes substantially uniform with respect to the incident angle. This will be described below.

- the back-illuminated CIS not all the light entering from the light incident surface is photoelectrically converted in the light receiving portion, and some light is transmitted through the semiconductor substrate and provided on the side opposite to the light incident surface of the semiconductor substrate. It is incident on the multi-layered wiring layer. At that time, if there is a reflective material ahead of the light incident on the multilayer wiring layer, the light is reflected again toward the light receiving portion, so that improvement in sensitivity and suppression of color mixing are expected.

- the reflective material is formed unbalanced with respect to the optical center in the region, the light reflected by the reflective material will also have asymmetry with respect to the optical center. As described above, when the light having asymmetry re-enters the light receiving portion, the sensitivity varies greatly in the incident direction of the light, and the image quality may deteriorate.

- the present embodiment it is provided on the first surface 10A of the semiconductor substrate 10 in the multilayer wiring layer 20 provided on the first surface 10A side of the semiconductor substrate 10 opposite to the light incident side S1.

- the light reflecting layer 23 is provided in the region R where the gate electrode or the like of the pixel transistor is not formed.

- the light reflecting layer 23 forms a reflecting region substantially symmetric with respect to the optical center C1 of the unit pixel P, and has a layout having symmetry with respect to the optical center C1. As a result, the light reflected by the light reflecting layer 23 and re-entering the light receiving unit 11 becomes substantially uniform with respect to the incident angle.

- the interlayer insulating layer 27 is formed in the region R in the multilayer wiring layer 20 in which a structure such as a gate electrode (gate wiring layer 22) constituting a pixel transistor is not formed. Since the light reflecting layer 23 forming a reflection region substantially symmetric with respect to the optical center C1 of the unit pixel P is provided in between, the light is not absorbed by the light receiving unit 11 and is incident on the multilayer wiring layer 20 to emit light. The light reflected by the reflecting layer 23 and re-incidented on the light receiving portion 11 becomes substantially uniform with respect to the incident angle. As a result, the variation in sensitivity within each unit pixel P is improved, and the shading shape has a peak at the center of the angle of view. Therefore, it is possible to improve the image quality.

- a structure such as a gate electrode (gate wiring layer 22) constituting a pixel transistor

- the optical of the unit pixel P is obtained by providing the light reflecting layer 23 between the first surface 10A of the semiconductor substrate 10 and the plurality of wiring layers 24 formed in the multilayer wiring layer 20.

- An example of forming a reflection region substantially symmetric with respect to the center C1 is shown, and this reflection region is formed by any of the wiring layers 24, 25, and 26 formed by laminating the interlayer insulating layer 27 in between. May be good.

- the wiring layer 24 is substantially relative to the optical center C1 of the unit pixel P.

- the wiring layer 24 can be used as a light reflecting layer.

- the contact 24C may be formed to connect the gate wiring layer 22 and the wiring layer 24 serving as the light reflection layer.

- the contact 24C is provided in an annular shape so as to surround the region R.

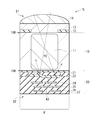

- FIG. 5 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1A) according to the modification 1 of the present disclosure.

- the light reflection layer 23 forming a reflection region substantially symmetrical with respect to the optical center C1 of the unit pixel P is provided, but the shape of the light reflection layer 23 is limited to this. is not it.

- the point that the light reflecting layer 33 forming a non-reflective region substantially symmetrical with respect to the optical center C1 of the unit pixel P is provided is different from the above-described embodiment.

- the light reflecting layer 33 is provided over the entire surface of the unit pixel P, for example, and has an opening 33H substantially symmetrical with respect to the optical center C1 of the unit pixel P.

- the opening 33H forms a non-reflective region substantially symmetrical with respect to the optical center C1.

- the light reflection layer 33 is formed from a region R in which structures such as a floating diffusion FD, a transfer transistor TR, an amplification transistor AMP, a reset transistor RST, and a selection transistor SEL are not formed. For example, it extends below the gate electrode of the pixel transistor.

- the substantially symmetrical points for example, the width W C of the left and right sides of the opening 33H for optical centers C1, W D is substantially equal to the case (W C ⁇ W D).

- the light reflecting layer 33 provided over the entire surface of the unit pixel P and having the opening 33H substantially symmetrical with respect to the optical center C1 of the unit pixel P is provided, so that the structure is provided.

- a non-reflective region substantially symmetric with respect to the optical center C1 is formed.

- the light that is not absorbed by the light receiving unit 11 but is incident on the multilayer wiring layer 20 and is reflected by the light reflecting layer 23 and re-incidented on the light receiving unit 11 becomes substantially uniform with respect to the incident angle.

- the variation in sensitivity within each unit pixel P is improved, and the shading shape has a peak at the center of the angle of view. Therefore, it is possible to improve the image quality.

- FIG. 6 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1B) according to the second modification of the present disclosure.

- the light reflecting layer 23 may form a reflection region substantially symmetric with respect to the optical center C1 of the unit pixel P with the interlayer insulating layer 27 in between, and the optical center may be formed.

- width W a of the left and right with respect to C1 if W B is met W a ⁇ W B, for example, as shown in FIG. 6, a portion of the light reflecting layer 23 extends under the gate wiring layer 22 May be.

- FIG. 7 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1C) according to the third modification of the present disclosure.

- the image pickup device 1C constitutes, for example, the unit pixel P in the vicinity of the peripheral edge portion when the pupil correction is applied to the unit pixel in the vicinity of the peripheral edge portion of the pixel portion 100A in the image pickup apparatus 100 shown in FIG.

- the center of the lens of the on-chip lens 14 and the center of the opening 12H of the light-shielding film 12 are in a predetermined direction (for example, the center direction of the pixel portion 100A). It is formed at the position shifted to.

- the light reflecting layer 23 it is preferable to form the light reflecting layer 23 by shifting it in a direction opposite to the shift direction of the opening 12H of the light-shielding film 12 according to the pupil correction amount.

- the light reflecting layer 33 having the opening 33H in the direction opposite to the shift direction of the opening 12H of the light shielding film 12 according to the pupil correction amount is provided. It may be provided. As a result, the variation in sensitivity within the unit pixel P provided in the vicinity of the peripheral edge portion due to the application of the pupil correction is reduced. Therefore, it is possible to improve the image quality.

- FIG. 9 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1D) according to the modified example 4 of the present disclosure.

- the structure (gate wiring layer 22) provided on the first surface 10A of the semiconductor substrate 10 is formed symmetrically with respect to the optical center C1, but will be described later, for example.

- the structure of the optical center C1 and the first surface 10A of the semiconductor substrate 10 is not formed.

- the center C2 of the region R may deviate from the center C2.

- the balance of sensitivity can be adjusted by covering the region where the sensitivity may decrease with the light reflecting layer 23. More specifically, as shown for example in FIG. 9, for example, it may be provided a light reflecting layer 23 where the width W A of the left and right with respect to optical center C1, the W B becomes W A> W B. Alternatively, for example, as shown in FIG. 10, for example, it may be provided a light reflecting layer 33 that the width W C of the left and right of the opening 33H, W D is W C ⁇ W D with respect to the optical center C1. As a result, the variation in sensitivity within the unit pixel P is reduced. Therefore, it is possible to improve the image quality.

- FIG. 11 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1E) according to the modified example 5 of the present disclosure.

- the image pickup device image pickup device 1E

- the light reflecting layer 23 is selectively formed in the region where the sensitivity is low, as shown in FIG. You may do it.

- the variation in sensitivity within the unit pixel P is reduced. Therefore, it is possible to improve the image quality.

- FIG. 12 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1F) according to the modification 6 of the present disclosure.

- the image sensor 1F of this modification realizes a so-called global shutter type back-illuminated CIS having, for example, a charge holding unit 15 that temporarily stores the charges generated in the light receiving unit 11 in the unit pixel P. Is.

- the global shutter method is basically a method of performing global exposure that starts exposure for all pixels at the same time and ends exposure for all pixels at the same time.

- all the pixels mean all the pixels of the portion appearing in the image, and the dummy pixels and the like are excluded.

- the global shutter method also includes a method of performing global exposure not only to all the pixels of the portion appearing in the image but also to the pixels in a predetermined region.

- FIG. 13 schematically shows an example of a specific planar configuration of the image pickup device 1F shown in FIG.

- FIG. 14 schematically shows the cross-sectional configuration of the image pickup device 1F in the I-I line shown in FIG.

- the image pickup element 1F has, as a pixel transistor, a conversion efficiency switching transistor OFG that initializes the PD, that is, resets it, in addition to the transfer transistor TR, the amplification transistor AMP, the reset transistor RST, and the selection transistor SEL. Further, for example, an element separation portion 16 is continuously formed at both ends of each gate electrode of the amplification transistor AMP, the reset transistor RST, and the selection transistor SEL and at the peripheral edge of the unit pixel P.

- the charge holding unit (MEM) 15 temporarily holds the charge generated in the light receiving unit 11 until it is transferred to the floating diffusion FD.

- the charge holding portion 15 is, for example, embedded and formed on the first surface 10A side of the semiconductor substrate 10 in the same manner as the light receiving portion 11.

- the conversion efficiency switching transistor OFG resets the PD according to the drive signal applied to the gate electrode, and has, for example, a drain connected to the power supply line VDD and a source connected to the transfer transistor TR. ing.

- the floating diffusion FD, the amplification transistor AMP, the reset transistor RST, and the selection transistor SEL are arranged in parallel along one side of the unit pixel P.

- the charge holding unit 15 is formed in the vicinity of the floating diffusion FD, for example, and the transfer transistor TR is arranged between the floating diffusion FD and the charge holding unit 15.

- the conversion efficiency switching transistor OFG is arranged on one side facing the other side in which the floating diffusion FD, the amplification transistor AMP, the reset transistor RST, and the selection transistor SEL are arranged in parallel.

- the light receiving unit 11 is formed between a floating diffusion FD, an amplification transistor AMP, a reset transistor RST, and a selection transistor SEL arranged in parallel, and a conversion efficiency switching transistor OFG.

- the light reflecting layer 23 forms a reflecting region substantially symmetrical with respect to the optical center C1 of the unit pixel P below the light receiving unit 11 as in the above embodiment.

- the light reflecting layer 23 further extends so as to cover the charge holding portion 15 in a plan view from the wiring layer side S2 side. This makes it possible to reduce the leakage of light into the charge holding unit 15, which causes a false signal (Parasitic Light Sensitivity).

- FIG. 15 schematically shows an example of a planar configuration of a non-global shutter type image sensor 1G such as the image sensor 1 that shares one pixel transistor between two adjacent unit pixels P. be.

- FIG. 16 schematically shows an example of a planar configuration of a global shutter type image sensor 1H such as the image sensor 1F that shares one pixel transistor between two adjacent unit pixels P (P1, P2). It is a representation.

- FIG. 17 schematically shows the cross-sectional configuration of the image pickup device 1H in the line II-II shown in FIG.

- the light reflection layer 23 has a mirror-symmetrical shape between adjacent unit pixels P, respectively.

- the charge holding unit MEM

- a light-shielding film is provided to suppress light leakage.

- This light-shielding film is formed of, for example, tungsten (W) and extends to the light receiving portion.

- the light-shielding film (light-shielding film 1023) has an asymmetric layout with respect to the optical center C1 including the light-receiving portion 1011.

- the width W A and the width W of the left and right of the light-shielding film 1023 with respect to the optical center C1 B and the width W A 'and width W B ' are each, for example, W a ⁇ W B, W a ' has a ⁇ W B '. Therefore, among a plurality of pixels arranged two-dimensionally in a matrix in the pixel portion, for example, an odd-numbered pixel in the row direction (for example, the unit pixel P1 in FIG. 17) and an even-numbered pixel (for example, the unit in FIG. 17). There is a variation (strength) in sensitivity between the pixel P2) and the pixel P2), which appears as vertical stripes. In addition, shading peak shift occurs in each pixel.

- the light reflection layer 23 forming a substantially symmetric reflection region is provided with respect to the optical center C1 including the light receiving portions 11 of the adjacent unit pixels P1 and P2, respectively.

- the light reflected by the light reflecting layer 23 and re-incidented into the respective light receiving portions 11 becomes substantially uniform with respect to the incident angle. Therefore, the shading shapes in the unit pixels P1 and P2 have peaks at the center of the angle of view of each other. Therefore, among the plurality of pixels two-dimensionally arranged in a matrix described above, for example, the variation in sensitivity between the odd-numbered pixel and the even-numbered pixel in the row direction is reduced. Therefore, it is possible to improve the image quality.

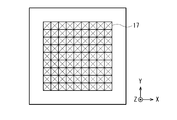

- FIG. 19 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1I) according to the modified example 8 of the present disclosure.

- the image pickup device 1I of this modification is different from the above-described embodiment in that the concave-convex structure 17 is provided on the first surface 10A of the semiconductor substrate 10.

- the uneven structure 17 is formed in a region R where the structure of the first surface 10A of the semiconductor substrate 10 is not formed, for example, a plurality of formed in a matrix and formed by digging in a pyramid shape. This digging is embedded, for example, by a silicon oxide (SiO x ) film 17A (see, for example, FIG. 22).

- SiO x silicon oxide

- the first surface 10A of the semiconductor substrate 10 may be formed with a concave digging substantially symmetrical with respect to the optical center C1, as shown in FIG. 21, for example.

- This concave digging is embedded by , for example, a SiO x film 17A, similar to the uneven structure 17 shown in FIG. 19 and the like.

- the light incident from the second surface 10B of the semiconductor substrate 10 and transmitted through the light receiving unit 11 is reflected toward the light receiving unit 11.

- a reflective film 17B made of a metal film or the like may be provided on the surface of the semiconductor substrate 10 on which the uneven structure 17 is formed. This improves the light reflectance on the surface of the concave-convex structure 17.

- the concave-convex structure 17 is provided on the first surface 10A of the semiconductor substrate 10, the variation in sensitivity within the unit pixel P is improved, and the shading shape has a peak in the center of the angle of view. It will be like. Further, as shown in the modification 7, the variation in sensitivity between the odd-numbered pixel and the even-numbered pixel in the image pickup element sharing one pixel transistor between two adjacent unit pixels P is reduced. .. Therefore, it is possible to improve the image quality.

- FIG. 23 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1J) according to the modification 9 of the present disclosure.

- the image pickup device 1J of this modification is different from the above embodiment in that the light reflection control layers 28A and 28B having different refractive indexes are provided on the light reflection layer 23 formed in the above embodiment and the like.

- the light reflection control layer 28 (28A, 28B) can be formed, for example, by using a metamaterial composed of a single-layer film or a multilayer film using a nanostructure of a metal or a dielectric.

- FIG. 25 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1K) according to the modified example 10 of the present disclosure.

- the light reflection control layer 28 is formed using a metamaterial, but the light reflection control layer 28 is formed, for example, by using a metal lens having a different refractive index in the plane. May be good.

- This makes it possible to control the light reflection direction on the surface of the light reflection layer 23, for example, as shown in FIGS. 25 and 26. Therefore, similarly to the above-mentioned modification 9, in addition to the effect of the above-described embodiment, it is possible to further improve the image quality.

- FIG. 27 schematically shows an example of the cross-sectional configuration of the image pickup device (image pickup device 1L) according to the modification 11 of the present disclosure.

- FIG. 28 schematically shows another example of the cross-sectional configuration of the image pickup device 1L according to the modified example 11 of the present disclosure.

- the image pickup element 1L of the present modification for example, a structure such as a gate electrode of a pixel transistor is formed in the multilayer wiring layer 20 provided on the first surface 10A side of the semiconductor substrate 10, as in the above embodiment.

- a light reflecting layer 43 is provided in the non-existing region R, and the surface of the semiconductor substrate 10 facing the first surface 10A is substantially symmetric or asymmetric with respect to the optical center C1 as shown in FIGS. 27 and 28, for example. It differs from the above-described embodiment in that an uneven structure and a step are provided.

- the light reflecting layer 23 is formed by using a metal material such as tungsten (W) or a dielectric multilayer film

- the light reflecting layer 43 constitutes the interlayer insulating layer 27. It may be formed by using an insulating material having a refractive index different from that of the insulating material. Even in the light reflecting layer 43 formed by using the insulating material, it is possible to control the light reflecting direction on the surface thereof.

- FIG. 29 shows an example of a schematic configuration of an image pickup system 2 provided with an image pickup device (for example, an image pickup device 1) according to the above-described embodiment and modifications 1 to 11.

- an image pickup device for example, an image pickup device 1

- the image pickup system 2 is, for example, an image pickup device such as a digital still camera or a video camera, or an electronic device such as a mobile terminal device such as a smartphone or a tablet terminal.

- the image pickup system 2 includes, for example, an image pickup element 1, an optical system 241, a shutter device 242, a DSP circuit 243, a frame memory 244, a display unit 245, a storage unit 246, an operation unit 247, and a power supply unit 248.

- the image pickup element 1, the DSP circuit 243, the frame memory 244, the display unit 245, the storage unit 246, the operation unit 247, and the power supply unit 248 are connected to each other via a bus line 249.

- the image sensor 1 outputs image data according to the incident light.

- the optical system 241 is configured to have one or a plurality of lenses, and guides light (incident light) from a subject to an image pickup element 1 to form an image on a light receiving surface of the image pickup element 1.

- the shutter device 242 is arranged between the optical system 241 and the image pickup element 1, and controls the light irradiation period and the light shielding period to the image pickup element 1 according to the control of the drive circuit.

- the DSP circuit 243 is a signal processing circuit that processes a signal (image data) output from the image sensor 1.

- the frame memory 244 temporarily holds the image data processed by the DSP circuit 243 in frame units.

- the display unit 245 comprises a panel-type display device such as a liquid crystal panel or an organic EL (ElectroLuminescence) panel, and displays a moving image or a still image captured by the image pickup device 1.

- the storage unit 246 records image data of a moving image or a still image captured by the image pickup device 1 on a recording medium such as a semiconductor memory or a hard disk.

- the operation unit 247 issues operation commands for various functions of the image pickup system 2 according to the operation by the user.

- the power supply unit 248 appropriately supplies various power sources that serve as operating power sources for the image pickup element 1, the DSP circuit 243, the frame memory 244, the display unit 245, the storage unit 246, and the operation unit 247.

- FIG. 30 shows an example of a flowchart of an imaging operation in the imaging system 2.

- the user instructs the start of imaging by operating the operation unit 247 (step S101).

- the operation unit 247 transmits an image pickup command to the image pickup element 1 (step S102).

- the image pickup element 1 (specifically, the system control circuit) executes an image pickup by a predetermined image pickup method (step S103).

- the image sensor 1 outputs the image data obtained by the image pickup to the DSP circuit 243.

- the image data is data for all pixels of the pixel signal generated based on the electric charge temporarily held in the floating diffusion FD.

- the DSP circuit 243 performs predetermined signal processing (for example, noise reduction processing) based on the image data input from the image sensor 1 (step S104).

- the DSP circuit 243 stores the image data to which the predetermined signal processing has been performed in the frame memory 244, and the frame memory 244 stores the image data in the storage unit 246 (step S105). In this way, the image pickup in the image pickup system 2 is performed.

- the image pickup devices 1, 1A to 1F according to the above-described embodiment and modifications 1 to 6 are applied to the image pickup system 2.

- the image sensor 1 can be miniaturized or high-definition, so that a small-sized or high-definition image pickup system 2 can be provided.

- the technology according to the present disclosure can be applied to various products.

- the technology according to the present disclosure is realized as a device mounted on a moving body of any kind such as an automobile, an electric vehicle, a hybrid electric vehicle, a motorcycle, a bicycle, a personal mobility, an airplane, a drone, a ship, and a robot. You may.

- FIG. 31 is a block diagram showing a schematic configuration example of a vehicle control system, which is an example of a mobile control system to which the technique according to the present disclosure can be applied.

- the vehicle control system 12000 includes a plurality of electronic control units connected via the communication network 12001.

- the vehicle control system 12000 includes a drive system control unit 12010, a body system control unit 12020, an outside information detection unit 12030, an in-vehicle information detection unit 12040, and an integrated control unit 12050.

- a microcomputer 12051, an audio image output unit 12052, and an in-vehicle network I / F (interface) 12053 are shown as a functional configuration of the integrated control unit 12050.

- the drive system control unit 12010 controls the operation of the device related to the drive system of the vehicle according to various programs.

- the drive system control unit 12010 has a driving force generator for generating the driving force of the vehicle such as an internal combustion engine or a driving motor, a driving force transmission mechanism for transmitting the driving force to the wheels, and a steering angle of the vehicle. It functions as a control device such as a steering mechanism for adjusting and a braking device for generating braking force of the vehicle.

- the body system control unit 12020 controls the operation of various devices mounted on the vehicle body according to various programs.

- the body system control unit 12020 functions as a keyless entry system, a smart key system, a power window device, or a control device for various lamps such as headlamps, back lamps, brake lamps, turn signals or fog lamps.

- the body system control unit 12020 may be input with radio waves transmitted from a portable device that substitutes for the key or signals of various switches.

- the body system control unit 12020 receives inputs of these radio waves or signals and controls a vehicle door lock device, a power window device, a lamp, and the like.

- the outside information detection unit 12030 detects information outside the vehicle equipped with the vehicle control system 12000.

- the image pickup unit 12031 is connected to the vehicle outside information detection unit 12030.

- the vehicle outside information detection unit 12030 causes the image pickup unit 12031 to capture an image of the outside of the vehicle and receives the captured image.

- the vehicle outside information detection unit 12030 may perform object detection processing or distance detection processing such as a person, a vehicle, an obstacle, a sign, or a character on the road surface based on the received image.

- the image pickup unit 12031 is an optical sensor that receives light and outputs an electric signal according to the amount of the light received.

- the image pickup unit 12031 can output an electric signal as an image or can output it as distance measurement information. Further, the light received by the image pickup unit 12031 may be visible light or invisible light such as infrared light.

- the in-vehicle information detection unit 12040 detects the in-vehicle information.

- a driver state detection unit 12041 that detects the state of the driver is connected to the in-vehicle information detection unit 12040.

- the driver state detection unit 12041 includes, for example, a camera that images the driver, and the in-vehicle information detection unit 12040 determines the degree of fatigue or concentration of the driver based on the detection information input from the driver state detection unit 12041. It may be calculated, or it may be determined whether the driver has fallen asleep.

- the microcomputer 12051 calculates the control target value of the driving force generator, the steering mechanism, or the braking device based on the information inside and outside the vehicle acquired by the vehicle exterior information detection unit 12030 or the vehicle interior information detection unit 12040, and the drive system control unit.

- a control command can be output to 12010.

- the microcomputer 12051 realizes ADAS (Advanced Driver Assistance System) functions including vehicle collision avoidance or impact mitigation, follow-up driving based on inter-vehicle distance, vehicle speed maintenance driving, vehicle collision warning, vehicle lane deviation warning, and the like. It is possible to perform cooperative control for the purpose of.

- ADAS Advanced Driver Assistance System

- the microcomputer 12051 controls the driving force generating device, the steering mechanism, the braking device, and the like based on the information around the vehicle acquired by the vehicle exterior information detection unit 12030 or the vehicle interior information detection unit 12040. It is possible to perform coordinated control for the purpose of automatic driving that runs autonomously without depending on the operation.

- the microcomputer 12051 can output a control command to the body system control unit 12020 based on the information outside the vehicle acquired by the vehicle outside information detection unit 12030.

- the microcomputer 12051 controls the headlamps according to the position of the preceding vehicle or the oncoming vehicle detected by the outside information detection unit 12030, and performs cooperative control for the purpose of anti-glare such as switching the high beam to the low beam. It can be carried out.

- the audio image output unit 12052 transmits an output signal of at least one of audio and an image to an output device capable of visually or audibly notifying information to the passenger or the outside of the vehicle.

- an audio speaker 12061, a display unit 12062, and an instrument panel 12063 are exemplified as output devices.

- the display unit 12062 may include, for example, at least one of an onboard display and a head-up display.

- FIG. 32 is a diagram showing an example of the installation position of the image pickup unit 12031.

- the vehicle 12100 has an imaging unit 12101, 12102, 12103, 12104, 12105 as an imaging unit 12031.

- the image pickup units 12101, 12102, 12103, 12104, 12105 are provided, for example, at positions such as the front nose, side mirrors, rear bumpers, back doors, and the upper part of the windshield in the vehicle interior of the vehicle 12100.

- the image pickup unit 12101 provided in the front nose and the image pickup section 12105 provided in the upper part of the windshield in the vehicle interior mainly acquire an image in front of the vehicle 12100.

- the image pickup units 12102 and 12103 provided in the side mirror mainly acquire images of the side of the vehicle 12100.

- the image pickup unit 12104 provided in the rear bumper or the back door mainly acquires an image of the rear of the vehicle 12100.

- the images in front acquired by the image pickup units 12101 and 12105 are mainly used for detecting a preceding vehicle, a pedestrian, an obstacle, a traffic light, a traffic sign, a lane, or the like.

- FIG. 32 shows an example of the shooting range of the imaging units 12101 to 12104.

- the imaging range 12111 indicates the imaging range of the imaging unit 12101 provided on the front nose

- the imaging ranges 12112 and 12113 indicate the imaging range of the imaging units 12102 and 12103 provided on the side mirrors, respectively

- the imaging range 12114 indicates the imaging range.

- the imaging range of the imaging unit 12104 provided on the rear bumper or the back door is shown. For example, by superimposing the image data captured by the image pickup units 12101 to 12104, a bird's-eye view image of the vehicle 12100 can be obtained.

- At least one of the image pickup units 12101 to 12104 may have a function of acquiring distance information.

- at least one of the image pickup units 12101 to 12104 may be a stereo camera including a plurality of image pickup elements, or may be an image pickup element having pixels for phase difference detection.

- the microcomputer 12051 has a distance to each three-dimensional object in the image pickup range 12111 to 12114 based on the distance information obtained from the image pickup unit 12101 to 12104, and a temporal change of this distance (relative speed with respect to the vehicle 12100). By obtaining can. Further, the microcomputer 12051 can set an inter-vehicle distance to be secured in advance in front of the preceding vehicle, and can perform automatic brake control (including follow-up stop control), automatic acceleration control (including follow-up start control), and the like. In this way, it is possible to perform coordinated control for the purpose of automatic driving or the like in which the vehicle travels autonomously without depending on the operation of the driver.

- automatic brake control including follow-up stop control

- automatic acceleration control including follow-up start control

- the microcomputer 12051 converts three-dimensional object data related to a three-dimensional object into two-wheeled vehicles, ordinary vehicles, large vehicles, pedestrians, electric poles, and other three-dimensional objects based on the distance information obtained from the image pickup units 12101 to 12104. It can be classified and extracted and used for automatic avoidance of obstacles. For example, the microcomputer 12051 distinguishes obstacles around the vehicle 12100 into obstacles that are visible to the driver of the vehicle 12100 and obstacles that are difficult to see. Then, the microcomputer 12051 determines the collision risk indicating the risk of collision with each obstacle, and when the collision risk is equal to or higher than the set value and there is a possibility of collision, the microcomputer 12051 via the audio speaker 12061 or the display unit 12062. By outputting an alarm to the driver and performing forced deceleration and avoidance steering via the drive system control unit 12010, driving support for collision avoidance can be provided.

- At least one of the image pickup units 12101 to 12104 may be an infrared camera that detects infrared rays.

- the microcomputer 12051 can recognize a pedestrian by determining whether or not a pedestrian is present in the captured image of the imaging unit 12101 to 12104.