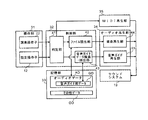

図1は、本発明の実施例による電子楽器100のハードウェア構成の一例を表すブロック図である。

電子楽器(電子音楽装置)100のバス6には、RAM7、ROM8、CPU9、検出回路11、表示回路13、記憶装置15、音源回路18、通信インターフェイス(I/F)21が接続される。

RAM7は、再生バッファ等のバッファ領域、フラグ、レジスタ、各種パラメータ等を記憶するCPU9のワーキングエリアを有する。

ROM8には、波形データや自動演奏データ、自動伴奏データ(伴奏スタイルデータ)などの各種データファイル、各種パラメータ及び制御プログラム、又は本実施例を実現するためのプログラムや、図4に示す対応テーブル等を記憶する。

CPU9は、ROM8又は、記憶装置15に記憶されている制御プログラム又は本実施例を実現するためのプログラム等に従い、演算又は装置の制御を行う。タイマ10が、CPU9に接続されており、基本クロック信号、割り込み処理タイミング等がCPU9に供給される。

ユーザーは、検出回路11に接続される設定操作子12を用いて、各種入力及び設定、選択をすることができる。設定操作子12は、例えば、スイッチ、パッド、フェーダー、スライダ、ロータリーエンコーダ、ジョイスティック、ジョグシャトル、文字入力用キーボード、マウス等、ユーザーの入力に応じた信号を出力できるものならどのようなものでもよい。また、設定操作子12は、カーソルスイッチ等の他の操作子を用いて操作するディスプレイ14上に表示されるソフトスイッチ等でもよい。なお、本実施例では、機能選択手段(設定操作子12)として、本体パネル上に配置される物理スイッチに加えて、タッチパネルを使用している。

タッチパネルは、ディスプレイ14表面に設けられるタッチパネル操作面に対するユーザーの押下操作を検出し、被操作位置の位置情報(例えば、xy座標)を出力する操作子である。本実施例では、このタッチパネルを設定操作子12として用い、該タッチパネルから出力される位置情報と電子楽器100が実行するコマンドが関連付けられている。なお、位置情報とコマンドの関連付けは、ディスプレイ14に表示される情報に合わせてその都度変化する。なお、本実施例では、タッチ操作面及びディスプレイ14の表示をあわせてタッチパネルと呼ぶ。

表示回路13は、ディスプレイ14に接続され、各種情報をディスプレイ14に表示することができる。ディスプレイ14は、電子楽器100の設定のための各種情報等を表示することができる。

記憶装置15は、ハードディスク、FD(フレキシブルディスク又はフロッピーディスク(登録商標))、CD(コンパクトディスク)、DVD(デジタル多目的ディスク)、フラッシュメモリ等の半導体メモリ等の記録媒体とその駆動装置の組み合わせの少なくとも1つで構成される。記録媒体は、音声ガイド用データを追加するために、ユーザーによる書き換えが可能な領域を有しており、着脱可能であることが好ましい。記憶装置15には、電子楽器100の製造者やサードパーティから提供される又はユーザーが自作する音声ガイド用データGD(図2)、オーディオデータAD(図2)、好ましくは複数の自動演奏データ及び自動伴奏データ(伴奏スタイルデータ)を含むその他データOD(図2)等を記憶する。

音源回路18は、例えば、記憶装置15、ROM8又はRAM7等に記録された音声ガイド用データGD、オーディオデータAD、自動伴奏データ、自動演奏データ又は演奏操作子(鍵盤)22あるいは通信インターフェイス21に接続された外部機器等から供給される演奏信号、MIDI信号、フレーズ波形データ等に応じて楽音信号を生成し、各種音楽的効果を付加して、DAC20を介して、サウンドシステム19に供給する。DAC20は、供給されるデジタル形式の楽音信号をアナログ形式に変換し、サウンドシステム19は、アンプ、スピーカを含み、DA変換された楽音信号を発音する。

通信インターフェイス21は、USBやIEEE1394等の汎用近距離有線I/F、Ethernet(登録商標)等の汎用ネットワークI/F等の通信インターフェイス、MIDI I/Fなどの汎用I/F、無線LANやBluetooth(登録商標)等の汎用近距離無線I/F等の通信インターフェイス及び音楽専用無線通信インターフェイスのうち少なくとも1つで構成され、外部機器、サーバー等との通信が可能である。

演奏操作子(鍵盤等)22は、検出回路11に接続され、ユーザーの演奏動作に従い、演奏情報(演奏データ)を供給する。演奏操作子22は、ユーザーの演奏を入力するための操作子であり、ユーザーが操作した操作子に対応する音高で、該ユーザーの操作子に対する操作開始タイミング及び終了タイミングをそれぞれキーオン及びキーオフ信号として入力する。また、ユーザーの演奏操作に応じてベロシティ値等の各種パラメータを入力することが可能である。

なお、本実施例による電子楽器が鍵盤などの演奏操作子を待たない形態、例えば、音源装置等である場合には、演奏操作子22は省略することも可能である。その場合、通信インターフェイス21に外部演奏操作子を接続して演奏操作子22の代わりに用いることができる。また、ディスプレイ14やサウンドシステム19なども外付けの機器を使用可能であり、その他の各構成は必要に応じて適宜追加及び省略が可能である。

図2は、本発明の実施例による電子楽器100の音声ガイド機能を表すブロック図である。

本発明の実施例による音声ガイド機能は、操作部31、制御部32、記憶部33、オーディオ再生部34、MIDI再生部35及びサウンドシステム19により実現される。なお、MIDI再生部35は必要に応じて省略可能である。

操作部(機能選択手段)31は、例えば、図1の演奏操作子22及び設定操作子12であり、ユーザーによる入力操作を受け付ける。ここで設定操作子12には、上述したようにディスプレイ14(図1)と当該ディスプレイ14の画面上に配置されるタッチ操作面からなるタッチパネルが含まれる。

ユーザーは設定操作子12を用いて各種機能選択操作を行う。なお、ここで選択される機能には、所定のモードに遷移する、所定のパラメータを選択する、パラメータ値を設定・変更する、自動演奏データや自動伴奏データの再生・停止、表示画面の遷移・変更、音声ガイド機能のオン/オフ、設定・変更など、電子楽器100上で実行されるどのような機能であっても良い。また、機能選択手段としての操作部31は、タッチパネルや本体パネル上の物理スイッチのみではなく、電子楽器100に接続されるマウスやジョイスティックなどで操作されるソフトスイッチでも良く、また、演奏操作子22を機能選択手段として用いても良い。

制御部32は、例えば、図1のCPU9で構成され、判定部41、ファイル読出部42及び音声ガイドデータ検索・読出部43を含む。

判定部41は、操作部31から入力される操作に基づく信号に応じて、MIDI再生部35、ファイル読出部42及び音声ガイドデータ検索・読出部43を制御する。具体的には、入力される信号が演奏操作子22の演奏操作(押鍵・離鍵操作)であれば、MIDI再生部35に対して、当該演奏操作に対応する楽音を生成するように指示する。入力される信号がオーディオデータADの選択指示であれば、ファイル読出部42に対して、当該選択指示に対応するオーディオデータADを記憶部33から読み出すように指示する。入力される信号が、機能IDが付加された操作に対応するものであれば、音声ガイド機能を実行するために、音声ガイドデータ検索・読出部43に対して、当該操作に対応する適切な音声ガイド用データGDを記憶部33から検索して読み出すように指示する。その他の処理に関する操作であった場合には、当該操作に対応する処理を行うための構成に対して指示を行う。

ファイル読出部42は、判定部41からの指示に従い、オーディオデータADを記憶部33から読み出して、当該読み出したオーディオデータADをオーディオ再生部34内の楽曲再生部44に送る。

音声ガイドデータ検索・読出部43は、判定部41からの指示に従い、音声ガイド用データGDを記憶部33から読み出して、当該読み出した音声ガイド用データGDをオーディオ再生部34内の音声ガイド再生部45に送る。音声ガイド用データの検索及び読み出しは、操作部31で入力された操作に付加された機能IDに対応する音声ガイド用データGDを、機能IDと音声ガイド用データGDとの対応を定義する対応情報、たとえば図4に示す対応テーブルを参照して特定し、当該特定したファイルを記憶部33内で検索して読み出すことにより行う。なお、この処理の詳細は図7のフローチャートを参照して後述する。

記憶部33は、例えば、図1の記憶装置15を外部機器により実現した外部記憶装置によって構成される。具体的には、USBメモリ等の半導体メモリ、CD−ROM、DVD−ROM等の着脱可能な記録媒体等からなり、音声ガイド用データGDを含むオーディオデータAD及びその他データODを記憶している。記憶部33としての記録媒体は、電子楽器100のメーカーやその他のサードパーティから提供されたものでもよいし、ユーザーが用意したものでも良い。また、記憶されるデータについても、同様に、電子楽器100のメーカーやその他のサードパーティから提供されたものでもよいし、ユーザーが用意したものでも良い。

音声ガイド用データGDは、電子楽器100の各種機能、設定、パラメータ等の選択、設定、表示状態や現在値等をユーザーに音声で知らせるために再生されるオーディオデータ(音声データ)である。音声ガイド用データGDは、例えば、WAV形式やMP3形式等の周知のオーディオデータフォーマットで構成されるため、周知のオーディオデータ再生処理により再生可能である。音声ガイド用データGDは、後述する図4に示すとおり、ユーザーによる各種機能選択操作と対応付けられており、ユーザーが機能選択操作を行うことで自動的に再生される。

オーディオデータADは、音声ガイド用データGDと同様に、WAV形式やMP3形式等の周知のオーディオデータフォーマットで構成される楽曲データであり、周知のオーディオデータ再生処理により再生可能である。オーディオデータADは、たとえばユーザーが電子楽器100で行なった演奏を録音したものや、音楽CDやコンピュータなどの外部機器から記憶部33に転送した楽曲などであり、ユーザーが再生したい楽曲を指定して再生操作を行うことにより再生される。

なお、オーディオデータAD(音声ガイド用データGD)のフォーマットは一種類に限らず、複数種類のフォーマットによるオーディオデータ(音声データ)が混在していても良い。

その他データODには、例えば、MIDIデータ等の自動演奏データや自動伴奏のためのスタイルデータなどが含まれる。

なお、記憶部33は着脱可能なものに限らず、電子楽器100に内蔵されたものであってもよく、その場合は外部機器(パーソナルコンピュータやサーバーなど)から通信ネットワークを介して音声ガイド用データGDを転送することで、記憶部33のデータを更新できる。また、記憶部33は、インターネットやLAN等のネットワークを介して接続される他の電子楽器や、サーバー等のコンピュータ上に設けても良い。

オーディオ再生部(音声データ再生手段)34は、例えば、図1の音源回路18及びDAC20で構成され、楽曲再生部44と音声ガイド再生部45とを含む。オーディオ再生部34は、外部機器(パーソナルコンピュータなど)によって実現してもよい。その場合、記憶部33にある音声ガイド用データGDを、電子楽器100本体が操作されたタイミングで外部機器に送信し、当該外部機器で再生するようにしても良い。

楽曲再生部44は、ファイル読出部42が記憶部33から読み出したオーディオデータADに基づき楽音信号を生成してサウンドシステム19に送出する。

音声ガイド再生部45は、音声ガイドデータ検索・読出部43が記憶部33から読み出した音声ガイド用データGDに基づき音声信号を生成してサウンドシステム19に送出する。

MIDI再生部35は、例えば、図1の音源回路18及びDAC20で構成され、操作部31の演奏操作子22から入力される演奏信号に基づき楽音信号を生成し、サウンドシステム19に送出する。

サウンドシステム19は、楽曲再生部44、音声ガイド再生部45及びMIDI再生部35から送出される楽音信号又は音声信号を増幅等して発音する。サウンドシステム19は1系統であっても良いが、複数系統のサウンドシステム19を備えることが好ましい。例えば、楽曲再生部44及びMIDI再生部35からの楽音信号はスピーカから発音し、音声ガイド再生部45からの音声信号はモニターヘッドフォンから発音するようにすると良い。そのようにすることで、音声ガイドの音声が演奏者(ユーザ)には聞こえるが、聴衆には聞こえないようにできる。

図3は、本発明の実施例によるデータ構成の一例を示す概念図である。図2の記憶部33には、例えば、図3に示すような階層構造で各種データが複数記憶されている。

本実施例では、GUIDEフォルダ(音声ガイド用フォルダ)内の音声データを音声ガイド用データGDとして認識し、音声ガイド機能における読み上げ対象としている。したがって、音声ガイド用データGDは、ROOTフォルダ直下のGUIDEフォルダに保存される。

ユーザーは自身で作成した又は入手した音声ガイド用データGDを、GUIDEフォルダの直下に置くか(例えば、図3のファイル「xxx.wav」等)、GUIDEフォルダ内に「JAPANESE」や「ENGLISH」などの言語フォルダを作成し、作成した言語フォルダ内に音声ガイド用データGDを置く(例えば、図3のファイル「aaa.wav」等)。

本実施例による電子楽器100は、ディスプレイ14(図1)の画面に表示するメニューやメッセージなどの言語を設定するための言語設定機能があり、「日本語」、「English」などの複数の選択肢の中からユーザー所望の言語を設定できる。ここで設定された言語に応じて、記憶部33(図2)内から音声ガイド用データGDを検索する際の、検索先フォルダが切り替わる。

なお、言語フォルダとして使用可能なフォルダ名は、電子楽器100の言語設定機能に応じて決めることが好ましい。例えば、電子楽器100の言語設定として、「日本語」、「英語」、「ドイツ語」、「フランス語」、「イタリア語」の設定が可能であれば、言語フォルダ名として「JAPANESE」、「ENGLISH」、「GERMAN」、「FRENCH」、「ITALIAN」のみを使用可能とすることが考えられる。なお、これに限らず、ユーザーが自由に言語フォルダ名を設定可能としても良いが、その場合には、言語フォルダと当該言語フォルダにおかれる言語が何語であるのかを識別する情報が必要となるであろう。

後述するように電子楽器100上で、ユーザーによる音声ガイド機能の対象となる操作が検出されると、その操作内容に応じて、音声ガイドとして再生される音声ガイド用データGDのファイル名が、図4(A)又は(B)に示すテーブルを参照して決定される。この時、当該操作が行われた時点における電子楽器100の言語設定に応じて、決定されたファイル名のファイルを検索するフォルダが決定される。例えば、言語設定が「日本語」となっているときに、音声ガイド機能の対象となる操作がなされた場合には、当該操作に対応した音声ガイド用データGD(例えば、bbb.wav)が「ドライブ名:/GUIDE/JAPANESE」内で検索される。ファイルbbb.wavが見つかれば、このファイルが読み出されて再生される。

同じ機能やパラメータ、コマンド、表示画面等に対応した音声ガイド用データGDには、同じファイル名を付して、異なる言語フォルダに格納することにより、電子楽器100の言語設定を参照することにより、当該言語設定に合致した音声ガイド機能が実行されることになる。これにより、言語の異なる複数のユーザーで1台の機器を共用する場合に、各ユーザーに対して適切な言語での音声ガイドが行えるようになる。なお、一人のユーザーまたは言語の同じユーザーのみが使用する場合には、一言語分の音声ガイド用データのみを記憶部33に保存しておけばよく、機器を使用するユーザーが増えたときなどに必要に応じて他言語のガイド音声データを随時追加することができる。

なお、図2の記憶部33のROOTフォルダ内には、音声ガイド用のフォルダ(GUIDEフォルダ)以外のフォルダが存在しても良い。例えば、図3に示すように、楽曲再生部44(図2)で再生可能なオーディオデータADを保存するAUDIO SONGフォルダや、MIDI再生部35(図2)で再生可能なMIDI形式の自動演奏データや伴奏スタイルデータ等を保存するMIDI SONGフォルダがあっても良い。

図4は、本発明の実施例による音声ガイド用データと機能ID又はパラメータ値との対応テーブルの例である。

図4(A)は、本発明の実施例による音声ガイド用データと機能IDとの対応テーブルの例である。

音声ガイド用データと機能IDとの対応テーブルには、機能IDと、各機能IDに対応する音声ファイル名(普声ガイド用データGDのファイル名)が定義されている。対応テーブルでは、ファイルの録音内容は定義されていないが、図4(A)では、各機能IDに対応した音声ファイルを日本語で録音した場合と英語で録音した場合の録音内容を例として記載してある。ユーザー自身または電子楽器100のメーカーがこの内容で音声を録音した音声ファイルを作成し、対応テーブルで定義されたファイル名をつけて保存することにより、音声ガイド用データGDとして使用できるようになる。なお、図2の操作部(機能選択手段)31で選択される電子楽器100の機能の中で、音声ガイドの対象となる(音声が読み上げられる)機能を実行するためのコマンドを指示する操作には、機能IDが付加されている(以下、単に「音声ガイドの対象となる操作」又は「機能IDが付加された操作」と呼ぶ)。

ユーザーが電子楽器100上で操作を行うと、当該操作に機能IDが付加されているか否かが判断され、付加されている場合には、当該付加された機能IDに対応する音声ファイル名がこの対応テーブルを参照して求められる。

図4(B)は、本発明の実施例による音声ガイド用データとパラメータ値との対応テーブルの例である。

この図4(B)に示す対応テーブルには、パラメータ値と音声ガイド用データGDのファイル名との対応が定義されている。

本実施例では、ユーザーがオンオフスイッチ(タッチパネル上の画像を含む)を操作した場合には、この対応テーブルの「ON」又は「OFF」に対応する音声ファイル名のデータがこの対応テーブルを参照して読み出されて再生される。また、パラメータ値を設定するためのスライダー(タッチパネル上の画像を含む)を操作した場合には、操作されたパラメータ値に対応する数値が読み上げられる。例えば、数値が「123」である場合には、それぞれ「1」に対応するファイル名のデータ、「2」に対応するファイル名のデータ、「3」に対応するファイル名のデータが、この対応テーブルを参照して読み出されて再生される。このように、10以上の値を読み上げる場合でも、0〜9までに対応する10個の音声ガイド用データGDのみで音声ガイドを行う。なお、数値読み上げ用の音声ガイド用データGDは、この10個に限らず多数用意しても良い。例えば、「10」や「100」に対応する音声ガイド用データGDを用意しても良い。また、「ON」、「OFF」及び数値に限らず、例えば、「+」や「−」などに対応する音声ガイド用データGDを用意しても良い。

上述したように、本実施例では、音声ガイドの対象となる各操作に機能IDを付加して、当該機能IDに対応する音声ガイド用データGDの名称を特定するため、当該機能IDに対応したファイル名で音声データをGUIDEフォルダ直下、もしくは当該音声ファイルの言語に対応する言語フォルダ内に格納することにより、ユーザーが自作したファイルや、製品入手後に取得したファイルを音声ガイド用データGDとして用いることができる。したがって、各ユーザー向けにカスタマイズされた音声ガイド用データGDを記録媒体に記録して配布したり、インターネット上のサイトからダウンロードさせたりして提供することが可能となる。

例えば、専門用語がわかりにくい場合などには、平易な言葉に置き換えた音声ガイド用データGDを用意したり、製品の表示言語と異なる言語を母語とするユーザーにはその言語で作成した音声ガイド用データGDを用意したりすることもできる。

よって、あらかじめガイド用の音声を製品に内蔵しておかなくても、あとから音声ガイド用データGDの追加や更新等が簡単に行えるようになるため、メーカーにとっては録音や翻訳作業を製品開発工数に組み入れる必要がなくなるというメリットが、ユーザーにとっては必要なガイド用音声を入手したり自作したりすることで適切な音声ガイド機能が利用できるというメリットがある。

図5は、本発明の実施例による音声ガイド機能を説明するための本体パネルの一部の概略平面図である。

本実施例による電子楽器100の本体パネル上には、少なくともタッチパネル50が配置される。また、その周囲に、各種物理スイッチ、ダイアル等の設定操作子12(機能ボタン51、音声ガイドボタン52、パラメータ変更ダイアル53、EXITボタン54)が配置されている。

機能(FUNCTION)ボタン51は、ユーザーがこのボタンを押下することにより、図5(A)に示すファンクションメニューの表示画面に遷移させるためのコマンドが割り当てられたボタンである。

音声ガイドボタン52は、音声ガイド用の音声のみを再生させるためのコマンドが割り当てられたボタンである。本実施例では、電子音楽装置100の音声ガイド機能がオンになっている時には、ユーザーがパネル上のボタンやタッチパネル上の表示を操作すると、操作に対応した機能が実行されるとともに当該操作に対応した音声ガイド用データGDが再生されるが、ユーザーがこのボタンを押下しながら他のボタンやタッチパネル上の表示を操作すると、操作に対応した機能は実行されずに、当該操作に対応する音声ガイド用データGDが再生される。

なお、音声ガイド用の音声のみを再生させるための指示を行なうボタン(音声ガイド指示手段)は、図5に示す音声ガイドボタン52のような専用の物理ボタンである必要はなく、例えば、任意の機能を割り当て可能なアサイナブルスイッチやペダルなどに音声ガイド指示の機能を割り当てるようにしても良い。また、使用頻度の低いボタン(例えば、デモ演奏等を行うためのデモボタン)を、音声ガイド機能がオンになっている場合にのみ音声ガイド指示手段として用いても良い。

パラメータ変更ダイアル53は、左右に回転させることにより、パラメータ値等を増減させることができる。EXITボタン54は、直前の画面もしくは一つ上の階層の画面に戻るためのコマンドが割り当てられたボタンである。

音声ガイド機能の対象となる機能を実行させるためのコマンドが割り当てられた操作子12又はタッチパネル上の領域には、それぞれ対応する機能を識別するための機能IDが割り振られており、図4を参照して説明したように、各機能IDには、音声ガイド用データGDが対応付けられている。

なお、電子楽器100の音声ガイド機能は予めオンになっている(後述する図5(B)のオンボタン58aが押されている)ものとする。

図5(A)に示す例では、タッチパネル50上にファンクションメニューが表示されており、このメニュー内には、各種機能の設定画面への遷移を指示するコマンドが割り当てられたボタンが複数個配置されている。この例では、チューニングの設定画面への遷移を指示するためのボタン55a、ソング設定を行うための設定画面への遷移を指示するためのボタン55b、スタイル設定を行うための設定画面への遷移を指示するためのボタン55c、ペダル設定を行うための設定画面への遷移を指示するためのボタン55d、マイク設定を行うための設定画面への遷移を指示するためのボタン55e、音声ガイド設定を行うための設定画面への遷移を指示するためのボタン55fが配置されている。なお、機能ボタン51、ボタン55a〜55fには、それぞれ図4(A)に示すテーブルの機能ID1〜7が割り当てられている。

音声ガイド機能がオンになっている状態で、音声ガイドボタン52を押しながら、音声ガイド設定ボタン55fを押すと、図4(A)の対応テーブルが参照されて、「audio_guide_setting.wav」が再生され、「音声ガイド設定」という音声がサウンドシステム19(図1)から発音される。この時、音声ガイド設定ボタン55fに割り当てられている音声ガイド設定メニューへの画面遷移コマンドは実行されず、画面表示は図5(A)に示すものから変化しない。一方、音声ガイドボタン52から手を離して、音声ガイド設定ボタン55fを押すと、音声ガイド設定メニューへの画面遷移コマンドが実行され、タッチパネル50上の表示は、図5(B)に示す音声ガイド設定メニューに遷移する。

したがって、視覚障害者が電子楽器100を操作する際には、まずは画面を遷移させずに音声ガイドを発音させることで、操作しようとしている対象操作子が意図通りのものであるかを確認し、意図通りであることが確認できてから操作を実行する、という使い方が可能となる。

ところで、ユーザーが音声ガイドボタン52を押しながら、機能ボタン51を押下すると、図4(A)の対応テーブルが参照されて、「function_menu.wav」が読み出されて「ファンクションメニュー」という音声ガイドが再生される。

なお、この時、「function_menu.wav」の録音内容を、ファンクションメニュー画面内に含まれる設定項目の内容を含むようにしても良い。例えば、ファンクションメニュー画面として図5(A)に示す画面を用いる場合には「function_menu.wav」の内容を、「ファンクションメニュー、チューニング、ソング設定、スタイル設定、ペダル設定、マイク設定、音声ガイド設定」としても良い。これにより、ユーザーは自分がどのボタンを押したかだけでなく、ユーザーの操作によって画面の内容がどのように変化したのかも知ることができるようになる。

また、「function_menu.wav」の内容を変えるのではなく「function_menu.wav」を読み出した後に、順次、「チューニング、ソング設定、スタイル設定、ペダル設定、マイク設定、ガイド設定」に対応する音声ガイド用データGDを読み出すように、図4に示す対応テーブルを定義するようにしてもよい。つまり、ファンクションボタンへの操作受付の機能IDを「a」とし、ファンクションメニュー画面表示の機能IDを「b」として、ファンクションボタンが押された際には「a」と「b」の両方の機能IDに対応する音声ガイド用データGDを順次読み出すようにする。このようにすると、機能ID「b」に対応する音声ガイド用データを用意するかしないかに応じて、画面内容の読み上げのオンオフを切り替えることができる。また、このようにすると、ファンクションボタン51を押してファンクションメニューを表示させる場合と、EXITボタン54を押してファンクションメニューを再表示させる場合とで、操作が違っても同じ音声ガイド用データGD(機能ID「b」に対応する音声データ)が共有できるので、複雑な操作体系でも状況に応じたガイドを行いやすくなる。

図5(B)に示す例では、タッチパネル50上に音声ガイド設定メニューが表示されており、このメニュー内には、音声ガイド機能の各種パラメータの表示領域及び各パラメータの設定・変更を指示するコマンドが割り当てられたボタン、フェーダー、スイッチ等が複数個配置されている。

この例では、音声ガイド機能のオン及びオフ状態を表示するとともに、オンオフ状態の切り替えを行うための音声ガイド機能オンボタン58a及び音声ガイド機能オフボタン58bが配置されるオンオフ状態表示領域56a、現在の音声ガイドのボリューム値を表示するとともに、当該ボリューム値の設定・変更を行うためのフェーダー57が配置されるボリューム表示領域56b、現在のパン設定を表示するとともに、パンを設定変更するためのノブを含むパン設定表示領域56c、現在の音声ガイドの読み上げ速度を表示するとともに、読み上げ速度を設定・変更するためのフェーダー57が配置される読み上げ速度表示領域56d、現在の読み上げ音声のピッチを表示するとともに、ピッチを設定・変更するためのフェーダー57が配置されるピッチ表示領域56eが表示されている。なお、オンオフ状態表示領域56a及びボリューム表示領域56bには、それぞれ図4(A)に示すテーブルの機能ID8及び9が割り当てられている。また、その他の領域にも、その他の機能IDが割り当てられている。

図5(B)に示すようなパラメータ値等を設定する画面においては、音声ガイド機能がオンになっている状態で、音声ガイドボタン52を押しながら、ボリューム設定領域56b等のパラメータ表示領域にタッチすると、図4(A)の対応テーブルが参照されて、当該ボリューム設定領域56b(パラメータ表示領域)に対応付けられている「audio_guide_vol.wav」(音声ガイド用データGD)が再生される。また、パラメータを変更するためのスイッチ(フェーダー、ノブ等)にタッチした場合には、タッチした場所に対応するパラメータ値(現在の設定されているパラメータ値ではない)が、図4(B)の対応テーブルを参照して読み上げられる。なお、現在の設定値を知りたい場合には、例えば、音声ガイドボタン52を押しながら、パラメータ表示領域内を所定時間内に2回続けてタッチする。

なお、図5(B)に示すようなパラメータ値等を設定する画面においては、音声ガイド機能はパラメータ名と値を順に読み上げるようにすることもできる。例えば、機能IDごとに、当該機能IDに対応付けられた機能がパラメータ値を有するか否かを表すフラグを立てておいて、フラグのある機能IDが選択されたときは、パラメータ名に対応した音声ガイド用データGDに続けて、当該パラメータの現在値を表す数字の音声ガイド用データGDを再生する。具体的には、音声ガイド機能がオンになっている状態で図5(B)に示す画面の表示中に、音声ガイドボタン52を押しながら、ボリューム設定領域56bにタッチすると、図4(A)の対応テーブルが参照されて、当該ボリューム設定領域56bに対応付けられている「audio_guide_vol.wav」が再生されたあと、続けて図4(B)の対応テーブルが参照されて、現在のパラメータ値「80」に対応する「value_eight.wav」及び「value_zero.wav」が再生され、「音声ガイドボリューム はち ぜろ」という音声がサウンドシステム19(図1)から発音される。

また、音声ガイド機能のボリューム値設定・変更する場合は、音声ガイドボタン52から手を離した後に、再度ボリューム設定領域56bにタッチすることにより、ボリューム設定を選択状態として、パラメータ変更ダイアル53を左右に回転させることによりパラメータ値を設定・変更する。

なお、パラメータ変更ダイアル53の操作時には、選択(設定・変更)中のパラメータのパラメータ値を音声ガイド機能により読み上げるようにすることが好ましい。ただし、パラメータ変更ダイアル53の回転にしたがって連続的に変化するパラメータ値を全て読み上げることはできないので、操作が一定時間(例えば、1秒間)停止した場合に、音声ガイドボタン52を押しながら、ボリューム設定領域56bにタッチした場合と同様に、パラメータ名と値を続けて読むようにすると良い。パラメータ変更ダイアル53の操作時は、音声ガイドボタン52が押されているか否かにかかわらず、音声ガイド機能がオンになっている状態であれば、パラメータ名とパラメータ値の読み上げを行うようにしても良いし、音声ガイドボタン52を押しながら操作したときのみパラメータ名とパラメータ値の読み上げを行うようにしても良い。

なお、音声ガイド用データGDは、波形データ等のオーディオデータであるので、再生速度(読み上げ速度)を変えるとピッチも変わってしまう。これを防ぐために、図5(B)の56d、56eに示す読み上げ速度、ピッチのパラメータを調整すると、周知のタイムストレッチやピッチシフトの機能を使用して、読み上げ速度やピッチ(声の高さ)を変更するようにする。これにより、インターネットなどで入手した音声ガイド用データGDが聞き取りづらいと感じた場合に、自分で聞き取りやすい速さ、ピッチの音声データを録音しなおさなくても、聞き取りやすい速さやピッチで音声ガイドを再生できる。

また、電子楽器100の電子楽器としての機能であるイコライザー機能を利用して、音声ガイド用データGDを再生する際に、高音域をブーストするなどして、高音域が聞き取りづらいユーザーに対応することが可能である。

以上のように、本実施例では、音声ガイド機能がオンになっている場合には、音声ガイドボタン52を押しながら操作することにより、操作対象の機能を実行させずにガイド音声の再生だけを行うことが可能である。よって、機能選択手段である操作子に割り当てられている機能やパラメータを音声ガイドで確認してから、当該機能の実行やパラメータの設定等を行うことが簡単にできる。

図6は、本発明の実施例による音声ガイド処理を表すフローチャートである。この音声ガイド処理は、図1のCPU9により実行される処理であり、操作部31(図2)の操作が検出されたときに起動する。

ステップSA1で音声ガイド処理を開始し、ステップSA2では、この処理が起動されるきっかけとなった操作が、機能IDが付加された操作(音声ガイドの対象となる操作)であるか否かが判断される。なお、機能IDが付加された操作とは、上述したように、当該操作によって実行されるコマンドに機能IDが付加されており、音声ガイド機能がオンの場合に、音声ガイドがなされる操作である。例えば、鍵盤(演奏操作子22)やペダルの操作などの演奏操作には音声ガイドの必要がないので、機能IDが付加されていない。また、自動伴奏データのテンポ変更操作といった、耳で聞いて明らかに変更内容がわかるような機能についても、音声ガイドがなくても操作可能であるので、機能IDは付加されていなくてもよい。一方、各種設定画面を開く場合や設定の変更、確認等を行う場合には、音声ガイドを行う必要があるので、これらの操作(に対応するコマンド)には機能IDが付加されている。機能IDが付加された操作である場合には、YESの矢印で示すステップSA3に進み、付加されていない場合には、音声ガイドを行わずNOの矢印で示すステップSA6に進み、当該操作に応じた処理を実行して、その後、ステップSA7に進み、音声ガイド処理を終了する。

ステップSA3では、音声ガイド機能がオンであるか否かを判断する。音声ガイド機能がオンである場合には、YESの矢印で示すステップSA4に進み、音声ガイド機能がオフである場合には、音声ガイドを行わずNOの矢印で示すステップSA6に進み、当該操作に応じた処理を実行して、その後、ステップSA7に進み、音声ガイド処理を終了する。

ステップSA4では、図7に示すファイル検索・再生処理を実行する。ファイル検索・再生処理では、今回の処理のきっかけとなった操作に付加された機能IDに対応する音声ガイド用データGDを記憶部33(図2)から検索して再生する。その後、ステップSA5に進む。

ステップSA5では、音声ガイドの再生のみを指示する音声ガイド用ボタン(例えば、図5に示す音声ガイドボタン52)の操作中(押下中)であるか否かを判断する。操作中である場合には、YESの矢印で示すステップSA7に進み、ガイド処理を終了する。操作中でない場合には、NOの矢印で示すステップSA6に進み、今回の処理のきっかけとなった操作に割り当てられている処理(コマンド)を実行して、その後ステップSA7に進み、音声ガイド処理を終了する。

なお、ステッブSA5のような、操作に対応した機能を実行するか否かの分岐は、上述のように専用の音声ガイド指示ボタンを用いる方法のほか、例えば(A)機能IDが付加された操作を一度行うと、操作に対応した機能は実行されずに音声ガイド用データGDの再生のみが行われ、所定時間内にもう一度同じ操作を行うと、操作に対応した機能が実行される、(B)機能IDが付加された操作をすばやく2回行う(例えば、ボタンをすばやく2回押すダブルクリックのような操作)ことで操作に対応した機能は実行されずに音声ガイド用データGDの再生のみが行われ、普通に1回押す操作で当該操作に対応した機能が実行されるようにしても良い。

いずれの手法を用いる場合でも、図2の操作部31に対する操作態様を少なくとも2種類以上定義し、第1の操作態様(例えば、音声ガイドボタン52を押下しながらの操作)の場合には機能を実行せずに音声ガイド用データのみを再生し、第2の操作態様(例えば、音声ガイドボタン52を押さないで操作)の場合には当該操作に対応する機能を実行するようにすることが好ましい。なお、図6に示すフローでは、第2の操作態様(ステップSA5でYES)の場合に音声ガイド用ファイルの再生(SA4)と機能の実行(SA6)とがともに行なわれることになるが、第2の操作態様の場合には機能の実行のみを行い音声ガイドは行なわないように構成してもよい。

図7は、図6のステップSA5で実行されるファイル検索・再生処理を表すフローチャートである。

ステップSB1でファイル検索・再生処理を開始し、ステップSB2では、図6の音声ガイド処理を開始するきっかけとなった操作に対応する音声ガイド用データGDのファイル名を、例えば図4に示す対応テーブルを参照して、確認(取得)する。

ステップSB3では、電子音楽装置100の現在の言語設定を取得し、ステップSB4において、音声ガイド用ファイルの検索先となるパスが存在するかどうかを確認する。検索先として、例えば「D:」ドライブ(USBなどの通信I/Fに接続された記憶領域)を予め設定して、ROM8に記憶しておく(ユーザーによる変更は不可)ようにする。この場合、「D:」ドライブとして、USBメモリが接続されていればそのUSBメモリ内を検索するし、SDカードリーダーがUSB接続されていれば、SDカード内を検索する。また、図4のテーブル内に、検索先が定義されていてもよい。例えば、機能IDごとに、「D:/Guide/aaa.wav」を検索するといったように、対応するファイル名をパスで定義しておくとよい。他の例として、検索先としてインターネットやLAN等のネットワークを介して接続されるサーバーが予め設定されている場合は、設定された検索先であるサーバーのアドレスが検索先のパスとなるので、このアドレスにアクセスできるかどうかを確認する。検索先となるパスが存在する場合には、YESの矢印で示すステップSB5に進み、パスが存在しない場合には、NOの矢印で示すステップSB12に進み、ファイル検索・再生処理を終了して、図6の音声ガイド処理に戻る。

ステップSB5では、ステップSB4で検索したパスで、ステップSB3で取得した言語設定に対応する言語フォルダ(対応言務フォルダ)を検索する。例えば、言語設定が「日本語」となっている場合には、図3の「GUIDE」フォルダ下の「JAPANESE」フォルダを検索する。対応言語フォルダを検出した場合には、YESの矢印で示すステップSB6に進み、検出しない場合には、NOの矢印で示すステップSB8に進む。

ステップSB6では、ステップSB5で検出した対応言語フォルダ内で、音声ガイドとして再生する対象の(図6の音声ガイド処理を開始するきっかけとなった操作に対応する)音声ガイド用データGD(対象ファイル)を検索する。

ステップSB7では、ステップSB6において対象ファイルが検出されたか否かを判断する。対象ファイルが検出された場合には、YESの矢印で示すステップSB11に進み、検出されない場合は、NOの矢印で示すステップSB8に進む。

ステップSB8では、ステップSB3で取得した言語設定に対応する言語フォルダ又は同言語による音声ガイド用データGDが検出されなかったので、音声ガイド用フォルダ(例えば、図3の「GUIDE」フォルダ)直下で対象ファイルを検索する。なお、このステップSB8で検索される対象ファイルは、言語設定のない音声ガイド用データGDであり、英語や日本語の場合もあれば、その他の言語の場合もある。

ステップSB9では、ステップSB8において対象ファイルが検出されたか否かを判断する。対象ファイルが検出された場合には、YESの矢印で示すステップSB11に進み、検出されなかった場合には、NOの矢印で示すステップSB10に進む。

ステップSB10では、エラー(対象ファイルが存在しないこと)を音声及び画面表示により通知する。その後、ステップSB12に進み、ファイル検索・再生処理を終了して、図6の音声ガイド処理に戻る。音声によるエラー通知は、例えば、「ファイルがありません」と音声で再生するか、エラーを表す報知音を鳴らすことで行う。この場合の音声等は予め図1のROM8等に用意されていることが好ましい。なお、対象ファイルが見つからなかった場合には、エラーメッセージを出さずに(ステップSB10を省略して)ステップSB12に進むようにしても良い。または、再生されるべき音声ファイルのファイル名を音声で知らせるようにして、ユーザーによる作成を促すようにしても良い。さらには、「音声ファイルがありません、録音しますか?」などの内蔵音声を流して、ユーザーが同意した場合に自動的に録音モードに移行して、音声ガイド用データGDの作成を行うようにしても良い。

ステップSB11では、ステップSB6もしくはステップSB8で検出した対象ファイルを、例えば、図2の音声ガイド再生部45にて再生し、その後、ステップSB12に進み、ファイル検索・再生処理を終了して、図6の音声ガイド処理に戻る。

上述の例では、検索先となるパスが不存在の場合(ステップSB4でNO)には、そのまま処理を終了するようにしたが、SB4の後にステップSB10へと進んで、パスが存在しないことをユーザーに通知するようにしてもよい。

また、上述の例では、対象ファイルが検索対象フォルダに不存在の場合、上述のステップSB8で一つ上の階層のフォルダのみを検索するようにしたが、さらに別の場所(例えば、更に上位の階層、下位の階層、別のドライブ、インターネットやLANなどのネットワーク上)で対象ファイルを検索するようにしても良い。この場合、電子楽器100の製造者等のホームページに予めデフォルトの音声ガイド用データGDを用意しておくことにより、電子楽器100がネットワークに接続されている場合には、対象ファイルが見つからないということがなくなり、確実に音声ガイドを行うことが可能となる。

または、検索を行う際に、ファイル名が若干異なる(大文字、小文字の違い、全角、半角の違い、ファイル名が1文字だけ異なる等)場合には、対象ファイルであると判断するようにしても良い。

図8は、本発明の実施例による音声再生処理を表すフローチャートである。この音声再生処理は、図1のCPU9により実行される処理であり、例えば、図6のステップSA6における操作に応じた処理として、又は図7のステップSB11における再生処理として、オーディオ再生部34(図2)でのオーディオファイル再生が開始されたときに起動する。

ステップSC1で音声再生処理を開始し、ステップSC2では、現在の再生対象となっているオーディオファイルが、図7のステップSB11における再生処理の対象ファイルとして選択されたもの、すなわち音声ガイド用のオーディオファイル(音声ガイド用データGD)であるか否かを判断する。音声ガイド用のオーディオファイルである場合には、YESの矢印で示すステップSC3に進み、それ以外の場合はNOの矢印で示すステップSC4に進む。

ステップSC3では、音声ガイド機能用の再生設定に応じて、読み上げ速度やピッチ、イコライザーなどが調整された聞き取りやすい音声でオーディオファイル(音声ガイド用データGD)を再生する。その後、ステップSC5に進み、音声再生処理を終了する。

ステップSC4では、オーディオ再生機能用の再生設定に応じてオーディオファイル(オーディオデータAD)を再生する。その後、ステップSC5に進み、音声再生処理を終了する。

以上、本発明の実施例によれば、音声ガイド用データを予め電子楽器100本体に内蔵しておく必要がない。着脱可能又は書き換え可能な記録媒体から、必要な音声ガイド用データを読み出して再生することにより、音声ガイド用データを後から自由に追加、変更、更新することが可能となる。

また、音声ガイド用データは、一般的なオーディオファイルフォーマットで記録されるので、音声ガイドのための特別なハードウェア構成は必要なく、音声ガイド機能による電子楽器100の負荷を軽減することができる。

さらに、音声ガイド用データを追加、変更、更新することができるので、音声ガイドの内容(読み上げる言葉の内容)や言語、声質や速度などをユーザーが自由にカスタマイズすることが可能となる。

また、特定の機能IDに対応する音声ファイルを記録媒体から削除すれば、その機能IDに対応する操作を行ったときには音声ガイドが行われなくなる。つまり、音声ガイドを行う機能と行わない機能とをユーザーが自由に選別できることになるので、例えば、すでに操作を熟知している機能については音声ガイドをしないといった使い方ができる。

また、着脱可能又は書き換え可能な記録媒体に音声ガイド用データを記憶して、それを音声ガイドに用いることにより、電子楽器100本体の設定をまったく変えることなく、記録媒体を差し替える又は内容を更新するだけの簡単な操作で、複数の音声ガイドを簡単に切り替えることが可能となる。例えば、上述のように自作のガイド音声や、有名なアーティスト等の声で作成したガイド音声、別の言語のガイド音声等を使用可能となる。さらに、記録媒体を譲渡したり貸し借りしたりすることにより、他人の作成したガイド音声を、記録媒体を差し替えるだけの簡単な操作で使用することができる。

また、本発明の実施例によれば、音声ガイドを実行するときには、当該操作によって実行される本来の機能を実行せずに、当該機能を案内する音声の再生のみを行うようにできるので、意図しない機能を間違って選択して実行させることを防止できる。

また、本発明の実施例によれば、音声ガイド用データを製品出荷後に着脱可能な記録媒体やインターネット等で提供することが可能となる。よって、本実施例による電子楽器100の開発段階(生産開始までの間)にガイド音声を収録する必要がなくなり、開発中の工数を削減できる。また、電子楽器100の開発が完了(仕様が確定)してから音声ファイルの制作(録音作業)始めることができ、仕様変更による手戻りがない(開発効率がよい)。

また、本発明の実施例によれば、コストをかけずに音声ガイド機能が実現できるので、多数の製品に音声ガイドの機能を搭載することができ、従来は視覚障害者が使用しなかった(できなかった)製品のマーケットを広げることができる。製品が異なっても機能が同じなら同じ音声ガイド用データを使用可能であるため、後発モデルではほとんど開発コストがかからない。

また、本発明の実施例によれば、電子楽器100に音声ガイド用データを内蔵しないで発売することができるので、音声ガイドが不要なユーザーは、音声ガイド用のコストを負担せずに安価に製品を入手することができる。また、一方で音声ガイドが必要なユーザーにとっては、製品購入後に音声ガイド用データの記録された記録媒体(USBメモリやメモリーカード)を製造者やサードパーティから入手して、製品本体に装着するだけで、簡単・確実に音声ガイドを利用できる。

さらに、機能ID(機能を実現するための操作)とファイル名の対応テーブルを製品の製造者から入手すれば、ユーザーが自作した音声ファイルを音声ガイド用データとして使用することも可能となる。

なお、上述の実施例では、音声ガイド用データGDを読み出すフォルダを分けて、同一機能に対応するファイルには同一ファイル名をつけることで、多言語に対応させていたが、例えば、ファイル名の先頭や末尾などに言語コードをつけておくことで、言語設定に対応するファイル名を有する音声ガイド用データGDを読み出すようにしても良い。

また、本実施例では、機能IDと音声ガイド用データとの対応を定義する対応情報として対応テーブルを用いたが、機能に対する音声ガイド用データ特定するための情報であれば、テーブル形式でなくてもよい。たとえば、ある機能が選択されると、機能に対応するオーディオファイル名がRAM上の所定の領域に書き込まれるようにし、その領域を参照することでオーディオファイル(音声ガイド用データ)を特定するなどの方法が考えられる。あるいは、機能IDや機能名称自体が音声ガイド用データを特定するための情報であってもよく、機能IDが「001」である機能が選択されるとファイル名に「001」が含まれるオーディオファイル(音声ガイド用データ)が特定されたり、機能名称が「Volume」である場合にファイル名に「volumu」が含まれるオーディオファイルが特定されたりしてもよい。

また、本実施例では、機能IDに対する音声ガイド用データをオーディオファイルのファイル名により特定したが、他の方法で特定してもよい。たとえばファイル名ではなくフォルダ名を機能IDと対応付けておき、ある機能が選択されると機能に対応するフォルダが特定されて、特定されたフォルダ内にあるオーディオファイルを再生するよう構成してもよい。あるいは、機能IDと所定の文字列とを対応付けておき、メタ情報(たとえばmp3形式のファイルのID3タグ)に所定の文字列が含まれるオーディオファイルを特定することで、機能IDに対応する音声ガイド用データを特定する方法でもよい。これらの場合、オーディオファイルのファイル名は任意であってよい。

なお、本発明の実施例による電子音楽装置(電子楽器)100は、鍵盤楽器の形態に限らず、管楽器、弦楽器、打楽器等どのよう形態であっても良い。さらに、電子音楽装置100は、演奏操作子を有さない音源装置や、ミキサ等のオーディオデータを再生可能な機器であれば、音声ガイド用データGDを再生可能であるので、そのような機器であっても良い。

また、本発明の実施例は、電子楽器の形態に限らず実施例に対応するコンピュータプログラム等をインストールした市販のコンピュータ等によって、実施させるようにしてもよい。その場合には、各実施例に対応するコンピュータプログラム等を、CD−ROM等のコンピュータが読み込むことが出来る記録媒体に記憶させた状態で、ユーザーに提供してもよい。また、そのコンピュータ等が、LAN、インターネット、電話回線等の通信ネットワークに接続されている場合には、通信ネットワークを介して、コンピュータプログラムや各種データ等をユーザーに提供してもよい。

以上実施例に沿って本発明を説明したが、本発明はこれらに制限されるものではない。例えば、種々の変更、改良、組み合わせ等が可能なことは当業者に自明であろう。