JP2011123761A - 電子機器 - Google Patents

電子機器 Download PDFInfo

- Publication number

- JP2011123761A JP2011123761A JP2009282109A JP2009282109A JP2011123761A JP 2011123761 A JP2011123761 A JP 2011123761A JP 2009282109 A JP2009282109 A JP 2009282109A JP 2009282109 A JP2009282109 A JP 2009282109A JP 2011123761 A JP2011123761 A JP 2011123761A

- Authority

- JP

- Japan

- Prior art keywords

- touch panel

- contact

- display

- processing

- icon

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F1/00—Details not covered by groups G06F3/00 - G06F13/00 and G06F21/00

- G06F1/16—Constructional details or arrangements

- G06F1/1613—Constructional details or arrangements for portable computers

- G06F1/1615—Constructional details or arrangements for portable computers with several enclosures having relative motions, each enclosure supporting at least one I/O or computing function

- G06F1/1616—Constructional details or arrangements for portable computers with several enclosures having relative motions, each enclosure supporting at least one I/O or computing function with folding flat displays, e.g. laptop computers or notebooks having a clamshell configuration, with body parts pivoting to an open position around an axis parallel to the plane they define in closed position

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F1/00—Details not covered by groups G06F3/00 - G06F13/00 and G06F21/00

- G06F1/16—Constructional details or arrangements

- G06F1/1613—Constructional details or arrangements for portable computers

- G06F1/1633—Constructional details or arrangements of portable computers not specific to the type of enclosures covered by groups G06F1/1615 - G06F1/1626

- G06F1/1637—Details related to the display arrangement, including those related to the mounting of the display in the housing

- G06F1/1643—Details related to the display arrangement, including those related to the mounting of the display in the housing the display being associated to a digitizer, e.g. laptops that can be used as penpads

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F1/00—Details not covered by groups G06F3/00 - G06F13/00 and G06F21/00

- G06F1/16—Constructional details or arrangements

- G06F1/1613—Constructional details or arrangements for portable computers

- G06F1/1633—Constructional details or arrangements of portable computers not specific to the type of enclosures covered by groups G06F1/1615 - G06F1/1626

- G06F1/1637—Details related to the display arrangement, including those related to the mounting of the display in the housing

- G06F1/1647—Details related to the display arrangement, including those related to the mounting of the display in the housing including at least an additional display

- G06F1/1649—Details related to the display arrangement, including those related to the mounting of the display in the housing including at least an additional display the additional display being independently orientable, e.g. for presenting information to a second user

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F1/00—Details not covered by groups G06F3/00 - G06F13/00 and G06F21/00

- G06F1/16—Constructional details or arrangements

- G06F1/1613—Constructional details or arrangements for portable computers

- G06F1/1633—Constructional details or arrangements of portable computers not specific to the type of enclosures covered by groups G06F1/1615 - G06F1/1626

- G06F1/1684—Constructional details or arrangements related to integrated I/O peripherals not covered by groups G06F1/1635 - G06F1/1675

- G06F1/169—Constructional details or arrangements related to integrated I/O peripherals not covered by groups G06F1/1635 - G06F1/1675 the I/O peripheral being an integrated pointing device, e.g. trackball in the palm rest area, mini-joystick integrated between keyboard keys, touch pads or touch stripes

- G06F1/1692—Constructional details or arrangements related to integrated I/O peripherals not covered by groups G06F1/1635 - G06F1/1675 the I/O peripheral being an integrated pointing device, e.g. trackball in the palm rest area, mini-joystick integrated between keyboard keys, touch pads or touch stripes the I/O peripheral being a secondary touch screen used as control interface, e.g. virtual buttons or sliders

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/041—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means

- G06F3/0416—Control or interface arrangements specially adapted for digitisers

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0481—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance

- G06F3/04817—Interaction techniques based on graphical user interfaces [GUI] based on specific properties of the displayed interaction object or a metaphor-based environment, e.g. interaction with desktop elements like windows or icons, or assisted by a cursor's changing behaviour or appearance using icons

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0484—Interaction techniques based on graphical user interfaces [GUI] for the control of specific functions or operations, e.g. selecting or manipulating an object, an image or a displayed text element, setting a parameter value or selecting a range

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0484—Interaction techniques based on graphical user interfaces [GUI] for the control of specific functions or operations, e.g. selecting or manipulating an object, an image or a displayed text element, setting a parameter value or selecting a range

- G06F3/0486—Drag-and-drop

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

- G06F3/04883—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures for inputting data by handwriting, e.g. gesture or text

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F2203/00—Indexing scheme relating to G06F3/00 - G06F3/048

- G06F2203/041—Indexing scheme relating to G06F3/041 - G06F3/045

- G06F2203/04105—Pressure sensors for measuring the pressure or force exerted on the touch surface without providing the touch position

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F2203/00—Indexing scheme relating to G06F3/00 - G06F3/048

- G06F2203/048—Indexing scheme relating to G06F3/048

- G06F2203/04808—Several contacts: gestures triggering a specific function, e.g. scrolling, zooming, right-click, when the user establishes several contacts with the surface simultaneously; e.g. using several fingers or a combination of fingers and pen

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- General Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Human Computer Interaction (AREA)

- General Physics & Mathematics (AREA)

- Computer Hardware Design (AREA)

- Mathematical Physics (AREA)

- User Interface Of Digital Computer (AREA)

- Digital Computer Display Output (AREA)

- Position Input By Displaying (AREA)

Abstract

【解決手段】パーソナルコンピュータは、2枚のタッチパネル15,17が設けられている。CPU111は、タッチパネルドライバ202により、一方のタッチパネル15に対する特定の操作が検出された場合に、特定の操作に応じた処理モードを設定する。CPU111は、処理モードが設定された後、他方のタッチパネル17に対する操作に応じて、処理モードに応じた処理を実行し、処理の結果をLCD16に表示させる。

【選択図】図2

Description

図1は、本実施形態における電子機器の構成を示す外観図である。この電子機器は、例えば、ノートブック型の携帯型パーソナルコンピュータ10として実現されている。本実施形態におけるパーソナルコンピュータ10は、外部電源(AC電源)による駆動だけでなく、バッテリ駆動が可能である。

パーソナルコンピュータ10は、図2に示すように、CPU111、ノースブリッジ114、主メモリ115、グラフィクスプロセッシングユニット(GPU)116、サウスブリッジ117、BIOS−ROM120、ハードディスクドライブ(HDD)121、光ディスクドライブ(ODD)122、エンベデッドコントローラIC(EC)140、電源回路141等を備えている。

パーソナルコンピュータ10は、OS200の制御により、例えば2つのLCD14,16において、1画面を表示することもできるし、それぞれに独立した画面(例えばアプリケーション毎の画面)を表示することもできる。以下の説明では、LCD14,16において1画面を表示し、一方のLCD14に表示されたフォルダ(あるいはファイル)を、タッチパネル15,17に対する操作によって他方のLCD16に移動させる場合を例にする。

図4は、第1の方法により処理モードを設定する処理を示すフローチャートである。図5は、LCD14に表示されたフォルダを表すアイコンAの一例を示している。

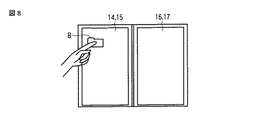

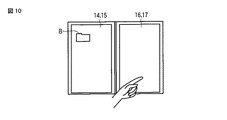

図7は、第2の方法により処理モードを設定する処理を示すフローチャートである。図8〜図11は、第2の方法を説明するためのLCD14,16におけるアイコンの表示例を示している。

図12は、第3の方法により処理モードを設定する処理を示すフローチャートである。

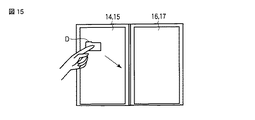

図14は、第4の方法により処理モードを設定する処理を示すフローチャートである。図15及び図16は、第4の方法を説明するためのLCD14におけるアイコンの表示例を示している。

図17は、第5の方法により処理モードを設定する処理を示すフローチャートである。第5の方法により処理モードを設定できるようにするために、パーソナルコンピュータ10には、圧力センサ15a,17aが装着されたタッチパネル15,17を実装する。

Claims (7)

- 第1及び第2のタッチパネルと、

ディスプレイと、

前記第1のタッチパネルに対する特定の操作を検出する検出手段と、

前記検出手段により前記特定の操作が検出された場合に、前記特定の操作に応じた処理モードを設定する設定手段と、

前記第2のタッチパネルに対する操作に応じて、前記処理モードに応じた処理をする処理手段と、

前記処理手段による処理の結果を前記ディスプレイに表示する表示手段と

を具備したことを特徴とする電子機器。 - 前記検出手段は、前記ディスプレイに表示されたオブジェクトを指定する操作を検出し、

前記設定手段は、前記オブジェクトに対する処理に対応する処理モードを設定することを特徴とする請求項1記載の電子機器。 - 前記検出手段は、

前記第1のタッチパネルに接触されている第1の位置と第2の位置とを前記ディスプレイに表示された前記オブジェクトに対応する位置に移動させ、前記第1の位置と前記第2の位置の移動先における距離を特定範囲内に含まれるようにする操作を検出することを特徴とする請求項2記載の電子機器。 - 前記検出手段は、

前記第1のタッチパネルに接触されている位置が前記ディスプレイに表示された前記オブジェクトに対応する位置であり、接触時間が一定時間以上である操作を検出することを特徴とする請求項2記載の電子機器。 - 前記検出手段は、

前記第1のタッチパネルに接触されている位置が前記ディスプレイに表示された前記オブジェクトに対応する位置であり、接触面積を規定値以上とする操作を検出することを特徴とする請求項2記載の電子機器。 - 前記検出手段は、

前記第1のタッチパネルに対して、前記ディスプレイに表示された前記オブジェクトに対応する第1の位置が接触され、接触された状態のまま前記第1の位置を前記第1のタッチパネルに対して予め設定された特定範囲内の第2の位置に移動させる操作を検出することを特徴とする請求項2記載の電子機器。 - 前記第1のタッチパネルに対する接触の圧力を検出する圧力センサをさらに具備し、

前記検出手段は、

前記第1のタッチパネルに接触されている位置が前記ディスプレイに表示された前記オブジェクトに対応する位置であり、前記圧力センサにより検出される接触の圧力が一定値以上である操作を検出することを特徴とする請求項2記載の電子機器。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2009282109A JP4843706B2 (ja) | 2009-12-11 | 2009-12-11 | 電子機器 |

| US12/964,509 US20110141044A1 (en) | 2009-12-11 | 2010-12-09 | Electronic apparatus |

| US13/661,992 US20130050127A1 (en) | 2009-12-11 | 2012-10-26 | Electronic apparatus |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2009282109A JP4843706B2 (ja) | 2009-12-11 | 2009-12-11 | 電子機器 |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2011220863A Division JP2012027940A (ja) | 2011-10-05 | 2011-10-05 | 電子機器 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2011123761A true JP2011123761A (ja) | 2011-06-23 |

| JP4843706B2 JP4843706B2 (ja) | 2011-12-21 |

Family

ID=44142361

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2009282109A Active JP4843706B2 (ja) | 2009-12-11 | 2009-12-11 | 電子機器 |

Country Status (2)

| Country | Link |

|---|---|

| US (2) | US20110141044A1 (ja) |

| JP (1) | JP4843706B2 (ja) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2015064316A1 (ja) * | 2013-10-30 | 2015-05-07 | シャープ株式会社 | 情報処理装置およびプログラム |

| JP2022539908A (ja) * | 2019-07-22 | 2022-09-13 | 維沃移動通信有限公司 | アイコン表示方法及び端末機器 |

Families Citing this family (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR101842906B1 (ko) * | 2011-02-10 | 2018-05-15 | 삼성전자주식회사 | 복수의 터치스크린을 가지는 장치 및 복수의 터치스크린을 가지는 장치의 화면 변경방법 |

| US8775947B2 (en) * | 2011-08-11 | 2014-07-08 | International Business Machines Corporation | Data sharing software program utilizing a drag-and-drop operation and spring-loaded portal |

| TW201327345A (zh) * | 2011-12-16 | 2013-07-01 | Fih Hong Kong Ltd | 電子裝置的檔案移動系統及方法 |

| CN102880422A (zh) * | 2012-09-27 | 2013-01-16 | 深圳Tcl新技术有限公司 | 触摸屏智能设备文字处理方法和装置 |

| TWI492163B (zh) * | 2013-02-20 | 2015-07-11 | Smartdisplayer Technology Co Ltd | Electronic card and its capacitive touch sensing method |

| JP6359862B2 (ja) * | 2014-04-17 | 2018-07-18 | シャープ株式会社 | タッチ操作入力装置、タッチ操作入力方法及びプログラム |

| US10338636B2 (en) * | 2017-09-16 | 2019-07-02 | Lenovo (Singapore) Pte. Ltd. | Computing device with keyboard mode |

| JP7490967B2 (ja) * | 2020-01-27 | 2024-05-28 | 富士通株式会社 | 表示制御プログラム、表示制御方法、及び表示制御装置 |

| US11957240B2 (en) * | 2020-11-03 | 2024-04-16 | Mark Kenneth Melville | Portable modular height-adjustable table |

Citations (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0683779A (ja) * | 1992-08-31 | 1994-03-25 | Toshiba Corp | 表示装置 |

| JPH0822436A (ja) * | 1994-07-05 | 1996-01-23 | Matsushita Electric Ind Co Ltd | 電子機器 |

| JPH10293644A (ja) * | 1997-04-18 | 1998-11-04 | Idec Izumi Corp | タッチパネル付表示装置 |

| JP2001517813A (ja) * | 1997-09-19 | 2001-10-09 | ボルグワード・ロールス・グレン | デジタルブック |

| JP2001290585A (ja) * | 2000-01-31 | 2001-10-19 | Canon Inc | 位置情報処理装置及びその方法及びそのプログラム、操作装置及びその方法及びそのプログラム |

| JP3143445U (ja) * | 2007-05-15 | 2008-07-24 | 宏達國際電子股▲ふん▼有限公司 | 接触動作を妨げない電子デバイス |

| JP2009211547A (ja) * | 2008-03-05 | 2009-09-17 | Seiko Epson Corp | 表示システム、表示装置及びプログラム |

Family Cites Families (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6545669B1 (en) * | 1999-03-26 | 2003-04-08 | Husam Kinawi | Object-drag continuity between discontinuous touch-screens |

| US7138983B2 (en) * | 2000-01-31 | 2006-11-21 | Canon Kabushiki Kaisha | Method and apparatus for detecting and interpreting path of designated position |

| JP2004185258A (ja) * | 2002-12-03 | 2004-07-02 | Hitachi Ltd | 情報処理装置 |

| US8134536B2 (en) * | 2007-05-15 | 2012-03-13 | Htc Corporation | Electronic device with no-hindrance touch operation |

| US20090237374A1 (en) * | 2008-03-20 | 2009-09-24 | Motorola, Inc. | Transparent pressure sensor and method for using |

-

2009

- 2009-12-11 JP JP2009282109A patent/JP4843706B2/ja active Active

-

2010

- 2010-12-09 US US12/964,509 patent/US20110141044A1/en not_active Abandoned

-

2012

- 2012-10-26 US US13/661,992 patent/US20130050127A1/en not_active Abandoned

Patent Citations (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0683779A (ja) * | 1992-08-31 | 1994-03-25 | Toshiba Corp | 表示装置 |

| JPH0822436A (ja) * | 1994-07-05 | 1996-01-23 | Matsushita Electric Ind Co Ltd | 電子機器 |

| JPH10293644A (ja) * | 1997-04-18 | 1998-11-04 | Idec Izumi Corp | タッチパネル付表示装置 |

| JP2001517813A (ja) * | 1997-09-19 | 2001-10-09 | ボルグワード・ロールス・グレン | デジタルブック |

| JP2001290585A (ja) * | 2000-01-31 | 2001-10-19 | Canon Inc | 位置情報処理装置及びその方法及びそのプログラム、操作装置及びその方法及びそのプログラム |

| JP3143445U (ja) * | 2007-05-15 | 2008-07-24 | 宏達國際電子股▲ふん▼有限公司 | 接触動作を妨げない電子デバイス |

| JP2009211547A (ja) * | 2008-03-05 | 2009-09-17 | Seiko Epson Corp | 表示システム、表示装置及びプログラム |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2015064316A1 (ja) * | 2013-10-30 | 2015-05-07 | シャープ株式会社 | 情報処理装置およびプログラム |

| JP2015087933A (ja) * | 2013-10-30 | 2015-05-07 | シャープ株式会社 | 情報処理装置およびプログラム |

| JP2022539908A (ja) * | 2019-07-22 | 2022-09-13 | 維沃移動通信有限公司 | アイコン表示方法及び端末機器 |

| JP7247417B2 (ja) | 2019-07-22 | 2023-03-28 | 維沃移動通信有限公司 | アイコン表示方法及び端末機器 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20110141044A1 (en) | 2011-06-16 |

| US20130050127A1 (en) | 2013-02-28 |

| JP4843706B2 (ja) | 2011-12-21 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2012027940A (ja) | 電子機器 | |

| JP4843706B2 (ja) | 電子機器 | |

| JP4865053B2 (ja) | 情報処理装置およびドラッグ制御方法 | |

| US8681115B2 (en) | Information processing apparatus and input control method | |

| US20110296329A1 (en) | Electronic apparatus and display control method | |

| JP5490508B2 (ja) | タッチセンサを有する装置、触感呈示方法及び触感呈示プログラム | |

| JP5237980B2 (ja) | 座標入力装置、座標入力方法、およびコンピュータが実行可能なプログラム | |

| JP4163713B2 (ja) | 情報処理装置およびタッチパッド制御方法 | |

| JP4956644B2 (ja) | 電子機器、及び入力制御方法 | |

| JP2010218422A (ja) | 情報処理装置および情報処理装置の制御方法 | |

| JP6162299B1 (ja) | 情報処理装置、入力切替方法、及びプログラム | |

| CN103197824A (zh) | 信息处理装置、信息处理方法和计算机程序 | |

| JP6293209B2 (ja) | 情報処理装置、誤操作抑制方法、及びプログラム | |

| JP2011248465A (ja) | 情報処理装置および表示制御方法 | |

| WO2013081594A1 (en) | Input mode based on location of hand gesture | |

| JP2011134127A (ja) | 情報処理装置およびキー入力方法 | |

| JP4892068B2 (ja) | 情報処理装置及び画像表示方法 | |

| US20210333923A1 (en) | Information processing apparatus and input control method | |

| JP6705033B1 (ja) | 情報処理装置及びその入力制御方法並びにプログラム | |

| JP5458130B2 (ja) | 電子機器、及び入力制御方法 | |

| JP2011054213A (ja) | 情報処理装置および制御方法 | |

| JP2012064232A (ja) | 情報処理装置およびドラッグ制御方法 | |

| JP6139647B1 (ja) | 情報処理装置、入力判定方法、及びプログラム | |

| JP5362061B2 (ja) | 情報処理装置および仮想キーボードの表示方法 | |

| JP2010218122A (ja) | 情報入力装置、オブジェクト表示方法、およびコンピュータが実行可能なプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20110412 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20110610 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20110913 |

|

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20111007 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 4843706 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20141014 Year of fee payment: 3 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313121 Free format text: JAPANESE INTERMEDIATE CODE: R313117 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |