JP2005149409A - 画像再生方法及び装置 - Google Patents

画像再生方法及び装置 Download PDFInfo

- Publication number

- JP2005149409A JP2005149409A JP2003389659A JP2003389659A JP2005149409A JP 2005149409 A JP2005149409 A JP 2005149409A JP 2003389659 A JP2003389659 A JP 2003389659A JP 2003389659 A JP2003389659 A JP 2003389659A JP 2005149409 A JP2005149409 A JP 2005149409A

- Authority

- JP

- Japan

- Prior art keywords

- annotation

- display

- displayed

- range

- image

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Withdrawn

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T15/00—Three-dimensional [3D] image rendering

- G06T15/10—Geometric effects

- G06T15/20—Perspective computation

- G06T15/205—Image-based rendering

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating three-dimensional [3D] models or images for computer graphics

- G06T19/003—Navigation within 3D models or images

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2219/00—Indexing scheme for manipulating 3D models or images for computer graphics

- G06T2219/004—Annotating, labelling

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Computer Graphics (AREA)

- Software Systems (AREA)

- Computer Hardware Design (AREA)

- General Engineering & Computer Science (AREA)

- Remote Sensing (AREA)

- Radar, Positioning & Navigation (AREA)

- Computing Systems (AREA)

- Geometry (AREA)

- Processing Or Creating Images (AREA)

- User Interface Of Digital Computer (AREA)

- Image Generation (AREA)

- Controls And Circuits For Display Device (AREA)

Abstract

【課題】アノテーションの表示位置を仮想空間内の視点位置からのオブジェクトの見え方に応じて変えることにより、アノテーションとオブジェクトの対応の誤認を防止する。

【解決手段】操作部10により、実写画像中のオブジェクトに対して、アノテーションを正面位置に表示する正面モードと、アノテーションをオブジェクト上に表示するオブジェクトモードを実行すべき第2視点位置範囲が視点位置の移動経路上に設定される。アノテーション表示位置決定部50は、移動経路に沿った視点位置の移動に応じて実写画像群を再生する間、視点位置が第1視点範囲にある場合、オブジェクトのアノテーションに対して上記正面モードを実行する。また、視点位置が第2視点範囲にある場合は、上記アノテーションに対してオブジェクトモードを実行する。

【選択図】図1

【解決手段】操作部10により、実写画像中のオブジェクトに対して、アノテーションを正面位置に表示する正面モードと、アノテーションをオブジェクト上に表示するオブジェクトモードを実行すべき第2視点位置範囲が視点位置の移動経路上に設定される。アノテーション表示位置決定部50は、移動経路に沿った視点位置の移動に応じて実写画像群を再生する間、視点位置が第1視点範囲にある場合、オブジェクトのアノテーションに対して上記正面モードを実行する。また、視点位置が第2視点範囲にある場合は、上記アノテーションに対してオブジェクトモードを実行する。

【選択図】図1

Description

本発明は、現実空間の撮影によって得られた実写画像データをもとに構築される仮想空間において、実写画像上にアノテーションを表示する機能を備えた画像再生方法及び装置に関する。

移動体に搭載された撮影装置によって撮影された実写画像データをもとに、撮影した現実空間を計算機を用いて仮想空間として表現する試みが提案されている(例えば、非特許文献1、または非特許文献2などを参照)。

実写画像データをもとに撮影した現実空間を仮想空間として表現する手法としては、実写画像データから現実空間の幾何形状モデルを再現し、従来のCG技術で表現する手法が挙げられるが、モデルの正確性や写実性の点で限界がある。一方、幾何形状モデルの再現を行わずに、実写画像を用いて仮想空間を表現するImage-Based Rendering(IBR)技術が近年注目を集めている。IBR技術は実写画像に基づいているために、写実的な仮想空間の表現が可能である。また、都市や町のような広大な空間の幾何形状モデルを作成するためには膨大な時間や労力が必要とされるが、IBR技術ではそのような時間や労力は必要とされないという長所も有する。

IBR技術を用いてウォークスルー可能な仮想空間を構築するためには、体験者の仮想空間内の位置に応じた画像の生成・呈示を行う必要がある。そのため、この種のシステムにおいては、実写画像データの各画像フレームと仮想空間内の位置を対応付けて保存しておき、体験者の仮想空間における位置と視線方向に基づいて対応する画像フレームを取得し、これを再生する。

また、このような仮想空間内のウォークスルーにおいては、体験者が各視点位置で所望の方向を見ることができるように、各視点位置に対応する画像フレームを再生時の画角よりも広い範囲をカバーするパノラマ画像で保存しておく。そして、再生時には、体験者の仮想空間内の視点位置に基づいてパノラマ画像を読出し、視線方向に基づいて部分画像をパノラマ画像から切り出して表示する。仮想空間内における視点位置の軌跡が撮影装置を搭載した車輌の軌跡と同一である場合、観察者はあたかも自分がその車輌に乗って走っているかのような感覚を味わうことができる。

さらに、このような仮想空間内のウォークスルーにおいては、表示画像中のビルの上にビルの名前などのアノテーション(注釈)を合成して表示することにより、観察者により豊富な情報を提供することができる。また、実写画像上では暗くて見えにくい標識などをアノテーションとして見やすく表示することも可能である。

遠藤、片山、田村、廣瀬、渡辺、谷川:"移動車輌搭載カメラを用いた都市空間の電脳映像化について"(信学ソサイエティ、PA-3-4、pp.276-277、1997年) 廣瀬、渡辺、谷川、遠藤、片山、田村:"移動車輌搭載カメラを用いた電脳映像都市空間の構築(2)−実写画像を用いた広域仮想空間の生成−"(日本バーチャルリアリティ学会第2回大会論文集、pp.67-70、1997年)

遠藤、片山、田村、廣瀬、渡辺、谷川:"移動車輌搭載カメラを用いた都市空間の電脳映像化について"(信学ソサイエティ、PA-3-4、pp.276-277、1997年) 廣瀬、渡辺、谷川、遠藤、片山、田村:"移動車輌搭載カメラを用いた電脳映像都市空間の構築(2)−実写画像を用いた広域仮想空間の生成−"(日本バーチャルリアリティ学会第2回大会論文集、pp.67-70、1997年)

しかしながら、前述のようなIBR技術によって構築されているウォークスルーシステムにおいて、アノテーションを常にビルなどのオブジェクトの上に表示しようとすると、アノテーションを表示したいオブジェクトが他のオブジェクトによって隠蔽されている場合には、そのアノテーションがどのオブジェクトに関するアノテーションか識別することができなくなってしまう。或いはアノテーションとオブジェクトとの対応付けを誤認してしまう。また、仮想空間内の視点位置とオブジェクトの距離が遠い場合、オブジェクトが小さく見えるため、オブジェクトがアノテーションに隠れてしまう可能性がある。

本発明は、上記の課題に鑑みてなされたものであり、アノテーションの表示態様を、仮想空間内の視点位置とオブジェクトの位置関係に応じて変更することにより、アノテーションが対象とするオブジェクトの誤認を防止することを目的とする。

上記の目的を達成するための本発明による画像再生方法は、

実写画像群によって構成される仮想空間内でアノテーションを表示可能な画像再生方法であって、

実写画像中のオブジェクトに対して、アノテーションを該オブジェクトの位置にかかわらず所定の位置に表示する第1モードを実行する第1視点位置範囲と、アノテーションを該オブジェクト上に表示する第2モードを実行する第2視点位置範囲が視点位置の移動経路上に設定されたアノテーション情報を読み取る工程と、

前記移動経路に沿った視点位置の移動に応じて前記実写画像群を再生する間、該視点位置が前記第1視点範囲もしくは前記第2視点範囲にあるかを判定する判定工程と、

前記オブジェクトのアノテーションを、前記判定工程により前記視点位置が前記第1視点範囲にあると判定された場合は前記第1モードで表示し、前記第2視点範囲にあると判定された場合は前記第2モードで表示する表示制御工程とを備える。

実写画像群によって構成される仮想空間内でアノテーションを表示可能な画像再生方法であって、

実写画像中のオブジェクトに対して、アノテーションを該オブジェクトの位置にかかわらず所定の位置に表示する第1モードを実行する第1視点位置範囲と、アノテーションを該オブジェクト上に表示する第2モードを実行する第2視点位置範囲が視点位置の移動経路上に設定されたアノテーション情報を読み取る工程と、

前記移動経路に沿った視点位置の移動に応じて前記実写画像群を再生する間、該視点位置が前記第1視点範囲もしくは前記第2視点範囲にあるかを判定する判定工程と、

前記オブジェクトのアノテーションを、前記判定工程により前記視点位置が前記第1視点範囲にあると判定された場合は前記第1モードで表示し、前記第2視点範囲にあると判定された場合は前記第2モードで表示する表示制御工程とを備える。

また、上記の目的を達成するための本発明による画像再生装置は以下の構成を備える。すなわち、

実写画像群によって構成される仮想空間内でアノテーションを表示可能な画像再生装置であって、

実写画像中のオブジェクトに対して、アノテーションを該オブジェクトの位置にかかわらず所定の位置に表示する第1モードを実行する第1視点位置範囲と、アノテーションを該オブジェクト上に表示する第2モードを実行する第2視点位置範囲が視点位置の移動経路上に設定されたアノテーション情報を保持する保持手段と、

前記移動経路に沿った視点位置の移動に応じて前記実写画像群を再生する間、該視点位置が前記第1視点範囲もしくは前記第2視点範囲にあるかを判定する判定手段と、

前記オブジェクトのアノテーションを、前記判定手段により前記視点位置が前記第1視点範囲にあると判定された場合は前記第1モードで表示し、前記第2視点範囲にあると判定された場合は前記第2モードで表示する表示制御手段とを備える。

実写画像群によって構成される仮想空間内でアノテーションを表示可能な画像再生装置であって、

実写画像中のオブジェクトに対して、アノテーションを該オブジェクトの位置にかかわらず所定の位置に表示する第1モードを実行する第1視点位置範囲と、アノテーションを該オブジェクト上に表示する第2モードを実行する第2視点位置範囲が視点位置の移動経路上に設定されたアノテーション情報を保持する保持手段と、

前記移動経路に沿った視点位置の移動に応じて前記実写画像群を再生する間、該視点位置が前記第1視点範囲もしくは前記第2視点範囲にあるかを判定する判定手段と、

前記オブジェクトのアノテーションを、前記判定手段により前記視点位置が前記第1視点範囲にあると判定された場合は前記第1モードで表示し、前記第2視点範囲にあると判定された場合は前記第2モードで表示する表示制御手段とを備える。

上記の構成によれば、アノテーションの表示位置を仮想空間内の視点位置とオブジェクトの位置関係に応じて変えることにより、ユーザはアノテーションとオブジェクトとの対応を容易に、正しく認識することができる。

以下、添付図面を参照しながら、本発明の好適な実施形態を説明する。

<第1実施形態>

まず、本実施形態による仮想空間のウォークスルーシステムについて説明する。本実施形態のウォークスルーシステムでは、実写画像データからパノラマ画像データを生成し、このパノラマ画像データを、現実空間の位置に対応する地図上の位置と対応付けて保持する。ここで、実写画像データは、例えば自動車などの移動体に搭載された複数の撮影装置によって撮影されたものである。そして、体験者の仮想空間における視点位置(地図上の位置)と視線方向に応じて、保持されているパノラマ画像データから表示画像を生成することにより、仮想空間内のウォークスルーを行う。

まず、本実施形態による仮想空間のウォークスルーシステムについて説明する。本実施形態のウォークスルーシステムでは、実写画像データからパノラマ画像データを生成し、このパノラマ画像データを、現実空間の位置に対応する地図上の位置と対応付けて保持する。ここで、実写画像データは、例えば自動車などの移動体に搭載された複数の撮影装置によって撮影されたものである。そして、体験者の仮想空間における視点位置(地図上の位置)と視線方向に応じて、保持されているパノラマ画像データから表示画像を生成することにより、仮想空間内のウォークスルーを行う。

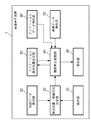

図1は、本実施形態によるウォークスルーシステムの機能構成を説明するブロック図である。本ウォークスルーシステムを構成する画像再生装置1は、操作部10、視点位置・視線方向決定部20、地図データ保存部30、画像再生制御部40、アノテーション表示位置決定部50、アノテーションデータ保存部60、画像データ保存部70、表示部80を有する。

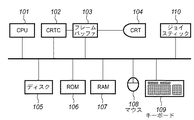

図2は、本実施形態における画像再生装置1のハード構成を示すブロック図である。図2に示したハード構成は通常のパーソナルコンピュータの構成と同等である。図2において、ディスク105はハードディスクやCD−ROM等の外部記憶媒体であり、CPU101が必要に応じて必要なデータを読み取ることができる。画像データ保存部70、地図データ保存部30、アノテーションデータ保存部60はディスク105によって構成される。

CPU101は、ROM106に格納されたプログラムを実行することにより、或いはディスク105または他の外部記憶装置(不図示)等に保存されているプログラムをRAM107へロードして実行することにより、視点位置・視線方向決定部20、画像再生制御部40、アノテーション表示位置決定部50として機能する。

また、CPU101が表示コントローラ102に対して各種の表示指示を行うことにより、表示コントローラ102はフレームバッファ103を用いて表示器104に各種の表示を行なう。CRTC102、フレームバッファ103及びCRT104は、上述の表示部80を構成する。なお、図2では表示部80の表示コントローラ102としてCRTC、表示器104としてCRTを示したが、表示部80に利用可能な表示器は陰極線管に限らず、液晶表示器等を用いてもよいことはもちろんである。

マウス108、キーボード109及びジョイスティック110は、当該画像再生装置1へのユーザの操作入力を行うためのものであり、上述の操作部10を構成する。

次に、以上の構成を備えた第1実施形態のウォークスルーシステムにおける、画像再生装置1の動作の概要について説明する。

操作部10が有するマウス108、キーボード109、ジョイスティック110等へのユーザ操作に基づいて視点位置の移動パラメータ、視線方向の回転パラメータが生成される。なお、第1実施形態では、視点位置・視線方向の制御にジョイスティック110を用いているが、ゲームコントローラ等の他の入力装置で行ってもよい。ジョイスティック110は、スティックの傾斜角と回転角を独立に制御することができる。なお、本実施形態では、ジョイスティック110を傾斜させる操作を仮想空間内での視点位置の移動に、ジョイスティック110を左右に回転させる動作を視線方向の回転に対応させる。

地図データ保存部30は、2次元地図画像データを格納する。視点位置・視線方向決定部20は、操作部10からの移動パラメータ、回転パラメータをもとに、地図データ保存部30に保存されている地図画像上における観察者の視点位置、視線方向を決定する。画像データ保存部70は、地図上の各位置に対応したパノラマ画像データを格納する。なお、画像データ保存部70は、画像再生装置1のローカルに存在する必要はなく、ネットワーク上に設置して、ネットワークを介して画像データを読み出すようにしてもよい。画像再生制御部40は、視点位置・視線方向決定部20から、観察者の地図上での視点位置及び視線方向を受け取り、その視点位置に対応した画像データを画像データ保存部70から読み出す。

次に、第1実施形態による、地図上の視点位置と画像データを対応付ける対応付けデータのデータ格納形態について説明する。

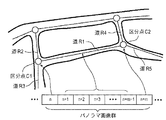

本実施形態では、観察者の移動を撮影経路上に限定する。そして、交差点(分岐点)や曲がり角等に区分点を設定し、それら区分点と、2つの区分点に挟まれた道を用いて移動経路を表現する。区分点は2次元地図画像上に設定され、道は区分点に挟まれた線分となる。各区分点や道にはIDが割り当てられ、区分点には対応する実空間の位置で撮影されたパノラマ画像が、道には両端の区分点に割り当てられたパノラマ画像に挟まれたパノラマ画像群が割り当てられる。

図3はこの様子を説明する図である。図3において、IDがC1である区分点とC2である区分点に挟まれた線分(道)にR1というIDが付与されている。そしてGPSデータ等に基づいて区分点C1とC2に対応するパノラマ画像が特定される。この結果、区分点C1にはフレーム番号nのパノラマ画像が、区分点C2にはフレーム番号n+mのパノラマ画像が割り当てられる。区分点にパノラマ画像が割り当てられると、区分点C1とC2に挟まれた道R1には自動的にフレーム番号n+1からn+m−1までのパノラマ画像群が割り当てられる。

また、図4の(a)に示すように、各区分点は、対応するパノラマ画像と地図上での2次元座標を属性として持つ。同様に、図4(b)に示すように、各道は対応するパノラマ画像と各パノラマ画像の地図上での2次元座標を有する。パノラマ画像の地図上での2次元座標は、GPSデータによって得られる緯度・経度データから求められるが、コンピュータ・ビジョンの技術を利用して画像情報から求めてもよい。また、両端の区分点の座標のみを求め、当該区分点間の道に含まれる各パノラマ画像の地図上の2次元座標は補間によって求めてもよい。

更に、画像再生制御部40は、アノテーション表示位置決定部50に地図上の視点位置を与える。アノテーション表示位置決定部50は、受け取った視点位置情報をもとにアノテーションの表示位置を決定し、画像再生制御部40にアノテーション表示位置を与える。アノテーションの表示位置の決定方法については後述する。画像再生制御部40は、表示部80に表示する画角にあわせてパノラマ画像を切り出して射影変換を行い、アノテーション表示位置に従ってアノテーション画像を合成して表示部80に表示する画像を生成する。そして、表示部80は画像再生制御部40により生成された画像を表示する。

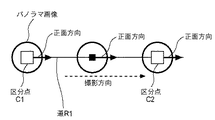

次に、アノテーション表示位置決定部50の動作について詳細に説明する。図5に示すように、本実施形態では、区分点に挟まれる道上において、パノラマ画像の正面方向は道の方向、つまり撮影時の進行方向であるとする。

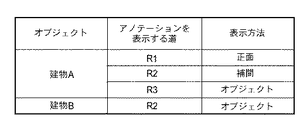

図6はアノテーション表示位置決定部50におけるアノテーション表示位置決定方法を説明する図である。ここでは、建物Aに関するアノテーションを、区分点C1からC4の間で表示させる。

本実施形態では、3種類のアノテーション表示方法(「正面モード」、「オブジェクトモード」、「補間モード」)を視点位置に応じて使い分ける。例えば、建物A上にアノテーションを表示する場合、図6中に破線で示すように、区分点C1、C2及び道R1上においては、建物Bに建物Aが隠されてしまい、アノテーションが建物B上に表示されてしまう。そこで、建物Aに関するアノテーションが建物B上に表示されないように、区分点C1とC2、道R1上においては、建物Aに関するアノテーションを建物Aの方向にではなく、パノラマ画像の正面方向に表示する。このようにアノテーションを正面方向に表示することにより、アノテーションを看板や標識として利用することができる。このようなアノテーションの表示方法「正面モード」と称する。

また、区分点C3とC4、道R3上においては、建物Aが建物Bに隠れないので建物A上に表示する。このようなアノテーションの表示方法を「オブジェクトモード」と称する。さらに、アノテーションが突然消えたりせずに連続して見えるように、区分点C2からC3、道R2上においては、正面方向から徐々に建物Aの方向に向くようにアノテーションの表示方向を補間する。このようなアノテーションの表示方法を「補間モード」と称する。

なお、区分点C1〜C4は、ユーザが実写画像を再生しながらマニュアルで設定するものとする。すなわち、ユーザはアノテーションの表示方法を「正面モード」から「補間モード」へ変化させるべき位置を区分点C2として、「補間モード」から「オブジェクトモード」へ変化させるべき位置を区分点C3として設定する。この設定の結果、アノテーションに関して図8のようなデータが生成、格納されることになる。詳細は後述する。

更にアノテーションの表示位置決定方法を詳細に説明する。簡単のために、図6に示すように、区分点C1をxy平面の原点とし、区分点C2、C3、C4はすべてx軸上にあるとする(すなわち道R1、R2、R3はx軸の一部である)。

図6において、建物Aのアノテーションを表示したい位置の座標は(xa,ya)である。区分点C3に対応するパノラマ画像において、建物Aのアノテーションを表示する水平方向の位置は、パノラマ画像の正面方向からの相対角度θ1(rad)で表すと、次式で表される。

また、区分点C4に対応するパノラマ画像において、建物Aのアノテーションを表示する水平方向の位置は、パノラマ画像の正面方向からの相対角度θ2で表すと、次式で表される。

同様にして、道R3上の点(x,0)に対応するパノラマ画像において、建物Aのアノテーションを表示する水平方向の位置は、パノラマ画像の正面方向からの相対角度θで表すと、次式で表される。

区分点C1及びC2、道R1上では、建物Aに関するアノテーションを常にパノラマ画像の正面方向に表示するため、アノテーションを表示する水平方向の位置θは次式で表される。

次に、道R2上におけるアノテーションの表示位置を説明する。建物Aに関するアノテーションは、区分点C2上では正面方向(θ=0)に表示され、道R2上で徐々に建物Aの方向へ移動し、区分点C3上では前述のθ1の方向に表示される。道R2上において、アノテーション表示方向は補間によって求められる。道R2上の点(x,0)に対応するパノラマ画像において、建物Aのアノテーションを表示する水平方向の位置θは次式で表される。

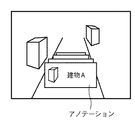

図7にアノテーションが表示される様子を示す。図7(a)は「正面モード」における表示例であり、アノテーションがパノラマ画像の正面方向(進行方向)、すなわちθ=0の位置に表示される様子を示す。なお、このときのパノラマ画像上の縦方向の位置(図7におけるZ軸方向位置)は、zorgとする。すなわち、θ=0、Z=zorgを中心としてアノテーション701が表示される。本来のアノテーション位置711にアノテーション701を表示すると、当該アノテーションが建物Bに対するものであると誤認される可能性があるが、図7(a)のような表示形態をとることによりそのような誤認を防止できる。

その後、視点位置が区分点C2、C3及び道R2上に到達すると「補間モード」によるアノテーション表示が行なわれ、図7(b)に示されるように、式(5)によって算出されたθTによって画像上の横方向位置が決定される。なお、縦方向位置は、その時点における建物Aのアノテーション表示位置711とzorgを結ぶ直線712によって決定する。すなわち、θTの位置を示す直線713と直線712との交点を中心としてアノテーション701を表示する。更に、道R3上に視点位置が移動すると、図7(c)に示すように、本来のアノテーション表示位置にアノテーション701が表示されるようになる。

なお、「補間」におけるアノテーション表示のZ方向位置zTは、「正面モード」におけるアノテーションのZ方向表示位置をzorgとし、「オブジェクトモード」におけるアノテーションのZ方向表示位置をz711とした場合に、以下の式(6)から求めてもよい(式中のx、x1、x2は式(5)と同じである)。

なお、図7(a)のようにアノテーションを表示する場合は、視界を遮る場合があるので、画面中央ではなく、上下方向にずらして表示してもよい。

図8にアノテーションデータの格納形式を示す。アノテーションデータは、オブジェクトごとに記述される。各オブジェクトについて、アノテーションが表示される道と、その道における表示方法を記述する。ここで表示方法とは、パノラマ画像の正面方向に表示する(図7(a)の表示状態(正面モード))か、オブジェクトの方向に表示する(図7(c)の表示状態(オブジェクトモード))か、正面方向からオブジェクト方向の間に表示する(図7(b)の表示状態(補間モード))かを表す。

図9に、アノテーション表示位置決定部50におけるアノテーション表示位置決定のフローチャートを示す。

まずステップS101において、新たな視点情報(視点位置、視線方向)を獲得する。次にステップS102において、ステップS101で獲得した視点情報から決定される道が、前のフレームと同じ道か否かを判定する。前のフレームと異なる新たな道である場合には、ステップS103に進む。ステップS103において、該当する道についてアノテーションを表示するオブジェクトを決定する。本実施形態では、複数のオブジェクトに対してアノテーションを表示することができる。例えば、図8のようなアノテーションデータを有する場合に、視点位置が道R2にあれば、建物A及び建物Bがアノテーションを表示すべきオブジェクトに決定される。ステップS103においてアノテーションを表示するオブジェクトを決定した後、ステップS104に進む。ステップS104において、各オブジェクトの表示方法を図8に示したアノテーションデータより決定する。例えば、道R2にある場合、建物Aのアノテーションは「正面モード」に、建物Bのアノテーションは「オブジェクトモード」に設定される。そして、ステップS105へ進む。一方、ステップS102において、同じ道であると判定された場合は、そのままステップS105に進む。

ステップS105では、アノテーションを表示するすべてのオブジェクトについて、該当する視点位置及び表示方法に対応したパノラマ画像におけるアノテーションの表示位置(パノラマ画像の正面方向からの相対角度)θを求める。また、表示方法が「補間」となっている場合は、図7(b)で説明した方法によりアノテーションの表示位置を求める。ステップS106において終了判定を行い、まだ終了しない場合は、ステップS101において新たに視点情報を獲得する。なお、「正面モード」で複数のアノテーションを表示する場合は、例えば第4実施形態で説明するような方法でアノテーションを表示すればよい。

以上のように、第1実施形態によれば、アノテーションの表示位置を、仮想空間内の視点位置とオブジェクトの位置との相対関係によって変更することにより、アノテーションが別のオブジェクトのものと混同されることを防止できる。また、どのオブジェクトに関するアノテーションかを簡単に、且つ確実に識別することが可能になる。

<第2実施形態>

第1実施形態では、視点の位置によりアノテーションの添付対象オブジェクトが見えない場合等、添付対象オブジェクト上にアノテーションを表示するとそのアノテーションの添付対象を誤認する可能性がある場合に、アノテーションの表示位置を変更することにより、誤認を防止した。しかしながら、一般に、アノテーションにはオブジェクトと視点位置との距離を表すような情報は含まれない。このため、第1実施形態によれば、図7の(a)に示した表示状態では、「正面モード」で表示されるアノテーションの形状は一定であり、当該アノテーションの付与されたオブジェクトまで近いのか遠いのかはわからない。そこで、第2実施形態では、仮想空間内の視点位置とオブジェクトの位置との相対関係によって表示するアノテーションの見た目(アノテーションの表示の体裁等)を変更することにより仮想空間内の観察者とオブジェクトとの位置関係を観察者が容易に把握できるようにする。

第1実施形態では、視点の位置によりアノテーションの添付対象オブジェクトが見えない場合等、添付対象オブジェクト上にアノテーションを表示するとそのアノテーションの添付対象を誤認する可能性がある場合に、アノテーションの表示位置を変更することにより、誤認を防止した。しかしながら、一般に、アノテーションにはオブジェクトと視点位置との距離を表すような情報は含まれない。このため、第1実施形態によれば、図7の(a)に示した表示状態では、「正面モード」で表示されるアノテーションの形状は一定であり、当該アノテーションの付与されたオブジェクトまで近いのか遠いのかはわからない。そこで、第2実施形態では、仮想空間内の視点位置とオブジェクトの位置との相対関係によって表示するアノテーションの見た目(アノテーションの表示の体裁等)を変更することにより仮想空間内の観察者とオブジェクトとの位置関係を観察者が容易に把握できるようにする。

図10は第2実施形態の一例を示す図である。図10(a)では、アノテーションをパノラマの正面方向に表示しているか、オブジェクト上に表示しているかによって表示するアノテーションの形状を変更している。表示するアノテーションの形状を変更することにより、観察者はすでにオブジェクトを観察できる位置に到達してオブジェクトそのものを観察しているのか、まだオブジェクトに到達していないのかをより明確に知ることができる。特にそのオブジェクトを始めてみる観察者にとっては、アノテーションとオブジェクトの対応を把握し易くなり、有用である。なお、アノテーションがパノラマ画像の正面方向に表示されている場合には、オブジェクトに近づくに従って徐々にアノテーションの矩形枠の縦方向の大きさを大きくしていくことで観察者がオブジェクトとの位置関係を容易に把握することが可能となる。

図10(b)では、仮想空間内の観察者とオブジェクトとの距離に応じて表示するアノテーションの透明度を変化させている。アノテーションがパノラマ画像の正面方向に表示されている場合には透明度を上げ、オブジェクト上に表示されている場合には透明度を下げる。また、アノテーションがパノラマ画像の正面方向に表示されている場合には、オブジェクトに近づくに従って徐々に透明度を下げることで、観察者がオブジェクトとの位置関係を容易に把握することができる。

図10(c)では、仮想空間内の観察者とオブジェクトとの距離に応じて表示するアノテーションの大きさを変化させている。アノテーションがパノラマ画像の正面方向に表示されている場合には小さく表示して目立たなくし、オブジェクト上に表示されている場合には大きく表示して目立つようにする。また、アノテーションがパノラマ画像の正面方向に表示されている場合には、オブジェクトに近づくに従って徐々にアノテーションを大きくしていくことで、観察者がオブジェクトとの位置関係を認識することができる。

以上のように、第2実施形態によれば、仮想空間内の視点位置とオブジェクトの位置との相対関係に応じて表示するアノテーションの形状や透明度、大きさ等の表示態様を変更することにより、観察者がアノテーションをもとにオブジェクトとの位置関係を把握することができる。すなわち、仮想空間内の視点位置とオブジェクトの位置との相対関係によって表示するアノテーションを変更することにより、仮想空間内の観察者とオブジェクトとの位置関係を観察者が容易に把握できるようになる。なお、視点位置とオブジェクトとの間の距離は、例えば、仮想空間内の視点位置から各オブジェクトへの直線距離もしくは、経路上の距離によって計算することができる。

また、第1実施形態では、アノテーションが付与されたオブジェクトが視認可能である場合にオブジェクト上にアノテーションが表示されることになるが、視点位置から対象オブジェクトが遠い場合にはオブジェクトの大きさが小さくなり、そのままアノテーションを表示するとオブジェクトがアノテーションによって隠されてしまう可能性がある。第2実施形態によれば、図10(b)や(c)のように、視点位置から対象オブジェクトが遠い場合に透明度を高くしたり、矩形枠の大きさを小さくすることにより、対象オブジェクトの表示サイズが小さくても、アノテーションによって対象オブジェクトを隠してしまうことを防止できるという効果もある。

<第3実施形態>

第2実施形態では、仮想空間内の視点位置とオブジェクトの位置との相対関係に応じてアノテーションの表示形態を変更することによって、観察者がオブジェクトとの位置関係を把握できるようにした。第3実施形態では、例えば図7(a)のように正面にアノテーションを表示している場合に、当該アノテーション上に対応するオブジェクトまでの道案内の情報を表示する。これにより、オブジェクトから離れている場合(オブジェクトが観察できない場合)でも、アノテーションの案内情報を頼りにオブジェクトまで到達できるようにする。

第2実施形態では、仮想空間内の視点位置とオブジェクトの位置との相対関係に応じてアノテーションの表示形態を変更することによって、観察者がオブジェクトとの位置関係を把握できるようにした。第3実施形態では、例えば図7(a)のように正面にアノテーションを表示している場合に、当該アノテーション上に対応するオブジェクトまでの道案内の情報を表示する。これにより、オブジェクトから離れている場合(オブジェクトが観察できない場合)でも、アノテーションの案内情報を頼りにオブジェクトまで到達できるようにする。

図11は、第3実施形態におけるアノテーション表示の動作を説明する図である。図11(a)の地図上に示す、経路A→B→C→Dにおいて建物Aに関するアノテーションが表示されると仮定する。但し、建物Aは他の建物に隠蔽されているため、経路C→D上からしか観察することができない。

経路A→B上において、観察者がBの方向を向いているときには、図11(b)に示すようなアノテーションが表示される。アノテーション上には、次の交差点で右に曲がることを促す矢印が同時に表示されるため、観察者は建物Aにたどり着くまでの道順を知ることができる。同様に経路B→C上において観察者がCの方向を向いているときには、図11(c)に示すように、アノテーション上に次の交差点で左に曲がることを促す矢印が同時に表示される。経路C→D上では、建物Aは観察可能であるために、アノテーション上に矢印は特に表示されない。なお、経路C→D上においても、他の建物に隠れる等により建物Aが見えない場合ある。従って、建物Aが見えていない間、(図7(a)の表示状態)では直進を示す矢印を表示するようにしてもよい。

なお、アノテーション上に表示する矢印は、リアルタイムに経路探索を行って表示時にアノテーション上に合成してもよいし、あらかじめオブジェクトまでの経路を決めておき、アノテーション画像上に合成しておいて、それを表示時に読み出してもよい。また、第3実施形態では道案内の情報の表示方法として、次の交差点での進行方向を示したが、他の形態であってもかまわない。

以上のように、第3実施形態によれば、アノテーション上に例えば次の交差点でどちらに曲がれば該当するオブジェクトにたどり着けるかというような案内情報を示すことにより、仮想空間内でオブジェクトから離れていても、観察者が容易にオブジェクトに到達することができる。すなわち、アノテーション上に道案内の情報を表示することで、オブジェクトから離れている場合でも、案内情報を頼りにオブジェクトまで到達することが可能になる。

<第4実施形態>

第1実施形態では、アノテーションの表示位置を、仮想空間内の視点位置とオブジェクトの位置との相対関係によって変更することにより、アノテーションが指し示すオブジェクトの誤認識を防止し、どのオブジェクトに関するアノテーションかを簡単に識別できるようにした。第4実施形態では、パノラマ画像の正面方向に複数のアノテーションが表示される場合に、観察者に最も近いオブジェクトのアノテーションを手前に表示することにより、観察者に混乱を生じさせないようにする。

第1実施形態では、アノテーションの表示位置を、仮想空間内の視点位置とオブジェクトの位置との相対関係によって変更することにより、アノテーションが指し示すオブジェクトの誤認識を防止し、どのオブジェクトに関するアノテーションかを簡単に識別できるようにした。第4実施形態では、パノラマ画像の正面方向に複数のアノテーションが表示される場合に、観察者に最も近いオブジェクトのアノテーションを手前に表示することにより、観察者に混乱を生じさせないようにする。

図12は、第4実施形態におけるアノテーション表示の様子を表す図である。図12に示すように、パノラマ画像の正面方向に表示される複数のアノテーションが、奥行き順に整列されて表示される。奥行きは、仮想空間内の視点位置から各オブジェクトへの直線距離もしくは、経路上の距離によって計算される。

また、図13に示すように、ユーザインタフェースからの入力によって、奥行き順に並んでいるアノテーションを切り替えて表示することも可能である。これにより、現在進行中の経路を進んでいくとどのようなオブジェクトを観察できるのかを観察者が知ることができる。

あるいは、図14に示されるように、奥行き順に並んでいるアノテーションのうち、何枚目のアノテーションを示しているかがわかるように表示してもよい。

以上のように、第4実施形態によれば、奥行き順にアノテーションを表示することにより、観察者が混乱するのを避けたり、さらに奥行き順に並んでいるアノテーションを切替表示することにより、オブジェクトに到達する前に観察者があらかじめ観察可能なオブジェクトを知ることができる。

また、本発明の目的は、前述した実施形態の機能を実現するソフトウェアのプログラムコードを記録した記憶媒体を、システムあるいは装置に供給し、そのシステムあるいは装置のコンピュータ(またはCPUやMPU)が記憶媒体に格納されたプログラムコードを読出し実行することによっても、達成されることは言うまでもない。

この場合、記憶媒体から読出されたプログラムコード自体が前述した実施形態の機能を実現することになり、そのプログラムコードを記憶した記憶媒体は本発明を構成することになる。

プログラムコードを供給するための記憶媒体としては、例えば、フレキシブルディスク,ハードディスク,光ディスク,光磁気ディスク,CD−ROM,CD−R,磁気テープ,不揮発性のメモリカード,ROMなどを用いることができる。

また、コンピュータが読出したプログラムコードを実行することにより、前述した実施形態の機能が実現されるだけでなく、そのプログラムコードの指示に基づき、コンピュータ上で稼働しているOS(オペレーティングシステム)などが実際の処理の一部または全部を行い、その処理によって前述した実施形態の機能が実現される場合も含まれることは言うまでもない。

さらに、記憶媒体から読出されたプログラムコードが、コンピュータに挿入された機能拡張ボードやコンピュータに接続された機能拡張ユニットに備わるメモリに書込まれた後、そのプログラムコードの指示に基づき、その機能拡張ボードや機能拡張ユニットに備わるCPUなどが実際の処理の一部または全部を行い、その処理によって前述した実施形態の機能が実現される場合も含まれることは言うまでもない。

Claims (14)

- 実写画像群によって構成される仮想空間内でアノテーションを表示可能な画像再生方法であって、

実写画像中のオブジェクトに対するアノテーションと、該アノテーションを該オブジェクトの位置にかかわらず所定の位置に表示させる第1モードを実行すべき第1範囲と、該アノテーションを該オブジェクト上に表示させる第2モードを実行すべき第2範囲とを視点位置の移動経路に沿って規定する規定情報とを含むアノテーション情報を取得する取得工程と、

前記移動経路に沿った視点位置の移動に応じて前記実写画像群を再生する間、該視点位置が前記第1範囲もしくは前記第2範囲にあるかを判定する判定工程と、

前記オブジェクトのアノテーションを、前記判定工程により前記視点位置が前記第1範囲にあると判定された場合は前記第1モードで表示させ、前記第2範囲にあると判定された場合は前記第2モードで表示させる表示制御工程とを備えることを特徴とする画像再生方法。 - 前記アノテーション情報に含まれる前記規定情報は、更に前記移動経路上の前記第1範囲と前記第2範囲との間に設定された第3範囲を規定し、ここで、該第3範囲は前記第1モードによるアノテーションの表示位置から前記第2モードによる表示位置へアノテーションの表示位置を視点位置の移動に従って移動させる第3モードを実行すべき範囲であり、

前記判定工程は、前記視点位置が前記第3範囲にあるか否かを更に判定し、

前記表示制御工程は、前記第3範囲に視点位置が存在する場合には、前記第3表示モードにより前記アノテーションの表示位置を決定して表示させることを特徴とする請求項1に記載の画像再生方法。 - 前記表示制御工程は、前記第1表示モードと前記第2表示モードとで、前記アノテーションの表示形態を変更させることを特徴とする請求項1又は2に記載の画像再生方法。

- 前記表示制御工程は、前記第1表示モードにおいて、前記視点位置と前記オブジェクトとの距離に基づいて前記アノテーションの表示形態を変更させることを特徴とする請求項1又は2に記載の画像再生方法。

- 前記表示制御工程は、前記第1表示モードにおいて、アノテーション表示中にオブジェクトへ到達するための経路案内を表示させることを特徴とする請求項1又は2に記載の画像再生方法。

- 前記表示制御工程は、前記第1表示モードで表示すべきアノテーションが複数存在する場合に、オブジェクトの位置が仮想空間内の観察者の位置に近い順に手前からアノテーションを表示させ、ユーザ操作によって表示するアノテーションを順次切り替えて表示させることを特徴とする請求項1又は2に記載の画像再生方法。

- 実写画像群によって構成される仮想空間内でアノテーションを表示可能な画像再生装置であって、

実写画像中のオブジェクトに対するアノテーションと、該アノテーションを該オブジェクトの位置にかかわらず所定の位置に表示させる第1モードを実行すべき第1範囲と、該アノテーションを該オブジェクト上に表示させる第2モードを実行すべき第2範囲とを視点位置の移動経路に沿って規定する規定情報とを含むアノテーション情報を保持する保持手段と、

前記移動経路に沿った視点位置の移動に応じて前記実写画像群を再生する間、該視点位置が前記第1範囲もしくは前記第2範囲にあるかを判定する判定手段と、

前記オブジェクトのアノテーションを、前記判定手段により前記視点位置が前記第1範囲にあると判定された場合は前記第1モードで表示させ、前記第2範囲にあると判定された場合は前記第2モードで表示させる表示制御手段とを備えることを特徴とする画像再生装置。 - 実写パノラマ画像群によって構成される仮想空間内でアノテーションを表示可能な画像再生方法において、

観察者の位置においてアノテーションを表示するオブジェクトが視界に入る状態では該オブジェクト上をアノテーション表示位置とし、視界に入らない状態では観察者の進行方向をアノテーション表示位置とし、遷移状態では補間によってアノテーション表示位置を決定するアノテーション表示位置決定工程を備える画像再生方法。 - 進行方向正面に表示されるアノテーションが複数存在する場合、仮想空間内の観察者の位置に最も近いオブジェクトのアノテーションを手前に表示し、ユーザ操作によってアノテーションを順次切り替えて表示することを特徴とする請求項8に記載の画像再生方法。

- 前記アノテーション表示位置決定工程は、

仮想空間内における観察者とアノテーションを表示するオブジェクトとの距離に応じて、アノテーションの表示形態を決定することを特徴とする請求項8に記載の画像再生方法。 - 前記アノテーションの表示形態は、前記観察者とアノテーションを表示するオブジェクトとの距離に応じてアノテーションの形状、透明度、大きさのうち少なくとも一つが変化することを特徴とする請求項10に記載の画像再生方法。

- 前記アノテーションの表示形態には、仮想空間内における現在位置から該オブジェクトに到達するまでのガイド情報を付与することを特徴とする請求項10または11に記載の画像再生方法。

- 請求項1乃至6と8乃至12のいずれかに記載の画像再生方法をコンピュータによって実現させるための制御プログラムを格納する記憶媒体。

- 請求項1乃至6と8乃至12のいずれかに記載の画像再生方法をコンピュータによって実現させるための制御プログラム。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003389659A JP2005149409A (ja) | 2003-11-19 | 2003-11-19 | 画像再生方法及び装置 |

| US10/988,615 US7626596B2 (en) | 2003-11-19 | 2004-11-16 | Image reproducing method and apparatus for displaying annotations on a real image in virtual space |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003389659A JP2005149409A (ja) | 2003-11-19 | 2003-11-19 | 画像再生方法及び装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2005149409A true JP2005149409A (ja) | 2005-06-09 |

| JP2005149409A5 JP2005149409A5 (ja) | 2007-01-11 |

Family

ID=34616260

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2003389659A Withdrawn JP2005149409A (ja) | 2003-11-19 | 2003-11-19 | 画像再生方法及び装置 |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US7626596B2 (ja) |

| JP (1) | JP2005149409A (ja) |

Cited By (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008102467A (ja) * | 2006-10-19 | 2008-05-01 | Kokusai Kogyo Co Ltd | サインオブジェクト表示システム |

| JP2010233161A (ja) * | 2009-03-30 | 2010-10-14 | Denso It Laboratory Inc | 撮像システム、端末装置、サーバ装置および撮像方法 |

| JP2011081557A (ja) * | 2009-10-06 | 2011-04-21 | Sony Corp | 情報処理装置、情報処理方法およびプログラム |

| JP2011215412A (ja) * | 2010-03-31 | 2011-10-27 | Zenrin Datacom Co Ltd | 地図画像処理装置、地図画像処理方法及び地図画像処理プログラム |

| JP2011233005A (ja) * | 2010-04-28 | 2011-11-17 | Ntt Docomo Inc | オブジェクト表示装置、オブジェクト表示システム及びオブジェクト表示方法 |

| WO2013121471A1 (ja) * | 2012-02-16 | 2013-08-22 | パナソニック株式会社 | 映像生成装置 |

| JP2014054428A (ja) * | 2012-09-13 | 2014-03-27 | Fujifilm Corp | 3次元画像表示装置および方法並びにプログラム |

| JP2014071663A (ja) * | 2012-09-28 | 2014-04-21 | Brother Ind Ltd | ヘッドマウントディスプレイ、それを作動させる方法およびプログラム |

| JP2014222446A (ja) * | 2013-05-14 | 2014-11-27 | 大日本印刷株式会社 | 映像出力装置、映像出力方法、及びプログラム |

| JP2015069444A (ja) * | 2013-09-30 | 2015-04-13 | 大日本印刷株式会社 | 映像出力装置、映像出力方法、及びプログラム |

| JP2015069445A (ja) * | 2013-09-30 | 2015-04-13 | 大日本印刷株式会社 | 映像出力装置、映像出力方法、及びプログラム |

| JP2021002321A (ja) * | 2019-06-20 | 2021-01-07 | Mig株式会社 | 情報処理装置、情報処理方法及び情報処理プログラム |

Families Citing this family (60)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CA2559726C (en) * | 2004-03-24 | 2015-10-20 | A9.Com, Inc. | System and method for displaying images in an online directory |

| JP4522129B2 (ja) * | 2004-03-31 | 2010-08-11 | キヤノン株式会社 | 画像処理方法および画像処理装置 |

| JP2005339377A (ja) * | 2004-05-28 | 2005-12-08 | Canon Inc | 画像処理方法、画像処理装置 |

| US8195386B2 (en) * | 2004-09-28 | 2012-06-05 | National University Corporation Kumamoto University | Movable-body navigation information display method and movable-body navigation information display unit |

| JP4667111B2 (ja) * | 2005-04-21 | 2011-04-06 | キヤノン株式会社 | 画像処理装置、画像処理方法 |

| JP4739002B2 (ja) * | 2005-06-30 | 2011-08-03 | キヤノン株式会社 | 画像処理方法、画像処理装置 |

| JP4914039B2 (ja) * | 2005-07-27 | 2012-04-11 | キヤノン株式会社 | 情報処理方法および装置 |

| US7836437B2 (en) * | 2006-02-10 | 2010-11-16 | Microsoft Corporation | Semantic annotations for virtual objects |

| JP2007306353A (ja) * | 2006-05-12 | 2007-11-22 | Opt Kk | 動画の表示方法、動画表示システムおよび広角動画撮像装置 |

| JP5154775B2 (ja) * | 2006-08-18 | 2013-02-27 | 任天堂株式会社 | ゲームプログラムおよびゲーム装置 |

| US20100030462A1 (en) * | 2007-02-15 | 2010-02-04 | Pioneer Corporation | Display control apparatus, display control method, display control program, and recording medium |

| JP2008217590A (ja) * | 2007-03-06 | 2008-09-18 | Fuji Xerox Co Ltd | 情報共有支援システム、情報処理装置及び制御プログラム |

| US7990394B2 (en) * | 2007-05-25 | 2011-08-02 | Google Inc. | Viewing and navigating within panoramic images, and applications thereof |

| CN101680766B (zh) * | 2007-05-31 | 2013-01-23 | 松下电器产业株式会社 | 图像摄影装置、附加信息提供服务器及附加信息过滤系统 |

| US8375397B1 (en) | 2007-11-06 | 2013-02-12 | Google Inc. | Snapshot view of multi-dimensional virtual environment |

| US8595299B1 (en) | 2007-11-07 | 2013-11-26 | Google Inc. | Portals between multi-dimensional virtual environments |

| US8732591B1 (en) | 2007-11-08 | 2014-05-20 | Google Inc. | Annotations of objects in multi-dimensional virtual environments |

| JP4994256B2 (ja) * | 2008-01-28 | 2012-08-08 | 株式会社ジオ技術研究所 | 経路案内データベースのデータ構造 |

| JP5111210B2 (ja) * | 2008-04-09 | 2013-01-09 | キヤノン株式会社 | 画像処理装置、画像処理方法 |

| US20100085350A1 (en) * | 2008-10-02 | 2010-04-08 | Microsoft Corporation | Oblique display with additional detail |

| US9477368B1 (en) | 2009-03-31 | 2016-10-25 | Google Inc. | System and method of indicating the distance or the surface of an image of a geographical object |

| US8462153B2 (en) * | 2009-04-24 | 2013-06-11 | Schlumberger Technology Corporation | Presenting textual and graphic information to annotate objects displayed by 3D visualization software |

| US20110115671A1 (en) * | 2009-11-17 | 2011-05-19 | Qualcomm Incorporated | Determination of elevation of mobile station |

| KR100989663B1 (ko) * | 2010-01-29 | 2010-10-26 | (주)올라웍스 | 단말 장치의 시야에 포함되지 않는 객체에 대한 정보를 제공하기 위한 방법, 단말 장치 및 컴퓨터 판독 가능한 기록 매체 |

| JP5743416B2 (ja) * | 2010-03-29 | 2015-07-01 | ソニー株式会社 | 情報処理装置、情報処理方法、およびプログラム |

| US20110279445A1 (en) * | 2010-05-16 | 2011-11-17 | Nokia Corporation | Method and apparatus for presenting location-based content |

| KR20110139375A (ko) * | 2010-06-23 | 2011-12-29 | 삼성전자주식회사 | 위치 정보가 포함된 이미지의 디스플레이 방법 및 장치 |

| US8890896B1 (en) * | 2010-11-02 | 2014-11-18 | Google Inc. | Image recognition in an augmented reality application |

| US9639857B2 (en) | 2011-09-30 | 2017-05-02 | Nokia Technologies Oy | Method and apparatus for associating commenting information with one or more objects |

| US9047688B2 (en) | 2011-10-21 | 2015-06-02 | Here Global B.V. | Depth cursor and depth measurement in images |

| US9116011B2 (en) | 2011-10-21 | 2015-08-25 | Here Global B.V. | Three dimensional routing |

| US8553942B2 (en) | 2011-10-21 | 2013-10-08 | Navteq B.V. | Reimaging based on depthmap information |

| JP6056127B2 (ja) * | 2011-10-31 | 2017-01-11 | ソニー株式会社 | 情報処理装置、情報処理方法、及びプログラム |

| US9361283B2 (en) * | 2011-11-30 | 2016-06-07 | Google Inc. | Method and system for projecting text onto surfaces in geographic imagery |

| US9404764B2 (en) | 2011-12-30 | 2016-08-02 | Here Global B.V. | Path side imagery |

| US9024970B2 (en) | 2011-12-30 | 2015-05-05 | Here Global B.V. | Path side image on map overlay |

| EP2817958A1 (en) * | 2012-02-22 | 2014-12-31 | Sony Ericsson Mobile Communications AB | Method and device relating to image content |

| US9395875B2 (en) * | 2012-06-27 | 2016-07-19 | Ebay, Inc. | Systems, methods, and computer program products for navigating through a virtual/augmented reality |

| US9429912B2 (en) * | 2012-08-17 | 2016-08-30 | Microsoft Technology Licensing, Llc | Mixed reality holographic object development |

| CN105264572B (zh) * | 2013-04-04 | 2018-09-21 | 索尼公司 | 信息处理设备、信息处理方法和程序 |

| EP2983140A4 (en) * | 2013-04-04 | 2016-11-09 | Sony Corp | DISPLAY CONTROL DEVICE, DISPLAY CONTROL METHOD AND PROGRAM |

| DE102014225513B4 (de) * | 2014-12-11 | 2026-03-19 | Robert Bosch Gmbh | Verfahren und Steuergerät zum Einstellen einer Charakteristik einer Lichtaussendung zumindest eines Scheinwerfers eines Fahrzeugs |

| DE102014225517A1 (de) * | 2014-12-11 | 2016-06-16 | Robert Bosch Gmbh | Verfahren und Steuergerät zum Einstellen zumindest eines Parameters einer Fahrerassistenzvorrichtung eines Fahrzeugs |

| RU2602386C1 (ru) * | 2015-05-26 | 2016-11-20 | Общество с ограниченной ответственностью "Лаборатория 24" | Способ визуализации объекта |

| RU2597462C1 (ru) | 2015-07-17 | 2016-09-10 | Виталий Витальевич Аверьянов | Способ отображения объекта на пространственной модели |

| JP6971544B2 (ja) | 2015-08-06 | 2021-11-24 | キヤノン株式会社 | 画像処理装置、画像処理方法、およびプログラム |

| US11699266B2 (en) * | 2015-09-02 | 2023-07-11 | Interdigital Ce Patent Holdings, Sas | Method, apparatus and system for facilitating navigation in an extended scene |

| US10217283B2 (en) | 2015-12-17 | 2019-02-26 | Google Llc | Navigation through multidimensional images spaces |

| US10254398B2 (en) * | 2016-04-28 | 2019-04-09 | Fluke Corporation | Manipulation of 3-D RF imagery and on-wall marking of detected structure |

| JP6711715B2 (ja) | 2016-07-19 | 2020-06-17 | キヤノン株式会社 | 画像処理装置および画像処理方法 |

| JP6840481B2 (ja) | 2016-07-19 | 2021-03-10 | キヤノン株式会社 | 画像処理装置および画像処理方法 |

| JP2018110615A (ja) | 2017-01-06 | 2018-07-19 | キヤノン株式会社 | 画像処理装置および画像処理方法 |

| US10262236B2 (en) | 2017-05-02 | 2019-04-16 | General Electric Company | Neural network training image generation system |

| JP7022554B2 (ja) | 2017-10-03 | 2022-02-18 | キヤノン株式会社 | 画像処理装置およびその制御方法、プログラム |

| WO2019163128A1 (ja) * | 2018-02-26 | 2019-08-29 | 三菱電機株式会社 | 仮想物体表示制御装置、仮想物体表示システム、仮想物体表示制御方法、及び仮想物体表示制御プログラム |

| US11880540B2 (en) | 2018-03-22 | 2024-01-23 | Hewlett-Packard Development Company, L.P. | Digital mark-up in a three dimensional environment |

| CN120876699A (zh) * | 2018-09-26 | 2025-10-31 | 相干逻辑公司 | 任何世界视图生成 |

| US11924393B2 (en) * | 2021-01-22 | 2024-03-05 | Valeo Comfort And Driving Assistance | Shared viewing of video among multiple users |

| US11983822B2 (en) | 2022-09-02 | 2024-05-14 | Valeo Comfort And Driving Assistance | Shared viewing of video with prevention of cyclical following among users |

| US20250111605A1 (en) * | 2023-09-29 | 2025-04-03 | Apple Inc. | Systems and methods of annotating in a three-dimensional environment |

Family Cites Families (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4072330B2 (ja) | 2001-10-31 | 2008-04-09 | キヤノン株式会社 | 表示装置および情報処理方法 |

| US7411594B2 (en) | 2002-01-15 | 2008-08-12 | Canon Kabushiki Kaisha | Information processing apparatus and method |

| US20060195858A1 (en) * | 2004-04-15 | 2006-08-31 | Yusuke Takahashi | Video object recognition device and recognition method, video annotation giving device and giving method, and program |

-

2003

- 2003-11-19 JP JP2003389659A patent/JP2005149409A/ja not_active Withdrawn

-

2004

- 2004-11-16 US US10/988,615 patent/US7626596B2/en not_active Expired - Fee Related

Cited By (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008102467A (ja) * | 2006-10-19 | 2008-05-01 | Kokusai Kogyo Co Ltd | サインオブジェクト表示システム |

| US8479121B2 (en) | 2006-10-19 | 2013-07-02 | Kokusai Kogyo Co., Ltd. | Sign object presentation system |

| JP2010233161A (ja) * | 2009-03-30 | 2010-10-14 | Denso It Laboratory Inc | 撮像システム、端末装置、サーバ装置および撮像方法 |

| JP2011081557A (ja) * | 2009-10-06 | 2011-04-21 | Sony Corp | 情報処理装置、情報処理方法およびプログラム |

| JP2011215412A (ja) * | 2010-03-31 | 2011-10-27 | Zenrin Datacom Co Ltd | 地図画像処理装置、地図画像処理方法及び地図画像処理プログラム |

| JP2011233005A (ja) * | 2010-04-28 | 2011-11-17 | Ntt Docomo Inc | オブジェクト表示装置、オブジェクト表示システム及びオブジェクト表示方法 |

| WO2013121471A1 (ja) * | 2012-02-16 | 2013-08-22 | パナソニック株式会社 | 映像生成装置 |

| JP2014054428A (ja) * | 2012-09-13 | 2014-03-27 | Fujifilm Corp | 3次元画像表示装置および方法並びにプログラム |

| JP2014071663A (ja) * | 2012-09-28 | 2014-04-21 | Brother Ind Ltd | ヘッドマウントディスプレイ、それを作動させる方法およびプログラム |

| JP2014222446A (ja) * | 2013-05-14 | 2014-11-27 | 大日本印刷株式会社 | 映像出力装置、映像出力方法、及びプログラム |

| JP2015069444A (ja) * | 2013-09-30 | 2015-04-13 | 大日本印刷株式会社 | 映像出力装置、映像出力方法、及びプログラム |

| JP2015069445A (ja) * | 2013-09-30 | 2015-04-13 | 大日本印刷株式会社 | 映像出力装置、映像出力方法、及びプログラム |

| JP2021002321A (ja) * | 2019-06-20 | 2021-01-07 | Mig株式会社 | 情報処理装置、情報処理方法及び情報処理プログラム |

Also Published As

| Publication number | Publication date |

|---|---|

| US7626596B2 (en) | 2009-12-01 |

| US20050116964A1 (en) | 2005-06-02 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2005149409A (ja) | 画像再生方法及び装置 | |

| US10217288B2 (en) | Method for representing points of interest in a view of a real environment on a mobile device and mobile device therefor | |

| Höllerer et al. | Mobile augmented reality | |

| EP2672459B1 (en) | Apparatus and method for providing augmented reality information using three dimension map | |

| JP2009020089A (ja) | ナビゲーション装置、ナビゲーション方法、及びナビゲーション用プログラム | |

| WO2006092853A1 (ja) | 地図表示装置および地図表示方法 | |

| US20040174386A1 (en) | Information processing method and image reproduction apparatus | |

| EP2905746A1 (en) | Stereoscopic map display system | |

| TW202300867A (zh) | 導航方法、電腦設備及電腦可讀儲存媒體 | |

| JP4105609B2 (ja) | ナビゲーション用立体表示方法およびナビゲーション装置 | |

| JPWO2007142084A1 (ja) | ナビゲーション装置 | |

| JP6345381B2 (ja) | 拡張現実システム | |

| Schmalstieg et al. | Augmented reality as a medium for cartography | |

| US11568579B2 (en) | Augmented reality content generation with update suspension | |

| JP2013225275A (ja) | 3次元画像表示システム | |

| JP2010231741A (ja) | 電子タグ作成表示システム、電子タグ作成表示装置およびそれらの方法 | |

| JP2005174024A (ja) | 画像生成装置及び方法 | |

| JP2004150918A (ja) | 地図表示方法 | |

| JP2004062755A (ja) | 画像提示装置および情報処理方法 | |

| CN112558008A (zh) | 基于光通信装置的导航方法、系统、设备及介质 | |

| JP3551184B2 (ja) | 案内システム及び地図データサーバ装置、地図データ表示端末装置 | |

| JP2005180957A (ja) | ナビゲーション装置およびランドマーク表示方法 | |

| JP3460719B2 (ja) | 地図データ表示装置及び地図データ表示方法 | |

| JP2005345299A (ja) | 地図表示装置 | |

| JP2001229363A (ja) | 3次元地図表示装置及び3次元地図上のシンボル表示方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20061120 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20061120 |

|

| A761 | Written withdrawal of application |

Free format text: JAPANESE INTERMEDIATE CODE: A761 Effective date: 20080919 |