WO2014132474A1 - 画像処理装置、内視鏡装置、画像処理方法及び画像処理プログラム - Google Patents

画像処理装置、内視鏡装置、画像処理方法及び画像処理プログラム Download PDFInfo

- Publication number

- WO2014132474A1 WO2014132474A1 PCT/JP2013/075627 JP2013075627W WO2014132474A1 WO 2014132474 A1 WO2014132474 A1 WO 2014132474A1 JP 2013075627 W JP2013075627 W JP 2013075627W WO 2014132474 A1 WO2014132474 A1 WO 2014132474A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- image

- subject

- known characteristic

- amount

- enhancement

- Prior art date

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/00002—Operational features of endoscopes

- A61B1/00004—Operational features of endoscopes characterised by electronic signal processing

- A61B1/00009—Operational features of endoscopes characterised by electronic signal processing of image signals during a use of endoscope

- A61B1/000095—Operational features of endoscopes characterised by electronic signal processing of image signals during a use of endoscope for image enhancement

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/00002—Operational features of endoscopes

- A61B1/00004—Operational features of endoscopes characterised by electronic signal processing

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/04—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor combined with photographic or television appliances

- A61B1/05—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor combined with photographic or television appliances characterised by the image sensor, e.g. camera, being in the distal end portion

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/06—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements

- A61B1/0638—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements providing two or more wavelengths

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/06—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements

- A61B1/0646—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor with illuminating arrangements with illumination filters

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/31—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor for the rectum, e.g. proctoscopes, sigmoidoscopes, colonoscopes

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/20—Analysis of motion

- G06T7/215—Motion-based segmentation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/00163—Optical arrangements

- A61B1/00193—Optical arrangements adapted for stereoscopic vision

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B1/00—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor

- A61B1/273—Instruments for performing medical examinations of the interior of cavities or tubes of the body by visual or photographical inspection, e.g. endoscopes; Illuminating arrangements therefor for the upper alimentary canal, e.g. oesophagoscopes, gastroscopes

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30004—Biomedical image processing

Definitions

- the present invention relates to an image processing apparatus, an endoscope apparatus, an image processing method, an image processing program, and the like.

- a process for facilitating observation of the difference in the structure and color of the subject is performed by performing image enhancement.

- a technique disclosed in Patent Document 1 is known as a technique for enhancing the structure of a subject by image processing.

- a technique for identifying a lesion site by color enhancement a technique disclosed in Patent Document 2 is known.

- an image processing device an endoscope device, an image processing method, an image processing program, and the like that can perform enhancement processing according to an observation state.

- One aspect of the present invention is an image acquisition unit that acquires a captured image including an image of a subject, a motion amount acquisition unit that acquires a motion amount of the subject, and known characteristic information that is information representing a known characteristic related to the subject.

- This is related to an image processing apparatus that includes a known characteristic information acquisition unit that acquires the image data and an enhancement processing unit that performs enhancement processing based on the known characteristic information with the processing content corresponding to the amount of motion.

- the enhancement process based on the known characteristic information that is information representing the known characteristic related to the subject is performed with the processing content corresponding to the amount of movement of the subject. This makes it possible to perform enhancement processing according to the observation state.

- a captured image including an image of a subject is acquired, a motion amount of the subject is acquired, known characteristic information that is information representing a known property related to the subject is acquired, and the motion amount is acquired.

- known characteristic information that is information representing a known property related to the subject

- the motion amount is acquired. Is related to an image processing method for performing enhancement processing based on the known characteristic information.

- a captured image including an image of a subject is acquired, a movement amount of the subject is acquired, known characteristic information that is information representing a known characteristic related to the subject is acquired, and the motion

- the present invention relates to an image processing program that causes a computer to execute a step of performing enhancement processing based on the known characteristic information with processing content corresponding to a quantity.

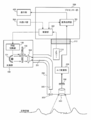

- FIG. 1 is a configuration example of an image processing apparatus.

- FIG. 2 is a configuration example of an endoscope apparatus.

- FIG. 3 is a detailed configuration example of the image processing unit in the first embodiment.

- FIG. 4 is a detailed configuration example of a distance information acquisition unit.

- FIG. 5 is a modified configuration example of the endoscope apparatus.

- FIG. 6 is a detailed configuration example of the enhancement processing unit in the first embodiment.

- FIGS. 7A to 7D are explanatory diagrams of extraction unevenness information extraction processing by filter processing.

- FIGS. 8A to 8F are explanatory diagrams of extraction unevenness information extraction processing by morphological processing.

- FIG. 9 is a flowchart example of image processing in the first embodiment.

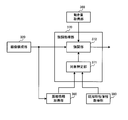

- FIG. 10 is a detailed configuration example of an image processing unit in the second embodiment.

- FIG. 11 is a detailed configuration example of an enhancement processing unit in the second embodiment.

- FIG. 12 is a flowchart example of image processing in the second embodiment.

- Patent Documents 1 and 2 since it is cumbersome for a doctor and a burden on a patient to perform a pigment spraying operation, an attempt has been made to emphasize a color or a concavo-convex structure by image processing and to determine a lesion (for example, Patent Documents 1 and 2).

- an image that is easier to see is obtained by changing the processing content in accordance with the observation state (observation technique). For example, in the case where the entire digestive tract is sequentially viewed by moving relatively quickly as in screening observation, the doctor observes a relatively large structure. Therefore, it is necessary to present on the image so as not to overlook the large structure. On the other hand, when the location of the target is specified by screening and the detailed structure is enlarged (scrutinized observation, proximity observation), the doctor observes the fine structure. Therefore, it is necessary to emphasize the fine structure so that it can be determined whether the target is benign or malignant.

- FIG. 1 shows a configuration example of an image processing apparatus that can solve such a problem.

- This image processing apparatus includes an image acquisition unit 310 that acquires a captured image including an image of a subject, a motion amount acquisition unit 360 that acquires a motion amount of the subject, and known characteristic information that is information representing a known characteristic related to the subject.

- the enhancement processing can be changed according to the observation state by performing the enhancement processing with the processing content corresponding to the amount of movement. Thereby, it is possible to selectively emphasize what should be emphasized in each observation state for easy viewing.

- the enhancement processing unit 370 performs enhancement processing with processing content corresponding to the amount of motion, using a subject that matches the characteristic specified by the known characteristic information as a target of enhancement processing.

- the enhancement processing unit determines that the motion amount corresponds to the motion amount corresponding to the screening observation

- the enhancement processing unit selects a subject that matches the characteristic specified by the known characteristic information as the target of the enhancement process.

- the process 1 emphasis processing is performed.

- a subject that matches the characteristic specified by the known characteristic information is selected as a target of enhancement processing, and the second processing content is different from the first processing content. The processing contents are emphasized.

- the object is an uneven part, a reddish part, and a fading part of a living body, and each part has features (for example, a large structure, a small structure, a region of a predetermined color, etc.) that the user pays attention to in each observation state.

- the enhancement process it is only necessary to emphasize the feature that the user pays attention to according to such an observation state. For example, it is possible to emphasize a relatively large uneven structure in screening observation with a large amount of movement of the subject, and to emphasize a fine uneven structure in an enlarged observation with a small amount of movement of the subject.

- the motion amount is an amount representing the motion of the subject in the captured image, and is, for example, the direction or distance of the motion of the subject on the captured image.

- the direction and distance may be acquired as a motion vector, or if only the speed of motion needs to be known, only the distance may be acquired as the amount of motion.

- Such a motion amount can be obtained, for example, by matching feature points of a captured image between two frames.

- the known characteristic information is information that can separate a useful structure in the present embodiment from a structure that is not so, among the structures on the surface of the subject.

- features of unevenness and color that are useful to enhance (for example, useful for finding early lesions) and color information (for example, the size, hue, and saturation of the unevenness characteristic of lesions) are known characteristics

- a subject that matches the known characteristic information is the target of the enhancement process.

- information on a structure that is not useful even if it is emphasized may be used as the known characteristic information.

- a subject that does not match the known characteristic information is to be emphasized.

- FIG. 2 shows a configuration example of the endoscope apparatus according to the first embodiment.

- the endoscope apparatus includes a light source unit 100, an imaging unit 200, a processor unit 300 (control device), a display unit 400, and an external I / F unit 500.

- the light source unit 100 includes a white light source 101, a rotating color filter 102 having a plurality of spectral transmittances, a rotation driving unit 103 that drives the rotating color filter 102, and light having each spectral characteristic from the rotating color filter 102. And a condensing lens 104 that condenses light on the incident end face of the light guide fiber 201.

- the rotation color filter 102 includes three primary color filters (a red filter, a green filter, and a blue filter) and a rotation motor.

- the rotation driving unit 103 rotates the rotating color filter 102 at a predetermined number of rotations in synchronization with the imaging period of the imaging element 206 of the imaging unit 200 based on a control signal from the control unit 302 of the processor unit 300. For example, if the rotating color filter 102 is rotated 20 times per second, each color filter crosses the incident white light at 1/60 second intervals. In this case, the observation target is irradiated with light of each of the three primary colors (R, G, or B) at 1/60 second intervals, and the image sensor 206 images the reflected light from the observation target. The captured image is transferred to the A / D conversion unit 209. That is, it is an example of an endoscope apparatus in which an R image, a G image, and a B image are captured in a frame sequential manner at 1/60 second intervals, and the actual frame rate is 20 fps.

- the present embodiment is not limited to the above-described frame sequential method.

- the subject may be irradiated with white light from the white light source 101 and may be imaged by an image sensor having a color filter with an RGB Bayer array.

- the imaging unit 200 is formed to be elongated and bendable so that it can be inserted into a body cavity such as the stomach or the large intestine.

- the imaging unit 200 includes a light guide fiber 201 for guiding the light condensed by the light source unit 100, and an illumination lens 203 that diffuses the light guided to the tip by the light guide fiber 201 and irradiates the observation target. Including.

- the imaging unit 200 digitally converts an objective lens 204 that collects reflected light returning from the observation target, an imaging element 206 that detects the focused imaging light, and a photoelectrically converted analog signal from the imaging element 206.

- An A / D conversion unit 209 that converts the signal into a signal.

- the imaging unit 200 includes a memory 210 in which unique information including scope ID information and manufacturing variation of the imaging unit 200 is recorded, and a connector 212 that allows the imaging unit 200 and the processor unit 300 to be attached and detached.

- the image sensor 206 is a monochrome single-plate image sensor, and for example, a CCD or a CMOS image sensor can be used.

- the A / D conversion unit 209 converts the analog signal output from the image sensor 206 into a digital signal, and outputs an image of the digital signal to the image processing unit 301.

- the memory 210 is connected to the control unit 302 and transfers scope ID information and unique information including manufacturing variations to the control unit 302.

- the processor unit 300 includes an image processing unit 301 that performs image processing on an image transferred from the A / D conversion unit 209, and a control unit 302 that controls each unit of the endoscope apparatus.

- the display unit 400 is a display device capable of displaying a moving image, and includes, for example, a CRT or a liquid crystal monitor.

- the external I / F unit 500 is an interface for performing input from the user to the endoscope apparatus.

- the external I / F unit 500 includes, for example, a power switch for turning on / off the power, a shutter button for starting a photographing operation, a mode switching switch for switching a photographing mode and various other modes (for example, a biological surface) For example, a switch for selectively emphasizing the concavo-convex portion).

- the external I / F unit 500 outputs input information to the control unit 302.

- FIG. 3 shows a detailed configuration example of the image processing unit 301.

- the image processing unit 301 includes an image configuration unit 320, an image storage unit 330, a storage unit 350, a motion amount acquisition unit 360, an enhancement processing unit 370, a distance information acquisition unit 380, and a known characteristic information acquisition unit 390.

- the image configuration unit 320 corresponds to the image acquisition unit 310 in FIG.

- the image construction unit 320 performs predetermined image processing (for example, OB processing, gain processing, gamma processing, etc.) on the image captured by the imaging unit 200, and generates an image that can be output to the display unit 400.

- the image configuration unit 320 outputs the processed image to the image storage unit 330, the enhancement processing unit 370, and the distance information acquisition unit 380.

- the image storage unit 330 stores the image output from the image configuration unit 320 for a plurality of frames (a plurality of temporally continuous frames).

- the motion amount acquisition unit 360 calculates the motion amount of the subject in the captured image based on the plurality of frames of images stored in the image storage unit 330 and outputs the motion amount to the enhancement processing unit 370. For example, a matching process is performed between the image of the reference frame and the image of the next frame, and a motion vector between the two frame images is calculated. Then, a motion vector is sequentially calculated over a plurality of frames while shifting the reference image, and an average value of the plurality of motion vectors is calculated as a motion amount.

- the known characteristic information acquisition unit 390 reads (acquires) the known characteristic information stored in the storage unit 350 and outputs the known characteristic information to the enhancement processing unit 370.

- the known characteristic information is the size (dimension information such as width, height, depth, etc.) of the concavo-convex part unique to the living body to be specified as an emphasis target.

- the distance information acquisition unit 380 acquires distance information to the subject based on the captured image, and outputs the distance information to the enhancement processing unit 370.

- the distance information is information in which each position in the captured image is associated with the distance to the subject at each position.

- the distance information is a distance map.

- the distance map is, for example, the distance (depth / depth) in the Z-axis direction to the subject for each point (for example, each pixel) on the XY plane when the optical axis direction of the imaging unit 200 is the Z-axis. It is a map with the value of. Details of the distance information acquisition unit 380 will be described later.

- the enhancement processing unit 370 specifies a target based on the known characteristic information and the distance information, performs an enhancement process on the target according to the amount of motion, and outputs the processed image to the display unit 400. Specifically, an uneven portion that matches a desired dimension characteristic represented by the known characteristic information is extracted from the distance information, and the extracted uneven portion is specified as a target.

- the threshold value for example, during screening observation

- the uneven portion whose size (uneven pattern) is smaller than the second size threshold among the extracted uneven portions is emphasized.

- the first size threshold and the second size threshold may be set in accordance with the size of the concavo-convex portion that is desired to be enhanced in each observation state (or the image after enhancement is easy to see).

- the enhancement processing for example, different color components are emphasized between the concave portion and the convex portion.

- the emphasis process is not limited to the case where the emphasis process is performed on the identified target, and the emphasis process may be performed based on the known characteristic information without performing the object identification.

- a filter characteristic for example, a frequency band to be emphasized

- structure enhancement for example, emphasizing a high frequency component of an image

- the filter characteristics may be changed according to the amount of movement.

- FIG. 4 shows a detailed configuration example of the distance information acquisition unit 380.

- the distance information acquisition unit 380 includes a luminance signal calculation unit 323, a difference calculation unit 324, a secondary differential calculation unit 325, a blur parameter calculation unit 326, a storage unit 327, and an LUT storage unit 328.

- the luminance signal calculation unit 323 obtains the luminance signal Y (luminance value) from the captured image output from the image acquisition unit 310 using the following equation (1).

- the calculated luminance signal Y is transferred to the difference calculation unit 324, the secondary differential calculation unit 325, and the storage unit 327.

- the difference calculation unit 324 calculates the difference of the luminance signal Y from a plurality of images necessary for calculating the blur parameter.

- the secondary differential calculation unit 325 calculates a secondary differential of the luminance signal Y in the image, and calculates an average value of secondary differentials obtained from the plurality of luminance signals Y having different blurs.

- the blur parameter calculation unit 326 calculates the blur parameter by dividing the average value of the second derivative calculated by the second derivative calculation unit 325 from the difference of the luminance signal Y of the image calculated by the difference calculation unit 324.

- the storage unit 327 stores the luminance signal Y and the second derivative result of the first photographed image. Thereby, the distance information acquisition unit 380 can acquire the plurality of luminance signals Y at different times by disposing the focus lens at different positions via the control unit 302.

- the LUT storage unit 328 stores the relationship between the blur parameter and the subject distance in the form of a lookup table (LUT).

- the control unit 302 determines an optimum focus lens position using a known contrast detection method, phase difference detection method, or the like based on a shooting mode preset by the external I / F unit 500. calculate.

- the lens driving unit 250 drives the focus lens to the calculated focus lens position based on a signal from the control unit 302.

- the first image of the subject is acquired by the image sensor 206 at the driven focus lens position.

- the acquired image is stored in the storage unit 327 via the image acquisition unit 310 and the luminance signal calculation unit 323.

- the lens driving unit 250 drives the focus lens to a second focus lens position different from the focus lens position from which the first image was acquired, and the image sensor 206 acquires the second image of the subject. .

- the second image acquired in this way is output to the distance information acquisition unit 380 via the image acquisition unit 310.

- the difference calculation unit 324 reads the luminance signal Y in the first image from the storage unit 327 and is output from the luminance signal Y in the first image and the luminance signal calculation unit 323 2. The difference from the luminance signal Y in the first image is calculated.

- the secondary differential calculation unit 325 calculates the secondary differential of the luminance signal Y in the second image output from the luminance signal calculation unit 323. Thereafter, the luminance signal Y in the first image is read from the storage unit 327, and its second derivative is calculated. Then, an average value of the calculated second derivative of the first sheet and the second sheet is calculated.

- the blur parameter calculation unit 326 calculates the blur parameter by dividing the average value of the second derivative calculated by the second derivative calculation unit 325 from the difference calculated by the difference calculation unit 324.

- the relationship between the blur parameter and the focus lens position is stored in the LUT storage unit 328 as a table.

- the blur parameter calculation unit 326 uses the blur parameter and information in the table stored in the LUT storage unit 328 to obtain the subject distance from the blur parameter with respect to the optical system by linear interpolation.

- the calculated subject distance is output to the emphasis processing unit 370 as distance information.

- the distance information acquisition process is not limited to the above-described distance information acquisition process.

- the distance information may be obtained by a time-of-flight method using infrared light.

- Time of Flight modifications such as using blue light instead of infrared light are possible.

- distance information may be acquired by stereo matching.

- FIG. 1 A configuration example of the endoscope apparatus in this case is shown in FIG.

- the imaging unit 200 includes an objective lens 205 and an imaging element 207.

- the objective lenses 204 and 205 are arranged at positions separated by a predetermined distance, and arranged so that a parallax image (hereinafter referred to as a stereo image) can be taken.

- a stereo image a parallax image

- a left image and a right image are formed on the image sensors 206 and 207, respectively.

- the A / D conversion unit 209 performs A / D conversion on the left image and the right image output from the imaging elements 206 and 207, and outputs the converted left image and right image to the image configuration unit 320 and the distance information acquisition unit 380. To do.

- the distance information acquisition unit 380 uses the left image as the reference image, and performs a matching operation between the local region including the target pixel and the local region of the right image on the epipolar line passing through the target pixel of the reference image.

- the position having the maximum correlation in the matching calculation is calculated as a parallax, the parallax is converted into a distance in the depth direction (Z-axis direction of the distance map), and the distance information is output to the enhancement processing unit 370.

- FIG. 6 shows a detailed configuration example of the enhancement processing unit 370.

- the enhancement processing unit 370 includes an object specifying unit 371 and an enhancement unit 372.

- object specifying unit 371 includes an object specifying unit 371 and an enhancement unit 372.

- FIG. 7A schematically shows an example of a distance map.

- a one-dimensional distance map is considered, and the distance axis is taken in the direction indicated by the arrow.

- the distance map includes both information on the rough structure of the living body (for example, shape information on the lumen and the folds 2, 3, 4 and the like) and information on the uneven portions (for example, the recessed portions 10, 30, and the protruding portion 20) of the living body surface layer. Is included.

- the known characteristic information acquisition unit 390 acquires the dimension information (size information of the concavo-convex part of the living body to be extracted) from the storage unit 350 as the known characteristic information, and determines the frequency characteristic of the low-pass filter processing based on the dimension information. As shown in FIG. 7B, the target specifying unit 371 performs low-pass filter processing of the frequency characteristics on the distance map, and extracts information on the rough structure of the living body (shape information on lumens, wrinkles, etc.). To do.

- the target specifying unit 371 subtracts the information on the rough structure of the living body from the distance map, and obtains the unevenness map (information on the unevenness portion of the desired size) that is the unevenness information of the biological surface layer.

- the horizontal direction in the image, distance map, and concavo-convex map is defined as the x axis

- the vertical direction is defined as the y axis.

- the enhancement processing unit 370 outputs the uneven map obtained as described above to the enhancement processing unit 370.

- extracting the concavo-convex portion of the biological surface layer as the concavo-convex map corresponds to specifying the concavo-convex portion of the biological surface layer as an emphasis target.

- the target specifying unit 371 performs low-pass filter processing of a predetermined size (for example, N ⁇ N pixels (N is a natural number of 2 or more (including that value))) on the input distance information. And based on the distance information (local average distance) after the process, an extraction process parameter is adaptively determined. More specifically, the unevenness portion unique to the living body to be extracted due to the lesion is smoothed, and the characteristics of the low-pass filter that retains the structure of the lumen and the eyelid unique to the observation site are determined.

- a predetermined size for example, N ⁇ N pixels (N is a natural number of 2 or more (including that value)

- the characteristics of the concavo-convex portion to be extracted, the soot to be excluded, and the characteristics of the lumen structure are known from the known characteristic information, their spatial frequency characteristics are known, and the characteristics of the low-pass filter can be determined. Further, since the apparent size of the structure changes according to the local average distance, the characteristics of the low-pass filter are determined according to the local average distance as shown in FIG.

- the low-pass filter processing is realized by, for example, a Gaussian filter expressed by the following formula (3) or a bilateral filter expressed by the following formula (4).

- the frequency characteristics of these filters are controlled by ⁇ , ⁇ c , and ⁇ ⁇ .

- a ⁇ map that corresponds one-to-one to the pixels of the distance map may be created as an extraction processing parameter.

- a ⁇ map of both or one of ⁇ c and ⁇ ⁇ may be created.

- ⁇ is larger than a predetermined multiple ⁇ (> 1) of the inter-pixel distance D1 of the distance map corresponding to the size of the concavo-convex part unique to the living body to be extracted, and is a distance corresponding to the size of the lumen and the eyelid unique to the observation site.

- a value smaller than a predetermined multiple ⁇ ( ⁇ 1) of the inter-pixel distance D2 of the map is set.

- ⁇ ( ⁇ * D1 + ⁇ * D2) / 2 * R ⁇ may be set.

- R ⁇ is a function of the local average distance. The smaller the local average distance, the larger the value, and the larger the local average distance, the smaller the value.

- the known characteristic information acquisition unit 390 may read, for example, dimension information corresponding to the observation site from the storage unit 350, and the target specifying unit 371 may specify a target corresponding to the observation site based on the dimension information.

- the observation site can be determined by, for example, the scope ID stored in the memory 210 of FIG.

- the dimension information corresponding to the esophagus, stomach, and duodenum which are observation sites is read out.

- part is read.

- the extraction unevenness information may be acquired by, for example, morphological processing without being limited to the extraction processing using the low-pass filter processing as described above.

- opening processing and closing processing of a predetermined kernel size are performed on the distance map.

- the extraction processing parameter is the size of the structural element. For example, when a sphere is used as a structural element, the diameter of the sphere is smaller than the size of the region-specific lumen and fold based on the observed region information, and larger than the size of the living body-specific uneven portion to be extracted due to the lesion Set. As shown in FIG.

- the diameter is increased as the local average distance is decreased, and the diameter is decreased as the local average distance is increased.

- a concave portion on the surface of the living body is extracted by taking the difference between the information obtained by the closing process and the original distance information.

- the convex portion of the surface of the living body is extracted by taking the difference between the information obtained by the opening process and the original distance information.

- the enhancement unit 372 determines the observation state (observation method) based on the amount of movement, and performs enhancement processing corresponding to the observation state. Specifically, when the enhancement unit 372 determines that the observation amount is large and screening observation is performed, the emphasis unit 372 emphasizes a large-sized uneven portion among the extracted uneven portions. On the other hand, when the movement amount is small and it is determined that the observation is magnified, the uneven portion having a small size is emphasized among the extracted uneven portions.

- a process of emphasizing different colors between the concave portion and the convex portion will be described.

- a pixel with diff (x, y) ⁇ 0 is a convex portion

- a pixel with diff (x, y)> 0 is a concave portion.

- the size of the concavo-convex portion for example, the width of the convex region (number of pixels) and the width of the concave region (number of pixels) may be used, and the size of the concavo-convex portion may be determined by comparing the size with a threshold value.

- the present embodiment is not limited to this, and various enhancement processes can be applied. For example, a process of emphasizing a predetermined color (for example, blue) as diff (x, y) is larger (deeper in the concave portion) and reproducing a pigment spray such as indigo carmine may be performed. Further, the coloring method may be changed between screening observation and magnified observation.

- the target specifying unit 371 determines the extraction process parameter based on the known characteristic information, and specifies the uneven portion of the subject as the target of the enhancement process based on the determined extraction process parameter.

- processing target identification processing

- information on the desired uneven portion is extracted from information on various structures included in the distance information, and other structures (for example, structures unique to living bodies such as wrinkles) are excluded. Control is required.

- control is realized by setting extraction processing parameters based on the known characteristic information.

- the target specifying unit 371 determines the size of the structural element used for the opening process and the closing process based on the known characteristic information as an extraction process parameter, and uses the structural element of the determined size. An opening process and a closing process are performed to extract the uneven portion of the subject as extracted uneven information.

- the extraction process parameter at that time is the size of the structural element used in the opening process and the closing process.

- the extraction processing parameter is a parameter representing the diameter of the sphere.

- the captured image is an in-vivo image obtained by imaging the inside of the living body, and the subject is formed in a general three-dimensional structure of the living body, which is a luminal structure inside the living body, and a luminal structure.

- the object specifying unit 371 has a local concavo-convex structure

- the target specifying unit 371 includes a general three-dimensional structure and concavo-convex part included in the subject, and a subject that matches the characteristics specified by the known characteristic information.

- the uneven part is extracted as extracted uneven part information.

- a general three-dimensional structure in this case, a structure having a lower spatial frequency than the uneven portion

- an uneven portion smaller than that are included.

- the extraction process can be realized.

- the object specifying part 371 may extract the uneven part except for them. In this case, what is excluded becomes global (a structure with a low spatial frequency) and the extraction target is local (a structure with a high spatial frequency), so a spatial frequency corresponding to the middle is set as a boundary.

- each part of the processor unit 300 is configured by hardware.

- the present embodiment is not limited to this.

- the configuration may be such that the CPU processes each unit for the image signal and distance information acquired in advance using the imaging device, and the CPU executes the program to realize the software.

- a part of processing performed by each unit may be configured by software.

- the program stored in the information storage medium is read, and the read program is executed by a processor such as a CPU.

- the information storage medium (computer-readable medium) stores programs, data, and the like, and functions as an optical disk (DVD, CD, etc.), HDD (hard disk drive), or memory (card type). It can be realized by memory, ROM, etc.

- a processor such as a CPU performs various processes according to the present embodiment based on a program (data) stored in the information storage medium.

- a program for causing a computer an apparatus including an operation unit, a processing unit, a storage unit, and an output unit

- a program for causing the computer to execute processing of each unit Is memorized.

- FIG. 9 shows a flowchart when the processing performed by the image processing unit 301 is realized by software.

- a captured image is acquired (step S1)

- distance information when the captured image is captured is acquired (step S2).

- the target is specified by the above-described method (step S3). Further, the amount of motion of the subject is calculated from the captured image (step S4), and it is determined whether or not the amount of motion (for example, the magnitude of the motion vector) is larger than the threshold ⁇ (step S5). If the amount of motion is larger than the threshold value ⁇ , it is determined that the observation is screening, the first enhancement processing is performed on the captured image (step S6), and the processed image is output (step S7). In the first emphasis process, an object whose size is larger than the first size threshold Tk among the specified objects is emphasized.

- the second enhancement processing is performed on the captured image (step S8), and the processed image is output (step S8). Step S9).

- the second enhancement process among the identified objects, an object having a size smaller than the second size threshold Ts is emphasized.

- the distance information acquisition unit 380 acquires distance information (distance map in a narrow sense) that represents the distance from the imaging unit 200 to the subject when the captured image is captured.

- the emphasis processing unit 370 performs an emphasis process on the processing content corresponding to the motion amount based on the distance information and the known characteristic information.

- the processing content can be changed according to the observation state.

- the distance information for example, it is possible to specify an observation target characterized by a three-dimensional structure or shape.

- the known characteristic information acquisition unit 390 acquires known characteristic information that is information indicating a known characteristic related to the structure of the subject (for example, the size of the structure characteristic of the lesion).

- the emphasis processing unit 370 performs emphasis processing on the uneven portion of the subject that matches the characteristics specified by the known characteristic information.

- the emphasis process can be changed according to the amount of movement so that the uneven portion that the user is paying attention to in each observation state is emphasized.

- the target specifying unit 371 extracts an uneven portion having a desired characteristic (for example, size) from the distance information, and specifies the extracted uneven portion as a target for the enhancement process.

- the enhancement processing unit 370 performs enhancement processing on the identified target.

- the characteristic for example, size

- the enhancement processing unit 370 has a size larger than the first size threshold Tk among the extracted uneven portions when the amount of motion (for example, the magnitude of the motion vector) is larger than the threshold ⁇ . Emphasis processing is performed on the uneven portion determined to be. On the other hand, when the amount of motion is smaller than the threshold value ⁇ , the emphasis process is performed on the concavo-convex portion of the concavo-convex portion that is determined to have a size smaller than the second size threshold value Ts.

- the reddish part or the fading part is emphasized.

- the reddish portion and the fading portion may not have a shape characteristic like the uneven portion, and therefore, it is desirable to change the method of emphasizing the uneven portion.

- the reddish portion is a portion that is visually more reddish than the surrounding colors

- the fading portion is a portion that is visually less reddish than the surrounding colors.

- the endoscope apparatus can be configured similarly to the first embodiment.

- the same components as those in the first embodiment are denoted by the same reference numerals, and description thereof will be omitted as appropriate.

- FIG. 10 shows a detailed configuration example of the image processing unit 301 in the second embodiment.

- the image processing unit 301 includes an image configuration unit 320, an image storage unit 330, a storage unit 350, a motion amount acquisition unit 360, an enhancement processing unit 370, and a known characteristic information acquisition unit 390.

- the distance information acquisition unit 380 is omitted.

- FIG. 11 shows a detailed configuration example of the enhancement processing unit 370 in the second embodiment.

- the enhancement processing unit 370 includes an object specifying unit 371 and an enhancement unit 372.

- the known characteristic information acquisition unit 390 acquires color information of a living body (for example, a reddish part or a fading part) to be extracted as known characteristic information.

- the target specifying unit 371 specifies a region that matches the color represented by the known characteristic information as a target. Taking the reddish part as an example, an area deviated in the reddish direction from the color of the normal mucous membrane is specified as the reddish part. For example, an area where the ratio R / G of the pixel value of red (R), the pixel value of green (G), and the ratio R / G is larger than the surrounding R / G is identified as a red portion.

- information about how much (for example, how many times) it should be larger than the surrounding R / G is known characteristic information.

- the range of R / G and hue value may be stored as known characteristic information, and an area that matches the range of R / G and hue value may be set as the redness portion.

- image frequency and shape information for example, size and shape characteristic of the redness portion may be used as known characteristic information.

- the emphasis unit 372 performs a process of emphasizing the identified target color when it is determined that the observation amount is large and the screening observation is performed. For example, the redness of the reddish part (for example, R / G or the saturation of the red hue range) is increased, and the redness of the fading part is reduced. On the other hand, when it is determined that the amount of motion is small and magnification observation is performed, processing for enhancing an edge component of an image and processing for enhancing a specific frequency region by frequency analysis are performed. Further, color enhancement similar to that during screening observation may be performed.

- the redness of the reddish part for example, R / G or the saturation of the red hue range

- the present embodiment is not limited to this, and the emphasis process may be performed without specifying the target.

- the emphasis process may be performed without specifying the target.

- the redness enhancement characteristic is stored as known characteristic information.

- the detection target is not limited to the reddish part and the fading part, but may be a polyp, for example.

- a shape (or color) peculiar to the polyp may be stored as known characteristic information, and the polyp may be detected by pattern matching (or color comparison). Then, when it is determined that the observation amount is large and screening observation is performed, the polyp may be emphasized by contour enhancement. When it is determined that the observation amount is small and enlarged observation, color enhancement may be performed in addition to the contour enhancement.

- FIG. 12 shows a flowchart when the processing performed by the image processing unit 301 is realized by software.

- a captured image is acquired (step S1).

- an object is specified by the above-described method (step S22).

- the amount of motion of the subject is calculated from the captured image (step S23), and it is determined whether or not the amount of motion (for example, the magnitude of the motion vector) is larger than the threshold ⁇ (step S24). If the amount of motion is larger than the threshold value ⁇ , it is determined that the observation is screening observation, the first enhancement processing is performed on the captured image (step S25), and the processed image is output (step S26). In the first enhancement process, the specified target color is enhanced.

- the second enhancement process is performed on the captured image (step S27), and the processed image is output ( Step S28).

- the color and edge of the identified target are enhanced.

- the known characteristic information acquisition unit 390 acquires known characteristic information that is information representing a known characteristic related to the color of the subject.

- the enhancement process for the color can be performed with the content according to the observation state.

- the information regarding the color for example, it is possible to emphasize so as to make it easy to see a lesion or the like having a different color compared to the normal part.

- the emphasis processing unit 370 performs the emphasis process using a subject that matches the characteristic specified by the known characteristic information as an object of the emphasis process.

- the target specifying unit 371 specifies a target that matches a desired characteristic (for example, color) represented by the known characteristic information from the captured image, and the enhancement processing unit 370 emphasizes the specified target.

- the emphasis process may be performed based on the known characteristic information without specifying the target, without being limited to the case where the target specifying unit 371 is included.

- the enhancement processing unit 370 enhances the target color (for example, R / G or saturation of a predetermined hue) when the amount of motion (for example, the magnitude of the motion vector) is larger than the threshold ⁇ . Perform the emphasis process. On the other hand, when the amount of motion is smaller than the threshold value ⁇ , enhancement processing for enhancing at least the structure of the object is performed.

- the known characteristic information is information representing a known characteristic relating to the color of the reddish portion having a red component (for example, R / G) larger than the color of the normal mucous membrane.

- the enhancement processing unit 370 performs enhancement processing for enhancing the red component (for example, R / G or saturation of the red hue range) specified as a target. .

- the location of the lesioned part can be specified without overlooking the lesioned part having a characteristic color such as a reddish part or a fading part.

- a characteristic color such as a reddish part or a fading part.

- the slow-motion magnified observation not only the color but also the structure can be emphasized, so that it is easy to see the fine structure of the lesion that the user is paying attention to.

- the visibility in each observation state can be improved, and the oversight of lesions and the improvement of diagnosis accuracy can be realized.

Landscapes

- Health & Medical Sciences (AREA)

- Life Sciences & Earth Sciences (AREA)

- Engineering & Computer Science (AREA)

- Surgery (AREA)

- Physics & Mathematics (AREA)

- Heart & Thoracic Surgery (AREA)

- General Health & Medical Sciences (AREA)

- Optics & Photonics (AREA)

- Pathology (AREA)

- Radiology & Medical Imaging (AREA)

- Biophysics (AREA)

- Biomedical Technology (AREA)

- Veterinary Medicine (AREA)

- Medical Informatics (AREA)

- Molecular Biology (AREA)

- Animal Behavior & Ethology (AREA)

- Nuclear Medicine, Radiotherapy & Molecular Imaging (AREA)

- Public Health (AREA)

- Signal Processing (AREA)

- Multimedia (AREA)

- Computer Vision & Pattern Recognition (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Endoscopes (AREA)

- Instruments For Viewing The Inside Of Hollow Bodies (AREA)

- Image Processing (AREA)

Abstract

観察状態に応じた強調処理を行うことが可能な画像処理装置、内視鏡装置、画像処理方法及び画像処理プログラム等を提供すること。 画像処理装置は、被写体の像を含む撮像画像を取得する画像取得部310と、被写体の動き量を取得する動き量取得部360と、被写体に関する既知の特性を表す情報である既知特性情報を取得する既知特性情報取得部390と、動き量に対応する処理内容で、既知特性情報に基づいて強調処理を行う強調処理部370と、を含む。

Description

本発明は、画像処理装置、内視鏡装置、画像処理方法及び画像処理プログラム等に関する。

内視鏡装置を用いた生体内部の観察、診断においては、生体の微小な凹凸状態や、発赤・褪色などの色の違いを観察することで早期病変部か否かの識別を行う手法が広く用いられている。また、生体用の内視鏡装置ではなく、工業用の内視鏡装置においても、被写体(狭義には被写体表面)の凹凸構造等を観察することは有用であり、例えば直接の目視が難しいパイプ内部等に発生した亀裂の検出等が可能になる。また、内視鏡装置以外の画像処理装置においても、処理対象となる画像から被写体の凹凸構造等を検出することが有用であることは多い。

内視鏡装置では、画像強調を行うことで、被写体の構造や色の違いを観察しやすくする処理が行われる。例えば被写体の構造を画像処理により強調する手法として、特許文献1に開示される手法が知られている。或は色強調により病変部位を識別する手法として、特許文献2に開示される手法が知られている。

さて、異なる観察状態に対して同一の強調処理を行った場合、観察しづらい画像となる可能性があるという課題がある。例えば、生体用の内視鏡装置では、スクリーニング観察と拡大観察で画像の動く速さが異なり、また医師が注目する観察対象も異なるため、それぞれの観察状態に適した強調処理が行われることが望ましい。

本発明の幾つかの態様によれば、観察状態に応じた強調処理を行うことが可能な画像処理装置、内視鏡装置、画像処理方法及び画像処理プログラム等を提供できる。

本発明の一態様は、被写体の像を含む撮像画像を取得する画像取得部と、前記被写体の動き量を取得する動き量取得部と、前記被写体に関する既知の特性を表す情報である既知特性情報を取得する既知特性情報取得部と、前記動き量に対応する処理内容で、前記既知特性情報に基づいて強調処理を行う強調処理部と、を含む画像処理装置に関係する。

本発明の一態様によれば、被写体に関する既知の特性を表す情報である既知特性情報に基づく強調処理が、被写体の動き量に対応する処理内容で行われる。これにより、観察状態に応じた強調処理を行うことが可能になる。

また本発明の他の態様は、被写体の像を含む撮像画像を取得し、前記被写体の動き量を取得し、前記被写体に関する既知の特性を表す情報である既知特性情報を取得し、前記動き量に対応する処理内容で、前記既知特性情報に基づいて強調処理を行う画像処理方法に関係する。

また本発明の更に他の態様は、被写体の像を含む撮像画像を取得し、前記被写体の動き量を取得し、前記被写体に関する既知の特性を表す情報である既知特性情報を取得し、前記動き量に対応する処理内容で、前記既知特性情報に基づいて強調処理を行うステップを、コンピューターに実行させる画像処理プログラムに関係する。

以下、本実施形態について説明する。なお、以下に説明する本実施形態は、請求の範囲に記載された本発明の内容を不当に限定するものではない。また本実施形態で説明される構成の全てが、本発明の必須構成要件であるとは限らない。

1.本実施形態の概要

内視鏡装置のような撮像装置を用いて、消化管の早期病変を鑑別・診断する際、生体表面の凹凸などの構造や発赤・褪色などの色の違いが重要視されている。このような被写体の構造をより観察しやすくするために、消化管に対して色素を散布することで色やコントラストを改善させる手法がある。

内視鏡装置のような撮像装置を用いて、消化管の早期病変を鑑別・診断する際、生体表面の凹凸などの構造や発赤・褪色などの色の違いが重要視されている。このような被写体の構造をより観察しやすくするために、消化管に対して色素を散布することで色やコントラストを改善させる手法がある。

しかしながら、色素散布の作業を行うことは医師にとって煩雑であり、また患者にとっても負担となるので、画像処理により色や凹凸構造を強調し、病変部を判別するという試みがなされている(例えば、特許文献1、2)。

このような画像処理による強調では、観察状態(観察手法)に応じて処理内容を変える方が見やすい画像となる。例えば、スクリーニング観察のように比較的早く動かして消化管全体を順次見ていくような場合には、医師は比較的大きな構造を観察している。そのため、その大きな構造を見落とさないように画像上で提示する必要がある。一方、スクリーニングによりターゲットの場所を特定し、その詳細構造を拡大観察(精査観察、近接観察)する場合には、医師は微細な構造を観察している。そのため、その微細な構造を強調し、ターゲットが良性か悪性かを判断できるようにする必要がある。

しかしながら、このように観察状態に応じて強調処理の内容を切り替えることは、手動で行う場合には操作が煩雑となる。一方、強調処理の内容を切り替えず、いつも大きな構造と微細な構造の両方を強調すると、スクリーニング観察では画像の動きが速いため微細な構造を強調されても見えづらく、拡大観察では微細な構造を見たいのにもかかわらず大きな構造が強調されるため見づらくなる。

図1に、このような課題を解決できる画像処理装置の構成例を示す。この画像処理装置は、被写体の像を含む撮像画像を取得する画像取得部310と、被写体の動き量を取得する動き量取得部360と、被写体に関する既知の特性を表す情報である既知特性情報を取得する既知特性情報取得部390と、動き量に対応する処理内容で、既知特性情報に基づいて強調処理を行う強調処理部370と、を含む。

このようにすれば、異なる観察状態では被写体の動き量も異なるため、動き量に対応する処理内容で強調処理を行うことで、観察状態に応じて強調処理を変えることができる。これにより、各観察状態において強調すべきものを選択的に強調して見やすくすることができる。

後述するように、強調処理部370は、既知特性情報により特定される特性と合致する被写体を強調処理の対象として、動き量に対応する処理内容で強調処理を行う。

より具体的には、強調処理部は、動き量が、スクリーニング観察に対応する動き量に該当すると判断した場合には、既知特性情報により特定される特性と合致する被写体を強調処理の対象として第1の処理内容の強調処理を行う。一方、動き量が、近接観察に対応する動き量に該当すると判断した場合には、既知特性情報により特定される特性と合致する被写体を強調処理の対象として第1の処理内容とは異なる第2の処理内容の強調処理を行う。

このようにすれば、既知特性情報に合致する対象に強調処理を行う際に、その対象が各観察状態において見やすくなるように、動き量に応じた強調処理を行うことができる。後述するように対象は生体の凹凸部や発赤部・褪色部であり、それぞれの部分において各観察状態でユーザーが注目する特徴(例えば大きな構造、小さい構造、所定色の領域等)がある。強調処理では、そのような観察状態に応じてユーザーが注目する特徴を強調すればよい。例えば、被写体の動き量が大きいスクリーニング観察では、比較的大きな凹凸構造を強調する処理を行い、被写体の動き量が小さい拡大観察では、微細な凹凸構造を強調することが可能となる。

ここで動き量とは、撮像画像における被写体の動きを表す量であり、例えば被写体の動きの撮像画像上での方向や距離である。方向及び距離を動きベクトルとして取得してもよいし、動きの速さだけ分かればよい場合には距離のみを動き量として取得してもよい。このような動き量は、例えば撮像画像の特徴点を2フレーム間でマッチングすることにより得られる。

また既知特性情報とは、被写体表面の構造のうち、本実施形態において有用な構造とそうでない構造とを分離可能な情報である。具体的には、強調することが有用な(例えば早期病変部の発見に役立つ)凹凸部や色の情報(例えば病変部に特徴的な凹凸部のサイズや、色相、彩度等)を既知特性情報としてもよく、その場合、当該既知特性情報と合致する被写体が強調処理の対象となる。或いは、強調しても有用でない構造の情報を既知特性情報としてもよく、その場合既知特性情報と合致しない被写体が強調対象となる。或いは、有用な凹凸部と有用でない構造の両方の情報を保持しておき、有用な凹凸部の範囲を精度よく設定するものとしてもよい。

2.第1実施形態

2.1.内視鏡装置

次に、本実施形態の詳細について説明する。図2に、第1実施形態における内視鏡装置の構成例を示す。内視鏡装置は、光源部100、撮像部200、プロセッサー部300(制御装置)、表示部400、外部I/F部500、を含む。

2.1.内視鏡装置

次に、本実施形態の詳細について説明する。図2に、第1実施形態における内視鏡装置の構成例を示す。内視鏡装置は、光源部100、撮像部200、プロセッサー部300(制御装置)、表示部400、外部I/F部500、を含む。

光源部100は、白色光源101と、複数の分光透過率を有する回転色フィルター102と、回転色フィルター102を駆動する回転駆動部103と、回転色フィルター102からの各分光特性を持った光をライトガイドファイバー201の入射端面に集光させる集光レンズ104と、を含む。回転色フィルター102は、三原色のフィルター(赤色フィルター、緑色フィルター、青色フィルター)と、回転モーターと、により構成されている。

回転駆動部103は、プロセッサー部300の制御部302からの制御信号に基づいて、撮像部200の撮像素子206の撮像期間と同期して回転色フィルター102を所定回転数で回転させる。例えば回転色フィルター102を1秒間に20回転させると、各色フィルターは60分の1秒間隔で入射白色光を横切ることになる。この場合、観察対象には、60分の1秒間隔で3原色の各色光(R或はG或はB)が照射され、撮像素子206は、その観察対象からの反射光を撮像し、その撮像画像をA/D変換部209へ転送することになる。即ち、R画像、G画像、B画像が60分の1秒間隔で面順次で撮像される内視鏡装置の例となり、実質のフレームレートは20fpsとなる。

なお本実施形態は上記のような面順次方式に限定されず、例えば白色光源101からの白色光を被写体に照射し、RGBベイヤー配列のカラーフィルターを有する撮像素子により撮像してもよい。

撮像部200は、例えば胃や大腸などの体腔への挿入を可能にするため、細長くかつ湾曲可能に形成されている。撮像部200は、光源部100で集光された光を導くためのライトガイドファイバー201と、ライトガイドファイバー201により先端まで導かれた光を拡散させて観察対象に照射する照明レンズ203と、を含む。また撮像部200は、観察対象から戻る反射光を集光する対物レンズ204と、集光した結像光を検出するための撮像素子206と、撮像素子206からの光電変換されたアナログ信号をデジタル信号に変換するA/D変換部209と、を含む。また撮像部200は、撮像部200のスコープID情報と製造バラツキを含めた固有情報が記録されているメモリー210と、撮像部200とプロセッサー部300とを着脱可能にするコネクター212と、を含む。

面順次方式の場合、撮像素子206はモノクロ単板撮像素子であり、例えばCCDやCMOSイメージセンサー等が利用できる。A/D変換部209は、撮像素子206から出力されたアナログ信号をデジタル信号に変換し、そのデジタル信号の画像を画像処理部301へ出力する。メモリー210は制御部302と接続されており、スコープID情報と製造バラツキを含めた固有情報とを、制御部302へ転送する。

プロセッサー部300は、A/D変換部209から転送される画像に対して画像処理を行う画像処理部301と、内視鏡装置の各部を制御する制御部302と、を含む。

表示部400は、動画表示可能な表示装置であり、例えばCRTや液晶モニター等で構成される。

外部I/F部500は、この内視鏡装置に対するユーザーからの入力等を行うためのインターフェースである。外部I/F部500は、例えば電源のオン/オフを行うための電源スイッチや、撮影操作を開始するためのシャッタボタン、撮影モードやその他各種のモードを切り換えるためのモード切換スイッチ(例えば生体表面の凹凸部の選択的な強調処理を行う為のスイッチ)等を含んで構成されている。そして、この外部I/F部500は、入力された情報を制御部302へ出力するようになっている。

2.2.画像処理部

図3に画像処理部301の詳細な構成例を示す。画像処理部301は、画像構成部320、画像記憶部330、記憶部350、動き量取得部360、強調処理部370、距離情報取得部380、既知特性情報取得部390を含む。なお画像構成部320は、図1の画像取得部310に対応する。

図3に画像処理部301の詳細な構成例を示す。画像処理部301は、画像構成部320、画像記憶部330、記憶部350、動き量取得部360、強調処理部370、距離情報取得部380、既知特性情報取得部390を含む。なお画像構成部320は、図1の画像取得部310に対応する。

画像構成部320は、撮像部200により撮像された画像に対して所定の画像処理(例えばOB処理や、ゲイン処理、ガンマ処理等)を施し、表示部400へ出力可能な画像を生成する。画像構成部320は、処理後の画像を画像記憶部330、強調処理部370、距離情報取得部380へ出力する。

画像記憶部330は、画像構成部320から出力される画像を複数フレーム(時間的に連続した複数フレーム)分、記憶する。

動き量取得部360は、画像記憶部330に記憶された複数フレームの画像に基づいて、撮像画像における被写体の動き量を算出し、その動き量を強調処理部370へ出力する。例えば、基準フレームの画像とその次のフレームの画像との間でマッチング処理を行って、その2つのフレーム画像の間の動きベクトルを算出する。そして、基準画像をずらしながら複数フレームにわたって順次動きベクトルを算出し、その複数の動きベクトルの平均値を動き量として算出する。

既知特性情報取得部390は、記憶部350に記憶された既知特性情報を読み出し(取得し)、その既知特性情報を強調処理部370へ出力する。ここで既知特性情報は、強調対象として特定したい生体固有の凹凸部のサイズ(幅や高さや深さ等のディメンジョン情報)である。

距離情報取得部380は、撮像画像に基づいて被写体までの距離情報を取得し、その距離情報を強調処理部370へ出力する。ここで距離情報とは、撮像画像での各位置と、その各位置での被写体までの距離とが対応付けられた情報である。例えば距離情報は距離マップである。距離マップとは、例えば撮像部200の光軸方向をZ軸とした場合に、XY平面の各点(例えば各画素)について、被写体までのZ軸方向での距離(奥行き・深度)を当該点の値としたマップのことである。なお距離情報取得部380の詳細については後述する。

強調処理部370は、既知特性情報と距離情報に基づいて対象を特定し、その対象に対して動き量に応じた強調処理を行い、処理後の画像を表示部400へ出力する。具体的には、既知特性情報が表す所望のディメンジョン特性に合致する凹凸部を距離情報から抽出し、その抽出した凹凸部を対象として特定する。そして、動き量が閾値よりも大きい場合(例えばスクリーニング観察時)には、抽出した凹凸部のうちサイズ(凹凸パターン)が第1サイズ閾値よりもが大きい凹凸部を強調する。一方、動き量が閾値よりも小さい場合(例えば拡大観察時)には、抽出した凹凸部のうちサイズ(凹凸パターン)が第2サイズ閾値よりもが小さい凹凸部を強調する。第1サイズ閾値と第2サイズ閾値は、それぞれの観察状態で強調したい(又は強調後の画像が見やすくなる)凹凸部のサイズに合わせて設定すればよい。強調処理としては、例えば凹部と凸部で異なる色成分を強調する。

なお本実施形態では、特定した対象に対して強調処理を行う場合に限定されず、対象特定を行わずに既知特性情報に基づいて強調処理を行ってもよい。例えば、既知特性情報が表す凹凸部のサイズに基づいて構造強調(例えば画像の高周波成分の強調)のフィルター特性(例えば強調する周波数帯域)を設定し、所望サイズの凹凸部が強調されるようにしてもよい。この場合、動き量に応じてフィルター特性を変えてもよい。

2.3.距離情報取得処理

図4に、距離情報取得部380の詳細な構成例を示す。距離情報取得部380は、輝度信号算出部323と、差分演算部324と、2次微分演算部325と、ぼけパラメーター演算部326と、記憶部327と、LUT記憶部328と、を含む。

図4に、距離情報取得部380の詳細な構成例を示す。距離情報取得部380は、輝度信号算出部323と、差分演算部324と、2次微分演算部325と、ぼけパラメーター演算部326と、記憶部327と、LUT記憶部328と、を含む。

算出された輝度信号Yは、差分演算部324、2次微分演算部325、記憶部327へ転送される。差分演算部324は、ぼけパラメーター算出のために必要な複数の画像から輝度信号Yの差分を算出する。2次微分演算部325は、画像における輝度信号Yの2次微分を算出し、ぼけの異なる複数の輝度信号Yから得られる2次微分の平均値を算出する。ぼけパラメーター演算部326は、差分演算部324で算出された画像の輝度信号Yの差分から2次微分演算部325で算出された2次微分の平均値を除算して、ぼけパラメーターを算出する。

記憶部327は、1枚目に撮影した画像における輝度信号Yとその2次微分の結果を記憶する。これによって、距離情報取得部380は、制御部302を介してフォーカスレンズを異なる位置に配置し、複数の輝度信号Yを異なる時刻で取得することができる。LUT記憶部328は、ぼけパラメーターと被写体距離との関係をルックアップテーブル(LUT)の形で記憶する。

次に、被写体距離の算出方法について説明する。被写体距離の算出を開始すると、制御部302は、外部I/F部500により予め設定された撮影モードに基づいて、公知のコントラス検出方式、位相差検出方式等を用いて最適なフォーカスレンズ位置を算出する。次に、レンズ駆動部250は、制御部302からの信号に基づいて、フォーカスレンズを、算出したフォーカスレンズ位置に駆動する。そして、駆動したフォーカスレンズ位置で、撮像素子206により被写体の1枚目の画像を取得する。取得した画像は、画像取得部310と輝度信号算出部323を介して、記憶部327に記憶される。

その後、レンズ駆動部250によって、フォーカスレンズを、1枚目の画像を取得したフォーカスレンズ位置とは異なる第2のフォーカスレンズ位置に駆動し、撮像素子206によって被写体の2枚目の画像を取得する。これにより取得された2枚目の画像は、画像取得部310を介して、距離情報取得部380へ出力される。

2枚目の画像の取得が完了すると、ぼけパラメーターの算出を行う。距離情報取得部380において、差分演算部324は、1枚目の画像における輝度信号Yを記憶部327から読み出し、1枚目の画像における輝度信号Yと、輝度信号算出部323から出力される2枚目の画像における輝度信号Yと、の差分を算出する。

また、2次微分演算部325は、輝度信号算出部323から出力される2枚目の画像における輝度信号Yの2次微分を算出する。その後、1枚目の画像における輝度信号Yを記憶部327から読み出して、その2次微分を算出する。そして、算出した1枚目と2枚目の2次微分の平均値を算出する。

その後、ぼけパラメーター演算部326は、差分演算部324で演算した差分から2次微分演算部325で演算した2次微分の平均値を除算して、ぼけパラメーターを算出する。

ぼけパラメーターとフォーカスレンズ位置の関係は、LUT記憶部328にテーブルとして記憶されている。ぼけパラメーター演算部326では、ぼけパラメーターとLUT記憶部328に記憶されているテーブルの情報を使用して、ぼけパラメーターから光学系に対する被写体距離を線形補間によって求める。算出された被写体距離は、距離情報として強調処理部370へ出力される。

なお本実施形態では、上記の距離情報取得処理に限定されず、例えば赤外光を用いたTime of Flight方式等により距離情報を求めてもよい。また、Time of Flightを用いる場合にも、赤外光ではなく青色光を用いる等の変形実施が可能である。

或は本実施形態では、ステレオマッチングにより距離情報を取得してもよい。この場合の内視鏡装置の構成例を図5に示す。この内視鏡装置は、図1の構成例に加えて、撮像部200が対物レンズ205、撮像素子207を含む。

対物レンズ204、205は所定間隔離した位置に配置され、視差画像(以降、ステレオ画像と記す)が撮影可能に配置されている。撮像素子206、207には、ステレオ画像のうち、それぞれ左画像、右画像が結像される。A/D変換部209は、撮像素子206、207から出力される左画像、右画像をA/D変換し、変換後の左画像、右画像を画像構成部320と距離情報取得部380へ出力する。

そして、距離情報取得部380が、左画像を基準画像とし、その基準画像の注目画素を通るエピポーラ線上で、その注目画素を含む局所領域と右画像の局所領域とのマッチング演算を行う。マッチング演算において最大相関となる位置を視差として算出し、その視差を奥行き方向(距離マップのZ軸方向)の距離に変換し、その距離情報を強調処理部370へ出力する。

2.4.対象特定処理、強調処理

図6に強調処理部370の詳細な構成例を示す。強調処理部370は、対象特定部371、強調部372を含む。なお以下では距離情報と既知特性情報に基づいて対象を特定し、その特定した対象に対して強調処理を行う場合を例に説明するが、上述のように本実施形態はこれに限定されない。

図6に強調処理部370の詳細な構成例を示す。強調処理部370は、対象特定部371、強調部372を含む。なお以下では距離情報と既知特性情報に基づいて対象を特定し、その特定した対象に対して強調処理を行う場合を例に説明するが、上述のように本実施形態はこれに限定されない。

図7(A)に、距離マップの例を模式的に示す。以下では説明の便宜上、一次元の距離マップを考え、矢印で示す方向に距離の軸をとる。距離マップは、生体のおおまかな構造の情報(例えば管腔や襞2、3、4等の形状情報)と、生体表層の凹凸部(例えば凹部10、30、凸部20)の情報との両方を含んでいる。

既知特性情報取得部390は、記憶部350からディメンジョン情報(抽出したい生体の凹凸部のサイズ情報)を既知特性情報として取得し、そのディメンジョン情報に基づいてローパスフィルター処理の周波数特性を決定する。図7(B)に示すように、対象特定部371は、その周波数特性のローパスフィルター処理を距離マップに対して施し、生体のおおまかな構造の情報(管腔や襞等に関する形状情報)を抽出する。

そして図7(C)に示すように、対象特定部371は、生体のおおまかな構造の情報を距離マップから減算し、生体表層の凹凸情報である凹凸マップ(所望サイズの凹凸部の情報)を生成する。例えば、画像や距離マップ、凹凸マップにおける水平方向をx軸と定義し、垂直方向をy軸と定義する。距離マップの座標(x,y)における距離をdist(x,y)と定義し、ローパスフィルター処理後の距離マップの座標(x,y)における距離をdist_LPF(x,y)と定義すると、凹凸マップの座標(x,y)における凹凸情報diff(x,y)は下式(2)で求められる。

強調処理部370は、上記のようにして求めた凹凸マップを強調処理部370へ出力する。この例では、生体表層の凹凸部を凹凸マップとして抽出することが、生体表層の凹凸部を強調対象として特定することに相当する。

次に、ディメンジョン情報からカットオフ周波数(広義には抽出処理パラメーター)を決定する処理の詳細について説明する。

対象特定部371は、入力された距離情報に対して所定サイズ(例えばN×N画素(Nは2以上(その値を含む)の自然数))のローパスフィルター処理を施す。そして、その処理後の距離情報(局所平均距離)に基づいて、適応的に抽出処理パラメーターを決定する。具体的には、病変部起因の抽出したい生体固有の凹凸部を平滑化すると共に、観察部位固有の管腔及び襞の構造が保持されるローパスフィルターの特性を決定する。既知特性情報から、抽出対象である凹凸部や、除外対象である襞、管腔構造の特性がわかるため、それらの空間周波数特性は既知となり、ローパスフィルターの特性を決定可能である。また、局所平均距離に応じて見かけ上の構造の大きさが変わるため、図7(D)に示すように局所平均距離に応じてローパスフィルターの特性を決定する。

ローパスフィルター処理は、例えば下式(3)に示すガウスフィルターや、下式(4)に示すバイラテラルフィルターにより実現される。これらのフィルターの周波数特性はσ、σc、σνで制御する。このとき、距離マップの画素に一対一で対応するσマップを、抽出処理パラメーターとして作成してもよい。なお、バイラテラルフィルターの場合は、σc、σνの両方或いは一方のσマップを作成してもよい。

σとしては、例えば抽出したい生体固有の凹凸部のサイズに対応する距離マップの画素間距離D1の所定倍α(>1)よりも大きく、観察部位固有の管腔及び襞のサイズに対応する距離マップの画素間距離D2の所定倍β(<1)よりも小さい値を設定する。例えば、σ=(α*D1+β*D2)/2*Rσと設定してもよい。ここでRσは、局所平均距離の関数であり、局所平均距離が小さいほど値が大きく、局所平均距離が大きいほど値が小さい。

なお、既知特性情報取得部390は、例えば観察部位に対応したディメンジョン情報を記憶部350から読み出し、対象特定部371は、そのディメンジョン情報に基づいて、観察部位に応じた対象を特定してもよい。観察部位は、例えば図2のメモリー210に記憶されたスコープIDにより決定できる。例えば上部消化器用スコープの場合には、観察部位である食道、胃、十二指腸に対応したディメンジョン情報が読み出される。或は、下部消化器用スコープの場合には、観察部位である大腸に対応したディメンジョン情報が読み出される。

ここで、本実施形態では上記のようなローパスフィルター処理を用いた抽出処理に限定されず、例えばモルフォロジー処理により抽出凹凸情報を取得してもよい。この場合、図8(A)に示すように、距離マップに対して所定カーネルサイズ(構造要素の大きさ(球の直径))のオープニング処理、クロージング処理を行う。抽出処理パラメーターは構造要素の大きさである。例えば構造要素として球を用いる場合、その球の直径として、観察部位情報に基づく部位固有の管腔及び襞のサイズよりも小さく、病変部起因の抽出したい生体固有の凹凸部のサイズよりも大きい直径を設定する。また、図8(F)に示すように、局所平均距離が小さいほど直径を大きくし、局所平均距離が大きいほど直径を小さくする。図8(B)、図8(C)に示すように、クロージング処理により得られた情報と、元の距離情報との差分を取ることで、生体表面の凹部が抽出される。また、図8(D)、図8(E)に示すように、オープニング処理により得られた情報と、元の距離情報との差分を取ることで、生体表面の凸部が抽出される。

強調部372は、動き量に基づいて観察状態(観察手法)を判断し、観察状態に対応した強調処理を行う。具体的には、強調部372は、動き量が大きくスクリーニング観察と判断した場合には、抽出した凹凸部のうち大きなサイズの凹凸部を強調する。一方、動き量が小さく拡大観察と判断した場合には、抽出した凹凸部のうち小さなサイズの凹凸部を強調する。

強調処理の一例として、凹部と凸部で異なる色を強調する処理を説明する。上式(2)より、例えばdiff(x,y)<0の画素を凸部とし、diff(x,y)>0の画素を凹部とする。そして、凸部の画素に対して例えば所定色相の彩度強調を行い、凹部の画素に対して、それと異なる所定色相の彩度強調を行う。凹凸部のサイズとしては、例えば凸部領域の幅(画素数)、凹部領域の幅(画素数)を用い、そのサイズを閾値と比較することにより凹凸部の大きさを判別すればよい。なお本実施形態はこれに限定されず、種々の強調処理を適用可能である。例えば、diff(x,y)が大きいほど(凹部の深いところほど)所定色(例えば青)を強調し、インジゴカルミン等の色素散布を再現する処理を行ってもよい。また、スクリーニング観察と拡大観察で色の付け方を変えてもよい。

以上の実施形態によれば、対象特定部371は、既知特性情報に基づいて抽出処理パラメーターを決定し、決定された抽出処理パラメーターに基づいて、被写体の凹凸部を強調処理の対象として特定する。

これにより、既知特性情報により決定された抽出処理パラメーターを用いて凹凸情報を抽出(分離)する処理(対象特定処理)を行うことが可能になる。抽出凹凸情報を精度よく抽出するためには、距離情報に含まれる種々の構造の情報から、所望の凹凸部に関する情報を抽出しつつ、他の構造(例えば襞等の生体固有の構造)を除外する制御が必要になる。ここでは既知特性情報に基づいて抽出処理パラメーターを設定することで、そのような制御を実現する。

また本実施形態では、対象特定部371は、既知特性情報に基づいて、オープニング処理及びクロージング処理に用いられる構造要素のサイズを、抽出処理パラメーターとして決定し、決定されたサイズの構造要素を用いたオープニング処理及びクロージング処理を行って、被写体の凹凸部を抽出凹凸情報として抽出する。

このようにすれば、オープニング処理及びクロージング処理(広義にはモルフォロジー処理)に基づいて抽出凹凸情報を抽出することが可能になる。その際の抽出処理パラメーターは、オープニング処理及びクロージング処理で用いられる構造要素のサイズである。本実施形態では構造要素として球を想定しているため、抽出処理パラメーターとは球の直径等を表すパラメーターとなる。

また、撮像画像は、生体の内部を撮像した生体内画像であり、被写体は、生体内部の管腔構造である生体の大局的な三次元構造と、管腔構造に形成され、大局的な三次元構造に比べて局所的な凹凸構造とを有し、対象特定部371は、被写体に含まれる大局的な三次元構造と凹凸部のうち、既知特性情報により特定される特性と合致する被写体の凹凸部を、抽出凹凸情報として抽出する。

これにより、生体内画像を対象とする場合には、距離情報に含まれる大局的な(ここでは凹凸部に比べて空間周波数が低い構造を指す)三次元構造と、それよりも小さい凹凸部を抽出する処理を実現できる。例えば、早期病変部の発見に有用な凹凸部を抽出対象とする場合には、生体固有の襞や、壁面の曲率に起因する構造等の生体固有の三次元構造は抽出対象とする必要はなく、対象特定部371はそれらを除いて凹凸部を抽出すればよい。この場合、除外されるものが大局的(空間周波数が低い構造)となり、抽出対象が局所的(空間周波数が高い構造)となるため、その中間に相当する空間周波数等を境界として設定する。

2.5.ソフトウェア

上記の実施形態では、プロセッサー部300を構成する各部をハードウェアで構成することとしたが、本実施形態はこれに限定されない。例えば、撮像装置を用いて予め取得された画像信号と距離情報に対して、CPUが各部の処理を行う構成とし、CPUがプログラムを実行することによってソフトウェアとして実現することとしてもよい。あるいは、各部が行う処理の一部をソフトウェアで構成することとしてもよい。

上記の実施形態では、プロセッサー部300を構成する各部をハードウェアで構成することとしたが、本実施形態はこれに限定されない。例えば、撮像装置を用いて予め取得された画像信号と距離情報に対して、CPUが各部の処理を行う構成とし、CPUがプログラムを実行することによってソフトウェアとして実現することとしてもよい。あるいは、各部が行う処理の一部をソフトウェアで構成することとしてもよい。

この場合、情報記憶媒体に記憶されたプログラムが読み出され、読み出されたプログラムをCPU等のプロセッサーが実行する。ここで、情報記憶媒体(コンピューターにより読み取り可能な媒体)は、プログラムやデータなどを格納するものであり、その機能は、光ディスク(DVD、CD等)、HDD(ハードディスクドライブ)、或いはメモリー(カード型メモリー、ROM等)などにより実現できる。そして、CPU等のプロセッサーは、情報記憶媒体に格納されるプログラム(データ)に基づいて本実施形態の種々の処理を行う。即ち、情報記憶媒体には、本実施形態の各部としてコンピューター(操作部、処理部、記憶部、出力部を備える装置)を機能させるためのプログラム(各部の処理をコンピューターに実行させるためのプログラム)が記憶される。

図9に、画像処理部301が行う処理をソフトウェアで実現する場合のフローチャートを示す。この処理を開始すると、撮像画像を取得し(ステップS1)、その撮像画像を撮像した際の距離情報を取得する(ステップS2)。

次に、上述の手法により対象を特定する(ステップS3)。また、撮像画像から被写体の動き量を算出し(ステップS4)、動き量(例えば動きベクトルの大きさ)が閾値εよりも大きいか否かの判定を行う(ステップS5)。動き量が閾値εよりも大きい場合にはスクリーニング観察と判断し、撮像画像に対して第1の強調処理を行い(ステップS6)、処理後の画像を出力する(ステップS7)。第1の強調処理では、特定した対象のうち大きさが第1サイズ閾値Tkより大きい対象を強調する。一方、動き量が閾値ε以下(その値を含む)である場合には拡大観察と判断し、撮像画像に対して第2の強調処理を行い(ステップS8)、処理後の画像を出力する(ステップS9)。第2の強調処理では、特定した対象のうち大きさが第2サイズ閾値Tsより小さい対象を強調する。

以上の実施形態によれば、距離情報取得部380は、撮像画像を撮像する際の撮像部200から被写体までの距離を表す距離情報(狭義には距離マップ)を取得する。強調処理部370は、距離情報及び既知特性情報に基づいて、動き量に対応する処理内容の強調処理を行う。

このようにすれば、距離情報及び既知特性情報に基づいて強調処理を行うことが可能となり、その強調処理において観察状態に応じて処理内容を変えることができる。距離情報を用いることによって、例えば3次元的な構造や形状に特徴がある観察対象を特定することが可能となる。

また本実施形態では、既知特性情報取得部390は、被写体の構造に関する既知の特性を表す情報(例えば病変部に特徴的な構造のサイズ等)である既知特性情報を取得する。強調処理部370は、その既知特性情報により特定される特性と合致する被写体の凹凸部を対象として強調処理を行う。

このようにすれば、ユーザーが各観察状態で着目している凹凸部が強調されるように、動き量に応じて強調処理を変えることができる。例えば本実施形態では、対象特定部371は、所望の特性(例えばサイズ)を有する凹凸部を距離情報から抽出し、その抽出した凹凸部を強調処理の対象として特定する。そして、強調処理部370は、特定された対象に対して強調処理を行う。これにより、動き量に応じて強調する凹凸部の特性(例えばサイズ)を変えることが可能となる。なお上述のように、対象特定部371を含む場合に限定されず、対象特定を行わずに既知特性情報に基づいて強調処理を行ってもよい。

より具体的には、強調処理部370は、動き量(例えば動きベクトルの大きさ)が閾値εよりも大きい場合には、抽出された凹凸部のうち第1のサイズ閾値Tkよりもサイズが大きいと判断した凹凸部に対して強調処理を行う。一方、動き量が閾値εよりも小さい場合には、凹凸部のうち第2のサイズ閾値Tsよりもサイズが小さいと判断した凹凸部に対して強調処理を行う。

このようにすれば、動きの速いスクリーニング観察では小さい構造が強調されなくなり、見た目の煩雑さを軽減できる。一方、動きの遅い拡大観察では小さい構造が強調され、ユーザーが精査する病変の微小な構造が見やすくなる。以上により、各観察状態における視認性を向上でき、病変見落としの低減や診断精度の向上を実現できる。

3.第2実施形態

第2実施形態では、発赤部或は褪色部の強調を行う。発赤部・褪色部は凹凸部のような形状的な特徴がないものもあるため、凹凸部に対する強調手法とは手法を変えることが望ましい。ここで発赤部とは、視覚的に周囲の色よりも赤みが強い部分のことであり、褪色部とは、視覚的に周囲の色よりも赤みが少ない部分のことである。

第2実施形態では、発赤部或は褪色部の強調を行う。発赤部・褪色部は凹凸部のような形状的な特徴がないものもあるため、凹凸部に対する強調手法とは手法を変えることが望ましい。ここで発赤部とは、視覚的に周囲の色よりも赤みが強い部分のことであり、褪色部とは、視覚的に周囲の色よりも赤みが少ない部分のことである。

第2実施形態における詳細な構成について説明する。内視鏡装置については、第1実施形態と同様に構成できる。なお以下では第1実施形態と同様の構成要素には同一の符号を付し、適宜説明を省略する。

図10に、第2実施形態における画像処理部301の詳細な構成例を示す。画像処理部301は、画像構成部320、画像記憶部330、記憶部350、動き量取得部360、強調処理部370、既知特性情報取得部390を含む。第1実施形態と比べて距離情報取得部380が省略されている。

図11に、第2実施形態における強調処理部370の詳細な構成例を示す。強調処理部370は、対象特定部371、強調部372を含む。

既知特性情報取得部390は、抽出したい生体(例えば発赤部、或は褪色部)の色の情報を既知特性情報として取得する。対象特定部371は、その既知特性情報が表す色に合致する領域を対象として特定する。発赤部を例にとると、正常粘膜の色から赤みの方向にずれている領域を発赤部として特定する。例えば、赤(R)の画素値と緑(G)の画素値と比R/Gが周囲のR/Gよりも大きい領域を発赤部と特定する。この場合、周囲のR/Gよりもどの程度(例えば何倍)大きければよいかの情報が、既知特性情報である。或は、R/Gや色相値の範囲を既知特性情報として記憶し、そのR/Gや色相値の範囲に合致する領域を発赤部としてもよい。或は、更に発赤部に特徴的な画像周波数や形態情報(例えばサイズや形状)を既知特性情報として用いてもよい。

強調部372は、動き量が大きくスクリーニング観察と判断した場合には、特定した対象の色を強調する処理を行う。例えば発赤部の赤み(例えばR/Gや、赤色の色相範囲の彩度等)を強くし、褪色部の赤みを弱くする処理を行う。一方、動き量が小さく拡大観察と判断した場合には、画像のエッジ成分を強調する処理や、周波数解析により特定の周波数領域を強調する処理を行う。また、更にスクリーニング観察時と同様な色の強調を行ってもよい。

なお上記では対象を特定する場合を例に説明したが、本実施形態ではこれに限定されず、対象を特定せずに強調処理を行ってもよい。例えば、動き量が大きい場合には、赤みが強い領域ほどより赤みを強くする処理を行い、動き量が小さい場合には、微小な構造ほど強調度合いを大きくした強調処理を行ってもよい。この場合、例えば赤みの強調特性を既知特性情報として記憶する。

また検出対象は発赤部や褪色部に限定されず、例えばポリープ等であってもよい。対象がポリープである場合、例えばポリープに特有な形状(又は色)を既知特性情報として記憶し、パターンマッチング(又は色の比較)によりポリープを検出してもよい。そして、動き量が大きくスクリーニング観察と判断した場合には、輪郭強調によりポリープを強調し、動き量が小さく拡大観察と判断した場合には、輪郭強調に加えて色強調を行ってもよい。

図12に、画像処理部301が行う処理をソフトウェアで実現する場合のフローチャートを示す。この処理を開始すると、撮像画像を取得する(ステップS1)。次に、上述の手法により対象を特定する(ステップS22)。また、撮像画像から被写体の動き量を算出し(ステップS23)、動き量(例えば動きベクトルの大きさ)が閾値εよりも大きいか否かの判定を行う(ステップS24)。動き量が閾値εよりも大きい場合にはスクリーニング観察と判断し、撮像画像に対して第1の強調処理を行い(ステップS25)、処理後の画像を出力する(ステップS26)。第1の強調処理では、特定した対象の色を強調する。一方、動き量が閾値ε以下(その値を含む)である場合には拡大観察と判断し、撮像画像に対して第2の強調処理を行い(ステップS27)、処理後の画像を出力する(ステップS28)。第2の強調処理では、特定した対象の色とエッジを強調する。

以上の実施形態によれば、既知特性情報取得部390は、被写体の色に関する既知の特性を表す情報である既知特性情報を取得する。

このようにすれば、観察したい対象に特徴的な色に関する情報に基づいて、その色に対する強調処理を観察状態に応じた内容で行うことができる。色に関する情報を用いることによって、例えば正常部に比べて色が異なっている病変部等が見やすくなるように、強調することが可能となる。

また本実施形態では、強調処理部370は、既知特性情報により特定される特性と合致する被写体を強調処理の対象として、強調処理を行う。例えば本実施形態では、対象特定部371が、既知特性情報が表す所望の特性(例えば色)に合致する対象を撮像画像から特定し、強調処理部370が、その特定された対象に対して強調処理を行う。なお第1実施形態で述べたように、対象特定部371を含む場合に限定されず、対象特定を行わずに既知特性情報に基づいて強調処理を行ってもよい。

より具体的には、強調処理部370は、動き量(例えば動きベクトルの大きさ)が閾値εよりも大きい場合には、対象の色(例えばR/Gや、所定色相の彩度)を強調する強調処理を行う。一方、動き量が閾値εよりも小さい場合には、対象の少なくとも構造を強調する強調処理を行う。

例えば、既知特性情報は、正常粘膜の色よりも赤成分(例えばR/G)が大きい発赤部の色に関する既知の特性を表す情報である。強調処理部370は、動き量が閾値εよりも大きい場合には、対象として特定された発赤部の赤成分(例えばR/Gや、赤色の色相範囲の彩度)を強調する強調処理を行う。

このようにすれば、動きの速いスクリーニング観察では、例えば発赤部・褪色部等の色に特徴がある病変部を見落とさず、その病変部の場所を特定することができる。一方、動きの遅い拡大観察では、色だけでなく構造を強調できるため、ユーザーが着目している病変部の微細な構造を見やすくできる。以上により、各観察状態における視認性を向上でき、病変見落としの低減や診断精度の向上を実現できる。

以上、本発明を適用した実施形態およびその変形例について説明したが、本発明は、各実施形態やその変形例そのままに限定されるものではなく、実施段階では、発明の要旨を逸脱しない範囲内で構成要素を変形して具体化することができる。また、上記した各実施形態や変形例に開示されている複数の構成要素を適宜組み合わせることによって、種々の発明を形成することができる。例えば、各実施形態や変形例に記載した全構成要素からいくつかの構成要素を削除してもよい。さらに、異なる実施の形態や変形例で説明した構成要素を適宜組み合わせてもよい。このように、発明の主旨を逸脱しない範囲内において種々の変形や応用が可能である。また、明細書又は図面において、少なくとも一度、より広義または同義な異なる用語と共に記載された用語は、明細書又は図面のいかなる箇所においても、その異なる用語に置き換えることができる。

2~4 襞、10,30 凹部、20 凸部、100 光源部、

101 白色光源、102 回転色フィルター、103 回転駆動部、

104 集光レンズ、200 撮像部、201 ライトガイドファイバー、

203 照明レンズ、204,205 対物レンズ、

206,207 撮像素子、209 A/D変換部、210 メモリー、

212 コネクター、250 レンズ駆動部、300 プロセッサー部、

301 画像処理部、302 制御部、310 画像取得部、

320 画像構成部、323 輝度信号算出部、324 差分演算部、

325 次微分演算部、326 パラメーター演算部、327 記憶部、

328 LUT記憶部、330 画像記憶部、350 記憶部、

360 動き量取得部、370 強調処理部、371 対象特定部、

372 強調部、380 距離情報取得部、390 既知特性情報取得部、

400 表示部、500 外部I/F部

101 白色光源、102 回転色フィルター、103 回転駆動部、

104 集光レンズ、200 撮像部、201 ライトガイドファイバー、

203 照明レンズ、204,205 対物レンズ、

206,207 撮像素子、209 A/D変換部、210 メモリー、

212 コネクター、250 レンズ駆動部、300 プロセッサー部、

301 画像処理部、302 制御部、310 画像取得部、

320 画像構成部、323 輝度信号算出部、324 差分演算部、

325 次微分演算部、326 パラメーター演算部、327 記憶部、

328 LUT記憶部、330 画像記憶部、350 記憶部、

360 動き量取得部、370 強調処理部、371 対象特定部、

372 強調部、380 距離情報取得部、390 既知特性情報取得部、

400 表示部、500 外部I/F部

Claims (13)

- 被写体の像を含む撮像画像を取得する画像取得部と、

前記被写体の動き量を取得する動き量取得部と、

前記被写体に関する既知の特性を表す情報である既知特性情報を取得する既知特性情報取得部と、

前記動き量に対応する処理内容で、前記既知特性情報に基づいて強調処理を行う強調処理部と、

を含むことを特徴とする画像処理装置。 - 請求項1において、

前記撮像画像を撮像する際の撮像部から前記被写体までの距離を表す距離情報を取得する距離情報取得部を含み、

前記強調処理部は、

前記距離情報及び前記既知特性情報に基づいて、前記動き量に対応する前記処理内容の前記強調処理を行うことを特徴とする画像処理装置。 - 請求項2において、

前記既知特性情報取得部は、

前記被写体の構造に関する既知の特性を表す情報である前記既知特性情報を取得し、

前記強調処理部は、

前記既知特性情報により特定される特性と合致する前記被写体の凹凸部を前記強調処理の対象として、前記強調処理を行うことを特徴とする画像処理装置。 - 請求項3において、

前記強調処理部は、

前記動き量が閾値よりも大きい場合には、前記凹凸部のうち第1のサイズ閾値よりもサイズが大きいと判断した凹凸部に対して前記強調処理を行い、

前記動き量が前記閾値よりも小さい場合には、前記凹凸部のうち第2のサイズ閾値よりもサイズが小さいと判断した凹凸部に対して前記強調処理を行うことを特徴とする画像処理装置。 - 請求項1において、

前記既知特性情報取得部は、

前記被写体の色に関する既知の特性を表す情報である前記既知特性情報を取得することを特徴とする画像処理装置。 - 請求項5において、

前記強調処理部は、

前記既知特性情報により特定される特性と合致する前記被写体を前記強調処理の対象として、前記動き量に対応する前記処理内容で前記強調処理を行うことを特徴とする画像処理装置。 - 請求項6において、

前記強調処理部は、

前記動き量が閾値よりも大きい場合には、前記対象の色を強調する前記強調処理を行い、

前記動き量が前記閾値よりも小さい場合には、前記対象の少なくとも構造を強調する前記強調処理を行うことを特徴とする画像処理装置。 - 請求項6において、

前記既知特性情報は、正常粘膜の色よりも赤成分が大きい発赤部の色に関する既知の特性を表す情報であり、

前記強調処理部は、

前記動き量が閾値よりも大きい場合には、前記発赤部の赤成分を強調する前記強調処理を行うことを特徴とする画像処理装置。 - 請求項1において、

前記強調処理部は、

前記既知特性情報により特定される特性と合致する前記被写体を前記強調処理の対象として、前記動き量に対応する前記処理内容で前記強調処理を行うことを特徴とする画像処理装置。 - 請求項9において、

前記強調処理部は、

前記動き量が、前記被写体のスクリーニング観察に対応する動き量に該当すると判断した場合には、前記既知特性情報により特定される特性と合致する前記被写体を前記強調処理の対象として第1の処理内容の前記強調処理を行い、

前記動き量が、前記被写体の拡大観察に対応する動き量に該当すると判断した場合には、前記既知特性情報により特定される特性と合致する前記被写体を前記強調処理の対象として前記第1の処理内容とは異なる第2の処理内容の前記強調処理を行うことを特徴とする画像処理装置。 - 請求項1に記載された画像処理装置を含むことを特徴とする内視鏡装置。

- 被写体の像を含む撮像画像を取得し、

前記被写体の動き量を取得し、

前記被写体に関する既知の特性を表す情報である既知特性情報を取得し、

前記動き量に対応する処理内容で、前記既知特性情報に基づいて強調処理を行うことを特徴とする画像処理方法。 - 被写体の像を含む撮像画像を取得し、

前記被写体の動き量を取得し、

前記被写体に関する既知の特性を表す情報である既知特性情報を取得し、

前記動き量に対応する処理内容で、前記既知特性情報に基づいて強調処理を行うステップを、

コンピューターに実行させる画像処理プログラム。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP13876108.5A EP2962621A4 (en) | 2013-02-26 | 2013-09-24 | IMAGE PROCESSING DEVICE, ENDOSCOPE DEVICE, IMAGE PROCESSING METHOD, AND IMAGE PROCESSING PROGRAM |

| CN201380073719.1A CN105025775A (zh) | 2013-02-26 | 2013-09-24 | 图像处理装置、内窥镜装置、图像处理方法和图像处理程序 |

| US14/834,816 US20150363942A1 (en) | 2013-02-26 | 2015-08-25 | Image processing device, endoscope apparatus, image processing method, and information storage device |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2013-035729 | 2013-02-26 | ||

| JP2013035729A JP6150554B2 (ja) | 2013-02-26 | 2013-02-26 | 画像処理装置、内視鏡装置、画像処理装置の作動方法及び画像処理プログラム |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| US14/834,816 Continuation US20150363942A1 (en) | 2013-02-26 | 2015-08-25 | Image processing device, endoscope apparatus, image processing method, and information storage device |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2014132474A1 true WO2014132474A1 (ja) | 2014-09-04 |

Family

ID=51427768

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2013/075627 WO2014132474A1 (ja) | 2013-02-26 | 2013-09-24 | 画像処理装置、内視鏡装置、画像処理方法及び画像処理プログラム |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US20150363942A1 (ja) |

| EP (1) | EP2962621A4 (ja) |

| JP (1) | JP6150554B2 (ja) |

| CN (1) | CN105025775A (ja) |

| WO (1) | WO2014132474A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9323978B2 (en) | 2013-06-27 | 2016-04-26 | Olympus Corporation | Image processing device, endoscope apparatus, and image processing method |

Families Citing this family (7)