JP6798032B2 - 地面環境検出方法及び機器 - Google Patents

地面環境検出方法及び機器 Download PDFInfo

- Publication number

- JP6798032B2 JP6798032B2 JP2019535919A JP2019535919A JP6798032B2 JP 6798032 B2 JP6798032 B2 JP 6798032B2 JP 2019535919 A JP2019535919 A JP 2019535919A JP 2019535919 A JP2019535919 A JP 2019535919A JP 6798032 B2 JP6798032 B2 JP 6798032B2

- Authority

- JP

- Japan

- Prior art keywords

- ground environment

- laser

- scan

- sub

- region

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000001514 detection method Methods 0.000 title claims description 38

- 238000000034 method Methods 0.000 claims description 57

- 238000013528 artificial neural network Methods 0.000 claims description 36

- 238000012545 processing Methods 0.000 claims description 31

- 230000004927 fusion Effects 0.000 claims description 23

- 238000013499 data model Methods 0.000 claims description 14

- 238000012549 training Methods 0.000 claims description 12

- 238000013480 data collection Methods 0.000 claims description 3

- 238000000638 solvent extraction Methods 0.000 claims description 3

- 230000011218 segmentation Effects 0.000 description 17

- 238000004891 communication Methods 0.000 description 9

- 230000000694 effects Effects 0.000 description 8

- 238000009434 installation Methods 0.000 description 7

- 230000005540 biological transmission Effects 0.000 description 6

- 230000006870 function Effects 0.000 description 6

- 238000004587 chromatography analysis Methods 0.000 description 4

- 238000007796 conventional method Methods 0.000 description 3

- 238000010586 diagram Methods 0.000 description 3

- 238000002310 reflectometry Methods 0.000 description 3

- 230000008878 coupling Effects 0.000 description 2

- 238000010168 coupling process Methods 0.000 description 2

- 238000005859 coupling reaction Methods 0.000 description 2

- 238000005516 engineering process Methods 0.000 description 2

- 239000000835 fiber Substances 0.000 description 2

- 230000003287 optical effect Effects 0.000 description 2

- XLYOFNOQVPJJNP-UHFFFAOYSA-N water Substances O XLYOFNOQVPJJNP-UHFFFAOYSA-N 0.000 description 2

- 244000025254 Cannabis sativa Species 0.000 description 1

- 241000196324 Embryophyta Species 0.000 description 1

- 238000006243 chemical reaction Methods 0.000 description 1

- 238000004590 computer program Methods 0.000 description 1

- 238000013461 design Methods 0.000 description 1

- 239000000284 extract Substances 0.000 description 1

- 230000010354 integration Effects 0.000 description 1

- 238000010801 machine learning Methods 0.000 description 1

- 230000002093 peripheral effect Effects 0.000 description 1

- 230000003068 static effect Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/4802—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00 using analysis of echo signal for target characterisation; Target signature; Target cross-section

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/491—Details of non-pulse systems

- G01S7/4912—Receivers

- G01S7/4913—Circuits for detection, sampling, integration or read-out

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/02—Systems using the reflection of electromagnetic waves other than radio waves

- G01S17/06—Systems determining position data of a target

- G01S17/42—Simultaneous measurement of distance and other co-ordinates

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/87—Combinations of systems using electromagnetic waves other than radio waves

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/88—Lidar systems specially adapted for specific applications

- G01S17/93—Lidar systems specially adapted for specific applications for anti-collision purposes

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/88—Lidar systems specially adapted for specific applications

- G01S17/93—Lidar systems specially adapted for specific applications for anti-collision purposes

- G01S17/931—Lidar systems specially adapted for specific applications for anti-collision purposes of land vehicles

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/4808—Evaluating distance, position or velocity data

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/23—Clustering techniques

- G06F18/232—Non-hierarchical techniques

- G06F18/2321—Non-hierarchical techniques using statistics or function optimisation, e.g. modelling of probability density functions

- G06F18/23213—Non-hierarchical techniques using statistics or function optimisation, e.g. modelling of probability density functions with fixed number of clusters, e.g. K-means clustering

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/25—Fusion techniques

- G06F18/251—Fusion techniques of input or preprocessed data

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/25—Fusion techniques

- G06F18/253—Fusion techniques of extracted features

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/20—Image preprocessing

- G06V10/22—Image preprocessing by selection of a specific region containing or referencing a pattern; Locating or processing of specific regions to guide the detection or recognition

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/60—Extraction of image or video features relating to illumination properties, e.g. using a reflectance or lighting model

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/762—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using clustering, e.g. of similar faces in social networks

- G06V10/763—Non-hierarchical techniques, e.g. based on statistics of modelling distributions

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/764—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using classification, e.g. of video objects

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/77—Processing image or video features in feature spaces; using data integration or data reduction, e.g. principal component analysis [PCA] or independent component analysis [ICA] or self-organising maps [SOM]; Blind source separation

- G06V10/80—Fusion, i.e. combining data from various sources at the sensor level, preprocessing level, feature extraction level or classification level

- G06V10/803—Fusion, i.e. combining data from various sources at the sensor level, preprocessing level, feature extraction level or classification level of input or preprocessed data

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/77—Processing image or video features in feature spaces; using data integration or data reduction, e.g. principal component analysis [PCA] or independent component analysis [ICA] or self-organising maps [SOM]; Blind source separation

- G06V10/80—Fusion, i.e. combining data from various sources at the sensor level, preprocessing level, feature extraction level or classification level

- G06V10/806—Fusion, i.e. combining data from various sources at the sensor level, preprocessing level, feature extraction level or classification level of extracted features

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/82—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using neural networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/50—Context or environment of the image

- G06V20/56—Context or environment of the image exterior to a vehicle by using sensors mounted on the vehicle

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Evolutionary Computation (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Software Systems (AREA)

- Multimedia (AREA)

- Artificial Intelligence (AREA)

- General Health & Medical Sciences (AREA)

- Computing Systems (AREA)

- Health & Medical Sciences (AREA)

- Medical Informatics (AREA)

- Databases & Information Systems (AREA)

- Remote Sensing (AREA)

- Radar, Positioning & Navigation (AREA)

- Computer Networks & Wireless Communication (AREA)

- Data Mining & Analysis (AREA)

- Electromagnetism (AREA)

- Life Sciences & Earth Sciences (AREA)

- General Engineering & Computer Science (AREA)

- Bioinformatics & Cheminformatics (AREA)

- Probability & Statistics with Applications (AREA)

- Evolutionary Biology (AREA)

- Bioinformatics & Computational Biology (AREA)

- Biomedical Technology (AREA)

- Mathematical Physics (AREA)

- Molecular Biology (AREA)

- Computational Linguistics (AREA)

- Biophysics (AREA)

- Optical Radar Systems And Details Thereof (AREA)

- Optics & Photonics (AREA)

- Aviation & Aerospace Engineering (AREA)

- Automation & Control Theory (AREA)

Description

Claims (12)

- 地面環境検出装置の実施する方法であって、

地面環境を、異なる動作波長を有するレーザ探測信号を用いてスキャンするステップと、

前記探測信号に対して前記地面環境により反射された反射信号を受信するステップと、

前記地面環境の各スキャンスポットのスキャンスポット情報を前記反射信号に基づき決定するステップであって、前記スキャンスポット情報は、レーザレーダに対する前記スキャンスポットの方向角、距離、及びレーザ反射強度を含む、ステップと、

各スキャンスポットの空間座標情報及びレーザ反射特性を、前記スキャンスポット情報に基づき決定し、前記地面環境を異なるレーザ反射特性を有するサブ領域に区分するステップであって、

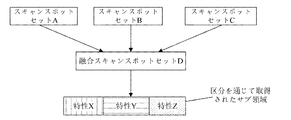

領域区分を、前記スキャンスポット情報に基づき各レーザレーダにより取得された前記スキャンスポットに対して別個に実行して、各レーザレーダが異なるレーザ反射強度を有する、クラスタリング後のサブ領域を生成するステップと、

各レーザレーダのクラスタリング後の前記サブ領域の位置情報を同じ座標系に変換し、各スキャンスポットのスキャンスポット情報を各レーザレーダのクラスタリング後の前記サブ領域に、変換したサブ領域の位置情報に基づき融合し、及び前記地面環境を異なるレーザ反射特性を有する前記サブ領域に区分するステップと、

を含み、前記レーザ反射特性は、異なる波長を有するレーザにおける反射率を含む、ステップと、

各サブ領域の地面環境種別を決定するステップと、

を含む方法。 - 各サブ領域の地面環境種別を決定する前記ステップは、

各サブ領域の前記地面環境種別を、各地面環境種別のレーザ反射特性に基づき決定するステップを含む、請求項1に記載の方法。 - 各サブ領域の地面環境種別を決定する前記ステップは、

各サブ領域のレーザ反射特性をニューラルネットワークに入力して、前記ニューラルネットワークから出力される各サブ領域の前記地面環境種別を取得するステップと、

を含み、

前記ニューラルネットワークにより異なる地面環境種別の間を区別するために使用されるデータモデルは、異なる波長を有する前記レーザにおける異なる地面環境の反射率のデータを入力として及び前記地面環境種別を出力として用いるデータのグループをトレーニングのためのサンプルデータセットとして使用することにより取得される、請求項1に記載の方法。 - 領域区分は、領域拡張法又はK−means法で実行される、請求項1乃至3のいずれか一項に記載の方法。

- 地面環境検出装置であって、

地面環境を、異なる動作波長を有するレーザ探測信号を用いてスキャンし、前記探測信号に対して前記地面環境により反射された反射信号を受信するよう構成されるレーザスキャンユニットと、

前記地面環境の各スキャンスポットのスキャンスポット情報を前記反射信号に基づき決定するよう構成されるデータ収集ユニットであって、前記スキャンスポット情報は、レーザレーダに対する前記スキャンスポットの方向角、距離、及びレーザ反射強度を含む、データ収集ユニットと、

各スキャンスポットの空間座標情報及びレーザ反射特性を、前記スキャンスポット情報に基づき決定し、前記地面環境を異なるレーザ反射特性を有するサブ領域に区分するよう構成されるスキャンデータ処理ユニットであって、

領域区分を、前記スキャンスポット情報に基づき、各レーザレーダにより取得された前記スキャンスポットに対して別個に実行して、各レーザレーダが異なるレーザ反射強度を有するクラスタリング後のサブ領域を生成するよう構成される領域区分サブユニットと、

各レーザレーダのクラスタリング後の前記サブ領域の位置情報を同じ座標系に変換し、各レーザレーダのクラスタリング後の前記サブ領域の中の各スキャンスポットのスキャンスポット情報を変換したサブ領域の位置情報に基づき融合し、及び前記地面環境を異なるレーザ反射特性を有する前記サブ領域に区分するよう構成される融合サブユニットと、

を含み、前記レーザ反射特性は、異なる波長を有するレーザにおける反射率を含む、スキャンデータ処理ユニットと、

各サブ領域の地面環境種別を決定するよう構成される地面環境決定ユニットと、

を含む検出装置。 - 前記地面環境決定ユニットは、

各サブ領域の前記地面環境種別を各地面環境種別のレーザ反射特性に基づき決定するよう構成される、請求項5に記載の検出装置。 - 前記地面環境決定ユニットは、

各サブ領域のレーザ反射特性をニューラルネットワークに入力して、前記ニューラルネットワークから出力される各サブ領域の前記地面環境種別を取得するよう構成され、

前記ニューラルネットワークにより異なる地面環境種別の間を区別するために使用されるデータモデルは、異なる波長を有する前記レーザにおける異なる地面環境の反射率のデータを入力として及び前記地面環境種別を出力として用いるデータのグループをトレーニングのためのサンプルデータセットとして使用することにより取得される、請求項6に記載の検出装置。 - 前記領域区分サブユニットは、領域拡張法又はK−means法で領域区分を実行する、請求項5乃至7のいずれか一項に記載の検出装置。

- 地面環境検出装置であって、

地面環境を、異なる動作波長を有するレーザ探測信号を用いてスキャンし、前記探測信号に対して前記地面環境により反射された反射信号を受信するよう構成されるレーザスキャンユニットと、

プロセッサ及びメモリを含むデータ処理ユニットであって、前記メモリはコンピュータ実行命令を格納するよう構成され、前記プロセッサは、前記コンピュータ実行命令を実行し、

前記地面環境の各スキャンスポットのスキャンスポット情報を前記反射信号に基づき決定し、

各スキャンスポットの空間座標情報及びレーザ反射特性を、前記スキャンスポット情報に基づき決定し、

前記地面環境を異なるレーザ反射特性を有するサブ領域に区分するとき、領域区分を、前記スキャンスポット情報に基づき、各レーザレーダにより取得された前記スキャンスポットに対して別個に実行して、各レーザレーダが異なるレーザ反射強度を有するクラスタリング後のサブ領域を生成し、各レーザレーダのクラスタリング後の前記サブ領域の位置情報を同じ座標系に変換し、各レーザレーダのクラスタリング後の前記サブ領域の中の各スキャンスポットのスキャンスポット情報を、変換したサブ領域の位置情報に基づき融合し、前記地面環境を異なるレーザ反射特性を有する前記サブ領域に区分し、

各サブ領域の地面環境種別を決定する、

よう構成され、前記スキャンスポット情報は、レーザレーダに対する前記スキャンスポットの方向角、距離、及びレーザ反射強度を含み、前記レーザ反射特性は、異なる波長を有するレーザにおける反射率を含む、データ処理ユニットと、

を含む検出装置。 - 前記プロセッサは、各サブ領域の前記地面環境種別を各地面環境種別のレーザ反射特性に基づき決定するよう構成される、請求項9に記載の検出装置。

- 前記プロセッサは、

各サブ領域のレーザ反射特性をニューラルネットワークに入力して、前記ニューラルネットワークから出力される各サブ領域の前記地面環境種別を取得するよう構成され、

前記ニューラルネットワークにより異なる地面環境種別の間を区別するために使用されるデータモデルは、異なる波長を有する前記レーザにおける異なる地面環境の反射率のデータを入力として及び前記地面環境種別を出力として用いるデータのグループをトレーニングのためのサンプルデータセットとして使用することにより取得される、請求項9に記載の検出装置。 - 前記プロセッサは、領域拡張法又はK−means法で領域区分を実行する、請求項9乃至11のいずれか一項に記載の検出装置。

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/CN2016/113089 WO2018119902A1 (zh) | 2016-12-29 | 2016-12-29 | 一种地面环境的检测方法和装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2020504827A JP2020504827A (ja) | 2020-02-13 |

| JP6798032B2 true JP6798032B2 (ja) | 2020-12-09 |

Family

ID=62710144

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019535919A Active JP6798032B2 (ja) | 2016-12-29 | 2016-12-29 | 地面環境検出方法及び機器 |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US11455511B2 (ja) |

| EP (1) | EP3553566B1 (ja) |

| JP (1) | JP6798032B2 (ja) |

| KR (1) | KR102243118B1 (ja) |

| CN (1) | CN110114692B (ja) |

| WO (1) | WO2018119902A1 (ja) |

Families Citing this family (18)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11124193B2 (en) | 2018-05-03 | 2021-09-21 | Volvo Car Corporation | System and method for providing vehicle safety distance and speed alerts under slippery road conditions |

| US11592566B2 (en) | 2019-08-15 | 2023-02-28 | Volvo Car Corporation | Vehicle systems and methods utilizing LIDAR data for road condition estimation |

| WO2020142879A1 (zh) * | 2019-01-07 | 2020-07-16 | 深圳市大疆创新科技有限公司 | 数据处理方法、探测装置、数据处理装置、可移动平台 |

| CN110441269A (zh) * | 2019-08-13 | 2019-11-12 | 江苏东交工程检测股份有限公司 | 标线反光检测方法、装置、设备及存储介质 |

| CN110674292B (zh) * | 2019-08-27 | 2023-04-18 | 腾讯科技(深圳)有限公司 | 一种人机交互方法、装置、设备及介质 |

| US10852158B1 (en) * | 2019-09-27 | 2020-12-01 | Kitty Hawk Corporation | Distance sensor test system |

| CN113040645B (zh) * | 2019-12-26 | 2022-08-02 | 江苏美的清洁电器股份有限公司 | 清洁设备、清洁设备控制方法及装置 |

| CN111123278B (zh) * | 2019-12-30 | 2022-07-12 | 科沃斯机器人股份有限公司 | 分区方法、设备及存储介质 |

| EP4099293B1 (en) * | 2020-02-25 | 2024-04-24 | Huawei Technologies Co., Ltd. | Method and apparatus for identifying special road conditions, electronic device, and storage medium |

| CN111724485B (zh) * | 2020-06-11 | 2024-06-07 | 浙江商汤科技开发有限公司 | 实现虚实融合的方法、装置、电子设备及存储介质 |

| CN111948669B (zh) * | 2020-08-11 | 2023-01-10 | 锐驰智光(苏州)科技有限公司 | 一种基于激光雷达的高光谱数据信息获取系统 |

| JP7338607B2 (ja) * | 2020-10-29 | 2023-09-05 | トヨタ自動車株式会社 | 車両位置推定装置 |

| CN112598690A (zh) * | 2020-12-11 | 2021-04-02 | 浙江大华技术股份有限公司 | 一种包裹切分方法、装置、设备及介质 |

| CN114812529B (zh) * | 2021-01-18 | 2023-12-08 | 上海理工大学 | 一种洁净室测点装置及洁净室的测点方法 |

| CN115248428B (zh) * | 2021-04-28 | 2023-12-22 | 北京航迹科技有限公司 | 激光雷达的标定、扫描方法、装置、电子设备及存储介质 |

| CN113436258B (zh) * | 2021-06-17 | 2023-09-12 | 中国船舶重工集团公司第七0七研究所九江分部 | 基于视觉与激光雷达融合的海上浮码头检测方法及系统 |

| CN113670277A (zh) * | 2021-08-25 | 2021-11-19 | 广东博智林机器人有限公司 | 地面装饰安装测绘方法、装置和测绘小车 |

| CN117872354B (zh) * | 2024-03-11 | 2024-05-31 | 陕西欧卡电子智能科技有限公司 | 一种多毫米波雷达点云的融合方法、装置、设备及介质 |

Family Cites Families (34)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CA1235773A (en) * | 1983-12-23 | 1988-04-26 | Shigeto Nakayama | Device for detecting road surface condition |

| US7630806B2 (en) * | 1994-05-23 | 2009-12-08 | Automotive Technologies International, Inc. | System and method for detecting and protecting pedestrians |

| US7840342B1 (en) * | 1997-10-22 | 2010-11-23 | Intelligent Technologies International, Inc. | Road physical condition monitoring techniques |

| NL1009364C2 (nl) * | 1998-06-10 | 1999-12-13 | Road Ware B V | Inrichting voor het bepalen van een profiel van een wegdek. |

| JP2002156452A (ja) * | 2000-11-20 | 2002-05-31 | Hioki Ee Corp | レーザレーダシステム |

| JP2005090974A (ja) * | 2003-09-12 | 2005-04-07 | Daihatsu Motor Co Ltd | 先行車認識装置 |

| US7026600B2 (en) | 2004-02-26 | 2006-04-11 | Rosemount Aerospace Inc. | System and method of identifying an object in a laser beam illuminated scene based on material types |

| JP3955616B2 (ja) * | 2005-09-01 | 2007-08-08 | 松下電器産業株式会社 | 画像処理方法、画像処理装置及び画像処理プログラム |

| JP2007240314A (ja) * | 2006-03-08 | 2007-09-20 | Omron Corp | 物体検出装置 |

| WO2008037282A1 (en) | 2006-09-28 | 2008-04-03 | B.E.A. S.A. | Sensor for presence detection |

| CN101806579B (zh) * | 2009-02-16 | 2012-11-21 | 华为技术有限公司 | 反射镜位置采样、标定方法及装置和激光器 |

| US8812274B2 (en) * | 2009-04-24 | 2014-08-19 | Hermant Virkar | Methods for mapping data into lower dimensions |

| CN102142892B (zh) * | 2010-06-30 | 2014-12-17 | 华为技术有限公司 | 一种探测脉冲的产生方法和相干光时域反射仪 |

| JP2012189535A (ja) * | 2011-03-14 | 2012-10-04 | Ihi Corp | 植生検出装置及び植生検出方法 |

| US9155675B2 (en) * | 2011-10-12 | 2015-10-13 | Board Of Trustees Of The University Of Arkansas | Portable robotic device |

| JP2013181968A (ja) * | 2012-03-05 | 2013-09-12 | Ricoh Co Ltd | 光学装置 |

| US9110196B2 (en) | 2012-09-20 | 2015-08-18 | Google, Inc. | Detecting road weather conditions |

| DE102013002333A1 (de) * | 2013-02-12 | 2014-08-14 | Continental Teves Ag & Co. Ohg | Verfahren und Strahlensensormodul zur vorausschauenden Straßenzustandsbestimmung in einem Fahrzeug |

| US9128190B1 (en) * | 2013-03-06 | 2015-09-08 | Google Inc. | Light steering device with an array of oscillating reflective slats |

| CN103198302B (zh) * | 2013-04-10 | 2015-12-02 | 浙江大学 | 一种基于双模态数据融合的道路检测方法 |

| JP2015014514A (ja) * | 2013-07-04 | 2015-01-22 | パイオニア株式会社 | 識別装置 |

| US9329073B2 (en) * | 2013-12-06 | 2016-05-03 | Honeywell International Inc. | Adaptive radar system with mutliple waveforms |

| CN103776318A (zh) * | 2014-01-03 | 2014-05-07 | 中国人民解放军陆军军官学院 | 光电检测环境模拟系统 |

| CN104463217A (zh) * | 2014-12-15 | 2015-03-25 | 长春理工大学 | 基于激光雷达的路面类型识别方法及装置 |

| CN104408443B (zh) | 2014-12-15 | 2017-07-18 | 长春理工大学 | 多传感器辅助的基于激光雷达的路面类型识别方法及装置 |

| US9453941B2 (en) * | 2014-12-22 | 2016-09-27 | GM Global Technology Operations LLC | Road surface reflectivity detection by lidar sensor |

| CN104656101B (zh) * | 2015-01-30 | 2015-11-18 | 福州华鹰重工机械有限公司 | 一种障碍物检测方法 |

| CN104850834A (zh) | 2015-05-11 | 2015-08-19 | 中国科学院合肥物质科学研究院 | 基于三维激光雷达的道路边界检测方法 |

| JP2016223795A (ja) * | 2015-05-27 | 2016-12-28 | 国立大学法人名古屋大学 | 床面状態検出装置および床面状態検出方法 |

| CN105094143A (zh) * | 2015-08-27 | 2015-11-25 | 泉州装备制造研究所 | 基于无人机的地图显示方法和装置 |

| US10832426B2 (en) * | 2015-09-24 | 2020-11-10 | Apple Inc. | Systems and methods for surface monitoring |

| CN105510897A (zh) * | 2015-12-01 | 2016-04-20 | 中国科学院上海技术物理研究所 | 基于地物类型卫星激光雷达出射激光波长反射率估算方法 |

| KR20170096723A (ko) * | 2016-02-17 | 2017-08-25 | 한국전자통신연구원 | 라이다 시스템 및 이의 다중 검출 신호 처리 방법 |

| US10761195B2 (en) * | 2016-04-22 | 2020-09-01 | OPSYS Tech Ltd. | Multi-wavelength LIDAR system |

-

2016

- 2016-12-29 JP JP2019535919A patent/JP6798032B2/ja active Active

- 2016-12-29 WO PCT/CN2016/113089 patent/WO2018119902A1/zh unknown

- 2016-12-29 EP EP16925037.0A patent/EP3553566B1/en active Active

- 2016-12-29 CN CN201680091952.6A patent/CN110114692B/zh active Active

- 2016-12-29 KR KR1020197021867A patent/KR102243118B1/ko active IP Right Grant

-

2019

- 2019-06-28 US US16/456,057 patent/US11455511B2/en active Active

Also Published As

| Publication number | Publication date |

|---|---|

| EP3553566A4 (en) | 2020-01-08 |

| WO2018119902A1 (zh) | 2018-07-05 |

| KR20190098238A (ko) | 2019-08-21 |

| EP3553566A1 (en) | 2019-10-16 |

| CN110114692B (zh) | 2021-09-17 |

| JP2020504827A (ja) | 2020-02-13 |

| US11455511B2 (en) | 2022-09-27 |

| CN110114692A (zh) | 2019-08-09 |

| US20190317218A1 (en) | 2019-10-17 |

| EP3553566B1 (en) | 2022-06-22 |

| KR102243118B1 (ko) | 2021-04-21 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6798032B2 (ja) | 地面環境検出方法及び機器 | |

| Bansal et al. | Pointillism: Accurate 3d bounding box estimation with multi-radars | |

| JP6802331B2 (ja) | 車線処理方法及び装置 | |

| CN107818557B (zh) | 用于自动车辆的增强型相机对象检测 | |

| Chen et al. | Principal axes descriptor for automated construction-equipment classification from point clouds | |

| JP2020079781A (ja) | 相対的位置姿勢の決定方法、装置、機器及び媒体 | |

| CN102915444A (zh) | 图像配准 | |

| US20220214444A1 (en) | Lidar and radar based tracking and mapping system and method thereof | |

| KR102040702B1 (ko) | 위성영상을 이용한 활용서비스 제공 장치 및 방법 | |

| US11774554B2 (en) | Electronic device, system and method for augmenting image data of a passive optical sensor | |

| US20210216814A1 (en) | Adaptive search for lidar-based clustering | |

| KR101864127B1 (ko) | 무인 차량을 위한 주변 환경 매핑 방법 및 장치 | |

| US11900691B2 (en) | Method for evaluating sensor data, including expanded object recognition | |

| WO2020127151A1 (en) | Method for improved object detection | |

| CN112444822A (zh) | 合成激光雷达信号的产生 | |

| CN114495045A (zh) | 感知方法、感知装置、感知系统及相关设备 | |

| Mussone et al. | An innovative method for the analysis of vehicle movements in roundabouts based on image processing | |

| Eslami et al. | Improvement of multiclass classification of pavement objects using intensity and range images | |

| Aboalia et al. | Enhancing Power Lines Detection Using Deep Learning and Feature-Level Fusion of Infrared and Visible Light Images | |

| Liang et al. | Learning Cross-modality Interaction for Robust Depth Perception of Autonomous Driving | |

| Li et al. | Digitizing and inventorying traffic control infrastructures: A review of practices | |

| WO2023193567A1 (zh) | 机器人的移动控制方法和装置、存储介质及电子装置 | |

| Boukhers et al. | Less restrictive camera odometry estimation from monocular camera | |

| Baek et al. | Robust tracking and detection based on radar camera fusion filtering in urban autonomous driving | |

| CN117290805A (zh) | 多识别设备的信息处理方法、控制装置及存储介质 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20190806 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20190806 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20200616 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20200914 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20201020 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20201118 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6798032 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |