JP6598089B2 - ジェスチャコントロール方法、装置、端末デバイス、およびストレージ媒体 - Google Patents

ジェスチャコントロール方法、装置、端末デバイス、およびストレージ媒体 Download PDFInfo

- Publication number

- JP6598089B2 JP6598089B2 JP2017553945A JP2017553945A JP6598089B2 JP 6598089 B2 JP6598089 B2 JP 6598089B2 JP 2017553945 A JP2017553945 A JP 2017553945A JP 2017553945 A JP2017553945 A JP 2017553945A JP 6598089 B2 JP6598089 B2 JP 6598089B2

- Authority

- JP

- Japan

- Prior art keywords

- gesture

- touch

- touch action

- action

- type

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 title claims description 82

- 230000009471 action Effects 0.000 claims description 327

- 230000001133 acceleration Effects 0.000 claims description 95

- 230000006870 function Effects 0.000 claims description 94

- 238000013507 mapping Methods 0.000 claims description 46

- 238000004364 calculation method Methods 0.000 claims description 15

- 230000005484 gravity Effects 0.000 claims description 7

- 238000001514 detection method Methods 0.000 claims description 6

- 230000003993 interaction Effects 0.000 description 11

- 238000010586 diagram Methods 0.000 description 8

- 230000008569 process Effects 0.000 description 8

- 238000005516 engineering process Methods 0.000 description 6

- 230000009916 joint effect Effects 0.000 description 6

- 238000004891 communication Methods 0.000 description 5

- 230000001960 triggered effect Effects 0.000 description 5

- 230000008859 change Effects 0.000 description 4

- 210000001145 finger joint Anatomy 0.000 description 3

- 230000008878 coupling Effects 0.000 description 2

- 238000010168 coupling process Methods 0.000 description 2

- 238000005859 coupling reaction Methods 0.000 description 2

- 230000000694 effects Effects 0.000 description 2

- 238000012545 processing Methods 0.000 description 2

- 238000010079 rubber tapping Methods 0.000 description 2

- TVEXGJYMHHTVKP-UHFFFAOYSA-N 6-oxabicyclo[3.2.1]oct-3-en-7-one Chemical compound C1C2C(=O)OC1C=CC2 TVEXGJYMHHTVKP-UHFFFAOYSA-N 0.000 description 1

- 230000009286 beneficial effect Effects 0.000 description 1

- 238000004422 calculation algorithm Methods 0.000 description 1

- 239000003990 capacitor Substances 0.000 description 1

- 238000004590 computer program Methods 0.000 description 1

- 230000005684 electric field Effects 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000003287 optical effect Effects 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 238000005316 response function Methods 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

- G06F3/04883—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures for inputting data by handwriting, e.g. gesture or text

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F1/00—Details not covered by groups G06F3/00 - G06F13/00 and G06F21/00

- G06F1/16—Constructional details or arrangements

- G06F1/1613—Constructional details or arrangements for portable computers

- G06F1/1633—Constructional details or arrangements of portable computers not specific to the type of enclosures covered by groups G06F1/1615 - G06F1/1626

- G06F1/1684—Constructional details or arrangements related to integrated I/O peripherals not covered by groups G06F1/1635 - G06F1/1675

- G06F1/1694—Constructional details or arrangements related to integrated I/O peripherals not covered by groups G06F1/1635 - G06F1/1675 the I/O peripheral being a single or a set of motion sensors for pointer control or gesture input obtained by sensing movements of the portable computer

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0484—Interaction techniques based on graphical user interfaces [GUI] for the control of specific functions or operations, e.g. selecting or manipulating an object, an image or a displayed text element, setting a parameter value or selecting a range

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F2200/00—Indexing scheme relating to G06F1/04 - G06F1/32

- G06F2200/16—Indexing scheme relating to G06F1/16 - G06F1/18

- G06F2200/163—Indexing scheme relating to constructional details of the computer

- G06F2200/1636—Sensing arrangement for detection of a tap gesture on the housing

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F2203/00—Indexing scheme relating to G06F3/00 - G06F3/048

- G06F2203/048—Indexing scheme relating to G06F3/048

- G06F2203/04808—Several contacts: gestures triggering a specific function, e.g. scrolling, zooming, right-click, when the user establishes several contacts with the surface simultaneously; e.g. using several fingers or a combination of fingers and pen

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/033—Pointing devices displaced or positioned by the user, e.g. mice, trackballs, pens or joysticks; Accessories therefor

- G06F3/0346—Pointing devices displaced or positioned by the user, e.g. mice, trackballs, pens or joysticks; Accessories therefor with detection of the device orientation or free movement in a 3D space, e.g. 3D mice, 6-DOF [six degrees of freedom] pointers using gyroscopes, accelerometers or tilt-sensors

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- General Engineering & Computer Science (AREA)

- Computer Hardware Design (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- User Interface Of Digital Computer (AREA)

- Telephone Function (AREA)

Description

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出するステップと、

タッチアクションがタッチスクリーンと接触しているときに生成されたタッチスクリーン上のタッチアクションの接触面積およびz軸加速度(z-axis acceleration)を取得するステップと、

接触面積が予め設定された面積よりも大きく、z軸加速度が予め設定された加速度よりも大きい場合、タッチアクションが関節タッチアクション(joint touch action)であると判定するステップと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従って端末デバイスの予め設定された機能を呼び出すステップとを含む、方法を提供する。

関節タッチアクションが実行されるユーザインターフェース、およびユーザインターフェースが属するアプリケーションプログラムを決定することと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってアプリケーションプログラムに対応する予め設定された機能を呼び出すこととを含む。

関節タッチアクションが実行されるユーザインターフェースを決定することと、

関節アクションが実行されるユーザインターフェースが端末デバイスのシステムデスクトップである場合、ジェスチャの種類に関連するアプリケーションプログラムを照会し、アプリケーションプログラムを起動するかまたは閉じることとを含む。

関節タッチアクションが実行されるユーザインターフェースを決定することと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってユーザインターフェース上で動作を実行することであって、動作が、スクリーンキャプチャ、アイコンの整列、またはテーマの取り替えを含む、実行することとを含む。

タッチスクリーンの接触領域内のタッチアクションのピクセルの量m、タッチスクリーンのピクセルの量n、およびタッチスクリーンの面積sを取得することと、

式s*(m/n)を使用することによって計算によりタッチスクリーン上のタッチアクションの接触面積を取得することと、

端末デバイスに付随する重力加速度センサを使用することによってタッチアクションのz軸加速度を取得することとを含む。

予め設定された機能と関節タッチアクションに対応するジェスチャの種類との間のマッピング関係をカスタマイズし、マッピング関係をマッピング関係データベースに記憶するステップをさらに含む。

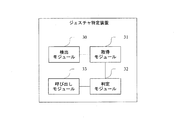

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出するように構成された検出モジュールと、

タッチアクションがタッチスクリーンと接触しているときに生成されたタッチスクリーン上のタッチアクションの接触面積およびz軸加速度を取得するように構成された取得モジュールと、

接触面積が予め設定された面積よりも大きく、z軸加速度が予め設定された加速度よりも大きい場合、タッチアクションが関節タッチアクションであると判定するように構成された判定モジュールと、

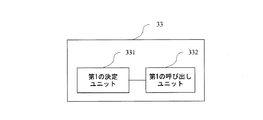

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従って端末デバイスの予め設定された機能を呼び出すように構成された呼び出しモジュールとを含む、装置を提供する。

関節タッチアクションが実行されるユーザインターフェース、およびユーザインターフェースが属するアプリケーションプログラムを決定するように構成された第1の決定ユニットと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってアプリケーションプログラムに対応する予め設定された機能を呼び出すように構成された第1の呼び出しユニットとを含む。

関節タッチアクションが実行されるユーザインターフェースを決定するように構成された第2の決定ユニットと、

関節アクションが実行されるユーザインターフェースが端末デバイスのシステムデスクトップである場合、ジェスチャの種類に関連するアプリケーションプログラムを照会し、アプリケーションプログラムを起動するかまたは閉じるように構成された第2の呼び出しユニットとを含む。

関節タッチアクションが実行されるユーザインターフェースを決定するように構成された第3の決定ユニットと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってユーザインターフェース上で動作を実行するように構成された第3の呼び出しユニットであって、動作が、スクリーンキャプチャ、アイコンの整列、またはテーマの取り替えを含む、第3の呼び出しユニットとを含む。

タッチスクリーンの接触領域内のタッチアクションのピクセルの量m、タッチスクリーンのピクセルの量n、およびタッチスクリーンの面積sを取得するように構成された第1の取得ユニットと、

式s*(m/n)を使用することによって計算によりタッチスクリーン上のタッチアクションの接触面積を取得するように構成された計算ユニットと、

端末デバイスに付随する重力加速度センサを使用することによってタッチアクションのz軸加速度を取得するように構成された第2の取得ユニットとを含む。

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出する動作と、

タッチアクションがタッチスクリーンと接触しているときに生成されたタッチスクリーン上のタッチアクションの接触面積およびz軸加速度を取得する動作と、

接触面積が予め設定された面積よりも大きく、z軸加速度が予め設定された加速度よりも大きい場合、タッチアクションが関節タッチアクションであると判定する動作と、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従って端末デバイスの予め設定された機能を呼び出す動作とを実行するためにメモリに記憶されたプログラムコードを呼び出す、装置を提供する。

関節タッチアクションが実行されるユーザインターフェース、およびユーザインターフェースが属するアプリケーションプログラムを決定することと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってアプリケーションプログラムに対応する予め設定された機能を呼び出すこととを含む。

関節タッチアクションが実行されるユーザインターフェースを決定することと、

関節アクションが実行されるユーザインターフェースが端末デバイスのシステムデスクトップである場合、ジェスチャの種類に関連するアプリケーションプログラムを照会し、アプリケーションプログラムを起動するかまたは閉じることとを含む。

関節タッチアクションが実行されるユーザインターフェースを決定するように構成された第3の決定ユニットと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってユーザインターフェース上で動作を実行するように構成された第3の呼び出しユニットであって、動作が、スクリーンキャプチャ、アイコンの整列、またはテーマの取り替えを含む、第3の呼び出しユニットとを含む。

タッチスクリーンの接触領域内のタッチアクションのピクセルの量m、タッチスクリーンのピクセルの量n、およびタッチスクリーンの面積sを取得することと、

式s*(m/n)を使用することによって計算によりタッチスクリーン上のタッチアクションの接触面積を取得することと、

端末デバイスに付随する重力加速度センサを使用することによってタッチアクションのz軸加速度を取得することとを含む。

予め設定された機能と関節タッチアクションに対応するジェスチャの種類との間のマッピング関係をカスタマイズし、マッピング関係をマッピング関係データベースに記憶する動作を実行するようにさらに構成される。

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出するステップと、

タッチアクションがタッチスクリーンと接触しているときに生成されたタッチスクリーン上のタッチアクションの接触面積およびz軸加速度を取得するステップと、

接触面積が予め設定された面積よりも大きく、z軸加速度が予め設定された加速度よりも大きい場合、タッチアクションが関節タッチアクションであると判定するステップと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従って端末デバイスの予め設定された機能を呼び出すステップとを含む、ストレージ媒体を提供する。

関節タッチアクションが実行されるユーザインターフェース、およびユーザインターフェースが属するアプリケーションプログラムを決定することと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってアプリケーションプログラムに対応する予め設定された機能を呼び出すこととを含む。

関節タッチアクションが実行されるユーザインターフェースを決定することと、

関節アクションが実行されるユーザインターフェースが端末デバイスのシステムデスクトップである場合、ジェスチャの種類に関連するアプリケーションプログラムを照会し、アプリケーションプログラムを起動するかまたは閉じることとを含む。

関節タッチアクションが実行されるユーザインターフェースを決定することと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってユーザインターフェース上で動作を実行することとを含む。

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出する動作と、

タッチアクションがタッチスクリーンと接触しているときに生成されたタッチスクリーン上のタッチアクションの接触面積およびz軸加速度を取得する動作と、

接触面積が予め設定された面積よりも大きく、z軸加速度が予め設定された加速度よりも大きい場合、タッチアクションが関節タッチアクションであると判定する動作と、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従って端末デバイスの予め設定された機能を呼び出す動作とを実行するために、メモリ72に記憶されたプログラムコードを呼び出すように構成される。

関節タッチアクションが実行されるユーザインターフェース、およびユーザインターフェースが属するアプリケーションプログラムを決定することと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってアプリケーションプログラムに対応する予め設定された機能を呼び出すこととを含む。

関節タッチアクションが実行されるユーザインターフェースを決定することと、

関節アクションが実行されるユーザインターフェースが端末デバイスのシステムデスクトップである場合、ジェスチャの種類に関連するアプリケーションプログラムを照会し、アプリケーションプログラムを起動するかまたは閉じることとを含む。

関節タッチアクションが実行されるユーザインターフェースを決定することと、

関節タッチアクションに対応するジェスチャの種類を特定し、ジェスチャの種類に従ってユーザインターフェース上で動作を実行することであって、動作が、スクリーンキャプチャ、アイコンの整列、またはテーマの取り替えを含む、実行することとを含む。

タッチスクリーンの接触領域内のタッチアクションのピクセルの量m、タッチスクリーンのピクセルの量n、およびタッチスクリーンの面積sを取得することと、

式s*(m/n)を使用することによって計算によりタッチスクリーン上のタッチアクションの接触面積を取得することと、

タッチアクションのz軸加速度が、端末デバイスに付随する重力加速度センサを使用することによって取得されることとを含む。

予め設定された機能と関節タッチアクションに対応するジェスチャの種類との間のマッピング関係をカスタマイズし、マッピング関係をマッピング関係データベースに記憶する動作を実行するようにさらに構成される。

31 取得モジュール

311 取得ユニット

312 計算ユニット

313 第2の取得モジュール

32 判定モジュール

33 呼び出しモジュール

331 第1の決定ユニット

332 第2の呼び出しユニット

333 第2の決定ユニット

334 第2の呼び出しユニット

335 第3の決定ユニット

336 第3の呼び出しユニット

34 マッピングモジュール

71 プロセッサ

72 メモリ

73 通信ユーザインターフェース

81 ジェスチャ特定装置

82 重力センサ

83 タッチスクリーン

Claims (21)

- ジェスチャコントロール方法であって、

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出するステップと、

前記タッチアクションが前記タッチスクリーンと接触しているときに生成された前記タッチスクリーン上の前記タッチアクションの接触面積およびz軸加速度を取得するステップであって、z軸は、前記タッチスクリーンと垂直な方向であり、前記接触面積および前記z軸加速度は、指が前記タッチスクリーンを初めて押下したときに取得され、前記タッチスクリーン上の前記タッチアクションの前記接触面積は、式s*(m/n)を使用することによって計算により取得され、ここで、sは前記タッチスクリーンの面積であり、mは前記タッチスクリーンの接触領域内の前記タッチアクションのピクセルの量であり、nはタッチスクリーンのピクセルの量であり、前記タッチアクションの前記z軸加速度は、前記端末デバイスに付随する重力加速度センサを使用することによって取得される、ステップと、

前記接触面積が予め設定された面積よりも大きく、前記z軸加速度が予め設定された加速度よりも大きい場合、前記タッチアクションが関節タッチアクションであると判定するステップと、

前記関節タッチアクションに対応するジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの予め設定された機能を呼び出すステップとを含み、

前記端末デバイスの前記タッチスクリーン上で実行された前記タッチアクションを検出する前に、前記方法は、カスタマイズされたジェスチャを学習するステップをさらに含み、前記カスタマイズされたジェスチャは少なくとも2回入力され、各回のカスタマイズされたジェスチャの類似性が予め決定された閾値よりも大きい場合に、前記カスタマイズされたジェスチャが成功裏に学習される、方法。 - 前記関節タッチアクションに対応するジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの予め設定された機能を呼び出す前記ステップが、

前記関節タッチアクションが実行されるユーザインターフェース、および前記ユーザインターフェースが属するアプリケーションプログラムを決定することと、

前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記アプリケーションプログラムに対応する予め設定された機能を呼び出すこととを含む請求項1に記載の方法。 - 前記関節タッチアクションに対応するジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの予め設定された機能を呼び出す前記ステップが、

前記関節タッチアクションが実行されるユーザインターフェースを決定することと、

前記関節タッチアクションが実行される前記ユーザインターフェースが前記端末デバイスのシステムデスクトップである場合、前記ジェスチャの種類に関連するアプリケーションプログラムを照会し、前記アプリケーションプログラムを起動するかまたは閉じることとを含む請求項1に記載の方法。 - 前記関節タッチアクションに対応するジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの予め設定された機能を呼び出す前記ステップが、

前記関節タッチアクションが実行されるユーザインターフェースを決定することと、

前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記ユーザインターフェース上で動作を実行することであって、前記動作が、スクリーンキャプチャ、アイコンの整列、またはテーマの取り替えを含む、実行することとを含む請求項1に記載の方法。 - 前記タッチアクションに対応する前記ジェスチャの種類が、タップジェスチャまたはスライドジェスチャを含み、前記タップジェスチャが、1点1タップジェスチャ、1点多タップジェスチャ、または多点タップジェスチャのうちの少なくとも1つを含み、前記スライドジェスチャのスライドの軌跡が、閉じた軌跡または閉じていない軌跡のうちの少なくとも1つを含む請求項1から4のいずれか一項に記載の方法。

- 端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出する前に、

前記予め設定された機能と前記関節タッチアクションに対応する前記ジェスチャの種類との間のマッピング関係をカスタマイズし、前記マッピング関係をマッピング関係データベースに記憶するステップをさらに含む請求項1から5のいずれか一項に記載の方法。 - ジェスチャコントロール装置であって、

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出するように構成された検出モジュールと、

前記タッチアクションが前記タッチスクリーンと接触しているときに生成された前記タッチスクリーン上の前記タッチアクションの接触面積およびz軸加速度を取得するように構成された取得モジュールであって、z軸は、前記タッチスクリーンと垂直な方向であり、前記接触面積および前記z軸加速度は、指が前記タッチスクリーンを初めて押下したときに取得され、前記タッチスクリーン上の前記タッチアクションの前記接触面積は、式s*(m/n)を使用することによって計算により取得され、ここで、sは前記タッチスクリーンの面積であり、mは前記タッチスクリーンの接触領域内の前記タッチアクションのピクセルの量であり、nはタッチスクリーンのピクセルの量であり、前記タッチアクションの前記z軸加速度は、前記端末デバイスに付随する重力加速度センサを使用することによって取得される、取得モジュールと、

前記接触面積が予め設定された面積よりも大きく、前記z軸加速度が予め設定された加速度よりも大きい場合、前記タッチアクションが関節タッチアクションであると判定するように構成された判定モジュールと、

前記関節タッチアクションに対応するジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの予め設定された機能を呼び出すように構成された呼び出しモジュールと、

前記端末デバイスの前記タッチスクリーン上で実行された前記タッチアクションを検出する前に、学習されるべきカスタマイズされたジェスチャをユーザが少なくとも2回入力するように構成されたジェスチャ学習ユーザインターフェースであって、各回のカスタマイズされたジェスチャの類似性が予め決定された閾値よりも大きい場合に、前記カスタマイズされたジェスチャが成功裏に学習される、ジェスチャ学習ユーザインターフェースとを含む、装置。 - 前記呼び出しモジュールが、

前記関節タッチアクションが実行されるユーザインターフェース、および前記ユーザインターフェースが属するアプリケーションプログラムを決定するように構成された第1の決定ユニットと、

前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記アプリケーションプログラムに対応する予め設定された機能を呼び出すように構成された第1の呼び出しユニットとを含む請求項7に記載の装置。 - 前記呼び出しモジュールが、

前記関節タッチアクションが実行されるユーザインターフェースを決定するように構成された第2の決定ユニットと、

前記関節タッチアクションが実行される前記ユーザインターフェースが前記端末デバイスのシステムデスクトップである場合、前記ジェスチャの種類に関連するアプリケーションプログラムを照会し、前記アプリケーションプログラムを起動するかまたは閉じるように構成された第2の呼び出しユニットとを含む請求項7に記載の装置。 - 前記呼び出しモジュールが、

前記関節タッチアクションが実行されるユーザインターフェースを決定するように構成された第3の決定ユニットと、

前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記ユーザインターフェース上で動作を実行するように構成された第3の呼び出しユニットであって、前記動作が、スクリーンキャプチャ、アイコンの整列、またはテーマの取り替えを含む、第3の呼び出しユニットとを含む請求項7に記載の装置。 - 前記タッチアクションに対応する前記ジェスチャの種類が、タップジェスチャまたはスライドジェスチャを含み、前記タップジェスチャが、1点1タップジェスチャ、1点多タップジェスチャ、または多点タップジェスチャのうちの少なくとも1つを含み、前記スライドジェスチャのスライドの軌跡が、閉じた軌跡または閉じていない軌跡のうちの少なくとも1つを含む請求項7から10のいずれか一項に記載の装置。

- 前記関節タッチアクションに対応する前記ジェスチャの種類と前記予め設定された機能との間のマッピング関係をカスタマイズし、前記マッピング関係をマッピング関係データベースに記憶するように構成されたマッピングモジュールをさらに含む請求項7から11のいずれか一項に記載の装置。

- プロセッサおよびメモリを含むジェスチャ特定装置であって、1組のプログラムコードが前記メモリに記憶され、前記プロセッサが以下の動作、すなわち、

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出する動作と、

前記タッチアクションが前記タッチスクリーンと接触しているときに生成された前記タッチスクリーン上の前記タッチアクションの接触面積およびz軸加速度を取得する動作であって、z軸は、前記タッチスクリーンと垂直な方向であり、前記接触面積および前記z軸加速度は、指が前記タッチスクリーンを初めて押下したときに取得され、前記タッチスクリーン上の前記タッチアクションの前記接触面積は、式s*(m/n)を使用することによって計算により取得され、ここで、sは前記タッチスクリーンの面積であり、mは前記タッチスクリーンの接触領域内の前記タッチアクションのピクセルの量であり、nはタッチスクリーンのピクセルの量であり、前記タッチアクションの前記z軸加速度は、前記端末デバイスに付随する重力加速度センサを使用することによって取得される、動作と、

前記接触面積が予め設定された面積よりも大きく、前記z軸加速度が予め設定された加速度よりも大きい場合、前記タッチアクションが関節タッチアクションであると判定する動作と、

前記関節タッチアクションに対応するジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの予め設定された機能を呼び出す動作と、

前記端末デバイスの前記タッチスクリーン上で実行された前記タッチアクションを検出する前に、カスタマイズされたジェスチャを学習する動作であって、前記カスタマイズされたジェスチャは少なくとも2回入力され、各回のカスタマイズされたジェスチャの類似性が予め決定された閾値よりも大きい場合に、前記カスタマイズされたジェスチャが成功裏に学習される、動作とを実行するために前記メモリに記憶された前記プログラムコードを呼び出す、装置。 - 前記プロセッサが、前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの対応する予め設定された機能を呼び出す前記動作を実行することが、

前記関節タッチアクションが実行されるユーザインターフェース、および前記ユーザインターフェースが属するアプリケーションプログラムを決定することと、

前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記アプリケーションプログラムに対応する予め設定された機能を呼び出すこととを含む請求項13に記載の装置。 - 前記プロセッサが、前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの対応する予め設定された機能を呼び出す前記動作を実行することが、

前記関節タッチアクションが実行されるユーザインターフェースを決定することと、

前記関節タッチアクションが実行される前記ユーザインターフェースが前記端末デバイスのシステムデスクトップである場合、前記ジェスチャの種類に関連するアプリケーションプログラムを照会し、前記アプリケーションプログラムを起動するかまたは閉じることとを含む請求項13に記載の装置。 - 前記プロセッサが、前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの対応する予め設定された機能を呼び出す前記動作を実行することが、

前記関節タッチアクションが実行されるユーザインターフェースを決定することと、

前記関節タッチアクションに対応する前記ジェスチャの種類を特定し、前記ジェスチャの種類に従って前記ユーザインターフェース上で動作を実行することであって、前記動作が、スクリーンキャプチャ、アイコンの整列、またはテーマの取り替えを含む、実行することとを含む請求項13に記載の装置。 - 前記タッチアクションに対応する前記ジェスチャの種類が、タップジェスチャまたはスライドジェスチャを含み、前記タップジェスチャが、1点1タップジェスチャ、1点多タップジェスチャ、または多点タップジェスチャのうちの少なくとも1つを含み、前記スライドジェスチャのスライドの軌跡が、閉じた軌跡または閉じていない軌跡のうちの少なくとも1つを含む請求項13から16のいずれか一項に記載の装置。

- 前記プロセッサが、以下の動作、すなわち、

前記予め設定された機能と前記関節タッチアクションに対応する前記ジェスチャの種類との間のマッピング関係をカスタマイズし、前記マッピング関係をマッピング関係データベースに記憶する動作を実行するようにさらに構成される請求項13から17のいずれか一項に記載の装置。 - 請求項7から12のいずれか一項に記載のジェスチャコントロール装置、前記タッチスクリーン、および重力センサを含む端末デバイス。

- 請求項13から18のいずれか一項に記載のジェスチャ特定装置、前記タッチスクリーン、および重力センサを含む端末デバイス。

- ジェスチャコントロール方法を実行するようにコンピュータデバイスを制御するように構成されたストレージ媒体であって、前記方法が、以下のステップ、すなわち、

端末デバイスのタッチスクリーン上で実行されたタッチアクションを検出するステップと、

前記タッチアクションが前記タッチスクリーンと接触しているときに生成された前記タッチスクリーン上の前記タッチアクションの接触面積およびz軸加速度を取得するステップあって、z軸は、前記タッチスクリーンと垂直な方向であり、前記接触面積および前記z軸加速度は、指が前記タッチスクリーンを初めて押下したときに取得され、前記タッチスクリーン上の前記タッチアクションの前記接触面積は、式s*(m/n)を使用することによって計算により取得され、ここで、sは前記タッチスクリーンの面積であり、mは前記タッチスクリーンの接触領域内の前記タッチアクションのピクセルの量であり、nはタッチスクリーンのピクセルの量であり、前記タッチアクションの前記z軸加速度は、前記端末デバイスに付随する重力加速度センサを使用することによって取得される、ステップと、

前記接触面積が予め設定された面積よりも大きく、前記z軸加速度が予め設定された加速度よりも大きい場合、前記タッチアクションが関節タッチアクションであると判定するステップと、

前記関節タッチアクションに対応するジェスチャの種類を特定し、前記ジェスチャの種類に従って前記端末デバイスの予め設定された機能を呼び出すステップとを含み、

前記端末デバイスの前記タッチスクリーン上で実行された前記タッチアクションを検出する前に、カスタマイズされたジェスチャを学習するステップをさらに含み、前記カスタマイズされたジェスチャは少なくとも2回入力され、各回のカスタマイズされたジェスチャの類似性が予め決定された閾値よりも大きい場合に、前記カスタマイズされたジェスチャが成功裏に学習される、ストレージ媒体。

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/CN2015/076536 WO2016165066A1 (zh) | 2015-04-14 | 2015-04-14 | 一种手势控制方法、装置、终端设备和存储介质 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2018511892A JP2018511892A (ja) | 2018-04-26 |

| JP2018511892A5 JP2018511892A5 (ja) | 2018-06-14 |

| JP6598089B2 true JP6598089B2 (ja) | 2019-10-30 |

Family

ID=57125459

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2017553945A Active JP6598089B2 (ja) | 2015-04-14 | 2015-04-14 | ジェスチャコントロール方法、装置、端末デバイス、およびストレージ媒体 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US10802704B2 (ja) |

| EP (1) | EP3276480A4 (ja) |

| JP (1) | JP6598089B2 (ja) |

| CN (1) | CN106415472B (ja) |

| WO (1) | WO2016165066A1 (ja) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20220116936A (ko) * | 2021-02-16 | 2022-08-23 | 서울과학기술대학교 산학협력단 | 사운드 기계학습에 기반한 제스처 검출 장치 및 방법 |

| WO2023003420A1 (ko) * | 2021-07-23 | 2023-01-26 | 삼성전자주식회사 | 전자 장치 및 그 제어 방법 |

Families Citing this family (12)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN105320436A (zh) * | 2015-07-07 | 2016-02-10 | 崔景城 | 一种以手指关节敲击屏幕来触发截屏的方法 |

| JP6819423B2 (ja) * | 2017-04-04 | 2021-01-27 | 富士ゼロックス株式会社 | 無線通信装置 |

| CN109408263A (zh) * | 2018-09-27 | 2019-03-01 | 惠州Tcl移动通信有限公司 | 一种界面稳定切换的方法、存储介质及智能终端 |

| CN110275665A (zh) * | 2019-05-23 | 2019-09-24 | 深圳龙图腾创新设计有限公司 | 一种触摸屏操作方法、电子设备及存储介质 |

| CN110502153B (zh) * | 2019-08-30 | 2022-11-11 | Oppo(重庆)智能科技有限公司 | 触摸屏报点率的调整方法、触摸屏、电子设备及存储介质 |

| CN111311489B (zh) * | 2020-01-17 | 2023-07-04 | 维沃移动通信有限公司 | 一种图像裁剪方法及电子设备 |

| CN113805487B (zh) * | 2020-07-23 | 2022-09-23 | 荣耀终端有限公司 | 控制指令的生成方法、装置、终端设备及可读存储介质 |

| CN112532226B (zh) * | 2020-11-05 | 2024-05-10 | 广东瑞德智能科技股份有限公司 | 一种新型触摸人机交互处理方法 |

| CN112445410B (zh) * | 2020-12-07 | 2023-04-18 | 北京小米移动软件有限公司 | 触控事件识别方法、装置及计算机可读存储介质 |

| CN114911401B (zh) * | 2021-02-08 | 2024-06-25 | 华为技术有限公司 | 电子设备及其触摸操作的分析方法和可读介质 |

| EP4287005A4 (en) * | 2021-04-06 | 2024-08-07 | Samsung Electronics Co Ltd | ELECTRONIC DEVICE FOR PERFORMING A DETECTION FUNCTION AND METHOD FOR OPERATING AN ELECTRONIC DEVICE |

| CN116225274A (zh) * | 2023-04-28 | 2023-06-06 | 荣耀终端有限公司 | 触控操作的识别方法、装置、电子设备及存储介质 |

Family Cites Families (20)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008192092A (ja) * | 2007-02-08 | 2008-08-21 | Fuji Xerox Co Ltd | タッチパネル装置、情報処理装置及びプログラム |

| JP5160337B2 (ja) | 2008-08-11 | 2013-03-13 | ソニーモバイルコミュニケーションズ, エービー | 入力処理装置、入力処理方法、入力処理プログラム、及び携帯端末装置 |

| US8633901B2 (en) * | 2009-01-30 | 2014-01-21 | Blackberry Limited | Handheld electronic device having a touchscreen and a method of using a touchscreen of a handheld electronic device |

| JP5091180B2 (ja) * | 2009-03-27 | 2012-12-05 | ソニーモバイルコミュニケーションズ, エービー | 携帯端末装置 |

| US8836648B2 (en) * | 2009-05-27 | 2014-09-16 | Microsoft Corporation | Touch pull-in gesture |

| JP2011014044A (ja) * | 2009-07-03 | 2011-01-20 | Sony Corp | 操作制御装置、操作制御方法およびコンピュータプログラム |

| JP2012058856A (ja) * | 2010-09-06 | 2012-03-22 | Sony Corp | 情報処理装置、情報処理方法及び情報処理プログラム |

| JP5352619B2 (ja) * | 2011-04-13 | 2013-11-27 | 株式会社日本自動車部品総合研究所 | 操作入力装置 |

| CN102799292B (zh) | 2011-05-24 | 2016-03-30 | 联想(北京)有限公司 | 一种触摸控制方法、装置及电子设备 |

| KR101858608B1 (ko) * | 2011-10-28 | 2018-05-17 | 엘지전자 주식회사 | 이동 단말기 및 이동 단말기의 제어 방법 |

| JP6021335B2 (ja) * | 2011-12-28 | 2016-11-09 | 任天堂株式会社 | 情報処理プログラム、情報処理装置、情報処理システム、および、情報処理方法 |

| US20130342468A1 (en) * | 2012-06-20 | 2013-12-26 | Chimei Innolux Corporation | Method for determining touch location on a touch panel and touch panel module |

| JP5460793B2 (ja) * | 2012-08-21 | 2014-04-02 | シャープ株式会社 | 表示装置、表示方法、テレビジョン受信機及び表示制御装置 |

| CN103809882B (zh) | 2012-11-07 | 2017-05-24 | 联想(北京)有限公司 | 一种信息处理的方法、电子设备及触控输入装置 |

| KR20140113119A (ko) | 2013-03-15 | 2014-09-24 | 엘지전자 주식회사 | 전자 기기 및 그 제어방법 |

| JP6132644B2 (ja) * | 2013-04-24 | 2017-05-24 | キヤノン株式会社 | 情報処理装置、表示制御方法、コンピュータプログラム、及び記憶媒体 |

| KR101474467B1 (ko) * | 2013-07-09 | 2014-12-19 | 엘지전자 주식회사 | 이동 단말기 및 그것의 제어방법 |

| JP2015060455A (ja) * | 2013-09-19 | 2015-03-30 | シャープ株式会社 | 電子装置、制御方法及びプログラム |

| WO2015085526A1 (en) * | 2013-12-12 | 2015-06-18 | Empire Technology Development Llc | Visualization of size of objects |

| CN104049759A (zh) * | 2014-06-25 | 2014-09-17 | 华东理工大学 | 触摸屏和行为感知联合的指令输入与防护方法 |

-

2015

- 2015-04-14 WO PCT/CN2015/076536 patent/WO2016165066A1/zh active Application Filing

- 2015-04-14 CN CN201580029659.2A patent/CN106415472B/zh active Active

- 2015-04-14 JP JP2017553945A patent/JP6598089B2/ja active Active

- 2015-04-14 EP EP15888771.1A patent/EP3276480A4/en not_active Ceased

- 2015-04-14 US US15/566,582 patent/US10802704B2/en active Active

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20220116936A (ko) * | 2021-02-16 | 2022-08-23 | 서울과학기술대학교 산학협력단 | 사운드 기계학습에 기반한 제스처 검출 장치 및 방법 |

| KR102436970B1 (ko) | 2021-02-16 | 2022-08-26 | 서울과학기술대학교 산학협력단 | 사운드 기계학습에 기반한 제스처 검출 장치 및 방법 |

| WO2023003420A1 (ko) * | 2021-07-23 | 2023-01-26 | 삼성전자주식회사 | 전자 장치 및 그 제어 방법 |

Also Published As

| Publication number | Publication date |

|---|---|

| US10802704B2 (en) | 2020-10-13 |

| US20180095657A1 (en) | 2018-04-05 |

| EP3276480A4 (en) | 2018-05-02 |

| WO2016165066A1 (zh) | 2016-10-20 |

| CN106415472A (zh) | 2017-02-15 |

| CN106415472B (zh) | 2020-10-09 |

| EP3276480A1 (en) | 2018-01-31 |

| JP2018511892A (ja) | 2018-04-26 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6598089B2 (ja) | ジェスチャコントロール方法、装置、端末デバイス、およびストレージ媒体 | |

| US10542205B2 (en) | Movable user interface shutter button for camera | |

| TWI617953B (zh) | 觸控介面多工切換方法、系統及電子裝置 | |

| CN107025019B (zh) | 虚拟按键的交互方法及终端设备 | |

| EP3025218B1 (en) | Multi-region touchpad | |

| US9529527B2 (en) | Information processing apparatus and control method, and recording medium | |

| US20130212541A1 (en) | Method, a device and a system for receiving user input | |

| WO2014029345A1 (zh) | 控制终端设备的方法和装置 | |

| KR20130090138A (ko) | 다중 터치 패널 운용 방법 및 이를 지원하는 단말기 | |

| CN103869947B (zh) | 控制电子设备的方法及电子设备 | |

| US9256359B2 (en) | Touch control method and electronic device using the same | |

| CN106415471A (zh) | 终端的用户界面的处理方法、用户界面和终端 | |

| TW201626204A (zh) | 相機觸控拍攝方法及其觸控終端 | |

| CN103853487A (zh) | 解除触摸屏锁定状态的方法及其电子装置 | |

| US20180210597A1 (en) | Information processing device, information processing method, and program | |

| US20150193139A1 (en) | Touchscreen device operation | |

| US20160349981A1 (en) | Control system for virtual mouse and control method thereof | |

| US10025420B2 (en) | Method for controlling display of touchscreen, and mobile device | |

| US9940010B2 (en) | Information processing method and electronic device | |

| US20150153925A1 (en) | Method for operating gestures and method for calling cursor | |

| US20170336962A1 (en) | Gesture response method and device | |

| CN110941339B (zh) | 一种手势感应方法及电子设备、存储介质 | |

| KR102049259B1 (ko) | 모션 기반 사용자 인터페이스 제어 장치 및 방법 | |

| CN105867777A (zh) | 一种屏幕控制方法及装置 | |

| KR101501811B1 (ko) | 터치 화면 확대 기술 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20180409 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20180409 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20181127 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20181203 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20190304 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20190318 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20190718 |

|

| A911 | Transfer to examiner for re-examination before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20190805 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20190909 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20190919 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6598089 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313113 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |