JP5154635B2 - 拡張された空間スケーラビティにおける画像レベルの適応化方法およびシステム - Google Patents

拡張された空間スケーラビティにおける画像レベルの適応化方法およびシステム Download PDFInfo

- Publication number

- JP5154635B2 JP5154635B2 JP2010277337A JP2010277337A JP5154635B2 JP 5154635 B2 JP5154635 B2 JP 5154635B2 JP 2010277337 A JP2010277337 A JP 2010277337A JP 2010277337 A JP2010277337 A JP 2010277337A JP 5154635 B2 JP5154635 B2 JP 5154635B2

- Authority

- JP

- Japan

- Prior art keywords

- base layer

- prediction

- image

- crop window

- base

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Lifetime

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

- H04N19/34—Scalability techniques involving progressive bit-plane based encoding of the enhancement layer, e.g. fine granular scalability [FGS]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/107—Selection of coding mode or of prediction mode between spatial and temporal predictive coding, e.g. picture refresh

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/117—Filters, e.g. for pre-processing or post-processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

- H04N19/139—Analysis of motion vectors, e.g. their magnitude, direction, variance or reliability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/14—Coding unit complexity, e.g. amount of activity or edge presence estimation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/156—Availability of hardware or computational resources, e.g. encoding based on power-saving criteria

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/157—Assigned coding mode, i.e. the coding mode being predefined or preselected to be further used for selection of another element or parameter

- H04N19/159—Prediction type, e.g. intra-frame, inter-frame or bidirectional frame prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/172—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a picture, frame or field

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/187—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a scalable video layer

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

- H04N19/33—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability in the spatial domain

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/44—Decoders specially adapted therefor, e.g. video decoders which are asymmetric with respect to the encoder

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/513—Processing of motion vectors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/523—Motion estimation or motion compensation with sub-pixel accuracy

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/537—Motion estimation other than block-based

- H04N19/543—Motion estimation other than block-based using regions

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/56—Motion estimation with initialisation of the vector search, e.g. estimating a good candidate to initiate a search

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/59—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving spatial sub-sampling or interpolation, e.g. alteration of picture size or resolution

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

- H04N19/61—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding in combination with predictive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/80—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/80—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation

- H04N19/82—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation involving filtering within a prediction loop

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/85—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using pre-processing or post-processing specially adapted for video compression

- H04N19/86—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using pre-processing or post-processing specially adapted for video compression involving reduction of coding artifacts, e.g. of blockiness

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Computing Systems (AREA)

- Theoretical Computer Science (AREA)

- Compression Or Coding Systems Of Tv Signals (AREA)

Description

上位レイヤマクロブロックは、BASE_LAYER_MODEまたはQPEL_REFINEMENT_MODEを使ってスケーリングベースレイヤ動きデータを使用することによってインターレイヤ予測を利用できる。WD-1.0 [MPEG Doc. N6901]の場合と同様に、これらのマクロブロックモードは、マクロブロックパーティションを含む動き/予測情報が、ベースレイヤから直接得られることを示している。ベースレイヤからの動きデータを継承することによって、予測マクロブロック(MB_pred)を構築することができる。BASE_LAYER_MODEでは、参照インデックスリスト、動きベクトルと同様に、マクロブロックのパーティションは、予測マクロブロックMB_predのそれである。QPEL_REFINEMENT_MODEの場合も、1/4サンプル動きベクトルの改良である点以外は同様である。

[4×4ブロックの継承]

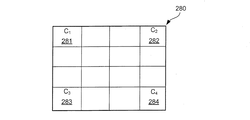

図3は、4つのコーナ281・282・283・284を有する4×4ブロック280を示している。この処理は、ブロックの3つのコーナ281・282・283・284をチェックする工程からなる。上位レイヤ座標系におけるコーナ画素cの座標位置を(x, y)とし、ベースレイヤ座標系における対応する座標位置を (xbase, ybase) とし、以下のように定義する。

・何れのコーナもこのリストを使用しない場合、当該リストの何れの参照インデックス、動きベクトルもbに設定しない。

・bに設定する参照インデックスrb(listx)を4つのコーナの存在する参照インデックスの最小値とする。

[8×8(ブロックにおける)パーティション選択]

各4×4ブロック動きデータが設定されると、それが属する8×8ブロックの実際のパーティションを決定するため、あるいは規則違反の構成を避けるために、結合処理が必要となる。以下に、図4を参照し、8×8ブロックを構成する複数の4×4ブロックについて説明する。

・何れの4×4ブロックもこのリストを使用しない場合、当該リストの何れの参照インデックス、動きベクトルもBに設定しない。

・Bに設定する参照インデックスrB(listx)を4つのコーナの存在する参照インデックスの最小値として計算する。

・b1 がb3と等しければ、BLK_8x8を選択する。

[予測マクロブロックモード選択]

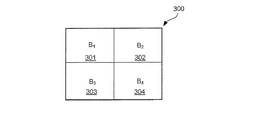

本発明の実施の形態では、予測マクロブロックMB_predモードを決定するプロセスを含むものであってもよい。次に、図5に示すマクロブロック300を構成する8×8ブロック301ないし304について以下に説明する。

・これらの2つのブロック双方のパーティションモードが、いずれもBLK_8x8であり、各ブロックのlist0およびlist1の参照インデックスおよび動きベクトルが存在する場合これらが同一であれば、これらの2つのブロックは同一であるとする。

各リストlistxについて、

・何れの8×8ブロックもこのリストを使用しない場合、当該リストの何れの参照インデックス、動きベクトルもBINTRA に割り当てない。

・B1 がB3と等しければ、MODE_16x16を選択する。

[動きベクトルスケーリング]

上記の工程により得られた予測マクロブロックMB_pred の存在するすべての動きベクトルに動きベクトルスケーリングを施してもよい。

[インターレイヤテクスチャ予測]

テクスチャアップサンプリング

本発明の実施の形態では、インターレイヤテクスチャ予測を、インターレイヤ動き予測と同様の原理に基づいて適応することができる。ベースレイヤテクスチャアップサンプリングには、2つまたは3つのlobed Lanczos-windowed sinc functionsを用いることができる。2つのlobed Lanczos-windowed sinc functionは、下記式にて定義することができる。

インターレイヤイントラテクスチャ予測

WD-1.0 [MPEG Doc. N6901]でI_BL modeを用いた場合、全ての対応するベースレイヤのマクロブロックをイントラ符号化する必要がある。本発明の本実施の形態では、上記の制約が緩和されており、対応するベースレイヤマクロブロックをインター符号化したり、また符号化しなくてもよい。

Clip1y(x) = min( max (0, x), (1 << BitDepthy) -1)

上記式中、BitDepthy は、輝度チャネルデータのビット深度を示す。

Clip1C( x ) = min( max ( 0, x ), ( 1 << BitDepthC ) -1)

上記式中、BitDepthC は、色度チャネルデータのビット深度を示す。

インターレイヤイントラテクスチャ予測と同様に、ベースレイヤの残差のアップサンプリング処理に、同じ4タップフィルタまたは他のフィルタを用いることができるが、四捨五入、クリッピング処理については式(15)および式(16)で定義されるものと異なっている。

[シンタックスおよびセマティックスの変更]

シンタックス表

本発明の実施の形態では、後述する大太文字で示した以下の変更を適用してもよい。主な変更としては、シーケンスパラメータセットのシンボル、extended_spatial _scalability、ベースレイヤのアップサンプリング処理に適用する位置変換に関するシーケンスパラメータセットおよびslice_data_in_scalable_extension()中の以下の4つのパラメータを追加する。

スケーラブル拡張におけるシーケンスパラメータセット

スケーラブル拡張におけるシンタックスのシーケンスパラメータのセット

extended_spatial_scalabilityは、ベースレイヤアップサンプリングの位置情報パラメータに関連するシンタックスエレメントの存在を示している。

extended_spatial_scalabilityが存在する場合、「0」と等しくなるようにしている。

スライスデータのシンタクスエレメントのセマンティックスは、シーケンスパラメータセットの同一のシンタックスエレメントのセマンティックスと同じである。

[デコード処理]

予測データのデコード処理

WD-1.0 [MPEG Doc. N6901]での処理と比較すると、以下の工程が追加される。

[サブバンド画像のデコード工程]

WD-1.0 [MPEG Doc. N6901]での処理に、以下の工程が追加される。

extended_spatial_scalabilityが1または2で、かつresidual_prediction_flagが1の場合、以下の処理を施す。

[ループフィルタの変更]

extended_spatial_scalabilityが1又は2の場合、I_BL modeにおけるブロックのフィルタ強度決定時のループフィルタに対しマイナーな変更を行う。

[6タップフィルタの実施例]

本発明の実施の形態は、H.264/MPEG-4 AVC スケーラブル映像符号化(SVC)の拡張方式に適応するものであり、特に2005年4月にJVT (Joint Video Team (合同映像チーム):MPEG, VCEG)で採用されたExtended Spatial Scalable (ESS) 映像符号化特性に適応するものである。

3.テクスチャ補間工程

テクスチャ補間工程における入力は、以下の通りである。

・ベースレイヤ画像の輝度サンプル配列(baseL[x, y], x = -2 + xB..(xB1+2),y= -2+yB..(yB1+2))

・「chroma_format_idc 」が0でない場合、

・ベースレイヤ画像の整数輝度サンプル位置((xCB, yCB)・(xCB1, yB1))

・ベースレイヤ画像の2つの色度サンプル配列(baseCb[x, y], x =-2 + xCB..(xCB1+2),y= -2+yCB..(yCB1+2))

テクスチャ補間工程における出力は、以下の通りである。

・輝度サンプルマクロブロック配列(predL[x,y] (x=0..15, y=0..15))

・chroma_format_idcがゼロでない場合、2つの色度サンプルマクロブロック配列(predCb[x,y]・predCr[x,y](x=0..MbWidthC-1, y=0..MbHeightC-1)

輝度サンプルpredL[x,y](x=0..15, y=0..15)は、以下の工程にて算出できる。

各tempL[x,y](x=-2+xB..(xB1+2), y=0..15)は、以下の工程にて求めることができる。

各tempC[x,y](CはCbとCr, x= -2+xCB..(xCB1+2), y=0..MbHeightC-1)は、以下の工程にて求めることができる。

テクスチャ補間工程における入力は、以下の通りである。

・ベースレイヤ画像の輝度残差サンプル配列(resBaseL[x,y], x=xB..xB1, y=yB..yB1)

・chroma_format_idc が0でない場合、

・ベース画像basePicの整数色度サンプル位置((xCB, yCB)・(xCB1, yCB1))

・2つの色差残差サンプル配列resBaseCb[x,y]・resBaseCr[x,y](x=xCB..xCB1, y=yCB..yCB1)

テクスチャ補間工程における出力は、以下の通りである。

・輝度サンプル配列resPredL[x,y](x=0..15, y=0..15)

・chroma_format_idcがゼロでない場合、2つの色度サンプル配列(resPredCb[x,y])・(predCb[x,y]・predCr[x,y](x=0..MbWidthC-1, y=0..MbHeightC-1)

各輝度残差サンプルresPredL[x,y](x=0..15, y=0..15)は、以下の工程にて算出できる。

BitDepthYは、輝度チャネルデータのビット深度を示す。

・各tempC[x,y](Cは、Cb, Cr, x=-xCB..xCB1,y=0..MbHeightC-1)は、以下の工程にて求めることができる。

BitDepthCは、色度チャネルデータのビット深度を示す。

空間スケーラブル映像符号化方式における画像レベルの適応化方法であって、

(a)入力ビデオシーケンスの第1画像の第1位置での第1クロップウインドウを規定する工程と、

(b)上記第1クロップウインドウに対応する第1ベースレイヤを生成する工程と、

(c)上記入力ビデオシーケンスの第2画像の前記第1位置と異なる位置である第2位置での第2クロップウインドウを規定する工程と、

(d)上記第2クロップウインドウに対応する第2ベースレイヤを生成する工程と、を含むことを特徴とする画像レベルの適応化方法。

上記第2ベースレイヤに基づいて上記第2画像のエンハンスメントレイヤを予測する工程を更に含むことを特徴とする<1>に記載の方法。

上記予測工程において、画像の動き成分とクロップウインドウの動き成分とを有する拡張した動きベクトルを用いることを特徴とする<2>に記載の方法。

上記予測工程は、上記式を用いて動きベクトルmv = (d x , d y ) をmv s = (d sx , d sy ) に拡張したベクトルを用いることを特徴とする<2>に記載の方法。

上記第1画像と上記第2画像とがテクスチャー画像であることを特徴とする<2>に記載の方法。

上記第1画像と上記第2画像とが残差画像であることを特徴とする<2>に記載の方法。

空間スケーラブル映像符号化方式におけるベースレイヤからクロップウインドウで規定されるエンハンスメントレイヤ領域を予測する方法であって、

(a)上記ベースレイヤの画像ブロックの方向のベースレイヤ動きベクトルを計算する工程と、

(b)上記方向の上記ベースレイヤの大きさに対する上記方向の上記クロップウインドウの大きさの比率に基づいて、上記ベースレイヤ動きベクトルを拡張する工程と、

(c)参照画像におけるクロップウインドウの位置に対し、上記クロップウインドウの動きを表す拡張された動きベクトルを調整する工程と、を含むことを特徴とする方法。

さらに、上記調整された拡張された動きベクトルを用いて上記エンハンスメントレイヤを予測する工程を含むことを特徴とする<7>に記載の方法。

上記拡張工程および調整工程を、互いに直行する2つの方向に行うことを特徴とする<7>に記載の方法。

上記予測工程は、上記式を用いて動きベクトルmv = (d x , d y ) をmv s = (d sx , d sy ) に拡張したベクトルを用いることを特徴とする<7>に記載の方法。

上記予測工程が、テクスチャー予測を含むことを特徴とする<7>に記載の方法。

上記予測工程が、残差予測を含むことを特徴とする<7>に記載の方法。

上記拡張行程および調整工程を、予測マクロブロック(MB_pred)の全ての動きベクトルに適応することを特徴とする<7>に記載の方法。

空間スケーラブル映像符号化方式においてベースレイヤからクロップウインドウで規定されるエンハンスメントレイヤ領域を予測するシステムであって、

(a)上記ベースレイヤの画像ブロックの方向のベースレイヤ動きベクトルを計算する演算部と、

(b)上記方向の上記ベースレイヤの大きさに対する上記方向の上記クロップウインドウの大きさの比率に基づいて、上記ベースレイヤ動きベクトルを拡張する拡張部と、

(c)上記参照画像におけるクロップウインドウの位置に対し、上記クロップウインドウの動きを表す拡張された動きベクトルを調整する調整部と、を含むことを特徴とするシステム。

さらに、上記調整された拡張された動きベクトルを用いて、エンハンスメントレイヤを予測する予測部を更に含むことを特徴とする<14>に記載のシステム。

上記拡張工程および調整工程を、互いに直行する2つの方向に行うことを特徴とする<14>に記載のシステム。

上記予測工程は、上記式を用いて動きベクトルmv = (d x , d y ) をmv s = (d sx , d sy ) に拡張したベクトルを用いることを特徴とする<14>に記載のシステム。

上記予測が、テクスチャ予測を含むことを特徴とする<14>に記載のシステム。

上記予測が、残差予測を含むことを特徴とする<14>に記載のシステム。

上記拡張および調整工程を、予測マクロブロック(MB_pred)の全ての動きベクトルに適応することを特徴とする<14>に記載の方法。

253 下位レイヤ(ベースレイヤ)

270 エンハンスメントレイヤ画像

272 ベースレイヤ画像

281・282・283・284 コーナブロック

300 マクロブロック

301・302・303・304 ブロック

Claims (14)

- 空間スケーラブル映像符号化方式におけるベースレイヤからクロップウインドウで規定されるエンハンスメントレイヤ領域を予測する方法であって、

(a)上記ベースレイヤと上記クロップウインドウとの水平方向の大きさ及び垂直方向の大きさの比率に基づいて、上記ベースレイヤの動きベクトルを拡張する拡張工程と、

(b)参照画像におけるクロップウインドウと、上記クロップウインドウとの間の動き成分に基づいて、上記拡張された動きベクトルを調整する調整工程と、を含むことを特徴とする方法。 - さらに、上記調整された拡張された動きベクトルを用いて上記エンハンスメントレイヤを予測する予測工程を含むことを特徴とする請求項1に記載の方法。

- 上記拡張工程および調整工程を、互いに直交する2つの方向に行うことを特徴とする請求項1に記載の方法。

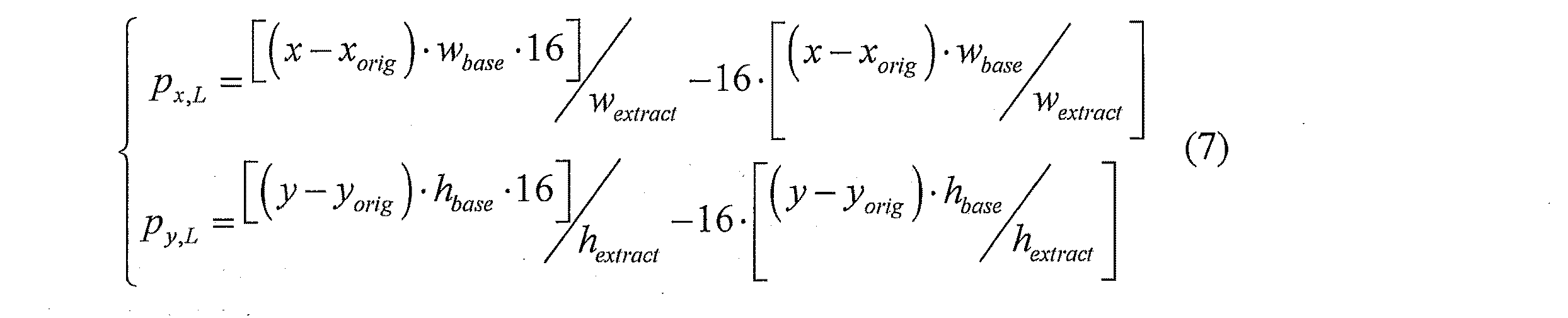

-

上記予測工程は、上記式を用いて上記ベースレイヤの動きベクトルmv = (dx, dy)にスケーリングおよび調整を行った動きベクトルmvs = (dsx, dsy)を用いることを特徴とする請求項2に記載の方法。 - 上記予測工程が、テクスチャー予測を含むことを特徴とする請求項2に記載の方法。

- 上記予測工程が、残差予測を含むことを特徴とする請求項2に記載の方法。

- 上記ベースレイヤと上記クロップウインドウとの大きさの比率に基づいて、上記ベースレイヤの動きベクトルを継承した動きデータをスケーリングし、参照画像におけるクロップウインドウと、上記クロップウインドウとの間の動き成分に基づいて、上記スケーリングされた動きデータを調整して、上記クロップウインドウで規定されるエンハンスメントレイヤ領域を予測することを特徴とする請求項1に記載の方法。

- 空間スケーラブル映像符号化方式においてベースレイヤからクロップウインドウで規定されるエンハンスメントレイヤ領域を予測するシステムであって、

(a)上記ベースレイヤと上記クロップウインドウとの水平方向の大きさ及び垂直方向の大きさの比率に基づいて、上記ベースレイヤの動きベクトルを拡張する拡張部と、

(b)参照画像におけるクロップウインドウと、上記クロップウインドウとの間の動き成分に基づいて、上記拡張された動きベクトルを調整する調整部と、を含むことを特徴とするシステム。 - さらに、上記調整された拡張された動きベクトルを用いて、エンハンスメントレイヤを予測する予測部を更に含むことを特徴とする請求項8に記載のシステム。

- 上記拡張部による拡張および調整部による調整を、互いに直交する2つの方向に行うことを特徴とする請求項8に記載のシステム。

-

上記予測部による予測は、上記式を用いて上記ベースレイヤの動きベクトルmv = (dx, dy)にスケーリングおよび調整を行った動きベクトルmvs = (dsx, dsy)を用いることを特徴とする請求項9に記載のシステム。 - 上記予測部による予測が、テクスチャ予測を含むことを特徴とする請求項9に記載のシステム。

- 上記予測部による予測が、残差予測を含むことを特徴とする請求項9に記載のシステム。

- 上記ベースレイヤと上記クロップウインドウとの大きさの比率に基づいて、上記ベースレイヤの動きベクトルを継承した動きデータをスケーリングし、参照画像におけるクロップウインドウと、上記クロップウインドウとの間の動き成分に基づいて、上記スケーリングされた動きデータを調整して、上記クロップウインドウで規定されるエンハンスメントレイヤ領域を予測することを特徴とする請求項8に記載のシステム。

Applications Claiming Priority (6)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US66316105P | 2005-03-18 | 2005-03-18 | |

| US60/663,161 | 2005-03-18 | ||

| US68306005P | 2005-05-20 | 2005-05-20 | |

| US60/683,060 | 2005-05-20 | ||

| US68667605P | 2005-06-01 | 2005-06-01 | |

| US60/686,676 | 2005-06-01 |

Related Parent Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2008501903A Division JP4751928B2 (ja) | 2005-03-18 | 2006-02-28 | 拡張された空間スケーラビティにおける画像レベルの適応化方法およびシステム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2011083022A JP2011083022A (ja) | 2011-04-21 |

| JP5154635B2 true JP5154635B2 (ja) | 2013-02-27 |

Family

ID=37024293

Family Applications (5)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2008501902A Expired - Lifetime JP4454678B2 (ja) | 2005-03-18 | 2006-02-28 | 隣接するブロック間のブロック境界の特徴を定める方法 |

| JP2008501903A Expired - Lifetime JP4751928B2 (ja) | 2005-03-18 | 2006-02-28 | 拡張された空間スケーラビティにおける画像レベルの適応化方法およびシステム |

| JP2009242741A Pending JP2010016911A (ja) | 2005-03-18 | 2009-10-21 | ブロッキング歪を低減した画像データの符号化・複号化装置及び伝送システム |

| JP2009242688A Expired - Lifetime JP4975078B2 (ja) | 2005-03-18 | 2009-10-21 | 空間的にスケーラブルなビデオ符号化のために、低い複雑さでブロッキング歪を低減するための方法およびシステム |

| JP2010277337A Expired - Lifetime JP5154635B2 (ja) | 2005-03-18 | 2010-12-13 | 拡張された空間スケーラビティにおける画像レベルの適応化方法およびシステム |

Family Applications Before (4)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2008501902A Expired - Lifetime JP4454678B2 (ja) | 2005-03-18 | 2006-02-28 | 隣接するブロック間のブロック境界の特徴を定める方法 |

| JP2008501903A Expired - Lifetime JP4751928B2 (ja) | 2005-03-18 | 2006-02-28 | 拡張された空間スケーラビティにおける画像レベルの適応化方法およびシステム |

| JP2009242741A Pending JP2010016911A (ja) | 2005-03-18 | 2009-10-21 | ブロッキング歪を低減した画像データの符号化・複号化装置及び伝送システム |

| JP2009242688A Expired - Lifetime JP4975078B2 (ja) | 2005-03-18 | 2009-10-21 | 空間的にスケーラブルなビデオ符号化のために、低い複雑さでブロッキング歪を低減するための方法およびシステム |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US7961963B2 (ja) |

| EP (2) | EP1859534A4 (ja) |

| JP (5) | JP4454678B2 (ja) |

| KR (2) | KR100947677B1 (ja) |

| CN (3) | CN102387366A (ja) |

| WO (2) | WO2006101682A2 (ja) |

Families Citing this family (115)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR100679035B1 (ko) * | 2005-01-04 | 2007-02-06 | 삼성전자주식회사 | 인트라 bl 모드를 고려한 디블록 필터링 방법, 및 상기방법을 이용하는 다 계층 비디오 인코더/디코더 |

| EP1849303A2 (en) * | 2005-02-18 | 2007-10-31 | THOMSON Licensing | Method for deriving coding information for high resolution pictures from low resolution pictures |

| EP1894412A1 (en) * | 2005-02-18 | 2008-03-05 | THOMSON Licensing | Method for deriving coding information for high resolution images from low resoluton images and coding and decoding devices implementing said method |

| JP4839035B2 (ja) * | 2005-07-22 | 2011-12-14 | オリンパス株式会社 | 内視鏡用処置具および内視鏡システム |

| KR100678958B1 (ko) * | 2005-07-29 | 2007-02-06 | 삼성전자주식회사 | 인트라 bl 모드를 고려한 디블록 필터링 방법, 및 상기방법을 이용하는 다 계층 비디오 인코더/디코더 |

| CN1859576A (zh) | 2005-10-11 | 2006-11-08 | 华为技术有限公司 | 对空间分层编码视频图象的上采样方法及其系统 |

| BRPI0616745A2 (pt) * | 2005-10-19 | 2011-06-28 | Thomson Licensing | codificação / decodificação de vìdeo com múltiplas visualizações usando codificação / decodificação de vìdeo escalonável |

| US8457201B2 (en) * | 2006-01-09 | 2013-06-04 | Lg Electronics Inc. | Inter-layer prediction method for video signal |

| US20070160134A1 (en) * | 2006-01-10 | 2007-07-12 | Segall Christopher A | Methods and Systems for Filter Characterization |

| CN101502118A (zh) * | 2006-01-10 | 2009-08-05 | 诺基亚公司 | 用于可伸缩视频编码的转换滤波器上采样机制 |

| CN1794821A (zh) * | 2006-01-11 | 2006-06-28 | 浙江大学 | 可分级视频压缩中插值的方法与装置 |

| US8014445B2 (en) * | 2006-02-24 | 2011-09-06 | Sharp Laboratories Of America, Inc. | Methods and systems for high dynamic range video coding |

| US8194997B2 (en) * | 2006-03-24 | 2012-06-05 | Sharp Laboratories Of America, Inc. | Methods and systems for tone mapping messaging |

| US8059714B2 (en) * | 2006-07-10 | 2011-11-15 | Sharp Laboratories Of America, Inc. | Methods and systems for residual layer scaling |

| US7885471B2 (en) * | 2006-07-10 | 2011-02-08 | Sharp Laboratories Of America, Inc. | Methods and systems for maintenance and use of coded block pattern information |

| US7840078B2 (en) * | 2006-07-10 | 2010-11-23 | Sharp Laboratories Of America, Inc. | Methods and systems for image processing control based on adjacent block characteristics |

| US8532176B2 (en) * | 2006-07-10 | 2013-09-10 | Sharp Laboratories Of America, Inc. | Methods and systems for combining layers in a multi-layer bitstream |

| US8130822B2 (en) * | 2006-07-10 | 2012-03-06 | Sharp Laboratories Of America, Inc. | Methods and systems for conditional transform-domain residual accumulation |

| US8422548B2 (en) * | 2006-07-10 | 2013-04-16 | Sharp Laboratories Of America, Inc. | Methods and systems for transform selection and management |

| EP1879399A1 (en) | 2006-07-12 | 2008-01-16 | THOMSON Licensing | Method for deriving motion data for high resolution pictures from motion data of low resolution pictures and coding and decoding devices implementing said method |

| WO2008030067A1 (en) * | 2006-09-07 | 2008-03-13 | Lg Electronics Inc. | Method and apparatus for decoding/encoding of a video signal |

| JP5134001B2 (ja) * | 2006-10-18 | 2013-01-30 | アップル インコーポレイテッド | 下層のフィルタリングを備えたスケーラブルビデオ符号化 |

| JP2009540666A (ja) * | 2006-11-09 | 2009-11-19 | エルジー エレクトロニクス インコーポレイティド | ビデオ信号のデコーディング/エンコーディング方法及び装置 |

| JP2009538084A (ja) * | 2006-11-17 | 2009-10-29 | エルジー エレクトロニクス インコーポレイティド | ビデオ信号のデコーディング/エンコーディング方法及び装置 |

| US8548056B2 (en) * | 2007-01-08 | 2013-10-01 | Qualcomm Incorporated | Extended inter-layer coding for spatial scability |

| US8199812B2 (en) | 2007-01-09 | 2012-06-12 | Qualcomm Incorporated | Adaptive upsampling for scalable video coding |

| US7826673B2 (en) * | 2007-01-23 | 2010-11-02 | Sharp Laboratories Of America, Inc. | Methods and systems for inter-layer image prediction with color-conversion |

| US8503524B2 (en) * | 2007-01-23 | 2013-08-06 | Sharp Laboratories Of America, Inc. | Methods and systems for inter-layer image prediction |

| US8233536B2 (en) | 2007-01-23 | 2012-07-31 | Sharp Laboratories Of America, Inc. | Methods and systems for multiplication-free inter-layer image prediction |

| US8665942B2 (en) * | 2007-01-23 | 2014-03-04 | Sharp Laboratories Of America, Inc. | Methods and systems for inter-layer image prediction signaling |

| KR100843100B1 (ko) * | 2007-02-07 | 2008-07-03 | 삼성전자주식회사 | 디지털 영상에서의 블록 노이즈 저감 방법 및 장치, 이를이용한 인코딩/디코딩 방법 및 인코더/디코더 |

| US7760949B2 (en) | 2007-02-08 | 2010-07-20 | Sharp Laboratories Of America, Inc. | Methods and systems for coding multiple dynamic range images |

| US8767834B2 (en) | 2007-03-09 | 2014-07-01 | Sharp Laboratories Of America, Inc. | Methods and systems for scalable-to-non-scalable bit-stream rewriting |

| US8014613B2 (en) * | 2007-04-16 | 2011-09-06 | Sharp Laboratories Of America, Inc. | Methods and systems for inter-layer image parameter prediction |

| US8605786B2 (en) * | 2007-09-04 | 2013-12-10 | The Regents Of The University Of California | Hierarchical motion vector processing method, software and devices |

| US8175158B2 (en) * | 2008-01-04 | 2012-05-08 | Sharp Laboratories Of America, Inc. | Methods and systems for inter-layer image prediction parameter determination |

| US8249142B2 (en) * | 2008-04-24 | 2012-08-21 | Motorola Mobility Llc | Method and apparatus for encoding and decoding video using redundant encoding and decoding techniques |

| KR101552639B1 (ko) * | 2008-07-11 | 2015-09-14 | 한국전자통신연구원 | 인트라 매크로 블록의 디블록킹 필터 및 필터링 방법 |

| US8379727B2 (en) * | 2008-09-26 | 2013-02-19 | General Instrument Corporation | Method and apparatus for scalable motion estimation |

| US9479786B2 (en) | 2008-09-26 | 2016-10-25 | Dolby Laboratories Licensing Corporation | Complexity allocation for video and image coding applications |

| KR101590500B1 (ko) * | 2008-10-23 | 2016-02-01 | 에스케이텔레콤 주식회사 | 동영상 부호화/복호화 장치, 이를 위한 인트라 예측 방향에기반한 디블록킹 필터링 장치 및 필터링 방법, 및 기록 매체 |

| KR101534050B1 (ko) * | 2008-10-28 | 2015-07-06 | 에스케이 텔레콤주식회사 | 동영상 부호화/복호화 장치, 이를 위한 디블록킹 필터링 장치와 방법, 및 기록 매체 |

| JP5667773B2 (ja) * | 2010-03-18 | 2015-02-12 | キヤノン株式会社 | 情報作成装置及びその制御方法 |

| TWI416961B (zh) * | 2010-04-02 | 2013-11-21 | Univ Nat Chiao Tung | 用於可調式視訊編碼系統之選擇性移動向量預測方法、移動估測方法及其裝置 |

| TWI575887B (zh) | 2010-04-13 | 2017-03-21 | Ge影像壓縮有限公司 | 在樣本陣列多元樹細分中之繼承技術 |

| RS63059B1 (sr) | 2010-04-13 | 2022-04-29 | Ge Video Compression Llc | Kodiranje videa primenom podele sa više stabala na slikama |

| KR101626688B1 (ko) | 2010-04-13 | 2016-06-01 | 지이 비디오 컴프레션, 엘엘씨 | 샘플 영역 병합 |

| BR122020007923B1 (pt) * | 2010-04-13 | 2021-08-03 | Ge Video Compression, Llc | Predição interplano |

| US9094658B2 (en) * | 2010-05-10 | 2015-07-28 | Mediatek Inc. | Method and apparatus of adaptive loop filtering |

| WO2011149291A2 (ko) * | 2010-05-26 | 2011-12-01 | 엘지전자 주식회사 | 비디오 신호의 처리 방법 및 장치 |

| JP5875979B2 (ja) | 2010-06-03 | 2016-03-02 | シャープ株式会社 | フィルタ装置、画像復号装置、画像符号化装置、および、フィルタパラメータのデータ構造 |

| WO2012035746A1 (ja) * | 2010-09-17 | 2012-03-22 | 日本電気株式会社 | 映像符号化装置および映像復号装置 |

| CN102438135B (zh) * | 2011-01-14 | 2013-12-04 | 展讯通信(上海)有限公司 | 高分辨率视频在小尺寸显示设备上的降采样解码方法及装置 |

| KR20120088488A (ko) * | 2011-01-31 | 2012-08-08 | 한국전자통신연구원 | 시간적 움직임 벡터 저장 방법 및 그 장치 |

| US9729879B2 (en) * | 2011-03-10 | 2017-08-08 | Hfi Innovation Inc. | Method and apparatus of deblocking filter |

| EP2719182B1 (en) * | 2011-06-07 | 2018-05-02 | Thomson Licensing | Method for encoding and/or decoding images on macroblock level using intra-prediction |

| CN103688533B (zh) * | 2011-06-20 | 2015-12-23 | 联发科技(新加坡)私人有限公司 | 可减少行存储器的色度帧内预测方法及装置 |

| KR20120140592A (ko) | 2011-06-21 | 2012-12-31 | 한국전자통신연구원 | 움직임 보상의 계산 복잡도 감소 및 부호화 효율을 증가시키는 방법 및 장치 |

| WO2012177052A2 (ko) | 2011-06-21 | 2012-12-27 | 한국전자통신연구원 | 인터 예측 방법 및 그 장치 |

| JP6070553B2 (ja) | 2011-06-28 | 2017-02-01 | ソニー株式会社 | 画像処理装置、画像処理方法、プログラム、並びに記録媒体 |

| CN106941608B (zh) * | 2011-06-30 | 2021-01-15 | 三菱电机株式会社 | 图像编码装置及方法、图像解码装置及方法 |

| EP2552115A1 (en) * | 2011-07-25 | 2013-01-30 | Siemens Aktiengesellschaft | A method for coding a sequence of digital images |

| EP2754096A4 (en) | 2011-09-09 | 2015-08-05 | Panamorph Inc | IMAGE PROCESSING SYSTEM AND METHOD |

| KR102590030B1 (ko) * | 2011-09-20 | 2023-10-17 | 엘지전자 주식회사 | 영상 정보 인코딩/디코딩 방법 및 장치 |

| KR20130037162A (ko) * | 2011-10-05 | 2013-04-15 | 한국전자통신연구원 | 스케일러블 비디오 코딩을 위한 계층간 텍스처 예측 방법 및 그 장치 |

| US9167269B2 (en) * | 2011-10-25 | 2015-10-20 | Qualcomm Incorporated | Determining boundary strength values for deblocking filtering for video coding |

| ES2694301T3 (es) * | 2011-10-31 | 2018-12-19 | Hfi Innovation Inc. | Procedimiento y aparato de desbloqueo de filtro con decisión de intensidad de límite simplificada |

| DK2775711T3 (da) * | 2011-11-04 | 2020-04-06 | Lg Electronics Inc | Fremgangsmåde og apparat til at indkode/afkode billedeinformation |

| WO2013077714A1 (ko) * | 2011-11-27 | 2013-05-30 | 엘지전자 주식회사 | 영상 정보 인코딩/디코딩 방법 및 장치 |

| KR102053028B1 (ko) * | 2012-01-17 | 2019-12-06 | 텔레폰악티에볼라겟엘엠에릭슨(펍) | 참조영상 리스트 처리 |

| US9860549B2 (en) | 2012-03-29 | 2018-01-02 | Lg Electronics Inc. | Inter-layer prediction method and encoding device and decoding device using same |

| CN102630015B (zh) * | 2012-04-06 | 2014-07-16 | 芯原微电子(北京)有限公司 | 一种基于RealVideo9或10去块效应的快速旁路方法和装置 |

| WO2013169049A1 (ko) * | 2012-05-10 | 2013-11-14 | 엘지전자 주식회사 | 인터 레이어 예측 방법 및 이를 이용하는 장치 |

| EP2859724B1 (en) * | 2012-06-22 | 2019-09-04 | MediaTek Inc. | Method and apparatus of adaptive intra prediction for inter-layer coding |

| JP6085601B2 (ja) * | 2012-07-03 | 2017-02-22 | シャープ株式会社 | 画像復号装置、および画像符号化装置 |

| IN2015MN00077A (ja) | 2012-07-06 | 2015-10-16 | Samsung Electronics Co Ltd | |

| CA2878807C (en) * | 2012-07-09 | 2018-06-12 | Vid Scale, Inc. | Codec architecture for multiple layer video coding |

| CN104704831B (zh) * | 2012-08-06 | 2019-01-04 | Vid拓展公司 | 多层视频编码中用于空间层的采样栅格信息 |

| US20140044162A1 (en) * | 2012-08-08 | 2014-02-13 | Qualcomm Incorporated | Adaptive inference mode information derivation in scalable video coding |

| US9854235B2 (en) | 2012-08-31 | 2017-12-26 | Blackberry Limited | Methods and devices for entropy coding in scalable video compression |

| US10448032B2 (en) * | 2012-09-04 | 2019-10-15 | Qualcomm Incorporated | Signaling of down-sampling location information in scalable video coding |

| JP6125215B2 (ja) | 2012-09-21 | 2017-05-10 | 株式会社東芝 | 復号装置、及び符号化装置 |

| JP6282763B2 (ja) * | 2012-09-21 | 2018-02-21 | 株式会社東芝 | 復号装置、符号化装置、復号方法、及び符号化方法 |

| IN2015DN02130A (ja) * | 2012-09-27 | 2015-08-14 | Dolby Lab Licensing Corp | |

| SG11201500311XA (en) * | 2012-09-28 | 2015-02-27 | Intel Corp | Inter-layer pixel sample prediction |

| CN104541505B (zh) * | 2012-09-28 | 2019-07-05 | 英特尔公司 | 层间内部模式预测方法、设备及装置 |

| CN103716622B (zh) * | 2012-09-29 | 2017-02-08 | 华为技术有限公司 | 用于图像处理的方法和装置 |

| CA2877454C (en) * | 2012-11-07 | 2017-10-03 | Lg Electronics Inc. | Apparatus for transceiving signals and method for transceiving signals |

| US9756613B2 (en) | 2012-12-06 | 2017-09-05 | Qualcomm Incorporated | Transmission and reception timing for device-to-device communication system embedded in a cellular system |

| TWI597968B (zh) * | 2012-12-21 | 2017-09-01 | 杜比實驗室特許公司 | 在高位元深度視訊的可適性編碼中,高精度升取樣 |

| CN103916676B (zh) * | 2012-12-31 | 2017-09-29 | 华为技术有限公司 | 一种边界强度确定方法、去块效应滤波方法、及装置 |

| CN116320392A (zh) | 2013-01-04 | 2023-06-23 | Ge视频压缩有限责任公司 | 高效可伸缩编码概念 |

| US9270991B2 (en) * | 2013-01-07 | 2016-02-23 | Qualcomm Incorporated | Inter-layer reference picture generation for HLS-only scalable video coding |

| US9743097B2 (en) * | 2013-03-01 | 2017-08-22 | Qualcomm Incorporated | Spatial motion vector scaling for scalable video coding |

| US10284842B2 (en) * | 2013-03-05 | 2019-05-07 | Qualcomm Incorporated | Inter-layer reference picture construction for spatial scalability with different aspect ratios |

| US9467707B2 (en) * | 2013-03-05 | 2016-10-11 | Qualcomm Incorporated | Parallel processing for video coding |

| EP2974313B1 (en) * | 2013-03-12 | 2018-07-11 | HFI Innovation Inc. | Inter-layer motion vector scaling for scalable video coding |

| KR102127281B1 (ko) | 2013-04-08 | 2020-06-26 | 지이 비디오 컴프레션, 엘엘씨 | 효율적인 다-시점/계층 코딩을 허용하는 코딩 개념 |

| CN103220529B (zh) * | 2013-04-15 | 2016-02-24 | 北京大学 | 一种视频编解码环路滤波的实现方法 |

| US9813723B2 (en) * | 2013-05-03 | 2017-11-07 | Qualcomm Incorporated | Conditionally invoking a resampling process in SHVC |

| US9578328B2 (en) * | 2013-07-15 | 2017-02-21 | Qualcomm Incorporated | Cross-layer parallel processing and offset delay parameters for video coding |

| CN110033494A (zh) | 2013-09-20 | 2019-07-19 | Vid拓展公司 | 视频解码器设备和方法 |

| US9912925B2 (en) * | 2013-12-13 | 2018-03-06 | Vid Scale, Inc. | Providing 3D look-up table (LUT) estimation for color gamut scalability |

| FR3018417B1 (fr) * | 2014-03-04 | 2017-07-28 | Sagemcom Broadband Sas | Procede de modification d'un flux video binaire. |

| KR20160132857A (ko) * | 2014-03-14 | 2016-11-21 | 삼성전자주식회사 | 스케일러블 비디오 부호화/복호화 방법 및 장치 |

| KR102260146B1 (ko) | 2014-03-31 | 2021-06-03 | 인텔렉추얼디스커버리 주식회사 | 시점 간 움직임 병합 후보 유도 방법 및 장치 |

| US9704213B2 (en) | 2014-08-13 | 2017-07-11 | Qualcomm Incorporated | Texture element streaming |

| JP6305279B2 (ja) | 2014-08-26 | 2018-04-04 | 株式会社東芝 | 映像圧縮装置および映像再生装置 |

| CN109257605B (zh) * | 2017-07-13 | 2021-11-19 | 华为技术有限公司 | 图像处理方法、设备及系统 |

| EP3454556A1 (en) | 2017-09-08 | 2019-03-13 | Thomson Licensing | Method and apparatus for video encoding and decoding using pattern-based block filtering |

| KR102520626B1 (ko) * | 2018-01-22 | 2023-04-11 | 삼성전자주식회사 | 아티팩트 감소 필터를 이용한 영상 부호화 방법 및 그 장치, 영상 복호화 방법 및 그 장치 |

| TWI719520B (zh) * | 2018-06-29 | 2021-02-21 | 大陸商北京字節跳動網絡技術有限公司 | 零單元的濾波 |

| WO2020003268A2 (en) | 2018-06-29 | 2020-01-02 | Beijing Bytedance Network Technology Co., Ltd. | Definition of zero unit |

| US11620775B2 (en) | 2020-03-30 | 2023-04-04 | Panamorph, Inc. | Method of displaying a composite image on an image display |

| JP7591878B2 (ja) * | 2020-06-29 | 2024-11-29 | 日本放送協会 | 符号化装置、復号装置、及びプログラム |

Family Cites Families (19)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| ATE143758T1 (de) | 1990-07-11 | 1996-10-15 | Philips Electronics Nv | Vorrichtung zur ableitung eines kompatiblen zeilensprungfernsehsignals mit geringer auflösung und anderen komponenten eines hochauflösenden zeilensprungfernsehsignals sowie vorrichtung zur wiederherstellung des originalsignals |

| JPH07107464A (ja) * | 1993-10-01 | 1995-04-21 | Hitachi Ltd | 画像符号化装置および復号化装置 |

| JPH07212761A (ja) * | 1994-01-17 | 1995-08-11 | Toshiba Corp | 階層符号化装置及び階層復号化装置 |

| US6957350B1 (en) * | 1996-01-30 | 2005-10-18 | Dolby Laboratories Licensing Corporation | Encrypted and watermarked temporal and resolution layering in advanced television |

| JPH1070717A (ja) * | 1996-06-19 | 1998-03-10 | Matsushita Electric Ind Co Ltd | 画像符号化装置及び画像復号化装置 |

| US6173013B1 (en) * | 1996-11-08 | 2001-01-09 | Sony Corporation | Method and apparatus for encoding enhancement and base layer image signals using a predicted image signal |

| ES2323358T3 (es) * | 1997-04-01 | 2009-07-14 | Sony Corporation | Codificador de imagenes, metodo de codificacion de imagenes, descodificador de imagenes, metodo de descodificacion de imagenes, y medio de distribucion. |

| US6057884A (en) * | 1997-06-05 | 2000-05-02 | General Instrument Corporation | Temporal and spatial scaleable coding for video object planes |

| JP2000036032A (ja) * | 1998-07-17 | 2000-02-02 | Fujitsu Ltd | 前景画像抽出方法、画像処理装置、自動トリミング装置、記録媒体及び肖像写真装置 |

| US6459814B1 (en) | 1998-09-08 | 2002-10-01 | Sarnoff Corporation | Method and apparatus for generic scalable shape coding by deriving shape information for chrominance components from luminance component |

| KR100644498B1 (ko) * | 1999-08-25 | 2006-11-10 | 마츠시타 덴끼 산교 가부시키가이샤 | 노이즈 검출방법과 노이즈 검출장치 및 화상 복호화장치 |

| US6873655B2 (en) | 2001-01-09 | 2005-03-29 | Thomson Licensing A.A. | Codec system and method for spatially scalable video data |

| US7450641B2 (en) * | 2001-09-14 | 2008-11-11 | Sharp Laboratories Of America, Inc. | Adaptive filtering based upon boundary strength |

| JP2005506816A (ja) * | 2001-10-26 | 2005-03-03 | コーニンクレッカ フィリップス エレクトロニクス エヌ ヴィ | 適応的コンテンツフィルタリングを用いた空間拡張可能圧縮の機構 |

| US7155654B2 (en) * | 2003-04-04 | 2006-12-26 | Sst Communications, Corp. | Low complexity error concealment for wireless transmission |

| JP2004328634A (ja) * | 2003-04-28 | 2004-11-18 | Sony Corp | 画像復号化装置及び方法 |

| US20070118794A1 (en) * | 2004-09-08 | 2007-05-24 | Josef Hollander | Shared annotation system and method |

| JP4191729B2 (ja) * | 2005-01-04 | 2008-12-03 | 三星電子株式会社 | イントラblモードを考慮したデブロックフィルタリング方法、及び該方法を用いる多階層ビデオエンコーダ/デコーダ |

| EP1894412A1 (en) * | 2005-02-18 | 2008-03-05 | THOMSON Licensing | Method for deriving coding information for high resolution images from low resoluton images and coding and decoding devices implementing said method |

-

2006

- 2006-02-07 US US11/350,000 patent/US7961963B2/en active Active

- 2006-02-28 JP JP2008501902A patent/JP4454678B2/ja not_active Expired - Lifetime

- 2006-02-28 WO PCT/US2006/007106 patent/WO2006101682A2/en not_active Ceased

- 2006-02-28 EP EP06736425A patent/EP1859534A4/en not_active Withdrawn

- 2006-02-28 EP EP06736426A patent/EP1859389A4/en not_active Withdrawn

- 2006-02-28 KR KR1020077023737A patent/KR100947677B1/ko not_active Expired - Lifetime

- 2006-02-28 CN CN2011103377932A patent/CN102387366A/zh active Pending

- 2006-02-28 JP JP2008501903A patent/JP4751928B2/ja not_active Expired - Lifetime

- 2006-02-28 WO PCT/US2006/007105 patent/WO2007064347A2/en not_active Ceased

- 2006-02-28 CN CN200680016560XA patent/CN101379511B/zh not_active Expired - Lifetime

- 2006-02-28 CN CN2006800168580A patent/CN101449476B/zh not_active Expired - Lifetime

- 2006-02-28 KR KR1020077023970A patent/KR100959436B1/ko not_active Expired - Lifetime

-

2009

- 2009-10-21 JP JP2009242741A patent/JP2010016911A/ja active Pending

- 2009-10-21 JP JP2009242688A patent/JP4975078B2/ja not_active Expired - Lifetime

-

2010

- 2010-12-13 JP JP2010277337A patent/JP5154635B2/ja not_active Expired - Lifetime

Also Published As

| Publication number | Publication date |

|---|---|

| JP4751928B2 (ja) | 2011-08-17 |

| CN101379511A (zh) | 2009-03-04 |

| JP4975078B2 (ja) | 2012-07-11 |

| EP1859534A2 (en) | 2007-11-28 |

| WO2006101682A2 (en) | 2006-09-28 |

| CN102387366A (zh) | 2012-03-21 |

| JP2010016910A (ja) | 2010-01-21 |

| JP2010016911A (ja) | 2010-01-21 |

| EP1859389A4 (en) | 2010-08-25 |

| KR20080003808A (ko) | 2008-01-08 |

| JP2011083022A (ja) | 2011-04-21 |

| KR20080005210A (ko) | 2008-01-10 |

| JP2008533909A (ja) | 2008-08-21 |

| US20060209959A1 (en) | 2006-09-21 |

| WO2007064347A3 (en) | 2008-01-17 |

| KR100959436B1 (ko) | 2010-05-26 |

| KR100947677B1 (ko) | 2010-03-16 |

| WO2006101682A3 (en) | 2008-11-13 |

| WO2007064347A2 (en) | 2007-06-07 |

| CN101449476A (zh) | 2009-06-03 |

| EP1859389A2 (en) | 2007-11-28 |

| CN101449476B (zh) | 2012-05-23 |

| JP4454678B2 (ja) | 2010-04-21 |

| JP2008538057A (ja) | 2008-10-02 |

| CN101379511B (zh) | 2011-11-09 |

| US7961963B2 (en) | 2011-06-14 |

| EP1859534A4 (en) | 2010-09-29 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5154635B2 (ja) | 拡張された空間スケーラビティにおける画像レベルの適応化方法およびシステム | |

| JP5189054B2 (ja) | 画像の復号方法 | |

| US8023569B2 (en) | Methods and systems for block-based residual upsampling | |

| CN108111846B (zh) | 用于可伸缩视频编码的帧间层预测方法及装置 | |

| US8457201B2 (en) | Inter-layer prediction method for video signal | |

| JP5416271B2 (ja) | 多層映像配信のための適応補間フィルタ | |

| US7929610B2 (en) | Methods and systems for reducing blocking artifacts with reduced complexity for spatially-scalable video coding | |

| KR102653005B1 (ko) | 휘도 샘플을 이용한 색차 블록의 화면 내 예측 방법 및 이러한 방법을 사용하는 장치 | |

| US20080267291A1 (en) | Method for Deriving Coding Information for High Resolution Images from Low Resolution Images and Coding and Decoding Devices Implementing Said Method | |

| JP7625054B2 (ja) | 符号化・復号方法、装置及びそのデバイス | |

| WO2011086836A1 (ja) | 符号化装置、復号装置、および、データ構造 | |

| CN104322067A (zh) | 基于树结构的编码单元对可伸缩视频进行编码的方法和装置以及基于树结构的编码单元对可伸缩视频进行解码的方法和装置 | |

| EP1817914B1 (en) | Method for scalable video coding | |

| CN115398918A (zh) | 用于视频编码的方法和装置 | |

| CN117581533A (zh) | 用于视频处理的方法、设备和介质 | |

| CN121002863A (zh) | 用于视频处理的方法、装置和介质 | |

| CN121040048A (zh) | 用于视频处理的方法、装置和介质 | |

| Bharanitharan | Efficient spatial scalability algorithm for H. 264/SVC encoders |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20121023 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20121106 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20121205 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20151214 Year of fee payment: 3 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 5154635 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313113 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |