JP3814566B2 - 情報処理装置、情報処理方法、制御プログラム - Google Patents

情報処理装置、情報処理方法、制御プログラム Download PDFInfo

- Publication number

- JP3814566B2 JP3814566B2 JP2002180053A JP2002180053A JP3814566B2 JP 3814566 B2 JP3814566 B2 JP 3814566B2 JP 2002180053 A JP2002180053 A JP 2002180053A JP 2002180053 A JP2002180053 A JP 2002180053A JP 3814566 B2 JP3814566 B2 JP 3814566B2

- Authority

- JP

- Japan

- Prior art keywords

- input

- instruction

- field

- utterance example

- information processing

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

- 230000010365 information processing Effects 0.000 title claims description 24

- 238000003672 processing method Methods 0.000 title claims description 7

- 238000010586 diagram Methods 0.000 description 13

- 238000000034 method Methods 0.000 description 12

- 230000006870 function Effects 0.000 description 9

- 238000004458 analytical method Methods 0.000 description 5

- 230000005540 biological transmission Effects 0.000 description 2

- 230000015572 biosynthetic process Effects 0.000 description 2

- 230000000694 effects Effects 0.000 description 2

- 238000003786 synthesis reaction Methods 0.000 description 2

- 230000003213 activating effect Effects 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/26—Speech to text systems

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/22—Procedures used during a speech recognition process, e.g. man-machine dialogue

- G10L2015/223—Execution procedure of a spoken command

Landscapes

- Engineering & Computer Science (AREA)

- Computational Linguistics (AREA)

- Health & Medical Sciences (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- Acoustics & Sound (AREA)

- Multimedia (AREA)

- User Interface Of Digital Computer (AREA)

Description

【発明の属する技術分野】

本発明は、データを入力する入力欄を表示し、当該入力欄に入力されたデータに基づいて所定のタスクを達成する情報処理装置、情報処理方法、プログラム、記憶媒体に関するものである。

【0002】

【従来の技術】

従来の音声認識技術のインプリメントは、プログラムを作成することにより行われていた。しかし近年では、VoiceXML等、ハイパーテキスト文書の利用により音声認識のインプリメントを行っている。VoiceXMLでは入出力の手段(ユーザインターフェース)として、基本的には音声のみが使用されているが(厳密にはDTMFなども使用)、特開2001−166915号公報、特開平10−154063号公報等には、音声入出力と共にGUI(Graphical User Interface)を併用したユーザインターフェースの記述に、ハイパーテキスト文書が使用されている。このGUIの記述にはHTMLのようなマークアップ言語が用いられ、さらに音声入出力を可能にするために、音声入力や音声出力に対応するいくつかのタグを追加している。

【0003】

一方GUIと音声入出力を併用したいわゆるマルチモーダル・ユーザインタフェースにおいては、音声認識による音声入力、音声合成による音声出力、GUIによるユーザからの入力や情報のグラフィックによる提示など、各モダリティがどのように連動するかの記述が必要となる。例えば特開2001−042890号公報においては、ボタンと入力欄および音声入力が関連づけられており、ボタンを押すと関連づけられた入力欄が選択され音声認識結果がその欄に入力される方法が開示されている。

【0004】

【発明が解決しようとする課題】

Webやダイアログアプリケーションの入力欄への入力を考えた場合、キーボード等の入力がどの欄に入力されるかをユーザに示すことが必要である。一般的には、現在入力可能な欄はフォーカス強調により、他の欄とは区別される。音声による入力を考えた場合も、入力対象となる欄を強調することは必要であり、認識誤りが生じやすいという音声認識の性格上、ユーザに入力欄の発声例を提示することで、ユーザの発声あやまりを減らすことも必要である。

【0005】

本発明は以上の問題に鑑みてなされたものであり、音声入力により入力欄にデータを入力する場合、この入力欄にデータを円滑に入力させることを目的とする。また、本発明は、どの入力欄にどの音声認識結果が入力されるかを示すことを目的とする。

【0006】

【課題を解決するための手段】

本発明の目的を達成するために、例えば本発明の情報処理装置は以下の構成を備える。

【0007】

すなわち、データを入力するための複数の入力欄を表示し、各入力欄に入力されたデータに基づいて所定のタスクを達成する情報処理装置であって、

前記複数の入力欄のうち、少なくとも1つ以上の入力欄を指示する指示手段と、

前記指示手段により1つの入力欄が指示された場合、該指示された入力欄に対応する文法を用いて、該指示された入力欄へデータを入力するための発声例を生成し、該発声例を表示もしくは音声出力する第1の発声例出力手段と、

前記指示手段により複数の入力欄が指示された場合、該指示された複数の入力欄に対応する文法及び、該指示された複数の入力欄のそれぞれに対応する文法を用いて、該指示された複数の入力欄へデータを入力するための発声例を生成し、該発声例を表示もしくは音声出力する第2の発声例出力手段と、

前記指示手段により指示された入力欄に対してデータを入力するために外部から入力された音声を、当該入力欄に対応した文法を用いて音声認識する音声認識手段と

を備えることを特徴とする。

【0010】

本発明の目的を達成するために、例えば本発明の情報処理方法は以下の構成を備える。

【0011】

すなわち、データを入力するための複数の入力欄を表示し、各入力欄に入力されたデータに基づいて所定のタスクを達成する情報処理方法であって、

前記複数の入力欄のうち、少なくとも1つ以上の入力欄を指示する指示工程と、

前記指示工程で1つの入力欄が指示された場合、該指示された入力欄に対応する文法を用いて、該指示された入力欄へデータを入力するための発声例を生成し、該発声例を表示もしくは音声出力する第1の発声例出力工程と、

前記指示工程で複数の入力欄が指示された場合、該指示された複数の入力欄に対応する文法及び、該指示された複数の入力欄のそれぞれに対応する文法を用いて、該指示された複数の入力欄へデータを入力するための発声例を生成し、該発声例を表示もしくは音声出力する第2の発声例出力工程と、

前記指示工程で指示された入力欄に対してデータを入力するために外部から入力された音声を、当該入力欄に対応した文法を用いて音声認識する音声認識工程と

を備えることを特徴とする。

【0014】

【発明の実施の形態】

以下添付図面を参照し、本発明を好適な実施形態に従って詳細に説明する。

【0015】

[第1の実施形態]

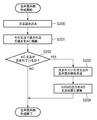

図1は本実施形態における情報処理装置の基本構成を示すブロック図である。また、図2は、図1の情報処理装置が行う処理のフローチャートである。以下、図1,2を用いて、本実施形態における情報処理装置の構成と共に、情報処理装置が行う処理について説明する。

【0016】

まず文章読み込み部101は、文章データを格納する文章データDB(データベース)100から、文章データを読み込む(ステップS100)。文書データはマークアップ言語などの記述言語で記述されており、GUIのデザイン、音声認識合成の動作、文法の位置などが記述されている。次に、文章読み込み部101が読み込んだ文章データの構造を文章解析部102が解析する(ステップS101)。文書データの例を図8に示す。またこれをGUIで表示した(所定のブラウザを用いて表示した)例を図3に示す。

【0017】

図8において、502及び503のinputタグはGUIにおいては図3に示すとおり、302および303の入力欄(子欄)として表示される。また501および504のformタグは、そのformタグ内のinputタグ要素を内部に含む301のような枠線(親欄)で表示され、どの入力要素(例えばinput)がformに含まれるのかを表示する。501のformタグでは、複数のinputタグで表される入力欄に対する属性の設定ができる。501および504で囲まれる2つのinputタグ502および503がform名"keiro"に含まれる。501や502,503にある属性grammarは文法が保持される位置(アドレス)を示す。本実施形態では、文法は本装置内に保持されているものとするが、これに限定されるものではなく、例えば、LANやインターネットを介した外部の装置内に保持されていても良い。

【0018】

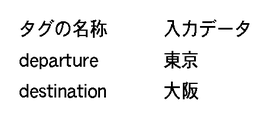

制御部109は、文章解析部102による解析結果に基づいて、入力欄と文法との対応関係を求める(ステップS102)。本実施形態では図8に示す通り、"keiro"という名称のformに対して文法“http://temp/long.grm#keiro”が対応し、"departure"という名称のinputに対して文法“http://temp/station.grm#station”が、"destination"という名称のinputに対して文法“http://temp/station.grm#station”が対応する。制御部109は、文章解析部102による解析結果において、この対応関係を示すデータを作成し、記憶装置103内の文法/入力欄対応保持部130に出力し、文法/入力欄対応保持部130は例えば図6に示すように、タグの名称と文法名(文法のファイル名)を関連づけた形態で保持する。図6は、文法/入力欄対応保持部130が保持するタグの名称と文法名との構成を示す図である。

【0019】

次に文章読み込み部101は、文法データを格納する文法DB(データベース)110から、ステップS100において読み込んだ文章データに対応する文法データを読み込む(ステップS103)。本実施形態では、501,502,503において”http://、、、、”で示される夫々のアドレスに位置する3つの文法が読み込まれ、記憶装置103内に、文法データ群121として記憶される(本実施形態ではn=3)。

【0020】

次に、制御部109は表示部104に指示し、表示部104はステップS101で解析した結果を表示する(ステップS104)。表示結果は上述の通り、GUIとして図3に示すように表示される。また、表示部104はCRTや液晶画面などにより構成されている。

【0021】

次に、ユーザによる操作部115からの入力指示があったか否かを判断する(ステップS105)。入力指示は何らかの形で301,302あるいは303など、どの入力欄に対する入力かを示すものである。入力指示は操作部115を用いた物理的なボタンで行われてもよいし、表示部104に表示されるGUIの要素を操作部115により押しても構わない。例えば302や303を選択したい場合は、それぞれの枠線内の領域を操作部115に含まれるポインティングデバイスで押せばよいし、301の入力欄を選択したい場合は、302と303の領域以外でかつ、301の枠線内の領域をポインティングデバイスで押す。以上のユーザからの入力指示があれば処理をステップS106に進める。

【0022】

制御部109は表示部104に表示されたもののうちで、上記入力指示された箇所(欄)を強調し、どの欄が入力可能になったかをユーザに示すと共に、入力可能な欄への入力例を表示する(ステップS106)。図9(a)、(b)は夫々、親欄の強調、指示した子欄の強調、及び各欄に対する発声例を具体的に示した図である。図9(a)に示すように、親欄の内部かつ子欄の内部以外を指示した場合、親欄が指示されたものとする。この場合、親欄の外枠を太くし、領域内部の描画色を変更する。さらに、親欄内部に表示テキストがある場合、そのフォントを太字のものに変更し、サイズを大きくし、文字の色を変更する。一方、図9(b)に示すように、特定の子欄が選択された場合、その欄の外枠を太くし、描画色を変更する。

【0023】

また同図(a)、(b)に示す601,602は、それぞれの入力欄を埋めるための発声例を、マウスポインタ下にポップアップテキストで提示している。図9(a)においては、formを指示しているので、『「東京から大阪まで」のように発声して下さい』という説明のポップアップテキスト601を表示する。一方、図9(b)においては、1つの子欄を指示しているので、『「大阪」のように発声して下さい』という説明のポップアップテキスト602を表示する。

【0024】

これらの文字列は、図8に示すように、コンテンツ作成時に文字列として埋め込んでおくことができる。本例ではinput要素のexplanation属性にその文字列を埋め込んでいる。

【0025】

次に、制御部109は、上記入力指示された欄に対応する文法をアクティブにする(ステップS107)。ここで文法をアクティブにするとは、音声認識部106にて、特定の文法のみを認識可能に制御することを意味する。例えば、図3において301の部分がユーザによって選択された場合、301の部分は501のformタグに対応するものであるから、501のformタグに記述された文法long.grmがアクティブとなり、その結果、音声認識部106は文法long.grmを用いて音声認識処理を行う。また同様に302の部分がユーザによって選択された場合、302の部分は502のinputタグに対応するものであるから、502のinputタグに記述された文法station.grmがアクティブとなり、その結果、音声認識部106は文法station.grmを用いて音声認識処理を行う。303の部分がユーザによって選択された場合も同様である。

【0026】

文法long.grmの記述例を図4に、文法station.grmの記述例を図5に示す。文法station.grmを用いることにより、音声認識部106は「東京」、「大阪」、「名古屋」などの発声を認識することが出来る。また文法long.grmを用いることで、音声認識部106は「××から○○まで」、「××から」、「○○まで」などの発声を認識することができる。ここで「××」や「○○」はstation.grmに記述される内容を用いる。すなわち「東京から大阪まで」、「名古屋から」、「東京まで」などを認識することができる。

【0027】

よって、音声認識部106は、ユーザからマイク105を介して入力された、ステップS107においてアクティブになった文法を用いて音声認識処理を行う(ステップS108)。一般に文法を用いた音声認識技術は公知の技術を用いるために、音声認識に関する説明は省略する。

【0028】

音声認識部106による音声認識結果はステップS105で入力指示した欄に表示される(ステップS109)。例えばユーザが302の部分を選択して「東京」と発声すると、302の部分(欄)に東京と表示される。しかし301のようなformタグで表される欄の場合は、302および303という複数の入力欄を含むので、以下の方法で表示する欄を決める。

【0029】

ここでは図4に示す文法記述に従い、説明を行う。文法記述において{}で囲まれる部分を解析し、{}に記述されている欄に対して入力を行う。例えばユーザがマイク105に対して「東京から大阪まで」と発声した場合、音声認識部106は、この発声内容において駅名を「東京」、「大阪」の順に認識する。その結果、「東京」は{departure}に対応し、「大阪」は{destination}に対応することがわかる。

【0030】

この対応関係から「東京」は"departure"に対応する302の欄に、「大阪」は"destination"に対応する303の欄に表示される。また「名古屋から」と発声した場合は{departure}に対応づけられるため302の欄に、「東京まで」と発声した場合は{destination}に対応づけられるため303の欄に表示される。すなわち301をユーザが選択した場合、発声内容に従って、302の欄、303の欄に順に、もしくは同時に音声認識結果が表示される。

【0031】

更にステップS109では、各欄(図4では302,303の欄)に入力された入力データが、入力欄を示すデータ(タグの名前)と共に入力データ保持部131に記憶される。例えば音声認識部106に「東京から大阪まで」という発声内容が入力され、音声認識部106がこれを音声認識した場合に、入力データ保持部131に記憶されるデータの例を図7に示す。同図の通り、表示された欄を示すデータであるタグの名称と、表示される入力データ(上記音声認識結果)とが関連づけられている。

【0032】

次に、ユーザから操作部115を介して、入力データをアプリケーション108へ送信する指示が入力されたら、制御部109が入力データ送信部107を指示し、入力データ送信部107は記憶装置103内の入力データ保持部131が保持するデータをアプリケーション108に送信する(ステップS110)。アプリケーション108は、例えば入力された2つの駅間の複数の経路を検索したり、検索した経路を使用した場合の所要時間などを求めるソフトウェアである。そして、送信されたデータを用いて制御部109はアプリケーション108を実行し、アプリケーション108は、上記動作を行い、その動作結果を表示部104に表示する(ステップS111)。

【0033】

以上の説明により、本実施形態における情報処理装置は、データが入力可能な各欄に文法データと発声例を対応づけておくことで、ユーザの入力指示した欄、もしくは欄群に対して発声例を示し、音声認識結果に従った入力データを入力することができ、音声入力を用いたソフトウェアをより快適に操作することができる。

【0034】

[第2の実施形態]

情報処理装置に音声出力装置が備わっている場合には、この音声出力装置により、各欄の発声例であるポップアップの文字列を音声により読み上げてもよい。

【0035】

[第3の実施形態]

第2の実施形態では、マークアップ文書データに入力欄の発声例を埋め込んだが、この発声例(のデータ)を入力欄に対応する文法から適宜作成することも可能である。この作成方法について図10,11を用いて以下説明する。なお、入力欄の強調以外の処理、及び情報処理装置の構成は、第1の実施形態で説明したものと同じものであるため割愛する。

【0036】

図10は音声の発声例を適宜作成する処理のフローチャートであり、入力欄の強調処理(ステップS106)から呼び出されるものである。ユーザがある特定の入力欄を選択した場合、その入力欄に対応する文法を引数にして、この処理が呼び出される。ここでは例として図4のlong.grmの発声例を作成する処理を示す。

【0037】

まず、対象となる文法(long.grm)を読み込む(ステップS200)。次に、読み込まれた文法で表される先頭の発声文を取得し、変数Aに格納する(ステップS201)。long.grmの場合では、先頭の発声文は「<station>から<station>まで」となり、この文字列が変数Aに格納される。

【0038】

次に、Aに文法が含まれるかを判定する。本例の場合、<station>が文法であるため、処理をステップS203に進める。そして、含まれていた全文法の音声発声例を本処理を再帰的に呼び出すことで取得する。<station>は図5で示される文法であり、station.grmを引数に本処理を行うことで、<station>の先頭発声文として“東京”という発声例を取得できる。ステップS203で取得された発声例は、変数Aの各文法位置に置換される(ステップS204)。本例では、<station>の位置に“東京”という文字列が置換されるため、変数Aは「東京から東京まで」となる。なお、発声例の取得例として、図5に示されるいずれの駅名を用いても良いことは明らかである。

【0039】

以上の処理が終わると、変数Aには文法を含まない発声例が格納されていることになる。本例では、long.grmの発声例として「東京から東京まで」という例のデータが作成されることになる。

【0040】

この処理により作成された音声発声例のGUIにおける表示例を図11(a)、(b)に示す。図11(a)、(b)は夫々、親欄の強調、指示した子欄の強調処理において表示される文字列を示した図である。図11(a)、(b)では701,702のようなフキダシ型のポップアップでユーザに発声を例示している。このように音声発声例は画面に出力してもよいし、情報処理装置に音声出力装置が備わっている場合には、この音声出力装置により、このポップアップの文字列を音声により読み上げてもよい。

【0041】

[第4の実施形態]

上記実施形態で説明した入力欄の強調は、ユーザにより入力欄が指示されてからすぐに開始してもよいし、指示後、ユーザからのアクションが何も検出されない状態が一定時間経過した場合に開始してもよい。後者の場合、入力欄の指示とそれに続く入力作業(音声発声)がスムーズに続かないユーザだけに、その入力欄の発声例を示すことになる。

【0042】

また、上記実施形態における文章データはマークアップ言語などの記述言語で提供されるため、簡単にカスタマイズできるという効果をもつ。

【0043】

また、上記実施形態では、アプリケーションソフトウェアとして2駅間の経路探索を行うソフトウェアとしたが、これに限定されるものではなく、入力欄が多く、全ての入力欄にデータを入力することが必要なアプリケーションソフトウェアにも好適である。

【0044】

[その他の実施形態]

本発明の目的は、前述した実施形態の機能を実現するソフトウェアのプログラムコードを記録した記憶媒体(または記録媒体)を、システムあるいは装置に供給し、そのシステムあるいは装置のコンピュータ(またはCPUやMPU)が記憶媒体に格納されたプログラムコードを読み出し実行することによっても、達成されることは言うまでもない。この場合、記憶媒体から読み出されたプログラムコード自体が前述した実施形態の機能を実現することになり、そのプログラムコードを記憶した記憶媒体は本発明を構成することになる。また、コンピュータが読み出したプログラムコードを実行することにより、前述した実施形態の機能が実現されるだけでなく、そのプログラムコードの指示に基づき、コンピュータ上で稼働しているオペレーティングシステム(OS)などが実際の処理の一部または全部を行い、その処理によって前述した実施形態の機能が実現される場合も含まれることは言うまでもない。

【0045】

さらに、記憶媒体から読み出されたプログラムコードが、コンピュータに挿入された機能拡張カードやコンピュータに接続された機能拡張ユニットに備わるメモリに書込まれた後、そのプログラムコードの指示に基づき、その機能拡張カードや機能拡張ユニットに備わるCPUなどが実際の処理の一部または全部を行い、その処理によって前述した実施形態の機能が実現される場合も含まれることは言うまでもない。

【0046】

【発明の効果】

以上の説明により、本発明によって、音声入力により入力欄にデータを入力する場合、この入力欄にデータを円滑に入力させることができる。また、本発明は、入力欄にどのような発声を行えば音声認識結果が正しく入力されるかをユーザに示すことができる。

【図面の簡単な説明】

【図1】本発明の実施形態における情報処理装置の基本構成を示すブロック図である。

【図2】図1の情報処理装置が行う処理のフローチャートである。

【図3】図8に示した文章データをGUIで表示した例を示す図である。

【図4】 long.grmの記述例の記述例を示す図である。

【図5】 station.grmの記述例を示す図である。

【図6】文法/入力欄対応保持部130が保持するタグの名称と文法名との構成を示す図である。

【図7】音声認識部106に「東京から大阪まで」という発声内容が入力され、音声認識部106がこれを音声認識した場合に、入力データ保持部131に記憶されるデータの例を示す図である。

【図8】本発明の第1の実施形態で用いる文章データの一例を示す図である。

【図9】(a)、(b)は夫々、親欄の強調、指示した子欄の強調、及び各欄に対する発声例を具体的に示した図である。

【図10】音声の発声例を適宜作成する処理のフローチャートである。

【図11】(a)、(b)は夫々、親欄の強調、指示した子欄の強調処理において表示される文字列を示す図である。

Claims (5)

- データを入力するための複数の入力欄を表示し、各入力欄に入力されたデータに基づいて所定のタスクを達成する情報処理装置であって、

前記複数の入力欄のうち、少なくとも1つ以上の入力欄を指示する指示手段と、

前記指示手段により1つの入力欄が指示された場合、該指示された入力欄に対応する文法を用いて、該指示された入力欄へデータを入力するための発声例を生成し、該発声例を表示もしくは音声出力する第1の発声例出力手段と、

前記指示手段により複数の入力欄が指示された場合、該指示された複数の入力欄に対応する文法及び、該指示された複数の入力欄のそれぞれに対応する文法を用いて、該指示された複数の入力欄へデータを入力するための発声例を生成し、該発声例を表示もしくは音声出力する第2の発声例出力手段と、

前記指示手段により指示された入力欄に対してデータを入力するために外部から入力された音声を、当該入力欄に対応した文法を用いて音声認識する音声認識手段と

を備えることを特徴とする情報処理装置。 - 前記第1の発声例出力手段は、前記指示手段により指示されてから一定時間経過した後に発声例を出力することを特徴とする請求項1に記載の情報処理装置。

- 前記第2の発声例出力手段は、前記指示手段により指示されてから一定時間経過した後に発声例を出力することを特徴とする請求項1に記載の情報処理装置。

- データを入力するための複数の入力欄を表示し、各入力欄に入力されたデータに基づいて所定のタスクを達成する情報処理方法であって、

前記複数の入力欄のうち、少なくとも1つ以上の入力欄を指示する指示工程と、

前記指示工程で1つの入力欄が指示された場合、該指示された入力欄に対応する文法を用いて、該指示された入力欄へデータを入力するための発声例を生成し、該発声例を表示もしくは音声出力する第1の発声例出力工程と、

前記指示工程で複数の入力欄が指示された場合、該指示された複数の入力欄に対応する文法及び、該指示された複数の入力欄のそれぞれに対応する文法を用いて、該指示された複数の入力欄へデータを入力するための発声例を生成し、該発声例を表示もしくは音声出力する第2の発声例出力工程と、

前記指示工程で指示された入力欄に対してデータを入力するために外部から入力された音声を、当該入力欄に対応した文法を用いて音声認識する音声認識工程と

を備えることを特徴とする情報処理方法。 - 請求項4に記載の情報処理方法をコンピュータに実行させるための制御プログラム。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2002180053A JP3814566B2 (ja) | 2002-06-20 | 2002-06-20 | 情報処理装置、情報処理方法、制御プログラム |

| US10/460,171 US7424429B2 (en) | 2002-06-20 | 2003-06-13 | Information processing apparatus, information processing method, program, and storage medium |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2002180053A JP3814566B2 (ja) | 2002-06-20 | 2002-06-20 | 情報処理装置、情報処理方法、制御プログラム |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2004021920A JP2004021920A (ja) | 2004-01-22 |

| JP2004021920A5 JP2004021920A5 (ja) | 2005-04-21 |

| JP3814566B2 true JP3814566B2 (ja) | 2006-08-30 |

Family

ID=29728241

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2002180053A Expired - Fee Related JP3814566B2 (ja) | 2002-06-20 | 2002-06-20 | 情報処理装置、情報処理方法、制御プログラム |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US7424429B2 (ja) |

| JP (1) | JP3814566B2 (ja) |

Families Citing this family (18)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3542578B2 (ja) * | 2001-11-22 | 2004-07-14 | キヤノン株式会社 | 音声認識装置及びその方法、プログラム |

| JP4217495B2 (ja) | 2003-01-29 | 2009-02-04 | キヤノン株式会社 | 音声認識辞書作成方法、音声認識辞書作成装置及びプログラム、記録媒体 |

| US7729919B2 (en) * | 2003-07-03 | 2010-06-01 | Microsoft Corporation | Combining use of a stepwise markup language and an object oriented development tool |

| JP2005148724A (ja) * | 2003-10-21 | 2005-06-09 | Zenrin Datacom Co Ltd | 音声認識を用いた情報入力を伴う情報処理装置 |

| JP4012143B2 (ja) * | 2003-12-16 | 2007-11-21 | キヤノン株式会社 | 情報処理装置およびデータ入力方法 |

| US20060247925A1 (en) * | 2005-04-27 | 2006-11-02 | International Business Machines Corporation | Virtual push-to-talk |

| JP4705406B2 (ja) | 2005-05-13 | 2011-06-22 | 富士通株式会社 | マルチモーダル制御装置およびマルチモーダル制御方法 |

| US7814501B2 (en) * | 2006-03-17 | 2010-10-12 | Microsoft Corporation | Application execution in a network based environment |

| JP4810343B2 (ja) * | 2006-07-20 | 2011-11-09 | キヤノン株式会社 | 音声処理装置およびその制御方法 |

| JP2008048076A (ja) * | 2006-08-11 | 2008-02-28 | Canon Inc | 音声処理装置およびその制御方法 |

| US8417529B2 (en) * | 2006-12-27 | 2013-04-09 | Nuance Communications, Inc. | System and methods for prompting user speech in multimodal devices |

| JP5002283B2 (ja) * | 2007-02-20 | 2012-08-15 | キヤノン株式会社 | 情報処理装置および情報処理方法 |

| US8635069B2 (en) * | 2007-08-16 | 2014-01-21 | Crimson Corporation | Scripting support for data identifiers, voice recognition and speech in a telnet session |

| JP2015129672A (ja) * | 2014-01-07 | 2015-07-16 | アルパイン株式会社 | 施設検索装置および方法 |

| US10033797B1 (en) | 2014-08-20 | 2018-07-24 | Ivanti, Inc. | Terminal emulation over HTML |

| US10372804B2 (en) | 2016-05-17 | 2019-08-06 | Bruce HASSEL | Interactive audio validation/assistance system and methodologies |

| US11100278B2 (en) | 2016-07-28 | 2021-08-24 | Ivanti, Inc. | Systems and methods for presentation of a terminal application screen |

| JP2020204919A (ja) * | 2019-06-18 | 2020-12-24 | オルガノプラントサービス株式会社 | 設備管理支援システム |

Family Cites Families (18)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH07146767A (ja) | 1993-11-24 | 1995-06-06 | Kobe Nippon Denki Software Kk | ヘルプ情報管理システム |

| JPH10105357A (ja) | 1996-08-07 | 1998-04-24 | Pfu Ltd | 地図上の目的物選択表示制御方法およびプログラム記憶媒体 |

| JP3826239B2 (ja) | 1996-11-22 | 2006-09-27 | 日本電信電話株式会社 | ハイパーテキスト中継方法及び装置 |

| US6157705A (en) * | 1997-12-05 | 2000-12-05 | E*Trade Group, Inc. | Voice control of a server |

| US6216104B1 (en) * | 1998-02-20 | 2001-04-10 | Philips Electronics North America Corporation | Computer-based patient record and message delivery system |

| US6513063B1 (en) * | 1999-01-05 | 2003-01-28 | Sri International | Accessing network-based electronic information through scripted online interfaces using spoken input |

| US6757718B1 (en) * | 1999-01-05 | 2004-06-29 | Sri International | Mobile navigation of network-based electronic information using spoken input |

| JP3822990B2 (ja) * | 1999-01-07 | 2006-09-20 | 株式会社日立製作所 | 翻訳装置、記録媒体 |

| US6600736B1 (en) * | 1999-03-31 | 2003-07-29 | Lucent Technologies Inc. | Method of providing transfer capability on web-based interactive voice response services |

| JP2001042890A (ja) | 1999-07-30 | 2001-02-16 | Toshiba Tec Corp | 音声認識装置 |

| JP4320487B2 (ja) * | 1999-09-03 | 2009-08-26 | ソニー株式会社 | 情報処理装置および方法、並びにプログラム格納媒体 |

| JP2001166915A (ja) | 1999-12-13 | 2001-06-22 | Nec Software Kobe Ltd | 音声wwwブラウザ装置および制御方法 |

| US6510417B1 (en) * | 2000-03-21 | 2003-01-21 | America Online, Inc. | System and method for voice access to internet-based information |

| US6687734B1 (en) * | 2000-03-21 | 2004-02-03 | America Online, Incorporated | System and method for determining if one web site has the same information as another web site |

| US6662157B1 (en) * | 2000-06-19 | 2003-12-09 | International Business Machines Corporation | Speech recognition system for database access through the use of data domain overloading of grammars |

| JP2002007019A (ja) | 2000-06-22 | 2002-01-11 | Hitachi Ltd | ヘルプガイダンス自動表示・消去方式 |

| JP3774698B2 (ja) * | 2000-10-11 | 2006-05-17 | キヤノン株式会社 | 情報処理装置、情報処理方法及び記憶媒体 |

| JP3974419B2 (ja) * | 2002-02-18 | 2007-09-12 | 株式会社日立製作所 | 音声入力を用いた情報取得方法及び情報取得システム |

-

2002

- 2002-06-20 JP JP2002180053A patent/JP3814566B2/ja not_active Expired - Fee Related

-

2003

- 2003-06-13 US US10/460,171 patent/US7424429B2/en not_active Expired - Fee Related

Also Published As

| Publication number | Publication date |

|---|---|

| JP2004021920A (ja) | 2004-01-22 |

| US7424429B2 (en) | 2008-09-09 |

| US20030236673A1 (en) | 2003-12-25 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP3814566B2 (ja) | 情報処理装置、情報処理方法、制御プログラム | |

| EP1485773B1 (en) | Voice-controlled user interfaces | |

| US7650284B2 (en) | Enabling voice click in a multimodal page | |

| RU2352979C2 (ru) | Синхронное понимание семантических объектов для высокоинтерактивного интерфейса | |

| KR100661687B1 (ko) | 대화형 음성 응답 애플리케이션 구현 장치 및 방법, 머신 판독가능 매체 및 대화형 음성 응답 시스템 | |

| US7389235B2 (en) | Method and system for unified speech and graphic user interfaces | |

| US7660828B2 (en) | Systems and methods for generating markup-language based expressions from multi-modal and unimodal inputs | |

| TWI510965B (zh) | 輸入方法編輯器整合 | |

| US20090199101A1 (en) | Systems and methods for inputting graphical data into a graphical input field | |

| US20060136220A1 (en) | Controlling user interfaces with voice commands from multiple languages | |

| JP2003241880A (ja) | 制御装置 | |

| JP2004310748A (ja) | ユーザ入力に基づくデータの提示 | |

| JP2002116796A (ja) | 音声処理装置、音声処理方法及び記憶媒体 | |

| JP3476007B2 (ja) | 認識単語登録方法、音声認識方法、音声認識装置、認識単語登録のためのソフトウエア・プロダクトを格納した記憶媒体、音声認識のためのソフトウエア・プロダクトを格納した記憶媒体 | |

| JP4027269B2 (ja) | 情報処理方法及び装置 | |

| JP3542578B2 (ja) | 音声認識装置及びその方法、プログラム | |

| JP2002351652A (ja) | 音声認識操作支援システム、音声認識操作支援方法、および、音声認識操作支援プログラム | |

| JP2002259113A (ja) | 音声マクロ処理装置、その方法、そのコンピュータ・プログラムおよびそのプログラムを記録した記録媒体 | |

| WO2017122657A1 (ja) | 音声翻訳装置、音声翻訳方法、及び音声翻訳プログラム | |

| JP2007164732A (ja) | コンピュータ実行可能なプログラム、および情報処理装置 | |

| JP6022111B2 (ja) | 動作設計装置及び動作設計プログラム | |

| JP2005181358A (ja) | 音声認識合成システム | |

| JP2002175175A (ja) | 音声駆動可能なユーザインターフェイス | |

| JP2015179481A (ja) | 動作設計装置及び動作設計プログラム | |

| JP4012228B2 (ja) | 情報入力方法、情報入力装置及び記憶媒体 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20040609 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20040609 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20060317 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20060425 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20060522 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20060605 |

|

| R150 | Certificate of patent or registration of utility model |

Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20090609 Year of fee payment: 3 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20100609 Year of fee payment: 4 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20110609 Year of fee payment: 5 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120609 Year of fee payment: 6 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120609 Year of fee payment: 6 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20130609 Year of fee payment: 7 |

|

| LAPS | Cancellation because of no payment of annual fees |