JP2012146224A - 描画処理装置 - Google Patents

描画処理装置 Download PDFInfo

- Publication number

- JP2012146224A JP2012146224A JP2011005345A JP2011005345A JP2012146224A JP 2012146224 A JP2012146224 A JP 2012146224A JP 2011005345 A JP2011005345 A JP 2011005345A JP 2011005345 A JP2011005345 A JP 2011005345A JP 2012146224 A JP2012146224 A JP 2012146224A

- Authority

- JP

- Japan

- Prior art keywords

- image

- depth value

- depth

- drawing processing

- processing apparatus

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

- 238000012545 processing Methods 0.000 title claims abstract description 88

- 238000001514 detection method Methods 0.000 claims abstract description 34

- 238000012805 post-processing Methods 0.000 claims abstract description 16

- 239000002131 composite material Substances 0.000 claims abstract description 11

- 238000000034 method Methods 0.000 claims description 15

- 238000010586 diagram Methods 0.000 description 9

- 230000006870 function Effects 0.000 description 7

- 230000015572 biosynthetic process Effects 0.000 description 6

- 238000003384 imaging method Methods 0.000 description 6

- 238000003786 synthesis reaction Methods 0.000 description 6

- 230000004888 barrier function Effects 0.000 description 4

- 238000006243 chemical reaction Methods 0.000 description 4

- 239000011521 glass Substances 0.000 description 4

- 230000010365 information processing Effects 0.000 description 4

- 239000000284 extract Substances 0.000 description 2

- 230000003287 optical effect Effects 0.000 description 2

- 238000009877 rendering Methods 0.000 description 2

- 230000002194 synthesizing effect Effects 0.000 description 2

- 206010047571 Visual impairment Diseases 0.000 description 1

- 230000002708 enhancing effect Effects 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 238000004519 manufacturing process Methods 0.000 description 1

- 239000000203 mixture Substances 0.000 description 1

Images

Landscapes

- Processing Or Creating Images (AREA)

- Image Generation (AREA)

Abstract

【解決手段】基本的には,実写画像の3次元空間における対象物までの奥行き値を検出し,検出した奥行き値に基づいて,例えば,ぼけ処理や,輪郭強調処理,動き強調処理のような後処理を行う。具体的には,同一の対象物を異なる視点において撮影した複数の実写画像に基づいて奥行き値の検出を行うため,例えば実写画像の視差に基づいて奥行き値を検出できるため,奥行き値の演算がより正確になる。また,奥行き値の検出処理に際して,異なる視点の複数の実写画像を用いることにより,生成された合成画像は,両眼の視差によって立体映像を表示する立体ディスプレイに好適に表示できる。従って,より写実的で自然な合成画像を生成できる。

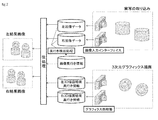

【選択図】図1

Description

本発明の描画処理装置100は,画像入力インターフェイス1と,奥行き検出部2と,グラフィックス処理部3と,後処理部4を含む。

画像入力インターフェイス1は,三次元空間における対象物の実写画像を入力するための機能を有する。

奥行き検出部2は,画像入力インターフェイス1によって入力された実写画像に基づいて,実写画像の撮影位置から対象物までの奥行き値を検出する機能を有する。

グラフィックス処理部3は,奥行き値を有するコンピュータグラフィックス画像を生成する機能を有する。

後処理部4は,奥行き検出部により検出された対象物までの奥行き値と,コンピュータグラフィックス画像が有する奥行き値に基づいて,実写画像とコンピュータグラフィックス画像の合成画像を生成するとともに,合成画像の空間表現を強調するための追加処理を行う機能を有する。

図1は,本発明の描画処理装置100の構成の例を示すブロック図である。図1に示されるように,本発明の描画処理装置100は,基本的には,画像入力インターフェイス1,奥行き検出部2,グラフィックス処理部3,後処理部4,及び画像出力インターフェイス5で構成される。また,これらの各要素によって処理された情報は,適宜システムメモリ6に格納され,システムメモリ6に格納された情報は,適宜これらの各要素によって読み出され処理される。

図2は,本発明の描画処理装置100の情報処理の例を概念的に示した図である。図2においては,2台のカメラが画像入力インターフェイス1として用いられるとともに,画像出力インターフェイス5が立体映像を表示するための立体ディスプレイに接続される例を示している。

以下,図面を参照して,描画処理装置100の構成要素について説明する。

画像入力インターフェイス1は,三次元空間における対象物の実写画像を入力する機能を有する。画像入力インターフェイス1の例は,カメラである。描画処理装置100は,画像入力インターフェイス1としてのカメラを,一台備えるものであってもよいし,複数台備えるものであってもよい。また,画像入力インターフェイス1は,一台のカメラに,複数の撮影レンズを備えるものであってもよい。

(3−2.奥行き検出部)

(3−3.グラフィックス処理部)

(3−3.グラフィックス処理部)

本発明の描画処理装置100における画像出力インターフェイス5は,一般的なディスプレイに接続されていてもよいし,例えば,複数の表示装置が連動するマルチディスプレイや,立体映像を表示するための立体ディスプレイに接続されていてもよい。また,その他,画像出力インターフェイス5は,例えば,携帯電話,ゲーム機,ナビゲーションシステム,スロットマシーンのようなコンピュータの表示装置に接続されていてもよい。

2 奥行き検出部

3 グラフィックス処理部

4 後処理部

5 画像入力インターフェイス

6 システムメモリ

31 3次元グラフィックス処理部

32 描画結果及び奥行き情報出力部

41 奥行き情報補正部

42 マスク生成部

43 画像生成・合成部

100 描画処理装置

200 立体ディスプレイ

Claims (7)

- 三次元空間における対象物の実写画像を入力するための画像入力インターフェイス(1)と,

前記画像入力インターフェイス(1)によって入力された実写画像に基づいて,前記実写画像の撮影位置から前記対象物までの奥行き値を検出する奥行き検出部(2)と,

奥行き値を有するコンピュータグラフィックス画像を生成するグラフィックス処理部(3)と,

前記奥行き検出部により検出された前記対象物までの奥行き値と,前記コンピュータグラフィックス画像が有する奥行き値に基づいて,前記実写画像と前記コンピュータグラフィックス画像の合成画像を生成するとともに,前記合成画像の空間表現を強調するための追加処理を行う後処理部(4)を含む

描画処理装置(100)。

- 前記画像入力インターフェイス(1)によって入力される実写画像は,同一の対象物を異なる視点において撮影した複数の実写画像であり,

前記奥行き検出部(2)は,前記複数の実写画像に基づいて,前記実写画像の撮影位置から前記対象物までの奥行き値を検出する

請求項1に記載の描画処理装置(100)。

- 前記後処理部(4)は,前記奥行き検出部(2)により検出された前記対象物までの奥行き値と,前記コンピュータグラフィックス画像が有する奥行き値に基づいて,マスク画像を生成する

請求項1に記載の描画処理装置(100)。

- 前記マスク画像は,少なくとも,ぼかしの強度に関する情報,エッジに関する情報,又は対象物の識別子のいずれか1つを有する

請求項3に記載の描画処理装置(100)。

- 請求項1から請求項4のいずれかに記載の描画処理装置(100)を備える

マルチディスプレイシステム。

- 請求項1から請求項4のいずれかに記載の描画処理装置(100)を備える

立体ディスプレイシステム。

- 請求項1から請求項4のいずれかに記載の描画処理装置(100)を備える

コンピュータ。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011005345A JP5689693B2 (ja) | 2011-01-13 | 2011-01-13 | 描画処理装置 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011005345A JP5689693B2 (ja) | 2011-01-13 | 2011-01-13 | 描画処理装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2012146224A true JP2012146224A (ja) | 2012-08-02 |

| JP5689693B2 JP5689693B2 (ja) | 2015-03-25 |

Family

ID=46789712

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2011005345A Active JP5689693B2 (ja) | 2011-01-13 | 2011-01-13 | 描画処理装置 |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP5689693B2 (ja) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20180083245A (ko) * | 2017-01-12 | 2018-07-20 | 한국전자통신연구원 | 멀티 카메라의 정보 처리 장치 및 방법 |

| WO2019082794A1 (ja) * | 2017-10-25 | 2019-05-02 | 株式会社ソニー・インタラクティブエンタテインメント | 画像生成装置、画像生成システム、画像生成方法、およびプログラム |

Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0344776A (ja) * | 1989-07-12 | 1991-02-26 | Fujitsu Ltd | ぼかし画像合成処理方法 |

| JPH08161532A (ja) * | 1994-12-07 | 1996-06-21 | Nec Corp | 3次元描画装置および3次元描画方法 |

| JPH09319896A (ja) * | 1996-03-25 | 1997-12-12 | Hitachi Ltd | 3次元画像作成装置 |

| JP2000354257A (ja) * | 1999-06-10 | 2000-12-19 | Sony Corp | 画像処理装置、画像処理方法、およびプログラム提供媒体 |

| JP2001175884A (ja) * | 1999-12-17 | 2001-06-29 | Namco Ltd | 画像生成システム及び情報記憶媒体 |

| JP2002063591A (ja) * | 2000-06-05 | 2002-02-28 | Namco Ltd | ゲームシステム、プログラム及び情報記憶媒体 |

| JP2002251634A (ja) * | 2001-02-23 | 2002-09-06 | Mixed Reality Systems Laboratory Inc | 画像処理装置及びその方法並びにプログラムコード、記憶媒体 |

| JP2010541053A (ja) * | 2007-09-25 | 2010-12-24 | メタイオ ゲゼルシャフト ミット ベシュレンクテル ハフツング | 現実環境内にバーチャルオブジェクトを描写する方法および装置 |

-

2011

- 2011-01-13 JP JP2011005345A patent/JP5689693B2/ja active Active

Patent Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0344776A (ja) * | 1989-07-12 | 1991-02-26 | Fujitsu Ltd | ぼかし画像合成処理方法 |

| JPH08161532A (ja) * | 1994-12-07 | 1996-06-21 | Nec Corp | 3次元描画装置および3次元描画方法 |

| JPH09319896A (ja) * | 1996-03-25 | 1997-12-12 | Hitachi Ltd | 3次元画像作成装置 |

| JP2000354257A (ja) * | 1999-06-10 | 2000-12-19 | Sony Corp | 画像処理装置、画像処理方法、およびプログラム提供媒体 |

| JP2001175884A (ja) * | 1999-12-17 | 2001-06-29 | Namco Ltd | 画像生成システム及び情報記憶媒体 |

| JP2002063591A (ja) * | 2000-06-05 | 2002-02-28 | Namco Ltd | ゲームシステム、プログラム及び情報記憶媒体 |

| JP2002251634A (ja) * | 2001-02-23 | 2002-09-06 | Mixed Reality Systems Laboratory Inc | 画像処理装置及びその方法並びにプログラムコード、記憶媒体 |

| JP2010541053A (ja) * | 2007-09-25 | 2010-12-24 | メタイオ ゲゼルシャフト ミット ベシュレンクテル ハフツング | 現実環境内にバーチャルオブジェクトを描写する方法および装置 |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20180083245A (ko) * | 2017-01-12 | 2018-07-20 | 한국전자통신연구원 | 멀티 카메라의 정보 처리 장치 및 방법 |

| KR102430726B1 (ko) * | 2017-01-12 | 2022-08-10 | 한국전자통신연구원 | 멀티 카메라의 정보 처리 장치 및 방법 |

| WO2019082794A1 (ja) * | 2017-10-25 | 2019-05-02 | 株式会社ソニー・インタラクティブエンタテインメント | 画像生成装置、画像生成システム、画像生成方法、およびプログラム |

| US11132846B2 (en) | 2017-10-25 | 2021-09-28 | Sony Interactive Entertainment Inc. | Image generation device, image generation system, image generation method, and program for producing an augmented reality image |

Also Published As

| Publication number | Publication date |

|---|---|

| JP5689693B2 (ja) | 2015-03-25 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5679978B2 (ja) | 立体視用画像位置合わせ装置、立体視用画像位置合わせ方法、及びそのプログラム | |

| JP4657313B2 (ja) | 立体画像表示装置および方法並びにプログラム | |

| US20130257908A1 (en) | Object display device, object display method, and object display program | |

| EP3073733A1 (en) | Method for generating picture and twin-lens device | |

| US9619886B2 (en) | Image processing apparatus, imaging apparatus, image processing method and program | |

| JP5755571B2 (ja) | 仮想視点画像生成装置、仮想視点画像生成方法、制御プログラム、記録媒体、および立体表示装置 | |

| WO2018032841A1 (zh) | 绘制三维图像的方法及其设备、系统 | |

| JP4819834B2 (ja) | 立体映像処理装置及び立体映像処理方法 | |

| US20150029311A1 (en) | Image processing method and image processing apparatus | |

| JP2009175866A (ja) | 立体像生成装置、その方法およびそのプログラム | |

| CN110969706B (zh) | 增强现实设备及其图像处理方法、系统以及存储介质 | |

| US8908012B2 (en) | Electronic device and method for creating three-dimensional image | |

| JP6409769B2 (ja) | 3次元形状計測装置、3次元形状計測方法及び3次元形状計測プログラム | |

| JP5689693B2 (ja) | 描画処理装置 | |

| TWI504936B (zh) | 影像處理裝置 | |

| KR20110025083A (ko) | 입체 영상 시스템에서 입체 영상 디스플레이 장치 및 방법 | |

| JP2011217229A (ja) | 撮像装置および表示方法 | |

| EP2750392A1 (en) | Visually-assisted stereo acquisition from a single camera | |

| WO2012014695A1 (ja) | 立体撮像装置およびその撮像方法 | |

| JP2005174148A (ja) | 撮像装置及び方法、撮像システム | |

| JP5871113B2 (ja) | 立体画像生成装置、立体画像生成方法及び立体画像生成プログラム | |

| JP5351878B2 (ja) | 立体画像表示装置および方法並びにプログラム | |

| JP2019114143A (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| JP5981460B2 (ja) | 立体シーンにおける焦点面の位置を管理するためのデバイスおよび方法 | |

| TWI382267B (zh) | 自動景深捕捉系統及自動景深捕捉方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20131101 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20140804 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20140819 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20141009 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20141104 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20141104 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20150113 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20150129 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 5689693 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |