JP2012133729A - 情報処理装置、情報処理方法、およびプログラム - Google Patents

情報処理装置、情報処理方法、およびプログラム Download PDFInfo

- Publication number

- JP2012133729A JP2012133729A JP2010287451A JP2010287451A JP2012133729A JP 2012133729 A JP2012133729 A JP 2012133729A JP 2010287451 A JP2010287451 A JP 2010287451A JP 2010287451 A JP2010287451 A JP 2010287451A JP 2012133729 A JP2012133729 A JP 2012133729A

- Authority

- JP

- Japan

- Prior art keywords

- input

- event

- state

- detected

- mode

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

- G06F3/0487—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser

- G06F3/0488—Interaction techniques based on graphical user interfaces [GUI] using specific features provided by the input device, e.g. functions controlled by the rotation of a mouse with dual sensing arrangements, or of the nature of the input device, e.g. tap gestures based on pressure sensed by a digitiser using a touch-screen or digitiser, e.g. input of commands through traced gestures

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/041—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means

- G06F3/0416—Control or interface arrangements specially adapted for digitisers

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/03—Arrangements for converting the position or the displacement of a member into a coded form

- G06F3/041—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means

- G06F3/044—Digitisers, e.g. for touch screens or touch pads, characterised by the transducing means by capacitive means

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F2203/00—Indexing scheme relating to G06F3/00 - G06F3/048

- G06F2203/041—Indexing scheme relating to G06F3/041 - G06F3/045

- G06F2203/04108—Touchless 2D- digitiser, i.e. digitiser detecting the X/Y position of the input means, finger or stylus, also when it does not touch, but is proximate to the digitiser's interaction surface without distance measurement in the Z direction

Abstract

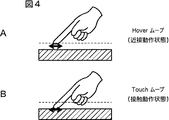

【解決手段】タッチパネルから出力された信号により表されるユーザの指までの距離が、ディスプレイの表面に触れてはいないが閾値th1より近い場合、Hoverイベントが検出され、ユーザの指がディスプレイ2に触れている場合、Touchイベントが検出される。手袋操作モードが設定されている場合、HoverイベントよりTouchイベントが優先され、Hoverイベントの検出領域においてもTouchイベントが検出される。手袋操作モードの設定は、本体の設定画面からユーザが意図的に行うことが可能とされる。本発明は、タッチパネルを有する装置に適用することができる。

【選択図】図3

Description

[情報処理装置の外観構成]

図1は、本発明の一実施形態に係る情報処理装置1の背面側の外観図である。

図3は、情報処理装置1において検出可能なイベントの例を示す図である。

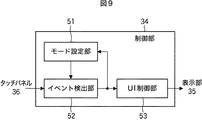

図8は、情報処理装置1の内部の構成例を示すブロック図である。

ここで、情報処理装置1の動作について説明する。はじめに、図12のフローチャートを参照して、操作モードを切り替える情報処理装置1の処理について説明する。図12の処理は、例えば、ユーザが情報処理装置1の電源をオンとし、メニュー画面の表示を指示したときに開始される。

以上においては、情報処理装置1において検出可能なイベントがTouchイベントとHoverイベントであるものとしたが、他のイベントをさらに検出可能にしてもよい。情報処理装置1の構成は、図8、図9を参照して説明した構成と同じである。

タッチパネル36が、同時に2点以上の多点のタッチ操作が可能ないわゆるマルチタッチに対応したタッチパネルである場合、複数のイベントが同時に以上のようにして検出されるようにしてもよい。マルチタッチでの操作が可能なモードであるマルチタッチモードと、シングルタッチでの操作が可能なモードであるシングルタッチモードをユーザが切り替えることができるようにしてもよい。

上述した一連の処理は、ハードウェアにより実行することもできるし、ソフトウェアにより実行することもできる。一連の処理をソフトウェアにより実行する場合には、そのソフトウェアを構成するプログラムが、専用のハードウェアに組み込まれているコンピュータ、または汎用のパーソナルコンピュータなどに、プログラム記録媒体からインストールされる。

Claims (6)

- 装置に対する操作の方法に関する操作モードとして、複数のモードの中から所定のモードを設定する設定手段と、

所定の面を基準として、前記所定の面の各位置における、近接された物体までの距離に応じた信号である検出信号を出力する物体検出手段と、

前記操作モードとして第1のモードが設定されている場合、前記検出信号により表される前記物体の状態が前記所定の面に触れている状態であるときと所定の距離より近い状態であるときに第1の入力が行われたことを検出し、第2のモードが設定されている場合、前記検出信号により表される前記物体の状態が前記所定の面に触れている状態であるときには前記第1の入力が行われたことを、前記所定の距離より近い状態であるときには第2の入力が行われたことをそれぞれ検出する入力検出手段と、

前記第1の入力が行われたことが検出された場合、前記第1の入力に応じた処理を行い、前記第2の入力が行われたことが検出された場合、前記第2の入力に応じた処理を行う制御手段と

を備える情報処理装置。 - 前記設定手段は、ユーザによる操作に応じて前記操作モードを設定する

請求項1に記載の情報処理装置。 - 前記入力検出手段は、さらに、前記第1のモードが設定されている場合と前記第2のモードが設定されている場合のいずれの場合においても、前記検出信号により表される前記物体の状態が、前記所定の距離より遠く、閾値となる他の距離より近い状態であるときに第3の入力が行われたことを検出する

請求項1に記載の情報処理装置。 - 前記制御手段は、前記第2の入力に応じた処理として、前記第2の入力が行われたことが検出された前記所定の面上の位置に所定の画像を表示させ続ける処理を行う

請求項1に記載の情報処理装置。 - 装置に対する操作の方法に関する操作モードとして、複数のモードの中から所定のモードを設定し、

前記操作モードとして第1のモードを設定している場合、物体検出手段から出力された、所定の面を基準として、前記所定の面の各位置における、近接された物体までの距離に応じた信号である検出信号により表される前記物体の状態が前記所定の面に触れている状態であるときと所定の距離より近い状態であるときに第1の入力が行われたことを検出し、第2のモードを設定している場合、前記検出信号により表される前記物体の状態が前記所定の面に触れている状態であるときには前記第1の入力が行われたことを、前記所定の距離より近い状態であるときには第2の入力が行われたことをそれぞれ検出し、

前記第1の入力が行われたことを検出した場合、前記第1の入力に応じた処理を行い、前記第2の入力が行われたことを検出した場合、前記第2の入力に応じた処理を行う

ステップを含む情報処理方法。 - 装置に対する操作の方法に関する操作モードとして、複数のモードの中から所定のモードを設定し、

前記操作モードとして第1のモードを設定している場合、物体検出手段から出力された、所定の面を基準として、前記所定の面の各位置における、近接された物体までの距離に応じた信号である検出信号により表される前記物体の状態が前記所定の面に触れている状態であるときと所定の距離より近い状態であるときに第1の入力が行われたことを検出し、第2のモードを設定している場合、前記検出信号により表される前記物体の状態が前記所定の面に触れている状態であるときには前記第1の入力が行われたことを、前記所定の距離より近い状態であるときには第2の入力が行われたことをそれぞれ検出し、

前記第1の入力が行われたことを検出した場合、前記第1の入力に応じた処理を行い、前記第2の入力が行われたことを検出した場合、前記第2の入力に応じた処理を行う

ステップを含む処理をコンピュータに実行させるプログラム。

Priority Applications (6)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2010287451A JP2012133729A (ja) | 2010-12-24 | 2010-12-24 | 情報処理装置、情報処理方法、およびプログラム |

| US13/280,388 US9250790B2 (en) | 2010-12-24 | 2011-10-25 | Information processing device, method of processing information, and computer program storage device |

| TW100145544A TW201241690A (en) | 2010-12-24 | 2011-12-09 | Information processing device, method of processing information, and computer program storage device |

| EP11192870A EP2469394A1 (en) | 2010-12-24 | 2011-12-09 | Information Processing Device, Method of Processing Information, and Computer Program Storage Device |

| CN2011104243738A CN102541379A (zh) | 2010-12-24 | 2011-12-16 | 信息处理装置、处理信息的方法和计算机程序存储装置 |

| KR1020110136188A KR20120073104A (ko) | 2010-12-24 | 2011-12-16 | 정보 처리 장치, 정보 처리 방법 및 컴퓨터 프로그램 기억 장치 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2010287451A JP2012133729A (ja) | 2010-12-24 | 2010-12-24 | 情報処理装置、情報処理方法、およびプログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2012133729A true JP2012133729A (ja) | 2012-07-12 |

Family

ID=45418383

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2010287451A Pending JP2012133729A (ja) | 2010-12-24 | 2010-12-24 | 情報処理装置、情報処理方法、およびプログラム |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US9250790B2 (ja) |

| EP (1) | EP2469394A1 (ja) |

| JP (1) | JP2012133729A (ja) |

| KR (1) | KR20120073104A (ja) |

| CN (1) | CN102541379A (ja) |

| TW (1) | TW201241690A (ja) |

Cited By (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2013161170A1 (ja) * | 2012-04-27 | 2013-10-31 | パナソニック株式会社 | 入力装置、入力支援方法及びプログラム |

| WO2014037981A1 (ja) * | 2012-09-07 | 2014-03-13 | Necカシオモバイルコミュニケーションズ株式会社 | 携帯端末装置、及び携帯端末装置の制御方法 |

| JP2014059863A (ja) * | 2012-08-23 | 2014-04-03 | Denso Corp | 操作デバイス |

| JP2014164755A (ja) * | 2013-02-22 | 2014-09-08 | Samsung Electronics Co Ltd | センサを用いる近接動作認識装置及びその装置を用いた方法 |

| JP2014222391A (ja) * | 2013-05-13 | 2014-11-27 | 株式会社Nttドコモ | 電子機器、軌跡補正方法、プログラム |

| JP2016157303A (ja) * | 2015-02-25 | 2016-09-01 | 京セラ株式会社 | 電子機器 |

| US10120452B2 (en) | 2015-01-09 | 2018-11-06 | Canon Kabushiki Kaisha | Information processing apparatus for recognizing operation input by gesture of object and control method thereof |

Families Citing this family (27)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9594446B2 (en) * | 2011-12-19 | 2017-03-14 | Nec Corporation | Information processing device that determines operational mode based on user's touch |

| US20130244730A1 (en) * | 2012-03-06 | 2013-09-19 | Industry-University Cooperation Foundation Hanyang University | User terminal capable of sharing image and method for controlling the same |

| KR102051585B1 (ko) * | 2012-08-27 | 2019-12-17 | 삼성전자주식회사 | 멀티 터치를 이용한 핸드 라이팅 기능을 갖는 전자 장치 및 제어 방법 |

| WO2014041732A1 (ja) * | 2012-09-13 | 2014-03-20 | パナソニック株式会社 | 携帯電子機器 |

| JP5565598B1 (ja) * | 2013-02-01 | 2014-08-06 | パナソニック インテレクチュアル プロパティ コーポレーション オブ アメリカ | 電子機器、入力処理方法、およびプログラム |

| US10394434B2 (en) | 2013-02-22 | 2019-08-27 | Samsung Electronics Co., Ltd. | Apparatus and method for recognizing proximity motion using sensors |

| KR20140106097A (ko) * | 2013-02-25 | 2014-09-03 | 삼성전자주식회사 | 전자 장치에서 터치 입력 방식을 결정하기 위한 장치 및 방법 |

| KR102091028B1 (ko) * | 2013-03-14 | 2020-04-14 | 삼성전자 주식회사 | 사용자 기기의 오브젝트 운용 방법 및 장치 |

| US9195332B2 (en) * | 2013-05-23 | 2015-11-24 | Nokia Technologies Oy | Apparatus with deformable flexible user interface area and adjustable hover input region and associated methods |

| CN104345999B (zh) * | 2013-07-24 | 2017-12-22 | 帝晶光电(深圳)有限公司 | 触摸识别方法 |

| WO2014135067A1 (zh) * | 2013-10-22 | 2014-09-12 | 中兴通讯股份有限公司 | 模式切换方法及装置 |

| KR102206053B1 (ko) * | 2013-11-18 | 2021-01-21 | 삼성전자주식회사 | 입력 도구에 따라 입력 모드를 변경하는 전자 장치 및 방법 |

| KR102186393B1 (ko) * | 2014-01-02 | 2020-12-03 | 삼성전자주식회사 | 입력 처리 방법 및 그 전자 장치 |

| CN103870195B (zh) * | 2014-03-03 | 2018-04-27 | 联想(北京)有限公司 | 一种信息提示方法及电子设备 |

| US20150277609A1 (en) * | 2014-04-01 | 2015-10-01 | Samsung Electronics Co., Ltd. | Touch data segmentation method of touch controller |

| US9690417B2 (en) | 2014-05-21 | 2017-06-27 | Apple Inc. | Glove touch detection |

| JP6360367B2 (ja) * | 2014-06-26 | 2018-07-18 | 京セラ株式会社 | 携帯電子機器、携帯電子機器の制御方法およびプログラム |

| EP2998840B1 (en) * | 2014-09-19 | 2023-08-30 | Kabushiki Kaisha Tokai Rika Denki Seisakusho | Capacitive touch sensor device and controller |

| CN106484199B (zh) * | 2015-08-31 | 2019-08-06 | 小米科技有限责任公司 | 门限设置方法及装置 |

| JP6742730B2 (ja) * | 2016-01-05 | 2020-08-19 | キヤノン株式会社 | 電子機器及びその制御方法 |

| US10242710B2 (en) * | 2016-04-07 | 2019-03-26 | Intel Corporation | Automatic cinemagraph |

| CN106569649A (zh) * | 2016-10-31 | 2017-04-19 | 努比亚技术有限公司 | 智能设备及智能设备控制方法 |

| CN106569648A (zh) * | 2016-10-31 | 2017-04-19 | 努比亚技术有限公司 | 移动设备及移动设备控制方法 |

| CN106569647A (zh) * | 2016-10-31 | 2017-04-19 | 努比亚技术有限公司 | 一种移动终端及移动终端控制方法 |

| CN108132729A (zh) * | 2017-12-19 | 2018-06-08 | 广州视源电子科技股份有限公司 | 触摸信号的处理方法、装置、及电子设备和存储介质 |

| US10963095B1 (en) | 2019-09-27 | 2021-03-30 | Apple Inc. | Glove touch detection |

| TWI718886B (zh) * | 2020-03-03 | 2021-02-11 | 紘康科技股份有限公司 | 電容式觸控面板的多模式操作方法 |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0713676A (ja) * | 1993-06-28 | 1995-01-17 | Sony Corp | 手書き情報入力装置 |

| JP2006171854A (ja) * | 2004-12-13 | 2006-06-29 | Canon Inc | 座標入力装置、座標入力方法、プログラムおよび記憶媒体 |

| JP2008505379A (ja) * | 2004-06-29 | 2008-02-21 | コーニンクレッカ フィリップス エレクトロニクス エヌ ヴィ | 3次元タッチ型インタラクションにおけるタッチダウン型フィードフォワード |

| JP2009003575A (ja) * | 2007-06-19 | 2009-01-08 | Canon Inc | 座標入力装置、座標検出方法、及びコンピュータプログラム |

Family Cites Families (15)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4419992B2 (ja) | 2006-07-31 | 2010-02-24 | 三菱自動車工業株式会社 | タッチパネル装置 |

| US8284165B2 (en) * | 2006-10-13 | 2012-10-09 | Sony Corporation | Information display apparatus with proximity detection performance and information display method using the same |

| KR101481557B1 (ko) * | 2008-03-26 | 2015-01-13 | 엘지전자 주식회사 | 단말기 및 그 제어 방법 |

| US9274681B2 (en) | 2008-03-26 | 2016-03-01 | Lg Electronics Inc. | Terminal and method of controlling the same |

| US8289289B2 (en) * | 2008-04-03 | 2012-10-16 | N-trig, Ltd. | Multi-touch and single touch detection |

| KR20100010860A (ko) * | 2008-07-23 | 2010-02-02 | 엘지전자 주식회사 | 이동 단말기 및 그의 이벤트 제어방법 |

| US9658765B2 (en) * | 2008-07-31 | 2017-05-23 | Northrop Grumman Systems Corporation | Image magnification system for computer interface |

| US8516397B2 (en) | 2008-10-27 | 2013-08-20 | Verizon Patent And Licensing Inc. | Proximity interface apparatuses, systems, and methods |

| JP5287403B2 (ja) * | 2009-03-19 | 2013-09-11 | ソニー株式会社 | 情報処理装置、情報処理方法、およびプログラム |

| KR101791540B1 (ko) * | 2009-06-08 | 2017-10-30 | 엘지전자 주식회사 | 이동 단말기 및 이동 단말기의 정보 표시 방법 |

| JP5487743B2 (ja) | 2009-06-12 | 2014-05-07 | 日産自動車株式会社 | 薄型電池及びその製造方法 |

| US9152317B2 (en) * | 2009-08-14 | 2015-10-06 | Microsoft Technology Licensing, Llc | Manipulation of graphical elements via gestures |

| KR101657215B1 (ko) * | 2009-09-08 | 2016-09-19 | 삼성디스플레이 주식회사 | 터치 패널 장치를 포함하는 표시 장치 및 커플링 노이즈 제거 방법 |

| CN201540555U (zh) * | 2009-11-19 | 2010-08-04 | 英业达股份有限公司 | 触控面板的输入装置 |

| US20110175827A1 (en) * | 2009-12-04 | 2011-07-21 | Adam Bogue | Filtering Input Streams in a Multi-Touch System |

-

2010

- 2010-12-24 JP JP2010287451A patent/JP2012133729A/ja active Pending

-

2011

- 2011-10-25 US US13/280,388 patent/US9250790B2/en active Active

- 2011-12-09 EP EP11192870A patent/EP2469394A1/en not_active Withdrawn

- 2011-12-09 TW TW100145544A patent/TW201241690A/zh unknown

- 2011-12-16 CN CN2011104243738A patent/CN102541379A/zh active Pending

- 2011-12-16 KR KR1020110136188A patent/KR20120073104A/ko not_active Application Discontinuation

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH0713676A (ja) * | 1993-06-28 | 1995-01-17 | Sony Corp | 手書き情報入力装置 |

| JP2008505379A (ja) * | 2004-06-29 | 2008-02-21 | コーニンクレッカ フィリップス エレクトロニクス エヌ ヴィ | 3次元タッチ型インタラクションにおけるタッチダウン型フィードフォワード |

| JP2006171854A (ja) * | 2004-12-13 | 2006-06-29 | Canon Inc | 座標入力装置、座標入力方法、プログラムおよび記憶媒体 |

| JP2009003575A (ja) * | 2007-06-19 | 2009-01-08 | Canon Inc | 座標入力装置、座標検出方法、及びコンピュータプログラム |

Cited By (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2013161170A1 (ja) * | 2012-04-27 | 2013-10-31 | パナソニック株式会社 | 入力装置、入力支援方法及びプログラム |

| JP2014059863A (ja) * | 2012-08-23 | 2014-04-03 | Denso Corp | 操作デバイス |

| WO2014037981A1 (ja) * | 2012-09-07 | 2014-03-13 | Necカシオモバイルコミュニケーションズ株式会社 | 携帯端末装置、及び携帯端末装置の制御方法 |

| JP2014164755A (ja) * | 2013-02-22 | 2014-09-08 | Samsung Electronics Co Ltd | センサを用いる近接動作認識装置及びその装置を用いた方法 |

| JP2014222391A (ja) * | 2013-05-13 | 2014-11-27 | 株式会社Nttドコモ | 電子機器、軌跡補正方法、プログラム |

| US10120452B2 (en) | 2015-01-09 | 2018-11-06 | Canon Kabushiki Kaisha | Information processing apparatus for recognizing operation input by gesture of object and control method thereof |

| JP2016157303A (ja) * | 2015-02-25 | 2016-09-01 | 京セラ株式会社 | 電子機器 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20120162105A1 (en) | 2012-06-28 |

| KR20120073104A (ko) | 2012-07-04 |

| CN102541379A (zh) | 2012-07-04 |

| TW201241690A (en) | 2012-10-16 |

| US9250790B2 (en) | 2016-02-02 |

| EP2469394A1 (en) | 2012-06-27 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2012133729A (ja) | 情報処理装置、情報処理方法、およびプログラム | |

| US10070044B2 (en) | Electronic apparatus, image sensing apparatus, control method and storage medium for multiple types of user interfaces | |

| US9635267B2 (en) | Method and mobile terminal for implementing preview control | |

| KR101925485B1 (ko) | 근접 터치 감지 장치 및 방법 | |

| US10551987B2 (en) | Multiple screen mode in mobile terminal | |

| US9594945B2 (en) | Method and apparatus for protecting eyesight | |

| US9939958B2 (en) | Touch sensitive surface with recessed surface feature for an electronic device | |

| JP5743847B2 (ja) | 携帯端末および低感度領域設定プログラム | |

| US10073585B2 (en) | Electronic device, storage medium and method for operating electronic device | |

| WO2010113597A1 (ja) | 情報処理装置、情報処理方法および情報処理プログラム | |

| US9519365B2 (en) | Display control apparatus and control method for the same | |

| JP5827109B2 (ja) | 装置、方法、及びプログラム | |

| CN104572322A (zh) | 一种终端屏幕操作的方法 | |

| JP2014052852A (ja) | 情報処理装置 | |

| CN108920069B (zh) | 一种触控操作方法、装置、移动终端和存储介质 | |

| KR20130097331A (ko) | 터치 스크린을 구비하는 전자기기에서 객체를 선택하기 위한 장치 및 방법 | |

| CN104572071A (zh) | 一种终端 | |

| CN106293184A (zh) | 可侧边触控的终端及其触控方法 | |

| CN105278753A (zh) | 触控响应方法及装置 | |

| CN106325574B (zh) | 在触摸屏上监测触摸的方法及装置 | |

| CN105468194B (zh) | 触控响应方法及装置 | |

| KR102197912B1 (ko) | 제스처 인식에 따른 기능 실행 방법, 장치 및 기록매체 | |

| WO2012118147A1 (ja) | 携帯端末装置、プログラムおよび携帯端末装置の制御方法 | |

| JP5969320B2 (ja) | 携帯端末装置 | |

| JP6457170B2 (ja) | 携帯電子機器 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20131206 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20140710 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20140724 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20140825 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20150122 |