JP2009044463A - 電子カメラ及び被写界像再生装置 - Google Patents

電子カメラ及び被写界像再生装置 Download PDFInfo

- Publication number

- JP2009044463A JP2009044463A JP2007207281A JP2007207281A JP2009044463A JP 2009044463 A JP2009044463 A JP 2009044463A JP 2007207281 A JP2007207281 A JP 2007207281A JP 2007207281 A JP2007207281 A JP 2007207281A JP 2009044463 A JP2009044463 A JP 2009044463A

- Authority

- JP

- Japan

- Prior art keywords

- image

- face

- area

- scene image

- reproducing

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/161—Detection; Localisation; Normalisation

- G06V40/166—Detection; Localisation; Normalisation using acquisition arrangements

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/10—Image acquisition

- G06V10/12—Details of acquisition arrangements; Constructional details thereof

- G06V10/14—Optical characteristics of the device performing the acquisition or on the illumination arrangements

- G06V10/147—Details of sensors, e.g. sensor lenses

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/61—Control of cameras or camera modules based on recognised objects

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/61—Control of cameras or camera modules based on recognised objects

- H04N23/611—Control of cameras or camera modules based on recognised objects where the recognised objects include parts of the human body

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/63—Control of cameras or camera modules by using electronic viewfinders

- H04N23/633—Control of cameras or camera modules by using electronic viewfinders for displaying additional information relating to control or operation of the camera

- H04N23/635—Region indicators; Field of view indicators

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/69—Control of means for changing angle of the field of view, e.g. optical zoom objectives or electronic zooming

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/70—Circuitry for compensating brightness variation in the scene

- H04N23/72—Combination of two or more compensation controls

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/67—Focus control based on electronic image sensor signals

- H04N23/673—Focus control based on electronic image sensor signals based on contrast or high frequency components of image signals, e.g. hill climbing method

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Theoretical Computer Science (AREA)

- General Health & Medical Sciences (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Health & Medical Sciences (AREA)

- Oral & Maxillofacial Surgery (AREA)

- Human Computer Interaction (AREA)

- Vascular Medicine (AREA)

- Studio Devices (AREA)

- Television Signal Processing For Recording (AREA)

Abstract

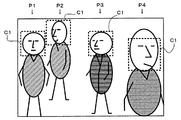

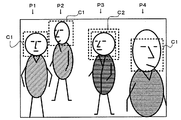

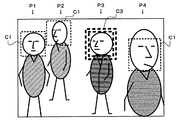

【解決手段】被写界を捉える撮像面を有し、被写界像を生成する撮像手段、撮像手段によって生成される被写界像内の特定位置を指定する指定手段、撮像手段によって生成された被写界像を、指定手段によって指定された特定位置の位置情報と共に記録する記録手段、および記録手段によって記録された被写界像を記録手段によって記録された位置情報を用いて再生を行う再生手段を具える、電子カメラである。

【選択図】図1

Description

ステップS63では、顔探索処理において、顔が検出されたことを示す顔検出フラグの値を、顔が検出されていないことを示す値である「0」に初期化する。

なお、当該位置情報は、第1の実施例とは異なり、JPEGデータの画素数に応じた値を有する位置情報であり、第1の実施例のように、値を換算する必要はない。

特徴画像として顔画像を用いるのではなく、サッカーボールや小動物の画像を特徴画像として探索し、被写界像内の特定位置を指定するようにしてもよい。

特定位置の指定は顔検出等の画像認識処理を用いるのでなく、AF機能を用いて検出された最も近い被写体の位置、最も遠い被写体の位置、画角中央に最も近い被写体の位置や、撮影時にタッチパネル等のポインティングデバイスで使用者が直接指定した位置としてもよい。

被写界像は圧縮して記録されている必要はなく、非圧縮で記録されていてもよい。

位置情報としては画素数を用いるのではなく、モニタ上での比率(縦方向にX%、横方向にY%の位置)で特定してもよい。

被写界像は静止画に限らず動画や動画の一部、例えばMPEG画像データ内のIピクチャ(フレーム内符号化画像)であってもよい。

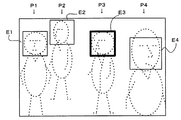

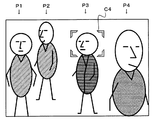

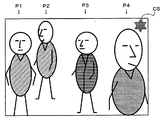

図26に示すように、1つの被写界像に対し複数個の当該位置情報を、記録媒体に記録して利用するようにしてもよい。再生時に、どの位置情報を用いて再生するかを選択するようにすればよい。再生時に用いる位置情報は1つに限らず、複数の位置情報を用いての再生、例えば複数の位置情報によって囲まれた領域の拡大再生やトリミング再生をするようにしてもよい。

12 光学レンズ

14 イメージセンサ

24 AE/AF評価回路

28 SDRAM

32 LCDモニタ

34 キャラクタジェネレータ

40 記録媒体

42 CPU

46 キー入力装置

48 フラッシュメモリ

100 画像再生装置

128 SDRAM

132 LCDモニタ

134 キャラクタジェネレータ

140 記録媒体

142 CPU

146 キー入力装置

148 フラッシュメモリ

Claims (7)

- 被写界を捉える撮像面を有し、被写界像を生成する撮像手段、

前記撮像手段によって生成される被写界像内の特定位置を指定する指定手段、

前記撮像手段によって生成された被写界像を、前記指定手段によって指定された特定位置の位置情報と共に記録する記録手段、および

前記記録手段によって記録された被写界像を前記記録手段によって記録された位置情報を用いて再生を行う再生手段を具える、電子カメラ。 - 前記撮像手段によって生成された被写界像に含まれる特徴画像を探索する探索手段をさらに具え、前記指定手段は前記探索手段によって検知された特徴画像の位置に基づいて特定位置を指定することを特徴とする請求項1記載の電子カメラ。

- 前記指定手段によって指定された特定位置の被写界像に基づいて前記撮像手段の撮影条件を調整する調整手段をさらに具え、前記記録手段は前記調整手段によって調整された撮像条件で作成された被写界像を記録することを特徴とする請求項1記載の電子カメラ。

- 前記撮影条件は前記撮像手段の焦点距離であることを特徴とする請求項3記載の電子カメラ。

- 前記再生手段は、前記記録手段によって記録された位置情報を用いて特定される位置を中心に被写界像を拡大再生することを特徴とする請求項1記載の電子カメラ。

- 被写界像内の特定位置を示す位置情報と当該被写界像と共に記録された記録媒体から前記被写界像を再生する被写界像再生装置であって、前記被写界像を前記位置情報を用いて再生を行う再生手段を具える、被写界像再生装置。

- 前記再生手段は、前記位置情報を用いて特定される位置を中心に被写界像を拡大再生することを特徴とする請求項6記載の被写界像再生装置。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2007207281A JP2009044463A (ja) | 2007-08-08 | 2007-08-08 | 電子カメラ及び被写界像再生装置 |

| US12/186,818 US8081804B2 (en) | 2007-08-08 | 2008-08-06 | Electronic camera and object scene image reproducing apparatus |

| CN2008101298046A CN101365063B (zh) | 2007-08-08 | 2008-08-07 | 电子照相机以及视场图像再现装置 |

| US13/298,509 US20120133798A1 (en) | 2007-08-08 | 2011-11-17 | Electronic camera and object scene image reproducing apparatus |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2007207281A JP2009044463A (ja) | 2007-08-08 | 2007-08-08 | 電子カメラ及び被写界像再生装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2009044463A true JP2009044463A (ja) | 2009-02-26 |

| JP2009044463A5 JP2009044463A5 (ja) | 2010-04-02 |

Family

ID=40346607

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2007207281A Pending JP2009044463A (ja) | 2007-08-08 | 2007-08-08 | 電子カメラ及び被写界像再生装置 |

Country Status (3)

| Country | Link |

|---|---|

| US (2) | US8081804B2 (ja) |

| JP (1) | JP2009044463A (ja) |

| CN (1) | CN101365063B (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2012231415A (ja) * | 2011-04-27 | 2012-11-22 | Ricoh Co Ltd | 撮像装置、画像表示装置および画像表示方法 |

Families Citing this family (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5187139B2 (ja) * | 2008-10-30 | 2013-04-24 | セイコーエプソン株式会社 | 画像処理装置およびプログラム |

| US8681236B2 (en) * | 2009-06-18 | 2014-03-25 | Samsung Electronics Co., Ltd. | Apparatus and method for reducing shutter lag of a digital camera |

| JP2012095236A (ja) * | 2010-10-28 | 2012-05-17 | Sanyo Electric Co Ltd | 撮像装置 |

| JP6114266B2 (ja) * | 2011-06-29 | 2017-04-12 | コーニンクレッカ フィリップス エヌ ヴェKoninklijke Philips N.V. | 画像をズームするシステム及び方法 |

| JP6295534B2 (ja) * | 2013-07-29 | 2018-03-20 | オムロン株式会社 | プログラマブル表示器、制御方法、およびプログラム |

| JP6512810B2 (ja) * | 2014-12-11 | 2019-05-15 | キヤノン株式会社 | 撮像装置および制御方法とプログラム |

| US10049273B2 (en) * | 2015-02-24 | 2018-08-14 | Kabushiki Kaisha Toshiba | Image recognition apparatus, image recognition system, and image recognition method |

| KR20190094677A (ko) * | 2018-02-05 | 2019-08-14 | 삼성전자주식회사 | 카메라 구동 방식 변경 기반의 음성 및 얼굴 인식 장치 및 방법 |

Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2005318009A (ja) * | 2004-04-26 | 2005-11-10 | Nikon Corp | 電子カメラおよび画像処理プログラム |

| JP2006109005A (ja) * | 2004-10-04 | 2006-04-20 | Canon Inc | 画像出力装置および撮像装置 |

| JP2006295888A (ja) * | 2005-03-17 | 2006-10-26 | Canon Inc | 撮像装置およびディスプレイの制御方法 |

| JP2007020029A (ja) * | 2005-07-11 | 2007-01-25 | Sony Corp | 画像処理装置および方法、プログラム並びに記録媒体 |

| JP2007041866A (ja) * | 2005-08-03 | 2007-02-15 | Canon Inc | 情報処理装置及び情報処理方法並びにプログラム |

| JP2007067559A (ja) * | 2005-08-29 | 2007-03-15 | Canon Inc | 画像処理方法、画像処理装置、及び撮像装置の制御方法 |

| WO2007052572A1 (en) * | 2005-11-02 | 2007-05-10 | Olympus Corporation | Electronic camera |

| JP2007174589A (ja) * | 2005-12-26 | 2007-07-05 | Hitachi Kokusai Electric Inc | サムネイル作成プログラム |

| JP2007195099A (ja) * | 2006-01-23 | 2007-08-02 | Fujifilm Corp | 撮影装置 |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3649468B2 (ja) | 1995-05-31 | 2005-05-18 | 株式会社日立製作所 | 撮影機能付き電子アルバムシステム |

| JP2000278578A (ja) | 1999-03-24 | 2000-10-06 | Matsushita Electric Ind Co Ltd | 電子スチルカメラ |

| KR100547992B1 (ko) * | 2003-01-16 | 2006-02-01 | 삼성테크윈 주식회사 | 디지털 카메라와 그의 제어 방법 |

| JP4307301B2 (ja) | 2003-07-31 | 2009-08-05 | キヤノン株式会社 | 画像処理装置およびその方法 |

| JP4489608B2 (ja) * | 2004-03-31 | 2010-06-23 | 富士フイルム株式会社 | ディジタル・スチル・カメラ,画像再生装置および顔画像表示装置ならびにそれらの制御方法 |

| JP2005354333A (ja) | 2004-06-10 | 2005-12-22 | Casio Comput Co Ltd | 画像再生装置およびプログラム |

| US20070291104A1 (en) * | 2006-06-07 | 2007-12-20 | Wavetronex, Inc. | Systems and methods of capturing high-resolution images of objects |

| JP4943769B2 (ja) * | 2006-08-15 | 2012-05-30 | 富士フイルム株式会社 | 撮影装置および合焦位置探索方法 |

-

2007

- 2007-08-08 JP JP2007207281A patent/JP2009044463A/ja active Pending

-

2008

- 2008-08-06 US US12/186,818 patent/US8081804B2/en not_active Expired - Fee Related

- 2008-08-07 CN CN2008101298046A patent/CN101365063B/zh not_active Expired - Fee Related

-

2011

- 2011-11-17 US US13/298,509 patent/US20120133798A1/en not_active Abandoned

Patent Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2005318009A (ja) * | 2004-04-26 | 2005-11-10 | Nikon Corp | 電子カメラおよび画像処理プログラム |

| JP2006109005A (ja) * | 2004-10-04 | 2006-04-20 | Canon Inc | 画像出力装置および撮像装置 |

| JP2006295888A (ja) * | 2005-03-17 | 2006-10-26 | Canon Inc | 撮像装置およびディスプレイの制御方法 |

| JP2007020029A (ja) * | 2005-07-11 | 2007-01-25 | Sony Corp | 画像処理装置および方法、プログラム並びに記録媒体 |

| JP2007041866A (ja) * | 2005-08-03 | 2007-02-15 | Canon Inc | 情報処理装置及び情報処理方法並びにプログラム |

| JP2007067559A (ja) * | 2005-08-29 | 2007-03-15 | Canon Inc | 画像処理方法、画像処理装置、及び撮像装置の制御方法 |

| WO2007052572A1 (en) * | 2005-11-02 | 2007-05-10 | Olympus Corporation | Electronic camera |

| JP2007174589A (ja) * | 2005-12-26 | 2007-07-05 | Hitachi Kokusai Electric Inc | サムネイル作成プログラム |

| JP2007195099A (ja) * | 2006-01-23 | 2007-08-02 | Fujifilm Corp | 撮影装置 |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2012231415A (ja) * | 2011-04-27 | 2012-11-22 | Ricoh Co Ltd | 撮像装置、画像表示装置および画像表示方法 |

| US9185294B2 (en) | 2011-04-27 | 2015-11-10 | Ricoh Company, Ltd. | Image apparatus, image display apparatus and image display method |

Also Published As

| Publication number | Publication date |

|---|---|

| CN101365063A (zh) | 2009-02-11 |

| US20120133798A1 (en) | 2012-05-31 |

| CN101365063B (zh) | 2012-10-24 |

| US20090041355A1 (en) | 2009-02-12 |

| US8081804B2 (en) | 2011-12-20 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN103535023B (zh) | 包括特定人的视频摘要 | |

| US8599316B2 (en) | Method for determining key video frames | |

| TWI375917B (en) | Image processing apparatus, imaging apparatus, image processing method, and computer program | |

| JP4930302B2 (ja) | 撮像装置、その制御方法およびプログラム | |

| EP2710594B1 (en) | Video summary including a feature of interest | |

| JP2009044463A (ja) | 電子カメラ及び被写界像再生装置 | |

| US8582891B2 (en) | Method and apparatus for guiding user with suitable composition, and digital photographing apparatus | |

| JP4413235B2 (ja) | 電子カメラ | |

| JP5821457B2 (ja) | 画像処理装置、および、画像処理装置の制御方法ならびに当該方法をコンピュータに実行させるためのプログラム | |

| US20110293250A1 (en) | Determining key video snippets using selection criteria | |

| CN106937051A (zh) | 成像设备、成像方法和程序 | |

| US20120098946A1 (en) | Image processing apparatus and methods of associating audio data with image data therein | |

| JP5837922B2 (ja) | カメラ位置に基づくキービデオフレームのランク付け | |

| JP2007241496A (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| JP2007310813A (ja) | 画像検索装置およびカメラ | |

| JP2008109338A (ja) | 画像管理装置、カメラ、画像管理方法、プログラム | |

| US20120229678A1 (en) | Image reproducing control apparatus | |

| JP2006039254A (ja) | カメラ | |

| JP2009077175A (ja) | 電子カメラ | |

| JP2009021893A (ja) | 撮像装置及び撮像方法 | |

| JP2007267308A (ja) | 画像再生装置 | |

| JP5356162B2 (ja) | 物体像探索装置 | |

| HK1190545A (en) | Video summary including a particular person | |

| JP2016071212A (ja) | 撮影装置、制御方法、及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20100217 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20100217 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20110720 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20110823 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20111024 |

|

| RD02 | Notification of acceptance of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7422 Effective date: 20111116 |

|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20111130 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20120403 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20120529 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20120828 |