JP2008009849A - 人物追跡装置 - Google Patents

人物追跡装置 Download PDFInfo

- Publication number

- JP2008009849A JP2008009849A JP2006181403A JP2006181403A JP2008009849A JP 2008009849 A JP2008009849 A JP 2008009849A JP 2006181403 A JP2006181403 A JP 2006181403A JP 2006181403 A JP2006181403 A JP 2006181403A JP 2008009849 A JP2008009849 A JP 2008009849A

- Authority

- JP

- Japan

- Prior art keywords

- face

- person

- detected

- area

- detection

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Landscapes

- Image Processing (AREA)

- Closed-Circuit Television Systems (AREA)

- Burglar Alarm Systems (AREA)

- Image Analysis (AREA)

Abstract

【課題】適切な顔向きパターンを用いて顔の検出を行い、高精度な人物追跡結果を作成することのできる人物追跡装置を提供する。

【解決手段】顔検出領域設定部2は、映像から人物の顔領域を検出するための検出領域を設定する。カメラ設置情報設定部3は、カメラの設置位置等の設置パラメータを設定する。顔向き推定部4は、前回検出された顔領域の位置とカメラの設置パラメータを用いて人物の顔の向きを推定する。顔検出パターン作成部5は、顔向き情報を用いて、顔の方向別にあらかじめ用意してある顔検出パターンの集合の中から、次に検出を行う顔の検出パターンを決定する。顔検出部7は、上記の検出領域と顔検出パターンを用いて映像中から人物の顔を検出する。検出された一連の人物の顔画像が同一人物の顔画像の追跡履歴として画面表示される。

【選択図】 図1

【解決手段】顔検出領域設定部2は、映像から人物の顔領域を検出するための検出領域を設定する。カメラ設置情報設定部3は、カメラの設置位置等の設置パラメータを設定する。顔向き推定部4は、前回検出された顔領域の位置とカメラの設置パラメータを用いて人物の顔の向きを推定する。顔検出パターン作成部5は、顔向き情報を用いて、顔の方向別にあらかじめ用意してある顔検出パターンの集合の中から、次に検出を行う顔の検出パターンを決定する。顔検出部7は、上記の検出領域と顔検出パターンを用いて映像中から人物の顔を検出する。検出された一連の人物の顔画像が同一人物の顔画像の追跡履歴として画面表示される。

【選択図】 図1

Description

本発明は、監視映像等のビデオ映像から人物の顔を検出して、人物の動きを追跡する人物追跡装置に関するものである。

従来、例えばセキュリティ等に有用な情報を提供するために、映像信号を処理して人物を抽出および追跡する人物追跡装置が提案されている。従来の典型的な人物追跡装置は、顔の検出を複数のフレームにおいて連続的に行うことにより人の顔の移動を追跡するように構成されている。また、従来の人物追跡装置は、各フレームにおける顔検出を前回のフレームで顔が検出された領域の近傍のみで行うように構成されている(例えば特許文献1参照)。

特開平11−15979号公報

しかしながら、従来の人物追跡装置においては、カメラの位置関係を考慮せずに、顔の向きが固定された顔パターンを参照し、この固定された顔パターンと映像を比較して顔を検出していた。その結果、適切な顔パターンが設定されていないために、顔検出が失敗することがあった。そして、顔検出が失敗してしまうと、顔の追跡が途切れてしまい、人物の追跡が失敗するという問題があった。例えば、監視映像等の人物追跡において、画面上に人物が複数人存在して接近している場合や交差した場合に、他人同士を互いに連結してしまうなどの追跡の失敗が発生するという問題があった。

特に、監視用途で使用するカメラは上方から撮影するシーンが多く、この場合に撮影される映像は下向き顔になる。しかし、従来はこのような撮像方向が考慮されていないためん、顔検出で取りこぼしてしまうという問題があった。

本発明は、従来の問題を解決するためになされたものであり、その目的は、カメラと人物の位置関係を考慮して、適切な顔向きパターンを用いて顔の検出を行い、高精度な人物追跡結果を作成することのできる人物追跡装置を提供することにある。

本発明の人物追跡装置は、カメラで撮影された映像を入力する映像入力手段と、前記映像入力手段で入力された映像から人物の顔領域を検出するための画面上の処理領域である検出領域を設定する顔検出領域設定手段と、前記カメラの設置パラメータを設定するカメラ設置情報設定手段と、前回検出された顔領域の位置と、前記カメラ設置情報設定手段で設定した前記カメラの設置パラメータを用いて、次に検出を行う人物の顔の向きを推定する顔向き推定手段と、前記顔向き推定手段で決定した顔向き情報を用いて、顔の方向別にあらかじめ用意してある顔検出パターンの中から、次に検出を行う顔の検出パターンを決定する顔検出パターン作成手段と、前記顔検出領域設定手段で設定した画面上の検出領域と、前記顔検出パターン作成手段で作成した顔の検出パターンを用いて映像中から人物の顔を検出する顔検出手段と、前記顔検出手段で検出した一連の人物の顔画像を同一人物の顔画像の追跡履歴として画面表示する追跡履歴表示手段を備えている。

この構成により、カメラの設置位置等の設置パラメータを用いて映像から人物の顔の向きが推定され、予め用意された顔方向別の顔検出パターンから顔向き情報に応じて顔検出パターンが生成され、この顔検出パターンを用いて映像中から人物の顔が検出される。こうして、カメラと人物の位置関係を考慮して、適切な顔向きパターンを用いて顔の検出を行い、高精度な人物追跡結果を作成することができる。

また、本発明の人物追跡装置では、前記顔検出領域設定手段が、直前に人物の顔を検出していない場合は、画面全領域を人物の顔を検出する検出領域として設定するように構成されている。

この構成により、人物が画面上の任意の場所に登場した場合でも顔の検出が可能となり、顔検出の失敗を防ぎ、高精度な人物追跡結果を作成することができる。

また、本発明の人物追跡装置では、前記顔検出領域設定手段が、直前に人物の顔を検出した場合は、直前に検出した顔のサイズと向きの情報から次に検出する顔の検出領域を決定するように構成されている。

この構成により、直前に検出した顔画像と次に検出する顔画像との対応をとることが可能となり、高精度な人物追跡結果を作成することができる。

また、本発明の人物追跡装置では、前記検出パターン作成手段が、直前に人物の顔を検出していない場合は、顔の正面を中心とした所定の比較的広範囲設定の顔向き範囲の顔パターンを用いて顔の検出パターンを作成するように構成されている。

この構成により、人物が監視映像に登場した場合に、顔向きが正面である場合でも、比較的角度の大きい顔向きの場合でも、顔検出の失敗を防ぎ、高精度な人物追跡結果を作成することができる。

また、本発明の人物追跡装置では、前記検出パターン作成手段が、直前に人物の顔を検出した場合は、前記顔向き推定手段で決定した顔向きを中心とした範囲の顔パターンを用いて顔の検出パターンを作成するように構成されている。

この構成により、カメラと人物の位置関係を考慮して、適切な顔向きパターンを用いて顔の検出を行い、高精度な人物追跡結果を作成することができる。

本発明の別の態様は、映像を処理して人物を抽出および追跡する人物追跡映像処理方法であり、カメラで撮影された映像を入力し、前記映像から人物の顔領域を検出するための画面上の処理領域である検出領域を設定し、前記カメラの設置パラメータを設定し、前回検出された顔領域の位置と、前記カメラの設置パラメータを用いて、次に検出を行う人物の顔の向きを推定し、推定された顔向き情報を用いて、顔の方向別にあらかじめ用意してある顔検出パターンの中から、次に検出を行う顔の検出パターンを決定し、画面上の前記検出領域と、決定された前記顔の検出パターンを用いて映像中から人物の顔を検出し、検出した一連の人物の顔画像を同一人物の顔画像の追跡履歴として画面表示する。この態様によっても、上述の本発明の利点が得られる。

本発明は、監視映像等のビデオ映像において、カメラと人物の位置関係を考慮して、適切な顔向きパターンを用いて顔の検出を行い、高精度な人物追跡結果を作成することのできるという効果を有する人物追跡装置を提供できる。

以下、本発明の実施の形態の人物追跡装置について、図面を用いて説明する。

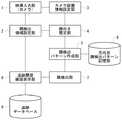

本発明の実施の形態に係る人物追跡装置を図1に示す。

図1において、本実施の形態の人物追跡装置は、監視映像等のビデオ映像を撮影するカメラを含み、カメラから出力された映像信号をデジタル画像データ等に変換してパソコン等の処理装置に入力する映像入力部1と、映像入力部1で出力された画像データを入力して、人物の顔領域を検出するための画面上の処理領域である検出領域を設定する顔検出領域設定部2と、映像入力部1で設置されているカメラの高さや取り付け角度、カメラの視野角を含む設置パラメータの設定を行うカメラ設置情報設定部3と、前回検出された顔領域の画面位置とカメラ設置情報設定部3で設定したカメラの設置パラメータから次に検出を行う顔の向きを推定する顔向き推定部4と、顔の様々な方向に対してあらかじめ用意してある複数の顔検出パターンである顔検出パターン集合を記憶した方向別顔検出パターン記憶部6と、顔向き推定部4で決定した顔向き情報を用いて、方向別顔検出パターン記憶部6を参照し、顔検出パターン集合の中から、次に検出を行う顔の検出パターンを決定する顔検出パターン作成部5と、顔検出領域設定部2で設定した検出領域に対して顔検出パターン作成部5で作成した顔検出パターンで人物の顔領域の検出を行う顔検出部7と、顔検出部7で検出した顔領域と前回検出した顔領域との対応をとり、追跡データベース9に格納して、検出した一連の顔画像を同一人物の追跡結果として画面に表示を行う追跡履歴画面表示部8とを有する。

以上のように構成された人物追跡装置について、図を用いてその動作を説明する。

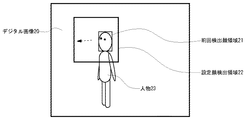

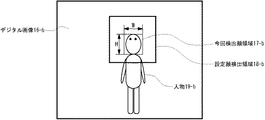

映像入力部1は、リアルタイムに映像が出力される監視カメラ等のデバイスによって構成され、撮影された映像信号が出力される。この映像信号に対して、キャプチャーボード等の映像入力デバイスによって、処理装置へのデータの移動処理および映像信号から図2に示すデジタル画像10(RGBカラー画像)への変換処理等が行われる。なお、本発明の範囲内で、映像入力部1にカメラが含まれなくてよい。映像入力部1は、カメラで撮影された録画映像を入力する構成であってもよい。

顔検出領域設定部2は、映像入力部1で出力されたデジタル画像10から人物11の顔領域の検出を行うための処理領域である検出領域の設定を行う。本装置の起動時、および直前の一定時間内に人物の顔を検出していない場合は、顔検出領域設定部2は、デジタル画像10の全領域を顔検出の検出領域に設定する。これは、人物が画面内に登場する前であるので、画面内の任意の位置に人物が登場しても対応できるようにするためである。直前の一定時間内に人物の顔を検出した場合は、顔検出領域設定部2は、直前に検出した顔のサイズと向きの情報から顔検出の検出領域を決定する。

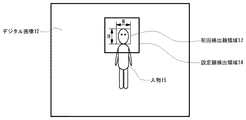

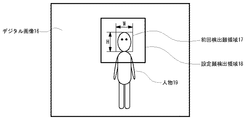

図3は、顔サイズが小さく顔向きがほぼ正面の場合の顔検出領域の設定処理を説明する図である。図4は、顔サイズが大きく顔向きがほぼ正面の場合の顔検出領域の設定処理を説明する図である。図3の前回検出顔領域13および図4の前回検出顔領域17は、直前の処理で検出された顔領域である。前回検出顔領域17は前回検出顔領域13よりも顔サイズが大きい。一般的に、画面上の顔サイズが大きい場合は、単位時間に移動する画面上の移動距離も大きくなる。このため、顔検出領域設定部2は、前回検出した顔領域のサイズが大きければ次に顔を検出する処理領域のサイズ(設定顔検出領域)も大きく設定をする。以上のことから、図4の設定顔検出領域18は図3の設定顔検出領域14よりも大きく設定される。

図5は、顔サイズが大きく顔向きが右横向きの場合の顔検出領域の設定処理を説明する図である。図5の前回検出顔領域21は、図4の前回検出顔領域17とほぼ同じサイズと仮定する。この場合、図5の設定顔検出領域22の領域サイズと図4の設定顔検出領域18の領域サイズは同じである。ただし、図5の場合は右方向に顔が向いているため、次に検出される顔領域は画面左方向にずれる可能性が高くなる。そこで、顔検出領域設定部2は、図5の設定顔検出領域22を、前回検出顔領域21の中心から画面左方向にずらして設定する。このずれは、前回検出した顔の向きの大きさに比例して設定される。

このようにして、直前に人物の顔が検出されている場合、顔検出領域設定部2は、(1)直前の人物の顔サイズに応じて、顔サイズが大きいほど検出領域サイズも大きくなるように検出領域を設定し、かつ、(2)直前の人物の顔向きに応じて、前回検出された顔領域の中心から顔向き方向にずれた位置に検出領域を設定し、さらに、(3)顔の向きが大きくなるほど(顔の向きがカメラに対して正面から離れるほど)検出領域のずれ量が大きくなるように検出領域を設定する。

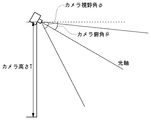

カメラ設置情報設定部3は、映像入力部1のカメラの設置パラメータの設定を装置に対して行う。図6は、カメラの設置パラメータを説明する図である。設置パラメータは、後述する顔向き推定に必要なカメラの設置位置および姿勢とカメラ仕様のパラメータである。本実施の形態では、設置パラメータとして、図6に示すように、カメラの設置高さT、カメラの俯角θ、カメラの視野角φ等を装置に設定する。

この設置パラメータの設定は、例えば、カメラが設置されたときに行われる。設置パラメータが、操作者によりキーボード等の入力デバイスを用いて入力されてよい。カメラ設置情報設定部3は、入力された設置パラメータの設定処理を行う。具体的には、設置パラメータが装置内のメモリ等に記憶され、必要に応じて読み出される。また別の例では、カメラに設置パラメータが保持されていてよい。この設置パラメータが映像入力部1からカメラ設置情報設定部3に供給され、装置に設定され、人物追跡のために使用される。この場合、設置パラメータは、必要に応じて任意のタイミングで映像入力部1から取得されてよい。

顔向き推定部4は、前回検出された顔領域の画面位置とカメラ設置情報設定部3で設定したカメラの設置パラメータから次に検出を行う顔の向きを推定する。本実施の形態では、前回と今回での顔向きの変化量が小さいと仮定して、前回検出された顔領域の顔向きが、次に検出を行う顔の向きとして求められる。

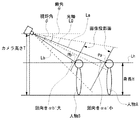

図7は、顔の向きを推定する処理を説明する図である。図7においては、人物A、Bの顔向き算出処理が示されており、添え字a、bは、人物A、Bに対応する。ここでは、まず、添え字a、bを省略して、顔向き算出処理について説明する。

図7において、カメラ設置情報設定部3では、カメラの設置高さT、カメラの俯角θ、カメラの視野角φが設定されて既知の値である。この情報と、前回検出された顔領域の中心位置座標Pと、人物の身長Hを用いて、人物の顔向きαが算出される。ここでは、人物が歩行している場合を想定している。

本実施の形態において、人物の身長Hは、通常の頭の上までの高さではなく、顔中心Pまでの高さである。人物の身長Hとしては、人物の平均身長が用いられる。身長Hは、カメラの設置パラメータと共に予め本装置に記憶されていてよい。

また、顔中心位置座標Pは、後段の顔検出結果に基づき決定される。例えば顔検出にて両目、鼻および口が抽出され、これら両目、鼻および口を包含する矩形が求められ、この矩形の中心点が顔中心として決定される。

本実施の形態では、人物の顔向きαは下記のように定義される。図において、線Lは、カメラと人物の顔中心Pを結ぶ線である。線Lhは、人物の身長Hを通る水平線である。そして、顔向きαは、水平線Lhに対する線Lの角度である。

顔向きαは以下のようにして算出できる。まず、カメラ高さTとカメラ俯角θから、図7のカメラの光軸L0が決定される。次に、光軸L0と視野角φと、映像内の顔中心位置座標Pから、顔中心Pとカメラを結ぶラインLが決定される。ここでは、視野角φを用いて任意の位置に光軸L0に垂直な画像投影面が設定され、顔中心座標Pが投影面上にプロットされ、顔中心座標Pがカメラと結ばれてラインLが得られる。そして、ラインLと水平線Lhの角度が求められる。上記の原理に従ったプログラムが用意され、顔向き推定部4で実行されればよい。

図7の例では、人物Aの顔向きαaと、人物Bの顔向きαbが算出される。人物Bの方が人物Aよりもカメラに近づいている。そのため、人物Bの顔向きαbの方が人物Aの顔向きαaよりも大きく算出される。

上述の図7では、上下方向の顔向きαが算出された。横方向の顔向きβは以下のように算出される。

本実施の形態は、顔が正面を向いているとき(より詳細には、光軸を通る鉛直面に平行な方向を顔が向いているとき)、横方向の顔向きβが0である。そして、顔が真横を向いているとき、横方向の顔向きβが90度である。

顔向きβを算出するために、顔の法線ベクトルが算出される。ここでは、顔が例えば球体に近似される。球体の中心と顔中心を結ぶベクトルが、顔の法線ベクトルである。まず、顔を円に近似し、円の中での顔中心点(本実施の形態では両目、鼻、口を包含する矩形の中心点)を特定すれば、上記の近似球体面上での顔中心の法線ベクトルが定まる。そして、法線ベクトルの横方向の顔向きβが算出される。顔向きβは、上方から見たときの光軸と法線ベクトルの角度である。より詳細には、法線ベクトルと光軸が、水平面に投影される。水平面上での法線ベクトルと光軸の角度が、横方向の顔向きに相当する。顔向き推定部4では、上記の原理に従ったプログラムが用意され、実行され、これにより顔向きβが算出される。

その他、顔向き推定部4は、本装置の起動時、および直前の一定時間内に人物の顔を本装置が検出していない場合には、上下方向および横方向の顔向きを0とする。ここでは、顔向きを判断できないので、後段の処理を適当に行うために、カメラに対して顔が正面を向いているものとして、顔向きを設定する。

図8は、上記のようにして算出される横方向の顔向きβを示している。顔が球体であるとすると、横方向の顔向きβは、球体上の顔中心Pの経度に相当する。したがって、顔中心Pが顔の中で横にずれるほど、顔向きβが大きくなる。

次に、顔検出パターン作成部5は、顔向き推定部4で決定した顔向き情報を用いて、顔検出パターン集合から、次に検出を行う顔の検出パターンを決定する。顔検出パターン集合は、顔の様々な方向に対してあらかじめ用意してある多数の顔検出パターンからなる。顔検出パターン集合は、方向別顔検出パターン記憶部6に記憶されており、顔検出パターン5により参照される。

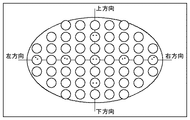

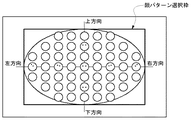

図9は、方向別顔検出パターンを説明する図である。顔向きには、上方向、下方向、右方向、左方向の4方向の向きが存在するため、それぞれの向きに対応した顔検出パターンをマトリクス状に配置してあらかじめ用意しておく。図9における各々の丸い絵が、それぞれの顔向きに対応した顔検出パターンを表している。また、図9の例では、上下方向に最大7つ、左右方向に最大9つの顔検出パターンを配置しているが、この配置間隔はこれよりも多くても少なくても構わない。

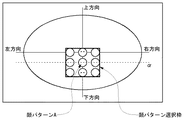

次に顔検出パターンを作成する処理を以下に説明する。本装置の起動時、および直前の一定時間内に人物の顔を検出していない場合は、図10に示すように、図9の全ての方向の顔検出パターンを選択して次に検出を行う顔検出パターンとして設定する。これは、人物が画面内に登場する前なので、画面内に任意の顔向きで人物が登場しても対応できるようにするためである。

より詳細には、前述の顔向き推定処理で、本装置の起動時、および直前の一定時間内に人物の顔を検出していない場合、顔の向きは正面に設定されている(顔向きが上下方向に0であり、左右方向にも0である)。この場合、正面方向の顔検出パターン(図10の中央の顔パターン)を中心として顔パターン選択枠が設定される。顔パターン選択枠は、全方向の顔検出パターンを網羅するように広く設定される。そして、この顔パターン選択枠内の顔検出パターンが選択される。こうして、直前に人物の顔を検出していない場合は、顔の正面を中心とした顔向きが比較的広い範囲の顔パターンを用いて顔の検出パターンが作成される。

一方、直前の一定時間内に人物の顔を検出した場合は、顔向き推定部4で決定した顔向き情報を用いる。顔向き推定部4で推定された顔向きが上下方向α(α<0)で、左右方向0の場合は、図11に示すように顔パターンAを中心としてその周辺の所定範囲から選択した顔パターン(図11の顔パターン選択枠内の顔検出パターン)のみを次に検出を行う顔検出パターンとして設定する。図11では、選択枠内の顔検出パターンとして、上下方向に3つ、左右方向に3つのパターンを選択しているが、本発明の範囲内でこれよりも多くても少なくても構わない。

図11の例では、横方向の顔向きが0である。横方向の顔向きが0でない場合にも同様である。顔向きに対応する位置の顔パターンを中心とする顔パターン選択枠が設定され、選択枠内の顔パターンが選択される。例えば、図11の例で、仮に横方向の顔向きが0でなければ、顔パターン選択枠が横方向へと顔向きと同じ方向にずらされる。

このようにして、顔検出パターン作成部5は、(1)直前に人物の顔を検出していない場合は、図10に示されるように、顔の正面を中心とした顔向きが比較的広い所定の基準範囲の顔パターンを用いて顔の検出パターンを作成し、(2)直前に人物の顔を検出した場合は、図11に示されるように、顔向き推定部4で決定した顔向きを中心とした所定の周辺範囲((1)よりも狭く設定された縮小範囲)の顔向きに対応する顔パターンを選択して顔の検出パターンを作成する。

顔検出部7は、顔検出領域設定部2で設定した検出領域に対して顔検出パターン作成部5で作成した顔検出パターンで人物の顔領域の検出を行う。具体例として、顔検出領域設定部2で設定した検出領域が図4の設定顔検出領域18になり、顔検出パターン作成部5で作成した顔検出パターンが図11の顔パターン選択枠内の顔検出パターンになった場合について説明する。図12のデジタル画像16−bは、図4のデジタル画像16の微小時間後の画像とする。この場合、顔検出領域設定部2で設定した顔検出領域は、図12の設定顔検出領域18−bであるので、この領域に対して、顔検出パターン作成部5で作成した図11の顔パターン選択枠内の顔検出パターンを用いて顔検出を行う。この結果、図12の今回検出顔領域17−bが検出される。

顔検出処理では、顔検出パターンと映像のパターンマッチングが行われてよい。顔検出パターンとマッチする領域が、人物の顔として検出される。このとき、上述の処理で顔パターン選択枠内から選択された複数の顔検出パターンの各々が映像と比較され、マッチング度が最大の領域が検出されてよい。簡単な例としては、パターンマッチングでは、映像の領域をずらしながら、顔検出パターンと映像の差分が求められる。そして、差分が最小になる領域が探索される。ただし、本発明の範囲内で、顔検出処理は上記に限定されないことはもちろんであり、各種の検出処理が適用可能なことはもちろんである。

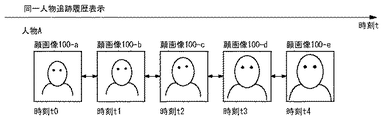

追跡履歴画面表示部8は、顔検出部7で今回検出した顔画像と前回検出した顔画像との対応をとり、顔画像を追跡データベース9に格納して、一連の顔画像を画面に表示する。本実施の形態では、前回検出された顔画像から、上述のようにして今回の検出領域と顔検出パターンが設定されている。追跡履歴画面表示部8は、これら情報を用いて顔画像が検出されたということは、検出された顔画像は前回検出された顔画像と対応すると判断する。具体的には、前回検出を行った画像を図4のデジタル画像16、今回検出した画像を図12のデジタル画像16−bとすると、図4の前回検出顔画像17と図12の今回検出顔画像17−bが同一人物として対応がとれ、追跡データベース9に同一人物として格納される。このようにして次々と対応する顔画像が検出され、追跡データベースには、同一人物毎に時系列の顔画像が保存される。この時系列に保存された一連の顔画像は、画面に表示をして確認することができるようにする。図13は、同一人物の追跡履歴を画面表示した例を説明する図である。このように、同一人物に対して、時系列に顔画像100−a、100−b、100−c、100−d、100−eを画面に表示する。

追跡履歴画面表示部8までの処理を行った場合は、顔検出領域設定部2の処理に戻り、上記説明の処理を繰り返して、人物の追跡を行い、追跡データベース9に追跡結果の蓄積を継続する。

以上に、本発明の実施の形態に係る人物追跡装置について説明した。本実施の形態によれば、上述のように、カメラの設置位置等の設置パラメータを用いて映像から人物の顔の向きが推定され、予め用意された顔方向別の顔検出パターンから顔向き情報に応じて顔検出処理で使用する顔検出パターンが作成され、この顔検出パターンを用いて映像中から人物の顔が検出される。こうして、カメラと人物の位置関係を考慮して、適切な顔向きパターンを用いて顔の検出を行い、高精度な人物追跡結果を作成することができる。

また、本実施の形態によれば、直前に人物の顔を検出していない場合は、画面全領域が人物の顔を検出する検出領域として設定される。これにより、人物が画面上の任意の場所に登場した場合でも顔の検出が可能となり、顔検出の失敗を防ぎ、高精度な人物追跡結果を作成することができる。

また、本実施の形態によれば、直前に人物の顔を検出した場合は、直前に検出した顔のサイズと向きの情報から次に検出する顔の検出領域が決定される。これにより、直前に検出した顔画像と次に検出する顔画像との対応をとることが可能となり、高精度な人物追跡結果を作成することができる。

また、本実施の形態によれば、直前に人物の顔を検出していない場合は、顔の正面を中心とした所定の比較的広範囲設定の顔向き範囲の顔パターンを用いて顔の検出パターンが作成される。これにより、人物が監視映像に登場した場合に、顔向きが正面である場合でも、比較的角度の大きい顔向きの場合でも、顔検出の失敗を防ぎ、高精度な人物追跡結果を作成することができる。

また、本実施の形態によれば、直前に人物の顔を検出した場合は、顔向き推定処理で決定した顔向きを中心とした範囲の顔パターンを用いて顔の検出パターンが作成される。これにより、カメラと人物の位置関係を考慮して、適切な顔向きパターンを用いて顔の検出を行い、高精度な人物追跡結果を作成することができる。

以上に本発明の好適な実施の形態を説明した。しかし、本発明は上述の実施の形態に限定されず、当業者が本発明の範囲内で上述の実施の形態を変形可能なことはもちろんである。

以上のように、本発明にかかる人物追跡装置は、監視映像等のビデオ映像において、カメラと人物の位置関係を考慮して、適切な顔向きパターンを用いて顔の検出を行い、高精度な人物追跡結果を作成することができるという効果を有し、人物の行動を監視する用途や人物の検索を行うためのデータベースを構築する人物追跡装置等として有用である。

1 映像入力部

2 顔検出領域設定部

3 カメラ設置情報設定部

4 顔向き推定部

5 顔検出パターン作成部

6 方向別顔検出パターン記憶部

7 顔検出部

8 追跡履歴画面表示部

9 追跡データベース部

2 顔検出領域設定部

3 カメラ設置情報設定部

4 顔向き推定部

5 顔検出パターン作成部

6 方向別顔検出パターン記憶部

7 顔検出部

8 追跡履歴画面表示部

9 追跡データベース部

Claims (6)

- カメラで撮影された映像を入力する映像入力手段と、

前記映像入力手段で入力された映像から人物の顔領域を検出するための画面上の処理領域である検出領域を設定する顔検出領域設定手段と、

前記カメラの設置パラメータを設定するカメラ設置情報設定手段と、

前回検出された顔領域の位置と、前記カメラ設置情報設定手段で設定した前記カメラの設置パラメータを用いて、次に検出を行う人物の顔の向きを推定する顔向き推定手段と、

前記顔向き推定手段で決定した顔向き情報を用いて、顔の方向別にあらかじめ用意してある顔検出パターンの中から、次に検出を行う顔の検出パターンを決定する顔検出パターン作成手段と、

前記顔検出領域設定手段で設定した画面上の検出領域と、前記顔検出パターン作成手段で作成した顔の検出パターンを用いて映像中から人物の顔を検出する顔検出手段と、

前記顔検出手段で検出した一連の人物の顔画像を同一人物の顔画像の追跡履歴として画面表示する追跡履歴表示手段を備えたことを特徴とする人物追跡装置。 - 前記顔検出領域設定手段は、直前に人物の顔を検出していない場合は、画面全領域を人物の顔を検出する検出領域として設定することを特徴とする請求項1記載の人物追跡装置。

- 前記顔検出領域設定手段は、直前に人物の顔を検出した場合は、直前に検出した顔のサイズと向きの情報から次に検出する顔の検出領域を決定することを特徴とする請求項1または請求項2に記載の人物追跡装置。

- 前記検出パターン作成手段は、直前に人物の顔を検出していない場合は、顔の正面を中心とした所定の比較的広範囲設定の顔向き範囲の顔パターンを用いて顔の検出パターンを作成することを特徴とする請求項1から請求項3のいずれかに記載の人物追跡装置。

- 前記検出パターン作成手段は、直前に人物の顔を検出した場合は、前記顔向き推定手段で決定した顔向きを中心とした範囲の顔パターンを用いて顔の検出パターンを作成することを特徴とする請求項1から請求項4のいずれかに記載の人物追跡装置。

- カメラで撮影された映像を入力し、

前記映像から人物の顔領域を検出するための画面上の処理領域である検出領域を設定し、

前記カメラの設置パラメータを設定し、

前回検出された顔領域の位置と、前記カメラの設置パラメータを用いて、次に検出を行う人物の顔の向きを推定し、

推定された顔向き情報を用いて、顔の方向別にあらかじめ用意してある顔検出パターンの中から、次に検出を行う顔の検出パターンを決定し、

画面上の前記検出領域と、決定された前記顔の検出パターンを用いて映像中から人物の顔を検出し、

検出した一連の人物の顔画像を同一人物の顔画像の追跡履歴として画面表示することを特徴とする人物追跡映像処理方法。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2006181403A JP2008009849A (ja) | 2006-06-30 | 2006-06-30 | 人物追跡装置 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2006181403A JP2008009849A (ja) | 2006-06-30 | 2006-06-30 | 人物追跡装置 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2008009849A true JP2008009849A (ja) | 2008-01-17 |

Family

ID=39067975

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2006181403A Pending JP2008009849A (ja) | 2006-06-30 | 2006-06-30 | 人物追跡装置 |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2008009849A (ja) |

Cited By (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2010022601A (ja) * | 2008-07-18 | 2010-02-04 | Omron Corp | 監視装置および方法、並びにプログラム |

| JP2011029737A (ja) * | 2009-07-22 | 2011-02-10 | Hitachi Kokusai Electric Inc | 監視映像検索装置及び監視システム |

| JP2011191987A (ja) * | 2010-03-15 | 2011-09-29 | Omron Corp | 通報装置、および通報システム |

| JP2011193198A (ja) * | 2010-03-15 | 2011-09-29 | Omron Corp | 監視カメラ端末 |

| JP2013042514A (ja) * | 2012-09-21 | 2013-02-28 | Omron Corp | 対象画像検出デバイス、その制御方法、制御プログラム、および該プログラムを記録した記録媒体、ならびに対象画像検出デバイスを備えた電子機器 |

| EP2237552A3 (en) * | 2009-04-03 | 2014-01-01 | FUJIFILM Corporation | Autofocus system |

| US9189683B2 (en) | 2008-03-14 | 2015-11-17 | Omron Corporation | Target image detection device, controlling method of the same, control program and recording medium recorded with program, and electronic apparatus equipped with target image detection device |

| JP2017033132A (ja) * | 2015-07-30 | 2017-02-09 | パナソニックIpマネジメント株式会社 | 顔認証装置 |

| WO2018168042A1 (ja) * | 2017-03-14 | 2018-09-20 | オムロン株式会社 | 画像解析装置、画像解析方法、及び画像解析プログラム |

| JP2019037004A (ja) * | 2018-11-26 | 2019-03-07 | キヤノン株式会社 | 画像処理装置、その制御方法、プログラム |

| US10475237B2 (en) | 2014-09-26 | 2019-11-12 | Canon Kabushiki Kaisha | Image processing apparatus and control method thereof |

| CN112419637A (zh) * | 2019-08-22 | 2021-02-26 | 北京奇虎科技有限公司 | 安防图像数据的处理方法及装置 |

| JP7132392B1 (ja) * | 2021-05-12 | 2022-09-06 | レノボ・シンガポール・プライベート・リミテッド | 電子機器、及び制御方法 |

-

2006

- 2006-06-30 JP JP2006181403A patent/JP2008009849A/ja active Pending

Cited By (19)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9189683B2 (en) | 2008-03-14 | 2015-11-17 | Omron Corporation | Target image detection device, controlling method of the same, control program and recording medium recorded with program, and electronic apparatus equipped with target image detection device |

| JP2010022601A (ja) * | 2008-07-18 | 2010-02-04 | Omron Corp | 監視装置および方法、並びにプログラム |

| EP2237552A3 (en) * | 2009-04-03 | 2014-01-01 | FUJIFILM Corporation | Autofocus system |

| JP2011029737A (ja) * | 2009-07-22 | 2011-02-10 | Hitachi Kokusai Electric Inc | 監視映像検索装置及び監視システム |

| JP2011191987A (ja) * | 2010-03-15 | 2011-09-29 | Omron Corp | 通報装置、および通報システム |

| JP2011193198A (ja) * | 2010-03-15 | 2011-09-29 | Omron Corp | 監視カメラ端末 |

| JP2013042514A (ja) * | 2012-09-21 | 2013-02-28 | Omron Corp | 対象画像検出デバイス、その制御方法、制御プログラム、および該プログラムを記録した記録媒体、ならびに対象画像検出デバイスを備えた電子機器 |

| US10475237B2 (en) | 2014-09-26 | 2019-11-12 | Canon Kabushiki Kaisha | Image processing apparatus and control method thereof |

| JP2017033132A (ja) * | 2015-07-30 | 2017-02-09 | パナソニックIpマネジメント株式会社 | 顔認証装置 |

| WO2018168042A1 (ja) * | 2017-03-14 | 2018-09-20 | オムロン株式会社 | 画像解析装置、画像解析方法、及び画像解析プログラム |

| JP2018151919A (ja) * | 2017-03-14 | 2018-09-27 | オムロン株式会社 | 画像解析装置、画像解析方法、及び画像解析プログラム |

| US11188781B2 (en) | 2017-03-14 | 2021-11-30 | Omron Corporation | Image analyzer, image analysis method, and image analysis program |

| JP2019037004A (ja) * | 2018-11-26 | 2019-03-07 | キヤノン株式会社 | 画像処理装置、その制御方法、プログラム |

| CN112419637A (zh) * | 2019-08-22 | 2021-02-26 | 北京奇虎科技有限公司 | 安防图像数据的处理方法及装置 |

| CN112419637B (zh) * | 2019-08-22 | 2024-05-14 | 北京奇虎科技有限公司 | 安防图像数据的处理方法及装置 |

| JP7132392B1 (ja) * | 2021-05-12 | 2022-09-06 | レノボ・シンガポール・プライベート・リミテッド | 電子機器、及び制御方法 |

| CN115344110A (zh) * | 2021-05-12 | 2022-11-15 | 联想(新加坡)私人有限公司 | 电子设备以及控制方法 |

| US12148243B2 (en) | 2021-05-12 | 2024-11-19 | Lenovo (Singapore) Pte. Ltd. | Electronic apparatus and control method |

| CN115344110B (zh) * | 2021-05-12 | 2026-04-03 | 联想(新加坡)私人有限公司 | 电子设备以及控制方法 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP3279479B2 (ja) | 映像監視方法及び装置 | |

| JP4991595B2 (ja) | パーティクルフィルタを使用する追跡システム | |

| US10769798B2 (en) | Moving object detection apparatus, moving object detection method and program | |

| JP4586709B2 (ja) | 撮像装置 | |

| JP4373840B2 (ja) | 動物体追跡方法、動物体追跡プログラムおよびその記録媒体、ならびに、動物体追跡装置 | |

| GB2516173A (en) | Tracking assistance device, tracking assistance system and tracking assistance method | |

| US20040141633A1 (en) | Intruding object detection device using background difference method | |

| JP5001930B2 (ja) | 動作認識装置及び方法 | |

| JP2012243161A (ja) | 画像処理装置、画像処理方法 | |

| JP2008009849A (ja) | 人物追跡装置 | |

| CN102369549A (zh) | 用于估计物体位置的信息创建设备、用于估计物体位置的信息创建方法和程序 | |

| US20220004748A1 (en) | Video display method, device and system, and video camera | |

| EP3624443B1 (en) | Surveillance device, surveillance method, computer program, and storage medium | |

| JP4559874B2 (ja) | 動体追跡装置 | |

| JP5253227B2 (ja) | 画像入力装置及び被写体検出方法、プログラム | |

| KR102344227B1 (ko) | 동체 검출 장치, 동체 검출 방법, 동체 검출 프로그램 | |

| KR20190026625A (ko) | 영상 표시 방법 및 컴퓨터 프로그램, 그 기록매체 | |

| JP2017147689A (ja) | 映像編集装置、映像編集方法及び映像編集用コンピュータプログラム | |

| JP7524713B2 (ja) | 情報処理装置および情報処理方法 | |

| JP6405606B2 (ja) | 画像処理装置、画像処理方法、および画像処理プログラム | |

| JP2006033188A (ja) | 監視装置および監視方法 | |

| US20120165084A1 (en) | Method and apparatus for tracking locations using webcams | |

| JP2004128648A (ja) | 侵入物体追尾方法 | |

| JP2018190132A (ja) | 画像認識用コンピュータプログラム、画像認識装置及び画像認識方法 | |

| JP3980341B2 (ja) | 目の位置のトラッキング方法、目の位置のトラッキング装置およびそのためのプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20071122 |