WO2023152971A1 - 画像処理装置、画像処理方法、およびプログラム - Google Patents

画像処理装置、画像処理方法、およびプログラム Download PDFInfo

- Publication number

- WO2023152971A1 WO2023152971A1 PCT/JP2022/005675 JP2022005675W WO2023152971A1 WO 2023152971 A1 WO2023152971 A1 WO 2023152971A1 JP 2022005675 W JP2022005675 W JP 2022005675W WO 2023152971 A1 WO2023152971 A1 WO 2023152971A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- human body

- quality value

- image

- image processing

- detected

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/18—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast

Abstract

本発明は、画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出部(11)と、人体毎に、検出されたキーポイントの品質値を算出する算出部(12)と、品質値が閾値以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力する出力部(13)と、を有する画像処理装置(10)を提供する。

Description

本発明は、画像処理装置、画像処理方法、およびプログラムに関する。

本発明に関連する技術が特許文献1及び非特許文献1に開示されている。特許文献1には、画像に含まれる人体の複数のキーポイント各々の特徴量を算出し、算出した特徴量に基づき姿勢が似た人体や動きが似た人体を含む画像を検索したり、当該姿勢や動きが似たもの同士でまとめて分類したりする技術が開示されている。また、非特許文献1には、人物の骨格推定に関連する技術が開示されている。

Zhe Cao, Tomas Simon, Shih-En Wei, Yaser Sheikh, "Realtime Multi-Person 2D Pose Estimation using Part Affinity Fields", The IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2017, P. 7291-7299

上述した特許文献1に開示の技術によれば、所望の姿勢や所望の動きの人体を含む画像を事前にテンプレート画像として登録しておくことで、処理対象の画像の中から所望の姿勢や所望の動きの人体を検出することができる。そして、本発明者は、このような特許文献1に開示の技術を検討した結果、一定の品質の画像をテンプレート画像として登録しなければ検出の精度が悪くなること、及び、そのようなテンプレート画像を用意する作業の作業性に改善の余地があることを新たに見出した。

上述した特許文献1及び非特許文献1はいずれも、テンプレート画像に関する課題及びその解決手段を開示していないため、上記課題を解決できないという問題点があった。

本発明の目的の一例は、上述した課題を鑑み、一定の品質のテンプレート画像を用意する作業の作業性の問題を解決する画像処理装置、画像処理方法、およびプログラムを提供することにある。

本発明の一態様によれば、

画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段と、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段と、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段と、

を有する画像処理装置が提供される。

画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段と、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段と、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段と、

を有する画像処理装置が提供される。

また、本発明の一態様によれば、

1以上のコンピュータが、

画像に含まれる人体のキーポイントを検出する処理を行い、

人体毎に、検出された前記キーポイントの品質値を算出し、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する、

画像処理方法が提供される。

1以上のコンピュータが、

画像に含まれる人体のキーポイントを検出する処理を行い、

人体毎に、検出された前記キーポイントの品質値を算出し、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する、

画像処理方法が提供される。

また、本発明の一態様によれば、

コンピュータを、

画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段、

として機能させるプログラムが提供される。

コンピュータを、

画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段、

として機能させるプログラムが提供される。

本発明の一態様によれば、一定の品質のテンプレート画像を用意する作業の作業性の問題を解決する画像処理装置、画像処理方法、およびプログラムが得られる。

上述した目的、およびその他の目的、特徴および利点は、以下に述べる公的な実施の形態、およびそれに付随する以下の図面によってさらに明らかになる。

以下、本発明の実施の形態について、図面を用いて説明する。尚、すべての図面において、同様な構成要素には同様の符号を付し、適宜説明を省略する。

<第1の実施形態>

図1は、第1の実施形態に係る画像処理装置10の概要を示す機能ブロック図である。図1に示すように、画像処理装置10は、骨格構造検出部11と、算出部12と、出力部13とを備える。骨格構造検出部11は、画像に含まれる人体のキーポイントを検出する処理を行う。算出部12は、人体毎に、検出されたキーポイントの品質値を算出する。出力部13は、品質値が閾値以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力する。

図1は、第1の実施形態に係る画像処理装置10の概要を示す機能ブロック図である。図1に示すように、画像処理装置10は、骨格構造検出部11と、算出部12と、出力部13とを備える。骨格構造検出部11は、画像に含まれる人体のキーポイントを検出する処理を行う。算出部12は、人体毎に、検出されたキーポイントの品質値を算出する。出力部13は、品質値が閾値以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力する。

この画像処理装置10によれば、一定の品質のテンプレート画像を用意する作業の作業性の問題を解決することができる。

<第2の実施形態>

「概要」

画像処理装置10は、画像に含まれる人体のキーポイントを検出すると、キーポイントの検出結果の確信度に基づき、検出した人体毎に、検出されたキーポイントの品質値を算出する。そして、画像処理装置10は、上記品質値が閾値以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力する。

「概要」

画像処理装置10は、画像に含まれる人体のキーポイントを検出すると、キーポイントの検出結果の確信度に基づき、検出した人体毎に、検出されたキーポイントの品質値を算出する。そして、画像処理装置10は、上記品質値が閾値以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力する。

ユーザは、上記品質値が閾値以上である人体が写る箇所からテンプレート画像を選別することで、一定の品質のテンプレート画像を用意することができる。

「ハードウエア構成」

次に、画像処理装置のハードウエア構成の一例を説明する。画像処理装置の各機能部は、任意のコンピュータのCPU(Central Processing Unit)、メモリ、メモリにロードされるプログラム、そのプログラムを格納するハードディスク等の記憶ユニット(あらかじめ装置を出荷する段階から格納されているプログラムのほか、CD(Compact Disc)等の記憶媒体やインターネット上のサーバ等からダウンロードされたプログラムをも格納できる)、ネットワーク接続用インターフェイスを中心にハードウエアとソフトウエアの任意の組合せによって実現される。そして、その実現方法、装置にはいろいろな変形例があることは、当業者には理解されるところである。

次に、画像処理装置のハードウエア構成の一例を説明する。画像処理装置の各機能部は、任意のコンピュータのCPU(Central Processing Unit)、メモリ、メモリにロードされるプログラム、そのプログラムを格納するハードディスク等の記憶ユニット(あらかじめ装置を出荷する段階から格納されているプログラムのほか、CD(Compact Disc)等の記憶媒体やインターネット上のサーバ等からダウンロードされたプログラムをも格納できる)、ネットワーク接続用インターフェイスを中心にハードウエアとソフトウエアの任意の組合せによって実現される。そして、その実現方法、装置にはいろいろな変形例があることは、当業者には理解されるところである。

図2は、画像処理装置10のハードウエア構成を例示するブロック図である。図2に示すように、画像処理装置10は、プロセッサ1A、メモリ2A、入出力インターフェイス3A、周辺回路4A、バス5Aを有する。周辺回路4Aには、様々なモジュールが含まれる。画像処理装置10は周辺回路4Aを有さなくてもよい。なお、画像処理装置10は物理的及び/又は論理的に分かれた複数の装置で構成されてもよい。この場合、複数の装置各々が上記ハードウエア構成を備えることができる。

バス5Aは、プロセッサ1A、メモリ2A、周辺回路4A及び入出力インターフェイス3Aが相互にデータを送受信するためのデータ伝送路である。プロセッサ1Aは、例えばCPU、GPU(Graphics Processing Unit)などの演算処理装置である。メモリ2Aは、例えばRAM(Random Access Memory)やROM(Read Only Memory)などのメモリである。入出力インターフェイス3Aは、入力装置、外部装置、外部サーバ、外部センサ、カメラ等から情報を取得するためのインターフェイスや、出力装置、外部装置、外部サーバ等に情報を出力するためのインターフェイスなどを含む。入力装置は、例えばキーボード、マウス、マイク、物理ボタン、タッチパネル等である。出力装置は、例えばディスプレイ、スピーカ、プリンター、メーラ等である。プロセッサ1Aは、各モジュールに指令を出し、それらの演算結果をもとに演算を行うことができる。

「機能構成」

図1は、第2の実施形態に係る画像処理装置10の概要を示す機能ブロック図である。図1に示すように、画像処理装置10は、骨格構造検出部11と、算出部12と、出力部13とを備える。

図1は、第2の実施形態に係る画像処理装置10の概要を示す機能ブロック図である。図1に示すように、画像処理装置10は、骨格構造検出部11と、算出部12と、出力部13とを備える。

骨格構造検出部11は、画像に含まれる人体のキーポイントを検出する処理を行う。

「画像」は、テンプレート画像の元となる画像である。テンプレート画像は、上述した特許文献1に開示の技術において事前に登録される画像であって、所望の姿勢や所望の動き(ユーザが検出したい姿勢や動き)の人体を含む画像である。画像は、複数のフレーム画像で構成される動画像であってもよいし、1枚で構成される静止画像であってもよい。

骨格構造検出部11は、画像に含まれる人体のN(Nは2以上の整数)個のキーポイントを検出する。動画像が処理対象の場合、骨格構造検出部11は、フレーム画像毎にキーポイントを検出する処理を行う。骨格構造検出部11による当該処理は、特許文献1に開示されている技術を用いて実現される。詳細は省略するが、特許文献1に開示されている技術では、非特許文献1に開示されたOpenPose等の骨格推定技術を利用して骨格構造の検出を行う。当該技術で検出される骨格構造は、関節等の特徴的な点である「キーポイント」と、キーポイント間のリンクを示す「ボーン(ボーンリンク)」とから構成される。

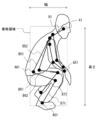

図3は、骨格構造検出部11により検出される人体モデル300の骨格構造を示しており、図4及び図5は、骨格構造の検出例を示している。骨格構造検出部11は、OpenPose等の骨格推定技術を用いて、2次元の画像から図3のような人体モデル(2次元骨格モデル)300の骨格構造を検出する。人体モデル300は、人物の関節等のキーポイントと、各キーポイントを結ぶボーンから構成された2次元モデルである。

骨格構造検出部11は、例えば、画像の中からキーポイントとなり得る特徴点を抽出し、キーポイントの画像を機械学習した情報を参照して、人体のN個のキーポイントを検出する。検出するN個のキーポイントは予め定められる。検出するキーポイントの数(すなわち、Nの数)や、人体のどの部分を検出するキーポイントとするかは様々であり、あらゆるバリエーションを採用できる。

以下では、図3に示すように、頭A1、首A2、右肩A31、左肩A32、右肘A41、左肘A42、右手A51、左手A52、右腰A61、左腰A62、右膝A71、左膝A72、右足A81、左足A82が、検出対象のN個のキーポイント(N=14)として定められているものとする。なお、図3に示す人体モデル300では、これらのキーポイントを連結した人物の骨として、頭A1と首A2を結ぶボーンB1、首A2と右肩A31及び左肩A32をそれぞれ結ぶボーンB21及びボーンB22、右肩A31及び左肩A32と右肘A41及び左肘A42をそれぞれ結ぶボーンB31及びボーンB32、右肘A41及び左肘A42と右手A51及び左手A52をそれぞれ結ぶボーンB41及びボーンB42、首A2と右腰A61及び左腰A62をそれぞれ結ぶボーンB51及びボーンB52、右腰A61及び左腰A62と右膝A71及び左膝A72をそれぞれ結ぶボーンB61及びボーンB62、右膝A71及び左膝A72と右足A81及び左足A82をそれぞれ結ぶボーンB71及びボーンB72がさらに定められている。

図4は、直立した状態の人物を検出する例である。図4では、直立した人物が正面から撮像されており、正面から見たボーンB1、ボーンB51及びボーンB52、ボーンB61及びボーンB62、ボーンB71及びボーンB72がそれぞれ重ならずに検出され、右足のボーンB61及びボーンB71は左足のボーンB62及びボーンB72よりも多少折れ曲がっている。

図5は、しゃがみ込んでいる状態の人物を検出する例である。図5では、しゃがみ込んでいる人物が右側から撮像されており、右側から見たボーンB1、ボーンB51及びボーンB52、ボーンB61及びボーンB62、ボーンB71及びボーンB72がそれぞれ検出され、右足のボーンB61及びボーンB71と左足のボーンB62及びボーンB72は大きく折れ曲がり、かつ、重なっている。

図1に戻り、算出部12は、人体毎に、検出されたキーポイントの品質値を算出する。そして、算出部12は、検出されたキーポイントの品質値が閾値以上である人体が写る画像内の箇所を特定する。以下、これらの処理を詳細に説明する。

-検出されたキーポイントの品質値を算出する処理-

算出部12は、検出されたキーポイントの品質値を算出する。「検出されたキーポイントの品質値」は、検出されたキーポイントの質がどれだけ良いものかを示す値であり、各種データに基づき算出することができる。本実施形態では、算出部12は、キーポイントの検出結果の確信度に基づき品質値を算出する。以下の実施形態で、キーポイントの検出結果の確信度以外のデータに基づき上記品質値を算出する例を説明する。確信度の算出方法は特段制限されない。例えば、OpenPose等の骨格推定技術において、検出された各キーポイントに紐付けて出力されるスコアを、各キーポイントの確信度としてもよい。

算出部12は、検出されたキーポイントの品質値を算出する。「検出されたキーポイントの品質値」は、検出されたキーポイントの質がどれだけ良いものかを示す値であり、各種データに基づき算出することができる。本実施形態では、算出部12は、キーポイントの検出結果の確信度に基づき品質値を算出する。以下の実施形態で、キーポイントの検出結果の確信度以外のデータに基づき上記品質値を算出する例を説明する。確信度の算出方法は特段制限されない。例えば、OpenPose等の骨格推定技術において、検出された各キーポイントに紐付けて出力されるスコアを、各キーポイントの確信度としてもよい。

算出部12は、キーポイントの検出結果の確信度が高いほど、高い品質値を算出する。例えば、算出部12は、各人体から検出されたN個のキーポイント各々の確信度の統計値(平均値、最大値、最小値、中央値、最頻値、重み付け平均値等)を品質値として算出してもよい。N個のキーポイントの中の一部が検出されていない場合、その検出されていないキーポイントの確信度は「0」等の固定値としてもよい。この固定値は、検出されたキーポイントの確信度よりも低い値とする。

なお、画像が静止画像の場合、算出部12は、その静止画像から検出された人体毎に、品質値を算出する。一方、画像が動画像の場合、算出部12は、複数のフレーム画像各々から検出された人体毎に、品質値を算出する。

-検出されたキーポイントの品質値が閾値以上である人体が写る画像内の箇所を特定する処理-

算出部12は、上述した品質値を算出する処理の算出結果に基づき、検出されたキーポイントの品質値が閾値以上である人体が写る画像内の箇所を特定する。算出部12は、検出された人体毎に、検出されたキーポイントの品質値が閾値以上か判定する。そして、算出部12は、判定結果に応じて、品質値が閾値以上である人体が写る箇所を特定する。

算出部12は、上述した品質値を算出する処理の算出結果に基づき、検出されたキーポイントの品質値が閾値以上である人体が写る画像内の箇所を特定する。算出部12は、検出された人体毎に、検出されたキーポイントの品質値が閾値以上か判定する。そして、算出部12は、判定結果に応じて、品質値が閾値以上である人体が写る箇所を特定する。

画像が静止画像である場合、「品質値が閾値以上である人体が写る箇所」は、1枚の静止画像内の一部領域となる。この場合、例えば画像に設定された座標系の座標で、検出されたキーポイントの品質値が閾値以上である人体が写る画像内の箇所が示される。

一方、画像が動画像である場合、「品質値が閾値以上である人体が写る箇所」は、動画像を構成する複数のフレーム画像の中の一部のフレーム画像各々内の一部領域となる。この場合、例えば複数のフレーム画像の中の一部のフレーム画像を示す情報(フレーム識別情報、冒頭からの経過時間等)と、画像に設定された座標系の座標とで、検出されたキーポイントの品質値が閾値以上である人体が写る画像内の箇所が示される。

なお、画像が動画像である場合、「同一人物の人体が継続して写っており、かつ"その人体から検出されたキーポイントの品質値が閾値以上"という条件を満たす複数のフレーム画像各々においてその人体が写る箇所」を特定することが好ましい。

そこで、算出部12は、複数のフレーム画像に跨って写っている同一人物の人体を特定してもよい。当該特定を実現する手法は特段制限されない。例えば、人物追跡技術や顔認証技術等を利用して複数のフレーム画像に跨って写っている同一人物を特定し、同一人物が写っている複数のフレーム画像各々内の位置で検出された人体を、同一人物の人体として特定してもよい。当該処理により、算出部12は、同一人物の人体が継続して写っている複数のフレーム画像を特定することができる。

次に、"その人体から検出されたキーポイントの品質値が閾値以上"という条件について説明する。この条件は、複数のフレーム画像の全てが当該条件を満たすことを要求するものであってもよい。すなわち、算出部12は、同一人物の人体が継続して写っており、かつ、すべてのフレーム画像においてその人体から検出されたキーポイントの品質値が閾値以上となっている複数のフレーム画像を特定してもよい。

その他、上記条件は、複数のフレーム画像の少なくとも一部が上記条件を満たすことを要求するものであってもよい。すなわち、算出部12は、同一人物の人体が継続して写っており、かつ、少なくとも一部のフレーム画像においてその人体から検出されたキーポイントの品質値が閾値以上となっている複数のフレーム画像を特定してもよい。この場合、上記複数のフレーム画像の条件として、さらに、「品質値が閾値未満となる人体が写るフレーム画像が連続する数はQ個以下」等を付与してもよい。このような追加の条件を付与することで、品質値が低い人体が所定フレーム数以上連続して現れている箇所がテンプレート画像の候補として特定される不都合を抑制できる。

出力部13は、品質値が閾値以上である人体(検出されたキーポイントの品質値が閾値上である人体のこと)が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力する。画像が動画像である場合、出力部13は、同一人物の人体が継続して写っており、かつ"その人体から検出されたキーポイントの品質値が閾値以上"という条件を満たす複数のフレーム画像各々においてその人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力してもよい。

なお、出力部13が部分画像を出力する場合、画像処理装置10は、画像から、品質値が閾値以上である人体が写る箇所を切り出して部分画像を生成する処理部を有することができる。そして、出力部13は、処理部が生成した部分画像を出力することができる。

「品質値が閾値以上である人体が写る箇所」が、テンプレート画像の候補となる。ユーザは、上記情報又は上記部分画像に基づき、品質値が閾値以上である人体が写る箇所を閲覧等し、所望の姿勢や所望の動きの人体を含む箇所を、テンプレート画像として選別することができる。

図6に、出力部13が出力した情報の一例を模式的に示す。図6に示す例では、検出された複数の人体を互いに識別するための人体識別情報と、各人体の属性情報とが互いに紐付けて表示されている。そして、属性情報の一例として、品質値、画像内箇所を示す情報(上述した人体が写る箇所を示す情報)、画像の撮影日時が表示されている。属性情報は、その他、画像を撮影したカメラの設置位置(撮影位置)を示す情報(例:102号バス車内後方、〇〇公園入口等)や、画像解析で算出される人物の属性情報(例:性別、年齢層、体型等)を含んでもよい。

次に、図7のフローチャートを用いて、画像処理装置10の処理の流れの一例を説明する。

画像処理装置10にテンプレート画像の元とする画像を入力すると、画像処理装置10は、画像に含まれる人体のキーポイントを検出する処理を行う(S10)。次いで、画像処理装置10は、検出された人体毎に、検出されたキーポイントの品質値を算出する(S11)。次いで、画像処理装置10は、検出された人体毎に、検出されたキーポイントの品質値が閾値以上か判定する(S12)。次いで、画像処理装置10は、S12の判定結果に応じて、品質値が閾値以上である人体が写る箇所を特定する(S13)。そして、画像処理装置10は、品質値が閾値以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力する(S14)。

「作用効果」

第2の実施形態の画像処理装置10によれば、第1の実施形態と同様の作用効果が実現される。また、第2の実施形態の画像処理装置10によれば、キーポイントの検出結果の確信度が高い人体が写る箇所を、テンプレート画像の候補としてユーザに提示することができる。ユーザは、このように提示されたテンプレート画像の候補の中からテンプレート画像を選別することで、キーポイントの検出結果の確信度が一定の品質を満たすテンプレート画像を容易に用意することができる。

第2の実施形態の画像処理装置10によれば、第1の実施形態と同様の作用効果が実現される。また、第2の実施形態の画像処理装置10によれば、キーポイントの検出結果の確信度が高い人体が写る箇所を、テンプレート画像の候補としてユーザに提示することができる。ユーザは、このように提示されたテンプレート画像の候補の中からテンプレート画像を選別することで、キーポイントの検出結果の確信度が一定の品質を満たすテンプレート画像を容易に用意することができる。

<第3の実施形態>

第3の実施形態の画像処理装置10は、品質値の算出の仕方が第1及び第2の実施形態と異なる。

第3の実施形態の画像処理装置10は、品質値の算出の仕方が第1及び第2の実施形態と異なる。

算出部12は、検出されたキーポイントの数が相対的に多い人体の品質値を、検出されたキーポイントの数が相対的に少ない人体の品質値よりも高く算出する。例えば、算出部12は、検出されたキーポイントの数を品質値としてもよい。その他、複数のキーポイント各々に重み付けポイントが設定されていてもよい。相対的に重要なキーポイントほど高い重み付けポイントが設定される。そして、算出部12は、検出されたキーポイント各々の重み付けポイントを足し合わせた値を品質値として算出してもよい。

その他、算出部12は、第2の実施形態で説明した手法と、上記検出されたキーポイントの数に基づく手法を組み合わせて品質値を算出してもよい。例えば、算出部12は、第2の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第1の品質値を算出するとともに、上記検出されたキーポイントの数に基づく手法で算出した品質値を所定のルールで正規化して第2の品質値を算出する。そして、算出部12は、第1の品質値と第2の品質値の統計値(平均値、最大値、最小値、中央値、最頻値、重み付け平均値等)を、人体の品質値として算出してもよい。

第3の実施形態の画像処理装置10のその他の構成は、第1及び第2の実施形態と同様である。

第3の実施形態の画像処理装置10によれば、第1及び第2の実施形態と同様の作用効果が実現される。また、第3の実施形態の画像処理装置10によれば、多くのキーポイントが検出された人体が写る箇所を、テンプレート画像の候補としてユーザに提示することができる。ユーザは、このように提示されたテンプレート画像の候補の中からテンプレート画像を選別することで、検出されたキーポイントの数が一定の品質を満たすテンプレート画像を容易に用意することができる。

<第4の実施形態>

第4の実施形態の画像処理装置10は、品質値の算出の仕方が第1乃至第3の実施形態と異なる。

第4の実施形態の画像処理装置10は、品質値の算出の仕方が第1乃至第3の実施形態と異なる。

算出部12は、他の人体との重なり度合に基づき、品質値を算出する。なお、「人物Aの人体が人物Bの人体と重なっている状態」は、人物Aの人体が人物Bの人体により一部もしくは全部を隠されている状態、人物Aの人体が人物Bの人体の一部もしくは全部を隠している状態、及び、その両方が発生している状態を含む。以下、当該算出の手法を具体的に説明する。

-第1の手法-

算出部12は、他の人体と重なっていない人体の品質値を、他の人体と重なっている人体の品質値よりも高く算出する。例えば、他の人体と重なっていない人体の品質値をX1とし、他の人体と重なっている人体の品質値をX2とするルールが予め作成され、画像処理装置10に記憶される。なお、X1>X2である。そして、算出部12は、当該ルールに基づき、他の人体と重なっていない人体の品質値をX1と算出し、他の人体と重なっている人体の品質値をX2と算出する。この場合、出力部13は、品質値がY以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力することができる。なお、X1>Y>X2である。

算出部12は、他の人体と重なっていない人体の品質値を、他の人体と重なっている人体の品質値よりも高く算出する。例えば、他の人体と重なっていない人体の品質値をX1とし、他の人体と重なっている人体の品質値をX2とするルールが予め作成され、画像処理装置10に記憶される。なお、X1>X2である。そして、算出部12は、当該ルールに基づき、他の人体と重なっていない人体の品質値をX1と算出し、他の人体と重なっている人体の品質値をX2と算出する。この場合、出力部13は、品質値がY以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力することができる。なお、X1>Y>X2である。

他の人体と重なっているか否かは、骨格構造検出部11が検出した人体モデル300(図3参照)の重なり度合に基づき特定してもよいし、画像に写る身体の重なり度合に基づき特定してもよい。

例えば、2つの人体の所定のキーポイント(例:頭A1)の画像内の距離が閾値以下である場合、その2つの人体は重なり合うと判定してもよい。この場合、閾値は、検出された人体の画像内での大きさに応じて変わる可変値であってもよい。検出された人体の画像内での大きさが大きいほど、閾値も大きくなる。なお、人体の画像内での大きさに代えて、所定のボーン(例:頭A1と首A2とを結ぶボーンB1)の長さや、画像内の顔の大きさ等を採用してもよい。

その他、ある人体のいずれかのボーンが他の人体のいずれかのボーンと交わっている場合、その2つの人体は互いに重なり合っていると判定してもよい。

-第2の手法-

算出部12は、他の人体と重なっていない人体の品質値を、他の人体と重なっている人体の品質値よりも高く算出するとともに、他の人体と重なっている人体のうち、前側に位置する人体の品質値を、後ろ側に位置する人体の品質値よりも高く算出する。

算出部12は、他の人体と重なっていない人体の品質値を、他の人体と重なっている人体の品質値よりも高く算出するとともに、他の人体と重なっている人体のうち、前側に位置する人体の品質値を、後ろ側に位置する人体の品質値よりも高く算出する。

すなわち、算出部12は、他の人体と重なっていない人体の品質値を最も高く算出し、他の人体と重なっているが前側に位置する人体の品質値を次に高く算出し、他の人体と重なっており後ろ側に位置する人体の品質値を最も低く算出する。

例えば、他の人体と重なっていない人体の品質値をX1とし、他の人体と重なっており前側に位置する人体の品質値X21とし、他の人体と重なっており後ろ側に位置する人体の品質値X22とするルールが予め作成され、画像処理装置10に記憶される。なお、X1>X21>X22である。そして、算出部12は、当該ルールに基づき、他の人体と重なっていない人体の品質値をX1と算出し、他の人体と重なっており前側に位置する人体の品質値をX21と算出し、他の人体と重なっており後ろ側に位置する人体の品質値をX22と算出する。この場合、出力部13は、品質値がZ以上である人体が写る箇所を示す情報、又は画像から当該箇所を切り出した部分画像を出力することができる。なお、X1>X21>Z>X22、又は、X1>Z>X21>X22である。

他の人体よりも前側にいるか後ろ側にいるかは、骨格構造検出部11が検出した人体モデル300(図3参照)の隠れ具合または欠損具合に基づき特定してもよいし、画像に写る身体の隠れ具合に基づき特定してもよい。例えば、互いに重なっている2つの人体のうち、一方はN個全てのキーポイントが検出され、他方はN個のキーポイントのうちの一部のみが検出されている場合、N個全てのキーポイントが検出された人体が前側に位置し、他方の人体が後ろ側に位置すると判断できる。

なお、算出部12は、第2及び第3の実施形態で説明した手法の少なくとも一方と、上記他の人体との重なり度合に基づく手法を組み合わせて品質値を算出してもよい。例えば、算出部12は、第2の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第1の品質値を算出する処理、及び第3の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第2の品質値を算出する処理の少なくとも一方を行う。また、算出部12は、上記他の人体との重なり度合に基づく手法で算出した品質値を所定のルールで正規化して第3の品質値を算出する。そして、算出部12は、第1及び第2の品質値の少なくとも一方と、第3の品質値との統計値(平均値、最大値、最小値、中央値、最頻値、重み付け平均値等)を、人体の品質値として算出してもよい。

第4の実施形態の画像処理装置10のその他の構成は、第1乃至第3の実施形態と同様である。

第4の実施形態の画像処理装置10によれば、第1乃至第3の実施形態と同様の作用効果が実現される。また、第4の実施形態の画像処理装置10によれば、他の人体と重なっていない人体が写る箇所を、テンプレート画像の候補としてユーザに提示することができる。また、第4の実施形態の画像処理装置10によれば、他の人体と重なっていない人体が写る箇所に加えて、他の人体と重なっているが前側に位置する人体が写る箇所を、テンプレート画像の候補としてユーザに提示することができる。ユーザは、このように提示されたテンプレート画像の候補の中からテンプレート画像を選別することで、他の人体との重なり度合が一定の品質を満たすテンプレート画像を容易に用意することができる。

<第5の実施形態>

第5の実施形態の画像処理装置10は、品質値の算出の仕方が第1乃至第4の実施形態と異なる。

第5の実施形態の画像処理装置10は、品質値の算出の仕方が第1乃至第4の実施形態と異なる。

まず、骨格構造検出部11は、画像内で人物領域を検出し、検出した前記人物領域内でキーポイントを検出する処理を行う。すなわち、骨格構造検出部11は、画像内の全ての領域を、キーポイントを検出する処理の対象とするのでなく、検出した人物領域のみを、キーポイントを検出する処理の対象とする。画像内で人物領域を検出する処理の詳細は特段制限されず、例えばYOLO等の物体検出技術を用いて実現されてもよい。

そして、算出部12は、上記人物領域の検出結果の確信度に基づき、品質値を算出する。人物領域の検出結果の確信度の算出方法は特段制限されない。例えば、YOLO等の物体検出技術において、検出された物体領域に紐付けて出力されるスコア(信頼度等と言う場合もある)を、各人物領域の確信度としてもよい。

算出部12は、人物領域の検出結果の確信度が高いほど、高い品質値を算出する。例えば、算出部12は、人物領域の検出結果の確信度を品質値として算出してもよい。

また、算出部12は、第2乃至第4の実施形態で説明した手法の少なくとも1つと、上記人物領域の検出結果の確信度に基づく手法を組み合わせて品質値を算出してもよい。例えば、算出部12は、第2の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第1の品質値を算出する処理、第3の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第2の品質値を算出する処理、及び第4の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第3の品質値を算出する処理の少なくとも1つを行う。また、算出部12は、上記人物領域の検出結果の確信度に基づく手法で算出した品質値を所定のルールで正規化して第4の品質値を算出する。そして、算出部12は、第1乃至第3の品質値の少なくとも1つと、第4の品質値との統計値(平均値、最大値、最小値、中央値、最頻値、重み付け平均値等)を、人体の品質値として算出してもよい。

第5の実施形態の画像処理装置10のその他の構成は、第1乃至第4の実施形態と同様である。

第5の実施形態の画像処理装置10によれば、第1乃至第4の実施形態と同様の作用効果が実現される。また、第5の実施形態の画像処理装置10によれば、人物が高い確信度で写る箇所を、テンプレート画像の候補としてユーザに提示することができる。ユーザは、このように提示されたテンプレート画像の候補の中からテンプレート画像を選別することで、人物領域の検出結果が一定の品質を満たすテンプレート画像を容易に用意することができる。

<第6の実施形態>

第6の実施形態の画像処理装置10は、品質値の算出の仕方が第1乃至第5の実施形態と異なる。

第6の実施形態の画像処理装置10は、品質値の算出の仕方が第1乃至第5の実施形態と異なる。

算出部12は、画像上での人体の大きさに基づき、品質値を算出する。算出部12は、相対的に大きい人体の品質値を、相対的に小さい人体の品質値よりも高く算出する。画像上での人体の大きさは、第5の実施形態で示した人物領域の大きさ(面積等)で示されてもよいし、所定のボーン(例:ボーンB1)の長さで示されてもよいし、所定の2つのキーポイント(例:キーポイントA31とA32)間の長さで示されてもよいし、その他の手法で示されてもよい。

また、算出部12は、第2乃至第5の実施形態で説明した手法の少なくとも1つと、上記画像上での人体の大きさに基づく手法を組み合わせて品質値を算出してもよい。例えば、算出部12は、第2の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第1の品質値を算出する処理、第3の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第2の品質値を算出する処理、第4の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第3の品質値を算出する処理、及び第5の実施形態で説明した手法で算出した品質値を所定のルールで正規化して第4の品質値を算出する処理の少なくとも1つを行う。また、算出部12は、上記画像上での人体の大きさに基づく手法で算出した品質値を所定のルールで正規化して第5の品質値を算出する。そして、算出部12は、第1乃至第4の品質値の少なくとも1つと、第5の品質値との統計値(平均値、最大値、最小値、中央値、最頻値、重み付け平均値等)を、人体の品質値として算出してもよい。

第6の実施形態の画像処理装置10のその他の構成は、第1乃至第5の実施形態と同様である。

第6の実施形態の画像処理装置10によれば、第1乃至第5の実施形態と同様の作用効果が実現される。また、第6の実施形態の画像処理装置10によれば、人体がある程度大きく写る箇所を、テンプレート画像の候補としてユーザに提示することができる。ユーザは、このように提示されたテンプレート画像の候補の中からテンプレート画像を選別することで、人体の大きさが一定の品質を満たすテンプレート画像を容易に用意することができる。

<変形例1>

複数のカメラで同一人物を同時に撮影した複数の画像が画像処理装置10に入力された場合であって、複数の画像各々から検出された同一人物の人体いずれもが検出されたキーポイントの品質値が閾値以上である場合、出力部13は、複数の画像各々から検出された同一人物の人体のうちの上記品質値が最も高い人体が写る箇所を示す情報、またはその画像からその箇所を切り出した部分画像を出力してもよい。当該変形例においては、「品質値が閾値以上である人体が写る箇所を示す情報」の中に、第2の実施形態で説明した情報に加えて、画像の識別情報が含まれる。

複数のカメラで同一人物を同時に撮影した複数の画像が画像処理装置10に入力された場合であって、複数の画像各々から検出された同一人物の人体いずれもが検出されたキーポイントの品質値が閾値以上である場合、出力部13は、複数の画像各々から検出された同一人物の人体のうちの上記品質値が最も高い人体が写る箇所を示す情報、またはその画像からその箇所を切り出した部分画像を出力してもよい。当該変形例においては、「品質値が閾値以上である人体が写る箇所を示す情報」の中に、第2の実施形態で説明した情報に加えて、画像の識別情報が含まれる。

<変形例2>

上記実施形態では、画像が動画像である場合、「品質値が閾値以上である人体が写る箇所」は、動画像を構成する複数のフレーム画像の中の一部のフレーム画像各々内の一部領域であった。そして、出力部13は、このような箇所を示す情報や、画像からこのような箇所を切り出した部分画像を出力した。これは、1つのフレーム画像に複数の人体が含まれ得ることを想定した構成である。

上記実施形態では、画像が動画像である場合、「品質値が閾値以上である人体が写る箇所」は、動画像を構成する複数のフレーム画像の中の一部のフレーム画像各々内の一部領域であった。そして、出力部13は、このような箇所を示す情報や、画像からこのような箇所を切り出した部分画像を出力した。これは、1つのフレーム画像に複数の人体が含まれ得ることを想定した構成である。

変形例として、画像が動画像である場合、品質値が閾値以上である人体が写る箇所は、動画像を構成する複数のフレーム画像の中の一部であってもよい。そして、出力部13は、このような複数のフレーム画像の中の一部を示す情報や、画像から一部のフレーム画像を切り出した部分画像を出力してもよい。また、品質値が閾値以上である人体が映るフレーム画像自体をテンプレート画像の候補として出力してもよい。これは、1つのフレーム画像に品質値が閾値以上である人体が1つだけ含まれ得ることを想定した構成である。

以上、図面を参照して本発明の実施形態について述べたが、これらは本発明の例示であり、上記以外の様々な構成を採用することもできる。

また、上述の説明で用いた複数のフローチャートでは、複数の工程(処理)が順番に記載されているが、各実施形態で実行される工程の実行順序は、その記載の順番に制限されない。各実施形態では、図示される工程の順番を内容的に支障のない範囲で変更することができる。また、上述の各実施形態は、内容が相反しない範囲で組み合わせることができる。

上記の実施形態の一部または全部は、以下の付記のようにも記載されうるが、以下に限られない。

1. 画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段と、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段と、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段と、

を有する画像処理装置。

2. 前記算出手段は、前記キーポイントの検出結果の確信度に基づき、前記品質値を算出する1に記載の画像処理装置。

3. 前記骨格構造検出手段は、前記画像内で人物領域を検出し、検出した前記人物領域内で前記キーポイントを検出する処理を行い、

前記算出手段は、前記人物領域の検出結果の確信度に基づき、前記品質値を算出する1又は2に記載の画像処理装置。

4. 前記算出手段は、他の人体との重なり度合に基づき、前記品質値を算出する1から3のいずれかに記載の画像処理装置。

5. 前記算出手段は、他の人体と重なっていない人体の前記品質値を、他の人体と重なっている人体の前記品質値よりも高く算出する4に記載の画像処理装置。

6. 前記算出手段は、他の人体と重なっている人体のうち、前側に位置する人体の前記品質値を、後ろ側に位置する人体の前記品質値よりも高く算出する5に記載の画像処理装置。

7. 前記算出手段は、検出された前記キーポイントの数が相対的に多い人体の前記品質値を、検出された前記キーポイントの数が相対的に少ない人体の前記品質値よりも高く算出する1から6のいずれかに記載の画像処理装置。

8. 前記算出手段は、前記画像上での人体の大きさに基づき、前記品質値を算出する1から7のいずれかに記載の画像処理装置。

9. 1以上のコンピュータが、

画像に含まれる人体のキーポイントを検出する処理を行い、

人体毎に、検出された前記キーポイントの品質値を算出し、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する、

画像処理方法。

10. コンピュータを、

画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段、

として機能させるプログラム

1. 画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段と、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段と、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段と、

を有する画像処理装置。

2. 前記算出手段は、前記キーポイントの検出結果の確信度に基づき、前記品質値を算出する1に記載の画像処理装置。

3. 前記骨格構造検出手段は、前記画像内で人物領域を検出し、検出した前記人物領域内で前記キーポイントを検出する処理を行い、

前記算出手段は、前記人物領域の検出結果の確信度に基づき、前記品質値を算出する1又は2に記載の画像処理装置。

4. 前記算出手段は、他の人体との重なり度合に基づき、前記品質値を算出する1から3のいずれかに記載の画像処理装置。

5. 前記算出手段は、他の人体と重なっていない人体の前記品質値を、他の人体と重なっている人体の前記品質値よりも高く算出する4に記載の画像処理装置。

6. 前記算出手段は、他の人体と重なっている人体のうち、前側に位置する人体の前記品質値を、後ろ側に位置する人体の前記品質値よりも高く算出する5に記載の画像処理装置。

7. 前記算出手段は、検出された前記キーポイントの数が相対的に多い人体の前記品質値を、検出された前記キーポイントの数が相対的に少ない人体の前記品質値よりも高く算出する1から6のいずれかに記載の画像処理装置。

8. 前記算出手段は、前記画像上での人体の大きさに基づき、前記品質値を算出する1から7のいずれかに記載の画像処理装置。

9. 1以上のコンピュータが、

画像に含まれる人体のキーポイントを検出する処理を行い、

人体毎に、検出された前記キーポイントの品質値を算出し、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する、

画像処理方法。

10. コンピュータを、

画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段、

として機能させるプログラム

10 画像処理装置

11 骨格構造検出部

12 算出部

13 出力部

1A プロセッサ

2A メモリ

3A 入出力I/F

4A 周辺回路

5A バス

11 骨格構造検出部

12 算出部

13 出力部

1A プロセッサ

2A メモリ

3A 入出力I/F

4A 周辺回路

5A バス

Claims (10)

- 画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段と、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段と、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段と、

を有する画像処理装置。 - 前記算出手段は、前記キーポイントの検出結果の確信度に基づき、前記品質値を算出する請求項1に記載の画像処理装置。

- 前記骨格構造検出手段は、前記画像内で人物領域を検出し、検出した前記人物領域内で前記キーポイントを検出する処理を行い、

前記算出手段は、前記人物領域の検出結果の確信度に基づき、前記品質値を算出する請求項1又は2に記載の画像処理装置。 - 前記算出手段は、他の人体との重なり度合に基づき、前記品質値を算出する請求項1から3のいずれか1項に記載の画像処理装置。

- 前記算出手段は、他の人体と重なっていない人体の前記品質値を、他の人体と重なっている人体の前記品質値よりも高く算出する請求項4に記載の画像処理装置。

- 前記算出手段は、他の人体と重なっている人体のうち、前側に位置する人体の前記品質値を、後ろ側に位置する人体の前記品質値よりも高く算出する請求項5に記載の画像処理装置。

- 前記算出手段は、検出された前記キーポイントの数が相対的に多い人体の前記品質値を、検出された前記キーポイントの数が相対的に少ない人体の前記品質値よりも高く算出する請求項1から6のいずれか1項に記載の画像処理装置。

- 前記算出手段は、前記画像上での人体の大きさに基づき、前記品質値を算出する請求項1から7のいずれか1項に記載の画像処理装置。

- 1以上のコンピュータが、

画像に含まれる人体のキーポイントを検出する処理を行い、

人体毎に、検出された前記キーポイントの品質値を算出し、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する、

画像処理方法。 - コンピュータを、

画像に含まれる人体のキーポイントを検出する処理を行う骨格構造検出手段、

人体毎に、検出された前記キーポイントの品質値を算出する算出手段、

前記品質値が閾値以上である人体が写る箇所を示す情報、又は前記画像から前記箇所を切り出した部分画像を出力する出力手段、

として機能させるプログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2022/005675 WO2023152971A1 (ja) | 2022-02-14 | 2022-02-14 | 画像処理装置、画像処理方法、およびプログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2022/005675 WO2023152971A1 (ja) | 2022-02-14 | 2022-02-14 | 画像処理装置、画像処理方法、およびプログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2023152971A1 true WO2023152971A1 (ja) | 2023-08-17 |

Family

ID=87564097

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2022/005675 WO2023152971A1 (ja) | 2022-02-14 | 2022-02-14 | 画像処理装置、画像処理方法、およびプログラム |

Country Status (1)

| Country | Link |

|---|---|

| WO (1) | WO2023152971A1 (ja) |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021135877A (ja) * | 2020-02-28 | 2021-09-13 | Kddi株式会社 | 骨格追跡方法、装置およびプログラム |

| WO2021229751A1 (ja) * | 2020-05-14 | 2021-11-18 | 日本電気株式会社 | 画像選択装置、画像選択方法、およびプログラム |

| WO2021250808A1 (ja) * | 2020-06-10 | 2021-12-16 | 日本電気株式会社 | 画像処理装置、画像処理方法、及びプログラム |

-

2022

- 2022-02-14 WO PCT/JP2022/005675 patent/WO2023152971A1/ja unknown

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021135877A (ja) * | 2020-02-28 | 2021-09-13 | Kddi株式会社 | 骨格追跡方法、装置およびプログラム |

| WO2021229751A1 (ja) * | 2020-05-14 | 2021-11-18 | 日本電気株式会社 | 画像選択装置、画像選択方法、およびプログラム |

| WO2021250808A1 (ja) * | 2020-06-10 | 2021-12-16 | 日本電気株式会社 | 画像処理装置、画像処理方法、及びプログラム |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| Khraief et al. | Elderly fall detection based on multi-stream deep convolutional networks | |

| US9330307B2 (en) | Learning based estimation of hand and finger pose | |

| Bobick et al. | The recognition of human movement using temporal templates | |

| WO2022009301A1 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| Mikolajczyk et al. | Face detection in a video sequence-a temporal approach | |

| Kumar et al. | 3D sign language recognition using spatio temporal graph kernels | |

| WO2021250808A1 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| WO2021229751A1 (ja) | 画像選択装置、画像選択方法、およびプログラム | |

| Ueng et al. | Vision based multi-user human computer interaction | |

| WO2023152971A1 (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| Polat et al. | A nonparametric adaptive tracking algorithm based on multiple feature distributions | |

| JP7435781B2 (ja) | 画像選択装置、画像選択方法、及びプログラム | |

| WO2023152973A1 (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| WO2022079794A1 (ja) | 画像選択装置、画像選択方法、及びプログラム | |

| WO2022009279A1 (ja) | 画像選択装置、画像選択方法、及びプログラム | |

| WO2023152977A1 (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| WO2023152974A1 (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| JP7468642B2 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| JP6308011B2 (ja) | 同一対象検出装置、同一対象検出方法、及び同一対象検出プログラム | |

| JP7485040B2 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| WO2023084778A1 (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| WO2023084780A1 (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| JP7302741B2 (ja) | 画像選択装置、画像選択方法、およびプログラム | |

| JP7364077B2 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| WO2022003854A1 (ja) | 画像処理装置、画像処理方法、及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| 121 | Ep: the epo has been informed by wipo that ep was designated in this application |

Ref document number: 22925990 Country of ref document: EP Kind code of ref document: A1 |