WO2023042402A1 - 行動監視システムおよび行動監視方法 - Google Patents

行動監視システムおよび行動監視方法 Download PDFInfo

- Publication number

- WO2023042402A1 WO2023042402A1 PCT/JP2021/034435 JP2021034435W WO2023042402A1 WO 2023042402 A1 WO2023042402 A1 WO 2023042402A1 JP 2021034435 W JP2021034435 W JP 2021034435W WO 2023042402 A1 WO2023042402 A1 WO 2023042402A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- monitored

- person

- monitoring system

- behavior monitoring

- unit

- Prior art date

Links

- 238000012544 monitoring process Methods 0.000 title claims abstract description 61

- 238000000034 method Methods 0.000 title claims description 32

- 238000012545 processing Methods 0.000 claims abstract description 57

- 238000001514 detection method Methods 0.000 claims abstract description 30

- 230000033001 locomotion Effects 0.000 claims description 26

- 230000035484 reaction time Effects 0.000 claims description 10

- 230000007423 decrease Effects 0.000 claims description 7

- 230000003247 decreasing effect Effects 0.000 claims description 6

- 230000003542 behavioural effect Effects 0.000 claims 1

- 230000004044 response Effects 0.000 abstract description 6

- 238000005259 measurement Methods 0.000 description 36

- 230000008569 process Effects 0.000 description 24

- 238000012806 monitoring device Methods 0.000 description 19

- 230000009471 action Effects 0.000 description 11

- 238000004891 communication Methods 0.000 description 6

- 238000010586 diagram Methods 0.000 description 6

- 238000003384 imaging method Methods 0.000 description 5

- 238000011156 evaluation Methods 0.000 description 3

- 230000004913 activation Effects 0.000 description 2

- 238000001994 activation Methods 0.000 description 2

- 230000006866 deterioration Effects 0.000 description 2

- 230000036541 health Effects 0.000 description 2

- 230000002159 abnormal effect Effects 0.000 description 1

- 230000005856 abnormality Effects 0.000 description 1

- 238000012937 correction Methods 0.000 description 1

- 239000000284 extract Substances 0.000 description 1

- 238000009434 installation Methods 0.000 description 1

- 230000002452 interceptive effect Effects 0.000 description 1

- 238000004519 manufacturing process Methods 0.000 description 1

- 230000000474 nursing effect Effects 0.000 description 1

- 230000033764 rhythmic process Effects 0.000 description 1

- 230000004622 sleep time Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H40/00—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices

- G16H40/60—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices

- G16H40/67—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices for remote operation

-

- G—PHYSICS

- G08—SIGNALLING

- G08B—SIGNALLING OR CALLING SYSTEMS; ORDER TELEGRAPHS; ALARM SYSTEMS

- G08B21/00—Alarms responsive to a single specified undesired or abnormal condition and not otherwise provided for

- G08B21/02—Alarms for ensuring the safety of persons

- G08B21/04—Alarms for ensuring the safety of persons responsive to non-activity, e.g. of elderly persons

- G08B21/0407—Alarms for ensuring the safety of persons responsive to non-activity, e.g. of elderly persons based on behaviour analysis

- G08B21/0423—Alarms for ensuring the safety of persons responsive to non-activity, e.g. of elderly persons based on behaviour analysis detecting deviation from an expected pattern of behaviour or schedule

-

- G—PHYSICS

- G08—SIGNALLING

- G08B—SIGNALLING OR CALLING SYSTEMS; ORDER TELEGRAPHS; ALARM SYSTEMS

- G08B21/00—Alarms responsive to a single specified undesired or abnormal condition and not otherwise provided for

- G08B21/02—Alarms for ensuring the safety of persons

- G08B21/04—Alarms for ensuring the safety of persons responsive to non-activity, e.g. of elderly persons

- G08B21/0438—Sensor means for detecting

- G08B21/0469—Presence detectors to detect unsafe condition, e.g. infrared sensor, microphone

Definitions

- This specification discloses a behavior monitoring system and a behavior monitoring method.

- the management center acquires each piece of life data on a daily basis, obtains the average value and standard deviation for each piece of life data in a unit period, and obtains an eigenvector indicating the relationship between a plurality of pieces of life data in the unit period.

- the management center calculates standardized data of each life data using the average value and standard deviation of each life data in the unit period, and standardized data of each life data. and two eigenvector components of the eigenvectors indicating the relationship between each piece of life data, which have a great influence on the life rhythm of the elderly. Then, the management center determines the health condition of the elderly person by monitoring the overall gap between the obtained life pattern and the life pattern in the past unit period.

- the place where the force mat can be installed is limited to the entrance/exit of the room, and it may not be sufficient to monitor the behavior of the monitored person.

- the pedal force mat will interfere with their walking.

- the main purpose of the present disclosure is to enable appropriate monitoring of the behavior of the monitoring target with a simple configuration without interfering with the behavior of the monitoring target.

- a behavior monitoring system of the present disclosure is a behavior monitoring system for monitoring the behavior of a person to be monitored who lives in a dwelling, and is installed in the dwelling and detects the person to be monitored without contact within different detection ranges.

- a detection unit including a sensor; a storage unit for storing data; a processing unit that stores the reaction time as reaction data in the storage unit when there is a reaction to any of them, and calculates the moving distance of the monitored person for each unit time based on the data stored in the storage unit; The gist of it is to be prepared.

- the behavior monitoring system of this disclosure includes a detection unit, a storage unit, and a processing unit.

- the detection unit is installed in a residence and includes a plurality of motion sensors that detect the person to be monitored in a different detection range without contact.

- the processing unit acquires in advance the distance between two points of the plurality of human sensors and stores it in the storage unit. Then, when any of the plurality of motion sensors reacts, the reaction time is stored as reaction data in the storage unit, and based on the data stored in the storage unit, the moving distance of the person to be monitored per unit time is calculated. do.

- the detection unit is composed of a motion sensor that can detect the person to be monitored without contact, there is a degree of freedom in installation, and it can be installed in a position that does not interfere with the behavior of the person to be monitored.

- the moving distance of the monitoring subject per unit time is calculated based on the reaction data (reaction time) of each human sensor, the behavior of the monitoring subject can be appropriately monitored with a simple configuration.

- a behavior monitoring method of the present disclosure is a behavior monitoring method for monitoring the behavior of a person to be monitored living in a dwelling, wherein the person to be monitored is detected using a plurality of detection means in the dwelling. acquires the distance between two points of the detection means and stores it in a storage unit, and when there is a reaction in any of the plurality of detection means, stores the reaction time in the storage unit as reaction data,

- the gist of the invention is to calculate a movement distance of a person to be monitored per unit time based on data stored in the storage unit.

- the behavior monitoring method of the present disclosure calculates the movement distance of the monitoring subject per unit time based on the reaction data (reaction time) of a plurality of detection means, the behavior of the monitoring subject can be appropriately monitored with a simple configuration. can be monitored.

- a detection means such as a lighting switch installed in a residence as the detection means, the behavior of the person to be monitored can be monitored without installing a new sensor.

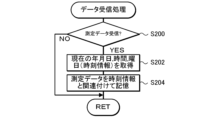

- FIG. 4 is a flowchart showing an example of data measurement processing; 6 is a flowchart showing an example of data reception processing; It is a flow chart which shows an example of action judging processing.

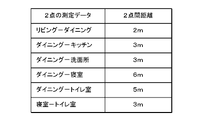

- FIG. 5 is an explanatory diagram showing an example of a distance table between two points; It is the figure which graphed the movement distance and the staying time of each room.

- FIG. 4 is an explanatory diagram showing how a surveillance camera is used to estimate a room in which a person to be monitored is present;

- FIG. 4 is an explanatory diagram showing how a surveillance camera is used to estimate a room in which a person to be monitored is present;

- FIG. 10 is an explanatory diagram showing how two motion sensors are used to estimate a room where a person to be monitored is present;

- FIG. 1 is a schematic configuration diagram of the behavior monitoring system 10 of this embodiment.

- the behavior monitoring system 10 of this embodiment includes a management server 20 that manages the entire system, and monitoring devices 30 that are installed in residences A to C where persons to be monitored live.

- the residences A to C are, for example, residences for the elderly or people requiring nursing care to live alone.

- FIG. It has a washroom, a bathroom, a toilet room, and an entrance.

- the behavior monitoring system 10 can be used, for example, to monitor the behavior of an elderly person or a person requiring care instead of a caregiver, and to quickly find an abnormality in the behavior.

- the monitoring device 30 includes a control section 31 , a communication section 32 , a display section 33 , a speaker 34 and sensors 40 .

- the control unit 31 is configured as a microprocessor centered around a CPU, and includes a ROM, a RAM, and the like in addition to the CPU.

- the display unit 33 and the speaker 34 output various information from the management server 20 by display and sound.

- the display unit 33 is configured as a touch panel type display unit that allows input by the operator.

- the sensors 40 are sensors for detecting where the person to be monitored who lives in the house is, and as shown in FIG. 46, 47 and a door sensor 48 provided at the front door.

- the human sensors 41 to 47 are sensors that detect a person within a detection area without contact, and are configured as infrared sensors that detect infrared rays and convert them into electrical signals, for example.

- Human sensors 41, 42, and 43 are provided in the living room, dining room, and kitchen of the LDK room, respectively.

- a human sensor 44 is provided in the bedroom, and a human sensor 45 is provided in the washroom.

- the human sensor 46 is provided in the bathroom, and the human sensor 47 is provided in the toilet room.

- the door sensor 48 detects opening and closing of the front door, and is configured as a magnet-type open/close sensor that has a permanent magnet fixed on the door side and a magnetic sensor fixed on the frame side, for example.

- the management server 20 includes a processing unit 21, a communication unit 22, and a storage unit 23.

- the processing unit 21 is configured as a microprocessor centered around a CPU, and includes a ROM, a RAM, and the like in addition to the CPU.

- the communication unit 22 of the management server 20 is connected to the communication unit 32 of each monitoring device 30 via the network 11 such as the Internet. exchange signals.

- the storage unit 23 is configured by an HDD, an SSD, or the like, receives data measured by each monitoring device 30, and stores the data for a certain period of time.

- the operation of each monitoring device 30 includes data measurement processing. Further, the operation of the management server 20 includes data reception processing and action determination processing.

- the data measurement process is the process of measuring (collecting) the whereabouts of the person being monitored from the sensors installed in each room of the residence.

- FIG. 3 is a flowchart showing an example of data measurement processing executed by the control unit 31 of each monitoring device 30. As shown in FIG. This process is repeatedly executed at predetermined time intervals.

- the control unit 31 of the monitoring device 30 first determines whether or not the human sensor 41 for the living room provided in the living room responds (step S100). When determining that the human sensor 41 for the living room responds, the control unit 31 determines that the monitored person is in the living room (step S102), and transmits the determination result to the management server 20 as measurement data. Then (step S136), the data measurement process ends.

- control unit 31 determines in step S100 that there is no response from the living sensor 41, it next determines whether there is a response from the dining sensor 42 provided in the dining room (step S100). S104). When the control unit 31 determines that the dining motion sensor 41 responds, it determines that the person to be monitored is in the dining room (step S106), and transmits the determination result to the management server 20 as measurement data. Then (step S136), the data measurement process ends.

- step S104 determines whether the human sensor 43 for the kitchen provided in the kitchen responds (step S104). S108).

- the control unit 31 determines that the human sensor 43 for the kitchen responds, it determines that the person to be monitored is in the kitchen (step S110), and transmits the determination result to the management server 20 as measurement data. Then (step S136), the data measurement process ends.

- step S108 determines whether the kitchen human sensor 43 provided in the bedroom responds. S112).

- step S114 determines that the person to be monitored is in the bedroom (step S114), and transmits the determination result to the management server 20 as measurement data. Then (step S136), the data measurement process ends.

- control unit 31 determines in step S112 that there is no response from the human sensor 44 for the bedroom, it next determines whether there is a response from the human sensor 45 for the washroom provided in the washroom (step S116). When determining that the human sensor 45 for the washroom responds, the control unit 31 determines that the person to be monitored is in the washroom (step S118), and sends the determination result to the management server 20 as measurement data. The data is transmitted (step S136), and the data measurement process ends.

- control unit 31 determines in step S116 that the human sensor 45 for the bathroom does not respond, it next determines whether the human sensor 46 for the bathroom provided in the bathroom responds (step S116). S120). When determining that the human sensor 46 for the bathroom responds, the control unit 31 determines that the monitored person is in the bathroom (step S122), and transmits the determination result to the management server 20 as measurement data. Then (step S136), the data measurement process ends.

- control unit 31 determines in step S120 that the human sensor 46 for the bathroom does not respond, it next determines whether the human sensor 47 for the toilet room provided in the toilet room responds. (Step S124). When determining that the human sensor 47 for the toilet room has responded, the control unit 31 determines that the person to be monitored is in the toilet room (step S126), and uses the determination result as measurement data to the management server 20. (step S136), and the data measurement process ends.

- step S124 determines whether the entrance door sensor 48 provided on the entrance door responds. S128).

- step S134 determines whether or not it is determined in step S134 described later that the person to be monitored is at home.

- step S132 determines that the person to be monitored has gone out (step S132), transmits the determination result to the management server 20 as measurement data (step S136), End the data measurement process.

- control unit 31 determines that the person to be monitored has not been determined to be at home (determined to be out of the house), it determines that the person to be monitored has returned home, that is, is at home (step S134). , the determination result is transmitted to the management server 20 as measurement data (step S136), and the data measurement process ends.

- the data reception process is a process of receiving measurement data transmitted from each monitoring device 30 .

- FIG. 4 is a flowchart showing an example of data reception processing executed by the processing unit 21 of the management server 20. As shown in FIG. This process is repeatedly executed at predetermined time intervals.

- the processing unit 21 of the management server 20 first determines whether measurement data has been received from the monitoring device 30 (step S200). When the processing unit 21 determines that the measurement data has not been received, it ends the data reception processing. On the other hand, when the processing unit 21 determines that it has received the measurement data, it accesses the time server via the Internet and acquires the current date, time (hour/minute/second) and day of the week as time information (step S202), the acquired time information is stored in the storage unit 23 in association with the received measurement data (step S204), and the data reception process ends.

- the time information may be obtained by reading the current time from an RTC (real time clock).

- FIG. 5 is a flowchart showing an example of action determination processing executed by the processing unit 21 of the management server 20. As shown in FIG. This process is repeatedly executed at predetermined time intervals.

- the processing unit 21 When the action determination process is executed, the processing unit 21 first stores measurement data (data of the room in which the person to be monitored was in) for a certain period of time (for example, one month or one week) in the storage unit 23. is accumulated (step S210). When the processing unit 21 determines that the measurement data for the fixed period has not been accumulated, the processing unit 21 ends the action determination processing. On the other hand, when the processing unit 21 determines that the measurement data for a certain period of time has been accumulated, the processing unit 21 sequentially extracts two points of measurement data that are continuous in time series from the measurement data for the certain period of time and have different room judgments ( Step S212), and the distance between two points is sequentially obtained based on the measurement data of the two points that are sequentially extracted (step S214).

- measurement data data of the room in which the person to be monitored was in

- a certain period of time for example, one month or one week

- the relationship between the measurement data of the two points and the distance between the two points is obtained in advance and registered in the storage unit 23 as a distance table between the two points. This is done by deriving the corresponding two-point distance from a two-point distance table.

- FIG. 6 shows an example of the distance table between two points.

- the processing unit 21 calculates the integrated value of the acquired distances between the two points for each unit time (for example, every 30 minutes or every hour), thereby calculating the unit time of the person to be monitored.

- the moving distance for each is calculated (step S216).

- the processing unit 21 aggregates the calculated movement distances for each unit time for each month, each week, and each day (step S218), and also counts the number of entry points for each room (by area) for each month, each week, and each day. The number of times is counted (step S220).

- the processing unit 21 compares the calculated moving distance with a value calculated in the past, and determines whether or not the moving distance of the monitored person has decreased by a predetermined amount or more (step S222). This determination may be made, for example, by comparing the value of the current day with the value of the previous day, the value of the current week with the value of the previous week, or the value of the current month with the value of the previous month. It may be done by comparing values. Alternatively, an evaluation value such as an average value of the aggregated values may be set, and the set evaluation value may be compared with past evaluation values.

- the processing unit 21 determines that the movement distance of the monitoring subject has not decreased by a predetermined amount or more, it determines that the walking function of the monitoring subject is normal (step S224), and outputs the determination result (normal) to the monitoring device 30. (step S232), and terminates the action determination process.

- the monitoring device 30 outputs from the display unit 33 or the speaker 34 that the current state is normal based on the received determination result.

- the processing unit 21 determines that the movement distance of the monitoring subject has decreased by a predetermined amount or more, it determines that the walking function of the monitoring subject has deteriorated (step S226). It is determined whether or not there is a room in which the number of times of entry has decreased by a predetermined amount or more by comparing with past values (step S228). This determination may be made for each room, for example, by comparing the current day's value with the previous day's value, the current week's value with the last week's value, or the current month's value. It may be done by comparing the value with the value of the previous month.

- the processing unit 21 determines that there is a corresponding room, it determines that there is an obstacle in the movement route toward the corresponding room (step S230), the walking function is deteriorated, and there is an obstacle in the movement route toward the corresponding room. is sent to the monitoring device 30 (step S232), and the action determination process is terminated.

- the processing unit 21 transmits the determination result that the walking function is degraded to the monitoring device 30 (step S232), and terminates the action determination process.

- the monitoring device 30 outputs to the display unit 33 and the speaker 34 the fact that the current state is abnormal and the content thereof based on the received determination result.

- the person to be monitored can recognize that the walking function is declining, which can be used for early treatment. Furthermore, by combining this with the presence or absence of a decrease in the number of times of entering the room, it is possible to confirm where the impact of the deterioration of walking function appears in daily life.

- the processing unit 21 transmits the movement distance per unit time, the number of times of room entry for each room, and the stay time for each room to the monitoring device 30, and the monitoring device 30 graphs these data. may be displayed on the display unit 33 (see FIG. 7).

- the processing unit 21 may transmit the determination result to a pre-registered information portable terminal such as a smart phone in order to notify the monitored person, the guardian of the monitored person, or the like.

- the human sensors 41 to 47 of the present embodiment correspond to the human sensors of the present disclosure

- the storage section 23 corresponds to the storage section

- the processing section 21 corresponds to the processing section

- the display unit 33 corresponds to the output unit.

- the human sensors 41 to 47 and the door sensor 48 correspond to detection means.

- the processing unit 21 estimates the room (area) where the person to be monitored is located based on the detection signals from the human sensors 41 to 47 provided in each room of the residence.

- a monitoring camera 141 is installed in some rooms (areas) in place of the human sensor, and the processing unit 21 detects the person to be monitored based on the imaging signal from the monitoring camera 141.

- the room (area) in which the user is present may be estimated.

- a destination room (area) may be estimated.

- the processing unit 21 detects that the person to be monitored is captured by the monitoring camera 141 whose imaging area is the dining room, and that the person to be monitored has moved toward the living room in the captured image. Once recognized, it can be inferred that the monitored person is in the living room.

- the processing unit 21 may use two human sensors whose detection areas are areas adjacent to each other to estimate the area where the person to be monitored exists even when the two human sensors do not react. .

- the processing unit 21 detects the presence of a person in the dining room.

- the sensitive sensor 42 changes from the unresponsive state to the responsive state to the unresponsive state, it can be estimated that the monitored person is in the living room. This makes it possible to reduce the number of human sensors.

- the processing unit 21 may detect the person to be monitored using a plurality of detection means pre-installed in the residence. For example, a person to be monitored may be detected based on signals from a plurality of lighting switches provided in each room for turning on and off the lighting in the room. In this case, the processing unit 21 registers the distance between rooms in advance, and when the lighting switch of one room is turned off from on among the rooms and then the lighting switch of the other room is turned on from off , the corresponding distance among the registered distances between rooms may be obtained as the moving distance.

- the processing unit acquires the distance between two points of the plurality of human sensors in advance and stores it in the storage unit. Then, when any of the plurality of motion sensors reacts, the reaction time is stored as reaction data in the storage unit, and based on the data stored in the storage unit, the moving distance of the person to be monitored per unit time is calculated. do. Since the motion sensor can detect the person to be monitored without contact, it can be installed at a position that does not interfere with the behavior of the person to be monitored. In addition, since the moving distance of the monitoring subject per unit time is calculated based on the reaction data (reaction time) of each human sensor, the behavior of the monitoring subject can be appropriately monitored with a simple configuration.

- the processing unit may further compare increases and decreases in the movement distance for each unit time in chronological order. By doing so, it is possible to accurately determine the deterioration of the monitoring subject's walking function with a simple configuration.

- an output unit may be provided that outputs a warning when the moving distance per unit time decreases by a predetermined distance or more in time series.

- the plurality of motion sensors are provided in each of the plurality of rooms of the residence, and the processing unit detects when any of the plurality of motion sensors reacts.

- the number of times a person to be monitored enters a room may be counted and stored in the storage unit. This makes it possible to appropriately grasp changes in the behavior of the person being monitored.

- the processing unit may further compare the increase/decrease in the number of times of room entry for each room in time series.

- an output unit may be provided that outputs a warning when the number of times of entering the room has decreased in time series by a predetermined number or more.

- the present disclosure is not limited to the form of a behavior monitoring system, and can also be in the form of a behavior monitoring method.

- the person to be monitored is detected using a plurality of detection means in the residence, and the distance between two points among the plurality of detection means is acquired in advance and stored in the storage unit.

- the reaction time is stored as reaction data in the storage unit, and the moving distance of the person to be monitored per unit time is calculated based on the data stored in the storage unit.

- the present disclosure can be used in the manufacturing industry of behavior monitoring systems.

Landscapes

- Health & Medical Sciences (AREA)

- Engineering & Computer Science (AREA)

- Biomedical Technology (AREA)

- Business, Economics & Management (AREA)

- General Health & Medical Sciences (AREA)

- Medical Informatics (AREA)

- Epidemiology (AREA)

- Public Health (AREA)

- Primary Health Care (AREA)

- General Business, Economics & Management (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Emergency Management (AREA)

- Gerontology & Geriatric Medicine (AREA)

- Psychiatry (AREA)

- Human Computer Interaction (AREA)

- Social Psychology (AREA)

- Psychology (AREA)

- Alarm Systems (AREA)

- Emergency Alarm Devices (AREA)

Abstract

Description

Claims (7)

- 住居に住む監視対象者の行動を監視する行動監視システムであって、

前記住居に設置され、それぞれ異なる検知範囲内において監視対象者を非接触で検知する複数の人感センサを含む検知部と、

データを記憶する記憶部と、

予め前記複数の人感センサのうちの2点間距離を取得して前記記憶部に記憶しておき、前記複数の人感センサのいずれかに反応があった場合に反応時刻を反応データとして前記記憶部に記憶し、前記記憶部に記憶したデータに基づいて監視対象者の単位時間毎の移動距離を算出する処理部と、

を備える行動監視システム。 - 請求項1に記載の行動監視システムであって、

前記処理部は、更に前記単位時間毎の移動距離の増減を時系列で比較する、

行動監視システム。 - 請求項2に記載の行動監視システムであって、

前記単位時間毎の移動距離が所定距離以上、時系列で減少した場合に警告を出力する出力部を備える行動監視システム。 - 請求項1ないし3いずれか1項に記載の行動監視システムであって、

前記複数の人感センサは、前記住居の複数の部屋にそれぞれ設けられ、

前記処理部は、前記複数の人感センサのいずれかに反応があった場合に部屋毎に監視対象者の入室回数を計数して前記記憶部に記憶する、

行動監視システム。 - 請求項4に記載の行動監視システムであって、

前記処理部は、更に前記部屋毎の入室回数の増減を時系列で比較する、

行動監視システム。 - 請求項5に記載の行動監視システムであって、

前記部屋の入室回数が所定回数以上、時系列で減少した場合に警告を出力する出力部を備える行動監視システム。 - 住居に住む監視対象者の行動を監視する行動監視方法であって、

前記住居において、複数の検知手段を用いて監視対象者を検知するものであり、

予め前記複数の検知手段のうちの2点間距離を取得して記憶部に記憶しておき、

前記複数の検知手段のいずれかに反応があった場合に反応時刻を反応データとして前記記憶部に記憶し、前記記憶部に記憶したデータに基づいて監視対象者の単位時間毎の移動距離を算出する、

行動監視方法。

Priority Applications (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2021/034435 WO2023042402A1 (ja) | 2021-09-17 | 2021-09-17 | 行動監視システムおよび行動監視方法 |

| EP21957583.4A EP4404165A1 (en) | 2021-09-17 | 2021-09-17 | Behavior monitoring system and behavior monitoring method |

| JP2023548084A JPWO2023042402A1 (ja) | 2021-09-17 | 2021-09-17 | |

| US18/688,936 US20240242831A1 (en) | 2021-09-17 | 2021-09-17 | Behavior monitoring system and behavior monitoring method |

| CN202180099882.XA CN117561552A (zh) | 2021-09-17 | 2021-09-17 | 行动监视系统以及行动监视方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2021/034435 WO2023042402A1 (ja) | 2021-09-17 | 2021-09-17 | 行動監視システムおよび行動監視方法 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2023042402A1 true WO2023042402A1 (ja) | 2023-03-23 |

Family

ID=85602650

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2021/034435 WO2023042402A1 (ja) | 2021-09-17 | 2021-09-17 | 行動監視システムおよび行動監視方法 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US20240242831A1 (ja) |

| EP (1) | EP4404165A1 (ja) |

| JP (1) | JPWO2023042402A1 (ja) |

| CN (1) | CN117561552A (ja) |

| WO (1) | WO2023042402A1 (ja) |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH10257204A (ja) * | 1997-03-07 | 1998-09-25 | Kawasaki Gakuen | 生活行動遠隔確認装置および生活行動遠隔確認システム |

| JP2003275181A (ja) | 2002-03-26 | 2003-09-30 | Hitachi Engineering & Services Co Ltd | 在宅者健康状態遠隔診断方法および装置 |

-

2021

- 2021-09-17 CN CN202180099882.XA patent/CN117561552A/zh active Pending

- 2021-09-17 JP JP2023548084A patent/JPWO2023042402A1/ja active Pending

- 2021-09-17 US US18/688,936 patent/US20240242831A1/en active Pending

- 2021-09-17 EP EP21957583.4A patent/EP4404165A1/en active Pending

- 2021-09-17 WO PCT/JP2021/034435 patent/WO2023042402A1/ja active Application Filing

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH10257204A (ja) * | 1997-03-07 | 1998-09-25 | Kawasaki Gakuen | 生活行動遠隔確認装置および生活行動遠隔確認システム |

| JP2003275181A (ja) | 2002-03-26 | 2003-09-30 | Hitachi Engineering & Services Co Ltd | 在宅者健康状態遠隔診断方法および装置 |

Also Published As

| Publication number | Publication date |

|---|---|

| EP4404165A1 (en) | 2024-07-24 |

| JPWO2023042402A1 (ja) | 2023-03-23 |

| US20240242831A1 (en) | 2024-07-18 |

| CN117561552A (zh) | 2024-02-13 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| EP1585078B1 (en) | system and method for determining whether a resident is at home or away | |

| AU2014375197B2 (en) | Method and system for monitoring | |

| JP3813024B2 (ja) | 生活行動遠隔確認装置および生活行動遠隔確認システム | |

| US20190110741A1 (en) | Life rhythm measurement system and life rhythm measurement method | |

| US20050285941A1 (en) | Monitoring devices | |

| US20100141397A1 (en) | System for activity recognition | |

| JP3178027U (ja) | セキュリティ機能付安否確認システム | |

| CN108242127B (zh) | 一种安全监测方法、装置及系统 | |

| AU2022202454A1 (en) | Method and system for monitoring | |

| JP2009077908A (ja) | 被介護者動作検出装置と被介護者動作検出方法 | |

| JP5457148B2 (ja) | 警備システム | |

| US20230053526A1 (en) | Automated door system | |

| WO2023042402A1 (ja) | 行動監視システムおよび行動監視方法 | |

| US20210225465A1 (en) | Tracking individual user health using intrusion detection sensors | |

| KR20230050619A (ko) | 위치 기반 생체정보 모니터링 시스템 및 방법 | |

| WO2023058154A1 (ja) | 行動監視システムおよび行動監視方法 | |

| Moshtaghi et al. | Monitoring personal safety by unobtrusively detecting unusual periods of inactivity | |

| CN111568427A (zh) | 老人活动状态监测系统和方法 | |

| JPH11224390A (ja) | 在室状況監視装置および在室状況監視システム | |

| KR20190020951A (ko) | 독거 노인 위험 알림 방법 및 장치 | |

| EP3803820B1 (en) | Tracking individual user health using intrusion detection sensors | |

| JP2003132463A (ja) | 活動量把握装置 | |

| JP7303650B2 (ja) | 警備システム | |

| JP6666152B2 (ja) | 警備業務支援システムおよび警備装置 | |

| WO2024171245A1 (ja) | 所在確認システム、所在確認装置、所在確認方法及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| 121 | Ep: the epo has been informed by wipo that ep was designated in this application |

Ref document number: 21957583 Country of ref document: EP Kind code of ref document: A1 |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 202180099882.X Country of ref document: CN |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 2023548084 Country of ref document: JP |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 18688936 Country of ref document: US |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 2021957583 Country of ref document: EP |

|

| NENP | Non-entry into the national phase |

Ref country code: DE |

|

| ENP | Entry into the national phase |

Ref document number: 2021957583 Country of ref document: EP Effective date: 20240417 |