WO2021193915A1 - 撮像装置及び電子機器 - Google Patents

撮像装置及び電子機器 Download PDFInfo

- Publication number

- WO2021193915A1 WO2021193915A1 PCT/JP2021/012841 JP2021012841W WO2021193915A1 WO 2021193915 A1 WO2021193915 A1 WO 2021193915A1 JP 2021012841 W JP2021012841 W JP 2021012841W WO 2021193915 A1 WO2021193915 A1 WO 2021193915A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- semiconductor substrate

- image pickup

- light receiving

- receiving surface

- region

- Prior art date

Links

- 238000003384 imaging method Methods 0.000 title claims abstract description 147

- 239000000758 substrate Substances 0.000 claims abstract description 382

- 239000004065 semiconductor Substances 0.000 claims abstract description 330

- 238000000926 separation method Methods 0.000 claims abstract description 301

- 238000009792 diffusion process Methods 0.000 claims abstract description 140

- 239000012535 impurity Substances 0.000 claims abstract description 68

- 238000006243 chemical reaction Methods 0.000 claims description 60

- 239000000463 material Substances 0.000 claims description 26

- 239000011159 matrix material Substances 0.000 claims description 14

- 230000004888 barrier function Effects 0.000 claims description 6

- 238000000034 method Methods 0.000 description 94

- 238000001514 detection method Methods 0.000 description 77

- 239000012071 phase Substances 0.000 description 62

- 239000010410 layer Substances 0.000 description 57

- 238000012545 processing Methods 0.000 description 46

- 238000012546 transfer Methods 0.000 description 38

- 238000004891 communication Methods 0.000 description 33

- 238000005468 ion implantation Methods 0.000 description 31

- 230000006866 deterioration Effects 0.000 description 30

- 238000004519 manufacturing process Methods 0.000 description 30

- 238000010586 diagram Methods 0.000 description 29

- 230000006870 function Effects 0.000 description 21

- 230000000875 corresponding effect Effects 0.000 description 20

- 238000005516 engineering process Methods 0.000 description 19

- 238000002156 mixing Methods 0.000 description 18

- 230000003287 optical effect Effects 0.000 description 18

- 239000011229 interlayer Substances 0.000 description 17

- 239000004020 conductor Substances 0.000 description 16

- 238000005520 cutting process Methods 0.000 description 16

- 230000008569 process Effects 0.000 description 15

- 238000002674 endoscopic surgery Methods 0.000 description 12

- 238000007667 floating Methods 0.000 description 12

- 229920006395 saturated elastomer Polymers 0.000 description 12

- 239000007790 solid phase Substances 0.000 description 12

- 230000000052 comparative effect Effects 0.000 description 11

- 238000012986 modification Methods 0.000 description 11

- 230000004048 modification Effects 0.000 description 11

- 238000003860 storage Methods 0.000 description 11

- 230000007246 mechanism Effects 0.000 description 10

- 241000519995 Stachys sylvatica Species 0.000 description 9

- 230000005540 biological transmission Effects 0.000 description 9

- 230000000694 effects Effects 0.000 description 9

- 238000005530 etching Methods 0.000 description 8

- 229910021420 polycrystalline silicon Inorganic materials 0.000 description 8

- 230000035945 sensitivity Effects 0.000 description 8

- 210000001519 tissue Anatomy 0.000 description 8

- OGIDPMRJRNCKJF-UHFFFAOYSA-N titanium oxide Inorganic materials [Ti]=O OGIDPMRJRNCKJF-UHFFFAOYSA-N 0.000 description 8

- GWEVSGVZZGPLCZ-UHFFFAOYSA-N Titan oxide Chemical compound O=[Ti]=O GWEVSGVZZGPLCZ-UHFFFAOYSA-N 0.000 description 7

- 230000008859 change Effects 0.000 description 7

- 229910052782 aluminium Inorganic materials 0.000 description 6

- XAGFODPZIPBFFR-UHFFFAOYSA-N aluminium Chemical compound [Al] XAGFODPZIPBFFR-UHFFFAOYSA-N 0.000 description 6

- 239000010949 copper Substances 0.000 description 6

- 238000013461 design Methods 0.000 description 6

- 230000000149 penetrating effect Effects 0.000 description 6

- VYPSYNLAJGMNEJ-UHFFFAOYSA-N Silicium dioxide Chemical compound O=[Si]=O VYPSYNLAJGMNEJ-UHFFFAOYSA-N 0.000 description 5

- XUIMIQQOPSSXEZ-UHFFFAOYSA-N Silicon Chemical compound [Si] XUIMIQQOPSSXEZ-UHFFFAOYSA-N 0.000 description 5

- 230000003321 amplification Effects 0.000 description 5

- 230000015572 biosynthetic process Effects 0.000 description 5

- 238000005229 chemical vapour deposition Methods 0.000 description 5

- 230000001276 controlling effect Effects 0.000 description 5

- 238000010030 laminating Methods 0.000 description 5

- 229910052751 metal Inorganic materials 0.000 description 5

- 239000002184 metal Substances 0.000 description 5

- 238000003199 nucleic acid amplification method Methods 0.000 description 5

- 229910052710 silicon Inorganic materials 0.000 description 5

- 239000010703 silicon Substances 0.000 description 5

- 229910052814 silicon oxide Inorganic materials 0.000 description 5

- 238000004544 sputter deposition Methods 0.000 description 5

- 238000001356 surgical procedure Methods 0.000 description 5

- WFKWXMTUELFFGS-UHFFFAOYSA-N tungsten Chemical compound [W] WFKWXMTUELFFGS-UHFFFAOYSA-N 0.000 description 5

- 229910052721 tungsten Inorganic materials 0.000 description 5

- 239000010937 tungsten Substances 0.000 description 5

- 229910052581 Si3N4 Inorganic materials 0.000 description 4

- 229910021417 amorphous silicon Inorganic materials 0.000 description 4

- 238000000149 argon plasma sintering Methods 0.000 description 4

- 239000013078 crystal Substances 0.000 description 4

- 230000007547 defect Effects 0.000 description 4

- 238000009826 distribution Methods 0.000 description 4

- 229920006227 ethylene-grafted-maleic anhydride Polymers 0.000 description 4

- 230000005284 excitation Effects 0.000 description 4

- 229920002120 photoresistant polymer Polymers 0.000 description 4

- 239000000047 product Substances 0.000 description 4

- HQVNEWCFYHHQES-UHFFFAOYSA-N silicon nitride Chemical compound N12[Si]34N5[Si]62N3[Si]51N64 HQVNEWCFYHHQES-UHFFFAOYSA-N 0.000 description 4

- ZOXJGFHDIHLPTG-UHFFFAOYSA-N Boron Chemical compound [B] ZOXJGFHDIHLPTG-UHFFFAOYSA-N 0.000 description 3

- RYGMFSIKBFXOCR-UHFFFAOYSA-N Copper Chemical compound [Cu] RYGMFSIKBFXOCR-UHFFFAOYSA-N 0.000 description 3

- PXHVJJICTQNCMI-UHFFFAOYSA-N Nickel Chemical compound [Ni] PXHVJJICTQNCMI-UHFFFAOYSA-N 0.000 description 3

- 230000001133 acceleration Effects 0.000 description 3

- 229910052796 boron Inorganic materials 0.000 description 3

- 229910052802 copper Inorganic materials 0.000 description 3

- 238000010336 energy treatment Methods 0.000 description 3

- 238000002955 isolation Methods 0.000 description 3

- 238000001451 molecular beam epitaxy Methods 0.000 description 3

- 238000000059 patterning Methods 0.000 description 3

- 230000002093 peripheral effect Effects 0.000 description 3

- 238000005240 physical vapour deposition Methods 0.000 description 3

- 238000007639 printing Methods 0.000 description 3

- 229920005989 resin Polymers 0.000 description 3

- 239000011347 resin Substances 0.000 description 3

- 238000004904 shortening Methods 0.000 description 3

- 238000004528 spin coating Methods 0.000 description 3

- 208000005646 Pneumoperitoneum Diseases 0.000 description 2

- PPBRXRYQALVLMV-UHFFFAOYSA-N Styrene Chemical compound C=CC1=CC=CC=C1 PPBRXRYQALVLMV-UHFFFAOYSA-N 0.000 description 2

- 230000004913 activation Effects 0.000 description 2

- 238000000137 annealing Methods 0.000 description 2

- 238000000231 atomic layer deposition Methods 0.000 description 2

- 210000004204 blood vessel Anatomy 0.000 description 2

- 230000003139 buffering effect Effects 0.000 description 2

- 238000005266 casting Methods 0.000 description 2

- 239000003153 chemical reaction reagent Substances 0.000 description 2

- 238000001312 dry etching Methods 0.000 description 2

- 238000010894 electron beam technology Methods 0.000 description 2

- MOFVSTNWEDAEEK-UHFFFAOYSA-M indocyanine green Chemical compound [Na+].[O-]S(=O)(=O)CCCCN1C2=CC=C3C=CC=CC3=C2C(C)(C)C1=CC=CC=CC=CC1=[N+](CCCCS([O-])(=O)=O)C2=CC=C(C=CC=C3)C3=C2C1(C)C MOFVSTNWEDAEEK-UHFFFAOYSA-M 0.000 description 2

- 229960004657 indocyanine green Drugs 0.000 description 2

- 238000009434 installation Methods 0.000 description 2

- 230000001678 irradiating effect Effects 0.000 description 2

- 230000033001 locomotion Effects 0.000 description 2

- 238000005498 polishing Methods 0.000 description 2

- 230000009467 reduction Effects 0.000 description 2

- 230000008439 repair process Effects 0.000 description 2

- 238000005070 sampling Methods 0.000 description 2

- 239000007921 spray Substances 0.000 description 2

- 239000000126 substance Substances 0.000 description 2

- 239000013589 supplement Substances 0.000 description 2

- 230000001629 suppression Effects 0.000 description 2

- 230000002194 synthesizing effect Effects 0.000 description 2

- 239000010936 titanium Substances 0.000 description 2

- 238000007740 vapor deposition Methods 0.000 description 2

- 125000003345 AMP group Chemical group 0.000 description 1

- 239000004925 Acrylic resin Substances 0.000 description 1

- 229920000178 Acrylic resin Polymers 0.000 description 1

- ZOKXTWBITQBERF-UHFFFAOYSA-N Molybdenum Chemical compound [Mo] ZOKXTWBITQBERF-UHFFFAOYSA-N 0.000 description 1

- 240000007594 Oryza sativa Species 0.000 description 1

- 235000007164 Oryza sativa Nutrition 0.000 description 1

- 240000004050 Pentaglottis sempervirens Species 0.000 description 1

- 235000004522 Pentaglottis sempervirens Nutrition 0.000 description 1

- 229910004298 SiO 2 Inorganic materials 0.000 description 1

- 229910000577 Silicon-germanium Inorganic materials 0.000 description 1

- RTAQQCXQSZGOHL-UHFFFAOYSA-N Titanium Chemical compound [Ti] RTAQQCXQSZGOHL-UHFFFAOYSA-N 0.000 description 1

- 230000003187 abdominal effect Effects 0.000 description 1

- 239000011230 binding agent Substances 0.000 description 1

- 230000000740 bleeding effect Effects 0.000 description 1

- 230000000903 blocking effect Effects 0.000 description 1

- 230000036772 blood pressure Effects 0.000 description 1

- 238000004364 calculation method Methods 0.000 description 1

- 238000003486 chemical etching Methods 0.000 description 1

- HPNSNYBUADCFDR-UHFFFAOYSA-N chromafenozide Chemical compound CC1=CC(C)=CC(C(=O)N(NC(=O)C=2C(=C3CCCOC3=CC=2)C)C(C)(C)C)=C1 HPNSNYBUADCFDR-UHFFFAOYSA-N 0.000 description 1

- 229920006026 co-polymeric resin Polymers 0.000 description 1

- 238000000576 coating method Methods 0.000 description 1

- 238000002485 combustion reaction Methods 0.000 description 1

- 230000000295 complement effect Effects 0.000 description 1

- 239000002131 composite material Substances 0.000 description 1

- 238000012937 correction Methods 0.000 description 1

- 230000002596 correlated effect Effects 0.000 description 1

- 238000013500 data storage Methods 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- KPUWHANPEXNPJT-UHFFFAOYSA-N disiloxane Chemical class [SiH3]O[SiH3] KPUWHANPEXNPJT-UHFFFAOYSA-N 0.000 description 1

- 230000009977 dual effect Effects 0.000 description 1

- 230000005684 electric field Effects 0.000 description 1

- 238000007772 electroless plating Methods 0.000 description 1

- 238000005401 electroluminescence Methods 0.000 description 1

- 238000009713 electroplating Methods 0.000 description 1

- 238000002073 fluorescence micrograph Methods 0.000 description 1

- 238000007646 gravure printing Methods 0.000 description 1

- 238000007654 immersion Methods 0.000 description 1

- 239000007943 implant Substances 0.000 description 1

- 238000002513 implantation Methods 0.000 description 1

- 230000006872 improvement Effects 0.000 description 1

- 238000007641 inkjet printing Methods 0.000 description 1

- 239000012212 insulator Substances 0.000 description 1

- 238000007733 ion plating Methods 0.000 description 1

- 150000002500 ions Chemical class 0.000 description 1

- 238000000608 laser ablation Methods 0.000 description 1

- 230000031700 light absorption Effects 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 238000001755 magnetron sputter deposition Methods 0.000 description 1

- 238000012423 maintenance Methods 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 239000007769 metal material Substances 0.000 description 1

- 238000000813 microcontact printing Methods 0.000 description 1

- 239000003595 mist Substances 0.000 description 1

- 230000000116 mitigating effect Effects 0.000 description 1

- 229910052750 molybdenum Inorganic materials 0.000 description 1

- 239000011733 molybdenum Substances 0.000 description 1

- 210000004400 mucous membrane Anatomy 0.000 description 1

- 229910052759 nickel Inorganic materials 0.000 description 1

- 150000004767 nitrides Chemical class 0.000 description 1

- 238000007645 offset printing Methods 0.000 description 1

- 239000013307 optical fiber Substances 0.000 description 1

- 125000002524 organometallic group Chemical group 0.000 description 1

- 230000001151 other effect Effects 0.000 description 1

- 239000002245 particle Substances 0.000 description 1

- 238000000206 photolithography Methods 0.000 description 1

- 239000000049 pigment Substances 0.000 description 1

- 238000005268 plasma chemical vapour deposition Methods 0.000 description 1

- 229920001296 polysiloxane Polymers 0.000 description 1

- 238000005036 potential barrier Methods 0.000 description 1

- 230000001737 promoting effect Effects 0.000 description 1

- 239000011241 protective layer Substances 0.000 description 1

- 238000011160 research Methods 0.000 description 1

- 230000002441 reversible effect Effects 0.000 description 1

- 235000009566 rice Nutrition 0.000 description 1

- 238000007650 screen-printing Methods 0.000 description 1

- 238000007789 sealing Methods 0.000 description 1

- LIVNPJMFVYWSIS-UHFFFAOYSA-N silicon monoxide Chemical compound [Si-]#[O+] LIVNPJMFVYWSIS-UHFFFAOYSA-N 0.000 description 1

- 239000002356 single layer Substances 0.000 description 1

- 229920001909 styrene-acrylic polymer Polymers 0.000 description 1

- 239000002344 surface layer Substances 0.000 description 1

- 230000002123 temporal effect Effects 0.000 description 1

- 238000002230 thermal chemical vapour deposition Methods 0.000 description 1

- 229910052719 titanium Inorganic materials 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14625—Optical elements or arrangements associated with the device

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/1463—Pixel isolation structures

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14609—Pixel-elements with integrated switching, control, storage or amplification elements

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/1462—Coatings

- H01L27/14621—Colour filter arrangements

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14601—Structural or functional details thereof

- H01L27/14625—Optical elements or arrangements associated with the device

- H01L27/14627—Microlenses

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14643—Photodiode arrays; MOS imagers

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14643—Photodiode arrays; MOS imagers

- H01L27/14645—Colour imagers

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L27/00—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate

- H01L27/14—Devices consisting of a plurality of semiconductor or other solid-state components formed in or on a common substrate including semiconductor components sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation

- H01L27/144—Devices controlled by radiation

- H01L27/146—Imager structures

- H01L27/14683—Processes or apparatus peculiar to the manufacture or treatment of these devices or parts thereof

-

- H—ELECTRICITY

- H01—ELECTRIC ELEMENTS

- H01L—SEMICONDUCTOR DEVICES NOT COVERED BY CLASS H10

- H01L31/00—Semiconductor devices sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation; Processes or apparatus specially adapted for the manufacture or treatment thereof or of parts thereof; Details thereof

- H01L31/08—Semiconductor devices sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation; Processes or apparatus specially adapted for the manufacture or treatment thereof or of parts thereof; Details thereof in which radiation controls flow of current through the device, e.g. photoresistors

- H01L31/10—Semiconductor devices sensitive to infrared radiation, light, electromagnetic radiation of shorter wavelength or corpuscular radiation and specially adapted either for the conversion of the energy of such radiation into electrical energy or for the control of electrical energy by such radiation; Processes or apparatus specially adapted for the manufacture or treatment thereof or of parts thereof; Details thereof in which radiation controls flow of current through the device, e.g. photoresistors characterised by potential barriers, e.g. phototransistors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N25/00—Circuitry of solid-state image sensors [SSIS]; Control thereof

- H04N25/70—SSIS architectures; Circuits associated therewith

- H04N25/703—SSIS architectures incorporating pixels for producing signals other than image signals

- H04N25/704—Pixels specially adapted for focusing, e.g. phase difference pixel sets

Definitions

- This disclosure relates to an imaging device and an electronic device.

- a semiconductor substrate and a plurality of imaging devices that are arranged on the semiconductor substrate in a matrix along the row direction and the column direction and perform photoelectric conversion on the incident light are provided.

- Each of the plurality of image pickup elements is provided in the semiconductor substrate so as to be adjacent to each other, surrounds the plurality of pixels containing the first conductive type impurity, the plurality of pixels, and penetrates the semiconductor substrate.

- An element separation wall provided so as to be provided, an on-chip lens provided above the light receiving surface of the semiconductor substrate so as to be shared by the plurality of pixels, and an area surrounded by the element separation wall.

- first separating portion for separating the plurality of pixels, and the first separating portion is provided so as to extend in the thickness direction of the semiconductor substrate and is located around the first separating portion.

- a first diffusion region containing impurities of a second conductive type having a conductive type opposite to that of the first conductive type is provided in the region extending in the thickness direction of the semiconductor substrate.

- a semiconductor substrate and a plurality of imaging elements that are arranged on the semiconductor substrate in a matrix along the row direction and the column direction and perform photoelectric conversion on the incident light are provided.

- Each of the plurality of image pickup elements is provided in the semiconductor substrate so as to be adjacent to each other, and includes a plurality of pixels containing the first conductive type impurities, a pixel separation wall for separating the plurality of pixels, and a pixel separation wall. It has an on-chip lens provided above the light receiving surface of the semiconductor substrate so as to be shared by the plurality of pixels, and the pixel separation wall is formed from the light receiving surface along the thickness direction of the semiconductor substrate.

- the region that is provided so as to extend halfway through the semiconductor substrate and is located on the side opposite to the light receiving surface with respect to the pixel separation wall in the thickness direction of the semiconductor substrate is different from that of the first conductive type.

- An image pickup apparatus is provided that contains a second conductive type impurity having the opposite conductive type.

- a semiconductor substrate and a plurality of imaging devices that are arranged on the semiconductor substrate in a matrix along the row direction and the column direction and perform photoelectric conversion on the incident light are provided.

- Each of the plurality of image pickup elements is provided in the semiconductor substrate so as to be adjacent to each other, and surrounds the plurality of pixels including the first conductive type impurity and the plurality of pixels.

- the element separation wall provided so as to penetrate the semiconductor substrate, the on-chip lens provided above the light receiving surface of the semiconductor substrate so as to be shared by the plurality of pixels, and the element separation wall.

- the first separating portion is provided in the above-mentioned region and has a first separating portion for separating the plurality of pixels, and the first separating portion is provided so as to extend in the thickness direction of the semiconductor substrate.

- a first diffusion region containing impurities of a second conductive type having a conductive type opposite to that of the first conductive type is formed.

- Electronic devices provided are provided.

- FIG. 3 is an explanatory diagram (No. 3) showing a part of a cross section of the image sensor 100 for each color according to the eighth embodiment of the present disclosure.

- FIG. 5 is an explanatory diagram (No. 5) showing a part of a cross section of the image pickup device 100 according to the eighth embodiment of the present disclosure. It is a process sectional view for demonstrating a part of the manufacturing process of the image pickup device 100 which concerns on 8th Embodiment of this disclosure.

- FIG. 3 is an explanatory diagram (No. 3) showing a part of a cross section of the image pickup device 100 according to the ninth embodiment of the present disclosure.

- FIG. 4 which shows a part of the cross section of the image pickup device 100 which concerns on 9th Embodiment of this disclosure.

- FIG. 5 is an explanatory diagram (No. 5) showing a part of a cross section of the image pickup device 100 according to the ninth embodiment of the present disclosure.

- FIG. 6 is an explanatory diagram (No. 6) showing a part of a cross section of the image pickup device 100 according to the ninth embodiment of the present disclosure.

- FIG. 7 is an explanatory diagram (No. 7) showing a part of a cross section of the image pickup device 100 according to the ninth embodiment of the present disclosure.

- It is explanatory drawing (the 2) which shows the plane of the image pickup device 100 which concerns on 9th Embodiment of this disclosure.

- FIG. 2 is a process cross-sectional view (No. 2) for explaining a part of the manufacturing process of the image pickup device 100 according to the ninth embodiment of the present disclosure.

- FIG. 3 is an explanatory diagram (No. 3) showing a plane of the image sensor 100 according to the tenth embodiment of the present disclosure.

- FIG. 6 is an explanatory diagram (No. 6) showing a plane of the image sensor 100 according to the tenth embodiment of the present disclosure.

- FIG. (7) which shows the plane of the image pickup device 100 which concerns on tenth Embodiment of this disclosure.

- drawing (the 1) which shows the plane of the image pickup device 100 which concerns on 11th Embodiment of this disclosure.

- FIG. 3 is an explanatory diagram (No. 3) showing a plane of the image sensor 100 according to the eleventh embodiment of the present disclosure. It is explanatory drawing (the 4) which shows the plane of the image pickup device 100 which concerns on 11th Embodiment of this disclosure.

- FIG. 3 is an explanatory diagram (No. 3) showing a cross section of the image pickup device 100 according to the twelfth embodiment of the present disclosure. It is explanatory drawing (the 4) which shows the cross section of the image pickup device 100 which concerns on the twelfth embodiment of this disclosure.

- FIG. 5 is an explanatory diagram (No. 5) showing a cross section of the image pickup device 100 according to the twelfth embodiment of the present disclosure.

- FIG. 6 is an explanatory diagram (No. 6) showing both sides and a cross section of the image pickup device 100 according to the twelfth embodiment of the present disclosure. It is explanatory drawing (7) which shows the cross section of the image pickup device 100 which concerns on the twelfth embodiment of this disclosure.

- FIG. 9 is an explanatory diagram (No. 9) showing both sides and a cross section of the image pickup device 100 according to the twelfth embodiment of the present disclosure. It is explanatory drawing (the 10) which shows both sides and the cross section of the image pickup device 100 which concerns on the twelfth embodiment of this disclosure.

- 11 is an explanatory diagram (11) showing both sides of the image sensor 100 according to the twelfth embodiment of the present disclosure. It is explanatory drawing (12) which shows both sides of the image sensor 100 which concerns on the twelfth embodiment of this disclosure.

- FIG. 3 is an explanatory diagram (No. 3) showing a plane of the image sensor 100 according to the thirteenth embodiment of the present disclosure.

- a plurality of components having substantially the same or similar functional configurations may be distinguished by adding different numbers after the same reference numerals. However, if it is not necessary to distinguish each of the plurality of components having substantially the same or similar functional configurations, only the same reference numerals are given. Further, similar components of different embodiments may be distinguished by adding different alphabets after the same reference numerals. However, if it is not necessary to distinguish each of the similar components, only the same reference numerals are given.

- the drawings referred to in the following description are drawings for explaining one embodiment of the present disclosure and promoting its understanding, and for the sake of clarity, the shapes, dimensions, ratios, etc. shown in the drawings are actually shown. May differ from.

- the image pickup apparatus shown in the drawing can be appropriately redesigned in consideration of the following description and known techniques.

- the vertical direction of the laminated structure of the image pickup device corresponds to the relative direction when the light receiving surface on which the light incident on the image pickup device enters is facing up. It may differ from the vertical direction according to the actual gravitational acceleration.

- the dimensions expressed in the following description not only mean the dimensions defined mathematically or geometrically, but also the degree of difference (error / strain) that is allowed in the operation of the image pickup device and the manufacturing process of the image pickup device. ) Is also included. Furthermore, the term "substantially identical" used for specific dimensions in the following description does not mean only when they are mathematically or geometrically perfectly matched, but also the operation of the imaging device and imaging. It shall be included that there is an allowable difference (error / strain) in the manufacturing process of the device.

- electrically connecting means connecting a plurality of elements directly or indirectly via other elements.

- sharing means using one other element (for example, an on-chip lens) together between elements different from each other (for example, a pixel or the like).

- FIG. 1 is an explanatory diagram showing a plan configuration example of the image pickup apparatus 1 according to the embodiment of the present disclosure.

- the image pickup apparatus 1 according to the embodiment of the present disclosure includes a pixel array unit 20 in which a plurality of image pickup elements 100 are arranged in a matric manner on a semiconductor substrate 10 made of silicon, for example, and the pixels. It has a peripheral circuit unit provided so as to surround the array unit 20.

- the image pickup apparatus 1 includes a vertical drive circuit unit 21, a column signal processing circuit unit 22, a horizontal drive circuit unit 23, an output circuit unit 24, a control circuit unit 25, and the like as the peripheral circuit unit. The details of each block of the image pickup apparatus 1 will be described below.

- the pixel array unit 20 has a plurality of image pickup elements 100 arranged two-dimensionally on the semiconductor substrate 10 in a matrix along the row direction and the column direction.

- Each image pickup element 100 is an element that performs photoelectric conversion with respect to the incident light, and has a photoelectric conversion unit (not shown) and a plurality of pixel transistors (for example, MOS (Metal-Oxide-Semiconductor) transistors) (not shown). ) And.

- the pixel transistor includes, for example, four MOS transistors: a transfer transistor, a selection transistor, a reset transistor, and an amplification transistor.

- a plurality of image pickup devices 100 are arranged two-dimensionally according to, for example, a Bayer arrangement.

- image pickup devices 100 that absorb light having a green wavelength (for example, a wavelength of 495 nm to 570 nm) and generate a charge are arranged in a checkered pattern, and the remaining portion has a red wavelength (for example, a wavelength of 620 nm).

- the image sensor 100 that absorbs light having a wavelength of up to 750 nm and generates a charge, and the image sensor 100 that absorbs light having a blue wavelength (for example, a wavelength of 450 nm to 495 nm) and generates a charge are alternately arranged in a row. It is an array pattern that is lined up. The detailed structure of the image sensor 100 will be described later.

- the vertical drive circuit unit 21 is formed by, for example, a shift register, selects the pixel drive wiring 26, supplies a pulse for driving the image pickup element 100 to the selected pixel drive wiring 26, and causes the image pickup element 100 in a row unit. Drive. That is, the vertical drive circuit unit 21 selectively scans each image sensor 100 of the pixel array unit 20 in a row-by-row vertical direction (vertical direction in FIG. 1), and a photoelectric conversion unit (not shown) of each image sensor 100. A pixel signal based on the signal charge generated according to the amount of received light is supplied to the column signal processing circuit unit 22 described later through the vertical signal line 27.

- the column signal processing circuit unit 22 is arranged for each column of the image sensor 100, and performs signal processing such as noise removal for each pixel signal output from the image sensor 100 for one row.

- the column signal processing circuit unit 22 performs signal processing such as CDS (Correlated Double Sampling: Correlation Double Sampling) and AD (Analog-Digital) conversion in order to remove fixed pattern noise peculiar to pixels.

- CDS Correlated Double Sampling: Correlation Double Sampling

- AD Analog-Digital

- the horizontal drive circuit unit 23 is formed by, for example, a shift register, and by sequentially outputting horizontal scanning pulses, each of the above-mentioned column signal processing circuit units 22 is sequentially selected, and pixels from each of the column signal processing circuit units 22. The signal is output to the horizontal signal line 28.

- the output circuit unit 24 performs signal processing on pixel signals sequentially supplied from each of the column signal processing circuit units 22 described above through the horizontal signal line 28 and outputs the signals.

- the output circuit unit 24 may function as, for example, a functional unit that performs buffering, or may perform processing such as black level adjustment, column variation correction, and various digital signal processing. Note that buffering refers to temporarily storing pixel signals in order to compensate for differences in processing speed and transfer speed when exchanging pixel signals.

- the input / output terminal 29 is a terminal for exchanging signals with an external device.

- Control circuit unit 25 receives an input clock and data for instructing an operation mode and the like, and outputs data such as internal information of the image pickup apparatus 1. That is, the control circuit unit 25 is based on the vertical synchronization signal, the horizontal synchronization signal, and the master clock, and is a clock signal that serves as a reference for the operation of the vertical drive circuit unit 21, the column signal processing circuit unit 22, the horizontal drive circuit unit 23, and the like. Generate a control signal. Then, the control circuit unit 25 outputs the generated clock signal and control signal to the vertical drive circuit unit 21, the column signal processing circuit unit 22, the horizontal drive circuit unit 23, and the like.

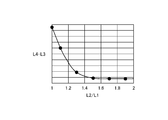

- the present inventors in order to improve the accuracy of the phase difference detection in the all-pixel phase difference detection, to avoid mixing the outputs of the pair of phase difference detection pixels in the phase difference detection.

- the idea was to provide an element that physically and electrically separates the phase difference detection pixels.

- the present inventors have conceived to provide an overflow path between a pair of phase difference detection pixels in order to avoid deterioration of the captured image in all pixel phase difference detection. Specifically, when the charge of one of the phase difference detection pixels is about to saturate during normal imaging, the charge is transferred to the other pixel via the overflow path, thereby causing one of the pixels. Pixel saturation can be avoided. By providing such an overflow path, the linearity of the pixel signal output from the image pickup device can be ensured, and deterioration of the captured image can be prevented.

- the present inventors have created an embodiment according to the present disclosure, which makes it possible to avoid deterioration of the captured image while improving the accuracy of phase difference detection. rice field.

- the details of the embodiments according to the present disclosure created by the present inventors will be sequentially described below.

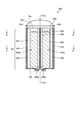

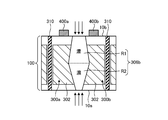

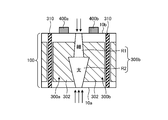

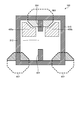

- FIGS. 2 and 3 are explanatory views showing a part of a cross section of the image pickup device 100 according to the present embodiment. Specifically, the image pickup device 100 is cut at different positions along the thickness direction of the semiconductor substrate 10. Corresponds to the cross section.

- the image sensor 100 includes an on-chip lens 200, a color filter 202, a light-shielding portion (light-shielding film) 204, and a semiconductor substrate 10 as in the comparative example. , And transfer gates 400a and 400b.

- the semiconductor substrate 10 has a pair of pixels 300a and 300b each having a photoelectric conversion unit 302.

- the semiconductor substrate 10 has a protruding portion (an example of a first separating portion) 304 that separates the pair of pixels 300a and 300b, and has an element separation wall 310 that surrounds the pixels 300a and 300b, and the protruding portion 304 and the element.

- FIG. 2 corresponds to a cross section in which the image sensor 100 is cut at a position where the above-mentioned protrusion 304 is cut

- FIG. 3 shows the space between the protrusions 304 facing each other (see slit 312 and FIG. 4).

- the image sensor 100 is provided above the light receiving surface 10a of the semiconductor substrate 10 and has one on-chip lens 200 that collects the incident light on the photoelectric conversion unit 302.

- the image sensor 100 has a structure in which a pair of pixels 300a and 300b are provided for one on-chip lens 200. That is, the on-chip lens 200 is shared by the two pixels 300a and 300b.

- the on-chip lens 200 may be formed of, for example, a silicon nitride film (SiN) or a resin-based material such as a styrene resin, an acrylic resin, a styrene-acrylic copolymer resin, or a siloxane resin. can.

- the color filter 202 is either a color filter that transmits a red wavelength component, a color filter that transmits a green wavelength component, or a color filter that transmits a blue wavelength component.

- the color filter 202 can be formed from a material in which a pigment or dye is dispersed in a transparent binder such as silicone.

- a light-shielding portion 204 is provided on the light-receiving surface 10a of the semiconductor substrate 10 so as to surround the color filter 202.

- the light-shielding portion 204 can be formed of, for example, a metal material containing tungsten (W), aluminum (Al), copper (Cu), titanium (Ti), molybdenum (Mo), nickel (Ni), or the like.

- the photoelectric conversion unit 302 having the impurities of the first conductive type (for example, N type) in the semiconductor substrate 10 of the second conductive type (for example, P type) is adjacent to each of the pixels 300a and 300b. It is provided in. As described above, the photoelectric conversion unit 302 absorbs light L having a red wavelength component, a green wavelength component, or a blue wavelength component incident through the color filter 202 to charge an electric charge. Generate. Then, in the present embodiment, the photoelectric conversion unit 302 of the pixel 300a and the photoelectric conversion unit 302 of the pixel 300b can function as a pair of phase difference detection pixels at the time of phase difference detection. That is, in the present embodiment, the phase difference can be detected by detecting the difference in the pixel signal based on the electric charge generated by the photoelectric conversion unit 302 of the pixel 300a and the photoelectric conversion unit 302 of the pixel 300b.

- the phase difference can be detected by detecting the difference in the pixel signal based on the electric charge generated by the photoelectric

- the photoelectric conversion unit 302 changes the amount of charge generated, that is, the sensitivity, depending on the incident angle of light with respect to its own optical axis (axis perpendicular to the light receiving surface). For example, the photoelectric conversion unit 302 has the highest sensitivity when the incident angle is 0 degrees, and the sensitivity of the photoelectric conversion unit 302 is the target axis when the incident angle is 0 degrees with respect to the incident angle. It has a line-symmetrical relationship. Therefore, in the photoelectric conversion unit 302 of the pixel 300a and the photoelectric conversion unit 302 of the pixel 300b, light from the same point is incident at different angles of incidence, and an amount of electric charge corresponding to the angle of incidence is generated.

- phase difference can be detected by detecting the difference in the pixel signal based on the amount of electric charge generated by the photoelectric conversion unit 302 of the pixel 300a and the photoelectric conversion unit 302 of the pixel 300b. Therefore, such a difference in pixel signals (phase difference) is detected as a difference signal by, for example, a detection unit (not shown) of the output circuit unit 24, and the defocus amount is calculated based on the detected phase difference. Autofocus can be achieved by adjusting (moving) the imaging lens (not shown).

- the phase difference is detected as the difference between the pixel signals of the photoelectric conversion unit 302 of the pixel 300a and the photoelectric conversion unit 302 of the pixel 300b, but the present embodiment is limited to this.

- the phase difference may be detected as the ratio of the pixel signals of the photoelectric conversion unit 302 of the pixel 300a and the photoelectric conversion unit 302 of the pixel 300b.

- the protruding portion 304 serves as a penetrating DTI (Deep Research Isolation) in a groove portion (trench) (not shown) provided so as to penetrate the semiconductor substrate 10 along the thickness direction of the semiconductor substrate 10 and in the trench. It is made of an embedded material composed of an oxide film (SiO), a silicon nitride film, an amorphous silicon, a polycrystalline silicon, a titanium oxide film (TiO), an oxide film such as aluminum or tungsten, or a metal film.

- DTI Deep Research Isolation

- Trench not shown

- It is made of an embedded material composed of an oxide film (SiO), a silicon nitride film, an amorphous silicon, a polycrystalline silicon, a titanium oxide film (TiO), an oxide film such as aluminum or tungsten, or a metal film.

- the accuracy of the phase difference detection deteriorates.

- the protruding portion 304 penetrates the semiconductor substrate 10

- the pair of pixels 300a and 300b can be effectively physically separated, and as a result, the occurrence of color mixing is suppressed and the phase difference is achieved.

- the accuracy of detection can be further improved.

- a slit 312 (see FIG. 4) corresponding to the space between the two protrusions 304 is provided near the center of the image sensor 100.

- the region of the slit 312 (an example of a region located around the protrusion 304 and extending in the thickness direction of the semiconductor substrate 10) is subjected to conformal doping via the protrusion 304.

- Second conductive type (for example, P type) impurities are diffused to form a diffusion region 306 (an example of the first diffusion region) (details, as will be described later, the diffusion region 306 is a device separation. It is also formed around the wall 310).

- the pair of pixels 300a and 300b can be electrically separated to prevent color mixing.

- the depth in the semiconductor substrate 10 is deepened by the conformal doping via the protruding portion 304 (here, the depth is the semiconductor substrate 10).

- a diffusion region 306 can be formed on the back surface 10a and the front surface 10b of the semiconductor substrate 10 along the thickness direction). Therefore, in the present embodiment, since the desired diffusion region 306 can be formed with high accuracy, the pair of pixels 300a and 300b can be effectively electrically separated, and as a result, the occurrence of color mixing is suppressed. , The accuracy of phase difference detection can be further improved. The details of the region of the slit 312 will be described later.

- a first conductive type (for example, N type) impurity is implanted below the diffusion region 306 provided in the slit 312 (on the surface 10b side) by ion implantation.

- a diffusion region 320 is formed.

- the diffusion region 320 is formed by ion-implanting the first conductive type impurity into the lower region in the diffusion region 306 described above so as to make a hole in the diffusion region 306. Then, the diffusion region 320 functions as an overflow path capable of exchanging the electric charges generated between the pixels 300a and 300b.

- a gate (not shown) may be provided on the surface 10b of the semiconductor substrate 10 between the transfer gates 400a and 400b.

- the pair of pixels 300a and 300b are electrically separated at the time of phase difference detection, and an overflow path is formed in the region on the surface 10b side of the slit 312 at the time of normal imaging. Channels may be formed.

- the semiconductor substrate 10 is provided with an element separation wall 310 that surrounds the pixels 300a and 300b and physically separates the adjacent image pickup elements 100.

- the element separation wall 310 includes a groove (trench) (not shown) provided so as to penetrate the semiconductor substrate 10 along the thickness direction of the semiconductor substrate 10, and a silicon oxide film and silicon embedded in the trench. It is made of a material composed of an oxide film such as a nitride film, amorphous silicon, polycrystalline silicon, a titanium oxide film, aluminum or tungsten, or a metal film. That is, the protrusion 304 and the element separation wall 310 may be formed of the same material.

- the element separation wall 310 and the projecting portion 304 have the same configuration, they can have an integrated form, and therefore can be formed at the same time.

- the protruding portion 304 can be formed at the same time as the element separation wall 310, so that the increase in the process process of the image pickup device 100 can be suppressed.

- the electric charges generated by the photoelectric conversion unit 302 of the pixel 300a and the photoelectric conversion unit 302 of the pixel 300b are provided on the surface 10b located on the side opposite to the light receiving surface 10a of the semiconductor substrate 10.

- the transfer transistor (one of the pixel transistors described above) is transferred via the transfer gates 400a and 400b.

- the transfer gates 400a and 400b can be formed from, for example, a metal film.

- the charge is accumulated in, for example, a floating diffusion portion (charge storage portion) (not shown) provided in a semiconductor region having a first conductive type (for example, N type) provided in the semiconductor substrate 10. May be good.

- the floating diffusion portion is not limited to being provided in the semiconductor substrate 10, and is provided, for example, on another substrate (not shown) laminated on the semiconductor substrate 10. It may have been.

- a plurality of pixel transistors (not shown) other than the transfer transistor described above, which are used for reading the electric charge as a pixel signal or the like, may be provided.

- the pixel transistor may be provided on the semiconductor substrate 10 or may be provided on another substrate (not shown) laminated on the semiconductor substrate 10.

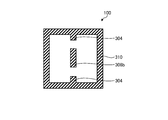

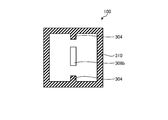

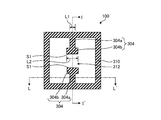

- FIG. 4 is an explanatory view showing a plane of the image sensor 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image sensor 100 cut along the AA'line shown in FIG.

- the pixels 300a and 300b adjacent to each other are separated by a protruding portion 304 formed integrally with the element separation wall 310.

- the element separation wall 310 projects toward the center O of the image sensor 100 along the row direction, and two projecting portions (first) facing each other. (Example) of the separation part) 304.

- the region between the two protrusions 304 located near the center of the image sensor 100 is referred to as a slit 312.

- impurities of the second conductive type are diffused through the protrusion 304 by conformal doping, and diffused so as to surround the protrusion 304.

- Region 306 is formed.

- the pair of pixels 300a and 300b can be electrically separated to prevent color mixing.

- the second conductive type impurities are diffused through the element separation wall 310, and the diffusion region 306 is formed along the element separation wall 310.

- the two projecting portions 304 are provided at the center of the image pickup element 100 in the row direction when the image pickup element 100 is viewed from above the light receiving surface 10a, and the projecting lengths (lengths in the column direction) are mutually different. It is almost the same. Then, as described above, the two protrusions 304 are provided so as to penetrate the semiconductor substrate 10.

- the width of the protruding portion 304 is not particularly limited as long as the pair of pixels 300a and 300b can be separated.

- the projecting portion 304 and the element separation wall 310 according to the present embodiment described so far have a form as shown in FIG. 5, which is a transmission perspective view of the image pickup device 100 according to the present embodiment. That is, the protrusion 304 and the element separation wall 310 according to the present embodiment are provided so as to penetrate the semiconductor substrate 10. Further, a slit 312 is provided near the center of the image pickup device 100 between the two protrusions 304.

- the slit 312 is located near the center O of the image sensor 100, the scattering of light by the protruding portion 304 is suppressed. Therefore, according to the present embodiment, the light incident on the center O of the image sensor 100 can be incident on the photoelectric conversion unit 302 without being scattered. As a result, according to the present embodiment, the image sensor 100 can more reliably capture the light incident on the center O of the image sensor 100, so that deterioration of the image sensor can be avoided.

- the first conductive type impurities are introduced by ion implantation, and a channel serving as an overflow path is provided. Can be formed. Therefore, according to the present embodiment, the pair of pixels 300a and 300b can be separated at the time of phase difference detection, and an overflow path can be formed at the time of normal shooting. Therefore, the accuracy of the phase difference detection can be improved and the captured image can be captured. Deterioration can be avoided.

- the present embodiment since impurities can be introduced into the region of the slit 312 through the protrusion 304 by conformal doping to form the diffusion region 306, it is possible to avoid using ion implantation. .. Therefore, according to the present embodiment, since ion implantation is not used, it is possible to avoid the introduction of impurities into the photoelectric conversion unit 302, and it is possible to avoid shrinkage and damage of the photoelectric conversion unit 302. Furthermore, by using conformal doping, it is possible to repair crystal defects while applying a high temperature to uniformly diffuse impurities. As a result, according to the present embodiment, it is possible to suppress a decrease in the sensitivity of the image sensor 100 and a reduction in the dynamic range.

- the element separation wall 310 projects toward the center O of the image sensor 100 along the row direction, and two protrusions facing each other. It may have a part (an example of a first separation part) 304. Further, in this case, the two projecting portions 304 may be provided at the center of the image pickup element 100 in the row direction when the image pickup element 100 is viewed from above the light receiving surface 10a.

- the diffusion region 306 that electrically separates the pair of pixels 300a and 300b from the protruding portion 304 that physically separates the pair of pixels 300a and 300b, and the pair of pixels 300a and 300b. Since the diffusion region 320 and the like for electrically separating the two are provided, it is possible to improve the accuracy of phase difference detection and avoid deterioration of the captured image. Specifically, in the present embodiment, the pair of pixels 300a and 300b can be effectively separated by the protrusion 304 and the diffusion region 306, and as a result, the occurrence of color mixing is suppressed and the accuracy of phase difference detection is suppressed. Can be further improved.

- the overflow path is provided, when the charge of one of the pixels 300a and 300b is about to be saturated during normal imaging, the overflow path is used. By transferring the charge to the other pixel, saturation of one pixel can be avoided. Therefore, according to the present embodiment, by providing such an overflow path, the linearity of the pixel signal output from the image pickup device 100 can be ensured, and deterioration of the captured image can be prevented.

- the present embodiment since impurities can be diffused into the region of the slit 312 through the protrusion 304 by conformal doping to form the diffusion region 306, it is possible to avoid using ion implantation. .. Therefore, according to the present embodiment, since ion implantation is not used, it is possible to avoid the introduction of impurities into the photoelectric conversion unit 302, and it is possible to avoid shrinkage and damage of the photoelectric conversion unit 302. Furthermore, by using conformal doping, it is possible to repair crystal defects while applying a high temperature to uniformly diffuse impurities. As a result, according to the present embodiment, it is possible to suppress a decrease in the sensitivity of the image sensor 100 and a reduction in the dynamic range.

- the diffusion region 306 can be formed in a deep region in the semiconductor substrate 10 by conformal doping through the protruding portion 304. Therefore, in the present embodiment, since the desired diffusion region 306 can be formed with high accuracy, the pair of pixels 300a and 300b can be effectively electrically separated, and as a result, the occurrence of color mixing is suppressed. , The accuracy of phase difference detection can be further improved. Further, according to the present embodiment, since the element separation wall 310 and the projecting portion 304 have the same form, the projecting portion 304 can be formed at the same time as the element separation wall 310, which is a process step of the image pickup device 100. The increase can be suppressed.

- the slit 312 is provided in the center O of the image sensor 100, the scattering of light by the protruding portion 304 is suppressed, and the light incident on the center O of the image sensor 100 is scattered. It can be incident on the photoelectric conversion unit 302 without any problem.

- the image sensor 100 can more reliably capture the light incident on the center O of the image sensor 100, so that deterioration of the image sensor can be avoided.

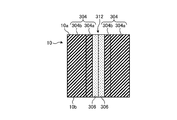

- FIG. 6 is an explanatory diagram showing a configuration example of the light-shielding portion 204 according to the present embodiment

- FIG. 7 is an explanatory diagram showing a configuration example of the light-shielding portion 204 according to a modified example of the present embodiment.

- the figure shown in the lower row corresponds to the cross section of the image sensor 100 cut along the line AA'shown in FIG. 3, and the figure shown in the upper row is BB shown in FIG. Corresponds to the cross section of the image sensor 100 cut along the'line.

- the light-shielding portion (light-shielding film) 204 is placed on the element separation wall 310 on the element separation wall 310. It may be provided along the line.

- the light-shielding portion (light-shielding film) 204 is placed on the element separation wall 310. Not only may it be provided along the element separation wall 310, but it may also be provided along the protrusion 304 on the protrusion 304 (an example of the first separation portion).

- FIG. 8 is an explanatory view showing a plane of the image sensor 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image sensor 100 cut along the AA'line shown in FIG.

- the element separation wall 310 is in the row direction toward the center O (not shown) of the image sensor 100. It has two protrusions (an example of a first separation) 304 that project along and face each other. Further, the protruding lengths of the two protruding portions 304 are different from each other.

- the two projecting portions 304 may project along the row direction toward the center O (not shown) of the image sensor 100.

- the protrusions 304 are not limited to being provided in two so as to face each other, and for example, one may be provided.

- a second conductive type for example, P type

- P type the conductive type impurity

- the two protrusions 304 are not limited to being provided at the center of the image pickup device 100 in the row direction when the image pickup device 100 is viewed from above the light receiving surface 10a. , In the row direction, it may be provided at a position deviated from the center of the image sensor 100 by a predetermined distance. Therefore, a third embodiment of the present disclosure will be described in which the two protrusions 304 are provided at positions deviated from the center of the image pickup device 100 by a predetermined distance in the row direction with reference to FIG. 9.

- FIG. 9 is an explanatory view showing a plane of the image sensor 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image sensor 100 cut along the AA'line shown in FIG.

- the element separation walls 310 face each other when the image sensor 100 is viewed from above the light receiving surface 10a, and are oriented along the row direction. It has two projecting portions (an example of a first separating portion) 304. Further, in the present embodiment, these projecting portions 304 are provided at positions deviated from the center of the image pickup device 100 by a predetermined distance in the row direction. In the present embodiment, the predetermined distance is not particularly limited.

- the two protrusions 304 are not limited to the form shown in FIG. 9, for example, the two protrusions protruding along the row direction (of the first separation portion).

- Example In the case of 304, it may be provided at a position deviated from the center of the image sensor 100 by a predetermined distance in the row direction.

- the present embodiment may be combined with the second embodiment described above, and therefore the protruding lengths of the two protrusions 304 may be different from each other.

- the element separation walls 310 face each other when the image pickup device 100 is viewed from above the light receiving surface 10a, and face each other in the row direction. It has two protrusions (an example of a first separation) 304 protruding along. Further, in the present embodiment, a plurality of rectangular additional walls 308 are arranged in a dot shape between the protrusions 304 (slit 312). The additional wall 308 is provided so as to penetrate the semiconductor substrate 10 in the same manner as the protrusion 304. In addition, although not shown in FIG. 10, a second conductive type (for example, P type) impurity is introduced around the additional wall 308 by conformal doping through the additional wall 308. The formed diffusion region 306 is provided.

- P type for example, P type

- a plurality of additional walls 308 are provided between the two protrusions 304 (slit 312), and a diffusion region 306 is also provided around the additional walls 308 to sufficiently provide a pair of pixels 300a and 300b. It is possible to secure more separation. Further, in the present embodiment, by providing the additional wall 308 in a dot shape, the scattering of light by the additional wall 308 is suppressed, and the light incident on the center O (not shown) of the image sensor 100 is scattered. It can be incident on the photoelectric conversion unit 302 without any light. As a result, according to the present embodiment, the image sensor 100 can more reliably capture the light incident on the center O of the image sensor 100, so that deterioration of the image sensor can be avoided.

- the cross section of the additional wall 308 is not limited to the rectangular shape as shown in FIG. 10, and the number of the additional walls 308 is also 2 as shown in FIG. The number is not limited to one, and may be one or three or more.

- one additional wall 308a is arranged between the two protrusions 304 (slit 312), and the additional wall 308a may be used as the back surface DTI. ..

- the back surface DTI forms a trench that penetrates halfway through the semiconductor substrate 10 from the light receiving surface 10a (back surface) side of the semiconductor substrate 10 along the thickness direction of the semiconductor substrate 10, and an oxide film or the like is embedded in the trench. Is formed by.

- a channel serving as the overflow path is formed.

- the cross section of the additional wall 308a is not limited to the rectangular shape as shown in FIG. 11, and the number of the additional walls 308a is also 2 as shown in FIG. The number is not limited to one, and may be one or three or more.

- a second conductivity is provided by ion implantation between the two protrusions 304 (slit 312).

- a diffusion region 306a (an example of a first diffusion region) formed by introducing a mold (for example, P-type) impurity may be provided.

- the protruding portion 304 may be formed of a material different from that of the element separation wall 310.

- FIG. 13 is an explanatory view showing a plane of the image sensor 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image sensor 100 cut along the AA'line shown in FIG.

- the projecting portion 304 and the element separation wall 310 are made of a material made of an oxide film such as a silicon oxide film, a silicon nitride film, an amorphous silicon, polycrystalline silicon, a titanium oxide film, aluminum, tungsten, or a metal film. Consists of. Therefore, in the present embodiment, as shown in FIG. 13, the material selected from the above-mentioned materials, and the protrusion 304 and the element separation wall 310 may be formed from different materials.

- the element separation wall 310 is formed of a silicon oxide film

- the protruding portion 304 is formed of a titanium oxide film having a high refractive index, which has a small difference in refractive index from the silicon forming the semiconductor substrate 10.

- the scattering of light by the protruding portion 304 is suppressed, and the light incident on the center O (not shown) of the image sensor 100 can be incident on the photoelectric conversion unit 302 without being scattered.

- the image sensor 100 can more reliably capture the light incident on the center O of the image sensor 100, so that deterioration of the image sensor can be avoided.

- the protrusion 304 is not limited to being formed of a titanium oxide film, and for example, another material may be used as long as the material has a small difference in refractive index from the material forming the semiconductor substrate 10. There may be.

- FIG. 14 is an explanatory view showing a plane of the image sensor 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image sensor 100 cut along the AA'line shown in FIG.

- the element separation walls 310 project toward the center of the image sensor 100 along the row direction and mutually.

- the four protrusions 304 and 324 are provided so as to penetrate the semiconductor substrate 10.

- a diffusion region 306 an example of a first diffusion region and an example of a second diffusion region.

- a first conductive type for example, N type

- a diffusion region 320 that functions as an overflow path is formed.

- the inside of the image sensor 100 is separated into four pixels 300a, 300b, 300c, and 300d by such four protrusions 304.

- one image sensor 100 can detect the phase difference in both the row direction and the column direction.

- the present invention is not limited to the four protrusions 304 and 324, and four or more protrusions may be provided (for example, eight).

- FIG. 15 is an explanatory view showing a plane of the image sensor 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image sensor 100 cut along the AA'line shown in FIG.

- a pixel separation wall (an example of a separation portion) 334 composed of a back surface DTI is provided between the pair of pixels 300a and 300b.

- the back surface DTI forms a trench that penetrates from the light receiving surface 10a (back surface) side of the semiconductor substrate 10 to the middle of the semiconductor substrate 10 along the thickness direction of the semiconductor substrate 10 and is inside the trench. It is formed by embedding an oxide film or the like in the.

- the region on the surface 10b side of the pixel separation wall 334, which is not penetrated by the pixel separation wall 334 is the overflow path.

- an overflow path may be formed by introducing a first conductive type impurity into the region by ion implantation.

- the pixel separation wall 334 may or may not be in contact with the element separation wall 310, and is not particularly limited. If they are not in contact with each other, a second conductive type (for example, P type) impurity is formed by conformal doping via the element separation wall 310 or ion implantation between the pixel separation wall 334 and the element separation wall 310. Is formed by introducing the above, and a diffusion region (not shown) that electrically separates the pair of pixels 300a and 300b is provided.

- the pair of pixels 300a and 300b are effective by providing the pixel separation wall 334 composed of the back surface DTI that physically separates the pair of pixels 300a and 300b at the time of phase difference detection.

- the occurrence of color mixing can be suppressed and the accuracy of phase difference detection can be further improved.

- the charge of one of the pixels 300a and 300b is likely to be saturated during normal imaging due to the overflow path located in the region on the surface 10b side of the pixel separation wall 334, By transferring the charge to the other pixel through the overflow path, saturation of one pixel can be avoided.

- the linearity of the pixel signal output from the image pickup device 100 can be ensured and the deterioration of the captured image can be prevented.

- a pixel separation wall 334 formed by introducing a second conductive type (for example, P type) impurity by ion implantation is provided between the pair of pixels 300a and 300b. May be done. Even in such a modification, the pixel separation wall 334 formed by ion implantation extends from the light receiving surface 10a (back surface) side of the semiconductor substrate 10 to the middle of the semiconductor substrate 10 along the thickness direction of the semiconductor substrate 10. It is formed in a penetrating form. In the modification, the region on the surface 10b side of the pixel separation wall 334, which is not penetrated by the pixel separation wall 334, is the overflow path in the thickness direction of the semiconductor substrate 10.

- a second conductive type for example, P type

- the overflow path may be formed by preventing impurities from being implanted into the region on the surface 10b side of the pixel separation wall 334 at the time of ion implantation for forming the pixel separation wall 334. It may be formed by introducing a first conductive type impurity into the region by ion implantation. In this modification as well, the pixel separation wall 334 may or may not be in contact with the element separation wall 310, and is not particularly limited.

- the pair of pixels 300a and 300b can be effectively electrically separated, and as a result, the pair of pixels 300a and 300b can be effectively electrically separated. It is possible to suppress the occurrence of color mixing and further improve the accuracy of phase difference detection. Further, in the present embodiment, when the charge of one of the pixels 300a and 300b is likely to be saturated during normal imaging due to the overflow path located in the region on the surface 10b side of the pixel separation wall 334, By transferring the charge to the other pixel through the overflow path, saturation of one pixel can be avoided. By providing such an overflow path, the linearity of the pixel signal output from the image pickup device 100 can be ensured, and deterioration of the captured image can be prevented.

- FIG. 16 is an explanatory diagram showing a configuration example of the light-shielding portion 204 according to the present embodiment.

- the figure shown in the lower row corresponds to a cross section obtained by cutting the image sensor 100 along the line AA'shown in FIG. 3, and the figure shown in the upper row is the line BB'shown in FIG. Corresponds to the cross section of the image sensor 100 cut.

- the light-shielding portion (light-shielding film) 204 is placed on the element separation wall 310. It may have two projecting portions 206 that are provided along the element separation wall 310 and project toward the center O of the image sensor 100 along the row direction and face each other. Alternatively, in the present embodiment and the modified example, the light-shielding portion 204 may be provided along the element separation wall 310 and may not have the protruding portion 206.

- FIG. 17 is an explanatory view showing a part of a cross section of the image pickup device 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image pickup device 100 cut along the thickness direction of the semiconductor substrate 10.

- FIG. 18 is an explanatory view showing a plane of the image sensor 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image sensor 100 cut along the CC'line shown in FIG. FIG.

- FIG. 19 is an explanatory view showing a plane of the image sensor 100 according to the present embodiment, and more specifically, corresponds to a cross section of the image sensor 100 cut along the DD'line shown in FIG.

- FIG. 20 is an explanatory view showing a part of a cross section of the image pickup device 100 according to the present embodiment, and more specifically, corresponds to a cross section obtained by cutting the semiconductor substrate 10 along the line EE shown in FIG.

- FIG. 21 is an explanatory view showing a part of a cross section of the image sensor 100 for each color according to the present embodiment, and more specifically, corresponds to a cross section obtained by cutting the semiconductor substrate 10 along the thickness direction of the semiconductor substrate 10. ..

- one additional wall 308b is arranged between the two protrusions 304 (slit 312), and the additional wall 308b is designated as a surface DTI. ..

- the surface DTI forms a trench extending from the surface 10b side, which is the opposite surface of the light receiving surface 10a of the semiconductor substrate 10, to the middle of the semiconductor substrate 10 along the thickness direction of the semiconductor substrate 10. It is formed by embedding an oxide film or the like in the trench. By adjusting the depth of the trench, it is possible to adjust the length of the semiconductor substrate 10 in the thickness direction of the additional wall 308b.

- a channel serving as the overflow path may be formed by introducing impurities into the region on the back surface 10a side of the additional wall 308b, which is not penetrated by the additional wall 308b.