WO2012132495A1 - 操作装置 - Google Patents

操作装置 Download PDFInfo

- Publication number

- WO2012132495A1 WO2012132495A1 PCT/JP2012/050568 JP2012050568W WO2012132495A1 WO 2012132495 A1 WO2012132495 A1 WO 2012132495A1 JP 2012050568 W JP2012050568 W JP 2012050568W WO 2012132495 A1 WO2012132495 A1 WO 2012132495A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- feedback

- display screen

- operation target

- movement

- sound

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/016—Input arrangements with force or tactile feedback as computer generated output to the user

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/16—Sound input; Sound output

- G06F3/167—Audio in a user interface, e.g. using voice commands for navigating, audio feedback

Definitions

- the present invention relates to an operating device.

- Priority is claimed on Japanese Patent Application No. 2011-076271, filed Mar. 30, 2011, the content of which is incorporated herein by reference.

- the present invention has been made in view of the above circumstances, and an object of the present invention is to provide an operating device capable of causing an operator to recognize movement of an operation target in a feedback manner, without causing the user to look at the screen.

- a display screen for displaying an operation target operable by an operator, and movement of the operation target on the display screen.

- the input means capable of the operation input of the direction and the operation target moving on the display screen in response to the operation input by the input means, the operator displays the operation target displayed on the display screen

- feedback means for performing predetermined feedback that can be recognized without direct visual recognition, wherein the input means is configured to determine the moving speed and amount of movement of the operation target in the moving direction on the display screen. It is possible to input an operation, and the feedback means is configured to move an amount of movement relative to a moving speed of the operation object and a position on the display screen before the start of the movement of the operation object. Depending on Chi at least one of the change, it performs the feedback as aspects of the feedback is continuously changed.

- the feedback unit has a sound feedback unit that performs the feedback by emitting a sound, and the moving speed of the operation target And at least one of the frequency and the volume of the sound emitted from the sound feedback unit as the movement amount of the operation target relative to the position on the display screen before the movement start increases.

- the feedback means has sound feedback means for performing the feedback by emitting a sound, and the operation The sound image of the sound is changed according to the change in the moving direction of the operation target so as to correspond to the moving direction of the target.

- the display screen and the feedback means are mounted on a vehicle, and the feedback means outputs sound. It has sound feedback means for performing the feedback by emitting, and the input means is disposed at a predetermined position in the vehicle compartment operable by the driver of the vehicle, and detects the direction in which the obstacle approaching the vehicle is present.

- the sound feedback means detects the obstacle detected by the obstacle detection means when the obstacle detection means detects the obstacle approaching the vehicle.

- the sound image in the direction emits a sound different from the sound emitted in response to the movement of the operation target.

- the feedback means has vibration feedback means for performing the feedback by transmitting vibration to the input means;

- the vibration transmitted to the input unit by the vibration feedback unit as at least one of the movement speed of the operation target and the relative movement amount with respect to the position on the display screen before the movement start of the operation target increases.

- the following configuration may be adopted: while detecting the visual line direction of the operator, the detected visual line direction indicates the display

- the apparatus further comprises a gaze detection means for determining whether or not the display is directed to the screen, and when the feedback means determines that the gaze direction of the operator is not directed to the display screen by the gaze detection means. The feedback is performed, and the feedback is not performed when it is determined by the gaze detection unit that the gaze direction of the operator is directed to the display screen.

- the display screen is below the upper surface of the instrument panel mounted in the vehicle compartment

- the input unit includes a substantially planar operation unit disposed at a predetermined position in the vehicle compartment that can be operated by a driver of the vehicle, and the driver's finger to the operation unit The contact position is detected, and the operation input to the operation target is performed according to the detection result.

- the operator since the feedback is continuously performed according to the movement of the operation target, the operator does not have to look at the operation target displayed on the display screen, the movement state of the operation target ( That is, at least one of the moving speed and the relative moving amount with respect to the position on the display screen before the start of the movement can be accurately recognized.

- the operator can easily learn the correspondence between the input operation to the input means and the movement state of the operation target, and easily operates the operation target without visually recognizing the display screen, so-called blind operation. The convenience can be improved.

- the driver who is performing the input operation to the input means can be made to recognize quickly and accurately the direction in which the obstacle approaching the vehicle is present, and the convenience and the vehicle Driving safety can be improved.

- the display disposed at a position where the driver's sight line deviates larger than the windshield of the vehicle (that is, below the upper surface of the instrument panel mounted in the vehicle compartment) Even when the operation target is displayed, the driver can accurately recognize the movement state of the operation target without having to gaze at the operation target displayed on the display screen, and a so-called blind operation can be performed. This can be easily performed, and the convenience can be improved.

- the operating device 10 is mounted on, for example, a vehicle, and as shown in FIG. 1, the input operating device (input means) 11, the display 12, the speaker 13, the actuator 14, and the control device 15 are included. It is configured to be equipped.

- the input operation device 11 is a pointing device capable of moving and operating an appropriate operation target displayed on the display screen 12 a of the display 12 according to an input operation of an operator (for example, a driver of a vehicle).

- the control unit 11a has a substantially planar operation unit 11a disposed at a predetermined position in the vehicle compartment which can be operated by the driver of the vehicle, detects the contact position of the driver's finger with respect to the operation unit 11a, In response, an operation input on the operation target on the display screen 12a is performed. Then, the input operation device 11 outputs a signal of an operation input A (t) indicating an operation state amount (for example, an operation direction, an operation amount, etc.) at an appropriate time t which changes sequentially according to the input operation of the operator.

- an operation input A t

- an operation state amount for example, an operation direction, an operation amount, etc.

- the display 12 includes, for example, a display screen 12a disposed in the vehicle compartment so as to be visible by a driver of the vehicle.

- the display screen 12a is disposed below the upper surface of an instrument panel mounted in the vehicle compartment of the vehicle. , And controlled by the controller 15.

- the speakers 13 are disposed, for example, at a plurality of locations in the vehicle cabin (for example, two locations on the left and right of the front of the vehicle and two locations on the left and right of the rear of the vehicle) It is controlled by 15.

- the actuator 14 includes, for example, a motor that is driven and controlled by the control device 15, and causes the input operation device 11 to generate vibration or applies a reaction force to the operation input by the operator with respect to the input operation device 11. .

- the control device 15 includes, for example, a movement state detection unit 21 and a feedback control unit 22.

- the movement state detection unit 21 is, for example, based on the signal of the operation input A (t) output from the input operation device 11, on the display screen 12 a of the display 12 according to the input operation of the operator on the input operation device 11.

- a movement state amount of an operation target for example, a cursor, a figure, etc.

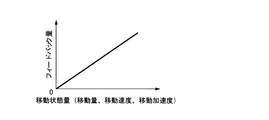

- the movement state amount B (t) may be, for example, a movement vector including a position on the display screen 12a, a movement direction on the display screen 12a, and a movement amount relative to the position before the start of movement, movement speed, movement Such as acceleration.

- the feedback control unit 22 recognizes the operation target displayed on the display screen 12 a without directly viewing it in response to the operation target moving on the display screen 12 a according to the input operation of the operator on the input operation device 11. Possibly provide predetermined feedback to the operator.

- the feedback control unit 22 continuously changes the feedback amount according to the change of the movement state amount B (t).

- Z (t) is generated, and feedback is given to the operator by this feedback amount Z (t).

- the change of the movement state amount B (t) is, for example, at least the movement speed of the operation target on the display screen 12a and the movement amount relative to the position before the start of movement of the operation target on the display screen 12a.

- the feedback amount Z (t) is, for example, various state amounts (for example, volume, pitch, timbre, sound field, sound image, frequency when repeating sound output, etc.) for the sound output from the speaker 13, an actuator Various state quantities (for example, frequency, amplitude, etc.) with respect to vibration transmitted to the input operation device 11 by 14 and various state quantities (for example, Size etc).

- the feedback control unit (sound feedback means) 22 has at least one of the moving speed of the operation target on the display screen 12a and the relative moving amount with respect to the position before the start of movement of the operation target on the display screen 12a. As it becomes larger, at least one of the frequency and volume of the sound emitted from the speaker 13 is changed to increase.

- the feedback control unit (sound feedback means) 22 changes the sound image of the sound emitted from the speaker 13 according to the change in the moving direction of the operation target so as to correspond to the moving direction of the operation target on the display screen 12a.

- the feedback control unit (vibration feedback means) 22 is at least at least one of the moving speed of the operation target on the display screen 12a and the relative moving amount with respect to the position before the movement start of the operation target on the display screen 12a. As the one becomes larger, at least one of the frequency and the amplitude of the vibration transmitted to the input operation device 11 by the actuator 14 is changed to increase.

- the controller device 10 has the above-described configuration. Next, the operation of the controller device 10 will be described.

- the feedback control unit 22 is configured to move relative to the position before the start of movement of the operation target on the display screen 12 a, move speed, move acceleration, etc. With the increase, a feedback amount Z (t) that changes in an increasing tendency is generated.

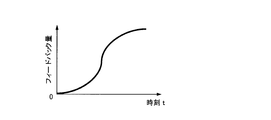

- the feedback control unit 22 passes the time t at the beginning of the movement start in the period from when the operation target starts moving until the movement end is ended on the display screen 12a.

- the increase rate of the feedback amount is set to change in an increasing tendency, and the increase rate of the feedback amount is changed to a decreasing tendency as time t elapses at the end of the movement.

- the feedback amount is not In the case of the volume, at the beginning of the movement, the rate of increase of the volume changes with the passage of time t, and at the end of the period of movement, the rate of increase of the volume with the passage of time t. Is set to change in a decreasing tendency.

- the pitch increase rate changes in an increasing tendency with the passage of time t at the beginning of the movement, and the pitch increase rate with the passage of time t at the end of the movement Is set to change in a decreasing tendency.

- the feedback control unit 22 outputs a feedback amount of the sound output from the speaker 13 in a period from when the operation target starts moving on the display screen 12a until it ends the movement.

- the frequency at the time of repeating the sound output is set, the frequency is set to change in an increasing tendency as time t elapses.

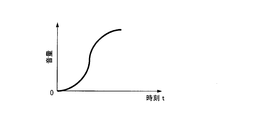

- the feedback control unit 22 causes the actuator 14 to input a feedback amount to the input operation device 11 in a period from when the operation target starts moving on the display screen 12a until it ends the movement.

- the amplitude is set to change in a decreasing tendency with the passage of time t.

- the feedback control unit 22 responds to the position of the operation target on the display screen 12a (for example, the two-dimensional coordinate position (X, Y) by X coordinate and Y coordinate).

- the feedback amount is the volume and pitch of the sound output from the speaker 13, these are continuously changed according to the position of the operation target.

- the feedback control unit 22 causes the volume to change in a decreasing tendency as the X coordinate of the operation target on the display screen 12a increases from zero toward the central portion C of the display screen 12a, and As the coordinates increase away from the central portion C of the display screen 12a, the sound volume is set to change in an increasing tendency. Further, for example, as the Y coordinate of the operation target on the display screen 12a increases from zero toward the central portion C of the display screen 12a, the pitch increase rate changes in an increasing tendency, and the Y coordinate Is set so that the rate of increase in pitch changes in a decreasing tendency as the distance from the central portion C of the display screen 12a increases.

- FIGS. 8A to 8C are an example in the case where the operation target on the display screen 12a is at the two-dimensional coordinate position (X 1 , Y 1 ).

- the feedback control unit 22 responds to the position of the operation target on the display screen 12a (for example, the two-dimensional coordinate position (X, Y) by X coordinate and Y coordinate).

- the feedback amount is set as the sound field of the sound output from the speaker 13, the sound field is continuously changed according to the position of the operation target.

- the feedback control unit 22 changes the volume of the speakers 13 disposed at the two locations on the left and right of the front of the vehicle to decrease as the Y coordinate of the operation target changes to decrease on the display screen 12a. And the volume of the speakers 13 disposed at the two places on the left and right of the rear part of the vehicle is changed to increase.

- the movement of the operation target on the display screen 12a in response to the input operation by the operator on the input operation device 11 may be performed by, for example, as shown in FIG. 10A, a predetermined figure P1 pointing at an arbitrary position on the display screen 12a.

- the pointing operation by movement is included.

- the display screen 12a of the display screen 12a accompanied by the movement of a predetermined scroll instruction figure P2. Scrolling action is included.

- the appropriate figure Pb on the display screen 12a is moved to The drag and drop operation to be superimposed on the figure Pa of is included.

- the figure P3 on the display screen 12a is enlarged (or reduced).

- the scaling operation is included.

- the operation device 10 since the continuous feedback is performed according to the movement of the operation target, the operator does not have to gaze at the operation target displayed on the display screen 12a.

- the movement state of the operation target that is, at least one of the movement speed and the relative movement amount with respect to the position on the display screen 12a before the start of movement

- the operator can easily learn the correspondence between the input operation on the input operation device 11 and the movement state of the operation target, and operates the operation target without visually recognizing the display screen 12a, so-called blind operation Can be easily performed, and the convenience can be improved.

- the operation target is displayed on the display screen 12a disposed at a position where the driver's line of sight deviates more than the windshield of the vehicle (that is, below the upper surface of the instrument panel mounted in the vehicle compartment). Even in this case, the driver can accurately recognize the movement state of the operation target without having to gaze at the operation target displayed on the display screen 12a, and can easily perform so-called blind operation. The convenience can be improved.

- continuous feedback is also performed on the input operation device 11 such as a touch pad that can not easily grasp the sensory correspondence with the state of the operation target (for example, the cursor position, the movement amount, etc.).

- the operator can accurately and easily recognize the movement state of the operation target without having to gaze at the operation target displayed on the display screen 12a, and can perform so-called blind operation easily, which is convenient. Can be improved.

- the operating device 10 includes the input operation device 11, the display 12, the speaker 13, the actuator 14, the control device 15, and the line of sight.

- a sensor (gaze detection means) 16 and an external sensor (obstacle detection means) 17 are provided.

- the control device 15 includes, for example, the movement state detection unit 21, the feedback control unit 22, the line of sight detection unit (line of sight detection unit) 23, the obstacle detection unit (obstacle detection unit) 24, It is configured with.

- the sight line sensor 16 includes at least the face of the occupant seated in the seat of the vehicle in the imaging area as an imaging target, and can pick up an image in the visible light area and the infrared area. And an occupant camera (not shown) for outputting a face image including the image to the control device 15.

- the external sensor 17 is configured by, for example, a radar device, an imaging device, a heat source tracking device, or the like by electromagnetic waves such as an infrared light laser or a millimeter wave.

- the radar apparatus divides a detection target area set in the external world of a vehicle into a plurality of angle areas, and scans each angle area to transmit an electromagnetic wave transmission signal. Then, each transmission signal receives a reflection signal generated by being reflected by an object outside the vehicle (for example, another vehicle or a structure) or a pedestrian, and the distance from the radar device to the external object or pedestrian is And generates a detection signal relating to the signal.

- the imaging device performs predetermined image processing on an image obtained by imaging the imaging region set in the outside of the vehicle, generates image data, and outputs the image data to the control device 15.

- the gaze detection unit 23 performs predetermined recognition processing on the face image of the occupant output from the occupant camera of the gaze sensor 16, for example, and the pupil position of the occupant's eye or the center position of the iris or the predetermined light source (not shown)

- the point of reflection on the corneal surface of the light emitted from e.g., the central position of the Purkinje image, which is a reflection image of infrared light

- the position of the eyes of the occupant's eyes etc.

- the obstacle detection unit 24 may be an obstacle such as another vehicle, a structure or a pedestrian existing in the outside of the vehicle based on, for example, a detection signal output from the radar device of the outside sensor 17 or image data output from the imaging device. Detect objects Then, the distance to the obstacle, the moving speed and moving direction of the obstacle, the position of the obstacle, and the like are detected, and signals of the detection results are output.

- the feedback control unit 22 is a signal of the detection result output from the obstacle detection unit 24 in a state where the predetermined sound is emitted from the speaker 13 according to the movement of the operation target on the display screen 12a, for example.

- the driver performing the input operation to the input operation device 11 can recognize the direction in which the obstacle approaching the vehicle is present quickly and accurately, and the convenience and the traveling safety of the vehicle can be improved. It can be improved.

- the feedback control unit 22 determines whether the line of sight direction of the operator is directed to the display screen 12a based on the detection result of the line of sight direction of the operator output from the line of sight detection unit 23, for example. It is determined whether or not feedback is to be performed according to the determination result. For example, when it is determined that the visual line direction of the operator is not directed to the display screen 12a, the feedback control unit 22 executes feedback and determines that the visual line direction of the operator is directed to the display screen 12a. In the case of stopping feedback execution.

- the feedback control unit 22 generates the feedback amount according to the movement state amount of the operation target on the display screen 12a, but is not limited to this.

- the amount of feedback may be generated according to the position of the operation target on the display screen 12a. For example, with the predetermined position on the display screen 12a as a reference position, the feedback control unit 22 sets the feedback amount to change in an increasing manner as it is separated from the reference position.

- the feedback control unit 22 stores the history of the input operation of the operator on the input operation device 11, and from the detection result of the smoothness of the input operation, the operation speed, etc.

- the degree of learning of the input operation to the input operation device 11 or the degree of skill may be estimated, and the feedback amount may be increased as the degree of skill or the degree of skill is lower.

- the feedback control unit 22 stores the history of the input operation of the operator on the input operation device 11, and the input operation according to the detection result of the execution frequency of the input operation. As the frequency of execution of is less, the amount of feedback may be increased.

- the feedback control unit 22 acts on the input operation device 11 due to external noise (for example, noise of sound that can be heard by the driver, vehicle vibration, etc.

- the amount of feedback may be changed according to the magnitude of vibration noise or the like.

- the feedback control unit 22 stimulates the driver such as the output of sound and the generation of vibration by the operation with higher priority (for example, various alarm operations). If it is added, the amount of feedback of other lower priority operations may be reduced.

- the input operation device 11 is, for example, a touch panel, a touch pad, a mouse, a trackball, a joystick, a pen tablet, a dial switch, a push button, a gesture input device, a remote input device Or the like.

- the display 12 displays, for example, a dashboard display in which the display screen 12a is disposed at the top of a dashboard of the vehicle, or a front window of the vehicle as the display screen 12a.

- the display may be a head-up display for performing an operation, a multi-information display in which a display screen is disposed on an instrument panel of a vehicle, or a display in which a display screen 12a is disposed in the vicinity of various instruments on the instrument panel of the vehicle.

- an operating device capable of causing the operator to recognize the movement of the operation target in a feedback manner without causing the user to look at the screen.

Abstract

Description

本願は、2011年3月30日に、日本に出願された特願2011-076271号に基づき優先権を主張し、その内容をここに援用する。

これにより、操作者は、入力手段に対する入力操作と操作対象の移動状態との対応関係を容易に学習することができ、表示画面を視認せずに操作対象を操作する、いわゆるブラインド操作を容易に行なうことができ、利便性を向上させることができる。

本実施形態による操作装置10は、例えば車両に搭載され、図1に示すように、入力操作機器(入力手段)11と、表示器12と、スピーカー13と、アクチュエータ14と、制御装置15とを備えて構成されている。

そして、入力操作機器11は、操作者の入力操作に応じて逐次変化する適宜の時刻tでの操作状態量(例えば、操作方向、操作量など)を示す操作入力A(t)の信号を出力する。

そして、入力操作機器11に対する操作者の入力操作に応じて逐次変化する適宜の時刻tでの移動状態量B(t)の検出結果の信号を出力する。

なお、移動状態量B(t)は、例えば、表示画面12a上での位置、表示画面12a上での移動方向および移動開始前の位置に対する相対的な移動量からなる移動ベクトル、移動速度、移動加速度などである。

また、例えば、表示画面12a上での操作対象のY座標がゼロから表示画面12aの中心部Cに向かい増大することに伴い、音程の増大率が増大傾向に変化するように、かつ、Y座標が表示画面12aの中心部Cから離間して増大することに伴い、音程の増大率が減少傾向に変化するように設定する。

なお、図8A~8Cは、表示画面12a上での操作対象が2次元座標位置(X1、Y1)にある場合の一例である。

これにより、操作者は、入力操作機器11に対する入力操作と操作対象の移動状態との対応関係を容易に学習することができ、表示画面12aを視認せずに操作対象を操作する、いわゆるブラインド操作を容易に行なうことができ、利便性を向上させることができる。

さらに、振動を用いてフィードバックを行なうことから、操作対象の連続的な移動状態の変化を操作者にのみ容易に認識させることができ、過剰なフィードバックの実行を防止することができる。

さらに、この変形例において、制御装置15は、例えば、移動状態検出部21と、フィードバック制御部22と、視線検出部(視線検出手段)23と、障害物検出部(障害物検出手段)24とを備えて構成されている。

例えばレーダ装置は、車両の外界に設定された検出対象領域を複数の角度領域に分割し、各角度領域を走査するようにして、電磁波の発信信号を発信する。そして、各発信信号が車両の外部の物体(例えば、他車両や構造物など)や歩行者によって反射されることで生じた反射信号を受信し、レーダ装置から外部の物体や歩行者までの距離に係る検知信号を生成し、制御装置15に出力する。

また、例えば撮像装置は、車両の外界に設定された撮像領域を撮像して得た画像に所定の画像処理を行なって画像データを生成し、制御装置15に出力する。

そして、これらの検出結果に基づき、例えば、眼の瞳孔または虹彩の中心位置と角膜表面の反射点との相対距離、あるいは、眼の瞳孔または虹彩の中心位置と目頭の位置との相対距離などから、乗員の視線方向を検知する。

例えば、フィードバック制御部22は、操作者の視線方向が表示画面12aに向けられていないと判定した場合にはフィードバックを実行し、操作者の視線方向が表示画面12aに向けられていると判定した場合にはフィードバックの実行を停止する。

例えば、フィードバック制御部22は、表示画面12a上の所定位置を基準位置として、この基準位置から離間することに伴いフィードバック量が増大傾向に変化するように設定する。

11 入力操作機器(入力手段)

11a 操作部

12 表示器

12a 表示画面

16 視線センサ(視線検出手段)

17 外界センサ(障害物検出手段)

22 フィードバック制御部(フィードバック手段、音フィードバック手段、振動フィードバック手段)

23 視線検出部(視線検出手段)

24 障害物検出部(障害物検出手段)

Claims (7)

- 操作者により操作可能な操作対象を表示する表示画面と、

前記表示画面上における前記操作対象の移動方向を操作入力可能な入力手段と、

前記入力手段による操作入力に伴って前記操作対象が前記表示画面上を移動したことに応じて、前記操作者が前記表示画面に表示される前記操作対象を直接視認せずに認識可能な所定のフィードバックを行なうフィードバック手段と、を備える操作装置であって、

前記入力手段は、前記表示画面上における前記操作対象の前記移動方向への移動速度および移動量を操作入力可能であり、

前記フィードバック手段は、前記操作対象の移動速度および前記操作対象の移動開始前の前記表示画面上の位置に対する相対的な移動量のうち少なくとも一方の変化に応じて、前記フィードバックの様態が連続的に変化するように前記フィードバックを行なう

ことを特徴とする操作装置。 - 前記フィードバック手段は、音を発することで前記フィードバックを行なう音フィードバック手段を有し、

前記操作対象の移動速度および前記操作対象の移動開始前の前記表示画面上の位置に対する相対的な移動量のうち少なくとも一方が大きくなることにつれて、前記音フィードバック手段から発する前記音の周波数および音量のうち少なくとも一方を増大傾向に変化させる

ことを特徴とする請求項1に記載の操作装置。 - 前記フィードバック手段は、音を発することで前記フィードバックを行なう音フィードバック手段を有し、

前記操作対象の移動方向と対応するように前記操作対象の移動方向の変化に応じて前記音の音像を変化させる

ことを特徴とする請求項1に記載の操作装置。 - 前記表示画面および前記フィードバック手段は車両に搭載され、

前記フィードバック手段は、音を発することで前記フィードバックを行なう音フィードバック手段を有し、

前記入力手段は、前記車両の運転者によって操作可能な車両室内の所定位置に配置され、前記車両に接近する障害物が存在する方向を検出する障害物検出手段を備え、

前記音フィードバック手段は、前記障害物検出手段により前記車両に接近する前記障害物が検出された場合には、前記障害物検出手段により検出された前記障害物が存在する方向の音像で前記操作対象の移動に応じて発する前記音とは異なる音を発する

ことを特徴とする請求項1に記載の操作装置。 - 前記フィードバック手段は、前記入力手段に振動を伝達することで前記フィードバックを行なう振動フィードバック手段を有し、

前記操作対象の移動速度および前記操作対象の移動開始前の前記表示画面上の位置に対する相対的な移動量のうち少なくとも一方が大きくなることにつれて、前記振動フィードバック手段により前記入力手段に伝達される前記振動の周波数および振幅のうち少なくとも一方を増大傾向に変化させる

ことを特徴とする請求項1に記載の操作装置。 - 前記操作者の視線方向を検出すると共に、前記検出された視線方向が前記表示画面に向けられているか否かを判定する視線検出手段をさらに備え、

前記フィードバック手段は、前記視線検出手段により前記操作者の視線方向が前記表示画面に向けられていないと判定された場合には前記フィードバックを実行し、前記視線検出手段により前記操作者の視線方向が前記表示画面に向けられていると判定された場合には前記フィードバックを実行しない

ことを特徴とする請求項1に記載の操作装置。 - 前記表示画面は、車両室内に搭載されるインストルメントパネルの上面よりも下方に配置されるディスプレイであり、

前記入力手段は、前記車両の運転者によって操作可能な前記車両室内の所定位置に配置された略平面状の操作部を有し、前記操作部に対する前記運転者の手指の接触位置を検出し、前記検出結果に応じて前記操作対象に対する操作入力を行なう

ことを特徴とする請求項1に記載の操作装置。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US13/978,563 US20130293466A1 (en) | 2011-03-30 | 2012-01-13 | Operation device |

| JP2013507211A JP5563153B2 (ja) | 2011-03-30 | 2012-01-13 | 操作装置 |

| CN2012800050673A CN103314342A (zh) | 2011-03-30 | 2012-01-13 | 操作装置 |

| EP12764860.8A EP2693311A4 (en) | 2011-03-30 | 2012-01-13 | OPERATIVE DEVICE |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011076271 | 2011-03-30 | ||

| JP2011-076271 | 2011-03-30 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2012132495A1 true WO2012132495A1 (ja) | 2012-10-04 |

Family

ID=46930263

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2012/050568 WO2012132495A1 (ja) | 2011-03-30 | 2012-01-13 | 操作装置 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US20130293466A1 (ja) |

| EP (1) | EP2693311A4 (ja) |

| JP (1) | JP5563153B2 (ja) |

| CN (1) | CN103314342A (ja) |

| WO (1) | WO2012132495A1 (ja) |

Cited By (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2014092990A (ja) * | 2012-11-05 | 2014-05-19 | Lenovo Singapore Pte Ltd | 情報入力装置及びその音声出力方法 |

| JP2014102654A (ja) * | 2012-11-19 | 2014-06-05 | Aisin Aw Co Ltd | 操作支援システム、操作支援方法及びコンピュータプログラム |

| JP2014174913A (ja) * | 2013-03-12 | 2014-09-22 | Olympus Imaging Corp | 情報機器及び情報伝達方法 |

| JP2014197388A (ja) * | 2013-03-11 | 2014-10-16 | イマージョン コーポレーションImmersion Corporation | 視線に応じた触覚感覚 |

| JPWO2013151155A1 (ja) * | 2012-04-06 | 2015-12-17 | 株式会社ニコン | データ処理装置、及びデータ処理プログラム |

| JP2017517053A (ja) * | 2014-04-10 | 2017-06-22 | マイクロソフト テクノロジー ライセンシング,エルエルシー | 注視トラッキングの方法およびデバイスにおける視覚的な変更の非視覚的なフィードバック |

| JP2017531870A (ja) * | 2014-10-02 | 2017-10-26 | ダヴ | 自動車両用の制御装置 |

| WO2020203425A1 (ja) * | 2019-04-01 | 2020-10-08 | ソニー株式会社 | 情報処理装置、情報処理方法、及びプログラム |

Families Citing this family (11)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8676431B1 (en) * | 2013-03-12 | 2014-03-18 | Google Inc. | User interface for displaying object-based indications in an autonomous driving system |

| JP6497158B2 (ja) * | 2014-05-16 | 2019-04-10 | 株式会社リコー | 表示装置、移動体 |

| JP6069282B2 (ja) * | 2014-10-30 | 2017-02-01 | 本田技研工業株式会社 | 車両用操作装置 |

| CN104834406B (zh) | 2015-05-29 | 2018-09-18 | 京东方科技集团股份有限公司 | 一种集成触摸功能的显示装置及其驱动方法 |

| CN106294911B (zh) | 2015-06-04 | 2019-09-10 | 北京智谷睿拓技术服务有限公司 | 信息处理方法、信息处理装置及用户设备 |

| CN106293031B (zh) | 2015-06-04 | 2019-05-21 | 北京智谷睿拓技术服务有限公司 | 信息处理方法、信息处理装置及用户设备 |

| CN106296796B (zh) * | 2015-06-04 | 2019-08-13 | 北京智谷睿拓技术服务有限公司 | 信息处理方法、信息处理装置及用户设备 |

| JP6705470B2 (ja) * | 2018-06-06 | 2020-06-03 | 株式会社Jvcケンウッド | 記録再生装置、記録再生方法、およびプログラム |

| JP2020166841A (ja) * | 2019-03-26 | 2020-10-08 | 株式会社東海理化電機製作所 | 制御装置、システム、及びプログラム |

| JP2020166831A (ja) * | 2019-03-26 | 2020-10-08 | 株式会社東海理化電機製作所 | 制御装置、システム、及びプログラム |

| CN112270910A (zh) * | 2020-11-26 | 2021-01-26 | 深圳市艾比森光电股份有限公司 | 显示屏的控制方法、控制装置及显示屏 |

Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009075861A (ja) * | 2007-09-20 | 2009-04-09 | Panasonic Corp | 入力装置および入力システム |

Family Cites Families (19)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH07120247B2 (ja) * | 1985-04-17 | 1995-12-20 | 松下電器産業株式会社 | 簡易入力装置 |

| US9513744B2 (en) * | 1994-08-15 | 2016-12-06 | Apple Inc. | Control systems employing novel physical controls and touch screens |

| US6750877B2 (en) * | 1995-12-13 | 2004-06-15 | Immersion Corporation | Controlling haptic feedback for enhancing navigation in a graphical environment |

| JPH11259202A (ja) * | 1998-03-12 | 1999-09-24 | Honda Motor Co Ltd | 習熟度判定手段を有する対話型コンピュータ・システム |

| US6297818B1 (en) * | 1998-05-08 | 2001-10-02 | Apple Computer, Inc. | Graphical user interface having sound effects for operating control elements and dragging objects |

| JP3753882B2 (ja) * | 1999-03-02 | 2006-03-08 | 株式会社東芝 | マルチモーダルインターフェース装置及びマルチモーダルインターフェース方法 |

| US6532005B1 (en) * | 1999-06-17 | 2003-03-11 | Denso Corporation | Audio positioning mechanism for a display |

| US20070078552A1 (en) * | 2006-01-13 | 2007-04-05 | Outland Research, Llc | Gaze-based power conservation for portable media players |

| JP2002196877A (ja) * | 2000-12-25 | 2002-07-12 | Hitachi Ltd | イメージセンサを用いた電子機器 |

| US7312785B2 (en) * | 2001-10-22 | 2007-12-25 | Apple Inc. | Method and apparatus for accelerated scrolling |

| US7218313B2 (en) * | 2003-10-31 | 2007-05-15 | Zeetoo, Inc. | Human interface system |

| JP2006301994A (ja) * | 2005-04-21 | 2006-11-02 | Matsushita Electric Ind Co Ltd | 操作反応出力装置 |

| US20080253592A1 (en) * | 2007-04-13 | 2008-10-16 | Christopher Sanders | User interface for multi-channel sound panner |

| US20100134408A1 (en) * | 2007-05-25 | 2010-06-03 | Palsbo Susan E | Fine-motor execution using repetitive force-feedback |

| JP5050720B2 (ja) * | 2007-08-06 | 2012-10-17 | 日産自動車株式会社 | 警報装置およびその方法 |

| US8253686B2 (en) * | 2007-11-26 | 2012-08-28 | Electronics And Telecommunications Research Institute | Pointing apparatus capable of providing haptic feedback, and haptic interaction system and method using the same |

| KR101486343B1 (ko) * | 2008-03-10 | 2015-01-26 | 엘지전자 주식회사 | 단말기 및 그 제어 방법 |

| JP2010074258A (ja) * | 2008-09-16 | 2010-04-02 | Sony Corp | 表示装置及び表示方法 |

| US20100236843A1 (en) * | 2009-03-20 | 2010-09-23 | Sony Ericsson Mobile Communications Ab | Data input device |

-

2012

- 2012-01-13 JP JP2013507211A patent/JP5563153B2/ja not_active Expired - Fee Related

- 2012-01-13 US US13/978,563 patent/US20130293466A1/en not_active Abandoned

- 2012-01-13 CN CN2012800050673A patent/CN103314342A/zh active Pending

- 2012-01-13 WO PCT/JP2012/050568 patent/WO2012132495A1/ja active Application Filing

- 2012-01-13 EP EP12764860.8A patent/EP2693311A4/en not_active Withdrawn

Patent Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009075861A (ja) * | 2007-09-20 | 2009-04-09 | Panasonic Corp | 入力装置および入力システム |

Cited By (10)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPWO2013151155A1 (ja) * | 2012-04-06 | 2015-12-17 | 株式会社ニコン | データ処理装置、及びデータ処理プログラム |

| JP2014092990A (ja) * | 2012-11-05 | 2014-05-19 | Lenovo Singapore Pte Ltd | 情報入力装置及びその音声出力方法 |

| JP2014102654A (ja) * | 2012-11-19 | 2014-06-05 | Aisin Aw Co Ltd | 操作支援システム、操作支援方法及びコンピュータプログラム |

| JP2014197388A (ja) * | 2013-03-11 | 2014-10-16 | イマージョン コーポレーションImmersion Corporation | 視線に応じた触覚感覚 |

| US9833697B2 (en) | 2013-03-11 | 2017-12-05 | Immersion Corporation | Haptic sensations as a function of eye gaze |

| JP2014174913A (ja) * | 2013-03-12 | 2014-09-22 | Olympus Imaging Corp | 情報機器及び情報伝達方法 |

| JP2017517053A (ja) * | 2014-04-10 | 2017-06-22 | マイクロソフト テクノロジー ライセンシング,エルエルシー | 注視トラッキングの方法およびデバイスにおける視覚的な変更の非視覚的なフィードバック |

| JP2017531870A (ja) * | 2014-10-02 | 2017-10-26 | ダヴ | 自動車両用の制御装置 |

| WO2020203425A1 (ja) * | 2019-04-01 | 2020-10-08 | ソニー株式会社 | 情報処理装置、情報処理方法、及びプログラム |

| US11947869B2 (en) | 2019-04-01 | 2024-04-02 | Sony Group Corporation | Information processing device, information processing method, and program |

Also Published As

| Publication number | Publication date |

|---|---|

| EP2693311A4 (en) | 2014-09-17 |

| EP2693311A1 (en) | 2014-02-05 |

| US20130293466A1 (en) | 2013-11-07 |

| CN103314342A (zh) | 2013-09-18 |

| JPWO2012132495A1 (ja) | 2014-07-24 |

| JP5563153B2 (ja) | 2014-07-30 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| WO2012132495A1 (ja) | 操作装置 | |

| US9671867B2 (en) | Interactive control device and method for operating the interactive control device | |

| JP2021166058A (ja) | 車両の中で触覚フィードバックを用いるジェスチャー・ベースの入力システム | |

| US20160132126A1 (en) | System for information transmission in a motor vehicle | |

| CN110740896B (zh) | 用于运输工具的用户界面以及具有用户界面的运输工具 | |

| US10747324B2 (en) | Gesture input system and gesture input method | |

| US10126928B2 (en) | Vehicle human machine interface with auto-customization | |

| EP3623930B1 (en) | Operation apparatus | |

| EP2700543A1 (en) | Vehicle operation device | |

| US10558271B2 (en) | System for receiving input in response to motion of user | |

| GB2501575A (en) | Interacting with vehicle controls through gesture recognition | |

| US10261653B2 (en) | Method and device for making available a user interface, in particular in a vehicle | |

| US10168786B2 (en) | Gesture guidance device for moving platform, gesture guidance system for moving platform, and gesture guidance method for moving platform | |

| JP4566596B2 (ja) | 操作指示装置 | |

| WO2019017008A1 (ja) | 入力装置 | |

| JP2006327526A (ja) | 車載機器の操作装置 | |

| JP4347112B2 (ja) | 仮想インタフェース制御装置 | |

| KR20150056322A (ko) | 헤드업 디스플레이의 메뉴 제어 장치 및 방법 | |

| US20160238701A1 (en) | Gaze recognition system and method | |

| KR101594404B1 (ko) | 대상 물체의 3차원적 움직임 및 속도를 인식할 수 있는 입력장치 및 이를 이용한 전자 기기 | |

| KR102302254B1 (ko) | 차량 내에서 사람의 머리 움직임을 활용한 인터페이스 장치 | |

| US20220392320A1 (en) | Tactile presentation device and tactile presentation method | |

| US20230221803A1 (en) | Method for detecting an operating input, and operating device | |

| KR20230157614A (ko) | 차량용 제스처 인식 시스템 및 그 제어 방법 | |

| KR20220020756A (ko) | 입력 장치, 이를 포함하는 차량 및 입력 장치의 제어 방법 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| 121 | Ep: the epo has been informed by wipo that ep was designated in this application |

Ref document number: 12764860 Country of ref document: EP Kind code of ref document: A1 |

|

| ENP | Entry into the national phase |

Ref document number: 2013507211 Country of ref document: JP Kind code of ref document: A |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 2012764860 Country of ref document: EP |

|

| WWE | Wipo information: entry into national phase |

Ref document number: 13978563 Country of ref document: US |

|

| NENP | Non-entry into the national phase |

Ref country code: DE |