KR20220135036A - 이미지의 품질을 향상시키는 전자 장치 및 그 동작 방법 - Google Patents

이미지의 품질을 향상시키는 전자 장치 및 그 동작 방법 Download PDFInfo

- Publication number

- KR20220135036A KR20220135036A KR1020210040510A KR20210040510A KR20220135036A KR 20220135036 A KR20220135036 A KR 20220135036A KR 1020210040510 A KR1020210040510 A KR 1020210040510A KR 20210040510 A KR20210040510 A KR 20210040510A KR 20220135036 A KR20220135036 A KR 20220135036A

- Authority

- KR

- South Korea

- Prior art keywords

- pixel data

- pixel

- data

- image

- image data

- Prior art date

Links

- 238000011017 operating method Methods 0.000 title 1

- 230000006870 function Effects 0.000 claims description 65

- 238000000034 method Methods 0.000 claims description 59

- 238000012935 Averaging Methods 0.000 claims description 11

- 238000004891 communication Methods 0.000 description 47

- 238000012545 processing Methods 0.000 description 15

- 230000007547 defect Effects 0.000 description 13

- 230000005484 gravity Effects 0.000 description 9

- 230000033001 locomotion Effects 0.000 description 9

- 238000013528 artificial neural network Methods 0.000 description 8

- 238000005516 engineering process Methods 0.000 description 7

- 230000008569 process Effects 0.000 description 7

- 238000010586 diagram Methods 0.000 description 6

- 239000003381 stabilizer Substances 0.000 description 6

- 238000013473 artificial intelligence Methods 0.000 description 5

- 238000004364 calculation method Methods 0.000 description 4

- 238000004590 computer program Methods 0.000 description 4

- 230000007423 decrease Effects 0.000 description 4

- 230000000694 effects Effects 0.000 description 3

- 230000003287 optical effect Effects 0.000 description 3

- 230000004044 response Effects 0.000 description 3

- 230000001133 acceleration Effects 0.000 description 2

- 230000000712 assembly Effects 0.000 description 2

- 238000000429 assembly Methods 0.000 description 2

- 238000004422 calculation algorithm Methods 0.000 description 2

- 238000006243 chemical reaction Methods 0.000 description 2

- 238000013527 convolutional neural network Methods 0.000 description 2

- 230000006872 improvement Effects 0.000 description 2

- 230000001788 irregular Effects 0.000 description 2

- 238000010801 machine learning Methods 0.000 description 2

- 230000002093 peripheral effect Effects 0.000 description 2

- 230000000306 recurrent effect Effects 0.000 description 2

- 230000008901 benefit Effects 0.000 description 1

- 230000002457 bidirectional effect Effects 0.000 description 1

- 230000005540 biological transmission Effects 0.000 description 1

- 230000015572 biosynthetic process Effects 0.000 description 1

- 230000010267 cellular communication Effects 0.000 description 1

- 230000001413 cellular effect Effects 0.000 description 1

- 230000000295 complement effect Effects 0.000 description 1

- 239000004020 conductor Substances 0.000 description 1

- 230000003111 delayed effect Effects 0.000 description 1

- 230000009977 dual effect Effects 0.000 description 1

- 230000007613 environmental effect Effects 0.000 description 1

- 238000000605 extraction Methods 0.000 description 1

- 239000000446 fuel Substances 0.000 description 1

- 230000036541 health Effects 0.000 description 1

- 230000010354 integration Effects 0.000 description 1

- 230000003155 kinesthetic effect Effects 0.000 description 1

- 229910044991 metal oxide Inorganic materials 0.000 description 1

- 150000004706 metal oxides Chemical class 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000001537 neural effect Effects 0.000 description 1

- 230000001151 other effect Effects 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 230000002787 reinforcement Effects 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

- 230000005236 sound signal Effects 0.000 description 1

- 230000006641 stabilisation Effects 0.000 description 1

- 238000011105 stabilization Methods 0.000 description 1

- 230000000638 stimulation Effects 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

- 239000000758 substrate Substances 0.000 description 1

- 238000003786 synthesis reaction Methods 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

- 229910052724 xenon Inorganic materials 0.000 description 1

- FHNFHKCVQCLJFQ-UHFFFAOYSA-N xenon atom Chemical compound [Xe] FHNFHKCVQCLJFQ-UHFFFAOYSA-N 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/68—Control of cameras or camera modules for stable pick-up of the scene, e.g. compensating for camera body vibrations

- H04N23/682—Vibration or motion blur correction

- H04N23/683—Vibration or motion blur correction performed by a processor, e.g. controlling the readout of an image memory

-

- H04N5/23287—

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/68—Control of cameras or camera modules for stable pick-up of the scene, e.g. compensating for camera body vibrations

- H04N23/681—Motion detection

- H04N23/6812—Motion detection based on additional sensors, e.g. acceleration sensors

-

- G—PHYSICS

- G03—PHOTOGRAPHY; CINEMATOGRAPHY; ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ELECTROGRAPHY; HOLOGRAPHY

- G03B—APPARATUS OR ARRANGEMENTS FOR TAKING PHOTOGRAPHS OR FOR PROJECTING OR VIEWING THEM; APPARATUS OR ARRANGEMENTS EMPLOYING ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ACCESSORIES THEREFOR

- G03B5/00—Adjustment of optical system relative to image or object surface other than for focusing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/68—Control of cameras or camera modules for stable pick-up of the scene, e.g. compensating for camera body vibrations

- H04N23/682—Vibration or motion blur correction

- H04N23/685—Vibration or motion blur correction performed by mechanical compensation

- H04N23/687—Vibration or motion blur correction performed by mechanical compensation by shifting the lens or sensor position

-

- H04N5/2253—

-

- H04N5/2254—

-

- H04N5/23229—

-

- G—PHYSICS

- G03—PHOTOGRAPHY; CINEMATOGRAPHY; ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ELECTROGRAPHY; HOLOGRAPHY

- G03B—APPARATUS OR ARRANGEMENTS FOR TAKING PHOTOGRAPHS OR FOR PROJECTING OR VIEWING THEM; APPARATUS OR ARRANGEMENTS EMPLOYING ANALOGOUS TECHNIQUES USING WAVES OTHER THAN OPTICAL WAVES; ACCESSORIES THEREFOR

- G03B2205/00—Adjustment of optical system relative to image or object surface other than for focusing

- G03B2205/0007—Movement of one or more optical elements for control of motion blur

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/95—Computational photography systems, e.g. light-field imaging systems

- H04N23/951—Computational photography systems, e.g. light-field imaging systems by using two or more images to influence resolution, frame rate or aspect ratio

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N25/00—Circuitry of solid-state image sensors [SSIS]; Control thereof

- H04N25/48—Increasing resolution by shifting the sensor relative to the scene

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N25/00—Circuitry of solid-state image sensors [SSIS]; Control thereof

- H04N25/50—Control of the SSIS exposure

- H04N25/53—Control of the integration time

- H04N25/531—Control of the integration time by controlling rolling shutters in CMOS SSIS

Abstract

본 문서의 일 실시 예에 따른 전자 장치는, OIS 기능을 수행할 수 있는 카메라 모듈, 및 상기 카메라 모듈과 전기적으로 연결된 적어도 하나의 프로세서를 포함할 수 있다. 상기 적어도 하나의 프로세서는, 상기 OIS 기능을 이용하여 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득하도록 상기 카메라 모듈을 제어하고, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득하고, 상기 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성할 수 있다.

Description

본 개시는 카메라 모듈을 이용한 영상 촬영 시 이미지의 품질을 향상시키는 기술에 관한 것이다.

최근 모바일 디바이스의 기능이 다양화되면서 모바일 디바이스를 이용한 이미지 촬영 기능의 향상에 대한 요구도 늘어나고 있다. 이에 따라 모바일 디바이스를 통해 획득되는 이미지의 품질을 향상시키기 위한 기술이 요구되고 있다.

전자 장치는 OIS(optical image stabilization, 광학식 흔들림 보정) 기능을 수행할 수 있는 카메라 모듈을 포함할 수 있다. 전자 장치는 OIS 기능을 통해 카메라 모듈에 포함된 렌즈 어셈블리를 이동시키거나, 이미지 센서를 이동시켜 흔들림을 보정할 수 있다. OIS 기능은 이미지 센서를 이동시키는 센서 시프트(sensor shift) 방식과 렌즈 어셈블리를 이동시키는 렌즈 시프트(lens shift) 방식을 포함한다. OIS 기능을 수행할 수 있는 전자 장치는, OIS 기능이 수행되는 동안 카메라 모듈로부터 복수의 이미지 데이터들을 획득할 수 있다.

종래 기술에 따르면, 카메라 모듈을 통해 획득되는 이미지의 해상도를 향상시키는 데에 한계가 있다. 예를 들면, 렌즈 어셈블리의 MTF(modulation transfer function), 또는 이미지 센서에 포함될 수 있는 화소 수에 한계가 있으므로, 이미지의 해상도를 향상시키기 어렵다는 문제가 있다.

또한 종래 기술에 따르면, 전자 장치가 OIS 기능을 수행하는 동안 흔들림을 일부 보정하여 획득한 이미지 데이터에도 노이즈(noise), 블러(blur), 재깅 결함(jagging artifact) 등의 결함(artifact)이 포함되어 있다는 문제가 있다.

본 문서의 일 실시 예에 따른 전자 장치(electronic device)는, OIS 기능을 수행할 수 있는 카메라 모듈, 및 상기 카메라 모듈과 전기적으로 연결된 적어도 하나의 프로세서를 포함할 수 있다. 상기 적어도 하나의 프로세서는, 상기 OIS 기능을 이용하여 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득하도록 상기 카메라 모듈을 제어하고, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득하고, 상기 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치의 동작 방법은, OIS 기능을 이용하여 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득하도록 상기 전자 장치에 포함된 카메라 모듈을 제어하는 동작, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득하는 동작, 및 상기 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성하는 동작을 포함할 수 있다.

본 문서에 개시되는 다양한 실시 예들에 따르면, 전자 장치는 해상도가 향상된 이미지를 획득할 수 있다. 전자 장치는 OIS 기능이 수행되는 동안 획득된 1개의 이미지 데이터보다 높은 해상도를 가지는 이미지를 획득할 수 있다.

본 문서에 개시되는 다양한 실시 예들에 따르면, 전자 장치는 이미지 데이터에 포함된 결함을 감소시킬 수 있다. 예를 들면, 전자 장치는 OIS 기능이 수행되는 동안 획득된 1개의 이미지 데이터보다 결함이 적은 이미지를 획득할 수 있다.

본 개시에서 얻을 수 있는 효과는 이상에서 언급한 효과들로 제한되지 않으며, 언급하지 않은 또 다른 효과들은 아래의 기재로부터 본 개시가 속하는 기술 분야에서 통상의 지식을 가진 자에게 명확하게 이해될 수 있다.

도 1은 다양한 실시 예들에 따른 네트워크 환경 내의 전자 장치의 블록도이다.

도 2는 다양한 실시 예들에 따른 카메라 모듈을 예시하는 블록도이다.

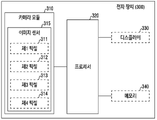

도 3은 일 실시 예에 따른 카메라 모듈을 포함하는 전자 장치의 간략한 구성을 나타내는 블록도이다.

도 4는 일 실시 예에 따라 이미지의 품질을 향상시킬 수 있는 전자 장치의 동작을 도시하는 흐름도이다.

도 5는 일 실시 예에 따라, OIS 기능을 이용하여 획득된 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터의 예를 도시한다.

도 6은 일 실시 예에 따라, 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 기반으로 제1 이미지 프레임을 생성하는 예를 도시한다.

도 7은 일 실시 예에 따라, 나이퀴스트 주파수(Nyquist frequency)가 달라지는 예를 도시한다.

도 8a는 일 실시 예에 따라 이미지에 포함된 결함이 감소되는 예를 도시한다.

도 8b는 일 실시 예에 따라 이미지의 해상도가 증가되는 예를 도시한다.

도 9는 일 실시 예에 따라, 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 기반으로 동영상을 생성하는 예를 도시한다.

도 2는 다양한 실시 예들에 따른 카메라 모듈을 예시하는 블록도이다.

도 3은 일 실시 예에 따른 카메라 모듈을 포함하는 전자 장치의 간략한 구성을 나타내는 블록도이다.

도 4는 일 실시 예에 따라 이미지의 품질을 향상시킬 수 있는 전자 장치의 동작을 도시하는 흐름도이다.

도 5는 일 실시 예에 따라, OIS 기능을 이용하여 획득된 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터의 예를 도시한다.

도 6은 일 실시 예에 따라, 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 기반으로 제1 이미지 프레임을 생성하는 예를 도시한다.

도 7은 일 실시 예에 따라, 나이퀴스트 주파수(Nyquist frequency)가 달라지는 예를 도시한다.

도 8a는 일 실시 예에 따라 이미지에 포함된 결함이 감소되는 예를 도시한다.

도 8b는 일 실시 예에 따라 이미지의 해상도가 증가되는 예를 도시한다.

도 9는 일 실시 예에 따라, 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 기반으로 동영상을 생성하는 예를 도시한다.

도 1은, 다양한 실시 예들에 따른, 네트워크 환경(100) 내의 전자 장치(101)의 블록도이다. 도 1을 참조하면, 네트워크 환경(100)에서 전자 장치(101)는 제 1 네트워크(198)(예: 근거리 무선 통신 네트워크)를 통하여 전자 장치(102)와 통신하거나, 또는 제 2 네트워크(199)(예: 원거리 무선 통신 네트워크)를 통하여 전자 장치(104) 또는 서버(108) 중 적어도 하나와 통신할 수 있다. 일 실시 예에 따르면, 전자 장치(101)는 서버(108)를 통하여 전자 장치(104)와 통신할 수 있다. 일 실시 예에 따르면, 전자 장치(101)는 프로세서(120), 메모리(130), 입력 모듈(150), 음향 출력 모듈(155), 디스플레이 모듈(160), 오디오 모듈(170), 센서 모듈(176), 인터페이스(177), 연결 단자(178), 햅틱 모듈(179), 카메라 모듈(180), 전력 관리 모듈(188), 배터리(189), 통신 모듈(190), 가입자 식별 모듈(196), 또는 안테나 모듈(197)을 포함할 수 있다. 어떤 실시 예에서는, 전자 장치(101)에는, 이 구성요소들 중 적어도 하나(예: 연결 단자(178))가 생략되거나, 하나 이상의 다른 구성요소가 추가될 수 있다. 어떤 실시 예에서는, 이 구성요소들 중 일부들(예: 센서 모듈(176), 카메라 모듈(180), 또는 안테나 모듈(197))은 하나의 구성요소(예: 디스플레이 모듈(160))로 통합될 수 있다.

프로세서(120)는, 예를 들면, 소프트웨어(예: 프로그램(140))를 실행하여 프로세서(120)에 연결된 전자 장치(101)의 적어도 하나의 다른 구성요소(예: 하드웨어 또는 소프트웨어 구성요소)를 제어할 수 있고, 다양한 데이터 처리 또는 연산을 수행할 수 있다. 일 실시 예에 따르면, 데이터 처리 또는 연산의 적어도 일부로서, 프로세서(120)는 다른 구성요소(예: 센서 모듈(176) 또는 통신 모듈(190))로부터 수신된 명령 또는 데이터를 휘발성 메모리(132)에 저장하고, 휘발성 메모리(132)에 저장된 명령 또는 데이터를 처리하고, 결과 데이터를 비휘발성 메모리(134)에 저장할 수 있다. 일 실시 예에 따르면, 프로세서(120)는 메인 프로세서(121)(예: 중앙 처리 장치 또는 어플리케이션 프로세서) 또는 이와는 독립적으로 또는 함께 운영 가능한 보조 프로세서(123)(예: 그래픽 처리 장치, 신경망 처리 장치(NPU: neural processing unit), 이미지 시그널 프로세서, 센서 허브 프로세서, 또는 커뮤니케이션 프로세서)를 포함할 수 있다. 예를 들어, 전자 장치(101)가 메인 프로세서(121) 및 보조 프로세서(123)를 포함하는 경우, 보조 프로세서(123)는 메인 프로세서(121)보다 저전력을 사용하거나, 지정된 기능에 특화되도록 설정될 수 있다. 보조 프로세서(123)는 메인 프로세서(121)와 별개로, 또는 그 일부로서 구현될 수 있다.

보조 프로세서(123)는, 예를 들면, 메인 프로세서(121)가 인액티브(예: 슬립) 상태에 있는 동안 메인 프로세서(121)를 대신하여, 또는 메인 프로세서(121)가 액티브(예: 어플리케이션 실행) 상태에 있는 동안 메인 프로세서(121)와 함께, 전자 장치(101)의 구성요소들 중 적어도 하나의 구성요소(예: 디스플레이 모듈(160), 센서 모듈(176), 또는 통신 모듈(190))와 관련된 기능 또는 상태들의 적어도 일부를 제어할 수 있다. 일 실시 예에 따르면, 보조 프로세서(123)(예: 이미지 시그널 프로세서 또는 커뮤니케이션 프로세서)는 기능적으로 관련 있는 다른 구성요소(예: 카메라 모듈(180) 또는 통신 모듈(190))의 일부로서 구현될 수 있다. 일 실시 예에 따르면, 보조 프로세서(123)(예: 신경망 처리 장치)는 인공지능 모델의 처리에 특화된 하드웨어 구조를 포함할 수 있다. 인공지능 모델은 기계 학습을 통해 생성될 수 있다. 이러한 학습은, 예를 들어, 인공지능 모델이 수행되는 전자 장치(101) 자체에서 수행될 수 있고, 별도의 서버(예: 서버(108))를 통해 수행될 수도 있다. 학습 알고리즘은, 예를 들어, 지도형 학습(supervised learning), 비지도형 학습(unsupervised learning), 준지도형 학습(semi-supervised learning) 또는 강화 학습(reinforcement learning)을 포함할 수 있으나, 전술한 예에 한정되지 않는다. 인공지능 모델은, 복수의 인공 신경망 레이어들을 포함할 수 있다. 인공 신경망은 심층 신경망(DNN: deep neural network), CNN(convolutional neural network), RNN(recurrent neural network), RBM(restricted boltzmann machine), DBN(deep belief network), BRDNN(bidirectional recurrent deep neural network), 심층 Q-네트워크(deep Q-networks) 또는 상기 중 둘 이상의 조합 중 하나일 수 있으나, 전술한 예에 한정되지 않는다. 인공지능 모델은 하드웨어 구조 이외에, 추가적으로 또는 대체적으로, 소프트웨어 구조를 포함할 수 있다.

메모리(130)는, 전자 장치(101)의 적어도 하나의 구성요소(예: 프로세서(120) 또는 센서 모듈(176))에 의해 사용되는 다양한 데이터를 저장할 수 있다. 데이터는, 예를 들어, 소프트웨어(예: 프로그램(140)) 및, 이와 관련된 명령에 대한 입력 데이터 또는 출력 데이터를 포함할 수 있다. 메모리(130)는, 휘발성 메모리(132) 또는 비휘발성 메모리(134)를 포함할 수 있다.

프로그램(140)은 메모리(130)에 소프트웨어로서 저장될 수 있으며, 예를 들면, 운영 체제(142), 미들 웨어(144) 또는 어플리케이션(146)을 포함할 수 있다.

입력 모듈(150)은, 전자 장치(101)의 구성요소(예: 프로세서(120))에 사용될 명령 또는 데이터를 전자 장치(101)의 외부(예: 사용자)로부터 수신할 수 있다. 입력 모듈(150)은, 예를 들면, 마이크, 마우스, 키보드, 키(예: 버튼), 또는 디지털 펜(예: 스타일러스 펜)을 포함할 수 있다.

음향 출력 모듈(155)은 음향 신호를 전자 장치(101)의 외부로 출력할 수 있다. 음향 출력 모듈(155)은, 예를 들면, 스피커 또는 리시버를 포함할 수 있다. 스피커는 멀티미디어 재생 또는 녹음 재생과 같이 일반적인 용도로 사용될 수 있다. 리시버는 착신 전화를 수신하기 위해 사용될 수 있다. 일 실시 예에 따르면, 리시버는 스피커와 별개로, 또는 그 일부로서 구현될 수 있다.

디스플레이 모듈(160)은 전자 장치(101)의 외부(예: 사용자)로 정보를 시각적으로 제공할 수 있다. 디스플레이 모듈(160)은, 예를 들면, 디스플레이, 홀로그램 장치, 또는 프로젝터 및 해당 장치를 제어하기 위한 제어 회로를 포함할 수 있다. 일 실시 예에 따르면, 디스플레이 모듈(160)은 터치를 감지하도록 설정된 터치 센서, 또는 상기 터치에 의해 발생되는 힘의 세기를 측정하도록 설정된 압력 센서를 포함할 수 있다.

오디오 모듈(170)은 소리를 전기 신호로 변환시키거나, 반대로 전기 신호를 소리로 변환시킬 수 있다. 일 실시 예에 따르면, 오디오 모듈(170)은, 입력 모듈(150)을 통해 소리를 획득하거나, 음향 출력 모듈(155), 또는 전자 장치(101)와 직접 또는 무선으로 연결된 외부 전자 장치(예: 전자 장치(102))(예: 스피커 또는 헤드폰)를 통해 소리를 출력할 수 있다.

센서 모듈(176)은 전자 장치(101)의 작동 상태(예: 전력 또는 온도), 또는 외부의 환경 상태(예: 사용자 상태)를 감지하고, 감지된 상태에 대응하는 전기 신호 또는 데이터 값을 생성할 수 있다. 일 실시 예에 따르면, 센서 모듈(176)은, 예를 들면, 제스처 센서, 자이로 센서, 기압 센서, 마그네틱 센서, 가속도 센서, 그립 센서, 근접 센서, 컬러 센서, IR(infrared) 센서, 생체 센서, 온도 센서, 습도 센서, 또는 조도 센서를 포함할 수 있다.

인터페이스(177)는 전자 장치(101)가 외부 전자 장치(예: 전자 장치(102))와 직접 또는 무선으로 연결되기 위해 사용될 수 있는 하나 이상의 지정된 프로토콜들을 지원할 수 있다. 일 실시 예에 따르면, 인터페이스(177)는, 예를 들면, HDMI(high definition multimedia interface), USB(universal serial bus) 인터페이스, SD카드 인터페이스, 또는 오디오 인터페이스를 포함할 수 있다.

연결 단자(178)는, 그를 통해서 전자 장치(101)가 외부 전자 장치(예: 전자 장치(102))와 물리적으로 연결될 수 있는 커넥터를 포함할 수 있다. 일 실시 예에 따르면, 연결 단자(178)는, 예를 들면, HDMI 커넥터, USB 커넥터, SD 카드 커넥터, 또는 오디오 커넥터(예: 헤드폰 커넥터)를 포함할 수 있다.

햅틱 모듈(179)은 전기적 신호를 사용자가 촉각 또는 운동 감각을 통해서 인지할 수 있는 기계적인 자극(예: 진동 또는 움직임) 또는 전기적인 자극으로 변환할 수 있다. 일 실시 예에 따르면, 햅틱 모듈(179)은, 예를 들면, 모터, 압전 소자, 또는 전기 자극 장치를 포함할 수 있다.

카메라 모듈(180)은 정지 영상 및 동영상을 촬영할 수 있다. 일 실시 예에 따르면, 카메라 모듈(180)은 하나 이상의 렌즈들, 이미지 센서들, 이미지 시그널 프로세서들, 또는 플래시들을 포함할 수 있다.

전력 관리 모듈(188)은 전자 장치(101)에 공급되는 전력을 관리할 수 있다. 일 실시 예에 따르면, 전력 관리 모듈(188)은, 예를 들면, PMIC(power management integrated circuit)의 적어도 일부로서 구현될 수 있다.

배터리(189)는 전자 장치(101)의 적어도 하나의 구성요소에 전력을 공급할 수 있다. 일 실시 예에 따르면, 배터리(189)는, 예를 들면, 재충전 불가능한 1차 전지, 재충전 가능한 2차 전지 또는 연료 전지를 포함할 수 있다.

통신 모듈(190)은 전자 장치(101)와 외부 전자 장치(예: 전자 장치(102), 전자 장치(104), 또는 서버(108)) 간의 직접(예: 유선) 통신 채널 또는 무선 통신 채널의 수립, 및 수립된 통신 채널을 통한 통신 수행을 지원할 수 있다. 통신 모듈(190)은 프로세서(120)(예: 어플리케이션 프로세서)와 독립적으로 운영되고, 직접(예: 유선) 통신 또는 무선 통신을 지원하는 하나 이상의 커뮤니케이션 프로세서를 포함할 수 있다. 일 실시 예에 따르면, 통신 모듈(190)은 무선 통신 모듈(192)(예: 셀룰러 통신 모듈, 근거리 무선 통신 모듈, 또는 GNSS(global navigation satellite system) 통신 모듈) 또는 유선 통신 모듈(194)(예: LAN(local area network) 통신 모듈, 또는 전력선 통신 모듈)을 포함할 수 있다. 이들 통신 모듈 중 해당하는 통신 모듈은 제 1 네트워크(198)(예: 블루투스, WiFi(wireless fidelity) direct 또는 IrDA(infrared data association)와 같은 근거리 통신 네트워크) 또는 제 2 네트워크(199)(예: 레거시 셀룰러 네트워크, 5G 네트워크, 차세대 통신 네트워크, 인터넷, 또는 컴퓨터 네트워크(예: LAN 또는 WAN)와 같은 원거리 통신 네트워크)를 통하여 외부의 전자 장치(104)와 통신할 수 있다. 이런 여러 종류의 통신 모듈들은 하나의 구성요소(예: 단일 칩)로 통합되거나, 또는 서로 별도의 복수의 구성요소들(예: 복수 칩들)로 구현될 수 있다. 무선 통신 모듈(192)은 가입자 식별 모듈(196)에 저장된 가입자 정보(예: 국제 모바일 가입자 식별자(IMSI))를 이용하여 제 1 네트워크(198) 또는 제 2 네트워크(199)와 같은 통신 네트워크 내에서 전자 장치(101)를 확인 또는 인증할 수 있다.

무선 통신 모듈(192)은 4G 네트워크 이후의 5G 네트워크 및 차세대 통신 기술, 예를 들어, NR 접속 기술(new radio access technology)을 지원할 수 있다. NR 접속 기술은 고용량 데이터의 고속 전송(eMBB(enhanced mobile broadband)), 단말 전력 최소화와 다수 단말의 접속(mMTC(massive machine type communications)), 또는 고신뢰도와 저지연(URLLC(ultra-reliable and low-latency communications))을 지원할 수 있다. 무선 통신 모듈(192)은, 예를 들어, 높은 데이터 전송률 달성을 위해, 고주파 대역(예: mmWave 대역)을 지원할 수 있다. 무선 통신 모듈(192)은 고주파 대역에서의 성능 확보를 위한 다양한 기술들, 예를 들어, 빔포밍(beamforming), 거대 배열 다중 입출력(massive MIMO(multiple-input and multiple-output)), 전차원 다중입출력(FD-MIMO: full dimensional MIMO), 어레이 안테나(array antenna), 아날로그 빔형성(analog beam-forming), 또는 대규모 안테나(large scale antenna)와 같은 기술들을 지원할 수 있다. 무선 통신 모듈(192)은 전자 장치(101), 외부 전자 장치(예: 전자 장치(104)) 또는 네트워크 시스템(예: 제 2 네트워크(199))에 규정되는 다양한 요구사항을 지원할 수 있다. 일 실시 예에 따르면, 무선 통신 모듈(192)은 eMBB 실현을 위한 Peak data rate(예: 20Gbps 이상), mMTC 실현을 위한 손실 Coverage(예: 164dB 이하), 또는 URLLC 실현을 위한 U-plane latency(예: 다운링크(DL) 및 업링크(UL) 각각 0.5ms 이하, 또는 라운드 트립 1ms 이하)를 지원할 수 있다.

안테나 모듈(197)은 신호 또는 전력을 외부(예: 외부의 전자 장치)로 송신하거나 외부로부터 수신할 수 있다. 일 실시 예에 따르면, 안테나 모듈(197)은 서브스트레이트(예: PCB) 위에 형성된 도전체 또는 도전성 패턴으로 이루어진 방사체를 포함하는 안테나를 포함할 수 있다. 일 실시 예에 따르면, 안테나 모듈(197)은 복수의 안테나들(예: 어레이 안테나)을 포함할 수 있다. 이런 경우, 제 1 네트워크(198) 또는 제 2 네트워크(199)와 같은 통신 네트워크에서 사용되는 통신 방식에 적합한 적어도 하나의 안테나가, 예를 들면, 통신 모듈(190)에 의하여 상기 복수의 안테나들로부터 선택될 수 있다. 신호 또는 전력은 상기 선택된 적어도 하나의 안테나를 통하여 통신 모듈(190)과 외부의 전자 장치 간에 송신되거나 수신될 수 있다. 어떤 실시 예에 따르면, 방사체 이외에 다른 부품(예: RFIC(radio frequency integrated circuit))이 추가로 안테나 모듈(197)의 일부로 형성될 수 있다.

다양한 실시 예에 따르면, 안테나 모듈(197)은 mmWave 안테나 모듈을 형성할 수 있다. 일 실시 예에 따르면, mmWave 안테나 모듈은 인쇄 회로 기판, 상기 인쇄 회로 기판의 제 1 면(예: 아래 면)에 또는 그에 인접하여 배치되고 지정된 고주파 대역(예: mmWave 대역)을 지원할 수 있는 RFIC, 및 상기 인쇄 회로 기판의 제 2 면(예: 윗 면 또는 측 면)에 또는 그에 인접하여 배치되고 상기 지정된 고주파 대역의 신호를 송신 또는 수신할 수 있는 복수의 안테나들(예: 어레이 안테나)을 포함할 수 있다.

상기 구성요소들 중 적어도 일부는 주변 기기들간 통신 방식(예: 버스, GPIO(general purpose input and output), SPI(serial peripheral interface), 또는 MIPI(mobile industry processor interface))을 통해 서로 연결되고 신호(예: 명령 또는 데이터)를 상호간에 교환할 수 있다.

일 실시 예에 따르면, 명령 또는 데이터는 제 2 네트워크(199)에 연결된 서버(108)를 통해서 전자 장치(101)와 외부의 전자 장치(104)간에 송신 또는 수신될 수 있다. 외부의 전자 장치(102, 또는 104) 각각은 전자 장치(101)와 동일한 또는 다른 종류의 장치일 수 있다. 일 실시 예에 따르면, 전자 장치(101)에서 실행되는 동작들의 전부 또는 일부는 외부의 전자 장치들(102, 104, 또는 108) 중 하나 이상의 외부의 전자 장치들에서 실행될 수 있다. 예를 들면, 전자 장치(101)가 어떤 기능이나 서비스를 자동으로, 또는 사용자 또는 다른 장치로부터의 요청에 반응하여 수행해야 할 경우에, 전자 장치(101)는 기능 또는 서비스를 자체적으로 실행시키는 대신에 또는 추가적으로, 하나 이상의 외부의 전자 장치들에게 그 기능 또는 그 서비스의 적어도 일부를 수행하라고 요청할 수 있다. 상기 요청을 수신한 하나 이상의 외부의 전자 장치들은 요청된 기능 또는 서비스의 적어도 일부, 또는 상기 요청과 관련된 추가 기능 또는 서비스를 실행하고, 그 실행의 결과를 전자 장치(101)로 전달할 수 있다. 전자 장치(101)는 상기 결과를, 그대로 또는 추가적으로 처리하여, 상기 요청에 대한 응답의 적어도 일부로서 제공할 수 있다. 이를 위하여, 예를 들면, 클라우드 컴퓨팅, 분산 컴퓨팅, 모바일 에지 컴퓨팅(MEC: mobile edge computing), 또는 클라이언트-서버 컴퓨팅 기술이 이용될 수 있다. 전자 장치(101)는, 예를 들어, 분산 컴퓨팅 또는 모바일 에지 컴퓨팅을 이용하여 초저지연 서비스를 제공할 수 있다. 다른 실시 예에 있어서, 외부의 전자 장치(104)는 IoT(internet of things) 기기를 포함할 수 있다. 서버(108)는 기계 학습 및/또는 신경망을 이용한 지능형 서버일 수 있다. 일 실시 예에 따르면, 외부의 전자 장치(104) 또는 서버(108)는 제 2 네트워크(199) 내에 포함될 수 있다. 전자 장치(101)는 5G 통신 기술 및 IoT 관련 기술을 기반으로 지능형 서비스(예: 스마트 홈, 스마트 시티, 스마트 카, 또는 헬스 케어)에 적용될 수 있다.

본 문서에 개시된 다양한 실시 예들에 따른 전자 장치는 다양한 형태의 장치가 될 수 있다. 전자 장치는, 예를 들면, 휴대용 통신 장치(예: 스마트폰), 컴퓨터 장치, 휴대용 멀티미디어 장치, 휴대용 의료 기기, 카메라, 웨어러블 장치, 또는 가전 장치를 포함할 수 있다. 본 문서의 실시 예에 따른 전자 장치는 전술한 기기들에 한정되지 않는다.

본 문서의 다양한 실시 예들 및 이에 사용된 용어들은 본 문서에 기재된 기술적 특징들을 특정한 실시 예들로 한정하려는 것이 아니며, 해당 실시 예의 다양한 변경, 균등물, 또는 대체물을 포함하는 것으로 이해되어야 한다. 도면의 설명과 관련하여, 유사한 또는 관련된 구성요소에 대해서는 유사한 참조 부호가 사용될 수 있다. 아이템에 대응하는 명사의 단수 형은 관련된 문맥상 명백하게 다르게 지시하지 않는 한, 상기 아이템 한 개 또는 복수 개를 포함할 수 있다. 본 문서에서, "A 또는 B", "A 및 B 중 적어도 하나", "A 또는 B 중 적어도 하나", "A, B 또는 C", "A, B 및 C 중 적어도 하나", 및 "A, B, 또는 C 중 적어도 하나"와 같은 문구들 각각은 그 문구들 중 해당하는 문구에 함께 나열된 항목들 중 어느 하나, 또는 그들의 모든 가능한 조합을 포함할 수 있다. "제 1", "제 2", 또는 "첫째" 또는 "둘째"와 같은 용어들은 단순히 해당 구성요소를 다른 해당 구성요소와 구분하기 위해 사용될 수 있으며, 해당 구성요소들을 다른 측면(예: 중요성 또는 순서)에서 한정하지 않는다. 어떤(예: 제 1) 구성요소가 다른(예: 제 2) 구성요소에, "기능적으로" 또는 "통신적으로"라는 용어와 함께 또는 이런 용어 없이, "커플드" 또는 "커넥티드"라고 언급된 경우, 그것은 상기 어떤 구성요소가 상기 다른 구성요소에 직접적으로(예: 유선으로), 무선으로, 또는 제 3 구성요소를 통하여 연결될 수 있다는 것을 의미한다.

본 문서의 다양한 실시 예들에서 사용된 용어 "모듈"은 하드웨어, 소프트웨어 또는 펌웨어로 구현된 유닛을 포함할 수 있으며, 예를 들면, 로직, 논리 블록, 부품, 또는 회로와 같은 용어와 상호 호환적으로 사용될 수 있다. 모듈은, 일체로 구성된 부품 또는 하나 또는 그 이상의 기능을 수행하는, 상기 부품의 최소 단위 또는 그 일부가 될 수 있다. 예를 들면, 일 실시 예에 따르면, 모듈은 ASIC(application-specific integrated circuit)의 형태로 구현될 수 있다.

본 문서의 다양한 실시 예들은 기기(machine)(예: 전자 장치(101)) 의해 읽을 수 있는 저장 매체(storage medium)(예: 내장 메모리(136) 또는 외장 메모리(138))에 저장된 하나 이상의 명령어들을 포함하는 소프트웨어(예: 프로그램(140))로서 구현될 수 있다. 예를 들면, 기기(예: 전자 장치(101))의 프로세서(예: 프로세서(120))는, 저장 매체로부터 저장된 하나 이상의 명령어들 중 적어도 하나의 명령을 호출하고, 그것을 실행할 수 있다. 이것은 기기가 상기 호출된 적어도 하나의 명령어에 따라 적어도 하나의 기능을 수행하도록 운영되는 것을 가능하게 한다. 상기 하나 이상의 명령어들은 컴파일러에 의해 생성된 코드 또는 인터프리터에 의해 실행될 수 있는 코드를 포함할 수 있다. 기기로 읽을 수 있는 저장 매체는, 비일시적(non-transitory) 저장 매체의 형태로 제공될 수 있다. 여기서, '비일시적'은 저장 매체가 실재(tangible)하는 장치이고, 신호(signal)(예: 전자기파)를 포함하지 않는다는 것을 의미할 뿐이며, 이 용어는 데이터가 저장 매체에 반영구적으로 저장되는 경우와 임시적으로 저장되는 경우를 구분하지 않는다.

일 실시 예에 따르면, 본 문서에 개시된 다양한 실시 예들에 따른 방법은 컴퓨터 프로그램 제품(computer program product)에 포함되어 제공될 수 있다. 컴퓨터 프로그램 제품은 상품으로서 판매자 및 구매자 간에 거래될 수 있다. 컴퓨터 프로그램 제품은 기기로 읽을 수 있는 저장 매체(예: compact disc read only memory(CD-ROM))의 형태로 배포되거나, 또는 어플리케이션 스토어(예: 플레이 스토어TM)를 통해 또는 두 개의 사용자 장치들(예: 스마트 폰들) 간에 직접, 온라인으로 배포(예: 다운로드 또는 업로드)될 수 있다. 온라인 배포의 경우에, 컴퓨터 프로그램 제품의 적어도 일부는 제조사의 서버, 어플리케이션 스토어의 서버, 또는 중계 서버의 메모리와 같은 기기로 읽을 수 있는 저장 매체에 적어도 일시 저장되거나, 임시적으로 생성될 수 있다.

다양한 실시 예들에 따르면, 상기 기술한 구성요소들의 각각의 구성요소(예: 모듈 또는 프로그램)는 단수 또는 복수의 개체를 포함할 수 있으며, 복수의 개체 중 일부는 다른 구성요소에 분리 배치될 수도 있다. 다양한 실시 예들에 따르면, 전술한 해당 구성요소들 중 하나 이상의 구성요소들 또는 동작들이 생략되거나, 또는 하나 이상의 다른 구성요소들 또는 동작들이 추가될 수 있다. 대체적으로 또는 추가적으로, 복수의 구성요소들(예: 모듈 또는 프로그램)은 하나의 구성요소로 통합될 수 있다. 이런 경우, 통합된 구성요소는 상기 복수의 구성요소들 각각의 구성요소의 하나 이상의 기능들을 상기 통합 이전에 상기 복수의 구성요소들 중 해당 구성요소에 의해 수행되는 것과 동일 또는 유사하게 수행할 수 있다. 다양한 실시 예들에 따르면, 모듈, 프로그램 또는 다른 구성요소에 의해 수행되는 동작들은 순차적으로, 병렬적으로, 반복적으로, 또는 휴리스틱하게 실행되거나, 상기 동작들 중 하나 이상이 다른 순서로 실행되거나, 생략되거나, 또는 하나 이상의 다른 동작들이 추가될 수 있다.

도 2는, 다양한 실시 예들에 따른, 카메라 모듈(180)을 예시하는 블록도(200)이다. 도 2를 참조하면, 카메라 모듈(180)은 렌즈 어셈블리(210), 플래쉬(220), 이미지 센서(230), 이미지 스태빌라이저(240), 메모리(250)(예: 버퍼 메모리), 또는 이미지 시그널 프로세서(260)를 포함할 수 있다. 렌즈 어셈블리(210)는 이미지 촬영의 대상인 피사체로부터 방출되는 빛을 수집할 수 있다. 렌즈 어셈블리(210)는 하나 또는 그 이상의 렌즈들을 포함할 수 있다. 일 실시 예에 따르면, 카메라 모듈(180)은 복수의 렌즈 어셈블리(210)들을 포함할 수 있다. 이런 경우, 카메라 모듈(180)은, 예를 들면, 듀얼 카메라, 360도 카메라, 또는 구형 카메라(spherical camera)를 형성할 수 있다. 복수의 렌즈 어셈블리(210)들 중 일부는 동일한 렌즈 속성(예: 화각, 초점 거리, 자동 초점, f 넘버(f number), 또는 광학 줌)을 갖거나, 또는 적어도 하나의 렌즈 어셈블리는 다른 렌즈 어셈블리의 렌즈 속성들과 다른 하나 이상의 렌즈 속성들을 가질 수 있다. 렌즈 어셈블리(210)는, 예를 들면, 광각 렌즈 또는 망원 렌즈를 포함할 수 있다.

플래쉬(220)는 피사체로부터 방출 또는 반사되는 빛을 강화하기 위하여 사용되는 빛을 방출할 수 있다. 일 실시 예에 따르면, 플래쉬(220)는 하나 이상의 발광 다이오드들(예: RGB(red-green-blue) LED, white LED, infrared LED, 또는 ultraviolet LED), 또는 xenon lamp를 포함할 수 있다. 이미지 센서(230)는 피사체로부터 방출 또는 반사되어 렌즈 어셈블리(210)를 통해 전달된 빛을 전기적인 신호로 변환함으로써, 상기 피사체에 대응하는 이미지를 획득할 수 있다. 일 실시 예에 따르면, 이미지 센서(230)는, 예를 들면, RGB 센서, BW(black and white) 센서, IR 센서, 또는 UV 센서와 같이 속성이 다른 이미지 센서들 중 선택된 하나의 이미지 센서, 동일한 속성을 갖는 복수의 이미지 센서들, 또는 다른 속성을 갖는 복수의 이미지 센서들을 포함할 수 있다. 이미지 센서(230)에 포함된 각각의 이미지 센서는, 예를 들면, CCD(charged coupled device) 센서 또는 CMOS(complementary metal oxide semiconductor) 센서를 이용하여 구현될 수 있다.

이미지 스태빌라이저(240)는 카메라 모듈(180) 또는 이를 포함하는 전자 장치(101)의 움직임에 반응하여, 렌즈 어셈블리(210)에 포함된 적어도 하나의 렌즈 또는 이미지 센서(230)를 특정한 방향으로 움직이거나 이미지 센서(230)의 동작 특성을 제어(예: 리드 아웃(read-out) 타이밍을 조정 등)할 수 있다. 이는 촬영되는 이미지에 대한 상기 움직임에 의한 부정적인 영향의 적어도 일부를 보상하게 해 준다. 일 실시 예에 따르면, 이미지 스태빌라이저(240)는, 일 실시 예에 따르면, 이미지 스태빌라이저(240)는 카메라 모듈(180)의 내부 또는 외부에 배치된 자이로 센서(미도시) 또는 가속도 센서(미도시)를 이용하여 카메라 모듈(180) 또는 전자 장치(101)의 그런 움직임을 감지할 수 있다. 일 실시 예에 따르면, 이미지 스태빌라이저(240)는, 예를 들면, 광학식 이미지 스태빌라이저로 구현될 수 있다. 메모리(250)는 이미지 센서(230)를 통하여 획득된 이미지의 적어도 일부를 다음 이미지 처리 작업을 위하여 적어도 일시 저장할 수 있다. 예를 들어, 셔터에 따른 이미지 획득이 지연되거나, 또는 복수의 이미지들이 고속으로 획득되는 경우, 획득된 원본 이미지(예: Bayer-patterned 이미지 또는 높은 해상도의 이미지)는 메모리(250)에 저장이 되고, 그에 대응하는 사본 이미지(예: 낮은 해상도의 이미지)는 디스플레이 모듈(160)을 통하여 프리뷰될 수 있다. 이후, 지정된 조건이 만족되면(예: 사용자 입력 또는 시스템 명령) 메모리(250)에 저장되었던 원본 이미지의 적어도 일부가, 예를 들면, 이미지 시그널 프로세서(260)에 의해 획득되어 처리될 수 있다. 일 실시 예에 따르면, 메모리(250)는 메모리(130)의 적어도 일부로, 또는 이와는 독립적으로 운영되는 별도의 메모리로 구성될 수 있다.

이미지 시그널 프로세서(260)는 이미지 센서(230)를 통하여 획득된 이미지 또는 메모리(250)에 저장된 이미지에 대하여 하나 이상의 이미지 처리들을 수행할 수 있다. 상기 하나 이상의 이미지 처리들은, 예를 들면, 깊이 지도(depth map) 생성, 3차원 모델링, 파노라마 생성, 특징점 추출, 이미지 합성, 또는 이미지 보상(예: 노이즈 감소, 해상도 조정, 밝기 조정, 블러링(blurring), 샤프닝(sharpening), 또는 소프트닝(softening)을 포함할 수 있다. 추가적으로 또는 대체적으로, 이미지 시그널 프로세서(260)는 카메라 모듈(180)에 포함된 구성 요소들 중 적어도 하나(예: 이미지 센서(230))에 대한 제어(예: 노출 시간 제어, 또는 리드 아웃 타이밍 제어 등)를 수행할 수 있다. 이미지 시그널 프로세서(260)에 의해 처리된 이미지는 추가 처리를 위하여 메모리(250)에 다시 저장되거나 카메라 모듈(180)의 외부 구성 요소(예: 메모리(130), 디스플레이 모듈(160), 전자 장치(102), 전자 장치(104), 또는 서버(108))로 제공될 수 있다. 일 실시 예에 따르면, 이미지 시그널 프로세서(260)는 프로세서(120)의 적어도 일부로 구성되거나, 프로세서(120)와 독립적으로 운영되는 별도의 프로세서로 구성될 수 있다. 이미지 시그널 프로세서(260)가 프로세서(120)와 별도의 프로세서로 구성된 경우, 이미지 시그널 프로세서(260)에 의해 처리된 적어도 하나의 이미지는 프로세서(120)에 의하여 그대로 또는 추가의 이미지 처리를 거친 후 디스플레이 모듈(160)을 통해 표시될 수 있다.

일 실시 예에 따르면, 전자 장치(101)는 각각 다른 속성 또는 기능을 가진 복수의 카메라 모듈(180)들을 포함할 수 있다. 이런 경우, 예를 들면, 상기 복수의 카메라 모듈(180)들 중 적어도 하나는 광각 카메라이고, 적어도 다른 하나는 망원 카메라일 수 있다. 유사하게, 상기 복수의 카메라 모듈(180)들 중 적어도 하나는 전면 카메라이고, 적어도 다른 하나는 후면 카메라일 수 있다.

도 3은 일 실시 예에 따른 카메라 모듈(310)을 포함하는 전자 장치(300)의 간략한 구성을 나타내는 블록도이다.

일 실시 예에 따르면, 도 3은 전자 장치(300)에 포함되는 간략한 구성들을 도시하며, 전자 장치(300)는 도 1에서 설명된 전자 장치(101)와 동일 또는 유사한 구성들을 포함할 수 있다.

도 3을 참조하면, 전자 장치(300)는 카메라 모듈(310) 및 프로세서(320)를 포함할 수 있다. 일 실시 예에서, 전자 장치(300)는 디스플레이(330) 또는 메모리(340) 중 적어도 하나를 더 포함할 수 있다. 일 실시 예에서, 카메라 모듈(310)은 도 1 및 도 2의 카메라 모듈(180)에 대응될 수 있다. 일 실시 예에서, 프로세서(320)는 도 1에서 도시된 프로세서(120), 또는 도 2에서 도시된 이미지 시그널 프로세서(260) 중 적어도 하나를 포함할 수 있다. 일 실시 예에서, 디스플레이(330)는 도 1에서 도시된 디스플레이 모듈(160)에 대응될 수 있다. 일 실시 예에서, 메모리(340)는 도 1에서 도시된 메모리(130) 또는 도 2에서 도시된 메모리(250)를 중 적어도 하나를 포함할 수 있다.

일 실시 예에 따르면, 카메라 모듈(310)은 프로세서(320)의 제어에 의해 이미지 데이터를 획득할 수 있다. 일 실시 예에 따르면, 카메라 모듈(310)은 프로세서(320)의 제어에 의해 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득할 수 있다. 예를 들면, 프로세서(320)는 카메라 모듈(310)로부터 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터를 시간의 흐름에 따라 연속적으로 획득할 수 있다.

일 실시 예에서, 프로세서(320)는 OIS 기능을 이용하여 N2 개수의 이미지 데이터를 연속적으로 획득하도록 상기 카메라 모듈(310)을 제어할 수 있다. 일 실시 예에서, N은 2 이상의 자연수를 의미할 수 있다. 예를 들면, 프로세서(320)는 카메라 모듈(310)을 제어하여 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 연속적으로 획득할 수 있다. 다른 예를 들면, 프로세서(320)는 카메라 모듈(310)을 제어하여 제1 이미지 데이터 내지 제9 이미지 데이터를 획득할 수도 있다. 프로세서(320)는 상기 N2 개수의 이미지 데이터를 기반으로 도 4 내지 도 6에서 설명되는 동작을 수행할 수 있다. 일 실시 예에서, 상기 N2 개수의 이미지 데이터는 각 이미지 데이터에 대응하는 N2 개수의 픽셀 데이터를 포함할 수 있다.

일 실시 예에 따르면, 카메라 모듈(310)은 OIS 기능을 수행할 수 있다. 예를 들면, 카메라 모듈(310)은 OIS 기능을 통해 카메라 모듈(310)에 포함된 렌즈 어셈블리를 이동시키는 렌즈 시프트(lens shift) 방식을 이용할 수 있고 다른 실시 예에서, 카메라 모듈(310)은 OIS 기능을 통해 카메라 모듈(310)에 포함된 이미지 센서(315)를 이동시키는 센서 시프트(sensor shift) 방식을 이용할 수도 있다. 일 실시 예에서, 프로세서(320)는 OIS 기능을 이용하여 서로 다른 위상(phase)을 가지는 복수의 이미지 데이터들을 연속적으로 획득하도록 카메라 모듈(310)을 제어할 수 있다. 예를 들면, 서로 다른 위상을 가지는 복수의 이미지 데이터들이란, 카메라 모듈(310)을 통해 촬영되는 장면 중에서 동일한 픽셀을 통해 획득되는 픽셀 데이터가 복수의 이미지 데이터들마다 상기 장면 중 서로 다른 위치에 대응하는 경우를 의미하는 것으로 이해될 수 있다. 위상 차이와 관련하여 도 5를 참조하여 후술한다.

일 실시 예에 따르면, 프로세서(320)는 OIS 기능을 통해 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터가 서로 다른 위상을 가지도록 카메라 모듈(310)을 제어할 수 있다. 프로세서(320)는 흔들림을 보정하기 위해서 OIS 기능을 수행할 수도 있고, 상기 복수의 이미지 데이터들이 서로 다른 위상을 가지도록 OIS 기능을 수행할 수도 있다. 일 실시 예에서, 프로세서(320)는 카메라 모듈(310)을 제어하기 위해 사전에 지정된 OIS 관련 정보 또는 카메라 모듈(310)에 포함된 홀 센서를 통해 획득한 정보 중 적어도 하나의 정보를 이용할 수 있다. 프로세서(320)는 상기 정보를 이용하여 해상도 향상을 위해 요구되는 위상 차이를 가지는 복수의 이미지 데이터들을 획득할 수 있도록 카메라 모듈(310)을 제어할 수 있다.

일 실시 예에 따르면, 카메라 모듈(310)은 이미지 센서(315)를 포함할 수 있다. 이미지 센서(315)는 도 2에서 도시된 이미지 센서(230)를 의미하는 것으로 이해될 수 있다. 일 실시 예에서, 카메라 모듈(310)은 이미지 센서(315)를 통해 이미지 데이터를 획득할 수 있다.

일 실시 예에 따르면, 이미지 센서(315)는 2x2 배열을 가지는 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 및 제4 픽셀(314)을 포함할 수 있다. 예를 들면, 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 및 제4 픽셀(314)은 서로 인접하도록 배치된 픽셀들일 수도 있고, 다른 예를 들면, 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 및 제4 픽셀(314)은 서로 일정 간격을 두고 이격된 픽셀들을 의미할 수도 있다. 일 실시 예에서 이미지 센서(315)는 3x3 배열을 가지는 제5 픽셀, 제6 픽셀, 제7 픽셀, 제8 픽셀, 제9 픽셀, 제10 픽셀, 제11 픽셀, 제12 픽셀, 및 제13 픽셀을 포함할 수 있다. 일 실시 예에서, 이미지 센서(315)는 NxN 배열을 가지는 N2개의 픽셀을 포함할 수 있다. 이 때, N은 2 이상의 자연수일 수 있다. 일 실시 예에 따르면, 상기 NxN 배열을 가지는 N2개의 픽셀들은 이미지 센서(315)에 포함된 XxY 개의 픽셀들 중 적어도 일부 영역에 포함된 픽셀들로 이해될 수 있다. 예를 들면, NxN 개의 픽셀은 이미지 센서(315)에 포함된 XxY 개의 픽셀들 중 본 문서에 개시된 실시 예들을 수행하기 위한 연산의 기본 단위로 이해될 수 있다.

일 실시 예에 따르면, 카메라 모듈(310)은 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 또는 제4 픽셀(314) 중 적어도 하나의 픽셀을 통해 픽셀 데이터를 획득할 수 있다. 예를 들면, 카메라 모듈(310)은 제1 시점에서 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 또는 제4 픽셀(314) 중 적어도 하나의 픽셀을 통해 제1 픽셀 데이터를 획득할 수 있다. 카메라 모듈(310)은 상기 제1 시점에 연속하는 제2 시점에서 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 또는 제4 픽셀(314) 중 적어도 하나의 픽셀을 통해 제2 픽셀 데이터를 획득할 수 있다. 이와 같은 방식으로 카메라 모듈(310)은 1개의 이미지 데이터에 포함되는 복수 개의 픽셀 데이터를 획득할 수 있다. 일 실시 예에서, 1개의 이미지 프레임을 생성하기 위해 프로세서(320)는 연속적으로 획득된 4개의 이미지 데이터(예: 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터)를 활용할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 적어도 하나의 프로세서를 포함하는 것으로 이해될 수 있다. 예를 들어, 프로세서(320)는 AP(application processor), 이미지 시그널 프로세서(260), CP(communication processor) 중 적어도 하나를 포함할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 획득한 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득할 수 있다. 예를 들면, 프로세서(320)는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터를 평균하여 제5 픽셀 데이터를 획득할 수 있다. 프로세서(320)는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터에 대해 무게중심 연산하여 제5 픽셀 데이터를 획득할 수 있다. 다른 예를 들면, 프로세서(320)는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터 중 적어도 하나의 픽셀 데이터에 가중치를 두어 제5 픽셀 데이터를 획득할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 상기 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성할 수 있다. 예를 들면, 제1 이미지 프레임의 해상도는 제1 이미지 데이터의 해상도보다 높을 수 있다. 다른 예를 들면, 제1 이미지 프레임에 포함된 결함(예: 노이즈(noise), 블러(blur))은 제1 이미지 데이터에 포함된 결함보다 적을 수 있다.

일 실시 예에 따르면, 디스플레이(330)에는 프로세서(320)에 의해 실행되는 애플리케이션(예: 카메라 애플리케이션)의 실행 화면이 표시될 수 있다. 일 실시 예에서, 프로세서(320)는 상기 제1 이미지 프레임을 디스플레이(330)에 프리뷰로서 출력할 수 있다. 다른 실시 예에서, 프로세서(320)는 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 또는 제4 이미지 데이터 중 적어도 하나를 프리뷰로서 디스플레이(330)에 출력할 수 있다.

일 실시 예에 따르면, 디스플레이(330)는 터치 패널과 일체형으로 구현될 수 있다. 디스플레이(330)는 터치 기능을 지원할 수 있으며, 사용자 입력(예: 손가락을 이용한 터치)을 감지할 수 있다. 디스플레이(330)는 사용자 입력을 프로세서(320)에 전달할 수 있다. 디스플레이(330)는 디스플레이(330)를 구동하기 위한 디스플레이 구동 회로(display driver integrated circuit, DDIC)와 연결될 수 있고, 터치 패널은 터치 좌표를 감지하고 터치 관련 알고리즘을 처리하는 터치 IC와 연결될 수 있다. 일 실시 예에서, 디스플레이 구동 회로와 터치 IC는 일체로 형성될 수 있고, 다른 실시 예에서, 디스플레이 구동 회로와 터치 IC는 별개로 형성될 수 있다. 디스플레이 구동 회로 및/또는 터치 IC는 프로세서(320)와 전기적으로 연결될 수 있다.

일 실시 예에 따르면, 메모리(340)는 프로세서(320)에 의해 각종 프로그래밍 언어 또는 명령어를 저장할 수 있다. 예를 들어, 프로세서(320)는 메모리(340)에 저장된 프로그래밍 언어로 작성된 코드를 실행함으로써 애플리케이션을 실행하고, 각종 하드웨어를 제어할 수 있다. 또한 프로세서(320)는 카메라 모듈(310)이 사용자가 의도하는 동작을 수행할 수 있도록 적절한 촬영 모드를 설정하고 지원할 수 있다. 일 실시 예에서, 프로세서(320)는 제1 이미지 프레임을 메모리(340)에 저장할 수 있다. 일 실시 예에서, 프로세서(320)는 제1 이미지 프레임과 함께 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 또는 제4 이미지 데이터 중 적어도 하나의 이미지 데이터를 메모리(340)에 저장할 수 있다.

도 4는 일 실시 예에 따라 이미지의 품질을 향상시킬 수 있는 전자 장치(300)의 동작을 도시하는 흐름도이다. 도 4에서 설명되는 동작은, 도 1에서 도시된 프로세서(120), 도 2에서 도시된 이미지 시그널 프로세서(260), 또는 도 3에서 도시된 프로세서(320)에 의해 수행될 수 있다.

일 실시 예에 따르면, 동작 401에서, 프로세서(320)는 OIS 기능을 이용하여 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득하도록 카메라 모듈(310)을 제어할 수 있다.

일 실시 예에 따르면, 카메라 모듈(310)은 렌즈 시프트 방식의 OIS 기능을 이용하여, OIS 기능을 수행하는 동안 렌즈 어셈블리를 이동시킬 수 있다. 카메라 모듈(310)은 이동된 렌즈 어셈블리를 통해 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 획득할 수 있다. 다른 실시 예에 따르면, 카메라 모듈(310)은 센서 시프트 방식의 OIS 기능을 이용하여, OIS 기능을 수행하는 동안 이미지 센서(315)를 이동시킬 수 있다. 카메라 모듈(310)은 이동된 이미지 센서(315)를 통해 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 획득할 수 있다.

일 실시 예에 따르면, 카메라 모듈(310)은 OIS 기능을 수행하는 동안 획득한 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 프로세서(320)에 제공할 수 있다.

일 실시 예에 따르면, 카메라 모듈(310)에 포함된 이미지 센서(315)는 2x2 배열을 가지는 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 및 제4 픽셀(314)을 포함할 수 있다. 카메라 모듈(310)은 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 및 제4 픽셀(314)을 통해 픽셀 데이터를 획득할 수 있다. 예를 들면, 프로세서(320)가 카메라 모듈(310)로부터 획득한 제1 이미지 데이터는, 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 또는 제4 픽셀(314) 중 적어도 하나의 픽셀을 통해 획득된 제1 픽셀 데이터를 포함할 수 있다.

일 실시 예에 따르면, 동작 403에서, 프로세서(320)는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 픽셀(311)을 통해 획득된 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터를 기반으로 제5 픽셀 데이터 중 일부를 획득할 수 있다. 다른 실시 예에 따르면, 프로세서(320)는 제2 픽셀(312)을 통해 획득된 제1 픽셀 데이터와 제3 픽셀 데이터, 및 제1 픽셀(311)을 통해 획득된 제2 픽셀 데이터와 제4 픽셀 데이터를 기반으로 제5 픽셀 데이터 중 다른 일부를 획득할 수 있다. 다른 실시 예에 따르면, 프로세서(320)는 제1 픽셀(311)을 통해 획득된 제4 픽셀 데이터, 제2 픽셀(312)을 통해 획득된 제3 픽셀 데이터, 제3 픽셀(313)을 통해 획득된 제2 픽셀 데이터, 및 제4 픽셀(314)을 통해 획득된 제1 픽셀 데이터를 기반으로 제5 픽셀 데이터 중 다른 일부를 획득할 수 있다. 제5 픽셀 데이터를 획득하는 동작과 관련하여, 도 6을 참조하여 후술한다.

일 실시 예에 따르면, 프로세서(320)는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터를 평균하여 제5 픽셀 데이터를 획득할 수 있다. 상술한 픽셀 데이터의 평균을 획득하는 과정은, 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터에 대해 의 계수를 가지는 LPF(low pass filter)를 적용하는 것으로 이해될 수 있다. 제5 픽셀 데이터를 획득하는 동작과 관련하여, 도 6을 참조하여 후술한다.

일 실시 예에 따르면, 동작 405에서, 프로세서(320)는 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제5 픽셀 데이터를 포함하는 제1 이미지 프레임을 생성할 수 있다. 일 실시 예에서, 제1 이미지 프레임의 해상도는 제1 이미지 데이터(또는, 제2 이미지 데이터, 제3 이미지 데이터, 제4 이미지 데이터)의 해상도보다 높을 수 있다. 일 실시 예에서, 제1 이미지 프레임의 화소의 개수는 제1 이미지 데이터(또는, 제2 이미지 데이터, 제3 이미지 데이터, 제4 이미지 데이터)의 화소의 개수보다 많을 수 있다. 일 실시 예에서, 제1 이미지 프레임에 포함된 결함(예: 노이즈, 블러)은 제1 이미지 데이터(또는, 제2 이미지 데이터, 제3 이미지 데이터, 제4 이미지 데이터)에 포함된 결함보다 적을 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 이미지 프레임을 디스플레이(330)에 프리뷰로서 출력할 수 있다. 일 실시 예에 따르면, 프로세서(320)는 제1 이미지 프레임을 메모리(340)에 저장할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 또는 제4 이미지 데이터 중 적어도 하나를 디스플레이(330)에 프리뷰로서 출력할 수도 있다. 예를 들면, 프로세서(320)는 이미지를 촬영하는 동안 디스플레이(330)에 제1 이미지 데이터를 프리뷰로서 표시할 수 있다. 일 실시 예에서, 프로세서(320)는 상기 프리뷰의 일 영역이 지정된 배율 이상으로 확대된 경우, 제1 이미지 프레임을 디스플레이(330)에 프리뷰로서 출력할 수 있다. 예를 들면, 프로세서(320)는 상기 프리뷰를 확대하는 사용자 입력을 수신할 수 있다. 프로세서(320)는 상기 사용자 입력에 따라 프리뷰의 일 영역이 지정된 배율 이상으로 확대된 경우, 상기 일 영역에 대응하는 제1 이미지 프레임의 일부를 프리뷰로 출력할 수 있다. 일 실시 예에서, 상기 지정된 배율은 제1 이미지 데이터(또는, 제2 이미지 데이터, 제3 이미지 데이터, 제4 이미지 데이터)의 해상도와 제1 이미지 프레임의 해상도에 기반하여 결정될 수 있다. 예를 들면, 프로세서(320)는 제1 이미지 데이터 중 상기 일 영역에 포함되는 픽셀 데이터의 개수보다 상기 일 영역을 프리뷰로서 디스플레이(330)에 표시하기 위해 필요한 픽셀 데이터의 개수가 더 커지는 경우, 상기 지정된 배율 이상으로 확대되었다고 판단할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 지정된 배율 미만으로 설정된 경우 동작 401 내지 동작 405를 수행하는 대신에 카메라 모듈(310)을 제어하여 제1 이미지 데이터를 획득할 수 있고, 지정된 배율 이상으로 설정된 경우 카메라 모듈(310)을 제어하여 동작 401 내지 동작 405를 수행할 수 있다. 일 실시 예에 따르면, 프로세서(320)는 지정된 배율 이상으로 설정된 경우 이미지 센서(315)를 통해 획득된 이미지 데이터 중 일부 영역에 대해 동작 401 내지 동작 405를 수행할 수 있다. 예를 들면, 상기 일부 영역은 지정된 배율 이상으로 확대됨에 따라 상기 이미지 데이터 중 크롭(crop)되는 영역을 의미할 수 있다. 일 실시 예에 따르면, 프로세서(320)는 지정된 배율 미만으로 설정된 경우 제1 이미지 데이터를 디스플레이(330)에 프리뷰로 제공하고, 지정된 배율 이상으로 설정된 경우 제1 이미지 프레임을 디스플레이(330)에 프리뷰로 제공할 수 있다.

도 5는 일 실시 예에 따라, OIS 기능을 이용하여 획득된 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터의 예를 도시한다.

도 5를 참조하면, 참조번호 510 및 참조번호 520은 각각 프로세서(320)가 카메라 모듈(310)로부터 획득한 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터의 예를 도시한다. 일 실시 예에서, 제1 이미지 데이터는 제1 픽셀 데이터(511, 512, 513, 또는 514)를 포함할 수 있고, 제2 이미지 데이터는 제2 픽셀 데이터(521, 522, 523, 또는 524)를 포함할 수 있고, 제3 이미지 데이터는 제3 픽셀 데이터(531, 532, 533, 또는 534)를 포함할 수 있고, 제4 이미지 데이터는 제4 픽셀 데이터(541, 542, 543, 또는 544)를 포함할 수 있다.

도 5 내지 도 6에서는 설명의 편의를 위해 제1 픽셀 데이터(511, 512, 513, 또는 514)가 제1-1 픽셀 데이터(511), 제1-2 픽셀 데이터(512), 제1-3 픽셀 데이터(513), 또는 제1-4 픽셀 데이터(514)로 구별되어 참조될 수 있다. 마찬가지로, 제2 픽셀 데이터(521, 522, 523, 또는 524)는 제2-1 픽셀 데이터(521), 제2-2 픽셀 데이터(522), 제2-3 픽셀 데이터(523), 또는 제2-4 픽셀 데이터(524)로 구별되어 참조될 수 있다. 제3 픽셀 데이터(531, 532, 533, 또는 534)는 제3-1 픽셀 데이터(531), 제3-2 픽셀 데이터(532), 제3-3 픽셀 데이터(533), 또는 제3-4 픽셀 데이터(534)로 구별되어 참조될 수 있다. 제4 픽셀 데이터(541, 542, 543, 또는 544)는 제4-1 픽셀 데이터(541), 제4-2 픽셀 데이터(542), 제4-3 픽셀 데이터(543), 또는 제4-4 픽셀 데이터(544)로 구별되어 참조될 수 있다. 일 실시 예에서, 제1-1 픽셀 데이터(511)는 제1 시점에 제1 픽셀(311)을 통해 획득된 픽셀 데이터, 제1-2 픽셀 데이터(512)는 제1 시점에 제2 픽셀(312)을 통해 획득된 픽셀 데이터, 제1-3 픽셀 데이터(513)는 제1 시점에 제3 픽셀(313)을 통해 획득된 픽셀 데이터, 제1-4 픽셀 데이터(514)는 제1 시점에 제4 픽셀(314)을 통해 획득된 픽셀 데이터를 의미할 수 있다. 일 실시 예에서, 제2-1 픽셀 데이터(521)는 제2 시점에 제1 픽셀(311)을 통해 획득된 픽셀 데이터, 제2-2 픽셀 데이터(522)는 제2 시점에 제2 픽셀(312)을 통해 획득된 픽셀 데이터, 제2-3 픽셀 데이터(523)는 제2 시점에 제3 픽셀(313)을 통해 획득된 픽셀 데이터, 제2-4 픽셀 데이터(524)는 제2 시점에 제4 픽셀(314)을 통해 획득된 픽셀 데이터를 의미할 수 있다. 상기 설명은 제3 픽셀 데이터(531, 532, 533, 또는 534), 제4 픽셀 데이터(541, 542, 543, 또는 544)에 대해서도 적용될 수 있다.

일 실시 예에 따르면, 도 5에 도시된 픽셀 데이터는 각 이미지 데이터의 적어도 일부 영역에 포함되는 픽셀 데이터가 도시된 것으로 이해될 수 있다. 도 5에서 각 픽셀 데이터가 도시된 위치는 카메라 모듈(310)을 통해 촬영된 장면 중 각 픽셀 데이터에 대응되는 위치를 의미하는 것으로 이해될 수 있다. 도 5 내지 도 6과 관련하여 설명되는 내용에서, 픽셀 데이터 사이의 간격이란 상기 장면 중 각 픽셀 데이터에 대응되는 위치 사이의 간격을 의미하는 것으로 이해될 수 있다.

일 실시 예에 따르면, 프로세서(320)가 카메라 모듈(310)을 정확하게 제어하는 경우, 적어도 일부의 이미지 영역에서는 참조번호 510과 같은 위치관계를 가지는 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 획득할 수 있다. 예를 들면, 프로세서(320)는 적어도 일부의 이미지 영역에서는 제1-1 픽셀 데이터(511)와 제1-2 픽셀 데이터(512)의 중간에 제2-1 픽셀 데이터(521)가 위치하고, 제1-1 픽셀 데이터(511)와 제1-3 픽셀 데이터(513)의 중간에 제3-1 픽셀 데이터(531)가 위치하고, 제1-1 픽셀 데이터(511)와 제1-4 픽셀 데이터(514)의 중간에 제4-1 픽셀 데이터(541)가 위치하는 복수의 이미지 데이터들이 획득되도록 카메라 모듈(310)을 제어할 수 있다.

일 실시 예에 따르면, 프로세서(320)가 카메라 모듈(310)을 제어하여 참조번호 510과 같은 위치관계를 가지는 이미지 데이터들을 획득하고자 하더라도, 전자 장치(300)의 움직임이나 렌즈에 의한 왜곡 때문에 프로세서(320)는 참조번호 520과 같은 위치관계를 가지는 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 획득할 수 있다. 예를 들면, 프로세서(320)가 참조번호 510의 위치관계를 가지는 복수의 이미지 데이터들을 획득하기 위해 OIS 기능을 이용하여 카메라 모듈(310)을 제어하더라도 적어도 일부의 이미지 영역에서는 참조번호 520의 위치관계를 가지는 복수의 이미지 데이터들을 획득할 수 있다.

일 실시 예에 따르면, 참조번호 510의 경우 각 픽셀 데이터 사이의 간격이 일정할 수 있다. 예를 들면, 참조번호 510에서 제1-1 픽셀 데이터(511)와 제2-1 픽셀 데이터(521) 사이의 간격은 제1-1 픽셀 데이터(511)와 제3-1 픽셀 데이터(531) 사이의 간격과 일치할 수 있다. 일 실시 예에 따르면, 참조번호 520의 경우 각 픽셀 데이터 사이의 간격이 일정하지 않을 수 있다. 예를 들면, 참조번호 520에서 제1-1 픽셀 데이터(511)와 제2-1 픽셀 데이터(521) 사이의 간격은 제1-1 픽셀 데이터(511)와 제3-1 픽셀 데이터(531) 사이의 간격과 다를 수 있다.

일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 획득된 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터에 대한 영상 처리를 통해 제1 이미지 프레임을 획득할 수 있다. 예를 들면, 프로세서(320)는 제1 이미지 데이터(또는, 제2 이미지 데이터, 제3 이미지 데이터, 제4 이미지 데이터)보다 해상도가 향상된 제1 이미지 프레임을 생성할 수 있다. 다른 예를 들면, 프로세서(320)는 제1 이미지 데이터(또는, 제2 이미지 데이터, 제3 이미지 데이터, 제4 이미지 데이터)보다 결함이 적은 제1 이미지 프레임을 생성할 수 있다.

일 실시 예에서, 프로세서(320)는 카메라 모듈(310)로부터 획득한 복수의 이미지 데이터들의 위치관계가 참조번호 510인 경우 도 6에서 설명되는 방법을 수행할 수 있고, 참조번호 520인 경우에도 도 6에서 설명되는 방법을 수행할 수 있다. 일 실시 예에서, 프로세서(320)는 참조번호 510 또는 참조번호 520의 위치관계를 가지는 복수의 이미지 데이터들에 대해 도 6과 관련하여 설명되는 방법을 수행하여 제1 이미지 프레임을 생성할 수 있다.

도 6은 일 실시 예에 따라, 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 기반으로 제1 이미지 프레임을 생성하는 예를 도시한다.

일 실시 예에 따르면, 도 6에서 도시되는 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터는 도 5의 참조번호 520에서 획득된 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터로 이해될 수 있다. 예를 들면, 제1 픽셀 데이터(611, 612, 613, 또는 614)는 도 5의 제1 픽셀 데이터(511, 512, 513, 또는 514)에 대응될 수 있다. 또는 제1-1 픽셀 데이터(611)는 도 5의 제1-1 픽셀 데이터(511)에 대응될 수 있다. 도 6과 관련된 설명에서, 제1 픽셀 데이터(611, 612, 613, 또는 614)는 제1-1 픽셀 데이터(611), 제1-2 픽셀 데이터(612), 제1-3 픽셀 데이터(613), 또는 제1-4 픽셀 데이터(614)로 구별되어 참조될 수도 있다.

일 실시 예에 따르면, 카메라 모듈(310)에 포함된 이미지 센서(315)는 2x2 배열을 가지는 제1 픽셀(311), 제2 픽셀(312), 제3 픽셀(313), 및 제4 픽셀(314)을 포함할 수 있다. 일 실시 예에서, 도 6에 도시된 복수의 이미지 데이터들에 포함된 복수의 픽셀 데이터들 중 좌측 상단의 픽셀 데이터(611, 621, 631, 641)는 제1 픽셀(311)을 통해 획득된 데이터, 우측 상단의 픽셀 데이터(612, 622, 632, 642)는 제2 픽셀(312)을 통해 획득된 데이터, 좌측 하단의 픽셀 데이터(613, 623, 633, 643)는 제3 픽셀(313)을 통해 획득된 데이터, 우측 하단의 픽셀 데이터(614, 624, 634, 644)는 제4 픽셀(314)을 통해 획득된 데이터로 이해될 수 있다. 예를 들면, 제1 이미지 데이터는 제1 픽셀(311)을 통해 획득된 제1-1 픽셀 데이터(611), 제2 픽셀(312)을 통해 획득된 제1-2 픽셀 데이터(612), 제3 픽셀(313)을 통해 획득된 제1-3 픽셀 데이터(613), 및 제4 픽셀(314)을 통해 획득된 제1-4 픽셀 데이터(614)를 포함할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 픽셀 데이터(611, 612, 613. 또는 614), 제2 픽셀 데이터(621, 622, 623, 또는 624), 제3 픽셀 데이터(631, 632, 633, 또는 634), 및 제4 픽셀 데이터(641, 642, 643, 또는 644)에 기반하여 제5 픽셀 데이터(651, 652, 653, 또는 654)를 획득할 수 있다. 일 실시 예에서, 프로세서(320)는 제1 픽셀 데이터(611, 612, 613. 또는 614), 제2 픽셀 데이터(621, 622, 623, 또는 624), 제3 픽셀 데이터(631, 632, 633, 또는 634), 및 제4 픽셀 데이터(641, 642, 643, 또는 644)를 평균하여 제5 픽셀 데이터(651, 652, 653, 또는 654)를 획득할 수 있다. 다른 실시 예에서, 프로세서(320)는 제1 픽셀 데이터(611, 612, 613. 또는 614), 제2 픽셀 데이터(621, 622, 623, 또는 624), 제3 픽셀 데이터(631, 632, 633, 또는 634), 및 제4 픽셀 데이터(641, 642, 643, 또는 644)를 합산하여 제5 픽셀 데이터(651, 652, 653, 또는 654)를 획득할 수도 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 픽셀(311)을 통해 획득된 제1 픽셀 데이터(611), 제2 픽셀 데이터(621), 제3 픽셀 데이터(631), 및 제4 픽셀 데이터(641)를 기반으로 제5 픽셀 데이터(651a)를 획득할 수 있다. 예를 들면, 프로세서(320)는 제1-1 픽셀 데이터(611), 제2-1 픽셀 데이터(621), 제3-1 픽셀 데이터(631), 및 제4-1 픽셀 데이터(641)를 평균하여 제5 픽셀 데이터(651a)를 획득할 수 있다. 프로세서(320)는 제1-1 픽셀 데이터(611), 제2-1 픽셀 데이터(621), 제3-1 픽셀 데이터(631), 및 제4-1 픽셀 데이터(641)에 대해 의 필터를 이용한 무게중심 연산을 하여 제5 픽셀 데이터(651a)를 획득할 수 있다. 제5 픽셀 데이터(651a)는 제1-1 픽셀 데이터(611), 제2-1 픽셀 데이터(621), 제3-1 픽셀 데이터(631), 및 제4-1 픽셀 데이터(641)의 무게중심에 위치할 수 있다.

일 실시 예에서, 제5 픽셀 데이터(651a)에 대한 설명은 도 6에 도시된 참조번호 651에 대해서 모두 적용될 수 있다. 예를 들면, 프로세서(320)는 제2 픽셀(312)을 통해 획득된 제1-2 픽셀 데이터(612), 제2-2 픽셀 데이터(622), 제3-2 픽셀 데이터(632), 및 제4-2 픽셀 데이터(642)를 기반으로 제5 픽셀 데이터(651b)를 획득할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제2 픽셀(312)을 통해 획득된 제1 픽셀 데이터(612)와 제3 픽셀 데이터(632), 및 제1 픽셀(311)을 통해 획득된 제2 픽셀 데이터(621)와 제4 픽셀 데이터(641)를 기반으로 제5 픽셀 데이터(652a)를 획득할 수 있다. 예를 들면, 프로세서(320)는 제1-2 픽셀 데이터(612), 제3-2 픽셀 데이터(632), 제2-1 픽셀 데이터(621)와 제4-1 픽셀 데이터(641)를 평균하여 제5 픽셀 데이터(652a)를 획득할 수 있다. 프로세서(320)는 제1-2 픽셀 데이터(612), 제2-1 픽셀 데이터(621), 제3-2 픽셀 데이터(632), 및 제4-1 픽셀 데이터(641)에 대해 의 필터를 이용한 무게중심 연산을 하여 제5 픽셀 데이터(652a)를 획득할 수 있다. 제5 픽셀 데이터(652a)는 제1-2 픽셀 데이터(612), 제3-2 픽셀 데이터(632), 제2-1 픽셀 데이터(621), 및 제4-1 픽셀 데이터(641)의 무게중심에 위치할 수 있다.

일 실시 예에서, 상기 설명은 도 6에 도시된 참조번호 652, 및 참조번호 653에 대해서도 적용될 수 있다. 예를 들면, 프로세서(320)는 제1 픽셀(311)을 통해 획득된 제3 픽셀 데이터(631)와 제4 픽셀 데이터(641), 및 제3 픽셀(313)을 통해 획득된 제1 픽셀 데이터(613)와 제2 픽셀 데이터(623)를 기반으로 제5 픽셀 데이터(653a)를 획득할 수 있다. 즉, 프로세서(320)는 제1-3 픽셀 데이터(513), 제2-3 픽셀 데이터(523), 제3-1 픽셀 데이터(631), 및 제4-1 픽셀 데이터(541)를 기반으로 제5 픽셀 데이터(653a)를 획득할 수 있다. 다른 예를 들면, 프로세서(320)는 제3 픽셀(313)을 통해 획득된 제2 픽셀 데이터(623)와 제4 픽셀 데이터(643), 및 제4 픽셀(314)을 통해 획득된 제1 픽셀 데이터(614)와 제3 픽셀 데이터(634)를 기반으로 제5 픽셀 데이터(652b)를 획득할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 픽셀(311)을 통해 획득된 제4 픽셀 데이터(641), 제2 픽셀(312)을 통해 획득된 제3 픽셀 데이터(632), 제3 픽셀(313)을 통해 획득된 제2 픽셀 데이터(623), 및 제4 픽셀(314)을 통해 획득된 제1 픽셀 데이터(614)를 기반으로 제5 픽셀 데이터(654a)를 획득할 수 있다. 프로세서(320)는 제1-4 픽셀 데이터(614), 제2-3 픽셀 데이터(623), 제3-2 픽셀 데이터(632), 및 제4-1 픽셀 데이터(641)에 대해 의 필터를 이용한 무게중심 연산을 하여 제5 픽셀 데이터(654a)를 획득할 수 있다. 제5 픽셀 데이터(654a)는 제4-1 픽셀 데이터(641), 제3-2 픽셀 데이터(632), 제2-3 픽셀 데이터(623), 및 제1-4 픽셀 데이터(614)의 무게중심에 위치할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 상기 획득된 제5 픽셀 데이터(651, 652, 653, 및 654)를 기반으로 제1 이미지 프레임을 생성할 수 있다. 프로세서(320)는 도 6과 관련하여 설명된 동작들을 통해 제5 픽셀 데이터(651, 652, 653, 654) 사이의 간격이 서로 일정한 제1 이미지 프레임을 획득할 수 있다. 예를 들면, 제5 픽셀 데이터(651a)와 제5 픽셀 데이터(652a) 사이의 간격은 제1 픽셀 데이터(611)와 제1 픽셀 데이터(612) 사이의 간격의 절반에 해당할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 픽셀 데이터(611, 612, 613, 또는 614), 제2 픽셀 데이터(621, 622, 623, 또는 624), 제3 픽셀 데이터(631, 632, 633, 또는 634), 및 제4 픽셀 데이터(641, 642, 643, 또는 644)를 평균하는 방법 외에 다른 방법을 활용하여 제5 픽셀 데이터(미도시)를 획득할 수도 있다. 예를 들면, 상기 제5 픽셀 데이터(미도시) 사이의 간격이 도 6에 도시된 제5 픽셀 데이터(651, 652, 653, 654) 사이의 간격과 일치할 수 있다면 프로세서(320)는 무게중심 연산 외에 다른 연산을 할 수 있다. 일 실시 예에서, 프로세서(320)는 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 또는 제4 이미지 데이터 중 적어도 하나의 이미지 데이터에 대해 가중치를 두어 제1 이미지 프레임을 생성할 수 있다.

일 실시 예에 따르면, 제1 이미지 프레임의 해상도는 제1 이미지 데이터(또는, 제2 이미지 데이터, 제3 이미지 데이터, 제4 이미지 데이터)의 해상도보다 높을 수 있다. 예를 들면, 제5 픽셀 데이터(651, 652, 653, 654) 사이의 간격이 제1 픽셀 데이터(611, 612, 613, 614) 사이의 간격보다 절반으로 감소함에 따라 이미지의 해상도가 향상될 수 있다.

일 실시 예에 따르면, 제1 이미지 프레임에 포함된 결함은 제1 이미지 데이터에 포함된 결함보다 적을 수 있다. 예를 들면, 제1 이미지 프레임에 포함된 노이즈는 제1 이미지 데이터에 포함된 노이즈보다 적을 수 있다. 프로세서(320)는 제1 픽셀 데이터(611, 612, 613, 또는 614), 제2 픽셀 데이터(621, 622, 623, 또는 624), 제3 픽셀 데이터(631, 632, 633, 또는 634), 및 제4 픽셀 데이터(641, 642, 643, 또는 644)에 대해 평균하는 동작을 통해 복수의 이미지 데이터들에 포함된 결함을 감소시킬 수 있다. 일 실시 예에서, 의 필터는 LPF(low pass filter)에 해당하고 노이즈는 고주파에 해당하므로 프로세서(320)는 상기 필터를 통해 복수의 이미지 데이터들에 포함된 노이즈를 제거할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 이미지 센서(315)의 변환 이득(conversion gain) 조절을 통해 제1 이미지 프레임에 포함되는 블러의 양을 감소시킬 수 있다. 제1 이미지 프레임에 포함되는 블러는, 카메라 모듈(310)이 복수의 이미지 데이터들(예: 4개의 이미지 데이터)을 획득하는 동안 발생하는 글로벌 모션(global motion) 또는 로컬 모션(local motion)에 의해 발생할 수 있다. 프로세서(320)가 이미지 센서(315)의 변환 이득을 증가시키면 촬영 시간을 감소시킬 수 있으므로, 제1 이미지 프레임에 포함되는 블러의 양이 감소할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 픽셀 데이터(611, 612, 613, 또는 614), 제2 픽셀 데이터(621, 622, 623, 또는 624), 제3 픽셀 데이터(631, 632, 633, 또는 634), 및 제4 픽셀 데이터(641, 642, 643, 또는 644)를 합산할 수 있다. 예를 들면, 프로세서(320)는 제1 픽셀 데이터(611, 612, 613, 또는 614), 제2 픽셀 데이터(621, 622, 623, 또는 624), 제3 픽셀 데이터(631, 632, 633, 또는 634), 및 제4 픽셀 데이터(641, 642, 643, 또는 644)에 대해 의 필터를 가할 수 있다. 일 실시 예에 따르면, 프로세서(320)는 이미지 센서(315)를 통해 연속적으로 획득된 픽셀 데이터를 합산함에 따라 제1 이미지 프레임에 포함되는 블러의 양을 감소시킬 수 있다. 예를 들면, 프로세서(320)는 의 필터를 이용하는 경우 이미지 센서(315)의 노출 시간이 감소하도록 카메라 모듈(310)을 제어할 수 있다. 프로세서(320)가 제1 이미지 데이터 내지 제4 이미지 데이터를 획득하기 위한 촬영 시간이 감소하는 경우, 글로벌 모션 또는 로컬 모션이 감소하므로 제1 이미지 프레임에 포함된 블러의 양이 감소될 수 있다.

도 7은 일 실시 예에 따라, 나이퀴스트 주파수가 달라지는 예를 도시한다.

일 실시 예에 따르면, 나이퀴스트 주파수란 샘플링 대상이 되는 데이터를 다시 재생할 수 있도록 상기 데이터가 갖는 최고 주파수의 두 배인 주파수를 의미하나, 본 개시에서는 나이퀴스트 주파수가 카메라 모듈(310)이 촬영할 수 있는 최대 주파수를 의미하는 것으로 이해될 수 있다. 예를 들면, 카메라 모듈(310)은 나이퀴스트 주파수 이하의 주파수를 가지는 장면의 이미지 데이터는 획득할 수 있으나, 나이퀴스트 주파수보다 큰 주파수를 가지는 장면의 이미지 데이터는 획득하기 어렵다. 즉, 나이퀴스트 주파수가 클수록 이미지의 해상도가 높은 것으로 이해될 수 있다.

도 7을 참조하면, 참조번호 710, 참조번호 720, 참조번호 730, 및 참조번호 740은 프로세서(320)가 장면의 주파수에 따라 획득할 수 있는 이미지 데이터의 비율을 도시한다. 도 7에 도시된 그래프에서 가로축은 프로세서(320)가 4개의 이미지 데이터(예: 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터)를 획득함에 따라 촬영할 수 있는 최대 주파수를 1로 변환한 것으로 이해될 수 있다. 도 7에 도시된 그래프에서 세로축은 프로세서(320)가 각 주파수마다 획득할 수 있는 이미지 데이터의 비율을 의미하는 것으로 이해될 수 있다.

일 실시 예에 따르면, 참조번호 710은 카메라 모듈(310)이 1개의 이미지 데이터(예: 제1 이미지 데이터)를 획득한 경우의 예를 도시한다. 일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 1개의 이미지 데이터를 획득한 후, 상기 이미지 데이터를 업스케일(upscale)할 수 있다. 예를 들면, 프로세서(320)는 제1 이미지 데이터에 대해 이중 선형 보간법(bilinear interpolation)을 수행하여, 제1 이미지 데이터를 2x2배로 리사이즈(resize)할 수 있다. 일 실시 예에 따르면, 프로세서(320)가 1개의 이미지 데이터를 획득한 경우 나이퀴스트 주파수(711)는 0.5에 해당할 수 있다.

일 실시 예에 따르면, 참조번호 720은 카메라 모듈(310)이 도 5의 참조번호 510의 위치관계를 가지는 4개의 이미지 데이터(예: 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터)를 획득한 경우의 예를 도시한다. 프로세서(320)는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터에 대해 의 필터를 이용한 무게중심 연산을 통해 제1 이미지 프레임을 생성할 수 있다. 이 때, 상기 필터는 LPF에 해당하므로 장면의 주파수가 증가할수록 획득되는 이미지 데이터의 양이 감소할 수 있다.

일 실시 예에서, 참조번호 720의 경우 나이퀴스트 주파수(721)는 1에 해당할 수 있다. 일 실시 예에서, 참조번호 720과 참조번호 710을 비교할 때, 프로세서(320)가 1개의 이미지 데이터를 획득한 경우보다 4개의 이미지 데이터를 획득하여 영상 처리를 하는 경우에 나이퀴스트 주파수가 2배로 증가할 수 있다. 프로세서(320)는 0.5보다 큰 주파수를 가지는 장면에 대한 이미지 데이터를 획득할 수 있다. 일 실시 예에서, 참조번호 720과 참조번호 710을 비교할 때, 프로세서(320)가 1개의 이미지 데이터를 획득한 경우보다 4개의 이미지 데이터를 획득하여 영상 처리를 하는 경우에 해상도가 2배 증가할 수 있다.

일 실시 예에 따르면, 참조번호 730은 도 5의 참조번호 520 또는 도 6의 위치관계를 가지는 4개의 이미지 데이터(예: 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터)를 획득한 경우의 예를 도시한다. 프로세서(320)는 도 6에서 설명된 방식을 통해 제1 이미지 프레임을 생성할 수 있다.

일 실시 예에서, 참조번호 730의 경우 나이퀴스트 주파수(731)는 1보다 작을 수 있다. 카메라 모듈(310)을 통해 획득되는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터 사이의 간격이 도 5의 참조번호 520과 같이 불규칙한 경우, 나이퀴스트 주파수(731)가 0.7 내지 0.8에 해당할 수 있다. 프로세서(320)는 0.5보다 큰 주파수를 가지는 장면에 대한 이미지 데이터를 획득할 수 있다. 프로세서(320)는 0.5보다 큰 주파수를 가지는 장면에 대해 획득되는 이미지 데이터를 증폭하여 해당 주파수 영역의 이미지 프레임을 생성할 수 있다.

일 실시 예에 따르면, 참조번호 740은 제1 이미지 데이터를 기준으로 제2 이미지 데이터, 제3 이미지 데이터, 또는 제4 이미지 데이터 중 적어도 하나의 이미지 데이터가 프로세서(320)의 제어와 다른 위치에서 획득된 경우의 예를 도시한다. 도 5에서 설명된 내용에 따르면, 프로세서(320)는 제2 픽셀 데이터(521)가 제1 픽셀 데이터(511)와 제1 픽셀 데이터(512)의 사이에 위치하도록 카메라 모듈(310)을 제어할 수 있다. 다만, 프로세서(320)는 전자 장치(300)의 움직임 또는 렌즈 왜곡 등의 원인에 의해, 제2 픽셀 데이터(621)가 제1 픽셀 데이터(611)와 제1 픽셀 데이터(612)의 사이가 아닌 다른 방향에 위치하는 제1 이미지 데이터와 제2 이미지 데이터를 획득할 수 있다.

일 실시 예에서, 참조번호 740의 경우 나이퀴스트 주파수(741)는 0.5보다 작을 수 있다. 프로세서(320)는 제1 이미지 데이터를 기준으로 제2 이미지 데이터, 제3 이미지 데이터, 또는 제4 이미지 데이터 중 적어도 하나의 이미지 데이터가 프로세서(320)의 제어와 다른 위치에서 획득된 경우에도 도 6에서 설명된 방법을 통해 복수의 이미지 데이터들에 포함된 결함을 감소시킬 수 있다. 예를 들면, 프로세서(320)는 카메라 모듈(310)로부터 획득한 복수의 이미지 데이터들에 노이즈가 포함되어 있는 경우에도 노이즈가 제거 또는 저감된 제1 이미지 프레임을 생성할 수 있다.

도 8a는 일 실시 예에 따라 이미지에 포함된 결함이 감소되는 예를 도시한다.

도 8a를 참조하면, 참조번호 810은 본 개시를 적용하지 않은 경우에 획득된 이미지 프레임의 예를 도시한다. 참조번호 820은 본 문서에 개시된 실시 예에 따라 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터를 기반으로 제5 픽셀 데이터를 획득하여 생성된 제1 이미지 프레임의 예를 도시한다.

도 8a를 참조하면, 종래 기술에 따라 획득된 이미지 프레임(810) 내에는 재깅 결함(jagging artifact)(811)이 포함되어 있으나, 본 개시에 따라 획득된 제1 이미지 프레임(820) 내에는 재깅 결함이 저감된다.

일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 획득한 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터에 대해 무게중심 연산을 하여 제5 픽셀 데이터를 획득할 수 있고, 제5 픽셀 데이터를 기반으로 제1 이미지 프레임(820)을 생성할 수 있다. 프로세서(320)가 무게중심 연산을 위해 이용하는 의 필터는 LPF에 해당하고, 이미지 데이터에 포함된 결함은 고주파에 해당할 수 있다. 따라서 프로세서(320)는 결함이 제거 또는 완화된 제1 이미지 프레임(820)을 획득할 수 있다.

도 8b는 일 실시 예에 따라 이미지의 해상도가 증가되는 예를 도시한다.

도 8b를 참조하면, 참조번호 830은 본 개시를 적용하지 않은 경우에 획득된 이미지 프레임의 예를 도시한다. 참조번호 840은 본 문서에 개시된 실시 예에 따라 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터를 기반으로 제5 픽셀 데이터를 획득하여 생성된 제1 이미지 프레임의 예를 도시한다.

도 8b를 참조하면, 종래 기술에 따라 획득된 이미지 프레임(830)의 해상도보다 본 개시에 따라 획득된 제1 이미지 프레임(840)의 해상도가 더 높다. 예를 들면, 종래 기술에 따라 획득된 이미지 프레임(830)의 고주파 영역(831)과 비교할 때, 본 개시에 따라 획득된 제1 이미지 프레임(840)의 고주파 영역(841)의 해상도가 더 높다.

일 실시 예에 따르면, 프로세서(320)는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터 사이의 간격이 불규칙한 경우에도 무게중심 연산을 통해 규칙적인 위치관계를 가지는 제5 픽셀 데이터를 획득할 수 있다. 프로세서(320)는 규칙적인 위치 관계를 가지는 제5 픽셀 데이터에 기반하여 제1 이미지 프레임(840)을 생성할 수 있다. 따라서 본 개시에 따라 획득된 제1 이미지 프레임(840)의 해상도가 종래 기술에 따라 획득된 이미지 프레임(830)의 해상도보다 높을 수 있다.

도 9는 일 실시 예에 따라, 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 기반으로 동영상을 생성하는 예를 도시한다.

일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 제1 이미지 데이터(915), 제2 이미지 데이터(952), 제3 이미지 데이터(935) 및 제4 이미지 데이터(945)를 획득할 수 있다. 도 9를 참조하면, 제1 이미지 데이터(915)는 제1 픽셀 데이터(910)를 포함하고, 제2 이미지 데이터(925)는 제2 픽셀 데이터(920)를 포함하고, 제3 이미지 데이터(935)는 제3 픽셀 데이터(930)를 포함하고, 제4 이미지 데이터(945)는 제4 픽셀 데이터(940)를 포함할 수 있다. 일 실시 예에서, 제1 픽셀 데이터(910), 제2 픽셀 데이터(920), 제3 픽셀 데이터(930), 및 제4 픽셀 데이터(940)는 각각 제1 시점, 제2 시점, 제3 시점, 및 제4 시점에 제1 픽셀(311)(또는, 제2 픽셀(312), 제3 픽셀(313), 제4 픽셀(314))을 통해 획득된 픽셀 데이터일 수 있다.

도 9를 참조하면, 프로세서(320)는 제1 픽셀 데이터(910), 제2 픽셀 데이터(920), 제3 픽셀 데이터(930), 및 제4 픽셀 데이터(940)가 도 9에 도시된 것과 같은 위치 관계를 가지는 제1 이미지 데이터 내지 제4 이미지 데이터를 획득할 수 있다. 예를 들면, 프로세서(320)는 제1 픽셀 데이터(910)와 제2 픽셀 데이터(920)가 0.5 픽셀 간격을 가지고, 제2 픽셀 데이터(920)와 제3 픽셀 데이터(930)가 0.5 픽셀 간격을 가지도록 카메라 모듈(310)을 제어할 수 있다. 일 실시 예에서, 프로세서(320)는 카메라 모듈(310)로부터 획득된 데이터가 도 5 내지 도 6에 도시된 위치 관계를 가지도록 카메라 모듈(310)을 제어할 수도 있고, 도 9에 도시된 위치 관계를 가지도록 카메라 모듈(310)을 제어할 수도 있다. 예를 들면, 제1 픽셀 데이터(910) 내지 제4 픽셀 데이터(940)의 위치 관계는 하나의 예시로서, 다양한 위치 관계를 가질 수 있다. 예를 들면, 제1 픽셀 데이터 내지 제4 픽셀 데이터는 , , , 또는 의 위치 관계를 가질 수 있다. 일 실시 예에서, 프로세서(320)는 제1 픽셀 데이터(910), 제2 픽셀 데이터(920), 제3 픽셀 데이터(930), 및 제4 픽셀 데이터(940)가 도 9에 도시된 위치 관계를 가지도록 카메라 모듈(310)을 제어하더라도, 적어도 일부의 이미지 영역에서는 도 9에 도시된 위치 관계를 가지지 않을 수 있다. 예를 들면, 프로세서(320)는 이미지 영역 중 적어도 일부의 영역에서는 픽셀 데이터 사이의 간격이 서로 일정하지 않은 데이터(예: 도 5의 참조번호 520의 위치 계)를 획득할 수 있다.

도 9를 참조하면, 카메라 모듈(310)은 t1 시점 내지 t2 시점에 제1 이미지 데이터(915)를 획득할 수 있다. 예를 들면, 카메라 모듈(310)은 t1 시점에 이미지 센서(315) 중 일부 영역에 포함된 픽셀로부터 픽셀 데이터를 리드 아웃할 수 있다. 카메라 모듈(310)은 t1 시점에서 t2 시점의 사이에 이미지 센서(315) 중 나머지 일부 영역에 포함된 픽셀로부터 픽셀 데이터를 리드 아웃할 수 있다. 일 실시 예에서, 카메라 모듈(310)은 이미지 센서(315)의 행(row) 마다 서로 다른 시점에 리드 아웃할 수 있다. 예를 들어 도 9의 그래프를 참조하면, 카메라 모듈(310)은 이미지 센서(315) 중 제1 행에 포함된 픽셀을 리드 아웃하는 시점과 제1 행과 다른 제2 행에 포함된 픽셀을 리드 아웃하는 시점이 서로 다를 수 있다. 일 실시 예에 따르면, 카메라 모듈(310)은 t1 시점에서 t2 시점 사이에 획득한 제1 이미지 데이터(915)를 프로세서(320)에 제공할 수 있다.

일 실시 예에 따르면, 카메라 모듈(310)은 t3 시점 내지 t4 시점에 제2 이미지 데이터(925)를 획득할 수 있다. 일 실시 예에 따르면, 카메라 모듈(310)은 t5 시점 내지 t6 시점에 제3 이미지 데이터(935)를 획득할 수 있다. 일 실시 예에 따르면, 카메라 모듈(310)은 t7 시점 내지 t8 시점에 제4 이미지 데이터(945)를 획득할 수 있다. 일 실시 예에서, 제1 이미지 데이터(915)의 획득에 대한 설명은 제2 이미지 데이터(925), 제3 이미지 데이터(935), 및 제4 이미지 데이터(945)에 대해서도 적용될 수 있다.

일 실시 예에 따르면, 프로세서(320)는 t2 시점에 이미지 센서(315)를 모두 리드 아웃한 후, t2 시점 내지 t3 시점에 카메라 모듈(310)을 제어하여 OIS 기능을 수행할 수 있다. 예를 들면, 프로세서(320)는 카메라 모듈(310)을 제어하여 제1 픽셀 데이터(910)와 다른 위상(phase)을 가지는 제2 픽셀 데이터(920)를 포함하는 제2 이미지 데이터(925)를 획득하기 위해, t2 시점과 t3 시점 사이에 렌즈 어셈블리(210)를 이동시킬 수 있다. 일 실시 예에서, 프로세서(320)는 t4 시점 내지 t5 시점, 및 t6 시점 내지 t7 시점에도 카메라 모듈(310)을 제어하여 OIS 기능을 수행할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 제1 이미지 데이터(915), 제2 이미지 데이터(925), 제3 이미지 데이터(935), 및 제4 이미지 데이터(945)를 연속적으로 획득한 후, 제1 픽셀 데이터(910), 제2 픽셀 데이터(920), 제3 픽셀 데이터(930), 및 제4 픽셀 데이터(940)를 기반으로 제1 최종 픽셀 데이터를 획득할 수 있다. 예를 들면, 상기 제1 최종 픽셀 데이터는 도 3 내지 도 8b에서 설명된 제5 픽셀 데이터를 의미하는 것으로 이해될 수 있다. 도 3 내지 도 8b에서 제5 픽셀 데이터로 참조된 픽셀 데이터는, 도 9에서 설명의 편의를 위해 제1 최종 픽셀 데이터로 참조될 수 있다. 일 실시 예에서, 프로세서(320)는 도 6과 관련되어 설명된 방법을 통해 제1 최종 픽셀 데이터를 획득할 수 있다. 예를 들면, 프로세서(320)는 제1 픽셀 데이터(910), 제2 픽셀 데이터(920), 제3 픽셀 데이터(930), 및 제4 픽셀 데이터(940)를 평균하거나 합산하여 제1 최종 픽셀 데이터를 획득할 수 있다. 일 실시 예에 따르면, 프로세서(320)는 상기 제1 최종 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 제4 픽셀 데이터(940)를 포함하는 제4 이미지 데이터(945)를 획득한 후, 제4 픽셀 데이터(940)에 비해 위쪽 방향으로 0.5 픽셀 간격을 가지는 제5 픽셀 데이터를 포함하는 제5 이미지 데이터를 획득할 수 있다. 도 9와 관련하여 설명되는 내용에서 제5 픽셀 데이터는, 도 3 내지 도 8b에서 참조된 제5 픽셀 데이터와 별개의 것으로 이해될 수 있다. 일 실시 예에서, 프로세서(320)는 카메라 모듈(310)의 OIS 기능을 제어하여, 연속적으로 획득된 픽셀 데이터 사이의 위치 관계가 시계 방향으로 변화하는 복수의 이미지 데이터를 획득할 수 있다. 일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 제5 픽셀 데이터를 포함하는 제5 이미지 데이터를 획득한 후, 제5 픽셀 데이터에 비해 오른쪽 방향으로 0.5 픽셀 간격을 가지는 제6 픽셀 데이터를 포함하는 제6 이미지 데이터를 획득할 수 있다. 일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 제6 이미지 데이터를 획득한 후, 제7 픽셀 데이터를 포함하는 제7 이미지 데이터, 및 제8 픽셀 데이터를 포함하는 제8 이미지 데이터를 연속적으로 획득할 수 있다. 일 실시 예에 따르면, 제1 픽셀 데이터(910), 제2 픽셀 데이터(920), 제3 픽셀 데이터(930), 및 제4 픽셀 데이터(940)의 위치 관계에 대한 설명은, 제5 픽셀 데이터, 제6 픽셀 데이터, 제7 픽셀 데이터, 및 제8 픽셀 데이터의 위치 관계에도 적용될 수 있다. 일 실시 예에 따르면, 프로세서(320)는 카메라 모듈(310)로부터 제1 이미지 데이터(915), 제2 이미지 데이터(925), 제3 이미지 데이터(935), 제4 이미지 데이터(945), 제5 이미지 데이터, 제6 이미지 데이터, 제7 이미지 데이터, 및 제8 이미지 데이터를 연속적으로 획득할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제1 이미지 데이터(915), 제2 이미지 데이터(925), 제3 이미지 데이터(935), 및 제4 이미지 데이터(945)를 기반으로 제1 이미지 프레임을 획득한 후, 제2 이미지 데이터(925), 제3 이미지 데이터(935), 제4 이미지 데이터(945), 및 제5 이미지 데이터를 기반으로 제2 이미지 프레임을 생성할 수 있다. 예를 들면, 프로세서(320)는 제2 픽셀 데이터(920), 제3 픽셀 데이터(930), 제4 픽셀 데이터(940), 및 제5 픽셀 데이터를 기반으로 제2 최종 픽셀 데이터를 획득할 수 있다. 프로세서(320)는 제2 최종 픽셀 데이터를 기반으로 제2 이미지 프레임을 생성할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제3 이미지 데이터(935), 제4 이미지 데이터(945), 제5 이미지 데이터, 및 제6 이미지 데이터를 기반으로 제3 이미지 프레임을 생성할 수 있다. 예를 들면, 프로세서(320)는 제3 픽셀 데이터(930), 제4 픽셀 데이터(940), 제5 픽셀 데이터, 및 제6 픽셀 데이터를 기반으로 제3 최종 픽셀 데이터를 획득할 수 있다. 프로세서(320)는 제3 최종 픽셀 데이터를 기반으로 제3 이미지 프레임을 생성할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 제4 이미지 데이터(945), 제5 이미지 데이터, 제6 이미지 데이터, 및 제7 이미지 데이터를 기반으로 제4 이미지 프레임을 생성할 수 있다. 일 실시 예에 따르면, 프로세서(320)는 제5 이미지 데이터, 제6 이미지 데이터, 제7 이미지 데이터, 및 제8 이미지 데이터를 기반으로 제5 이미지 프레임을 생성할 수 있다.

일 실시 예에 따르면, 프로세서(320)가 현재 시점에서 이미지 프레임을 생성하기 위해 필요한 4개의 이미지 데이터에는 이전 시점에서 이미지 프레임을 생성할 때 이용된 이미지 데이터가 포함될 수 있다. 예를 들면, 프로세서(320)는 제1 이미지 데이터(915) 내지 제4 이미지 데이터(945)를 획득하여 제1 이미지 프레임을 생성한 후 제5 이미지 데이터 내지 제8 이미지 데이터를 획득하여 제1 이미지 프레임에 연속하는 이미지 프레임을 생성(이하, 제1 방법)할 수도 있으나, 제1 이미지 프레임을 생성한 후 제2 이미지 데이터(925) 내지 제4 이미지 데이터(945)를 다시 활용하여 제2 이미지 프레임을 생성(이하, 제2 방법)할 수도 있다. 일 실시 예에서, 프로세서(320)가 이전 시점의 이미지 프레임을 생성할 때에 이용된 이미지 데이터를 현재 시점의 이미지 프레임을 생성할 때에도 이용하는 경우, 생성되는 이미지 프레임 사이의 시간 간격이 감소하는 장점이 있다. 예를 들면, 상기 제1 방법에 따라 이미지 프레임을 생성하는 경우 4개의 이미지 데이터가 획득될 때마다 1개의 이미지 프레임을 생성할 수 있으나, 상기 제2 방법에 따라 이미지 프레임을 생성하는 경우 1개의 이미지 데이터가 획득될 때마다 1개의 이미지 프레임을 생성할 수 있다.

일 실시 예에 따르면, 프로세서(320)는 이미지 촬영 모드에 따라서 서로 다른 방법으로 이미지 프레임을 획득할 수 있다. 예를 들면, 프로세서(320)는 스틸 이미지(still image)를 촬영하는 경우에는 제1 이미지 프레임을 생성하기 위해 제1 이미지 데이터(915), 제2 이미지 데이터(925), 제3 이미지 데이터(935), 및 제4 이미지 데이터(945)를 획득할 수 있다. 다른 예를 들면, 프로세서(320)는 동영상(video)을 촬영하는 경우에는 이전 시점의 이미지 프레임(예: 제1 이미지 프레임)을 생성할 때 이용된 이미지 데이터(예: 제2 이미지 데이터(925), 제3 이미지 데이터(935), 제4 이미지 데이터(945))와 함께 제5 이미지 데이터를 기반으로 제2 이미지 프레임을 생성할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치는, OIS 기능을 수행할 수 있는 카메라 모듈, 및 상기 카메라 모듈과 전기적으로 연결된 적어도 하나의 프로세서를 포함할 수 있다. 상기 적어도 하나의 프로세서는, 상기 OIS 기능을 이용하여 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득하도록 상기 카메라 모듈을 제어하고, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득하고, 상기 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 카메라 모듈은 렌즈 어셈블리를 포함하고, 상기 카메라 모듈은, 상기 OIS 기능을 수행하는 동안 상기 렌즈 어셈블리를 이동시키고, 상기 이동된 렌즈 어셈블리를 통해 상기 제1 이미지 데이터, 상기 제2 이미지 데이터, 상기 제3 이미지 데이터, 및 상기 제4 이미지 데이터를 획득하고, 상기 제1 이미지 데이터, 상기 제2 이미지 데이터, 상기 제3 이미지 데이터, 및 상기 제4 이미지 데이터를 상기 적어도 하나의 프로세서에 제공할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 카메라 모듈은 이미지 센서를 포함하고, 상기 이미지 센서는 2x2 배열을 가지는 제1 픽셀, 제2 픽셀, 제3 픽셀, 및 제4 픽셀을 포함할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 적어도 하나의 프로세서는, 상기 제1 픽셀을 통해 획득된 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 적어도 하나의 프로세서는, 상기 제2 픽셀을 통해 획득된 상기 제1 픽셀 데이터와 상기 제3 픽셀 데이터, 및 상기 제1 픽셀을 통해 획득된 상기 제2 픽셀 데이터와 상기 제4 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 적어도 하나의 프로세서는, 상기 제1 픽셀을 통해 획득된 상기 제4 픽셀 데이터, 상기 제2 픽셀을 통해 획득된 상기 제3 픽셀 데이터, 상기 제3 픽셀을 통해 획득된 상기 제2 픽셀 데이터, 및 상기 제4 픽셀을 통해 획득된 상기 제1 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 적어도 하나의 프로세서는, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 평균하여 상기 제5 픽셀 데이터를 획득할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 적어도 하나의 프로세서는, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 합산하여 상기 제5 픽셀 데이터를 획득할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치의 동작 방법은, OIS 기능을 이용하여 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득하도록 상기 전자 장치에 포함된 카메라 모듈을 제어하는 동작, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득하는 동작, 및 상기 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성하는 동작을 포함할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치의 동작 방법에 있어서, 상기 제1 이미지 데이터, 상기 제2 이미지 데이터, 상기 제3 이미지 데이터, 및 상기 제4 이미지 데이터를 획득하도록 상기 카메라 모듈을 제어하는 동작은, 상기 OIS 기능을 수행하는 동안 상기 카메라 모듈에 포함된 렌즈 어셈블리를 이동시키는 동작, 및 상기 이동된 렌즈 어셈블리를 통해 상기 제1 이미지 데이터, 상기 제2 이미지 데이터, 상기 제3 이미지 데이터, 및 상기 제4 이미지 데이터를 획득하는 동작을 포함할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치의 동작 방법에 있어서, 상기 제5 픽셀 데이터를 획득하는 동작은, 상기 카메라 모듈의 이미지 센서에 포함된 제1 픽셀을 통해 획득된 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는 동작을 포함할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치의 동작 방법에 있어서, 상기 카메라 모듈의 이미지 센서는 제1 픽셀, 및 상기 제1 픽셀에 인접한 제2 픽셀을 포함하고, 상기 제5 픽셀 데이터를 획득하는 동작은, 상기 제2 픽셀을 통해 획득된 상기 제1 픽셀 데이터와 상기 제3 픽셀 데이터, 및 상기 제1 픽셀을 통해 획득된 상기 제2 픽셀 데이터와 상기 제4 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는 동작을 포함할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치의 동작 방법에 있어서, 상기 카메라 모듈의 이미지 센서는 2x2 배열을 가지는 제1 픽셀, 제2 픽셀, 제3 픽셀, 제4 픽셀을 포함하고, 상기 제5 픽셀 데이터를 획득하는 동작은, 상기 제1 픽셀을 통해 획득된 상기 제4 픽셀 데이터, 상기 제2 픽셀을 통해 획득된 상기 제3 픽셀 데이터, 상기 제3 픽셀을 통해 획득된 상기 제2 픽셀 데이터, 및 상기 제4 픽셀을 통해 획득된 상기 제1 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는 동작을 포함할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치의 동작 방법에 있어서, 상기 제5 픽셀 데이터를 획득하는 동작은, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 평균하는 동작을 포함할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치의 동작 방법에 있어서, 상기 제5 픽셀 데이터를 획득하는 동작은, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 합산하는 동작을 포함할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치는, OIS 기능을 수행할 수 있는 카메라 모듈, 및 상기 카메라 모듈과 전기적으로 연결된 적어도 하나의 프로세서를 포함할 수 있다. 상기 적어도 하나의 프로세서는, 상기 OIS 기능을 이용하여 N2 개수의 이미지 데이터를 연속적으로 획득하도록 상기 카메라 모듈을 제어하고, 상기 N2 개수의 이미지 데이터는 각 이미지 데이터에 대응하는 N2 개수의 픽셀 데이터를 포함하고, 상기 N은 2 이상의 자연수임, 상기 N2 개수의 픽셀 데이터에 기반하여 최종 픽셀 데이터를 획득하고, 상기 최종 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 N2 개수의 이미지 데이터는 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 포함하고, 상기 N2 개수의 픽셀 데이터는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터를 포함하고, 상기 최종 픽셀 데이터는 제1 최종 픽셀 데이터이고, 상기 적어도 하나의 프로세서는, 상기 OIS 기능을 이용하여 상기 카메라 모듈로부터 상기 제4 이미지 데이터에 연속하는 제5 이미지 데이터를 획득하고, 상기 제5 이미지 데이터는 제5 픽셀 데이터를 포함함, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 상기 제4 픽셀 데이터, 및 상기 제5 픽셀 데이터에 기반하여 제2 최종 픽셀 데이터를 획득하고, 상기 제2 최종 픽셀 데이터를 기반으로 제2 이미지 프레임을 생성할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 적어도 하나의 프로세서는, 상기 OIS 기능을 이용하여 상기 카메라 모듈로부터 상기 제5 이미지 데이터에 연속하는 제6 이미지 데이터를 획득하고, 상기 제6 이미지 데이터는 제6 픽셀 데이터를 포함함, 상기 제3 픽셀 데이터, 상기 제4 픽셀 데이터, 상기 제5 픽셀 데이터, 및 상기 제6 픽셀 데이터에 기반하여 제3 최종 픽셀 데이터를 획득하고, 상기 제3 최종 픽셀 데이터를 기반으로 제3 이미지 프레임을 생성할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 적어도 하나의 프로세서는, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제3 픽셀 데이터를 평균하여 상기 제1 최종 픽셀 데이터를 획득하고, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 상기 제4 픽셀 데이터, 및 상기 제5 픽셀 데이터를 평균하여 상기 제2 최종 픽셀 데이터를 획득할 수 있다.

본 문서의 일 실시 예에 따른 전자 장치에 있어서, 상기 적어도 하나의 프로세서는, 동영상 촬영 모드에서 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 상기 제4 픽셀 데이터, 및 상기 제5 픽셀 데이터를 기반으로 상기 제2 이미지 프레임을 생성할 수 있다.

Claims (20)

- 전자 장치에 있어서,

OIS 기능을 수행할 수 있는 카메라 모듈; 및

상기 카메라 모듈과 전기적으로 연결된 적어도 하나의 프로세서를 포함하고,

상기 적어도 하나의 프로세서는:

상기 OIS 기능을 이용하여 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득하도록 상기 카메라 모듈을 제어하고,

상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득하고,

상기 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성하는, 전자 장치. - 청구항 1에 있어서,

상기 카메라 모듈은 렌즈 어셈블리를 포함하고,

상기 카메라 모듈은:

상기 OIS 기능을 수행하는 동안 상기 렌즈 어셈블리를 이동시키고,

상기 이동된 렌즈 어셈블리를 통해 상기 제1 이미지 데이터, 상기 제2 이미지 데이터, 상기 제3 이미지 데이터, 및 상기 제4 이미지 데이터를 획득하고,

상기 제1 이미지 데이터, 상기 제2 이미지 데이터, 상기 제3 이미지 데이터, 및 상기 제4 이미지 데이터를 상기 적어도 하나의 프로세서에 제공하는, 전자 장치. - 청구항 1에 있어서,

상기 카메라 모듈은 이미지 센서를 포함하고,

상기 이미지 센서는 2x2 배열을 가지는 제1 픽셀, 제2 픽셀, 제3 픽셀, 및 제4 픽셀을 포함하는, 전자 장치. - 청구항 3에 있어서,

상기 적어도 하나의 프로세서는, 상기 제1 픽셀을 통해 획득된 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는, 전자 장치. - 청구항 3에 있어서,

상기 적어도 하나의 프로세서는, 상기 제2 픽셀을 통해 획득된 상기 제1 픽셀 데이터와 상기 제3 픽셀 데이터, 및 상기 제1 픽셀을 통해 획득된 상기 제2 픽셀 데이터와 상기 제4 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는, 전자 장치. - 청구항 3에 있어서,

상기 적어도 하나의 프로세서는, 상기 제1 픽셀을 통해 획득된 상기 제4 픽셀 데이터, 상기 제2 픽셀을 통해 획득된 상기 제3 픽셀 데이터, 상기 제3 픽셀을 통해 획득된 상기 제2 픽셀 데이터, 및 상기 제4 픽셀을 통해 획득된 상기 제1 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는, 전자 장치. - 청구항 1에 있어서,

상기 적어도 하나의 프로세서는, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 평균하여 상기 제5 픽셀 데이터를 획득하는, 전자 장치. - 청구항 1에 있어서,

상기 적어도 하나의 프로세서는, 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 합산하여 상기 제5 픽셀 데이터를 획득하는, 전자 장치. - 전자 장치의 동작 방법에 있어서,

OIS 기능을 이용하여 제1 픽셀 데이터를 포함하는 제1 이미지 데이터, 제2 픽셀 데이터를 포함하는 제2 이미지 데이터, 제3 픽셀 데이터를 포함하는 제3 이미지 데이터, 및 제4 픽셀 데이터를 포함하는 제4 이미지 데이터를 연속적으로 획득하도록 상기 전자 장치에 포함된 카메라 모듈을 제어하는 동작;

상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터에 기반하여 제5 픽셀 데이터를 획득하는 동작; 및

상기 제5 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성하는 동작을 포함하는, 전자 장치의 동작 방법. - 청구항 9에 있어서,

상기 제1 이미지 데이터, 상기 제2 이미지 데이터, 상기 제3 이미지 데이터, 및 상기 제4 이미지 데이터를 획득하도록 상기 카메라 모듈을 제어하는 동작은:

상기 OIS 기능을 수행하는 동안 상기 카메라 모듈에 포함된 렌즈 어셈블리를 이동시키는 동작; 및

상기 이동된 렌즈 어셈블리를 통해 상기 제1 이미지 데이터, 상기 제2 이미지 데이터, 상기 제3 이미지 데이터, 및 상기 제4 이미지 데이터를 획득하는 동작을 포함하는, 전자 장치의 동작 방법. - 청구항 9에 있어서,

상기 제5 픽셀 데이터를 획득하는 동작은,

상기 카메라 모듈의 이미지 센서에 포함된 제1 픽셀을 통해 획득된 상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는 동작을 포함하는, 전자 장치의 동작 방법. - 청구항 9에 있어서,

상기 카메라 모듈의 이미지 센서는 제1 픽셀, 및 상기 제1 픽셀에 인접한 제2 픽셀을 포함하고,

상기 제5 픽셀 데이터를 획득하는 동작은,

상기 제2 픽셀을 통해 획득된 상기 제1 픽셀 데이터와 상기 제3 픽셀 데이터, 및 상기 제1 픽셀을 통해 획득된 상기 제2 픽셀 데이터와 상기 제4 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는 동작을 포함하는, 전자 장치의 동작 방법. - 청구항 9에 있어서,

상기 카메라 모듈의 이미지 센서는 2x2 배열을 가지는 제1 픽셀, 제2 픽셀, 제3 픽셀, 제4 픽셀을 포함하고,

상기 제5 픽셀 데이터를 획득하는 동작은,

상기 제1 픽셀을 통해 획득된 상기 제4 픽셀 데이터, 상기 제2 픽셀을 통해 획득된 상기 제3 픽셀 데이터, 상기 제3 픽셀을 통해 획득된 상기 제2 픽셀 데이터, 및 상기 제4 픽셀을 통해 획득된 상기 제1 픽셀 데이터를 기반으로 상기 제5 픽셀 데이터를 획득하는 동작을 포함하는, 전자 장치의 동작 방법. - 청구항 9에 있어서,

상기 제5 픽셀 데이터를 획득하는 동작은,

상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 평균하는 동작을 포함하는, 전자 장치의 동작 방법. - 청구항 9에 있어서,

상기 제5 픽셀 데이터를 획득하는 동작은,

상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제4 픽셀 데이터를 합산하는 동작을 포함하는, 전자 장치의 동작 방법. - 전자 장치에 있어서,

OIS 기능을 수행할 수 있는 카메라 모듈; 및

상기 카메라 모듈과 전기적으로 연결된 적어도 하나의 프로세서를 포함하고,

상기 적어도 하나의 프로세서는:

상기 OIS 기능을 이용하여 N2 개수의 이미지 데이터를 연속적으로 획득하도록 상기 카메라 모듈을 제어하고, 상기 N2 개수의 이미지 데이터는 각 이미지 데이터에 대응하는 N2 개수의 픽셀 데이터를 포함하고, 상기 N은 2 이상의 자연수임;

상기 N2 개수의 픽셀 데이터에 기반하여 최종 픽셀 데이터를 획득하고,

상기 최종 픽셀 데이터를 기반으로 제1 이미지 프레임을 생성하는, 전자 장치. - 청구항 16에 있어서,

상기 N2 개수의 이미지 데이터는 제1 이미지 데이터, 제2 이미지 데이터, 제3 이미지 데이터, 및 제4 이미지 데이터를 포함하고,

상기 N2 개수의 픽셀 데이터는 제1 픽셀 데이터, 제2 픽셀 데이터, 제3 픽셀 데이터, 및 제4 픽셀 데이터를 포함하고,

상기 최종 픽셀 데이터는 제1 최종 픽셀 데이터이고,

상기 적어도 하나의 프로세서는:

상기 OIS 기능을 이용하여 상기 카메라 모듈로부터 상기 제4 이미지 데이터에 연속하는 제5 이미지 데이터를 획득하고, 상기 제5 이미지 데이터는 제5 픽셀 데이터를 포함함;

상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 상기 제4 픽셀 데이터, 및 상기 제5 픽셀 데이터에 기반하여 제2 최종 픽셀 데이터를 획득하고,

상기 제2 최종 픽셀 데이터를 기반으로 제2 이미지 프레임을 생성하는, 전자 장치. - 청구항 17에 있어서,

상기 적어도 하나의 프로세서는:

상기 OIS 기능을 이용하여 상기 카메라 모듈로부터 상기 제5 이미지 데이터에 연속하는 제6 이미지 데이터를 획득하고, 상기 제6 이미지 데이터는 제6 픽셀 데이터를 포함함;

상기 제3 픽셀 데이터, 상기 제4 픽셀 데이터, 상기 제5 픽셀 데이터, 및 상기 제6 픽셀 데이터에 기반하여 제3 최종 픽셀 데이터를 획득하고,

상기 제3 최종 픽셀 데이터를 기반으로 제3 이미지 프레임을 생성하는, 전자 장치. - 청구항 17에 있어서,

상기 적어도 하나의 프로세서는:

상기 제1 픽셀 데이터, 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 및 상기 제3 픽셀 데이터를 평균하여 상기 제1 최종 픽셀 데이터를 획득하고,

상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 상기 제4 픽셀 데이터, 및 상기 제5 픽셀 데이터를 평균하여 상기 제2 최종 픽셀 데이터를 획득하는, 전자 장치. - 청구항 17에 있어서,

상기 적어도 하나의 프로세서는,

동영상 촬영 모드에서 상기 제2 픽셀 데이터, 상기 제3 픽셀 데이터, 상기 제4 픽셀 데이터, 및 상기 제5 픽셀 데이터를 기반으로 상기 제2 이미지 프레임을 생성하는, 전자 장치.

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020210040510A KR20220135036A (ko) | 2021-03-29 | 2021-03-29 | 이미지의 품질을 향상시키는 전자 장치 및 그 동작 방법 |

| PCT/KR2022/004123 WO2022211367A1 (ko) | 2021-03-29 | 2022-03-24 | 이미지의 품질을 향상시키는 전자 장치 및 그 동작 방법 |

| US18/454,538 US20230396884A1 (en) | 2021-03-29 | 2023-08-23 | Electronic device for improving image quality, and operation method of same |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020210040510A KR20220135036A (ko) | 2021-03-29 | 2021-03-29 | 이미지의 품질을 향상시키는 전자 장치 및 그 동작 방법 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20220135036A true KR20220135036A (ko) | 2022-10-06 |

Family

ID=83456490

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020210040510A KR20220135036A (ko) | 2021-03-29 | 2021-03-29 | 이미지의 품질을 향상시키는 전자 장치 및 그 동작 방법 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US20230396884A1 (ko) |

| KR (1) | KR20220135036A (ko) |

| WO (1) | WO2022211367A1 (ko) |

Family Cites Families (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5377179B2 (ja) * | 2009-09-09 | 2013-12-25 | キヤノン株式会社 | 撮像装置及び撮像装置の制御方法 |

| KR101630287B1 (ko) * | 2009-11-19 | 2016-06-14 | 삼성전자주식회사 | 손 떨림 보정 모듈을 구비하는 디지털 촬영 장치 및 이의 제어 방법 |

| JP5788551B1 (ja) * | 2014-03-27 | 2015-09-30 | オリンパス株式会社 | 画像処理装置および画像処理方法 |

| KR102176285B1 (ko) * | 2015-01-14 | 2020-11-09 | 삼성전기주식회사 | 손떨림 보정 장치를 이용한 고해상도 이미지 형성 장치 및 방법 |

| JP2020096301A (ja) * | 2018-12-13 | 2020-06-18 | オリンパス株式会社 | 撮像装置 |

-

2021

- 2021-03-29 KR KR1020210040510A patent/KR20220135036A/ko active Search and Examination

-

2022

- 2022-03-24 WO PCT/KR2022/004123 patent/WO2022211367A1/ko active Application Filing

-

2023

- 2023-08-23 US US18/454,538 patent/US20230396884A1/en active Pending

Also Published As

| Publication number | Publication date |

|---|---|

| WO2022211367A1 (ko) | 2022-10-06 |

| US20230396884A1 (en) | 2023-12-07 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US20230209202A1 (en) | Electronic device for performing image stabilization, and operating method therefor | |

| KR20220072616A (ko) | 복수의 카메라를 포함하는 전자 장치 및 그 전자 장치의 제어 방법 | |

| KR20220067034A (ko) | 슬로우 셔터를 제공하기 위한 방법, 장치 및 저장 매체 | |

| KR20220064170A (ko) | 이미지 센서를 포함하는 전자 장치 및 그 동작 방법 | |

| KR20220099789A (ko) | 카메라 모듈을 포함하는 전자 장치 및 그 전자 장치의 동작 방법 | |

| KR20220135036A (ko) | 이미지의 품질을 향상시키는 전자 장치 및 그 동작 방법 | |

| KR20220166592A (ko) | 카메라 모듈을 포함하는 전자 장치 및 그 전자 장치의 동작 방법 | |

| KR20220130481A (ko) | 카메라 모듈의 화각을 이용하여 이미지를 촬영하는 전자 장치 및 방법 | |

| KR20210130972A (ko) | 전자 장치의 컬러 필터, 및 그 전자 장치 | |

| US20220318971A1 (en) | Electronic device for supporting machine learning-based image processing | |

| KR20240010372A (ko) | 카메라 흔들림을 보정하기 위한 방법 및 이를 지원하는 전자 장치 | |

| US20230074962A1 (en) | Electronic device including a plurality of cameras and operating method thereof | |

| US20230388677A1 (en) | Electronic device including image sensor and operating method thereof | |

| KR20220132278A (ko) | 영상의 노이즈를 제거하는 전자 장치 및 그 동작 방법 | |

| KR20230022645A (ko) | 이미지를 제공하는 방법 및 이를 지원하는 전자 장치 | |

| KR20240034073A (ko) | 이미지 센서의 데이터 독출 방법 및 그 이미지 센서 | |

| KR20220145621A (ko) | 촬영 시 흔들림을 보정하는 방법 및 그 전자 장치 | |

| KR20220102491A (ko) | 화각을 조정할 수 있는 전자 장치 및 그 동작 방법 | |

| KR20220101998A (ko) | 자동 초점 조절이 가능한 전자 장치 및 그 동작 방법 | |

| KR20220058218A (ko) | 이미지 센서를 포함하는 전자 장치 및 그 동작 방법 | |

| KR20210141070A (ko) | 복수의 카메라를 이용한 이미지 촬영 방법 및 그 전자 장치 | |

| KR20240057293A (ko) | 이미지를 제공하는 방법 및 이를 지원하는 전자 장치 | |

| KR20220134276A (ko) | 이미지 센서를 포함하는 전자 장치 및 그 동작 방법 | |

| KR20240045046A (ko) | 카메라 모듈을 포함하는 전자 장치 및 그 동작 방법 | |

| KR20220141663A (ko) | 영상을 처리하는 방법 및 이를 수행하는 전자 장치 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination |