JP7197571B2 - 低レイテンシ動作計画更新を有するインテリジェントladarシステム - Google Patents

低レイテンシ動作計画更新を有するインテリジェントladarシステム Download PDFInfo

- Publication number

- JP7197571B2 JP7197571B2 JP2020515068A JP2020515068A JP7197571B2 JP 7197571 B2 JP7197571 B2 JP 7197571B2 JP 2020515068 A JP2020515068 A JP 2020515068A JP 2020515068 A JP2020515068 A JP 2020515068A JP 7197571 B2 JP7197571 B2 JP 7197571B2

- Authority

- JP

- Japan

- Prior art keywords

- ladar

- frame

- shot list

- frames

- data

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/88—Lidar systems specially adapted for specific applications

- G01S17/89—Lidar systems specially adapted for specific applications for mapping or imaging

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/02—Systems using the reflection of electromagnetic waves other than radio waves

- G01S17/06—Systems determining position data of a target

- G01S17/08—Systems determining position data of a target for measuring distance only

- G01S17/10—Systems determining position data of a target for measuring distance only using transmission of interrupted, pulse-modulated waves

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/02—Systems using the reflection of electromagnetic waves other than radio waves

- G01S17/06—Systems determining position data of a target

- G01S17/42—Simultaneous measurement of distance and other co-ordinates

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/86—Combinations of lidar systems with systems other than lidar, radar or sonar, e.g. with direction finders

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S17/00—Systems using the reflection or reradiation of electromagnetic waves other than radio waves, e.g. lidar systems

- G01S17/88—Lidar systems specially adapted for specific applications

- G01S17/93—Lidar systems specially adapted for specific applications for anti-collision purposes

- G01S17/931—Lidar systems specially adapted for specific applications for anti-collision purposes of land vehicles

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/481—Constructional features, e.g. arrangements of optical elements

- G01S7/4811—Constructional features, e.g. arrangements of optical elements common to transmitter and receiver

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/481—Constructional features, e.g. arrangements of optical elements

- G01S7/4814—Constructional features, e.g. arrangements of optical elements of transmitters alone

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/481—Constructional features, e.g. arrangements of optical elements

- G01S7/4817—Constructional features, e.g. arrangements of optical elements relating to scanning

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/483—Details of pulse systems

- G01S7/484—Transmitters

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S7/00—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00

- G01S7/48—Details of systems according to groups G01S13/00, G01S15/00, G01S17/00 of systems according to group G01S17/00

- G01S7/483—Details of pulse systems

- G01S7/486—Receivers

- G01S7/4861—Circuits for detection, sampling, integration or read-out

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B19/00—Condensers, e.g. light collectors or similar non-imaging optics

- G02B19/0004—Condensers, e.g. light collectors or similar non-imaging optics characterised by the optical means employed

- G02B19/0028—Condensers, e.g. light collectors or similar non-imaging optics characterised by the optical means employed refractive and reflective surfaces, e.g. non-imaging catadioptric systems

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B19/00—Condensers, e.g. light collectors or similar non-imaging optics

- G02B19/0033—Condensers, e.g. light collectors or similar non-imaging optics characterised by the use

- G02B19/0085—Condensers, e.g. light collectors or similar non-imaging optics characterised by the use for use with both a detector and a source

-

- G—PHYSICS

- G02—OPTICS

- G02B—OPTICAL ELEMENTS, SYSTEMS OR APPARATUS

- G02B26/00—Optical devices or arrangements for the control of light using movable or deformable optical elements

- G02B26/08—Optical devices or arrangements for the control of light using movable or deformable optical elements for controlling the direction of light

- G02B26/10—Scanning systems

- G02B26/108—Scanning systems having one or more prisms as scanning elements

Description

本特許出願は、2018年7月2日に出願された「Intelligent Ladar System with Low Latency Motion Planning Updates」と題する米国仮特許出願第62/693,078号に対する優先権を主張するものであり、この開示全体が参照により本明細書に組み込まれる。

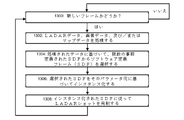

空中、地上、または海上を問わず、車両の安全な自律性は、動的障害物の迅速な精度、その特性評価、およびそれに対する迅速な対応に依存している。移動車両の自律障害物検出および動作計画に対する従来のアプローチを図1で示す。車両と共に使用するシステム100は、センサ106のスイート104と組み合わせた動作計画システム102を含む。スイート104内のセンサ106は、障害物検出および動作計画プロセスで使用するためのセンサデータ120を有する動作計画システム102を提供する。動作計画システム102内のセンサデータ取り込みインターフェース108は、センサ106からセンサデータ120を受信し、センサデータ120をセンサデータリポジトリ130に記憶し、そこで処理を待つ。動作計画システム102内の動作計画インテリジェンス110は、読み出しまたは照会コマンド124をセンサデータリポジトリ130に発行し、要求されたセンサデータを照会124に対する応答126として受信する。次いで、インテリジェンス110は、この取得されたセンサデータを解析して、1つ以上の他の車両サブシステムに通信される車両の動きに関する決定128を行う。動作計画インテリジェンス110はまた、センサ106にタスク付与コマンド122を発行して、センサデータ取得の制御を行使することもできる。

1) xおよびyのカメラ画素をそれぞれiおよびj、射程をi、j=1、.....、100、LADARをk、l、射程を同様にk、l=1、.....、100と規定する。

・ 差し迫ったバンプ/ポットホール‐垂直y軸に沿って上下に再方向付けられる速度

o 検出: マップから明らかなように道路の勾配をはるかに超える高速の瞬間的な垂直速度。

o 実用性: バンプが差し迫っていることを警告し、乗客が快適に過ごせるように減速する時間を確保し、および/または車両制御を強化する。

・ 雨/氷の発生(横滑り)‐バルク速度ベクトルの変化を伴わない水平面内でのマイクロスケールの車両速度シフト

o 検出:車両の位置のランダムウォークは、標準的な自我(すなわち、自車)の動きをはるかに超えて戻る。

o 実用性: 安全でない[グリップが低下した]道路状況の警告、車両制御のためのターン半径および制動モデルを更新する。

・ 差し迫ったワインディング/カーブ道路 ‐速度を変えずに水平方向に徐々に横方向に変化して(揺れて)いるか、または速度が低下している可能性がある

o 検出:車両の半径方向に投影された長さのわずかな変化、および/または車両の後方と前方との速度の差[範囲が分解されている場合]、または上記の検出モダリティに対してSNR依存の範囲分解が不十分な場合の方位角重心の変化。

o 実用性:横方向の変化は、道路の曲率が近づいていることを事前に警告し、自車の路面が変化する前に車両制御に対する修正アクションを可能にする。

・ 差し迫った渋滞‐減速/制動

o 検出:ライダー搭載車両の前の車両のコヒーレント減速パターン。

o 実用性:減速の必要性の事前警告、および/または好ましい経路の選択肢を探る経路計画の変更。

行動知覚:人間またはロボット運転手の意思確認。行動の知覚は、異常検出の問題である。したがって、例えば、1台の車両は、「フリップフロップ」していた場合、路面が証拠となる原因になることはなく、運転が直接の原因であることは明らかである。

・ 運転者の異常行動[飲酒運転または機器の故障]‐方向および速度(速度ベクトル)の微妙な横方向への変化(脱線)

o 検出:車両の半径方向に投影された長さのわずかな変化、および/または車両の後方と前方との速度の差[範囲が分解されている場合]、または上記の検出モダリティに対してSNR依存の範囲分解が不十分な場合の方位角重心の変化。

o 実用性:ロボットであれ人間であれ、異常な運転者は脅威的な運転者である。高度な警告は、回避的な自車の予防的な再計画を可能にする。

・ 「マクドナルドでの停止」 (自発的な脱線)‐方向および速度(方位速度ベクトル)の急速な横方向の変化(揺れ)。

o 検出:車両の半径方向に投影された長さのわずかな変化、および/または車両の後方と前方との速度の差[範囲が分解されている場合]、または上記の検出モダリティに対してSNR依存の範囲分解が不十分な場合の方位角重心の変化。

o 実用性:当該迂回者を後回しにすることを回避する。

上記検出モードの様々な混合を含む追加の行動モード検出は、以下のものを含む。

・ 合流/車線変更/通過-微妙なまたは急速な加速を伴う微妙なまたは急速な横方向の方向転換。

・ 緊急制動‐Z軸(半径方向の)減速

・ 左旋回開始-旋回車線の手前で半径方向に減速する。

・ 黄信号での保護(黄色で飛び出す)-横方向への減速

・ ブレーキの故障による惰性走行(丘)-一定のベクトルでの徐々の加速(減速なし)。

Claims (52)

- LADAR送信機と、プロセッサと、を備える装置であって、

前記LADAR送信機は、視野内の複数の測距点に向けて、複数のLADARフレームに対応する複数のLADARパルスを送信するように構成されており、

前記プロセッサは、(1)前記視野に関するデータを処理するプロセスと、(2)前記処理されたデータに基づいて、複数の規定されたショットリストフレームの中から前記LADAR送信機の規定されたショットリストフレームを選択するプロセスと、を実施するように構成されており、前記規定されたショットリストフレームは、所定のLADARフレーム内の前記LADARパルスによる目標設定のための前記視野内の複数の座標を識別し、

前記LADAR送信機は、前記選択されたショットリストフレームに応じて、前記所定のLADARフレームの前記LADARパルスを送信するプロセスを実施するようにさらに構成されている、

装置。 - 前記プロセッサは、前記処理するプロセス、前記選択するプロセスおよび前記送信するプロセスをフレームごとに繰り返し実施するようにさらに構成されている、

請求項1に記載の装置。 - 前記プロセッサは、前記処理するプロセス、前記選択するプロセスおよび前記送信するプロセスをフレームごとに繰り返し実施するようにさらに構成され、これにより複数の異なる規定されたショットリストフレームは、複数の異なるLADARフレームに対して選択される、

請求項2に記載の装置。 - 前記処理されたデータは、前記視野の複数の特性を表す特性データを含む、

請求項1~3のいずれか1項に記載の装置。 - 前記特性データは、前記視野内の物体を表すデータを含む、

請求項4に記載の装置。 - 前記装置は、前記送信されたLADARパルスの反射を受信するように構成されたLADAR受信機をさらに備え、

前記プロセッサは、前記受信された反射に基づいて前記視野に関する射程情報を計算するようにさらに構成され、前記処理されたデータは、前記計算された射程情報を含む、

請求項1~5のいずれか1項に記載の装置。 - 前記装置は、前記視野に対応する画像データを生成するように構成されたカメラをさらに備え、

前記処理されたデータは、前記生成された画像データを含む、

請求項6に記載の装置。 - 前記カメラは、前記生成された画像データが前記LADAR受信機の前記視野に対応するように、前記LADAR受信機と共に照準されている、

請求項7に記載の装置。 - 前記生成された画像データは、複数の画像フレームを含み、前記プロセッサは、

前記カメラおよびLADARフレームによって生成された画像フレームを空間的に整列させることと、

前記画像フレームおよび前記LADARフレーム上でエッジ検出を実施して、前記画像フレームおよび前記LADARフレーム内の物体を検出することと、

前記エッジ検出および前記画像フレームと前記LADARフレームとの前記空間的な整列に基づいて、前記物体に関する動きデータを生成することと、

を行うようにさらに構成されている、

請求項7または8のいずれかに記載の装置。 - 前記LADAR送信機は、

複数の走査可能なミラーと、

前記走査可能なミラーに対する制御を介して前記測距点に向けて、前記LADAR送信機を照準させるように構成されたビームスキャナコントローラと、

を含む、

請求項1~9のいずれか1項に記載の装置。 - 複数の前記規定されたショットリストフレームの各々は、これらの規定されたショットリストフレームを前記所定のLADARフレームに対してパラメータ化することを可能にする複数の変数を含む、

請求項1~10のいずれか1項に記載の装置。 - 前記変数は、前記ショットリストフレームのLADARパルス間の間隔、前記ショットリストフレームの前記LADARパルスによって規定されるパターン、および/または、前記ショットリストフレームのLADARパルスによる目標設定のための特定の座標のうちの少なくとも1つを制御する、

請求項11に記載の装置。 - 前記規定されたショットリストフレームは、ラスタエミュレーションショットリストフレームを含む、

請求項1~12のいずれか1項に記載の装置。 - 前記規定されたショットリストフレームは、フォビエーションショットリストフレームを含む、

請求項1~13のいずれか1項に記載の装置。 - 前記フォビエーションショットリストフレームは、仰角フォビエーションショットリストフレームを含む、

請求項14に記載の装置。 - 前記フォビエーションショットリストフレームは、方位角フォビエーションショットリストフレームを含む、

請求項14または15のいずれかに記載の装置。 - 前記フォビエーションショットリストフレームは、重心フォビエーションショットリストフレームを含む、

請求項14~16のいずれか1項に記載の装置。 - 前記規定されたショットリストフレームは、ランダムサンプリングショットリストフレームを含む、

請求項1~17のいずれか1項に記載の装置。 - 前記規定されたショットリストフレームは、関心領域ショットリストフレームを含む、

請求項1~18のいずれか1項に記載の装置。 - 前記関心領域ショットリストフレームは、少なくとも1つの境界ボックスを含む、

請求項19に記載の装置。 - 前記規定されたショットリストフレームは、画像で喚起されるショットリストフレームを含む、

請求項1~20のいずれか1項に記載の装置。 - 前記画像で喚起されるショットリストフレームは、前記視野内のエッジに基づいている、

請求項21に記載の装置。 - 前記画像で喚起されるショットリストフレームは、前記視野内の影に基づいている、

請求項21に記載の装置。 - 前記規定されたショットリストフレームは、マップで喚起されるショットリストフレームを含む、

請求項1~23のいずれか1項に記載の装置。 - 前記装置は、LADAR受信機をさらに含み、

前記LADAR送信機は、視野内の目標に向けてLADARフレーム内のLADARパルスのクラスタを送信するようにさらに構成されており、前記クラスタ内の複数の前記LADARパルスの各々は、離間されているが、前記視野内の指定された距離で前記クラスタ内の他のLADARパルスのうちの少なくとも1つと重複しており、

前記LADAR受信機は、前記送信されたLADARパルスのクラスタの反射を受信するように構成されており、

前記プロセッサは、(1)前記受信された反射を表すデータを処理し、(2)前記処理されたデータに基づいて、前記目標のフレーム内の動きデータを計算するようにさらに構成されており、前記規定されたショットリストフレームを選択するために使用される前記処理されたデータは、前記計算されたフレーム内の動きデータを含む、

請求項1~24のいずれか1項に記載の装置。 - プロセッサが、LADARシステムの視野に関するデータを処理することと、

プロセッサが、前記処理されたデータに基づいて、複数の規定されたショットリストフレームの中から規定されたショットリストフレームを選択することであって、前記規定されたショットリストフレームが、所定のLADARフレーム内の複数のLADARパルスによる目標設定のための前記視野内の複数の座標を識別することと、

前記選択されたショットリストフレームに従って、前記視野内の複数の測距点に向けて、前記所定のLADARフレームの複数のLADARパルスを送信することと、

を含む方法。 - 前記方法は、前記処理すること、前記選択することおよび前記送信することをフレームごとに繰り返し実施することをさらに含む、

請求項26に記載の方法。 - 前記方法は、複数の異なる規定されたショットリストフレームが複数の異なるLADARフレームに対して選択されるように、前記処理すること、前記選択することおよび前記送信することをフレームごとに繰り返し実施することをさらに含む、

請求項27に記載の方法。 - 前記処理されたデータは、前記視野の複数の特性を表す特性データを含む、

請求項26~28のいずれか1項に記載の方法。 - 前記特性データは、前記視野内の物体を表すデータを含む、

請求項29に記載の方法。 - 前記方法は、

前記送信されたLADARパルスの反射を受信することと、

プロセッサが、前記受信された反射に基づいて、前記視野に関する射程情報を計算することと、

をさらに含み、

前記処理されたデータは、前記計算された射程情報を含む、

請求項26~30のいずれか1項に記載の方法。 - 前記方法は、カメラが、前記視野に対応する画像データを生成することをさらに含み、

前記処理されたデータは、前記生成された画像データを含む、

請求項31に記載の方法。 - 前記カメラは、前記生成された画像データが、前記受信することを実施するLADAR受信機の前記視野に対応するように、前記LADAR受信機と共に照準されている、

請求項32に記載の方法。 - 前記生成された画像データは、複数の画像フレームを含み、前記方法は、

プロセッサが、前記カメラおよびLADARフレームによって生成された画像フレームを空間的に整列させることと、

プロセッサが、前記画像フレームおよび前記LADARフレーム上でエッジ検出を実施して、前記画像フレームおよび前記LADARフレーム内の物体を検出することと、

プロセッサが、前記エッジ検出および前記画像フレームと前記LADARフレームとの前記空間的な整列に基づいて、前記物体に関する動きデータを生成することと、

をさらに含む、

請求項32または33のいずれかに記載の方法。 - 前記送信することは、LADAR送信機によって実施され、前記LADAR送信機は、

複数の走査可能なミラーと、

前記走査可能なミラーに対する制御を介して前記測距点に向けて、前記LADAR送信機を照準させるように構成されたビームスキャナコントローラと、

を含む、

請求項26~34のいずれか1項に記載の方法。 - 複数の前記規定されたショットリストフレームの各々は、これらの規定されたショットリストフレームを前記所定のLADARフレームに対してパラメータ化することを可能にする複数の変数を含む、

請求項26~35のいずれか1項に記載の方法。 - 前記変数は、前記ショットリストフレームのLADARパルス間の間隔、前記ショットリストフレームの前記LADARパルスによって規定されるパターン、および/または、前記ショットリストフレームのLADARパルスによる目標設定のための特定の座標のうちの少なくとも1つを制御する、

請求項36に記載の方法。 - 前記規定されたショットリストフレームは、ラスタエミュレーションショットリストフレームを含む、

請求項26~37のいずれか1項に記載の方法。 - 前記規定されたショットリストフレームは、フォビエーションショットリストフレームを含む、

請求項26~38のいずれか1項に記載の方法。 - 前記フォビエーションショットリストフレームは、仰角フォビエーションショットリストフレームを含む、

請求項39に記載の方法。 - 前記フォビエーションショットリストフレームは、方位角フォビエーションショットリストフレームを含む、

請求項39または40のいずれかに記載の方法。 - 前記フォビエーションショットリストフレームは、重心フォビエーションショットリストフレームを含む、

請求項39~41のいずれか1項に記載の方法。 - 前記規定されたショットリストフレームは、ランダムサンプリングショットリストフレームを含む、

請求項26~42のいずれか1項に記載の方法。 - 前記規定されたショットリストフレームは、関心領域ショットリストフレームを含む、

請求項26~43のいずれか1項に記載の方法。 - 前記関心領域ショットリストフレームは、少なくとも1つの境界ボックスを含む、

請求項44に記載の方法。 - 前記規定されたショットリストフレームは、画像で喚起されるショットリストフレームを含む、

請求項26~45のいずれか1項に記載の方法。 - 前記画像で喚起されるショットリストフレームは、前記視野内のエッジに基づいている、

請求項46に記載の方法。 - 前記画像で喚起されるショットリストフレームは、前記視野内の影に基づいている、

請求項46に記載の方法。 - 前記規定されたショットリストフレームは、マップで喚起されるショットリストフレームを含む、

請求項26~48のいずれか1項に記載の方法。 - 前記送信することは、視野内の目標に向けてLADARフレーム内のLADARパルスのクラスタを送信することをさらに含み、前記クラスタ内の複数の前記LADARパルスの各々は、離間されているが、前記視野内の指定された距離で前記クラスタ内の他のLADARパルスのうちの少なくとも1つと重複しており、前記方法は、

LADAR受信機が、前記送信されたLADARパルスのクラスタの反射を受信することと、

プロセッサが、前記受信された反射を表すデータを処理することと、

プロセッサが、前記処理されたデータに基づいて、前記目標のフレーム内の動きデータを計算することであって、前記選択することによって使用される前記処理されたデータが、前記計算されたフレーム内の動きデータを含むことと、

を含む、

請求項26~49のいずれか1項に記載の方法。 - 前記LADAR送信機は、圧縮センシングを使用する、

請求項1~25のいずれか1項に記載の装置。 - 前記LADARシステムは、圧縮センシングを使用する、

請求項26~50のいずれか1項に記載の方法。

Applications Claiming Priority (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US201762558937P | 2017-09-15 | 2017-09-15 | |

| US62/558,937 | 2017-09-15 | ||

| US201862693078P | 2018-07-02 | 2018-07-02 | |

| US62/693,078 | 2018-07-02 | ||

| PCT/US2018/047199 WO2019216937A2 (en) | 2017-09-15 | 2018-08-21 | Intelligent ladar system with low latency motion planning updates |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2020534518A JP2020534518A (ja) | 2020-11-26 |

| JP2020534518A5 JP2020534518A5 (ja) | 2021-09-24 |

| JP7197571B2 true JP7197571B2 (ja) | 2022-12-27 |

Family

ID=65720084

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020515068A Active JP7197571B2 (ja) | 2017-09-15 | 2018-08-21 | 低レイテンシ動作計画更新を有するインテリジェントladarシステム |

Country Status (6)

| Country | Link |

|---|---|

| US (5) | US10495757B2 (ja) |

| EP (1) | EP3682308B1 (ja) |

| JP (1) | JP7197571B2 (ja) |

| CN (1) | CN111344647A (ja) |

| CA (1) | CA3075736A1 (ja) |

| WO (1) | WO2019216937A2 (ja) |

Families Citing this family (90)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11609336B1 (en) | 2018-08-21 | 2023-03-21 | Innovusion, Inc. | Refraction compensation for use in LiDAR systems |

| US20170328729A1 (en) * | 2012-08-14 | 2017-11-16 | Google Inc. | System To Optimize Sensor Parameters In An Autonomous Vehicle |

| CA2958204A1 (en) | 2014-08-15 | 2016-02-18 | Aeye, Inc. | Methods and systems for ladar transmission |

| US10042159B2 (en) | 2016-02-18 | 2018-08-07 | Aeye, Inc. | Ladar transmitter with optical field splitter/inverter |

| US10761196B2 (en) | 2016-02-18 | 2020-09-01 | Aeye, Inc. | Adaptive ladar receiving method |

| US9933513B2 (en) | 2016-02-18 | 2018-04-03 | Aeye, Inc. | Method and apparatus for an adaptive ladar receiver |

| US10908262B2 (en) | 2016-02-18 | 2021-02-02 | Aeye, Inc. | Ladar transmitter with optical field splitter/inverter for improved gaze on scan area portions |

| US11092690B1 (en) * | 2016-09-22 | 2021-08-17 | Apple Inc. | Predicting lidar data using machine learning |

| CN114296093A (zh) | 2016-11-29 | 2022-04-08 | 布莱克莫尔传感器和分析有限责任公司 | 用于以点云数据集合对对象进行分类的方法和系统 |

| EP3548841A4 (en) | 2016-11-30 | 2020-06-10 | Blackmore Sensors And Analytics Inc. | METHOD AND SYSTEM FOR DOPPLER DETECTION AND DOPPLER CORRECTION OF THE OPTICAL DETECTION OF THE CHIRPED AREA |

| KR102380943B1 (ko) | 2016-11-30 | 2022-03-30 | 블랙모어 센서스 앤드 애널리틱스, 엘엘씨 | 광학 거리 측정 시스템을 이용한 자동적인 실시간 적응형 스캐닝 방법과 시스템 |

| WO2018125438A2 (en) | 2016-11-30 | 2018-07-05 | Blackmore Sensors and Analytics Inc. | Method and system for adaptive scanning with optical ranging systems |

| JP7088937B2 (ja) | 2016-12-30 | 2022-06-21 | イノビュージョン インコーポレイテッド | 多波長ライダー設計 |

| US10942257B2 (en) | 2016-12-31 | 2021-03-09 | Innovusion Ireland Limited | 2D scanning high precision LiDAR using combination of rotating concave mirror and beam steering devices |

| US11009605B2 (en) | 2017-01-05 | 2021-05-18 | Innovusion Ireland Limited | MEMS beam steering and fisheye receiving lens for LiDAR system |

| EP3566070A4 (en) | 2017-01-05 | 2020-08-12 | Innovusion Ireland Limited | METHOD AND SYSTEM FOR ENCODING AND DECODING A LIDAR |

| US10422880B2 (en) | 2017-02-03 | 2019-09-24 | Blackmore Sensors and Analytics Inc. | Method and system for doppler detection and doppler correction of optical phase-encoded range detection |

| DE102017201936A1 (de) * | 2017-02-08 | 2018-08-09 | Robert Bosch Gmbh | Verfahren zur Reduzierung eines Kollisionsschadens |

| US10185028B2 (en) | 2017-02-17 | 2019-01-22 | Aeye, Inc. | Method and system for ladar pulse deconfliction using delay code selection |

| CN110582439B (zh) * | 2017-03-02 | 2022-07-22 | 松下知识产权经营株式会社 | 驾驶辅助方法以及利用了该驾驶辅助方法的驾驶辅助装置、驾驶辅助系统 |

| US10401495B2 (en) | 2017-07-10 | 2019-09-03 | Blackmore Sensors and Analytics Inc. | Method and system for time separated quadrature detection of doppler effects in optical range measurements |

| CN111344647A (zh) | 2017-09-15 | 2020-06-26 | 艾耶股份有限公司 | 具有低延时运动规划更新的智能激光雷达系统 |

| JP7117092B2 (ja) * | 2017-09-25 | 2022-08-12 | 株式会社トプコン | レーザ測定方法及びレーザ測定装置 |

| WO2019079642A1 (en) | 2017-10-19 | 2019-04-25 | Innovusion Ireland Limited | LIDAR WITH EXTENDED DYNAMIC RANGE |

| US11493601B2 (en) | 2017-12-22 | 2022-11-08 | Innovusion, Inc. | High density LIDAR scanning |

| US11675050B2 (en) | 2018-01-09 | 2023-06-13 | Innovusion, Inc. | LiDAR detection systems and methods |

| WO2019139895A1 (en) | 2018-01-09 | 2019-07-18 | Innovusion Ireland Limited | Lidar detection systems and methods that use multi-plane mirrors |

| WO2019164961A1 (en) | 2018-02-21 | 2019-08-29 | Innovusion Ireland Limited | Lidar systems with fiber optic coupling |

| US11391823B2 (en) | 2018-02-21 | 2022-07-19 | Innovusion, Inc. | LiDAR detection systems and methods with high repetition rate to observe far objects |

| US20190265339A1 (en) | 2018-02-23 | 2019-08-29 | Innovusion Ireland Limited | Distributed lidar systems |

| US11808888B2 (en) | 2018-02-23 | 2023-11-07 | Innovusion, Inc. | Multi-wavelength pulse steering in LiDAR systems |

| US11567182B2 (en) | 2018-03-09 | 2023-01-31 | Innovusion, Inc. | LiDAR safety systems and methods |

| WO2019199796A1 (en) | 2018-04-09 | 2019-10-17 | Innovusion Ireland Limited | Compensation circuitry for lidar receiver systems and method of use thereof |

| WO2019199775A1 (en) | 2018-04-09 | 2019-10-17 | Innovusion Ireland Limited | Lidar systems and methods for exercising precise control of a fiber laser |

| US10705534B2 (en) * | 2018-04-19 | 2020-07-07 | Faraday&Future Inc. | System and method for ground plane detection |

| US10705220B2 (en) * | 2018-04-19 | 2020-07-07 | Faraday & Future Inc. | System and method for ground and free-space detection |

| CN115079195A (zh) * | 2018-04-23 | 2022-09-20 | 布莱克莫尔传感器和分析有限责任公司 | 用相干距离多普勒光学传感器控制自主车辆的方法和系统 |

| CN114114295A (zh) | 2018-06-15 | 2022-03-01 | 图达通爱尔兰有限公司 | 用于聚焦感兴趣的范围的lidar系统和方法 |

| US10809364B2 (en) | 2018-08-06 | 2020-10-20 | Luminar Technologies, Inc. | Determining relative velocity using co-located pixels |

| US11860316B1 (en) | 2018-08-21 | 2024-01-02 | Innovusion, Inc. | Systems and method for debris and water obfuscation compensation for use in LiDAR systems |

| US11579300B1 (en) | 2018-08-21 | 2023-02-14 | Innovusion, Inc. | Dual lens receive path for LiDAR system |

| US11614526B1 (en) | 2018-08-24 | 2023-03-28 | Innovusion, Inc. | Virtual windows for LIDAR safety systems and methods |

| US11796645B1 (en) | 2018-08-24 | 2023-10-24 | Innovusion, Inc. | Systems and methods for tuning filters for use in lidar systems |

| US11579258B1 (en) | 2018-08-30 | 2023-02-14 | Innovusion, Inc. | Solid state pulse steering in lidar systems |

| US11327177B2 (en) | 2018-10-25 | 2022-05-10 | Aeye, Inc. | Adaptive control of ladar shot energy using spatial index of prior ladar return data |

| WO2020102406A1 (en) | 2018-11-14 | 2020-05-22 | Innovusion Ireland Limited | Lidar systems and methods that use a multi-facet mirror |

| US11294042B2 (en) * | 2018-12-31 | 2022-04-05 | Wipro Limited | Method and system for detecting presence of partial visual fault in Lidar sensor of vehicle |

| US11822010B2 (en) | 2019-01-04 | 2023-11-21 | Blackmore Sensors & Analytics, Llc | LIDAR system |

| US11675055B2 (en) | 2019-01-10 | 2023-06-13 | Innovusion, Inc. | LiDAR systems and methods with beam steering and wide angle signal detection |

| JP2022521459A (ja) | 2019-02-09 | 2022-04-08 | シルク テクノロジーズ インコーポレイティッド | スペックル感度が低減されたlidarシステム |

| US11486970B1 (en) | 2019-02-11 | 2022-11-01 | Innovusion, Inc. | Multiple beam generation from a single source beam for use with a LiDAR system |

| US11513223B2 (en) | 2019-04-24 | 2022-11-29 | Aeye, Inc. | Ladar system and method with cross-receiver |

| US11567206B1 (en) * | 2019-05-17 | 2023-01-31 | Insight Lidar, Inc. | Chip-scale coherent lidar utilizing quantum dots |

| DE102019207741A1 (de) * | 2019-05-27 | 2020-12-03 | Infineon Technologies Ag | Ein LIDAR-System, ein Verfahren für ein LIDAR-System und ein Empfänger für ein LIDAR-System mit ersten und zweiten Umwandlungselementen |

| US10718638B1 (en) | 2019-06-10 | 2020-07-21 | Pony Ai Inc. | Systems and methods for using photonics to detect alignment anomaly |

| US11556000B1 (en) | 2019-08-22 | 2023-01-17 | Red Creamery Llc | Distally-actuated scanning mirror |

| DE102019126400A1 (de) * | 2019-09-30 | 2021-04-01 | Ford Global Technologies, Llc | Verfahren zum Betrieb eines Kraftfahrzeugs mit einem LIDAR-Sensor |

| CN112606839A (zh) * | 2019-10-03 | 2021-04-06 | 株式会社斯巴鲁 | 车外环境识别装置 |

| US11391842B2 (en) * | 2020-01-06 | 2022-07-19 | Luminar, Llc | Adaptive scan pattern with virtual horizon estimation |

| US11016197B1 (en) | 2020-06-29 | 2021-05-25 | Aurora Innovation, Inc. | LIDAR system |

| US20220018945A1 (en) * | 2020-07-14 | 2022-01-20 | Samsung Electronics Co., Ltd. | Readout architecture for fmcw lidar |

| JP6837626B1 (ja) | 2020-08-03 | 2021-03-03 | 株式会社空間技術総合研究所 | 地物データの生成システム、地物データベース更新システム及び地物データの生成方法 |

| JP2022052270A (ja) * | 2020-09-23 | 2022-04-04 | 株式会社デンソー | Lidar装置 |

| US11702102B2 (en) * | 2020-11-19 | 2023-07-18 | Waymo Llc | Filtering return points in a point cloud based on radial velocity measurement |

| US11706507B2 (en) | 2020-12-30 | 2023-07-18 | Waymo Llc | Systems, apparatus, and methods for generating enhanced images |

| US11921234B2 (en) | 2021-02-16 | 2024-03-05 | Innovusion, Inc. | Attaching a glass mirror to a rotating metal motor frame |

| US11422267B1 (en) | 2021-02-18 | 2022-08-23 | Innovusion, Inc. | Dual shaft axial flux motor for optical scanners |

| US11789128B2 (en) | 2021-03-01 | 2023-10-17 | Innovusion, Inc. | Fiber-based transmitter and receiver channels of light detection and ranging systems |

| WO2022196016A1 (ja) * | 2021-03-17 | 2022-09-22 | ソニーセミコンダクタソリューションズ株式会社 | 情報処理装置および情報処理方法、ならびに、センシングシステム |

| US20230044929A1 (en) | 2021-03-26 | 2023-02-09 | Aeye, Inc. | Multi-Lens Lidar Receiver with Multiple Readout Channels |

| US11474214B1 (en) | 2021-03-26 | 2022-10-18 | Aeye, Inc. | Hyper temporal lidar with controllable pulse bursts to resolve angle to target |

| US11635495B1 (en) | 2021-03-26 | 2023-04-25 | Aeye, Inc. | Hyper temporal lidar with controllable tilt amplitude for a variable amplitude scan mirror |

| US11448734B1 (en) | 2021-03-26 | 2022-09-20 | Aeye, Inc. | Hyper temporal LIDAR with dynamic laser control using laser energy and mirror motion models |

| US11630188B1 (en) | 2021-03-26 | 2023-04-18 | Aeye, Inc. | Hyper temporal lidar with dynamic laser control using safety models |

| US11500093B2 (en) | 2021-03-26 | 2022-11-15 | Aeye, Inc. | Hyper temporal lidar using multiple matched filters to determine target obliquity |

| US20220308214A1 (en) | 2021-03-26 | 2022-09-29 | Aeye, Inc. | Hyper Temporal Lidar with Controllable Detection Intervals Based on Range Estimates |

| US11486983B1 (en) * | 2021-04-15 | 2022-11-01 | Aeva, Inc. | Techniques for detection processing with amplitude modulation (AM) and frequency modulation (FM) paths for simultaneous determination of range and velocity |

| US11555895B2 (en) | 2021-04-20 | 2023-01-17 | Innovusion, Inc. | Dynamic compensation to polygon and motor tolerance using galvo control profile |

| US11614521B2 (en) | 2021-04-21 | 2023-03-28 | Innovusion, Inc. | LiDAR scanner with pivot prism and mirror |

| CN117178199A (zh) | 2021-04-22 | 2023-12-05 | 图达通智能美国有限公司 | 具有高分辨率和超宽视场的紧凑型光检测和测距设计 |

| EP4314885A1 (en) | 2021-05-12 | 2024-02-07 | Innovusion, Inc. | Systems and apparatuses for mitigating lidar noise, vibration, and harshness |

| IL283638B2 (en) * | 2021-05-18 | 2023-04-01 | Elbit Systems Ltd | A system and method for creating focused 3D maps |

| CN117413199A (zh) | 2021-05-21 | 2024-01-16 | 图达通智能美国有限公司 | 使用lidar扫描仪内部的检流计镜进行智能扫描的移动配置文件 |

| US20220392091A1 (en) * | 2021-06-02 | 2022-12-08 | Faro Technologies, Inc. | Automated update of geometrical digital representation |

| US11768294B2 (en) | 2021-07-09 | 2023-09-26 | Innovusion, Inc. | Compact lidar systems for vehicle contour fitting |

| CN113885590B (zh) * | 2021-10-11 | 2023-06-23 | 电子科技大学 | 一种基于fpga的高速可扩展光学相控阵控制系统 |

| WO2023141183A2 (en) * | 2022-01-21 | 2023-07-27 | Aeye, Inc. | Systems and methods for high precision direct time-of-flight lidar in the presence of strong pile-up |

| US11871130B2 (en) | 2022-03-25 | 2024-01-09 | Innovusion, Inc. | Compact perception device |

| FR3135790A1 (fr) | 2022-05-17 | 2023-11-24 | Commissariat A L'energie Atomique Et Aux Energies Alternatives | Procede et systeme de perception de corps materiels a balayage optimise |

| CN115150547A (zh) * | 2022-06-02 | 2022-10-04 | 合肥鼎原科技有限公司 | 一种飞行监视装置及其监视方法 |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20080029701A1 (en) | 2006-07-25 | 2008-02-07 | Matsushita Electric Industrial Co. Ltd. | Night-vision imaging apparatus, control method of the same, and headlight module |

| WO2016025908A2 (en) | 2014-08-15 | 2016-02-18 | US LADAR, Inc. | Methods and systems for ladar transmission |

| JP2016169001A (ja) | 2015-03-11 | 2016-09-23 | 株式会社リコー | 撮像システム、画像処理システム、移動体制御システム、移動体装置、投光装置、物体検出方法、物体検出プログラム |

| WO2017034689A1 (en) | 2015-08-24 | 2017-03-02 | Qualcomm Incorporated | System and method for laser depth map sampling |

Family Cites Families (163)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6926227B1 (en) | 1977-04-27 | 2005-08-09 | Bae Systems Information And Electronics Systems Integration Inc. | Extended range, light weight laser target designator |

| DE3245939C2 (de) | 1982-12-11 | 1985-12-19 | Fa. Carl Zeiss, 7920 Heidenheim | Vorrichtung zur Erzeugung eines Bildes des Augenhintergrundes |

| US5625644A (en) | 1991-12-20 | 1997-04-29 | Myers; David J. | DC balanced 4B/8B binary block code for digital data communications |

| JP3042278B2 (ja) | 1993-09-17 | 2000-05-15 | 三菱電機株式会社 | 距離測定装置 |

| IL110611A (en) | 1994-08-09 | 1997-01-10 | Israel State | Apparatus and method for laser imaging |

| US5557444A (en) | 1994-10-26 | 1996-09-17 | University Of Washington | Miniature optical scanner for a two axis scanning system |

| US5596600A (en) | 1995-04-06 | 1997-01-21 | Mayflower Communications Company, Inc. | Standalone canceller of narrow band interference for spread spectrum receivers |

| JPH09243943A (ja) | 1996-03-13 | 1997-09-19 | Minolta Co Ltd | レーザビーム走査光学装置 |

| US5831719A (en) | 1996-04-12 | 1998-11-03 | Holometrics, Inc. | Laser scanning system |

| US5988862A (en) | 1996-04-24 | 1999-11-23 | Cyra Technologies, Inc. | Integrated system for quickly and accurately imaging and modeling three dimensional objects |

| US5815250A (en) | 1997-05-27 | 1998-09-29 | Coherent Technologies, Inc. | Doublet pulse coherent laser radar for precision range and velocity measurements |

| JPH11153664A (ja) | 1997-09-30 | 1999-06-08 | Sumitomo Electric Ind Ltd | 繰り返しパルス光を利用した物体検知装置 |

| US6205275B1 (en) | 1998-06-22 | 2001-03-20 | Brian E. Melville | Fiber optic image transfer assembly and method of using |

| US6031601A (en) | 1998-07-08 | 2000-02-29 | Trimble Navigation Limited | Code-space optical electronic distance meter |

| US6245590B1 (en) | 1999-08-05 | 2001-06-12 | Microvision Inc. | Frequency tunable resonant scanner and method of making |

| AU2000267433A1 (en) | 2000-05-16 | 2001-11-26 | Nortel Networks Limited | Cellular communications system receivers |

| DE10104022A1 (de) | 2001-01-31 | 2002-08-01 | Bosch Gmbh Robert | Radareinrichtung und Verfahren zum Codieren einer Radareinrichtung |

| AU2002339874A1 (en) | 2001-05-23 | 2002-12-03 | Canesta, Inc. | Enhanced dynamic range conversion in 3-d imaging |

| US6683539B2 (en) | 2001-12-27 | 2004-01-27 | Koninklijke Philips Electronics N.V. | Computer vision based parking assistant |

| FR2835120B1 (fr) | 2002-01-21 | 2006-10-20 | Evolium Sas | Procede et dispositif de preparation de signaux destines a etre compares pour etablir une pre-distorsion sur l'entree d'un amplificateur |

| GB0223512D0 (en) | 2002-10-10 | 2002-11-13 | Qinetiq Ltd | Bistatic laser radar apparatus |

| CN1273841C (zh) | 2002-12-24 | 2006-09-06 | 中国科学院上海技术物理研究所 | 自适应变速扫描激光成像装置 |

| US6870815B2 (en) | 2003-01-30 | 2005-03-22 | Atheros Communications, Inc. | Methods for implementing a dynamic frequency selection (DFS) and a temporary channel selection feature for WLAN devices |

| US7436494B1 (en) | 2003-03-28 | 2008-10-14 | Irvine Sensors Corp. | Three-dimensional ladar module with alignment reference insert circuitry |

| US6704619B1 (en) | 2003-05-24 | 2004-03-09 | American Gnc Corporation | Method and system for universal guidance and control of automated machines |

| US7474332B2 (en) | 2003-08-28 | 2009-01-06 | Raytheon Company | Synthetic aperture ladar system and method using real-time holography |

| US7064810B2 (en) | 2003-09-15 | 2006-06-20 | Deere & Company | Optical range finder with directed attention |

| US7643966B2 (en) | 2004-03-10 | 2010-01-05 | Leica Geosystems Ag | Identification of 3D surface points using context-based hypothesis testing |

| ITRM20040249A1 (it) | 2004-05-17 | 2004-08-17 | Univ Roma | Sistema di sorveglianza ad alta precisione mediante multilaterazione dei segnali ssr. |

| KR20050117047A (ko) | 2004-06-09 | 2005-12-14 | 삼성전자주식회사 | 주사각 확장 광학 시스템 및 이를 구비한 레이저 스캐닝장치 |

| US7236235B2 (en) | 2004-07-06 | 2007-06-26 | Dimsdale Engineering, Llc | System and method for determining range in 3D imaging systems |

| US7038608B1 (en) | 2004-12-16 | 2006-05-02 | Valeo Raytheon Systems, Inc. | Digital to analog converter |

| WO2006076474A1 (en) | 2005-01-13 | 2006-07-20 | Arete Associates | Optical system with wavefront sensor |

| US7375804B2 (en) | 2005-03-01 | 2008-05-20 | Lockheed Martin Corporation | Single detector receiver for multi-beam LADAR systems |

| US7532311B2 (en) | 2005-04-06 | 2009-05-12 | Lockheed Martin Coherent Technologies, Inc. | Efficient lidar with flexible target interrogation pattern |

| EP1712888A1 (en) | 2005-04-11 | 2006-10-18 | Agilent Technologies Inc | Time-of-flight measurement using pulse sequences |

| JP2006308482A (ja) * | 2005-04-28 | 2006-11-09 | Sanyo Electric Co Ltd | 検出装置 |

| US7417717B2 (en) | 2005-10-05 | 2008-08-26 | Utah State University | System and method for improving lidar data fidelity using pixel-aligned lidar/electro-optic data |

| US20090242468A1 (en) | 2005-10-17 | 2009-10-01 | Tim Corben | System for Controlling the Concentration of a Detrimental Substance in a Sewer Network |

| US7397019B1 (en) | 2005-10-19 | 2008-07-08 | Alliant Techsystems, Inc. | Light sensor module, focused light sensor array, and an air vehicle so equipped |

| US7944548B2 (en) | 2006-03-07 | 2011-05-17 | Leica Geosystems Ag | Increasing measurement rate in time of flight measurement apparatuses |

| US8958057B2 (en) | 2006-06-27 | 2015-02-17 | Arete Associates | Camera-style lidar setup |

| US7969558B2 (en) | 2006-07-13 | 2011-06-28 | Velodyne Acoustics Inc. | High definition lidar system |

| EP1901093B1 (de) | 2006-09-15 | 2018-11-14 | Triple-IN Holding AG | Aufnahme von Entfernungsbildern |

| US7701558B2 (en) | 2006-09-22 | 2010-04-20 | Leica Geosystems Ag | LIDAR system |

| US8884763B2 (en) | 2006-10-02 | 2014-11-11 | iRobert Corporation | Threat detection sensor suite |

| EP2078212A4 (en) | 2006-10-30 | 2010-12-29 | Autonosys Inc | SCANNING SYSTEM FOR LIDAR |

| US7961906B2 (en) * | 2007-01-03 | 2011-06-14 | Science Applications International Corporation | Human detection with imaging sensors |

| IL185355A (en) | 2007-08-19 | 2012-05-31 | Sason Sourani | Optical device for projection of light beams |

| US7746450B2 (en) | 2007-08-28 | 2010-06-29 | Science Applications International Corporation | Full-field light detection and ranging imaging system |

| JP2009130380A (ja) | 2007-11-19 | 2009-06-11 | Ricoh Co Ltd | 画像読み取り装置及び画像形成装置 |

| US8774950B2 (en) * | 2008-01-22 | 2014-07-08 | Carnegie Mellon University | Apparatuses, systems, and methods for apparatus operation and remote sensing |

| US7894044B1 (en) | 2008-03-11 | 2011-02-22 | Oceanit Laboratories, Inc. | Laser for coherent LIDAR |

| US20090292468A1 (en) | 2008-03-25 | 2009-11-26 | Shunguang Wu | Collision avoidance method and system using stereo vision and radar sensor fusion |

| US9041915B2 (en) * | 2008-05-09 | 2015-05-26 | Ball Aerospace & Technologies Corp. | Systems and methods of scene and action capture using imaging system incorporating 3D LIDAR |

| US20090318815A1 (en) * | 2008-05-23 | 2009-12-24 | Michael Barnes | Systems and methods for hyperspectral medical imaging |

| US7982861B2 (en) | 2008-07-31 | 2011-07-19 | The United States Of America As Represented By The Administrator Of The National Aeronautics And Space Administration | Time delay and distance measurement |

| US7924441B1 (en) | 2008-08-08 | 2011-04-12 | Mirrorcle Technologies, Inc. | Fast and high-precision 3D tracking and position measurement with MEMS micromirrors |

| US20100204964A1 (en) * | 2009-02-09 | 2010-08-12 | Utah State University | Lidar-assisted multi-image matching for 3-d model and sensor pose refinement |

| US8120754B2 (en) | 2009-02-19 | 2012-02-21 | Northrop Grumman Systems Corporation | Light detection and ranging apparatus |

| US8081301B2 (en) | 2009-10-08 | 2011-12-20 | The United States Of America As Represented By The Secretary Of The Army | LADAR transmitting and receiving system and method |

| ES2387484B1 (es) | 2009-10-15 | 2013-08-02 | Alfa Imaging S.A. | Sistema de multiespectral de barrido. |

| US8635091B2 (en) * | 2009-12-17 | 2014-01-21 | Hartford Fire Insurance Company | Systems and methods for linking vehicles to telematics-enabled portable devices |

| US20110149268A1 (en) | 2009-12-17 | 2011-06-23 | Marchant Alan B | Dynamic 3d wind mapping system and method |

| US9008998B2 (en) * | 2010-02-05 | 2015-04-14 | Trimble Navigation Limited | Systems and methods for processing mapping and modeling data |

| US20110260036A1 (en) | 2010-02-22 | 2011-10-27 | Baraniuk Richard G | Temporally- And Spatially-Resolved Single Photon Counting Using Compressive Sensing For Debug Of Integrated Circuits, Lidar And Other Applications |

| US8605262B2 (en) | 2010-06-23 | 2013-12-10 | The United States Of America As Represented By The Administrator Of The National Aeronautics And Space Administration | Time shifted PN codes for CW LiDAR, radar, and sonar |

| US8570406B2 (en) | 2010-08-11 | 2013-10-29 | Inview Technology Corporation | Low-pass filtering of compressive imaging measurements to infer light level variation |

| US8736818B2 (en) | 2010-08-16 | 2014-05-27 | Ball Aerospace & Technologies Corp. | Electronically steered flash LIDAR |

| US8648702B2 (en) | 2010-08-20 | 2014-02-11 | Denso International America, Inc. | Combined time-of-flight and image sensor systems |

| US20120236379A1 (en) | 2010-08-23 | 2012-09-20 | Lighttime, Llc | Ladar using mems scanning |

| CN102023082A (zh) | 2010-09-29 | 2011-04-20 | 中国科学院上海光学精密机械研究所 | 二维指向镜动态性能检测装置及检测方法 |

| WO2012051700A1 (en) | 2010-10-22 | 2012-04-26 | Neptec Design Group Ltd. | Wide angle bistatic scanning optical ranging sensor |

| EP2469301A1 (en) | 2010-12-23 | 2012-06-27 | André Borowski | Methods and devices for generating a representation of a 3D scene at very high speed |

| JP5532003B2 (ja) | 2011-03-31 | 2014-06-25 | 株式会社デンソーウェーブ | レーザレーダ装置 |

| AT511310B1 (de) | 2011-04-07 | 2013-05-15 | Riegl Laser Measurement Sys | Verfahren zur entfernungsmessung |

| US9645579B2 (en) * | 2011-07-06 | 2017-05-09 | Peloton Technology, Inc. | Vehicle platooning systems and methods |

| US9069061B1 (en) | 2011-07-19 | 2015-06-30 | Ball Aerospace & Technologies Corp. | LIDAR with analog memory |

| US10027952B2 (en) | 2011-08-04 | 2018-07-17 | Trx Systems, Inc. | Mapping and tracking system with features in three-dimensional space |

| JP5985661B2 (ja) * | 2012-02-15 | 2016-09-06 | アップル インコーポレイテッド | 走査深度エンジン |

| US20130268862A1 (en) * | 2012-03-07 | 2013-10-10 | Willow Garage Inc. | Point cloud data hierarchy |

| US9335220B2 (en) | 2012-03-22 | 2016-05-10 | Apple Inc. | Calibration of time-of-flight measurement using stray reflections |

| US9315178B1 (en) | 2012-04-13 | 2016-04-19 | Google Inc. | Model checking for autonomous vehicles |

| US9176240B2 (en) | 2012-07-18 | 2015-11-03 | Kabushiki Kaisha Toshiba | Apparatus and method for channel count reduction in solid-state-based positron emission tomography |

| CN102849086B (zh) * | 2012-09-15 | 2015-07-29 | 梁衍庆 | 列车激光安全导行方法 |

| US9383753B1 (en) | 2012-09-26 | 2016-07-05 | Google Inc. | Wide-view LIDAR with areas of special attention |

| CN103033806A (zh) | 2012-12-27 | 2013-04-10 | 山东理工大学 | 一种用于机载激光扫描飞行高度变化实时补偿的方法与装置 |

| US9285477B1 (en) | 2013-01-25 | 2016-03-15 | Apple Inc. | 3D depth point cloud from timing flight of 2D scanned light beam pulses |

| US20140211194A1 (en) | 2013-01-27 | 2014-07-31 | Quanergy Systems, Inc. | Cost-effective lidar sensor for multi-signal detection, weak signal detection and signal disambiguation and method of using same |

| US8908251B2 (en) | 2013-01-30 | 2014-12-09 | Hrl Laboratories, Llc | Tunable optical metamaterial |

| ES2512965B2 (es) | 2013-02-13 | 2015-11-24 | Universitat Politècnica De Catalunya | Sistema y método para escanear una superficie y programa de ordenador que implementa el método |

| US9128190B1 (en) | 2013-03-06 | 2015-09-08 | Google Inc. | Light steering device with an array of oscillating reflective slats |

| US9110169B2 (en) | 2013-03-08 | 2015-08-18 | Advanced Scientific Concepts, Inc. | LADAR enabled impact mitigation system |

| US9251587B2 (en) * | 2013-04-05 | 2016-02-02 | Caterpillar Inc. | Motion estimation utilizing range detection-enhanced visual odometry |

| US9085354B1 (en) | 2013-04-23 | 2015-07-21 | Google Inc. | Systems and methods for vertical takeoff and/or landing |

| US9069080B2 (en) | 2013-05-24 | 2015-06-30 | Advanced Scientific Concepts, Inc. | Automotive auxiliary ladar sensor |

| US20150006616A1 (en) * | 2013-06-28 | 2015-01-01 | Broadcom Corporation | Host Offloading Architecture |

| CN103324945B (zh) | 2013-07-08 | 2016-12-28 | 南京大学 | 一种基于模式识别的森林点云分类方法 |

| US9261881B1 (en) | 2013-08-01 | 2016-02-16 | Google Inc. | Filtering noisy/high-intensity regions in laser-based lane marker detection |

| US9280899B2 (en) * | 2013-08-06 | 2016-03-08 | GM Global Technology Operations LLC | Dynamic safety shields for situation assessment and decision making in collision avoidance tasks |

| US9435653B2 (en) | 2013-09-17 | 2016-09-06 | GM Global Technology Operations LLC | Sensor-aided vehicle positioning system |

| WO2015100483A1 (en) | 2014-01-06 | 2015-07-09 | Geodigital International Inc. | Determining portions of a roadway model requiring updating |

| US9305219B2 (en) | 2014-01-23 | 2016-04-05 | Mitsubishi Electric Research Laboratories, Inc. | Method for estimating free space using a camera system |

| US9626566B2 (en) * | 2014-03-19 | 2017-04-18 | Neurala, Inc. | Methods and apparatus for autonomous robotic control |

| CN103885065B (zh) | 2014-03-21 | 2016-04-13 | 中国科学院上海光学精密机械研究所 | 双波长双脉冲的无模糊激光测距装置 |

| DE112015001704T5 (de) | 2014-04-07 | 2016-12-29 | Samsung Electronics Co., Ltd. | Bildsensor mit hoher Auflösung, Frame-Rate und niedrigem Stromverbrauch |

| US9360554B2 (en) | 2014-04-11 | 2016-06-07 | Facet Technology Corp. | Methods and apparatus for object detection and identification in a multiple detector lidar array |

| FR3020616B1 (fr) * | 2014-04-30 | 2017-10-27 | Renault Sas | Dispositif de signalisation d'objets a un module de navigation de vehicule equipe de ce dispositif |

| US20150334371A1 (en) | 2014-05-19 | 2015-11-19 | Rockwell Automation Technologies, Inc. | Optical safety monitoring with selective pixel array analysis |

| FR3021938B1 (fr) | 2014-06-04 | 2016-05-27 | Commissariat Energie Atomique | Dispositif d'aide au parking et vehicule equipe d'un tel dispositif. |

| JP6459239B2 (ja) | 2014-06-20 | 2019-01-30 | 船井電機株式会社 | レーザレンジファインダ |

| CN106415309B (zh) | 2014-06-27 | 2019-07-30 | Hrl实验室有限责任公司 | 扫描激光雷达及其制造方法 |

| US9575341B2 (en) | 2014-06-28 | 2017-02-21 | Intel Corporation | Solid state LIDAR circuit with waveguides tunable to separate phase offsets |

| US10068373B2 (en) | 2014-07-01 | 2018-09-04 | Samsung Electronics Co., Ltd. | Electronic device for providing map information |

| US9575184B2 (en) | 2014-07-03 | 2017-02-21 | Continental Advanced Lidar Solutions Us, Inc. | LADAR sensor for a dense environment |

| WO2016025502A1 (en) | 2014-08-11 | 2016-02-18 | Gerard Dirk Smits | Three-dimensional triangulation and time-of-flight based tracking systems and methods |

| US9278689B1 (en) | 2014-11-13 | 2016-03-08 | Toyota Motor Engineering & Manufacturing North America, Inc. | Autonomous vehicle detection of and response to emergency vehicles |

| US9638801B2 (en) | 2014-11-24 | 2017-05-02 | Mitsubishi Electric Research Laboratories, Inc | Depth sensing using optical pulses and fixed coded aperature |

| US9336455B1 (en) | 2014-12-22 | 2016-05-10 | Accusoft Corporation | Methods and apparatus for locating lines in images and using located lines to make image adjustments |

| US9581967B1 (en) | 2015-01-07 | 2017-02-28 | Lockheed Martin Coherent Technologies, Inc. | Motion compensated multi-wavelength digital holography |

| US10274600B2 (en) | 2015-03-27 | 2019-04-30 | Sensors Unlimited, Inc. | Laser designator pulse detection |

| US9698182B2 (en) | 2015-03-30 | 2017-07-04 | Hamilton Sundstrand Corporation | Digital imaging and pulse detection array |

| EP3298325A1 (en) | 2015-05-18 | 2018-03-28 | Lumileds Holding B.V. | Lighting system |

| US10289940B2 (en) | 2015-06-26 | 2019-05-14 | Here Global B.V. | Method and apparatus for providing classification of quality characteristics of images |

| CN106489062B (zh) * | 2015-06-26 | 2019-06-28 | 深圳市大疆创新科技有限公司 | 用于测量移动平台的位移的系统和方法 |

| US10527726B2 (en) | 2015-07-02 | 2020-01-07 | Texas Instruments Incorporated | Methods and apparatus for LIDAR with DMD |

| WO2017079483A1 (en) | 2015-11-05 | 2017-05-11 | Luminar Technologies, Inc. | Lidar system with improved scanning speed for high-resolution depth mapping |

| US10520602B2 (en) | 2015-11-30 | 2019-12-31 | Luminar Technologies, Inc. | Pulsed laser for lidar system |

| EP3196593B1 (en) | 2016-01-21 | 2018-01-17 | Safran Vectronix AG | Stabilized observation with lrf function |

| US10627490B2 (en) | 2016-01-31 | 2020-04-21 | Velodyne Lidar, Inc. | Multiple pulse, LIDAR based 3-D imaging |

| EP3206045B1 (en) | 2016-02-15 | 2021-03-31 | Airborne Hydrography AB | Single-photon lidar scanner |

| WO2017143217A1 (en) | 2016-02-18 | 2017-08-24 | Aeye, Inc. | Adaptive ladar receiver |

| US9933513B2 (en) | 2016-02-18 | 2018-04-03 | Aeye, Inc. | Method and apparatus for an adaptive ladar receiver |

| US10761196B2 (en) | 2016-02-18 | 2020-09-01 | Aeye, Inc. | Adaptive ladar receiving method |

| US10042159B2 (en) | 2016-02-18 | 2018-08-07 | Aeye, Inc. | Ladar transmitter with optical field splitter/inverter |

| WO2017143183A1 (en) | 2016-02-18 | 2017-08-24 | Aeye, Inc. | Ladar transmitter with improved gaze on scan area portions |

| US10908262B2 (en) | 2016-02-18 | 2021-02-02 | Aeye, Inc. | Ladar transmitter with optical field splitter/inverter for improved gaze on scan area portions |

| WO2017164989A1 (en) | 2016-03-19 | 2017-09-28 | Velodyne Lidar, Inc. | Integrated illumination and detection for lidar based 3-d imaging |

| WO2017165319A1 (en) * | 2016-03-21 | 2017-09-28 | Velodyne Lidar, Inc. | Lidar based 3-d imaging with varying illumination intensity |

| EP3433634B8 (en) * | 2016-03-21 | 2021-07-21 | Velodyne Lidar USA, Inc. | Lidar based 3-d imaging with varying illumination field density |

| WO2017165316A1 (en) | 2016-03-21 | 2017-09-28 | Velodyne Lidar, Inc. | Lidar based 3-d imaging with varying pulse repetition |

| CN205417356U (zh) * | 2016-03-22 | 2016-08-03 | 盐城工业职业技术学院 | 基于视觉的智能驾驶辅助系统 |

| CN105867373B (zh) * | 2016-04-07 | 2018-09-11 | 重庆大学 | 一种基于激光雷达数据的移动机器人位姿推算方法及系统 |

| US10473784B2 (en) * | 2016-05-24 | 2019-11-12 | Veoneer Us, Inc. | Direct detection LiDAR system and method with step frequency modulation (FM) pulse-burst envelope modulation transmission and quadrature demodulation |

| CN105881539B (zh) * | 2016-06-12 | 2018-04-27 | 江苏若博机器人科技有限公司 | 一种两核八轴无线传输履带式天然气管道机器人控制系统 |

| US10859700B2 (en) | 2016-07-21 | 2020-12-08 | Z-Senz Llc | Systems, devices, and/or methods for encoded time of flight light detection and ranging |

| JP6940612B2 (ja) | 2016-09-14 | 2021-09-29 | ナウト, インコーポレイテッドNauto, Inc. | ニアクラッシュ判定システムおよび方法 |

| CN111796255A (zh) * | 2016-09-20 | 2020-10-20 | 创新科技有限公司 | 激光雷达系统和使用其检测物体的方法及车辆 |

| EP3532863A4 (en) | 2016-10-31 | 2020-06-03 | Gerard Dirk Smits | FAST SCAN LIDAR WITH DYNAMIC VOXEL PROBE |

| EP3542184A1 (en) | 2016-11-16 | 2019-09-25 | Innoviz Technologies Ltd. | Lidar systems and methods |

| CN106772407A (zh) * | 2016-12-02 | 2017-05-31 | 深圳市镭神智能系统有限公司 | 基于mems微镜扫描的激光雷达系统 |

| US10942257B2 (en) * | 2016-12-31 | 2021-03-09 | Innovusion Ireland Limited | 2D scanning high precision LiDAR using combination of rotating concave mirror and beam steering devices |

| CN106647768A (zh) * | 2017-01-18 | 2017-05-10 | 成都黑盒子电子技术有限公司 | 服务型机器人自主运动避障方法 |

| US10185028B2 (en) | 2017-02-17 | 2019-01-22 | Aeye, Inc. | Method and system for ladar pulse deconfliction using delay code selection |

| US10007001B1 (en) | 2017-03-28 | 2018-06-26 | Luminar Technologies, Inc. | Active short-wave infrared four-dimensional camera |

| US10209359B2 (en) | 2017-03-28 | 2019-02-19 | Luminar Technologies, Inc. | Adaptive pulse rate in a lidar system |

| US10545240B2 (en) | 2017-03-28 | 2020-01-28 | Luminar Technologies, Inc. | LIDAR transmitter and detector system using pulse encoding to reduce range ambiguity |

| US20180284234A1 (en) | 2017-03-29 | 2018-10-04 | Luminar Technologies, Inc. | Foveated Imaging in a Lidar System |

| US10677897B2 (en) | 2017-04-14 | 2020-06-09 | Luminar Technologies, Inc. | Combining lidar and camera data |

| US20180306927A1 (en) | 2017-04-21 | 2018-10-25 | GM Global Technology Operations LLC | Method and apparatus for pulse repetition sequence with high processing gain |

| WO2019010425A1 (en) | 2017-07-07 | 2019-01-10 | Aeye, Inc. | LADAR TRANSMITTER WITH REIMAGER |

| CN111344647A (zh) | 2017-09-15 | 2020-06-26 | 艾耶股份有限公司 | 具有低延时运动规划更新的智能激光雷达系统 |

| JP2019052981A (ja) | 2017-09-15 | 2019-04-04 | 株式会社東芝 | 距離計測装置 |

-

2018

- 2018-08-21 CN CN201880069950.6A patent/CN111344647A/zh active Pending

- 2018-08-21 US US16/106,350 patent/US10495757B2/en active Active

- 2018-08-21 WO PCT/US2018/047199 patent/WO2019216937A2/en unknown

- 2018-08-21 CA CA3075736A patent/CA3075736A1/en active Pending

- 2018-08-21 US US16/106,374 patent/US10663596B2/en active Active

- 2018-08-21 EP EP18918225.6A patent/EP3682308B1/en active Active

- 2018-08-21 JP JP2020515068A patent/JP7197571B2/ja active Active

- 2018-08-21 US US16/106,406 patent/US10641900B2/en active Active

- 2018-08-21 US US16/106,441 patent/US11002857B2/en active Active

-

2021

- 2021-05-10 US US17/315,563 patent/US11821988B2/en active Active

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20080029701A1 (en) | 2006-07-25 | 2008-02-07 | Matsushita Electric Industrial Co. Ltd. | Night-vision imaging apparatus, control method of the same, and headlight module |

| WO2016025908A2 (en) | 2014-08-15 | 2016-02-18 | US LADAR, Inc. | Methods and systems for ladar transmission |

| JP2016169001A (ja) | 2015-03-11 | 2016-09-23 | 株式会社リコー | 撮像システム、画像処理システム、移動体制御システム、移動体装置、投光装置、物体検出方法、物体検出プログラム |

| WO2017034689A1 (en) | 2015-08-24 | 2017-03-02 | Qualcomm Incorporated | System and method for laser depth map sampling |

Also Published As

| Publication number | Publication date |

|---|---|

| US20190086550A1 (en) | 2019-03-21 |

| US10495757B2 (en) | 2019-12-03 |

| US10663596B2 (en) | 2020-05-26 |

| US20200025886A1 (en) | 2020-01-23 |

| EP3682308A2 (en) | 2020-07-22 |

| US20200025887A1 (en) | 2020-01-23 |

| CN111344647A (zh) | 2020-06-26 |

| JP2020534518A (ja) | 2020-11-26 |

| US10641900B2 (en) | 2020-05-05 |

| WO2019216937A9 (en) | 2020-01-02 |

| US20190086514A1 (en) | 2019-03-21 |

| EP3682308B1 (en) | 2024-04-10 |

| US11002857B2 (en) | 2021-05-11 |

| WO2019216937A3 (en) | 2020-02-06 |

| US20220075067A1 (en) | 2022-03-10 |

| EP3682308A4 (en) | 2021-07-14 |

| CA3075736A1 (en) | 2019-11-14 |

| WO2019216937A2 (en) | 2019-11-14 |

| US11821988B2 (en) | 2023-11-21 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7197571B2 (ja) | 低レイテンシ動作計画更新を有するインテリジェントladarシステム | |

| Roriz et al. | Automotive LiDAR technology: A survey | |

| US11226413B2 (en) | Apparatus for acquiring 3-dimensional maps of a scene | |

| US11487288B2 (en) | Data synthesis for autonomous control systems | |

| US11609329B2 (en) | Camera-gated lidar system | |

| US10345447B1 (en) | Dynamic vision sensor to direct lidar scanning | |

| US20200217950A1 (en) | Resolution of elevation ambiguity in one-dimensional radar processing | |

| JP4405155B2 (ja) | 画像解析システム | |

| CN109387857B (zh) | 激光雷达系统中的跨网段检测方法和设备 | |

| Cao et al. | You Can't See Me: Physical Removal Attacks on {LiDAR-based} Autonomous Vehicles Driving Frameworks | |

| US20220390612A1 (en) | Determination of atmospheric visibility in autonomous vehicle applications | |

| Zhou | A review of LiDAR sensor technologies for perception in automated driving | |

| Rana et al. | Comparative study of Automotive Sensor technologies used for Unmanned Driving | |

| CN211032395U (zh) | 自动驾驶车辆 | |

| WO2023044688A1 (zh) | 信号处理方法、信号传输方法及装置 | |

| US20230161014A1 (en) | Methods and systems for reducing lidar memory load | |

| Nisula | Obstacle Detection in Railway Environment: Filtering the output of an on-board detection system using railway maps | |

| WO2023091399A2 (en) | Lidar system with scene dependent focus intensity |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20210816 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20210816 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20220523 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20220525 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20220822 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20221206 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20221215 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7197571 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |