JP3934151B2 - 画像生成装置および画像生成方法 - Google Patents

画像生成装置および画像生成方法 Download PDFInfo

- Publication number

- JP3934151B2 JP3934151B2 JP2006526470A JP2006526470A JP3934151B2 JP 3934151 B2 JP3934151 B2 JP 3934151B2 JP 2006526470 A JP2006526470 A JP 2006526470A JP 2006526470 A JP2006526470 A JP 2006526470A JP 3934151 B2 JP3934151 B2 JP 3934151B2

- Authority

- JP

- Japan

- Prior art keywords

- image

- moving image

- resolution

- speed

- frame

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

- 238000000034 method Methods 0.000 title claims description 56

- 230000033001 locomotion Effects 0.000 claims description 238

- 238000001514 detection method Methods 0.000 claims description 133

- 230000010354 integration Effects 0.000 claims description 39

- 238000003384 imaging method Methods 0.000 claims description 27

- 230000008859 change Effects 0.000 claims description 20

- 230000002123 temporal effect Effects 0.000 claims description 8

- 239000000284 extract Substances 0.000 claims description 3

- 238000012545 processing Methods 0.000 description 45

- 238000010586 diagram Methods 0.000 description 42

- 238000004364 calculation method Methods 0.000 description 19

- 230000014509 gene expression Effects 0.000 description 18

- 230000006835 compression Effects 0.000 description 14

- 238000007906 compression Methods 0.000 description 14

- 230000008569 process Effects 0.000 description 13

- 230000000694 effects Effects 0.000 description 10

- 230000001133 acceleration Effects 0.000 description 7

- 239000013598 vector Substances 0.000 description 7

- 210000005155 neural progenitor cell Anatomy 0.000 description 5

- 238000006731 degradation reaction Methods 0.000 description 4

- 230000006870 function Effects 0.000 description 4

- 230000015556 catabolic process Effects 0.000 description 3

- 238000012937 correction Methods 0.000 description 3

- 238000011156 evaluation Methods 0.000 description 3

- 101100405018 Arabidopsis thaliana NPC3 gene Proteins 0.000 description 2

- 238000013459 approach Methods 0.000 description 2

- 238000013528 artificial neural network Methods 0.000 description 2

- 238000007796 conventional method Methods 0.000 description 2

- 230000007423 decrease Effects 0.000 description 2

- 238000003708 edge detection Methods 0.000 description 2

- 238000005259 measurement Methods 0.000 description 2

- 230000003287 optical effect Effects 0.000 description 2

- 230000000750 progressive effect Effects 0.000 description 2

- 230000035945 sensitivity Effects 0.000 description 2

- PXFBZOLANLWPMH-UHFFFAOYSA-N 16-Epiaffinine Natural products C1C(C2=CC=CC=C2N2)=C2C(=O)CC2C(=CC)CN(C)C1C2CO PXFBZOLANLWPMH-UHFFFAOYSA-N 0.000 description 1

- 238000012935 Averaging Methods 0.000 description 1

- 241001648319 Toronia toru Species 0.000 description 1

- 230000008901 benefit Effects 0.000 description 1

- 238000004891 communication Methods 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 238000007429 general method Methods 0.000 description 1

- 238000009499 grossing Methods 0.000 description 1

- 238000005286 illumination Methods 0.000 description 1

- 230000006872 improvement Effects 0.000 description 1

- 239000011159 matrix material Substances 0.000 description 1

- 239000000203 mixture Substances 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000008447 perception Effects 0.000 description 1

- 238000012805 post-processing Methods 0.000 description 1

- 238000000513 principal component analysis Methods 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 230000011218 segmentation Effects 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

- 230000009012 visual motion Effects 0.000 description 1

Images

Classifications

-

- G06T3/16—

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/95—Computational photography systems, e.g. light-field imaging systems

- H04N23/951—Computational photography systems, e.g. light-field imaging systems by using two or more images to influence resolution, frame rate or aspect ratio

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/20—Analysis of motion

- G06T7/246—Analysis of motion using feature-based methods, e.g. the tracking of corners or segments

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/45—Cameras or camera modules comprising electronic image sensors; Control thereof for generating image signals from two or more image sensors being of different type or operating in different modes, e.g. with a CMOS sensor for moving images in combination with a charge-coupled device [CCD] for still images

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/90—Arrangement of cameras or camera modules, e.g. multiple cameras in TV studios or sports stadiums

Description

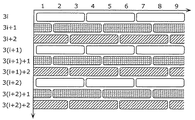

本発明の第1の実施形態は、同一事象を撮影して得られた複数の動画像から、前記事象を表す新たな動画像を生成する画像生成装置であって、第1動画像と、前記第1動画像と同一の事象を撮影し、解像度が前記第1動画像の解像度よりも高く、かつ各々のフレームが前記第1動画像の1フレーム時間よりも長時間の露光によって得られる第2動画像とを受け付ける画像入力手段と、前記第1動画像と前記第2動画像とから、前記第1動画像のフレームレート以上のフレームレートでかつ前記第2動画像の解像度以上の解像度の新たな動画像を、前記第2動画像のフレームと、そのフレームの露光期間に対応する前記新たな動画像の複数のフレームの合計との誤差を減少させることによって生成する画像統合手段とを備える。

度動画像HLとの差(対応する画素値との差の2乗和)を表す拘束で、第2項目は高速高解像度動画像から数2の関係式を使って作り出した低速高解像度動画像LH'と、低速画

像入力部101bに実際に入力される低速高解像度動画像LHとの差(対応する画素値との差の2乗和)を表す拘束である。第1項目の拘束と第2項目の拘束は、生成した画像と撮影した画像との輝度値の関係が、上記数1と数2の関係をできるだけ満たすようにするものであり、撮影画像と生成画像との間で輝度値の矛盾を生じにくくする条件である。

本発明の第2の実施形態は、前述した画像生成装置を時空間位相が異なる複数の動画像に適用する一例であって、前記画像入力手段は、時空間位相が異なる複数の動画像として、原動画像の本来のフレーム画像の複数の部分をそれぞれ異なる時刻について表す複数種類のフィールド画像のうち、一種類のフィールド画像を複数のフレームについて連ねてなる異なる複数の動画像を受け付け、前記画像統合手段は、前記原動画像のフィールドレートと同等のフレームレートを有し、かつ前記本来のフレーム画像と同等の解像度を有するフレーム画像から構成される新たな動画像を生成する。

20 画像記憶装置

30 画像生成装置

40 表示装置

100 画像生成システム

101 画像入力部

101a 高速画像入力部

101b 低速画像入力部

101c マルチインターレース画像入力部

102 符号化部

103 動き検出部

103a 動き分布算出部

103b 動き信頼度分布算出部

103c センサ入力部

104 画像統合部

104a 統合処理部

104b 拘束制御部

104c 動き拘束指定部

104d 外部モデル拘束部

104e 拘束指定部

300 カメラ

400 ディスプレイ機器

Claims (12)

- 同一事象を撮影して得られた複数の動画像から、前記事象を表す新たな動画像を生成する画像生成装置であって、

第1動画像と、前記第1動画像と同一の事象を撮影し、解像度が前記第1動画像の解像度よりも高く、かつ各々のフレームが前記第1動画像の1フレーム時間よりも長時間の露光によって得られる第2動画像とを受け付ける画像入力手段と、

前記第1動画像と前記第2動画像とから、前記第1動画像のフレームレート以上のフレームレートでかつ前記第2動画像の解像度以上の解像度の新たな動画像を、前記第2動画像のフレームと、そのフレームの露光期間に対応する前記新たな動画像の複数のフレームの合計との誤差を減少させることによって生成する画像統合手段と

を備えることを特徴とする画像生成装置。 - 前記第2動画像のフレームはフレーム間の開放露光により得られる

ことを特徴とする請求項1記載の画像生成装置。 - さらに、生成される新たな動画像の画素値が、時空間的に隣り合う画素の画素値の連続性から満たすべき拘束条件を指定する拘束手段を備え、

前記画像統合手段は、前記指定された前記拘束条件が維持されるように前記新たな動画像を生成する

ことを特徴とする請求項1記載の画像生成装置。 - さらに、前記画像入力手段が受け付けた複数の動画像の少なくとも1つから対象物の動きを検出する動き検出手段と、

生成される新たな動画像の画素値が、前記動き検出結果に基づいて満たすべき拘束条件を指定する拘束手段とを備え、

前記画像統合手段は、指定された前記拘束条件が維持されるように前記新たな動画像を生成する

ことを特徴とする請求項1記載の画像生成装置。 - 前記動き検出手段は、前記動き検出の信頼度を算出し、

前記画像統合手段は、前記動き検出手段によって算出された信頼度が高い画像領域については前記動き検出結果に基づく拘束条件を用いて新たな画像を生成し、前記信頼度が低い画像領域については動き拘束以外の予め定められた拘束条件を用いて前記新たな動画像を生成する

ことを特徴とする請求項4記載の画像生成装置。 - 前記動き検出手段は、前記動画像を構成する各画像を分割したブロック単位で動きを検出し、ブロック同士の画素値の差の2乗和の符号を逆にした値を前記信頼度として算出し、

前記画像統合手段は、前記信頼度が予め定めた値よりも大きいブロックを信頼度の高い画像領域とし、前記信頼度が予め定めた値よりも小さいブロックを信頼度の低い画像領域として、前記新たな動画像を生成する

ことを特徴とする請求項5記載の画像生成装置。 - 前記動き検出手段はさらに、対象物を撮像する撮像装置の姿勢を検出する姿勢センサからの信号を受け付ける姿勢センサ入力部を有し、前記姿勢センサ入力部が受け付けた信号を用いて前記動きを検出する

ことを特徴とする請求項4記載の画像生成装置。 - 前記画像統合手段は、前記第1動画像から色差情報を抽出し、前記第1動画像から取得された輝度情報と前記第2動画像とから中間的な新たな動画像を生成し、生成した中間的な動画像に前記色差情報を付加することによって、最終的な前記新たな動画像を生成する

ことを特徴とする請求項1記載の画像生成装置。 - 前記画像統合手段は、前記複数の動画像の少なくとも1つについて画像の時間的な変化量を算出し、算出した変化量が予め定めた値を超える時間を画像生成の区切りとして新たな動画像を生成する

ことを特徴とする請求項1記載の画像生成装置。 - 前記画像統合手段はさらに、生成した新たな動画像の信頼性を示す値を算出し、算出した値を前記新たな動画像とともに出力する

ことを特徴とする請求項1記載の画像生成装置。 - 複数の動画像から新たな動画像を生成する画像生成方法であって、

第1動画像と、解像度が前記第1動画像の解像度よりも高くかつ一つのフレームが前記第1動画像の複数のフレーム期間にわたる露出により得られる第2動画像とを受け付ける画像入力ステップと、

前記第1動画像のフレームレート以上のフレームレートでかつ前記第2動画像の解像度以上の解像度の新たな動画像を、前記第2動画像のフレームと、そのフレームの露出期間に対応する前記新たな動画像の複数のフレームの合計との誤差を減少させるように生成する画像統合ステップと

を含むことを特徴とする画像生成方法。 - 複数の動画像から新たな動画像を生成するためのプログラムであって、

請求項11記載の画像生成方法に含まれるステップをコンピュータに実行させる

ことを特徴とするプログラム。

Applications Claiming Priority (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2005182646 | 2005-06-22 | ||

| JP2005182646 | 2005-06-22 | ||

| JP2006019138 | 2006-01-27 | ||

| JP2006019138 | 2006-01-27 | ||

| PCT/JP2006/310976 WO2006137253A1 (ja) | 2005-06-22 | 2006-06-01 | 画像生成装置および画像生成方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP3934151B2 true JP3934151B2 (ja) | 2007-06-20 |

| JPWO2006137253A1 JPWO2006137253A1 (ja) | 2009-01-22 |

Family

ID=37570286

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2006526470A Expired - Fee Related JP3934151B2 (ja) | 2005-06-22 | 2006-06-01 | 画像生成装置および画像生成方法 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US7596177B2 (ja) |

| JP (1) | JP3934151B2 (ja) |

| WO (1) | WO2006137253A1 (ja) |

Cited By (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2009011082A1 (ja) * | 2007-07-17 | 2009-01-22 | Panasonic Corporation | 画像処理装置、画像処理方法、コンピュータプログラムおよび当該コンピュータプログラムを記録した記録媒体、フレーム間動き算出方法および画像処理方法 |

| WO2009019823A1 (ja) * | 2007-08-07 | 2009-02-12 | Panasonic Corporation | 撮像処理装置および撮像装置、画像処理方法およびコンピュータプログラム |

| WO2009019808A1 (ja) * | 2007-08-03 | 2009-02-12 | Panasonic Corporation | 画像データを生成する装置、方法およびプログラム |

| WO2009019824A1 (ja) * | 2007-08-07 | 2009-02-12 | Panasonic Corporation | 撮像処理装置および撮像装置、画像処理方法およびコンピュータプログラム |

| WO2009031287A1 (ja) * | 2007-09-07 | 2009-03-12 | Panasonic Corporation | 多色画像処理装置及び信号処理装置 |

| US7907183B2 (en) | 2006-10-30 | 2011-03-15 | Panasonic Corporation | Image generation apparatus and image generation method for generating a new video sequence from a plurality of video sequences |

| US8094717B2 (en) | 2006-10-19 | 2012-01-10 | Panasonic Corporation | Image generation apparatus and image generation method |

| WO2016151734A1 (ja) * | 2015-03-23 | 2016-09-29 | 日立マクセル株式会社 | 撮像装置、画像処理装置、およびデジタルカメラ |

Families Citing this family (88)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US7620203B1 (en) * | 2005-03-24 | 2009-11-17 | Itt Manufacturing Enterprises, Inc. | Imaging system analysis methods and apparatus |

| WO2007136745A2 (en) | 2006-05-19 | 2007-11-29 | University Of Hawaii | Motion tracking system for real time adaptive imaging and spectroscopy |

| US7978239B2 (en) * | 2007-03-01 | 2011-07-12 | Eastman Kodak Company | Digital camera using multiple image sensors to provide improved temporal sampling |

| JP4826546B2 (ja) | 2007-06-18 | 2011-11-30 | ソニー株式会社 | 画像処理装置、画像処理方法、及びプログラム |

| JP4877090B2 (ja) | 2007-06-18 | 2012-02-15 | ソニー株式会社 | 画像処理装置、画像処理方法、及びプログラム |

| DE102007049740A1 (de) * | 2007-10-16 | 2009-04-23 | Technische Universität Braunschweig Carolo-Wilhelmina | Verfahren zur Ermittlung von zweidimensionalen Bewegungsvektorfeldern in einer Bildsequenz und Bildverarbeitungseinrichtung hierzu |

| JP4551486B2 (ja) * | 2007-12-04 | 2010-09-29 | パナソニック株式会社 | 画像生成装置 |

| JP5144237B2 (ja) * | 2007-12-05 | 2013-02-13 | キヤノン株式会社 | 画像処理装置、その制御方法、プログラム |

| JP2009147730A (ja) * | 2007-12-14 | 2009-07-02 | Fujifilm Corp | 動画生成装置、動画撮影装置、動画生成方法及びプログラム |

| JP2009164859A (ja) * | 2008-01-04 | 2009-07-23 | Fujifilm Corp | 撮像装置及び撮像制御方法 |

| US8120659B2 (en) * | 2008-05-22 | 2012-02-21 | Aptina Imaging Corporation | Method and system for motion estimation in digital imaging applications |

| US8705896B2 (en) * | 2008-06-13 | 2014-04-22 | Hewlett-Packard Development Company, L.P. | Processing a super-resolution target image |

| JP2010028722A (ja) * | 2008-07-24 | 2010-02-04 | Sanyo Electric Co Ltd | 撮像装置及び画像処理装置 |

| US8130278B2 (en) * | 2008-08-01 | 2012-03-06 | Omnivision Technologies, Inc. | Method for forming an improved image using images with different resolutions |

| JP5347440B2 (ja) * | 2008-11-10 | 2013-11-20 | 日本電気株式会社 | 動画像処理装置 |

| GB2503833B (en) * | 2008-12-09 | 2014-04-30 | Snell Ltd | Motion image rendering system |

| CN102106150A (zh) * | 2009-02-05 | 2011-06-22 | 松下电器产业株式会社 | 摄像处理装置 |

| JP5149861B2 (ja) * | 2009-05-01 | 2013-02-20 | 富士フイルム株式会社 | 中間画像生成装置およびその動作制御方法 |

| US8837576B2 (en) * | 2009-11-06 | 2014-09-16 | Qualcomm Incorporated | Camera parameter-assisted video encoding |

| US10178406B2 (en) | 2009-11-06 | 2019-01-08 | Qualcomm Incorporated | Control of video encoding based on one or more video capture parameters |

| US20110292997A1 (en) * | 2009-11-06 | 2011-12-01 | Qualcomm Incorporated | Control of video encoding based on image capture parameters |

| EP2523459B1 (en) | 2010-01-07 | 2017-02-08 | Panasonic Intellectual Property Management Co., Ltd. | Image processing device, image generating system, method, and program |

| EP2590396B1 (en) * | 2010-07-02 | 2018-08-08 | Sony Interactive Entertainment Inc. | Information processing system and information processing method |

| US8374453B2 (en) | 2010-11-10 | 2013-02-12 | Raytheon Company | Integrating image frames |

| US8994837B2 (en) * | 2010-11-26 | 2015-03-31 | Intel Mobile Communications GmbH | Image processing devices and image processing methods of moving objects |

| KR101701852B1 (ko) * | 2010-12-29 | 2017-02-13 | 엘지전자 주식회사 | 이동단말기 및 그 제어방법 |

| US9606209B2 (en) | 2011-08-26 | 2017-03-28 | Kineticor, Inc. | Methods, systems, and devices for intra-scan motion correction |

| JP5773944B2 (ja) * | 2012-05-22 | 2015-09-02 | 株式会社ソニー・コンピュータエンタテインメント | 情報処理装置および情報処理方法 |

| US10150028B2 (en) | 2012-06-04 | 2018-12-11 | Sony Interactive Entertainment Inc. | Managing controller pairing in a multiplayer game |

| CN116405747A (zh) | 2012-11-28 | 2023-07-07 | 核心光电有限公司 | 多孔径成像系统以及通过多孔径成像系统获取图像的方法 |

| US9782141B2 (en) | 2013-02-01 | 2017-10-10 | Kineticor, Inc. | Motion tracking system for real time adaptive motion compensation in biomedical imaging |

| CN109040553B (zh) | 2013-06-13 | 2021-04-13 | 核心光电有限公司 | 双孔径变焦数字摄影机 |

| EP3779564B1 (en) | 2013-07-04 | 2024-04-10 | Corephotonics Ltd. | Miniature telephoto lens assembly |

| WO2015015383A2 (en) | 2013-08-01 | 2015-02-05 | Corephotonics Ltd. | Thin multi-aperture imaging system with auto-focus and methods for using same |

| EP3188660A4 (en) | 2014-07-23 | 2018-05-16 | Kineticor, Inc. | Systems, devices, and methods for tracking and compensating for patient motion during a medical imaging scan |

| US9392188B2 (en) | 2014-08-10 | 2016-07-12 | Corephotonics Ltd. | Zoom dual-aperture camera with folded lens |

| US9570106B2 (en) | 2014-12-02 | 2017-02-14 | Sony Corporation | Sensor configuration switching for adaptation of video capturing frame rate |

| US20160182866A1 (en) * | 2014-12-19 | 2016-06-23 | Sony Corporation | Selective high frame rate video capturing in imaging sensor subarea |

| CN112327463B (zh) | 2015-01-03 | 2022-10-14 | 核心光电有限公司 | 微型长焦镜头模块和使用该镜头模块的相机 |

| EP3492958B1 (en) | 2015-04-02 | 2022-03-30 | Corephotonics Ltd. | Dual voice coil motor structure in a dual-optical module camera |

| CN112305833A (zh) | 2015-04-16 | 2021-02-02 | 核心光电有限公司 | 紧凑型折叠式相机中的自动对焦和光学图像稳定 |

| EP3722860B1 (en) | 2015-05-28 | 2023-04-19 | Corephotonics Ltd. | Bi-directional stiffness for optical image stabilization and auto-focus in a digital camera |

| CN106331722B (zh) | 2015-07-03 | 2019-04-26 | 华为技术有限公司 | 图像预测方法和相关设备 |

| US9906715B2 (en) * | 2015-07-08 | 2018-02-27 | Htc Corporation | Electronic device and method for increasing a frame rate of a plurality of pictures photographed by an electronic device |

| US9943247B2 (en) * | 2015-07-28 | 2018-04-17 | The University Of Hawai'i | Systems, devices, and methods for detecting false movements for motion correction during a medical imaging scan |

| US10230898B2 (en) | 2015-08-13 | 2019-03-12 | Corephotonics Ltd. | Dual aperture zoom camera with video support and switching / non-switching dynamic control |

| JP6705134B2 (ja) * | 2015-08-21 | 2020-06-03 | コニカミノルタ株式会社 | 超音波画像診断装置、超音波画像処理方法及び超音波画像処理プログラム |

| US20170061586A1 (en) * | 2015-08-28 | 2017-03-02 | Nokia Technologies Oy | Method, apparatus and computer program product for motion deblurring of image frames |

| US10070060B2 (en) | 2015-09-06 | 2018-09-04 | Corephotonics Ltd | Auto focus and optical image stabilization with roll compensation in a compact folded camera |

| KR102291525B1 (ko) | 2015-12-29 | 2021-08-19 | 코어포토닉스 리미티드 | 자동 조정가능 텔레 시야(fov)를 갖는 듀얼-애퍼처 줌 디지털 카메라 |

| WO2017208090A1 (en) | 2016-05-30 | 2017-12-07 | Corephotonics Ltd. | Rotational ball-guided voice coil motor |

| CN107925728B (zh) | 2016-06-19 | 2020-12-08 | 核心光电有限公司 | 双孔径摄影机系统中的帧同步 |

| EP4224233A1 (en) | 2016-07-07 | 2023-08-09 | Corephotonics Ltd. | Linear ball guided voice coil motor for folded optic |

| WO2018007951A1 (en) | 2016-07-07 | 2018-01-11 | Corephotonics Ltd. | Dual-camera system with improved video smooth transition by image blending |

| CN114051092A (zh) | 2016-12-28 | 2022-02-15 | 核心光电有限公司 | 具有延伸光折叠元件扫描范围的致动器及含其的折叠相机 |

| EP3789810B1 (en) | 2017-01-12 | 2022-09-28 | Corephotonics Ltd. | Compact folded camera |

| EP3579040B1 (en) | 2017-02-23 | 2021-06-23 | Corephotonics Ltd. | Folded camera lens designs |

| CN114137791A (zh) | 2017-03-15 | 2022-03-04 | 核心光电有限公司 | 具有全景扫瞄范围的照相装置及移动装置 |

| WO2019048904A1 (en) | 2017-09-06 | 2019-03-14 | Corephotonics Ltd. | STEREOSCOPIC DEPTH CARTOGRAPHY AND COMBINED PHASE DETECTION IN A DOUBLE-OPENING CAMERA |

| US10951834B2 (en) | 2017-10-03 | 2021-03-16 | Corephotonics Ltd. | Synthetically enlarged camera aperture |

| US10572976B2 (en) * | 2017-10-18 | 2020-02-25 | International Business Machines Corporation | Enhancing observation resolution using continuous learning |

| KR102104761B1 (ko) | 2017-11-23 | 2020-04-27 | 코어포토닉스 리미티드 | 컴팩트 폴디드 카메라 구조 |

| EP3848749A1 (en) | 2018-02-05 | 2021-07-14 | Corephotonics Ltd. | Reduced height penalty for folded camera |

| CN111448793B (zh) | 2018-02-12 | 2021-08-31 | 核心光电有限公司 | 具有光学图像稳定化的折叠摄像机 |

| US10599951B2 (en) * | 2018-03-28 | 2020-03-24 | Kla-Tencor Corp. | Training a neural network for defect detection in low resolution images |

| US10694168B2 (en) | 2018-04-22 | 2020-06-23 | Corephotonics Ltd. | System and method for mitigating or preventing eye damage from structured light IR/NIR projector systems |

| EP3822588B1 (en) | 2018-04-23 | 2022-09-07 | Corephotonics Ltd. | An optical-path folding-element with an extended two degree of freedom rotation range |

| CN111316346B (zh) | 2018-08-04 | 2022-11-29 | 核心光电有限公司 | 摄像机上方的可切换连续显示信息系统 |

| US11635596B2 (en) | 2018-08-22 | 2023-04-25 | Corephotonics Ltd. | Two-state zoom folded camera |

| JP7309520B2 (ja) * | 2018-09-26 | 2023-07-18 | キヤノン株式会社 | 画像処理方法、画像処理装置、撮像装置、プログラム、記憶媒体、画像処理システム、および、学習済みモデルの製造方法 |

| CN112805996B (zh) | 2018-10-08 | 2022-04-22 | 华为技术有限公司 | 一种用于生成慢动作视频片段的设备和方法 |

| KR102242437B1 (ko) | 2019-01-07 | 2021-04-20 | 코어포토닉스 리미티드 | 슬라이딩 조인트를 갖는 회전 메커니즘 |

| JP2020136774A (ja) * | 2019-02-14 | 2020-08-31 | キヤノン株式会社 | 動きベクトルを検出する画像処理装置およびその制御方法ならびにプログラム |

| EP4224841A1 (en) | 2019-03-09 | 2023-08-09 | Corephotonics Ltd. | System and method for dynamic stereoscopic calibration |

| KR102365748B1 (ko) | 2019-07-31 | 2022-02-23 | 코어포토닉스 리미티드 | 카메라 패닝 또는 모션에서 배경 블러링을 생성하는 시스템 및 방법 |

| US11659135B2 (en) * | 2019-10-30 | 2023-05-23 | Corephotonics Ltd. | Slow or fast motion video using depth information |

| CN114641983A (zh) | 2019-12-09 | 2022-06-17 | 核心光电有限公司 | 用于获得智能全景图像的系统及方法 |

| US11949976B2 (en) | 2019-12-09 | 2024-04-02 | Corephotonics Ltd. | Systems and methods for obtaining a smart panoramic image |

| US11295427B2 (en) | 2020-02-14 | 2022-04-05 | Pixelworks, Inc. | Methods and systems for image processing with multiple image sources |

| US11356604B2 (en) * | 2020-02-14 | 2022-06-07 | Pixelworks, Inc. | Methods and systems for image processing with multiple image sources |

| CN113347490B (zh) * | 2020-02-18 | 2022-08-16 | RealMe重庆移动通信有限公司 | 视频处理方法、终端及存储介质 |

| KR20220003550A (ko) | 2020-04-26 | 2022-01-10 | 코어포토닉스 리미티드 | 홀 바 센서 보정을 위한 온도 제어 |

| CN117372248A (zh) | 2020-05-17 | 2024-01-09 | 核心光电有限公司 | 全视场参考图像的图像拼接 |

| WO2021245488A1 (en) | 2020-05-30 | 2021-12-09 | Corephotonics Ltd. | Systems and methods for obtaining a super macro image |

| US11637977B2 (en) | 2020-07-15 | 2023-04-25 | Corephotonics Ltd. | Image sensors and sensing methods to obtain time-of-flight and phase detection information |

| EP4045960A4 (en) | 2020-07-15 | 2022-12-14 | Corephotonics Ltd. | CORRECTING THE ABERRATION OF VIEWPOINTS IN A FOLDED SCANNING CAMERA |

| WO2022023914A1 (en) | 2020-07-31 | 2022-02-03 | Corephotonics Ltd. | Hall sensor - magnet geometry for large stroke linear position sensing |

| CN112927142B (zh) * | 2021-04-02 | 2022-11-11 | 中国人民解放军国防科技大学 | 一种基于时域插值的高速高分辨率视频生成方法和装置 |

Family Cites Families (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5821986A (en) * | 1994-11-03 | 1998-10-13 | Picturetel Corporation | Method and apparatus for visual communications in a scalable network environment |

| JP4039858B2 (ja) * | 2002-01-09 | 2008-01-30 | 株式会社モノリス | 画像マッチング方法と装置、および画像符号化方法と装置 |

| JP2003234931A (ja) * | 2002-02-08 | 2003-08-22 | Fuji Photo Film Co Ltd | 電子カメラ |

| JP3877651B2 (ja) * | 2002-07-02 | 2007-02-07 | 株式会社モノリス | 画像処理方法と装置 |

| KR100586883B1 (ko) * | 2004-03-04 | 2006-06-08 | 삼성전자주식회사 | 비디오 스트리밍 서비스를 위한 비디오 코딩방법, 프리디코딩방법, 비디오 디코딩방법, 및 이를 위한 장치와, 이미지 필터링방법 |

| US20050219642A1 (en) * | 2004-03-30 | 2005-10-06 | Masahiko Yachida | Imaging system, image data stream creation apparatus, image generation apparatus, image data stream generation apparatus, and image data stream generation system |

| US7777790B2 (en) * | 2005-01-27 | 2010-08-17 | Technion Research & Development Foundation Ltd. | Acquisition of image sequences with enhanced resolution |

-

2006

- 2006-06-01 JP JP2006526470A patent/JP3934151B2/ja not_active Expired - Fee Related

- 2006-06-01 WO PCT/JP2006/310976 patent/WO2006137253A1/ja active Application Filing

-

2007

- 2007-04-17 US US11/785,367 patent/US7596177B2/en not_active Expired - Fee Related

Cited By (18)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8094717B2 (en) | 2006-10-19 | 2012-01-10 | Panasonic Corporation | Image generation apparatus and image generation method |

| US7907183B2 (en) | 2006-10-30 | 2011-03-15 | Panasonic Corporation | Image generation apparatus and image generation method for generating a new video sequence from a plurality of video sequences |

| JP4469018B2 (ja) * | 2007-07-17 | 2010-05-26 | パナソニック株式会社 | 画像処理装置、画像処理方法、コンピュータプログラムおよび当該コンピュータプログラムを記録した記録媒体、フレーム間動き算出方法および画像処理方法 |

| US7903156B2 (en) | 2007-07-17 | 2011-03-08 | Panasonic Corporation | Image processing device, image processing method, computer program, recording medium storing the computer program, frame-to-frame motion computing method, and image processing method |

| WO2009011082A1 (ja) * | 2007-07-17 | 2009-01-22 | Panasonic Corporation | 画像処理装置、画像処理方法、コンピュータプログラムおよび当該コンピュータプログラムを記録した記録媒体、フレーム間動き算出方法および画像処理方法 |

| JPWO2009011082A1 (ja) * | 2007-07-17 | 2010-09-16 | パナソニック株式会社 | 画像処理装置、画像処理方法、コンピュータプログラムおよび当該コンピュータプログラムを記録した記録媒体、フレーム間動き算出方法および画像処理方法 |

| JPWO2009019808A1 (ja) * | 2007-08-03 | 2010-10-28 | パナソニック株式会社 | 画像データを生成する装置、方法およびプログラム |

| JP4469019B2 (ja) * | 2007-08-03 | 2010-05-26 | パナソニック株式会社 | 画像データを生成する装置、方法およびプログラム |

| US7868927B2 (en) | 2007-08-03 | 2011-01-11 | Panasonic Corporation | Image data generating apparatus, method and program |

| WO2009019808A1 (ja) * | 2007-08-03 | 2009-02-12 | Panasonic Corporation | 画像データを生成する装置、方法およびプログラム |

| WO2009019824A1 (ja) * | 2007-08-07 | 2009-02-12 | Panasonic Corporation | 撮像処理装置および撮像装置、画像処理方法およびコンピュータプログラム |

| US8018500B2 (en) | 2007-08-07 | 2011-09-13 | Panasonic Corporation | Image picking-up processing device, image picking-up device, image processing method and computer program |

| CN101578886B (zh) * | 2007-08-07 | 2011-11-23 | 松下电器产业株式会社 | 摄像处理装置以及摄像装置、图像处理方法以及计算机程序 |

| WO2009019823A1 (ja) * | 2007-08-07 | 2009-02-12 | Panasonic Corporation | 撮像処理装置および撮像装置、画像処理方法およびコンピュータプログラム |

| US8248495B2 (en) | 2007-08-07 | 2012-08-21 | Panasonic Corporation | Image picking-up processing device, image picking-up device, image processing method and computer program |

| WO2009031287A1 (ja) * | 2007-09-07 | 2009-03-12 | Panasonic Corporation | 多色画像処理装置及び信号処理装置 |

| US7825968B2 (en) | 2007-09-07 | 2010-11-02 | Panasonic Corporation | Multi-color image processing apparatus and signal processing apparatus |

| WO2016151734A1 (ja) * | 2015-03-23 | 2016-09-29 | 日立マクセル株式会社 | 撮像装置、画像処理装置、およびデジタルカメラ |

Also Published As

| Publication number | Publication date |

|---|---|

| US7596177B2 (en) | 2009-09-29 |

| JPWO2006137253A1 (ja) | 2009-01-22 |

| WO2006137253A1 (ja) | 2006-12-28 |

| US20070189386A1 (en) | 2007-08-16 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP3934151B2 (ja) | 画像生成装置および画像生成方法 | |

| JP4215266B2 (ja) | 画像生成装置および画像生成方法 | |

| JP4215267B2 (ja) | 画像生成装置および画像生成方法 | |

| JP5017419B2 (ja) | 画像生成装置、画像生成方法、およびプログラム | |

| JP5341010B2 (ja) | 画像処理装置、撮像装置、プログラム及び画像処理方法 | |

| JP6308748B2 (ja) | 画像処理装置、撮像装置及び画像処理方法 | |

| WO2011090107A1 (ja) | 画像処理装置、撮像装置、プログラム及び画像処理方法 | |

| US20110141224A1 (en) | Panorama Imaging Using Lo-Res Images | |

| CN113271415B (zh) | 具有多个图像源的图像处理的方法和系统 | |

| JP5002738B2 (ja) | 画像生成装置 | |

| JP2008541662A (ja) | 二重経路画像シーケンス安定化 | |

| US8085986B2 (en) | Image processing apparatus and method for processing images more naturally and sharply | |

| EP2545411A1 (en) | Panorama imaging | |

| JPWO2011083555A1 (ja) | 画像処理装置、画像生成システム、方法、およびプログラム | |

| JP5882702B2 (ja) | 撮像装置 | |

| JP2007329596A (ja) | 画像生成装置および画像生成方法 | |

| JP6772000B2 (ja) | 画像処理装置、画像処理方法およびプログラム | |

| JP6508926B2 (ja) | 撮像装置および撮像装置の制御方法 | |

| JP2009118434A (ja) | ぶれ補正装置及び撮像装置 | |

| JP4052348B2 (ja) | 画像処理装置、及び画像処理方法 | |

| JP2012085205A (ja) | 画像処理装置、撮像装置、画像処理方法および画像処理プログラム | |

| Quevedo et al. | Approach to super-resolution through the concept of multicamera imaging | |

| US11206344B2 (en) | Image pickup apparatus and storage medium | |

| JP7409604B2 (ja) | 画像処理装置、撮像装置、画像処理方法、プログラムおよび記録媒体 | |

| JP7458769B2 (ja) | 画像処理装置、撮像装置、画像処理方法、プログラムおよび記録媒体 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20070313 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20070314 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 3934151 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20100330 Year of fee payment: 3 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20110330 Year of fee payment: 4 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20110330 Year of fee payment: 4 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120330 Year of fee payment: 5 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20130330 Year of fee payment: 6 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20130330 Year of fee payment: 6 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20140330 Year of fee payment: 7 |

|

| S533 | Written request for registration of change of name |

Free format text: JAPANESE INTERMEDIATE CODE: R313533 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| LAPS | Cancellation because of no payment of annual fees |