JP2022110885A - 画像処理装置、画像処理方法、およびプログラム - Google Patents

画像処理装置、画像処理方法、およびプログラム Download PDFInfo

- Publication number

- JP2022110885A JP2022110885A JP2021006596A JP2021006596A JP2022110885A JP 2022110885 A JP2022110885 A JP 2022110885A JP 2021006596 A JP2021006596 A JP 2021006596A JP 2021006596 A JP2021006596 A JP 2021006596A JP 2022110885 A JP2022110885 A JP 2022110885A

- Authority

- JP

- Japan

- Prior art keywords

- color

- color information

- information

- subject

- expansion

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/56—Extraction of image or video features relating to colour

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

- G06T7/174—Segmentation; Edge detection involving the use of two or more images

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/50—Depth or shape recovery

- G06T7/55—Depth or shape recovery from multiple images

- G06T7/593—Depth or shape recovery from multiple images from stereo images

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/90—Determination of colour characteristics

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/20—Image preprocessing

- G06V10/28—Quantising the image, e.g. histogram thresholding for discrimination between background and foreground patterns

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/20—Scenes; Scene-specific elements in augmented reality scenes

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/60—Type of objects

- G06V20/64—Three-dimensional objects

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10016—Video; Image sequence

- G06T2207/10021—Stereoscopic video; Stereoscopic image sequence

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10024—Color image

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20092—Interactive image processing based on input by user

- G06T2207/20104—Interactive definition of region of interest [ROI]

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Multimedia (AREA)

- Image Analysis (AREA)

- Image Processing (AREA)

Abstract

Description

また、特許文献2には、より簡便な操作で、被写体領域の登録、および、被写体ではないのに被写体領域として誤って検出される誤検出領域(ノイズ領域と呼ぶ)の削除をサポートするユーザインターフェースが開示されている。

なお、事前に登録した色を抽出することで被写体領域を特定する手法の他に、デプスセンサで得られた奥行き画像に対し、奥行き値の閾値を設定することで、前景となる被写体領域を抽出する手法もある。ただしこの手法の場合、カメラとは別のデプスセンサを配置して同時に撮影する必要があり、デバイスのコスト面やセンサ校正の手間などがデメリットとなっている。

また、特許文献3には、特許文献2の「被写体領域」と「ノイズ(背景)領域」を同時に指定できるユーザインターフェースを提供して、短時間に被写体の領域を抽出する処理が開示されている。

その他、特許文献4には、被写体と背景の色情報を色情報テーブルとして保持し、被写体と背景の色情報が重複する領域を自動で弁別する方法が開示されている。

<第1の実施形態>

本実施形態では、現実空間に仮想空間の情報をリアルタイムに重ね合せてユーザに複合現実感を提供する場合を例に挙げて説明する。このため本実施形態に係る画像処理装置は、撮像装置の位置姿勢に応じた仮想空間の画像をCGにより生成し、そのCG画像に、撮像装置で現実空間を撮像した画像の全域又は一部を重畳した合成画像を生成する複合現実感生成処理機能を有しているものとする。また本実施形態の画像処理装置は、背景となる現実空間の映像上にCG画像を重畳表示するだけではなく、CGで描画された仮想物体をユーザが仮想的に操作するといった、インタラクションを実現する機能も備えているとする。なお現実の画像を仮想空間のCG画像に重畳して合成画像を生成する処理技術は既存のものであるため、その構成の図示および詳細な説明は省略する。

図1に示すように、画像処理装置100には、撮像部101、入力部150、および表示部270が接続されている。

撮像部101は、カラー画像を撮像可能なビデオカメラであり、被写体等を撮像することにより、被写体を含む画像を取得する。例えばビデオシースルー型のヘッドマウントディスプレイへの適用例を想定した場合、撮像部101は、ユーザの左右両眼の視野に応じたステレオ画像を取得可能なステレオカメラであるとする。なお、ステレオカメラの場合は、処理対象の画像は左右カメラの二つの画像となるが、時分割で1画像ずつ順番に処理するものとする。ただしステレオカメラに限定されるものではなく、単眼のカメラであっても本実施形態は適用可能である。

被写体の色を登録する場合、ユーザは、ユーザインターフェース画面に提示されている映像500を見ながら、入力装置であるマウスを操作してマウスカーソルを動かす。図2(a)の例の場合、ユーザは、撮像画像上の手510の領域であることを認識して、マウスカーソルを位置530から位置540にドラッグして動かすことで領域550を指定する。これにより、カーソルの移動により指定された領域550の中に含まれる画像の輝度および色味情報が取得される。輝度および色味情報は、例えばYCbCr空間にマッピングされ、図2(c)の3次元登録色領域560を形成する。前述した特許文献1および特許文献2に記載されているように、照明条件の相違等による色彩変化の影響を排除するために、3次元登録色領域560をCbCr空間に投影した登録色領域570を使用することで、撮像画像から色が抽出される。

図2(i)は、追加で設定した登録色領域の色空間(YCbCr空間)の状態を示した図である。前の状態である図2(g)の登録色領域560に比べて、図2(i)の登録色領域560は大きくなっている。さらに登録色領域560がCbCr空間に投影され、投影後の登録色領域570となる。登録色領域570は、非登録色領域575、577と重複した領域がある場合は、登録色領域570として上書きされるため、図2(j)に示すように誤検出領域555および誤検出領域557が再び現れる。

本実施形態の画像処理装置100は、図1に示したように、記憶部110、色情報登録部120、抽出部140、膨張部130、および出力部115を有して構成されている。

膨張制御部210は、記憶部110から取得した色情報テーブルの属性で「登録色」と「非登録色」が設定されているデータのYCbCr値を参照し、メモリ上の3次元色空間へマッピングする。マッピングの結果は、例えば図3(a)のような3次元色空間の状態になるものとする。図3(a)は、最初にユーザが入力部150経由で色情報登録部120によって色を登録した状態である。

以上の説明は、主に被写体の色情報を登録する際の処理の流れであるが、ユーザが複合現実感を体験する際の色抽出のみが実行される場合には、前述したようにステップS110、ステップS140、ステップS145の処理がスキップされる。

ステップS300では、膨張制御部210が、記憶部110から読み出した色情報に基づいて、メモリ上の3次元色空間に色情報を登録する。

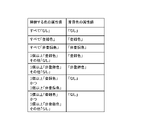

属性情報が「登録色」で膨張情報が「0」の場合は「P」

属性情報が「登録色」で膨張情報が「1」の場合は「Q」

属性情報が「非登録色」で膨張情報が「0」の場合は「N」

属性情報が「非登録色」で膨張情報が「1」の場合は「M」

本実施形態では、以上の処理により、登録色と非登録色を独立して膨張させるのではなく、重複が発生するブロックに関しては意図的に膨張させないように制御する。すなわち膨張部130の膨張制御部210は、被写体の色情報を3次元色空間で膨張させるときに、背景の色情報の3次元色空間における位置を参照して重複しないように膨張を制御する。これにより、本実施形態によれば、抽出した被写体領域の誤検出領域557や未検出領域552を偏りなく減少させることができる。

前述したように第1の実施形態では、輝度方向と色味方向への膨張回数は1回のみとしていたが、膨張回数は1回に限定されることに限定されるものではなく、また輝度方向と色味方向への膨張回数は同一の回数に限定されるものではない。膨張回数は、予め設定されていても良いし、ユーザによって任意の回数に設定されてもよい。

なお、輝度方向の膨張回数を色味方向の膨張回数よりも多くした場合は、膨張する幅が輝度方向に長くなる。特に被写体が明るい場所と暗い場所を行き来するようなシーンにおいては、輝度方向の膨張を多くするように調整することで、未検出領域を減少させることができる。

また、照明の色温度が異なる部屋を体験者が移動するようなシーンでは、色味方向の膨張回数を輝度方向に比べて多くするように調整することで、未検出領域を減少させることができる。

前述の例では、事前に膨張回数を記憶部110に格納して処理中は変更していない。膨張回数は処理中に固定された回数であることに限定されるものではなく、変形例2として、現在の撮像画像に対し、ユーザが表示部270で被写体の抽出結果を確認した後で、同じ画像に対して膨張回数を変更するように指示してもよい。

変形例2の処理を実現するためには、記憶部110に格納する膨張回数を、ユーザが入力部150を介して入力し、色情報登録部120経由で変更して同じ処理を実行すればよい。

第1の実施形態では、被写体の色を登録するときに、色情報登録部120が、入力部150経由でユーザからの入力を取得している。ただし、ユーザからの入力が常に正しいとは限らないため、被写体領域ではない色を登録してしまう可能性がある。この場合、例えば背景の色であるのに被写体の色として登録色に登録されてしまい、抽出結果に誤検出領域が増える。さらに前述したような膨張処理を行うと、登録色が膨張されるため、誤検出領域の増大が助長されてしまう虞がある。

そこで、第2の実施形態では、ユーザの入力が誤った入力であったとしても、誤った領域を登録しないように自動的に防ぐ画像処理装置を説明する。

奥行判定部1310で被写体が存在する確率が高いと判定される、撮像部101からの奥行方向の距離を、所定の距離範囲として入力すれば、図13(c)のような適正距離の領域画像が得られる。第2の実施形態では、この情報を用いて色情報を登録することにより、図13(d)に示すような領域に自動的に補正することができる。また第2の実施形態においても、その色情報を膨張することにより、未検出領域と誤検出領域が少ない被写体の抽出画像を得ることができる。

CPU901は、装置全体を制御する。RAM907は、CPU901が各部を制御しながら処理を行う時に作業領域として用いられる。またCPU901は、表示部270を制御する表示制御部としても動作する。ROM902は、制御プログラム、各種アプリケーションプログラム、データなどを記憶する。CPU901がROM902に記憶する制御プログラムをRAM907に展開して実行することにより、図1或いは図12の画像処理装置100が実現される。I/F903は、情報処理装置の外部の装置との通信に用いられる。例えば、I/F903は、撮像部101が撮像した撮像画像の信号を、画像処理装置100で処理可能な形式にして取得する。なおI/F903は、情報処理装置が外部の装置と有線で接続される場合には通信用のケーブルがI/F903に接続される。また情報処理装置が外部の装置と無線通信する機能を有する場合にはI/F903はアンテナを備える。

上述の実施形態は、何れも本発明を実施するにあたっての具体化の例を示したものに過ぎず、これらによって本発明の技術的範囲が限定的に解釈されてはならないものである。即ち、本発明は、その技術思想、又はその主要な特徴から逸脱することなく、様々な形で実施することができる。

Claims (13)

- 撮像装置で撮像された第1の画像における被写体と背景の色情報を取得する色情報取得手段と、

前記取得された前記被写体と背景の前記色情報を記憶する記憶手段と、

前記記憶手段に記憶された前記色情報を、3次元色空間上で膨張させる膨張手段と、

を有することを特徴とする画像処理装置。 - 前記記憶手段に記憶された前記色情報と前記膨張手段で前記膨張された色情報とに基づいて、前記撮像装置で撮像された第2の画像から前記被写体の領域を抽出する抽出手段を有することを特徴とする請求項1に記載の画像処理装置。

- 前記抽出手段により前記抽出された被写体の領域を出力する出力手段を有することを特徴とする請求項2に記載の画像処理装置。

- 前記記憶手段は、前記色情報を、輝度情報と色味情報とに分けて保持する色情報テーブルを記憶することを特徴とする請求項1乃至請求項3のいずれか1項に記載の画像処理装置。

- 前記膨張手段は、前記被写体と背景の前記色情報の少なくとも1つを、3次元色空間の輝度方向に膨張させることを特徴とする請求項1乃至請求項4のいずれか1項に記載の画像処理装置。

- 前記膨張手段は、前記被写体と背景の前記色情報の少なくとも1つを、3次元色空間の色味方向に膨張させることを特徴とする請求項1乃至請求項5のいずれか1項に記載の画像処理装置。

- 前記膨張手段は、前記被写体の色情報を3次元色空間で膨張させるときに、前記背景の色情報の3次元色空間における位置を参照して重複しないように前記膨張を制御することを特徴とする請求項1乃至請求項6のいずれか1項に記載の画像処理装置。

- 前記膨張手段は、ユーザが入力した膨張回数、又は、予め設定された膨張回数に基づいて、前記膨張を制御することを特徴とする請求項1乃至請求項7のいずれか1項に記載の画像処理装置。

- 前記被写体と背景の前記色情報の少なくとも1つを3次元色空間の輝度方向および色味方向に膨張させる場合、前記膨張回数は、前記輝度方向における膨張回数を前記色味方向の膨張回数よりも多くすることを特徴とする請求項8に記載の画像処理装置。

- 前記被写体と背景の前記色情報の少なくとも1つを3次元色空間の輝度方向および色味方向に膨張させる場合、前記膨張回数は、前記色味方向における膨張回数を前記輝度方向の膨張回数よりも多くすることを特徴とする請求項8に記載の画像処理装置。

- 前記撮像装置から前記被写体までの距離情報を取得する距離取得手段を有し、

前記記憶手段は、前記距離情報が規定の範囲内である場合に前記色情報を記憶することを特徴とする請求項1乃至請求項9のいずれか1項に記載の画像処理装置。 - 撮像装置で撮像された第1の画像における被写体と背景の色情報を取得する色情報取得工程と、

前記取得された前記被写体と背景の前記色情報を記憶する記憶工程と、

前記記憶工程にて記憶された前記色情報を、3次元色空間上で膨張させる膨張工程と、

を有することを特徴とする画像処理方法。 - コンピュータを、請求項1乃至請求項11のいずれか1項に記載の画像処理装置の各手段として機能させるためのプログラム。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2021006596A JP7599966B2 (ja) | 2021-01-19 | 2021-01-19 | 画像処理装置、画像処理方法、およびプログラム |

| US17/575,029 US11842519B2 (en) | 2021-01-19 | 2022-01-13 | Image processing apparatus for processing captured image, method therefor, and storage medium |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2021006596A JP7599966B2 (ja) | 2021-01-19 | 2021-01-19 | 画像処理装置、画像処理方法、およびプログラム |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2022110885A true JP2022110885A (ja) | 2022-07-29 |

| JP2022110885A5 JP2022110885A5 (ja) | 2024-01-16 |

| JP7599966B2 JP7599966B2 (ja) | 2024-12-16 |

Family

ID=82406488

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021006596A Active JP7599966B2 (ja) | 2021-01-19 | 2021-01-19 | 画像処理装置、画像処理方法、およびプログラム |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US11842519B2 (ja) |

| JP (1) | JP7599966B2 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN115205162A (zh) * | 2022-08-19 | 2022-10-18 | 广州虎牙信息科技有限公司 | 一种图像处理方法、装置、电子设备及存储介质 |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2024030465A (ja) * | 2022-08-24 | 2024-03-07 | 株式会社ソニー・インタラクティブエンタテインメント | 情報処理装置および情報処理方法 |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4328639B2 (ja) | 2004-02-13 | 2009-09-09 | キヤノン株式会社 | 被写体検出情報の調整方法及び調整装置 |

| JP4323910B2 (ja) | 2003-09-30 | 2009-09-02 | キヤノン株式会社 | 画像合成装置及び方法 |

| EP2458559B1 (en) * | 2009-07-23 | 2023-01-11 | Nec Corporation | Marker determination device, marker determination detection system, marker determination detection device, marker, marker determination method, and program therefor |

| JP2012014558A (ja) | 2010-07-02 | 2012-01-19 | Sony Corp | 画像処理方法、画像処理装置、プログラム、および記録媒体 |

| JP5023205B2 (ja) | 2010-09-16 | 2012-09-12 | 日立コンピュータ機器株式会社 | ドロップアウトカラー処理装置およびこれを用いたドロップアウトカラー処理方法 |

| JP2015152645A (ja) * | 2014-02-10 | 2015-08-24 | シナプティクス・ディスプレイ・デバイス合同会社 | 画像処理装置、画像処理方法、表示パネルドライバ及び表示装置 |

| JP5762600B1 (ja) | 2014-06-06 | 2015-08-12 | キヤノン株式会社 | 情報処理装置及び情報処理方法 |

| JP6587421B2 (ja) | 2015-05-25 | 2019-10-09 | キヤノン株式会社 | 情報処理装置、情報処理方法、及びプログラム |

-

2021

- 2021-01-19 JP JP2021006596A patent/JP7599966B2/ja active Active

-

2022

- 2022-01-13 US US17/575,029 patent/US11842519B2/en active Active

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN115205162A (zh) * | 2022-08-19 | 2022-10-18 | 广州虎牙信息科技有限公司 | 一种图像处理方法、装置、电子设备及存储介质 |

Also Published As

| Publication number | Publication date |

|---|---|

| US11842519B2 (en) | 2023-12-12 |

| US20220230358A1 (en) | 2022-07-21 |

| JP7599966B2 (ja) | 2024-12-16 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US6714689B1 (en) | Image synthesizing method | |

| EP3189495B1 (en) | Method and apparatus for efficient depth image transformation | |

| US7519218B2 (en) | Marker detection method and apparatus, and position and orientation estimation method | |

| JP7155530B2 (ja) | 回路装置、電子機器及びエラー検出方法 | |

| US10347000B2 (en) | Entity visualization method | |

| US20230026038A1 (en) | Image processing apparatus, image processing method, and storage medium | |

| JPWO2020174862A1 (ja) | 情報処理装置、情報処理方法および情報処理システム | |

| TW201447811A (zh) | 區域分割方法及檢查裝置 | |

| US11416978B2 (en) | Image processing apparatus, control method and non-transitory computer-readable recording medium therefor | |

| JPWO2018034214A1 (ja) | 回路装置、電子機器及びエラー検出方法 | |

| JP2019207535A (ja) | 情報処理装置、情報処理方法及びプログラム | |

| JP2008198082A (ja) | 画像処理方法、画像処理装置、及びディジタルカメラ | |

| US11200706B2 (en) | Image processing apparatus, image processing method, and storage medium | |

| JP2015041254A (ja) | Trimap生成装置、Trimap生成方法、及びプログラム | |

| JP7599966B2 (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| JP2002366963A (ja) | 画像処理方法、画像処理装置、撮像装置及びコンピュータプログラム | |

| JP4328639B2 (ja) | 被写体検出情報の調整方法及び調整装置 | |

| JP2011070415A (ja) | 画像処理装置及び画像処理方法 | |

| WO2024143844A1 (en) | Mask generation with object and scene segmentation for passthrough extended reality (xr) | |

| JP6350331B2 (ja) | 追尾装置、追尾方法及び追尾プログラム | |

| US11830177B2 (en) | Image processing apparatus, control method and non-transitory computer-readable recording medium therefor | |

| US10497103B2 (en) | Information processing apparatus, information processing system, information processing method, and recording medium | |

| JP7665333B2 (ja) | 情報処理装置、情報処理方法及びプログラム | |

| EP2492843A1 (en) | Graphic user interface for adaption of parameters for an automatic logo removal algorithm and method for adaption of these parameters | |

| US10217245B2 (en) | Method and system for chroma keying |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20240105 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20240105 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20240730 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20240819 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20241105 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20241204 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7599966 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |