以下、図面を参照しつつ、本発明の実施の形態について説明する。以下の説明では、同一の部品には同一の符号を付してある。それらの名称および機能も同じである。したがって、それらについての詳細な説明は繰り返さない。

[HMDシステムの構成]

図1を参照して、HMD(Head Mount Display)システム100の構成について説明する。図1は、ある実施の形態に従うHMDシステム100の構成の概略を表す図である。ある局面において、HMDシステム100は、家庭用のシステムとしてあるいは業務用のシステムとして提供される。

図1に示されるように、ある実施の形態に従うHMDシステム100は、HMD装置110と、HMDセンサ120と、ボード180と、コンピュータ200とを備える。HMD装置110は、モニタ112と、注視センサ140とを含む。ボード180は、傾きセ

ンサ170を含む。ある局面において、コンピュータ200は、ネットワーク19に接続可能であり、ネットワーク19に接続されているサーバ150と通信可能である。別の局面において、HMD装置110は、HMDセンサ120の代わりに、センサ114を含み得る。

ある実施の形態に従うHMD装置110は、ユーザの頭部に装着され、動作中に仮想空間をユーザに提供し得る。より具体的には、HMD装置110は、右目用の画像および左目用の画像をモニタ112にそれぞれ表示する。ユーザの各目がそれぞれの画像を視認すると、ユーザは、両目の視差に基づき当該画像を3次元の画像として認識し得る。

モニタ112は、例えば、非透過型の表示装置として実現される。ある局面において、モニタ112は、ユーザの両目の前方に位置するようにHMD装置110の本体に配置されている。したがって、ユーザは、モニタ112に表示される3次元画像を視認すると、仮想空間に没入することができる。ある実施の形態において、仮想空間は、例えば、背景、ユーザが操作可能なオブジェクト、ユーザが選択可能なメニューの画像を含む。ある実施の形態において、モニタ112は、所謂スマートフォンその他の情報表示端末が備える液晶モニタまたは有機EL(Electro Luminescence)モニタとして実現され得る。

ある局面において、モニタ112は、右目用の画像を表示するためのサブモニタと、左目用の画像を表示するためのサブモニタとを含み得る。別の局面において、モニタ112は、右目用の画像と左目用の画像とを一体として表示する構成であってもよい。この場合、モニタ112は、高速シャッタを含む。高速シャッタは、画像がいずれか一方の目にのみ認識されるように、右目用の画像と左目用の画像とを交互に表示可能に作動する。

HMDセンサ120は、複数の光源(図示しない)を含む。各光源は例えば、赤外線を発するLEDにより実現される。HMDセンサ120は、HMD装置110の動きを検出するためのポジショントラッキング機能を有する。HMDセンサ120は、この機能を用いて、現実空間内におけるHMD装置110の位置および傾きを検出する。

なお、別の局面において、HMDセンサ120は、カメラにより実現されてもよい。この場合、HMDセンサ120は、カメラから出力されるHMD装置110の画像情報を用いて、画像解析処理を実行することにより、HMD装置110の位置および傾きを検出することができる。

別の局面において、HMD装置110は、位置検出器として、HMDセンサ120の代わりに、センサ114を備えてもよい。HMD装置110は、センサ114を用いて、HMD装置110自身の位置および傾きを検出し得る。例えば、センサ114が角速度センサ、地磁気センサ、加速度センサ、あるいはジャイロセンサ等である場合、HMD装置110は、HMDセンサ120の代わりに、これらの各センサのいずれかを用いて、自身の位置および傾きを検出し得る。一例として、センサ114が角速度センサである場合、角速度センサは、現実空間におけるHMD装置110の3軸周りの角速度を経時的に検出する。HMD装置110は、各角速度に基づいて、HMD装置110の3軸周りの角度の時間的変化を算出し、さらに、角度の時間的変化に基づいて、HMD装置110の傾きを算出する。

注視センサ140は、ユーザ190の右目および左目の視線が向けられる方向(視線方向)を検出する。当該方向の検出は、例えば、公知のアイトラッキング機能によって実現される。注視センサ140は、当該アイトラッキング機能を有するセンサにより実現される。ある局面において、注視センサ140は、右目用のセンサおよび左目用のセンサを含むことが好ましい。注視センサ140は、例えば、ユーザ190の右目および左目に赤外

光を照射するとともに、照射光に対する角膜および虹彩からの反射光を受けることにより各眼球の回転角を検出するセンサであってもよい。注視センサ140は、検出した各回転角に基づいて、ユーザ190の視線方向を検知することができる。

サーバ150は、コンピュータ200にプログラムを送信し得る。別の局面において、サーバ150は、他のユーザによって使用されるHMD装置に仮想現実を提供するための他のコンピュータ200と通信し得る。例えば、アミューズメント施設において、複数のユーザが参加型のゲームを行なう場合、各コンピュータ200は、各ユーザの動作に基づく信号を他のコンピュータ200と通信して、同じ仮想空間において複数のユーザが共通のゲームを楽しむことを可能にする。

ある実施の形態に従うと、HMDシステム100は、コントローラ160をさらに備えてもよい。コントローラ160はモーションセンサ130を含み得る。

コントローラ160は、ユーザ190からコンピュータ200への命令の入力を受け付ける。ある局面において、コントローラ160は、ユーザ190によって把持可能に構成される。別の局面において、コントローラ160は、ユーザ190の身体あるいは衣類の一部に装着可能に構成される。別の局面において、コントローラ160は、コンピュータ200から送られる信号に基づいて、振動、音、光のうちの少なくともいずれかを出力するように構成されてもよい。

モーションセンサ130は、ある局面において、ユーザの手に取り付けられて、ユーザの手の動きを検出する。例えば、モーションセンサ130は、手の回転速度、回転数等を検出する。検出された信号は、コンピュータ200に送られる。モーションセンサ130は、例えば、手袋型のコントローラ160に設けられている。ある実施の形態において、現実空間における安全のため、コントローラ160は、手袋型のようにユーザ190の手に装着されることにより容易に飛んで行かないものに装着されるのが望ましい。別の局面において、ユーザ190に装着されないセンサがユーザ190の手の動きを検出してもよい。例えば、ユーザ190を撮影するカメラの信号が、ユーザ190の動作を表わす信号として、コンピュータ200に入力されてもよい。モーションセンサ130とコンピュータ200とは、有線により、または無線により互いに接続される。無線の場合、通信形態は特に限られず、例えば、Bluetooth(登録商標)その他の公知の通信手法が用いられる。

傾きセンサ170は、例えば、加速度センサ、タッチセンサ等によって実現される。ある実施の形態において、ボード180のように底部が球面状である部材では、加速度センサが傾きセンサ170として使用される。ある実施の形態において、ボブスレーのように側壁を有する器具がユーザ190によって使用される場合には、加速度センサに加えて、あるいは加速度センサの代わりに、タッチセンサが傾きセンサとして左右の側壁に配置されてもよい。この場合、当該器具は、ユーザ190がタッチした側壁の方向に傾いていることが検知され得る。

ボード180は、上面に作用する荷重に応じて傾くように構成されている。例えば、ある局面において、ボード180の底面には、円弧状の傾きが形成されている。別の局面において、ボード180は、作用する荷重をボード180が設置される床に伝達するように配置された複数のばねその他の弾性部材を含む。

[ハードウェア構成]

図2を参照して、本実施の形態に係るコンピュータ200について説明する。図2は、一局面に従うコンピュータ200のハードウェア構成の一例を表すブロック図である。コ

ンピュータ200は、主たる構成要素として、プロセッサ10と、メモリ11と、ストレージ12と、入出力インターフェイス13と、通信インターフェイス14とを備える。各構成要素は、それぞれ、バス15に接続されている。

プロセッサ10は、コンピュータ200に与えられる信号に基づいて、あるいは、予め定められた条件が成立したことに基づいて、メモリ11またはストレージ12に格納されているプログラムに含まれる一連の命令を実行する。ある局面において、プロセッサ10は、CPU(Central Processing Unit)、MPU(Micro Processor Unit)、FP

GA(Field-Programmable Gate Array)その他のデバイスとして実現される。

メモリ11は、プログラムおよびデータを一時的に保存する。プログラムは、例えば、ストレージ12からロードされる。データは、コンピュータ200に入力されたデータと、プロセッサ10によって生成されたデータとを含む。ある局面において、メモリ11は、RAM(Random Access Memory)その他の揮発メモリとして実現される。

ストレージ12は、プログラムおよびデータを永続的に保持する。ストレージ12は、例えば、ROM(Read-Only Memory)、ハードディスク装置、フラッシュメモリ、その

他の不揮発記憶装置として実現される。ストレージ12に格納されるプログラムは、HMDシステム100において仮想空間を提供するためのプログラム、シミュレーションプログラム、ゲームプログラム、ユーザ認証プログラム、他のコンピュータ200との通信を実現するためのプログラムを含む。ストレージ12に格納されるデータは、仮想空間を規定するためのデータおよびオブジェクト等を含む。

なお、別の局面において、ストレージ12は、メモリカードのように着脱可能な記憶装置として実現されてもよい。さらに別の局面において、コンピュータ200に内蔵されたストレージ12の代わりに、外部の記憶装置に保存されているプログラムおよびデータを使用する構成が使用されてもよい。このような構成によれば、例えば、アミューズメント施設のように複数のHMDシステム100が使用される場面において、プログラムやデータの更新を一括して行なうことが可能になる。

ある実施の形態において、入出力インターフェイス13は、HMD装置110、HMDセンサ120、モーションセンサ130、および傾きセンサ170との間で信号を通信する。ある局面において、入出力インターフェイス13は、USB(Universal Serial Bus)インターフェイス、DVI(Digital Visual Interface)、HDMI(登録商標)(High-Definition Multimedia Interface)その他の端子を用いて実現される。なお、入出力インターフェイス13は上述のものに限られない。

ある実施の形態において、入出力インターフェイス13は、さらに、コントローラ160と通信し得る。例えば、入出力インターフェイス13は、モーションセンサ130から出力された信号の入力を受ける。別の局面において、入出力インターフェイス13は、プロセッサ10から出力された命令を、コントローラ160に送る。当該命令は、振動、音声出力、発光等をコントローラ160に指示する。コントローラ160は、当該命令を受信すると、その命令に応じて、振動、音声出力または発光のいずれかを実行する。

通信インターフェイス14は、ネットワーク19に接続されて、ネットワーク19に接続されている他のコンピュータ(例えば、サーバ150)と通信する。ある局面において、通信インターフェイス14は、例えば、LAN(Local Area Network)その他の有線通信インターフェイス、あるいは、WiFi(Wireless Fidelity)、Bluetooth(登録商標)、NFC(Near Field Communication)その他の無線通信インターフェイスとして実現される。なお、通信インターフェイス14は上述のものに限られない。

ある局面において、プロセッサ10は、ストレージ12に格納されている1つ以上のプログラムをメモリ11にロードし、当該プログラムに含まれる一連の命令を実行する。当該1つ以上のプログラムは、コンピュータ200のオペレーティングシステム、仮想空間を提供するためのアプリケーションプログラム、コントローラ160を用いて仮想空間で実行可能なゲームソフトウェア等を含み得る。プロセッサ10は、入出力インターフェイス13を介して、仮想空間を提供するための信号をHMD装置110に送る。HMD装置110は、その信号に基づいてモニタ112に映像を表示する。

なお、図2に示される例では、コンピュータ200は、HMD装置110の外部に設けられる構成が示されているが、別の局面において、コンピュータ200は、HMD装置110に内蔵されてもよい。一例として、モニタ112を含む携帯型の情報通信端末(例えば、スマートフォン)がコンピュータ200として機能してもよい。

また、コンピュータ200は、複数のHMD装置110に共通して用いられる構成であってもよい。このような構成によれば、例えば、複数のユーザに同一の仮想空間を提供することもできるので、各ユーザは同一の仮想空間で他のユーザと同一のアプリケーションを楽しむことができる。

ある実施の形態において、HMDシステム100では、グローバル座標系が予め設定されている。グローバル座標系は、現実空間における鉛直方向、鉛直方向に直交する水平方向、ならびに、鉛直方向および水平方向の双方に直交する前後方向にそれぞれ平行な、3つの基準方向(軸)を有する。本実施の形態では、グローバル座標系は視点座標系の一つである。そこで、グローバル座標系における水平方向、鉛直方向(上下方向)、および前後方向は、それぞれ、x軸、y軸、z軸と規定される。より具体的には、グローバル座標系において、x軸は現実空間の水平方向に平行である。y軸は、現実空間の鉛直方向に平行である。z軸は現実空間の前後方向に平行である。

ある局面において、HMDセンサ120は、赤外線センサを含む。赤外線センサが、HMD装置110の各光源から発せられた赤外線をそれぞれ検出すると、HMD装置110の存在を検出する。HMDセンサ120は、さらに、各点の値(グローバル座標系における各座標値)に基づいて、HMD装置110を装着したユーザ190の動きに応じた、現実空間内におけるHMD装置110の位置および傾きを検出する。より詳しくは、HMDセンサ120は、経時的に検出された各値を用いて、HMD装置110の位置および傾きの時間的変化を検出できる。

グローバル座標系は現実空間の座標系と平行である。したがって、HMDセンサ120によって検出されたHMD装置110の各傾きは、グローバル座標系におけるHMD装置110の3軸周りの各傾きに相当する。HMDセンサ120は、グローバル座標系におけるHMD装置110の傾きに基づき、uvw視野座標系をHMD装置110に設定する。HMD装置110に設定されるuvw視野座標系は、HMD装置110を装着したユーザ190が仮想空間において物体を見る際の視点座標系に対応する。

[開示された実施の形態の構成の概要]

ある実施の形態に従うと、コンピュータがヘッドマウントディスプレイ装置に仮想空間を提供するための方法が提供される。この方法は、少なくとも1つのプロセッサが、仮想空間を定義するステップと、少なくとも1つのプロセッサが、当該ヘッドマウントディスプレイ装置のユーザが傾いている方向(例えば、左右または前後のいずれか)を検出するステップと、少なくとも1つのプロセッサが、ユーザ190が傾いている方向に基づいて当該仮想空間においてユーザ190に相当する仮想ユーザの移動方向を決定するステップ

と、少なくとも1つのプロセッサが、当該仮想空間における仮想ユーザの視界が、決定された仮想ユーザの移動方向に移動するように、当該ヘッドマウントディスプレイ装置に当該視界を表示させるステップとを含む。

ある実施の形態に従うと、当該移動方向を決定するステップは、ユーザ190の傾きが継続している時間に応じて、当該移動方向を決定することを含む。

ある実施の形態に従うと、当該移動方向を決定するステップは、ユーザ190の傾きの程度に応じて、当該移動方向を決定することを含む。

ある実施の形態に従うと、当該方法は、少なくとも1つのプロセッサが、検出されたユーザ190の傾きに基づいて当該仮想空間における仮想ユーザの移動距離を決定するステップをさらに備える。当該視界を表示させるステップは、仮想ユーザの視界が当該移動方向に向かって当該移動距離だけ移動するように、当該視界を表示させることを含む。

ある実施の形態に従う、コンピュータがヘッドマウントディスプレイ装置に仮想空間を提供するための方法は、少なくとも1つのプロセッサが、仮想空間を定義するステップと、少なくとも1つのプロセッサが、当該ヘッドマウントディスプレイ装置のユーザが傾いている方向を検出するステップと、少なくとも1つのプロセッサが、検出されたユーザ190の傾きに基づいて当該仮想空間における仮想ユーザの移動距離を決定するステップと、少なくとも1つのプロセッサが、当該仮想空間における仮想ユーザの視界が、決定された仮想ユーザの移動距離だけ移動するように、当該ヘッドマウントディスプレイ装置に当該視界を表示させるステップとを含む。

ある実施の形態に従うと、当該移動距離を決定するステップは、ユーザ190の傾きが継続している時間に応じて、当該移動距離を決定することを含む。

ある実施の形態に従うと、当該移動距離を決定するステップは、ユーザ190の傾きの程度に応じて、当該移動距離を決定することを含む。

ある実施の形態に従うと、ユーザ190が傾いている方向を検出するステップは、ユーザ190による体重移動を伴う動作または姿勢に基づく加速度を検出するステップを含む。

ある実施の形態に従うと、ユーザ190が傾いている方向を検出するステップは、ユーザ190から作用する荷重を検出することを含む。

ある実施の形態に従うと、当該プロセッサは、仮想空間を定義し、当該ヘッドマウントディスプレイ装置のユーザが傾いている方向を検出し、検出された方向に基づいて当該仮想空間における仮想ユーザの移動方向を決定し、当該仮想空間における仮想ユーザの視界が、決定された仮想ユーザの移動方向に移動するように、当該ヘッドマウントディスプレイ装置に当該視界を表示させるように構成されている。

ある実施の形態に従うと、当該プロセッサは、検出されたユーザ190の傾きに基づいて当該仮想空間における仮想ユーザの移動距離を決定するようにさらに構成されている。当該視界を表示させることは、仮想ユーザの視界が当該移動方向に向かって当該移動距離だけ移動するように、当該視界を表示させることを含む。

ある実施の形態に従うと、プロセッサは、仮想空間を定義し、当該ヘッドマウントディスプレイ装置のユーザが傾いている方向を検出し、検出された方向に基づいて当該仮想空

間における仮想ユーザの移動距離を決定し、当該仮想空間における仮想ユーザの視界が、決定された仮想ユーザの移動距離だけ移動するように、当該ヘッドマウントディスプレイ装置に当該視界を表示させるように構成されている。

[uvw視野座標系]

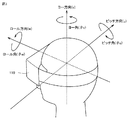

図3を参照して、uvw視野座標系について説明する。図3は、ある実施の形態に従うHMD装置110に設定されるuvw視野座標系を概念的に表す図である。HMDセンサ120は、HMD装置110の起動時に、グローバル座標系におけるHMD装置110の位置および傾きを検出する。プロセッサ10は、検出された値に基づいて、uvw視野座標系をHMD装置110に設定する。

図3に示されるように、HMD装置110は、HMD装置110を装着したユーザの頭部を中心(原点)とした3次元のuvw視野座標系を設定する。より具体的には、HMD装置110は、グローバル座標系を規定する水平方向、鉛直方向、および前後方向(x軸、y軸、z軸)を、グローバル座標系内においてHMD装置110の各軸周りの傾きだけ各軸周りにそれぞれ傾けることによって新たに得られる3つの方向を、HMD装置110におけるuvw視野座標系のピッチ方向(u軸)、ヨー方向(v軸)、およびロール方向(w軸)として設定する。

ある局面において、HMD装置110を装着したユーザ190が直立し、かつ、正面を視認している場合、プロセッサ10は、グローバル座標系に平行なuvw視野座標系をHMD装置110に設定する。この場合、グローバル座標系における水平方向(x軸)、鉛直方向(y軸)、および前後方向(z軸)は、HMD装置110におけるuvw視野座標系のピッチ方向(u軸)、ヨー方向(v軸)、およびロール方向(w軸)に一致する。

uvw視野座標系がHMD装置110に設定された後、HMDセンサ120は、HMD装置110の動きに基づいて、設定されたuvw視野座標系におけるHMD装置110の傾き(傾きの変化量)を検出できる。この場合、HMDセンサ120は、HMD装置110の傾きとして、uvw視野座標系におけるHMD装置110のピッチ角(θu)、ヨー角(θv)、およびロール角(θw)をそれぞれ検出する。ピッチ角(θu)は、uvw視野座標系におけるピッチ方向周りのHMD装置110の傾き角度を表す。ヨー角(θv)は、uvw視野座標系におけるヨー方向周りのHMD装置110の傾き角度を表す。ロール角(θw)は、uvw視野座標系におけるロール方向周りのHMD装置110の傾き角度を表す。

HMDセンサ120は、検出されたHMD装置110の傾き角度に基づいて、HMD装置110が動いた後のHMD装置110におけるuvw視野座標系を、HMD装置110に設定する。HMD装置110と、HMD装置110のuvw視野座標系との関係は、HMD装置110の位置および傾きに関わらず、常に一定である。HMD装置110の位置および傾きが変わると、当該位置および傾きの変化に連動して、グローバル座標系におけるHMD装置110のuvw視野座標系の位置および傾きが変化する。

ある局面において、HMDセンサ120は、赤外線センサからの出力に基づいて取得される赤外線の光強度および複数の点間の相対的な位置関係(例えば、各点間の距離など)に基づいて、HMD装置110の現実空間内における位置を、HMDセンサ120に対する相対位置として特定してもよい。また、プロセッサ10は、特定された相対位置に基づいて、現実空間内(グローバル座標系)におけるHMD装置110のuvw視野座標系の原点を決定してもよい。

[仮想空間]

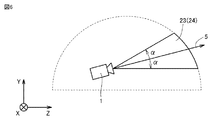

図4を参照して、仮想空間についてさらに説明する。図4は、ある実施の形態に従う仮想空間2を表現する一態様を概念的に表す図である。仮想空間2は、中心21の360度方向の全体を覆う全天球状の構造を有する。図4では、説明を複雑にしないために、仮想空間2のうちの上半分の天球が例示されている。仮想空間2では各メッシュが規定される。各メッシュの位置は、仮想空間2に規定されるXYZ座標系における座標値として予め規定されている。コンピュータ200は、仮想空間2に展開可能なコンテンツ(静止画、動画等)を構成する各部分画像を、仮想空間2において対応する各メッシュにそれぞれ対応付けて、ユーザによって視認可能な仮想空間画像22が展開される仮想空間2をユーザに提供する。

ある局面において、仮想空間2では、中心21を原点とするXYZ座標系が規定される。XYZ座標系は、例えば、グローバル座標系に平行である。XYZ座標系は視点座標系の一種であるため、XYZ座標系における水平方向、鉛直方向(上下方向)、および前後方向は、それぞれX軸、Y軸、Z軸として規定される。したがって、XYZ座標系のX軸(水平方向)がグローバル座標系のx軸と平行であり、XYZ座標系のY軸(鉛直方向)がグローバル座標系のy軸と平行であり、XYZ座標系のZ軸(前後方向)がグローバル座標系のz軸と平行である。

HMD装置110の起動時、すなわちHMD装置110の初期状態において、仮想カメラ1が、仮想空間2の中心21に配置される。仮想カメラ1は、現実空間におけるHMD装置110の動きに連動して、仮想空間2を同様に移動する。これにより、現実空間におけるHMD装置110の位置および向きの変化が、仮想空間2において同様に再現される。

仮想カメラ1には、HMD装置110の場合と同様に、uvw視野座標系が規定される。仮想空間2における仮想カメラのuvw視野座標系は、現実空間(グローバル座標系)におけるHMD装置110のuvw視野座標系に連動するように規定されている。したがって、HMD装置110の傾きが変化すると、それに応じて、仮想カメラ1の傾きも変化する。また、仮想カメラ1は、HMD装置110を装着したユーザの現実空間における移動に連動して、仮想空間2において移動することもできる。

仮想カメラ1の向きは、仮想カメラ1の位置および傾きに応じて決まるので、ユーザが仮想空間画像22を視認する際に基準となる視線(基準視線5)は、仮想カメラ1の向きに応じて決まる。コンピュータ200のプロセッサ10は、基準視線5に基づいて、仮想空間2における視界領域23を規定する。視界領域23は、仮想空間2のうち、HMD装置110を装着したユーザの視界に対応する。

注視センサ140によって検出されるユーザ190の視線方向は、ユーザ190が物体を視認する際の視点座標系における方向である。HMD装置110のuvw視野座標系は、ユーザ190がモニタ112を視認する際の視点座標系に等しい。また、仮想カメラ1のuvw視野座標系は、HMD装置110のuvw視野座標系に連動している。したがって、ある局面に従うHMDシステム100は、注視センサ140によって検出されたユーザ190の視線方向を、仮想カメラ1のuvw視野座標系におけるユーザの視線方向とみなすことができる。

[ユーザの視線]

図5を参照して、ユーザの視線方向の決定について説明する。図5は、ある実施の形態に従うHMD装置110を装着するユーザ190の頭部を上から表した図である。

ある局面において、注視センサ140は、ユーザ190の右目および左目の各視線を検

出する。ある局面において、ユーザ190が近くを見ている場合、注視センサ140は、視線R1およびL1を検出する。別の局面において、ユーザ190が遠くを見ている場合、注視センサ140は、視線R2およびL2を検出する。この場合、ロール方向wに対して視線R2およびL2がなす角度は、ロール方向wに対して視線R1およびL1がなす角度よりも小さい。注視センサ140は、検出結果をコンピュータ200に送信する。

コンピュータ200が、視線の検出結果として、視線R1およびL1の検出値を注視センサ140から受信した場合には、その検出値に基づいて、視線R1およびL1の交点である注視点N1を特定する。一方、コンピュータ200は、視線R2およびL2の検出値を注視センサ140から受信した場合には、視線R2およびL2の交点を注視点として特定する。コンピュータ200は、特定した注視点N1の位置に基づき、ユーザ190の視線方向N0を特定する。コンピュータ200は、例えば、ユーザ190の右目Rと左目Lとを結ぶ直線の中点と、注視点N1とを通る直線の延びる方向を、視線方向N0として検出する。視線方向N0は、ユーザ190が両目により実際に視線を向けている方向である。また、視線方向N0は、視界領域23に対してユーザ190が実際に視線を向けている方向に相当する。

別の局面において、HMDシステム100は、HMDシステム100を構成するいずれかのパーツに、マイクおよびスピーカを備えてもよい。ユーザは、マイクに発話することにより、仮想空間2に対して、音声による指示を与えることができる。

また、別の局面において、HMDシステム100は、テレビジョン放送受信チューナを備えてもよい。このような構成によれば、HMDシステム100は、仮想空間2においてテレビ番組を表示することができる。

さらに別の局面において、HMDシステム100は、インターネットに接続するための通信回路、あるいは、電話回線に接続するための通話機能を備えていてもよい。

[視界領域]

図6および図7を参照して、視界領域23について説明する。図6は、仮想空間2において視界領域23をX方向から見たYZ断面を表す図である。図7は、仮想空間2において視界領域23をY方向から見たXZ断面を表す図である。

図6に示されるように、YZ断面における視界領域23は、領域24を含む。領域24は、仮想カメラ1の基準視線5と仮想空間2のYZ断面とによって定義される。プロセッサ10は、仮想空間おける基準視線5を中心として極角αを含む範囲を、領域24として規定する。

図7に示されるように、XZ断面における視界領域23は、領域25を含む。領域25は、基準視線5と仮想空間2のXZ断面とによって定義される。プロセッサ10は、仮想空間2における基準視線5を中心とした方位角βを含む範囲を、領域25として規定する。

ある局面において、HMDシステム100は、コンピュータ200からの信号に基づいて、視界画像26をモニタ112に表示させることにより、ユーザ190に仮想空間を提供する。視界画像26は、仮想空間画像22のうち視界領域23に重畳する部分に相当する。ユーザ190が、頭に装着したHMD装置110を動かすと、その動きに連動して仮想カメラ1も動く。その結果、仮想空間2における視界領域23の位置が変化する。これにより、モニタ112に表示される視界画像26は、仮想空間画像22のうち、仮想空間2においてユーザが向いた方向の視界領域23に重畳する画像に更新される。ユーザは、

仮想空間2における所望の方向を視認することができる。

ユーザ190は、HMD装置110を装着している間、現実世界を視認することなく、仮想空間2に展開される仮想空間画像22のみを視認できる。そのため、HMDシステム100は、仮想空間2への高い没入感覚をユーザに与えることができる。

ある局面において、プロセッサ10は、HMD装置110を装着したユーザ190の現実空間における移動に連動して、仮想空間2において仮想カメラ1を移動し得る。この場合、プロセッサ10は、仮想空間2における仮想カメラ1の位置および向きに基づいて、HMD装置110のモニタ112に投影される画像領域(すなわち、仮想空間2における視界領域23)を特定する。

ある実施の形態に従うと、仮想カメラ1は、二つの仮想カメラ、すなわち、右目用の画像を提供するための仮想カメラと、左目用の画像を提供するための仮想カメラとを含むことが望ましい。また、ユーザ190が3次元の仮想空間2を認識できるように、適切な視差が、二つの仮想カメラに設定されていることが好ましい。本実施の形態においては、仮想カメラ1が二つの仮想カメラを含み、二つの仮想カメラのロール方向が合成されることによって生成されるロール方向(w)がHMD装置110のロール方向(w)に適合されるように構成されているものとして、本開示に係る技術思想を例示する。

[HMD装置の制御装置]

図8を参照して、HMD装置110の制御装置について説明する。ある実施の形態において、制御装置は周知の構成を有するコンピュータ200によって実現される。図8は、ある実施の形態に従うコンピュータ200をモジュール構成として表わすブロック図である。

図8に示されるように、コンピュータ200は、表示制御モジュール220と、仮想空間制御モジュール230と、メモリモジュール240と、通信制御モジュール250とを備える。表示制御モジュール220は、サブモジュールとして、仮想カメラ制御モジュール221と、視界領域決定モジュール222と、視界画像生成モジュール223と、基準視線特定モジュール224とを含む。仮想空間制御モジュール230は、サブモジュールとして、仮想空間定義モジュール231と、仮想オブジェクト生成モジュール232と、物体制御モジュール233と、移動方向決定モジュール234と、移動距離決定モジュール235とを含む。

ある実施の形態において、表示制御モジュール220と仮想空間制御モジュール230とは、プロセッサ10によって実現される。別の実施の形態において、複数のプロセッサ10が表示制御モジュール220と仮想空間制御モジュール230として作動してもよい。メモリモジュール240は、メモリ11またはストレージ12によって実現される。通信制御モジュール250は、通信インターフェイス14によって実現される。

ある局面において、表示制御モジュール220は、HMD装置110のモニタ112における画像表示を制御する。仮想カメラ制御モジュール221は、仮想空間2に仮想カメラ1を配置し、仮想カメラ1の挙動、向き等を制御する。視界領域決定モジュール222は、視界領域23を規定する。視界画像生成モジュール223は、決定された視界領域23に基づいて、モニタ112に表示される視界画像26を生成する。

基準視線特定モジュール224は、注視センサ140からの信号に基づいて、ユーザ190の視線を特定する。

仮想空間制御モジュール230は、ユーザ190に提供される仮想空間2を制御する。仮想空間定義モジュール231は、仮想空間2を表わす仮想空間データを生成することにより、HMDシステム100における仮想空間2を規定する。

仮想オブジェクト生成モジュール232は、仮想空間2に表示される対象物を生成する。対象物は、例えば、ゲームのストーリーの進行に従って表示される森、山その他を含む風景、動物等を含む。

物体制御モジュール233は、仮想空間2においてユーザが保持する物体の動作を制御する。当該物体は、例えば、現実空間におけるユーザ190の動作に連動して、仮想空間2において表示される仮想ユーザが乗るための台、乗り物等を含み得る。ある実施の形態に従う乗り物は、例えば、そり、スキー、スノーボード、船舶その他の仮想ユーザの乗り物であって、荷重に応じて移動方向および移動速度の少なくともいずれか一方が変化する乗り物として実現される。

移動方向決定モジュール234は、傾きセンサ170からの出力に基づいて、仮想空間2における仮想ユーザの移動方向を決定する。ある実施の形態に従うと、移動方向決定モジュール234は、傾きセンサ170から出力される信号に基づいてユーザ190による荷重が作用する方向を検知し、当該方向を仮想ユーザが移動するべき方向として決定する。

移動距離決定モジュール235は、傾きセンサ170からの出力に基づいて、仮想ユーザの移動距離を決定する。例えば、水平状態にあったボード180が傾いた場合に、移動距離決定モジュール235は、傾斜角度に応じた移動距離を決定する。ある局面において、移動距離決定モジュール235は、プロセッサ10が実行しているプログラムにおいて予め規定された傾斜角度一度当たりの仮想移動距離と、当該傾斜角度とに基づいて、仮想ユーザの移動距離を決定する。別の実施の形態に従うと、移動距離決定モジュール235は、傾斜が継続している時間に基づいて、仮想ユーザの移動距離を決定する。例えば、プロセッサ10が実行しているプログラムにおいて予め規定された時間当たりの仮想移動距離と、当該傾斜が継続している時間との積に基づいて、仮想ユーザの移動距離を決定し得る。

メモリモジュール240は、コンピュータ200が仮想空間2をユーザ190に提供するために使用されるデータを保持している。ある局面において、メモリモジュール240は、空間情報241と、オブジェクト情報242と、ユーザ情報243とを保持している。空間情報241は、仮想空間2を提供するために規定された1つ以上のテンプレートを保持している。オブジェクト情報242は、仮想空間2において再生されるコンテンツ、当該コンテンツで使用されるオブジェクトを表示するための情報を保持している。当該コンテンツは、例えば、ゲーム、現実社会と同様の風景を表したコンテンツ等を含み得る。ユーザ情報243は、HMDシステム100の制御装置としてコンピュータ200を機能させるためのプログラム、オブジェクト情報242に保持される各コンテンツを使用するアプリケーションプログラム等を保持している。メモリモジュール240に格納されているデータおよびプログラムは、HMD装置110のユーザによって入力される。あるいは、プロセッサ10が、当該コンテンツを提供する事業者が運営するコンピュータ(例えば、サーバ150)からプログラムあるいはデータをダウンロードして、ダウンロードされたプログラムあるいはデータをメモリモジュール240に格納する。

通信制御モジュール250は、ネットワーク19を介して、サーバ150その他の情報通信装置と通信し得る。

ある局面において、表示制御モジュール220および仮想空間制御モジュール230は、ユニティテクノロジーズ社によって提供されるUnity(登録商標)を用いて実現され得る。

[制御構造]

図9を参照して、HMDシステム100の制御構造について説明する。図9は、ある実施の形態に従うHMDシステム100において実行される処理の一部を表わすシーケンスチャートである。

ステップS910にて、コンピュータ200のプロセッサ10は、仮想空間定義モジュール231として、仮想空間画像データを特定する。

ステップS920にて、プロセッサ10は、仮想カメラ1を初期化する。例えば、仮想カメラ1を仮想空間2において予め規定された中心点に配置し、仮想カメラ1の視線をユーザ190が向いている方向に向ける。

ステップS930にて、プロセッサ10は、視界画像生成モジュール223として、初期の視界画像を表示するための視界画像データを生成する。生成された視界画像データは、視界画像生成モジュール223を介して通信制御モジュール250によってHMD装置110に送られる。

ステップS932にて、HMD装置110のモニタ112は、コンピュータ200から受信した信号に基づいて、視界画像を表示する。HMD装置110を装着したユーザ190は、視界画像を視認すると仮想空間2を認識し得る。

ステップS934にて、HMDセンサ120は、HMD装置110から発信される複数の赤外線光に基づいて、HMD装置110の位置と傾きを検知する。検知結果は、動き検知データとして、コンピュータ200に送られる。

ステップS940にて、プロセッサ10は、HMD装置110の位置と傾きとに基づいて、HMD装置110を装着したユーザ190の視界方向を特定する。プロセッサ10は、アプリケーションプログラムを実行し、アプリケーションプログラムに含まれる命令に基づいて、仮想空間2においてオブジェクトを表示させる。ユーザ190は、そのアプリケーションプログラムの実行により仮想空間2において視認可能なコンテンツを楽しむ。ある局面において、当該コンテンツは、例えば、ボブスレーその他のそりを用いたスポーツ、スキー、スノーボード等を含む。ある実施の形態において、ユーザ190は、ボード180に着座し、モニタ112に表示された画像の推移に応じて姿勢を変え得る。

ステップS942にて、傾きセンサ170は、ユーザ190が傾いている方向を検出する。検出された傾きを示す信号は、コンピュータ200に送られる。当該信号は、ボード180の傾斜角度を含む。例えば、ある局面において、ボブスレーのような滑降競技のアプリケーションプログラムが実行されている場合、ユーザ190の傾きに応じて、仮想空間2に存在する仮想ユーザが仮想空間2において表示されたボブスレーの進行方向を制御するシーンがあり得る。この場合、ユーザ190が体を傾けたときに、傾きセンサ170は、その傾斜方向を検出する。

ステップS950にて、プロセッサ10は、傾きセンサ170から出力される信号に基づいて、仮想ユーザの移動方向と移動距離とを決定する。本実施の形態において、移動方向とは、仮想空間2において、仮想ユーザあるいは仮想ユーザが着座しているそりその他の器具が進む方向を含む。なお、別の局面において、移動方向のみが必要とされる場合に

は、プロセッサ10は、移動方向決定モジュール234として、移動方向のみを決定し得る。別の局面において、移動距離のみが必要とされる場合には、プロセッサ10は、移動距離決定モジュール235として、移動距離のみを決定し得る。

さらに他の局面において、プロセッサ10は、傾きセンサ170から出力される信号に基づいて、仮想ユーザの移動方向と移動速度とを決定する構成であってもよい。仮想ユーザの移動速度は、ボード180の傾斜角度が大きいほど速く設定され得る。

ステップS960にて、プロセッサ10は、決定された移動方向および移動距離に基づいて、仮想ユーザの移動後の視界を決定する。

ステップS970にて、プロセッサ10は、決定された移動方向および移動距離に基づいて、仮想カメラ1の仮想空間2における位置および向きを決定する。

ステップS980にて、プロセッサ10は、決定された仮想カメラ1の位置および向きに基づいて、視界領域を決定する。本実施の形態において、視界領域とは、仮想空間2において仮想ユーザが視認できる範囲を表わす。

ステップS990にて、コンピュータ200は、決定された視界領域に応じて視界画像を表示するための視界画像データを生成し、生成した視界画像データをHMD装置110に出力する。視界画像データは、決定された移動方向に向かって仮想ユーザが高速に移動するように、仮想ユーザの周りの景色が高速に仮想ユーザの方に向かっている態様を表示可能に構成されている。

ステップS992にて、HMD装置110のモニタ112は、受信した視界画像データに基づいて視界画像を更新し、更新後の視界画像を表示する。ユーザ190は、更新後の視界画像、すなわち、移動方向に視線が移動したのちの視界を認識することができる。

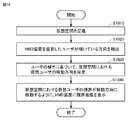

図10を参照して、コンピュータ200の制御構造についてさらに説明する。図10は、ボード180に着座したユーザ190の動作に応じてコンピュータ200が実行する処理の一部を表わすフローチャートである。

ステップS1010にて、プロセッサ10は、仮想空間定義モジュール231として、メモリ11において仮想空間2を定義する。

ステップS1020にて、プロセッサ10は、傾きセンサ170からの信号に基づいて、HMD装置110を装着してボード180に着座しているユーザ190が傾いている方向、具体的には、右、左、前または後を検出する。

ステップS1030にて、プロセッサ10は、ユーザ190の傾きに基づいて、仮想空間2を進行する仮想ユーザの移動方向を決定する。例えば、ユーザ190が一定時間右側に体を傾けた場合に、プロセッサ10は、仮想ユーザあるいは仮想ユーザが着座している乗り物が右側に移動すると判断する。他の局面において、ユーザ190が右側に体を一時的に傾ける動作を行なった回数に応じて、プロセッサ10は、仮想ユーザが右側に移動する方向を決定する。例えば、予め規定された時間内にユーザ190が体を傾けるための1回の動作を行なった場合、プロセッサ10は、仮想ユーザが進行方向に対して右側に1度移動すると決定する。ユーザ190が当該動作を10回行った場合、プロセッサ10は、仮想ユーザが右側に10度移動すると決定する。

別の局面において、ユーザ190が体を左側に傾ける動作を行なった場合にも、右側に

傾ける動作を行なった場合と同様に、プロセッサ10は、左側の移動方向を決定する。

別の実施の形態において、傾きセンサ170は、ユーザ190が体を前傾させたことを検知し得る。このときに、プロセッサ10は、傾きセンサ170からの信号に応じてユーザ190が体を前に傾けたことを検知し、傾斜角度に基づいて移動距離を決定し得る。例えば、前方への1度の傾斜が検知された場合に、仮想ユーザを10m移動させることが、プロセッサ10が実行しているプログラムにおいて予め規定されている場合、プロセッサ10は、ユーザ190が前方に5度傾いたことを検知すると、仮想空間2において仮想ユーザを50m移動させることを決定する。

ステップS1040にて、プロセッサ10は、仮想オブジェクト生成モジュール232として、仮想空間2における仮想ユーザの視界が、ステップSS1030において決定された移動方向に移動するように、HMD装置110に視界画像を表示させるための視界画像データを生成する。ある実施の形態に従うと、プロセッサ10は、移動方向に加えて、ユーザ190の傾きが継続している時間に応じた移動距離が反映された視界画像データを生成する。プロセッサ10は、生成した視界画像データをHMD装置110に送信し、当該視界画像データに基づいて視界画像をモニタ112に表示させる。

[着座しているユーザの移動]

図11〜図13を参照して、ユーザ190の傾きの検出の一態様について説明する。

図11は、ある実施の形態において、ユーザ190がボード180に着座している態様を表す図である。分図Aは、HMD装置110(図示しない)を装着したユーザ190がボード180において水平状態を維持して着座している態様を表す。分図Bは、ユーザ190が体重移動を行ない、ユーザ190から見て左側にボード180を傾けた態様を表す。分図Cは、ユーザが体重移動を行ない、ユーザ190から見て右側にボード180を傾けた状態を表す。ボード180が傾くと、傾きセンサ170は、その方向きに応じた信号を出力する。出力された信号は、コンピュータ200に入力される。傾きが検知される方向は、分図Bに示される左、分図Cに示される右に限られず、ある実施の形態において、傾きセンサ170は、ユーザ190が前方に体重移動を行なった場合の前方への傾き、あるいは、ユーザ190が後方に体重移動を行なった場合の後方への傾きも検知し得る。

図12は、ある実施の形態において、ユーザ190がボード180に立っている態様を表す図である。分図Aは、HMD装置110(図示しない)を装着したユーザ190がボード180において水平状態を維持して立っている態様を表す。分図Bは、ユーザ190が体重移動を行ない、ユーザ190から見て左側にボード180を傾けた態様を表す。分図Cは、ユーザが体重移動を行ない、ユーザ190から見て右側にボード180を傾けた状態を表す。ボード180が傾くと、傾きセンサ170は、その方向きに応じた信号を出力する。出力された信号は、コンピュータ200に入力される。傾きが検知される方向は、分図Bに示される左、分図Cに示される右に限られず、ある実施の形態において、傾きセンサ170は、ユーザ190が前方に体重移動を行なった場合の前方への傾き、あるいは、ユーザ190が後方に体重移動を行なった場合の後方への傾きも検知し得る。ユーザ190は、自身の体重移動に応じて、仮想空間2における仮想ユーザの移動方向を予測できるので、没入感を損なうことなく、所謂映像酔い(VR酔い)を防止することができる。

図13を参照して、傾きの検知の他の態様について説明する。図13は、ある実施の形態において、ユーザ190がそり1300に着座している態様を表す図である。そり1300の両側面には、タッチセンサ1370,1371がそれぞれ配置されている。タッチセンサ1370,1371の出力は、コンピュータ200の入力インターフェイスに接続

されている。ある局面において、一つ以上のそり1300は、遊技場において提供され得る。

分図Aは、HMD装置110(図示しない)を装着したユーザ190がそり1300において水平状態を維持して着座している態様を表す。このとき、ユーザ190はタッチセンサ1370および1371に触れていない。

分図Bは、ユーザ190が体重移動を行ない、ユーザ190から見て右側にそり1300を傾けた態様を表す。そり1300が右側に傾いてユーザの右手がタッチセンサ1370に触れると、タッチセンサ1370から出力された信号は、コンピュータ200に入力される。プロセッサ10は、その信号に基づいて、そり1300が右側に傾いたことを検知する。さらに、プロセッサ10は、仮想空間2において仮想ユーザの右前方からの視界がユーザ190によって認識されるように、視界画像データを生成する。プロセッサ10が視界画像データをHMD装置110に送信して、モニタ112が視界画像データに基づく画像を表示する。ユーザ190は、その画像を見ると、仮想空間2において右方向に移動しているように認識する。

分図Cは、ユーザ190が体重移動を行ない、ユーザ190から見て左側にそり1300を傾けた状態を表す。そり1300が左側に傾いてユーザの左手がタッチセンサ1371に触れると、タッチセンサ1371から出力された信号は、コンピュータ200に入力される。プロセッサ10は、その信号に基づいて、そり1300が左側に傾いたことを検知する。さらに、プロセッサ10は、仮想空間2において仮想ユーザの左前方からの視界がユーザ190によって認識されるように、視界画像データを生成する。プロセッサ10が視界画像データをHMD装置110に送信して、モニタ112が視界画像データに基づく画像を表示する。ユーザ190は、その画像を見ると、仮想空間2において左方向に移動しているように認識する。

なお、図13に示される例でも、タッチセンサ1370,1371の代わりに、図11または図12と同様に、傾きセンサ170が、そり1300の底部に配置されてもよい。

次に、図14〜図16を参照して、仮想空間2における仮想ユーザの移動について説明する。ある実施の形態において、HMD装置110を装着したユーザ190は、仮想ユーザとして、仮想空間2における視界画像1400を視認している。

図14は、ユーザ190が着座して又は立っているボード180またはそり1300が水平に維持されている場合を説明するための図である。このとき、プロセッサ10は、傾きセンサ170またはタッチセンサ1370,1371から出力される信号に基づき、ユーザ190は水平状態を維持していると判断する。さらに、プロセッサ10は、仮想空間2において水平状態の画像が視認されるような視界画像データを生成し、HMD装置110のモニタ112に当該視界画像データを送信する。

分図Aに示されるように、モニタ112がその視界画像データに基づいて画像を表示した場合には、ユーザ190は、仮想ユーザとして視界画像1400を認識する。このとき、分図Bに示されるように、仮想ユーザに対応する仮想カメラ1は、仮想ユーザの視野に応じた視界領域23をとらえている。

[右側への移動]

図15は、水平状態を維持していたユーザ190が右側に傾いて、ボード180またはそり1300を右側に傾けた場合を説明するための図である。このとき、プロセッサ10は、傾きセンサ170またはタッチセンサ1370,1371から出力される信号に基づ

き、ユーザ190が右側に傾いていると判断する。さらに、プロセッサ10は、仮想空間2における仮想ユーザが当所いた場所(例えば、図14参照)から右側に移動していると認識される視界画像データを生成する。例えば、プロセッサ10は、仮想空間2において認識される画像が右から左に流れるような視界画像を表示するための視界画像データを生成し、視界画像データをHMD装置110に送信する。

分図Aに示されるように、モニタ112が、当該視界画像データに基づく視界画像1500を表示する。視界画像1400において右に表示されていた木1410が視界画像1500の中心に移動している。

分図Bに示されるように、このような移動は、例えば、仮想空間2において仮定される仮想カメラ1が木1410の正面に移動することに相当する。プロセッサ10は、仮想カメラ1の移動に応じて認識される画像と同様の画像を表示するために視界画像データを生成する。

視界画像1400から視界画像1500への推移は、ユーザ190が体重を右側に移動したことに基づいて行なわれる。このようにすると、ユーザ190は、右側への体重移動という自らの動作に応じて、視界画像の推移による仮想空間2における移動を認識できるので、ユーザ190の傾きと仮想空間2における移動方向とが連動することになる。その結果、所謂VR酔いの発生が抑制され得る。

[左側への移動]

図16は、水平状態を維持していたユーザ190が左側に傾いて、ボード180またはそり1300を左側に傾けた場合を説明するための図である。このとき、プロセッサ10は、傾きセンサ170またはタッチセンサ1370,1371から出力される信号に基づき、ユーザ190が左側に傾いていると判断する。さらに、プロセッサ10は、仮想空間2における仮想ユーザが当所いた場所(例えば、図14参照)から左側に移動していると認識される視界画像データを生成する。例えば、プロセッサ10は、仮想空間2において認識される画像が左から右に流れるような視界画像を表示するための視界画像データを生成し、視界画像データをHMD装置110に送信する。

分図Aに示されるように、モニタ112が、当該視界画像データに基づく視界画像1600を表示する。視界画像1400において左に表示されていた山1420が視界画像1600の中心に移動している。

分図Bに示されるように、このような移動は、例えば、仮想空間2において仮定される仮想カメラ1が山1420の正面に移動することに相当する。プロセッサ10は、仮想カメラ1の移動に応じて認識される画像と同様の画像を表示するために視界画像データを生成する。

視界画像1400から視界画像1600への推移は、ユーザ190が体重を左側に移動したことに基づいて行なわれる。このようにすると、ユーザ190は、左側への体重移動という自らの動作に応じて、視界画像の推移による仮想空間2における移動を認識できるので、ユーザ190の傾きと仮想空間2における移動方向とが連動することになる。その結果、所謂VR酔いの発生が抑制され得る。

[前方への移動]

図17は、水平状態を維持していたユーザ190が前に傾いて、ボード180を前方に傾けた場合を説明するための図である。プロセッサ10は、傾きセンサ170から出力される信号に基づき、ユーザ190が前方に傾いていると判断する。さらに、プロセッサ1

0は、仮想空間2における仮想ユーザが当所いた場所(例えば、図14参照)から前方に移動していると認識される視界画像データを生成する。例えば、プロセッサ10は、仮想空間2において認識される画像が高速に近づいてくるような視界画像を表示するための視界画像データを生成し、視界画像データをHMD装置110に送信する。

分図Aに示されるように、モニタ112が、当該視界画像データに基づく視界画像1700を表示する。視界画像1400において遠方に小さく表示されていた木1410および山1420は、それぞれ、仮想空間2における移動距離に応じて大きく表示される。なお、仮想空間2における移動距離は、ある局面において、例えば、ユーザ190による前傾の角度と、予め定められた単位角度当たりの移動距離とに基づいて算出され得る。当該移動距離は、別の局面において、前傾の状態が継続していた時間と、予め定められた単位時間当たりの移動距離とに基づいて算出されてもよい。

分図Bに示されるように、仮想空間2における視界画像の移動は、例えば、仮想空間2において仮定される仮想カメラ1が木1410や山1420の方に向かって高速に移動することに相当する。プロセッサ10は、仮想カメラ1の移動に応じて認識される画像と同様の画像を表示するために視界画像データを生成する。

視界画像1400から視界画像1700への推移は、ユーザ190が体重を前に移動したことに基づいて行なわれる。ユーザ190は、体重移動という自らの動作に応じて、仮想空間2における移動を認識できるので、ユーザ190の傾きと仮想空間2における移動方向とが連動することになる。その結果、所謂VR酔いの発生が抑制され得る。

[後方への移動]

図18は、水平状態を維持していたユーザ190が後方に傾いて、ボード180を後方に傾けた場合を説明するための図である。プロセッサ10は、傾きセンサ170から出力される信号に基づき、ユーザ190が後方に傾いていると判断する。さらに、プロセッサ10は、仮想空間2における仮想ユーザが当所いた場所(例えば、図14参照)から後方に移動していると認識される視界画像データを生成する。例えば、プロセッサ10は、仮想空間2において認識される画像が高速に遠ざかるような視界画像を表示するための視界画像データを生成し、視界画像データをHMD装置110に送信する。

分図Aに示されるように、モニタ112が、当該視界画像データに基づく視界画像1800を表示する。視界画像1400において表示されていた木1410および山1420は、それぞれ、図14に示されていた場合よりも小さく表示される。例えば、木1410および山1420は、仮想空間2における移動距離に応じて小さく表示される。なお、仮想空間2における移動距離は、ある局面において、例えば、ユーザ190による後傾の角度と、予め定められた単位角度当たりの移動距離とに基づいて算出され得る。当該移動距離は、別の局面において、後傾の状態が継続していた時間と、予め定められた単位時間当たりの移動距離とに基づいて算出されてもよい。

分図Bに示されるように、仮想空間2における視界画像の移動は、例えば、仮想空間2において仮定される仮想カメラ1が木1410や山1420から遠ざかる方向に高速に移動することに相当する。プロセッサ10は、仮想カメラ1の移動に応じて認識される画像と同様の画像を表示するために視界画像データを生成する。

視界画像1400から視界画像1800への推移は、ユーザ190が体重を後に移動したことに基づいて行なわれる。ユーザ190は、体重移動という自らの動作に応じて、仮想空間2における移動を認識できるので、前傾の場合と同様に、ユーザ190の傾きと仮想空間2における移動方向とが連動することになる。その結果、所謂VR酔いの発生が抑

制され得る。

以上のようにして、ある実施の形態によれば、現実空間においてユーザ190が傾いている方向に基づき、仮想空間2における仮想ユーザの移動方向が決定されるので、ユーザ190の傾きと仮想空間2における移動方向とが連動することになる。その結果、仮想空間2において仮想ユーザの移動が行なわれても、その時の画像を視認したユーザ190に対するVR酔いの発生が抑制され得る。なお、上記の実施の形態でそれぞれ説明された各特徴は、適宜、組み合わせられ得る。例えば、水平方向を維持していたユーザ190がボード180を傾けた場合の前方または後方の成分については、仮想空間2において仮想カメラ1の基準視線5の方向へ仮想ユーザが前進または後退するように移動するものとして移動距離の算出を行い、ユーザがボード180を右側または左側へと傾ける傾斜の度合いに応じて、仮想カメラ1を、ヨー方向(v軸)周りに回転させ得る。

今回開示された実施の形態はすべての点で例示であって制限的なものではないと考えられるべきである。本発明の範囲は上記した説明ではなくて特許請求の範囲によって示され、特許請求の範囲と均等の意味および範囲内でのすべての変更が含まれることが意図される。