JP2017194856A - 情報処理装置、情報処理方法、および情報処理プログラム - Google Patents

情報処理装置、情報処理方法、および情報処理プログラム Download PDFInfo

- Publication number

- JP2017194856A JP2017194856A JP2016085167A JP2016085167A JP2017194856A JP 2017194856 A JP2017194856 A JP 2017194856A JP 2016085167 A JP2016085167 A JP 2016085167A JP 2016085167 A JP2016085167 A JP 2016085167A JP 2017194856 A JP2017194856 A JP 2017194856A

- Authority

- JP

- Japan

- Prior art keywords

- mask

- image data

- image

- region

- unit

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Landscapes

- Image Analysis (AREA)

- Controls And Circuits For Display Device (AREA)

Abstract

【課題】画像処理対象の有効領域を容易に特定する。【解決手段】情報処理装置10の取得部10Aは、画像データを取得する。ラベリング処理部10Bは、画像データの画像における、第1の閾値以上の輝度値の特徴領域の各々にラベルを付与する。生成部10Dは、画像データの画像における、特徴領域以外の第1のマスク領域と、特徴領域の大きさに応じて選択した第2のマスク領域と、を覆うマスクデータを生成する。特定部10Fは、画像データにおける、マスクデータによって覆われる第1のマスク領域および第2のマスク領域以外の領域を、画像処理対象の有効領域として特定する。【選択図】図3

Description

本発明は、情報処理装置、情報処理方法、および情報処理プログラムに関する。

画像データから物体の距離や位置の計測などを行うための事前処理として、ラベリング処理を行う技術が知られている(例えば、特許文献1、特許文献2参照)。ラベリング処理は、画像を背景領域と物体領域とに分類し、連続する物体領域ごとにラベル番号を付与する処理である。

特許文献1には、ラベリング処理によって、画像データ内に存在する対象物を区別し、対象物ごとに画像処理を行うことが開示されている。特許文献2には、CAM(Content Addressable Memory)を搭載した構成とすることで、ラベルの書き換えを高速度で行う技術が開示されている。

しかしながら、従来技術では、ラベリング処理によって特定した物体領域に、画像処理対象以外の領域が含まれる場合があった。このため、従来技術では、不要な領域を別途除去する必要があり、画像処理対象の有効領域を容易に特定することは困難であった。

本発明は、上記に鑑みてなされたものであって、画像処理対象の有効領域を容易に特定することができる、情報処理装置、情報処理方法、および情報処理プログラムを提供することを目的とする。

上述した課題を解決するために、情報処理装置は、画像データを取得する取得部と、前記画像データの画像における、第1の閾値以上の輝度値の特徴領域の各々にラベルを付与するラベリング処理部と、前記画像データの画像における、前記特徴領域以外の第1のマスク領域と、前記特徴領域の大きさに応じて選択した第2のマスク領域と、を覆うマスクデータを生成する生成部と、前記画像データにおける、前記マスクデータによって覆われる前記第1のマスク領域および前記第2のマスク領域以外の領域を、画像処理対象の有効領域として特定する特定部と、を備える。

本発明によれば、画像処理対象の有効領域を容易に特定することができる。

以下、添付図面を参照しながら、本実施の形態の情報処理装置、情報処理方法、および情報処理プログラムの実施の形態を詳細に説明する。なお、本明細書において、同じ構成および機能を示す部分には、同じ符号を付与し、詳細な説明を省略する場合がある。

なお、本実施の形態では、本実施の形態の情報処理装置を、電子黒板(インタラクティブ・ホワイトボード)のシステムに搭載した形態を一例として説明する。なお、本実施の形態の情報処理装置の適用対象は、電子黒板のシステムに限定されない。

図1は、本実施の形態の情報処理システム1000の構成の一例を示す模式図である。情報処理システム1000は、情報処理装置10と、電子黒板12と、を含む。情報処理装置10と電子黒板12とは、データや信号を送受信可能に接続されている。

電子黒板12は、画像を二次元の表示面に投影または表示する装置である。また、電子黒板12は、表示面に対する操作位置や操作軌跡を検出する機能を備える。電子黒板12は、インタラクティブ・ホワイトボード(Interactive Whiteboard:IWB)と称される場合がある。

電子黒板12は、撮影部14と、画像処理部15と、表示部19と、を備える。表示部19は、表示面16と、縁部18と、を備える。表示面16は、画像を表示する二次元面である。縁部18は、表示面16の周縁に沿って設けられた部材である。本実施の形態では、表示面16は矩形状であり、縁部18は、該矩形状の表示面16の周縁に沿って、該周縁を矩形状に囲むように配置されている。縁部18は、入射光を反射する性質を有する。このため、電子黒板12に入射し、縁部18によって反射した反射光によって、表示面16上には、縁部18に対応する反射光により輝度の高い領域が生じる。

撮影部14は、表示部19の表面を撮影する。本実施の形態では、撮影部14は、撮影部14Aと、撮影部14Bと、を含む。撮影部14は、表示部19の表示面16を撮影することによって撮影画像の画像データを得る。なお、以下、撮影画像を、単に、画像と称して説明する場合がある。

画像処理部15は、表示面16へ表示画像を表示する。表示面16へ表示する表示画像は、他の電子黒板12から通信回線などを介して受信した表示画像データの表示画像や、画像処理部15に記憶されている表示画像データの表示画像である。

また、画像処理部15は、撮影部14で得られた撮影画像の画像データから、表示面16上の、ユーザの身体の一部(例えば、指)や指示部材20などによって操作された操作位置を検出する。

本実施の形態では、画像処理部15は、画像処理を行うことで、画像データに含まれる、指や指示部材20による影を検出する。そして、検出した影の位置を、操作位置を示す位置情報として用いる。詳細には、本実施の形態では、画像処理部15は、表示面16における縁部18によって反射した反射光による輝度の高い領域に映った、指や指示部材20などの操作位置に応じた影を検出する。これによって、画像処理部15は、検出した影の位置を、操作位置を示す位置情報として用いる。また、画像処理部15は、検出した位置情報によって示される操作位置を示すポイント画像を、表示画像に重畳し、表示面16へ表示する。

本実施の形態では、画像処理部15は、情報処理装置10から、画像データにおける画像処理対象の有効領域を示す情報を取得する。そして、画像処理部15は、撮影画像の画像データにおける有効領域から、指や指示部材20による影を検出する。

次に、情報処理装置10について説明する。情報処理装置10は、撮影部14から撮影画像の画像データを取得し、電子黒板12や外部装置などで実行する画像処理の前処理として、画像処理対象の有効領域を特定する。なお、情報処理装置10と電子黒板12とを一体的に構成してもよい。

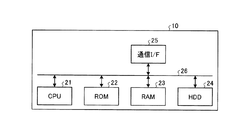

次に、情報処理装置10の、ハードウェア構成の一例を説明する。図2は、情報処理装置10の、ハードウェア構成の一例を示す模式図である。

情報処理装置10は、CPU(Central Processing Unit)21と、ROM(Read Only Memory)22と、RAM(Random Access Memory)23と、HDD(Hard Disk Drive)24と、通信I/F(インターフェース)25と、を備え、バス26を介して相互に接続されている。

CPU21は、情報処理装置10の各々の動作を統括的に制御する。CPU21は、RAM23をワークエリア(作業領域)とし、ROM22またはHDD24などに格納されたプログラムを実行することで、全体の動作を制御し、後述する各種機能部を実現する。

HDD24は、各種データを格納する。通信I/F25は、ネットワークを介して他の装置と通信するためのインターフェースである。

次に、情報処理装置10の機能的構成を説明する。図3は、情報処理装置10の機能的構成の一例を示す模式図である。情報処理装置10は、取得部10Aと、ラベリング処理部10Bと、第1のバッファ部10Cと、生成部10Dと、第2のバッファ部10Eと、特定部10Fと、出力部10Gと、を備える。

取得部10A、ラベリング処理部10B、第1のバッファ部10C、生成部10D、第2のバッファ部10E、特定部10、および、出力部10Gの一部または全ては、例えば、CPU21などの処理装置にプログラムを実行させること(すなわちソフトウェア)により実現してもよいし、IC(Integrated Circuit)などのハードウェアにより実現してもよいし、併用して実現してもよい。

取得部10Aは、撮影部14から画像データを取得する。本実施の形態では、取得部10Aは、撮影部14で撮影した撮影画像(すなわち、表示面16の撮影画像)の画像データを取得する。

取得部10Aは、取得した画像データを、ラベリング処理部10B、第1のバッファ部10C、および第2のバッファ部10Eへ出力する。

なお、取得部10Aは、複数のフレームの画像データを連続して取得してもよい。この場合、取得部10Aは、1フレームごとに画像データを、ラベリング処理部10B、第1のバッファ部10C、および第2のバッファ部10Eの各々へ出力する。

ラベリング処理部10Bは、取得部10Aから画像データを取得する。ラベリング処理部10Bは、取得した画像データにラベリング処理を行う。

ラベリング処理とは、画像データを構成する各画素の画素値に応じて画像データを背景画素と特徴画素(物体画素と称する場合もある)とに二値化し、連続する特徴画素による特徴領域ごとに、ラベル番号を付与する処理である。本実施の形態のラベリング処理には、公知のラベリング処理を用いればよい。例えば、本実施の形態のラベリング処理には、特許第4612352号公報および特開2006−48222号公報に記載のラベリング処理を用いればよい。

なお、本実施の形態のラベリング処理部10Bでは、画像データを構成する各画素を、画素値が第1の閾値以上の輝度値を示す特徴画素と、画素値が第1の閾値未満の輝度値を示す背景画素と、に分類する。これによって、ラベリング処理部10Bは、画像データを二値化する。そして、ラベリング処理部10Bは、連続する特徴画素による特徴領域ごとに、ラベル番号を付与する。

第1の閾値は、ラベリング処理対象の画像データや、電子黒板12が行う画像処理の内容に応じて、予め設定すればよい。また、第1の閾値は、ユーザによる操作指示などによって変更可能としてもよい。

図4は、ラベリング処理の一例の説明図である。例えば、取得部10Aが、図4(A)に示す画像データ30を取得したと仮定する。画像データ30には、輝度値が第1の閾値以上の複数の領域(領域30A〜領域30D)が含まれていると仮定する。これらの領域(領域30A〜領域30D)は、電子黒板12の縁部18の反射領域や、外光の映り込みなどによる輝度値の高い領域である。なお、本実施の形態では、縁部18の反射領域である領域30Dには、指や指示部材20による影Pが含まれる場合を説明する。

この場合、ラベリング処理部10Bは、画像データ30における、第1の閾値以上の輝度値の領域(30A〜30D)を、特徴領域32(特徴領域32A〜特徴領域32D)として特定する(図4(B)参照)。

そして、ラベリング処理部10Bは、特徴領域32(特徴領域32A〜特徴領域32D)の各々にラベルを付与する。本実施の形態では、ラベリング処理部10Bは、特徴領域32A〜特徴領域32Dの各々に、ラベル“L1”〜“L4”の各々を付与する。そして、ラベリング処理部10Bは、ラベリング処理結果を示すラベリング処理結果情報を生成する。

図4(C)は、ラベリング処理結果情報34の一例を示す模式図である。ラベリング処理結果情報34は、特徴領域32(特徴領域32A〜特徴領域32D)の各々の、ラベルを示すラベル情報(ラベル“L1”〜“L4”)と、画像データ30における位置を示す位置情報(例えば、X座標、Y座標)と、大きさを示す大きさ情報と、を含む。

特徴領域32の大きさを示す大きさ情報は、特徴領域32の面積、特徴領域32の予め定めた方向の長さ、の少なくとも一方を含む。特徴領域32の予め定めた方向の長さは、例えば、X方向(ラベリング処理に走査型を用いる場合には走査方向)と、X方向に直交するY方向と、の少なくとも一方の長さである。

本実施の形態では、ラベリング処理結果情報34は、特徴領域32の大きさを示す大きさ情報として、特徴領域32の面積、特徴領域32のX方向の長さ、および、特徴領域32のY方向の長さ、を含む場合を一例として説明する。

図3に戻り説明を続ける。ラベリング処理部10Bは、ラベリング処理結果情報34(図4(C)参照)を、生成部10Dおよび出力部10Gへ出力する。

第1のバッファ部10Cは、情報処理装置の調整部に相当する。第1のバッファ部10Cは、取得部10Aから取得した画像データを一時的に保存し、生成部10Dへ出力する出力タイミングを調整する。詳細には、第1のバッファ部10Cは、ラベリング処理部10Bがラベリング処理結果情報34を生成部10Dへ出力するときに、該ラベリング処理結果情報34の導出に用いた画像データ30(同じフレームの画像データ30)を、生成部10Dへ出力する。

このため、生成部10Dは、第1のバッファ部10Cから画像データを取得するタイミングで、該画像データ30のラベリング処理結果情報34をラベリング処理部10Bから取得する。このため、第1のバッファ部10Cは、ラベリング処理部10Bと生成部10Dとの処理時間のずれを調整することができる。

生成部10Dは、取得部10Aから第1のバッファ部10Cを介して取得した画像データ30と、ラベリング処理結果情報34と、に基づいて、マスクデータを生成する。

図5は、マスクデータの生成の一例の説明図である。生成部10Dは、例えば、生成部10Dが、図5(A)に示すラベリング処理結果情報34をラベリング処理部10Bから取得したと仮定する。

ラベリング処理結果情報34は、上述したように、特徴領域32(特徴領域32A〜特徴領域32D)の各々の、ラベルを示すラベル情報(ラベル“L1”〜“L4”)と、画像データ30における位置を示す位置情報(例えば、X座標、Y座標)と、大きさを示す大きさ情報と、を含む。

まず、生成部10Dは、画像データ30(図4(A)参照)の画像における、ラベリング処理結果情報34に示される特徴領域32以外の第1のマスク領域M1を特定する(図5(B)参照)。

生成部10Dは、画像データ30を、特徴領域32と、特徴領域32以外の背景領域と、に二値化する。そして、生成部10Dは、二値化した画像データ30における、特徴領域32以外の領域(すなわち背景領域)を、第1のマスク領域M1として特定する。図5(B)に示す例では、画像データ30における、特徴領域32A〜特徴領域32D以外の領域が、第1のマスク領域M1として特定される。

次に、生成部10Dは、ラベリング処理結果情報34に示される特徴領域32の大きさに応じて、第2のマスク領域M2を選択する。

例えば、生成部10Dは、画像データ30の画像における特徴領域32(特徴領域32A〜特徴領域32D)の内、面積が第2の閾値以下の大きさの特徴領域32を、第2のマスク領域M2として選択する。特徴領域32の各々の面積は、ラベリング処理結果情報34から読取ればよい。この第2の閾値は、処理対象の画像データや、電子黒板12が行う画像処理の内容に応じて、予め設定すればよい。また、第2の閾値は、ユーザによる操作指示などによって変更可能としてもよい。

例えば、特徴領域32A〜特徴領域32Dの内、特徴領域32A〜特徴領域32Cの面積が第2の閾値以下の大きさであったとする。この場合、生成部10Dは、特徴領域32A〜特徴領域32C(すなわち、特徴領域32D以外の特徴領域32)を、第2のマスク領域M2として選択する。

また、生成部10Dは、画像データ30の画像における特徴領域32(特徴領域32A〜特徴領域32D)の内、予め定めた方向の長さが第3の閾値以下の大きさの特徴領域32を、第2のマスク領域M2として選択してもよい。

特徴領域32の各々の予め定めた方向の長さは、ラベリング処理結果情報34から読取ればよい。また、第2のマスク領域M2の選択に用いる方向(X方向、Y方向)に何れの方向を用いるかについては、処理対象の画像データや画像処理の内容に応じて、予め設定すればよい。また、第3の閾値は、処理対象の画像データや電子黒板12が行う画像処理の内容に応じて、予め設定すればよい。また、第2のマスク領域M2の選択に用いる方向や第2の閾値は、ユーザによる操作指示などによって変更可能としてもよい。

例えば、特徴領域32A〜特徴領域32Dの内、特徴領域32A〜特徴領域32CのX方向の長さが第3の閾値以下の大きさであったとする。この場合、生成部10Dは、特徴領域32A〜特徴領域32C(すなわち、特徴領域32D以外の特徴領域32)を、第2のマスク領域M2として選択する。

また、生成部10Dは、画像データ30の画像における複数の特徴領域32(特徴領域32A〜特徴領域32D)の内、最も大きい特徴領域32以外の特徴領域32を、第2のマスク領域M2として選択してもよい。

例えば、特徴領域32A〜特徴領域32Dの内、最も大きい特徴領域32が特徴領域32Dであったとする。この場合、生成部10Dは、特徴領域32A〜特徴領域32C(すなわち、最も大きい特徴領域32D以外の特徴領域32)を、第2のマスク領域M2として選択する。

そして、生成部10Dは、画像データ30の画像における、特定した第1のマスク領域M1と、選択した第2のマスク領域M2と、を覆うマスクデータMを生成する(図5(C)参照)。このため、マスクデータMは、画像データ30の画像における、特徴領域32以外の領域と、画像データ30に含まれる特徴領域32における選択された特徴領域32と、の双方を覆うものとなる。言い換えると、マスクデータMは、画像データ30の画像における、第2のマスク領域M2として選択された特徴領域32以外の特徴領域32(特徴領域32D)を除く領域を、マスクしたデータである。

図3に戻り、説明を続ける。生成部10Dは、生成したマスクデータMを、特定部10Fへ出力する。

第2のバッファ部10Eは、取得部10Aから取得した画像データを一時的に保存し、特定部10Fへ出力する出力タイミングを調整する。詳細には、第2のバッファ部10Eは、生成部10DがマスクデータMを特定部10Fへ出力するときに、該マスクデータMの生成に用いた画像データ30(同じフレームの画像データ30)を、特定部10Fへ出力する。

このため、特定部10Fは、第2のバッファ部10Eから画像データ30を取得するタイミングで、生成部10Dから該画像データ30のマスクデータMを生成部10Dから取得する。このため、第2のバッファ部10Eは、生成部10Dと特定部10Fとの処理時間のずれを調整することができる。

特定部10Fは、画像データ30における、マスクデータMによって覆われる第1のマスク領域M1および第2のマスク領域M2以外の領域を、画像処理対象の有効領域として特定する。

図6は、有効領域Eの特定の一例の説明図である。例えば、特定部10Fは、画像データ30を第2のバッファ部10Eから取得する(図6(A)、図4(A)参照)。また、特定部10Fは、該画像データ30のマスクデータMを生成部10Dから取得する(図6(B)、図5(C)参照)。

特定部10Fは、画像データ30上にマスクデータMを重畳し、画像データ30における、マスクデータMによって覆われていない領域である特徴領域32Dを、有効領域Eとして特定する(図6(C)参照)。

本実施の形態では、特徴領域32Dは、縁部18の反射領域である領域30Dに相当し、指や指示部材20による影Pが含まれる。

図3に戻り、特定部10Fは、第2のバッファ部10Eから取得した画像データ30と、特定した有効領域Eを示す有効領域情報と、を、出力部10Gへ出力する。出力部10Gは、ラベリング処理部10Bから取得したラベリング処理結果情報34と、特定部10Fから取得した画像データ30と、特定した有効領域Eを示す有効領域情報と、を外部装置28へ出力する。

外部装置28は、画像データ30における有効領域Eについて画像処理を行う装置である。本実施の形態では、外部装置28は、電子黒板12である場合を説明する。

電子黒板12の画像処理部15では、画像データ30における、有効領域情報によって示される有効領域Eについて画像処理を行い、有効領域Eにおける影Pの位置を、操作位置を示す位置情報として用いる。そして、例えば、画像処理部15は、該位置情報によって示される操作位置を示す点画像を、表示画像に重畳し、電子黒板12の表示面16へ表示する。

このため、電子黒板12などの外部装置28では、画像データ30における、画像処理に用いない不要領域の除去などの処理を行うことなく、画像処理対象として特定された有効領域Eを用いて、画像処理を行うことができる。

次に、情報処理装置10が実行する情報処理の手順の一例を説明する。図7は、情報処理装置10が実行する情報処理の手順の一例を示す、フローチャートである。

まず、取得部10Aが画像データ30を取得する(ステップS100)。ステップS100では、1フレーム分の画像データ30を取得したと仮定する。次に、取得部10Aは、ステップS100で取得した画像データ30を、ラベリング処理部10B、第1のバッファ部10C、および第2のバッファ部10Eへ出力する(ステップS102)。

次に、ラベリング処理部10Bが、取得部10Aから取得した画像データ30にラベリング処理を行う(ステップS104)。次に、ラベリング処理部10Bは、ステップS104のラベリング処理結果を示すラベリング処理結果情報34を、生成部10Dおよび出力部10Gの各々へ出力する(ステップS106)。

第1のバッファ部10Cは、ステップS102で取得部10Aから取得した画像データ30を、生成部10Dへ出力する(ステップS108)。

次に、生成部10Dは、画像データ30を、ラベリング処理結果情報34に示される特徴領域32と、特徴領域32以外の背景領域と、に二値化する(ステップS110)。そして、生成部10Dは、二値化した画像データ30における、特徴領域32以外の領域(すなわち背景領域)を、第1のマスク領域M1として特定する(ステップS112)(図5(B)参照)。

次に、生成部10Dは、ラベリング処理結果情報34に示される特徴領域32の大きさに応じて、第2のマスク領域M2を選択する(ステップS114)。上述したように、生成部10Dは、面積が第2の閾値以下の大きさの特徴領域32、予め定めた方向の長さが第3の閾値以下の大きさの特徴領域32、または、最も大きい特徴領域32以外の特徴領域32を、第2のマスク領域M2として選択する。

次に、生成部10Dは、画像データ30の画像における、ステップS112で特定した第1のマスク領域M1と、ステップS114で選択した第2のマスク領域M2と、を覆うマスクデータMを生成する(ステップS116)。すなわち、第1のマスク領域M1と第2のマスク領域M2とからなるマスクデータMを生成する。

次に、生成部10Dは、ステップS116で生成したマスクデータMを、特定部10Fへ出力する(ステップS118)。すると、第2のバッファ部10Eは、取得部10Aから取得した画像データ30であって、該マスクデータMの生成に用いた画像データ30を、特定部10Fへ出力する(ステップS120)。

次に、特定部10Fが、ステップS120で取得した画像データ30における、ステップS118で取得したマスクデータMによって覆われる第1のマスク領域M1および第2のマスク領域M2以外の領域を、画像処理対象の有効領域Eとして特定する(ステップS122)。

そして、出力部10Gが、ステップS102で取得したラベリング処理結果情報34と、特定部10Fから取得した画像データ30と、特定した有効領域Eを示す有効領域情報と、を外部装置28(電子黒板12)へ出力する(ステップS124)。外部装置28(電子黒板12)は、画像データ30における有効領域Eについて画像処理を行う。そして、本ルーチンを終了する。

以上説明したように、本実施の形態の情報処理装置10は、取得部10Aと、ラベリング処理部10Bと、生成部10Dと、特定部10Fと、を備える。取得部10Aは、画像データ30を取得する。ラベリング処理部10Bは、画像データ30の画像における、第1の閾値以上の輝度値の特徴領域32の各々にラベルを付与する。生成部10Dは、画像データ30の画像における、特徴領域32以外の第1のマスク領域M1と、特徴領域32の大きさに応じて選択した第2のマスク領域M2と、を覆うマスクデータMを生成する。特定部10Fは、画像データ30における、マスクデータMによって覆われる第1のマスク領域M1および第2のマスク領域M2以外の領域を、画像処理対象の有効領域Eとして特定する。

このように、本実施の形態の情報処理装置10は、特徴領域32以外の第1のマスク領域M1と、特徴領域32の大きさに応じて選択した第2のマスク領域M2と、を覆うマスクデータMを生成する。そして、情報処理装置10は、画像データ30における、第1のマスク領域M1および第2のマスク領域M2以外の領域を、有効領域Eとして特定する。

従って、本実施の形態の情報処理装置10では、画像データ30における、画像処理対象の有効領域Eを容易に特定することができる。

ここで、従来の方法では、特定した有効領域に、画像処理に用いない不要な不要領域が含まれる場合があった。一方、本実施の形態の情報処理装置10では、ラベリング処理部10Bによるラベリング処理結果を用いることによって、不要領域(例えば、第2のマスク領域M2)を容易に特定する。そして、情報処理装置10は、第1のマスク領域M1と第2のマスク領域M2とを、マスクデータMとして特定する。

このため、本実施の形態の情報処理装置10では、画像データ30における、画像処理対象の有効領域Eを容易に特定することができる。

また、生成部10Dは、画像データ30の画像における特徴領域32の内、面積が第2の閾値以下の大きさの特徴領域32を、第2のマスク領域M2として選択する。

また、生成部10Dは、画像データ30の画像における特徴領域32の内、予め定めた方向(X方向、Y方向)の長さが第3の閾値以下の大きさの特徴領域32を、第2のマスク領域M2として選択する。

また、生成部10Dは、画像データ30の画像における複数の特徴領域32の内、最も大きい特徴領域32以外の特徴領域32を、第2のマスク領域M2として選択する。

また、情報処理装置10は、第1のバッファ部10C(調整部)を備える。第1のバッファ部10Cは、取得部10Aが取得した画像データ30を生成部10Dへ出力する出力タイミングを調整する。ラベリング処理部10Bは、取得部10Aが取得した画像データ30における特徴領域32の各々にラベルを付与したラベリング処理結果を示すラベリング処理結果情報34を生成部10Dへ出力する。第1のバッファ部10C(調整部)は、ラベリング処理部10Bがラベリング処理結果情報34を生成部10Dへ出力するときに、該画像データ30を生成部10Dへ出力する。生成部10Dは、ラベリング処理結果情報34に基づいて、該画像データ30からマスクデータMを生成する。

本実施の形態の情報処理方法は、画像データ30を取得するステップと、画像データ30の画像における、第1の閾値以上の輝度値の特徴領域32の各々にラベルを付与するステップと、画像データ30の画像における、特徴領域32以外の第1のマスク領域M1と、特徴領域32の大きさに応じて選択した第2のマスク領域M2と、を覆うマスクデータMを生成するステップと、画像データ30における、マスクデータMによって覆われる第1のマスク領域M1および第2のマスク領域M2以外の領域を、画像処理対象の有効領域Eとして特定するステップと、を含む。

本実施の形態の情報処理プログラムは、画像データ30を取得するステップと、画像データ30の画像における、第1の閾値以上の輝度値の特徴領域32の各々にラベルを付与するステップと、画像データ30の画像における、特徴領域32以外の第1のマスク領域M1と、特徴領域32の大きさに応じて選択した第2のマスク領域M2と、を覆うマスクデータMを生成するステップと、画像データ30における、マスクデータMによって覆われる第1のマスク領域M1および第2のマスク領域M2以外の領域を、画像処理対象の有効領域Eとして特定するステップと、をコンピュータに実行させるための情報処理プログラムである。

なお、本実施の形態では、特定部10Fが特定した有効領域Eを用いて画像処理を行う外部装置28が、電子黒板12である場合を一例として説明した。しかし、情報処理装置10が、有効領域Eを用いて画像処理を行う画像処理部を備えた構成であってもよい。また、画像処理を行う外部装置28は、電子黒板12に限定されない。外部装置28は、各種の画像処理を行う公知の装置または機能部であればよい。例えば、外部装置28は、プロジェクタや電子会議システムなどであってもよい。

なお、上述した実施の形態における、情報処理装置10で実行する上記処理を実行するためのプログラムは、インストール可能な形式または実行可能な形式のファイルでCD−ROM、フレキシブルディスク(FD)、CD−R、DVD(Digital Versatile Disk)、USB(Universal Serial Bus)メモリ等のコンピュータで読み取り可能な記録媒体に記録して提供するように構成してもよいし、インターネット等のネットワーク経由で提供または配布するように構成してもよい。また、各種プログラムを、ROM等に予め組み込んで提供するように構成してもよい。

なお、上記には、実施の形態を説明したが、上記実施の形態は、例として提示したものであり、発明の範囲を限定することは意図していない。上記新規な実施の形態は、その他の様々な形態で実施されることが可能であり、発明の要旨を逸脱しない範囲で、種々の省略、置き換え、変更を行うことができる。上記実施の形態および変形例は、発明の範囲や要旨に含まれるとともに、特許請求の範囲に記載された発明とその均等の範囲に含まれる。

10 情報処理装置

10A 取得部

10B ラベリング処理部

10C 第1のバッファ部

10D 生成部

10F 特定部

10A 取得部

10B ラベリング処理部

10C 第1のバッファ部

10D 生成部

10F 特定部

Claims (7)

- 画像データを取得する取得部と、

前記画像データの画像における、第1の閾値以上の輝度値の特徴領域の各々にラベルを付与するラベリング処理部と、

前記画像データの画像における、前記特徴領域以外の第1のマスク領域と、前記特徴領域の大きさに応じて選択した第2のマスク領域と、を覆うマスクデータを生成する生成部と、

前記画像データにおける、前記マスクデータによって覆われる前記第1のマスク領域および前記第2のマスク領域以外の領域を、画像処理対象の有効領域として特定する特定部と、

を備える情報処理装置。 - 前記生成部は、前記画像データの画像における前記特徴領域の内、面積が第2の閾値以下の大きさの前記特徴領域を、前記第2のマスク領域として選択する、請求項1に記載の情報処理装置。

- 前記生成部は、前記画像データの画像における前記特徴領域の内、予め定めた方向の長さが第3の閾値以下の大きさの前記特徴領域を、前記第2のマスク領域として選択する、請求項1に記載の情報処理装置。

- 前記生成部は、前記画像データの画像における複数の前記特徴領域の内、最も大きい前記特徴領域以外の前記特徴領域を、前記第2のマスク領域として選択する、請求項1に記載の情報処理装置。

- 前記取得部が取得した前記画像データを前記生成部へ出力する出力タイミングを調整する調整部を備え、

前記ラベリング処理部は、前記取得部が取得した前記画像データにおける前記特徴領域の各々にラベルを付与したラベリング処理結果を示すラベリング処理結果情報を前記生成部へ出力し、

前記調整部は、前記ラベリング処理部が前記ラベリング処理結果情報を前記生成部へ出力するときに、該画像データを前記生成部へ出力し、

前記生成部は、前記ラベリング処理結果情報に基づいて、該画像データから前記マスクデータを生成する、

請求項1〜請求項4の何れか1項に記載の情報処理装置。 - 画像データを取得するステップと、

前記画像データの画像における、第1の閾値以上の輝度値の特徴領域の各々にラベルを付与するステップと、

前記画像データの画像における、前記特徴領域以外の第1のマスク領域と、前記特徴領域の大きさに応じて選択した第2のマスク領域と、を覆うマスクデータを生成するステップと、

前記画像データにおける、前記マスクデータによって覆われる前記第1のマスク領域および前記第2のマスク領域以外の領域を、画像処理対象の有効領域として特定するステップと、

を含む情報処理方法。 - 画像データを取得するステップと、

前記画像データの画像における、第1の閾値以上の輝度値の特徴領域の各々にラベルを付与するステップと、

前記画像データの画像における、前記特徴領域以外の第1のマスク領域と、前記特徴領域の大きさに応じて選択した第2のマスク領域と、を覆うマスクデータを生成するステップと、

前記画像データにおける、前記マスクデータによって覆われる前記第1のマスク領域および前記第2のマスク領域以外の領域を、画像処理対象の有効領域として特定するステップと、

をコンピュータに実行させるための情報処理プログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016085167A JP2017194856A (ja) | 2016-04-21 | 2016-04-21 | 情報処理装置、情報処理方法、および情報処理プログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016085167A JP2017194856A (ja) | 2016-04-21 | 2016-04-21 | 情報処理装置、情報処理方法、および情報処理プログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2017194856A true JP2017194856A (ja) | 2017-10-26 |

Family

ID=60154815

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016085167A Pending JP2017194856A (ja) | 2016-04-21 | 2016-04-21 | 情報処理装置、情報処理方法、および情報処理プログラム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2017194856A (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE112018004418T5 (de) | 2017-10-05 | 2020-05-20 | Kyb Corporation | Druck-feste Vorrichtung und Fluid-Druck-Zylinder |

-

2016

- 2016-04-21 JP JP2016085167A patent/JP2017194856A/ja active Pending

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE112018004418T5 (de) | 2017-10-05 | 2020-05-20 | Kyb Corporation | Druck-feste Vorrichtung und Fluid-Druck-Zylinder |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US11948282B2 (en) | Image processing apparatus, image processing method, and storage medium for lighting processing on image using model data | |

| EP3537378B1 (en) | Image processing apparatus and method for object boundary stabilization in an image of a sequence of images | |

| JP6844692B2 (ja) | 学習データ生成装置、学習データ生成方法、およびプログラム | |

| US9767612B2 (en) | Method, system and apparatus for removing a marker projected in a scene | |

| US9710872B2 (en) | Information insertion method, information extraction method, and information extraction apparatus using dot-based information robust to geometric distortion | |

| JP5560721B2 (ja) | 画像処理装置、画像表示システム、及び画像処理方法 | |

| US20150054974A1 (en) | TEMPORALLY COHERENT SEGMENTATION OF RGBt VOLUMES WITH AID OF NOISY OR INCOMPLETE AUXILIARY DATA | |

| JP2005072888A (ja) | 画像投影方法、及び画像投影装置 | |

| JP6337614B2 (ja) | 制御装置、ロボット、及び制御方法 | |

| JP7010209B2 (ja) | 画像処理装置および方法 | |

| US10254893B2 (en) | Operating apparatus, control method therefor, and storage medium storing program | |

| WO2020251695A1 (en) | Correction for pixel-to-pixel signal diffusion | |

| JP2018006981A5 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| JPWO2011142313A1 (ja) | 物体認識装置、方法、プログラム、および該ソフトウェアを格納したコンピュータ可読媒体 | |

| JP6530432B2 (ja) | 画像処理装置、画像処理方法及びプログラム | |

| JP6953178B2 (ja) | 画像処理装置、画像処理方法、プログラム | |

| JP2017194856A (ja) | 情報処理装置、情報処理方法、および情報処理プログラム | |

| JP2016057194A (ja) | 情報処理装置、情報処理方法、プログラム | |

| JP2015170206A (ja) | 検出装置および検出方法 | |

| US20200244937A1 (en) | Image processing apparatus and method, and program | |

| US10116809B2 (en) | Image processing apparatus, control method, and computer-readable storage medium, which obtains calibration image information with which to correct image data | |

| JP2019016843A (ja) | 原稿読取装置、原稿読取装置の制御方法、及びプログラム | |

| US9454247B2 (en) | Interactive writing device and operating method thereof using adaptive color identification mechanism | |

| JP2018081424A (ja) | 画像処理装置および画像処理方法 | |

| JP2017220880A (ja) | 投影装置及び投影方法 |