JP2010014836A - 表示装置及び表示方法 - Google Patents

表示装置及び表示方法 Download PDFInfo

- Publication number

- JP2010014836A JP2010014836A JP2008173006A JP2008173006A JP2010014836A JP 2010014836 A JP2010014836 A JP 2010014836A JP 2008173006 A JP2008173006 A JP 2008173006A JP 2008173006 A JP2008173006 A JP 2008173006A JP 2010014836 A JP2010014836 A JP 2010014836A

- Authority

- JP

- Japan

- Prior art keywords

- user

- monitor

- enhancement processing

- line

- video information

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/44—Receiver circuitry for the reception of television signals according to analogue transmission standards

- H04N5/57—Control of contrast or brightness

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G5/00—Control arrangements or circuits for visual indicators common to cathode-ray tube indicators and other visual indicators

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/41—Structure of client; Structure of client peripherals

- H04N21/422—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS]

- H04N21/4223—Cameras

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/431—Generation of visual interfaces for content selection or interaction; Content or additional data rendering

- H04N21/4318—Generation of visual interfaces for content selection or interaction; Content or additional data rendering by altering the content in the rendering process, e.g. blanking, blurring or masking an image region

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/442—Monitoring of processes or resources, e.g. detecting the failure of a recording device, monitoring the downstream bandwidth, the number of times a movie has been viewed, the storage space available from the internal hard disk

- H04N21/44213—Monitoring of end-user related data

- H04N21/44218—Detecting physical presence or behaviour of the user, e.g. using sensors to detect if the user is leaving the room or changes his face expression during a TV program

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/44—Receiver circuitry for the reception of television signals according to analogue transmission standards

- H04N5/52—Automatic gain control

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/66—Transforming electric information into light information

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2320/00—Control of display operating conditions

- G09G2320/06—Adjustment of display parameters

- G09G2320/0686—Adjustment of display parameters with two or more screen areas displaying information with different brightness or colours

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2354/00—Aspects of interface with display user

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Health & Medical Sciences (AREA)

- Social Psychology (AREA)

- General Health & Medical Sciences (AREA)

- Computer Hardware Design (AREA)

- Theoretical Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Physics & Mathematics (AREA)

- Computer Networks & Wireless Communication (AREA)

- Databases & Information Systems (AREA)

- User Interface Of Digital Computer (AREA)

- Two-Way Televisions, Distribution Of Moving Picture Or The Like (AREA)

- Position Input By Displaying (AREA)

- Image Processing (AREA)

- Transforming Electric Information Into Light Information (AREA)

- Controls And Circuits For Display Device (AREA)

- Image Analysis (AREA)

Abstract

【解決手段】表示装置10は、ユーザ映像情報を解析してユーザの視線を検出する視線検出部120と、視線検出部120が検出したユーザの視線とモニタ19の映像表示面との交点をユーザが注目している点である注目点として検出し、注目点との距離が大きい位置から小さい位置に向けて段階的に高いゲイン量を設定することでモニタ19に対するエンハンス処理を行うエンハンス処理部160と、エンハンス処理部160が設定したゲイン量と表示映像情報入力部150が入力を受け付けた表示映像情報とに基づいて、モニタ19を介して映像を出力する表示映像出力制御部170と、を備える。

【選択図】図3

Description

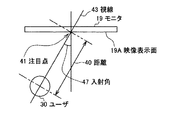

先ず、本実施形態に対する理解を容易とするために、本実施形態の概要について説明する。

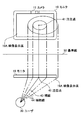

図3は、本実施形態に係る表示装置の機能構成を示す機能構成図である。図3を参照して(適宜図1及び図2参照)、本実施形態に係る表示装置の機能構成について説明する。

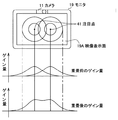

図4は、本実施形態に係るエンハンス処理部が行うエンハンス処理の一例(その1)を模式的に示す図である。図4を参照して、本実施形態に係るエンハンス処理部が行うエンハンス処理の一例について説明する。

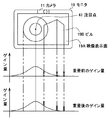

図8は、本実施形態に係るユーザ位置検出部が行うユーザ位置検出処理の一例を模式的に示す図である。図8を参照して(適宜他の図参照)、本実施形態に係るユーザ位置検出部が行うユーザ位置検出処理の一例について説明する。

図9は、本実施形態に係る距離算出部が行う距離算出処理の一例を模式的に示す図である。図9を参照して、本実施形態に係る距離算出部が行う距離算出処理の一例について説明する。

図10は、ユーザが複数存在する場合について説明するための図である。図10を参照して、ユーザが複数存在する場合について説明する。

図12は、本実施形態に係る表示装置が実行する処理の流れを示すフローチャートである。図12を参照して(適宜他の図参照)、本実施形態に係る表示装置が実行する処理の流れについて説明する。なお、ここでは、ユーザ30がn人存在する場合を想定している。

図13は、カメラが複数存在する場合について説明するための図である。図13を参照して、カメラが複数存在する場合について説明する。

図14は、既存方式と本実施形態による方式とを組み合わせる場合について説明するための図である。図14を参照して、既存方式と本実施形態による方式とを組み合わせる場合について説明する。

11 カメラ

12 チューナ

19 モニタ

19A 映像表示面

19B ビル

30 ユーザ

40 距離

41 注目点

43 視線

44 補助線

47 入射角

50 基準線

110 ユーザ映像情報入力部

120 視線検出部

130 ユーザ位置検出部

140 距離算出部

150 表示映像情報入力部

160 エンハンス処理部

170 表示映像出力制御部

Claims (10)

- モニタに表示される映像のもとになる表示映像情報の入力を受け付ける表示映像情報入力部と、

カメラによって取得された、前記モニタに表示される映像を見るユーザの映像情報であるユーザ映像情報の入力を受け付けるユーザ映像情報入力部と、

前記ユーザ映像情報入力部が入力を受け付けた前記ユーザ映像情報を解析して当該ユーザの視線を検出する視線検出部と、

前記視線検出部が検出した前記ユーザの視線と前記モニタの映像表示面との交点を前記ユーザが注目している点である注目点として検出し、当該注目点との距離が大きい位置から小さい位置に向けて段階的に高いゲイン量を設定することで前記モニタに対するエンハンス処理を行うエンハンス処理部と、

前記エンハンス処理部が設定した前記ゲイン量と前記表示映像情報入力部が入力を受け付けた前記表示映像情報とに基づいて、前記モニタを介して映像を出力する表示映像出力制御部と、

を備える、表示装置。 - 前記エンハンス処理部は、

前記注目点を中心とした1または複数の同心円によって区分けされる複数の領域のうち、前記注目点との距離が大きい領域から小さい領域に向けて段階的に高いゲイン量を設定することで、前記注目点との距離が大きい位置から小さい位置に向けて段階的に高いゲイン量を設定する、

請求項1に記載の表示装置。 - 前記エンハンス処理部は、

前記1または複数の同心円のそれぞれの半径が、所定の長さを増分として前記注目点との距離を順次に増加させたものであるとして、前記ゲイン量を設定する、

請求項2に記載の表示装置。 - 前記エンハンス処理部は、

前記所定の長さが前記モニタを構成する隣り合う画素間の距離以下であるとして、前記ゲイン量を設定する、

請求項3に記載の表示装置。 - 前記エンハンス処理部は、

前記注目点を中心とした1または複数の同心円が、前記モニタの縦横比と一致する比率を長軸短軸比とする楕円であるとして、前記ゲイン量を設定する、

請求項2に記載の表示装置。 - 前記ユーザの位置を検出するユーザ位置検出部をさらに備え、

前記エンハンス処理部は、

前記ユーザ位置検出部が検出した前記ユーザの位置を基準点として前記ユーザの視線と所定の角度をなす直線群と前記モニタの映像表示面との交点の集合を境界とし、前記角度を1または複数設定することで、前記境界によって前記モニタを複数の領域に区分けし、当該複数の領域のうち、前記注目点との距離が大きい領域から小さい領域に向けて段階的に高いゲイン量を設定することで、前記注目点との距離が大きい位置から小さい位置に向けて段階的に高いゲイン量を設定する、

請求項1に記載の表示装置。 - 前記エンハンス処理部は、

前記1または複数の角度のそれぞれが、所定の角度を増分として前記視線となす角度を順次に増加させたものであるとして、前記ゲイン量を設定する

請求項6に記載の表示装置。 - 前記モニタと前記ユーザとの距離を算出する距離算出部をさらに備え、

前記エンハンス処理部は、

前記距離算出部が算出した前記モニタと前記ユーザとの距離が大きくなるにしたがって、段階的に高いゲイン量を設定することで前記モニタに対するエンハンス処理を行う、

請求項1乃至請求項7のいずれか1項に記載の表示装置。 - 前記視線検出部は、

複数の視線を複数のユーザそれぞれの視線として検出することで、前記ユーザの視線を検出し、

前記エンハンス処理部は、

前記視線検出部が検出した前記複数のユーザそれぞれの視線と前記モニタの映像表示面との交点を前記複数のユーザそれぞれが注目している点である各注目点として検出し、当該各注目点から遠い位置から近い位置に向けて段階的に高いゲイン量をそれぞれ設定し、当該ゲイン量を各注目点について重ね合わせることで、前記エンハンス処理を行う、

請求項1乃至請求項7のいずれか1項に記載の表示装置。 - 表示映像情報入力部が、モニタに表示される映像のもとになる表示映像情報の入力を受け付けるステップと、

ユーザ映像情報入力部が、カメラによって取得された、前記モニタに表示される映像を見るユーザの映像情報であるユーザ映像情報の入力を受け付けるステップと、

視線検出部が、前記ユーザ映像情報入力部が入力を受け付けた前記ユーザ映像情報を解析して当該ユーザの視線を検出するステップと、

エンハンス処理部が、前記視線検出部が検出した前記ユーザの視線と前記モニタの映像表示面との交点を前記ユーザが注目している点である注目点として検出し、当該注目点との距離が大きい位置から小さい位置に向けて段階的に高いゲイン量を設定することで前記モニタに対するエンハンス処理を行うステップと、

表示映像出力制御部が、前記エンハンス処理部が設定した前記ゲイン量と前記表示映像情報入力部が入力を受け付けた前記表示映像情報とに基づいて、前記モニタを介して映像を出力するステップと、

を含む、表示方法。

Priority Applications (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2008173006A JP4743234B2 (ja) | 2008-07-02 | 2008-07-02 | 表示装置及び表示方法 |

| US12/459,449 US8619195B2 (en) | 2008-07-02 | 2009-07-01 | Display apparatus and display method |

| EP09164394.0A EP2141921B1 (en) | 2008-07-02 | 2009-07-02 | Display apparatus and display method |

| CN2009101396823A CN101635861B (zh) | 2008-07-02 | 2009-07-02 | 显示装置和显示方法 |

| US14/080,075 US8994883B2 (en) | 2008-07-02 | 2013-11-14 | Display apparatus and display method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2008173006A JP4743234B2 (ja) | 2008-07-02 | 2008-07-02 | 表示装置及び表示方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2010014836A true JP2010014836A (ja) | 2010-01-21 |

| JP4743234B2 JP4743234B2 (ja) | 2011-08-10 |

Family

ID=41172316

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2008173006A Expired - Fee Related JP4743234B2 (ja) | 2008-07-02 | 2008-07-02 | 表示装置及び表示方法 |

Country Status (4)

| Country | Link |

|---|---|

| US (2) | US8619195B2 (ja) |

| EP (1) | EP2141921B1 (ja) |

| JP (1) | JP4743234B2 (ja) |

| CN (1) | CN101635861B (ja) |

Cited By (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2013254358A (ja) * | 2012-06-07 | 2013-12-19 | Sony Corp | 画像処理装置、画像処理方法およびプログラム |

| KR20150026564A (ko) * | 2013-09-03 | 2015-03-11 | 엘지전자 주식회사 | 입력 모듈 및 이를 구비한 영상표시기기 |

| JP2019049705A (ja) * | 2017-09-11 | 2019-03-28 | アップル インコーポレイテッドApple Inc. | 電子ディスプレイの境界ゲインシステム及び方法 |

| WO2019224868A1 (ja) * | 2018-05-21 | 2019-11-28 | Necディスプレイソリューションズ株式会社 | 表示装置 |

| US10642353B2 (en) | 2017-07-19 | 2020-05-05 | Fujitsu Limited | Non-transitory computer-readable storage medium, information processing apparatus, and information processing method |

| JP2023543557A (ja) * | 2020-10-05 | 2023-10-17 | メタ プラットフォームズ テクノロジーズ, リミテッド ライアビリティ カンパニー | ニアアイディスプレイの光源を駆動する方法 |

| JP2025085790A (ja) * | 2020-12-15 | 2025-06-05 | 株式会社Jvcケンウッド | 表示装置及びその制御方法 |

Families Citing this family (17)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN101894511B (zh) * | 2010-07-15 | 2012-03-14 | 鸿富锦精密工业(深圳)有限公司 | 电子看板 |

| WO2012040392A2 (en) | 2010-09-21 | 2012-03-29 | Cellepathy Ltd. | System and method for sensor-based determination of user role, location, and/or state of one of more in-vehicle mobile devices and enforcement of usage thereof |

| WO2013043228A1 (en) * | 2011-09-21 | 2013-03-28 | Cellepathy Ltd. | Restricting mobile device usage |

| US11070661B2 (en) | 2010-09-21 | 2021-07-20 | Cellepathy Inc. | Restricting mobile device usage |

| US9800716B2 (en) | 2010-09-21 | 2017-10-24 | Cellepathy Inc. | Restricting mobile device usage |

| CN102572217B (zh) * | 2011-12-29 | 2014-08-20 | 华为技术有限公司 | 基于视觉关注的多媒体处理方法及装置 |

| US9691115B2 (en) | 2012-06-21 | 2017-06-27 | Cellepathy Inc. | Context determination using access points in transportation and other scenarios |

| KR102111407B1 (ko) * | 2013-08-19 | 2020-05-15 | 엘지전자 주식회사 | 디스플레이 장치 및 그 동작방법 |

| KR102244620B1 (ko) * | 2014-09-05 | 2021-04-26 | 삼성전자 주식회사 | 렌더링 수준 제어 방법 및 장치 |

| US10375344B2 (en) | 2014-10-24 | 2019-08-06 | Dish Ukraine L.L.C. | Display device viewing angle compensation |

| CN106060658B (zh) * | 2016-05-27 | 2019-06-14 | 青岛海信电器股份有限公司 | 一种图像处理方法及装置 |

| US10714049B2 (en) | 2016-06-06 | 2020-07-14 | Apple Inc. | Electronic display border gain systems and methods |

| EP3846418B1 (en) * | 2017-06-03 | 2023-12-20 | Apple Inc. | Attention detection service |

| US10642335B2 (en) | 2017-06-03 | 2020-05-05 | Apple Inc. | Attention detection service |

| CN113115086B (zh) * | 2021-04-16 | 2023-09-19 | 浙江闪链科技有限公司 | 基于视频视线识别对电梯媒体收视信息进行采集的方法 |

| US11727892B1 (en) | 2022-11-09 | 2023-08-15 | Meta Platforms Technologies, Llc | Eye-tracking based foveation control of displays |

| CN116189158B (zh) * | 2023-03-10 | 2026-01-30 | 深圳市天双科技有限公司 | 一种基于2d数据进行视线估计的方法 |

Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH04192762A (ja) * | 1990-11-26 | 1992-07-10 | Mitsubishi Electric Corp | カラーテレビジョン受像機 |

| JPH10282877A (ja) * | 1997-04-08 | 1998-10-23 | Canon Inc | 画像生成方法、画像生成装置、シュミレーションシステム、及び記憶媒体 |

| JP2000132152A (ja) * | 1998-10-27 | 2000-05-12 | Sharp Corp | 表示装置 |

| JP2002055675A (ja) * | 1999-09-17 | 2002-02-20 | Matsushita Electric Ind Co Ltd | 画像表示装置 |

| JP2002116728A (ja) * | 2000-10-10 | 2002-04-19 | Matsushita Electric Ind Co Ltd | 表示装置 |

| JP2002175067A (ja) * | 2000-12-05 | 2002-06-21 | Nissan Motor Co Ltd | 自動車用表示装置 |

| JP2003202850A (ja) * | 2001-10-04 | 2003-07-18 | Eastman Kodak Co | 画像表示方法及びシステム |

| JP2005208182A (ja) * | 2004-01-21 | 2005-08-04 | Sony Corp | 表示制御装置および方法、記録媒体、並びにプログラム |

| JP2005315956A (ja) * | 2004-04-27 | 2005-11-10 | Pioneer Electronic Corp | 表示器駆動装置及び駆動方法 |

Family Cites Families (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US2008301A (en) * | 1933-09-25 | 1935-07-16 | Stanley F Gleason | Meat processing and molding device |

| JPH01290385A (ja) | 1988-05-17 | 1989-11-22 | Mitsubishi Electric Corp | テレビジョン受像機 |

| JPH04132487A (ja) | 1990-09-25 | 1992-05-06 | Matsushita Electric Ind Co Ltd | テレビジョン受像機、その制御装置および制御方法 |

| JP2868389B2 (ja) * | 1993-06-14 | 1999-03-10 | 株式会社エイ・ティ・アール通信システム研究所 | 画像表示装置 |

| JPH07287761A (ja) * | 1994-04-19 | 1995-10-31 | Canon Inc | 画像処理装置及び画像処理方法 |

| KR100265164B1 (ko) | 1996-11-08 | 2000-09-15 | 윤종용 | 거리 측정 센서를 이용한 자동 휘도 조정 회로 및 방법 |

| JP2000221953A (ja) | 1999-01-29 | 2000-08-11 | Sony Corp | 映像表示装置、映像処理方法及びこれらを応用した映像表示システム |

| WO2000060855A1 (en) * | 1999-04-06 | 2000-10-12 | Koninklijke Philips Electronics N.V. | Apparatus for processing signals |

| US6954193B1 (en) * | 2000-09-08 | 2005-10-11 | Apple Computer, Inc. | Method and apparatus for correcting pixel level intensity variation |

| JP2004213486A (ja) | 2003-01-07 | 2004-07-29 | Sony Corp | 画像処理装置および方法、記録媒体、並びにプログラム |

| WO2005124735A1 (ja) * | 2004-06-18 | 2005-12-29 | Nec Corporation | 画像表示システム、画像表示方法および画像表示プログラム |

| DE102004057013A1 (de) * | 2004-11-25 | 2006-06-01 | Micronas Gmbh | Videoanzeigegerät und Verfahren zur Verarbeitung eines Videosignals zur Optimierung der Bilddarstellung |

| JP2006235307A (ja) | 2005-02-25 | 2006-09-07 | Toshiba Corp | 表示装置および同装置の表示制御方法 |

| US7697751B2 (en) * | 2005-12-29 | 2010-04-13 | Graphics Properties Holdings, Inc. | Use of ray tracing for generating images for auto-stereo displays |

| US20080316372A1 (en) * | 2007-06-20 | 2008-12-25 | Ning Xu | Video display enhancement based on viewer characteristics |

| JP4858476B2 (ja) | 2008-03-31 | 2012-01-18 | 株式会社日立製作所 | 交流電動機の制御装置 |

-

2008

- 2008-07-02 JP JP2008173006A patent/JP4743234B2/ja not_active Expired - Fee Related

-

2009

- 2009-07-01 US US12/459,449 patent/US8619195B2/en active Active

- 2009-07-02 EP EP09164394.0A patent/EP2141921B1/en active Active

- 2009-07-02 CN CN2009101396823A patent/CN101635861B/zh active Active

-

2013

- 2013-11-14 US US14/080,075 patent/US8994883B2/en active Active

Patent Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH04192762A (ja) * | 1990-11-26 | 1992-07-10 | Mitsubishi Electric Corp | カラーテレビジョン受像機 |

| JPH10282877A (ja) * | 1997-04-08 | 1998-10-23 | Canon Inc | 画像生成方法、画像生成装置、シュミレーションシステム、及び記憶媒体 |

| JP2000132152A (ja) * | 1998-10-27 | 2000-05-12 | Sharp Corp | 表示装置 |

| JP2002055675A (ja) * | 1999-09-17 | 2002-02-20 | Matsushita Electric Ind Co Ltd | 画像表示装置 |

| JP2002116728A (ja) * | 2000-10-10 | 2002-04-19 | Matsushita Electric Ind Co Ltd | 表示装置 |

| JP2002175067A (ja) * | 2000-12-05 | 2002-06-21 | Nissan Motor Co Ltd | 自動車用表示装置 |

| JP2003202850A (ja) * | 2001-10-04 | 2003-07-18 | Eastman Kodak Co | 画像表示方法及びシステム |

| JP2005208182A (ja) * | 2004-01-21 | 2005-08-04 | Sony Corp | 表示制御装置および方法、記録媒体、並びにプログラム |

| JP2005315956A (ja) * | 2004-04-27 | 2005-11-10 | Pioneer Electronic Corp | 表示器駆動装置及び駆動方法 |

Cited By (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2013254358A (ja) * | 2012-06-07 | 2013-12-19 | Sony Corp | 画像処理装置、画像処理方法およびプログラム |

| KR20150026564A (ko) * | 2013-09-03 | 2015-03-11 | 엘지전자 주식회사 | 입력 모듈 및 이를 구비한 영상표시기기 |

| KR102149200B1 (ko) * | 2013-09-03 | 2020-08-28 | 엘지전자 주식회사 | 입력 모듈 및 이를 구비한 영상표시기기 |

| US10642353B2 (en) | 2017-07-19 | 2020-05-05 | Fujitsu Limited | Non-transitory computer-readable storage medium, information processing apparatus, and information processing method |

| JP2019049705A (ja) * | 2017-09-11 | 2019-03-28 | アップル インコーポレイテッドApple Inc. | 電子ディスプレイの境界ゲインシステム及び方法 |

| WO2019224868A1 (ja) * | 2018-05-21 | 2019-11-28 | Necディスプレイソリューションズ株式会社 | 表示装置 |

| JP2023543557A (ja) * | 2020-10-05 | 2023-10-17 | メタ プラットフォームズ テクノロジーズ, リミテッド ライアビリティ カンパニー | ニアアイディスプレイの光源を駆動する方法 |

| JP2025085790A (ja) * | 2020-12-15 | 2025-06-05 | 株式会社Jvcケンウッド | 表示装置及びその制御方法 |

Also Published As

| Publication number | Publication date |

|---|---|

| CN101635861A (zh) | 2010-01-27 |

| CN101635861B (zh) | 2011-06-08 |

| EP2141921B1 (en) | 2021-12-15 |

| US8994883B2 (en) | 2015-03-31 |

| US20100002072A1 (en) | 2010-01-07 |

| JP4743234B2 (ja) | 2011-08-10 |

| US20140071296A1 (en) | 2014-03-13 |

| US8619195B2 (en) | 2013-12-31 |

| EP2141921A1 (en) | 2010-01-06 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP4743234B2 (ja) | 表示装置及び表示方法 | |

| US8908991B2 (en) | Image processing apparatus, image processing method and storage medium | |

| JP6131948B2 (ja) | 表示制御装置、表示制御方法、プログラム | |

| US10317777B2 (en) | Automatic zooming method and apparatus | |

| JP2008269396A (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| WO2017032035A1 (zh) | 调节方法、调节装置和终端 | |

| JP2018073366A (ja) | 画像処理装置、画像処理方法、およびプログラム | |

| JP2017212638A (ja) | 表示装置、表示装置の制御方法、及びプログラム | |

| JP5974205B1 (ja) | 画像処理装置、画像処理装置の作動方法 | |

| TW202345097A (zh) | 對於圖像擷取的建議 | |

| JP2018041201A (ja) | 表示制御プログラム、表示制御方法および情報処理装置 | |

| WO2024174971A1 (zh) | 视频处理方法、装置、设备和存储介质 | |

| JP5482589B2 (ja) | 画像処理装置、画像処理方法および画像処理用プログラム | |

| JP2021056899A (ja) | 画像処理装置、画像処理方法およびプログラム | |

| JP6103942B2 (ja) | 画像データ処理装置及び画像データ処理プログラム | |

| CN106960460A (zh) | 动画处理方法、装置及设备 | |

| TW200920102A (en) | Document camera and its method for sharpening partial image on projected image | |

| JP6347604B2 (ja) | 映像投影装置、映像投影方法及びプログラム | |

| US8212796B2 (en) | Image display apparatus and method, program and recording media | |

| JP5448223B2 (ja) | 画像色変換装置、表示装置、画像色変換方法、画像色変換プログラム | |

| JP2012169735A (ja) | 画像処理装置、画像処理方法及びプログラム | |

| TW201331889A (zh) | 影像處理裝置與方法 | |

| JP2009282736A (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| CN119135865A (zh) | 拍摄方法、装置、设备、介质及产品 | |

| JP6489733B2 (ja) | 画像出力装置、画像出力方法、およびプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20100412 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20100420 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20100618 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20110111 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20110228 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20110412 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20110425 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20140520 Year of fee payment: 3 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 4743234 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20140520 Year of fee payment: 3 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |