CN109124657B - 用于认知和发育状况的检测的系统和方法 - Google Patents

用于认知和发育状况的检测的系统和方法 Download PDFInfo

- Publication number

- CN109124657B CN109124657B CN201810873155.4A CN201810873155A CN109124657B CN 109124657 B CN109124657 B CN 109124657B CN 201810873155 A CN201810873155 A CN 201810873155A CN 109124657 B CN109124657 B CN 109124657B

- Authority

- CN

- China

- Prior art keywords

- subject

- data

- fixation

- target

- operator

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 title claims abstract description 119

- 230000001149 cognitive effect Effects 0.000 title abstract description 31

- 238000001514 detection method Methods 0.000 title abstract description 6

- 230000000007 visual effect Effects 0.000 claims abstract description 86

- 230000004044 response Effects 0.000 claims abstract description 10

- 230000004424 eye movement Effects 0.000 claims description 34

- 230000001755 vocal effect Effects 0.000 claims description 11

- 230000004397 blinking Effects 0.000 claims description 4

- 230000009191 jumping Effects 0.000 claims description 2

- 238000013480 data collection Methods 0.000 abstract description 44

- 238000004458 analytical method Methods 0.000 abstract description 33

- 208000029560 autism spectrum disease Diseases 0.000 abstract description 27

- 238000003745 diagnosis Methods 0.000 abstract description 20

- 238000012544 monitoring process Methods 0.000 abstract description 15

- 238000012216 screening Methods 0.000 abstract description 11

- 238000012956 testing procedure Methods 0.000 abstract description 2

- 238000012545 processing Methods 0.000 description 51

- 230000008569 process Effects 0.000 description 43

- 238000012795 verification Methods 0.000 description 27

- 230000006870 function Effects 0.000 description 19

- 230000018109 developmental process Effects 0.000 description 17

- 238000011161 development Methods 0.000 description 16

- 238000012360 testing method Methods 0.000 description 16

- 238000010586 diagram Methods 0.000 description 15

- 238000000586 desensitisation Methods 0.000 description 9

- 230000009466 transformation Effects 0.000 description 8

- 238000013500 data storage Methods 0.000 description 7

- 230000004886 head movement Effects 0.000 description 7

- 208000006096 Attention Deficit Disorder with Hyperactivity Diseases 0.000 description 6

- 208000036864 Attention deficit/hyperactivity disease Diseases 0.000 description 4

- 208000012239 Developmental disease Diseases 0.000 description 4

- 208000015802 attention deficit-hyperactivity disease Diseases 0.000 description 4

- 238000004590 computer program Methods 0.000 description 4

- 208000035231 inattentive type attention deficit hyperactivity disease Diseases 0.000 description 4

- 208000028173 post-traumatic stress disease Diseases 0.000 description 4

- 230000003997 social interaction Effects 0.000 description 4

- 125000006850 spacer group Chemical group 0.000 description 4

- 230000002159 abnormal effect Effects 0.000 description 3

- 230000006399 behavior Effects 0.000 description 3

- 238000004422 calculation algorithm Methods 0.000 description 3

- 208000010877 cognitive disease Diseases 0.000 description 3

- 238000012937 correction Methods 0.000 description 3

- 238000007405 data analysis Methods 0.000 description 3

- 230000001419 dependent effect Effects 0.000 description 3

- 208000037265 diseases, disorders, signs and symptoms Diseases 0.000 description 3

- 208000035475 disorder Diseases 0.000 description 3

- 230000036541 health Effects 0.000 description 3

- 230000007246 mechanism Effects 0.000 description 3

- 239000002184 metal Substances 0.000 description 3

- 238000012986 modification Methods 0.000 description 3

- 230000004048 modification Effects 0.000 description 3

- 238000012552 review Methods 0.000 description 3

- 230000003068 static effect Effects 0.000 description 3

- 238000012546 transfer Methods 0.000 description 3

- PXFBZOLANLWPMH-UHFFFAOYSA-N 16-Epiaffinine Natural products C1C(C2=CC=CC=C2N2)=C2C(=O)CC2C(=CC)CN(C)C1C2CO PXFBZOLANLWPMH-UHFFFAOYSA-N 0.000 description 2

- 206010012289 Dementia Diseases 0.000 description 2

- 206010019196 Head injury Diseases 0.000 description 2

- 201000006347 Intellectual Disability Diseases 0.000 description 2

- 206010047571 Visual impairment Diseases 0.000 description 2

- 230000004075 alteration Effects 0.000 description 2

- 230000008901 benefit Effects 0.000 description 2

- 238000006243 chemical reaction Methods 0.000 description 2

- 230000009514 concussion Effects 0.000 description 2

- 230000000875 corresponding effect Effects 0.000 description 2

- 238000003066 decision tree Methods 0.000 description 2

- 230000006735 deficit Effects 0.000 description 2

- 238000002405 diagnostic procedure Methods 0.000 description 2

- 238000011156 evaluation Methods 0.000 description 2

- 230000000193 eyeblink Effects 0.000 description 2

- 230000037406 food intake Effects 0.000 description 2

- 210000003128 head Anatomy 0.000 description 2

- -1 including but not limited to Diseases 0.000 description 2

- 230000003993 interaction Effects 0.000 description 2

- 230000002452 interceptive effect Effects 0.000 description 2

- 208000011977 language disease Diseases 0.000 description 2

- 230000000737 periodic effect Effects 0.000 description 2

- 238000003825 pressing Methods 0.000 description 2

- 238000004445 quantitative analysis Methods 0.000 description 2

- 238000007619 statistical method Methods 0.000 description 2

- 238000013179 statistical model Methods 0.000 description 2

- 230000001225 therapeutic effect Effects 0.000 description 2

- 206010003805 Autism Diseases 0.000 description 1

- 208000020706 Autistic disease Diseases 0.000 description 1

- 208000035976 Developmental Disabilities Diseases 0.000 description 1

- 206010012559 Developmental delay Diseases 0.000 description 1

- 208000026350 Inborn Genetic disease Diseases 0.000 description 1

- 235000004443 Ricinus communis Nutrition 0.000 description 1

- 240000000528 Ricinus communis Species 0.000 description 1

- 230000001133 acceleration Effects 0.000 description 1

- 230000009471 action Effects 0.000 description 1

- 230000004888 barrier function Effects 0.000 description 1

- 238000003339 best practice Methods 0.000 description 1

- 238000004364 calculation method Methods 0.000 description 1

- 230000008859 change Effects 0.000 description 1

- 230000003930 cognitive ability Effects 0.000 description 1

- 230000008133 cognitive development Effects 0.000 description 1

- 238000004891 communication Methods 0.000 description 1

- 238000010205 computational analysis Methods 0.000 description 1

- 238000000205 computational method Methods 0.000 description 1

- 239000004020 conductor Substances 0.000 description 1

- 230000002596 correlated effect Effects 0.000 description 1

- 238000013499 data model Methods 0.000 description 1

- 230000003111 delayed effect Effects 0.000 description 1

- 230000009977 dual effect Effects 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 230000007613 environmental effect Effects 0.000 description 1

- 230000007717 exclusion Effects 0.000 description 1

- 238000010230 functional analysis Methods 0.000 description 1

- 208000016361 genetic disease Diseases 0.000 description 1

- 230000005764 inhibitory process Effects 0.000 description 1

- 230000008140 language development Effects 0.000 description 1

- 238000013507 mapping Methods 0.000 description 1

- 239000003550 marker Substances 0.000 description 1

- 239000000463 material Substances 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 239000000203 mixture Substances 0.000 description 1

- 230000003287 optical effect Effects 0.000 description 1

- 239000003973 paint Substances 0.000 description 1

- 238000005192 partition Methods 0.000 description 1

- 238000013442 quality metrics Methods 0.000 description 1

- 230000001105 regulatory effect Effects 0.000 description 1

- 210000001525 retina Anatomy 0.000 description 1

- 238000005096 rolling process Methods 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

- 230000035945 sensitivity Effects 0.000 description 1

- 238000000926 separation method Methods 0.000 description 1

- 230000000638 stimulation Effects 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

- 230000002123 temporal effect Effects 0.000 description 1

- 238000010998 test method Methods 0.000 description 1

- 238000012549 training Methods 0.000 description 1

- 238000000844 transformation Methods 0.000 description 1

- 230000001131 transforming effect Effects 0.000 description 1

Images

Classifications

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B3/00—Apparatus for testing the eyes; Instruments for examining the eyes

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B3/00—Apparatus for testing the eyes; Instruments for examining the eyes

- A61B3/10—Objective types, i.e. instruments for examining the eyes independent of the patients' perceptions or reactions

- A61B3/113—Objective types, i.e. instruments for examining the eyes independent of the patients' perceptions or reactions for determining or recording eye movement

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B3/00—Apparatus for testing the eyes; Instruments for examining the eyes

- A61B3/0016—Operational features thereof

- A61B3/0025—Operational features thereof characterised by electronic signal processing, e.g. eye models

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B3/00—Apparatus for testing the eyes; Instruments for examining the eyes

- A61B3/0016—Operational features thereof

- A61B3/0041—Operational features thereof characterised by display arrangements

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B3/00—Apparatus for testing the eyes; Instruments for examining the eyes

- A61B3/0016—Operational features thereof

- A61B3/0041—Operational features thereof characterised by display arrangements

- A61B3/005—Constructional features of the display

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B3/00—Apparatus for testing the eyes; Instruments for examining the eyes

- A61B3/0083—Apparatus for testing the eyes; Instruments for examining the eyes provided with means for patient positioning

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B3/00—Apparatus for testing the eyes; Instruments for examining the eyes

- A61B3/0091—Fixation targets for viewing direction

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B3/00—Apparatus for testing the eyes; Instruments for examining the eyes

- A61B3/02—Subjective types, i.e. testing apparatus requiring the active assistance of the patient

- A61B3/028—Subjective types, i.e. testing apparatus requiring the active assistance of the patient for testing visual acuity; for determination of refraction, e.g. phoropters

- A61B3/032—Devices for presenting test symbols or characters, e.g. test chart projectors

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/16—Devices for psychotechnics; Testing reaction times ; Devices for evaluating the psychological state

- A61B5/168—Evaluating attention deficit, hyperactivity

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H20/00—ICT specially adapted for therapies or health-improving plans, e.g. for handling prescriptions, for steering therapy or for monitoring patient compliance

- G16H20/70—ICT specially adapted for therapies or health-improving plans, e.g. for handling prescriptions, for steering therapy or for monitoring patient compliance relating to mental therapies, e.g. psychological therapy or autogenous training

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H50/00—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics

- G16H50/20—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics for computer-aided diagnosis, e.g. based on medical expert systems

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H50/00—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics

- G16H50/30—ICT specially adapted for medical diagnosis, medical simulation or medical data mining; ICT specially adapted for detecting, monitoring or modelling epidemics or pandemics for calculating health indices; for individual health risk assessment

Landscapes

- Health & Medical Sciences (AREA)

- Life Sciences & Earth Sciences (AREA)

- Engineering & Computer Science (AREA)

- Medical Informatics (AREA)

- Public Health (AREA)

- General Health & Medical Sciences (AREA)

- Biomedical Technology (AREA)

- Veterinary Medicine (AREA)

- Molecular Biology (AREA)

- Surgery (AREA)

- Animal Behavior & Ethology (AREA)

- Biophysics (AREA)

- Physics & Mathematics (AREA)

- Heart & Thoracic Surgery (AREA)

- Ophthalmology & Optometry (AREA)

- Human Computer Interaction (AREA)

- Developmental Disabilities (AREA)

- Pathology (AREA)

- Primary Health Care (AREA)

- Epidemiology (AREA)

- Child & Adolescent Psychology (AREA)

- Psychiatry (AREA)

- Psychology (AREA)

- Social Psychology (AREA)

- Hospice & Palliative Care (AREA)

- Data Mining & Analysis (AREA)

- Databases & Information Systems (AREA)

- Educational Technology (AREA)

- Signal Processing (AREA)

- Eye Examination Apparatus (AREA)

- Investigating Or Analysing Biological Materials (AREA)

Abstract

本申请涉及用于认知和发育状况的检测的系统和方法。系统、设备和方法被描述用于通过分析从被接收作为对受试者或患者的具体预定视觉刺激的显示的结果的反馈生成的眼睛跟踪数据对发育或认知状况,包括自闭症谱系障碍(ASD),进行评定、筛选、监控或诊断。在校准阶段之后,通过经由显示设备将预定刺激(例如,视频)呈现给受试者来执行测试过程。收集眼睛跟踪数据(来自响应于预定电影或其他视觉刺激移动他的或她的眼睛的受试者)。在数据收集周期期间,系统周期性地呈现目标以便反射性地引起受试者的注视。这些数据用于随后证实准确性。对在这些刺激期间的受试者的察看模式的分析用于诸如ASD的发育或认知状况的评定、筛选、监控或诊断。

Description

本申请是申请日为2014年3月11日,申请号为201480020606.X,发明名称为“用于认知和发育状况的检测的系统和方法”的申请的分案申请。

相关申请的交叉引用

本申请要求提交于2013年3月11日的申请号为61/775,880的共同未决、共同分配的美国临时申请的利益,其据此通过引用以其整体并入本文。

背景

诸如自闭症谱系障碍(ASD)的发育障碍影响美国几乎14%的儿童。用于诸如ASD的状况的诊断方法变化相当大,并且即使使用“最佳实践”工具也只提供对状况的相当差的灵敏度和特异性。发育残疾的延误诊断降低治疗的有效性并通常导致差的结果。此外,治疗提供者(例如,儿科医生或其他医疗专业人员)缺少用于测量这些状况中的进展的足够工具。

概述

本系统、设备和方法总体上涉及使用眼睛跟踪数据的分析对受试者中的包括ASD的发育或认知状况进行检测,其中所述眼睛跟踪数据响应于向受试者显示具体预定视觉刺激(例如,一个或多个视频)而生成。此外,此类系统、设备和方法可被应用用于定量测量和监控相应的状况或多个状况的症状学,并且在某些情况下,向患者、家庭和服务提供者提供更加准确和相关的规定信息。根据附加的方面,所公开的系统、设备和方法可用于预测具有自闭症的受试者中的结果(因此提供规定机能),同时也为全球发育残疾者提供类似的诊断和规定测量。

根据一个方面,提供了用于从眼睛跟踪器件收集数据的方法,方法包括致使显示第一视觉图像,在显示第一视觉图像之后,致使显示固视目标代替第一视觉图像,从眼睛跟踪器件接收数据,其指示受试者相对于显示的固视目标的眼睛移动,以及响应于接收指示受试者的眼睛移动的数据,致使在显示第二视觉图像代替固视目标。在某些实施中,固视目标触发受试者的反射性眼睛移动。在某些实施中,在没有言语指令的情况下引起受试者的眼睛移动。方法可进一步包括从指示受试者的眼睛移动的数据识别固视,计算固视的固视位置坐标,以及确定固视位置坐标是否在显示的固视目标的已知目标位置坐标的接近度阈值内。在某些实施中,如果固视位置坐标不在接近度阈值内,则为校准的目的拒绝指示受试者的眼睛移动的数据。方法还可包括从操作者接收手动指示,其从通过述操作者观察的固视识别所述固视。方法还可包括从操作者接收手动指示,其用通过操作者观察的固视印证识别的固视。

在某些实施中,方法还包括确定接收的数据是否指示在相对于显示的固视目标的受试者的眼睛移动期间的眨眼、眼跳或平滑尾随跟踪中的任一个。如果接收的数据指示在相对于显示的固视目标的受试者的眼睛移动期间的眨眼、眼跳或平滑尾随跟踪中的任一个,则至少部分为了校准的目的可以拒绝指示受试者的眼睛移动的数据。在某些实施中,如果数据不包括固视,则为了校准的目的拒绝指示受试者的眼睛移动的数据。在某些实施中,第一视觉图像不同于第二视觉图像。在某些实施中,第一视觉图像与第二视觉图像相同。

在某些实施中,方法还包括致使显示一个或多个随后的固视目标替代第二视觉图像。在某些实施中,在显示每个相应的随后固视目标之后显示相应的视觉图像。每个相应的视觉图像可以不同于第一视觉图像和第二视觉图像,或者每个相应的视觉图像可以与第一视觉图像和第二视觉图像相同。在某些实施中,每个相应的随后固视目标具有相应的目标位置坐标。在某些实施中,响应于来自观察受试者的操作者的手动指示显示固视目标。在某些实施中,基于受试者的属性来选择视觉图像。属性可以是受试者的年龄。在某些实施中,第一视觉图像和第二视觉图像是动态视觉图像。在某些实施中,方法用于受试者中的发育或认知状况的评定、筛选、监控或诊断。

根据一个方面,提供了包括框架的系统,框架支撑显示设备,用于检测受试者响应于通过显示设备显示的刺激的眼睛移动的传感器以及用于使受试者就坐的支撑设备,其中支撑设备可调整用于以相对于显示设备和传感器的允许收集眼睛移动数据的取向定位受试者,并且其中一旦被定位,则支撑设备将受试者限制在所述取向中。框架可包括轮子以及耦合到轮子的制动器。在某些实施中,支撑设备包括隔离物,以使受试者的视野视觉干扰最小。支撑设备可以配置为倾斜。在某些实施中,支撑设备包括可调整的头枕。头枕可限制受试者的头部移动的范围。在某些实施中,支撑设备被配置为围绕轴旋转。

在某些实施中,显示设备可相对于受试者调整到多个位置。在某些实施中,传感器可相对于受试者调整到多个位置。系统还可包括被配置为向操作者显示受试者的图像的第二显示设备。在某些实施中,系统包括用于将检测的受试者的眼睛移动传送到网络的网络接口。系统可用于受试者中的发育或认知状况的评定、筛选、监控或诊断。在某些实施中,系统经配置执行本公开的方法中的任一项。

根据一个方面,提供了用于校正眼睛跟踪数据中的空间不准确性的方法,方法包括接收在显示受试者的刺激期间记录的眼睛跟踪数据(其中刺激包括固视目标,其引起通过受试者的固视),在接收的眼睛跟踪数据中识别固视,计算与固视目标相关的目标位置坐标和与固视相关的固视位置坐标之间的差异,将计算的目标位置坐标和固视位置坐标之间的差异存储作为矢量数据,以及转换所述矢量数据,以使固视位置坐标与目标位置坐标对准。在某些实施中,转换包括执行选自由三线性插值、重心坐标中的线性插值、仿射转换以及分段多项式转换组成的组的数学运算。在某些实施中,方法用于受试者中的发育或认知状况的评定、筛选、监控或诊断。

根据一个方面,提供了包括框架的系统,框架支撑用于向受试者显示刺激的装置、用于检测受试者响应于通过用于显示的装置显示的刺激的眼睛移动的装置以及用于支撑受试者的装置,其中用于支撑的装置可调整用于以相对于用于显示的装置和用于检测的装置的允许收集眼睛移动数据的取向定位受试者,并且其中一旦被定位,则用于支撑的装置将受试者限制在所述取向中。框架可包括用于移动系统的装置以及用于阻止移动的装置,其耦合到用于移动的装置。在某些实施中,用于支撑的装置包括用于使受试者的视野的视觉干扰最小化的装置。用于支撑的装置经配置倾斜。在某些实施中,用于支撑的装置包括可调整的头枕。头枕可以限制受试者的头部移动的范围。在某些实施中,用于支撑的装置经配置围绕轴旋转。

在某些实施中,用于显示的装置可相对于受试者调整到多个位置。在某些实施中,用于检测的装置可相对于受试者调整到多个位置。系统可进一步包括用于向操作者显示受试者的图像的装置。在某些实施中,系统包括用于将检测的受试者的眼睛移动传送到网络的装置。系统可用于受试者中的发育或认知状况的评定、筛选、监控或诊断。在某些实施中,系统经配置执行本公开的方法中的任一项。

根据一个方面,提供了单机设备及相关方法。用于诸如ASD的发育或认知障碍的诊断、筛选和监控的平台包括(a)设备(特别是摄像头和光源),其用于收集与所呈现的视觉信息相关的眼睛跟踪数据;(b)屏幕,其用于将刺激(多个刺激)呈现给患者;(c)扬声器,其用于将声音呈现给患者;(d)系统,其用于维持合适的患者定位,使得设备可在多个位置之间关节式活动,提供给婴儿倾斜的位置,同时也允许作出调整,使得较大的儿童可相对于刺激呈现屏幕坐端正,刺激呈现屏幕可被垂直地调整以便适应患者的不同高度,患者眼睛离屏幕具有规定距离,患者被安全地支撑并且患者被安全地抑制离开系统;(e)用于与眼睛跟踪硬件和刺激呈现监控器以及扬声器接合的计算机;(f)伴随眼睛跟踪硬件和刺激呈现监控器以及扬声器的定制软件,使得例如可记录识别患者信息,可关于患者校准眼睛跟踪硬件,可将电影呈现给患者,可收集眼睛跟踪数据,可保存数据以及可自动地传递数据以用于处理;(g)刚性框架,其支撑硬件部件,使得例如眼睛跟踪硬件放置在光学上适当的位置中,刺激呈现屏幕放置在患者可访问的位置中,并使患者的干扰最小化;(h)可选择的患者头枕,其使患者头部移动最小化;(i)操作者控件,其包括键盘、鼠标、计算机监控器;(j)摄像头,其用于监控患者行为;以及(k)用于受控环境照明的系统。

根据一个方面,用于将眼睛跟踪数据传递到处理器以用于数据分析的方法包括(a)用于收集与所呈现视觉信息相关的眼睛跟踪数据的设备;(b)网络连接;(c)用于将数据上传到中央数据库的软件;以及(d)中央数据库。根据另一个方面,用于分析数据的方法包括(a)从原始眼睛跟踪数据和通过患者察看的电影列表解析出相关信息;(b)记录有关感兴趣的区域的眼睛跟踪数据;以及(c)经由眼睛跟踪数据将个体患者数据与规范和非典型发育的现有模型进行比较。根据另一个方面,用于将结果递送给儿科医师的方法包括(a)规范发育或ASD的指示,其被以以下格式中的任一个图形地或非图形地呈现(i)纸质形式或(ii)基于网络(web)的接口。

根据一个方面,自动化“决策树”校准方法被提供用于通过以下基于软件的方法减少在针对不能跟随口头指示(由于年龄或认知能力)的个人校准眼睛跟踪器件中的操作者错误(a)校准(i)通过个人(操作者)操作的校准,(ii)校准软件允许向参与者呈现视频刺激,(iii)将固视目标呈现给个人(参与者),(iv)操作者具有通过直接注视、直接视频馈送或其他方法察看参与者的能力,(v)操作者具有通过注视、直接视频馈送或其他方法察看参与者眼睛的能力,(vi)操作者具有将视觉刺激目标呈现给参与者的能力,(vii)操作者具有指示他们何时观察到参与者的注视转移朝向目标的能力,(viii)当操作者指示参与者正在看着目标时,眼睛跟踪系统记录记录关于参与者眼睛的视觉信息,最终收集跨越足够点的足够信息以便校准系统;(b)验证(i)在成功校准之后,操作者具有向参与者显示随机目标的能力,其中所校准的数据现在由眼睛跟踪器件输出,(ii)当目标出现在屏幕上时,可记录实时眼睛跟踪数据,(iii)操作者具有指示他们何时观察到参与者注视转移朝向目标的能力,(iv)使用所记录的数据以及通过或不通过由操作者指示的定时信息,软件自动计算每个示出点的平均固视位置,(v)软件将所计算的平均固视位置与预指定的准确性阈值进行比较并随后接受(验证)或拒绝(非验证)点;(c)决策树(i)状况I,其中<3个目标被验证,软件指令操作者尝试从头开始重新校准或者加载一般的校准;(ii)状况II,其中3-4个目标被验证,软件指令操作者尝试仅重新验证剩余点或者继续当前校准;(iii)状况III,其中5个目标被验证,软件指令操作者继续当前校准。

根据一个方面,提供了事后校准错误解决方案。提供了用于调整眼睛跟踪数据空间准确性中的一般错误的计算方法,使得(a)记录与呈现给参与者的视觉刺激目标相关的眼睛跟踪数据;(b)通过计算分析识别平均固视位置;(c)基于所计算的到实际呈现的目标位置的接近度将接受/拒绝准则应用到每个平均固视位置计算;以及(d)应用从计算的平均固视位置到实际呈现的目标位置的空间转换到眼睛跟踪数据。

根据一个方面,提供了社交能力发育的生长图表。提供了通过视觉表示来表示社交能力发育的方法,使得(a)通过眼睛跟踪数据的许多个体实例的定量分析来定义典型(和/或异常)发育,以及(b)该定量分析的结果被表示为关于以下方面的典型(和/或异常)发育的纵向图(i)给定刺激中的感兴趣的特定区域上的固视的测量结果被纵向地形成图表,或者(ii)在眼睛跟踪数据收集时的相对显著性相对年龄;(b)使得眼睛跟踪数据的分析的新来结果可以图形形式与典型(和/或异常)数据进行比较;(c)使得图形表示可帮助将关于个体数据的医学上的相关信息传送给护理者。

本领域技术人员将在回顾本公开之后想到这些实施例的变型和修改。前述特征和方面可以以具有本文所描述的一个或多个其他特征的任何组合和子组合(包括多个从属组合和子组合)来实施。包括其任何组成部分的本文所描述或示出的各种特征可在其他系统中组合或整合。此外,可省略或不实施某些特征。

附图说明

在考虑以下结合随附附图的进行的详细描述之后,前述和其他目标及优点将为明显的,其中相似的参考字符在全文中指的是相似的部件,并且在附图中:

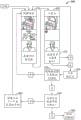

图1根据本公开的某些实施例示出包括设备和支持数据基础架构的用于递送诊断或规定结果的示例性系统的方框图;

图2分别示出用于受试者中的发育或认知状况的评定、筛选、监控或诊断的示例性设备的前透视图和后透视图;

图3A到图3F根据本公开的某些实施例示出图2的设备的可选实施例的透视图;

图4根据本公开的某些实施例示出数据收集的示例性流程图;

图5A到图5L根据本公开的某些实施例示出数据收集期间被呈现给操作者的一系列示例性显示屏幕;

图6根据本公开的某些实施例示出用于校准眼睛跟踪数据的计算机实施的功能的示例性流程图;

图7根据本公开的某些实施例示出用于验证眼睛跟踪数据的计算机实施的功能的示例性流程图;

图8根据本公开的某些实施例示出用于检测潜在校准点是否包括固视的计算机实施的功能的示例性流程图;

图9和图10根据本公开的某些实施例示出校准不准确的基于计算机实施的功能和准则的评定和校正的代表性图像;

图11根据本公开的某些实施例示出用于传递所收集的数据的示例性系统的方框图;

图12根据本公开的某些实施例示出用于使用集中式数据库支持数据收集和数据处理以及分析步骤的示例性流程图;

图13根据本公开的某些实施例示出用于处理所收集的数据的示例性流程图;

图14根据本公开的某些实施例示出用于递送数据分析的结果的示例性系统的方框图;以及

图15根据本公开的某些实施例示出相对于其他发育或认知属性的受试者的发育或认知进展的示例性计算机生成的数据表示。

详细描述

为了提供对本文所描述的系统、设备和方法的全面理解,将描述某些示例性实施例。尽管本文的实施例和特征被具体描述用于接合收集和分析来自受试者的眼睛跟踪数据使用以用于自闭症谱系障碍(ASD)的评定、筛选、监控或诊断,将理解的是,系统、设备和方法还可应用于其他发育或认知障碍,以及其他状况,其包括但不限于语言障碍、智力残疾、存在或不存在已知一般障碍的发育残疾,以及注意缺陷多动障碍(ADHD)、注意缺陷障碍(ADD)、创伤后精神紧张性障碍(PTSD)、头部创伤、脑震荡、运动损伤和痴呆。将理解的是,如果不指示关于障碍的量度,则该类数据可提供规范发育的典型性程度的量度,从而提供典型发育中的可变性的指示。此外,下面所概述的所有部件和其他特征可以以任何合适的方式彼此组合,并且可适应和应用到医疗诊断以外的系统。例如,本公开的交互式视觉刺激可被用作治疗工具。此外,所收集的数据可产生受试者优选注意的某些类型的视觉刺激的量度。该类优选量度都应用于医疗诊断和治疗的领域中或领域之外两者,其包括例如广告或其中对与视觉刺激优先相关的数据感兴趣的其它行业。

在本说明书中提及的所有公布、专利和公开专利申请通过引用具体地并入本文。如果发生冲突,则包括其具体定义的本说明书将对此进行控制。贯穿整个说明书,术语“包括(comprise)”或诸如“包括(comprising)”或“包括(comprises)”的变型将被理解为意指包括所陈述的整体(或部件)或整体的组(或多个部件),但不排除任何其他整体(或部件)或整体的组(或多个部件)。单数形式“一(a)”、“一个(an)”、和“这个(the)”包括复数,除非上下文另有明确规定。此外,术语“患者”、“参与者”和“受试者”可贯穿本公开交换地使用。如本文所使用的,“固视”为视觉固视的简写。视觉固视为用于使在视网膜上的视觉信息稳定的一种类型的眼睛移动。

本文所描述的用于包括ASD的发育或认知状况的检测的系统、设备和方法可与用于处理和分析包括所描述的那些的所收集的眼睛跟踪数据的其他技术一起使用,其它技术例如在提交于2006年2月23日的并且名称为“System and Method for Quantifying andMapping Visual Salience”的专利号为7,922,670的美国专利中,以及在提交于2013年12月11日的并且名称为“Systems and Methods for Detecting Blink Inhibition as aMarker of Engagement and Perceived Stimulus Salience”的申请号为14/103,640的美国专利申请中,以上公开内容据此通过引用以其整体并入本文。

图1根据某些实施例示出用于诊断或规定结果的递送的包括设备100和支持数据基础架构的系统10的方框图。如所示出的,系统10通常被划分为与数据收集20、数据存储30、数据处理和分析40以及数据结果50相关的四个部分(本文中有时也被称为系统)。在某些实施例中,系统10用于诊断受试者或患者中的诸如ASD的发育或认知状况。具体地,系统10允许在相对小的年龄的ASD的诊断,包括六个月和更小的幼儿和婴儿。具体地,系统、设备和方法可以可靠地收集任何年龄的患者的数据,从新生儿到老年人,并使用该收集的数据以用于ASD或其他认知或发育状况的诊断。通常,系统10收集并随后分析眼睛跟踪数据,以确定受试者的社交功能的水平。系统10为非侵入性的。与收集眼睛跟踪数据相关的过程(也被称作“会话”)可允许任何合适量的时间(例如,15分钟)并涉及四个主要步骤,其对应于图1中示出的系统10的四个部分(即,数据收集系统20、数据存储系统30、数据处理和分析系统40以及数据结果系统50)。

作为总体概述,当受试者观看描绘常见社交交互(通常为两者交互或三者交互)的动态视觉刺激(例如,电影)时,从他或她收集第一眼睛跟踪数据(数据收集20)。出于数据收集的目的被显示给受试者的刺激可为任何合适的视觉图像(无论是静态的还是动态的),其包括电影或视频以及静止图像或任何其他视觉刺激。将理解的是,电影或视频仅仅通过示例的方式被引用,并且任何该种讨论也应用于其他形式的视觉刺激。跟随该过程,眼睛跟踪数据以及任何其他合适的信息(例如,受试者所察看的电影的列表)被传递到安全数据库(数据存储30)。数据库优选地远离设备,以容纳和聚集从许多设备收集的数据,但将理解的是,在一些实施例中,数据库对于设备来说可为本地的。在该传递之后,数据被再次传递到中央处理计算机(对数据库和/或设备是本地或远程的),并被使用以任何合适的编程语言(例如,Matlab)编写的定制软件进行处理(数据处理和分析40)。在该处理步骤中,将个体受试者的数据与统计模型进行比较。该比较基于在受试者查看的电影期间唯一的他或她自身的注视点输出社交功能的量度(例如,分数)(数据结果50)。该分数与预定截断值或来自统计模型的其他值进行比较。在一些实施例中,该比较的输出为确定受试者的包括ASD的发育或认知状况的诊断以及该状况的严重程度。在一些实施例中,该比较的输出为受试者的言语或非言语认知技能的量度。在一些实施例中,该比较的输出为规范发育的典型性程度的量度,从而提供典型发育中的可变性的指示。此外,结果可用于随着时时间的推移监控被ASD或其他认知或发育状况影响的受试者的治疗的有效性。分析以及所处理的文件本身的结果被随后上传到数据库。通常,结果对受试者的医师(例如,儿科医师或其他医疗专业人员)或其他护理者可用。

在一些实施例中,数据收集系统20包括硬件部件和软件部件的混合。这些部件一起将视觉和听觉刺激呈现给受试者并收集暂时对准的眼睛跟踪数据。用于数据收集的设备100经设计促进适当的受试者定位(例如,相对于受试者监控器和眼睛跟踪单元),同时也使受试者的视野的视觉干扰最小化。将参考下面注解的附图来描述用于执行本公开的方法的示例性系统和设备的某些细节。

图2根据某些实施例分别示出图1的设备100的前透视图和后透视图。设备100用于受试者中的包括ASD的发育或认知状况的评定、筛选、监控或诊断。在一些实施例中,设备100位于轮子或脚轮108的顶上,以用于跨越多种表面的高效移动性。任何合适的轮式或其它促进移动的部件可以用于代替或附加到脚轮108以提供移动性。设备100经设计在脚轮108上移动通过标准走廊和门廊,并优选地具有允许所有尺寸和力量的操作者的可操作性的重量(例如,大约250磅或更轻)。脚轮108可包括用于当未被移动时将设备固定在适当位置中的制动器。

设备100还包括用于受试者的舒服座椅101(或支撑设备),其具有定位或约束系统(例如,座椅安全带),以用于防止在测试期间无意识地离开座椅101。任何合适的支撑设备可用于在过程期间使受试者定位或就座,其包括用于婴儿和幼儿的汽车座椅或高脚椅子,或者其他类型的支撑设备(诸如用于较大儿童和成人的定制椅子)。设备具有用于由受试者察看测试刺激(包括视觉图像和校准/固视目标)的监控器或显示设备103以及用于播放与测试刺激相关的音频的扬声器或音频刺激106的其他源。在一些实施例中,尽管可单独地提供部件,但是扬声器与监控器整合在一起。监控器的位置可相对于监控器的任何轴调整(例如,垂直调整、水平调整和朝向或远离受试者的调整)。

如所示出的,设备100进一步包括用于响应于通过显示设备103显示的刺激检测受试者的眼睛移动的眼睛跟踪单元或传感器104、操作者控件110以及用于使受试者免受受试者的视野中的干扰的足够的视觉分离的挡板或隔离物107。操作者控件110被与操作者监控器或显示设备109一起提供,这允许操作者经由来自视频摄像头105的反馈在整个过程中观察受试者,所述反馈显示受试者并在操作者监控器109上显示。因此,在一些实施例中,操作者可位于远离(例如,在相同房间的不同部分中或完全地不同房间中)受试者的位置。设备100被提供有用于眼睛跟踪收集和刺激呈现的控制计算机111以及用于给设备100的部件提供电力的功电源单元112。设备100可配置用于通过直接插入式连接或无线连接连接到医师的办公室或诊所处的网络。在某些实施例中,设备100仅允许输出数据通信以防止恶意软件的引入。在一些实施例中,可使用支撑以上讨论的设备的各种部件的外壳或框架结构来形成设备100。

设备100的支撑设备或座椅101可以是可调整的,以便以相对于显示设备103和眼睛跟踪传感器104的允许眼睛移动数据的收集的取向定位受试者。并且一旦被定位,则座椅101可将受试者限制在该特定取向中。这允许座椅在可重复位置(无论从受试者到受试者还是对于与相同受试者的多个会话)中操作。例如,在一些实施例中,设备100以两个模式(“婴儿模式”和“幼儿模式”)操作,使得监控器103和座椅101取向可容纳幼儿(其像成人一样更喜欢坐端正)和婴儿(其更喜欢倾斜)。图1的数据收集系统20的插图15中示出了用于婴儿或幼儿/成年人的双重位置。由于存在可以被使用和从受试者到受试者可重复的许多可能的位置,因此将理解的是,座椅可具有任何合适数目的“模式”并且可进一步是可定位/可调整的。例如,设备100具有用于经受受试者进入/离开的旋转机构102,其还可用于相对于显示设备103和眼睛跟踪单元对受试者进行定向。

图2的设备100可用于以上概述的数据收集20,使得(1)受试者在显示屏幕(例如,计算机监控器)前面就座,其中在所述显示屏幕上为受试者播放不同的动态视频和其他刺激,(2)操作者能够控制软件,其将(a)针对受试者校准眼睛跟踪单元,(b)验证校准为准确的,以及(c)当受试者观看动态视频或其他视觉刺激时,从他或她收集眼睛跟踪数据。在被称为“数据收集”的过程的该部分之后,可将受试者的数据传递到安全数据库。数据库优选地远离设备,以便容纳和聚集从许多设备收集的数据,但将理解的是,在一些实施例中,数据库对于设备来说可为本地的。在一些实施例中,通过数据库收到所收集的数据开始自动软件实施的处理和分析过程,其中受试者的个体数据与从历史眼睛跟踪数据先前生成的眼睛跟踪数据的模型进行比较。比较的结果为受试者的发育功能的诊断和/或规定量度。那些结果可被压缩为用于由受试者的医师使用的诊断报告。

设备操作者(例如,医疗助手或其他医疗专业人员)仅需进行最小限度的训练来操作设备。设备经设计允许受试者在显示设备(例如,图2的显示设备103)前面的可重复的适当定位。在将操作者和受试者的信息输入到在设备上运行的定制软件平台之后,软件选择特定于年龄的刺激(例如,电影)并指令操作者以适当的取向将显示设备定位在受试者的前面。然后,执行校准过程,以便关于眼睛跟踪设备(例如,图2的眼睛跟踪设备104)校准受试者。在有效的校准(由软件确定)之后,软件通过选择经由显示设备为受试者播放的视频来开始数据收集过程,并且收集原始眼睛跟踪数据(来自受试者响应于预定电影或其他视觉刺激移动他的或她的眼睛)。然后将眼睛跟踪数据以及与刺激(例如,受试者所察看的刺激的列表)相关的信息两者传递到安全数据库以用于处理。

显示给受试者的电影可取决于受试者的年龄。在一些实施例中,设备测量受试者(位于座椅中)看着演员的眼睛、嘴巴或身体所花费的固视时间量以及受试者看着视频中的背景区域所花费的时间量。经由显示设备显示给受试者的视频场景可描绘社交交互的场景(例如,直接看着摄像头的演员试图吸引正在察看的受试者,例如,或者正在玩耍的儿童的场景)。在一些实施例中,视频场景可包括其他合适的刺激(包括例如动画和优先的察看任务)。相对于视频中的特定位置的固视时间的量度与受试者的社交和/或认知发育水平相关。例如,作为他们的语言发育的发育阶段的结果,在12-15个月年龄之间的儿童显示出渐增的嘴巴固视,并且在眼睛固视和嘴巴固视之间交替。

受试者的察看模式(在播放的电影期间)的分析被执行用于包括ASD的发育或认知状况的诊断和监控。在该数据收集周期期间,系统周期性地将校准或固视目标(其可为动画的)显示给受试者。这些数据随后用于证实准确性。测试方法取决于清醒的并正在看着屏幕的受试者。在校准以及数据收集过程两者期间,经由显示设备将预定电影和/或其他视觉刺激呈现给受试者。这些电影和/或其他视觉刺激可包括人类或动画演员,其作出手部/脸部/身体移动。

任何合适的眼睛跟踪单元和相关软件可与本公开的系统、设备和方法一起使用。例如,可使用各种商购的眼睛跟踪单元,其包括从SensoMotoric Instruments(例如,型号RED-m)、ISCAN公司(ISCAN Inc.)(例如,型号RK-464)和Tobii Technology(例如,型号X60)商购的那些眼睛跟踪单元或者来自其他制造商的任何其他合适的眼睛跟踪单元。在某些实施例中,诸如通过本文公开的系统、设备和方法的申请人开发的主站软件代码的主站软件代码用于监督或控制眼睛跟踪软件的步骤并附加地用于执行其他功能。该类功能的示例包括将界面呈现给操作者,所述界面显示受试者的名字、出生日期等等、与被显示给受试者的刺激(例如,电影)相关的信息等等。在一些实施例中,主站软件代码经由软件开发工具包(SDK)与眼睛跟踪软件交互。

根据一些实施例,促进诊断测试会话的计算机为具有高处理能力的专用计算机(例如,由于测试过程中涉及相对高容量的视频)。眼睛跟踪数据由计算机收集并被存储在数据文件中(例如,作为.idf数据),所述数据文件然后经由安全网络连接从医师的办公室传送到中央数据库和处理计算机以用于分析。在处理设施处,可通过分析与从历史数据创建的模型相关的眼睛跟踪数据(接收自在医师的办公室处检测的受试者)来执行数据的离线分析(例如,使用从被已知具有ASD或者其他发育或认知状况的受试者先前收集的数据以及也使用健康控件)。然而,如贯穿该公开所讨论的,将理解的是,在一些实施例中,可通过设备本地的计算机在会话期间实时执行处理步骤和分析步骤。

存在很多可能的修改或改变,可对设备100做出这些可能的修改或改变而不影响其中眼睛跟踪数据被收集、存储、分析和处理的方式。在每种情况下,被修改或改变的设备提供数据收集和适当的受试者定位(例如,相对于受试者监控器和眼睛跟踪单元),同时也使受试者的视野的视觉干扰最小化。图3A到图3F示出图2的设备100的可选实施例(A)到(F)的透视图。例如,在一些实施例中,设备为固定的(即,设备不是移动的)。设备可永久地或半永久地固定到地板(例如,在使用中固定在合适的位置),或者设备可不包括脚轮或轮子,并且设备的重量因此将其保持在适当的位置中。如图3A到图3E中所示,各自的设备不包括脚轮或轮子。在一些实施例中,支撑设备(例如,图2的座椅101)可以与其各自的设备可分离(无论设备本身是移动的还是固定的)。例如,其中定位受试者的座椅可经由滚动机构是可滑动地可调整的。如图3E中所示,设备240为固定的但支撑设备242为移动的。作为另一个示例,在图3F中,设备250为移动的并且支撑设备252也为移动的。

根据某些实施例,包括图3A到图3F中以上讨论的那些的本公开的设备中的任一个可包括(1)用于受试者的座椅,其可根据受试者的年龄进行调整,(2)用于朝向或远离设备转动座椅的机构,(3)用于显示给受试者电影或其他视觉刺激的显示设备(即,手动或使用电机可被调整以针对不同的受试者身高),(4)眼睛跟踪单元,其使摄像头聚焦于受试者的眼睛并通过安全量的红外线或其他电磁能量照亮所述眼睛,(5)摄像头,用于操作者使用以监控受试者的总体健康状况和顺应性,(6)产生声音的一个或多个扬声器,(7)用于定位显示设备、眼睛跟踪单元和任何其他部件的机械系统(可选择地为电动的),(8)具有制动器的旋转脚轮,(9)用于操作者操作设备的监控器(例如,触摸屏),(10)用于操作者的键盘和鼠标,(11)具有定制软件的控制计算机,(12)用于将电力递送到设备的各种部件的电源,以及(13)用于将所有部件保持在一起的焊接的、装有护套的机械框架。

在一些实施例中,以上部件(1)-(13)以常见参考框架对准(例如,以上提及的焊接的、装有护套的机械框架或任何其他合适的外壳或壳体),使得它们可被一起定位或运输。该参考框架可为静态的、定制设计的金属支撑结构。在一些实施例中,金属支撑结构包括焊接的管状构件,其垂直地、水平地和/或有角度地布置以便创建支撑框架和测试区域;座椅定位在测试区域内部,其中受试者邻近显示设备定位但通过挡板或隔离物屏蔽大部分外部干扰。设备的操作者可站在框架的外部位置中,以便经由操作者计算机指令监督受试者,并通过监控摄像头观察受试者。由于受试者的视野被隔离物遮断,因此受试者(定位在支撑设备上)优选地不能够看到操作者。隔离物可由类似塑料的材料构成,其易于清洗并被加热模塑到金属框架。如图3A到图3F中所示,例如,设备具有支撑各自的设备的全部或一些部件的框架。

图4根据某些实施例示出数据收集的流程图300。使用通过诸如本公开的图2的设备100的设备中的任一个实施的定制开发的软件应用来完成数据收集。过程的某些步骤为在与计算机相关的软件代码中实施例的计算机实施的功能,所述计算机操作所公开的设备(例如,图2的计算机111)。图5A到图5L根据某些实施例示出一系列显示屏幕,其在数据收集期间被呈现给操作者(例如,经由图2的操作者监控器109)并将与过程300的步骤的讨论一起被引用。将理解的是,该公开的流程图的步骤仅仅为示例性的。可修改、省略或重新布置流程图的步骤中的任一个,可组合步骤中的两个或多于两个步骤或者可添加任何附加步骤,而不脱离本公开的范围。

在某些实施例中,定制开发的软件应用使得设备操作者能够(a)将测试过程与具体受试者联系在一起,(b)针对受试者校准眼睛跟踪数据收集器件,(c)在受试者刺激监控器和扬声器上呈现视频刺激和音频刺激,以及(d)从受试者收集如与视觉刺激和音频刺激相关的眼睛跟踪数据(例如,注视的x、y坐标)。在一些实施例中,在会话的结束时将所收集的数据传递到中央数据库(例如,图12的过程1000),以用于进一步的处理和分析(例如,图13的过程1050)。

过程300在步骤302处开始,其中输入操作者信息(例如,经由图2的操作者控件1110)。信息可以是任何合适的信息,其允许操作者的识别。例如,可记录操作者的名和姓。名和姓可与用户名称相关,以用于登录到系统以及识别操作者的目的。在一些实施例中,在数据库(例如,图1的数据库35)中查询操作者信息,以监控场地利用和取决于操作者的数据质量变化(尽管这被预期为低的)。如图5A中所示,显示屏幕400a包括覆盖物460,其允许操作者使用用户名称和密码登录到系统中。显示器400a还包括横幅条410,其具有在整个会话中可用的各种按钮(例如,动画、撤销上次、下一个电影、活动电影、音量、结束会话、注销),以便浏览会话的部分或者控制会话的其他功能。显示器400a的底部处还呈现的是上下文按钮450(例如,播放下一个目标、看着目标!返返回电影!),其与可用于会话中当前应用的特定模式的功能相关(例如,显示器400a具有不同于显示器400j中的那些按钮的上下文按钮450)。

在步骤304处,输入受试者信息。信息可为允许受试者的识别的任何合适的信息以及用于数据处理和分析的目的的相关的任何其他信息。例如,可输入受试者的名和姓、出生日期、性别以及主要语言。受试者信息用于将给定会话的数据链接到数据库中所记录的个体。如图5B中示出,显示屏幕400b包括覆盖物462,其允许操作者将受试者信息输入到包括以上讨论的那些的不同字段中。覆盖物462中还示出的是“会话ID”,其允许根据与各自的受试者相关的会话在数据库中索引所收集的数据。

在步骤306处,在监控器上播放年龄适当的或特定于年龄的刺激(例如,电影)。该显示将受试者的注意力吸引到监控器(例如,图2的显示设备103)并允许在步骤308处操作者或受试者的护理者将受试者紧固在椅子中。在某些实施例中,应用指令操作者(a)基于受试者的年龄调整监控器和椅子角度,(b)将受试者放置在椅子中并安全地紧固座椅安全带,以及(c)确认眼睛跟踪器可识别受试者的眼睛。如图5C中所示,显示屏幕400c包括覆盖物464,以用于观察受试者的位置(使用视频窗口466)并确认受试者的眼睛被眼睛跟踪器识别(使用视频窗口468)。视频窗口466示出受试者的视频馈送并且相对于受试者的位置描绘其中固视目标将被显示的位置。视频窗口468示出受试者的眼睛是否已经被眼睛跟踪器识别,并提供关于当前位置评定的反馈(元件468a和468b)。在一些实施例中,位置评定被彩色编码以表示极好的位置、中等的位置或差的位置。

在步骤310处,关于受试者校准眼睛跟踪系统。操作者经由摄像头馈送维持受试者的连续视觉监控。在某些实施例中,当校准目标(也称为固视目标)呈现给受试者时,操作者和眼睛跟踪单元(例如,图2的眼睛跟踪单元104)两者确认受试者正在固视。目标反射性地捕获受试者的注意力并导致朝向已知目标位置的眼跳和已知目标位置上的固视。目标可靠地将固视引到有限的位置(例如,小于0.5度的可视角度的径向对称目标跨越)。其他示例包括同心模式、形状或收缩刺激,使得即使最初在尺寸上较大,也能可靠地将固视引到固定的目标位置。如图5D中所示,显示屏幕400d包括视频窗口440,其示出操作者维持受试者的连续视觉监控,其中在窗口420中经由摄像头馈送监控所述受试者。覆盖在窗口420中的摄像头馈送之上的是顺序地呈现给受试者的校准目标或固视目标的位置。操作者可通过看着视频窗口420视觉上地确认受试者正在固视所显示的目标,并然后使用输入设备手动地指示所观察的固视。视频窗口430具有覆盖在馈送之上的目标,所述馈送描绘来自眼睛跟踪器件的信息。任何合适的图标可用作校准或固视目标,并且目标可为静态的或动态的。例如,如图5E的显示器400e中所示,从横幅条410选择“动画”按钮导致显示可用作固视目标的可能的动画的列表。动态或动画固视目标可以反射性地导致对受试者的外来提示,而不需要通过操作者的言语中介或指令。例如,由于目标本身捕获受试者的注意力,因此操作者不需要给出看着动态目标的指令。

在步骤312处,从眼睛跟踪器件(例如,图2的眼睛跟踪设备104)输出连续(x,y)注视坐标。在已经记录了朝向校准目标的足够数目的固视之后,例如以120Hz或任何其他合适的速率输出连续流的(x,y)注视位置坐标。如图5F中所示,显示器400f在眼睛跟踪视频窗口440中包括注视位置坐标442。随着受试者继续看着显示设备(在显示刺激之前、期间或之后)时,眼睛跟踪器件输出连续的注视位置坐标以用于随后的数据处理和分析。

可经由视觉刺激的呈现评定所收集的眼睛跟踪数据的准确性,所述视觉刺激反射性地捕获注意力并导致朝向已知目标位置的眼跳和已知目标位置上的固视。目标可靠地将固视引到有限的位置(例如,小于0.5度的可视角度的径向对称目标跨越)。其他示例包括同心模式、形状或收缩刺激,使得即使最初在尺寸上较大,也能可靠地将固视引到固定的目标位置。该类刺激可在具有头部限制的数据收集下测试,以便确保它们在理想测试环境下可靠地引起注视;然后它们的使用可被扩展到包括非头部限制的数据收集。

为了确保所收集的数据是准确的,在步骤314处,验证眼睛跟踪校准。该步骤可在初始校准之后立即发生,或者该步骤可在已经将刺激呈现给受试者之后(例如,在已经示出若干电影之后)发生。在一些实施例中,附加固视目标被示出给受试者并且所输出的眼睛跟踪数据与已知目标位置进行比较以评定数据准确性。如果数据质量不足,则软件应用可指令操作者进行重新校准。例如,如图5G的显示器400g中所示,(五个中的)少于三个目标被验证并且指令操作者尝试两点校准或者结束会话。如图5H的示例性显示器400h中所示,五个目标中的四个目标被验证并且指令操作者尝试验证剩余点或者继续进行(或继续(continue with))刺激的显示。如图5I的示例性显示器400i中所示,五个目标中的五个目标被验证并且指令操作者继续进行数据收集。将理解的是,任何适当数目的目标可被显示并且可用于眼睛跟踪设备的校准和/或验证。例如,在一些实施例中,两点校准和验证可用于可靠的眼睛跟踪数据的收集。

在步骤316处,将刺激示出给受试者并记录注视坐标流。在某些实施例中,注视坐标流包括以给定频率(例如,60Hz、120Hz、521Hz、1000Hz或任何其他合适频率)取样的数据,所述数据指示在给定时间周期内(例如,视觉刺激的持续时间)受试者相对于显示器(例如,图2的显示器103)的瞬时注视位置坐标。在成功验证(在步骤314处)之后,将刺激(例如,描绘普通二元和三元社交交互的电影)呈现给受试者。注视位置坐标被记录在时间上与刺激呈现相关。例如,如图5J的显示器400j中所示,窗口470指示当前“活动电影”以及将显示给受试者的“下一个电影”。另一个窗口472具有关于当前会话的信息,其包括完成百分比472a、流逝时间472b、示出的电影472c的数目和验证的点472d的数目。如先前指出的上下文按钮450不同于早期显示器中所显示的那些按钮,并给出操作者跳到下一个电影的选项,以及指示电影的数目,直到下一个校准检查。如以上关于步骤314所讨论的,眼睛跟踪校准的验证可在紧接初始校准之后立即发生,以及和/或者或校准可在已经将刺激呈现给受试者之后发生。在图5K的显示器400k中,在已经将刺激呈现给受试者之后(在该情况下,在示出了九个电影之后)执行校准检查。显示了覆盖物480,其包括类似于以上关于图5F讨论的那些窗口的窗口。上下文按钮450指示当前有效目标为“右上方”目标。

在步骤318处,当已经收集了足够的数据或者如果受试者变得烦躁或以其他方式不合作时(例如,假定受试者通常为年轻儿童、幼儿和婴儿),则结束会话。可记录过程结束的原因并指令操作者移动受试者(或使受试者的护理者移动受试者)。如图5L的显示器400I中所示,生成询问操作者的若干问题的覆盖物490,若干问题包括会话结束的原因以及对会话期间的各种事件排行的调查问卷。还示出了当前会话的各种统计的汇总492,其包括满足的数据需求的百分比、流逝时间、示出的电影、示出的校准检查和验证的校准目标的数目。可显示与会话相关的任何其他合适的度量。

根据某些实施例,本文描述的系统、设备和方法不要求用于指令受试者关于在给定会话期间做什么的言语中介。也就是说,眼睛跟踪系统不要求可跟随指挥的顺从的人以便收集有意义的数据。为了在没有言语中介的情况下记录有意义的数据,系统、设备和方法依赖视觉注意力的反射性或外来提示(无论是用于校准、校准的验证还是其他视觉刺激的显示),并且可使用自然刺激(例如,真实世界社交交互的视频场景)或拟自然刺激(例如,视频动画)以便收集数据并最终给出诊断。自然刺激和拟自然刺激为有效的,这是因为即使在受试者不或不能跟随指挥的情况下,刺激(例如,视频)仍自然地获得受试者的注意力并可记录有意义的数据。因此,对于将被收集的眼睛跟踪数据,受试者不需要意识到眼睛跟踪数据被正在被收集。

存在可根据本公开的实施例执行校准的若干方式。图6根据某些实施例示出用于校准眼睛跟踪数据的计算机实施的功能的流程图。可从不能够跟随言语指令(例如,由于年龄或功能的认知水平)的受试者获得适当的校准。过程500允许操作者自行裁量决定何时示出刺激以吸引受试者的注意力。本公开的眼睛跟踪系统、设备和方法因此对这些群体有效,因为基于该种操作者自行裁量,只要受试者跟随在预指定持续时间和定时出现的一组目标刺激,则不需要获得校准(尽管在一些实施例中,可以以该方式获得校准)。在一些实施例中,过程500的校准步骤可被执行作为图4的步骤310的部分。

一经开始校准过程500,在步骤510处为受试者显示脱敏电影。在脱敏电影的显示期间通常不记录数据;相反,电影被显示以获得受试者的注意力。电影可反射性地导致对受试者的外来提示,而不需要通过操作者的言语中介或指令。例如,由于电影本身捕获受试者的注意力,因此操作者不需要给出看着显示设备(例如,图2的显示设备103)的指令。当受试者注意时,在步骤520处显示校准或固视目标。校准或固视目标反射性地捕获受试者的注意力并导致朝向已知目标位置的眼跳和已知目标位置上的固视。目标可靠地将固视引到有限的位置(例如,小于0.5度的可视角度的径向对称目标跨越)。其他示例包括同心模式、形状或收缩刺激,使得即使最初在尺寸上较大,也能可靠地将固视引到固定的目标位置。

当受试者在看着目标时被操作者观察到时(步骤522),操作者使用输入设备(例如,通过按下“接受点”按钮)手动地指示(步骤524)所观察的固视。如果受试者没有正看着目标,则操作者可继续显示目标或者致使显示另一个脱敏电影。在某些实施例中,不同于操作者手动接受受试者正在看着校准目标或除了操作者手动接受受试者正在看着校准目标之外,设备(例如,设备100)包括软件或其他逻辑,其能够自动确定受试者正在看着目标(例如,识别目标周围的预定空间区域内的注视)。在步骤530处,眼睛跟踪器(例如,图2的眼睛跟踪设备104)确定是否检测到固视。如果未检测到固视,则操作者可允许目标的继续显示并尝试再次接受目标,或者可指引过程500返回到步骤510,并且为受试者再次显示脱敏电影。如果检测到固视,则在步骤540处,确定是否已经校准了全部点。任何合适数目的点可用于本公开的校准步骤中。优选地,校准至少两个点,尽管可使用附加的点(例如,五个)或更少的点(例如,包括没有点)。如果所有点还未被校准,则过程准备通过首先在步骤510处示出脱敏电影来在步骤550处示出下一个未校准目标。如果已经在步骤540处校准了所有点,则过程继续到步骤560,其中验证了校准的点。

图7根据某些实施例示出用于验证眼睛跟踪数据的计算机实施的功能的流程图。类似于图6中概述的过程500,操作者可自行裁量决定何时示出刺激以便吸引受试者的注意力。当操作者通知软件受试者正在看着目标时,计算从那时起的所记录的注视坐标信息并将其与所显示的目标的实际位置进行比较。具有不同程度成功的初始验证(例如,所验证的点的数目)将自动地指令操作者(1)重新校准眼睛跟踪器,(2)重新验证可能未被验证的那些目标,或者(3)接受校准并继续到数据收集软件的“显示刺激并记录注视坐标流”状态(例如,图4的步骤316)。类似于校准,应指出的是,本系统、设备和方法允许操作者自行裁量显示目标点和脱敏刺激(例如,电影)的时间选择。在一些实施例中,过程570的验证步骤可被执行作为图4的步骤314的部分。

验证过程570可在校准过程500的步骤560之后开始。然而,在一些实施例中,可在已经将刺激(例如,电影)显示给受试者之后执行(一次或多次)验证过程570,以便评定数据收集过程期间的数据准确性。在步骤580处,将脱敏电影显示给受试者。在脱敏电影的显示期间通常不记录数据;相反,电影被显示用于获得受试者的注意力。电影可以反射性地导致对受试者的外来提示,而不需要通过操作者的言语中介或指令。例如,由于电影本身捕获受试者的注意力,因此操作者不需要给出看着显示设备(例如,图2的显示设备103)的指令。当受试者注意时,在步骤590处显示校准或固视目标,并记录与受试者的注视位置坐标相关的数据。校准或固视目标反射性地捕获受试者的注意力并导致朝向已知目标位置的眼跳和已知目标位置上的固视。目标可靠地将固视引到有限的位置(例如,小于0.5度的可视角度的径向对称目标跨越)。其他示例包括同心模式、形状或收缩刺激,使得即使最初在尺寸上较大,也能可靠地将固视引到固定的目标位置。

当受试者在看着目标时被操作者观察到时(步骤592),操作者使用输入设备(例如,通过按下“接受点”按钮)手动地指示(步骤594)所观察的固视。如果受试者没有正看着目标,则操作者可继续显示目标或者致使显示另一个脱敏电影。在某些实施例中,不同于操作者手动接受受试者正在看着校准目标或除了操作者手动接受受试者正在看着校准目标之外,设备(例如,设备100)包括软件或其他逻辑,其能够自动确定受试者正在看着目标(例如,识别目标周围的预定空间区域内的注视)。在步骤600处,眼睛跟踪器(例如,图2的眼睛跟踪设备104)确定是否检测到固视。如果未检测到固视,则操作者可允许目标的继续显示并尝试再次接受目标,或者可指引过程570返回到步骤580,并且为受试者再次显示脱敏电影。如果检测到固视,则在步骤610处,计算固视的固视位置并在步骤620处确定固视是否落入目标的已知位置坐标的指定接近度阈值内。在步骤630处,如果固视不在指定接近度阈值内,则固视被拒绝作为验证点。否则,在步骤630处,如果固视在指定接近度阈值内,则固视被接受作为验证点。

在接受或拒绝固视之后,在步骤640处,确定是否已经示出了所有可用点(对应于所校准的点的数目)。如果不是所有点已经被示出,则过程准备通过首先在步骤580处示出脱敏电影来在步骤650处示出下一个目标。如果已经示出了所有点,则过程在步骤660处继续,其中确定是否接受了三个或四个验证点。肯定地,过程在步骤650处重复以示出附加点。如果接受少于三个验证点(步骤670),则系统在步骤680处清除校准并返回到校准过程(例如,图6的过程500)。在步骤690处,仅仅剩余的替换物指示在步骤690处已经接受了所有五个验证点。在该步骤处,验证过程570结束。前述讨论假设正在验证五个校准点。在一些实施例中,验证可为可接受的,其中仅仅五个校准点中的四个(或者在一些情况下,五个校准点中的三个)被接受。此外,将理解的是,可使用任何合数数目的校准点(在一些实施例中,包括零个校准点),并且可相应地更新验证过程570(具体地,步骤660、670/690)。

在以上讨论的校准过程和验证过程两者中,包括用于确定眼睛跟踪器是否检测固视的步骤(步骤530和步骤600)。图8根据某些实施例示出用于检测潜在校准点是否包括固视的计算机实施的功能的流程图。在一些实施例中,过程700的步骤可被执行作为图6的步骤530和/或图7的步骤600的部分。在操作者指示所观察的固视之后,系统可使用过程700的步骤确认或否认所指示的固视。眼睛跟踪数据收集软件确定在或接近其中所观察的固视被操作者指示的时间记录的数据中的固视位置坐标是否实际指示目标上的固视。在一些情况下,在操作者观察固视的时间中以及固视实际发生的时间中可存在延迟。眼睛跟踪数据收集软件和/或眼睛跟踪设备可因此考虑在或接近操作者指示所观察的固视的时间的一系列时间。例如,可相对于所观察的固视分析两秒的窗口(在所观察的固视的时间之前一秒和之后一秒)。如果在该窗口期间不存在固视,则数据点被确定不包括固视并且可被拒绝用于校准和/或验证目的。如果在该窗口中存在固视,则数据点被确定包括固视并且可被接受用于校准和/或验证目的。

在步骤710处,眼睛跟踪器确定是否识别了受试者的眼睛。如果未识别眼睛,则数据点在步骤720处被确定不包括固视,并且可被拒绝用于校准和/或验证目的。如果识别了眼睛,那么在步骤730处确定眼睛是否离眼睛跟踪设备适当的距离。任何合适的距离可用于从受试者收集数据,并且在一些实施例中,适当的距离可取决于特定受试者的一个或多个属性(例如,年龄)或眼睛跟踪器设备本身。如果眼睛不在离眼睛跟踪器的适当距离处,则数据点在步骤720处被确定不包括固视,并且可被拒绝用于校准目的和/或验证目的。如果眼睛在适当的距离处,那么在步骤740处确定眼睛移动是否指示稳定固视。例如,即使在数据包括固视的情况下,眼跳、平滑尾随跟踪或眨眼中的任一个还可存在于正被分析的时间窗口中。如果存在该种眼睛移动(例如,眼跳、平滑尾随跟踪、眨眼等等),则数据对于校准或验证目的可能不是可取的。各种技术可用于在步骤740处检测稳定固视。在一些实施例中,当眼睛移动在给定持续时间内小于给定速率或加速度时,可发生固视的指示。例如,当眼睛移动在大约100ms或更多时间内小于大约五度/秒时,可发生固视的指示。将理解的是,可定义任何其他合适的事件,以确定稳定固视的发生。如果该事件没有发生,则数据点在步骤720处被确定不包括固视,并且可被拒绝用于校准目的和/或验证目的。如果该事件发生了,那么在步骤750处,数据点被确定包括固视并且可被接受用于校准目的和/或验证目的。

除了在数据收集会话期间发生的校准数据的验证和错误检查之外,校准数据的验证和错误检查可发生在完成给定会话之后。眼睛跟踪数据的准确性为潜在地限制随后分析的有效性的特征。除了别的以外,准确性取决于初始受试者校准(通常在数据收集会话的开始时进行)的准确性、取决于可在整个周期数据收集内发生的任何头部移动,以及取决于数据质量和准确性中的自然的和预期的受试者间变化。如果限制了头部移动,则可维持初始校准的准确性;如果未限制头部移动,如优选地,准确性在数据收集会话期间可能改变(例如,偏斜数据点或初始校准的准确性中的漂移可作为数据收集会话期间的头部移动的结果发生)。下面参考图9和图10讨论用于评定和校正所收集的眼睛跟踪数据中的空间不准确性的算法。该算法在测试过程内的重新校准实例期间利用代表性固视点。该类代表性固视点可然后用于事后(即,在测试过程之后)转换以校准偏斜数据点。在一些实施例中,转换可在当收集数据时实时发生。附图根据某些实施例示出基于计算机实施的功能和准则的校准不准确性的评定和校正的代表性图像。

如以上所讨论的,可经由视觉刺激的呈现评定所收集的眼睛跟踪数据的准确性,所述视觉刺激反射性地捕获注意力并导致朝向已知目标位置的眼跳和已知目标位置上的固视。目标可靠地将固视引到有限的位置(例如,小于0.5度的可视角度的径向对称目标跨越)。其他示例包括同心模式、形状或收缩刺激,使得即使最初在尺寸上较大,也能可靠地将固视引到固定的目标位置。该类刺激可在具有头部限制的数据收集下测试,以便确保它们在理想测试环境下可靠地引起固视;然后它们的使用可被扩展到包括非头部限制的数据收集。

在一些实施例中,所收集的眼睛跟踪数据的准确性的数值评定可包括以下步骤:(1)呈现固视目标,其可靠地将固视引到视觉显示单元的小区域;(2)记录整个目标呈现内的眼睛跟踪数据;(3)在所收集的眼睛跟踪数据中识别固视;(4)计算固视位置坐标和目标位置坐标之间的差;(5)针对只有一个目标或者针对尽可能多个目标(通常为五个或九个但可以更多)将所计算的固视位置坐标和目标位置坐标之间的差存储作为矢量数据(方向和大小);以及(6)通过包括但不限于(a)三线性插值、(b)重心坐标中的线性插值、(c)仿射转换和(d)分段多项式转换的方法应用空间转换以使固视位置坐标与实际目标位置坐标对准。

如图9中所示,所记录的眼睛跟踪数据810被输出到文件820(或多个文件),其包含与刺激(例如,通过受试者察看的电影列表)相关的眼睛跟踪数据和信息。所收集的原始数据在附图中被视觉上地描绘为具有对应于图像分辨率(该分辨率可以是显示屏幕的实际分辨率或者可以是减小的分辨率以便减小处理时间)的轴830a、830b的显示830。如可在显示830中看出,原始数据指示某些固视位置坐标(例如,点823)通常彼此一致,但偏离它们各自已知的目标位置坐标(例如,目标834)。显示840示出用于使固视位置坐标832’与目标位置坐标834对准的空间转换的结果。关于转换的进一步细节在图10中的显示850的进展中示出。第一显示860示出从所收集的原始数据提取的固视数据。第二显示870示出确定了固视数据的中值,并且然后在第三显示880中,固视数据的中值与各自的固视位置阈值进行比较。在一些实施例中,忽视阈值之外的点(点884)。可选地或附加地,可根据它们的接近度以概率方式对该类点进行加权,以便在不取决于(或另外取决于)固定阈值的情况下计算集中趋势的加权估计(例如,中值)。在一些实施例中,在阈值内的点(点882)用作可接受点以用于将数据转换为显示890中示出的结果。将理解和明白的是,ASD以及其他发育或认知状况的检测的准确性取决于从所公开设备中的眼睛跟踪单元接收的眼睛跟踪数据的准确性。

现在返回图1,在通过数据收集系统20收集数据之后,将该数据传递到包括具有受试者匹配的安全数据库35的数据存储系统30。数据库优选地远离设备100以便容纳和聚集从许多设备收集的数据,但将理解的是,在一些实施例中,数据库对于设备来说可以是本地的。一旦完成数据收集,则可经由安全网络连接手动地或自动地将数据传递(例如,在周期基础上,诸如每小时或每晚)到在线数据库。在线数据库处接收数据之后分析数据。通常,分析涉及将一个特定受试者的行为与其他受试者的行为进行比较,所述其他受试者当被进行眼睛跟踪时已经看过类似电影。根据某些实施例,数据处理和分析的结果指示受试者具有(或将发育)ASD症状学的可能性。在一些实施例中,结果指示规范发育的典型性程度的度量,从而提供典型发育中的可变性的指示。

经由安全、基于网络的入口通常将分析的结果递送到每个受试者的医师或其他护理者。在一些实施例中,可存在操作者入口和医师入口。例如,操作者入口的定制接口被提供用于使操作者经由一个或多个电子设备访问数据库。在一些实施例中,一个或多个电子设备不具有相互的网络访问(即,数据可仅被推送到设备而不从设备接收)。在一些实施例中,经由该入口,用户可(a)为新受试者输入摄入信息,(b)访问用户手册和快速参考卡,以及(c)访问关于过去的受试者体验设备的信息(例如,关于先前会话的注意等等)。医师入口使得医师能够在已经处理原始数据后访问受试者的测试结果。入口通常可从因特网驱动设备获得。

图11根据本公开的某些实施例示出用于传递所收集的数据(例如,从图1的数据收集系统20)的系统900的方框图。系统900的布置可被体现作为图1的数据存储系统30以及数据处理和分析系统40。根据某些实施例,处理设施920处的数据库930提供集中式数据存储并与其他部件(诸如数据收集系统20以及数据处理和分析系统40)交互,并且通常使用设备将特定于受试者的信息两者提供给设备操作者并且提供给医师和/或专家。数据存储系统30可远离数据处理和分析系统40,或者这两个系统可为相同计算系统的部分。例如,如图9中所示,处理设施920包括数据存储装置930以及数据处理和分析935系统两者。

在一些实施例中,数据库为SQL服务器,并与以任何合适编程语言(例如,Python、Matlab)编写的工具配对,从而允许基于URL的接口和对数据库的查询。此外,数据库可与编程语言(例如,Python、Matlab)兼容,所述编程语言用于将数据从数据收集系统传递到数据库,以及将数据从数据库传递到中央处理计算机。例如,在设备(例如,图1的设备100)位于医疗设施910的情况下,数据收集发生在该设施910处并且数据在处理设施920的数据库930和医疗设施910之间传递。数据库为安全的、HIPAA兼容的,并通过冗余备份系统保护。

在某些实施例中,数据库经设计使得能够(a)摄入新受试者信息,(b)存储原始数据文件(例如,包括眼睛跟踪数据),(c)文件在数据收集设备、数据处理计算机和数据库之间的自动和安全传递,(d)数据的制表和查询,以用于评定设备利用和其他数据质量度量的目的,以及(e)通过医师访问处理的结果。数据库的示例性功能在图12中被描绘为根据某些实施例用于使用集中式数据库支持数据处理和分析步骤的数据收集的流程图1000。用于数据处理的数据库的进一步功能在图13中被描绘为根据某些实施例用于处理所收集的数据的流程图1050。流程图描绘在软件代码中实施的计算机实施的功能,所述软件代码与存储原始受试者数据以及通过数据处理和分析生成的文件的数据库相关。

在步骤1002处,执行受试者摄入。在收集数据之前,操作者或另一个经训练的用户可使用操作者入口或任何其他合适的安全、基于网络的工具将受试者添加到数据库(例如,图1的数据库35),所述任何其他合适的安全、基于网络的工具用于输入和查看摄入信息。在步骤1004处,将原始数据上传到数据库。在使用设备(例如,图1的设备100)完成数据收集会话之后,将两个文件上传到数据库,一个包含原始眼睛跟踪注视位置坐标,并且另一个包含与刺激(例如,通过受试者察看的那些电影的列表或播放列表)相关的信息。如果会话尝试未成功,则可仍上传具有受试者的标识符的空播放列表作为记录。

在步骤1006处,将数据存储到受试者文件。针对摄入记录检查所上传的数据(以及播放列表内的标识符)并且其(如果匹配)链接到受试者的记录。如果存在错配,则将数据存储在错误表中以用于手动调和。在步骤1008处,将数据下载到数据处理。定期安排的查询指示尚未被处理的原始数据并将该原始数据推送到中央处理计算机。在步骤1010处,数据处理涉及处理并然后分析原始数据文件,产生关于受试者的诊断信息。在某些实施例中,生成了三个文件,一个包含处理的ET数据,一个包含汇总性眼睛跟踪统计数据,并且一个包含诊断信息。下面参考图13的过程1050讨论数据处理的更多细节。在步骤1012处,存储所处理的文件。在步骤1010处通过处理生成的三个文件被随后上传到数据库并与受试者相关。在步骤1014处,数据被制成会话表。汇总性眼睛跟踪信息(例如,固视样本/电影等等)被从过程汇总ET文件读取并在数据库中制成表格以用于随后的查询。然后在数据库内计算汇总值(例如,固视/电影百分比等等)。

在步骤1016处,将结果制成结果表。汇总诊断数据被从诊断汇总处理文件读取并随后在数据库内被可视化以用于医师回顾。在步骤1018处,可查询数据。数据库允许基于URL的查询(例如,对于具有管理角色的那些)以跨越多个变量查询。例如,变量可包括受试者/设备、不良事件等等。在步骤1020处,医师入口(例如,基于网络的接口)允许医师察看测试结果。可基于测试结果提供预写的行动步骤(例如,寻求进一步的评估)。将理解的是,该公开的流程图的步骤仅仅是示例性的。可修改、省略或重新布置流程图的步骤中的任一个,可组合步骤中的两个或两个以上的步骤或者可添加任何附加步骤,而不脱离本公开的范围。

如以上提及的,图13根据某些实施例示出用于处理所收集的数据的流程图1050。在步骤1052处,将原始数据读入数据库(例如,图1的数据库35)中。例如,以任何合适的编程语言(例如,Python、Matlab)编写的软件脚本可用于将原始的、未处理的数据文件从数据库传递到计算机以用于处理。该计算机通常处理并分析输入的数据。可将两个文件读入程序中以用于分析,一个包含包括(x,y)注视位置坐标的眼睛跟踪数据,另一个包含与刺激(例如,通过受试者察看的电影列表)相关的信息。相关信息被分离出来并被仓储化(binned)。在步骤1054处,对数据重新取样以便考虑样本之间的任何时间差异。使用任何合适的插值技术对数据进行重新取样。在步骤1056处,将数据转化为适当的分辨率以用于分析(例如,640x 480像素)。通常以高于用于处理(例如,重新调整为640x 480像素)的分辨率的分辨率(例如,1024x 768像素)收集原始数据。将理解的是,任何合适的分辨率(包括所收集的数据的任何指定的原始分辨率)可用于数据处理。

在步骤1058处,识别固视、眼跳、眨眼和离屏或失败的数据点。算法自动识别其中受试者在固视、眼跳、眨眼的时间或者当受试者没有看着屏幕时的时间。在示例性实施例中,数据处理应用为自动可执行的,其以诸如Matlab的编程语言编写,尽管可使用任何其他合适的编程语言。通常,软件从在受试者的测试会话期间生成的原始文件提取相关信息,并使用该信息以通过统计分析获得诊断。在一个方面中,程序自动地识别基本眼球运动事件(固视、眼跳、眨眼、离屏或缺失数据等等),并调整用于如通过眼睛跟踪器件输出的注视位置估计中的偏差像差。例如,在步骤1060处,校正校准。通过从来自其间在其期间示出附加校准目标时起的时间的数据,校正注视位置中的任何差异。一些较大的差异可以将某些数据排除出随后的分析。在步骤1062处,执行错误检查。如果(a)受试者在低于电影持续时间的20%(或任何其他合适百分比)内固视屏幕或者受试者在屏幕上的固视小于20%(或任何其他合适的百分比)的电影持续时间,或者(b)未在它们的整个持续时间内示出电影,则来自电影的数据可以被排除出随后的分析。在步骤1060和步骤1062中的任一个或两者处,可使用以上相对于图9和图10讨论的数据评定和校正。

在步骤1064处,执行数据分析。针对跨越不同社交、认知或发育功能程度的受试者(例如,婴儿和幼儿),将个体受试者数据与注视位置中的显著差异的实例进行比较。数据的分析可通过比较揭示社交功能的程度。在该处理步骤内,受试者的眼睛跟踪数据的统计分析可用于确定该受试者是否被诊断有包括ASD的发育或认知状况。如先前在美国专利号7,922,670中公开且并入上文的,所处理的眼睛跟踪数据与现有数据模型进行比较,以确定发育或认知状况的程度。生成的分数然后与预定截断值或其他值进行比较,以确定受试者的ASD诊断以及状况的严重程度。

在步骤1066处,执行计数。注视位置坐标与跨越所示出的电影的每个帧的感兴趣的预指定区域进行比较。在步骤1068处,汇总相关统计数据。记录每个电影的汇总统计数据(包括屏幕和每个感兴趣的区域上的固视时间,以及眼跳、眨眼或以其他方式不与屏幕接合所花费的时间)。还汇总社交功能分析的结果。最后,在步骤1070处,将所处理的数据传回数据库。将两个文件传回数据库,一个包含汇总统计数据并且一个包含跟踪处理和分析的每个步骤的仓储化信息。类似于以上在步骤1052处所讨论的原始数据下载脚本,任何合适的脚本可用于将所有处理的数据文件传回数据库。如先前所讨论的,可经由医师入口访问处理的诊断结果。将理解的是,该公开的流程图的步骤仅仅是示例性的。可修改、省略或重新布置流程图的步骤中的任一个步骤,可组合步骤中的两个或两个以上的步骤或者可添加任何附加步骤,而不脱离本公开的范围。

可以以任何合适的方式将基于数据处理和分析的诊断或规定结果呈现给医师或其他护理者。例如,图14根据某些实施例示出图11的用于递送数据处理和分析的结果的系统900的方框图。系统900的该布置包括医疗设施910和处理设施920的数据库930。处理设施920通过数据库930可递送诊断报告/结果工作表940(如所示出的)。报告940包括与数据收集相关的著录和其他相关信息950、被描绘为诊断分数的测试结果960以及评论和推荐970。将理解的是,任何合适的格式可用于向医师或其他护理者提供诊断或规定结果。在一些实施例中,设备可提供有打印机以便直接递送测试结果。

例如,现参考图15,示出了受试者相对于其他发育或认知属性的发育或认知进展的计算机生成的数据表示。诊断生长图表1100指示与典型发育受试者以及被已知具有ASD的那些受试者的历史标准相比的若干示例性受试者的社交发育。例如,图表1110(a)和1120(a)涉及受试者,其基于单个数据点1110或基于随时间获取的多个数据点1120显示相对于具有ASD的那些受试者的典型发育。图表1110(b)和1120(b)涉及受试者,其基于单个数据点1110或基于随时间获取的多个数据点1120显示不同程度的ASD。

在前述讨论的基础上,将理解的是,本文公开的系统、设备和方法可在数字电子电路中、在计算机硬件中、固件中、软件中或其组合中实施。本公开的装置可在计算机程序产品中实施,所述计算机程序产品有形地体现在非暂时性机器可读或非暂时性计算机可读存储设备中以用于通过可编程处理器执行。可通过执行指令程序的可编程处理器实施本公开的方法或处理步骤以通过基于输入数据的操作以及通过生成输出数据来实施本公开的功能。可使用一个或若干计算机程序实施系统、设备和方法,所述计算机程序可在可编程系统中执行,所述可编程系统分别包括耦合用于从存储系统接收数据并向存储系统传输数据的至少一个可编程处理器、至少一个输入设备以及至少一个输出设备。可以以高层次或面向对象的编程语言和/或以汇编或机器编码或任何其他合适语言或编码来实施计算机程序。语言或编码可为编译或者解译的语言或编码。处理器可包括通用和专用微处理器。处理器从存储器接收指令和数据。适用于有形体现计算机程序指令和数据的存储设备包括非易失性存储器的形式,其通过示例的方式包括半导体存储器设备,诸如EPROM、EEPROM和闪存设备;磁盘,诸如内置硬盘和可移动磁盘;磁光磁盘;以及光盘。前述中的任一项可由ASIC(专用集成电路)补充或并入ASIC中。

前述仅为本公开原理的示例,并且可通过不同于所描述的实施例的实施例来实践系统、设备和方法,所描述的实施例被呈现用于说明而非限制的目的。尽管本文的实施例和特征被具体描述用于与收集和分析来自受试者的眼睛跟踪数据结合使用以用于自闭症谱系障碍(ASD)的评定、筛选、监控或诊断,但是将理解的是,系统、设备和方法还可应用于其他发育或认知障碍,以及其他状况(包括但不限于语言障碍、智力残疾、存在或不存在已知的遗传障碍的发育残疾,以及注意缺陷多动障碍(ADHD)、注意缺陷障碍(ADD)、创伤后精神紧张性障碍(PTSD)、头部创伤、脑震荡、运动损伤和痴呆)。将理解的是,如果不指示用于障碍的度量,则该类数据可提供规范发育的典型性程度的度量,从而提供典型发育中的可变性的指示。此外,下面所概述的所有部件和其他特征可以以任何合适的方式彼此组合,并且可适应和应用到医疗诊断以外的系统。例如,本公开的交互式视觉刺激可被用作治疗工具。此外,所收集的数据可产生受试者优选注意的某些类型的视觉刺激的度量。该类优选度量应用在医疗诊断和治疗的领域中和该领域之外(包括例如广告或其中对与视觉刺激优选相关的数据感兴趣的其他行业)两者。

本领域技术人员将在回顾本公开之后想到变化和修改。所公开的特征可以以具有本文所描述的一个或多个其他特征的任何组合和子组合(包括多个从属组合和子组合)来实施。以上所描述或示出的各种特征(包括其任何组成部分)可在其他系统中组合或整合。此外,可省略或不实施某些特征。

可由本领域一个技术人员确定并且可作出改变、替换和变更的示例而不脱离本文所公开的信息的范围。本文引用的所有参考通过引用以其整体并入本文并且成为本申请的部分。

Claims (20)

1.一种用于从眼睛跟踪器件收集数据的方法,所述方法包括:

致使显示第一视觉图像;

在显示所述第一视觉图像之后,致使显示固视目标代替所述第一视觉图像;

从所述眼睛跟踪器件接收指示受试者相对于显示的固视目标的眼睛移动的数据;以及

响应于接收到指示所述受试者的眼睛移动的所述数据,致使显示第二视觉图像代替所述固视目标;

其中所述第一视觉图像和所述第二视觉图像为动态视觉图像。

2.根据权利要求1所述的方法,其中所述固视目标触发所述受试者的反射性眼睛移动。

3.根据权利要求1或2所述的方法,其中在没有言语指令的情况下引起所述受试者的所述眼睛移动。

4.根据权利要求1或2所述的方法,还包括:

从指示所述受试者的眼睛移动的所述数据识别固视;

计算所述固视的固视位置坐标;以及

确定所述固视位置坐标是否在所述显示的固视目标的已知目标位置坐标的接近度阈值内。

5.根据权利要求4所述的方法,其中如果所述固视位置坐标不在所述接近度阈值内,则为了校准目的拒绝指示所述受试者的眼睛移动的所述数据。

6.根据权利要求4所述的方法,还包括从操作者接收手动指示,所述手动指示从通过所述操作者观察的固视识别所述固视。

7.根据权利要求4所述的方法,还包括从操作者接收手动指示,所述手动指示使用通过所述操作者观察的固视印证所识别的固视。

8.根据权利要求1-2以及5-7中的任一项所述的方法,还包括确定所接收的数据是否指示在所述受试者相对于所述显示的固视目标的眼睛移动期间的眨眼、眼跳或平滑尾随跟踪中的任一个。

9.根据权利要求8所述的方法,其中如果所接收的数据指示在所述受试者相对于所述显示的固视目标的眼睛移动期间的眨眼、眼跳或平滑尾随跟踪中的任一个,则至少部分为了校准目的拒绝指示所述受试者的眼睛移动的数据。

10.根据权利要求1或2所述的方法,其中如果指示所述受试者的眼睛移动的所述数据不包括固视,则为了校准目的拒绝所述数据。

11.根据权利要求1-2、5-7以及9中的任一项所述的方法,其中所述第一视觉图像不同于所述第二视觉图像。

12.根据权利要求1-2、5-7以及9中的任一项所述的方法,其中所述第一视觉图像与所述第二视觉图像相同。

13.根据权利要求1-2、5-7以及9中的任一项所述的方法,还包括致使显示一个或多个随后的固视目标替代所述第二视觉图像。

14.根据权利要求13所述的方法,其中在显示每个相应的随后固视目标之后显示相应的视觉图像。

15.根据权利要求14所述的方法,其中每个相应的视觉图像不同于所述第一视觉图像和所述第二视觉图像。

16.根据权利要求14所述的方法,其中每个相应的视觉图像与所述第一视觉图像和所述第二视觉图像相同。

17.根据权利要求13所述的方法,其中每个相应的随后固视目标具有相应的目标位置坐标。

18.根据权利要求1-2、5-7、9以及14-17中的任一项所述的方法,其中响应于来自观察所述受试者的操作者的手动指示显示所述固视目标。

19.根据权利要求1-2、5-7、9以及14-17中的任一项所述的方法,其中基于所述受试者的属性来选择所述第一视觉图像和所述第二视觉图像。

20.根据权利要求19所述的方法,其中所述属性为所述受试者的年龄。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US201361775880P | 2013-03-11 | 2013-03-11 | |

| US61/775,880 | 2013-03-11 | ||

| CN201480020606.XA CN105163648B (zh) | 2013-03-11 | 2014-03-11 | 用于认知和发育状况的检测的系统和方法 |

Related Parent Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201480020606.XA Division CN105163648B (zh) | 2013-03-11 | 2014-03-11 | 用于认知和发育状况的检测的系统和方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN109124657A CN109124657A (zh) | 2019-01-04 |

| CN109124657B true CN109124657B (zh) | 2021-11-23 |

Family

ID=50630989

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201810873155.4A Active CN109124657B (zh) | 2013-03-11 | 2014-03-11 | 用于认知和发育状况的检测的系统和方法 |

| CN201480020606.XA Active CN105163648B (zh) | 2013-03-11 | 2014-03-11 | 用于认知和发育状况的检测的系统和方法 |

Family Applications After (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201480020606.XA Active CN105163648B (zh) | 2013-03-11 | 2014-03-11 | 用于认知和发育状况的检测的系统和方法 |

Country Status (15)

| Country | Link |

|---|---|

| US (3) | US9265416B2 (zh) |

| EP (1) | EP2967314B1 (zh) |

| JP (1) | JP6462657B2 (zh) |

| KR (1) | KR102179931B1 (zh) |

| CN (2) | CN109124657B (zh) |

| AU (1) | AU2014248925B2 (zh) |

| BR (1) | BR112015022523A2 (zh) |

| CA (1) | CA2904346C (zh) |

| ES (1) | ES2877350T3 (zh) |

| HK (1) | HK1220597A1 (zh) |

| IL (1) | IL241256B (zh) |

| MX (1) | MX363272B (zh) |

| NZ (1) | NZ712214A (zh) |

| SG (1) | SG11201507147VA (zh) |

| WO (1) | WO2014164858A1 (zh) |

Families Citing this family (72)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2013105114A2 (en) * | 2011-12-05 | 2013-07-18 | Gautam Singh | A computer implemented system and method for statistically assessing co-scholastic skills of a user |

| JP6559062B2 (ja) | 2012-03-26 | 2019-08-14 | ニューヨーク ユニバーシティ | 中枢神経系の完全性を評価するための方法およびキット |

| ES2877350T3 (es) * | 2013-03-11 | 2021-11-16 | Childrens Healthcare Atlanta Inc | Procedimientos para la detección de afecciones cognitivas y del desarrollo |

| WO2014204904A1 (en) | 2013-06-17 | 2014-12-24 | New York University | Methods and kits for assessing neurological and ophthalmic function and localizing neurological lesions |

| WO2015057315A1 (en) | 2013-09-04 | 2015-04-23 | Kelly Joseph Michael Lawless | Methods and systems for the detection of disease |

| CN105873515B (zh) | 2013-10-17 | 2020-11-20 | 亚特兰大儿童医疗保健公司 | 用于经由眼跟踪来评估婴儿和儿童发育的方法 |

| US9804753B2 (en) * | 2014-03-20 | 2017-10-31 | Microsoft Technology Licensing, Llc | Selection using eye gaze evaluation over time |

| US9465981B2 (en) | 2014-05-09 | 2016-10-11 | Barron Associates, Inc. | System and method for communication |

| WO2016022414A1 (en) | 2014-08-04 | 2016-02-11 | New York University | Methods and kits for diagnosing, assessing or quantitating drug use, drug abuse and narcosis, internuclear ophthalmoplegia, attention deficit hyperactivity disorder (adhd), chronic traumatic encephalopathy, schizophrenia spectrum disorders and alcohol consumption |

| KR20160049273A (ko) * | 2014-10-27 | 2016-05-09 | 삼성전자주식회사 | 의료 영상 장치 |

| US9782069B2 (en) * | 2014-11-06 | 2017-10-10 | International Business Machines Corporation | Correcting systematic calibration errors in eye tracking data |

| RU2582180C1 (ru) * | 2015-03-20 | 2016-04-20 | Виктор Маркович Шкловский | Аппаратно-программный комплекс для обеспечения физической, профессиональной или когнитивной терапии пациентов с нарушением высших психических функций |

| CN107710050A (zh) | 2015-06-30 | 2018-02-16 | 3M创新有限公司 | 照明器 |

| CN105069304B (zh) * | 2015-08-18 | 2019-04-05 | 广东顺德中山大学卡内基梅隆大学国际联合研究院 | 一种基于机器学习的评估预测asd的装置 |

| CA2901477C (en) | 2015-08-25 | 2023-07-18 | Evolution Optiks Limited | Vision correction system, method and graphical user interface for implementation on electronic devices having a graphical display |

| US11972336B2 (en) * | 2015-12-18 | 2024-04-30 | Cognoa, Inc. | Machine learning platform and system for data analysis |

| CN105534483B (zh) * | 2016-02-03 | 2018-05-04 | 中国科学院昆明动物研究所 | 触屏多功能非人灵长类动物认知功能测试方法 |

| AU2017305321B2 (en) | 2016-08-02 | 2022-12-22 | New York University | Methods and kits for assessing neurological function and localizing neurological lesions |

| US10863902B2 (en) | 2016-10-03 | 2020-12-15 | Oculogica Inc. | Method for detecting glaucoma |

| WO2018066422A1 (ja) * | 2016-10-07 | 2018-04-12 | パナソニックIpマネジメント株式会社 | 認知機能評価装置、認知機能評価方法及びプログラム |

| JP7182554B2 (ja) | 2016-11-14 | 2022-12-02 | コグノア,インク. | 発達に係る疾病を評価し、およびカバー率と信頼度に対する制御を提供する方法および装置 |

| JP7141396B2 (ja) * | 2016-12-07 | 2022-09-22 | オークランド ユニサービシズ リミテッド | 刺激及び視標追跡システム |

| FR3062307B1 (fr) * | 2017-01-30 | 2022-01-21 | Herve Harounian | Dispositif et procede de stimulation cognitive d'un patient |

| US11141095B2 (en) | 2017-02-17 | 2021-10-12 | Oculogica Inc. | Method and system for detecting concussion |

| EP3592204B1 (en) * | 2017-03-05 | 2024-05-08 | Virtuoptica Ltd. | Eye examination method and apparatus therefor |

| US10950346B2 (en) | 2017-04-28 | 2021-03-16 | International Business Machines Corporation | Utilizing artificial intelligence for data extraction |

| CN109276228B (zh) * | 2017-07-21 | 2020-12-25 | 成都集思鸣智科技有限公司 | 一种检测大脑功能的系统及其装置 |

| CN107397527B (zh) * | 2017-07-26 | 2019-04-30 | 武汉爱尔眼科医院有限公司 | 一种眼睛视力测量装置 |

| US10599682B2 (en) | 2017-08-08 | 2020-03-24 | International Business Machines Corporation | User interaction during ground truth curation in a cognitive system |

| US20210233652A1 (en) * | 2017-08-10 | 2021-07-29 | Nuance Communications, Inc. | Automated Clinical Documentation System and Method |

| US11074996B2 (en) | 2017-08-10 | 2021-07-27 | Nuance Communications, Inc. | Automated clinical documentation system and method |

| EP3668403B1 (en) * | 2017-09-13 | 2021-12-29 | Oculogica Inc. | Eye tracking system |

| CA3086037A1 (en) * | 2017-11-30 | 2019-06-06 | Viewmind S.A. | System and method for detecting neurological disorders and for measuring general cognitive performance |

| WO2019157053A1 (en) | 2018-02-07 | 2019-08-15 | RightEye, LLC | Systems and methods for assessing user physiology based on eye tracking data |

| WO2019173331A1 (en) | 2018-03-05 | 2019-09-12 | Nuance Communications, Inc. | System and method for review of automated clinical documentation |

| US11250382B2 (en) | 2018-03-05 | 2022-02-15 | Nuance Communications, Inc. | Automated clinical documentation system and method |

| EP3591664A1 (en) | 2018-07-05 | 2020-01-08 | Université Libre de Bruxelles (ULB) | Method for evaluating a risk of neurodevelopmental disorder with a child |

| EP3591665A1 (en) * | 2018-07-05 | 2020-01-08 | Universite Libre De Bruxelles | Method for evaluating a risk of neurodevelopmental disorder with a child |

| US11406257B2 (en) * | 2018-07-27 | 2022-08-09 | Welch Allyn, Inc. | Vision screening device and methods |

| CN109259775A (zh) * | 2018-08-30 | 2019-01-25 | 清华大学 | 一种人脸刺激范式生成方法及自闭症分析系统 |

| US11966507B2 (en) | 2018-10-22 | 2024-04-23 | Evolution Optiks Limited | Light field vision testing device, adjusted pixel rendering method therefor, and vision testing system and method using same |

| US11500460B2 (en) | 2018-10-22 | 2022-11-15 | Evolution Optiks Limited | Light field device, optical aberration compensation or simulation rendering |

| US11327563B2 (en) | 2018-10-22 | 2022-05-10 | Evolution Optiks Limited | Light field vision-based testing device, adjusted pixel rendering method therefor, and online vision-based testing management system and method using same |

| CN109620258A (zh) * | 2018-12-04 | 2019-04-16 | 北京大学 | 基于眼动技术测量孤独症重复刻板行为的测试装置 |

| CN109589122B (zh) * | 2018-12-18 | 2022-02-15 | 中国科学院深圳先进技术研究院 | 一种认知能力测评系统及方法 |

| CN109464151B (zh) * | 2018-12-29 | 2021-09-07 | 中国科学院深圳先进技术研究院 | 注意抑制能力获取方法、装置、设备及存储介质 |

| US11789531B2 (en) | 2019-01-28 | 2023-10-17 | Evolution Optiks Limited | Light field vision-based testing device, system and method |

| US11500461B2 (en) | 2019-11-01 | 2022-11-15 | Evolution Optiks Limited | Light field vision-based testing device, system and method |

| CN109770921B (zh) * | 2019-02-03 | 2020-12-08 | 清华大学 | 自闭症儿童早期语言与认知能力筛查的方法及装置 |

| CN109758166A (zh) * | 2019-03-06 | 2019-05-17 | 西安市儿童医院 | 消毒式儿童智力测试专用桌 |

| JP7215246B2 (ja) | 2019-03-08 | 2023-01-31 | 株式会社Jvcケンウッド | 表示装置、表示方法、及び表示プログラム |

| CA3134747A1 (en) | 2019-04-23 | 2020-10-29 | Evolution Optiks Limited | Light field display and vibrating light field shaping layer and vision testing and/or correction device |

| WO2020219446A1 (en) | 2019-04-23 | 2020-10-29 | Evolution Optiks Limited | Digital display device comprising a complementary light field display or display portion, and vision correction system and method using same |

| KR102255399B1 (ko) * | 2019-06-17 | 2021-05-24 | 김도훈 | 하이브리드 카시트 장치, 이를 이용한 영유아 안전 제공 시스템 및 방법 |

| WO2021038422A2 (en) | 2019-08-26 | 2021-03-04 | Evolution Optiks Limited | Binocular light field display, adjusted pixel rendering method therefor, and vision correction system and method using same |

| IL290886B2 (en) * | 2019-08-26 | 2024-12-01 | Evolution Optiks Ltd | Vision-based device for light field inspection, method for adjusting pixel rendering, online system for managing vision-based inspection and method for using the same |

| CN110547756A (zh) * | 2019-09-17 | 2019-12-10 | 广州智伴人工智能科技有限公司 | 一种视力测试方法、装置和系统 |

| CN110652281B (zh) * | 2019-10-25 | 2023-02-24 | 北京机械设备研究所 | 一种基于虚拟现实技术的视野计及视野检测方法 |

| US11487361B1 (en) | 2019-11-01 | 2022-11-01 | Evolution Optiks Limited | Light field device and vision testing system using same |

| US12112665B2 (en) | 2019-11-01 | 2024-10-08 | Evolution Optiks Limited | Light field device, variable perception pixel rendering method therefor, and variable perception system and method using same |

| US11823598B2 (en) | 2019-11-01 | 2023-11-21 | Evolution Optiks Limited | Light field device, variable perception pixel rendering method therefor, and variable perception system and method using same |

| KR102281927B1 (ko) * | 2019-11-27 | 2021-07-26 | 고큐바테크놀로지 주식회사 | 다양한 상태의 눈을 위한 동공 추적 방법 및 이를 이용한 건강 진단 시스템 |

| CN111568367B (zh) * | 2020-05-14 | 2023-07-21 | 中国民航大学 | 一种识别和量化眼跳入侵的方法 |

| CN111939422A (zh) * | 2020-08-13 | 2020-11-17 | 深圳市艾利特医疗科技有限公司 | 一种用于自闭症儿童的基于听觉训练的康复装置 |

| KR102529240B1 (ko) * | 2020-11-24 | 2023-05-04 | (주)싱스웰 | 사용자 맞춤형 서비스를 제공하는 캡슐형 스마트 쉘터 |

| CN113274021B (zh) * | 2021-04-25 | 2023-11-28 | 阿呆科技(北京)有限公司 | 基于惊反射诱发的创伤后应激障碍诊断评估系统 |

| US20220358645A1 (en) * | 2021-05-04 | 2022-11-10 | Bsolutions, Inc. | Systems and methods for developmental monitoring of children |

| JP2023006771A (ja) * | 2021-06-30 | 2023-01-18 | キヤノン株式会社 | 制御装置およびその制御方法 |

| KR102377135B1 (ko) * | 2021-08-19 | 2022-03-21 | 의료법인 명지의료재단 | 노인의 인지 기능 측정 방법 및 시스템 |

| US11556174B1 (en) * | 2022-03-30 | 2023-01-17 | Motorola Mobility Llc | Monitoring system having contextual gaze-detection-based selection/triggering of caregiver functions |

| US11903711B2 (en) | 2022-06-09 | 2024-02-20 | EarliTec Diagnostics, Inc. | Assessing developmental disorders via eye tracking |

| EP4331470A1 (en) * | 2022-08-30 | 2024-03-06 | DIVE Medical SL | Validation of eye tracking data |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2006106877A1 (ja) * | 2005-03-31 | 2006-10-12 | The University Of Tokyo | 視野計及び視野計測方法 |

| US7922670B2 (en) * | 2005-02-24 | 2011-04-12 | Warren Jones | System and method for quantifying and mapping visual salience |

| CN102245085A (zh) * | 2008-10-14 | 2011-11-16 | 俄亥俄大学 | 利用眼跟踪的认知和语言评估 |

Family Cites Families (26)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US4474186A (en) * | 1979-07-17 | 1984-10-02 | Georgetown University | Computerized electro-oculographic (CEOG) system with feedback control of stimuli |

| JPH0655203B2 (ja) * | 1992-07-09 | 1994-07-27 | 株式会社エイ・ティ・アール視聴覚機構研究所 | 視線検出を用いた医療診断装置 |

| JP3821259B2 (ja) * | 1998-02-12 | 2006-09-13 | 独立行政法人科学技術振興機構 | 眼球運動観察用装着具、視標投影装置、及びこれらを用いた平衡機能検査装置 |

| JP2002513176A (ja) | 1998-04-29 | 2002-05-08 | カーネギー−メロン ユニバーシティ | 2つの異なる波長の光を用いて対象者の眼を監視する装置および方法 |

| US6106119A (en) | 1998-10-16 | 2000-08-22 | The Board Of Trustees Of The Leland Stanford Junior University | Method for presenting high level interpretations of eye tracking data correlated to saved display images |

| US6231187B1 (en) | 1999-02-11 | 2001-05-15 | Queen's University At Kingston | Method and apparatus for detecting eye movement |

| JP2002253509A (ja) * | 2000-12-28 | 2002-09-10 | Matsushita Electric Works Ltd | 脳機能検査方法とその装置、脳機能検査システム、脳機能検査サービス方法及びそのプログラムと装置 |

| WO2002064031A2 (en) | 2001-02-09 | 2002-08-22 | Sensomotoric Instruments Gmbh | Multidimensional eye tracking and position measurement system |

| US6752498B2 (en) * | 2001-05-14 | 2004-06-22 | Eastman Kodak Company | Adaptive autostereoscopic display system |

| GB0210288D0 (en) * | 2002-05-04 | 2002-06-12 | Univ Nottingham | Ocular display apparatus for assessment and measurement of and for treatment of ocular disorders, and methods therefor |

| US6896655B2 (en) * | 2002-08-05 | 2005-05-24 | Eastman Kodak Company | System and method for conditioning the psychological state of a subject using an adaptive autostereoscopic display |

| US7892180B2 (en) * | 2002-11-18 | 2011-02-22 | Epley Research Llc | Head-stabilized medical apparatus, system and methodology |

| US7533989B2 (en) | 2003-12-25 | 2009-05-19 | National University Corporation Shizuoka University | Sight-line detection method and device, and three-dimensional view-point measurement device |

| US7819818B2 (en) | 2004-02-11 | 2010-10-26 | Jamshid Ghajar | Cognition and motor timing diagnosis using smooth eye pursuit analysis |

| JP2006087833A (ja) * | 2004-09-27 | 2006-04-06 | Matsushita Electric Works Ltd | 認知機能検査方法、認知機能検査プログラム、認知機能検査装置 |

| GB0709405D0 (en) * | 2007-05-16 | 2007-06-27 | Univ Edinburgh | Testing vision |

| US7556377B2 (en) * | 2007-09-28 | 2009-07-07 | International Business Machines Corporation | System and method of detecting eye fixations using adaptive thresholds |

| AU2009236301A1 (en) * | 2008-04-14 | 2009-10-22 | The Johns Hopkins University | Systems and methods for testing vestibular and oculomotor function |

| US8808195B2 (en) | 2009-01-15 | 2014-08-19 | Po-He Tseng | Eye-tracking method and system for screening human diseases |

| US20120314045A1 (en) | 2009-08-26 | 2012-12-13 | Ecole Polytechnique Federale De Lausanne (Epfl) | Wearable systems for audio, visual and gaze monitoring |

| US8371693B2 (en) | 2010-03-30 | 2013-02-12 | National University Corporation Shizuoka University | Autism diagnosis support apparatus |

| US8885877B2 (en) * | 2011-05-20 | 2014-11-11 | Eyefluence, Inc. | Systems and methods for identifying gaze tracking scene reference locations |

| ES2877350T3 (es) * | 2013-03-11 | 2021-11-16 | Childrens Healthcare Atlanta Inc | Procedimientos para la detección de afecciones cognitivas y del desarrollo |

| US9301675B2 (en) * | 2013-03-15 | 2016-04-05 | Neuro Kinetics, Inc | Method and apparatus for validating testing procedures in objective ophthalmic eye testing for eye evaluation applications requiring subject compliance with eye fixation to a visual target |

| KR102224932B1 (ko) * | 2014-02-19 | 2021-03-08 | 삼성전자주식회사 | 비전 센서를 이용한 사용자 입력 처리 장치 및 사용자 입력 처리 방법 |

| US10120413B2 (en) * | 2014-09-11 | 2018-11-06 | Interaxon Inc. | System and method for enhanced training using a virtual reality environment and bio-signal data |

-

2014

- 2014-03-11 ES ES14721043T patent/ES2877350T3/es active Active

- 2014-03-11 MX MX2015012061A patent/MX363272B/es unknown

- 2014-03-11 JP JP2016501301A patent/JP6462657B2/ja active Active

- 2014-03-11 CA CA2904346A patent/CA2904346C/en active Active

- 2014-03-11 SG SG11201507147VA patent/SG11201507147VA/en unknown

- 2014-03-11 AU AU2014248925A patent/AU2014248925B2/en active Active

- 2014-03-11 BR BR112015022523A patent/BR112015022523A2/pt not_active IP Right Cessation

- 2014-03-11 KR KR1020157028283A patent/KR102179931B1/ko active IP Right Grant

- 2014-03-11 CN CN201810873155.4A patent/CN109124657B/zh active Active

- 2014-03-11 US US14/205,012 patent/US9265416B2/en active Active

- 2014-03-11 CN CN201480020606.XA patent/CN105163648B/zh active Active

- 2014-03-11 EP EP14721043.9A patent/EP2967314B1/en active Active

- 2014-03-11 WO PCT/US2014/023644 patent/WO2014164858A1/en active Application Filing

- 2014-03-11 NZ NZ712214A patent/NZ712214A/en not_active IP Right Cessation

-

2015

- 2015-09-07 IL IL241256A patent/IL241256B/en active IP Right Grant

-

2016

- 2016-01-15 US US14/996,816 patent/US10022049B2/en active Active

- 2016-07-20 HK HK16108688.2A patent/HK1220597A1/zh unknown

-

2018

- 2018-06-14 US US16/008,667 patent/US10702150B2/en active Active

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US7922670B2 (en) * | 2005-02-24 | 2011-04-12 | Warren Jones | System and method for quantifying and mapping visual salience |

| WO2006106877A1 (ja) * | 2005-03-31 | 2006-10-12 | The University Of Tokyo | 視野計及び視野計測方法 |

| CN102245085A (zh) * | 2008-10-14 | 2011-11-16 | 俄亥俄大学 | 利用眼跟踪的认知和语言评估 |

Also Published As

| Publication number | Publication date |

|---|---|

| CN105163648A (zh) | 2015-12-16 |

| CN109124657A (zh) | 2019-01-04 |

| CA2904346C (en) | 2021-09-28 |

| WO2014164858A1 (en) | 2014-10-09 |

| CN105163648B (zh) | 2018-08-28 |

| MX363272B (es) | 2019-03-19 |

| US20180289259A1 (en) | 2018-10-11 |

| KR20150141957A (ko) | 2015-12-21 |

| US10702150B2 (en) | 2020-07-07 |

| IL241256A0 (en) | 2015-11-30 |

| SG11201507147VA (en) | 2015-10-29 |

| AU2014248925A1 (en) | 2015-10-01 |

| CA2904346A1 (en) | 2014-10-09 |

| EP2967314A1 (en) | 2016-01-20 |

| US9265416B2 (en) | 2016-02-23 |

| BR112015022523A2 (pt) | 2017-07-18 |

| MX2015012061A (es) | 2016-07-05 |

| US20140253876A1 (en) | 2014-09-11 |

| IL241256B (en) | 2019-09-26 |

| EP2967314B1 (en) | 2021-06-02 |

| NZ712214A (en) | 2019-03-29 |

| HK1220597A1 (zh) | 2017-05-12 |

| AU2014248925B2 (en) | 2018-07-12 |

| KR102179931B1 (ko) | 2020-11-18 |

| US10022049B2 (en) | 2018-07-17 |

| US20160262612A1 (en) | 2016-09-15 |

| JP2016515017A (ja) | 2016-05-26 |

| JP6462657B2 (ja) | 2019-01-30 |

| ES2877350T3 (es) | 2021-11-16 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN109124657B (zh) | 用于认知和发育状况的检测的系统和方法 | |

| US11864832B2 (en) | Systems and methods for assessing infant and child development via eye tracking | |

| US11903711B2 (en) | Assessing developmental disorders via eye tracking | |

| US20240398302A1 (en) | Systems and methods for using portable computer devices having eye-tracking capability |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant |