WO2021131767A1 - 送信装置、送信方法、受信装置および受信方法 - Google Patents

送信装置、送信方法、受信装置および受信方法 Download PDFInfo

- Publication number

- WO2021131767A1 WO2021131767A1 PCT/JP2020/046175 JP2020046175W WO2021131767A1 WO 2021131767 A1 WO2021131767 A1 WO 2021131767A1 JP 2020046175 W JP2020046175 W JP 2020046175W WO 2021131767 A1 WO2021131767 A1 WO 2021131767A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- tactile presentation

- signal

- channel

- channels

- transmission

- Prior art date

Links

- 238000000034 method Methods 0.000 title claims description 41

- 230000005540 biological transmission Effects 0.000 claims abstract description 188

- 230000005236 sound signal Effects 0.000 claims abstract description 69

- 238000012545 processing Methods 0.000 claims description 33

- 230000007274 generation of a signal involved in cell-cell signaling Effects 0.000 claims description 15

- 230000008859 change Effects 0.000 claims description 7

- 230000003287 optical effect Effects 0.000 claims description 7

- 210000001015 abdomen Anatomy 0.000 description 45

- 210000003127 knee Anatomy 0.000 description 24

- 210000002784 stomach Anatomy 0.000 description 24

- 210000000707 wrist Anatomy 0.000 description 22

- 230000035807 sensation Effects 0.000 description 15

- 230000008878 coupling Effects 0.000 description 14

- 238000010168 coupling process Methods 0.000 description 14

- 238000005859 coupling reaction Methods 0.000 description 14

- 238000005516 engineering process Methods 0.000 description 12

- 230000003187 abdominal effect Effects 0.000 description 10

- GJWAPAVRQYYSTK-UHFFFAOYSA-N [(dimethyl-$l^{3}-silanyl)amino]-dimethylsilicon Chemical compound C[Si](C)N[Si](C)C GJWAPAVRQYYSTK-UHFFFAOYSA-N 0.000 description 8

- 230000008569 process Effects 0.000 description 8

- 230000008054 signal transmission Effects 0.000 description 8

- 230000006854 communication Effects 0.000 description 7

- 238000004891 communication Methods 0.000 description 7

- 238000010586 diagram Methods 0.000 description 6

- 238000013507 mapping Methods 0.000 description 6

- 230000000694 effects Effects 0.000 description 4

- 230000004048 modification Effects 0.000 description 4

- 238000012986 modification Methods 0.000 description 4

- 230000007175 bidirectional communication Effects 0.000 description 3

- 239000000284 extract Substances 0.000 description 3

- 230000006870 function Effects 0.000 description 3

- 230000014509 gene expression Effects 0.000 description 3

- 238000003780 insertion Methods 0.000 description 3

- 230000037431 insertion Effects 0.000 description 3

- 230000001360 synchronised effect Effects 0.000 description 3

- 238000005315 distribution function Methods 0.000 description 2

- 239000000203 mixture Substances 0.000 description 2

- 230000015541 sensory perception of touch Effects 0.000 description 2

- 230000009471 action Effects 0.000 description 1

- 210000000038 chest Anatomy 0.000 description 1

- 230000001186 cumulative effect Effects 0.000 description 1

- 238000001514 detection method Methods 0.000 description 1

- 238000004519 manufacturing process Methods 0.000 description 1

- 230000001151 other effect Effects 0.000 description 1

- 230000002040 relaxant effect Effects 0.000 description 1

- 230000000630 rising effect Effects 0.000 description 1

- 230000000007 visual effect Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/008—Multichannel audio signal coding or decoding using interchannel correlation to reduce redundancy, e.g. joint-stereo, intensity-coding or matrixing

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/16—Sound input; Sound output

- G06F3/165—Management of the audio stream, e.g. setting of volume, audio stream path

-

- G—PHYSICS

- G08—SIGNALLING

- G08C—TRANSMISSION SYSTEMS FOR MEASURED VALUES, CONTROL OR SIMILAR SIGNALS

- G08C15/00—Arrangements characterised by the use of multiplexing for the transmission of a plurality of signals over a common path

- G08C15/06—Arrangements characterised by the use of multiplexing for the transmission of a plurality of signals over a common path successively, i.e. using time division

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04J—MULTIPLEX COMMUNICATION

- H04J3/00—Time-division multiplex systems

- H04J3/16—Time-division multiplex systems in which the time allocation to individual channels within a transmission cycle is variable, e.g. to accommodate varying complexity of signals, to vary number of channels transmitted

- H04J3/1676—Time-division multiplex with pulse-position, pulse-interval, or pulse-width modulation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R1/00—Details of transducers, loudspeakers or microphones

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R1/00—Details of transducers, loudspeakers or microphones

- H04R1/20—Arrangements for obtaining desired frequency or directional characteristics

- H04R1/22—Arrangements for obtaining desired frequency or directional characteristics for obtaining desired frequency characteristic only

- H04R1/26—Spatial arrangements of separate transducers responsive to two or more frequency ranges

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S3/00—Systems employing more than two channels, e.g. quadraphonic

- H04S3/008—Systems employing more than two channels, e.g. quadraphonic in which the audio signals are in digital form, i.e. employing more than two discrete digital channels

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S7/00—Indicating arrangements; Control arrangements, e.g. balance control

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04R—LOUDSPEAKERS, MICROPHONES, GRAMOPHONE PICK-UPS OR LIKE ACOUSTIC ELECTROMECHANICAL TRANSDUCERS; DEAF-AID SETS; PUBLIC ADDRESS SYSTEMS

- H04R2400/00—Loudspeakers

- H04R2400/03—Transducers capable of generating both sound as well as tactile vibration, e.g. as used in cellular phones

Definitions

- the present technology relates to a transmitting device, a transmitting method, a receiving device and a receiving method, and more particularly to a transmitting device, a transmitting method, a receiving device and a receiving method for handling a tactile presentation signal together with an audio signal.

- a right channel a left channel, a center channel, an LFE (Low Frequency Effect) channel, and the like. These are expected to be delivered to loudspeakers located at the location indicated by their name and reproduced as sound.

- LFE Low Frequency Effect

- Patent Document 1 describes a technique of transmitting a tactile vibration signal (tactile signal) and vibrating a vibrating portion based on the tactile vibration signal on the receiving side.

- the most popular multi-channel audio transmission system is 5.1 channels (6 channels in total).

- the tactile presentation is simply performed at four positions, and sufficient tactile production is impossible. is there.

- the purpose of this technology is to enable tactile presentation at more positions than the number of channels of tactile presentation signals that can be transmitted.

- a transmission signal that includes an audio signal of a predetermined number of channels and a tactile presentation signal of a predetermined number of channels, and generates a transmission signal to which metadata for designating a target tactile presentation position is added to each of the tactile presentation signals of the predetermined number of channels.

- Generator and It is in a transmission device including a transmission unit that transmits the transmission signal to the receiving side via a predetermined transmission line.

- a transmission signal is generated by the transmission signal generator.

- This transmission signal includes an audio signal having a predetermined number of channels and a tactile presentation signal having a predetermined number of channels, and metadata for designating a target tactile presentation position for each of the tactile presentation signals having a predetermined number of channels is added.

- the metadata may be configured to specify zero, one or more tactile presentation positions as the tactile presentation positions targeted by each of a predetermined number of tactile presentation signals.

- the transmission unit transmits this transmission signal to the receiving side via a predetermined transmission line.

- the predetermined transmission line may be a coaxial cable, an optical cable, an Ethernet (IEC61883-6) cable, an HDMI cable, an MHL cable, or a display port cable.

- the transmission signal is a transmission signal for each block composed of a plurality of frames

- the transmission unit sequentially transmits the transmission signal for each block to the receiving side via a predetermined transmission line

- the transmission signal generation unit for each block Metadata may be added using a predetermined bit area of the configured channel status.

- a plurality of frames are composed of repetitions of a multi-channel group composed of a predetermined number of frames

- a transmitter transmits an audio signal of a predetermined number of channels and a tactile presentation signal of a predetermined number of channels for each multi-channel group. All or part of a predetermined number of frames may be arranged and transmitted in a time-division manner for each channel.

- the tactile presentation signal of a predetermined number of channels can be output as the tactile presentation signal of the target tactile presentation position based on the metadata, and the position is larger than the number of channels of the tactile presentation signal that can be transmitted. Tactile presentation is possible.

- the transmission signal generation unit dynamically changes the metadata to dynamically change the target tactile presentation position of each of the tactile presentation signals of a predetermined number of channels. You may.

- the tactile presentation position targeted by the tactile presentation signals of a predetermined number of channels can be dynamically changed based on the metadata.

- the transmission signal generation unit when changing the metadata from the first state to the second state, the transmission signal generation unit either performs fade-out / fade-in processing on the tactile presentation signals of a predetermined number of channels, or determines.

- a mute signal may be inserted for the tactile presentation signal of the number of channels.

- the transmission signal generation unit may be configured to dynamically change the metadata in synchronization with the scene of the content related to the audio signal.

- the tactile presentation position suitable for the scene can be effectively driven, and appropriate tactile presentation to the user becomes possible.

- a transmission signal including an audio signal of a predetermined number of channels and a tactile presentation signal of a predetermined number of channels, to which metadata for designating a target tactile presentation position is added to each of the tactile presentation signals of the predetermined number of channels is transmitted from the transmitting side.

- a receiver that receives data via a predetermined transmission line, The audio signal of the predetermined channel is extracted from the transmission signal and output, and the tactile presentation signal of the predetermined channel is extracted from the transmission signal, and each of the tactile presentation signals of the predetermined channel is targeted based on the metadata.

- the receiver is provided with a processing unit that outputs a tactile presentation signal at the tactile presentation position.

- the receiving unit receives a transmission signal from the transmitting side via a predetermined transmission line.

- This transmission signal includes an audio signal having a predetermined number of channels and a tactile presentation signal having a predetermined number of channels, and metadata for designating a target tactile presentation position for each of the tactile presentation signals having a predetermined number of channels is added.

- the predetermined transmission line may be a coaxial cable, an optical cable, an Ethernet (IEC61883-6) cable, an HDMI cable, an MHL cable, or a display port cable.

- the transmission signal is a transmission signal for each block composed of a plurality of frames

- the receiving unit sequentially receives the transmission signal for each block from the transmitting side via a predetermined transmission line

- the metadata is for each block. It may be added using a predetermined bit area of the configured channel status.

- a plurality of frames are composed of repetitions of a multi-channel group consisting of a predetermined number of frames, and an audio signal having a predetermined number of channels and a tactile presentation signal having a predetermined number of channels have a predetermined number of frames for each multi-channel group. All or part of the above may be arranged in a time-division manner by channel.

- the processing unit extracts the audio signal of a predetermined channel from the transmission signal and outputs it. Further, the processing unit extracts the tactile presentation signal of the predetermined channel from the transmission signal, and each of the tactile presentation signals of the predetermined channel is output as the tactile presentation signal of the target tactile presentation position based on the metadata. To.

- each of the tactile presentation signals of the predetermined channel extracted from the transmission signal is output as the tactile presentation signal of the target tactile presentation position based on the metadata. Therefore, the tactile presentation can be performed at more positions than the number of channels of the tactile presentation signal.

- FIG. 1 shows a configuration example of an AV (Audio / Visual) system 10 as an embodiment.

- the AV system 10 has a television receiver 100 and an audio amplifier 200.

- the television receiver 100 is connected to a television broadcast receiving antenna 121, a BD (Blu-ray Disc) player 122, and the Internet 123.

- the audio amplifier 200 is connected to a 2-channel or multi-channel speaker system 250 and a 1-channel or multi-channel tactile presentation system 260.

- "Blu-ray” is a registered trademark.

- the television receiver 100 and the audio amplifier 200 are connected via an HDMI (High-Definition Multimedia Interface) cable 300.

- HDMI High-Definition Multimedia Interface

- the television receiver 100 is provided with an HDMI terminal 101 to which an HDMI receiving unit (HDMI RX) 102 and a high-speed bus interface 103 constituting a communication unit are connected.

- the audio amplifier 200 is provided with an HDMI terminal 201 in which an HDMI transmission unit (HDMI TX) 202 and a high-speed bus interface 203 constituting a communication unit are connected.

- One end of the HDMI cable 300 is connected to the HDMI terminal 101 of the television receiver 100, and the other end is connected to the HDMI terminal 201 of the audio amplifier 200.

- the television receiver 100 includes an HDMI receiver 102, a high-speed bus interface 103, and an SPDIF (Sony Philips Digital InterFace) transmission circuit 104. Further, the television receiver 100 has a system controller 105, a digital broadcast reception circuit 107, a content reproduction circuit 108, a display unit 109, and an Ethernet interface 110. "Ethernet” and “Ethernet” are registered trademarks. Further, in the illustrated example, each part of the image system is appropriately omitted for simplification of explanation.

- the system controller 105 controls the operation of each part of the television receiver 100.

- the digital broadcast receiving circuit 107 processes the television broadcast signal input from the receiving antenna 121, and processes the video signal related to the broadcast content, the multi-channel audio signal (linear PCM signal), the tactile presentation signal of a predetermined number of channels, and the predetermined number of tactile presentation signals. Outputs metadata that specifies the target tactile presentation position for each of the tactile presentation signals of the number of channels.

- the Ethernet interface 110 communicates with an external server via the Internet 123 to provide a video signal related to net contents, a multi-channel audio signal (linear PCM signal), a tactile presentation signal of a predetermined number of channels, and a tactile presentation of the predetermined number of channels.

- Outputs metadata that specifies the target tactile presentation position for each signal.

- the BD player 122 has a tactile sensation targeted at each of a video signal related to the reproduced content, a multi-channel audio signal (linear PCM signal), a tactile presentation signal of a predetermined number of channels, and a tactile presentation signal of the predetermined number of channels by the reproduction operation.

- Outputs metadata that specifies the presentation position.

- the tactile presentation position (tactile presentation site) targeted by the tactile presentation signal of each channel is limited to, for example, a predefined tactile presentation position range.

- FIG. 2 shows an example of the tactile presentation position range.

- the full size (32 devices) version, the part 1 size (24 devices) version, the part 2 size (16 devices) version, and the part 3 size (8 devices) version are shown as the tactile presentation position range.

- FIG. 3 schematically shows each tactile presentation position.

- the part 1 size version includes (0) frontal "Head front", (1) head back "Head back", (2) head left “Head left”, (3) head right “Head right”, ( 4) Shoulder left “Shoulder left”, (5) Shoulder right “Shoulder right”, (6) Hand left “Hand left”, (7) Hand right “Hand right”, (8) Wrist left “Wrist left”, ( 9) Wrist right “Wrist right”, (10) Chest upper left “Chest upper-left", (11) Chest upper right “Chest upper-right”, (12) Chest lower left “Chest lower-left", (13) ) Chest lower-right, (14) Belly left “Stomach left”, (15) Belly right “Stomach right”, (16) Back upper left “Back upper-left”, (17) Back upper right “Back upper-right”, (18) lower back left “Back lower-left”, (19) lower back right “Back lower-right”, (20) left knee "Knee left”, (21) right knee "Knee” 24 tactile presentation positions of "right

- the part 2 size version includes (6) left hand “Hand left”, (7) right hand “Hand right”, (8) left wrist “Wrist left”, (9) right wrist “Wrist right”, ( 10) Chest upper-left, (11) Chest upper-right, (12) Chest lower-left, (13) Chest lower-right , (14) Belly left “Stomach left”, (15) Belly right “Stomach right”, (16) Back upper left “Back upper-left”, (17) Back upper right “Back upper-right”, (18) Includes 16 tactile presentation positions: lower back left “Back lower-left”, (19) lower right “Back lower-right”, (22) left foot “Foot left”, (23) right foot “Foot right” Is done.

- the part 3 size version includes (10) upper chest left “Chest upper-left”, (11) upper chest right “Chest upper-right”, (12) lower chest left “Chest lower-left”, (13). ) Chest lower-right, (14) Belly left “Stomach left”, (15) Belly right “Stomach right”, (16) Back upper left “Back upper-left”, (17) Back upper right Includes 8 tactile presentation positions of "Back upper-right”.

- the tactile presentation position targeted by each of the predetermined number of channels of the tactile presentation signal is changed according to the content or dynamically changed in synchronization with the content scene.

- the metadata specifies a target tactile presentation position for each of a predetermined number of tactile presentation signals, but the target tactile presentation position for one channel tactile presentation signal is zero, one, or Multiple tactile presentation positions are possible.

- the content reproduction circuit 108 selectively extracts the video signal, the multi-channel audio signal, the tactile presentation signal of a predetermined number of channels, and the metadata obtained by the digital broadcast reception circuit 107, the Ethernet interface 110, or the BD player 122. Then, the content reproduction circuit 108 sends a video signal to the display unit 109.

- the display unit 109 displays an image based on this video signal.

- the content reproduction circuit 108 sends a multi-channel audio signal and a tactile presentation signal of a predetermined number of channels to the SPDIF transmission circuit 104.

- the SPDIF transmission circuit 104 is a circuit for transmitting an IEC 60958 standard digital audio transmission signal (hereinafter, appropriately referred to as “SPDIF signal”).

- SPDIF signal an IEC 60958 standard digital audio transmission signal

- This SPDIF transmission circuit 104 is a transmission circuit conforming to the IEC60958 standard. The details of the SPDIF signal will be described later.

- the SPDIF transmission circuit 104 simultaneously transmits a multi-channel audio signal and a predetermined number of tactile presentation signals to the audio amplifier 200 with metadata (tactile presentation position information) added.

- a transmission signal for each block consisting of a plurality of frames, here 192 frames, is sequentially transmitted.

- the transmission signal includes a multi-channel audio signal and a predetermined number of tactile presentation signals, and further, the above-mentioned metadata (tactile presentation position information) is added.

- metadata is added using a predetermined bit area of channel status configured for each block.

- the frequency band of the tactile presentation signal is said to be DC-1 kHz.

- a digital audio interface capable of transmitting linear PCM can also transmit a tactile presentation signal.

- expressions such as "push” with a plus, “pull” or “pull” with a minus can be used for the DC region.

- a plurality of frames are composed of repetitions of a multi-channel group consisting of a predetermined number of frames.

- the multi-channel audio signal and the tactile presentation signal of a predetermined number of channels are arranged in a time-division manner for each channel in all or a part of a predetermined number of frames for each multi-channel group.

- the HDMI receiving unit 102 receives video and audio data supplied to the HDMI terminal 101 via the HDMI cable 300 by HDMI-compliant communication.

- the high-speed bus interface 103 is a bidirectional communication path interface configured by using a reserve line and an HPD (Hot Plug Detect) line constituting the HDMI cable 300. The details of the HDMI receiving unit 102 and the high-speed bus interface 103 will be described later.

- the audio amplifier 200 has an HDMI transmission unit 202, a high-speed bus interface 203, and an SPDIF receiving circuit 204. Further, the audio amplifier 200 has a system controller 205, an audio DA converter 206, a selector 207, a driver 208, and an Ethernet interface 210.

- the system controller 205 controls the operation of each part of the audio amplifier 200.

- the HDMI transmission unit 202 transmits video and audio data from the HDMI terminal 201 to the HDMI cable 300 by HDMI-compliant communication.

- the high-speed bus interface 203 is a bidirectional communication path interface configured by using a reserve line and an HPD (Hot Plug Detect) line constituting the HDMI cable 300. The details of the HDMI transmission unit 202 and the high-speed bus interface 203 will be described later.

- the SPDIF receiving circuit 204 receives a transmission signal as an SDPIF signal (IEC 60958 standard digital audio signal), and acquires a multi-channel audio signal included in the transmission signal, a tactile presentation signal of a predetermined number of channels, and metadata.

- SDPIF signal ISO 60958 standard digital audio signal

- the audio DA converter 206 DA-converts the multi-channel audio signal extracted by the SPDIF receiving circuit 204 for each channel, amplifies it, and sends it to the speaker system 250 having a speaker corresponding to each channel. As a result, the speaker system 250 performs audio reproduction using the multi-channel audio signal.

- the selector 207 presents the tactile presentation signals of a predetermined number of channels extracted by the SPDIF receiving circuit 204 based on the metadata extracted by the SPDIF receiving circuit 204, respectively, at the target tactile presentation position. It is distributed and output as a signal.

- the driver 208 DA-converts and amplifies the tactile presentation signals of a predetermined number of channels distributed by the selector 207, and sends them to the tactile presentation system 260 having a tactile presentation device at each tactile presentation position.

- the tactile presentation reproduction at each target tactile presentation position is performed by the tactile presentation signals of a predetermined number of channels.

- the tactile presentation signal of a predetermined number of channels is sent at the same time as the multi-channel audio signal, this tactile presentation reproduction is correctly synchronized with the audio reproduction, and the television receiver It is also synchronized with the video display on the display unit 109 of 100.

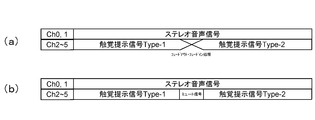

- the multi-channel audio signal will be described as a 2-channel stereo audio signal

- the tactile presentation signal of a predetermined number of channels will be described as a 4-channel tactile presentation signal.

- the present technology is not limited to this.

- FIG. 4 shows a configuration example of the parts of the SPDIF receiving circuit 204, the audio DA converter 206, the selector 207, and the driver 208 in the audio amplifier 200.

- the 2-channel stereo audio signal (signal of channels 0 and 1) taken out by the SPDIF receiving circuit 204 is supplied to the audio DA converter 206.

- the two-channel stereo audio signal (left audio signal, right audio signal) is DA-converted and amplified, and supplied to the headphone 251 as the speaker system 250.

- the headphones 251 perform audio reproduction using the 2-channel stereo audio signal.

- the metadata of the four-channel tactile presentation signal (signals of channels 2 to 5) extracted by the SPDIF receiving circuit 204 and the tactile presentation position to be targeted by each of the four-channel tactile presentation signals are It is supplied to the selector 207.

- the tactile presentation signals of the four channels are distributed and output as the tactile presentation signals of the tactile presentation positions (included in the six tactile presentation positions) of each target based on the metadata.

- the four-channel tactile presentation signals distributed by the selector 207 are DA-converted and amplified by the driver 208, and then correspond to the tactile presentation best 261 having the tactile presentation device and the tactile presentation sofa 262 as the tactile presentation system 260. It is supplied to the tactile presentation device. As a result, vibration reproduction is performed at each target tactile presentation position by the tactile presentation signals of the four channels.

- the "circle” indicates the tactile presentation position (arrangement position of the tactile presentation device), and there are a total of 6 tactile presentation positions.

- the six tactile presentation positions are sofa left, sofa right, chest left, chest right, belly left, and belly right.

- FIG. 5 shows a tactile vibration signal distribution function included in the selector 207.

- the selector 207 is configured to be able to output a tactile presentation signal of a certain channel (channel x) as a tactile presentation signal at a predetermined tactile presentation position based on metadata.

- the selector 207 is configured to be able to output tactile presentation signals of a plurality of channels as tactile presentation signals at a certain tactile presentation position based on metadata.

- FIG. 6 shows a configuration example of the selector 207.

- the selector 207 has four input systems In1 to In4 for inputting four channels of tactile presentation signals as input terminals. Further, the selector 207 has six output systems Out1 to Out6. Then, each output system has an input unit that selectively inputs zero, one, or a plurality of four-channel tactile presentation signals input to the four-input systems In1 to In4 based on the metadata. It is equipped with a totaling unit that totals and outputs each input tactile presentation signal. With this configuration, the selector 207 functions as the sorting function shown in FIGS. 5A and 5B described above.

- FIG. 7 shows a configuration example in which a part of the path of the SPDIF receiving circuit 204, the selector 207, and the driver 208 is made wireless.

- Tx indicates a wireless transmitter

- Rx indicates a wireless receiver.

- FIG. 7A all six paths between the six outputs of the selector 207 and the six inputs of the driver 208 are wireless.

- FIG. 7B only a part of the paths between the 6 outputs of the selector 207 and the 6 inputs of the driver 208, or 4 paths in the illustrated example, are wireless.

- the four outputs of the SPDIF receiving circuit 204 and the six inputs of the driver 208 are wireless.

- the transmitters related to the four outputs of the SPDIF receiving circuit 204 have the function of the selector 207, and based on the metadata, selectively transmit the tactile presentation signals to the receivers related to the six inputs of the driver 208. To do.

- FIG. 8 shows an example of audiovisual content reproduction.

- FIG. 8A schematically shows scenes 1 (scenes that are hitting each other) and scenes 2 (scenes that are down) that are continuous in chronological order.

- FIG. 8B shows a continuous 2-channel stereo audio signal and a 4-channel tactile presentation signal that dynamically changes in synchronization with the scene.

- the 4-channel tactile presentation signal corresponding to scene 1 is indicated by type 1.

- the tactile presentation signals of the four channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the vibration positions of the chest left, chest right, belly left, and belly right as shown in FIG. Is targeted.

- circled numbers 0, 1, 2, and 3 indicate the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel, respectively.

- the tactile presentation signals of the four channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the chest left, chest right, and abdominal left, respectively. It is output as a tactile presentation signal of the vibration position on the right side of the abdomen.

- the sensation of being beaten is produced at the tactile presentation positions of the chest left, chest right, belly left, and belly right (see the white “circle”). Tactile presentation reproduction is performed.

- the 4-channel tactile presentation signal corresponding to scene 2 is indicated by type 2.

- the tactile presentation signals of the four channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the tactile presentations of the chest left, chest right, sofa left, and sofa right as shown in FIG. Target the position.

- the selector 207 outputs the four-channel tactile presentation signals as tactile presentation signals at the tactile presentation positions of the chest left, chest right, sofa left, and sofa right, respectively.

- the tactile sensation is moved from the front to the back at the tactile presentation positions of the chest left, chest right, sofa left, and sofa right (see the white “circle”).

- tactile presentation reproduction is performed to produce a down tactile sensation that falls backward after an impact.

- the 2-channel stereo audio signal is continuously reproduced without a break, and only the tactile presentation signal is switched discontinuously. Since the tactile presentation signal is discontinuous between the scene 1 and the scene 2, as shown in FIG. 10A, when switching between the tactile presentation signals, the tactile presentation signal is faded out or faded in, or the tactile presentation signal is faded out or faded in. As shown in FIG. 10B, it is desirable to perform a mute signal insertion process on the tactile presentation signal at the time of switching. This makes it possible to alleviate the discomfort of the user due to the discontinuous change of the tactile presentation signal.

- the fade-out / fade-in process and the mute signal insertion process may be performed in advance on the television receiver 100 side, may be performed by the selector 207 or the driver 208 of the audio amplifier 200, or the tactile presentation best 261 or the tactile sensation. It may be done on the presentation sofa 262.

- FIG. 11 shows another configuration example of the parts of the SPDIF receiving circuit 204, the audio DA converter 206, the selector 207, and the driver 208 in the audio amplifier 200.

- the parts corresponding to those in FIG. 4 are designated by the same reference numerals.

- the other configuration examples differ from the configuration example of FIG. 4 in that the connection order of the selector 207 and the driver 208 is reversed, and the other configurations are the same.

- FIG. 12 shows a configuration example of the HDMI receiving unit 102 of the television receiver 100 and the HDMI transmitting unit 202 of the audio amplifier 200 in the AV system 10 of FIG.

- the HDMI transmission unit 202 is a valid image section which is a section from a certain vertical synchronization signal to the next vertical synchronization signal (hereinafter, appropriately referred to as “video field”) excluding the horizontal blanking period and the vertical blanking period.

- video field the next vertical synchronization signal

- active video section the differential signal of the image data for one screen of the base band (uncompressed) is transmitted to the HDMI receiving unit 102 in one direction by a plurality of channels.

- the HDMI transmission unit 202 transmits a plurality of differential signals corresponding to voice data and control packets (Control Packet) accompanying the image data, other auxiliary data, and the like during the horizontal blanking period and the vertical blanking period.

- the channel transmits data to the HDMI receiving unit 102 in one direction.

- the HDMI transmission unit 202 has a source signal processing unit 71 and an HDMI transmitter 72.

- Baseband uncompressed image (Video) and audio (Audio) data are supplied to the source signal processing unit 71.

- the source signal processing unit 71 performs necessary processing on the supplied image and audio data, and supplies the HDMI transmitter 72. Further, the source signal processing unit 71 exchanges control information, status information (Control / Status), and the like with the HDMI transmitter 72, if necessary.

- the HDMI transmitter 72 converts the image data supplied from the source signal processing unit 71 into corresponding differential signals, and connects the HDMI cable 300 with three TMDS channels # 0, # 1, and # 2, which are a plurality of channels. It transmits in one direction to the HDMI receiving unit 102 connected via the device.

- auxiliary data associated with uncompressed image data supplied from the HDMI transmitter 72 and the source signal processing unit 71, a vertical synchronization signal (VSYNC), and a horizontal synchronization signal (VSYNC).

- VSYNC vertical synchronization signal

- VSYNC horizontal synchronization signal

- HSYNC auxiliary data and other control data are converted into corresponding differential signals, and the HDMI receiver 102 connected via the HDMI cable 300 on the three TMDS channels # 0, # 1, and # 2. To send in one direction.

- the HDMI transmitter 72 connects the pixel clock synchronized with the image data transmitted through the three TMDS channels # 0, # 1 and # 2 to the HDMI receiver 102 via the HDMI cable 300 on the TMDS clock channel. Send to.

- the HDMI receiving unit 102 receives the differential signal corresponding to the image data transmitted in one direction from the HDMI transmitting unit 202 on a plurality of channels in the active video section, and also has a horizontal blanking period and a vertical blanking period. In the plurality of channels, the differential signals corresponding to the auxiliary data and the control data transmitted from the HDMI transmission unit 202 are received.

- the HDMI receiving unit 102 includes an HDMI receiver 81 and a sink signal processing unit 82.

- the HDMI receiver 81 is a differential signal corresponding to image data transmitted in one direction from the HDMI transmission unit 202 connected via the HDMI cable 300 on TMDS channels # 0, # 1, and # 2.

- the differential signal corresponding to the auxiliary data and the control data is received in synchronization with the pixel clock transmitted from the HDMI transmission unit 202 on the TMDS clock channel. Further, the HDMI receiver 81 converts the differential signal into corresponding image data, auxiliary data, and control data, and supplies the differential signal to the sync signal processing unit 82 as needed.

- the sink signal processing unit 82 performs necessary processing on the data supplied from the HDMI receiver 81 and outputs the data. In addition, the sync signal processing unit 82 exchanges control information, status information (Control / Status), and the like with the HDMI receiver 81, if necessary.

- the HDMI transmission channels include three TMDS channels for serially transmitting image data, auxiliary data, and control data from the HDMI transmission unit 202 to the HDMI reception unit 102 in one direction in synchronization with the pixel clock.

- TMDS Serial Data Channel

- a TMDS clock channel as a transmission channel for transmitting a pixel clock, there are a DDC (Display Data Channel) 83 and a transmission channel called a CEC line 84.

- the DDC 83 is composed of two lines (signal lines) (not shown) included in the HDMI cable 300, and the source device performs E-EDID (Enhanced-Extended Display Identification) from the sink device connected via the HDMI cable 300. Used to read. That is, the sink device has an EDID ROM 85. The source device reads the E-EDID stored in the EDID ROM 85 from the sink device connected via the HDMI cable 300 via the DDC 83, and recognizes the setting and performance of the sink device based on the E-EDID. To do.

- E-EDID Enhanced-Extended Display Identification

- the CEC line 84 consists of one line (not shown) included in the HDMI cable 300, and is used for bidirectional communication of control data between the source device and the sink device.

- the HDMI cable 300 includes a line 86 connected to a pin called HPD (Hot Plug Detect).

- HPD Hot Plug Detect

- the source device can detect the connection of the sink device by using the line 86.

- the HDMI cable 300 also includes a line 87 used to supply power from the source device to the sink device.

- the HDMI cable 300 includes a reserve line 88.

- FIG. 13 shows a configuration example of the high-speed bus interface 103 of the television receiver 100 in the AV system 10 of FIG.

- the Ethernet interface 110 performs LAN (Local Area Network) communication, that is, transmission / reception of Ethernet signals, using a transmission line composed of a pair of reserve lines and HPD lines among a plurality of lines constituting the HDMI cable 300.

- the SPDIF transmission circuit 104 transmits an SPDIF signal using a transmission line composed of the pair of lines described above.

- the television receiver 100 has a LAN signal transmission circuit 441, a terminating resistor 442, an AC coupling capacitance 443, 444, a LAN signal reception circuit 445, a subtraction circuit 446, an addition circuit 449, 450, and an amplifier 451. These constitute the high-speed bus interface 103. Further, the television receiver 100 has a choke coil 461, a resistor 462, and a resistor 463 that form a plug connection transmission circuit 128.

- a series circuit of AC coupling capacitance 443, terminating resistor 442 and AC coupling capacitance 444 is connected between the 14-pin terminal 521 and the 19-pin terminal 522 of the HDMI terminal 101. Further, a series circuit of the resistor 462 and the resistor 463 is connected between the power supply line (+ 5.0V) and the ground line. Then, the connection points of the resistors 462 and 463 are connected to the connection point Q4 between the 19-pin terminal 522 and the AC coupling capacitance 444 via the choke coil 461.

- connection points P3 of the AC coupling capacitance 443 and the terminating resistor 442 are connected to the output side of the adder circuit 449 and to the positive input side of the LAN signal reception circuit 445. Further, the connection points P4 of the AC coupling capacitance 444 and the terminating resistor 442 are connected to the output side of the adder circuit 450 and to the negative input side of the LAN signal reception circuit 445.

- One input side of the adder circuit 449 is connected to the positive output side of the LAN signal transmission circuit 441, and the SPDIF signal output from the SPDIF transmission circuit 104 is supplied to the other input side of the adder circuit 449 via the amplifier 451. Will be done. Further, one input side of the adder circuit 450 is connected to the negative output side of the LAN signal transmission circuit 441, and the SPDIF signal output from the SPDIF transmission circuit 104 is transmitted to the other input side of the adder circuit 450 via the amplifier 451. Is supplied.

- a transmission signal (transmission data) SG417 is supplied from the Ethernet interface 110 to the input side of the LAN signal transmission circuit 441. Further, the output signal SG418 of the LAN signal receiving circuit 445 is supplied to the positive terminal of the subtraction circuit 446, and the transmission signal SG417 is supplied to the negative terminal of the subtraction circuit 446. In this subtraction circuit 446, the transmission signal SG417 is subtracted from the output signal SG418 of the LAN signal reception circuit 445, and the reception signal (reception data) SG419 is obtained. The received signal SG419 becomes the LAN signal when the LAN signal (Ethernet signal) is transmitted as a differential signal via the reserve line and the HPD line. The received signal SG419 is supplied to the Ethernet interface 110.

- FIG. 14 shows a configuration example of the high-speed bus interface 203 of the audio amplifier 200 in the AV system 10 of FIG.

- the Ethernet interface 210 performs LAN (Local Area Network) communication, that is, transmission / reception of Ethernet signals, using a transmission line composed of a pair of reserve lines and HPD lines among a plurality of lines constituting the HDMI cable 300. ..

- the SPDIF receiving circuit 204 receives the SPDIF signal using the transmission line composed of the pair of lines described above.

- the audio amplifier 200 includes a LAN signal transmission circuit 411, a terminating resistor 412, an AC coupling capacitance 413, 414, a LAN signal reception circuit 415, a subtraction circuit 416, an adder circuit 419, and an amplifier 420. These constitute the high-speed bus interface 203. Further, the audio amplifier 200 has a pull-down resistor 431, a resistor 432, a capacitance 433, and a comparator 434 that constitute the plug connection detection circuit 221. Here, the resistor 432 and the capacitance 433 form a low-pass filter.

- a series circuit of AC coupling capacitance 413, terminating resistor 412 and AC coupling capacitance 414 is connected between the 14-pin terminal 511 and the 19-pin terminal 512 of the HDMI terminal 201.

- the connection points P1 of the AC coupling capacitance 413 and the terminating resistor 412 are connected to the positive output side of the LAN signal transmission circuit 411 and to the positive input side of the LAN signal reception circuit 415.

- connection points P2 of the AC coupling capacitance 414 and the terminating resistor 412 are connected to the negative output side of the LAN signal transmission circuit 411 and to the negative input side of the LAN signal reception circuit 415.

- a transmission signal (transmission data) SG411 is supplied from the Ethernet interface 210 to the input side of the LAN signal transmission circuit 411.

- the output signal SG412 of the LAN signal receiving circuit 415 is supplied to the positive terminal of the subtraction circuit 416, and the transmission signal (transmission data) SG411 is supplied to the negative terminal of the subtraction circuit 416.

- the transmission signal SG411 is subtracted from the output signal SG412 of the LAN signal reception circuit 415, and the reception signal SG413 is obtained.

- the received signal SG413 becomes the LAN signal when the LAN signal (Ethernet signal) is transmitted as a differential signal via the reserve line and the HPD line.

- the received signal SG413 is supplied to the Ethernet interface 210.

- connection point Q2 between the AC coupling capacitance 414 and the 19-pin terminal 512 is connected to the ground wire via the pull-down resistor 431 and is also connected to the ground wire via the series circuit of the resistor 432 and the capacitance 433. Then, the output signal of the low-pass filter obtained at the connection point between the resistor 432 and the capacitance 433 is supplied to one input terminal of the comparator 434.

- the output signal of the low-pass filter is compared with the reference voltage Vref2 (+ 1.4V) supplied to the other input terminal.

- the output signal SG415 of the comparator 434 is supplied to a control unit (CPU) (not shown) of the audio amplifier 200.

- connection point P1 of the AC coupling capacitance 413 and the terminating resistor 412 is connected to one input terminal of the adder circuit 419. Further, the connection points P2 of the AC coupling capacitance 414 and the terminating resistor 412 are connected to the other input terminal of the adder circuit 419.

- the output signal of the adder circuit 419 is supplied to the SPDIF receiving circuit 204 via the amplifier 420.

- the output signal of the addition circuit 419 becomes the SPDIF signal when the SPDIF signal is transmitted as an in-phase signal via the reserve line and the HPD line.

- FIG. 15 shows the frame configuration in the IEC 60958 standard.

- Each frame consists of two subframes.

- the first subframe contains the left channel signal and the second subframe contains the right channel signal.

- a preamble is provided at the beginning of the subframe as described later, and "M” is given as a preamble to the left channel signal and “W” is given as a preamble to the right channel signal. However, every 192 frames, "B” indicating the start of the block is added to the first preamble. That is, one block is composed of 192 frames.

- a block is a unit that constitutes a channel status described later.

- FIG. 16 shows the subframe configuration in the IEC60958 standard.

- the subframe is composed of a total of 32 time slots from the 0th to the 31st.

- the 0th to 3rd time slots indicate a preamble (Sync preamble).

- This preamble indicates either "M", "W” or "B” in order to distinguish the left and right channels and to indicate the start position of the block as described above.

- the 4th to 27th time slots are the main data fields, and when the 24-bit code range is adopted, the whole represents audio data.

- the 8th to 27th time slots represent audio data (Audio sample word).

- the 4th to 7th time slots can be used as additional information (Auxiliary sample bits). The illustrated example shows the latter case.

- the 28th time slot is a valid flag (Validity flag) of the main data field.

- the 29th time slot represents one bit of user data (User data).

- a series of user data can be constructed by accumulating the 29th time slot over each frame.

- This user data message is configured in units of 8-bit information units (IU: Information Units), and one message includes 3 to 129 information units.

- the head of the information unit is identified by the start bit "1".

- the first seven information units in the message are reserved, and the user can set arbitrary information in the eighth and subsequent information units.

- the messages are divided by "0" of 8 bits or more.

- the 30th time slot represents one bit of channel status.

- a series of channel statuses can be configured by accumulating the 30th time slot for each block across each frame.

- the start position of the block is indicated by the preamble (0th to 3rd time slots) of "B" as described above.

- the 31st time slot is a parity bit. This parity bit is assigned so that the number of "0" and "1" contained in the fourth to 31st time slots is an even number.

- a multi-channel transmission format based on the IEC60958 standard is used to target the above-mentioned 2-channel stereo audio signal and 4-channel tactile presentation signal, respectively of the 4-channel tactile presentation signal. It is transmitted at the same time with the metadata that specifies the tactile presentation position to be added.

- FIG. 17 shows an example of a frame configuration of a multi-channel transmission format when a 2-channel stereo audio signal and a 4-channel tactile presentation signal are simultaneously transmitted.

- one block is composed of 192 frames, and this 192 frames consists of repeating a multichannel group consisting of a predetermined number of subframes. Each subframe part constitutes a multichannel order. The number of subframes to be included in the multi-channel group can be indicated by using a predetermined bit area of the channel status configured for each block.

- Multi-channel subgroups consist of one or more multi-channel orders.

- the signals of each channel of the multi-channel audio signal are sequentially arranged in each multi-channel order constituting this multi-channel subgroup.

- What kind of multi-channel subgroup is formed in the multi-channel group can be indicated by using a predetermined bit area of the channel status configured for each block, and by using a predetermined number of frames of user data bits. Can also be shown.

- one multi-channel group is composed of 6 subframes, that is, multi-channel orders 1 to 6. Further, one multi-channel subgroup of the multi-channel subgroup 1 is formed in the multi-channel group. Then, in this example, the two-channel stereo audio signal and the four-channel tactile presentation signal are simultaneously transmitted by the one multi-channel subgroup.

- the front left (FL) audio signal, the front right (FR) audio signal, the 0th channel (Haptic_0) tactile presentation signal, and the 1st channel (Haptic_1) are in the multi-channel orders 1 to 6 constituting the multi-channel subgroup 1.

- Tactile presentation signal, the second channel (Haptic_2) tactile presentation signal, and the third channel (Haptic_3) tactile presentation signal are arranged in this order.

- the metadata that specifies the target tactile presentation position for each of the four channels of tactile presentation signals is added, for example, using a predetermined bit area of the channel status configured for each block.

- a method of adding metadata using a predetermined bit area of the channel status for example, the following first to third methods can be considered.

- the first method is a method of designating the target tactile presentation position for each of the four channels of the tactile presentation signal by the mapping type.

- FIG. 18 schematically shows the format of the channel status in the IEC60958 standard.

- the channel status is the cumulative 30th time slot in the subframe for each block (see FIG. 16).

- the contents of the channel status are arranged one byte at a time in the vertical direction, and the bit configuration in each byte is shown in the horizontal direction.

- the format for consumer use will be assumed.

- the 0th bit (bit 0) a is set to “0", indicating that this channel status is for consumer use. Further, b of the first bit (bit 1) is set to "0", indicating that the sample is a linear PCM sample.

- the 6th and 7th bits (bits 6-7) indicate the mode of the channel status.

- the 44th to 47th bits constitute a 4-bit field of "Multichannel Count", and the number of subframes to be included in the multichannel group is shown. Here, it is shown that the number of subframes included in the multi-channel group is "6".

- the 53rd to 60th bits constitute an 8-bit field of "Multichannel configuration value", and the configuration of the multichannel subgroup is shown.

- the signal configuration is 6 channels including a 2-channel stereo audio signal and a 4-channel tactile presentation signal.

- the xxth bit to the xx + 7th bit of the xth byte constitute an 8-bit field of "Haptic channel mapping type", and each of the four channel tactile presentation signals is a mapping that specifies a target tactile presentation position.

- the type is shown. For example, as shown in FIG. 19, “00000001” indicates type 1 (Type-1), “00000010” indicates type 2 (Type-2), and “00000011” indicates type 3 (Type-3). , "00000100” indicates Type 4 (Type-4).

- the tactile presentation position targeted by each of the four channels of tactile presentation signals is defined in advance for each type.

- the tactile presentation signals of the 0th, 1st, 2nd, and 3rd channels are chest left and chest right, respectively.

- Stomach left, Stomach right, and in the case of type 2 (Type-2) the tactile presentation signals of channels 0, 1, 2, and 3 are chest left and chest, respectively.

- Right, sofa left (Sofa left), sofa right (Sofa right) are targeted, and in the case of type 3 (Type-3), the tactile presentation signals of the 0th, 1st, 2nd, and 3rd channels are the belly left and the belly left, respectively.

- the tactile presentation signals of channels 0, 1, 2, and 3 are for chest left, belly left, and sofa left, respectively.

- the third channel is N.I. A. Indicates that (not available).

- the second method is a method of designating the tactile presentation position targeted by each of the tactile presentation signals of the four channels by setting a flag in the corresponding bit of the channel allocation.

- FIG. 21 schematically shows the format of the channel status in the IEC60958 standard.

- the description of the portion corresponding to FIG. 18 will be omitted as appropriate.

- the 44th to 47th bits constitute a 4-bit field of "Multichannel Count", and the number of subframes to be included in the multichannel group is shown. Here, it is shown that the number of subframes included in the multi-channel group is "6".

- the 53rd to 60th bits constitute an 8-bit field of "Multichannel configuration value", and the configuration of the multichannel subgroup is shown.

- the signal configuration is 6 channels including a 2-channel stereo audio signal and a 4-channel tactile presentation signal.

- the xxth bit to the xx + 7th bit of the xth byte constitute an 8-bit field of "Haptic channel 0 allocation", and the channel allocation of the tactile presentation signal of the 0th channel is shown.

- the xxth bit, the xx + 1 bit, the xx + 2 bit, the xx + 3 bit, the xx + 4 bit, and the xx + 5 bit are the chest left and the chest right, respectively.

- the tactile presentation position targeted by the tactile presentation signal of the 0th channel is specified.

- the xx + 8th bit to the xx + 15th bit of the x + 1 byte constitute an 8-bit field of "Haptic channel 1 allocation", and the channel allocation of the tactile presentation signal of the first channel is shown.

- the xx + 8 bits, the xx + 9 bits, the xx + 10 bits, the xx + 11 bits, the xx + 12 bits, and the xx + 13 bits are the chest left and the chest right, respectively.

- the tactile presentation position targeted by the tactile presentation signal of the first channel is specified.

- the xx + 16 bits to the xx + 23 bits of the xx + 2 bytes constitute an 8-bit field of "Haptic channel 2 allocation", and the channel allocation of the tactile presentation signal of the second channel is shown.

- the xx + 16 bits, the xx + 17 bits, the xx + 18 bits, the xx + 19 bits, the xx + 20 bits, and the xx + 21 bits are the chest left and the chest right, respectively.

- the tactile presentation position targeted by the tactile presentation signal of the second channel is specified.

- the xx + 24 bits to the xx + 31 bits of the xx + 3 bytes constitute an 8-bit field of "Haptic channel 3 allocation", and the channel allocation of the tactile presentation signal of the third channel is shown.

- the xx + 24 bits, the xx + 25 bits, the xx + 26 bits, the xx + 27 bits, the xx + 28 bits, and the xx + 29 bits are the chest left and the chest right, respectively.

- the tactile presentation position targeted by the tactile presentation signal of the third channel is specified.

- the third method is a method of designating the tactile presentation position targeted by each of the four channels of the tactile presentation signal by a number defined in advance for the tactile presentation position.

- FIG. 24 schematically shows the format of the channel status in the IEC60958 standard.

- the description of the portion corresponding to FIG. 18 will be omitted as appropriate.

- the 44th to 47th bits constitute a 4-bit field of "Multichannel Count", and the number of subframes to be included in the multichannel group is shown. Here, it is shown that the number of subframes included in the multi-channel group is "6".

- the 53rd to 60th bits constitute an 8-bit field of "Multichannel configuration value", and the configuration of the multichannel subgroup is shown.

- the signal configuration is 6 channels including a 2-channel stereo audio signal and a 4-channel tactile presentation signal.

- the xx bits to xx + 3 bits of the xth byte constitute a 4-bit field of "Haptic channel 0 position number_1", and the tactile presentation signal of the 0th channel is the target of the first tactile presentation position.

- the position number is shown, and the x + 4th to xx + 7 bits of the xth byte constitute a 4-bit field of "Haptic channel 0 position number_2", and the second tactile presentation signal of the 0th channel is targeted.

- the position number of the tactile presentation position is shown.

- FIG. 25 shows an example of the correspondence between the position number and the tactile presentation position.

- the position number "0000” indicates the chest left (Chest left)

- the position number "0001” indicates the chest right (Chest right)

- the position number "0010” indicates the belly left (Stomach left)

- the position number "0011” indicates the belly right (Stomach right)

- the position number "0100” indicates the sofa left (Sofa left)

- the position number "0101” indicates the sofa right (Sofa right).

- If there is no target tactile presentation position it is set to, for example, "1111".

- the xx + 8 bits to the xx + 11 bits of the x + 1 bytes constitute a 4-bit field of "Haptic channel 1 position number_1", and the tactile presentation signal of the first channel is the target of the first tactile presentation position.

- the position number is shown, and the xx + 12 bits to xx + 15 bits of the x + 1 byte constitute a 4-bit field of "Haptic channel 1 position number_2", and the second tactile presentation signal of the first channel is targeted.

- the position number of the tactile presentation position is shown.

- the xx + 16 bits to the xx + 19 bits of the x + 2 bytes constitute a 4-bit field of "Haptic channel 2 position number_1", and the tactile presentation signal of the second channel is the target of the first tactile presentation position.

- the position number is shown, and the xx + 20 bits to xx + 23 bits of the x + 2 bytes constitute a 4-bit field of "Haptic channel 2 position number_2", and the second tactile presentation signal of the second channel is targeted.

- the position number of the tactile presentation position is shown.

- the xx + 24 bits to the xx + 27 bits of the x + 3 bytes constitute a 4-bit field of "Haptic channel 3 position number_1", and the tactile presentation signal of the third channel is the target of the first tactile presentation position.

- the position number is shown, and the xx + 28 bits to xx + 31 bits of the xx + 3 bytes constitute a 4-bit field of "Haptic channel 3 position number_2", and the second tactile presentation signal of the third channel is targeted.

- the position number of the tactile presentation position is shown.

- each of the tactile presentation positions of a predetermined number of channels is targeted by the transmission signal including the audio signal of a predetermined number of channels and the tactile presentation signal of a predetermined number of channels. Is added and transmitted from the television receiver 100 to the audio amplifier 200. Therefore, on the receiving side, the tactile presentation signal of a predetermined number of channels can be output as the tactile presentation signal of the target tactile presentation position based on the metadata, and the position is larger than the number of channels of the tactile presentation signal that can be transmitted. Tactile presentation is possible.

- the metadata added to the transmission signal is dynamically changed in synchronization with, for example, the scene in the content, and each of the tactile presentation signals of a predetermined number of channels is targeted.

- the tactile presentation position can be dynamically changed.

- the tactile presentation position targeted by the tactile presentation signals of a predetermined number of channels can be dynamically changed based on the metadata, and effective tactile presentation can be performed.

- FIG. 26 shows another example of audiovisual content reproduction.

- the tactile presentation position (tactile presentation device) is head front "Head front”, head back “Head back”, head left “Head left”, head right “Head right”, shoulder left “Shoulder left”, shoulder.

- the tactile presentation signals of the 4 channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the tactile presentation positions of the left knee, the right knee, the left foot, and the right foot, respectively. Is targeted.

- the tactile presentation signals of the 4 channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the tactile senses of the left knee, the right knee, the left abdomen, and the right abdomen, respectively. Target the presentation position.

- the tactile presentation signals of the 4 channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the lower chest left, the lower chest right, the belly left, and the belly right, respectively.

- the tactile presentation position of is targeted.

- the tactile presentation signals of the 4 channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the lower chest left, the lower chest right, the upper chest left, and the chest, respectively.

- the target is the tactile presentation position on the upper right.

- the tactile presentation signals of the 4 channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are shoulder left, shoulder right, chest left, and chest right, respectively.

- the tactile presentation position of is targeted.

- the tactile presentation signals of the four channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the tactile sensations of the shoulder left, the shoulder right, the head left, and the head right, respectively.

- the tactile presentation signals of the four channels of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel are the tactile sensations of the frontal, posterior, head left, and head right, respectively.

- the tactile presentation position targeted by the tactile presentation signal of 4 channels moves from the foot to the head for each scene, and the tactile presentation is performed by the foot. You can express in detail the feeling of rising from the head to the head.

- FIG. 27 shows yet another example of audiovisual content reproduction.

- This example is an example in which there are 24 tactile presentation positions (tactile presentation devices) as in the example of FIG. 26.

- the circled numbers 0, 1, 2, and 3 indicate the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel, respectively.

- the tactile presentation signal of the 0th channel targets the tactile presentation positions of the front, back, left, and right of the head, and the tactile presentation signal of the 1st channel is the shoulder left, shoulder right, and so on.

- the tactile presentation positions of the left hand, right hand, left wrist, and right wrist are targeted, and the tactile presentation signals of the second channel are chest left, chest right, chest left, chest right, belly left, belly right, and back.

- the tactile presentation positions of upper left, upper back right, lower back left and lower back right are targeted, and the tactile presentation signals of the third channel target the tactile presentation positions of knee left, knee right, foot left and foot right.

- all the tactile presentation positions are targeted by any of the tactile presentation signals from the 0th channel to the 3rd channel, and for example, the tactile presentation that gives an impact to the whole body can be performed.

- the tactile presentation signal of the 0th channel targets the tactile presentation positions of the left above the chest and the right above the chest, and the tactile presentation signal of the 1st channel is the left below the chest and the right below the chest.

- the tactile presentation position is targeted

- the tactile presentation signal of the second channel is targeted at the tactile presentation position of the abdominal left and the ventral right

- the tactile presentation signal of the third channel is targeted at the tactile presentation position of the left knee and the right knee.

- the tactile presentation signals of channel 0 are head left, shoulder left, hand left, wrist left, chest left, chest bottom left, abdominal left, back top left, back bottom left,

- the tactile presentation positions of the left knee and left foot are targeted, and the tactile presentation signals of the first channel are head right, shoulder right, hand right, wrist right, chest right, chest lower right, abdominal right, back upper right, lower back.

- the tactile presentation positions on the right, right knee, and right foot are targeted.

- the tactile presentation signal of the 0th channel targets the tactile presentation positions of the upper chest left, the upper chest right, the lower chest left, the lower chest right, the abdominal left and the abdominal right, and the first The tactile presentation signal of the channel targets the tactile presentation positions of the left and right chest, the tactile presentation signal of the second channel targets the tactile presentation position of the left knee and the right knee, and the tactile presentation signal of the third channel The tactile presentation positions on the left and right feet are targeted.

- the tactile presentation signal of the 0th channel are the targets of the tactile presentation signal of the 0th channel and the tactile presentation signal of the 1st channel, a complicated impact is given to the upper body, and another impact is given to the knee and the foot. Tactile presentation can be made to give.

- FIG. 28 shows yet another example of audiovisual content reproduction.

- the tactile presentation position (tactile presentation device) is head front "Head front”, head back “Head back”, head left “Head left”, head right “Head right”, shoulder left “Shoulder left”, shoulder.

- the tactile presentation signal of the 0th channel targets the tactile presentation position of the floor front left and the floor front right, and the tactile presentation signal of the 1st channel is the floor back left and the floor back.

- the tactile presentation position of the right channel is targeted

- the tactile presentation signal of the second channel is targeted at the tactile presentation position of the left foot and the right foot

- the tactile presentation signal of the third channel is the sofa seat front left and the sofa seat front.

- the tactile presentation positions on the right, sofa seat back left, and sofa seat back right are targeted. In this case, for example, it is possible to present the tactile sensation of the earth's sound with an emphasis on the feet and the bottom.

- the tactile presentation signal of the 0th channel targets the tactile presentation position on the left side of the controller

- the tactile presentation signal of the 1st channel targets the tactile presentation position on the right side of the controller

- the second channel targets the tactile presentation positions of the upper chest left, the lower chest left, and the abdominal left

- the tactile presentation signal of the second channel targets the tactile presentation positions of the upper chest right, the lower chest right, and the abdominal right.

- tactile presentation corresponding to an action scene in which an item is held can be performed.

- the tactile presentation signal of the 0th channel targets the tactile presentation positions of the table left and the table far left

- the tactile presentation signal of the first channel is the tactile presentation of the table right and the table far right

- the tactile presentation signal of the second channel targets the tactile presentation position on the left side of the sofa backrest

- the tactile presentation signal of the third channel targets the tactile presentation position on the right side of the sofa backrest.

- a horror effect can be produced by placing a hand on the table.

- the tactile presentation signal of the 0th channel targets the tactile presentation position on the left of the sofa backrest and the left of the sofa seat back, and the tactile presentation signal of the 1st channel is the sofa back.

- the tactile presentation position on the right side of the rest and the right side of the sofa seat back is targeted, the tactile presentation signal on the second channel is targeted at the tactile presentation position on the left side of the sofa seat front, and the tactile presentation signal on the third channel is the sofa seat. ⁇ Target the tactile presentation position on the right side of the front. In this case, for example, it is possible to perform a tactile presentation corresponding to a ride-type scene that receives vibration from the seat.

- the tactile presentation signal of the 0th channel targets the tactile presentation position of the cushion A

- the tactile presentation signal of the 1st channel targets the tactile presentation position of the cushion B.

- the cushion can be freely vibrated to present a tactile sensation corresponding to a relaxing scene.

- the tactile presentation signal of the 0th channel targets the tactile presentation position of the sofa / backrest left, the sofa / seat front left, and the sofa / seat back left, and the tactile presentation position of the 1st channel.

- the tactile presentation signal targets the tactile presentation position on the sofa backrest right, sofa seat front right and sofa seat back right, and the tactile presentation signal on the second channel is on the left above the chest, left below the chest and left on the abdomen.

- the tactile presentation position is targeted, and the tactile presentation signal of the third channel targets the tactile presentation position on the right above the chest, the right below the chest, and the right on the abdomen. In this case, for example, it is possible to perform a tactile presentation corresponding to listening to music so that the bass can be experienced by the body.

- metadata for designating the target tactile presentation position for each of the four channel tactile presentation signals of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel is configured for each block.

- An example of adding using a predetermined bit area of the channel status to be performed is shown.

- the tactile presentation position targeted by the four-channel tactile presentation signal is specified by the mapping type (see FIGS. 18 to 20). In this case, the number of types may be excessive due to the large number of combinations.

- a predetermined bit area of the channel status composed of each block of metadata that specifies the target tactile presentation position for each of the four channel tactile presentation signals of the 0th channel, the 1st channel, the 2nd channel, and the 3rd channel. As shown in FIG. 29, it is conceivable to add to each of the four channels of the tactile presentation signal instead of adding by using.

- the tactile presentation position designation flag is added to the tactile presentation signal of each channel.

- the tactile presentation position designation flag of each channel is composed of several parts of the tactile presentation position that can be specified. In the illustrated example, there are 24 tactile presentation positions that can be specified, and there are Part 1 (Part 0) to Part 23 (Part 23).

- FIG. 30 shows an example of the correspondence between the part and the tactile presentation position. In this case, by setting "1" in the corresponding part in each channel, one or a plurality of tactile presentation positions targeted by the tactile presentation signal of the channel can be specified.

- FIG. 31 shows the state (flag configuration) of each part in the scene 1 of the above-mentioned example of FIG. 27.

- FIG. 32 shows the state (flag configuration) of each part in the scene 4 of the above-mentioned example of FIG. 27.

- the target tactile presentation position is switched by each of the four channels of tactile presentation signals in synchronization with the scene in one content.

- the target tactile presentation position of each of the four channels of tactile presentation signals is fixed regardless of the scene, and the target tactile presentation position of each of the four channels of tactile presentation signals is switched according to the content.

- An example is also possible.

- the 0th channel, the 1st channel, and the first channel emphasize the expressive power of the tactile presentation to the front of the upper body.

- the tactile presentation positions targeted by the tactile presentation signals of the 2nd channel and the 3rd channel are chest right, chest left, abdominal right, and abdominal left, respectively. This enables fine tactile expression within the front of the upper body, such as presenting an impact on the right chest and then presenting an impact on the left abdomen.

- the tactile presentation of the 0th channel is emphasized by emphasizing the expressive power of the tactile presentation on the front and rear surfaces of the upper body, as shown in FIG. 33 (a2).

- the tactile presentation positions targeted by the signal are chest right and chest left