WO2017191749A1 - 画像処理装置及び画像処理方法 - Google Patents

画像処理装置及び画像処理方法 Download PDFInfo

- Publication number

- WO2017191749A1 WO2017191749A1 PCT/JP2017/015521 JP2017015521W WO2017191749A1 WO 2017191749 A1 WO2017191749 A1 WO 2017191749A1 JP 2017015521 W JP2017015521 W JP 2017015521W WO 2017191749 A1 WO2017191749 A1 WO 2017191749A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- class

- image

- unit

- pixel

- tap

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Ceased

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/117—Filters, e.g. for pre-processing or post-processing

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/24—Classification techniques

- G06F18/243—Classification techniques relating to the number of classes

- G06F18/2431—Multiple classes

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/119—Adaptive subdivision aspects, e.g. subdivision of a picture into rectangular or non-rectangular coding blocks

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/14—Coding unit complexity, e.g. amount of activity or edge presence estimation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/182—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being a pixel

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/189—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding

- H04N19/192—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding the adaptation method, adaptation tool or adaptation type being iterative or recursive

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/189—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding

- H04N19/196—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding being specially adapted for the computation of encoding parameters, e.g. by averaging previously computed encoding parameters

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/80—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation

- H04N19/82—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation involving filtering within a prediction loop

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/42—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by implementation details or hardware specially adapted for video compression or decompression, e.g. dedicated software implementation

- H04N19/436—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by implementation details or hardware specially adapted for video compression or decompression, e.g. dedicated software implementation using parallelised computational arrangements

Definitions

- the present technology relates to an image processing apparatus and an image processing method, and more particularly, to an image processing apparatus and an image processing method capable of greatly improving, for example, an image S / N and compression efficiency.

- HEVC High Efficiency Video Coding

- ILF In Loop Filter

- post-HEVC predictive coding scheme of the next generation of HEVC

- ILF includes DF (Deblocking Filter) to reduce block noise, SAO (Sample Adaptive Offset) to reduce ringing, and ALF to minimize coding error (error of decoded image with respect to original image). (Adaptive Loop Filter).

- ALF is described in Patent Document 1

- SAO is described in Patent Document 2.

- the present technology has been made in view of such a situation, and makes it possible to greatly improve the S / N and compression efficiency of an image.

- the image processing apparatus performs a filtering process on a first image obtained by adding a prediction encoding residual and a predicted image, and generates a second image used for prediction of the predicted image.

- a prediction tap used for a prediction calculation for obtaining a pixel value of a corresponding pixel of the second image corresponding to a processing target pixel that is a processing target of the first image.

- a prediction tap selection unit that selects the pixel to be from the first image, a class classification unit that classifies the processing target pixel into any one of a plurality of classes, and the first image.

- An image processing apparatus having an arithmetic unit for obtaining a pixel value of a corresponding pixel.

- the image processing method of the present technology performs a filter process on a first image obtained by adding a prediction encoding residual and a predicted image, and generates a second image used for prediction of the predicted image.

- the filtering process includes a pixel that becomes a prediction tap used for a prediction calculation for obtaining a pixel value of a corresponding pixel of the second image corresponding to a processing target pixel that is a processing target of the first image.

- the first image obtained by adding the prediction encoding residual and the prediction image is subjected to filter processing, and is used for prediction of the prediction image.

- Two images are generated.

- a pixel serving as a prediction tap used for a prediction calculation for obtaining a pixel value of a corresponding pixel of the second image corresponding to a processing target pixel that is a processing target of the first image is the first pixel.

- the processing target pixel is classified into one of a plurality of classes.

- the prediction calculation for each of the plurality of classes obtained by learning using a student image corresponding to the first image and a teacher image corresponding to the original image corresponding to the first image is performed.

- the tap coefficient of the class of the processing target pixel is acquired, and the prediction calculation using the tap coefficient of the class of the processing target pixel and the prediction tap of the processing target pixel is performed.

- the pixel value of the corresponding pixel is obtained.

- the image processing apparatus may be an independent apparatus or an internal block constituting one apparatus.

- the image processing apparatus can be realized by causing a computer to execute a program.

- the program can be provided by being transmitted through a transmission medium or by being recorded on a recording medium.

- the image S / N and compression efficiency can be greatly improved.

- FIG. 3 is a block diagram illustrating a configuration example of a learning unit 33.

- FIG. It is a block diagram which shows the 2nd structural example of the image converter which performs a classification classification adaptive process. It is a block diagram which shows the structural example of the learning apparatus which learns the seed coefficient memorize

- FIG. 10 is a block diagram illustrating another configuration example of a learning unit 63.

- FIG. 3 is a block diagram illustrating a first configuration example of an encoding device 11.

- FIG. 3 is a block diagram illustrating a configuration example of a class classification adaptive filter 111.

- FIG. 3 is a block diagram illustrating a configuration example of an image conversion apparatus 131.

- FIG. It is a figure explaining the example of the class classification performed by the class classification part 23.

- FIG. 3 is a block diagram illustrating a configuration example of a learning device 132.

- FIG. 12 is a flowchart illustrating an example of encoding processing of the encoding device 11. It is a flowchart explaining the example of the class classification adaptation process performed by step S25.

- FIG. 3 is a block diagram illustrating a first configuration example of a decoding device 12.

- FIG. 3 is a block diagram illustrating a configuration example of a class classification adaptive filter 206.

- FIG. 3 is a block diagram illustrating a configuration example of an image conversion apparatus 231.

- FIG. 12 is a flowchart illustrating an example of a decoding process of the decoding device 12. It is a flowchart explaining the example of the class classification adaptation process performed by step S70. It is a figure explaining the difference of a class classification

- FIG. 3 is a block diagram illustrating a second configuration example of the encoding device 11.

- FIG. 12 is a block diagram illustrating a second configuration example of the decoding device 12.

- FIG. 12 is a block diagram illustrating a third configuration example of the encoding device 11.

- FIG. 12 is a block diagram illustrating a third configuration example of the decoding device 12.

- FIG. 12 is a block diagram illustrating a fourth configuration example of the encoding device 11.

- FIG. 12 is a block diagram illustrating a fourth configuration example of the decoding device 12.

- FIG. 12 is a block diagram illustrating a fourth configuration example of the decoding device 12.

- FIG. 12 is a block diagram illustrating a fifth configuration example of the encoding device 11.

- FIG. 3 is a block diagram illustrating a configuration example of a class classification adaptive filter 411.

- FIG. 3 is a block diagram illustrating a configuration example of an image conversion apparatus 431.

- FIG. 4 is a block diagram illustrating a configuration example of a class classification unit 441.

- FIG. 3 is a block diagram illustrating a configuration example of a learning device 432.

- FIG. 12 is a flowchart illustrating an example of encoding processing of the encoding device 11. It is a flowchart explaining the example of the class classification adaptation process performed by step S125.

- 12 is a block diagram illustrating a fifth configuration example of the decoding device 12.

- FIG. 3 is a block diagram illustrating a configuration example of a class classification adaptive filter 411.

- FIG. 3 is a block diagram illustrating a configuration example of an image conversion apparatus 431.

- FIG. 4 is a block diagram illustrating a configuration example

- FIG. 6 is a block diagram illustrating a configuration example of a class classification adaptive filter 471.

- FIG. FIG. 11 is a block diagram illustrating a configuration example of an image conversion device 481. It is a block diagram which shows the structural example of the class classification

- FIG. 12 is a flowchart illustrating an example of a decoding process of the decoding device 12. It is a flowchart explaining the example of the class classification adaptation process performed by step S170. It is a figure explaining degeneracy of a class. 12 is a block diagram illustrating a sixth configuration example of the encoding device 11.

- FIG. 5 is a block diagram illustrating a configuration example of a class classification adaptive filter 511.

- FIG. 20 is a block diagram illustrating a configuration example of an image conversion apparatus 531.

- 6 is a block diagram illustrating a configuration example of a class classification unit 541.

- FIG. 3 is a block diagram illustrating a configuration example of a learning device 532.

- FIG. 12 is a flowchart illustrating an example of encoding processing of the encoding device 11. It is a flowchart explaining the example of the class classification adaptation process performed by step S225.

- 22 is a block diagram illustrating a sixth configuration example of the decoding device 12.

- FIG. 6 is a block diagram illustrating a configuration example of a class classification adaptive filter 571.

- FIG. FIG. 20 is a block diagram illustrating a configuration example of an image conversion device 581.

- FIG. 10 is a block diagram illustrating a configuration example of a class classification unit 591.

- FIG. 12 is a flowchart illustrating an example of a decoding process of the decoding device 12. It is a flowchart explaining the example of the class classification adaptation process performed by step S270. It is a figure explaining the outline

- FIG. 10 is a flowchart for explaining an example of class classification processing using a class classification coefficient performed by a class classification unit 721.

- 12 is a block diagram illustrating a seventh configuration example of the encoding device 11.

- FIG. 10 is a block diagram illustrating a configuration example of a class classification adaptive filter 811.

- FIG. 25 is a block diagram illustrating a configuration example of an image conversion apparatus 831.

- 5 is a block diagram illustrating a configuration example of a class classification unit 841.

- FIG. 20 is a block diagram illustrating a configuration example of a learning device 832.

- 12 is a flowchart illustrating an example of encoding processing of the encoding device 11. It is a flowchart explaining the example of the class classification adaptation process performed by step S425.

- 22 is a block diagram illustrating a seventh configuration example of the decoding device 12.

- FIG. 6 is a block diagram illustrating a configuration example of a class classification adaptive filter 861.

- FIG. 3 is a block diagram illustrating a configuration example of an image conversion apparatus 871.

- FIG. 12 is a flowchart illustrating an example of a decoding process of the decoding device 12. It is a flowchart explaining the example of the class classification adaptation process performed by step S470.

- FIG. 20 is a block diagram illustrating another configuration example of the learning device 832. It is a figure which shows the RD (Rate-Distortion) curve at the time of providing the class classification adaptive filter which performs an ILF process by class classification adaptive processing, and the case where ALF is provided as ILF. It is a figure which shows the example of a multiview image encoding system. It is a figure which shows the main structural examples of the multiview image coding apparatus to which this technique is applied. It is a figure which shows the main structural examples of the multiview image decoding apparatus to which this technique is applied. It is a figure which shows the example of a hierarchy image coding system. It is a figure which shows the main structural examples of the hierarchy image coding apparatus to which this technique is applied.

- RD Rate-Distortion

- FIG. 20 is a block diagram illustrating a main configuration example of a computer. It is a block diagram which shows an example of a schematic structure of a television apparatus. It is a block diagram which shows an example of a schematic structure of a mobile telephone. It is a block diagram which shows an example of a schematic structure of a recording / reproducing apparatus. It is a block diagram which shows an example of a schematic structure of an imaging device. It is a block diagram which shows an example of a schematic structure of a video set. It is a block diagram which shows an example of a schematic structure of a video processor. It is a block diagram which shows the other example of the schematic structure of a video processor.

- FIG. 1 is a diagram illustrating a configuration example of an embodiment of an image processing system to which the present technology is applied.

- the image processing system includes an encoding device 11 and a decoding device 12.

- the original image to be encoded is supplied to the encoding device 11.

- the encoding device 11 encodes the original image by predictive encoding such as HEVC or AVC (Advanced Video Coding).

- predictive encoding such as HEVC or AVC (Advanced Video Coding).

- a predicted image of the original image is generated, and the residual between the original image and the predicted image is encoded.

- an ILF process is performed by applying ILF to a decoding intermediate image obtained by adding the residual of predictive encoding and the predictive image, and is used for prediction of the predictive image.

- a reference image to be generated is generated.

- an image obtained by performing filter processing (filtering) as ILF processing on an image in the middle of decoding is also referred to as a post-filter image.

- the encoding device 11 performs filtering using ILF processing so that the filtered image is as close to the original image as possible by performing learning using the decoding intermediate image and the original image. Find filter information for

- the ILF process of the encoding device 11 is performed using the filter information obtained by learning.

- learning for obtaining filter information is performed, for example, for each sequence of one or a plurality of original images, or for one or a plurality of scenes (frames from a scene change to the next scene change) of the original image. Alternatively, it can be performed for each of a plurality of frames (pictures), for each of one or a plurality of slices of the original image, for one or a plurality of lines of a block of a unit for encoding a picture, or any other unit.

- the learning for obtaining the filter information can be performed, for example, when the residual becomes equal to or greater than a threshold value.

- the encoding device 11 transmits the encoded data obtained by predictive encoding of the original image and the filter information obtained by learning via the transmission medium 13 or transmitted to the recording medium 14 for recording.

- learning for obtaining filter information can be performed by a device different from the encoding device 11.

- the filter information can be transmitted separately from the encoded data, or can be transmitted by being included in the encoded data.

- the learning for obtaining the filter information is performed using the original image itself (and the decoding intermediate image obtained from the original image), or using an image that is similar to the original image and that is different from the original image. be able to.

- the decoding device 12 receives (receives) (acquires) the encoded data and filter information transmitted from the encoding device 11 via the transmission medium 13 and the recording medium 14, and transmits the encoded data to the encoding device 11. Is decoded by a method corresponding to the prediction encoding.

- the decoding device 12 processes the encoded data from the encoding device 11 to obtain a prediction encoding residual. Furthermore, the decoding device 12 obtains a decoding intermediate image similar to that obtained by the encoding device 11 by adding the residual and the predicted image. Then, the decoding device 12 performs a filtering process as an ILF process using the filter information from the encoding device 11 on the image being decoded, and obtains a filtered image.

- the filtered image is output as a decoded image of the original image, and is temporarily stored as a reference image used for prediction of the predicted image as necessary.

- Filter processing as ILF processing of the encoding device 11 and the decoding device 12 is performed by class classification adaptive processing.

- class classification adaptation process will be described.

- FIG. 2 is a block diagram illustrating a first configuration example of an image conversion apparatus that performs class classification adaptation processing.

- the class classification adaptation process can be understood as, for example, an image conversion process for converting a first image into a second image.

- the image conversion processing for converting the first image into the second image is various signal processing depending on the definition of the first and second images.

- the image conversion process is a spatial resolution creation (improvement) process that improves the spatial resolution. be able to.

- the image conversion process can be referred to as a noise removal process for removing noise.

- the image conversion process is performed as follows: This can be referred to as resizing processing for resizing (enlarging or reducing) an image.

- the first image is a decoded image obtained by decoding an image encoded in block units such as HEVC

- the second image is an original image before encoding

- the image conversion process can be referred to as a distortion removal process that removes block distortion caused by encoding and decoding in units of blocks.

- the classification classification adaptive processing can be performed on, for example, sound as well as images.

- the classification classification adaptation process for sound is a sound conversion process for converting the first sound (for example, sound with low S / N) into the second sound (for example, sound with high S / N). Can be caught.

- the pixel value of the target pixel is obtained by a prediction calculation using the tap coefficient and the pixel values of the same number of pixels as the tap coefficient of the first image selected for the target pixel.

- FIG. 2 shows a configuration example of an image conversion apparatus that performs image conversion processing by class classification adaptive processing.

- the image conversion apparatus 20 includes tap selection units 21 and 22, a class classification unit 23, a coefficient acquisition unit 24, and a prediction calculation unit 25.

- the first image is supplied to the image conversion device 20.

- the first image supplied to the image conversion device 20 is supplied to the tap selection units 21 and 22.

- the tap selection unit 21 sequentially selects the pixels constituting the first image as the target pixel. Further, the tap selection unit 21 predicts some of the pixels (the pixel values) constituting the first image used to predict the corresponding pixels (the pixel values) of the second image corresponding to the target pixel. Select as a tap.

- the tap selection unit 21 selects, as prediction taps, a plurality of pixels of the first image that are spatially or temporally close to the temporal and spatial positions of the target pixel.

- the tap selection unit 22 classifies some of the pixels (pixel values) constituting the first image used for classifying the target pixel into any of several classes. Choose as. That is, the tap selection unit 22 selects a class tap in the same manner as the tap selection unit 21 selects a prediction tap.

- prediction tap and the class tap may have the same tap structure or may have different tap structures.

- the prediction tap obtained by the tap selection unit 21 is supplied to the prediction calculation unit 25, and the class tap obtained by the tap selection unit 22 is supplied to the class classification unit 23.

- the class classification unit 23 classifies the target pixel according to a certain rule, and supplies a class code corresponding to the class obtained as a result to the coefficient acquisition unit 24.

- the class classification unit 23 classifies the target pixel using, for example, the class tap from the tap selection unit 22 and supplies a class code corresponding to the class obtained as a result to the coefficient acquisition unit 24.

- the class classification unit 23 obtains the image feature amount of the target pixel using the class tap. Further, the class classification unit 23 classifies the target pixel according to the image feature amount of the target pixel, and supplies a class code corresponding to the class obtained as a result to the coefficient acquisition unit 24.

- ADRC Adaptive Dynamic Range Coding

- pixels (pixel values) constituting the class tap are subjected to ADRC processing, and the class of the pixel of interest is determined according to the ADRC code (ADRC value) obtained as a result.

- the ADRC code represents a waveform pattern as an image feature amount of a small area including the target pixel.

- the pixel value of each pixel constituting the class tap is requantized to L bits. That is, the pixel value of each pixel forming the class taps, the minimum value MIN is subtracted, and the subtracted value is divided by DR / 2 L (requantization).

- a bit string obtained by arranging the pixel values of the L-bit pixels constituting the class tap in a predetermined order, which is obtained as described above, is output as an ADRC code.

- the pixel value of each pixel constituting the class tap is divided by the average value of the maximum value MAX and the minimum value MIN (rounded down). Thereby, the pixel value of each pixel is set to 1 bit (binarized). Then, a bit string in which the 1-bit pixel values are arranged in a predetermined order is output as an ADRC code.

- the level distribution pattern of the pixel values of the pixels constituting the class tap can be directly output to the class classification unit 23 as a class code.

- the class tap is composed of pixel values of N pixels, and the A bit is assigned to the pixel value of each pixel, the number of class codes output by the class classification unit 23 Is (2 N ) A , which is an enormous number that is exponentially proportional to the number of bits A of the pixel value of the pixel.

- the class classification unit 23 preferably performs class classification by compressing the information amount of the class tap by the above-described ADRC processing or vector quantization.

- the coefficient acquisition unit 24 stores the tap coefficient for each class obtained by learning described later, and further, among the stored tap coefficients, the tap coefficient of the class represented by the class code supplied from the class classification unit 23, That is, the tap coefficient of the class of the target pixel is acquired. Further, the coefficient acquisition unit 24 supplies the tap coefficient of the class of the target pixel to the prediction calculation unit 25.

- the tap coefficient is a coefficient corresponding to a coefficient multiplied with input data in a so-called tap in a digital filter.

- the prediction calculation unit 25 uses the prediction tap output from the tap selection unit 21 and the tap coefficient supplied from the coefficient acquisition unit 24, and the pixel value of the pixel (corresponding pixel) of the second image corresponding to the target pixel. A predetermined prediction calculation for obtaining a predicted value of the true value of is performed. Thereby, the prediction calculation unit 25 obtains and outputs the pixel value of the corresponding pixel (predicted value thereof), that is, the pixel value of the pixels constituting the second image.

- FIG. 3 is a block diagram illustrating a configuration example of a learning device that performs learning of tap coefficients stored in the coefficient acquisition unit 24.

- a high-quality image (high-quality image) is used as the second image, and the high-quality image is filtered by LPF (Low Pass Filter) to reduce the image quality (resolution).

- LPF Low Pass Filter

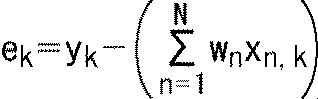

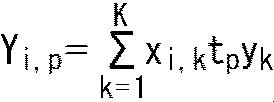

- the pixel value y of the high-quality pixel is obtained by the following linear primary expression.

- x n represents a pixel value of an n-th low-quality image pixel (hereinafter referred to as a low-quality pixel as appropriate) that constitutes a prediction tap for the high-quality pixel y as the corresponding pixel.

- W n represent the n th tap coefficient to be multiplied by the n th low image quality pixel (its pixel value).

- the pixel value y of the high-quality pixel can be obtained not by the linear primary expression shown in Expression (1) but by a higher-order expression of the second or higher order.

- x n, k represents the n-th low-quality pixel constituting the prediction tap for the high-quality pixel of the k-th sample as the corresponding pixel.

- Tap coefficient w n for the prediction error e k 0 of the formula (3) (or Equation (2)) is, is the optimal for predicting the high-quality pixel, for all the high-quality pixel, such In general, it is difficult to obtain a simple tap coefficient w n .

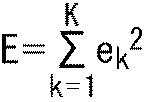

- the optimal tap coefficient w n is the sum of square errors E ( It can be obtained by minimizing (statistical error).

- K is a high-quality pixel y k as the corresponding pixel

- low quality pixels x 1, k that constitute prediction taps for the high quality pixel y k, x 2, k, ⁇ ⁇ ⁇ , X N, k represents the number of samples (number of learning samples).

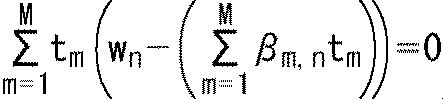

- Equation (5) The minimum value of the sum E of square errors of Equation (4) (minimum value), as shown in Equation (5), given that by partially differentiating the sum E with the tap coefficient w n by w n to 0.

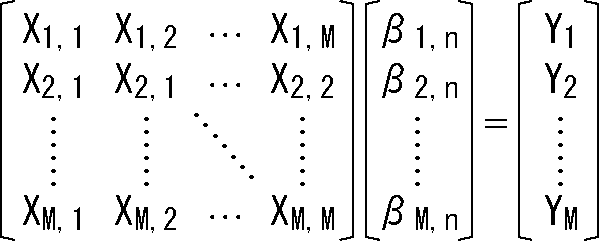

- equation (7) can be expressed by the normal equation shown in equation (8).

- Equation (8) by solving for each class, the optimal tap coefficient (here, the tap coefficient that minimizes the sum E of square errors) to w n, can be found for each class .

- Figure 3 shows an example of the configuration of a learning apparatus that performs learning for determining the tap coefficient w n by solving the normal equations in equation (8).

- the learning device 30 includes a teacher data generation unit 31, a student data generation unit 32, and a learning unit 33.

- the tutor data generating unit 31 and student data generating unit 32 the learning image used for learning of the tap coefficient w n is supplied.

- the learning image for example, a high-quality image with high resolution can be used.

- the teacher data generation unit 32 uses the learning image as teacher data to be a teacher (true value) for learning the tap coefficient, that is, as teacher data to be obtained by the class classification adaptation process, as a prediction calculation by Expression (1).

- a teacher image as a mapping destination is generated and supplied to the learning unit 33.

- the teacher data generation unit 32 supplies a high-quality image as a learning image to the learning unit 33 as it is as a teacher image.

- the student data generation unit 32 uses the learning image as the student data to be a student of tap coefficient learning, that is, as the student data to be subjected to the prediction calculation with the tap coefficient in the class classification adaptation process, the prediction calculation according to Expression (1).

- a student image to be converted by the mapping is generated and supplied to the learning unit 33.

- the student data generation unit 32 generates a low-quality image by, for example, filtering a high-quality image as a learning image with an LPF (low-pass filter) to reduce the resolution, thereby generating the low-quality image.

- the image is supplied to the learning unit 33 as a student image.

- the learning unit 33 sequentially sets the pixels constituting the student image as the student data from the student data generation unit 32 as the target pixel, and the same tap as the tap selection unit 21 of FIG. 2 selects for the target pixel.

- a pixel of the structure is selected as a prediction tap from the student image.

- the learning unit 33 uses the corresponding pixels constituting the teacher image corresponding to the target pixel and the prediction tap of the target pixel, and for each class, establishes a normal equation of Equation (8) and solves the class.

- the tap coefficient for each is obtained.

- FIG. 4 is a block diagram illustrating a configuration example of the learning unit 33 in FIG.

- the learning unit 33 includes tap selection units 41 and 42, a class classification unit 43, an addition unit 44, and a coefficient calculation unit 45.

- the student image is supplied to the tap selection units 41 and 42, and the teacher image is supplied to the adding unit 44.

- the tap selection unit 41 sequentially selects pixels constituting the student image as the target pixel, and supplies information representing the target pixel to the necessary block.

- the tap selection unit 41 selects the same pixel as the pixel selected by the tap selection unit 21 in FIG. 2 from the pixels constituting the student image as the prediction pixel, and the tap selection unit 21 thereby selects the target pixel.

- a prediction tap having the same tap structure as that obtained is obtained and supplied to the adding portion 44.

- the tap selection unit 42 selects the same pixel as the pixel selected by the tap selection unit 22 in FIG. 2 from the pixels constituting the student image for the target pixel, and is thereby obtained by the tap selection unit 22. Class taps having the same tap structure are obtained and supplied to the class classification unit 43.

- the class classification unit 43 performs the same class classification as the class classification unit 23 of FIG. 2 using the class tap from the tap selection unit 42, and adds the class code corresponding to the class of the pixel of interest obtained as a result To the unit 44.

- the adding unit 44 acquires the corresponding pixel (the pixel value thereof) corresponding to the target pixel from the pixels constituting the teacher image, and configures the corresponding pixel and a prediction tap for the target pixel supplied from the tap selection unit 41. Addition is performed for each class code supplied from the class classification unit 43.

- the addition unit 44 is supplied with the corresponding pixel y k of the teacher image as the teacher data, the prediction tap x n, k of the target pixel as the student data, and the class code representing the class of the target pixel.

- Adder 44 for each class of the subject pixel, prediction taps (student data) x n, with k, multiplication (x n of each other learner data in the matrix on the left of formula (8), k x n ' , k ) And a calculation corresponding to summation ( ⁇ ).

- the adding unit 44 also uses the prediction tap (student data) x n, k and the teacher data y k for each class of the pixel of interest , and uses the student data x n, k in the vector on the right side of Expression (8). And the multiplication (x n, k y k ) of the teacher data y k and the calculation corresponding to the summation ( ⁇ ) are performed.

- the adding unit 44 calculates the component ( ⁇ x n, k x n ′, k ) of the left side matrix in Equation (8) obtained for the corresponding pixel corresponding to the target pixel as teacher data last time, and the right side Vector components ( ⁇ x n, k y k ) are stored in a built-in memory (not shown), and the matrix components ( ⁇ x n, k x n ′, k ) or vector components ( ⁇ x n, k y k ), the teacher data corresponding to the new pixel of interest is calculated using the teacher data y k + 1 and student data x n, k + 1.

- the component x n, k + 1 x n ′, k + 1 or x n, k + 1 y k + 1 to be added is added (addition represented by the summation of Expression (8) is performed).

- the addition unit 44 performs the above-described addition using all the pixels of the student image as the target pixel, thereby forming the normal equation shown in Expression (8) for each class, To the coefficient calculation unit 45.

- the coefficient calculation unit 45 finds and outputs the optimum tap coefficient w n for each class by solving the normal equation for each class supplied from the addition unit 44.

- the coefficient acquiring unit 24 of the image converter 20 of FIG. 2 can be stored tap coefficient w n for each class determined as described above.

- FIG. 5 is a block diagram illustrating a second configuration example of an image conversion apparatus that performs class classification adaptation processing.

- the image conversion apparatus 20 includes tap selection units 21 and 22, a class classification unit 23, a coefficient acquisition unit 24, and a prediction calculation unit 25.

- the image conversion apparatus 20 in FIG. 5 is configured in the same manner as in FIG.

- the coefficient acquisition unit 24 stores a seed coefficient described later. Furthermore, in FIG. 5, the parameter acquisition unit 24 is supplied with a parameter z from the outside.

- the coefficient acquisition unit 24 generates a tap coefficient for each class corresponding to the parameter z from the seed coefficient, acquires the tap coefficient of the class from the class classification unit 23 from the tap coefficient for each class, and performs prediction calculation. To the unit 25.

- the coefficient acquisition unit 24 stores the tap coefficient itself, but in FIG. 5, the coefficient acquisition unit 24 stores the seed coefficient.

- a tap coefficient can be generated by giving (determining) the parameter z.

- the seed coefficient can be regarded as information equivalent to the tap coefficient.

- the tap coefficient includes, as necessary, a seed coefficient that can generate the tap coefficient in addition to the tap coefficient itself.

- FIG. 6 is a block diagram illustrating a configuration example of a learning device that performs learning of seed coefficients stored in the coefficient acquisition unit 24.

- a high-quality image (high-quality image) is used as the second image, and a low-quality image (low-level image) in which the spatial resolution of the high-quality image is reduced.

- a prediction tap is selected from the low-quality image with the image quality image) as the first image, and the pixel value of the high-quality pixel, which is a pixel of the high-quality image, is calculated using, for example, Equation (1) ) Is obtained (predicted) by the linear primary prediction calculation.

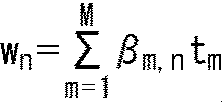

- the tap coefficient w n is generated by the following equation using the seed coefficient and the parameter z.

- beta m, n denotes the m-th species coefficients used for determining the n-th tap coefficient w n.

- the tap coefficient w n is obtained using M seed coefficients ⁇ 1, n , ⁇ 2, n ,..., ⁇ M, n .

- the formula for obtaining the tap coefficient w n from the seed coefficient ⁇ m, n and the parameter z is not limited to the formula (9).

- a value z m ⁇ 1 determined by the parameter z in equation (9) is defined by the following equation by introducing a new variable t m .

- the tap coefficient w n is obtained by a linear linear expression of the seed coefficient ⁇ m, n and the variable t m .

- x n, k represents the n-th low-quality pixel constituting the prediction tap for the high-quality pixel of the k-th sample as the corresponding pixel.

- Prediction error seeds coefficient e k and 0 beta m, n of formula (14), is the optimal for predicting the high-quality pixel, for all the high-quality pixel, such species coefficient beta m , n is generally difficult to find.

- the optimum seed coefficient ⁇ m, n is a square error represented by the following equation. Can be obtained by minimizing the sum E of

- K is a high-quality pixel y k as a corresponding pixel and low-quality pixels x 1, k , x 2, k ,... Constituting a prediction tap for the high-quality pixel y k .

- X N, k represents the number of samples (number of learning samples).

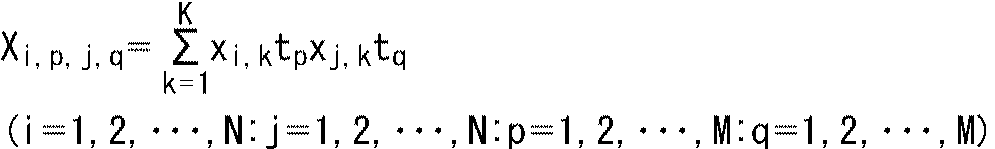

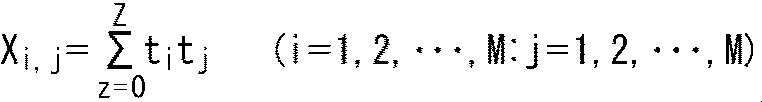

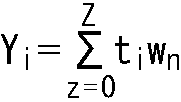

- Expression (17) can be expressed by a normal equation shown in Expression (20) using X i, p, j, q and Y i, p .

- the normal equation of Expression (20) can be solved for the seed coefficient ⁇ m, n by using, for example, a sweeping method (Gauss-Jordan elimination method) or the like.

- a large number of high-quality pixels y 1 , y 2 ,..., Y K are used as teacher data, and low-quality pixels x that constitute prediction taps for the respective high-quality pixels y k .

- the seed coefficient for each class obtained by learning by creating and solving the normal equation of Formula (20) for each class, using 1, k , x 2, k ,..., X N, k as student data beta m, n are stored in the coefficient obtaining unit 24. Then, the coefficient acquisition unit 24 generates a tap coefficient w n for each class from the seed coefficient ⁇ m, n and the parameter z given from the outside according to the equation (9).

- the high-quality pixel (second image) is calculated by calculating the equation (1) using the coefficient w n and the low-quality pixel (first image pixel) x n constituting the prediction tap for the target pixel. Pixel value) (a predicted value close to).

- FIG. 6 shows a configuration example of a learning apparatus that performs learning for obtaining the seed coefficient ⁇ m, n for each class by solving the normal equation of Expression (20) for each class.

- the learning device 30 includes a teacher data generation unit 31, a parameter generation unit 61, a student data generation unit 62, and a learning unit 63.

- the learning device 30 of FIG. 6 is common to the case of FIG. 3 in that it has a teacher data generation unit 31.

- the learning device 30 of FIG. 6 is different from the case of FIG. 3 in that it further includes a parameter generation unit 61. Further, the learning device 30 of FIG. 6 is different from the case of FIG. 3 in that a student data generation unit 62 and a learning unit 63 are provided instead of the student data generation unit 32 and the learning unit 33, respectively. .

- the parameter generation unit 61 generates some values within the range that the parameter z can take, and supplies the values to the student data generation unit 62 and the learning unit 63.

- the same learning image as that supplied to the teacher data generation unit 31 is supplied to the student data generation unit 62.

- the student data generation unit 62 generates a student image from the learning image and supplies it to the learning unit 63 as student data, similarly to the student data generation unit 32 of FIG.

- the student data generation unit 62 is supplied with several values in the range that the parameter z can take from the parameter generation unit 61.

- the student data generation unit 62 filters the high-quality image as the learning image with an LPF having a cutoff frequency corresponding to the parameter z supplied thereto, for example, for each of several values of the parameter z. Then, a low quality image as a student image is generated.

- the student data generation unit 62 generates Z + 1 types of low-quality images as student images having different spatial resolutions as high-quality images as learning images.

- a high-quality image is filtered using an LPF with a high cutoff frequency to generate a low-quality image as a student image.

- the lower the image quality as the student image for the parameter z having a larger value the higher the spatial resolution.

- the student data generation unit 62 generates a low-quality image as a student image in which the spatial resolution in one or both of the horizontal direction and the vertical direction of the high-quality image as a learning image is reduced according to the parameter z. can do.

- the horizontal direction of the high-quality image as the learning image can be reduced separately depending on the respective separate parameters, ie the two parameters z and z ′.

- the coefficient acquisition unit 24 in FIG. 5 is given two parameters z and z ′ from the outside, and a tap coefficient is generated using the two parameters z and z ′ and the seed coefficient.

- a seed coefficient As described above, as a seed coefficient, a seed coefficient that can generate a tap coefficient using one parameter z, two parameters z and z ′, and three or more parameters is used. You can ask. However, in this specification, in order to simplify the description, a description will be given by taking a seed coefficient that generates a tap coefficient using one parameter z as an example.

- the learning unit 63 uses the teacher image as the teacher data from the teacher data generation unit 31, the parameter z from the parameter generation unit 61, and the student image as the student data from the student data generation unit 62 for each class. Obtain the seed coefficient and output it.

- FIG. 7 is a block diagram illustrating a configuration example of the learning unit 63 in FIG.

- portions corresponding to the learning unit 33 in FIG. 4 are denoted by the same reference numerals, and description thereof will be omitted below as appropriate.

- the learning unit 63 includes tap selection units 41 and 42, a class classification unit 43, an addition unit 71, and a coefficient calculation unit 72.

- the learning unit 63 in FIG. 7 is common to the learning unit 33 in FIG. 4 in that the tap selection units 41 and 42 and the class classification unit 43 are included.

- the learning unit 63 is different from the learning unit 33 in that it includes an addition unit 71 and a coefficient calculation unit 72 instead of the addition unit 44 and the coefficient calculation unit 45.

- the tap selection units 41 and 42 are generated using a student image generated in correspondence with the parameter z generated by the parameter generation unit 61 (here, an LPF having a cutoff frequency corresponding to the parameter z).

- a low-quality image as student data), a prediction tap and a class tap are respectively selected.

- the adding unit 71 acquires a corresponding pixel corresponding to the target pixel from the teacher image from the teacher data generation unit 31 in FIG. 6, and the corresponding pixel and the prediction configured for the target pixel supplied from the tap selection unit 41.

- the addition of the student data (student image pixels) constituting the tap and the parameter z when the student data is generated is performed for each class supplied from the class classification unit 43.

- the addition unit 71 includes teacher data y k as corresponding pixels corresponding to the target pixel, prediction taps x i, k (x j, k ) for the target pixel output by the tap selection unit 41, and class The class of the target pixel output from the classification unit 43 is supplied, and the parameter z when the student data constituting the prediction tap for the target pixel is generated is supplied from the parameter generation unit 61.

- the adding unit 71 uses the prediction tap (student data) x i, k (x j, k ) and the parameter z for each class supplied from the class classification unit 43 , and the matrix on the left side of Expression (20).

- t p of formula (18), according to equation (10) is calculated from the parameter z. The same applies to tq in equation (18).

- the adding unit 71 again uses the prediction tap (student data) x i, k , the teacher data y k , and the parameter z for each class supplied from the class classification unit 43, and the equation (20).

- an operation corresponding to summation ( ⁇ ) is calculated from the parameter z.

- the adding unit 71 lastly calculates the component X i, p, j, q of the matrix on the left side in the equation (20) obtained for the corresponding pixel corresponding to the target pixel as the teacher data , and the vector on the right side.

- the component Y i, p is stored in its built-in memory (not shown), and a new pixel of interest is added to the matrix component X i, p, j, q or the vector component Y i, p .

- the addition unit 71 performs the above-described addition for all the parameters z for all values of 0, 1,.

- the normal equation shown in (20) is established, and the normal equation is supplied to the coefficient calculation unit 72.

- the coefficient calculation unit 72 obtains and outputs the seed coefficient ⁇ m, n for each class by solving the normal equation for each class supplied from the addition unit 71.

- a high-quality image as a learning image is used as teacher data, and a low-quality image obtained by degrading the spatial resolution of the high-quality image corresponding to the parameter z is used as student data.

- the learning of the seed coefficient ⁇ m, n involves learning to find the seed coefficient ⁇ m, n that indirectly minimizes the sum of the squared errors of the predicted value y of the teacher data. be able to.

- a high-quality image as a learning image is used as teacher data, and the high-quality image is filtered by an LPF having a cutoff frequency corresponding to the parameter z, thereby reducing the horizontal resolution and the vertical resolution.

- a parameter z as the learner data a parameter z is species coefficient beta m, n and student data by equation (11)

- the seed coefficient ⁇ m, n that minimizes the sum of the square errors of the predicted values of the tap coefficient w n as teacher data predicted from the variable t m to be calculated is obtained.

- the tap coefficient w n for the teacher data predicted by a linear first-order prediction equation the sum E of square errors of the prediction value y that minimizes (minimum) of formula (1), when in the learning apparatus 30 of FIG. 3

- the tap coefficient is obtained from the seed coefficient ⁇ m, n and the variable t m corresponding to the parameter z as shown in the equation (11).

- the tap coefficient obtained by the equation (11) is expressed as w n ′

- the optimum tap coefficient w n expressed by the following equation (21) and the equation (11) are obtained.

- seed coefficient beta m, n of the error e n and 0 and the tap coefficient w n ' is, although the optimum seed coefficient for determining the optimal tap coefficient w n, for all of the tap coefficients w n, such

- equation (21) can be transformed into the following equation by equation (11).

- the optimum seed coefficient ⁇ m, n is expressed by the following equation. It can be obtained by minimizing the sum E of square errors.

- Equation (23) minimum value of the sum E of square errors of Equation (23) (minimum value), as shown in equation (24), those which the sum E partially differentiated at the species factor beta m, n and 0 beta m, n Given by.

- Expression (25) can be expressed by a normal equation shown in Expression (28) using X i, j and Y i .

- Equation (28) can also be solved for the seed coefficient ⁇ m, n by using, for example, a sweeping method.

- FIG. 8 is a block diagram showing another configuration example of the learning unit 63 in FIG.

- FIG. 8 shows a configuration example of the learning unit 63 that performs learning for obtaining the seed coefficient ⁇ m, n by building and solving the normal equation of Expression (28).

- tap selection units 41 and 42 includes tap selection units 41 and 42, a class classification unit 43, a coefficient calculation unit 45, addition units 81 and 82, and a coefficient calculation unit 83.

- the learning unit 63 in FIG. 8 is common to the learning unit 33 in FIG. 4 in that the tap selection units 41 and 42, the class classification unit 43, and the coefficient calculation unit 45 are included.

- the learning unit 63 in FIG. 8 has the addition unit 81 in place of the addition unit 44 and the addition of the addition unit 82 and the coefficient calculation unit 83 in that the learning unit 33 in FIG. Is different.

- the addition unit 81 is supplied with the class of the pixel of interest output by the class classification unit 43 and the parameter z output by the parameter generation unit 61.

- the addition unit 81 includes teacher data as corresponding pixels corresponding to the target pixel in the teacher image from the teacher data generation unit 31 and a student constituting a prediction tap for the target pixel supplied from the tap selection unit 41.

- the addition for the data is performed for each class supplied from the class classification unit 43 and for each value of the parameter z output from the parameter generation unit 61.

- the addition unit 81 is supplied with the teacher data y k , the prediction tap x n, k , the class of the pixel of interest, and the parameter z when the student image constituting the prediction tap x n, k is generated. .

- the adding unit 81 uses prediction taps (student data) x n, k for each class of the target pixel and for each value of the parameter z, and multiplies the student data in the matrix on the left side of Equation (8) ( x n, k x n ′, k ) and calculation corresponding to summation ( ⁇ ).

- the adding unit 81 uses the prediction tap (student data) x n, k and the teacher data y k for each class of the target pixel and for each value of the parameter z, in the vector on the right side of Expression (8).

- An operation corresponding to multiplication (x n, k y k ) of student data x n, k and teacher data y k and summation ( ⁇ ) is performed.

- the adding unit 81 lastly calculates the component ( ⁇ x n, k x n ′, k ) of the left side matrix in Equation (8) obtained for the corresponding pixel corresponding to the target pixel as the teacher data, and the right side Vector components ( ⁇ x n, k y k ) are stored in a built-in memory (not shown), and the matrix components ( ⁇ x n, k x n ′, k ) or vector components ( ⁇ x n, k y k ), the teacher data corresponding to the new pixel of interest is calculated using the teacher data y k + 1 and student data x n, k + 1.

- the component x n, k + 1 x n ′, k + 1 or x n, k + 1 y k + 1 to be added is added (addition represented by the summation of Expression (8) is performed).

- the addition unit 81 performs the above-described addition using all the pixels of the student image as the target pixel, thereby obtaining the normal equation shown in Expression (8) for each value of the parameter z for each class. Then, the normal equation is supplied to the coefficient calculation unit 45.

- the adding unit 81 establishes a normal equation of the equation (8) for each class, similarly to the adding unit 44 of FIG. However, the addition unit 81 is different from the addition unit 44 of FIG. 4 in that the normal equation of Expression (8) is further established for each value of the parameter z.

- the coefficient calculation unit 45 obtains an optimum tap coefficient w n for each value of the parameter z for each class by solving a normal equation for each value of the parameter z for each class supplied from the addition unit 81. , Supplied to the adding portion 82.

- the adding unit 82 adds the parameters z (variable t m corresponding to the parameter z supplied from the parameter generating unit 61 (FIG. 6)) and the optimum tap coefficient w n supplied from the coefficient calculating unit 45. For each class.

- the adding unit 82 uses the variable t i (t j ) obtained from the parameter z supplied from the parameter generating unit 61 by the equation (10), and uses the equation (26) in the matrix on the left side of the equation (28). For each class, the multiplication (t i t j ) between the variables t i (t j ) corresponding to the parameter z for obtaining the component X i, j defined by Do.

- the component X i, j is determined only by the parameter z and has no relation to the class , the calculation of the component X i, j does not actually need to be performed for each class, and is performed once. Just do it.

- the adding unit 82 uses the variable t i obtained from the parameter z supplied from the parameter generating unit 61 by the equation (10) and the optimum tap coefficient w n supplied from the coefficient calculating unit 45, and uses the equation t In the vector on the right side of (28), the multiplication (t i w n ) of the variable t i corresponding to the parameter z for obtaining the component Y i defined by the equation (27) and the optimum tap coefficient w n , An operation corresponding to the formation ( ⁇ ) is performed for each class.

- the adding unit 82 obtains the component X i, j represented by the equation (26) and the component Y i represented by the equation (27) for each class, thereby obtaining the equation (28) for each class. And the normal equation is supplied to the coefficient calculation unit 83.

- Coefficient calculating unit 83 solves the normal equation of Equation (28) for each class supplied from the adder 82 obtains and outputs the seed coefficient beta m, n for each class.

- the coefficient acquisition unit 24 in FIG. 5 can store the seed coefficient ⁇ m, n for each class obtained as described above.

- the seed coefficient depends on how the student data corresponding to the first image and the image to be used as teacher data corresponding to the second image are selected. As a result, seed coefficients for performing various image conversion processes can be obtained.

- the learning image is used as teacher data corresponding to the second image as it is, and the low-quality image in which the spatial resolution of the learning image is deteriorated is the student data corresponding to the first image. Since the seed coefficient is learned, the seed coefficient is subjected to image conversion processing as spatial resolution creation processing for converting the first image into the second image with improved spatial resolution. A seed coefficient can be obtained.

- the image conversion apparatus 20 in FIG. 5 can improve the horizontal resolution and vertical resolution of the image to the resolution corresponding to the parameter z.

- a high-quality image is used as teacher data, and a seed coefficient is learned using, as student data, an image in which noise of a level corresponding to the parameter z is superimposed on the high-quality image as the teacher data.

- a seed coefficient it is possible to obtain a seed coefficient for performing an image conversion process as a noise removal process for converting the first image into a second image from which the noise included therein is removed (reduced).

- the image conversion apparatus 20 of FIG. 5 can obtain an S / N image corresponding to the parameter z (an image subjected to noise removal with an intensity corresponding to the parameter z).

- the tap coefficient w n in as shown in Equation (9), ⁇ 1, n z 0 + ⁇ 2, n z 1 + ⁇ + ⁇ M, n z M-1 and, by the equation (9), the spatial resolution in the horizontal and vertical directions, both have been to obtain the tap coefficient w n for improving corresponding to the parameter z, the tap coefficient w n is horizontal It is also possible to obtain a resolution and a vertical resolution that are independently improved corresponding to the independent parameters z x and z y .

- the tap coefficient w n can be finally expressed by the equation (11). Therefore, in the learning device 30 in FIG. 6, the horizontal direction of the teacher data corresponds to the parameters z x and z y. The image with degraded resolution and vertical resolution is used as student data, and learning is performed to obtain the seed coefficient ⁇ m, n , so that the horizontal and vertical resolutions correspond to independent parameters z x and z y , it is possible to determine the tap coefficient w n to improve independently.

- an image obtained by degrading the horizontal resolution and vertical resolution of the teacher data corresponding to the parameter z x and adding noise to the teacher data corresponding to the parameter z y is used as student data.

- FIG. 9 is a block diagram illustrating a first configuration example of the encoding device 11 of FIG.

- the encoding device 11 includes an A / D conversion unit 101, a rearrangement buffer 102, a calculation unit 103, an orthogonal transformation unit 104, a quantization unit 105, a lossless encoding unit 106, and a storage buffer 107. Furthermore, the encoding device 11 includes an inverse quantization unit 108, an inverse orthogonal transform unit 109, a calculation unit 110, a class classification adaptive filter 111, a frame memory 112, a selection unit 113, an intra prediction unit 114, a motion prediction compensation unit 115, a prediction An image selection unit 116 and a rate control unit 117 are included.

- the A / D conversion unit 101 A / D converts the analog signal original image into a digital signal original image, and supplies the converted image to the rearrangement buffer 102 for storage.

- the rearrangement buffer 102 rearranges the frames of the original image in the order of encoding (decoding) from the display order according to GOP (Group Of Picture). To the class classification adaptive filter 111.

- the calculation unit 103 subtracts the prediction image supplied from the intra prediction unit 114 or the motion prediction compensation unit 115 via the prediction image selection unit 116 from the original image from the rearrangement buffer 102 and obtains a residual obtained by the subtraction. (Prediction residual) is supplied to the orthogonal transform unit 104.

- the calculation unit 103 subtracts the predicted image supplied from the motion prediction / compensation unit 115 from the original image read from the rearrangement buffer 102.

- the orthogonal transform unit 104 performs orthogonal transform such as discrete cosine transform and Karhunen-Loeve transform on the residual supplied from the computation unit 103. Note that this orthogonal transformation method is arbitrary.

- the orthogonal transform unit 104 supplies transform coefficients obtained by the orthogonal exchange to the quantization unit 105.

- the quantization unit 105 quantizes the transform coefficient supplied from the orthogonal transform unit 104.

- the quantization unit 105 sets the quantization parameter QP based on the code amount target value (code amount target value) supplied from the rate control unit 117 and quantizes the transform coefficient. Note that this quantization method is arbitrary.

- the quantization unit 105 supplies the quantized transform coefficient to the lossless encoding unit 106.

- the lossless encoding unit 106 encodes the transform coefficient quantized by the quantization unit 105 using a predetermined lossless encoding method. Since the transform coefficient is quantized under the control of the rate control unit 117, the code amount of the encoded data obtained by the lossless encoding of the lossless encoding unit 106 is the code amount target set by the rate control unit 117. Value (or approximate the code amount target value).

- the lossless encoding unit 106 acquires necessary encoding information from the blocks among the encoding information related to predictive encoding in the encoding device 11.

- motion information such as a motion vector, code amount target value, quantization parameter QP, picture type (I, P, B), CU (Coding Unit) and CTU (Coding

- the prediction mode can be acquired from the intra prediction unit 114 or the motion prediction / compensation unit 115.

- the motion information can be acquired from the motion prediction / compensation unit 115.

- the lossless encoding unit 106 acquires encoding information, and also acquires filter information related to class classification adaptive processing in the class classification adaptive filter 111 from the class classification adaptive filter 111.

- the filter information includes a tap coefficient for each class.

- the lossless encoding unit 106 encodes the encoded information and the filter information by an arbitrary lossless encoding method, and uses it as part of the header information of the encoded data (multiplexes).

- the lossless encoding unit 106 transmits the encoded data via the accumulation buffer 107. Therefore, the lossless encoding unit 106 functions as a transmission unit that transmits encoded data, and thus encoded information and filter information included in the encoded data.

- variable length encoding or arithmetic encoding can be adopted.

- variable length coding include H.264.

- CAVLC Context-AdaptiveaptVariable Length Coding

- arithmetic coding include CABAC (Context-AdaptiveaptBinary Arithmetic Coding).

- the accumulation buffer 107 temporarily accumulates the encoded data supplied from the lossless encoding unit 106.

- the encoded data stored in the storage buffer 107 is read and transmitted at a predetermined timing.

- the transform coefficient quantized by the quantization unit 105 is supplied to the lossless encoding unit 106 and also to the inverse quantization unit 108.

- the inverse quantization unit 108 inversely quantizes the quantized transform coefficient by a method corresponding to the quantization by the quantization unit 105.

- the inverse quantization method may be any method as long as it is a method corresponding to the quantization processing by the quantization unit 105.

- the inverse quantization unit 108 supplies the transform coefficient obtained by the inverse quantization to the inverse orthogonal transform unit 109.

- the inverse orthogonal transform unit 109 performs inverse orthogonal transform on the transform coefficient supplied from the inverse quantization unit 108 by a method corresponding to the orthogonal transform process by the orthogonal transform unit 104.

- the inverse orthogonal transform method may be any method as long as it corresponds to the orthogonal transform processing by the orthogonal transform unit 104.

- the inversely orthogonally transformed output (restored residual) is supplied to the calculation unit 110.

- the calculation unit 110 is supplied from the intra prediction unit 114 or the motion prediction / compensation unit 115 to the inverse orthogonal transform result supplied from the inverse orthogonal transform unit 109, that is, the restored residual, via the predicted image selection unit 116.

- the prediction image is added, and the addition result is output as a decoding intermediate image.

- the decoding intermediate image output from the calculation unit 110 is supplied to the class classification adaptive filter 111 or the frame memory 112.

- the class classification adaptive filter 111 is a filter that functions as ILF, that is, all of DF, SAO, and ALF, by class classification adaptive processing, and performs ILF processing by class classification adaptive processing.

- the class classification adaptive filter 111 is supplied with the decoding-in-progress image from the calculation unit 110 and is supplied with the original image corresponding to the decoding-in-progress image from the rearrangement buffer 102 and is required from each block of the encoding device 11. Encoded information is supplied.

- the class classification adaptive filter 111 uses a student image corresponding to the intermediate decoding image from the calculation unit 110 and a teacher image corresponding to the original image from the rearrangement buffer 102, and uses encoded information as necessary. To learn the tap coefficient for each class.

- the class classification adaptive filter 111 uses, for example, the decoding intermediate image itself from the calculation unit 110 as a student image and the original image itself from the rearrangement buffer 102 as a teacher image, and encodes information as necessary. And learning to find the tap coefficient for each class.

- the tap coefficient for each class is supplied from the class classification adaptive filter 111 to the lossless encoding unit 106 as filter information.

- the class classification adaptive filter 111 performs the class classification adaptive processing (by image conversion) using the tap coefficient for each class, using the decoding intermediate image from the calculation unit 110 as the first image, and the encoded information as necessary. In this way, the halfway decoded image as the first image is converted into a filtered image as a second image corresponding to the original image (generates a filtered image) and output.

- the filtered image output from the class classification adaptive filter 111 is supplied to the frame memory 112.

- the class classification adaptive filter 111 learning is performed by using the mid-decoding image as the student image and the original image as the teacher image, and using the tap coefficient obtained by the learning, the mid-decoding is performed.

- a class classification adaptation process for converting an image into a filtered image is performed. Therefore, the filtered image obtained by the class classification adaptive filter 111 is an image very close to the original image.

- the frame memory 112 temporarily stores the decoding intermediate image supplied from the calculation unit 110 or the filtered image supplied from the class classification adaptive filter 111 as a locally decoded decoded image.

- the decoded image stored in the frame memory 112 is supplied to the selection unit 113 as a reference image used for generating a predicted image at a necessary timing.

- a decoding intermediate image supplied from the computation unit 110 and a filtered intermediate image supplied from the class classification adaptive filter 111 as decoded images stored in the frame memory 112 are intra prediction. Used as a reference image.

- the filtered image is used as a reference image for inter prediction.

- the selection unit 113 selects a supply destination of the reference image supplied from the frame memory 112. For example, when intra prediction is performed in the intra prediction unit 114, the selection unit 113 supplies the reference image supplied from the frame memory 112 to the intra prediction unit 114. For example, when inter prediction is performed in the motion prediction / compensation unit 115, the selection unit 113 supplies the reference image supplied from the frame memory 112 to the motion prediction / compensation unit 115.

- the intra prediction unit 114 basically uses the original image supplied from the rearrangement buffer 102 and the reference image supplied from the frame memory 112 via the selection unit 113 as a processing unit for PU (Prediction Unit). Intra prediction (in-screen prediction) is performed.

- the intra prediction unit 114 selects an optimal intra prediction mode based on a predetermined cost function, and supplies the prediction image generated in the optimal intra prediction mode to the prediction image selection unit 116. Further, as described above, the intra prediction unit 114 appropriately supplies a prediction mode indicating the intra prediction mode selected based on the cost function to the lossless encoding unit 106 and the like.

- the motion prediction / compensation unit 115 uses the original image supplied from the rearrangement buffer 102 and the reference image supplied from the frame memory 112 via the selection unit 113 to basically perform motion prediction using the PU as a processing unit. (Inter prediction) is performed. Furthermore, the motion prediction / compensation unit 115 performs motion compensation according to a motion vector detected by motion prediction, and generates a predicted image. The motion prediction / compensation unit 115 performs inter prediction in a plurality of inter prediction modes prepared in advance, and generates a prediction image.

- the motion prediction / compensation unit 115 selects an optimal inter prediction mode based on a predetermined cost function of the prediction image obtained for each of the plurality of inter prediction modes. Furthermore, the motion prediction / compensation unit 115 supplies the predicted image generated in the optimal inter prediction mode to the predicted image selection unit 116.

- the motion prediction / compensation unit 115 performs motion such as a prediction mode indicating an inter prediction mode selected based on a cost function and a motion vector necessary for decoding encoded data encoded in the inter prediction mode. Information or the like is supplied to the lossless encoding unit 106.

- the prediction image selection unit 116 selects a supply source (intra prediction unit 114 or motion prediction compensation unit 115) of a prediction image to be supplied to the calculation units 103 and 110, and selects a prediction image supplied from the selected supply source. , To the arithmetic units 103 and 110.

- the rate control unit 117 controls the quantization operation rate of the quantization unit 105 based on the code amount of the encoded data stored in the storage buffer 107 so that overflow or underflow does not occur. That is, the rate control unit 117 sets the target code amount of the encoded data so that the overflow and underflow of the accumulation buffer 107 do not occur, and supplies them to the quantization unit 105.

- FIG. 10 is a block diagram showing a configuration example of the class classification adaptive filter 111 of FIG.

- the class classification adaptive filter 111 includes an image conversion device 131 and a learning device 132.

- the image conversion device 131 is supplied with the decoding intermediate image from the calculation unit 110 (FIG. 9) and the tap coefficient for each class from the learning device 132. Further, the image conversion apparatus 131 is supplied with encoded information.