WO2014156728A1 - ロボットサービス連携システム、プラットフォームおよび方法 - Google Patents

ロボットサービス連携システム、プラットフォームおよび方法 Download PDFInfo

- Publication number

- WO2014156728A1 WO2014156728A1 PCT/JP2014/056914 JP2014056914W WO2014156728A1 WO 2014156728 A1 WO2014156728 A1 WO 2014156728A1 JP 2014056914 W JP2014056914 W JP 2014056914W WO 2014156728 A1 WO2014156728 A1 WO 2014156728A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- service

- robot

- user

- information

- services

- Prior art date

Links

- 238000000034 method Methods 0.000 title claims description 29

- 238000001514 detection method Methods 0.000 claims description 16

- 230000036541 health Effects 0.000 description 36

- 230000006870 function Effects 0.000 description 27

- 230000008569 process Effects 0.000 description 21

- 238000012545 processing Methods 0.000 description 21

- 238000012544 monitoring process Methods 0.000 description 16

- 238000004891 communication Methods 0.000 description 9

- 230000007704 transition Effects 0.000 description 8

- 238000010586 diagram Methods 0.000 description 5

- 238000007726 management method Methods 0.000 description 4

- 230000007613 environmental effect Effects 0.000 description 3

- 230000010365 information processing Effects 0.000 description 3

- 230000004044 response Effects 0.000 description 3

- 230000006399 behavior Effects 0.000 description 2

- 230000005012 migration Effects 0.000 description 2

- 238000013508 migration Methods 0.000 description 2

- 238000013468 resource allocation Methods 0.000 description 2

- 230000001133 acceleration Effects 0.000 description 1

- 230000009471 action Effects 0.000 description 1

- 230000004913 activation Effects 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G16—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR SPECIFIC APPLICATION FIELDS

- G16H—HEALTHCARE INFORMATICS, i.e. INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR THE HANDLING OR PROCESSING OF MEDICAL OR HEALTHCARE DATA

- G16H40/00—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices

- G16H40/60—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices

- G16H40/67—ICT specially adapted for the management or administration of healthcare resources or facilities; ICT specially adapted for the management or operation of medical equipment or devices for the operation of medical equipment or devices for remote operation

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J11/00—Manipulators not otherwise provided for

- B25J11/008—Manipulators for service tasks

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J13/00—Controls for manipulators

- B25J13/006—Controls for manipulators by means of a wireless system for controlling one or several manipulators

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J13/00—Controls for manipulators

- B25J13/08—Controls for manipulators by means of sensing devices, e.g. viewing or touching devices

- B25J13/081—Touching devices, e.g. pressure-sensitive

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q10/00—Administration; Management

- G06Q10/10—Office automation; Time management

- G06Q10/101—Collaborative creation, e.g. joint development of products or services

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q30/00—Commerce

- G06Q30/06—Buying, selling or leasing transactions

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q50/00—Information and communication technology [ICT] specially adapted for implementation of business processes of specific business sectors, e.g. utilities or tourism

- G06Q50/02—Agriculture; Fishing; Forestry; Mining

Definitions

- the present invention relates to a robot service cooperation system, a platform, and a method, and more particularly, to a robot service cooperation system, a platform, and a method for providing a service to a user at various places using a robot connected to a network.

- Patent Document 1 a system disclosed in Patent Document 1 is known.

- one or more robots arranged in a space, a robot router for controlling the robot, and a space manager that manages the state of the robot in the space and collects and manages environmental information

- the system controls the robot based on the user attributes and environment information held in the robot router in the space where the robot router exists. And provide services.

- the user can receive an optimum service in the latest environment.

- a main object of the present invention is to provide a novel robot service cooperation system, platform and method.

- Another object of the present invention is to provide a robot service cooperation system, platform, and method that can provide a plurality of services required by a user in cooperation with each other.

- the first invention includes a server (12) connected to the network (100), a mobile terminal (14) connected to the network, and a robot (16a-16c) connected to the network.

- a robot service cooperation system (10) in which a plurality of application software (A1-A3) links a plurality of services provided to a user of a portable terminal (14) using a robot (16a-16c).

- linkage information indicating which other application software can be linked is described (FIG. 5), and the server provides each service application with a plurality of services that can be provided in cooperation with the user of the mobile terminal.

- presentation selection means S7, S13: FIGS.

- a presentation selection means performs presentation selection via the touch screen of a portable terminal (14) in a certain Example, in another Example, it utilizes the audio

- a plurality of services required by the user can be provided in cooperation in at least a sequential manner.

- the second invention is a robot service cooperation system according to the first invention, wherein the presentation selecting means further inputs information related to the selected combination to the user of the portable terminal (S13: FIG. 16).

- the cooperation unit sets the start condition of the second service based on the information. 1 is registered in association with the service end event (FIG. 9A).

- the service end / interruption event is issued from, for example, application software that provides the service. Or it may be issued from a portable terminal according to a user's operation.

- two services required by the user can be sequentially provided in a coordinated manner.

- a third invention is a robot service cooperation system subordinate to the second invention, wherein the cooperation means has information capable of determining that the second service should be interrupted during execution of the first service.

- the second service start condition is registered in association with the first service interruption event based on the information, and the first service restart condition is set as the second service end event. Registration is performed in association with each other (FIG. 9B).

- two services required by the user can be provided in cooperation with each other in the mode desired by the user among the sequential mode and the parallel mode.

- the fourth invention is a robot service cooperation system subordinate to the second invention, and the cooperation information of the specific application software (A3) can be linked in parallel with any other application software (A1, A2). If the service provided by the specific application software is included in a plurality of services constituting the combination selected by the selection means, the cooperation means Are registered in association with start events of other services (FIGS. 9D and 9E).

- two services can be linked in a sequential manner or in a parallel manner, and another service can be provided in a linked manner in a parallel manner.

- a fifth invention is a robot service cooperation system subordinate to the first invention, wherein user attribute information (92: FIG. 7) indicating attributes of the user of the mobile terminal and robot information (94) indicating at least the function of the robot. : FIG. 8) and a registered database (DB) are further included, and the specifying means specifies the information with reference to each information in the database.

- each information is preferably registered so as to be updatable.

- the fifth invention it is possible to provide a service using a robot having a function corresponding to the user's attribute.

- 6th invention is a robot service cooperation system which depends on 5th invention, Comprising: Robot information further shows the movement range of a robot, It further has a detection means (46) which detects the present position of the user of a portable terminal.

- the specifying unit performs the determination in consideration of a comparison result between the detection result of the position detecting unit and the movement range of the robot.

- a seventh invention is a robot service cooperation system according to the first invention, wherein the presentation selecting means touches a plurality of icons (I1-I3) corresponding to the plurality of services specified by the specifying means by touching the mobile terminal.

- Arbitrary combinations are selected by being displayed on the screen (32, 34) (FIGS. 14 and 15), and among the plurality of icons displayed on the touch screen, a plurality of first icons (I1, I1) constituting the selected combination are displayed.

- the display mode is different between I2) and the remaining second icon (I3) (FIG. 16).

- the user can recognize whether each service is in a selected state or a non-selected state. As a result, the user can know the existence of a service that has not been selected so far, and can also switch the selection / non-selection state of each service.

- the eighth invention is realized by the computer (20) of the server (12) connected to the network (100), and a plurality of application software (A1-A3) on the network is connected to the mobile terminal (14).

- a robot service linkage platform (PF) that links a plurality of services provided to each user using a robot (16a-16c) connected to a network, and each application software includes any other Coordination information indicating whether it can be linked with application software is described (FIG. 5), and a plurality of services that can be provided in cooperation with the user of the mobile terminal are specified based at least on the linkage information described in each service application software.

- Specific means S3

- a presentation selection means S7, S13: FIGS.

- Coordinating means for coordinating a plurality of services with each other by registering at least a start condition of each service in an event queue in association with at least an end event of another service (S17, S19: FIG. 9A to FIG. 9) E)).

- a ninth invention is performed by a computer of a server connected to a network, and a plurality of application software on the network are respectively provided to a user of a mobile terminal connected to the network by using a robot connected to the network.

- This is a robot service cooperation method that links multiple services to each other.

- Each application software contains linkage information that indicates which other application software can be linked to, and can be provided to users of mobile terminals in cooperation.

- a specific step for identifying a plurality of services based at least on linkage information described in each service application software, and a presentation selection for presenting a plurality of services identified in the specific step to a user of the mobile terminal and selecting an arbitrary combination Cooperation that links a plurality of services constituting the combination selected in the step and the presentation selection step to each other by registering at least a start condition of each service in an event queue in association with at least an end event of another service Includes steps.

- a plurality of services required by the user can be provided in cooperation at least sequentially.

- a robot service cooperation system and a platform capable of providing a plurality of services required by a user in cooperation with each other are realized.

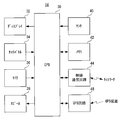

- FIG. 1 is a block diagram showing a configuration of a robot service cooperation system according to an embodiment of the present invention.

- FIG. 2 is a block diagram illustrating a configuration example of a server included in the robot service cooperation system.

- FIG. 3 is a block diagram illustrating a configuration example of a mobile terminal included in the robot service cooperation system.

- FIG. 4 is a block diagram illustrating a configuration example of a wheelchair / humanoid robot included in the robot service cooperation system.

- FIG. 5 is an illustrative view showing an example of application software for providing various robot services on the robot service cooperation system.

- FIG. 6 is a memory map showing the contents of the server memory.

- FIG. 7 is an illustrative view showing an example of user attribute information stored in a memory.

- FIG. 1 is a block diagram showing a configuration of a robot service cooperation system according to an embodiment of the present invention.

- FIG. 2 is a block diagram illustrating a configuration example of a server included in the robot service cooperation system.

- FIG. 8 is an illustrative view showing an example of robot information stored in the memory.

- FIG. 9 is an illustrative view showing an example of event queue information stored in a memory.

- FIG. 9A shows event queue information when shopping support and excursion support are provided in a continuous manner

- FIG. 9C shows event queue information when shopping support and excursion support are provided in an interrupt mode

- FIG. 9C shows event queue information when shopping support and health watch (or excursion support and health watch) are provided in a parallel mode

- FIG. 9D shows event queue information when providing health support in a parallel manner while providing shopping support and excursion support in a continuous manner

- FIG. 9E shows an aspect of interrupting shopping support and excursion support.

- FIG. 10 is a block diagram showing a functional configuration of a service cooperation platform (PF) realized by the CPU operation of the server.

- FIG. 11 is a flowchart showing a part of PF processing (robot service cooperation processing).

- FIG. 12 is a flowchart showing another part of the robot service cooperation processing.

- FIG. 13 is a flowchart showing processing of each application (service provision processing) realized by the CPU operation of the server.

- FIG. 14 is an illustrative view showing an example of a user interface (UI) applied to a touch screen of a mobile terminal, and shows a screen for presenting a service that can be provided in cooperation to a user and selecting an arbitrary combination .

- FIG. UI user interface

- FIG. 15 is an illustrative view showing a selection example of a combination by a user.

- FIG. 15A shows a state where a combination of shopping support and excursion support is selected

- FIG. 15B shows a combination of shopping support and health monitoring.

- FIG. 15C shows a state where the combination of excursion support and health watching is selected

- FIG. 15D shows a state where the combination of shopping support, excursion support and health watching is selected.

- FIG. 16 is an illustrative view showing a screen for allowing the user to continuously input detailed information when a combination of shopping support and excursion support is selected.

- FIG. 1 shows the configuration of a robot service cooperation system according to an embodiment of the present invention.

- a robot service cooperation system 10 includes a server 12, which is connected to each of a mobile terminal 14, a wheelchair robot 16a, a humanoid robot 16b, and an environment sensor 16c via a network 100.

- the mobile terminal 14 is carried by the user, and the wheelchair robot 16a, the humanoid robot 16b, and the environment sensor 16c are arranged in a shopping center where the user shop.

- the mobile terminal 14 detects the current position of the user (that is, the user) based on a signal from the GPS satellite 102, detects the user's pulse and momentum, and communicates with the user through a virtual robot (not shown) in the virtual space. And can interact.

- the humanoid robot 16b has a head, arms, wheels, and the like, and can move autonomously in the shopping center while interacting with the user through gestures.

- the wheelchair robot 16a has a chair and wheels, and can move autonomously in the shopping center while interacting with the user with the user on the wheelchair robot 16a.

- the environment sensor 16c is composed of a laser range finder, an infrared sensor, an image sensor, and the like, and is an invisible robot fixed at a predetermined position (for example, along an entrance or a passage) in a shopping center. Detection (recognize face and identify position).

- FIG. 2 shows a configuration example of the server 12.

- the server 12 includes a CPU 20, a display 22, a keyboard 24, a memory 26, and a communication circuit 28.

- the keyboard 24 is operated by an operator, and inputs a command to the CPU 20 to execute information processing. The operator can also remotely operate each robot (16a, 16b).

- the display 22 displays the result of information processing by the CPU 20.

- the memory 26 stores programs and data for causing the CPU 20 to perform information processing.

- the communication circuit 28 connects the CPU 20 to the network 100 so that communication is possible.

- FIG. 3 shows a configuration example of the mobile terminal 14.

- the mobile terminal 14 includes a CPU 30, a display 32, a touch panel 34, a microphone 36, a speaker 38, a sensor 40, a memory 42, a wireless communication circuit 44 and a GPS circuit 46.

- a touch screen is constituted by the display 32 and the touch panel 34, and the CPU 30 presents or inputs (selects) information to the user through the touch screen.

- the CPU 30 displays a virtual robot on the display 32 and interacts with the user through the microphone 36 and the speaker 38.

- the sensor 40 is configured by an acceleration sensor, a gyroscope, or the like, and the CPU 30 detects a user's pulse and momentum based on the output of the sensor 40.

- the memory 42 stores a program and data for causing the CPU 30 to perform the above processing.

- the wireless communication circuit 44 connects the CPU 30 to the network 100 so that wireless communication is possible.

- the GPS circuit 46 receives signals from a plurality of GPS satellites 102, detects the current position of the mobile terminal 14 (user) based on the received signal, and outputs current position information indicating the detection result.

- FIG. 4 shows a configuration example of the wheelchair robot 16a / humanoid robot 16b.

- wheelchair robot 16a / humanoid robot 16b includes a CPU 50, a microphone 52, a speaker 54, a sensor 56, a motor 58, a memory 60, and a wireless communication circuit 62.

- the CPU 50 interacts with the user through the microphone 52 and the speaker 54.

- the sensor 56 is configured by an image sensor, an infrared sensor, or the like, and the CPU 50 controls the motor 58 or detects a user based on the output of the sensor 56.

- the motor 58 drives the wheel (further arm / head in the case of the humanoid robot 16b) under the control of the CPU 50.

- the memory 60 stores programs and data for causing the CPU 50 to perform the above processing.

- the wireless communication circuit 62 connects the CPU 50 to the network 100 so that wireless communication is possible.

- FIG. 5 shows examples of application software (hereinafter “applications”) A1, A2, and A3 that provide various services on the robot service cooperation system 10 configured as described above.

- each application A1, A2, A3 program (shopping support program, excursion support program, health watching program) includes link information (“linkable with excursion support app”, “link with shopping support app”). Possible “and” can be linked in parallel with each application ").

- the application A1 provides, for example, a shopping support service using a humanoid robot 16b to a user such as an elderly person (service such as guiding to a target store, explaining a product at a store, or carrying a purchased item).

- a shopping support application to be provided and can be linked with the excursion support application (A2).

- the application A2 is a migration support application that provides, for example, a walking support service using a wheelchair robot 16a to a user such as a person with a walking disability (service that travels in a wheelchair while explaining products in each store in the shopping center).

- the shopping support application (A1) can be linked.

- App A3 provides health monitoring services (services that provide health advice such as “let's take a break” by detecting heart rate, exercise amount, etc.) using virtual robots (mobile devices 14) to users such as the elderly

- health monitoring services services that provide health advice such as “let's take a break” by detecting heart rate, exercise amount, etc.

- virtual robots mobile devices 14

- “shopping” refers to purchasing behavior that has already been decided on what is desired to be purchased and goes directly to the sales floor.

- “Walking” refers to shopping that has not yet been decided on what to buy. Purchasing behavior to find what you want to buy while visiting the center.

- the CPU 20 of the server 12 mainly uses the robot service cooperation platform (FIG. 10) based on the programs and data shown in FIGS.

- the robot service cooperation platform FIG. 10

- PF robot service cooperation platform

- FIG. 6 shows the contents of the memory 26.

- memory 26 includes a program area 70, a transition data area 76, and a non-transition data area 86, and application program 72 and service cooperation program 74 are stored in program area 70.

- the application program 72 is a program for controlling the hardware of the robot service cooperation system 10 and providing various services to the user.

- the application program 72 corresponds to each of the three applications A1, A2, and A3 shown in FIG.

- a shopping support program 72a, a migration support program 72b, and a health watch program 72c are included.

- the service cooperation program 74 is a program for linking a plurality of services based on the application program 72 (here, two or three of the three services of shopping support, excursion support, and health monitoring).

- the current position information 78 is information indicating the current position of the mobile terminal 14, that is, the user, and mainly uses the current position information output from the GPS circuit 46 of the mobile terminal 14 itself (the current position information obtained from the environment sensor 16c is used as a substitute). Or may be used in combination.

- the robot status information 80 is information indicating the status (for example, available status, status used for any service) of the various robots (14, 16a-16c) shown in FIG. Information provided by the robot itself is used.

- the service state information 82 is a state of a plurality of services provided by the application (in this case, shopping support, excursion support and health monitoring provided by the three applications in FIG. 5) (waiting for start, running, suspended) Information indicating whether it is in a completed state or the like, and is controlled by the service cooperation program 74 based on event information (such as a start event, an interrupt event, a resume event, and an end event of the service) provided from the application itself.

- event information such as a start event, an interrupt event, a resume event, and an end event of the service

- the event queue information 84 includes a plurality of services provided by the application (in this case, shopping support, excursion support, and health monitoring provided by the three applications in FIG. 5) sequentially or in an interrupt manner, or sequentially or in parallel with the interrupt. 9 is information controlled by the service cooperation program 74 to have the contents shown in FIG.

- the event queue information 84 in FIG. 9A is used to link shopping support (first service) and excursion support (second service) in a sequential manner, and “shopping center” is used as a shopping support start condition. Is registered, and “After shopping” is registered as a start condition for excursion support. In this way, when the first and second services are linked in a sequential manner, the start condition of the second service may be registered in association with the end event of the first service. In general, if the start condition of the i-th service is registered in association with the end event of the (i-1) -th service, i services can be linked in a sequential manner (where i is an integer of 2 or more) ).

- the event queue information 84 in FIG. 9B is for linking shopping support (second service) and excursion support (first service) in an interrupt mode, and “shopping” is set as a start condition for excursion support. "When it arrives at the center” is registered, "When the excursion is interrupted” is registered as a shopping support start condition, and "After shopping” is registered as a resumption condition of the excursion support.

- the start condition of the second service is registered in association with the interruption event of the first service, and the restart condition of the first service is set. What is necessary is just to register in association with the end event of the second service.

- the event queue information 84 in FIG. 9C is for linking shopping support (or excursion support) in a parallel manner with health monitoring.

- a start condition for shopping support (or excursion support) “arrival at shopping center” Is registered, and “when shopping (or excursion) starts” is registered as a condition for starting health monitoring.

- the start condition of the second service may be registered in association with the start event of the first service.

- the event queue information 84 of FIG. 9 (D) includes shopping support (first service) and excursion support (second service) linked in a sequential manner and further excursion support (third service) in a parallel manner.

- shopping support first service

- excursion support second service

- third service further excursion support

- “When shopping begins” is registered as a start condition.

- the start condition of the second service is associated with the end event of the first service. It is only necessary to register and register the start condition of the third service in association with the start event of the first service.

- the event queue information 84 of FIG. 9 (E) is a parallel mode in which the shopping support (second service) and the excursion support (first service) are linked in an interrupt mode and the excursion support (third service) is further parallelized. "When you arrive at the shopping center” is registered as the start condition for excursion support, and "When excursion is interrupted” is registered as the start condition for shopping support, and as the resumption condition for excursion support In addition to registering “when shopping is completed”, “when excursion begins” is registered as a condition for starting health monitoring.

- the start condition of the second service is associated with the interruption event of the first service. And registering the restart condition of the first service in association with the end event of the second service, and registering the start condition of the third service in association with the start event of the first service. That's fine.

- linkage information 88 in the non-transition data area 86, linkage information 88, combination & detailed information 90, user attribute information 92, robot information 94, map information 96 and UI image data 98 are stored.

- the cooperation information 88 is information indicating what kind of cooperation is possible between a plurality of applications, and is controlled by the service cooperation program 74 based on the cooperation information described in each application (see FIG. 5).

- the linkage information described in the three apps shown in FIG. 5, that is, ““ Shopping support app can be linked with the tour support app ”,“ Travel support app can be linked with the shopping support app ”and“ Health watch app is “Can be linked in parallel with each application” ”is written in the non-transition data area 86 as linkage information 88.

- the combination & detail information 90 includes a combination (for example, “shopping support & excursion support”) arbitrarily selected from a plurality of applications that can be linked (here, the three applications shown in FIG. 5), and details of the combination (desired to buy).

- a combination for example, “shopping support & excursion support”

- Information indicating an article name, “determined while traveling”, and the like, and is controlled by the service cooperation program 74 based on user selection (input) via a UI (described later) in FIGS.

- the user attribute information 92 is information indicating user attributes. For example, as shown in FIG. 7, the user (mobile terminal) ID (a, b,%) And the attributes (walking disabled, elderly,. Registered in association.

- the robot information 94 is information indicating the attributes, functions, and movement ranges of various robots included in the robot service cooperation system 10 shown in FIG. 1, and for example, as shown in FIG. 8, the robot ID (R1, R2, R3, R4). , 7), attributes (wheelchair, humanoid, virtual, invisible, 7), functions ("wheelchair, dialogue”, “guidance, luggage holding, dialogue", “health watch, dialogue”, “person detection”, %) and The movement ranges (“within shopping center”, “within shopping center”, “within the communicable range of portable terminal”, “fixed at a predetermined position of shopping center”,%) Are registered in association with each other.

- the map information 96 includes wide-area map information that covers the user's action range (a range that includes at least the home and the shopping center) and detailed map information related to the movement range (that is, the shopping center) of the wheelchair robot 16a and the humanoid robot 16b. .

- the detailed map information in addition to the arrangement of stores and sales floors in the shopping center, steps and obstacles that prevent the robot from moving are described.

- the UI image data 98 is image data for displaying a UI image as shown in FIGS. 14 to 16 on the touch screen of the mobile terminal 14.

- the UI image in FIG. 14 is for presenting a plurality of services (in this case, shopping support, excursion support, and health monitoring) that can be provided in cooperation with the user and selecting a necessary combination. It includes three icons I1-I3 indicating support and health watch respectively, and a message M1 prompting the user to select the required combination (by touch operation).

- FIGS. 15A to 15D There are four combinations shown in FIGS. 15A to 15D that can be linked to the three services of shopping support, excursion support, and health monitoring.

- the display mode of the icons I1-I3 changes so that the selected / non-selected state of each service can be seen.

- the icon of the service in the selected state remains normal display, and the icon of the service in the non-selected state is changed to a low luminance (translucent) display.

- the UI image of FIG. 14 is updated as shown in FIG.

- the UI image in FIG. 16 is for allowing the user to continue to input detailed information regarding the selected combination, that is, the combination of shopping support and excursion support, and icons I1-I3 similar to those in FIG. , A message M1 indicating that a combination of shopping support and excursion support has been selected, a message M2 that prompts the user to input the name of the item to be purchased, and an input field C4. And an icon I4 indicating “undecided”.

- the combination & detailed information 90 is written in the non-transition data area 86.

- the CPU 20 can create the event queue information 84 as shown in FIGS. 9A to 9E.

- FIG. 10 shows a functional configuration of the robot service cooperation platform (PF) realized by the hardware of FIG. 1 to FIG. 4 (particularly the CPU 20 and the memory 26 of the server 12) and the software of FIG. 5 to FIG. .

- this PF includes application layer L1 to which application A1 (shopping support application), application A2 (travel support application), application A3 (health watching application),... And component C1 (wheelchair robot 16a).

- application layer L2 to which the component C2 (conveying function), the component C2 (guidance function of the humanoid robot 16b), the component C3 (detection function of the environmental sensor 16c),... Belong, the state management function F1, the position detection function F2, A service cooperation function F3, a database DB, an event queue IC, and a user interface UI are provided.

- the user interface UI may belong to the component layer L2 as a UI component between the mobile terminal 14 and the user.

- a new application may be added to the application layer L1, and a new component may be added to the component layer L2.

- the state management function F1 is a function for managing the state of each robot and the state of each service, and controls the robot state information 80 and the service state information 82.

- the position detection function F2 is a function for detecting the current position of the user, and controls the current position information 78.

- the database DB stores various information required by the service cooperation function F3, here, cooperation information 88, user attribute information 92, robot information 94, and map information 96.

- the event queue IC is for registering a service using a predetermined event as a start condition (restart condition), and corresponds to the event queue information 84.

- the user interface UI is for presenting a combination of services that can be linked to the user and selecting a necessary combination, and controls the combination & detailed information 90.

- the service cooperation function F3 realizes the service cooperation as described above by registering the service in the event queue IC using the state management function F1 and the position detection function F2 while referring to the database DB.

- step S1 the current position of the user (mobile terminal 14) connected to network 100 is detected by position detection function F1 (GPS circuit 46).

- step S3 a plurality of services that can be cooperatively provided to the user, the current position of the detected user (current position information 78), and information in the database DB (cooperation information 88, user attribute information 92, robot information 94, and map information) 96).

- the user attribute information 92 indicates that the user is a person with a walking disability.

- the current position information 78 indicates that the current position of the user is in or near the shopping center. Therefore, referring to the robot information 94, since the wheelchair robot 16a and the humanoid robot 16b are arranged in the shopping center, it is possible to provide the user with a tour support application that uses the wheelchair robot 16a. Further, it can be seen that a shopping support application using the humanoid robot 16b can be provided.

- step S3 three services of excursion support, shopping support, and health watching are specified as services that can be provided in cooperation with the user “a”.

- step S3 two services of shopping support and health watching are provided. Identified.

- step S5 it is determined in step S5 whether a plurality of services have been specified. If NO, if NO, the process proceeds to step S33 and other processing (for example, single service processing or error processing) is performed. This robot service cooperation process is terminated.

- step S5 the process proceeds to a step S7 to perform UI control using the UI image data 98, and carry a plurality of icons (I1, I2,9) Corresponding to the plurality of services specified in the step S3. Display on the touch screen of the terminal 14 to allow the user to select any combination.

- step S3 when three services of excursion support, shopping support, and health monitoring are specified in step S3, the touch screen displays a UI image as shown in FIG. 14 (that is, three icons I1-I3 indicating the three services, and necessary services).

- a message M1) prompting selection of a combination is displayed, and the user selects any combination of FIGS. 15A to 15D. Accordingly, the icon in the selected state remains normally displayed and the icon in the non-selected state is displayed with low luminance (translucent).

- the icon in the non-selected state is normally displayed and the icon in the selected state is highlighted (outline enhancement, high brightness, etc.).

- the brightness of the non-selected icon may be reduced and the selected icon may be emphasized.

- step S9 it is determined in step S9 whether any combination has been selected. If NO in this step, the process moves to step S33 to execute other processing (for example, error processing), and then the robot service cooperation processing. Exit. If “YES” in the step S9, the process proceeds to a step S11, and a plurality of applications corresponding to the selected combination are activated on the mobile terminal 14.

- step S13 further UI control is performed, and the user is caused to input detailed information regarding the selected combination.

- a UI image as shown in FIG. 16 that is, a message M2 indicating that the combination of shopping and excursion has been selected, and a message prompting input of the name of the item to be purchased are displayed on the touch screen.

- the combination & detailed information 90 is stored (registered in the database DB) in the non-transition data area 86.

- step S15 it is determined in step S15 whether or not the detailed information has been input (selected) based on the presence / absence of the combination & detailed information 90. If NO is determined in this step, the process proceeds to step S33 to perform other processing (for example, error processing). Is executed, the robot service cooperation process is terminated. If “YES” in the step S15, the process proceeds to a step S17.

- a cooperation mode of a plurality of services constituting the selected combination is determined based on cooperation information 88 and combination & detailed information 90. For example, when a combination of shopping and excursion is selected and an article name such as “book” is input, the cooperation mode of shopping and excursion is determined as “sequential”. When a combination of shopping and excursion is selected and “undecided” is further selected, the cooperation mode of shopping and excursion is determined as “interrupt”. The cooperation mode between shopping and / or excursion and health watching is always “parallel”.

- step S19 activation conditions for each service (further resume conditions in the case of an interrupt mode) are registered in the event queue IC according to the determined linkage mode. For example, when shopping and excursion are linked in order, as shown in FIG. 9A, “when you arrive at the shopping center” is registered in the event queue IC as a shopping support start condition, and further excursion support "After shopping” is registered as the start condition of. When shopping support and excursion support are linked in an interrupt mode, as shown in FIG.

- the event queue IC has “shopping support” (or excursion support) as a start condition for shopping support (or excursion support) as shown in FIG. “When you arrive at the center” is registered, and “When shopping (or excursion) starts” is registered as a condition for starting health monitoring.

- excursion support is linked in a sequential manner, and further, excursion support is linked in a parallel manner, as shown in FIG. “After” is registered, and “After shopping” is registered as a start condition for excursion support, and “When shopping starts” is registered as a start condition for health watching.

- step S21 the service status information 82 is referenced (using the status management function), and it is determined whether or not there is a service that satisfies the start condition (or the restart condition) among the registered services of the event queue IC. To do. If “NO” here, the same determination is repeated with a predetermined waiting time in between.

- step S21 If “YES” in the step S21, the process proceeds to a step S23 to allocate resources (robots or components) necessary for the service. In response to this, the robot state information 80 is updated. In step S25, the application corresponding to the service is notified of resource allocation, and the process proceeds to step S27.

- step S27 it is determined based on the service status information 82 whether or not there is a completed (or interrupted) service. If “NO” here, the process returns to the step S21 to repeat the same processing as described above. If “YES” in the step S27, the process proceeds to a step S29 to release the resources allocated to the completed (or interrupted) service. In response to this, the robot state information 80 is updated.

- step S31 it is determined whether or not all event queue IC registration services have been completed. If NO in this step, the flow returns to step S21 to repeat the same processing as described above. If “YES” in the step S31, the process returns to the step S1 to repeat the same process as described above.

- FIG. 13 shows processing of each application (A1, A2,%) Realized by the CPU operation of the server 12. This process may be executed by another server (not shown) on the network 100. Referring to FIG. 13, in step S ⁇ b> 51, it is determined whether or not there is a resource allocation notification from the PF. If “NO” here, the same determination is repeated with a predetermined waiting time interposed therebetween. If YES in step S51, the service is started using the allocated resource. Then, the process proceeds to step S55.

- step S55 it is determined whether or not the service is completed (or interrupted). If “NO” here, the process returns to the step S53 to repeat the same determination.

- step S55 If “YES” in the step S55, the process proceeds to a step S57 to notify the PF of the completion (or interruption) of the service. Accordingly, the service status information 82 is updated. Then, it returns to step S51 and repeats the same process as the above.

- the robot service cooperation system 10 of this embodiment includes a server 12 connected to the network 100, a mobile terminal 14 connected to the network 100, and various robots 16a- connected to the network 100.

- the CPUs 20 cooperate with each other as follows.

- each application A1-A3 describes linkage information indicating which other apps can be linked (FIG. 5), and the CPU 20 provides a plurality of services that can be provided in cooperation with the user of the mobile terminal 14. Identify at least based on the cooperation information described in each application A1-A3 (S3), and present the identified services to the user of the mobile terminal 14 via the touch screen (UI as shown in FIGS. 14-16)

- An arbitrary combination is selected (S7, S13), and a plurality of services constituting the selected combination are associated with at least a start condition of each service with at least an end event of another service, and an event queue IC (event By registering them in a queue (also called a queue), they are linked to each other (S17, S19: FIGS. 9A to 9E). Therefore, a plurality of services required by the user can be provided in cooperation in at least a sequential manner.

- the CPU 20 causes the user to further input information (detailed information) related to the selected combination (S13: FIG. 16), and provides the first service (shopping support) and the second service (travel support).

- information that can be sequentially determined for example, the name of an item to be purchased

- the start condition of the second service is set based on the information to end the first service (shopping support).

- Registration is performed in association with the event (FIG. 9A).

- the two services required by the user can be provided in a sequentially coordinated manner.

- i services can be linked in a sequential manner (where i is an integer of 2 or more) ).

- the CPU 20 can determine whether the second service (shopping support) should be interrupted during execution of the first service (travel support) (for example, “what to buy is undecided” or “travel”). ”Determine what you want to buy”) is entered, and the start condition of the second service (shopping support) is registered in association with the interruption event of the first service (walking support) based on the information, Then, the resumption condition of the first service (travel support) is registered in association with the end event of the second service (shopping support) (FIG. 9B).

- the second service switching support

- the CPU 20 can determine whether the second service (shopping support) should be interrupted during execution of the first service (travel support) (for example, “what to buy is undecided” or “travel”). ”Determine what you want to buy”) is entered, and the start condition of the second service (shopping support) is registered in association with the interruption event of the first service (walking support) based on the information, Then, the resumption condition of the first

- the cooperation information of a specific application (health monitoring application A3) describes that any other application (shopping support application A1, excursion support application A2) can be linked in a parallel manner, and the CPU 20 If a service (health watch) provided by a specific application is included in the multiple services that make up the selected combination, the start conditions for that service are set for other services (shopping, excursions). Registration is performed in association with the start event (FIGS. 9D and 9E). As a result, two services can be provided in cooperation in a parallel manner while the two services are linked in a sequential manner or a parallel manner.

- the service end / interruption event is issued from, for example, an application that provides the service (or a robot or component used thereby). Alternatively, it may be issued from the mobile terminal 14 in response to a user operation.

- the non-transition data area 86 of the memory 26 stores user attribute information 92 (FIG. 7) indicating user attributes and robot information 94 (FIG. 8) indicating at least functions of various robots (stored in the database DB).

- the CPU 20 specifies a plurality of services that can be cooperatively provided to the user (step S3), in addition to the cooperation information described in each of the applications A1-A3, the user attribute information 92 and the robot information 94 is also referred to. Each information is preferably registered so that it can be updated. As a result, it is possible to provide a service using a robot having a function corresponding to the user's attribute.

- the robot information 94 further indicates the movement range of the robot.

- the CPU 20 detects the current position of the user by the GPS circuit 40, and specifies the service in consideration of the comparison result between the detection result and the movement range of the robot. This makes it possible to provide services using robots in various places.

- the CPU 20 displays a plurality of corresponding icons (for example, three icons I1-I3) on the touch screen (display surface of the display 32).

- a plurality of corresponding icons for example, three icons I1-I3

- the touch screen display surface of the display 32.

- an arbitrary combination is selected (FIGS. 14 and 15) and an arbitrary combination is selected (FIGS. 14 and 15), and among the plurality of icons (I1-I3) displayed on the touch screen, a plurality of the selected combinations are configured.

- the display mode is made different between the first icon (I1, I2) and the remaining second icon (I3) (FIG. 16). This allows the user to recognize whether each service is in a selected state or a non-selected state. As a result, the user can know the existence of a service that has not been selected so far, and can also switch the selection / non-selection state of each service.

- the process of presenting a plurality of services to the user and selecting an arbitrary combination is performed via the touch screen of the mobile terminal 14 (using a UI as shown in FIGS. 14 to 16).

- it may be performed using the voice output function and voice recognition function of the mobile terminal 10 and various robots (16a, 16b).

- the CPU 50 of the humanoid robot 16b presents a plurality of services that can be provided in cooperation with the user, outputs a voice requesting selection of a required combination from the speaker 38, and captures the voice of the user corresponding thereto by the microphone 36. There is a way to recognize.

- the current position detection (step S1) of the user (mobile terminal 14) is performed using GPS, but instead of or in addition to this, the position detection function of the network 100 is provided. May be used.

- Robot service cooperation system 12 ... Server 14 ... Mobile terminal (virtual robot) 16a ... wheelchair robot 16b ... humanoid robot 16c ... environmental sensor (invisible robot) 20, 30, 50 ... CPU 22, 32 ... Display 26, 42, 60 ... Memory 34 ... Touch panel 100 ... Network

Landscapes

- Engineering & Computer Science (AREA)

- Business, Economics & Management (AREA)

- Human Resources & Organizations (AREA)

- Strategic Management (AREA)

- General Business, Economics & Management (AREA)

- Health & Medical Sciences (AREA)

- Economics (AREA)

- Marketing (AREA)

- Theoretical Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Physics & Mathematics (AREA)

- Entrepreneurship & Innovation (AREA)

- Robotics (AREA)

- Mechanical Engineering (AREA)

- Tourism & Hospitality (AREA)

- Finance (AREA)

- Accounting & Taxation (AREA)

- Primary Health Care (AREA)

- General Health & Medical Sciences (AREA)

- Biomedical Technology (AREA)

- Quality & Reliability (AREA)

- Life Sciences & Earth Sciences (AREA)

- Marine Sciences & Fisheries (AREA)

- Animal Husbandry (AREA)

- Agronomy & Crop Science (AREA)

- Development Economics (AREA)

- Data Mining & Analysis (AREA)

- Mining & Mineral Resources (AREA)

- Operations Research (AREA)

- Epidemiology (AREA)

- Medical Informatics (AREA)

- Public Health (AREA)

- Computer Networks & Wireless Communication (AREA)

- Human Computer Interaction (AREA)

- Manipulator (AREA)

- Child & Adolescent Psychology (AREA)

Abstract

ロボットサービス連携システム(10)は、ネットワーク(100)に各々接続されたサーバ(12),携帯端末(14)および各種のロボット(16a-16c)を含む。ネットワーク上のアプリ(A1,A2,A3,…)には、他のどのアプリと連携可能かを示す連携情報が記述されている。サーバのCPU(20)は、携帯端末のユーザに対し連携提供可能な複数のサービスを連携情報に少なくとも基づいて特定し(S3)、特定した複数のサービスをユーザに提示して任意の組み合わせを選択させ(S7,S13)、そして、選択された組み合わせを構成する複数のサービスを、各サービスの少なくとも開始条件を他のサービスの少なくとも終了イベントと関連付けてイベントキューに登録することによって、互いに連携させる(S17,S19)。

Description

この発明は、ロボットサービ連携システム、プラットフォームおよび方法に関し、特にたとえば、ネットワークに接続されたロボットを利用して様々な場所でユーザにサービスを提供する、ロボットサービス連携システム、プラットフォームおよび方法に関する。

この種の従来のシステムとしては、たとえば特許文献1に開示されたものが知られている。この背景技術では、空間内に配置された1または2以上のロボットと、ロボットを制御するためのロボットルータと、空間内のロボットの状態管理を行うと共に環境情報を収集管理する空間マネージャとが通信ネットワークで接続されており、利用者がロボットルータに利用者属性を登録すると、システムは、ロボットルータが存在する空間で、ロボットルータに保持された利用者属性と環境情報を基に、ロボットを制御してサービスを提供する。こうして、利用者属性と環境情報を連携させることで、利用者は、最新環境で最適なサービスを受けられる。

特開2005-111637号公報

しかし、背景技術で利用者が受けられるのは、単一のサービスに過ぎなかった。

それゆえに、この発明の主たる目的は、新規な、ロボットサービス連携システム、プラットフォームおよび方法を提供することである。

この発明の他の目的は、ユーザが必要とする複数のサービスを連携させて提供できるようにする、ロボットサービス連携システム、プラットフォームおよび方法を提供することである。

この発明は、上記の課題を解決するために、以下の構成を採用した。なお、括弧内の参照符号および補足説明等は、本発明の理解を助けるために後述する実施の形態との対応関係を示したものであって、本発明を何ら限定するものではない。

第1の発明は、ネットワーク(100)に接続されたサーバ(12)と、ネットワークに接続された携帯端末(14)と、ネットワークに接続されたロボット(16a-16c)とを含み、ネットワーク上の複数のアプリケーションソフトウェア(A1-A3)が携帯端末(14)のユーザに対しロボット(16a-16c)を利用してそれぞれ提供する複数のサービスを互いに連携させる、ロボットサービス連携システム(10)であって、各アプリケーションソフトウェアには、他のどのアプリケーションソフトウェアと連携可能かを示す連携情報が記述されており(図5)、サーバは、携帯端末のユーザに対し連携提供可能な複数のサービスを各サービスアプリケーションソフトウェアに記述された連携情報に少なくとも基づいて特定する特定手段(S3)、特定手段で特定した複数のサービスを携帯端末のユーザに提示して任意の組み合わせを選択させる提示選択手段(S7,S13:図14-図16)、および提示選択手段で選択された組み合わせを構成する複数のサービスを、各サービスの少なくとも開始条件を他のサービスの少なくとも終了イベントと関連付けてイベント待ち行列に登録することによって、互いに連携させる連携手段(S17,S19:図9(A)-図9(E))を備える。

なお、提示選択手段は、ある実施例では携帯端末(14)のタッチ画面を介して提示選択を行うが、他の実施例では、携帯端末やロボットの音声出力機能および音声認識機能を利用してもよい。

第1の発明によれば、ユーザが必要とする複数のサービスを少なくとも順次態様で連携させて提供できるようになる。

第2の発明は、第1の発明に従属するロボットサービス連携システムであって、提示選択手段は、携帯端末のユーザに選択した組み合わせに関連する情報をさらに入力させる入力手段(S13:図16)を含み、連携手段は、第1のサービスおよび第2のサービスを順次実行すべきことを判断可能な情報が入力手段で入力された場合に、当該情報に基づき第2のサービスの開始条件を第1のサービスの終了イベントと関連付けて登録する(図9(A))。

なお、サービスの終了/中断イベントは、たとえば、当該サービスを提供するアプリケーションソフトウェアから発行される。または、ユーザの操作に応じて携帯端末から発行されてもよい。

第2の発明よれば、ユーザが必要とする2つのサービスを順次態様で連携させて提供できる。

第3の発明は、第2の発明に従属するロボットサービス連携システムであって、連携手段は、第1のサービスの実行中に第2のサービスを割込実行すべきことを判断可能な情報が入力手段で入力された場合には、当該情報に基づき第2のサービス開始条件を第1のサービスの中断イベントと関連付けて登録し、そして第1のサービス再開条件を第2のサービスの終了イベントと関連付けて登録する(図9(B))。

第3の発明によれば、ユーザが必要とする2つのサービスを、順次態様および並列態様のうちユーザが所望する方の態様で連携させて提供できる。

第4の発明は、第2の発明に従属するロボットサービス連携システムであって、特定のアプリケーションソフトウェア(A3)の連携情報には、他のどのアプリケーションソフトウェア(A1,A2)とも並列態様で連携可能であることが記述されており、連携手段は、選択手段で選択された組み合わせを構成する複数のサービスの中に、特定のアプリケーションソフトウェアによって提供されるサービスが含まれている場合には、当該サービスの開始条件を他のサービスの開始イベントと関連付けて登録する(図9(D),図9(E))。

第4の発明によれば、2つのサービスを順次態様または並列態様で連携させながら、さらに他のサービスを並列態様で連携させて提供できる。

第5の発明は、第1の発明に従属するロボットサービス連携システムであって、携帯端末のユーザの属性を示すユーザ属性情報(92:図7)と、ロボットの機能を少なくとも示すロボット情報(94:図8)とが登録されたデータベース(DB)をさらに備え、特定手段は、データベースの各情報も参照して特定を行う。

なお、各情報は、好ましくは更新可能に登録される。

第5の発明によれば、ユーザの属性に応じた機能を持つロボットを利用したサービス提供が可能になる。

第6の発明は、第5の発明に従属するロボットサービス連携システムであって、ロボット情報はロボットの移動範囲をさらに示し、携帯端末のユーザの現在位置を検出する検出手段(46)をさらに備え、特定手段は、位置検出手段の検出結果とロボットの移動範囲との比較結果も考慮して特定を行う。

第6の発明によれば、様々な場所でロボットを利用したサービス提供が可能になる。

第7の発明は、第1の発明に従属するロボットサービス連携システムであって、提示選択手段は、特定手段で特定した複数のサービスに対応する複数のアイコン(I1-I3)を携帯端末のタッチ画面(32,34)に表示して任意の組み合わせを選択させ(図14,図15)、タッチ画面に表示した複数のアイコンのうち、選択された組み合わせを構成する複数の第1アイコン(I1,I2)と残りの第2アイコン(I3)との間で表示態様を互いに異ならせる(図16)。

第7の発明によれば、ユーザに各サービスが選択状態にあるか非選択状態にあるかを認識させることができる。その結果、ユーザは、これまでに選択したことがないサービスの存在を知ることができるし、各サービスの選択・非選択状態を相互に切り換えることもできる。

第8の発明は、ネットワーク(100)に接続されたサーバ(12)のコンピュータ(20)によって実現され、ネットワーク上の複数のアプリケーションソフトウェア(A1-A3)がネットワークに接続された携帯端末(14)のユーザに対しネットワークに接続されたロボット(16a-16c)を利用してそれぞれ提供する複数のサービスを互いに連携させる、ロボットサービス連携プラットフォーム(PF)であって、各アプリケーションソフトウェアには、他のどのアプリケーションソフトウェアと連携可能かを示す連携情報が記述されており(図5)、携帯端末のユーザに対し連携提供可能な複数のサービスを各サービスアプリケーションソフトウェアに記述された連携情報に少なくとも基づいて特定する特定手段(S3)、特定手段で特定した複数のサービスを携帯端末のユーザに提示して任意の組み合わせを選択させる提示選択手段(S7,S13:図14-図16)、および提示選択手段で選択された組み合わせを構成する複数のサービスを、各サービスの少なくとも開始条件を他のサービスの少なくとも終了イベントと関連付けてイベント待ち行列に登録することによって、互いに連携させる連携手段(S17,S19:図9(A)-図9(E))を備える。

第9の発明は、ネットワークに接続されたサーバのコンピュータによって行われ、ネットワーク上の複数のアプリケーションソフトウェアがネットワークに接続された携帯端末のユーザに対しネットワークに接続されたロボットを利用してそれぞれ提供する複数のサービスを互いに連携させる、ロボットサービス連携方法であって、各アプリケーションソフトウェアには、他のどのアプリケーションソフトウェアと連携可能かを示す連携情報が記述されており、携帯端末のユーザに対し連携提供可能な複数のサービスを各サービスアプリケーションソフトウェアに記述された連携情報に少なくとも基づいて特定する特定ステップ、特定ステップで特定した複数のサービスを携帯端末のユーザに提示して任意の組み合わせを選択させる提示選択ステップ、および、提示選択ステップで選択された組み合わせを構成する複数のサービスを、各サービスの少なくとも開始条件を他のサービスの少なくとも終了イベントと関連付けてイベント待ち行列に登録することによって、互いに連携させる連携ステップを含む。

第8および第9の各発明でも、第1の発明と同様に、ユーザが必要とする複数のサービスを少なくとも順次態様で連携させて提供できるようになる。

この発明によれば、ユーザが必要とする複数のサービスを連携させて提供できるようにする、ロボットサービス連携システムおよびプラットフォームが実現される。

この発明の上述の目的,その他の目的,特徴および利点は、図面を参照して行う以下の実施例の詳細な説明から一層明らかとなろう。

図1には、この発明の一実施例であるロボットサービス連携システムの構成が示される。図1を参照して、ロボットサービス連携システム10はサーバ12を含み、サーバ12はネットワーク100を介して携帯端末14,車椅子ロボット16a,人型ロボット16bおよび環境センサ16cの各々と接続される。携帯端末14はユーザによって携帯され、車椅子ロボット16a,人型ロボット16bおよび環境センサ16cはユーザが買物をするショッピングセンタに配置される。

携帯端末14は、GPS衛星102からの信号に基づき自己(つまりユーザ)の現在位置を検出したり、ユーザの脈拍や運動量を検出したり、仮想空間内のバーチャルロボット(図示せず)を通じてユーザと対話したりすることができる。

人型ロボット16bは、頭部,腕および車輪などを有し、ユーザとジェスチャを交えて対話しながらショッピングセンタ内を自律的に移動できる。車椅子ロボット16aは、椅子および車輪を有し、ユーザを乗せた状態で、ユーザと対話しながらショッピングセンタ内を自律的に移動できる。

環境センサ16cは、レーザレンジファインダ,赤外線センサ,イメージセンサなどで構成され、ショッピングセンタ内の所定位置(たとえば入口,通路沿いなど)に固定されたインビジブルロボットとして、ユーザに意識されることなくユーザを検出(顔を認識して位置を特定)できる。

図2には、サーバ12の構成例が示される。図2を参照して、サーバ12は、CPU20,ディスプレイ22,キーボード24,メモリ26および通信回路28を備える。キーボード24は、オペレータによって操作され、CPU20に命令を入力して情報処理を実行させる。なお、オペレータは、各ロボット(16a,16b)を遠隔操作することもできる。ディスプレイ22は、CPU20による情報処理の結果を表示する。メモリ26は、CPU20に情報処理を行わせるためのプログラムやデータを記憶する。通信回路28は、CPU20をネットワーク100に通信可能に接続する。

図3には、携帯端末14の構成例が示される。図3を参照して、携帯端末14は、CPU30,ディスプレイ32,タッチパネル34,マイク36,スピーカ38,センサ40,メモリ42,無線通信回路44およびGPS回路46を備える。ディスプレイ32およびタッチパネル34でタッチ画面が構成され、CPU30は、タッチ画面を通じてユーザに情報を提示したり入力(選択)させたりする。また、CPU30は、ディスプレイ32にバーチャルロボットを表示して、マイク36およびスピーカ38を通じユーザと対話する。センサ40は加速度センサやジャイロスコープなどで構成され、CPU30は、センサ40の出力に基づきユーザの脈拍や運動量を検出する。

メモリ42は、CPU30に上記のような処理を行わせるためのプログラムやデータを記憶する。無線通信回路44は、CPU30をネットワーク100に無線通信可能に接続する。GPS回路46は、複数のGPS衛星102からの信号を受信して、携帯端末14(ユーザ)の現在位置を受信信号に基づき検出し、検出結果を示す現在位置情報を出力する。

図4には、車椅子ロボット16a/人型ロボット16bの構成例が示される。図4を参照して、車椅子ロボット16a/人型ロボット16bは、CPU50,マイク52,スピーカ54,センサ56,モータ58,メモリ60および無線通信回路62を備える。CPU50は、マイク52およびスピーカ54を通じてユーザと対話する。センサ56はイメージセンサや赤外線センサなどで構成され、CPU50は、センサ56の出力に基づき、モータ58を制御したり、ユーザを検出したりする。モータ58は、CPU50の制御下で車輪(人型ロボット16bの場合はさらに腕/頭部)を駆動する。

メモリ60は、CPU50に上記のような処理を行わせるためのプログラムやデータを記憶する。無線通信回路62は、CPU50をネットワーク100に無線通信可能に接続する。

図5には、以上のように構成されたロボットサービス連携システム10上で各種のサービスを提供するアプリケーションソフトウェア(以下“アプリ”)A1,A2,A3の例が示される。図5を参照して、各アプリA1,A2,A3のプログラム(買物支援プログラム,回遊支援プログラム,健康見守りプログラム)には、連携情報(「回遊支援アプリと連携可能」,「買物支援アプリと連携可能」,「各アプリと並列態様で連携可能」)が付加されている。

すなわち、アプリA1は、たとえば高齢者などのユーザに人型ロボット16bを利用した買い物支援サービス(目的の店舗に案内したり、店舗で商品説明をしたり、購入した品物を持ち運んだりといったサービス)を提供する買物支援アプリであって、回遊支援アプリ(A2)と連携可能である。アプリA2は、たとえば歩行障がい者などのユーザに車椅子ロボット16aを利用した回遊支援サービス(ショッピングセンタ内を各店舗の商品説明も行いながら車椅子で巡回するサービス)を提供する回遊支援アプリであって、買物支援アプリ(A1)と連携可能である。アプリA3は、たとえば高齢者などのユーザにバーチャルロボット(携帯端末14)を利用した健康見守りサービス(心拍数,運動量などを検出して「少し休憩しましょう」といった健康に関するアドバイスを行うサービス)を提供する健康見守りアプリであり、買物支援および回遊の各アプリ(A1,A2)と並列態様で連携可能である。

なお、この実施例で「買物」とは、既に買いたいものが決まっていて、その売り場に直行するような購買行動をいい、「回遊」とは、未だ買いたいものが決まっておらず、ショッピングセンタ内を巡回しながら買いたいものを見つけるような購買行動をいう。

ロボットサービス連携システム10では、主としてサーバ12のCPU20が、メモリ26に記憶された図6-図9に示すようなプログラムおよびデータに基づいて、図10に示すような機能を持つロボットサービス連携プラットフォーム(適宜“PF”のように略記)を実現して、図11-図13のフローに従う処理を実行することにより、複数のアプリがそれぞれ提供する複数のサービス(たとえば図5に示した3つのアプリが提供する買物支援,回遊支援および健康見守りのうち任意の2つまたは3つ全て)を、ユーザに対し連携させて提供することができる。

図6には、メモリ26の内容が示される。図6を参照して、メモリ26はプログラムエリア70,遷移データエリア76および非遷移データエリア86を含み、プログラムエリア70にはアプリケーションプログラム72およびサービス連携プログラム74が記憶される。

アプリケーションプログラム72は、ロボットサービス連携システム10のハードウェアを制御して各種サービスをユーザに提供するためのプログラムであり、ここでは、図5に示した3つのアプリA1,A2,A3にそれぞれ対応する買物支援プログラム72a,回遊支援プログラム72bおよび健康見守りプログラム72cを含む。サービス連携プログラム74は、アプリケーションプログラム72に基づく複数のサービス(ここでは買物支援,回遊支援および健康見守りの3サービスのうち2つまたは3つ)を互いに連携させるためのプログラムである。

遷移データエリア76には、現在位置情報78,ロボット状態情報80,サービス状態情報82,およびイベントキュー情報84が記憶される。現在位置情報78は、携帯端末14つまりユーザの現在位置を示す情報であり、主として携帯端末14自身のGPS回路46から出力される現在位置情報を用いる(環境センサ16cから得られる現在位置情報で代用してもよいし、両者を併用してもよい)。

ロボット状態情報80は、図1に示した各種のロボット(14,16a-16c)の状態(たとえば利用可能な状態か、いずれかのサービスに利用されている状態か等)を示す情報であり、当該ロボット自身から提供される情報を用いる。

サービス状態情報82は、アプリが提供する複数のサービス(ここでは図5の3つのアプリが提供する買物支援,回遊支援および健康見守り)の状態(開始待ち状態か、実行中か、中断状態か、完了状態かなど)を示す情報であり、当該アプリ自身から提供されるイベント情報(当該サービスの開始イベント,中断イベント,再開イベント,終了イベントなど)に基づきサービス連携プログラム74によって制御される。

イベントキュー情報84は、アプリが提供する複数のサービス(ここでは図5の3つのアプリが提供する買物支援,回遊支援および健康見守り)を順次または割込態様で、もしくは順次または割込と並列とを併用した態様で連携させるために、サービス連携プログラム74によって制御される情報であり、たとえば図9に示すような内容を有する。

図9(A)のイベントキュー情報84は、買物支援(第1のサービス)および回遊支援(第2のサービス)を順次態様で連携させるためのものであり、買物支援の開始条件として「ショッピングセンタに到着したら」が登録され、さらに回遊支援の開始条件として「買物が済んだら」が登録されている。このように、第1および第2のサービスを順次態様で連携させる場合、第2のサービスの開始条件を第1のサービスの終了イベントと関連付けて登録すればよい。一般には、第iのサービスの開始条件を第(i-1)のサービスの終了イベントと関連付けて登録すれば、i個のサービスを順次態様で連携させることができる(ただしiは2以上の整数)。

図9(B)のイベントキュー情報84は、買物支援(第2のサービス)および回遊支援(第1のサービス)を割込態様で連携させるためのものであり、回遊支援の開始条件として「ショッピングセンタに到着したら」が登録され、さらに買物支援の開始条件として「回遊が中断したら」が登録され、そして回遊支援の再開条件として「買物が済んだら」が登録されている。このように、第1および第2のサービスを割込態様で連携させる場合、第2のサービスの開始条件を第1のサービスの中断イベントと関連付けて登録し、かつ第1のサービスの再開条件を第2のサービスの終了イベントと関連付けて登録すればよい。

図9(C)のイベントキュー情報84は、買物支援(または回遊支援)を健康見守りと並列態様で連携させるためのものであり、買物支援(または回遊支援)の開始条件として「ショッピングセンタに到着したら」が登録され、さらに健康見守りの開始条件として「買物(または回遊)が始まったら」が登録されている。このように、第1および第2のサービスを並列態様で連携させる場合、第2のサービスの開始条件を第1のサービスの開始イベントと関連付けて登録すればよい。

図9(D)のイベントキュー情報84は、買物支援(第1のサービス)および回遊支援(第2のサービス)を順次態様で連携させつつ、さらに回遊支援(第3のサービス)を並列態様で連携させるためのものであり、買物支援の開始条件として「ショッピングセンタに到着したら」が登録され、さらに回遊支援の開始条件として「買物が済んだら」が登録されるのに加えて、健康見守りの開始条件として「買物が始まったら」が登録されている。このように、第1および第2のサービスを順次態様で連携させつつ、さらに第3のサービスを並列態様で連携させる場合、第2のサービスの開始条件を第1のサービスの終了イベントと関連付けて登録し、かつ第3のサービスの開始条件を第1のサービスの開始イベントと関連付けて登録すればよい。

図9(E)のイベントキュー情報84は、買物支援(第2のサービス)および回遊支援(第1のサービス)を割込態様で連携させつつ、さらに回遊支援(第3のサービス)を並列態様で連携させるためのものであり、回遊支援の開始条件として「ショッピングセンタに到着したら」が登録され、さらに買物支援の開始条件として「回遊が中断したら」が登録され、そして回遊支援の再開条件として「買物が済んだら」が登録されるのに加えて、健康見守りの開始条件として「回遊が始まったら」が登録されている。このように、第1および第2のサービスを割込態様で連携させつつ、さらに第3のサービスを並列態様で連携させる場合、第2のサービスの開始条件を第1のサービスの中断イベントと関連付けて登録し、かつ第1のサービスの再開条件を第2のサービスの終了イベントと関連付けて登録するのに加えて、第3のサービスの開始条件を第1のサービスの開始イベントと関連付けて登録すればよい。

図6に戻って、非遷移データエリア86には、連携情報88,組合せ&詳細情報90,ユーザ属性情報92,ロボット情報94,地図情報96およびUI画像データ98が記憶される。

連携情報88は、複数のアプリ間でどのような連携が可能かを示す情報であり、各アプリに記述された連携情報(図5参照)に基づきサービス連携プログラム74により制御される。ここでは、図5に示す3つのアプリに記述された連携情報、つまり「“買物支援アプリは回遊支援アプリと連携可能”,“回遊支援アプリは買物支援アプリと連携可能”および“健康見守りアプリは各アプリと並列態様で連携可能”」が、連携情報88として非遷移データエリア86に書き込まれる。

組合せ&詳細情報90は、連携可能な複数のアプリ(ここでは図5に示す3つのアプリ)から任意に選択された組み合わせ(たとえば“買物支援&回遊支援”)と、その組み合わせの詳細(買いたい物品名,“回遊しながら決める”など)とを示す情報であり、図14-図16のUI(後述)を介したユーザの選択(入力)に基づきサービス連携プログラム74により制御される。

ユーザ属性情報92は、ユーザの属性を示す情報であり、たとえば図7に示すように、ユーザ(携帯端末)ID(a,b,…)および属性(歩行障がい者,高齢者,…)が互いに関連付けて登録されている。

ロボット情報94は、図1に示すロボットサービス連携システム10に含まれる各種ロボットの属性,機能および移動範囲を示す情報であり、たとえば図8に示すように、ロボットID(R1,R2,R3,R4,…),属性(車椅子,人型,バーチャル,インビジブル,…),機能(「車椅子,対話」,「案内,荷物持ち,対話」,「健康見守り,対話」,「人検出」,…)および移動範囲(「ショッピングセンタ内」,「ショッピングセンタ内」,「携帯端末の通信可能範囲内」,「ショッピングセンタの所定位置に固定」,…)が互いに関連付けて登録されている。

地図情報96は、ユーザの行動範囲(少なくとも自宅およびショッピングセンタを含む範囲)をカバーする広域地図情報と、車椅子ロボット16aおよび人型ロボット16bの移動範囲(つまりショッピングセンタ)に関する詳細地図情報とを含む。詳細地図情報には、ショッピングセンタ内での店舗や売り場の配置に加え、ロボットの移動を妨げる段差,障害物なども記述される。

UI画像データ98は、図14-図16に示されるようなUI画像を携帯端末14のタッチ画面に表示させるための画像データである。図14のUI画像は、ユーザに対して連携提供可能な複数のサービス(ここでは買物支援,回遊支援および健康見守り)を提示して必要な組み合わせを選択させるためのものであり、買物支援,回遊支援および健康見守りをそれぞれ示す3つのアイコンI1-I3と、必要な組み合わせを(タッチ操作により)選択するように促すメッセージM1とを含む。

買物支援,回遊支援および健康見守りの3サービスに関し、連携可能な組み合わせは、図15(A)-図15(D)に示す4通りある。このうち必要な組み合わせがタッチ操作により選択されると、各サービスの選択状態/非選択状態がわかるようにアイコンI1-I3の表示態様が変化する。ここでは、選択状態のサービスのアイコンは通常表示のまま、非選択状態のサービスのアイコンが低輝度(半透明)表示に変化している。

たとえば、図15(A)の組み合わせ、つまり買物支援および回遊支援が選択されると、図14のUIがUI画像は、図16のように更新される。図16のUI画像は、選択された組み合わせ、つまり買物支援および回遊支援の組み合わせに関する詳細情報を引き続きユーザに入力させるためのものであり、図15(A)のものと同様のアイコンI1-I3と、買物支援および回遊支援の組み合わせが選択された旨のメッセージM1と、買いたい品名の入力を促すメッセージM2および入力欄Cと、回遊しながら決めたい場合に“未定”を選択するよう促すメッセージM4および“未定”を示すアイコンI4とを含む。

図14-図16のようなUIを介して、ユーザが必要な組み合わせを選択し、さらにその組み合わせに関する詳細情報を入力することで、非遷移データエリア86に組合せ&詳細情報90が書き込まれ、これに基づいて、CPU20は、図9(A)-図9(E)に示すようなイベントキュー情報84を作成することができる。

図10には、図1-図4のハードウェア(特にサーバ12のCPU20およびメモリ26)および図5-図9のソフトウェアによって実現されるロボットサービス連携プラットフォーム(PF)の機能的な構成が示される。図10を参照して、このPFは、アプリA1(買物支援アプリ),アプリA2(回遊支援アプリ),アプリA3(健康見守りアプリ),…が属するアプリケーション層L1と、コンポーネントC1(車椅子ロボット16aの搬送機能),コンポーネントC2(人型ロボット16bの案内機能),コンポーネントC3(環境センサ16cの検出機能),…が属するコンポーネント層L2との間に形成され、状態管理機能F1,位置検出機能F2,サービス連携機能F3,データベースDB,イベントキューICおよびユーザ・インターフェースUIを備える。

ただし、ユーザ・インターフェースUIは、携帯端末14とユーザとの間のUIコンポーネントとして、コンポーネント層L2に属してよい。また、アプリケーション層L1には新たなアプリが、コンポーネント層L2にも新たなコンポーネントが、それぞれ追加されてよい。

状態管理機能F1は、各ロボットの状態および各サービスの状態を管理する機能であり、ロボット状態情報80およびサービス状態情報82を制御する。位置検出機能F2は、ユーザの現在位置を検出する機能であり、現在位置情報78を制御する。データベースDBは、サービス連携機能F3が必要とする各種の情報、ここでは連携情報88,ユーザ属性情報92,ロボット情報94および地図情報96を記憶する。

イベントキューICは、所定のイベントを開始条件(再開条件)としてサービスを登録するためのものであり、イベントキュー情報84に対応する。ユーザ・インターフェースUIは、ユーザに連携可能なサービスの組み合わせを提示して必要な組み合わせを選択させるためのものであり、組合せ&詳細情報90を制御する。そして、サービス連携機能F3は、データベースDBを参照しつつ状態管理機能F1および位置検出機能F2を利用してイベントキューICへのサービスの登録を行うことで、上述したようなサービス連携を実現する。

図11-図12には、サーバ12のCPU動作によって実現されるPFの処理(ロボットサービス連携処理)が示される。図11を参照して、ステップS1では、ネットワーク100に接続してきたユーザ(携帯端末14)の現在位置を位置検出機能F1(GPS回路46)で検出する。ステップS3では、ユーザに対し連携提供可能な複数のサービスを、検出したユーザの現在位置(現在位置情報78)と、データベースDBの情報(連携情報88,ユーザ属性情報92,ロボット情報94および地図情報96)とに基づき特定する。

たとえば、ショッピングセンタの近くに住むユーザ“a”が携帯端末14を操作してロボットサービス連携システム10にアクセスしてきた場合、ユーザ属性情報92から、ユーザは歩行障がい者であることがわかる。また、現在位置情報78と地図情報96との比較から、ユーザの現在位置がショッピングセンタ内またはその近くであることがわかる。そこで、ロボット情報94を参照すると、ショッピングセンタには車椅子ロボット16aおよび人型ロボット16bが配置されていることから、ユーザに対しては、まず、車椅子ロボット16aを利用する回遊支援アプリの提供が可能であり、さらに、人型ロボット16bを利用する買物支援アプリも提供可能であることがわかる。

次に、連携情報88を参照すると、回遊支援アプリと買物支援アプリとは互いに連携可能であり、さらに、健康見守りアプリが回遊支援アプリおよび買物支援アプリの各々と並列態様で連携可能であることがわかる。したがって、この場合、ステップS3では、ユーザ“a”に対して連携提供連可能なサービスとして、回遊支援,買物支援および健康見守りの3サービスが特定される。

なお、高齢者である(歩行障がい者ではない)ユーザ“b”がアクセスしてきた場合には、車椅子ロボット16aを利用する回遊支援は必要ないため、ステップS3では買物支援および健康見守りの2サービスが特定される。

次に、複数のサービスが特定されたかをステップS5で判別し、NOであれば、NOであれば、ステップS33に移って他の処理(たとえば単一サービス処理やエラー処理など)を実行した後、このロボットサービス連携処理を終了する。

ステップS5でYESであれば、ステップS7に進んで、UI画像データ98を用いてUI制御を行い、ステップS3で特定された複数のサービスに対応する複数のアイコン(I1,I2,…)を携帯端末14のタッチ画面に表示して任意の組み合わせをユーザに選択させる。

たとえば、ステップS3で回遊支援,買物支援および健康見守りの3サービスが特定された場合、タッチ画面には図14のようなUI画像(つまり3サービスをそれぞれ示す3つのアイコンI1-I3と、必要な組み合わせの選択を促すメッセージM1)が表示され、ユーザは、図15(A)-図15(D)のいずれかの組み合わせを選択する。応じて、選択状態のアイコンは通常表示のまま、非選択状態のアイコンが低輝度(半透明)表示となる。

なお、図15(A)-図15(D)の制御とは逆に、非選択状態のアイコンは通常表示のまま、選択状態のアイコンを強調表示(輪郭強調,高輝度化など)してもよいし、非選択状態のアイコンを低輝度化すると共に選択状態のアイコンを強調してもよい。

次に、いずれかの組み合わせが選択されたか否かをステップS9で判別し、ここでNOであれば、ステップS33に移って他の処理(たとえばエラー処理)を実行した後、このロボットサービス連携処理を終了する。ステップS9でYESであれば、ステップS11に進み、選択された組み合わせに対応する複数のアプリを携帯端末14において起動する。

そして、ステップS13で、さらなるUI制御を行い、選択された組み合わせに関する詳細情報をユーザに入力させる。たとえば、買物および回遊の組み合わせが選択された場合、タッチ画面には図16のようなUI画像(つまり、買物および回遊の組み合わせが選択された旨のメッセージM2と、買いたい品名の入力を促すメッセージM3および入力欄と、回遊しながら決めたい場合に“未定”を選択するよう促すメッセージM4および“未定”を示すアイコンI4)が表示され、ユーザは、買いたいものが決まっていれば品名を入力し、そうでなければ(回遊しながら決めたければ)“未定”を選択する。

こうして組み合わせが選択され、さらにその組み合わせ関する詳細情報が入力(選択)されると、非遷移データエリア86に組合せ&詳細情報90が記憶(データベースDBに登録)される。

次に、組合せ&詳細情報90の有無から、詳細情報が入力(選択)されたか否かをステップS15で判別し、ここでNOであれば、ステップS33に移って他の処理(たとえばエラー処理)を実行した後、このロボットサービス連携処理を終了する。ステップS15でYESであれば、ステップS17に進む。

図12を参照して、ステップS17では、選択された組み合わせを構成する複数のサービスの連携態様を連携情報88および組合せ&詳細情報90に基づき決定する。たとえば、買物および回遊の組み合わせが選択され、さらに“本”のような物品名が入力された場合、買物および回遊の連携態様は“順次”に決定される。買物および回遊の組み合わせが選択され、さらに“未定”が選択された場合、買物および回遊の連携態様は“割込”に決定される。なお、買物および/または回遊と健康見守りとの連携態様は、常に“並列”である。

その後、ステップS19に進み、決定した連携態様に応じて各サービスの起動条件(割込態様の場合はさらに再開条件)をイベントキューICに登録する。たとえば、買物および回遊を順次態様で連携させる場合、イベントキューICには、図9(A)に示されるように、買物支援の開始条件として「ショッピングセンタに到着したら」を登録し、さらに回遊支援の開始条件として「買物が済んだら」を登録する。買物支援および回遊支援を割込態様で連携させる場合には、図9(B)に示されるように、回遊支援の開始条件として「ショッピングセンタに到着したら」を登録し、さらに買物支援の開始条件として「回遊が中断したら」を登録し、そして回遊支援の再開条件として「買物が済んだら」を登録する。

また、買物支援(または回遊支援)を健康見守りと並列態様で連携させる場合、イベントキューICには、図9(C)に示されるように、買物支援(または回遊支援)の開始条件として「ショッピングセンタに到着したら」を登録し、さらに健康見守りの開始条件として「買物(または回遊)が始まったら」を登録する。

なお、買物支援および回遊支援を順次態様で連携させつつ、さらに回遊支援を並列態様で連携させる場合には、図9(D)に示されるように、買物支援の開始条件として「ショッピングセンタに到着したら」を登録し、さらに回遊支援の開始条件として「買物が済んだら」を登録するのに加えて、健康見守りの開始条件として「買物が始まったら」を登録すればよい。

同様に、買物支援および回遊支援を割込態様で連携させつつ、さらに回遊支援を並列態様で連携させる場合には、図9(E)に示されるように、回遊支援の開始条件として「ショッピングセンタに到着したら」を登録し、さらに買物支援の開始条件として「回遊が中断したら」を登録し、そして回遊支援の再開条件として「買物が済んだら」を登録されるのに加えて、健康見守りの開始条件として「回遊が始まったら」を登録すればよい。

次に、ステップS21で、サービス状態情報82を参照(状態管理機能を利用)して、イベントキューICの登録サービスの中に開始条件(または再開条件を)満足したサービスがあるか否かを判別する。ここでNOであれば、所定の待機時間を挟んで同様の判別を繰り返す。

ステップS21でYESであれば、ステップS23に進んで、そのサービスに必要なリソース(ロボットないしコンポーネント)を割り当てる。これに応じて、ロボット状態情報80が更新される。そして、ステップS25で、そのサービスに対応するアプリにリソース割り当て済みを通知した後、ステップS27に進む。

ステップS27では、完了(または中断)したサービスがあるか否かをサービス状態情報82に基づき判別する。ここでNOであれば、ステップS21に戻って上記と同様の処理を繰り返す。ステップS27でYESであれば、ステップS29に進んで、その完了(または中断)したサービスに割り当てられていたリソースを開放する。これに応じて、ロボット状態情報80が更新される。

そして、ステップS31で、イベントキューICの登録サービスがすべて完了したか否かを判別し、ここでNOであれば、ステップS21に戻って上記と同様の処理を繰り返す。ステップS31でYESであれば、ステップS1に戻って、上記と同様の処理を繰り返す。

図13には、サーバ12のCPU動作によって実現される各アプリ(A1,A2,…)の処理が示される。なお、この処理は、ネットワーク100上の他のサーバ(図示せず)によって実行されてもよい。図13を参照して、ステップS51では、PFからリソース割り当て済みの通知があったか否かを判別し、ここでNOであれば、所定の待機時間を挟んで同様の判別を繰り返す。ステップS51でYESであれば、割り当てられたリソースを利用してサービスを開始する。そして、ステップS55に進む。

ステップS55では、サービスが完了(または中断)したか否かを判別し、ここでNOであれば、ステップS53に戻って同様の判別を繰り返す。

ステップS55でYESであれば、ステップS57に進んで、サービスの完了(または中断)をPFに通知する。これに伴い、サービス状態情報82が更新される。その後、ステップS51に戻って上記と同様の処理を繰り返す。

以上から明らかなように、この実施例のロボットサービス連携システム10は、ネットワーク100に接続されたサーバ12と、ネットワーク100に接続された携帯端末14と、ネットワーク100に接続された各種のロボット16a-16cとを含み、ネットワーク100上の複数のアプリケーションソフトウェア(以下“アプリ”)A1-A3が携帯端末14のユーザに対し各種のロボット16a-16cを利用してそれぞれ提供する複数のサービスを、サーバ12のCPU20が次のようにして互いに連携させる。

すなわち、各アプリA1-A3には、他のどのアプリと連携可能かを示す連携情報が記述されており(図5)、CPU20は、携帯端末14のユーザに対し連携提供可能な複数のサービスを各アプリA1-A3に記述された連携情報に少なくとも基づいて特定し(S3)、特定した複数のサービスを携帯端末14のユーザにタッチ画面(図14-図16のようなUI)を介して提示して任意の組み合わせを選択させ(S7,S13)、そして、選択された組み合わせを構成する複数のサービスを、各サービスの少なくとも開始条件を他のサービスの少なくとも終了イベントと関連付けてイベントキューIC(イベント待ち行列ともいう)に登録することによって、互いに連携させる(S17,S19:図9(A)-図9(E))。したがって、ユーザが必要とする複数のサービスを少なくとも順次態様で連携させて提供することができる。

具体的には、CPU20は、ユーザに選択した組み合わせに関連する情報(詳細情報)をさらに入力させ(S13:図16)、第1のサービス(買物支援)および第2のサービス(回遊支援)を順次実行すべきことを判断可能な情報(たとえば買いたい物品名)が入力された場合に、当該情報に基づき第2のサービス(回遊支援)の開始条件を第1のサービス(買物支援)の終了イベントと関連付けて登録する(図9(A))。これにより、ユーザが必要とする2つのサービスを順次態様で連携させて提供することができる。一般には、第iのサービスの開始条件を第(i-1)のサービスの終了イベントと関連付けて登録すれば、i個のサービスを順次態様で連携させることができる(ただしiは2以上の整数)。

また、CPU20は、第1のサービス(回遊支援)の実行中に第2のサービス(買物支援)を割込実行すべきことを判断可能な情報(たとえば「買いたいものは未定」や「回遊しながら買いたいものを決める」など)が入力された場合には、当該情報に基づき第2のサービス(買物支援)の開始条件を第1のサービス(回遊支援)の中断イベントと関連付けて登録し、そして第1のサービス(回遊支援)の再開条件を第2のサービス(買物支援)の終了イベントと関連付けて登録する(図9(B))。これにより、ユーザが必要とする2つのサービスを、順次態様および並列態様のうちユーザが所望する方の態様で連携させて提供することができる。

また、特定のアプリ(健康見守りアプリA3)の連携情報には、他のどのアプリ(買物支援アプリA1,回遊支援アプリA2)とも並列態様で連携可能であることが記述されており、CPU20は、選択された組み合わせを構成する複数のサービスの中に、特定のアプリによって提供されるサービス(健康見守り)が含まれている場合には、当該サービスの開始条件を他のサービス(買物,回遊)の開始イベントと関連付けて登録する(図9(D),図9(E))。これにより、2つのサービスを順次態様または並列態様で連携させながら、さらに他のサービスを並列態様で連携させて提供することができる。

なお、サービスの終了/中断イベントは、たとえば、当該サービスを提供するアプリ(またはこれにより利用されるロボットないしコンポーネント)から発行される。または、ユーザの操作に応じて携帯端末14から発行されてもよい。

また、メモリ26の非遷移データエリア86には、ユーザの属性を示すユーザ属性情報92(図7)と、各種のロボットの機能を少なくとも示すロボット情報94(図8)とが記憶(データベースDBに登録)されており、CPU20は、ユーザに対し連携提供可能な複数のサービスを特定する(ステップS3)にあたって、各アプリA1-A3に記述された連携情報に加えて、ユーザ属性情報92およびロボット情報94も参照する。なお、各情報は、好ましくは更新可能に登録される。これにより、ユーザの属性に応じた機能を持つロボットを利用したサービス提供が可能になる。

好ましくは、ロボット情報94はロボットの移動範囲をさらに示す。この場合、CPU20は、ユーザの現在位置をGPS回路40で検出して、その検出結果とロボットの移動範囲との比較結果も考慮してサービスの特定を行う。これにより、様々な場所でロボットを利用したサービス提供が可能になる。

また、CPU20は、特定した複数のサービス(たとえば買物支援,回遊支援,健康見守り)を提示する際に、対応する複数のアイコン(たとえば3つのアイコンI1-I3)をタッチ画面(ディスプレイ32の表示面にタッチパネル34を設けたもの)に表示して任意の組み合わせを選択させ(図14,図15)、タッチ画面に表示した複数のアイコン(I1-I3)のうち、選択された組み合わせを構成する複数の第1アイコン(I1,I2)と残りの第2アイコン(I3)との間で表示態様を互いに異ならせる(図16)。これにより、ユーザに各サービスが選択状態にあるか非選択状態にあるかを認識させることができる。その結果、ユーザは、これまでに選択したことがないサービスの存在を知ることができるし、各サービスの選択・非選択状態を相互に切り換えることもできる。

なお、複数のサービスをユーザに提示して任意の組み合わせを選択させる処理(ステップS7)は、この実施例では、携帯端末14のタッチ画面を介して(図14-図16のようなUIを利用して)行ったが、携帯端末10や各種ロボット(16a,16b)の音声出力機能および音声認識機能を利用して行ってもよい。たとえば、人型ロボット16bのCPU50が、ユーザに対し連携提供可能な複数のサービスを提示して必要な組み合わせの選択を求める音声をスピーカ38から出力し、これに対するユーザの発話音声をマイク36で捉えて認識する方法がある。

また、ユーザ(携帯端末14)の現在位置検出(ステップS1)は、この実施例では、GPSを利用して行ったが、これに代えて、またはこれに加えて、ネットワーク100の位置検出機能を利用してもよい。

以上では、1人のユーザに対し複数のサービスを連携させて提供する場合(言い換えると、ユーザ数に対してリソースが十分にあり、ユーザ間で競合が発生しない状況でのサービス連携)について説明したが、複数のユーザに対し数のサービスを連携させて提供する場合には、ユーザ間でのリソース競合を回避(調停)しながら、各ユーザに対するサービスをイベントキューICに登録する必要がある。

10 …ロボットサービス連携システム

12 …サーバ

14 …携帯端末(バーチャルロボット)

16a …車椅子ロボット

16b …人型ロボット

16c …環境センサ(インビジブルロボット)

20,30,50 …CPU

22,32 …ディスプレイ

26,42,60 …メモリ

34 …タッチパネル

100 …ネットワーク

12 …サーバ

14 …携帯端末(バーチャルロボット)

16a …車椅子ロボット

16b …人型ロボット

16c …環境センサ(インビジブルロボット)

20,30,50 …CPU

22,32 …ディスプレイ

26,42,60 …メモリ

34 …タッチパネル

100 …ネットワーク

Claims (9)

- ネットワークに接続されたサーバと、前記ネットワークに接続された携帯端末と、前記ネットワークに接続されたロボットとを含み、前記ネットワーク上の複数のアプリケーションソフトウェアが前記携帯端末のユーザに対し前記ロボットを利用してそれぞれ提供する複数のサービスを互いに連携させる、ロボットサービス連携システムであって、

各アプリケーションソフトウェアには、他のどのアプリケーションソフトウェアと連携可能かを示す連携情報が記述されており、

前記サーバは、

前記携帯端末のユーザに対し連携提供可能な複数のサービスを各サービスアプリケーションソフトウェアに記述された連携情報に少なくとも基づいて特定する特定手段、

前記特定手段で特定した複数のサービスを前記携帯端末のユーザに提示して任意の組み合わせを選択させる提示選択手段、および

前記提示選択手段で選択された組み合わせを構成する複数のサービスを、各サービスの少なくとも開始条件を他のサービスの少なくとも終了イベントと関連付けてイベント待ち行列に登録することによって、互いに連携させる連携手段を備える、ロボットサービス連携システム。 - 前記提示選択手段は、前記携帯端末のユーザに選択した組み合わせに関連する情報をさらに入力させる入力手段を含み、

前記連携手段は、第1のサービスおよび第2のサービスを順次実行すべきことを判断可能な情報が前記入力手段で入力された場合に、当該情報に基づき第2のサービスの開始条件を第1のサービスの終了イベントと関連付けて登録する、請求項1に記載のロボットサービス連携システム。 - 前記連携手段は、第1のサービスの実行中に第2のサービスを割込実行すべきことを判断可能な情報が前記入力手段で入力された場合には、当該情報に基づき第2のサービス開始条件を第1のサービスの中断イベントと関連付けて登録し、そして第1のサービス再開条件を第2のサービスの終了イベントと関連付けて登録する、請求項2に記載のロボットサービス連携システム。

- 特定のアプリケーションソフトウェアの連携情報には、他のどのアプリケーションソフトウェアとも並列態様で連携可能であることが記述されており、

前記連携手段は、前記選択手段で選択された組み合わせを構成する複数のサービスの中に、前記特定のアプリケーションソフトウェアによって提供されるサービスが含まれている場合には、当該サービスの開始条件を他のサービスの開始イベントと関連付けて登録する、請求項2に記載のロボットサービス連携システム。 - 前記携帯端末のユーザの属性を示すユーザ属性情報と、前記ロボットの機能を少なくとも示すロボット情報とが登録されたデータベースをさらに備え、

前記特定手段は、前記データベースの各情報も参照して特定を行う、請求項1に記載のロボットサービス連携システム。 - 前記ロボット情報は前記ロボットの移動範囲をさらに示し、

前記携帯端末のユーザの現在位置を検出する検出手段をさらに備え、

前記特定手段は、前記位置検出手段の検出結果と前記ロボットの移動範囲との比較結果も考慮して特定を行う、請求項5に記載のロボットサービス連携システム。 - 前記提示選択手段は、

前記特定手段で特定した複数のサービスに対応する複数のアイコンを前記携帯端末のタッチ画面に表示して任意の組み合わせを選択させ、

前記タッチ画面に表示した複数のアイコンのうち、選択された組み合わせを構成する複数の第1アイコンと残りの第2アイコンとの間で表示態様を互いに異ならせる、請求項1に記載のロボットサービス連携システム。 - ネットワークに接続されたサーバのコンピュータによって実現され、前記ネットワーク上の複数のアプリケーションソフトウェアが前記ネットワークに接続された携帯端末のユーザに対し前記ネットワークに接続されたロボットを利用してそれぞれ提供する複数のサービスを互いに連携させる、ロボットサービス連携プラットフォームであって、

各アプリケーションソフトウェアには、他のどのアプリケーションソフトウェアと連携可能かを示す連携情報が記述されており、

前記携帯端末のユーザに対し連携提供可能な複数のサービスを各サービスアプリケーションソフトウェアに記述された連携情報に少なくとも基づいて特定する特定手段、

前記特定手段で特定した複数のサービスを前記携帯端末のユーザに提示して任意の組み合わせを選択させる提示選択手段、および

前記提示選択手段で選択された組み合わせを構成する複数のサービスを、各サービスの少なくとも開始条件を他のサービスの少なくとも終了イベントと関連付けてイベント待ち行列に登録することによって、互いに連携させる連携手段を備える、ロボットサービス連携プラットフォーム。 - ネットワークに接続されたサーバのコンピュータによって行われ、前記ネットワーク上の複数のアプリケーションソフトウェアが前記ネットワークに接続された携帯端末のユーザに対し前記ネットワークに接続されたロボットを利用してそれぞれ提供する複数のサービスを互いに連携させる、ロボットサービス連携方法であって、

各アプリケーションソフトウェアには、他のどのアプリケーションソフトウェアと連携可能かを示す連携情報が記述されており、

前記携帯端末のユーザに対し連携提供可能な複数のサービスを各サービスアプリケーションソフトウェアに記述された連携情報に少なくとも基づいて特定する特定ステップ、

前記特定ステップで特定した複数のサービスを前記携帯端末のユーザに提示して任意の組み合わせを選択させる提示選択ステップ、および

前記提示選択ステップで選択された組み合わせを構成する複数のサービスを、各サービスの少なくとも開始条件を他のサービスの少なくとも終了イベントと関連付けてイベント待ち行列に登録することによって、互いに連携させる連携ステップを含む、ロボットサービス連携方法。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP14774107.8A EP2980746A4 (en) | 2013-03-26 | 2014-03-14 | ROBOT SERVICES COORDINATION SYSTEM, PLATFORM AND METHOD |

| US14/780,105 US10065321B2 (en) | 2013-03-26 | 2014-03-14 | Robot service cooperation system, platform and method |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2013-063706 | 2013-03-26 | ||

| JP2013063706A JP6069607B2 (ja) | 2013-03-26 | 2013-03-26 | ロボットサービス連携システムおよびプラットフォーム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2014156728A1 true WO2014156728A1 (ja) | 2014-10-02 |

Family

ID=51623709

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2014/056914 WO2014156728A1 (ja) | 2013-03-26 | 2014-03-14 | ロボットサービス連携システム、プラットフォームおよび方法 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US10065321B2 (ja) |

| EP (1) | EP2980746A4 (ja) |

| JP (1) | JP6069607B2 (ja) |

| WO (1) | WO2014156728A1 (ja) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN108573367A (zh) * | 2017-03-14 | 2018-09-25 | 富士施乐株式会社 | 信息提供设备和方法以及信息提供系统 |

| US11017454B2 (en) | 2016-07-13 | 2021-05-25 | Sony Corporation | Agent robot control system, agent robot system, agent robot control method, and storage medium |

Families Citing this family (15)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|