JP7581334B2 - 植物種の識別のためのシステムおよび方法 - Google Patents

植物種の識別のためのシステムおよび方法 Download PDFInfo

- Publication number

- JP7581334B2 JP7581334B2 JP2022513875A JP2022513875A JP7581334B2 JP 7581334 B2 JP7581334 B2 JP 7581334B2 JP 2022513875 A JP2022513875 A JP 2022513875A JP 2022513875 A JP2022513875 A JP 2022513875A JP 7581334 B2 JP7581334 B2 JP 7581334B2

- Authority

- JP

- Japan

- Prior art keywords

- image

- species

- module

- plant

- weed

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A01—AGRICULTURE; FORESTRY; ANIMAL HUSBANDRY; HUNTING; TRAPPING; FISHING

- A01M—CATCHING, TRAPPING OR SCARING OF ANIMALS; APPARATUS FOR THE DESTRUCTION OF NOXIOUS ANIMALS OR NOXIOUS PLANTS

- A01M21/00—Apparatus for the destruction of unwanted vegetation, e.g. weeds

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/82—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using neural networks

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/0002—Inspection of images, e.g. flaw detection

- G06T7/0004—Industrial image inspection

- G06T7/001—Industrial image inspection using an image reference approach

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/10—Terrestrial scenes

- G06V20/188—Vegetation

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10024—Color image

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20081—Training; Learning

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Computer Vision & Pattern Recognition (AREA)

- General Health & Medical Sciences (AREA)

- Multimedia (AREA)

- Evolutionary Computation (AREA)

- Health & Medical Sciences (AREA)

- Life Sciences & Earth Sciences (AREA)

- Computing Systems (AREA)

- Databases & Information Systems (AREA)

- Medical Informatics (AREA)

- Software Systems (AREA)

- Quality & Reliability (AREA)

- Artificial Intelligence (AREA)

- Insects & Arthropods (AREA)

- Pest Control & Pesticides (AREA)

- Wood Science & Technology (AREA)

- Zoology (AREA)

- Environmental Sciences (AREA)

- Image Analysis (AREA)

Description

- テスト入力画像91上に存在する雑草種11、12、13を判定するにあたって第1タスクを実行するための中間モジュール121。第1タスクは、DTCNNの最適化の目的のための第1損失関数LF1に関連付けられている。DTCNNモデルの第1タスク(分類)は、タイルごとに入力画像を解析し、入力画像の各小部分(すなわち、タイル)中の異なるクラスの存在を予測する。

- テスト入力画像91の画素毎にクラスを判定するためにテスト入力画像91をセグメント化する第2タスクを実行するためのセグメンテーション・モジュール122。当然、画素ごとのクラスは、特定の画素が単一のクラスにのみ属することができるという点において排他的である。一旦、画像タイルが分類タスクを通過すれば、セグメンテーション・モジュールに渡される特性マップへと縮小される。クラスには、判定された雑草種が(および作物種と土壌種も)含まれる。第2タスクは、第2の異なる損失関数LF2に関連付けられている。タイル毎のセグメンテーション・モジュールの生成1700された出力は、クラス毎の対応マスクである。このマスクは、タイルと同じサイズを持つ画像によって表され、ここで、各画素は、その画素が関連付けられたクラスに属する可能性を表す間隔[0,1]の値に関連付けられる。値が1に近いほど、画素がそのクラスに属している可能性が高い。所定の閾値を上回る値は、クラスに属していると考えられる。このバイナリマスクは、セグメンテーション・モジュールにより生成1700されたセグメンテーションタスク出力と考えられる。

組み合わせ損失=セグメンテーション損失+アルファ*分類損失

ここで、アルファは、[0,100]の範囲内の数であることができる。その結果、「セグメンテーション損失」はLF2に関連付けられ、「分類損失」はLF1に関連付けられている。例えば、アルファ=0.2を選択し、セグメンテーションタスクに重み付けカテゴリ交差エントロピー損失関数LF2を考慮し、分類タスクに重み付けカテゴリ交差エントロピー損失関数LF1を考慮してもよい。すなわち、両方のモジュールのトレーニングは、2つの関連する損失関数の最適化と同時に並行して起こる。前述のように、PSPNetトポロジー等の先行技術のセグメンテーション・ネットワークは、2つの後続のトレーニング段階を有するが、第2段階のトレーニングを実施すると、第1段階のトレーニングがほとんど失われる。対照的に、タスク毎に別々の損失関数を有する共同トレーニングアプローチは、各損失関数を通して各タスクのパフォーマンスを別々に測定できる一方、同時に、(分類タスク用の)中間モジュール121と(セグメンテーションタスク用の)セグメンテーション・モジュール122を含むDTCNN120のトポロジー全体の重みを設定する。

- 空間的情報の抽出。モデルは葉のグループをセグメント化できるが、実際には、画像上の全ての画素を1つずつ分類することを行っている。その結果、ネットワークは単一の画素に注目するが、同時に、オブジェクトをセグメント化するための空間的情報を抽出できる。このようにして、モデルは、特定の領域のどの画素が葉に属するのかを学習するという点において、葉が何であるかの抽象的な概念を学習する。この特性は「画素グループ化」と呼ばれる。

- 高特性解像度。異なる雑草種の葉は非常に類似し得る。2種類の葉の違いが、ちょうど20画素程度の高解像度テスト入力画像全体で見える画像が存在することがある。これは、DTCNNが、画素の小さなグループに注目してこのような軽微な違いを検出するフィルタを学習する必要があることを意味する。これはまた、さまざまな植物のサブ要素(例えば、果物、茎等)を検出する学習フィルタに関しても当てはまる。

- マルチスケール検出。典型的に、葉のスケールは画像毎に変わる。多くの場合、同じ画像に異なる成長段階にある異なる植物が表される。従って、DTCNNは同じ画像に共存する異なる年齢で異なるサイズの同じ種類の葉(すなわち、同じ植物種の葉)を認識しなくてはならない。例えば、後の成長段階では、植物はすでに果実を実らせているかもしれない。従って、特定の種に特有の果実の特徴を学習することもまた、前述の種を認識することに役立ち得る。

他の検出シナリオでは、例えば、背景として空を検出することで飛行機や航空機を分類することに役立ち得る。しかしながら植物画像データセットでは、背景と隣接するオブジェクトとは、多くの場合、識別対象とほぼ同じように見える。その情報を使用すると、実際的に分類を誤った方向に導き得る。さらに、全ての葉はほぼ同じ色である。多くの場合、単一オブジェクトは、そのオブジェクトを他のオブジェクトから区別する共通画素強度(色)を示す。この場合、全ての葉はその部分では同様に見え、色は付加情報を提供しない。従って、DTCNN120のトレーニングはエッジおよび境界線に注目する。

このアルゴリズムのパイプラインは以下の通りである。

(i)栽培領域はランダムなサイズの楕円に作られる。

(ii)各楕円には、クラス(種)、年齢(播種後の日数)、密度(0から1の間の実数)がランダムに割り当てられる。

(iii)画像内のロケーション点は、各植物候補に対してランダムにサンプリングされる。

(iv)ロケーション点に応じて、候補が栽培領域内にあるかどうか(ない場合、潜在的な候補は不合格と判定される)。

(v)候補が楕円内にある場合、アルゴリズムは0から1の間の数をランダムにサンプリングし、それをその栽培領域の「密度」パラメータと比較する。サンプリングされた数が「密度」の閾値より大きい場合、候補は不合格と判定される。

(vi)アルゴリズムは、候補リポジトリから栽培領域の要件に適した候補画像を選択し、それを区画画像に配置する。

‐PSPNet第1+第3。この実験では、第1データサブセットと第3データサブセットとの両方からの画像でトレーニングされたベースラインPSPNetを使用する。この組み合わせは、トレーニングに最良のデータサブセットの組み合わせとして選択された。

‐二重タスクPSPNet第1+第3。この実験は前のものと同様だが、伝統的なPSPNetネットワークアーキテクチャを開示の二重タスクPSPNetで置き換えた。

接続システム212は、スマート農業機械210を分散型コンピュータ環境に通信可能に接続するように構成されている。スマート農業機械210で収集されたデータを、分散型コンピュータ環境の1以上のリモートコンピューティングリソース212、214、216に提供するように構成されていてもよい。1つのコンピューティングリソース212、214、216は、スマート農業機械210にデータを送信するように、またはスマート農業機械210からデータを受信するように構成されていてもよいデータ管理システム214であってもよい。例えば、検出マップとして、または散布中に記録されたデータを含む散布マップとして、スマート農業機械10からデータ管理システム214に送信されてもよい。さらなるコンピューティングリソース212、214、216は、制御プロトコル、起動コードもしくは決定ロジックをスマート農業機械210に提供するように、またはスマート農業機械210からデータを受信するように構成されていてもよいフィールド管理システム216であってもよい。このようなデータはまた、データ管理システム214を通して受信さてもよい。さらに、さらなるコンピューティングリソース212、214、216は、フィールド管理システム214および/またはスマート農業機械210からクライアントデータを受信するように構成されていてもよいクライアントコンピュータ216であってもよい。このようなクライアントデータは、例えば、スマート農業機械210を使用して特定のフィールドで実施される予定の散布スケジュール、または特定のフィールドの健康状態に対する見識を提供するためのフィールド分析データを含む。

図1に示す実施形態では、検出コンポーネント230は光学的検出コンポーネントであり、ノズルが各位置に達すると、視野がフィールド上の各ノズル222の噴霧形状を含むまたは噴霧形状に少なくとも重なるように、各検出コンポーネント230は、単一のノズル222に関連付けられている。他の装置では、各検出コンポーネント30が、1を超えるノズル222に関連付けられてもよいし、1を超える検出コンポーネント30が、各ノズル222に関連付けられてもよい。

Claims (21)

- トポロジーを有する二重タスク畳み込みニューラルネットワーク(120)を使用して農地で雑草を識別するためのコンピュータに実装される方法(1000)であって、

前記トポロジーを有する二重タスク畳み込みニューラルネットワーク(120)は、

テスト入力画像(91)上に存在する雑草種(11、12、13)を判定するにあたって、第1損失関数(LF1)と関連付けられている第1タスクを実行するように構成されている中間モジュール(121)と、

前記テスト入力画像(91)の画素毎に、前記判定された雑草種を含むクラスを判定するために前記テスト入力画像(91)をセグメント化するにあたって、第2の異なる損失関数(LF2)と関連付けられている第2タスクを実行するように構成されているセマンティック・セグメンテーション・モジュール(122)と、

を備え、

前記中間モジュールおよび前記セグメンテーション・モジュールは、前記第1損失関数および前記第2損失関数(LF1、LF2)を考慮して、一緒にトレーニングされ、

前記方法は、

圃場における作物種の作物植物と、前記作物植物の間にある1以上の雑草種の雑草植物とを表す画像を含むテスト入力(91)を受信すること(1100)と、

前記テスト入力画像から前記中間モジュールの入力の形状の次元を有するタイルを抽出すること(1200)と、

抽出されたタイル毎に、

前記中間モジュール(121)は、前記各タイルに存在する1以上の雑草種の存在を予測(1300)し、

前記中間モジュール(121)は、前記第1タスクの出力として前記セグメンテーション・モジュール(122)に対応する中間特性マップ(121-o1)を出力(1400)し、

前記セグメンテーション・モジュールは、前記中間特性マップからマルチスケール特性およびコンテキスト情報を抽出(1500)し、前記抽出された情報を連結(1600)させて、セマンティック・セグメンテーションを行うことで、前記第2タスクのセグメンテーション出力として雑草種クラス毎にマスクを生成(1700)し、前記マスクは、タイルと同じサイズを有する画像であり、前記マスク上の各画素は、関連づけられたクラスに属する前記画素の確率を表す値に関連付けられており、

前記生成されたマスクを、特定の雑草種に属しているかどうか、および属している場合、どの雑草種に属しているのかを画素毎に示している最終画像へと組み合わせる(1800)こととを備える方法。 - 前記中間モジュールは、分類ニューラルネットワークによって実装される、請求項1に記載の方法。

- 前記第1損失関数(FL1)は、各サンプル画素が属する前記クラスに応じて重み付けされる「重み付けバイナリ交差エントロピー」であり、前記中間モジュール(121)は、「シグモイド」を最後の活性化層として使用して、複数のクラスの存在を同時にサポートする、請求項1または2に記載の方法。

- 前記中間モジュールは、回帰型ニューラルネットワークによって実装される、請求項1に記載の方法。

- 前記第1損失関数(FL1)は、「平均二乗誤差」または「平均誤差」であり、前記中間モジュール(121)は、「線形」または「シグモイド」を最後の活性化層として使用して、複数のクラスの存在の検出を同時にサポートする、請求項4に記載の方法。

- 前記セグメンテーション・モジュールに関連付けられている前記第2損失関数(FL2)は、「重み付けカテゴリ交差エントロピー」である、請求項1から5のいずれか一項に記載の方法。

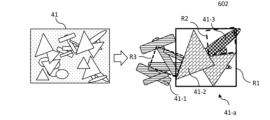

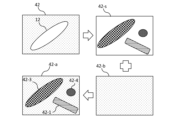

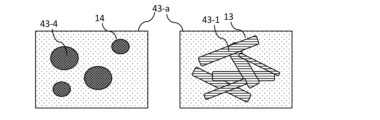

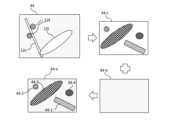

- 前記中間モジュールを前記セグメンテーション・モジュールと一緒にトレーニングするために使用される画像トレーニングデータセットは、

作物種(10)の作物植物と、前記作物植物の間にある1以上の雑草種(11、12、13)の雑草植物とを有する圃場内の実際の状況を表す画像(41-a)を有し、トレーニング画像の前記画素が属する種を示す手動画素アノテーション(41-1、41-2、41-3)を有する第1データサブセット、並びに

土壌の背景画像に貼り付けられる、各単一植物画像が単一種の植物を表す単一植物画像から得られる異なる雑草種の複数の雑草植物を表す画像(42-a)を有し、単一雑草種に属する前記画素の自動アノテーション(42-1、42-3、42-4)を有する第2データサブセット、及び

単一雑草種の複数の雑草植物を表す画像(43-a)を有し、前記単一雑草種に属する前記画素の自動アノテーション(42-3、43-1、43-4)を有する第3データサブセット、

の少なくとも1つと、

を備える、請求項1から6のいずれか一項に記載の方法。 - 前記セグメンテーション・モジュール(122)は、ピラミッドプーリングモジュールにより実装される、請求項1から7のいずれか一項に記載の方法。

- 前記ピラミッドプーリングモジュールは、PSPNetトポロジーに基づく、請求項8に記載の方法。

- 前記ピラミッドプーリングモジュールは、前記中間特性マップ(121o1)をスキャンし、マルチスケール特性検出のための4つの配列を作成して、異なるスケールとサイズの情報を統合する異なる受容野を有する4つの分離したフィルタ(122-2)を備える、請求項8または9に記載の方法。

- 前記ピラミッドプーリングモジュールは、各配列の画像サイズを、バイリニア補間法を使用して、前記中間特性マップ(121o1)の前記サイズに復元するように構成されている複数のアップサンプリング層をさらに備える、請求項10に記載の方法。

- 前記ピラミッドプーリングモジュールは、前記4つの分離したフィルタからコンテキスト情報を抽出し、前記コンテキスト情報を異なるスケールとサイズの情報と結合させて、前記中間特性マップ(121-o1)と同じサイズの最終特性マップ(122-4o)を生成するように構成されている畳み込み層(122-4)をさらに備える、請求項11に記載の方法。

- 前記ピラミッドプーリングモジュールは、最後の活性化層「softmax」を有する前記生成されたマスクとして、最終的な画素単位の予測を計算する全結合層(122-5)をさらに備える、請求項12に記載の方法。

- 特定の雑草が識別された場合、農業機械を操作、制御および/またはモニタリングするための信号を出力することをさらに備え、

前記信号は、前記特定の雑草を対象とした除草剤または他の作物保護剤を噴霧または散布することをトリガするように構成されている、請求項1から13のいずれか一項に記載の方法。 - コンピューティングデバイスのメモリにロードされて、前記コンピューティングデバイスの少なくとも1つのプロセッサによって実行されると、前記少なくとも1つのプロセッサに請求項1から14のいずれか一項に記載の前記コンピュータに実装される方法のステップを実行させる、農地において雑草を識別するためのコンピュータプログラム製品。

- メモリと、少なくとも1つのプロセッサとを備えるコンピュータシステムであって、少なくとも1つのプロセッサによって実行されると、前記コンピュータシステムに請求項1から14のいずれか一項に記載の前記コンピュータに実装される方法のステップを実行させるソフトウェアモジュールをさらに備える、農地において雑草を識別するためのコンピュータシステム。

- トポロジーを有する二重タスク畳み込みニューラルネットワーク(120)を使用して圃場で植物種を識別するためのコンピュータに実装される方法(1000)であって、

前記トポロジーを有する二重タスク畳み込みニューラルネットワーク(120)は、

テスト入力画像(91)上に存在する植物種(11、12、13)を判定するにあたって、第1損失関数(LF1)と関連付けられている第1タスクを実行するように構成されている中間モジュール(121)と、

前記テスト入力画像(91)の画素毎に、前記判定された植物種を含むクラスを判定するために前記テスト入力画像(91)をセグメント化するにあたって、第2の異なる損失関数(LF2)と関連付けられている第2タスクを実行するように構成されているセマンティック・セグメンテーション・モジュール(122)と、

を備え、

前記中間モジュールおよび前記セグメンテーション・モジュールは、前記第1損失関数および前記第2損失関数(LF1、LF2)を考慮して、一緒にトレーニングされ、

前記方法は、

圃場における複数の植物種の植物を表す画像を含むテスト入力(91)を受信すること(1100)と、

前記テスト入力画像から前記中間モジュールの入力の形状の次元を有するタイルを抽出すること(1200)と、

抽出されたタイル毎に、

前記中間モジュール(121)は、前記各タイルに存在する1以上の植物種の存在を予測(1300)し、

前記中間モジュール(121)は、前記第1タスクの出力として前記セグメンテーション・モジュール(122)に対応する中間特性マップ(121-o1)を出力(1400)し、

前記セグメンテーション・モジュールは、前記中間特性マップからマルチスケール特性およびコンテキスト情報を抽出(1500)し、前記抽出された情報を連結(1600)させて、セマンティック・セグメンテーションを行うことで、前記第2タスクのセグメンテーション出力として植物種クラス毎にマスクを生成(1700)し、前記マスクは、タイルと同じサイズを有する画像であり、ここで前記マスク上の各画素は、関連づけられたクラスに属する前記画素の確率を表す値に関連付けられており、

前記生成されたマスクを、特定の植物種に属しているかどうか、および属している場合、どの植物種に属しているのかを画素毎に示している最終画像へと組み合わせる(1800)こととを備える方法。 - 特定の雑草が識別された場合、農業機械を操作、制御および/またはモニタリングするための信号を出力することをさらに備え、

前記信号は前記特定の雑草を対象とした除草剤または他の作物保護剤を噴霧または散布することをトリガするように構成されている、請求項17記載の方法。 - トポロジーを有する二重タスク畳み込みニューラルネットワーク(120)を使用して圃場で植物種と植物果実を識別するためのコンピュータに実装される方法であって、

前記トポロジーを有する二重タスク畳み込みニューラルネットワーク(120)は、

テスト入力画像(91)上に存在する植物種(11、12、13)と各植物種(12)の植物果実(12f)を判定するにあたって、第1損失関数(LF1)と関連付けられている第1タスクを実行するように構成されている中間モジュール(121)と、

前記テスト入力画像(91)の画素毎に、前記判定された植物種と植物果実とを含むクラスを判定するために前記テスト入力画像(91)をセグメント化するにあたって、第2の異なる損失関数(LF2)と関連付けられている第2タスクを実行するように構成されているセマンティック・セグメンテーション・モジュール(122)と、

を備え、

前記中間モジュールおよび前記セグメンテーション・モジュールは、前記第1損失関数および前記第2損失関数(LF1、LF2)を考慮して、一緒にトレーニングされ、

前記方法は、

植物果実を持つ少なくとも1つの植物を有する圃場における複数の植物種の植物を表す画像を含むテスト入力(91)を受信することと、

前記テスト入力画像から前記中間モジュールの入力の形状の次元を有するタイルを抽出することと、

抽出されたタイル毎に、

前記中間モジュール(121)は、前記各タイルに存在する1以上の植物種と各植物種の植物果実の存在を予測し、

前記中間モジュール(121)は、前記第1タスクの出力として前記セグメンテーション・モジュール(122)に対応する中間特性マップ(121-o1)を出力(1400)し、

前記セグメンテーション・モジュールは、前記中間特性マップからマルチスケール特性およびコンテキスト情報を抽出し、前記抽出された情報を連結させて、セマンティック・セグメンテーションを行うことで、前記第2タスクのセグメンテーション出力として植物種クラスと植物果実クラス毎にマスクを生成し、前記マスクは、タイルと同じサイズを有する画像であり、ここで前記マスク上の各画素は、関連づけられたクラスに属する前記画素の確率を表す値に関連付けられており、

前記生成されたマスクを、特定の植物種または特定の植物果実クラスに属しているかどうか、および属している場合、どの植物種または特定の植物果実クラスに属しているのかを画素毎に示している最終画像へと組み合わせることとを備える方法。 - 前記圃場で栽培される作物に関連付けられている特定の植物果実クラスに属する画素の数を判定することと、

前記特定の植物果実クラスに属する画素の数と、対応する作物植物種に属する画素の数との比率を推定することと、

をさらに備える、請求項19記載の方法。 - 特定の雑草が識別された場合、農業機械を操作、制御および/またはモニタリングするための信号を出力することをさらに備え、

前記信号は前記特定の雑草を対象とした除草剤または他の作物保護剤を噴霧または散布することをトリガするように構成されている、請求項19または20記載の方法。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP19195608 | 2019-09-05 | ||

| EP19195608.5 | 2019-09-05 | ||

| PCT/EP2020/074600 WO2021043904A1 (en) | 2019-09-05 | 2020-09-03 | System and method for identification of plant species |

Publications (4)

| Publication Number | Publication Date |

|---|---|

| JP2022546998A JP2022546998A (ja) | 2022-11-10 |

| JPWO2021043904A5 JPWO2021043904A5 (ja) | 2024-09-12 |

| JP2022546998A5 JP2022546998A5 (ja) | 2024-09-12 |

| JP7581334B2 true JP7581334B2 (ja) | 2024-11-12 |

Family

ID=67874336

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022513875A Active JP7581334B2 (ja) | 2019-09-05 | 2020-09-03 | 植物種の識別のためのシステムおよび方法 |

Country Status (8)

| Country | Link |

|---|---|

| US (1) | US12142033B2 (ja) |

| EP (1) | EP4025047B1 (ja) |

| JP (1) | JP7581334B2 (ja) |

| CN (1) | CN114341948A (ja) |

| AR (1) | AR119901A1 (ja) |

| BR (1) | BR112022002385A2 (ja) |

| CA (1) | CA3148726A1 (ja) |

| WO (1) | WO2021043904A1 (ja) |

Families Citing this family (52)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11641800B2 (en) | 2020-02-06 | 2023-05-09 | Deere & Company | Agricultural harvesting machine with pre-emergence weed detection and mitigation system |

| US12069978B2 (en) | 2018-10-26 | 2024-08-27 | Deere & Company | Predictive environmental characteristic map generation and control system |

| US11672203B2 (en) | 2018-10-26 | 2023-06-13 | Deere & Company | Predictive map generation and control |

| US11589509B2 (en) | 2018-10-26 | 2023-02-28 | Deere & Company | Predictive machine characteristic map generation and control system |

| US11957072B2 (en) | 2020-02-06 | 2024-04-16 | Deere & Company | Pre-emergence weed detection and mitigation system |

| WO2020163539A1 (en) * | 2019-02-05 | 2020-08-13 | University Of Virginia Patent Foundation | System and method for fully automatic lv segmentation of myocardial first-pass perfusion images |

| CN111325240A (zh) * | 2020-01-23 | 2020-06-23 | 杭州睿琪软件有限公司 | 与杂草相关的计算机可执行的方法和计算机系统 |

| US12225846B2 (en) * | 2020-02-06 | 2025-02-18 | Deere & Company | Machine control using a predictive map |

| DE102021200028A1 (de) | 2020-02-06 | 2021-08-12 | Deere & Company | Landwirtschaftliche erntemaschine mit vorauflauf-unkrauterkennungs- und -eindämmungssystem |

| US12329148B2 (en) | 2020-02-06 | 2025-06-17 | Deere & Company | Predictive weed map and material application machine control |

| US12035648B2 (en) * | 2020-02-06 | 2024-07-16 | Deere & Company | Predictive weed map generation and control system |

| CN115039139B (zh) * | 2020-02-28 | 2025-04-18 | Oppo广东移动通信有限公司 | 用于获取融合多尺度第一和第二维感受野信息的方法、系统和计算机可读介质 |

| CN113807143B (zh) * | 2020-06-12 | 2024-11-12 | 广州极飞科技股份有限公司 | 作物连通域的识别方法、装置及作业系统 |

| US12045992B2 (en) * | 2020-11-10 | 2024-07-23 | Nec Corporation | Multi-domain semantic segmentation with label shifts |

| PY2224136A (es) * | 2021-03-31 | 2022-10-07 | Upl Ltd | Sistema y método para identificar malas hierbas |

| WO2022236175A1 (en) * | 2021-05-07 | 2022-11-10 | Northeastern University | Infant 2d pose estimation and posture detection system |

| JP7718684B2 (ja) * | 2021-08-26 | 2025-08-05 | 国立大学法人 筑波大学 | 区分け画像推定装置、区分け画像推定方法、及びプログラム |

| CN113781417B (zh) * | 2021-08-30 | 2025-04-22 | 中国三峡新能源(集团)股份有限公司四川分公司 | 基于杂草检测的防火监测方法、装置、终端及存储介质 |

| CN113781306B (zh) * | 2021-09-09 | 2024-03-08 | 西北工业大学 | 基于双阶段策略的高光谱图像超分辨率重建方法 |

| US12035707B2 (en) * | 2021-09-23 | 2024-07-16 | Cnh Industrial America Llc | System and method for performing spraying operations with an agricultural applicator |

| WO2023055960A1 (en) * | 2021-09-30 | 2023-04-06 | Monsanto Technology Llc | Methods and systems for use in processing images related to crops |

| EP4165987B1 (en) * | 2021-10-18 | 2024-08-07 | Bilberry SAS | Plant treatment system with plant recognition |

| WO2023072980A1 (en) * | 2021-10-26 | 2023-05-04 | Basf Agro Trademarks Gmbh | Monitoring the treatment of an agricultural field |

| CN114398892B (zh) * | 2021-11-30 | 2024-09-24 | 苏州空天信息研究院 | 一种基于拓扑结构的图像图谱化实现方法 |

| US12389828B2 (en) * | 2021-12-07 | 2025-08-19 | Cnh Industrial America Llc | System and method for an agricultural applicator |

| US20230186623A1 (en) * | 2021-12-14 | 2023-06-15 | Ping An Technology (Shenzhen) Co., Ltd. | Systems and methods for crop disease diagnosis |

| EP4520169A1 (en) * | 2022-04-08 | 2025-03-12 | Eirene Projetos e Consultoria Ltda | System, device and method for identifying plants and controlling spraying |

| EP4533201A1 (en) * | 2022-05-26 | 2025-04-09 | Farm-NG Inc. | Image segmentation for row following and associated training system |

| NL2032111B1 (en) * | 2022-06-09 | 2023-12-18 | Look E B V | A method of real-time controlling a remote device, and training a learning algorithm |

| CN114863287A (zh) * | 2022-06-15 | 2022-08-05 | 南京林业大学 | 一种基于图像分类融合分割模块的苜蓿田杂草识别方法 |

| CN115104468A (zh) * | 2022-06-22 | 2022-09-27 | 杨粉莉 | 一种果园生草的抑制生长方法 |

| CN115413550B (zh) * | 2022-11-07 | 2023-03-14 | 中化现代农业有限公司 | 甜菜植保方法及甜菜植保设备 |

| CN116229143A (zh) * | 2022-12-26 | 2023-06-06 | 华为技术有限公司 | 一种图像处理方法、装置及计算设备 |

| CN116468263A (zh) * | 2023-02-24 | 2023-07-21 | 四川思极科技有限公司 | 输电线通道的放电预警方法、装置、电子设备及存储介质 |

| CN115880574B (zh) * | 2023-03-02 | 2023-06-16 | 吉林大学 | 一种水下光学图像轻量化目标识别方法、设备和介质 |

| CN116434255B (zh) * | 2023-03-17 | 2025-12-23 | 武汉大学 | 基于跨模态金字塔对齐的视觉意图分析方法及系统 |

| CN116883836B (zh) * | 2023-06-19 | 2025-12-12 | 武汉大学 | 基于图卷积神经网络的农产品等级自动识别方法及系统 |

| CN116740570B (zh) * | 2023-06-20 | 2026-03-17 | 中国人民解放军国防科技大学 | 基于掩码图像建模的遥感图像道路提取方法、装置及设备 |

| CN116863212B (zh) * | 2023-06-27 | 2026-01-09 | 武汉轻工大学 | 作物区杂草与幼苗识别方法、装置、设备及存储介质 |

| CN116977877A (zh) * | 2023-07-18 | 2023-10-31 | 武汉大学 | 一种基于无人机高光谱技术的农药残留检测方法及系统 |

| WO2025026591A1 (en) * | 2023-08-03 | 2025-02-06 | Basf Se | Ontology based training of image classifiers |

| CN117274566B (zh) * | 2023-09-25 | 2024-04-26 | 北京工业大学 | 一种基于深度学习和株间杂草分布状况的实时除草方法 |

| CN117218519B (zh) * | 2023-09-25 | 2026-01-06 | 中国科学院南京地理与湖泊研究所 | 一种沉水植物图像实时识别及分布显示方法 |

| US12062159B1 (en) * | 2023-10-19 | 2024-08-13 | Tartan Aerial Sense Tech Private Limited | Camera apparatus and method of enhanced foliage detection |

| CN117115668B (zh) * | 2023-10-23 | 2024-01-26 | 安徽农业大学 | 一种作物冠层表型信息提取方法、电子设备及存储介质 |

| KR102697521B1 (ko) * | 2023-11-20 | 2024-08-22 | (주) 지오씨엔아이 | 고해상도 영상과 LiDAR 점군을 활용한 습지 육상 식물 분류 방법 및 시스템 |

| CN117357928B (zh) * | 2023-12-08 | 2024-04-12 | 广州泽力医药科技有限公司 | 一种基于物联网的植物提取方法及系统 |

| CN117853930B (zh) * | 2024-01-25 | 2024-11-05 | 湖南省第二测绘院 | 一种基于机器学习的巡田方法及系统 |

| CN118799343B (zh) * | 2024-09-13 | 2024-11-15 | 慧诺瑞德(北京)科技有限公司 | 基于深度信息的植物分割方法、装置及设备 |

| CN119048853B (zh) * | 2024-10-31 | 2025-01-24 | 北京中实信息技术有限公司 | 一种中草药视觉识别方法、电子设备及存储介质 |

| CN119478517A (zh) * | 2024-11-06 | 2025-02-18 | 华南农业大学 | 一种基于深度学习的复杂条件下杂草目标识别方法 |

| CN119478842B (zh) * | 2025-01-15 | 2025-08-05 | 绵阳师范学院 | 一种融合多尺度方向纹理特征的植物标本分类系统和方法 |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2017194399A1 (en) | 2016-05-12 | 2017-11-16 | Bayer Cropscience Aktiengesellschaft | Recognition of weed in a natural environment |

| CN108805083A (zh) | 2018-06-13 | 2018-11-13 | 中国科学技术大学 | 单阶段的视频行为检测方法 |

| US20190220666A1 (en) | 2016-05-12 | 2019-07-18 | Bayer Cropscience Aktiengesellschaft | Recognition of weed in a natural environment |

Family Cites Families (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| BR112019023576A8 (pt) | 2017-05-09 | 2022-11-22 | Blue River Tech Inc | Método e meio legível por computador |

| KR102463175B1 (ko) | 2017-09-04 | 2022-11-04 | 삼성전자주식회사 | 객체 인식 방법 및 장치 |

| CN109711448A (zh) | 2018-12-19 | 2019-05-03 | 华东理工大学 | 基于判别关键域和深度学习的植物图像细粒度分类方法 |

| US10373317B1 (en) * | 2019-01-22 | 2019-08-06 | StradVision, Inc. | Learning method and learning device for attention-driven image segmentation by using at least one adaptive loss weight map to be used for updating HD maps required to satisfy level 4 of autonomous vehicles and testing method and testing device using the same |

-

2020

- 2020-09-03 US US17/640,742 patent/US12142033B2/en active Active

- 2020-09-03 CN CN202080062373.5A patent/CN114341948A/zh active Pending

- 2020-09-03 BR BR112022002385A patent/BR112022002385A2/pt unknown

- 2020-09-03 JP JP2022513875A patent/JP7581334B2/ja active Active

- 2020-09-03 EP EP20767539.8A patent/EP4025047B1/en active Active

- 2020-09-03 CA CA3148726A patent/CA3148726A1/en active Pending

- 2020-09-03 WO PCT/EP2020/074600 patent/WO2021043904A1/en not_active Ceased

- 2020-09-04 AR ARP200102478A patent/AR119901A1/es active IP Right Grant

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2017194399A1 (en) | 2016-05-12 | 2017-11-16 | Bayer Cropscience Aktiengesellschaft | Recognition of weed in a natural environment |

| JP2019520631A (ja) | 2016-05-12 | 2019-07-18 | ビーエーエスエフ ソシエタス・ヨーロピアBasf Se | 自然環境における雑草の認識 |

| US20190220666A1 (en) | 2016-05-12 | 2019-07-18 | Bayer Cropscience Aktiengesellschaft | Recognition of weed in a natural environment |

| CN108805083A (zh) | 2018-06-13 | 2018-11-13 | 中国科学技术大学 | 单阶段的视频行为检测方法 |

Non-Patent Citations (2)

| Title |

|---|

| Lottes Philipp et al.,"Fully Convolutional Networks With Sequential Information for Robust Crop and Weed Detection in Precision Farming",IEEE Robotics and Automation Letters[online],IEEE,2018年,Vol.3,No.4,pp.2870-2877,[検索日 2024.5.24], インターネット:<URL:https://ieeexplore.ieee.org/stamp/stamp.jsp?tp=&arnumber=8379414&tag=1>,DOI: 10.1109/LRA.2018.2846289 |

| 中田敦,レタスの「間引き」を自動化する農業ロボット 今後は深層学習を採用し、「雑草」も除去,NIKKEI Robotics,日経BP社,2016年07月10日,第13号,pp.12~13 |

Also Published As

| Publication number | Publication date |

|---|---|

| CN114341948A (zh) | 2022-04-12 |

| WO2021043904A1 (en) | 2021-03-11 |

| EP4025047A1 (en) | 2022-07-13 |

| US12142033B2 (en) | 2024-11-12 |

| AR119901A1 (es) | 2022-01-19 |

| US20220327815A1 (en) | 2022-10-13 |

| EP4025047B1 (en) | 2025-08-13 |

| CA3148726A1 (en) | 2021-03-11 |

| BR112022002385A2 (pt) | 2022-04-26 |

| JP2022546998A (ja) | 2022-11-10 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7581334B2 (ja) | 植物種の識別のためのシステムおよび方法 | |

| Peng et al. | Weed detection in paddy field using an improved RetinaNet network | |

| Alibabaei et al. | A review of the challenges of using deep learning algorithms to support decision-making in agricultural activities | |

| Sadeghi-Tehran et al. | DeepCount: in-field automatic quantification of wheat spikes using simple linear iterative clustering and deep convolutional neural networks | |

| Qu et al. | Deep learning-based weed–crop recognition for smart agricultural equipment: A review | |

| Gao et al. | Cross-domain transfer learning for weed segmentation and mapping in precision farming using ground and UAV images | |

| Zenkl et al. | Outdoor plant segmentation with deep learning for high-throughput field phenotyping on a diverse wheat dataset | |

| Jiménez-Brenes et al. | Automatic UAV-based detection of Cynodon dactylon for site-specific vineyard management | |

| Boissard et al. | A cognitive vision approach to early pest detection in greenhouse crops | |

| Huang et al. | Deep localization model for intra-row crop detection in paddy field | |

| Zhang et al. | Rapeseed stand count estimation at leaf development stages with UAV imagery and convolutional neural networks | |

| Pai et al. | Deep learning techniques for weed detection in agricultural environments: A comprehensive review | |

| CN106407880A (zh) | 使用图像处理的存量、生长和风险预测 | |

| Janneh et al. | Multi-level feature re-weighted fusion for the semantic segmentation of crops and weeds | |

| Buddha et al. | Weed detection and classification in high altitude aerial images for robot-based precision agriculture | |

| Xu et al. | Cucumber flower detection based on YOLOv5s-SE7 within greenhouse environments | |

| Lin et al. | Multi-task deep convolutional neural network for weed detection and navigation path extraction | |

| Lyu et al. | Development of phenotyping system using low altitude UAV imagery and deep learning | |

| Ajayi et al. | Drone-based crop type identification with convolutional neural networks: an evaluation of the performance of RESNET architectures | |

| Raveena et al. | Detectron2 powered-image segmentation and object detection for smart weed control program in coffee plantation | |

| Ke et al. | Intelligent vineyard blade density measurement method incorporating a lightweight vision transformer | |

| Hnida et al. | Enhanced multi-scale detection of olive tree crowns in UAV orthophotos using a deep learning architecture | |

| Shinde et al. | An Indian annotated weed dataset for computer vision tasks in precision farming | |

| Ramesh et al. | Detection of commercial crop weeds using machine learning algorithms | |

| Cheppally et al. | Seed localization system suite with CNNs for seed spacing estimation, population estimation and doubles identification |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230901 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230901 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20240520 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20240604 |

|

| A524 | Written submission of copy of amendment under article 19 pct |

Free format text: JAPANESE INTERMEDIATE CODE: A524 Effective date: 20240904 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20241001 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20241030 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7581334 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |