JP7560310B2 - 髪年齢評価方法 - Google Patents

髪年齢評価方法 Download PDFInfo

- Publication number

- JP7560310B2 JP7560310B2 JP2020170764A JP2020170764A JP7560310B2 JP 7560310 B2 JP7560310 B2 JP 7560310B2 JP 2020170764 A JP2020170764 A JP 2020170764A JP 2020170764 A JP2020170764 A JP 2020170764A JP 7560310 B2 JP7560310 B2 JP 7560310B2

- Authority

- JP

- Japan

- Prior art keywords

- calculation method

- values

- standard deviation

- color unevenness

- value

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 210000004209 hair Anatomy 0.000 title claims description 542

- 238000000034 method Methods 0.000 title claims description 194

- 238000004364 calculation method Methods 0.000 claims description 458

- 238000011156 evaluation Methods 0.000 claims description 169

- 230000037308 hair color Effects 0.000 claims description 28

- 230000003741 hair volume Effects 0.000 claims description 26

- 238000004458 analytical method Methods 0.000 claims description 24

- 230000003814 hair luster Effects 0.000 claims description 9

- 230000001174 ascending effect Effects 0.000 claims description 8

- 239000002932 luster Substances 0.000 claims description 5

- 238000003384 imaging method Methods 0.000 claims description 3

- 230000003247 decreasing effect Effects 0.000 claims 2

- 238000013527 convolutional neural network Methods 0.000 description 106

- 238000012360 testing method Methods 0.000 description 71

- 238000012549 training Methods 0.000 description 46

- 230000006870 function Effects 0.000 description 19

- 238000010586 diagram Methods 0.000 description 14

- 238000011478 gradient descent method Methods 0.000 description 9

- 238000012935 Averaging Methods 0.000 description 7

- 238000006243 chemical reaction Methods 0.000 description 7

- 210000004709 eyebrow Anatomy 0.000 description 7

- 210000003128 head Anatomy 0.000 description 7

- 238000011179 visual inspection Methods 0.000 description 7

- 239000011159 matrix material Substances 0.000 description 6

- 230000000007 visual effect Effects 0.000 description 6

- 238000002790 cross-validation Methods 0.000 description 5

- 239000000203 mixture Substances 0.000 description 4

- 230000003760 hair shine Effects 0.000 description 3

- 230000000052 comparative effect Effects 0.000 description 2

- 238000000605 extraction Methods 0.000 description 2

- 238000003745 diagnosis Methods 0.000 description 1

- 230000003648 hair appearance Effects 0.000 description 1

- 230000003806 hair structure Effects 0.000 description 1

- 238000010191 image analysis Methods 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 238000000491 multivariate analysis Methods 0.000 description 1

- 230000002093 peripheral effect Effects 0.000 description 1

- 238000012545 processing Methods 0.000 description 1

- 238000011160 research Methods 0.000 description 1

Images

Landscapes

- Measurement Of The Respiration, Hearing Ability, Form, And Blood Characteristics Of Living Organisms (AREA)

- Measuring And Recording Apparatus For Diagnosis (AREA)

Description

毛髪を評価する方法として、例えば、被験者に対する問診データと、被験者の毛髪構造を光学的に観察したデータとを入力し、これらのデータを基に被験者の毛髪状態を診断する手段を備えた毛髪診断システムが知られている(特許文献1)。また、超音波皮膚画像を画像解析装置に取り込んで皮膚年齢を推定する方法が知られている(特許文献2)。

従って、本発明の目的は、簡便且つ高精度で髪年齢を評価する方法を提供することにある。

[1]

対象者の髪の画像を解析して、髪のツヤ、うねり、ボリューム、色むらの各解析値を算出し、該各解析値に基づいて前記対象者の髪年齢を算出する、髪年齢評価方法。

[2]

前記対象者の髪年齢を算出する際に、

下記式(1):

Y(髪年齢)=α+β1×(標準化した髪のツヤ評価Vg)+β2×(標準化した髪のうねり評価Vw)+β3×(標準化した髪のボリューム評価Vv)+β4×(標準化した髪の色むら評価Vu)・・・(1)

(式(1)において、27.02≦α≦65.8、-12.20≦β1≦-3.40、2.40≦β2≦8.94、-6.96≦β3≦8.81、-4.94≦β4≦4.29である)

を用いる、[1]に記載の髪年齢評価方法。

[3]

畳み込みニューラルネットワークを用いて、対象者の髪の画像から、前記髪のツヤを算出する、[1]又は[2]に記載の髪年齢評価方法。

[4]

畳み込みニューラルネットワークを用いて、対象者の髪の画像から、前記髪のうねりを算出する、[1]~[3]のいずれかに記載の髪年齢評価方法。

[5]

畳み込みニューラルネットワークを用いて、対象者の髪の画像から、前記髪のボリュームを算出する、[1]~[4]のいずれかに記載の髪年齢評価方法。

[6]

畳み込みニューラルネットワークを用いて、対象者の髪の画像から、前記髪の色むらを算出する、[1]~[5]のいずれかに記載の髪年齢評価方法。

[7]

前記対象者の髪の画像を前記対象者の髪を撮影して取得し、

算出された前記対象者の髪年齢を画面に表示する、

[1]~[6]のいずれかに記載の髪年齢評価方法。

[8]

[1]~[7]のいずれかに記載の髪年齢評価方法により算出された前記対象者の髪年齢と、前記対象者に対する問診結果とに基づいて、ヘアケア製品又はヘアケアサービスを提案する方法。

[9]

対象者の髪のツヤを解析するツヤ解析部と、

対象者の髪のうねりを解析するうねり解析部と、

対象者の髪のボリュームを解析するボリューム解析部と、

対象者の髪の色むらを解析する色むら解析部と、

を含む解析部を含む、髪年齢評価装置。

[10]

前記解析部において、

下記式(1):

Y(髪年齢)=α+β1×(標準化した髪のツヤ評価Vg)+β2×(標準化した髪のうねり評価Vw)+β3×(標準化した髪のボリューム評価Vv)+β4×(標準化した髪の色むら評価Vu)・・・(1)

(式(1)において、27.02≦α≦65.8、-12.20≦β1≦-3.40、2.40≦β2≦8.94、-6.96≦β3≦8.81、-4.94≦β4≦4.29である)

を用いる、[9]に記載の髪年齢評価装置。

[11]

前記対象者の髪を撮影してその画像を取得する撮像部と、

算出された前記髪年齢を画面に表示する表示部と、

を含む、[9]又は[10]に記載の髪年齢評価装置。

[12]

[9]~[11]のいずれかに記載の髪年齢評価装置と、前記対象者に対する問診装置とを含む、ヘアケア製品又はヘアケアサービスを提案する装置。

[13]

畳み込みニューラルネットワークを用いて、対象者の髪の画像から、前記対象者の髪年齢を算出する、髪年齢評価方法。

本実施形態の髪年齢評価方法は、対象者の髪の画像を解析して、髪のツヤ、うねり、ボリューム、色むらの各解析値を算出し、該各解析値に基づいて上記対象者の髪年齢を算出する方法である。

下記式(1):

Y(髪年齢)=α+β1×(標準化した髪のツヤ評価Vg)+β2×(標準化した髪のうねり評価Vw)+β3×(標準化した髪のボリューム評価Vv)+β4×(標準化した髪の色むら評価Vu)・・・(1)

(式(1)において、27.02≦α≦65.8、-12.20≦β1≦-3.40、2.40≦β2≦8.94、-6.96≦β3≦8.81、-4.94≦β4≦4.29である)

を用いることが好ましい。

上記αは、上述の範囲のβ1、β2、β3、β4とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは27.02~39.73である。

上記β1は、上述の範囲のα、β2、β3、β4とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは-6.56~-3.40である。

上記β2は、上述の範囲のα、β1、β3、β4とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは5.59~8.94である。

上記β3は、上述の範囲のα、β1、β2、β4とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは-6.96~3.63、さらに好ましくは-4.31~3.63である。

上記β4は、上述の範囲のα、β1、β2、β3とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは-1.12~4.29である。

上記α、β1、β2、β3、β4は、専門家が複数の対象者を目視で観察して評価した髪年齢、及び後述の方法で算出した該複数の対象者の標準化後の髪のツヤ、標準化後の髪のうねり、標準化後の髪のボリューム及び標準化後の髪の色むらを用いて解析を行うことにより導くことができる。

上記算出式は、例えば、ランダムに抽出した10代~70代日本人女性200名の髪のツヤ、髪のうねり、髪のボリューム、髪の色むらを目視評価した結果及び後頭部撮影写真のデータセットを用い、多変量解析することにより求めることができる(使用ソフト:JMP14、独立変数の選択:ステップワイズ法)。

上記α、β1、β2、β3、β4を算出する際に使用する対象者の数としては、一層精度高く髪年齢を評価できる観点から、10名以上であることが好ましく、より好ましくは15名以上、さらに好ましくは20名以上、さらに好ましくは50名以上、特に好ましくは200名以上である。

上記β1は、上述の好適範囲のα、β2、β3、β4とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは-6.56~-3.40である。

上記β2は、上述の好適範囲のα、β1、β3、β4とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは5.59~8.94である。

上記β3は、上述の好適範囲のα、β1、β2、β4とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは-6.96~3.63、さらに好ましくは-4.31~3.63である。

上記β4は、上述の好適範囲のα、β1、β2、β3とともに用いることにより、一層誤差が小さく髪年齢を算出できる観点から、より好ましくは-1.12~4.29である。

上記画像は、背景を白色として撮像することが好ましい。

上記画像は、立位又は座位で撮像することが好ましい。

上記画像は、白色の服を着て撮像することが好ましく、対象者の髪、顔、以外の部分が白色の画像であることがより好ましい。

髪年齢、ツヤ、うねり、ボリューム、又は色むらの各種の算出に用いる全対象者の画像は、同じ条件で撮影した画像であることが好ましく、全種の算出において同じ条件で撮影した画像を用いることがより好ましい。

また、対象者の年齢も特に限定されない。

上記髪のツヤは、画像の輝度値を用いて算出してよい。中でも、一層正確にツヤを評価できる観点から、後述のツヤの算出方法i~iiiの方法で算出することが好ましく、後述のツヤの算出方法iで算出することがより好ましい。

上記髪のツヤは、1枚の上記後姿の画像から算出することが好ましい。

なお、目視によって評価したツヤは、後述の実施例に記載の方法により評価することができる。

本明細書において、髪輪郭は、Python言語によるプログラムにOpenCVライブラリを組み込み、OpenCV内の関数cv2.findContoursにより作成することができる。髪輪郭は、例えば、画面上で髪の輪郭をなぞって形成する等、他の方法で形成してもよい。

ツヤの測定において、対象者の背骨の方向(例えば、背側の正中線方向)をy方向とし、足側を正の方向、頭側を負の方向とする。また、画像中の髪の周囲を形作る線(本明細書において、「髪輪郭」と称する場合がある)上において、y方向に最も小さい位置のy座標をy_minとし、y方向に最も大きい位置のy座標をy_maxとする。ここで、y_minが複数ある場合は、最も正中線に近い位置のy座標をy_minとしてよい。

また、上記画像において、y方向に垂直な方向をx方向とする。画像の右を正の方向、左を負の方向とする。背側の正中線のx座標をx_0とし、上記髪輪郭において、x方向に最も小さい位置のx座標(最も左の座標)をx_min、x_minからx方向に最も大きい位置のx座標をx_maxとする。

y_100からy_maxまでのy方向長さを100%とし、y_100からy方向の正の方向に25%の位置のy座標をy_dp1、50%の位置のy座標をy_dp2、75%の位置のy座標をy_dp3とする(なお、100%の位置のy座標は、y_maxである)。また、y_100からy_maxまでのy方向長さを100%とし、y_100からy方向の正の方向に10%の位置のy座標をy_100A、y_dp1からy方向の正の方向に10%の位置のy座標をy_dp1A、y_dp2からy方向の正の方向に10%の位置のy座標をy_dp2Aとする。

座標(x_l、y_dp1)、(x_r、y_dp1)、(x_r、y_dp1A)、(x_l、y_dp1A)で囲まれた四角形領域を領域Bとする。

座標(x_l、y_dp2)、(x_r、y_dp2)、(x_r、y_dp2A)、(x_l、y_dp2A)で囲まれた四角形領域を領域Cとする。

座標(x_A’l、y_100)、(x_A’r、y_100)、(x_A’r、y_dp1)、(x_A’l、y_dp1)で囲まれた四角形領域を領域A’とする。

座標(x_B’l、y_dp1)、(x_B’r、y_dp1)、(x_B’r、y_dp2)、(x_B’l、y_dp2)で囲まれた四角形領域を領域B’とする。

座標(x_C’l、y_dp2)、(x_C’r、y_dp2)、(x_C’r、y_dp3)、(x_C’l、y_dp3)で囲まれた四角形領域を領域C’とする。

領域B’と領域C’とをあわせた領域を領域D’とする。

座標(x_l、y_100)、(x_r、y_100)、(x_A’r、y_dp1)、(x_A’l、y_dp1)で囲まれた四角形領域(台形状)を領域A’’とする。

座標(x_A’l、y_dp1)、(x_A’r、y_dp1)、(x_B’r、y_dp2)、(x_B’l、y_dp2)で囲まれた四角形領域(台形状)を領域B’’とする。

座標(x_B’l、y_dp2)、(x_B’r、y_dp2)、(x_C’r、y_dp3)、(x_C’l、y_dp3)で囲まれた四角形領域(台形状)を領域C’’とする。

領域B’と領域C’とをあわせた領域を領域D’’とする。

輝度は、例えば、領域内の任意の点(例えば10000~10000000点、好ましくは20000~5000000点、より好ましくは30000~1000000点)で測定してもよい。

上記輝度を測定する際の任意の点としては、例えば、領域を区画化して、各区画を一つの点としてもよい。例えば、領域A、B、Cは、領域をx方向に100~1000等分、y方向に100~1000等分して区画化し、各区画の輝度値を測定してよい。領域A’は、x方向に100~1000等分、y方向に100~1000等分して区画化すること以外、領域A~Cと同様にして各区画の輝度値を得てよい。領域B’は、x方向に100~1000等分、y方向に100~1000等分して区画化すること以外、領域A~Cと同様にして各区画の輝度値を得てよい。領域C’は、x方向に100~1000等分、y方向に100~1000等分すること以外、領域A~Cと同様にして各区画の輝度値を得てよい。例えば、画像がデジタル画像である場合、1つの区画は1画素としてもよい。なお、髪輪郭内に入らない区画がある場合、その区画を除いて測定してよい。

なお、上記各区画の輝度値は、各区画内の任意の2~20点(好ましくは10点)の輝度値を平均した値としてもよい。

上記輝度は、後述の実施例に記載の方法により測定することができる。

事前に、頭髪専門評価者が、200名以上の対象者の髪のツヤを目視で5段階に評価する。5の評価(非常に良好なツヤがあるの評価)の人数を「5の評価者数」、4の評価(良好なツヤがあるの評価)の人数を「4の評価者数」、3の評価(平均的なツヤがあるの評価)の人数を「3の評価者数」、2の評価(わずかにツヤがあるの評価)の人数を「2の評価者数」、1の評価(ツヤがないの評価)の人数を「1の評価者数」とする。ここで、上記対象者は、ランダムに選択した対象者とする。

次に、同じ対象者に対して、後述のツヤの算出方法により、輝度値の標準偏差等を対比した値等を算出する。そして、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も低い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

上記領域A、Bを、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。上記各区画の輝度値は、各区画内の10点の輝度値を測定し、その平均値をその区画の輝度値とする。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A及び領域Bのヒストグラムから、領域Aの標準偏差、領域Bの標準偏差を求め、「領域Aの標準偏差-領域Bの標準偏差」を求める。

得られた標準偏差の差を、上述の方法により変換して、標準化後のツヤVgを得る。

上記領域A、Cを、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。上記各区画の輝度値は、各区画内の10点の輝度値を測定し、その平均値をその区画の輝度値とする。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A及び領域Cのヒストグラムから、領域Aの標準偏差、領域Cの標準偏差を求め、「領域Aの標準偏差-領域Cの標準偏差」を求める。

得られた値を、上述の方法により変換して、標準化後のツヤVgを得る。

上記領域A’、B’を、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。上記各区画の輝度値は、各区画内の10点の輝度値を測定し、その平均値をその区画の輝度値とする。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A’及び領域B’のヒストグラムから、領域A’の標準偏差、領域B’の標準偏差を求め、「領域A’の標準偏差-領域B’の標準偏差」を求める。

得られた値を、上述の方法により変換して、標準化後のツヤVgを得る。

対象者の髪の画像から、畳み込みニューラルネットワーク(本明細書において、「CNN」と称する場合がある。)を用いて、ツヤを算出する。用いる画像としては、上述の画像が挙げられ、中でも対象者の後姿の画像1枚を用いることが好ましい。後述の教師あり学習を行う場合、学習に用いた髪の画像と同じ種類の入力データを用いることが好ましい。対象者の画像を入力し、CNNの出力として、標準化後のツヤVgを得ることができる。ツヤの算出方法ivにより、従来、頭髪専門評価者が、対象者の画像を目視して判定していたツヤを、簡易に、短時間で算出することができる。

上記CNNとしては、VGG16、AlexNet等を用いることができ、中でも、ツヤを一層精度よく算出できる観点から、VGG16が好ましい。

上記CNNは、事前に、教師あり学習をしてもよい。上記教師あり学習としては、以下の手順1~3による方法A、又は手順a~dによる方法B(即ち、クロスバリデーション)等が挙げられる。中でも、一層精度高くツヤを判定できる観点から、方法Bが好ましい。教師あり学習後に、対象者の画像からCNNが出力したツヤ値を、標準化後のツヤVgとしてよい。

上記教師あり学習としては、教師用対象者の髪の画像(例えば、教師用対象者の背後から撮像した髪画像)から頭髪専門評価者が教師用対象者の髪のツヤを目視で5段階に評価したツヤの評価値、及び該髪の画像を教師データとして用いることが好ましい。教師データの上記髪の画像としては、教師用対象者の背後から撮像した髪画像であることが好ましく、髪の画像中の上記髪輪郭、上記領域A~C、A’~C’、又はA’’~D’’であることがより好ましい。教師データの上記髪の画像は、1種であってもよいし複数種であってもよいが、より簡易にツヤを算出できる観点から、1種であることが好ましい。また、教師データの全教師用対象者の画像は、同じ条件(例えば、撮影時の明るさ、画素数、画像に対する髪輪郭の面積割合等の条件)で撮影した画像であることが好ましい。

<方法A>

(手順1)

頭髪専門評価者が、教師用対象者の髪の画像から、教師用対象者の髪のツヤを目視で5段階に評価する。CNNに、該髪の画像と、該評価値とを入力する。CNNを用いて、上記髪の画像の髪のツヤが、1~5の5段階のいずれであるか、標準化後のツヤの推測値Iの出力を得る。

(手順2)

上記推測ツヤ値Iと、頭髪専門評価者による評価値と、を比較する。

(手順3)

上記推測ツヤ値Iと、上記評価値とのずれが小さくなるように(例えば、上記推測ツヤ値Iと上記評価値とのずれが1以下となるように、又は上記推測ツヤ値Iと上記評価値とが一致するように)CNNのパラメータを調整する。上記調整は、上記評価値と上記推測ツヤ値Iとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。なお、上記確率値は、CNNが、推測ツヤ値Iが「1」である確率が100%と算出した場合「1」の確率値が1となり、「1」である確率が0%と算出した場合「1」の確率値が0となる値であって、1~5段階の確率値の合計が1となる値である。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順1~3を繰り返し、教師あり学習を終了する。

<方法B>

(手順a)

上記手順1と同様にして、髪の画像、及び頭髪専門評価者による該髪の画像の評価値、を用意する。全教師用対象者(例えば10名、好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の6~9割の任意の割合をトレーニングデータとし、残りの全てをテストデータとする(例えば、全教師用対象者数の8割をトレーニングデータ、2割をテストデータとする)。

(手順b)

上記トレーニングデータとした教師用対象者のうち一人の教師用対象者の髪の画像及び評価値をCNNに入力し、該一人の教師用対象者のツヤの推測値IIを得る。上記推測ツヤ値IIと、頭髪専門評価者による評価値と、を比較する。

上記推測ツヤ値IIと、上記評価値とのずれが小さくなるように(例えば、上記推測ツヤ値IIと上記評価値とのずれが1以下となるように、又は上記推測ツヤ値IIと上記評価値とが一致するように)CNNのパラメータを調整する。上記調整は、上記評価値と上記推測ツヤ値IIとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順を繰り返し、教師あり学習を終了する。

(手順c)

トレーニングデータとした全教師用対象者について、手順bを繰り返し、CNNのパラメータを調整する。テストデータとした全教師用対象者について、CNNによるツヤ出力値と、頭髪専門評価者による評価値とを比較し、十分な精度に達したと判断した時点で、学習を終了する。上記十分な精度に達したときとは、例えば、テストデータの全教師用対象者について、上記評価値と上記ツヤ出力値との一致率が0.6以上となったとき、等が挙げられる。なお、上記一致率とは、テストデータの全教師用対象者のうち、上記評価値と上記ツヤ出力値とが一致する対象者の数の割合であり、一致する対象者の割合が60%であるとき、一致率を0.6とする。

(手順d)

さらなる学習が必要と判断した場合は、手順aと同じ割合で、教師用対象者全員を、再度、トレーニングデータとテストデータとに分類し、上記手順a~cを繰り返してもよい。トレーニングデータとテストデータとの分類は、過去にテストデータに分類した教師用対象者はトレーニングデータとし、これまでにテストデータに用いたことがない教師用対象者をテストデータとすることが好ましい。全教師用対象者を少なくとも1回テストデータとするまで(例えば、テストデータの割合が2割である場合は5回以上繰り返すまで)上記手順a~cを繰り返し、精度を確認してもよい。

上記うねりは、画像の輝度値を用いて算出してよい。中でも、一層正確にうねりを評価できる観点から、後述のうねりの算出方法i~xviの方法で算出することが好ましく、後述のうねりの算出方法iで算出することがより好ましい。

上記うねりは、1枚の上記後姿の画像から算出することが好ましい。

なお、目視によって評価したうねりは、後述の実施例に記載の方法により評価することができる。

事前に、頭髪専門評価者が、200名以上の対象者の髪のうねりを目視で5段階に評価する。5の評価(うねりの頻度が高い、あるいはうねり毛の量が多い)の人数を「5の評価者数」、4の評価(うねりの頻度が比較的高い、又はうねり毛の量が比較的多い)の人数を「4の評価者数」、3の評価(うねりの頻度が中程度、又はうねり毛の量が中程度)の人数を「3の評価者数」、2の評価(うねりの頻度が比較的低い、又はうねり毛の量が比較的少ない)の人数を「2の評価者数」、1の評価(うねりの頻度が低い、又はうねり毛の量が少ない)の人数を「1の評価者数」とする。ここで、上記対象者は、ランダムに選択した対象者とする。

次に、同じ対象者に対して、後述のうねりの算出方法により、標準偏差等を算出する。そして、算出方法i~iiiでは、該値が低い順に並べ、最低値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が低い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が低い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が低い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も高い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。算出方法iv~xviでは、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も低い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

また、上記画像において、y方向に垂直な方向をx方向とする。画像の右を正の方向、左を負の方向とする。

上記後姿の画像を、グレースケールに変換し、閾値110で二値化する。上記後姿の画像において、Python言語によるプログラムにOpenCVライブラリを組み込み、OpenCV内の関数cv2.findContoursにより、髪輪郭を作成し、OpenCV内の関数cv2.contourAreaにより、輪郭抽出面積を算出する。続いて、該画像において、OpenCV内の関数cv2.arcLengthにより、輪郭の周囲の長さを算出する。

変換後の画像において、y_minからy_topまでのy方向長さを100%とし、y_topからy方向の負の方向に10%の位置のy座標をy_100、y_100からy方向の負の方向に20%の位置のy座標をy_100+200とする。

上記後姿の画像において、y座標がy_100であるx方向に平行な直線と上記髪輪郭との交点のうちx方向に最も小さい交点のx座標をx_l_0、x方向に最も大きい交点のx座標をx_r_0とする。また、x_l_0とx_r_0との中間点のx座標をx_c_0とする。また、x_l_0からx_r_0までのx方向長さを100%とし、x_c_0からx方向の負の方向に10%の位置のx座標をx_c_0-100、x_c_0からx方向の正の方向に10%の位置のx座標をx_c_0+100とする。

座標(x_c_0-100、y_100)、(x_c_0+100、y_100)、(x_c_0-100、y_100+200)、(x_c_0+100、y_100+200)で囲まれた四角形領域を領域Aとする。

xdp=((x_l_0)から(x_r_0)までのx方向長さ)/50

x_l_0からx方向の正の方向にxdpの位置のx座標をx_dp1、x_dp1からx方向の正の方向にxdpの位置のx座標をx_dp2として、x座標x_dp1~x_dp50を定める。ここで、x座標x_dp50は、x座標x_r_0である。

座標(x_dp1、y_100)を通るy方向と平行な直線と髪輪郭との交点のうちy方向に最も小さい交点のy座標をy_dp1_min、最も大きい交点のy座標をy_dp1_maxとし、y_dp1_minからy_dp1_maxまでのy方向長さを2400等分して2400個の線分を作成する。y_dp1_maxからy方向の負の方向に順に、各線分について輝度値を測定する。上記各線分の輝度値は、各線分内の任意の10点の輝度値を平均した値としてよい。線分の輝度値が、上記閾値より大きい線分を白色線分、上記閾値より小さい線分を黒色線分と判定する。y方向の負の方向に、白色線分が40個連続して存在する箇所を抽出し、40個連続して存在する該箇所の始点のy座標をy_dp1_startとする。白色線分が40個連続して存在する上記箇所からy方向の負の方向であって、黒色線分が40個連続して存在する箇所を抽出し、40個連続して存在する該箇所の始点のy座標をy_dp1_endとする。そして、y_dp1_startからy_dp1_endまでのy方向長さを算出する。

ここで、白色線分がy方向の負の方向に40個連続して存在する箇所、黒色線分がy方向の負の方向に40個連続して存在する箇所が複数存在する場合は、最もy方向に大きい位置に存在する箇所を用いる。また、白色線分がy方向の負の方向に40個連続して存在する箇所、黒色線分がy方向の負の方向に40個連続して存在する箇所が存在しない場合は、ブランクを記録する。

x_dp2~x_dp50についても同様に、y_dpn_startからy_dpn_endまでのy方向の長さ(nは、2~50の整数を表す)を算出し、合計50個の値(ブランクを含んでよい)を算出する。

得られた50個の値から、ブランクの数、標準偏差、標準偏差の最大値から最小値を引いた差分を算出する。

得られた標準偏差を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法iで求めたブランクの数を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法iで求めた標準偏差の最大値から最小値を引いた差分を、上述の方法により変換して、標準化後のうねりVwを得る。

上記後姿の画像を、グレースケールに変換し、閾値110で二値化する。

上記後姿の画像において、Python言語によるプログラムにOpenCVライブラリを組み込み、OpenCV内の関数cv2.findContoursにより、髪輪郭を作成し、OpenCV内の関数cv2.contourAreaにより、輪郭抽出面積を算出する。続いて、該画像において、OpenCV内の関数cv2.arcLengthにより、輪郭の周囲の長さを算出する。

(上記輪郭の周囲の長さ)/(輪郭抽出面積)を算出する。

得られた値を上述の方法により変換して、標準化後のうねりVwを得る。

上記髪輪郭において、y方向に最も大きい位置のy座標をy_topとする。y_minからy_topまでのy方向長さを100%とし、y_topからy方向の負の方向に10%の点_200のy座標をy_top-200とする。

また、y座標がy_top_200であるx方向に平行な直線(x軸_top-200)と上記髪輪郭との交点のうち、x方向に最も小さい交点のx座標をx_l_top-200、x方向に最も大きい交点のx座標をx_r_top-200とする。また、上記後姿の画像の最左端のx座標をx_ml、最右端のx座標をx_mrとする。なお、画像の最左端及び最右端は、対象者の髪よりも左側又は右側であり、背景に相当する。

x_mlからx_l_top-200までの各区分の輝度値の平均輝度値A及び標準偏差Aを算出し、以下の式からLaを算出する。

La=平均輝度値A-標準偏差A

また、x_l_top-200からx_r_top-200までの各区分の輝度値の平均輝度値B及び標準偏差Bを算出し、以下の式からLbを算出する。

Lb=平均輝度値B+標準偏差B

また、x_r_top-200からx_mrまでの各区分の輝度値の平均輝度値C及び標準偏差Cを算出し、以下の式からLcを算出する。

Lc=平均輝度値C-標準偏差C

そして、以下の式により、y方向の長さydを求める。

yd=(y_topからy_endpointまでのy方向長さ)/50

y_top-200からy方向の負の方向にydの位置のy座標をy_top-200_d1、y_top-200_d1からy方向の負の方向にydの位置のy座標をy_top-200_d2として、y_top-200_d1~y_top-200_d50を定める。

y座標がy_top-200_d1~y_top-200_d50についても、上記と同様にして、x_abからx_aaまでのx方向長さ、及びx_ccからx_cbまでのx方向長さを算出する。

50個のx_abからx_aaまでのx方向長さの値から、最大値、最小値、平均値、標準偏差、最頻値、中央値を算出する。

50個のx_ccからx_cbまでのx方向長さの値から、最大値、最小値、平均値、標準偏差、最頻値、中央値を算出する。

そして、得られたx_abからx_aaまでのx方向長さの最大値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの最小値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの平均値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの標準偏差を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの最頻値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの中央値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最大値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最小値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの平均値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの標準偏差を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最頻値を、上述の方法により変換して、標準化後のうねりVwを得る。

上記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの中央値を、上述の方法により変換して、標準化後のうねりVwを得る。

対象者の髪の画像から、畳み込みニューラルネットワークを用いて、うねりを算出する。用いる画像としては、上述の画像が挙げられ、中でも対象者の後姿の画像1枚を用いることが好ましい。後述の教師あり学習を行う場合、学習に用いた髪の画像と同じ種類の入力データを用いることが好ましい。対象者の画像を入力し、CNNの出力として、標準化後のうねりVwを得ることができる。うねりの算出方法xviiにより、従来、頭髪専門評価者が、対象者の画像を目視して判定していたうねりを、簡易に、短時間で算出することができる。

上記CNNとしては、VGG16、AlexNet等を用いることができ、中でも、うねりを一層精度よく算出できる観点から、VGG16が好ましい。

上記CNNは、事前に、教師あり学習をしてもよい。上記教師あり学習としては、以下の手順1~3による方法A、又は手順a~dによる方法B(即ち、クロスバリデーション)等が挙げられる。中でも、一層精度高くうねりを判定できる観点から、方法Bが好ましい。教師あり学習後に、対象者の画像からCNNが出力したうねり値を、標準化後のうねりVwとしてよい。

上記教師あり学習としては、教師用対象者の髪の画像(例えば、教師用対象者の背後から撮像した髪画像)から頭髪専門評価者が教師用対象者の髪のうねりを目視で5段階に評価したうねりの評価値、及び該髪の画像を教師データとして用いることが好ましい。教師データの上記髪の画像としては、教師用対象者の背後から撮像した髪画像であることが好ましく、髪の画像中の上記髪輪郭、又は上記領域Aであることがより好ましい。教師データの上記髪の画像は、1種であってもよいし複数種であってもよいが、より簡易にうねりを算出できる観点から、1種であることが好ましい。また、教師データの全教師用対象者の画像は、同じ条件(例えば、撮影時の明るさ、画素数、画像に対する髪輪郭の面積割合等の条件)で撮影した画像であることが好ましい。

<方法A>

(手順1)

頭髪専門評価者が、教師用対象者の髪の画像から、教師用対象者の髪のうねりを目視で5段階に評価する。CNNに、該髪の画像と、該評価値とを入力する。CNNを用いて、上記髪の画像の髪のうねりが、1~5の5段階のいずれであるか、標準化後のうねりの推測値Iの出力を得る。

(手順2)

上記推測うねり値Iと、頭髪専門評価者による評価値と、を比較する。

(手順3)

上記推測うねり値Iと、上記評価値とのずれが小さくなるように(例えば、上記推測うねり値Iと上記評価値とのずれが1以下となるように、又は上記推測うねり値Iと上記評価値とが一致するように)CNNのパラメータを調整する。上記調整は、上記評価値と上記推測うねり値Iとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順1~3を繰り返し、教師あり学習を終了する。

<方法B>

(手順a)

上記手順1と同様にして、髪の画像、及び頭髪専門評価者による該髪の画像の評価値、を用意する。全教師用対象者(例えば10名、好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の6~9割の任意の割合をトレーニングデータとし、残りの全てをテストデータとする(例えば、全教師用対象者数の8割をトレーニングデータ、2割をテストデータとする)。

(手順b)

上記トレーニングデータとした教師用対象者のうち一人の教師用対象者の髪の画像及び評価値をCNNに入力し、該一人の教師用対象者のうねりの推測値IIを得る。上記推測うねり値IIと、頭髪専門評価者による評価値と、を比較する。

上記推測うねり値IIと、上記評価値とのずれが小さくなるように(例えば、上記推測うねり値IIと上記評価値とのずれが1以下となるように、又は上記推測うねり値IIと上記評価値とが一致するように)CNNのパラメータを調整する。上記調整は、上記評価値と上記推測うねり値IIとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順を繰り返し、教師あり学習を終了する。

(手順c)

トレーニングデータとした全教師用対象者について、手順bを繰り返し、CNNのパラメータを調整する。テストデータとした全教師用対象者について、CNNによるうねり出力値と、頭髪専門評価者による評価値とを比較し、十分な精度に達したと判断した時点で、学習を終了する。上記十分な精度に達したときとは、例えば、テストデータの全教師用対象者について、上記評価値と上記うねり出力値との一致率が0.6以上となったとき、等が挙げられる。

(手順d)

さらなる学習が必要と判断した場合は、手順aと同じ割合で、教師用対象者全員を、再度、トレーニングデータとテストデータとに分類し、上記手順a~cを繰り返しても良い。トレーニングデータとテストデータとの分類は、過去にテストデータに分類した教師用対象者はトレーニングデータとし、これまでにテストデータに用いたことがない教師用対象者をテストデータとすることが好ましい。全教師用対象者を少なくとも1回テストデータとするまで(例えば、テストデータの割合が2割である場合は5回以上繰り返すまで)上記手順a~cを繰り返し、精度を確認してもよい。

上記ボリュームは、画像の輝度値を用いて算出してよい。中でも、一層正確にボリュームを評価できる観点から、後述のボリュームの算出方法i~vの方法で算出することが好ましく、後述のボリュームの算出方法iで算出することがより好ましい。

上記ボリュームは、1枚の前姿の画像及び1枚の後姿の画像から算出することが好ましく、一層簡易に髪年齢を評価する観点から、1枚の上記後姿の画像から算出することがより好ましい。

なお、目視によって評価したボリュームは、後述の実施例に記載の方法により評価することができる。

ボリュームの測定において、対象者の背骨の方向(例えば、背側の正中線方向)をy方向とし、頭側を正の方向、足側を負の方向とする。また、画像中の髪の周囲を形作る線で覆われた領域(すなわち、髪輪郭)において、y方向に最も大きい位置のy座標をy_maxとし、y方向に最も小さい位置のy座標をy_minとする。ここで、y_maxが複数ある場合は、最も正中線に近い位置のy座標をy_maxとしてよい。また、y方向に垂直な方向をx方向とし、画像の右を正の方向、左を負の方向とする。

上記後姿の画像において、y座標がy_10%であるx方向に平行な直線と上記輪郭との交点のうちx方向に最も小さい位置のx座標をx_10%l、x方向に最も大きい位置のx座標をx_10%rとする。そして、x_10%lとx_10%rとの間のx方向長さを、10%位置幅とする。(図4(a))

そして、点CRから点BRまでの長さをrbc、点BRから点ARまでの長さをrab、点CLから点BLまでの長さをlbc、点BLから点ALまでの長さをlab、とする。

上記点ARは画像処理を用いて、眉部分を抽出することで取得する。得られた点ARのx座標をx_a、y座標をy_aとする。また、点ARのy方向に平行な直線と画像外端との交点をDR(x_a、y_highest)とする。

点ARから点DRまでの長さを100として、点ARからy軸正方向に10の長さの線分を引き、その線分上の輝度値の平均値L_350を算出する。

上記L_350を閾値として、画像を二値化して、画像1を得る。そして、点ARから点DRまで線分を500等分し、等分後の各線分の輝度値を、点DRからy方向の負の方向に順に測定する。線分の輝度値が、上記閾値L_350よりも大きい線分を白色線分、上記閾値L_350より小さい線分を黒色線分とし、黒色線分が20個連続して存在する箇所の始点ER(x_a、y_c)を得る。

点ERから点ARまでの長さを100として、点ARからy軸正方向に10の長さの線分を引き、線分上の輝度値の平均値L_y_c_y_aを算出する。

上記L_y_c_y_aを閾値として、画像を二値化して、画像2を得る。そして、点ARから点ERまで線分を500等分し、等分後の各線分の輝度値を、点ERからy方向の負の方向に順に測定する。線分の輝度値が、上記閾値L_y_c_y_aよりも大きい線分を白色線分、上記閾値L_350より小さい線分を黒色線分とし、白色線分が20個連続して存在する箇所の始点FR(x_a、y_b)を得る。

そして、「(点ARと点FRとのy方向長さ)/(点FRと点ERとのy方向長さ)」を算出する。

同様にして、左側眉についても、点AL、FL、ELを求め、「(点ALと点FLとのy方向長さ)/(点FLと点ELとのy方向長さ)」を算出する。

事前に、頭髪専門評価者が、200名以上の対象者の髪のボリュームを目視で5段階に評価する。5の評価(ボリュームが最も大きい評価)の人数を「5の評価者数」、4の評価(ボリュームがやや大きい評価)の人数を「4の評価者数」、3の評価(ボリュームが普通の評価)の人数を「3の評価者数」、2の評価(ボリュームがやや小さい評価)の人数を「2の評価者数」、1の評価(ボリュームが最も小さい評価)の人数を「1の評価者数」とする。ここで、上記対象者は、ランダムに選択した対象者とする。

次に、同じ対象者に対して、後述のボリュームの算出方法により、10%位置幅を最大幅で除した値等を算出する。そして、後述のボリュームの算出方法i、iii、ivでは、該値が低い順に並べ、最低値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が低い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が低い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が低い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も高い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。また、ボリュームの算出方法ii、vでは、値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も低い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

上記10%位置幅を上記最大幅で除した値(10%位置幅/最大幅)を算出し、上述の方法により変換して、標準化後のボリュームVvを得る。

上記長さlbcを上記長さlabで除した値(lbc/lab)を算出し、l_ratioを求める。上記長さrbcを上記長さrabで除した値(rbc/rab)を算出し、r_ratioを求める。そして、上記l_ratioと上記r_ratioとの平均ave_ratioを算出し、上述の方法により変換して、標準化後のボリュームVvを得る。

上記10%位置幅を上記最大幅で除した値(10%位置幅/最大幅)と、上記平均ave_ratioとの和を算出し、上述の方法により変換して、標準化後のボリュームVvを得る。

上記10%位置幅を上記最大幅で除した値(10%位置幅/最大幅)と、上記平均ave_ratioとを乗じた値を算出し、上述の方法により変換して、標準化後のボリュームVvを得る。

上記「(点ARと点FRとのy方向長さ)/(点FRと点ERとのy方向長さ)」と、「(点ALと点FLとのy方向長さ)/(点FLと点ELとのy方向長さ)」との平均値を算出し、上述の方法により変換して、標準化後のボリュームVvを得る。

対象者の髪の画像から、畳み込みニューラルネットワーク(本明細書において、「CNN」と称する場合がある。)を用いて、ボリュームを算出する。用いる画像としては、上述の画像が挙げられ、中でも対象者の後姿の画像1枚を用いることが好ましい。後述の教師あり学習を行う場合、学習に用いた髪の画像と同じ種類の入力データを用いることが好ましい。対象者の画像を入力し、CNNの出力として、標準化後のボリュームVvを得ることができる。ボリュームの算出方法viにより、従来、頭髪専門評価者が、対象者の画像を目視して判定していたボリュームを、簡易に、短時間で算出することができる。

上記CNNとしては、VGG16、AlexNet等を用いることができ、中でも、ボリュームを一層精度よく算出できる観点から、VGG16が好ましい。

上記CNNは、事前に、教師あり学習をしてもよい。上記教師あり学習としては、以下の手順1~3による方法A、又は手順a~dによる方法B(即ち、クロスバリデーション)等が挙げられる。中でも、一層精度高くボリュームを判定できる観点から、方法Bが好ましい。教師あり学習後に、対象者の画像からCNNが出力したボリューム値を、標準化後のボリュームVvとしてよい。

上記教師あり学習としては、教師用対象者の髪の画像(例えば、教師用対象者の背後から撮像した髪画像)から頭髪専門評価者が教師用対象者の髪のボリュームを目視で5段階に評価したボリュームの評価値、及び該髪の画像を教師データとして用いることが好ましい。教師データの上記髪の画像としては、教師用対象者の背後から撮像した髪画像であることが好ましく、髪の画像中の上記髪輪郭であることがより好ましい。教師データの上記髪の画像は、1種であってもよいし複数種であってもよいが、より簡易にボリュームを算出できる観点から、1種であることが好ましい。また、教師データの全教師用対象者の画像は、同じ条件(例えば、撮影時の明るさ、画素数、画像に対する髪輪郭の面積割合等の条件)で撮影した画像であることが好ましい。

<方法A>

(手順1)

頭髪専門評価者が、教師用対象者の髪の画像から、教師用対象者の髪のボリュームを目視で5段階に評価する。CNNに、該髪の画像と、該評価値とを入力する。CNNを用いて、上記髪の画像の髪のボリュームが、1~5の5段階のいずれであるか、標準化後のボリュームの推測値Iの出力を得る。

(手順2)

上記推測ボリューム値Iと、頭髪専門評価者による評価値と、を比較する。

(手順3)

上記推測ボリューム値Iと、上記評価値とのずれが小さくなるように(例えば、上記推測ボリューム値Iと上記評価値とのずれが1以下となるように、又は上記推測ボリューム値Iと上記評価値とが一致するように)CNNのパラメータを調整する。上記調整は、上記評価値と上記推測ボリューム値Iとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。なお、上記確率値は、CNNが、推測ボリューム値Iが「1」である確率が100%と算出した場合「1」の確率値が1となり、「1」である確率が0%と算出した場合「1」の確率値が0となる値であって、1~5段階の確率値の合計が1となる値である。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順1~3を繰り返し、教師あり学習を終了する。

<方法B>

(手順a)

上記手順1と同様にして、髪の画像、及び頭髪専門評価者による該髪の画像の評価値、を用意する。全教師用対象者(例えば10名、好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の6~9割の任意の割合をトレーニングデータとし、残りの全てをテストデータとする(例えば、全教師用対象者数の8割をトレーニングデータ、2割をテストデータとする)。

(手順b)

上記トレーニングデータとした教師用対象者のうち一人の教師用対象者の髪の画像及び評価値をCNNに入力し、該一人の教師用対象者のボリュームの推測値IIを得る。上記推測ボリューム値IIと、頭髪専門評価者による評価値と、を比較する。

上記推測ボリューム値IIと、上記評価値とのずれが小さくなるように(例えば、上記推測ボリューム値IIと上記評価値とのずれが1以下となるように、又は上記推測ボリューム値IIと上記評価値とが一致するように)CNNのパラメータを調整する。上記調整は、上記評価値と上記推測ボリューム値IIとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順を繰り返し、教師あり学習を終了する。

(手順c)

トレーニングデータとした全教師用対象者について、手順bを繰り返し、CNNのパラメータを調整する。テストデータとした全教師用対象者について、CNNによるボリューム出力値と、頭髪専門評価者による評価値とを比較し、十分な精度に達したと判断した時点で、学習を終了する。上記十分な精度に達したときとは、例えば、テストデータの全教師用対象者について、上記評価値と上記ボリューム出力値との一致率が0.6以上となったとき、等が挙げられる。

(手順d)

さらなる学習が必要と判断した場合は、手順aと同じ割合で、教師用対象者全員を、再度、トレーニングデータとテストデータとに分類し、上記手順a~cを繰り返しても良い。トレーニングデータとテストデータとの分類は、過去にテストデータに分類した教師用対象者はトレーニングデータとし、これまでにテストデータに用いたことがない教師用対象者をテストデータとすることが好ましい。全教師用対象者を少なくとも1回テストデータとするまで(例えば、テストデータの割合が2割である場合は5回以上繰り返すまで)上記手順a~cを繰り返し、精度を確認してもよい。

上記色むらは、画像の色相値、又は彩度値を用いて算出してよい。中でも、一層正確に色むらを評価できる観点から、後述の色むらの算出方法i~xxxiiの方法で算出することが好ましく、後述の色むらの算出方法iで算出することがより好ましい。

上記色むらは、1枚の上記後姿の画像から算出することが好ましい。

なお、目視によって評価した色むらは、後述の実施例に記載の方法により評価することができる。

上記後姿の画像の、髪の周囲を形作る線で覆われた領域(すなわち、髪輪郭)において、y方向に最も大きい点のy座標をy_maxとし、y方向に最も小さい点のy座標をy_minとする。y_minからy_maxまでのy方向長さを100%とし、y_minからy方向の正の方向に10%の位置のy座標をy_230とし、25%の位置のy座標をy_25%とする。

事前に、頭髪専門評価者が、200名以上の対象者の髪の色むらを目視で5段階に評価する。5の評価(色むらが劣る評価)の人数を「5の評価者数」、4の評価(色むらが若干劣る評価)の人数を「4の評価者数」、3の評価(色むらが普通の評価)の人数を「3の評価者数」、2の評価(色むらが良好の評価)の人数を「2の評価者数」、1の評価(色むらが最も良好な評価)の人数を「1の評価者数」とする。ここで、上記対象者は、ランダムに選択した対象者とする。

次に、同じ対象者に対して、後述の色むらの算出方法により、標準偏差等を算出する。そして、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、最も該値が低い「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

対象者の後姿の画像を、RGBからHSV空間に変換した画像1を作成する。HSV空間への変換は、Python言語によるプログラムにOpenCVライブラリを組み込み、OpenCV内の関数cvtColor関数を使用し、二つ目の引数をCV_BGR2HSVに変更して形成してよい。

また、対象者の後姿の画像を、グレースケールに変換し、閾値110で二値化した画像1-2を得る。

上記画像1-2において、y座標がy_25%であるx方向に平行な直線と上記髪輪郭との交点のうち、x方向に最も小さい交点のx座標をx_left_25%v、x方向に最も大きい交点のx座標をx_right_25%vとする。x_left_25%vからx_right_25%vまでのx方向長さを50等分し、以下の長さxdp25%vを算出する。

xdp25%v=(x_left_25%vからx_right_25%vまでのx方向長さ)/50

そして、x_left_25%vからx方向の正の方向にxdp25%vの位置のx座標をx_25%v_1、x_25%v_1からx方向の正の方向にxdp25%vの位置のx座標をx_25%v_2として、x座標x_25%v_1~x_25%v_50を定める。ここで、x座標x_25%v_50は、x座標x_right_25%vである。

x座標がx_25%v_1であるy方向に平行な直線と上記髪輪郭との交点のうち、y方向に最も大きい交点のy座標をy_25%v_1とする。座標(x_25%v_1、y_25%)を始点とし、座標(x_25%v_1、y_25%v_1)を終点とする線分1を50等分し、50個に区画化する。上記画像1において、各区画について色相を測定し、線分1の各区画の色相値から、最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。なお、上記各区画の色相値は、各区画内の任意の10点の色相値を平均した値としてもよい。

x_25%v_2~x_25%v_50についても同様に、線分の各区画の色相値の最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。

得られた50個の標準偏差値の平均値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法iで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法iで得られた50個の平均値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法iで得られた50個の中央値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

対象者の後姿の画像を、RGBからHSV空間に変換した画像2を作成する。HSV空間への変換は、Python言語によるプログラムにOpenCVライブラリを組み込み、OpenCV内の関数cvtColor関数を使用し、二つ目の引数をCV_BGR2HSVに変更して形成してよい。

また、対象者の後姿の画像を、グレースケールに変換し、閾値110で二値化した画像2-2を得る。

上記画像2-2において、y座標がy_230であるx方向に平行な直線と上記髪輪郭との交点のうち、x方向に最も小さい交点のx座標をx_left_230v、x方向に最も大きい交点のx座標をx_right_230vとする。x_left_230vからx_right_230vまでのx方向長さを50等分し、以下の長さxdp230vを算出する。

xdp230v=(x_left_230vからx_right_230vまでのx方向長さ)/50

そして、x_left_230vからx方向の正の方向にxdp230vの位置のx座標をx_230v_1、x_230v_1からx方向の正の方向にxdp230vの位置のx座標をx_230v_2として、x座標x_230v_1~x_230v_50を定める。ここで、x座標x_230v_50は、x座標x_right_230vである。

x座標がx_230v_1であるy方向に平行な直線と上記髪輪郭との交点のうち、y方向に最も大きい交点のy座標をy_230v_1とする。座標(x_230v_1、y_230)を始点とし、座標(x_230v_1、y_230v_1)を終点とする線分2を50等分し、50個に区画化する。上記画像2において、各区画について色相を測定し、線分2の各区画の色相値から、最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。なお、上記各区画の色相値は、各区画内の任意の10点の色相値を平均した値としてもよい。

x_230v_2~x_230v_50についても同様に、線分の各区画の色相値の最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。

得られた50個の標準偏差値の平均値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法vで得られた50個の最大値の平均値及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法vで得られた50個の平均値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法vで得られた50個の中央値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

対象者の後姿の画像を、RGBからHSV空間に変換した画像4を作成する。HSV空間への変換は、Python言語によるプログラムにOpenCVライブラリを組み込み、OpenCV内の関数cvtColor関数を使用し、二つ目の引数をCV_BGR2HSVに変更して形成してよい。

また、対象者の後姿の画像を、グレースケールに変換し、閾値110で二値化した画像4-2を得る。

上記画像4-2において、y_25%からy_maxまでのy方向長さを50等分し、以下の長さydp25%sを算出する。

ydp25%s=(y_25%からy_maxまでのy方向長さ)/50

そして、y_25%からy方向の正の方向にydp25%sの位置のy座標をy_25%s_1、y_25%s_1からy方向の正の方向にydp25%sの位置のy座標をy_25%s_2として、y座標y_25%s_1~y_25%s_50を定める。ここで、y座標y_25%s_50は、y座標y_maxである。

y座標がy_25%s_1であるx方向に平行な直線と上記髪輪郭との交点のうち、x方向に最も大きい交点のx座標をx_right_25%s_1、x方向に最も小さい交点のx座標をx_left_25%s_1とする。座標(x_left_25%s_1、y_25%s_1)を始点とし、座標(x_right_25%s_1、y_25%s_1)を終点とする線分4を50等分し、50個に区画化する。上記画像4において、各区画について色相を測定し、線分4の各区画の色相値から、最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。なお、上記各区画の色相値は、各区画内の任意の10点の色相値を平均した値としてもよい。

y_25%s_2~y_25%s_50についても同様に、線分の各区画の色相値の最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。

得られた50個の標準偏差値の平均値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法ixで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法ixで得られた50個の平均値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法ixで得られた50個の中央値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

対象者の後姿の画像を、RGBからHSV空間に変換した画像3を作成する。HSV空間への変換は、Python言語によるプログラムにOpenCVライブラリを組み込み、OpenCV内の関数cvtColor関数を使用し、二つ目の引数をCV_BGR2HSVに変更して形成してよい。

また、対象者の後姿の画像を、グレースケールに変換し、閾値110で二値化した画像3-2を得る。

上記画像3-2において、y_230からy_maxまでのy方向長さを50等分し、以下の長さydp230sを算出する。

ydp230s=(y_230からy_maxまでのy方向長さ)/50

そして、y_230からy方向の正の方向にydp230sの位置のy座標をy_230s_1、y_230s_1からy方向の正の方向にydp230sの位置のy座標をy_230s_2として、y座標y_230s_1~y_230s_50を定める。ここで、y座標y_230s_50は、y座標y_maxである。

y座標がy_230s_1であるx方向に平行な直線と上記髪輪郭との交点のうち、x方向に最も大きい交点のx座標をx_right_230s_1、x方向に最も小さい交点のx座標をx_left_230s_1とする。座標(x_left_230s_1、y_230s_1)を始点とし、座標(x_right_230s_1、y_230s_1)を終点とする線分3を50等分し、50個に区画化する。上記画像3において、各区画について色相を測定し、線分3の各区画の色相値から、最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。なお、上記各区画の色相値は、各区画内の任意の10点の色相値を平均した値としてもよい。

y_230s_2~y_230s_50についても同様に、線分の各区画の色相値の最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。

得られた50個の標準偏差値の平均値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xiiiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xiiiで得られた50個の平均値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xiiiで得られた50個の中央値の標準偏差を求め上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法iと同様にして、座標(x_25%v_1、y_25%)を始点とし、座標(x_25%v_1、y_25%v_1)を終点とする線分1を50等分し、50個に区画化する。上記画像1において、各区画について彩度を測定し、線分1の各区画の彩度値から、最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。なお、上記各区画の彩度値は、各区画内の任意の10点の彩度値を平均した値としてもよい。

x_25%v_2~x_25%v_50についても同様に、線分の各区画の彩度値の最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。

得られた50個の標準偏差値の平均値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

なお、彩度は対象者の後姿の画像を、RGBからHSV空間に変換した画像を作成する。HSV空間への変換は、Python言語によるプログラムにOpenCVライブラリを組み込み、OpenCV内の関数cvtColor関数を使用し、二つ目の引数をCV_BGR2HSVに変更することにより取得できる。

上記色むらの算出方法xviiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xviiで得られた50個の平均値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xviiで得られた50個の中央値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法vと同様にして、座標(x_230v_1、y_230)を始点とし、座標(x_230v_1、y_230v_1)を終点とする線分2を50等分し、50個に区画化する。上記画像2において、各区画について彩度を測定し、線分2の各区画の彩度値から、最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。なお、上記各区画の彩度値は、各区画内の任意の10点の彩度値を平均した値としてもよい。

x_230v_2~x_230v_50についても同様に、線分の各区画の彩度値の最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。

得られた50個の標準偏差値の平均値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxiで得られた50個の平均値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxiで得られた50個の中央値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法ixと同様にして、座標(x_left_25%s_1、y_25%s_1)を始点とし、座標(x_right_25%s_1、y_25%s_1)を終点とする線分4を50等分し、50個に区画化する。上記画像4において、各区画について彩度を測定し、線分4の各区画の彩度値から、最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。なお、上記各区画の彩度値は、各区画内の任意の10点の彩度値を平均した値としてもよい。

y_25%s_2~y_25%s_50についても同様に、線分の各区画の彩度値の最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。

得られた50個の標準偏差値の平均値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxvで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxvで得られた50個の平均値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxvで得られた50個の中央値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xiiiと同様にして、座標(x_left_230s_1、y_230s_1)を始点とし、座標(x_right_230s_1、y_230s_1)を終点とする線分3を50等分し、50個に区画化する。上記画像3において、各区画について彩度を測定し、線分3の各区画の彩度値から、最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。なお、上記各区画の彩度値は、各区画内の任意の10点の彩度値を平均した値としてもよい。

y_230s_2~y_230s_50についても同様に、線分の各区画の彩度値の最大値、最小値、平均値、標準偏差、中央値、最頻値を求める。

得られた50個の標準偏差値の平均値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxixで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxixで得られた50個の平均値の標準偏差を求め、上述の方法により変換して、標準化後の色むらVuを得る。

上記色むらの算出方法xxixで得られた50個の中央値の標準偏差を求め上述の方法により変換して、標準化後の色むらVuを得る。

対象者の髪の画像から、畳み込みニューラルネットワーク(本明細書において、「CNN」と称する場合がある。)を用いて、色むらを算出する。用いる画像としては、上述の画像が挙げられ、中でも対象者の後姿の画像1枚を用いることが好ましい。後述の教師あり学習を行う場合、学習に用いた髪の画像と同じ種類の入力データを用いることが好ましい。対象者の画像を入力し、CNNの出力として、標準化後の色むらVuを得ることができる。色むらの算出方法xxxiiiにより、従来、頭髪専門評価者が、対象者の画像を目視して判定していた色むらを、簡易に、短時間で算出することができる。

上記CNNとしては、VGG16、AlexNet等を用いることができ、中でも、色むらを一層精度よく算出できる観点から、VGG16が好ましい。

上記CNNは、事前に、教師あり学習をしてもよい。上記教師あり学習としては、以下の手順1~3による方法A、又は手順a~dによる方法B(即ち、クロスバリデーション)等が挙げられる。中でも、一層精度高く色むらを判定できる観点から、方法Bが好ましい。教師あり学習後に、対象者の画像からCNNが出力した色むら値を、標準化後の色むらVuとしてよい。

上記教師あり学習としては、教師用対象者の髪の画像(例えば、教師用対象者の背後から撮像した髪画像)から頭髪専門評価者が教師用対象者の髪の色むらを目視で5段階に評価した色むらの評価値、及び該髪の画像を教師データとして用いることが好ましい。教師データの上記髪の画像としては、教師用対象者の背後から撮像した髪画像であることが好ましく、髪の画像中の上記髪輪郭であることがより好ましい。教師データの上記髪の画像は、1種であってもよいし複数種であってもよいが、より簡易に色むらを算出できる観点から、1種であることが好ましい。また、教師データの全教師用対象者の画像は、同じ条件(例えば、撮影時の明るさ、画素数、画像に対する髪輪郭の面積割合等の条件)で撮影した画像であることが好ましい。

<方法A>

(手順1)

頭髪専門評価者が、教師用対象者の髪の画像から、教師用対象者の髪の色むらを目視で5段階に評価する。CNNに、該髪の画像と、該評価値とを入力する。CNNを用いて、上記髪の画像の髪の色むらが、1~5の5段階のいずれであるか、標準化後の色むらの推測値Iの出力を得る。なお、推測色むら値Iは、入力する髪の画像とCNNのパラメータが影響する。

(手順2)

上記推測色むら値Iと、頭髪専門評価者による評価値と、を比較する。

(手順3)

上記推測色むら値Iと、上記評価値とのずれが小さくなるように(例えば、上記推測色むら値Iと上記評価値とのずれが1以下となるように、又は上記推測色むら値Iと上記評価値とが一致するように)CNNのパラメータを調整する。上記調整は、上記評価値と上記推測色むら値Iとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。なお、上記確率値は、CNNが、推測ツヤ値Iが「1」である確率が100%と算出した場合「1」の確率値が1となり、「1」である確率が0%と算出した場合「1」の確率値が0となる値であって、1~5段階の確率値の合計が1となる値である。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順を繰り返し、教師あり学習を終了する。

<方法B>

(手順a)

上記手順1と同様にして、髪の画像、及び頭髪専門評価者による該髪の画像の評価値、を用意する。全教師用対象者(例えば10名、好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の6~9割の任意の割合をトレーニングデータとし、残りの全てをテストデータとする(例えば、全教師用対象者数の8割をトレーニングデータ、2割をテストデータとする)。

(手順b)

上記トレーニングデータとした教師用対象者のうち一人の教師用対象者の髪の画像及び評価値をCNNに入力し、該一人の教師用対象者の色むらの推測値IIを得る。上記推測色むら値IIと、頭髪専門評価者による評価値と、を比較する。

上記推測色むら値IIと、上記評価値とのずれが小さくなるように(例えば、上記推測色むら値IIと上記評価値とのずれが1以下となるように、又は上記推測色むら値IIと上記評価値とが一致するように)CNNのパラメータを調整する。上記調整は、上記評価値と上記推測色むら値IIとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順1~3を繰り返し、教師あり学習を終了する。

(手順c)

トレーニングデータとした全教師用対象者について、手順bを繰り返し、CNNのパラメータを調整する。テストデータとした全教師用対象者について、CNNによる色むら出力値と、頭髪専門評価者による評価値とを比較し、十分な精度に達したと判断した時点で、学習を終了する。上記十分な精度に達したときとは、例えば、テストデータの全教師用対象者について、上記評価値と上記色むら出力値との一致率が0.6以上となったとき、等が挙げられる。

(手順d)

さらなる学習が必要と判断した場合は、手順aと同じ割合で、教師用対象者全員を、再度、トレーニングデータとテストデータとに分類し、上記手順a~cを繰り返してもよい。トレーニングデータとテストデータとの分類は、過去にテストデータに分類した教師用対象者はトレーニングデータとし、これまでにテストデータに用いたことがない教師用対象者をテストデータとすることが好ましい。全教師用対象者を少なくとも1回テストデータとするまで(例えば、テストデータの割合が2割である場合は5回以上繰り返すまで)上記手順a~cを繰り返し、精度を確認してもよい。

本実施形態のヘアケア製品又はヘアケアサービスを提案する方法は、上述に記載の本実施形態の髪年齢評価方法により算出された対象者の髪年齢と、対象者に対する問診結果とに基づいて提案する方法であることが好ましい。

上記問診データは、質問に対する回答の複数の選択肢の中から、回答を選択して得られるデータであることが好ましい。

本実施形態の髪年齢評価装置は、対象者の髪のツヤを解析するツヤ解析部と、対象者の髪のうねりを解析するうねり解析部と、対象者の髪のボリュームを解析するボリューム解析部と、対象者の髪の色むらを解析する色むら解析部と、を含む解析部を含む。

Y(髪年齢)=α+β1×(標準化した髪のツヤ評価Vg)+β2×(標準化した髪のうねり評価Vw)+β3×(標準化した髪のボリューム評価Vv)+β4×(標準化した髪の色むら評価Vu)・・・(1)

(式(1)において、27.02≦α≦65.8、-12.20≦β1≦-3.40、2.40≦β2≦8.94、-6.96≦β3≦8.81、-4.94≦β4≦4.29である)

を用いることが好ましい。

本実施形態のヘアケア製品又はヘアケアサービスを提案する装置は、上述の本実施形態の髪年齢評価装置と、上記対象者に対する問診装置とを含むことが好ましい。例えば、算出された上記髪年齢及び提案するヘアケア製品又はヘアケアサービスを同時に表示する表示部を含んでいてよい。

本実施形態の髪年齢評価方法では、畳み込みニューラルネットワークを用いて、対象者の髪の画像から、上記対象者の髪年齢を算出することができる。上記方法によれば、特定のパラメータの算出を必要とせず、簡便に、画像から直接髪年齢を評価できる。

用いる画像としては、上述の画像が挙げられ、中でも、対象者の後姿の画像1枚を用いることが好ましい。後述の教師あり学習を行う場合、学習に用いた髪の画像と同じ種類の入力データを用いることが好ましい。対象者の画像を入力し、CNNの出力として、髪年齢を得ることができる。本実施形態の髪年齢評価方法により、従来、頭髪専門評価者が、対象者の画像を目視して判定していた髪年齢を、簡易に、短時間で算出することができる。

上記CNNとしては、VGG16、AlexNet等を用いることができ、中でも、髪年齢を一層精度よく評価できる観点から、VGG16が好ましい。

上記CNNは、事前に、教師あり学習をしてもよい。上記教師あり学習としては、以下の手順1~3による方法A、又は手順a~dによる方法B(即ち、クロスバリデーション)等が挙げられる。中でも、一層精度よく髪年齢を評価できる観点から、方法Bが好ましい。教師あり学習後に、CNNを用いて、対象者の画像から髪年齢を評価することが好ましい。

上記教師あり学習としては、教師用対象者の髪の画像(例えば、教師用対象者の背後から撮像した髪画像)から頭髪専門評価者が評価した髪年齢、及び該髪の画像を教師データとして用いることが好ましい。教師データの上記髪の画像としては、教師用対象者の背後から撮像した髪画像であることが好ましく、髪の画像中の上記髪輪郭であることがより好ましい。教師データの上記髪の画像は、1種であってもよいし複数種であってもよいが、より簡易に髪年齢を評価できる観点から、1種であることが好ましい。また、教師データの全教師用対象者の画像は、同じ条件(例えば、撮影時の明るさ、画素数、画像に対する髪輪郭の面積割合等の条件)で撮影した画像であることが好ましい。

<方法A>

(手順1)

教師用対象者の髪の画像から、頭髪専門評価者が、教師用対象者の髪年齢(以下、評価髪年齢と称する場合がある)を評価する。CNNに、該髪の画像と、該評価髪年齢とを入力する。CNNを用いて、上記髪の画像の推測髪年齢Iの出力を得る。なお、CNNによる推測髪年齢Iは、入力する髪の画像とCNNのパラメータが影響する。

(手順2)

上記推測髪年齢Iと、頭髪専門評価者による評価髪年齢と、を比較する。

(手順3)

上記推測髪年齢Iと、上記評価髪年齢とのずれが小さくなるように(例えば、上記評価髪年齢と上記推測髪年齢Iとのずれが21歳以下(好ましくは10歳以下、より好ましくは5歳以下、さらに好ましくは髪年齢が一致)となるように、CNNのパラメータを調整する。上記調整は、上記評価髪年齢と上記推測髪年齢Iとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。なお、上記確率値は、CNNが、髪年齢が30歳である確率が100%と算出した場合「30歳」の確率値が1となり、「30歳」である確率が30%と算出した場合「30歳」の確率値が0.3となる値であって、全年齢の確率値の和が1となる値である。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。また、上記パラメータの調整では、髪年齢の推測に用いる画像の解析領域の調整を行ってよく、例えば、画像の解析領域を、上記髪輪郭等としてもよい。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価髪年齢を用いて上記の手順1~3を繰り返し、教師あり学習を終了する。

<方法B>

(手順a)

上記手順1と同様にして、髪の画像、及び頭髪専門評価者による該髪の画像の評価髪年齢、を用意する。全教師用対象者(例えば10名、好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の6~9割の任意の割合をトレーニングデータとし、残りの全てをテストデータとする(例えば、全教師用対象者数の8割をトレーニングデータ、2割をテストデータとする)。

(手順b)

上記トレーニングデータとした教師用対象者のうち一人の教師用対象者の髪の画像及び評価髪年齢をCNNに入力し、該一人の教師用対象者の推測髪年齢IIを得る。上記推測髪年齢IIと、頭髪専門評価者による評価髪年齢と、を比較する。

上記推測髪年齢IIと、上記評価髪年齢とのずれが小さくなるように(例えば、評価髪年齢と推測髪年齢IIとの誤差が21歳以下、好ましくは10歳以下、より好ましくは5歳以下、さらに好ましくは髪年齢が一致、となるように、CNNのパラメータを調整する。上記調整は、上記評価髪年齢と上記推測髪年齢IIとが一致する確率値をCNNによって出力し、一致する確率値が0.4以上(好ましくは0.5以上、より好ましくは0.6以上、さらに好ましくは0.7以上)となるようにしてもよい。CNNのパラメータの上記調整方法としては、誤差逆伝搬法、勾配降下法等を用いることができる。10名(好ましくは20名以上、より好ましくは50名以上、さらに好ましくは100名以上、特に好ましくは200名以上)の教師用対象者の髪の画像及び評価値を用いて上記の手順を繰り返し、教師あり学習を終了する。

(手順c)

トレーニングデータとした全教師用対象者について、手順bを繰り返し、CNNのパラメータを調整する。テストデータとした全教師用対象者について、CNNによる推測髪年齢と、頭髪専門評価者による評価髪年齢とを比較し、十分な精度に達したと判断した時点で、学習を終了する。上記十分な精度に達したときとは、例えば、テストデータの全教師用対象者について、上記評価髪年齢と上記推測髪年齢との一致率が0.6以上となったとき、等が挙げられる。なお、上記一致率とは、テストデータの全教師用対象者のうち、上記評価髪年齢と上記推測髪年齢とが一致する対象者の数の割合であり、一致する対象者の割合が60%であるとき、一致率を0.6とする。

(手順d)

さらなる学習が必要と判断した場合は、手順aと同じ割合で、教師用対象者全員を、再度、トレーニングデータとテストデータとに分類する。トレーニングデータとテストデータとの分類は、過去にテストデータに分類した教師用対象者はトレーニングデータとし、これまでにテストデータに用いたことがない教師用対象者をテストデータとすることが好ましい。全教師用対象者を少なくとも1回テストデータとするまで(例えば、テストデータの割合が2割である場合は5回以上繰り返すまで)上記手順a~cを繰り返し、精度を確認してもよい。

20人の対象者について、頭髪専門評価者3名が、髪のツヤVg’、髪のうねりVw’、髪のボリュームVv’、髪の色むらVu’、髪年齢Y’(歳)をそれぞれ目視で評価した。ツヤVg’、うねりVw’、ボリュームVv’、色むらVu’は5段階評価とした。

20人の対象者について、1枚ずつ後姿の画像を取得した。背景は白色の壁とし、白色のケープを着けた対象者の背側正中が中心となるように撮影をした。撮影は、デジタルカメラ(機種iPad(第6世代)、アップル社製)を使用して、(カメラの写真モードで行った。撮影の際、対象者の上側から光を当て、975ルクスの条件で撮影をした。

得られた画像は、いずれの画像でも、髪輪郭のx方向が1536画素以上、髪輪郭のy方向が2048画素以上であった。

対象者の後姿の画像をパソコンに取り込み、グレースケールに変換し、閾値110で二値化した。変換後の画像において、OpenCVライブラリを組み込んだPython言語により作成したプログラムを用いて、OpenCV内の関数cv2.findContoursにより、髪輪郭を作成した。

そして、上述のツヤの算出方法iにより標準化後のツヤVgを得た。標準化後のツヤは5段階評価とした。なお、ツヤの算出方法iにおいて、領域A、Bをx方向に200等分、y方向に100等分した。

なお、上記算出において、標準偏差の差から標準化後のツヤへの変換は、以下の方法で行った。

事前に、頭髪専門評価者が、200名の対象者の髪のツヤを目視で5段階に評価する。5の評価(非常に良好なツヤがあるの評価)の人数を「5の評価者数」、4の評価(良好なツヤがあるの評価)の人数を「4の評価者数」、3の評価(平均的なツヤがあるの評価)の人数を「3の評価者数」、2の評価(わずかにツヤがあるの評価)の人数を「2の評価者数」、1の評価(ツヤがないの評価)の人数を「1の評価者数」とする。

次に、同じ対象者に対して、ツヤの算出方法iで標準偏差値の差を算出する。そして、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も低い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価した。

また、輝度は、OpenCVライブラリを組み込んだPython言語により作成したプログラムを用いてcv2.cvtColor(a,b)関数を用い、a:元画像、b:グレースケールに変換するモードを指定する条件で測定した。

対象者の後姿の画像をパソコンに取り込み、グレースケールに変換し、閾値110で二値化した。変換後の画像において、OpenCVライブラリを組み込んだPython言語により作成したプログラムを用いて、OpenCV内の関数cv2.findContoursにより、髪輪郭を作成した。

そして、上述のうねりの算出方法iにより標準化後のうねりVwを得た。

なお、上記算出において、標準偏差の差から標準化後のうねりへの変換は、以下の方法で行った。

事前に、頭髪専門評価者が、200名の対象者の髪のうねりを目視で5段階に評価する。5の評価(うねりの頻度が高い、又はうねり毛の量が多い)の人数を「5の評価者数」、4の評価(うねりの頻度が比較的高い、又はうねり毛の量が比較的多い)の人数を「4の評価者数」、3の評価(うねりの頻度が中程度、又はうねり毛の量が中程度)の人数を「3の評価者数」、2の評価(うねりの頻度が比較的低い、又はうねり毛の量が比較的少ない)の人数を「2の評価者数」、1の評価(うねりの頻度が低い、又はうねり毛の量が少ない)の人数を「1の評価者数」とする。

次に、同じ対象者に対して、うねりの算出方法iにより、標準偏差を算出する。そして、該値が低い順に並べ、最低値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が低い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が低い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が低い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も高い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価した。

対象者の後姿の画像をパソコンに取り込み、グレースケールに変換し、閾値110で二値化した。変換後の画像において、OpenCVライブラリを組み込んだPython言語により作成したプログラムを用いて、OpenCV内の関数cv2.findContoursにより、髪輪郭を作成した。

そして、上述のボリュームの算出方法iにより標準化後のボリュームVvを得た。

なお、上記算出において、「10%位置幅/最大幅」から標準化後のボリュームへの変換は、以下の方法で行った。

事前に、頭髪専門評価者が、200名の対象者の髪のボリュームを目視で5段階に評価する。5の評価(ボリュームが最も大きい評価)の人数を「5の評価者数」、4の評価(ボリュームがやや大きい評価)の人数を「4の評価者数」、3の評価(ボリュームが普通の評価)の人数を「3の評価者数」、2の評価(ボリュームがやや小さい評価)の人数を「2の評価者数」、1の評価(ボリュームが最も小さい評価)の人数を「1の評価者数」とする。

次に、同じ対象者に対して、ボリュームの算出方法iにより、10%位置幅を最大幅で除した値を算出する。そして、該値が低い順に並べ、最低値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が低い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が低い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が低い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も高い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価した。

対象者の後姿の画像をパソコンに取り込み、グレースケールに変換し、閾値110で二値化した。また、HSV空間に変換した画像を作成した。HSV空間への変換は、Python言語によって作られたプログラムに組み込んだOpenCV内の関数、cvtColor関数を使用し、二つ目の引数をCV_BGR2HSVに変更して形成した。

作成した画像を用いて、上述の色むらの算出方法iにより、標準化後の色むらVuを得た。

また、色相は、OpenCVライブラリを組み込んだPython言語により作成したプログラムを用いてcv2.cvtColor(a,b)関数を用い、a:元画像、b:HSV色空間に指定するモードを使用し、得られたHSV各値のS値を抽出した。

なお、上記算出において、標準偏差値の平均値から標準化後のボリュームへの変換は、以下の方法で行った。

事前に、頭髪専門評価者が、200名の対象者の髪の色むらを目視で5段階に評価する。5の評価(色むらが劣る評価)の人数を「5の評価者数」、4の評価(色むらが若干劣る評価)の人数を「4の評価者数」、3の評価(色むらが普通の評価)の人数を「3の評価者数」、2の評価(色むらが良好の評価)の人数を「2の評価者数」、1の評価(色むらが最も良好な評価)の人数を「1の評価者数」とする。

次に、同じ対象者に対して、色むらの算出方法iにより、標準偏差の平均値を算出する。そして、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、最も該値が低い「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

下記式(1)を用いて、髪年齢Yの評価をした。

Y(髪年齢、単位:歳)=α+β1×(標準化した髪のツヤ評価Vg)+β2×(標準化した髪のうねり評価Vw)+β3×(標準化した髪のボリューム評価Vv)+β4×(標準化した髪の色むら評価Vu)・・・(1)

α、β1、β2、β3、β4の係数セットとしては、表1に記載の値を使用した。例えば、係数セットaは、専門家が目視で評価した20名の髪年齢、20名の対象者の標準化後のツヤVg、標準化後のうねりVw、標準化後のボリュームVv、標準化後の色むらVuを用いて導き出した。

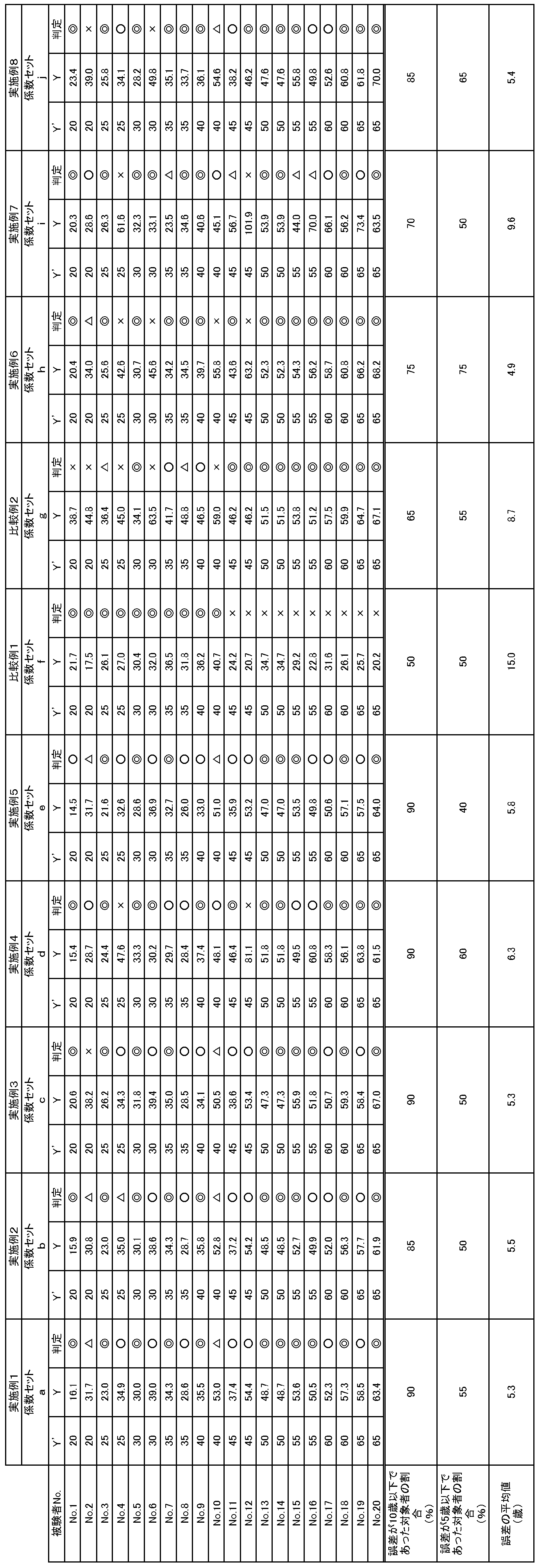

各実施例で、表1に記載の係数セットa~e、h~jを上記式(1)に代入して、20名の対象者の髪年齢Yを評価した。結果を表2に示す。

各比較例で、表1に記載の係数セットf、gを上記式(1)に代入して、20名の対象者の髪年齢Yを評価した。結果を表2に示す。

そして、20人の対象者のうち、誤差が10歳以下であった対象者の割合(%)、5歳以下であった対象者の割合(%)、20名の対象者の算出後の髪年齢Yと目視による髪年齢Y’との誤差の平均値(歳)を算出した。

多くの被験者のデータを基に算出した係数セットを用いて髪年齢を評価した実施例1~5は、誤差が大きい結果(例えば、誤差が10歳超の評価結果)の割合が少なく、且つ対象者全員の目視髪年齢と、本発明の方法による評価髪年齢との誤差の平均が小さく、精度よく髪年齢が評価できた。

(CNNによる標準化した髪のツヤの評価)

375名の教師用対象者について、髪の画像と、頭髪専門評価者の目視による5段階のツヤ評価値とを得た。なお、髪の画像は、上記「(画像の取得)」と同様の方法で得た後姿の画像である。

375名の教師用対象者のうち、8割の300名をトレーニングデータとし、2割の75名をテストデータとした。

VGG16に、上記髪の画像と、上記ツヤ評価値とを入力した。

各教師用対象者について、CNNによるツヤの推測値と、上記ツヤ評価値との比較を行い、値が一致する確率値が0.4以上となるようにVGG16のパラメータを調整した。トレーニングデータとした300名の全教師用対象者について同様の調整を行い、テストデータとした75名の教師用対象者で精度を確認した。

続いて、テストデータとなる教師用対象者が重複しないように、375名の教師用対象者をトレーニングデータ8割とテストデータ2割とに分類し、同様にしてVGG16のパラメータを調整し、別種のVGG16パラメータを有するVGG16モデルを作成し、テストデータとした75名の教師用対象者で精度を確認した。全教師用対象者がテストデータとなるように、同様の操作を5回行い、各操作時のテストデータを用いて精度を確認することで、全教師用対象者に対して精度確認を行った。

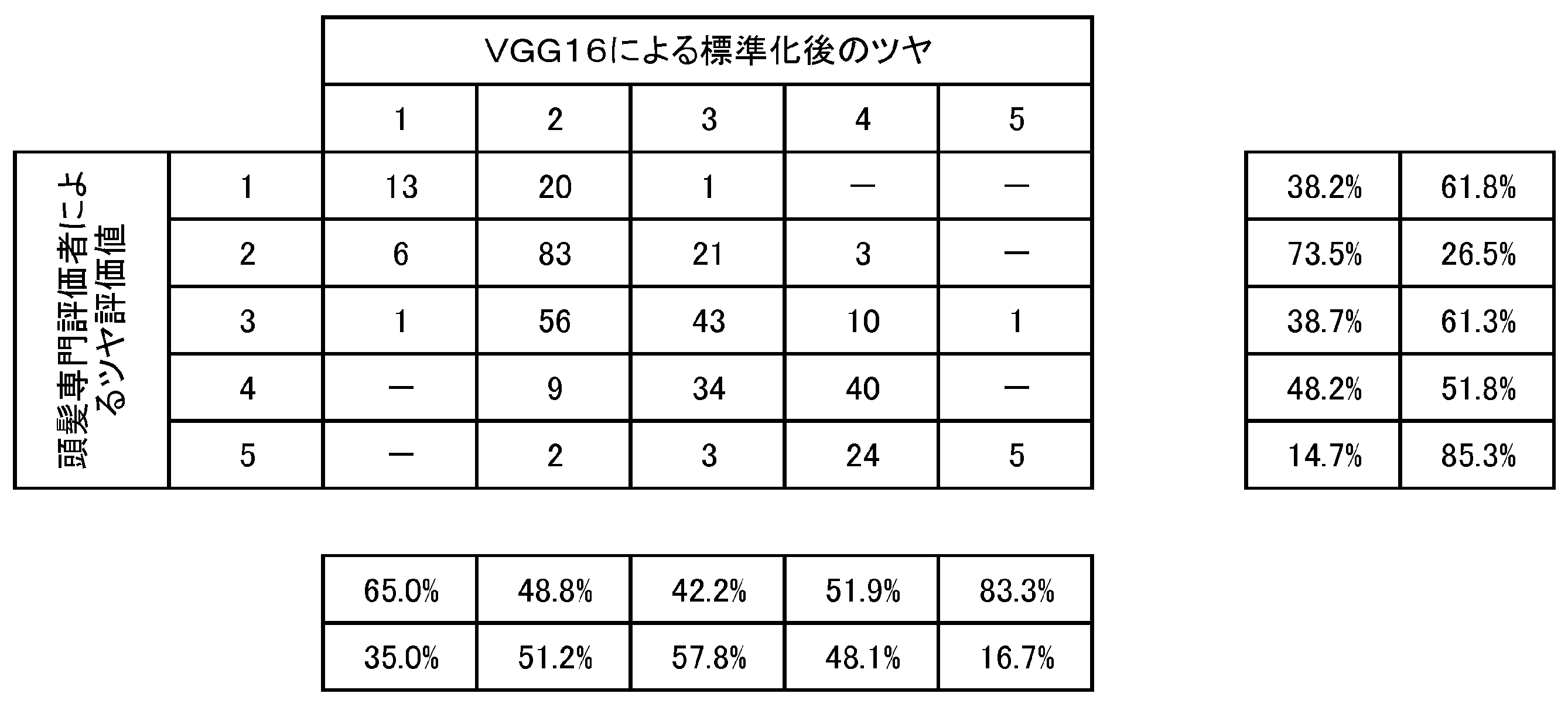

表3に、縦行に頭髪専門評価者の目視によるツヤの評価値、横列にVGG16による標準化した髪の標準化後のツヤ値、の混合行列を示す。表3において、頭髪専門評価者の評価値が「1」である対象者の総数は34名であり、そのうち、VGG16が「1」と算出した対象者数が13名、「2」と算出した対象者数が20名、「3」と算出した対象者数が1名であった。また、頭髪専門評価者の評価値が「1」である全対象者のうち、VGG16と評価が一致した対象者数は13名(38.2%)、一致しなかった対象者数は21名(61.8%)であった(表3の混合行列の右欄)。VGG16が「1」と算出した全対象者(20名)のうち、頭髪専門評価者の評価値と一致した対象者の数の割合は65.0%、一致しなかった対象者の数の割合は35.0%であった(表3の混合行列の下欄)。

全対象者375名のうち、頭髪専門評価者の評価値と、VGG16による算出値とが一致した対象者の数の割合は、49.1%であり、非常に精度が高かった。

また、頭髪専門評価者の評価においても起こり得る、ツヤのスコア±1の誤差を許容した場合、全対象者375名のうち、頭髪専門評価者の評価値とVGG16による算出値との誤差が1以内であった対象者の数の割合は、94.7%であり、極めて精度が高かった。

(CNNによる標準化した髪のうねりの評価)

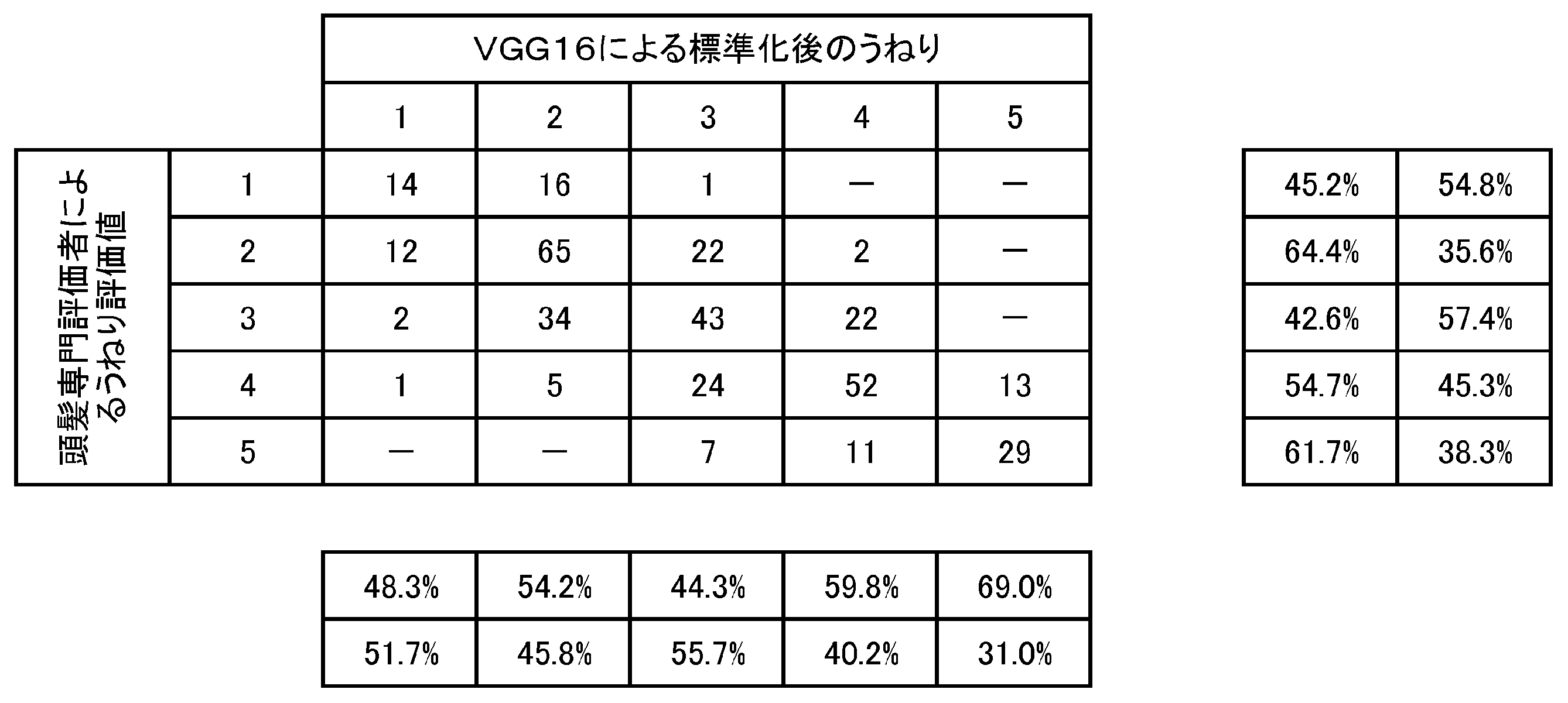

教師用データとして375名の教師用対象者の髪の画像と頭髪専門評価者の目視による5段階のうねり評価値とを用いたこと以外は、実施例9と同様にして髪のうねりの評価を行った。

全対象者375名のうち、頭髪専門評価者のうねり評価値と、VGG16による算出値とが一致した対象者の数の割合は、54.1%であり、非常に精度が高かった。

また、頭髪専門評価者の評価においても起こり得る、うねりのスコア±1の誤差を許容した場合、全対象者375名のうち、頭髪専門評価者のうねり評価値とVGG16による算出値との誤差が1以内であった対象者の数の割合は、95.2%であり、極めて精度が高かった。

(CNNによる標準化した髪のボリュームの評価)

教師用データとして375名の教師用対象者の髪の画像と頭髪専門評価者の目視による5段階のボリューム評価値とを用いたこと以外は、実施例9と同様にして髪のボリュームの評価を行った。

全対象者375名のうち、頭髪専門評価者のボリューム評価値と、VGG16による算出値とが一致した対象者の数の割合は、43.2%であり、非常に精度が高かった。

また、頭髪専門評価者の評価においても起こり得る、ボリュームのスコア±1の誤差を許容した場合、全対象者375名のうち、頭髪専門評価者のボリューム評価値とVGG16による算出値との誤差が1以内であった対象者の数の割合は、91.2%であり、極めて精度が高かった。

(CNNによる標準化した髪の色むらの評価)

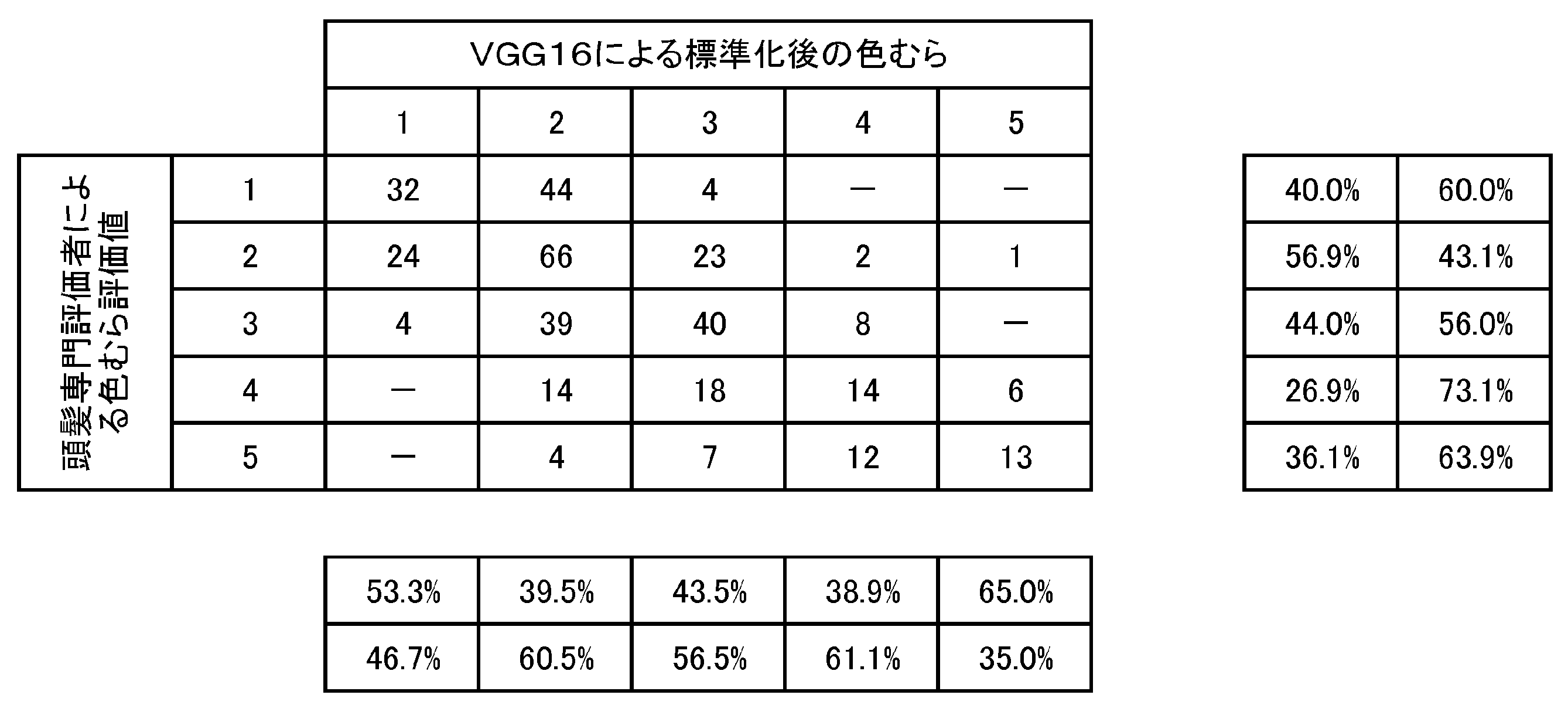

教師用データとして375名の教師用対象者の髪の画像と頭髪専門評価者の目視による5段階の色むら評価値とを用いたこと以外は、実施例9と同様にして髪の色むらの評価を行った。

全対象者375名のうち、頭髪専門評価者の色むら評価値と、VGG16による算出値とが一致した対象者の数の割合は、44.0%であり、非常に精度が高かった。

また、頭髪専門評価者の評価においても起こり得る、色むらのスコア±1の誤差を許容した場合、全対象者375名のうち、頭髪専門評価者の色むら評価値とVGG16による算出値との誤差が1以内であった対象者の数の割合は、90.4%であり、極めて精度が高かった。

(CNNによる髪年齢評価)

375名の教師用対象者について、髪の画像と、頭髪専門評価者の目視による評価髪年齢とを得た。なお、髪の画像は、上記「(画像の取得)」と同様の方法で得た後姿の画像である。

375名の教師用対象者のうち、8割の300名をトレーニングデータとし、2割の75名をテストデータとした。

VGG16に、上記髪の画像と、上記評価髪年齢とを入力した。

各教師用対象者について、CNNによる推測髪年齢と、上記評価髪年齢との比較を行い、年齢が一致する確率値が0.4以上となるようにVGG16のパラメータを調整した。トレーニングデータとした300名の全教師用対象者について同様の調整を行い、テストデータとした75名の教師用対象者で精度を確認した。

続いて、テストデータとなる対象者が重複しないように、375名の対象者をトレーニングデータ8割とテストデータ2割とに分類し、同様にしてVGG16のパラメータを調整し、別種のVGG16パラメータを有するVGG16モデルを作成し、テストデータとした75名の教師用対象者で精度を確認した。全教師用対象者がテストデータとなるように、同様の操作を5回行い、各操作時のテストデータを用いて精度を確認することで、全教師用対象者に対して精度確認を行った。

表7に、縦行に頭髪専門評価者の目視による評価髪年齢、横列にVGG16によって算出した髪年齢、の混合行列を示す。なお、髪年齢は、18~29歳を20歳代、30~39歳を30歳代、40~49歳を40歳代、50~59歳を50歳代、60~69歳を60歳代、70~79歳を70歳代の6クラスに分類した。

表7において、頭髪専門評価者が評価した髪年齢が「20歳代」である対象者の総数は86名であり、そのうち、VGG16が「20歳代」と評価した対象者数が63名、「30歳代」と評価した対象者数が18名、「40歳代」と評価した対象者数が3名、「50歳代」と評価した対象者数が1名、「70歳代」と評価した対象者数が1名であった。また、頭髪専門評価者が評価した髪年齢が「20歳代」である全対象者86名のうち、VGG16と髪年齢のクラスが一致した対象者数は63名(73.3%)、一致しなかった対象者数は23名(26.7%)であった(表7の混合行列の右欄)。VGG16が「20歳代」と評価した全対象者(97名)のうち、頭髪専門評価者の髪年齢とクラスが一致した対象者の数の割合は64.9%、一致しなかった対象者の数の割合は35.1%であった(表7の混合行列の下欄)。

全対象者375名のうち、頭髪専門評価者の髪年齢と、VGG16による髪年齢とで、クラスが一致した対象者の数の割合は、47.2%であり、非常に精度が高かった。

また、頭髪専門評価者の評価においても起こり得る、前後のクラスの誤差(前後の年代の誤差)を許容した場合、全対象者375名のうち、頭髪専門評価者の髪年齢とVGG16による髪年齢との誤差が前後のクラス及びクラスが一致する対象者の総数の割合は、88.8%であり、極めて精度が高かった。

(CNNにより評価した髪年齢と、実際の年齢との誤差)

実施例13で評価した375名の対象者の髪年齢について、下記数式により、回帰モデルの評価指数であるRMSEを算出した。375名のうち、i番目の対象者の、頭髪専門評価者が目視で評価した髪年齢をYi、VGG16により評価した髪年齢をyiとした。

RMSE=√Σi{(Yi-yi)2/375}=8.66

RMSEは10以下であり、非常に精度が高かった。

Claims (6)

- 対象者の髪の画像を解析して、髪のツヤ、うねり、ボリューム、色むらの各解析値を算出し、該各解析値に基づいて前記対象者の髪年齢を算出する、髪年齢評価方法であって、

前記対象者の髪年齢を算出する際に、

下記式(1):

Y(髪年齢)=α+β1×(標準化した髪のツヤ評価Vg)+β2×(標準化した髪のうねり評価Vw)+β3×(標準化した髪のボリューム評価Vv)+β4×(標準化した髪の色むら評価Vu)・・・(1)

(式(1)において、27.02≦α≦65.8、-12.20≦β1≦-3.40、2.40≦β2≦8.94、-6.96≦β3≦8.81、-4.94≦β4≦4.29である)

を用い、

前記Vgが以下のツヤの算出方法i~iiiのいずれかの方法で得られた値であり、

前記Vwが以下のうねりの算出方法i~xviのいずれか方法で得られた値であり、

前記Vvが以下のボリュームの算出方法i~vのいずれか方法で得られた値であり、

前記Vuが以下の色むらの算出方法i~xxxiiのいずれか方法で得られた値である、

髪年齢評価方法。

(ツヤの算出方法i)

対象者の後姿の画像から画定した出願当初の段落0027に記載の領域A、Bを、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A及び領域Bのヒストグラムから、領域Aの標準偏差、領域Bの標準偏差を求め、「領域Aの標準偏差-領域Bの標準偏差」を求める。

以下の方法で、前記「領域Aの標準偏差-領域Bの標準偏差」を標準化したツヤに変換する。事前に、頭髪専門評価者が、200名以上の対象者の髪のツヤを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、前記ツヤの算出方法i)により、前記「領域Aの標準偏差-領域Bの標準偏差」を算出し、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も低い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、とする。

(ツヤの算出方法ii)

対象者の後姿の画像から画定した出願当初の段落0027に記載の領域A、Cを、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A及び領域Cのヒストグラムから、領域Aの標準偏差、領域Cの標準偏差を求め、「領域Aの標準偏差-領域Cの標準偏差」を求める。

前記ツヤの算出方法iの「領域Aの標準偏差-領域Bの標準偏差」を「領域Aの標準偏差-領域Cの標準偏差」に変更して、「領域Aの標準偏差-領域Cの標準偏差」を標準化したツヤに変換する。

(ツヤの算出方法iii)

対象者の後姿の画像から画定した出願当初の段落0027に記載の領域A’、B’を、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A’及び領域B’のヒストグラムから、領域A’の標準偏差、領域B’の標準偏差を求め、「領域A’の標準偏差-領域B’の標準偏差」を求める。

前記ツヤの算出方法iの「領域Aの標準偏差-領域Bの標準偏差」を「領域A’の標準偏差-領域B’の標準偏差」に変更して、「領域A’の標準偏差-領域B’の標準偏差」を標準化したツヤに変換する。

(うねりの算出方法i)

対象者の後姿の画像から画定した出願当初の段落0044に記載の領域Aを、x方向に100等分、y方向に100等分し、得られた10000個の区画内の輝度値を測定し、その区画の輝度値を得る。そして、全区画の輝度値の平均値を算出し、閾値とする。

そして、出願当初の段落0046に記載のx_dp1~x_dp50の、y_dpn_startからy_dpn_endまでのy方向の長さ(nは、1~50の整数を表す)を算出し、合計50個の値(ブランクを含んでよい)を算出する。

得られた50個の値から、ブランクの数、標準偏差、標準偏差の最大値から最小値を引いた差分を算出する。

得られた標準偏差を、以下の方法で標準化したうねりに変換する。

事前に、頭髪専門評価者が、200名以上の対象者の髪のうねりを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、うねりの算出方法iにより、標準偏差を算出する。そして、標準偏差が低い順に並べ、最低値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が低い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が低い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が低い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も高い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

(うねりの算出方法ii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法iで求めたブランクの数に変更して、標準化したうねりVwを得る。

(うねりの算出方法iii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法iで求めた標準偏差の最大値から最小値を引いた差分に変更して、標準化したうねりVwを得る。

(うねりの算出方法iv)

(輪郭の周囲の長さ)/(輪郭抽出面積)を算出する。

前記うねりの算出方法iの標準偏差を、前記(輪郭の周囲の長さ)/(輪郭抽出面積)の算出値に変更して、標準化したうねりVwを得る。

(うねりの算出方法v)

対象者の後姿の画像から、出願当初の段落0051、0052、0053、0054に記載の方法で、y座標がy_top-200_d1~y_top-200_d50についての、x_abからx_aaまでのx方向長さ、及びx_ccからx_cbまでのx方向長さを算出する。50個のx_abからx_aaまでのx方向長さの値から、最大値、最小値、平均値、標準偏差、最頻値、中央値を算出する。

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの最大値に変更して、標準化したうねりVwを得る。

(うねりの算出方法vi)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの最小値に変更して、標準化したうねりVwを得る。

(うねりの算出方法vii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの平均値に変更して、標準化したうねりVwを得る。

(うねりの算出方法viii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの標準偏差に変更して、標準化したうねりVwを得る。

(うねりの算出方法ix)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの最頻値に変更して、標準化したうねりVwを得る。

(うねりの算出方法x)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの中央値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xi)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最大値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最小値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xiii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの平均値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xiv)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの標準偏差に変更して、標準化したうねりVwを得る。

(うねりの算出方法xv)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最頻値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xvi)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの中央値に変更して、標準化したうねりVwを得る。

(ボリュームの算出方法i)

対象者の後姿及び前姿の画像から、出願当初の段落0071、0072、0073、0074、0075に記載の方法で、10%位置幅、最大幅、rbc、rab、lbc、lab、(点ARと点FRとのy方向長さ)/(点FRと点ERとのy方向長さ)、(点ALと点FLとのy方向長さ)/(点FLと点ELとのy方向長さ)、を算出する。そして、前記10%位置幅を前記最大幅で除した値(10%位置幅/最大幅)を算出する。

以下の方法で、前記(10%位置幅/最大幅)を標準化したボリュームに変換する。事前に、頭髪専門評価者が、200名以上の対象者の髪のボリュームを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、前記ボリュームの算出方法iにより、前記(10%位置幅/最大幅)を算出し、該値が低い順に並べ、最低値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が低い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が低い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が低い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も高い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

(ボリュームの算出方法ii)

前記長さlbcを前記長さlabで除した値(lbc/lab)を算出し、l_ratioとする。前記長さrbcを前記長さrabで除した値(rbc/rab)を算出し、r_ratioとする。そして、前記l_ratioと前記r_ratioとの平均ave_ratioを算出する。

以下の方法で、前記平均ave_ratioを標準化したボリュームに変換する。事前に、頭髪専門評価者が、200名以上の対象者の髪のボリュームを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、前記ボリュームの算出方法iiにより、前記平均ave_ratioを算出し、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も低い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

(ボリュームの算出方法iii)

前記10%位置幅/最大幅と前記平均ave_ratioとの和を算出し、前記ボリュームの算出方法iの10%位置幅/最大幅を前記10%位置幅/最大幅と前記平均ave_ratioとの前記和に変更して、標準化したボリュームVvを得る。

(ボリュームの算出方法iv)

前記10%位置幅/最大幅と前記平均ave_ratioとを乗じた値を算出し、前記ボリュームの算出方法iの10%位置幅/最大幅を前記10%位置幅/最大幅と前記平均ave_ratioとを乗じた前記値に変更して、標準化したボリュームVvを得る。

(ボリュームの算出方法v)

前記「(点ARと点FRとのy方向長さ)/(点FRと点ERとのy方向長さ)」と、前記「(点ALと点FLとのy方向長さ)/(点FLと点ELとのy方向長さ)」との平均値を算出し、前記ボリュームの算出方法iiの平均ave_ratioを前記「(点ARと点FRとのy方向長さ)/(点FRと点ERとのy方向長さ)」と、前記「(点ALと点FLとのy方向長さ)/(点FLと点ELとのy方向長さ)」との前記平均値に変更して、標準化したボリュームVvを得る。

(色むらの算出方法i)

対象者の後姿の画像から、出願当初の段落0090に記載の方法で、x_25%v_1~x_25%v_50の線分の各区画の色相値から、線分の色相値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。

以下の方法で、前記標準偏差値の平均値を標準化した色むらに変換する。事前に、頭髪専門評価者が、200名以上の対象者の髪の色むらを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、前記色むらの算出方法iにより、前記標準偏差値の平均値を算出する。そして、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、最も該値が低い「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

(色むらの算出方法ii)

前記色むらの算出方法iで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、前記最大値の平均値から前記最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法iii)

前記色むらの算出方法iで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法iv)

前記色むらの算出方法iで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法v)

対象者の後姿の画像から、出願当初の段落0095に記載の方法で、x_230v_1~x_230v_50の線分の各区画の色相値から、線分の色相値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法vの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法vi)

前記色むらの算出方法vで得られた50個の最大値の平均値及び50個の最小値の平均値を求め、前記最大値の平均値から前記最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法vii)

前記色むらの算出方法vで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法viii)

前記色むらの算出方法vで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法ix)

対象者の後姿の画像から、出願当初の段落0100に記載の方法で、y_25%s_1~y_25%s_50の線分の各区画の色相値から、線分の色相値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法ixの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法x)

前記色むらの算出方法ixで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、前記最大値の平均値から前記最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xi)

前記色むらの算出方法ixで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xii)

前記色むらの算出方法ixで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xiii)

対象者の後姿の画像から、出願当初の段落0105に記載の方法で、y_230s_1~y_230s_50の線分の各区画の色相値から、線分の色相値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xiiiの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xiv)

前記色むらの算出方法xiiiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、前記最大値の平均値から前記最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xv)

前記色むらの算出方法xiiiで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xvi)

前記色むらの算出方法xiiiで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xvii)

対象者の後姿の画像から、出願当初の段落0109に記載の方法で、x_25%v_1~x_25%v_50の線分の各区画の彩度値から、線分の彩度値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xviiの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xviii)

前記色むらの算出方法xviiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xix)

前記色むらの算出方法xviiで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xx)

前記色むらの算出方法xviiで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxi)

対象者の後姿の画像から、出願当初の段落0113に記載の方法で、x_230v_1~x_230v_50の線分の各区画の彩度値から、線分の彩度値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xxiの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxii)

前記色むらの算出方法xxiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxiii)

前記色むらの算出方法xxiで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxiv)

前記色むらの算出方法xxiで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxv)

対象者の後姿の画像から、出願当初の段落0117に記載の方法で、y_25%s_1~y_25%s_50の線分の各区画の彩度値から、線分の彩度値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xxvの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxvi)

前記色むらの算出方法xxvで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxvii)

前記色むらの算出方法xxvで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxviii)

前記色むらの算出方法xxvで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxix)

対象者の後姿の画像から、出願当初の段落0121に記載の方法で、y_230s_1~y_230s_50の線分の各区画の彩度値から、線分の彩度値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xxixの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxx)

前記色むらの算出方法xxixで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxxi)

前記色むらの算出方法xxixで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxxii)

前記色むらの算出方法xxixで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。 - 前記対象者の髪の画像を前記対象者の髪を撮影して取得し、

算出された前記対象者の髪年齢を画面に表示する、

請求項1に記載の髪年齢評価方法。 - 請求項1又は2に記載の髪年齢評価方法により算出された前記対象者の髪年齢と、前記対象者に対する問診結果とに基づいて、ヘアケア製品又はヘアケアサービスを提案する方法。

- 対象者の髪のツヤを解析するツヤ解析部と、

対象者の髪のうねりを解析するうねり解析部と、

対象者の髪のボリュームを解析するボリューム解析部と、

対象者の髪の色むらを解析する色むら解析部と、

を含む解析部を含み、

前記解析部において、

下記式(1):

Y(髪年齢)=α+β1×(標準化した髪のツヤ評価Vg)+β2×(標準化した髪のうねり評価Vw)+β3×(標準化した髪のボリューム評価Vv)+β4×(標準化した髪の色むら評価Vu)・・・(1)

(式(1)において、27.02≦α≦65.8、-12.20≦β1≦-3.40、2.40≦β2≦8.94、-6.96≦β3≦8.81、-4.94≦β4≦4.29である)

を用い、

前記Vgが以下のツヤの算出方法i~iiiのいずれかの方法で得られた値であり、

前記Vwが以下のうねりの算出方法i~xviのいずれか方法で得られた値であり、

前記Vvが以下のボリュームの算出方法i~vのいずれか方法で得られた値であり、

前記Vuが以下の色むらの算出方法i~xxxiiのいずれか方法で得られた値である

、髪年齢評価装置。

(ツヤの算出方法i)

対象者の後姿の画像から画定した出願当初の段落0027に記載の領域A、Bを、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A及び領域Bのヒストグラムから、領域Aの標準偏差、領域Bの標準偏差を求め、「領域Aの標準偏差-領域Bの標準偏差」を求める。

以下の方法で、前記「領域Aの標準偏差-領域Bの標準偏差」を標準化したツヤに変換する。事前に、頭髪専門評価者が、200名以上の対象者の髪のツヤを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、前記ツヤの算出方法i)により、前記「領域Aの標準偏差-領域Bの標準偏差」を算出し、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も低い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、とする。

(ツヤの算出方法ii)

対象者の後姿の画像から画定した出願当初の段落0027に記載の領域A、Cを、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A及び領域Cのヒストグラムから、領域Aの標準偏差、領域Cの標準偏差を求め、「領域Aの標準偏差-領域Cの標準偏差」を求める。

前記ツヤの算出方法iの「領域Aの標準偏差-領域Bの標準偏差」を「領域Aの標準偏差-領域Cの標準偏差」に変更して、「領域Aの標準偏差-領域Cの標準偏差」を標準化したツヤに変換する。

(ツヤの算出方法iii)

対象者の後姿の画像から画定した出願当初の段落0027に記載の領域A’、B’を、x方向に100~1000等分、y方向に100~1000等分し、得られた各区画内の輝度値を測定する。得られた各区画の輝度値から、横軸に輝度値、縦軸に頻度をとるヒストグラムを、領域ごとに作成する。領域A’及び領域B’のヒストグラムから、領域A’の標準偏差、領域B’の標準偏差を求め、「領域A’の標準偏差-領域B’の標準偏差」を求める。

前記ツヤの算出方法iの「領域Aの標準偏差-領域Bの標準偏差」を「領域A’の標準偏差-領域B’の標準偏差」に変更して、「領域A’の標準偏差-領域B’の標準偏差」を標準化したツヤに変換する。

(うねりの算出方法i)

対象者の後姿の画像から画定した出願当初の段落0044に記載の領域Aを、x方向に100等分、y方向に100等分し、得られた10000個の区画内の輝度値を測定し、その区画の輝度値を得る。そして、全区画の輝度値の平均値を算出し、閾値とする。

そして、出願当初の段落0046に記載のx_dp1~x_dp50の、y_dpn_startからy_dpn_endまでのy方向の長さ(nは、1~50の整数を表す)を算出し、合計50個の値(ブランクを含んでよい)を算出する。

得られた50個の値から、ブランクの数、標準偏差、標準偏差の最大値から最小値を引いた差分を算出する。

得られた標準偏差を、以下の方法で標準化したうねりに変換する。

事前に、頭髪専門評価者が、200名以上の対象者の髪のうねりを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、うねりの算出方法iにより、標準偏差を算出する。そして、標準偏差が低い順に並べ、最低値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が低い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が低い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が低い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も高い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

(うねりの算出方法ii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法iで求めたブランクの数に変更して、標準化したうねりVwを得る。

(うねりの算出方法iii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法iで求めた標準偏差の最大値から最小値を引いた差分に変更して、標準化したうねりVwを得る。

(うねりの算出方法iv)

(輪郭の周囲の長さ)/(輪郭抽出面積)を算出する。

前記うねりの算出方法iの標準偏差を、前記(輪郭の周囲の長さ)/(輪郭抽出面積)の算出値に変更して、標準化したうねりVwを得る。

(うねりの算出方法v)

対象者の後姿の画像から、出願当初の段落0051、0052、0053、0054に記載の方法で、y座標がy_top-200_d1~y_top-200_d50についての、x_abからx_aaまでのx方向長さ、及びx_ccからx_cbまでのx方向長さを算出する。50個のx_abからx_aaまでのx方向長さの値から、最大値、最小値、平均値、標準偏差、最頻値、中央値を算出する。

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの最大値に変更して、標準化したうねりVwを得る。

(うねりの算出方法vi)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの最小値に変更して、標準化したうねりVwを得る。

(うねりの算出方法vii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの平均値に変更して、標準化したうねりVwを得る。

(うねりの算出方法viii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの標準偏差に変更して、標準化したうねりVwを得る。

(うねりの算出方法ix)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの最頻値に変更して、標準化したうねりVwを得る。

(うねりの算出方法x)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_abからx_aaまでのx方向長さの中央値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xi)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最大値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最小値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xiii)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの平均値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xiv)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの標準偏差に変更して、標準化したうねりVwを得る。

(うねりの算出方法xv)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの最頻値に変更して、標準化したうねりVwを得る。

(うねりの算出方法xvi)

前記うねりの算出方法iの標準偏差を、前記うねりの算出方法vで求めたx_ccからx_cbまでのx方向長さの中央値に変更して、標準化したうねりVwを得る。

(ボリュームの算出方法i)

対象者の後姿及び前姿の画像から、出願当初の段落0071、0072、0073、0074、0075に記載の方法で、10%位置幅、最大幅、rbc、rab、lbc、lab、(点ARと点FRとのy方向長さ)/(点FRと点ERとのy方向長さ)、(点ALと点FLとのy方向長さ)/(点FLと点ELとのy方向長さ)、を算出する。そして、前記10%位置幅を前記最大幅で除した値(10%位置幅/最大幅)を算出する。

以下の方法で、前記(10%位置幅/最大幅)を標準化したボリュームに変換する。事前に、頭髪専門評価者が、200名以上の対象者の髪のボリュームを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、前記ボリュームの算出方法iにより、前記(10%位置幅/最大幅)を算出し、該値が低い順に並べ、最低値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が低い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が低い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が低い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も高い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

(ボリュームの算出方法ii)

前記長さlbcを前記長さlabで除した値(lbc/lab)を算出し、l_ratioとする。前記長さrbcを前記長さrabで除した値(rbc/rab)を算出し、r_ratioとする。そして、前記l_ratioと前記r_ratioとの平均ave_ratioを算出する。

以下の方法で、前記平均ave_ratioを標準化したボリュームに変換する。事前に、頭髪専門評価者が、200名以上の対象者の髪のボリュームを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、前記ボリュームの算出方法iiにより、前記平均ave_ratioを算出し、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、該値が最も低い対象者から「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

(ボリュームの算出方法iii)

前記10%位置幅/最大幅と前記平均ave_ratioとの和を算出し、前記ボリュームの算出方法iの10%位置幅/最大幅を前記10%位置幅/最大幅と前記平均ave_ratioとの前記和に変更して、標準化したボリュームVvを得る。

(ボリュームの算出方法iv)

前記10%位置幅/最大幅と前記平均ave_ratioとを乗じた値を算出し、前記ボリュームの算出方法iの10%位置幅/最大幅を前記10%位置幅/最大幅と前記平均ave_ratioとを乗じた前記値に変更して、標準化したボリュームVvを得る。

(ボリュームの算出方法v)

前記「(点ARと点FRとのy方向長さ)/(点FRと点ERとのy方向長さ)」と、前記「(点ALと点FLとのy方向長さ)/(点FLと点ELとのy方向長さ)」との平均値を算出し、前記ボリュームの算出方法iiの平均ave_ratioを前記「(点ARと点FRとのy方向長さ)/(点FRと点ERとのy方向長さ)」と、前記「(点ALと点FLとのy方向長さ)/(点FLと点ELとのy方向長さ)」との前記平均値に変更して、標準化したボリュームVvを得る。

(色むらの算出方法i)

対象者の後姿の画像から、出願当初の段落0090に記載の方法で、x_25%v_1~x_25%v_50の線分の各区画の色相値から、線分の色相値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。

以下の方法で、前記標準偏差値の平均値を標準化した色むらに変換する。事前に、頭髪専門評価者が、200名以上の対象者の髪の色むらを目視で5段階に評価する。5の評価の人数を「5の評価者数」、4の評価の人数を「4の評価者数」、3の評価の人数を「3の評価者数」、2の評価の人数を「2の評価者数」、1の評価の人数を「1の評価者数」とする。次に、同じ対象者に対して、前記色むらの算出方法iにより、前記標準偏差値の平均値を算出する。そして、該値が高い順に並べ、最高値の対象者から「5の評価者数」の人数までの該値の範囲の場合を5、次に該値が高い「4の評価者数」の人数までの該値の範囲の場合を4、次に該値が高い「3の評価者数」の人数までの該値の範囲の場合を3、次に該値が高い「2の評価者数」の人数までの該値の範囲の場合を2、最も該値が低い「1の評価者数」の人数の対象者の該値の範囲の場合を1、と評価する。

(色むらの算出方法ii)

前記色むらの算出方法iで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、前記最大値の平均値から前記最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法iii)

前記色むらの算出方法iで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法iv)

前記色むらの算出方法iで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法v)

対象者の後姿の画像から、出願当初の段落0095に記載の方法で、x_230v_1~x_230v_50の線分の各区画の色相値から、線分の色相値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法vの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法vi)

前記色むらの算出方法vで得られた50個の最大値の平均値及び50個の最小値の平均値を求め、前記最大値の平均値から前記最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法vii)

前記色むらの算出方法vで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法viii)

前記色むらの算出方法vで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法ix)

対象者の後姿の画像から、出願当初の段落0100に記載の方法で、y_25%s_1~y_25%s_50の線分の各区画の色相値から、線分の色相値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法ixの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法x)

前記色むらの算出方法ixで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、前記最大値の平均値から前記最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xi)

前記色むらの算出方法ixで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xii)

前記色むらの算出方法ixで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xiii)

対象者の後姿の画像から、出願当初の段落0105に記載の方法で、y_230s_1~y_230s_50の線分の各区画の色相値から、線分の色相値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xiiiの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xiv)

前記色むらの算出方法xiiiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、前記最大値の平均値から前記最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xv)

前記色むらの算出方法xiiiで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xvi)

前記色むらの算出方法xiiiで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xvii)

対象者の後姿の画像から、出願当初の段落0109に記載の方法で、x_25%v_1~x_25%v_50の線分の各区画の彩度値から、線分の彩度値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xviiの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xviii)

前記色むらの算出方法xviiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xix)

前記色むらの算出方法xviiで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xx)

前記色むらの算出方法xviiで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxi)

対象者の後姿の画像から、出願当初の段落0113に記載の方法で、x_230v_1~x_230v_50の線分の各区画の彩度値から、線分の彩度値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xxiの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxii)

前記色むらの算出方法xxiで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxiii)

前記色むらの算出方法xxiで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxiv)

前記色むらの算出方法xxiで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxv)

対象者の後姿の画像から、出願当初の段落0117に記載の方法で、y_25%s_1~y_25%s_50の線分の各区画の彩度値から、線分の彩度値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xxvの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxvi)

前記色むらの算出方法xxvで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxvii)

前記色むらの算出方法xxvで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxviii)

前記色むらの算出方法xxvで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxix)

対象者の後姿の画像から、出願当初の段落0121に記載の方法で、y_230s_1~y_230s_50の線分の各区画の彩度値から、線分の彩度値の最大値、最小値、平均値、標準偏差、中央値を求める。そして、50個の標準偏差値の平均値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記色むらの算出方法xxixの標準偏差値の平均値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxx)

前記色むらの算出方法xxixで得られた50個の最大値の平均値、及び50個の最小値の平均値を求め、最大値の平均値から最小値の平均値を引いた値を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記最大値の平均値から最小値の平均値を引いた値に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxxi)

前記色むらの算出方法xxixで得られた50個の平均値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の平均値の標準偏差に変更して、標準化した色むらVuを得る。

(色むらの算出方法xxxii)

前記色むらの算出方法xxixで得られた50個の中央値の標準偏差を求める。前記色むらの算出方法iの標準偏差値の平均値を、前記50個の中央値の標準偏差に変更して、標準化した色むらVuを得る。 - 前記対象者の髪を撮影してその画像を取得する撮像部と、

算出された前記髪年齢を画面に表示する表示部と、

を含む、請求項4に記載の髪年齢評価装置。 - 請求項4又は5に記載の髪年齢評価装置と、前記対象者に対する問診装置とを含む、ヘアケア製品又はヘアケアサービスを提案する装置。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020044700 | 2020-03-13 | ||

| JP2020044700 | 2020-03-13 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2021146189A JP2021146189A (ja) | 2021-09-27 |

| JP7560310B2 true JP7560310B2 (ja) | 2024-10-02 |

Family

ID=77850195

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020170764A Active JP7560310B2 (ja) | 2020-03-13 | 2020-10-08 | 髪年齢評価方法 |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP7560310B2 (ja) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2025150268A1 (ja) * | 2024-01-12 | 2025-07-17 | 花王株式会社 | 毛髪性状推定装置、毛髪性状推定方法、毛髪性状推定プログラム、毛髪性状推定システム、携帯端末、携帯端末用プログラムおよび記憶媒体 |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008206975A (ja) | 2007-01-30 | 2008-09-11 | Kao Corp | 毛髪の評価方法及びシステム |

| WO2019222327A1 (en) | 2018-05-17 | 2019-11-21 | The Procter & Gamble Company | Systems and methods for hair analysis |

-

2020

- 2020-10-08 JP JP2020170764A patent/JP7560310B2/ja active Active

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008206975A (ja) | 2007-01-30 | 2008-09-11 | Kao Corp | 毛髪の評価方法及びシステム |

| WO2019222327A1 (en) | 2018-05-17 | 2019-11-21 | The Procter & Gamble Company | Systems and methods for hair analysis |

Non-Patent Citations (4)

| Title |

|---|

| なぜ年齢を重ねると髪を長くできないのか?,2019年10月21日,https://www.tree-hairsalon.com/hairstyle/entry30375.html |

| 年齢の変化で髪質も変わる?髪のハリコシがなくなる原因とは,2017年06月02日,https://www.ruan.co.jp/column/usuge/cause-of-changing-hair-quality/ |

| 髪が老ける原因は? 女性も薄毛になる? 専門家が答える老け見えヘアのQ&A,2019年06月05日,https://maquia.hpplus.jp/hair/news/40555/ |

| 髪年齢を調べてみよう,2017年07月13日,https://web.archive.org/web/20170713092912/https://www.atama-bijin.jp/hair_care/basis/structure/examine_hair_age/ |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2021146189A (ja) | 2021-09-27 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6849824B2 (ja) | セルフィーを撮影するためにユーザをガイドするためのシステム及び方法 | |

| TWI514291B (zh) | 年齡估計方法 | |

| JP5290585B2 (ja) | 肌色評価方法、肌色評価装置、肌色評価プログラム、及び該プログラムが記録された記録媒体 | |

| KR101140533B1 (ko) | 이미지로부터 추정된 피부색에 기초해서 제품을 추천하는 컴퓨터 구현된 방법 | |

| US20210142477A1 (en) | Bone Age Assessment And Height Prediction Model, System Thereof And Prediction Method Thereof | |

| CN112837805A (zh) | 基于深度学习的眼睑拓扑形态特征的提取方法 | |

| JP2007252891A (ja) | 肌の美しさの目視評価値の推定方法 | |

| TWI452998B (zh) | System and method for establishing and analyzing skin parameters using digital image multi-area analysis | |

| CN117152507B (zh) | 一种牙齿健康状态检测方法、装置、设备及存储介质 | |

| CN115039130A (zh) | 视距推测方法、视距推测装置以及视距推测程序 | |

| JP7234086B2 (ja) | 生体情報取得装置およびプログラム | |

| CN119342359B (zh) | 用于宫腔镜视野优化的动态白平衡调整方法及系统 | |

| Alagha et al. | Objective grading facial paralysis severity using a dynamic 3D stereo photogrammetry imaging system | |

| JP2009082338A (ja) | エントロピーを用いた肌の鑑別方法 | |

| JP2010075354A (ja) | 毛細血管血流測定装置、毛細血管血流測定方法およびプログラム | |

| JP7560310B2 (ja) | 髪年齢評価方法 | |

| CN115429271A (zh) | 基于眼动和面部表情的孤独症谱系障碍筛查系统及方法 | |

| JP4682373B2 (ja) | 顔画像合成装置、顔画像合成方法および顔画像合成プログラム | |

| JP2007252892A (ja) | 皮膚表面の立体形状の目視評価値の推定方法 | |

| Kumari et al. | Automated process for retinal image segmentation and classification via deep learning based CNN model | |

| TWI729338B (zh) | 皮膚檢測方法及影像處理裝置 | |

| Alonso-Caneiro et al. | Use of uncertainty quantification as a surrogate for layer segmentation error in Stargardt disease retinal OCT images | |

| JP6481432B2 (ja) | 眼底画像処理装置 | |

| CN113034467B (zh) | 一种基于灰度分段及Lab颜色聚类的鲜红斑痣色卡生成方法 | |

| Doan et al. | Implementation of complete glaucoma diagnostic system using machine learning and retinal fundus image processing |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230904 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20240325 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20240409 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20240610 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20240827 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20240919 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7560310 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |