JP7298687B2 - 物体認識装置及び物体認識方法 - Google Patents

物体認識装置及び物体認識方法 Download PDFInfo

- Publication number

- JP7298687B2 JP7298687B2 JP2021525479A JP2021525479A JP7298687B2 JP 7298687 B2 JP7298687 B2 JP 7298687B2 JP 2021525479 A JP2021525479 A JP 2021525479A JP 2021525479 A JP2021525479 A JP 2021525479A JP 7298687 B2 JP7298687 B2 JP 7298687B2

- Authority

- JP

- Japan

- Prior art keywords

- dimensional

- point

- dimensional data

- image

- information

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/60—Type of objects

- G06V20/64—Three-dimensional objects

- G06V20/647—Three-dimensional objects by matching two-dimensional images to three-dimensional objects

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T11/00—2D [Two Dimensional] image generation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/74—Image or video pattern matching; Proximity measures in feature spaces

- G06V10/75—Organisation of the matching processes, e.g. simultaneous or sequential comparisons of image or video features; Coarse-fine approaches, e.g. multi-scale approaches; using context analysis; Selection of dictionaries

- G06V10/751—Comparing pixel values or logical combinations thereof, or feature values having positional relevance, e.g. template matching

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Multimedia (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Computing Systems (AREA)

- Artificial Intelligence (AREA)

- Health & Medical Sciences (AREA)

- Databases & Information Systems (AREA)

- Evolutionary Computation (AREA)

- General Health & Medical Sciences (AREA)

- Medical Informatics (AREA)

- Software Systems (AREA)

- Image Analysis (AREA)

- Length Measuring Devices By Optical Means (AREA)

- Image Processing (AREA)

Description

図1は、本発明の適用例の一つである物体認識装置による処理を模式的に示している。図1の符号10は、ステージ101上の3つの物体102a、102b、102cを斜め上方からカメラ103によって計測(撮影)する様子を示している。物体102a、102b、102cは同じ形状(円柱形)・同じサイズの物体であるが、カメラ103からの奥行き距離が物体102a、物体102b、物体102cの順で遠い。

(物体認識装置の全体構成)

図2を参照して、本発明の実施形態に係る物体認識装置について説明する。

センサユニット20は、対象物体27の光学像を撮影するためのカメラを少なくとも有する。さらに、センサユニット20は、対象物体27の3次元計測を行うために必要な構成(センサ、照明装置、投光装置など)を含んでもよい。例えば、ステレオマッチング(ステレオビジョン、ステレオカメラ方式などとも呼ばれる。)によって奥行き距離を計測する場合には、センサユニット20に複数台のカメラが設けられる。アクティブステレオの場合はさらに、対象物体27にパターン光を投射する投光装置がセンサユニット20に設けられる。空間コード化パターン投影方式により3次元計測を行う場合には、パターン光を投射する投光装置とカメラがセンサユニット20に設けられる。他にも、照度差ステレオ法、TOF(タイムオブフライト)法、位相シフト法など、対象物体27の3次元情報を取得可能な方法であればいかなる方式を用いてもよい。

画像処理装置21は、例えば、CPU(プロセッサ)、RAM(メモリ)、不揮発性記憶装置(ハードディスク、SSDなど)、入力装置、出力装置などを備えるコンピュータにより構成される。この場合、CPUが、不揮発性記憶装置に格納されたプログラムをRAMに展開し、当該プログラムを実行することによって、後述する各種の構成が実現される。ただし、画像処理装置21の構成はこれに限られず、後述する構成のうちの全部又は一部を、FPGAやASICなどの専用回路で実現してもよいし、クラウドコンピューティングや分散コンピューティングにより実現してもよい。

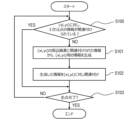

図4のフローチャートを参照して、テンプレート作成装置30によるテンプレート作成処理の一例を説明する。

図7のフローチャートを参照して、物体認識処理装置31による物体認識処理の一例を説明する。

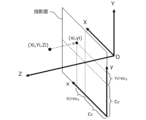

resx=d/fx

resy=d/fy

としてもよい。dは、対象物体27が存在し得る奥行き距離に応じて設定される定数である。例えば、センサユニット20から対象物体27までの奥行き距離の平均値、最小値、もしくは、最大値などを定数dに設定してもよい。なお、前述のように、(resx,resy)については、テンプレート作成時と同じ値を用いることが好ましい。(cx,cy)は投影画像の中心座標である。

xi=ROUND(Xi/resx+cx)

yi=ROUND(Yi/resy+cy)

により求まる。ROUNDは小数点以下を丸める演算子である。

以上述べた構成及び処理では、3次元データを平行投影することで生成された2次元画像をテンプレートマッチングに利用する。平行投影では、投影面から対象物体までの距離にかかわらず、対象物体は同じ大きさで投影される。それゆえ、平行投影により生成された2次元画像においては、対象物体の像は(その奥行き距離によらず)常に同じ大きさをとる。したがって、単一のサイズのテンプレートだけを用いてマッチングを行えばよいので、従来方法に比べて高速な処理が可能である。また、テンプレートの数及びデータ量を削減できるとともに、ワークメモリの必要量も少なくて済むため、実用性に優れるという利点もある。

上記実施形態は、本発明の構成例を例示的に説明するものに過ぎない。本発明は上記の具体的な形態には限定されることはなく、その技術的思想の範囲内で種々の変形が可能である。

(1) 各々が3次元情報をもつ複数の点から構成される3次元データを取得する3次元データ取得部(310)と、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成する平行投影変換部(312)と、

テンプレートマッチングにより前記2次元画像から対象物体を検出する認識処理部(313、314、315)と、

を有することを特徴とする物体認識装置(2)。

20:センサユニット

21:画像処理装置

22:ディスプレイ

27:対象物体

30:テンプレート作成装置

31:物体認識処理装置

Claims (13)

- 各々が3次元情報をもつ複数の点から構成される3次元データを取得する3次元データ取得部と、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成する平行投影変換部と、

テンプレートマッチングにより前記2次元画像から対象物体を検出する認識処理部と、を有し、

前記3次元データは、カメラで撮影された画像を用いて生成されたデータであり、

前記平行投影変換部は、前記カメラの光軸に直交するように前記投影面を設定する

ことを特徴とする物体認識装置。 - 各々が3次元情報をもつ複数の点から構成される3次元データを取得する3次元データ取得部と、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成する平行投影変換部と、

テンプレートマッチングにより前記2次元画像から対象物体を検出する認識処理部と、を有し、

前記3次元データの各点は、輝度の情報を有しており、

前記平行投影変換部は、前記3次元データにおける第1の点が前記2次元画像における第1の画素に投影された場合に、前記第1の点の輝度の情報を前記第1の画素に関連付ける

ことを特徴とする物体認識装置。 - 各々が3次元情報をもつ複数の点から構成される3次元データを取得する3次元データ取得部と、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成する平行投影変換部と、

テンプレートマッチングにより前記2次元画像から対象物体を検出する認識処理部と、

を有し、

前記3次元データの各点は、色の情報を有しており、

前記平行投影変換部は、前記3次元データにおける第1の点が前記2次元画像における第1の画素に投影された場合に、前記第1の点の色の情報を前記第1の画素に関連付けることを特徴とする物体認識装置。 - 各々が3次元情報をもつ複数の点から構成される3次元データを取得する3次元データ取得部と、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成する平行投影変換部と、

テンプレートマッチングにより前記2次元画像から対象物体を検出する認識処理部と、を有し、

前記3次元データは、カメラで撮影された画像を用いて生成されたデータであり、

前記平行投影変換部は、前記3次元データにおける複数の点が前記投影面上の同じ位置に投影される場合には、前記複数の点のうち前記カメラに最も近い点を前記2次元画像の生成に用いる

ことを特徴とする物体認識装置。 - 前記平行投影変換部は、前記3次元データにおける第1の点が前記2次元画像における第1の画素に投影された場合に、前記第1の点の3次元情報から求まるデプス情報を前記第1の画素に関連付ける

ことを特徴とする請求項1~4のうちいずれか1項に記載の物体認識装置。 - 前記平行投影変換部は、前記2次元画像における第2の画素に投影される点が存在しない場合に、前記第2の画素の周辺の画素に関連付けられた情報に基づいて、前記第2の画素に関連付ける情報を生成する

ことを特徴とする請求項2、3、または、5に記載の物体認識装置。 - 前記平行投影変換部は、前記第2の画素の周辺の画素に関連付けられた情報を補間することによって、前記第2の画素に関連付ける情報を求める

ことを特徴とする請求項6に記載の物体認識装置。 - 前記認識処理部は、前記対象物体のテンプレートとして、前記対象物体を平行投影した画像から生成されたテンプレートを用いる

ことを特徴とする請求項1~7のうちいずれか1項に記載の物体認識装置。 - 各々が3次元情報をもつ複数の点から構成される3次元データを取得するステップと、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成するステップと、

テンプレートマッチングにより前記2次元画像から対象物体を検出するステップと、

を有し、

前記3次元データは、カメラで撮影された画像を用いて生成されたデータであり、

前記平行投影では、前記カメラの光軸に直交するように前記投影面を設定する

ことを特徴とする物体認識方法。 - 各々が3次元情報をもつ複数の点から構成される3次元データを取得するステップと、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成するステップと、

テンプレートマッチングにより前記2次元画像から対象物体を検出するステップと、

を有し、

前記3次元データの各点は、輝度の情報を有しており、

前記平行投影では、前記3次元データにおける第1の点が前記2次元画像における第1の画素に投影された場合に、前記第1の点の輝度の情報を前記第1の画素に関連付ける

ことを特徴とする物体認識方法。 - 各々が3次元情報をもつ複数の点から構成される3次元データを取得するステップと、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成するステップと、

テンプレートマッチングにより前記2次元画像から対象物体を検出するステップと、

を有し、

前記3次元データの各点は、色の情報を有しており、

前記平行投影では、前記3次元データにおける第1の点が前記2次元画像における第1の画素に投影された場合に、前記第1の点の色の情報を前記第1の画素に関連付ける

ことを特徴とする物体認識方法。 - 各々が3次元情報をもつ複数の点から構成される3次元データを取得するステップと、

前記3次元データの各点をある投影面に平行投影することにより2次元画像を生成するステップと、

テンプレートマッチングにより前記2次元画像から対象物体を検出するステップと、

を有し、

前記3次元データは、カメラで撮影された画像を用いて生成されたデータであり、

前記平行投影では、前記3次元データにおける複数の点が前記投影面上の同じ位置に投影される場合には、前記複数の点のうち前記カメラに最も近い点を前記2次元画像の生成に用いる

ことを特徴とする物体認識方法。 - 請求項9~12のうちいずれか1項に記載の物体認識方法の各ステップをコンピュータに実行させるためのプログラム。

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2019/023330 WO2020250348A1 (ja) | 2019-06-12 | 2019-06-12 | 物体認識装置及び物体認識方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JPWO2020250348A1 JPWO2020250348A1 (ja) | 2020-12-17 |

| JP7298687B2 true JP7298687B2 (ja) | 2023-06-27 |

Family

ID=73781383

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021525479A Active JP7298687B2 (ja) | 2019-06-12 | 2019-06-12 | 物体認識装置及び物体認識方法 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US12094227B2 (ja) |

| EP (1) | EP3961556A4 (ja) |

| JP (1) | JP7298687B2 (ja) |

| CN (1) | CN113939852A (ja) |

| WO (1) | WO2020250348A1 (ja) |

Families Citing this family (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP7391342B2 (ja) | 2021-08-09 | 2023-12-05 | 株式会社Mujin | 計算システム、方法及び非一時的コンピュータ可読媒体 |

| TWI834495B (zh) * | 2023-02-10 | 2024-03-01 | 所羅門股份有限公司 | 物件姿態辨識方法及系統 |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008203991A (ja) | 2007-02-16 | 2008-09-04 | Mitsubishi Electric Corp | 画像処理装置 |

| CN103065130A (zh) | 2012-12-31 | 2013-04-24 | 华中科技大学 | 一种三维模糊空间目标识别方法 |

| JP2019003407A (ja) | 2017-06-15 | 2019-01-10 | オムロン株式会社 | テンプレート作成装置、物体認識処理装置、テンプレート作成方法及びプログラム |

Family Cites Families (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US4823533A (en) * | 1987-12-30 | 1989-04-25 | Marketing Displays, Inc. | Structural cladding apparatus |

| US5904653A (en) * | 1997-05-07 | 1999-05-18 | General Electric Company | Method and apparatus for three-dimensional ultrasound imaging combining intensity data with color flow velocity or power data |

| US7003134B1 (en) * | 1999-03-08 | 2006-02-21 | Vulcan Patents Llc | Three dimensional object pose estimation which employs dense depth information |

| US6556704B1 (en) * | 1999-08-25 | 2003-04-29 | Eastman Kodak Company | Method for forming a depth image from digital image data |

| GB0031016D0 (en) * | 2000-12-20 | 2001-01-31 | Alphafox Systems Ltd | Security systems |

| TW583600B (en) * | 2002-12-31 | 2004-04-11 | Ind Tech Res Inst | Method of seamless processing for merging 3D color images |

| US8737720B2 (en) * | 2003-04-30 | 2014-05-27 | Deere & Company | System and method for detecting and analyzing features in an agricultural field |

| US7436988B2 (en) * | 2004-06-03 | 2008-10-14 | Arizona Board Of Regents | 3D face authentication and recognition based on bilateral symmetry analysis |

| US7873185B2 (en) * | 2005-08-03 | 2011-01-18 | Siemens Medical Solutions Usa, Inc. | Method for detection and tracking of deformable objects |

| JP5553673B2 (ja) * | 2009-05-11 | 2014-07-16 | キヤノン株式会社 | 撮像装置および表示制御方法 |

| US9203301B2 (en) * | 2010-06-23 | 2015-12-01 | Volterra Semiconductor Corporation | Feedback for controlling the switching frequency of a voltage regulator |

| US9341678B2 (en) * | 2011-09-28 | 2016-05-17 | Alliance For Sustainable Energy, Llc | Fail-safe designs for large capacity battery systems |

| JP2013210254A (ja) * | 2012-03-30 | 2013-10-10 | Canon Inc | 三次元計測装置、三次元計測方法及び三次元計測プログラム |

| DE102014005181A1 (de) | 2014-04-03 | 2015-10-08 | Astrium Gmbh | Positions- und Lagebestimmung von Objekten |

| WO2016019347A1 (en) * | 2014-07-31 | 2016-02-04 | California Institute Of Technology | Multi modality brain mapping system (mbms) using artificial intelligence and pattern recognition |

| US9424470B1 (en) | 2014-08-22 | 2016-08-23 | Google Inc. | Systems and methods for scale invariant 3D object detection leveraging processor architecture |

-

2019

- 2019-06-12 CN CN201980096937.4A patent/CN113939852A/zh active Pending

- 2019-06-12 US US17/614,642 patent/US12094227B2/en active Active

- 2019-06-12 WO PCT/JP2019/023330 patent/WO2020250348A1/ja unknown

- 2019-06-12 EP EP19932513.5A patent/EP3961556A4/en active Pending

- 2019-06-12 JP JP2021525479A patent/JP7298687B2/ja active Active

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008203991A (ja) | 2007-02-16 | 2008-09-04 | Mitsubishi Electric Corp | 画像処理装置 |

| CN103065130A (zh) | 2012-12-31 | 2013-04-24 | 华中科技大学 | 一种三维模糊空间目标识别方法 |

| JP2019003407A (ja) | 2017-06-15 | 2019-01-10 | オムロン株式会社 | テンプレート作成装置、物体認識処理装置、テンプレート作成方法及びプログラム |

Also Published As

| Publication number | Publication date |

|---|---|

| EP3961556A4 (en) | 2022-12-07 |

| US20220230459A1 (en) | 2022-07-21 |

| CN113939852A (zh) | 2022-01-14 |

| JPWO2020250348A1 (ja) | 2020-12-17 |

| US12094227B2 (en) | 2024-09-17 |

| EP3961556A1 (en) | 2022-03-02 |

| WO2020250348A1 (ja) | 2020-12-17 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN109737874B (zh) | 基于三维视觉技术的物体尺寸测量方法及装置 | |

| US10288418B2 (en) | Information processing apparatus, information processing method, and storage medium | |

| JP6426968B2 (ja) | 情報処理装置およびその方法 | |

| JP6465789B2 (ja) | デプスカメラの内部パラメータを算出するプログラム、装置及び方法 | |

| JP4677536B1 (ja) | 3次元物体認識装置及び3次元物体認識方法 | |

| JP6363863B2 (ja) | 情報処理装置および情報処理方法 | |

| JP6554900B2 (ja) | テンプレート作成装置及びテンプレート作成方法 | |

| JP6836561B2 (ja) | 画像処理装置及び画像処理方法 | |

| WO2011115143A1 (en) | Geometric feature extracting device, geometric feature extracting method, storage medium, three-dimensional measurement apparatus, and object recognition apparatus | |

| JP6172432B2 (ja) | 被写体識別装置、被写体識別方法および被写体識別プログラム | |

| JP2021174554A (ja) | 画像深度確定方法及び生き物認識方法、回路、装置、記憶媒体 | |

| JP7298687B2 (ja) | 物体認識装置及び物体認識方法 | |

| CN112802114A (zh) | 多视觉传感器融合装置及其方法和电子设备 | |

| KR102195762B1 (ko) | 포토그래메트리를 이용한 고품질 3차원 공간 정보 획득 방법 | |

| KR101673144B1 (ko) | 부분 선형화 기반의 3차원 영상 정합 방법 | |

| JP7195785B2 (ja) | 3次元形状データを生成する装置、方法、及びプログラム | |

| JP6198104B2 (ja) | 3次元物体認識装置及び3次元物体認識方法 | |

| JP7251631B2 (ja) | テンプレート作成装置、物体認識処理装置、テンプレート作成方法、物体認識処理方法及びプログラム | |

| KR101741501B1 (ko) | 카메라와 객체 간 거리 추정 장치 및 그 방법 | |

| JP6719168B1 (ja) | 教師データとしてのデプス画像にラベルを付与するプログラム、装置及び方法 | |

| JPH0273471A (ja) | 三次元形状推定方法 | |

| JP6641313B2 (ja) | 領域抽出装置及びプログラム | |

| EP2953096B1 (en) | Information processing device, information processing method, system and carrier means | |

| JP7327484B2 (ja) | テンプレート作成装置、物体認識処理装置、テンプレート作成方法、物体認識処理方法及びプログラム | |

| WO2023132275A1 (ja) | 物体測定装置及び物体測定方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20211122 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20230117 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230210 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20230516 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20230529 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7298687 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |