特許法第30条第2項適用 ・2018年 8月7日 「REALITY」公式DLサイト(https://le.wrightflyer.net/reality/) ・2018年10月22日 「REALITY Avatar」公式DLサイト(https://le.wrightflyer.net/reality/)

以下、図面を適宜参照し、本発明の様々な実施形態を説明する。複数の図面において同一の又は類似する構成要素には同じ参照符号が付される。

図1から図5を参照して、一実施形態による動画配信システムについて説明する。図1および2は、一実施形態による動画配信システム1を示すブロック図であり、図3は、動画配信システム1で配信される動画の制作が行われるスタジオの設備を模式的に示す模式図であり、図4および図5は、動画配信システム1において記憶される情報を説明するための図である。

動画配信システム1は、クライアント装置10a~10cと、サーバ装置20と、スタジオユニット30と、ストレージ60と、を備える。クライアント装置10a~10cと、サーバ装置20と、ストレージ60とは、ネットワーク50を介して相互に通信可能に接続されている。サーバ装置20は、後述するように、キャラクタのアニメーションを含む動画を配信するように構成される。この動画に含まれるキャラクタは、仮想空間内でモーション制御されてもよい。

この動画は、サーバ装置20からクライアント装置10a~10cの各々に配信され得る。クライアント装置10aのユーザである第1視聴ユーザ、クライアント装置10bのユーザである第2視聴ユーザ、およびクライアント装置10cのユーザである第3視聴ユーザは、配信された動画を、各クライアント装置により視聴することができる。動画配信システム1は、3台よりも少ない数のクライアント装置を備えていてもよく、3台よりも多い数のクライアント装置を備えていてもよい。

クライアント装置10a~10cは、スマートフォンなどの情報処理装置である。クライアント装置10a~10cは、スマートフォン以外に、携帯電話機、タブレット端末、パーソナルコンピュータ、電子書籍リーダー、ウェアラブルコンピュータ、ゲーム用コンソール、およびこれら以外の動画を再生可能な各種情報処理装置であってもよい。クライアント装置10a~10cの各々は、コンピュータプロセッサ、メモリ、通信I/F、ディスプレイ、ジャイロセンサ等の各種センサを備えるセンサユニット、マイク等の集音装置、および各種情報を記憶するストレージを備えていてもよい。

図2に示す実施形態において、サーバ装置20は、コンピュータプロセッサ21と、通信I/F22と、ストレージ23と、を備えている。

コンピュータプロセッサ21は、ストレージ23又はそれ以外のストレージからオペレーティングシステムや様々な機能を実現する様々なプログラムをメモリにロードし、ロードしたプログラムに含まれる命令を実行する演算装置である。コンピュータプロセッサ21は、例えば、CPU、MPU、DSP、GPU、これら以外の各種演算装置、又はこれらの組み合わせである。コンピュータプロセッサ21は、ASIC、PLD、FPGA、MCU等の集積回路により実現されてもよい。図2においては、コンピュータプロセッサ21が単一の構成要素として図示されているが、コンピュータプロセッサ21は複数の物理的に別体のコンピュータプロセッサの集合であってもよい。本明細書において、コンピュータプロセッサ21によって実行されるとして説明されるプログラム又は当該プログラムに含まれる命令は、単一のコンピュータプロセッサで実行されてもよいし、複数のコンピュータプロセッサにより分散して実行されてもよい。また、コンピュータプロセッサ21によって実行されるプログラム又は当該プログラムに含まれる命令は、複数の仮想コンピュータプロセッサにより実行されてもよい。

通信I/F22は、ハードウェア、ファームウェア、又はTCP/IPドライバやPPPドライバ等の通信用ソフトウェア又はこれらの組み合わせとして実装される。サーバ装置20は、通信I/F22を介して、他の装置とデータを送受信することができる。

ストレージ23は、コンピュータプロセッサ21によりアクセスされる記憶装置である。ストレージ23は、例えば、磁気ディスク、光ディスク、半導体メモリ、又はデータを記憶可能な以外の各種記憶装置である。ストレージ23には、様々なプログラムが記憶され得る。ストレージ23に記憶され得るプログラムおよび各種データの少なくとも一部は、サーバ装置20とは物理的に別体のストレージ(例えば、ストレージ60)に格納されてもよい。

スタジオユニット30の構成要素の多くは、例えば、図3に示されているスタジオルームRに配されている。図示のように、スタジオルームRにおいては、アクターA1およびアクターA2がパフォーマンスを行っている。スタジオユニット30は、アクターA1およびアクターA2の動きおよび表情を検出し、検出した情報をサーバ装置20に出力するように構成されている。

アクターA1およびアクターA2はいずれも、スタジオユニット30に備えられる後述のセンサ群によって動きや表情がキャプチャされる対象である。アクターA1およびアクターA2は、例えば、パフォーマンスを行う人間、動物、または運動する物体である。アクターA1およびアクターA2は、例えば、自立運動可能なロボットであってもよい。スタジオルームR内のアクターの数は、1であってもよいし、3以上であってもよい。

スタジオユニット30は、アクターA1に装着される6つのモーションセンサ31a~31fと、アクターA1の左手に把持されているコントローラ33aと、アクターA1の右手に把持されているコントローラ33bと、装着具37bを介してアクターA1の頭部に取り付けられるカメラ37a(図示せず)と、を有する。スタジオユニット30はまた、アクターA2に装着される6つのモーションセンサ32a~32fと、アクターA2の左手に把持されているコントローラ34aと、アクターA2の右手に把持されているコントローラ34bと、装着具38bを介してアクターA2の頭部に取り付けられるカメラ38a(図示せず)と、を有する。装着具37bおよび装着具38bの各々には、音声データを取得するためのマイクが取り付けられてもよい。このマイクは、アクターA1およびアクターA2の発話を音声データとして取得することができる。マイクは、装着具37bおよび装着具38bを介してアクターA1およびアクターA2に装着される装着型のマイクであってもよく、スタジオルームRの床、壁、又は天井に設置される設置型のものであってもよい。スタジオユニット30は、上記の構成要素に加えて、ベースステーション35aと、ベースステーション35bと、トラッキングセンサ36aと、トラッキングセンサ36bと、ディスプレイ39と、を有する。スタジオルームRとガラス窓を隔てた隣室には、サポーターコンピュータ40が設置されている。サーバ装置20は、サポーターコンピュータ40が設置されている部屋と同じ部屋に設置されてもよい。

モーションセンサ31a~31fおよびモーションセンサ32a~32fは、ベースステーション35aおよびベースステーション35bと協働して、自らの位置および向きを検出する。一実施形態において、ベースステーション35aおよびベースステーション35bは、多軸レーザーエミッターである。ベースステーション35aは、同期用の点滅光を発した後に、例えば鉛直軸の周りでレーザー光を走査する。ベースステーション35bは、例えば水平軸の周りでレーザー光を走査する。モーションセンサ31a~31fおよびモーションセンサ32a~32fはそれぞれ、ベースステーション35aおよびベースステーション35bからの点滅光およびレーザー光の入射を検知する光センサを複数備えてもよい。モーションセンサ31a~31fおよびモーションセンサ32a~32fはそれぞれ、点滅光の入射タイミングとレーザー光の入射タイミングとの時間差、各光センサでの受光時間、各光センサが検知したレーザー光の入射角度、および必要に応じてこれら以外の情報に基づいて、自らの位置および向きを検出してもよい。モーションセンサ31a~31fおよびモーションセンサ32a~32fは、例えば、HTC CORPORATIONから提供されているVive Trackerであってもよい。ベースステーション35aおよびベースステーション35bは、例えば、HTC CORPORATIONから提供されているベースステーションであってもよい。

モーションセンサ31a~31fおよびモーションセンサ32a~32fの各々において算出された各モーションセンサの位置および向きを示す検出情報は、サーバ装置20に送信される。この検出情報は、モーションセンサ31a~31fおよびモーションセンサ32a~32fの各々からサーバ装置20に無線送信されてもよい。ベースステーション35aおよびベースステーション35bは、一定のインターバルで点滅光の発光およびレーザー光の走査を行うので、各モーションセンサの検出情報は、当該インターバルごとに更新される。

図示の実施形態において、アクターA1は、6つのモーションセンサ31a~31fを装着している。モーションセンサ31a,31b,31c,31d,31e,および31fはそれぞれ、アクターA1の左手首、右手首、左足甲、右足甲、腰、および頭頂に装着されている。モーションセンサ31a~31fは、装着具を介してアクターA1に装着されてもよい。アクターA2は、6つのモーションセンサ32a~32fを装着している。モーションセンサ32a~32fは、アクターA2に対してモーションセンサ31a~31fと同様の位置に装着され得る。図2に示されているモーションセンサ31a~31fおよびモーションセンサ32a~32fは例示である。モーションセンサ31a~31fは、アクターA1の様々な部位に装着され得るし、モーションセンサ32a~32fは、アクターA2の様々な部位に装着され得る。アクターA1およびアクターA2に装着されるモーションセンサの数は5以下であってもよいし7以上であってもよい。このように、アクターA1およびアクターA2の体の各部に装着されたモーションセンサ31a~31fおよびモーションセンサ32a~32fの位置および向きを検出することにより、アクターA1およびアクターA2の体の動きを検出することができる。

一実施形態においては、アクターA1およびアクターA2に装着される複数のモーションセンサの各々に多数の赤外LEDを搭載し、この赤外LEDからの光を、スタジオルームRの床や壁に設けられた赤外線カメラで検知することで、当該モーションセンサの各々の位置および向きを検出してもよい。赤外LEDに代えて可視光LEDを使用し、この可視光LEDからの光を可視光カメラで検出することで、当該モーションセンサの各々の位置および向きを検出してもよい。このように、アクターに装着される複数のモーションセンサの各々に発光部(例えば、赤外LEDや可視光LED)を設け、この発光部からの光をスタジオルームR内に設けられた受光部(例えば、赤外線カメラや可視光カメラ)で検出することで、当該モーションセンサの各々の位置および向きを検出してもよい。

一実施形態においては、モーションセンサ31a~31fおよびモーションセンサ32a~32fに代えて、複数の反射マーカーを用いることができる。反射マーカーは、アクターA1およびアクターA2の各々に粘着テープなどにより貼付される。このように反射マーカーが貼付されたアクターA1およびアクターA2を撮影して撮影データを生成し、この撮影データを画像処理することにより、反射マーカーの位置および向きを検出することができる。

コントローラ33aおよびコントローラ33bは、アクターA1の操作に応じたコントロール信号をサーバ装置20に出力する。同様に、コントローラ34aおよびコントローラ34bは、アクターA2の操作に応じたコントロール信号をサーバ装置20に出力する。

トラッキングセンサ36aおよびトラッキングセンサ36bは、動画に含まれる仮想空間を構築するための仮想カメラの設定情報を定めるためのトラッキング情報を生成する。トラッキングセンサ36aおよびトラッキングセンサ36bのトラッキング情報は、各々の三次元直交座標系での位置および各軸回りの角度として算出される。トラッキングセンサ36aの位置および向きは、操作者の操作に応じて変更されえる。トラッキングセンサ36aは、その位置および向きを示すトラッキング情報をトラッキング情報サーバ装置20に送信する。同様に、トラッキングセンサ36bの位置および向きは、操作者の操作に応じて設定される。トラッキングセンサ36bは、その位置および向きを示すトラッキング情報をトラッキング情報サーバ装置20に送信する。

カメラ37aは、上記のように、アクターA1の頭部に取り付けられている。例えば、カメラ37aは、アクターA1の顔を撮像できるように配置されている。カメラ37aは、アクターA1の顔を連続的に撮像し、アクターA1の顔の撮像データを取得する。同様に、カメラ38aは、アクターA2の頭部に取り付けられている。カメラ38aは、アクターA2の顔を撮像できるように配置されており、アクターA2の顔を連続的に撮像し、アクターA2の顔の撮像データを取得する。カメラ37aは、アクターA1の顔の撮像データをサーバ装置20に送信し、カメラ38aは、アクターA1の顔の撮像データをサーバ装置20に送信する。カメラ37aおよびカメラ38aは、人物の顔の奥行きを検出可能な3Dカメラであってもよい。

ディスプレイ39は、サポートコンピュータ40から受信した情報を表示するように構成される。サポートコンピュータ40からディスプレイ39に送信される情報は、例えば、テキスト情報、画像情報、およびこれら以外の各種情報を含み得る。ディスプレイ39は、アクターA1およびアクターA2によって視認可能な位置に配置される。

図示の実施形態において、サポーターコンピュータ40は、スタジオルームRの隣室に設置されている。サポーターコンピュータ40が設置されている部屋とスタジオルームRとはガラス窓によって隔てられているため、サポーターコンピュータ40のオペレータ(本明細書では「サポーター」ということがある。)は、アクターA1およびアクターA2を視認できる。図示の実施形態においては、サポーターコンピュータ40のオペレータとして、サポーターB1およびサポーターB2が在室している。

サポーターコンピュータ40は、サポーターB1およびサポーターB2の操作に応じて、スタジオユニット30の構成要素の設定を変更することができるように構成されてもよい。サポーターコンピュータ40は、例えば、ベースステーション35aおよびベースステーション35bによる走査インターバルの設定、トラッキングセンサ36aおよびトラッキングセンサ36bの位置または向きの設定、およびこれら以外の各種機器の各種設定の変更を行うことができる。サポーターB1およびサポータB2の少なくとも一方は、サポーターコンピュータ40にメッセージを入力し、当該入力されたメッセージをディスプレイ39に表示することができる。

図2に示されているスタジオユニット30の構成要素および機能は例示である。本発明に適用可能なスタジオユニット30は、図示されていない様々な構成要素を備え得る。例えば、スタジオユニット30は、プロジェクタを備えていてもよい。当該プロジェクタは、クライアント装置10aまたはそれ以外のクライアント装置に配信される動画をスクリーンSに投影することができる。

次に、一態様において、ストレージ23に記憶される情報について説明する。図示の実施形態においては、ストレージ23には、モデルデータ23a、オブジェクトデータ23b、保有リスト23c、候補リスト23d、および以外の配信動画の生成および配信に必要な様々な情報が記憶される。

モデルデータ23aは、キャラクタのアニメーションを生成するためのモデルデータである。モデルデータ23aは、3次元のアニメーションを生成するための3次元モデルデータであってもよいし、2次元のモデルデータを生成するための2次元モデルデータであってもよい。モデルデータ23aは、例えば、キャラクタの骨格を示すリグデータ(「スケルトンデータ」と呼ばれることもある。)と、キャラクタの表面の形状や質感を示す表面データと、を含む。モデルデータ23aには、互いに異なる複数のモデルデータを含むことができる。この複数のモデルデータは、互いに異なるリグデータを有していてもよいし、同じリグデータを有していてもよい。この複数のモデルデータは、互いと異なる表面データを有していてもよいし、同じ表面データを有していてもよい。図示の実施形態においては、アクターA1に対応するキャラクタオブジェクトおよびアクターA2に対応するキャラクタオブジェクトを生成するために、モデルデータ23aは、互いに異なる少なくとも2種類のモデルデータを有する。このアクターA1に対応するキャラクタオブジェクト用のモデルデータとアクターA2に対応するキャラクタオブジェクト用のモデルデータとは、例えば、同じリグデータを有するが、異なる表面データを有していてもよい。

オブジェクトデータ23bは、動画を構成する仮想空間を構築するためのアセットデータを含む。オブジェクトデータ23bは、動画を構成する仮想空間の背景を描画するためのデータ、動画に表示される各種物体を描画するためのデータ、およびこれら以外の動画に表示される各種オブジェクトを描画するためのデータが含まれる。オブジェクトデータ23aには、仮想空間におけるオブジェクトの位置を示すオブジェクト位置情報を含んでもよい。

オブジェクトデータ23bには、上記以外にも、クライアント装置10a~10cの視聴ユーザからの表示要求に基づいて動画に表示されるギフトオブジェクトが含まれ得る。ギフトオブジェクトには、エフェクトオブジェクトと、通常オブジェクトと、装飾オブジェクトと、特定オブジェクトとが含まれ得る。視聴ユーザは、所望のギフトオブジェクトを購入することができる。

エフェクトオブジェクトは、配信動画の視聴画面全体の印象に影響を与えるオブジェクトであり、例えば紙吹雪を模したオブジェクトである。紙吹雪を模したオブジェクトは、視聴画面全体に表示されてもよく、これにより表示の前後における視聴画面全体の印象を変えることができる。エフェクトオブジェクトは、キャラクタオブジェクトと重複するように表示されることもあるが、キャラクタオブジェクトの特定の部位と関連付けられた表示はなされない点で装飾オブジェクトと異なっている。

通常オブジェクトは、視聴ユーザからアクター(例えば、アクターA1またはアクターA2)へのデジタル的なギフトとなるオブジェクトであり、例えばぬいぐるみや花束を模したオブジェクトである。一態様において、通常オブジェクトは、キャラクタオブジェクトと接しないように動画の表示画面に表示される。一態様において、通常オブジェクトは、キャラクタオブジェクトと重複しないように動画の表示画面に表示される。通常オブジェクトは、仮想空間においてキャラクタオブジェクト以外のオブジェクトと重複するように表示されてもよい。通常オブジェクトは、キャラクタオブジェクトと重複するように表示されることもあるが、キャラクタオブジェクトの特定の部位と関連付けられた表示はなされない点で装飾オブジェクトと異なっている。一態様において、通常オブジェクトをキャラクタオブジェクトと重複して表示させる場合には、当該通常オブジェクトは、当該キャラクタオブジェクトの顔を含む頭部以外の部分と重複し、当該キャラクタオブジェクトの頭部とは重複しないように表示される。

装飾オブジェクトは、キャラクタオブジェクトの特定の部位と関連付けて表示画面に表示されるオブジェクトである。一態様において、キャラクタオブジェクトの特定の部位と関連付けて表示画面に表示される装飾オブジェクトは、当該キャラクタオブジェクトの当該特定の部位に接するように表示画面に表示される。一態様において、キャラクタオブジェクトの特定の部位と関連付けて表示画面に表示される装飾オブジェクトは、当該キャラクタオブジェクトの当該特定の部位の一部又は全部を覆うように表示画面に表示される。特定の部位は、3次元座標空間における位置を示す3次元位置情報で特定されてもよいし、3次元座標空間の位置情報に関連付けられていてもよい。例えばキャラクタの頭部において、特定の部位は、頭部の前方左側、前方右側、後方左側、後方右側、中央前側、中央後側、左目、右目、左耳、右耳、および髪全体という単位で定められてもよい。

装飾オブジェクトは、例えば、キャラクタオブジェクトに装着されるアクセサリー(カチューシャ、ネックレス、イヤリングなど)、衣服(Tシャツなど)、コスチューム、およびこれら以外のキャラクラオブジェクトに装着可能なオブジェクトである。装飾オブジェクトに対応するオブジェクトデータ23bには、当該装飾オブジェクトがキャラクタオブジェクトのどの部位に関連付けられるかを示す装着位置情報が含まれてもよい。ある装飾オブジェクトの装着位置情報は、当該装飾オブジェクトがキャラクタオブジェクトのどの部位に装着されるかを示すことができる。例えば、装飾オブジェクトがカチューシャである場合には、当該装飾オブジェクトの装着位置情報は、当該装飾オブジェクトがキャラクタオブジェクトの「頭部」に装着されることを示してもよい。装飾オブジェクトが装着される装着位置情報が3次元座標空間の位置として特定される場合には、当該装着位置情報は3次元座標空間における複数の位置と関連付けられてもよい。例えば「カチューシャ」を示す装飾オブジェクトが装着される位置を示す装着位置情報は、キャラクタオブジェクトの「頭部後方左側」と「頭部後方右側」の2つの部位と関連付けられてもよい。つまり、「カチューシャ」を示す装飾オブジェクトは、「頭部後方左側」および「頭部後方右側」の両方に装着されてもよい。装飾オブジェクトがTシャツである場合には、当該装飾オブジェクトの装着位置情報は、当該装飾オブジェクトがキャラクタオブジェクトの「胴部」に装着されることを示してもよい。

特定オブジェクトは、視聴ユーザからアクター(例えば、アクターA1またはアクターA2)へのデジタル的なギフトとなるオブジェクトであり、例えば図4に示されるようなサイコロなどの複数の面を有する多面体オブジェクトである。この多面体オブジェクトの面の数は特に限定されず、多面体を構成可能であればよい。

一態様において、特定オブジェクトは、キャラクタオブジェクトと接しないように動画の表示画面に表示される。一態様において、特定オブジェクトは、キャラクタオブジェクトと重複しないように動画の表示画面に表示される。特定オブジェクトは、仮想空間においてキャラクタオブジェクト以外のオブジェクトと重複するように表示されてもよい。特定オブジェクトは、キャラクタオブジェクトと重複するように表示されることもあるが、キャラクタオブジェクトの特定の部位と関連付けられた表示はなされない点で装飾オブジェクトと異なっている。一態様において、特定オブジェクトをキャラクタオブジェクトと重複して表示させる場合には、当該特定オブジェクトは、当該キャラクタオブジェクトの顔を含む頭部以外の部分と重複し、当該キャラクタオブジェクトの頭部とは重複しないように表示される。

多面体オブジェクトは、仮想空間において転がるように表示され、予め定められた所定の確率で特定された少なくとも一の面がアクターに識別可能に停止するよう表示される。

多面体オブジェクトの各面が特定される確率は、面の数に基づいて均等に分配されるものとすることができる。あるいは、所定の条件に基づいて設定された確率とすることもできる。

一の面を仮想空間の床面と接する面と反対の面(上面)としたり、仮想カメラの方向の面(例えば正面)としたりすることで、一の面をアクターに識別させることができる。アクターが図3に示すようなスクリーンSやディスプレイ39により配信動画を確認している場合には、一の面は正面とするとアクターが一の面を確認し易くなる。一方、アクターが図示しないHMD(ヘッドマウントディスプレイ)を装着して配信動画を確認している場合には、一の面は上面とするとアクターの動きが自然となり動画のクオリティが向上する。このように、特定される一の面は、アクターの状態に応じて異ならせてもよい。

また、多面体オブジェクトの各面には、アクターがリアクション可能な文字情報が表示されることができる。このリアクション可能な文字情報とは、例えば「恋バナ」「マイブーム」「笑い話」などの話題を提供するものや、「キス顔」「投げキッス」「ウインク」などの動作を求めるものとすることができる。

アクターは、特定された一の面に表示される文字情報を確認し、その文字情報に対応するリアクションを行うことで、視聴ユーザの要求に応えることができる。

また、多面体オブジェクトは、各面で異なる数字や色が表示されているものであってもよい。この場合、アクターは、上記数字や色に別途対応付けられた話題や動作に対してリアクションを行うものとする。

なお、多面体オブジェクトが停止して表示された際、動画を撮影する仮想カメラが移動することにより一の面をズーム表示するのが好ましい。かかる構成によれば、多面体オブジェクトの場所やサイズに依らず、表示された文字情報をアクターは容易に確認することができる。

また、一の面に表示された文字情報は、多面体オブジェクトとは別に動画内にテキスト表示されてもよい。このテキストは、視聴ユーザからのコメント欄に並べられてもよいし、動画内の別の場所、例えば多面体オブジェクトの周囲に表示されるものとしてもよい。かかる構成によれば、多面体オブジェクトの場所やサイズに依らず、表示された文字情報をアクターは容易に確認することができる。

特定オブジェクトを除くギフトオブジェクトの各々には、その種類に応じた表示時間が設定されていてもよい。一態様において、装飾オブジェクトの表示時間は、エフェクトオブジェクトの表示時間および通常オブジェクトの表示時間よりも長く設定されていてもよい。例えば、装飾オブジェクトの表示時間は60秒間に設定され、エフェクトオブジェクトの表示時間は5秒間に設定され、通常オブジェクトの表示時間は10秒間に設定されてもよい。

保有リスト23cは、動画の視聴ユーザが保有しているギフトオブジェクトを示すリストである。保有リスト23cの例が図5に示されている。図示のように、保有リスト23cにおいては、視聴ユーザのアカウント情報(例えば、視聴ユーザのユーザID)と対応づけて、当該視聴ユーザが保有するギフトオブジェクトを特定するオブジェクトIDが記憶されている。この視聴ユーザは、例えば、クライアント装置10a~クライアント装置10cの第1視聴ユーザ~第3視聴ユーザが含まれる。

次に、コンピュータプロセッサ21により実現される機能についてより具体的に説明する。図2に示されるように、コンピュータプロセッサ21は、配信プログラムに含まれるコンピュータ読み取り可能な命令を実行することにより、ボディモーションデータ生成部21a、フェイスモーションデータ生成部21b、アニメーション生成部21c、動画生成部21d、動画配信部21e、表示要求処理部21f、表示終了要求解析部21g、オブジェクト購入処理部21hとして機能する。コンピュータプロセッサ21により実現される機能の少なくとも一部は、動画配信システム1のコンピュータプロセッサ21以外のコンピュータプロセッサにより実現されてもよい。コンピュータプロセッサ21により実現される機能の少なくとも一部は、例えば、サポーターコンピュータ40に搭載されているコンピュータプロセッサにより実現されてもよい。

ボディモーションデータ生成部21aは、モーションセンサ31a~31fの各々の検出情報に基づいて、アクターA1の体の各部位の第1ボディモーションデータを生成し、また、モーションセンサ32a~32fの各々の検出情報に基づいて、アクターA2の体の各部位の位置および向きのデジタル表現である第2ボディモーションデータを生成する。本明細書では、第1ボディモーションデータおよび第2ボディモーションデータを総称して単に「ボディモーションデータ」と呼ぶことがある。ボディモーションデータは、時間の経過に伴って随時生成される。例えば、ボディモーションデータは、所定のサンプリング時間間隔ごとに生成されてもよい。このように、ボディモーションデータは、アクターA1およびアクターA2の体の動きを時系列的にデジタルデータとして表現することができる。図示の実施形態においては、モーションセンサ31a~31fおよびモーションセンサ32a~32fは、アクターA1およびアクターA2の各々の左右の手足、腰、および頭部に装着されているため、モーションセンサ31a~31fおよびモーションセンサ32a~32fの検出情報に基づいて、アクターA1およびアクターA2の概ね全身の位置および向きを経時的にデジタル表現することが可能である。ボディモーションデータは、例えば、モデルデータ23aに含まれるリグデータを構成する骨(ボーン)の位置および回転角度を規定することができる。

フェイスモーションデータ生成部21bは、カメラ37aの撮像データに基づいて、アクターA1の顔の動きのデジタル表現である第1フェイスモーションデータを生成し、また、カメラ38aの各々の撮像データに基づいて、アクターA2の顔の動きのデジタル表現である第2フェイスモーションデータを生成する。本明細書では、第1フェイスモーションデータおよび第2フェイスモーションデータを総称して単に「フェイスモーションデータ」と呼ぶことがある。フェイスモーションデータは、時間の経過に伴って随時生成される。例えば、フェイスモーションデータは、所定のサンプリング時間間隔ごとに生成されてもよい。このように、フェイスモーションデータは、アクターA2およびアクターA2の顔の動き(表情の変化)を時系列的にデジタル表現することができる。

アニメーション生成部21cは、ボディモーションデータ生成部21aによって生成されたボディモーションデータおよびフェイスモーションデータ生成部21bによって生成されたフェイスモーションデータを、モデルデータ23aに含まれる所定のモデルデータに適用することにより、仮想空間内で動き、また、表情が変化するキャラクタオブジェクトのアニメーションを生成するように構成される。具体的には、アニメーション生成部21cは、アクターA1に関する第1ボディモーションデータおよび第1フェイスモーションデータに基づいて、アクターA1の体および表情の動きに同期して動くキャラクタオブジェクトのアニメーションを生成し、アクターA2に関する第2ボディモーションデータおよび第2フェイスモーションデータに基づいて、アクターA2の体および表情の動きに同期して動くキャラクタオブジェクトのアニメーションを生成することができる。本明細書においては、アクターA1の動きおよび表情に基づいて生成されたキャラクタオブジェクトを「第1キャラクタオブジェクト」といい、アクターA2の動きおよび表情に基づいて生成されたキャラクタオブジェクトを「第2キャラクタオブジェクト」ということがある。

動画生成部21dは、オブジェクトデータ23bを用いて仮想空間を構築し、この仮想空間と、アクターA1に対応する第1キャラクタオブジェクトのアニメーションと、アクターA2に対応する第2キャラクタオブジェクトのアニメーションと、を含む動画を生成する。第1キャラクタオブジェクトは、トラッキングセンサ36aに対するアクターA1の位置に合致するように仮想空間内に配置され、第2キャラクタオブジェクトは、トラッキングセンサ36aに対するアクターA2の位置に合致するように仮想空間内に配置される。したがって、トラッキングセンサ36aの位置または向きを変更することにより、仮想空間内における第1キャラクタオブジェクトおよび第2キャラクタオブジェクトの位置および向きを変化させることができる。

一態様において、動画生成部21dは、トラッキングセンサ36aのトラッキング情報に基づいて仮想空間を構築する。例えば、動画生成部21dは、トラッキングセンサ36aのトラッキング情報に基づいて仮想カメラの設定情報(仮想空間内における位置、注視位置、注視方向、および画角)を定め、この仮想カメラの設定情報に基づいて仮想空間全体のうちの描画領域を定め、この仮想空間の描画領域を表示するための動画情報を生成する。

動画生成部21dは、トラッキングセンサ36aのトラッキング情報に代えて、または、トラッキングセンサ36aのトラッキング情報に加えて、トラッキングセンサ36bのトラッキング情報に基づいて、仮想空間内における第1キャラクタオブジェクトおよび第2キャラクタオブジェクトの位置および向き、並びに、仮想カメラの設定情報を定めるように構成されてもよい。

動画生成部21dは、生成した動画に、スタジオユニット30のマイクから取得したアクターA1およびアクターA2の音声を合成することができる。

以上のようにして、動画生成部21dは、アクターA1の体および表情の動きに同期して動く第1キャラクタオブジェクトのアニメーション、並びに、アクターA2の体および表情の動きに同期して動く第2キャラクタオブジェクトのアニメーションを生成し、このアニメーションにアクターA1およびアクターA2の音声が合成された配信用の動画を生成することができる。

動画配信部21eは、動画生成部21dにおいて生成された動画を配信する。この動画は、ネットワーク50を介してクライアント装置10a~クライアント装置10cおよびこれら以外のクライアント装置に配信される。受信された動画は、クライアント装置10a~クライアント装置10cにおいて再生される。

この動画は、スタジオルームR内に設置されているクライアント装置(不図示)に配信され、このクライアント装置から短焦点プロジェクタを介してスクリーンSに投影されてもよい。また、この動画は、サポーターコンピュータ40に配信されてもよい。これにより、サポーターB1およびサポーターB2は、配信されている動画の視聴画面を確認することができる。

サーバ装置20からクライアント装置10aに配信され、このクライアント装置10aにおいて再生されている動画の表示例が図6に示されている。図示のように、サーバ装置20から配信された動画の表示画像70は、クライアント装置10aのディスプレイに表示される。このクライアント装置10aに表示されている表示画像70は、仮想空間内に、アクターA1に対応するキャラクタオブジェクト71Aと、アクターA2に対応するキャラクタオブジェクト71Bと、テーブルを示すオブジェクト72と、が含まれている。オブジェクト72は、ギフトオブジェクトではなく、オブジェクトデータ23bに含まれている仮想空間を構築するためのオブジェクトの一つである。キャラクタオブジェクト71Aは、アクターA1の第1ボディモーションデータおよび第1フェイスモーションデータをモデルデータ23aに含まれているアクターA1用のモデルデータに適用することにより生成される。キャラクタオブジェクト71Aは、第1ボディモーションデータおよび第1フェイスモーションデータに基づいてモーション制御される。キャラクタオブジェクト71Bは、アクターA2の第2ボディモーションデータおよび第2フェイスモーションデータを、モデルデータ23aに含まれているアクターA2用のモデルデータに適用することにより生成される。キャラクタオブジェクト71Bは、第2ボディモーションデータおよび第2フェイスモーションデータに基づいてモーション制御される。したがって、キャラクタオブジェクト71Aは、アクターA1の体および表情の動きに同期して画面内で動くように制御され、キャラクタオブジェクト71Bは、アクターA2の体および表情の動きに同期して画面内で動くように制御される。

上記のように、サーバ装置20からの配信動画は、サポーターコンピュータ40に配信されてもよい。サポーターコンピュータ40に配信された動画は、サポーターコンピュータ40において図6と同様に表示される。サポーターB1およびサポーターB2は、サポーターコンピュータ40において再生されている動画を見て、スタジオユニット30の構成要素の設定を変更することができる。一態様において、サポーターB1およびサポーターB2は、配信中の動画においてキャラクタオブジェクト71Aおよびキャラクタオブジェクト71Bのアングルを変更したい場合には、トラッキングセンサ36aの向きの変更を指示する指示信号をサポーターコンピュータ40からトラッキングセンサ36aに送信することができる。トラッキングセンサ36aは、当該指示信号に応じて、その向きを変更することができる。例えば、トラッキングセンサ36aは、スタンドにその軸周りにアクチュエータを内蔵した回動機構を介して回動可能に取り付けられており、トラッキングセンサ36aがその向きの変更を指示する指示信号を受信すると、当該指示信号に基づいて当該回動機構のアクチュエータが駆動され、当該指示信号に応じた角度だけトラッキングセンサ36aが回動されてもよい。一態様において、サポーターB1およびサポーターB2は、トラッキングセンサ36aからのトラッキング情報に代えて、トラッキングセンサ36bからのトラッキング情報を用いるための指示をサポーターコンピュータ40からトラッキングセンサ36aおよびトラッキングセンサ36bに送信してもよい。

一態様において、サポーターB1およびサポーターB2は、サポーターコンピュータ40にて再生されている動画を見てアクターA1またはアクターA2に対する指示が必要と判断した場合には、その指示を示すメッセージをサポーターコンピュータ40に入力し、このメッセージをディスプレイ39に出力することができる。例えば、サポーターB1およびサポーターB2は、このディスプレイ39に表示されるメッセージを通じて、アクターA1またはアクターA2に対して立ち位置の変更を指示することができる。

表示要求処理部21fは、視聴ユーザのクライアント装置からギフトオブジェクトの表示要求を受け付け、当該表示要求に応じた処理を行う。各視聴ユーザは、自らのクライアント装置を操作することにより、ギフトオブジェクトの表示要求をサーバ装置20に送信することができる。例えば、第1視聴ユーザは、クライアント装置10aを操作することにより、ギフトオブジェクトの表示要求をサーバ装置20に送信することができる。ギフトオブジェクトの表示要求には、視聴ユーザのユーザIDと、表示を要求するオブジェクトを特定する識別情報(オブジェクトID)が含まれてもよい。

一態様において、表示要求処理部21fは、視聴ユーザから特定の多面体オブジェクトの表示要求を受け付けると、当該表示要求に基づいて、表示が要求された多面体オブジェクトを動画70に表示させるための処理を行う。例えば、六面体のサイコロを示す多面体オブジェクトの表示要求がなされた場合には、表示要求処理部21fは、図7に示すように、当該表示要求に基づいてサイコロを示す多面体オブジェクト74を表示画像70に表示させる。

多面体オブジェクト74の表示要求には、仮想空間内における当該多面体オブジェクト74の表示位置の範囲を指定する範囲指定パラメータが含まれてもよい。この場合、表示要求処理部21fは、仮想空間内の範囲指定パラメータによって指定された位置に多面体オブジェクト74を表示することができる。例えば、範囲指定パラメータによって、テーブルを示すオブジェクト72の上を多面体オブジェクト74の表示位置として指定することができる。視聴ユーザは、範囲指定パラメータを用いることにより、動画70に含まれているキャラクタオブジェクト71A、キャラクタオブジェクト71B、ギフトオブジェクト、およびこれら以外のオブジェクトの表示を見て、多面体オブジェクトを表示したい位置の範囲を指定することができる。

一態様において、多面体オブジェクト74は、動画の表示画像70内で移動するように表示されてもよい。例えば、通常オブジェクト74は、画面の上から下に向かって落下し、床面を転がるように表示されてもよい。多面体オブジェクト74の画面内での移動方向は任意に設定され得る。例えば、多面体オブジェクト74は、動画70の左から右へ、右から左へ、左上から左下へ、またはこれら以外の方向に移動するように表示画像70において表示されてもよい。多面体オブジェクト74は、様々な軌道上を移動することができる。例えば、多面体オブジェクト74は、直線軌道上、円軌道上、楕円軌道上、螺旋軌道上、またはこれら以外の軌道上を移動することができる。視聴ユーザは、多面体オブジェクトの表示要求に、範囲指定パラメータに加えてまたは範囲指定パラメータに代えて、多面体オブジェクト74の移動方向を指定する移動方向パラメータおよび多面体オブジェクト74が移動する軌道を指定する軌道パラメータの少なくとも一方を含めることができる。

一態様において、表示終了要求解析部21gは、アクターの動作または音声に、多面体オブジェクトに対する表示終了要求が含まれるか否かを解析し、解析の結果、アクターの動作または音声に表示終了要求が含まれると解析された場合に、多面体オブジェクトの表示を終了する。

表示終了要求が含まれる動作は、予め定められており、例えば、多面体オブジェクトを払い退けたり、蹴飛ばしたりする動作とすることができるが、これらに限られるものではない。

表示終了要求が含まれる音声は、予め定められており、例えば、「サイコロ終わり」「次のサイコロ」などといった音声があげられるが、これらに限られるものではない。

多面体オブジェクトの各面に、アクターがリアクション可能な文字情報が表示されている場合には、表示停止要求は、アクターが一の面に表示された文字情報に対応するリアクションを行った際の動作または音声に含まれるものとすることができる。

具体的には、リアクションは、文字情報の読み上げ、文字情報が意味する内容への返答、文字情報が意味する内容に関する動作の少なくとも一つを含むことができる。

例えば、多面体オブジェクトの特定された一の面に「大好き」と記載されている場合には、「大好き」と読み上げた場合に、この音声に表示終了要求が含まれるとすることができる。

例えば、多面体オブジェクトの特定された一の面に「好きな食べ物」と記載されている場合には、「ハンバーグ」と返答した場合に、この音声に表示終了要求が含まれるとすることができる。

例えば、多面体オブジェクトの特定された一の面に「投げキッス」と記載されている場合には、投げキッスの動作をした場合に、この動作に表示終了要求が含まれるとすることができる。

このように、リアクションの動作または音声に表示終了要求を含ませることで、アクターが多面体オブジェクトを消すためだけの動作または発言を行うことなく、さりげなく表示終了要求を行うことができるため、動画のクオリティを上げることができる。

表示停止要求は、アクターによる所定の第一の動作、および、当該第一の動作から所定時間内に行われた第二の動作を含むセットに含まれることができる。

例えば、手のひらをグ-にする動作から所定時間内の手のひらをパーにする動作をセットとして表示停止要求とすることができる。この時、手のひらをグーにする動作が第一の動作であり、手のひらをパーにする動作が第二の動作である。

これらの動作は予め設定しておくことができ、アクトに支障のない動作を設定しておくことで、表示停止要求をさりげなく行うことができる。

表示停止要求は、アクターによる所定の第一の音声、および、当該第一の音声から所定時間内に行われた第二の音声を含むセットに含まれることができる。

例えば、「サイコロ」という音声から所定時間内の「終わり」という音声をセットとして表示停止要求とすることができる。この時、「サイコロ」という音声が第一の音声であり、「終わり」という音声が第二の音声である。

なお、所定時間は数秒程度とするのが好ましい。

このように、表示停止要求を単一の動作や音声ではなく複数の動作や音声のセットとすることで、誤ってアクトが指示と解析されることを防止することができる。

なお、これらのセットは2つの音声や動作に限られず、3以上の音声や動作であってもよい。また、音声と動作をセットとしてもよい。

また、これらのセットは、多面体オブジェクトの各面に対応付けられることができる。

具体的には、各面毎に上記セットが異なるものとなるよう設定されることができる。例えば、「投げキッス」と書かれた面に対応するセットとしては、第一の動作を手を口に当てる動作、第二の動作を手をカメラの方に向ける動作とし、「キス顔」と書かれた面に対応するセットとしては、第一の動作を目を閉じて唇を突き出す動作とし、第二の動作を目を開けて唇を通常の位置に戻す動作といったように、各面の内容に応じたセットが対応付けられる。

なお、これらのセットは視聴者以外の者(演者やサポータ)が設定することもできるし、予め運営側が設定しておくこともできる。あるいは、記載された内容に応じて自動的にコンピュータが動作を設定しておくこともできる。

また、一の面に表示された情報に基づいて、仮想空間内に所定の効果を発生させてもよい。具体的には、特定された一の面に「紙吹雪」と表示されていた場合には、所定の効果としては、上述のエフェクトオブジェクトで説明したような、紙吹雪などの視聴画面全体の印象に影響を与える効果を発生されせることができる。

さらに、一の視聴ユーザからの表示要求に基づいて、多面体オブジェクトを、動画内の仮想空間内に表示させている場合には、一の視聴ユーザおよび他の視聴ユーザからの表示要求に基づいて、多面体オブジェクトを、動画内の仮想空間内に表示させないものとすることができる。

具体的には、一の多面体オブジェクトの表示停止要求が行われるまでは、次の多面体オブジェクトが表示されないようにすることができる。

かかる構成により、アクターによる多面体オブジェクトに対するリアクションを確実なものとし、視聴ユーザのギフティングの意欲を向上させることができる。

あるいは、一の視聴ユーザからの表示要求に基づいて、多面体オブジェクトを、動画内の仮想空間内に表示させている場合には、一の視聴ユーザおよび他の視聴ユーザに対し、多面体オブジェクトを動画内の仮想空間内に表示させるための表示を行わないものとすることができる。

具体的には、視聴ユーザの視聴アプリにおいて、多面体オブジェクトをギフティングするためのボタンを表示させない、またはグレーアウトして選択できないようにするなどの構成とすることができる。

かかる構成により、他の視聴ユーザに不必要なアクションを行わせることを防ぐことができる。また、次に多面体オブジェクトをギフティング可能なタイミングを期待感をもって待つことができるため、視聴ユーザのギフティングの意欲を向上させることができる。

別の態様として、前のサイコロが表示されている場合であっても別の多面体オブジェクトをギフティングするためのボタンを選択できるようにし、何番目に表示されるかを表示する構成としてもよい。この表示は、ギフティングするためのボタンを押したときのほか、新しいサイコロが投じられるたびにカウントダウンする構成としてもよい。

かかる構成により、自分がギフティングした多面体オブジェクトがあと何番目に表示されるかを知ることができるため、視聴ユーザは安心して動画を楽しむことができる。

一態様において、オブジェクト購入処理部21hは、動画の視聴ユーザからの要求に応じて、当該動画に関連して購入可能な複数のギフトオブジェクトの各々の購入情報を当該視聴ユーザのクライアント装置(例えば、クライアント装置10a)に送信する。各ギフトオブジェクトの購入情報には、当該ギフトオブジェクトの種類(エフェクトオブジェクト、通常オブジェクト、または装飾オブジェクト)、当該ギフトオブジェクトの画像、当該ギフトオブジェクトの価格、およびこれら以外のギフトオブジェクトの購入に必要な情報が含まれ得る。視聴ユーザは、クライアント装置10aに表示されているギフトオブジェクトの購入情報に基づいて、購入するギフトオブジェクトを選択することができる。購入対象のギフトオブジェクトの選択は、クライアント装置10aの操作により行われてもよい。購入対象のギフトオブジェクトが視聴ユーザによって選択されると、当該ギフトオブジェクトの購入要求がサーバ装置20に送信される。オブジェクト購入処理部21hは、当該購入要求に基づいて、決済処理を行う。この決済処理が完了すると、当該購入されたギフトオブジェクトは、当該視聴ユーザによって保有される。この場合、保有リスト23cに、購入した視聴ユーザのユーザIDと対応づけて、購入されたギフトオブジェクトのオブジェクトIDが記憶される。

購入可能なギフトオブジェクトは、動画ごとに異なっていてもよい。購入可能なギフトオブジェクトは、複数の動画において購入可能であってもよい。つまり、購入可能なギフトオブジェクトには、各動画に固有の固有ギフトオブジェクトと、複数の動画において購入可能な共通ギフトオブジェクトと、が含まれてもよい。例えば、紙吹雪を示すエフェクトオブジェクトは、複数の動画において購入可能な共通ギフトオブジェクトであってもよい。

一態様においては、所定の動画を視聴中に多面体オブジェクトを購入した場合、当該多面体オブジェクトを購入するための決済処理が完了したことに応じて、当該購入対象の多面体ギフトオブジェクトが当該視聴中の動画に自動的に表示されてもよい。

他の態様においては、購入対象のエフェクトオブジェクトについてオブジェクト購入処理部21hにおける決済処理が完了したことに応じて、決済完了通知がクライアント装置10aに送信され、当該クライアント装置10aにおいて、購入された多面体オブジェクトの表示要求を行うか否かを視聴ユーザに確認するための確認画面が表示されてもよい。視聴ユーザが、当該購入された多面体オブジェクトについて表示要求を行うことを選択した場合には、当該購入された多面体オブジェクトの表示を要求する表示要求が、当該視聴ユーザのクライアント装置から表示要求処理部21fに送信され、表示要求処理部21fにおいて、当該購入対象の多面体オブジェクトを動画70に表示させる処理が行われてもよい。

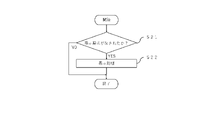

次に、図8および図9を参照して、一態様による動画配信処理について説明する。図8は、一実施形態における動画配信処理の流れを示すフロー図であり、図9は、一実施形態における多面体オブジェクトを表示する処理の流れを示すフロー図である。動画配信処理においては、スタジオルームRにおいてアクターA1およびアクターA2がパフォーマンスを行っていることが想定されている。

まず、ステップS11では、アクターA1およびアクターA2の体の動きのデジタル表現であるボディモーションデータと、アクターA1およびアクターA2の顔の動き(表情)のデジタル表現であるフェイスモーションデータと、が生成される。ボディモーションデータの生成は、例えば、上記のボディモーションデータ生成部21aで行われ、フェイスモーションデータの生成は、例えば、上記のフェイスモーションデータ生成部21bで行われる。

次に、ステップS12において、アクターA1のボディモーションデータおよびフェイスモーションデータを、アクターA1用のモデルデータに適用することにより、アクターA1の体および表情の動きに同期して動く第1キャラクタオブジェクトのアニメーションが生成される。同様に、アクターA2のボディモーションデータおよびフェイスモーションデータを、アクターA2用のモデルデータに適用することにより、アクターA2の体および表情の動きに同期して動く第2キャラクタオブジェクトのアニメーションが生成される。このアニメーションの生成は、例えば、上記のアニメーション生成部21cで行われる。

次に、ステップS13において、アクターA1に対応する第1キャラクタオブジェクトのアニメーションと、アクターA2に対応する第2キャラクタオブジェクトのアニメーションと、を含む動画を生成する。この動画には、アクターA1およびアクターA2の音声が合成されてもよい。第1キャラクタオブジェクトのアニメーションおよび第2キャラクタオブジェクトのアニメーションは、仮想空間内に配置されてもよい。この動画の生成は、例えば、上記の動画生成部21dで行われる。

次に、ステップS14に移行し、ステップS13にて生成された動画が配信される。この動画は、ネットワーク50を介してクライアント装置10a~クライアント装置10cおよびこれら以外のクライアント装置に配信される。この動画は、サポーターコンピュータ40に配信され、また、スタジオルームR内のスクリーンSに投影されてもよい。動画は、所定の配信期間にわたって継続して配信される。動画の配信期間は、例えば、30秒間、1分間、5分間、10分、30分間、60分間、120分間、およびこれら以外の任意の時間に定め得る。

次に、ステップS15に進み、動画の配信を終了させるための終了条件が成就したか否かが判定される。終了条件は、例えば、配信の終了時刻に達したこと、サポーターコンピュータ40により配信を終了するための指示がなされたこと、またはこれら以外の条件である。終了条件が成就していなければステップS11~S14の処理が繰り返し実行され、アクターA1およびアクターA2の動きに同期したアニメーションを含む動画の配信が継続される。動画について終了条件が成就していると判定された場合には、当該動画の配信処理を終了する。

次に、図9をさらに参照して、動画の配信中に行われる特定オブジェクトの表示処理について説明する。特定オブジェクトの表示処理は、図8に示した動画の配信処理と並行して行われる。

動画の配信中に、ステップS21において、通常オブジェクトの表示要求がなされたか否かが判定される。例えば、第1視聴ユーザは、自らが保有する通常オブジェクトの中から一の特定の特定オブジェクトを選択し、この選択された特定オブジェクトの表示を要求する表示要求をクライアント装置10aからサーバ装置20に対して送信することができる。上述したように、所定の特定オブジェクトの購入処理又は決済処理がなされたことに応じて、当該所定の特定オブジェクトの表示要求が生成されてもよい。

特定オブジェクトの表示要求がなされた場合には、当該表示処理はステップS22に進む。ステップS22においては、当該表示要求に基づいて、表示が要求された特定オブジェクトを配信中の動画に表示させるための処理が行われる。例えば、所定の動画の配信中に特定オブジェクト74の表示要求がなされると、図7に示されているように、当該動画の表示画面70内に表示要求がなされた特定オブジェクト74が表示される。

通特定常オブジェクトの表示要求がなされていない場合には、特定オブジェクトの表示処理は終了する。図9に示されている特定オブジェクトの表示処理は、動画の配信期間中に繰り返し行われる。

本発明の実施形態は、上述した実施形態に限定されるものではなく、その要旨を逸脱しない範囲内で様々な変更が可能である。例えば、配信される動画は、スタジオルームR以外で撮影および生成されてもよい。例えば、配信される動画を生成するための撮影は、アクターやサポーターの自宅で行われてもよい。

また、本発明の他の実施形態として、特定オブジェクトとして、多面体オブジェクトではなく、ガラポン抽選機から排出される球オブジェクトが表示され、この排出された球オブジェクトの一つ一つにアクターがリアクションすべき情報が表示され、この球オブジェクトの表示を終了する実施形態に適用することも可能である。

本明細書において説明された処理手順、特にフロー図を用いて説明された処理手順においては、その処理手順を構成する工程(ステップ)の一部を省略すること、その処理手順を構成する工程として明示されていない工程を追加すること、および/又は当該工程の順序を入れ替えることが可能であり、このような省略、追加、順序の変更がなされた処理手順も本発明の趣旨を逸脱しない限り本発明の範囲に含まれる。